JP5996092B2 - 患者のモニタリングおよび方法 - Google Patents

患者のモニタリングおよび方法 Download PDFInfo

- Publication number

- JP5996092B2 JP5996092B2 JP2015506304A JP2015506304A JP5996092B2 JP 5996092 B2 JP5996092 B2 JP 5996092B2 JP 2015506304 A JP2015506304 A JP 2015506304A JP 2015506304 A JP2015506304 A JP 2015506304A JP 5996092 B2 JP5996092 B2 JP 5996092B2

- Authority

- JP

- Japan

- Prior art keywords

- point

- patient

- identified

- grid

- vertex

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000000034 method Methods 0.000 title claims description 40

- 238000012544 monitoring process Methods 0.000 title claims description 26

- 230000009466 transformation Effects 0.000 claims description 38

- 238000003384 imaging method Methods 0.000 claims description 18

- 238000012545 processing Methods 0.000 claims description 15

- 238000006243 chemical reaction Methods 0.000 claims description 8

- 241001669679 Eleotris Species 0.000 claims description 6

- 238000001914 filtration Methods 0.000 claims description 6

- 239000013598 vector Substances 0.000 claims description 6

- 230000005484 gravity Effects 0.000 claims description 5

- 238000000844 transformation Methods 0.000 claims 1

- 230000005855 radiation Effects 0.000 description 6

- 238000001959 radiotherapy Methods 0.000 description 5

- 206010028980 Neoplasm Diseases 0.000 description 3

- 241000228740 Procrustes Species 0.000 description 3

- 238000004458 analytical method Methods 0.000 description 3

- 238000013459 approach Methods 0.000 description 2

- 238000002591 computed tomography Methods 0.000 description 2

- 238000004590 computer program Methods 0.000 description 2

- 238000001514 detection method Methods 0.000 description 2

- 238000010586 diagram Methods 0.000 description 2

- 230000001678 irradiating effect Effects 0.000 description 2

- 230000003287 optical effect Effects 0.000 description 2

- 230000000644 propagated effect Effects 0.000 description 2

- 238000004364 calculation method Methods 0.000 description 1

- 238000004891 communication Methods 0.000 description 1

- 230000000750 progressive effect Effects 0.000 description 1

- 230000000241 respiratory effect Effects 0.000 description 1

- 230000000717 retained effect Effects 0.000 description 1

- 239000004065 semiconductor Substances 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/73—Determining position or orientation of objects or cameras using feature-based methods

- G06T7/74—Determining position or orientation of objects or cameras using feature-based methods involving reference images or patches

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/73—Determining position or orientation of objects or cameras using feature-based methods

- G06T7/75—Determining position or orientation of objects or cameras using feature-based methods involving models

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61N—ELECTROTHERAPY; MAGNETOTHERAPY; RADIATION THERAPY; ULTRASOUND THERAPY

- A61N5/00—Radiation therapy

- A61N5/10—X-ray therapy; Gamma-ray therapy; Particle-irradiation therapy

- A61N5/1048—Monitoring, verifying, controlling systems and methods

- A61N5/1049—Monitoring, verifying, controlling systems and methods for verifying the position of the patient with respect to the radiation beam

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T17/00—Three dimensional [3D] modelling, e.g. data description of 3D objects

- G06T17/20—Finite element generation, e.g. wire-frame surface description, tesselation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/10—Processing, recording or transmission of stereoscopic or multi-view image signals

- H04N13/106—Processing image signals

- H04N13/111—Transformation of image signals corresponding to virtual viewpoints, e.g. spatial image interpolation

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10028—Range image; Depth image; 3D point clouds

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10072—Tomographic images

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30196—Human being; Person

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2219/00—Indexing scheme for manipulating 3D models or images for computer graphics

- G06T2219/20—Indexing scheme for editing of 3D models

- G06T2219/2004—Aligning objects, relative positioning of parts

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N2013/0074—Stereoscopic image analysis

- H04N2013/0085—Motion estimation from stereoscopic image signals

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Health & Medical Sciences (AREA)

- Biomedical Technology (AREA)

- Signal Processing (AREA)

- Multimedia (AREA)

- Pathology (AREA)

- Public Health (AREA)

- Nuclear Medicine, Radiotherapy & Molecular Imaging (AREA)

- Radiology & Medical Imaging (AREA)

- Life Sciences & Earth Sciences (AREA)

- Animal Behavior & Ethology (AREA)

- General Health & Medical Sciences (AREA)

- Software Systems (AREA)

- Veterinary Medicine (AREA)

- Geometry (AREA)

- Computer Graphics (AREA)

- Apparatus For Radiation Diagnosis (AREA)

- Image Analysis (AREA)

- Image Processing (AREA)

Description

図面に関して説明された本発明の実施例は、コンピュータ装置、および、コンピュータ装置において実行されるプロセスを含んでいるが、本発明は、また、コンピュータプログラム、特には、本発明を実施するように適合され、キャリア上または中に在るコンピュータプログラムまで広がっている。プログラムは、ソース、または、オブジェクトコードの形式、もしくは、本発明に従ったプロセスの実施における使用に好適な他の形式であってよい。キャリアは、プログラムを運搬することができるあらゆるエンティティまたはデバイスであってよい。

Claims (18)

- 患者の位置とターゲットオブジェクトをマッチングするための厳密な変換を決定するようにコンピュータで実施される方法であって、前記ターゲットオブジェクトは、三角形状の3次元ワイヤーメッシュに係る一式の頂点の3次元位置と頂点間の接続を示す接続性とを特定するデータを含んでいるターゲットモデルによって表されており、前記方法は:

患者の立体画像を取得するステップと;

画像化された患者の表面上の複数のポイントに係る3次元位置を特定するために、コンピュータを利用して前記立体画像を処理するステップと;

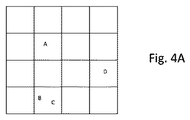

3次元空間におけるポイントの標準グリッドについて、グリッドポイントに最も近いターゲットモデルの頂点を特定する最も近い頂点アレイを:

a)前記ターゲットモデルにおけるそれぞれの頂点に対して、前記頂点の場所を含む立方体の角に対応する標準3次元グリッドのグリッド部分を特定するために、前記ターゲットモデルの頂点に関連付けされた前記3次元座標を使用すること;前記頂点と前記特定されたグリッドポイントに対応する位置との間の距離を決定すること;および、前記特定されたグリッドポイントが、前記ターゲットモデルにおける別の頂点により近いことを示すデータに関連付けされてるか否かを判断すること、かつ、該当しない場合は、前記グリッドポイントを前記頂点および前記頂点と前記グリッドポイントとの間の距離を特定するデータと関連付けること;および、

b)前記標準3次元グリッドの軸に対応しているそれぞれの方向において、前記標準3次元グリッドを横切ることによって、前記グリッドの至る所で頂点および距離データをプロパゲーションすること;現在のグリッドポイントに対して、前記グリッドを横切るときに、横切る方向におけるグリッド上の近隣のグリッドポイントと関連付けされた頂点が、現在のグリッドポイントに関連付けされた位置に対して、以前に前記現在のグリッドポイントに関連付けされた何れの頂点よりも近いか否かを判断すること、かつ、該当する場合は、前記現在のグリッドポイントを前記近隣のグリッドポイントと関連付けされた頂点を特定しているデータと関連付けること;

によって生成するステップと;

画像化された患者の表面上のそれぞれのポイントに対して、画像化された患者の前記表面上のポイントに最も近い前記標準3次元グリッドのグリッドポイントを8個まで特定するステップと;

画像化された患者の前記表面上の前記それぞれのポイントに最も近い前記ターゲットモデル表面における三角形を特定するために、前記最も近い頂点アレイを使用することによって前記特定されたグリッドポイントに関連付けされた前記頂点を利用するステップと;

前記画像化された患者の前記表面上でポイントとして特定された一式の3次元位置を選択するために前記コンピュータを利用するステップであり、前記ポイントは、前記特定された3次元位置と前記位置に最も近いものとして特定された前記ターゲットモデルの頂点との間の決定された距離に基づいて、患者の前記位置をターゲットオブジェクトの前記位置にマッチングするための厳密な変換を決定するために利用されるべきポイントである、ステップと;

前記特定された3次元位置と前記ポイントに最も近いものとして特定された前記ターゲットモデル表面の三角形を含んでいる平面との間のポイントから平面への距離を最小化する厳密な変換を算出するために前記コンピュータを利用するステップと、

を含む、コンピュータで実施される方法。 - 前記画像化された患者の表面上で特定された一式の3次元位置を選択すること、および、前記特定された一式の3次元位置と前記ポイントに最も近いものとして特定された前記ターゲットモデル表面の三角形を含んでいる前記平面との間のポイントから平面への距離を最小化する厳密な変換を算出することは、多くの反復を含んでおり:

現在の反復に対して利用されるべき閾値を決定するステップと;

前記特定された3次元位置と前記閾値を用いて前記位置に最も近いものとして特定された前記ターゲットモデルの頂点との間の距離の比較に基づいて、前記患者の前記位置を前記ターゲットオブジェクトの前記位置にマッチングするための厳密な変換を決定するために利用されるべきポイントとして、前記画像化された患者の前記表面上の特定された一式の3次元位置を選択するステップと;

前記特定された3次元位置と前記ポイントに最も近いものとして特定された前記ターゲットモデル表面の三角形を含んでいる平面との間のポイントから平面への距離を最小化する厳密な変換を算出するステップと、が反復され、

患者の前記位置をターゲットオブジェクトの前記位置にマッチングするための前記厳密な変換は、それぞれの反復において決定さえた前記変換の合計を含んでいる、

請求項1に記載のコンピュータで実施される方法。 - 現在の反復に対して利用されるべき閾値を決定するステップは:

最初の反復に対する最初の閾値を設定する段階と;

前記特定された3次元位置と前記位置に最も近いものとして特定された前記ターゲットモデルの頂点との間の平均距離に基づいて、後続の反復において使用するための閾値を決定する段階と、

を含む、請求項2に記載のコンピュータで実施される方法。 - 前記患者の前記位置を前記ターゲットオブジェクトの前記位置にマッチングするための厳密な変換を決定するために利用されるべきポイントとして、画像化された患者の前記表面上の特定された一式の3次元位置を選択することは、さらに:

ポイントにおける前記患者の相対的な方向とポイントに最も近いものであるとして特定された前記ターゲットモデル表面における三角形の方法とに基づいて、厳密な変換を算出するために利用されるべき前記画像化された患者の前記表面上の選択された一式の特定された3次元位置をフィルタリングすること、を含み、

前記ポイントにおける前記患者の前記方向は、前記患者のモデルを生成すること、および、前記ポイントを含む前記生成されたモデルにおける三角形の平均法線ベクトルを計算すること、によって決定される、

請求項2に記載のコンピュータで実施される方法。 - 患者の前記位置をターゲットオブジェクトの前記位置にマッチングするための厳密な変換を決定するために利用されるべきポイントとして、画像化された患者の前記表面上の特定された一式の3次元位置を選択することは、さらに:

厳密な変換を算出する以前に同一の場所の投射するように判断されたあらゆるポイントを除去するために、厳密な変換を算出するために利用されるべき前記画像化された患者の前記表面上の前記選択され特定された3次元位置をフィルタリングすること、を含み、

厳密な変換は、フィルタリングされた前記特定された一式の3次元位置と、前記ポイントに最も近いものとして特定された前記ターゲットモデル表面の前記三角形を含んでいる平面との間の、ポイントから平面への距離を最小化する、

請求項4に記載のコンピュータで実施される方法。 - 前記画像化された患者の前記表面上の前記特定されたポイントと、前記ポイントに最も近いものとして特定された前記ターゲットモデル表面の前記三角形を含んでいる平面との間の、ポイントから平面への距離を最小化する厳密な変換を算出することは:

前記ポイントのそれぞれに対して、前記ポイントに最も近いものとして特定された前記ターゲットモデル表面の前記三角形を含んでいる前記平面への前記ポイントの投射を決定すること;

患者の前記表面上の場所であるものとして特定されたポイントの重心を、前記ポイントに最も近いものとして特定された前記ターゲットモデル表面の前記三角形を含んでいる特定された平面への前記ポイントの投射の重心と揃える移動を決定すること;

前記移動が適用された後で、前記画像化された患者の前記表面上の前記特定されたポイントと、前記ポイントに最も近いものとして特定された前記ターゲットモデル表面の前記三角形を含んでいる前記平面との間の、ポイントから平面への距離を最小化する回転を決定すること、

を含む、請求項1に記載のコンピュータで実施される方法。 - 前記画像化された患者の前記表面上のそれぞれのポイントに最も近い前記ターゲットモデル表面における三角形を特定するために、前記最も近い頂点アレイを使用することによって3次元グリッドの前記特定されたグリッドポイントに関連付けされた前記頂点を利用することは:

現在処理されている患者の前記表面上の前記ポイントに最も近い前記モデル表面の頂点であり、前記3次元グリッドの前記特定されたグリッドポイントに関連付けされた頂点を決定すること;

前記決定された最も近い頂点に直接的に接続された何れかの頂点が、現在処理されている前記画像化された患者の前記表面上の前記ポイントの前記3次元座標に、より近いかを判断すること、

前記直接的に接続された何れかの頂点が、現在処理されている前記画像化された患者の前記表面上の前記ポイントの前記3次元座標に、より近いと判断された場合、前記頂点に接続された何れかの頂点が、現在処理されている前記画像化された患者の前記表面上の前記ポイントの前記3次元座標に、より近いか否かを特定すること;

前記直接的に接続された頂点の何れも、現在処理されている前記画像化された患者の前記表面上の前記ポイントの前記3次元座標に、より近いと判断されない場合に、現在処理されている患者の前記表面上の前記ポイントに最も近い前記ターゲット表面における三角形を特定するために、最も近い前記頂点を含んでいる前記ターゲットモデルにおけるそれぞれの三角形に対して、前記三角形を含んでいる平面と前記画像化された患者の前記表面上のポイントの前記3次元位置との間の距離を決定すること、

を含む、請求項1に記載のコンピュータで実施される方法。 - 患者モニタリングシステムであって:

画像化された患者の表面上の複数のポイントの3次元位置を特定するために、患者の立体画像を処理するように動作可能である、3次元位置決定モジュールと;

三角形状の3次元ワイヤーメッシュモデルに係る一式の頂点の3次元位置と頂点間の接続を示す接続性とを特定するデータを含むターゲットモデルを保管するように動作可能である、ターゲットモデルストアと;

前記ターゲットモデルストアの中に保管されたターゲットモデル表面において、前記3次元位置決定モジュールによって特定されたポイントに最も近い三角形を特定するように、かつ、選択された一式の特定されたポイントと、前記ポイントに最も近いものとして特定されたターゲットモデル表面に係る三角計を含んでいる平面との間の、ポイントから平面への距離を最小化する厳密な変換を算出するように動作可能である、マッチングモジュールであり、前記厳密な変換を決定するために利用される選択された一式のポイントは、前記特定された3次元位置と、前記位置に最も近いものとして特定されたターゲットモデルの頂点との間の決定された距離に基づいて選択される、マッチングモジュールと;

標準グリッド上のポイントについて、前記グリッドポイントに最も近い、前記ターゲットモデルストアに保管されたターゲットモデルの前記頂点を特定するデータを保管するように動作可能である、最も近い頂点アレイと、を含み、

前記マッチングモジュールは、3次元空間におけるポイントの標準グリッドについて、前記グリッドポイントに最も近いターゲットモデルの頂点を特定するデータを:

a)前記ターゲットモデルにおけるそれぞれの頂点に対して、前記頂点の場所を含む立方体の角に対応する標準3次元グリッドのグリッド部分を特定するために、前記ターゲットモデルの頂点に関連付けされた前記3次元座標を使用すること;前記頂点と前記特定されたグリッドポイントに対応する位置との間の距離を決定すること;および、前記特定されたグリッドポイントが、前記ターゲットモデルにおける別の頂点により近いことを示すデータに関連付けされてるか否かを判断すること、かつ、該当しない場合は、前記グリッドポイントを前記頂点および前記頂点と前記グリッドポイントとの間の距離を特定するデータと関連付けること;および、

b)前記標準3次元グリッドの軸に対応しているそれぞれの方向において、前記標準3次元グリッドを横切ることによって、前記グリッドの至る所で頂点および距離データをプロパゲーションすること;現在のグリッドポイントに対して、前記グリッドを横切るときに、横切る方向におけるグリッド上の近隣のグリッドポイントと関連付けされた頂点が、現在のグリッドポイントに関連付けされた位置に対して、以前に前記現在のグリッドポイントに関連付けされた何れの頂点よりも近いか否かを判断すること、かつ、該当する場合は、前記現在のグリッドポイントを前記近隣のグリッドポイントと関連付けされた頂点を特定しているデータと関連付けること;

によって生成し、

前記マッチングモジュールは、前記3次元位置決定モジュールによって特定されたポイントに最も近い、前記ターゲットモデルストアに保管されたターゲットモデル表面における前記三角形を:

画像化された患者の表面上のそれぞれのポイントに対して、画像化された患者の前記表面上のポイントに最も近い前記標準3次元グリッドのグリッドポイントを8個まで特定すること;および

画像化された患者の前記表面上の前記それぞれのポイントに最も近い前記ターゲットモデル表面における三角形を特定するために、前記最も近い頂点アレイを使用することによって前記特定されたグリッドポイントに関連付けされた前記頂点を利用すること;

によって特定するように、動作可能である、

患者モニタリングシステム。 - 前記マッチングモジュールは、厳密な変換を算出するために利用されるべき前記画像化された患者の前記表面上の特定された3次元位置を、

ポイントと、前記ポイントに最も近いものとして特定された前記ターゲットモデルの頂点との間の距離を決定すること、かつ、

厳密な変換を算出するために利用されるべきポイントとして、閾値より小さい距離と関連付けされたポイントを選択すること、

によって選択するように動作可能である、

請求項8に記載の患者モニタリングシステム。 - 前記閾値は、前記特定された3次元位置と、前記ターゲットモデルにおいて特定された最も近い頂点との決定された距離の平均に基づいて、決定された閾値を含んでいる、

請求項9に記載の患者モニタリングシステム。 - 前記マッチングモジュールは、厳密な変換を算出するために利用されるべき前記画像化された患者の前記表面上の選択された一式の特定された3次元位置をフィルタリングするように動作可能であり、

厳密な変換は、ポイントにおける患者の相対的な方向と、前記ポイントに最も近いものとして特定された前記ターゲットモデルにおける三角形の方向とに基づいて、ポイントから平面への距離を最小化し、

前記ポイントにおける前記患者の前記方向は、前記患者のモデルを生成すること、および、前記ポイントを含む前記生成されたモデルにおける三角形の平均法線ベクトルを計算すること、によって決定される、

請求項9に記載の患者モニタリングシステム。 - 前記マッチングモジュールは、ポイントから平面への距離を最小化する厳密な変換を算出するために利用されるべき前記画像化された患者の前記表面上の前記選択され特定された3次元位置をフィルタリングするように動作可能であり、

前記フィルタリングされ特定された一式の3次元位置と、前記ポイントに最も近いものとして特定されたターゲットモデル表面に係る三角計を含んでいる平面との間の、ポイントから平面への距離を最小化する厳密な変換を算出する以前に、同一の場所の投射するように判断されたあらゆるポイントを除去する、

請求項11に記載の患者モニタリングシステム。 - 前記マッチングモジュールは、ポイントから平面への距離を最小化する厳密な変換を、

ポイントに対して、前記ポイントに最も近いものとして特定された前記ターゲットモデル表面の前記三角形を含んでいる前記平面への前記ポイントの投射を決定すること;

患者の前記表面上の場所であるものとして特定されたポイントの重心を、前記ポイントに最も近いものとして特定された前記ターゲットモデル表面の前記三角形を含んでいる特定された平面への前記ポイントの投射の重心と揃える移動を決定すること;かつ、

前記移動が適用された後で、前記画像化された患者の前記表面上の前記特定されたポイントと、前記ポイントに最も近いものとして特定された前記ターゲットモデル表面の前記三角形を含んでいる前記平面との間の、ポイントから平面への距離を最小化する回転を決定すること、

によって算出するように動作可能である、

請求項8に記載の患者モニタリングシステム。 - 前記マッチングモジュールは、前記画像化された患者の前記表面上のそれぞれのポイントに最も近い前記ターゲットモデル表面における三角形を特定するために、

現在処理されている患者の前記表面上の前記ポイントに最も近い前記モデル表面の頂点であり、前記最も近い頂点アレイにおけるデータによって前記3次元グリッドの前記特定されたグリッドポイントに関連付けされた頂点を決定すること;

前記決定された最も近い頂点に直接的に接続された何れかの頂点が、現在処理されている前記画像化された患者の前記表面上の前記ポイントの前記3次元座標に、より近いかを判断すること、

前記直接的に接続された何れかの頂点が、現在処理されている前記画像化された患者の前記表面上の前記ポイントの前記3次元座標に、より近いと判断された場合、前記頂点に接続された何れかの頂点が、現在処理されている画像化された患者の前記表面上の前記ポイントの前記3次元座標に、より近いか否かを特定すること;

前記直接的に接続された頂点の何れも、現在処理されている前記画像化された患者の前記表面上の前記ポイントの前記3次元座標に、より近いと判断されない場合に、現在処理されている前記患者の前記表面上の前記ポイントに最も近い前記ターゲットモデル表面における三角形を特定するために、最も近い前記頂点を含んでいる前記ターゲットモデルにおけるそれぞれの三角形に対して、前記三角形を含んでいる平面と前記画像化された患者の前記表面上のポイントの前記3次元位置との間の距離を決定すること、

によって、前記最も近い頂点アレイを使用することによって3次元グリッドの前記特定されたグリッドポイントに関連付けされた前記頂点を利用するように動作可能である、

請求項8に記載の患者モニタリングシステム。 - 前記患者モニタリングシステムは、さらに:

患者の立体画像を取得するように動作可能である立体視カメラ、を含み、

前記3次元位置決定モジュールは、前記立体視カメラによって取得された立体画像を処理するように構成されている、

請求項8に記載の患者モニタリングシステム。 - 前記患者モニタリングシステムは、さらに:

メカニカル寝いす、を含み、

前記立体視カメラは前記寝いす上の患者の立体画像を取得するように動作可能であり、

前記マッチングモジュールは、画像化された患者の表面上の前記特定されたポイントと前記ポイントに最も近いものとして特定されたターゲットモデル表面に係る三角計を含んでいる平面との間のポイントから平面への距離を最小化する、算出された厳密な変換に基づいて、前記寝いすに画像化された患者を揃えさせるためにインストラクションを生成するように動作可能である、

請求項15に記載の患者モニタリングシステム。 - 前記患者モニタリングシステムは、さらに:

治療装置、を含み、

前記治療装置は、画像化された患者の表面上の前記特定されたポイントと前記ポイントに最も近いものとして特定されたターゲットモデル表面の三角形を含んでいる前記平面との間のポイントから平面への距離を最小化する、算出された厳密な変換が、患者の位置が閾値量以上に外れた位置に居ることを示していると、前記マッチングモジュールが判断する場合に、動作を停止するように構成されている、

請求項8に記載の患者モニタリングシステム。 - コンピュータで実施可能なインストラクションを保管しているコンピュータで読取り可能な媒体であって、プログラム可能なコンピュータによって実施されると、前記コンピュータに、患者の位置とターゲットオブジェクトをマッチングするための厳密な変換を決定させ、前記ターゲットオブジェクトは、三角形状の3次元ワイヤーメッシュに係る一式の頂点の3次元位置と頂点間の接続を示す接続性とを特定するデータを含んでいるターゲットモデルによって表されており、前記インストラクションは:

患者の立体画像を取得するステップと;

画像化された患者の表面上の複数のポイントに係る3次元位置を特定するために、コンピュータを利用して前記立体画像を処理するステップと;

3次元空間におけるポイントの標準グリッドについて、グリッドポイントに最も近いターゲットモデルの頂点を特定する最も近い頂点アレイを:

a)前記ターゲットモデルにおけるそれぞれの頂点に対して、前記頂点の場所を含む立方体の角に対応する標準3次元グリッドのグリッド部分を特定するために、前記ターゲットモデルの頂点に関連付けされた前記3次元座標を使用すること;前記頂点と前記特定されたグリッドポイントに対応する位置との間の距離を決定すること;および、前記特定されたグリッドポイントが、前記ターゲットモデルにおける別の頂点により近いことを示すデータに関連付けされてるか否かを判断すること、かつ、該当しない場合は、前記グリッドポイントを前記頂点および前記頂点と前記グリッドポイントとの間の距離を特定するデータと関連付けること;および、

b)前記標準3次元グリッドの軸に対応しているそれぞれの方向において、前記標準3次元グリッドを横切ることによって、前記グリッドの至る所で頂点および距離データをプロパゲーションすること;現在のグリッドポイントに対して、前記グリッドを横切るときに、横切る方向におけるグリッド上の近隣のグリッドポイントと関連付けされた頂点が、現在のグリッドポイントに関連付けされた位置に対して、以前に前記現在のグリッドポイントに関連付けされた何れの頂点よりも近いか否かを判断すること、かつ、該当する場合は、前記現在のグリッドポイントを前記近隣のグリッドポイントと関連付けされた頂点を特定しているデータと関連付けること;

によって生成するステップと;

画像化された患者の表面上のそれぞれのポイントに対して、画像化された患者の前記表面上のポイントに最も近い前記標準3次元グリッドのグリッドポイントを8個まで特定するステップと;

画像化された患者の前記表面上の前記それぞれのポイントに最も近い前記ターゲットモデル表面における三角形を特定するために、前記最も近い頂点アレイを使用することによって前記特定されたグリッドポイントに関連付けされた前記頂点を利用するステップと;

前記画像化された患者の前記表面上でポイントとして特定された一式の3次元位置を選択するステップであり、前記ポイントは、前記特定された3次元位置と前記位置に最も近いものとして特定された前記ターゲットモデルの頂点との間の決定された距離に基づいて、患者の前記位置をターゲットオブジェクトの前記位置にマッチングするための厳密な変換を決定するために利用されるべきポイントである、ステップと;

前記特定された3次元位置と前記ポイントに最も近いものとして特定された前記ターゲットモデル表面の三角形を含んでいる平面との間のポイントから平面への距離を最小化する厳密な変換を算出するステップと、

を含む、コンピュータで読取り可能な媒体。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| GB1206915.9A GB2501308A (en) | 2012-04-19 | 2012-04-19 | Matching the position of an object to a target model using rigid transformations |

| GB1206915.9 | 2012-04-19 | ||

| PCT/GB2013/050976 WO2013156775A1 (en) | 2012-04-19 | 2013-04-17 | Patient monitor and method |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2015515068A JP2015515068A (ja) | 2015-05-21 |

| JP2015515068A5 JP2015515068A5 (ja) | 2016-06-16 |

| JP5996092B2 true JP5996092B2 (ja) | 2016-09-21 |

Family

ID=46261590

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2015506304A Active JP5996092B2 (ja) | 2012-04-19 | 2013-04-17 | 患者のモニタリングおよび方法 |

Country Status (6)

| Country | Link |

|---|---|

| US (1) | US9420254B2 (ja) |

| EP (1) | EP2839432B1 (ja) |

| JP (1) | JP5996092B2 (ja) |

| CN (1) | CN104246827B (ja) |

| GB (1) | GB2501308A (ja) |

| WO (1) | WO2013156775A1 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| DE102015111291A1 (de) | 2015-06-12 | 2016-12-15 | Institut Für Luft- Und Kältetechnik Gemeinnützige Gmbh | Strömungsmaschine mit gegenläufigen Schaufelrädern |

Families Citing this family (11)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP6049882B2 (ja) * | 2013-07-18 | 2016-12-21 | 三菱電機株式会社 | 目標類識別装置 |

| US9530226B2 (en) * | 2014-02-18 | 2016-12-27 | Par Technology Corporation | Systems and methods for optimizing N dimensional volume data for transmission |

| JP2015230982A (ja) * | 2014-06-05 | 2015-12-21 | 株式会社東芝 | 対象物分布解析装置および対象物分布解析方法 |

| US9987504B2 (en) | 2015-04-02 | 2018-06-05 | Varian Medical Systems International Ag | Portal dosimetry systems, devices, and methods |

| US10272265B2 (en) | 2016-04-01 | 2019-04-30 | Varian Medical Systems International Ag | Collision avoidance for radiation therapy |

| US9789338B1 (en) * | 2016-04-13 | 2017-10-17 | Vision Rt Ltd. | Patient monitoring system |

| CN110997066B (zh) * | 2017-06-21 | 2022-08-05 | 香港理工大学 | 用于超声脊髓刺激的设备和方法 |

| GB2565306A (en) * | 2017-08-08 | 2019-02-13 | Vision Rt Ltd | Method and apparatus for measuring the accuracy of models generated by a patient monitoring system |

| JP7350519B2 (ja) | 2019-05-29 | 2023-09-26 | キヤノン株式会社 | 放射線撮影システム、放射線撮影制御装置及びその制御方法、並びに、プログラム |

| US10881353B2 (en) * | 2019-06-03 | 2021-01-05 | General Electric Company | Machine-guided imaging techniques |

| KR102235858B1 (ko) * | 2020-04-09 | 2021-04-02 | 에스케이씨 주식회사 | 탄화규소 잉곳의 제조방법 및 탄화규소 잉곳 제조용 시스템 |

Family Cites Families (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US6362820B1 (en) * | 1999-06-24 | 2002-03-26 | Microsoft Corporation | Quadric metric for simplifying meshes with appearance attributes |

| GB2355789A (en) * | 1999-10-26 | 2001-05-02 | Tricorder Technology Plc | Surface registration |

| GB2390792B (en) * | 2002-07-08 | 2005-08-31 | Vision Rt Ltd | Image processing system for use with a patient positioning device |

| US20050096515A1 (en) | 2003-10-23 | 2005-05-05 | Geng Z. J. | Three-dimensional surface image guided adaptive therapy system |

| GB2418495B (en) * | 2004-09-24 | 2010-04-28 | Vision Rt Ltd | Image processing system for use with a patient positioning device |

| US8591225B2 (en) * | 2008-12-12 | 2013-11-26 | Align Technology, Inc. | Tooth movement measurement by automatic impression matching |

| JP5110356B2 (ja) | 2007-07-10 | 2012-12-26 | オムロン株式会社 | 検出装置および方法、並びに、プログラム |

| US8108189B2 (en) * | 2008-03-25 | 2012-01-31 | Align Technologies, Inc. | Reconstruction of non-visible part of tooth |

| WO2010143400A1 (ja) * | 2009-06-10 | 2010-12-16 | 三菱電機株式会社 | 画像照合装置及びこれを用いた患者位置決め装置 |

-

2012

- 2012-04-19 GB GB1206915.9A patent/GB2501308A/en not_active Withdrawn

-

2013

- 2013-04-17 WO PCT/GB2013/050976 patent/WO2013156775A1/en active Application Filing

- 2013-04-17 CN CN201380020931.1A patent/CN104246827B/zh active Active

- 2013-04-17 EP EP13718213.5A patent/EP2839432B1/en active Active

- 2013-04-17 JP JP2015506304A patent/JP5996092B2/ja active Active

- 2013-04-17 US US14/394,704 patent/US9420254B2/en active Active

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| DE102015111291A1 (de) | 2015-06-12 | 2016-12-15 | Institut Für Luft- Und Kältetechnik Gemeinnützige Gmbh | Strömungsmaschine mit gegenläufigen Schaufelrädern |

Also Published As

| Publication number | Publication date |

|---|---|

| EP2839432A1 (en) | 2015-02-25 |

| US9420254B2 (en) | 2016-08-16 |

| WO2013156775A1 (en) | 2013-10-24 |

| GB201206915D0 (en) | 2012-06-06 |

| JP2015515068A (ja) | 2015-05-21 |

| GB2501308A (en) | 2013-10-23 |

| EP2839432B1 (en) | 2016-07-20 |

| CN104246827B (zh) | 2016-12-14 |

| US20150071527A1 (en) | 2015-03-12 |

| CN104246827A (zh) | 2014-12-24 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5996092B2 (ja) | 患者のモニタリングおよび方法 | |

| US11605185B2 (en) | System and method for generating partial surface from volumetric data for registration to surface topology image data | |

| US10861193B2 (en) | Method of calibrating a patient monitoring system for use with a radiotherapy treatment apparatus | |

| EP3175426B1 (en) | Online patient reconstruction and tracking for patient setup in radiation therapy using an iterative closest point algorithm | |

| US11822340B2 (en) | Method and system for obstacle avoidance in robot path planning using depth sensors | |

| US11348216B2 (en) | Technologies for determining the accuracy of three-dimensional models for use in an orthopaedic surgical procedure | |

| EP3285639B1 (en) | Monitoring a patient's position using a planning image and subsequent thermal imaging | |

| JP2015515068A5 (ja) | ||

| US20160242745A1 (en) | Systems, Methods and Computer Readable Storage Media Storing Instructions for Image-Guided Interventions Based on Patient-Specific Models | |

| Lee et al. | Accuracy evaluation of surface registration algorithm using normal distribution transform in stereotactic body radiotherapy/radiosurgery: A phantom study | |

| JP2010237941A (ja) | マスク画像生成装置、3次元物体モデル情報生成装置及びプログラム | |

| JP2012191986A (ja) | 位置決め装置 | |

| CN117984310A (zh) | 医疗机器人的避障方法、装置、系统和医疗机器人 | |

| JP4122663B2 (ja) | 物体の三次元形状モデル作製装置 | |

| Chiang et al. | A Model Deformation Approach for 3D Reconstruction | |

| Tsai et al. | Mandible Parameterization using a Reference Line. |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20160222 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20160420 |

|

| A871 | Explanation of circumstances concerning accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A871 Effective date: 20160420 |

|

| A975 | Report on accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A971005 Effective date: 20160727 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20160809 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20160823 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 5996092 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |