JP5976019B2 - 写実的に表されたビューのテーマベースの拡張 - Google Patents

写実的に表されたビューのテーマベースの拡張 Download PDFInfo

- Publication number

- JP5976019B2 JP5976019B2 JP2013557791A JP2013557791A JP5976019B2 JP 5976019 B2 JP5976019 B2 JP 5976019B2 JP 2013557791 A JP2013557791 A JP 2013557791A JP 2013557791 A JP2013557791 A JP 2013557791A JP 5976019 B2 JP5976019 B2 JP 5976019B2

- Authority

- JP

- Japan

- Prior art keywords

- display

- physical environment

- extension

- user

- spatial model

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N5/00—Details of television systems

- H04N5/222—Studio circuitry; Studio devices; Studio equipment

- H04N5/262—Studio circuits, e.g. for mixing, switching-over, change of character of image, other special effects ; Cameras specially adapted for the electronic generation of special effects

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T17/00—Three-dimensional [3D] modelling for computer graphics

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/048—Interaction techniques based on graphical user interfaces [GUI]

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/14—Digital output to display device ; Cooperation and interconnection of the display device with other functional units

- G06F3/147—Digital output to display device ; Cooperation and interconnection of the display device with other functional units using display panels

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T19/00—Manipulating three-dimensional [3D] models or images for computer graphics

- G06T19/006—Mixed reality

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- General Engineering & Computer Science (AREA)

- Computer Graphics (AREA)

- Software Systems (AREA)

- Signal Processing (AREA)

- Multimedia (AREA)

- Human Computer Interaction (AREA)

- Computer Hardware Design (AREA)

- Geometry (AREA)

- User Interface Of Digital Computer (AREA)

- Processing Or Creating Images (AREA)

- Studio Devices (AREA)

- Measurement Of The Respiration, Hearing Ability, Form, And Blood Characteristics Of Living Organisms (AREA)

Description

Claims (20)

- 透過型ディスプレイであって、ユーザの視点からのある物理的環境の写実的に表されたビューを、前記透過型ディスプレイの1つまたは複数の十分に透過的な部分を介して提供するように構成され、前記透過型ディスプレイを通して前記物理的環境を見ることができる前記透過型ディスプレイにおいて、前記写実的に表されたビューのテーマベースの拡張を実現する方法であって、

前記写実的に表されたビューを拡張する際に使用するためのテーマを選択する入力を前記ユーザから受けるステップであって、前記テーマは複数の可能な拡張を含み、複数の可能なテーマから選択された、ステップと、

前記物理的環境の環境情報を光学的にリアルタイムで取得するステップと、

前記環境情報に基づいて、前記物理的環境に存在する物体の表現を含む、前記物理的環境の三次元空間モデルをリアルタイムで生成するステップと、

前記三次元空間モデルの解析を介して、それぞれが前記物理的環境内の1つまたは複数の物理的特徴に対応する、前記三次元空間モデル内の1つまたは複数の特徴を識別するステップと、

前記解析に基づいて、前記テーマに関連し且つ可視である、前記三次元空間モデルの解析を介して識別された前記1つまたは複数の特徴のうちの特徴の拡張を、前記物理的環境の部分を前記透過型ディスプレイを通して見ることができるまま前記透過型ディスプレイ上に表示するステップであって、該拡張は、前記複数の可能な拡張から、識別された前記特徴に基づき選択された、ステップと、

前記ユーザが前記物理的環境を動くにつれて、前記三次元空間モデルを、前記環境情報に基づきリアルタイムで更新するステップと

を含む方法。 - 請求項1に記載の方法であって、前記ディスプレイはヘッドアップディスプレイである、方法。

- 請求項1に記載の方法であって、前記ディスプレイはヘッドマウントディスプレイである、方法。

- 請求項1に記載の方法であって、前記拡張を表示するステップが、識別された前記特徴に対応する、前記物理的環境内の前記物理的特徴を前記ユーザの視点からオーバーレイする画像を表示するステップを含む、方法。

- 請求項1に記載の方法であって、前記拡張を表示するステップが、仮想皮膚を前記三次元空間モデルの識別された前記特徴に適用するステップと、前記仮想皮膚の画像を表示するステップであって、該画像は、前記物理的環境内の対応する前記物理的特徴を前記ユーザの視点からオーバーレイする、ステップとを含む、方法。

- 請求項1に記載の方法であって、前記拡張を表示するステップが、仮想物体を前記三次元空間モデルの識別された前記特徴上にオーバーレイするステップと、前記仮想物体の画像を表示するステップであって、該画像は、前記透過型ディスプレイを介して前記ユーザに可視である、前記物理的環境内の対応する前記物理的特徴を前記ユーザの視点からオーバーレイする、ステップとを含む、方法。

- 請求項1に記載の方法であって、前記環境情報を取得するステップは、前記環境情報を、前記ディスプレイと関連する1つまたは複数のセンサを介して検出するステップを含む、方法。

- 請求項1に記載の方法であって、前記三次元空間モデルの解析を介して、それぞれが前記物理的環境内の1つまたは複数の物理的特徴に対応する、前記三次元空間モデル内の1つまたは複数の特徴を識別するステップは、前記三次元空間モデルに関する物体認識解析を実行して前記物理的環境内の物体を識別するステップを更に含む、方法。

- 請求項8に記載の方法であって、前記拡張は、前記複数の可能な拡張から、識別された前記物体に基づき、識別された前記物体の寸法及び特徴の一方または双方に対応するようにサイズ変更され形状変更された拡張であるように選択される、方法。

- 請求項1に記載の方法であって、

前記三次元空間モデルの前記更新の結果として、前記透過型ディスプレイに拡張の変化を表示するステップ

を更に含む方法。 - 請求項10に記載の方法であって、前記拡張の変化を表示するステップは、前記テーマに関連した第2の拡張を表示するステップであって、前記第2の拡張は、前記複数の可能な拡張から、前記三次元空間モデルにおいて識別された追加の特徴に基づき選択された、ステップを含む、方法。

- 請求項10に記載の方法であって、前記拡張の変化を表示するステップは、前記拡張の前記表示を、前記ユーザが前記物理的環境の中を動くにつれて調整するステップを含む、方法。

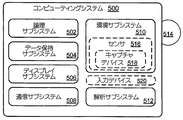

- ディスプレイ出力を介して拡張を提供するためのディスプレイシステムであって、

ヘッドマウント光透過型ディスプレイであって、ユーザの視点からの、ある物理的環境の写実的に表されたビューを、前記ディスプレイの1つまたは複数の十分に透過的な部分を介して提供するように構成され、前記ディスプレイを通して前記物理的環境が前記ユーザに可視である前記ヘッドマウント光透過型ディスプレイと、

前記物理的環境の環境情報を光学的にリアルタイムで取得するように構成された1つまたは複数の統合されたセンサと、

前記ディスプレイおよび前記1つまたは複数の統合されたセンサと動作上結合されたデータ保持サブシステムであって、

前記環境情報に基づいて、前記物理的環境に存在する物体の表現を含む、前記物理的環境の空間モデルをリアルタイムで生成することと、

複数の可能なテーマからテーマを選択するユーザ入力を受けることであって、前記テーマは複数の可能な拡張を含む、ことと、

前記空間モデルの解析を介して、それぞれが前記物理的環境内の1つまたは複数の物理的特徴に対応する、前記空間モデル内の1つまたは複数の特徴を識別することと、

前記解析に基づいて、前記複数の可能な拡張から拡張を、前記1つまたは複数の特徴のうちの識別された特徴に基づき自動的に選択することと、

識別された前記特徴の前記拡張を、同時に前記物理的環境の他の部分の透過的ビューを提供しながら、前記ヘッドマウント光透過型ディスプレイ上に表示することと

を行うために、論理サブシステムによって実行可能な命令を含むデータ保持サブシステムと

を備えたディスプレイシステム。 - 請求項13に記載のディスプレイシステムであって、前記1つまたは複数の統合されたセンサが、前記物理的環境の1つまたは複数の奥行き画像を取得するように構成された画像キャプチャデバイスを含む、ディスプレイシステム。

- 請求項14に記載のディスプレイシステムであって、前記画像キャプチャデバイスは、飛行時間型デプスカメラを含む、ディスプレイシステム。

- 請求項14に記載のディスプレイシステムであって、前記画像キャプチャデバイスは、構造化光型デプスカメラを含む、ディスプレイシステム。

- 請求項14に記載のディスプレイシステムであって、前記命令は、前記空間モデルを、前記奥行き画像から前記物理的環境のデプスマップを生成し、前記デプスマップから前記物理的環境の機械可読表現を導出することによって生成するように実行可能である、ディスプレイシステム。

- ヘッドマウント透過型ディスプレイ上に、テーマベースの拡張を、ディスプレイ出力を介して、前記ヘッドマウント透過型ディスプレイの1つまたは複数の十分に透過な部分を介して提供する方法であって、前記ヘッドマウント透過型ディスプレイを通して物理的環境を見ることができ、前記方法は、

ユーザから、ある写実的に表されたビューを拡張するためのテーマを、複数の可能なテーマから選択する入力を受けるステップであって、前記写実的に表されたビューは、前記ユーザの視点からの物理的環境であって、該物理的環境内に前記ユーザは位置する、物理的環境のものである、ステップと、

光学的にリアルタイムに、前記物理的環境のデプス情報を、前記ディスプレイ近くに位置する1つまたは複数のデプスカメラを介して検出するステップと、

前記ユーザの眺めからの前記物理的環境の空間モデルを、前記デプス情報に基づきリアルタイムに生成するステップと、

前記空間モデルの解析を介して、それぞれが前記物理的環境内の1つまたは複数の物理的特徴に対応する、前記空間モデル内の1つまたは複数の特徴を識別するステップと、

識別された前記1つまたは複数の特徴に基づき、前記テーマに関連した複数の拡張から拡張を自動的に選択するステップと、

それに応じ、前記ヘッドマウント透過型ディスプレイ上に、前記拡張を、前記物理的環境の前記写実的に表されたビューの少なくとも一部をいまだ提供させながら表示するステップと

を含む方法。 - 請求項18に記載の方法であって、前記拡張を表示するステップは、前記拡張を、前記ユーザが前記物理的環境内を動くにつれて動的に表示して、前記写実的に表されたビューの結果的な変化を生じさせるステップを含む、方法。

- 請求項18に記載の方法であって、識別された前記1つまたは複数の特徴に基づき、前記テーマに関連した複数の拡張から拡張を選択するステップは、前記物理的環境内に位置する物体の寸法及び特徴の一方または双方に対応するようにサイズ変更され形状変更された拡張を選択するステップを更に含む、方法。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US13/044,895 US10972680B2 (en) | 2011-03-10 | 2011-03-10 | Theme-based augmentation of photorepresentative view |

| US13/044,895 | 2011-03-10 | ||

| PCT/US2012/027787 WO2012122133A2 (en) | 2011-03-10 | 2012-03-05 | Theme-based augmentation of photorepresentative view |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2014515130A JP2014515130A (ja) | 2014-06-26 |

| JP2014515130A5 JP2014515130A5 (ja) | 2015-04-09 |

| JP5976019B2 true JP5976019B2 (ja) | 2016-08-23 |

Family

ID=46795136

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2013557791A Expired - Fee Related JP5976019B2 (ja) | 2011-03-10 | 2012-03-05 | 写実的に表されたビューのテーマベースの拡張 |

Country Status (8)

| Country | Link |

|---|---|

| US (1) | US10972680B2 (ja) |

| EP (1) | EP2684350A4 (ja) |

| JP (1) | JP5976019B2 (ja) |

| KR (1) | KR101961964B1 (ja) |

| CN (1) | CN102681811B (ja) |

| AR (1) | AR085659A1 (ja) |

| TW (1) | TWI567659B (ja) |

| WO (1) | WO2012122133A2 (ja) |

Families Citing this family (96)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US10332176B2 (en) | 2014-08-28 | 2019-06-25 | Ebay Inc. | Methods and systems for virtual fitting rooms or hybrid stores |

| US10972680B2 (en) | 2011-03-10 | 2021-04-06 | Microsoft Technology Licensing, Llc | Theme-based augmentation of photorepresentative view |

| US20120320216A1 (en) * | 2011-06-14 | 2012-12-20 | Disney Enterprises, Inc. | Method and System for Object Recognition, Authentication, and Tracking with Infrared Distortion Caused by Objects for Augmented Reality |

| DE102011104524A1 (de) * | 2011-06-15 | 2012-12-20 | Ifakt Gmbh | Verfahren und Vorrichtung zum Ermitteln und Wiedergeben virtueller ortsbezogener Informationen für einen Raumbereich |

| US9734633B2 (en) * | 2012-01-27 | 2017-08-15 | Microsoft Technology Licensing, Llc | Virtual environment generating system |

| EP2629498A1 (en) * | 2012-02-17 | 2013-08-21 | Sony Ericsson Mobile Communications AB | Portable electronic equipment and method of visualizing sound |

| US10067568B2 (en) * | 2012-02-28 | 2018-09-04 | Qualcomm Incorporated | Augmented reality writing system and method thereof |

| US9001153B2 (en) * | 2012-03-21 | 2015-04-07 | GM Global Technology Operations LLC | System and apparatus for augmented reality display and controls |

| US9524585B2 (en) | 2012-11-05 | 2016-12-20 | Microsoft Technology Licensing, Llc | Constructing augmented reality environment with pre-computed lighting |

| CN103869933B (zh) * | 2012-12-11 | 2017-06-27 | 联想(北京)有限公司 | 信息处理的方法和终端设备 |

| DE102012224321B4 (de) * | 2012-12-21 | 2022-12-15 | Applejack 199 L.P. | Messvorrichtung zum Erfassen einer Schlagbewegung eines Schlägers, Trainingsvorrichtung und Verfahren zum Training einer Schlagbewegung |

| US10514541B2 (en) * | 2012-12-27 | 2019-12-24 | Microsoft Technology Licensing, Llc | Display update time reduction for a near-eye display |

| US9083960B2 (en) | 2013-01-30 | 2015-07-14 | Qualcomm Incorporated | Real-time 3D reconstruction with power efficient depth sensor usage |

| US10572118B2 (en) * | 2013-03-28 | 2020-02-25 | David Michael Priest | Pattern-based design system |

| US9245387B2 (en) * | 2013-04-12 | 2016-01-26 | Microsoft Technology Licensing, Llc | Holographic snap grid |

| US9367960B2 (en) * | 2013-05-22 | 2016-06-14 | Microsoft Technology Licensing, Llc | Body-locked placement of augmented reality objects |

| KR102249577B1 (ko) * | 2013-05-30 | 2021-05-07 | 찰스 안소니 스미스 | Hud 객체 설계 및 방법 |

| US9779548B2 (en) * | 2013-06-25 | 2017-10-03 | Jordan Kent Weisman | Multiuser augmented reality system |

| US9996974B2 (en) * | 2013-08-30 | 2018-06-12 | Qualcomm Incorporated | Method and apparatus for representing a physical scene |

| US9934611B2 (en) * | 2013-09-11 | 2018-04-03 | Qualcomm Incorporated | Structural modeling using depth sensors |

| US9256072B2 (en) * | 2013-10-02 | 2016-02-09 | Philip Scott Lyren | Wearable electronic glasses that detect movement of a real object copies movement of a virtual object |

| KR102197504B1 (ko) * | 2013-12-18 | 2020-12-31 | 마이크로소프트 테크놀로지 라이센싱, 엘엘씨 | 사전 계산된 조명으로 증강 현실 환경을 구성하는 기법 |

| JP6272687B2 (ja) * | 2013-12-18 | 2018-01-31 | マイクロソフト テクノロジー ライセンシング,エルエルシー | 事前計算された照明による拡張現実環境の構築 |

| US9761049B2 (en) | 2014-03-28 | 2017-09-12 | Intel Corporation | Determination of mobile display position and orientation using micropower impulse radar |

| CN103902983A (zh) * | 2014-04-14 | 2014-07-02 | 夷希数码科技(上海)有限公司 | 一种穿戴式人脸识别方法及装置 |

| WO2015167549A1 (en) * | 2014-04-30 | 2015-11-05 | Longsand Limited | An augmented gaming platform |

| US9996636B2 (en) * | 2014-05-13 | 2018-06-12 | Atheer, Inc. | Method for forming walls to align 3D objects in 2D environment |

| US9959675B2 (en) * | 2014-06-09 | 2018-05-01 | Microsoft Technology Licensing, Llc | Layout design using locally satisfiable proposals |

| US10529009B2 (en) | 2014-06-25 | 2020-01-07 | Ebay Inc. | Digital avatars in online marketplaces |

| US10653962B2 (en) | 2014-08-01 | 2020-05-19 | Ebay Inc. | Generating and utilizing digital avatar data for online marketplaces |

| WO2016064435A1 (en) * | 2014-10-24 | 2016-04-28 | Usens, Inc. | System and method for immersive and interactive multimedia generation |

| US10091015B2 (en) * | 2014-12-16 | 2018-10-02 | Microsoft Technology Licensing, Llc | 3D mapping of internet of things devices |

| US20160224657A1 (en) * | 2015-01-30 | 2016-08-04 | Llc Daqri, Llc | Digitized interactions with an identified object |

| CN106033418B (zh) | 2015-03-10 | 2020-01-31 | 阿里巴巴集团控股有限公司 | 语音添加、播放方法及装置、图片分类、检索方法及装置 |

| US10799792B2 (en) * | 2015-07-23 | 2020-10-13 | At&T Intellectual Property I, L.P. | Coordinating multiple virtual environments |

| US20170256096A1 (en) * | 2016-03-07 | 2017-09-07 | Google Inc. | Intelligent object sizing and placement in a augmented / virtual reality environment |

| US10037465B2 (en) | 2016-03-18 | 2018-07-31 | Disney Enterprises, Inc. | Systems and methods for generating augmented reality environments |

| US9933855B2 (en) * | 2016-03-31 | 2018-04-03 | Intel Corporation | Augmented reality in a field of view including a reflection |

| JP2017199238A (ja) * | 2016-04-28 | 2017-11-02 | 株式会社カプコン | 仮想空間表示システム |

| US10909761B1 (en) * | 2016-07-07 | 2021-02-02 | Google Llc | 2D video with option for projected viewing in modeled 3D space |

| KR101692267B1 (ko) * | 2016-08-25 | 2017-01-04 | 지스마트 주식회사 | Hmd 유저와 복수의 일반인들 간에 상호작용이 가능한 가상현실 컨텐츠 시스템 및 그 제어방법 |

| US10068379B2 (en) * | 2016-09-30 | 2018-09-04 | Intel Corporation | Automatic placement of augmented reality models |

| TWI637287B (zh) * | 2016-11-04 | 2018-10-01 | 宏達國際電子股份有限公司 | 在虛擬實境中快速移動的方法、虛擬實境裝置及記錄媒體 |

| GB2555838A (en) * | 2016-11-11 | 2018-05-16 | Sony Corp | An apparatus, computer program and method |

| US10359863B2 (en) * | 2016-11-15 | 2019-07-23 | Google Llc | Dragging virtual elements of an augmented and/or virtual reality environment |

| KR102355135B1 (ko) * | 2017-01-16 | 2022-01-26 | 소니그룹주식회사 | 정보 처리 장치, 정보 처리 방법, 및 프로그램 |

| US10542300B2 (en) | 2017-05-31 | 2020-01-21 | Verizon Patent And Licensing Inc. | Methods and systems for customizing virtual reality data |

| US20190108558A1 (en) | 2017-07-28 | 2019-04-11 | Magical Technologies, Llc | Systems, Methods and Apparatuses Of Multidimensional Mapping Of Universal Locations Or Location Ranges For Alternate Or Augmented Digital Experiences |

| US20190102946A1 (en) * | 2017-08-04 | 2019-04-04 | Magical Technologies, Llc | Systems, methods and apparatuses for deployment and targeting of context-aware virtual objects and behavior modeling of virtual objects based on physical principles |

| US20210166481A1 (en) * | 2017-08-04 | 2021-06-03 | Zyetric Enterprise Limited | Intelligent virtual object in an augmented reality environment interactively responding to ambient environmental changes |

| US11249714B2 (en) | 2017-09-13 | 2022-02-15 | Magical Technologies, Llc | Systems and methods of shareable virtual objects and virtual objects as message objects to facilitate communications sessions in an augmented reality environment |

| WO2019079826A1 (en) | 2017-10-22 | 2019-04-25 | Magical Technologies, Llc | DIGITAL ASSISTANT SYSTEMS, METHODS AND APPARATUSES IN AN INCREASED REALITY ENVIRONMENT AND LOCAL DETERMINATION OF VIRTUAL OBJECT PLACEMENT AND SINGLE OR MULTIDIRECTIONAL OBJECTIVES AS GATEWAYS BETWEEN A PHYSICAL WORLD AND A DIGITAL WORLD COMPONENT OF THE SAME ENVIRONMENT OF INCREASED REALITY |

| EP3476448B1 (de) * | 2017-10-24 | 2021-12-08 | VR Coaster GmbH & Co. KG | Vr-vorrichtung zum erzeugen und darstellen einer virtuellen realität |

| US10726463B2 (en) * | 2017-12-20 | 2020-07-28 | Signify Holding B.V. | Lighting and internet of things design using augmented reality |

| JP7364218B2 (ja) * | 2017-12-28 | 2023-10-18 | 株式会社コナミデジタルエンタテインメント | 情報処理装置、情報処理装置のプログラム、情報処理システム、及び、表示方法 |

| JP6857795B2 (ja) | 2017-12-28 | 2021-04-14 | 株式会社コナミデジタルエンタテインメント | 情報処理装置、情報処理装置のプログラム、情報処理システム、及び、表示方法 |

| JP6590324B2 (ja) | 2017-12-28 | 2019-10-16 | 株式会社コナミデジタルエンタテインメント | 情報処理装置、情報処理装置のプログラム、情報処理システム、及び、表示方法 |

| US10500496B2 (en) * | 2018-01-12 | 2019-12-10 | International Business Machines Corporation | Physical obstacle avoidance in a virtual reality environment |

| US10904374B2 (en) | 2018-01-24 | 2021-01-26 | Magical Technologies, Llc | Systems, methods and apparatuses to facilitate gradual or instantaneous adjustment in levels of perceptibility of virtual objects or reality object in a digital scene |

| US11398088B2 (en) | 2018-01-30 | 2022-07-26 | Magical Technologies, Llc | Systems, methods and apparatuses to generate a fingerprint of a physical location for placement of virtual objects |

| JP7041888B2 (ja) * | 2018-02-08 | 2022-03-25 | 株式会社バンダイナムコ研究所 | シミュレーションシステム及びプログラム |

| US10803671B2 (en) | 2018-05-04 | 2020-10-13 | Microsoft Technology Licensing, Llc | Authoring content in three-dimensional environment |

| US11983990B2 (en) | 2018-08-22 | 2024-05-14 | Aristocrat Technologies Australia Pty Limited | Gaming machine and method for evaluating player reactions |

| US10593152B1 (en) | 2018-08-22 | 2020-03-17 | Aristocrat Technologies Australia Pty Limited | Gaming machine and method for evaluating player reactions |

| CN109344923A (zh) * | 2018-08-27 | 2019-02-15 | 百度在线网络技术(北京)有限公司 | 关联物体的显示方法、装置及电子设备 |

| US10783713B2 (en) | 2018-09-05 | 2020-09-22 | International Business Machines Corporation | Transmutation of virtual entity sketch using extracted features and relationships of real and virtual objects in mixed reality scene |

| US10664989B1 (en) | 2018-12-19 | 2020-05-26 | Disney Enterprises, Inc. | Systems and methods to present interactive content based on detection of markers |

| CN109543663B (zh) * | 2018-12-28 | 2021-04-27 | 北京旷视科技有限公司 | 一种犬只身份识别方法、装置、系统及存储介质 |

| US11189130B2 (en) | 2019-01-23 | 2021-11-30 | Aristocrat Technologies Australia Pty Limited | Gaming machine security devices and methods |

| JP2022051977A (ja) * | 2019-02-13 | 2022-04-04 | ソニーグループ株式会社 | 情報処理装置、情報処理方法、およびプログラム |

| US11467656B2 (en) | 2019-03-04 | 2022-10-11 | Magical Technologies, Llc | Virtual object control of a physical device and/or physical device control of a virtual object |

| US11335060B2 (en) * | 2019-04-04 | 2022-05-17 | Snap Inc. | Location based augmented-reality system |

| JP7315362B2 (ja) * | 2019-04-12 | 2023-07-26 | 日産自動車株式会社 | 映像出力システム及び映像出力方法 |

| US11263866B2 (en) | 2019-05-31 | 2022-03-01 | Aristocrat Technologies, Inc. | Securely storing machine data on a non-volatile memory device |

| US11308761B2 (en) | 2019-05-31 | 2022-04-19 | Aristocrat Technologies, Inc. | Ticketing systems on a distributed ledger |

| JP2020074064A (ja) * | 2019-09-05 | 2020-05-14 | 株式会社コナミデジタルエンタテインメント | 情報処理装置、情報処理装置のプログラム、情報処理システム、及び、表示方法 |

| US11380070B2 (en) * | 2019-10-30 | 2022-07-05 | The Paddock LLC | Real-time augmentation of a virtual object onto a real-world object |

| US11195371B2 (en) | 2019-12-04 | 2021-12-07 | Aristocrat Technologies, Inc. | Preparation and installation of gaming devices using blockchain |

| US11206365B2 (en) | 2020-01-13 | 2021-12-21 | Charter Communications Operating, Llc | Method and apparatus for overlaying themed imagery onto real-world objects in a head-mounted display device |

| US11095855B2 (en) | 2020-01-16 | 2021-08-17 | Microsoft Technology Licensing, Llc | Remote collaborations with volumetric space indications |

| US11138771B2 (en) | 2020-02-03 | 2021-10-05 | Apple Inc. | Systems, methods, and graphical user interfaces for annotating, measuring, and modeling environments |

| US11727650B2 (en) * | 2020-03-17 | 2023-08-15 | Apple Inc. | Systems, methods, and graphical user interfaces for displaying and manipulating virtual objects in augmented reality environments |

| US11636726B2 (en) * | 2020-05-08 | 2023-04-25 | Aristocrat Technologies, Inc. | Systems and methods for gaming machine diagnostic analysis |

| US11514690B2 (en) * | 2020-06-30 | 2022-11-29 | Sony Interactive Entertainment LLC | Scanning of 3D objects with a second screen device for insertion into a virtual environment |

| WO2022009607A1 (ja) * | 2020-07-09 | 2022-01-13 | ソニーグループ株式会社 | 画像処理装置、および画像処理方法、並びにプログラム |

| EP4327293A1 (en) | 2021-04-18 | 2024-02-28 | Apple Inc. | Systems, methods, and graphical user interfaces for adding effects in augmented reality environments |

| US12223797B2 (en) | 2021-05-14 | 2025-02-11 | Aristocrat Technologies, Inc. | Slidable gaming chair including return-to-home feature |

| CN113298938A (zh) * | 2021-06-23 | 2021-08-24 | 东莞市小精灵教育软件有限公司 | 一种辅助建模方法、系统、可穿戴智能设备及vr设备 |

| US20230024386A1 (en) | 2021-07-09 | 2023-01-26 | Aristocrat Technologies, Inc. | Data collection cloud system for electronic gaming machines |

| JPWO2023286321A1 (ja) * | 2021-07-12 | 2023-01-19 | ||

| US12469207B2 (en) | 2022-05-10 | 2025-11-11 | Apple Inc. | Systems, methods, and graphical user interfaces for scanning and modeling environments |

| JP2024034133A (ja) * | 2022-08-31 | 2024-03-13 | 株式会社Jvcケンウッド | 提供装置および提供方法 |

| US12268954B2 (en) * | 2022-10-23 | 2025-04-08 | JoyWAY LTD | Computer-readable medium configured to translating movements performed by a person onto a user in augmented or virtual reality |

| US20240242445A1 (en) * | 2023-01-17 | 2024-07-18 | Disney Enterprises, Inc. | Neural extension of 2d content in augmented reality environments |

| US12430857B2 (en) * | 2023-01-17 | 2025-09-30 | Disney Enterprises, Inc. | Neural extension of 3D content in augmented reality environments |

| US12228750B2 (en) | 2023-07-13 | 2025-02-18 | Blaise Photonics LLC | Volumetric display systems, methods, and devices |

Family Cites Families (60)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US5870136A (en) * | 1997-12-05 | 1999-02-09 | The University Of North Carolina At Chapel Hill | Dynamic generation of imperceptible structured light for tracking and acquisition of three dimensional scene geometry and surface characteristics in interactive three dimensional computer graphics applications |

| JP2000207575A (ja) | 1999-01-08 | 2000-07-28 | Nadeisu:Kk | 空間融合装置及びこれを適用した応用装置 |

| JP2000276613A (ja) | 1999-03-29 | 2000-10-06 | Sony Corp | 情報処理装置および情報処理方法 |

| JP3728160B2 (ja) | 1999-12-06 | 2005-12-21 | キヤノン株式会社 | 奥行き画像計測装置及び方法、並びに複合現実感提示システム |

| US6930715B1 (en) * | 2000-07-21 | 2005-08-16 | The Research Foundation Of The State University Of New York | Method, system and program product for augmenting an image of a scene with information about the scene |

| GB0111431D0 (en) | 2001-05-11 | 2001-07-04 | Koninkl Philips Electronics Nv | A real-world representation system and language |

| US6917370B2 (en) * | 2002-05-13 | 2005-07-12 | Charles Benton | Interacting augmented reality and virtual reality |

| US7277572B2 (en) * | 2003-10-10 | 2007-10-02 | Macpearl Design Llc | Three-dimensional interior design system |

| KR100500898B1 (ko) | 2003-12-18 | 2005-07-18 | 한국전자통신연구원 | 공간정보를 이용한 3차원 공간모델링 장치 및 그 방법 |

| US20160267720A1 (en) * | 2004-01-30 | 2016-09-15 | Electronic Scripting Products, Inc. | Pleasant and Realistic Virtual/Augmented/Mixed Reality Experience |

| US8965460B1 (en) * | 2004-01-30 | 2015-02-24 | Ip Holdings, Inc. | Image and augmented reality based networks using mobile devices and intelligent electronic glasses |

| DE602005017290D1 (de) | 2004-09-06 | 2009-12-03 | Bayerische Motoren Werke Ag | Vorrichtung zur erfassung eines objekts auf einem fahrzeugsitz |

| JP4677281B2 (ja) | 2005-05-11 | 2011-04-27 | キヤノン株式会社 | 画像処理方法、画像処理装置 |

| CN101243392A (zh) * | 2005-08-15 | 2008-08-13 | 皇家飞利浦电子股份有限公司 | 用于终端用户编程的增强现实眼镜的系统、设备和方法 |

| JP5084167B2 (ja) | 2006-03-31 | 2012-11-28 | キヤノン株式会社 | 位置姿勢計測方法及び装置 |

| JP4925120B2 (ja) | 2007-07-02 | 2012-04-25 | 独立行政法人産業技術総合研究所 | 物体認識装置および物体認識方法 |

| JP4973622B2 (ja) | 2007-08-29 | 2012-07-11 | カシオ計算機株式会社 | 画像合成装置および画像合成処理プログラム |

| US9703369B1 (en) * | 2007-10-11 | 2017-07-11 | Jeffrey David Mullen | Augmented reality video game systems |

| KR101367282B1 (ko) | 2007-12-21 | 2014-03-12 | 삼성전자주식회사 | 깊이 정보에 대한 적응적 정보 표현 방법 및 그 장치 |

| US8264505B2 (en) | 2007-12-28 | 2012-09-11 | Microsoft Corporation | Augmented reality and filtering |

| WO2009094587A1 (en) | 2008-01-23 | 2009-07-30 | Deering Michael F | Eye mounted displays |

| US8786675B2 (en) | 2008-01-23 | 2014-07-22 | Michael F. Deering | Systems using eye mounted displays |

| KR100912264B1 (ko) | 2008-02-12 | 2009-08-17 | 광주과학기술원 | 사용자 반응형 증강 영상 생성 방법 및 시스템 |

| KR100963238B1 (ko) * | 2008-02-12 | 2010-06-10 | 광주과학기술원 | 개인화 및 협업을 위한 테이블탑-모바일 증강현실 시스템과증강현실을 이용한 상호작용방법 |

| US8231465B2 (en) | 2008-02-21 | 2012-07-31 | Palo Alto Research Center Incorporated | Location-aware mixed-reality gaming platform |

| US20090237564A1 (en) * | 2008-03-18 | 2009-09-24 | Invism, Inc. | Interactive immersive virtual reality and simulation |

| JP2009281895A (ja) | 2008-05-23 | 2009-12-03 | Calsonic Kansei Corp | 車両用距離画像データ生成装置および車両用距離画像データの生成方法 |

| US20090313285A1 (en) | 2008-06-16 | 2009-12-17 | Andreas Hronopoulos | Methods and systems for facilitating the fantasies of users based on user profiles/preferences |

| US9480919B2 (en) | 2008-10-24 | 2016-11-01 | Excalibur Ip, Llc | Reconfiguring reality using a reality overlay device |

| US20100110069A1 (en) * | 2008-10-31 | 2010-05-06 | Sharp Laboratories Of America, Inc. | System for rendering virtual see-through scenes |

| US8303406B2 (en) | 2008-11-24 | 2012-11-06 | Disney Enterprises, Inc. | System and method for providing an augmented reality experience |

| KR101062961B1 (ko) | 2009-01-07 | 2011-09-06 | 광주과학기술원 | 증강현실 컨텐츠 저작 시스템과 방법 및 상기 방법을 구현하는 프로그램이 기록된 기록매체 |

| KR101002785B1 (ko) | 2009-02-06 | 2010-12-21 | 광주과학기술원 | 증강 현실 환경에서의 공간 상호 작용 방법 및 시스템 |

| US8970690B2 (en) * | 2009-02-13 | 2015-03-03 | Metaio Gmbh | Methods and systems for determining the pose of a camera with respect to at least one object of a real environment |

| US20140240313A1 (en) * | 2009-03-19 | 2014-08-28 | Real Time Companies | Computer-aided system for 360° heads up display of safety/mission critical data |

| KR101343054B1 (ko) | 2009-07-30 | 2013-12-18 | 에스케이플래닛 주식회사 | 사용자 선택 정보에 의해 증강 현실을 제공하는 방법과 그를 위한 서버 및 휴대용 단말기 |

| HU0900478D0 (en) | 2009-07-31 | 2009-09-28 | Holografika Hologrameloeallito | Method and apparatus for displaying 3d images |

| KR20110118421A (ko) * | 2010-04-23 | 2011-10-31 | 엘지전자 주식회사 | 증강 원격제어장치, 증강 원격제어장치 제어방법 및 그 시스템 |

| US8400548B2 (en) * | 2010-01-05 | 2013-03-19 | Apple Inc. | Synchronized, interactive augmented reality displays for multifunction devices |

| US8964298B2 (en) * | 2010-02-28 | 2015-02-24 | Microsoft Corporation | Video display modification based on sensor input for a see-through near-to-eye display |

| KR101135186B1 (ko) * | 2010-03-03 | 2012-04-16 | 광주과학기술원 | 상호작용형 실시간 증강현실 시스템과 그 방법, 및 상기 방법을 구현하는 프로그램이 기록된 기록매체 |

| US20110234631A1 (en) * | 2010-03-25 | 2011-09-29 | Bizmodeline Co., Ltd. | Augmented reality systems |

| US9122707B2 (en) * | 2010-05-28 | 2015-09-01 | Nokia Technologies Oy | Method and apparatus for providing a localized virtual reality environment |

| US9348141B2 (en) * | 2010-10-27 | 2016-05-24 | Microsoft Technology Licensing, Llc | Low-latency fusing of virtual and real content |

| US20120113223A1 (en) * | 2010-11-05 | 2012-05-10 | Microsoft Corporation | User Interaction in Augmented Reality |

| US8576276B2 (en) * | 2010-11-18 | 2013-11-05 | Microsoft Corporation | Head-mounted display device which provides surround video |

| US9247238B2 (en) * | 2011-01-31 | 2016-01-26 | Microsoft Technology Licensing, Llc | Reducing interference between multiple infra-red depth cameras |

| US8570320B2 (en) * | 2011-01-31 | 2013-10-29 | Microsoft Corporation | Using a three-dimensional environment model in gameplay |

| US20120194547A1 (en) * | 2011-01-31 | 2012-08-02 | Nokia Corporation | Method and apparatus for generating a perspective display |

| US8711206B2 (en) * | 2011-01-31 | 2014-04-29 | Microsoft Corporation | Mobile camera localization using depth maps |

| US20120223885A1 (en) * | 2011-03-02 | 2012-09-06 | Microsoft Corporation | Immersive display experience |

| US9480907B2 (en) * | 2011-03-02 | 2016-11-01 | Microsoft Technology Licensing, Llc | Immersive display with peripheral illusions |

| US8721337B2 (en) * | 2011-03-08 | 2014-05-13 | Bank Of America Corporation | Real-time video image analysis for providing virtual landscaping |

| US10972680B2 (en) | 2011-03-10 | 2021-04-06 | Microsoft Technology Licensing, Llc | Theme-based augmentation of photorepresentative view |

| US8743244B2 (en) * | 2011-03-21 | 2014-06-03 | HJ Laboratories, LLC | Providing augmented reality based on third party information |

| US8963956B2 (en) * | 2011-08-19 | 2015-02-24 | Microsoft Technology Licensing, Llc | Location based skins for mixed reality displays |

| WO2013032955A1 (en) * | 2011-08-26 | 2013-03-07 | Reincloud Corporation | Equipment, systems and methods for navigating through multiple reality models |

| US9323325B2 (en) * | 2011-08-30 | 2016-04-26 | Microsoft Technology Licensing, Llc | Enhancing an object of interest in a see-through, mixed reality display device |

| US9286711B2 (en) * | 2011-09-30 | 2016-03-15 | Microsoft Technology Licensing, Llc | Representing a location at a previous time period using an augmented reality display |

| US9911232B2 (en) * | 2015-02-27 | 2018-03-06 | Microsoft Technology Licensing, Llc | Molding and anchoring physically constrained virtual environments to real-world environments |

-

2011

- 2011-03-10 US US13/044,895 patent/US10972680B2/en active Active

-

2012

- 2012-02-24 TW TW101106393A patent/TWI567659B/zh not_active IP Right Cessation

- 2012-03-05 JP JP2013557791A patent/JP5976019B2/ja not_active Expired - Fee Related

- 2012-03-05 KR KR1020137023809A patent/KR101961964B1/ko active Active

- 2012-03-05 EP EP12754739.6A patent/EP2684350A4/en not_active Ceased

- 2012-03-05 WO PCT/US2012/027787 patent/WO2012122133A2/en not_active Ceased

- 2012-03-08 CN CN201210060159.3A patent/CN102681811B/zh active Active

- 2012-03-12 AR ARP120100796A patent/AR085659A1/es not_active Application Discontinuation

Also Published As

| Publication number | Publication date |

|---|---|

| US20120229508A1 (en) | 2012-09-13 |

| EP2684350A2 (en) | 2014-01-15 |

| JP2014515130A (ja) | 2014-06-26 |

| CN102681811B (zh) | 2018-01-26 |

| US10972680B2 (en) | 2021-04-06 |

| CN102681811A (zh) | 2012-09-19 |

| WO2012122133A3 (en) | 2012-11-29 |

| KR20140007427A (ko) | 2014-01-17 |

| AR085659A1 (es) | 2013-10-16 |

| WO2012122133A2 (en) | 2012-09-13 |

| EP2684350A4 (en) | 2014-08-13 |

| TW201246088A (en) | 2012-11-16 |

| KR101961964B1 (ko) | 2019-03-25 |

| TWI567659B (zh) | 2017-01-21 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5976019B2 (ja) | 写実的に表されたビューのテーマベースの拡張 | |

| JP7560568B2 (ja) | 仮想および拡張現実のためのシステムおよび方法 | |

| US10055888B2 (en) | Producing and consuming metadata within multi-dimensional data | |

| US9704295B2 (en) | Construction of synthetic augmented reality environment | |

| CN108292444B (zh) | 更新混合现实缩略图 | |

| JP2022040219A (ja) | 拡張現実データを記録するための手法 | |

| US9551871B2 (en) | Virtual light in augmented reality | |

| CN112154405B (zh) | 三维推送通知 | |

| JP2014509429A (ja) | ユーザーインターフェースの提示およびインタラクション | |

| US10559130B2 (en) | Displaying image data behind surfaces | |

| CN105723420A (zh) | 混合现实聚光灯 | |

| KR20140081840A (ko) | 모션으로 제어되는 리스트 스크롤 방법 | |

| US10582190B2 (en) | Virtual training system | |

| US12475656B2 (en) | Space and content matching for augmented and mixed reality | |

| HK1173807B (en) | Theme-based augmentation of photorepresentative view | |

| HK1173807A (en) | Theme-based augmentation of photorepresentative view | |

| HK40097466A (en) | Space and content matching for augmented and mixed reality |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20150218 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20150218 |

|

| A711 | Notification of change in applicant |

Free format text: JAPANESE INTERMEDIATE CODE: A711 Effective date: 20150521 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20151222 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20160104 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20160404 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20160620 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20160719 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 5976019 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| LAPS | Cancellation because of no payment of annual fees |