JP5472019B2 - Image composition apparatus, image composition program, and image composition method - Google Patents

Image composition apparatus, image composition program, and image composition method Download PDFInfo

- Publication number

- JP5472019B2 JP5472019B2 JP2010223451A JP2010223451A JP5472019B2 JP 5472019 B2 JP5472019 B2 JP 5472019B2 JP 2010223451 A JP2010223451 A JP 2010223451A JP 2010223451 A JP2010223451 A JP 2010223451A JP 5472019 B2 JP5472019 B2 JP 5472019B2

- Authority

- JP

- Japan

- Prior art keywords

- image

- handwritten

- image data

- input

- closed region

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

Images

Description

本発明は、画像合成装置及び画像合成プログラムに関し、特に、電子ペンを利用して画像を合成する画像合成装置及び画像合成プログラムに関する。 The present invention relates to an image composition device and an image composition program, and more particularly to an image composition device and an image composition program that compose an image using an electronic pen.

近年、入力デバイスとして、ペンで入力した筆跡をデータとして出力する電子ペンが利用されている。この電子ペンは、ペン先に小型カメラを搭載しており、用紙に印刷されたアノト(登録商標)パターンと呼ばれる位置検出用パターンを小型カメラで読み取ることによってペン先の位置を特定し、手書きした文字や図形、絵などの筆跡を手書きデータとして出力する。 In recent years, electronic pens that output handwriting input with a pen as data have been used as input devices. This electronic pen is equipped with a small camera at the pen tip, and the position of the pen tip is specified by reading a position detection pattern called an Anoto (registered trademark) pattern printed on the paper with a small camera and handwritten. Handwriting such as letters, figures, and pictures is output as handwritten data.

このような電子ペンを利用したシステムとして、例えば、下記特許文献1には、デジタルカメラを内蔵し、筆記機能を有するデジタルペンと、デジタルペン専用用紙と、デジタルペンから写真画像データを受信してサーバに受信画像を送信し、サーバから編集されたデータを受信する通信装置と、少なくとも写真画像情報読取部とを有し、前記通信装置に接続されて印刷物を出力する出力装置を有する印刷システムが開示されている。

As a system using such an electronic pen, for example, in

上記特許文献1の技術を利用することにより、用紙に予め配置された画像と、その画像上に手書きした手書き画像と、を合成して合成画像を出力することができるが、画像が配置された用紙を作成するためには、ユーザが画像を選択し、選択した画像を用紙上のどの位置に配置するかを指定しなければならず、煩雑な操作が必要になる。

By using the technique of the above-mentioned

特に、デジタルカメラで撮影した画像やスキャナで読み取った画像などの多数の画像を各ページの所定の位置に配置した資料等を作成する場合には、画像と用紙上の位置との対応付けに手間がかかり、簡便に画像を合成することができないという問題があった。 In particular, when creating a document etc. in which a large number of images such as images taken with a digital camera or images scanned with a scanner are arranged at predetermined positions on each page, it is troublesome to associate the images with the positions on the paper. There is a problem that the image cannot be easily combined.

本発明は、上記問題点に鑑みてなされたものであって、その主たる目的は、用紙や画面の所定の位置に簡便に画像を合成することができる画像合成装置及び画像合成プログラムを提供することにある。 The present invention has been made in view of the above-described problems, and a main object thereof is to provide an image composition apparatus and an image composition program that can easily compose an image at a predetermined position on a sheet or a screen. It is in.

上記目的を達成するため、本発明の画像合成装置は、用紙上若しくは画面上の電子ペンの移動軌跡を表す1又は複数の手書き画像と当該画像を手書きした時刻を特定する少なくとも1つの時刻情報とが対応付けられた手書き情報と、予め時刻情報が対応付けられた、デジタルカメラで撮影した画像データ、及び/又は、スキャナで読み取った画像データと、を繰り返し入力する入力部、前記手書き画像に対応付けられた少なくとも1つの時刻情報と前記画像データに対応付けられた時刻情報とに基づいて、各々の手書き画像に、当該手書き画像を手書きした時刻に最も近い時刻に撮影又は保存された画像データを対応付ける制御部と、前記手書き画像で特定される閉領域内に、当該手書き画像に対応付けられた画像データに基づく入力画像又は当該画像データの保存場所情報を合成する画像処理部と、合成結果を出力する出力部と、を少なくとも備えるものである。 In order to achieve the above object, an image composition device of the present invention includes one or a plurality of handwritten images representing a movement locus of an electronic pen on a sheet or a screen, and at least one time information for specifying a time when the image is handwritten. a handwritten information is associated in advance time information associated with the image data taken by a digital camera, and / or an input unit for repeatedly inputting the image data read by the scanner, and corresponding to the handwritten image Based on at least one attached time information and time information associated with the image data, image data captured or stored at a time closest to the time when the handwritten image is handwritten on each handwritten image. An input image or an image based on the image data associated with the handwritten image within the closed region specified by the handwritten image and the control unit to be associated An image processing section for combining the location information of the image data, and an output unit for outputting the combined result, the one in which at least comprises.

また、本発明は、入力部と出力部とを備える装置で動作する画像合成プログラムであって、前記装置に、前記入力部に、用紙上若しくは画面上の電子ペンの移動軌跡を表す1又は複数の手書き画像と当該画像を手書きした時刻を特定する少なくとも1つの時刻情報とが対応付けられた手書き情報と、予め時刻情報が対応付けられた、デジタルカメラで撮影した画像データ、及び/又は、スキャナで読み取った画像データと、を繰り返し入力させる第1の処理、前記手書き画像に対応付けられた少なくとも1つの時刻情報と前記画像データに対応付けられた時刻情報とに基づいて、各々の手書き画像に、当該手書き画像を手書きした時刻に最も近い時刻に撮影又は保存された画像データを対応付ける第2の処理、前記手書き画像で特定される閉領域内に、当該手書き画像に対応付けられた画像データに基づく入力画像又は当該画像データの保存場所情報を合成する第3の処理、前記出力部に、合成結果を出力させる第4の処理、を実行させるものである。

In addition, the present invention is an image composition program that operates on an apparatus including an input unit and an output unit, and the apparatus includes one or more that represents a movement locus of an electronic pen on a sheet or a screen on the input unit. Handwritten image associated with handwritten information associated with at least one time information specifying the time when the image was handwritten , image data captured with a digital camera and associated with time information in advance , and / or scanner Each of the handwritten images based on the first process of repeatedly inputting the image data read in

本発明の画像合成装置及び画像合成プログラムによれば、用紙や画面の所定の位置に簡便に画像を合成することができる。 According to the image synthesizing apparatus and the image synthesizing program of the present invention, it is possible to easily synthesize an image at a predetermined position on a sheet or a screen.

その理由は、画像合成装置(画像合成プログラム)は、電子ペンから、位置検出用パターンが印刷された用紙や位置検出用パターンが表示された画面で手書きした1又は複数の手書き画像とその手書き画像を手書きした時刻を特定する少なくとも1つの時刻情報とが対応付けられた手書き情報を取得すると共に、デジタルカメラやスキャナから、予め時刻情報が対応付けられた画像データを取得し、手書き画像に対応付けられた少なくとも1つの時刻情報と画像データに対応付けられた時刻情報とに基づいて、手書き画像と画像データとを対応付け、各々の画像合成領域に時刻情報に基づいて対応付けられた画像データに基づく画像又は当該画像データの保存場所情報を合成する制御を行うからである。 The reason is that the image synthesizing device (image synthesizing program) is one or a plurality of handwritten images handwritten on the screen on which the position detection pattern is printed or the screen on which the position detection pattern is displayed and the handwritten image from the electronic pen. Handwritten information associated with at least one piece of time information specifying the time at which the handwriting is handwritten is acquired, and image data associated with the time information is obtained in advance from a digital camera or scanner, and is associated with the handwritten image. The handwritten image and the image data are associated with each other based on the at least one piece of time information and the time information associated with the image data, and the image data associated with each image composition area based on the time information This is because control for combining the image based on the image or the storage location information of the image data is performed.

背景技術で示したように、電子ペンを利用した様々なシステムが提案されており、特許文献1には、デジタルペン専用用紙にデジタル写真画像を出力し、その上にデジタルペンで文字等を記入させることにより、手書きメッセージ入り写真画像を印刷する印刷システムが開示されている。しかしながら、このシステムは、予め用紙上に配置された画像に手書きした手書き画像を合成するものであり、用紙に画像を配置する際には、どの画像を用紙上のどの位置に配置するかをユーザが指定しなければならず、煩雑な操作が必要になるという問題があった。

As shown in the background art, various systems using an electronic pen have been proposed.

そこで、本発明の一実施の形態では、用紙や画面の所定の位置に画像を配置する処理に対して電子ペンを利用する。具体的には、用紙や画面上に電子ペンで認識可能な位置検出用パターンを出力し、電子ペンで用紙や画面上に手書きした手書き情報と、デジタルカメラで撮影した画像データやスキャナで読み取った画像データとを取得する。そして、手書きした時刻情報と画像データに予め対応付けられた時刻情報とに基づいて、手書き画像と画像データとを対応付ける。 Therefore, in one embodiment of the present invention, an electronic pen is used for processing to place an image at a predetermined position on a sheet or screen. Specifically, a position detection pattern that is recognizable with an electronic pen is output on paper or a screen, and handwritten information handwritten on the paper or screen with an electronic pen, and image data or a scanner photographed with a digital camera are read. Get image data. The handwritten image and the image data are associated with each other based on the handwritten time information and the time information previously associated with the image data.

例えば、ユーザは、デジタルカメラを用いて写真を撮影したり、スキャナを用いて原稿を読み取ったりする共に、電子ペンを用いて位置検出用パターンが印刷された用紙上若しくは位置検出用パターンが表示された画面上で1又は複数の画像を手書きし、画像合成装置(画像合成プログラム)では、電子ペンで画像を手書きした時刻に近い時刻に、デジタルカメラで撮影若しくはスキャナで読み取った画像データを特定し、その手書き画像で特定される画像合成領域に画像データに基づく画像又は当該画像データの保存場所情報を配置した合成画像を生成する。これにより、電子ペンの操作とデジタルカメラやスキャナの操作とを対応付けることができ、電子ペンで指定した各々の位置に所望の画像を配置した合成画像を容易に作成することができる。 For example, the user takes a picture using a digital camera or reads a document using a scanner, and the electronic pen is used to display a position detection pattern on a sheet of paper on which a position detection pattern is printed. One or more images are handwritten on the screen, and the image composition device (image composition program) specifies image data captured by a digital camera or read by a scanner at a time close to the time when the image was handwritten with an electronic pen. Then, a composite image is generated in which an image based on image data or storage location information of the image data is arranged in an image composition area specified by the handwritten image. Thereby, the operation of the electronic pen can be associated with the operation of the digital camera or the scanner, and a composite image in which a desired image is arranged at each position designated by the electronic pen can be easily created.

以下、位置検出用パターンが印刷された用紙を用いて、デジタルカメラで取得した画像データに基づく画像を用紙上に配置する場合を例にして詳細に説明する。 Hereinafter, a case where an image based on image data acquired by a digital camera is arranged on a sheet using a sheet on which a position detection pattern is printed will be described in detail.

上記した本発明の一実施の形態についてさらに詳細に説明すべく、本発明の一実施例に係る画像合成装置及び画像合成プログラムについて、図1乃至図16を参照して説明する。図1は、本実施例の画像合成システムの構成及び概略動作を示す図であり、図2は、画像合成装置の構成を示すブロック図である。また、図3は、電子ペンの構成を示すブロック図、図4は、デジタルカメラの構成を示すブロック図であり、図5は、アノト(登録商標)パターンの一例を示す図である。また、図6、7、9、11乃至13、15は、画像合成システムの処理を示すフローチャート図であり、図8、10、14、16は、画像合成システムの処理を説明する図である。 In order to describe the above-described embodiment of the present invention in further detail, an image composition apparatus and an image composition program according to an embodiment of the present invention will be described with reference to FIGS. FIG. 1 is a diagram showing the configuration and schematic operation of the image composition system of this embodiment, and FIG. 2 is a block diagram showing the configuration of the image composition device. 3 is a block diagram illustrating the configuration of the electronic pen, FIG. 4 is a block diagram illustrating the configuration of the digital camera, and FIG. 5 is a diagram illustrating an example of an Anoto (registered trademark) pattern. 6, 7, 9, 11 to 13, and 15 are flowcharts illustrating processing of the image composition system, and FIGS. 8, 10, 14, and 16 are diagrams illustrating processing of the image composition system.

図1に示すように、本実施例の画像合成システムは、画像合成処理などを行う画像合成装置10と、アノト(登録商標)パターンに代表される位置検出用パターンを検出する電子ペン20と、合成対象となる画像(入力画像と呼ぶ。)を提供するデジタルカメラ30などで構成される。

As shown in FIG. 1, the image composition system of the present embodiment includes an image composition device 10 that performs image composition processing, an

上記画像合成システムの概略動作を説明すると、まず、画像合成装置10にて、位置検出用パターンを印刷した用紙(手書き入力用紙と呼ぶ。)を作成する。そして、作成した手書き入力用紙に電子ペン20で文字や図を記入するだけでなく、入力画像をどのページのどの位置に入力するかを指示する所定の操作(画像合成領域を描画する操作)も行う。このような手書きを行った電子ペン20に保存される情報(手書き情報と呼ぶ。)には、電子ペン20の移動軌跡を示す手書き画像と共に手書きした時刻情報も含まれる。

The schematic operation of the image composition system will be described. First, the image composition apparatus 10 creates a paper (referred to as handwritten input paper) on which a position detection pattern is printed. In addition to writing characters and diagrams on the created handwriting input sheet with the

一方、合成対象となる入力画像は、手書き作業と共にデジタルカメラ30により撮影され、所定のフォーマットの画像データとしてメモリカードや画像合成装置10、サーバなどに保存される。その際、画像データのヘッダなどには、撮影時刻や画像データの保存時刻などの時刻情報が書き込まれる。

On the other hand, the input image to be synthesized is taken by the

その後、画像合成装置10は、電子ペン20から手書き情報を取り込むと共に、デジタルカメラ30やサーバなどから画像データを取り込み(又は画像データの保存場所情報を取得し)、手書き画像を解析する。そして、手書き画像が画像合成領域を表す場合は、手書きした時刻情報と画像データに対応付けられた時刻情報とを比較することによって、画像合成領域と画像データとを対応付け、各々の画像合成領域に画像データに基づく画像又は当該画像データの保存場所情報を合成し、合成画像を印刷したり、ファイルで出力したりする。

Thereafter, the image composition device 10 captures handwritten information from the

なお、本実施例では、上記画像合成装置10を、手書き入力用紙を作成する印刷機能を備えた装置(例えば、複写機や複合機(MFP:Multi Function Peripheral)などの画像形成装置)とするが、位置検出用パターンを画面上に表示する場合は、表示機能を備えた装置(例えば、電子ペーパーや電子ブック、携帯端末、コンピュータ装置など)とすることもできる。以下、各々の装置の構成について図面を参照して説明する。 In the present embodiment, the image composition apparatus 10 is an apparatus having a printing function for creating handwritten input paper (for example, an image forming apparatus such as a copier or a multi function peripheral (MFP)). When the position detection pattern is displayed on the screen, a device having a display function (for example, electronic paper, electronic book, portable terminal, computer device, etc.) can be used. Hereinafter, the configuration of each apparatus will be described with reference to the drawings.

[画像合成装置]

図2に示すように、画像合成装置10は、コントローラ部と、コントローラ部によって制御される各種装置と、で構成され、コントローラ部は、制御部11、通信部12、表示・操作部13、画像入力部14、画像出力部15、データ記憶部16、画像処理部17などで構成される。

[Image composition device]

As illustrated in FIG. 2, the image composition device 10 includes a controller unit and various devices controlled by the controller unit. The controller unit includes a control unit 11, a communication unit 12, a display /

制御部11は、CPU(Central Processing Unit)と、ROM(Read Only Memory)やRAM(Random Access Memory)などのメモリとで構成され、CPUは、ROMに保存されている制御プログラムをRAMに展開して実行し、画像合成装置10の全体制御を行う。本実施例では、特に、位置検出用パターンをメモリや外部のコンピュータ装置から読み出し、画像出力部15を制御して、画像出力装置19に手書き入力用紙を印刷させる処理や、電子ペン20から手書き情報を取得すると共にデジタルカメラ30や自装置、他の装置(画像合成装置10にネットワーク接続されたサーバ)などから画像データを取得(又は当該画像データの保存場所情報を取得)し、手書き画像が画像合成領域を表す場合は、手書きした時刻情報と画像データに対応付けられた時刻情報とを比較して画像合成領域と画像データとを対応付け、画像処理部17を制御して、各々の画像合成領域に画像データに基づく画像又は当該画像データの保存場所情報(リンク先のアドレスなど)を合成し、画像出力部15を制御して、画像出力装置19に合成画像を印刷させたり、通信部12を介して、合成画像データを出力したりする処理を行う。

The control unit 11 includes a CPU (Central Processing Unit) and a memory such as a ROM (Read Only Memory) and a RAM (Random Access Memory). The CPU expands a control program stored in the ROM to the RAM. And execute overall control of the image composition apparatus 10. In the present embodiment, in particular, a process for reading a position detection pattern from a memory or an external computer device, controlling the

通信部12は、様々なプロトコルを制御し、デジタルカメラ30やサーバなどからの画像データの入力、電子ペン20からの手書き情報の入力、コンピュータ装置からの位置検出用パターンのダウンロードを行う入力部と、合成画像データの外部のコンピュータ装置への送信を行う出力部として機能する。

The communication unit 12 controls various protocols, inputs an image data from the

表示・操作部13は、LCD(Liquid Crystal Display)や有機EL(electroluminescence)ディスプレイ上に透明電極が格子状に配置されたタッチパネルなどであり、ユーザへの情報表示とユーザからの情報入力を受け付ける。

The display /

画像入力部14は、画像入力装置18(例えば、スキャナ)からの画像入力を制御する部分であり、手書き入力用紙の作成時に位置検出用パターンに合成する画像や、画像合成領域に合成する画像の取り込みを制御する。なお、デジタルカメラ30や自装置、サーバなどから取得した画像のみを使用する場合は、画像入力部14及び画像入力装置18を省略することもできる。

The

画像出力部15は、画像出力装置19(例えば、プリンタ)への画像出力を制御する部分であり、位置検出用パターンの印刷や、画像合成領域に画像又は当該画像の保存場所情報を合成した合成画像の印刷を制御する。

The

データ記憶部16は、HDD(Hard Disk Drive)などであり、画像データ、手書き情報、その他システムの情報など記憶する。

The

画像処理部17は、手書き入力用紙への位置検出用パターンの合成、画像合成領域への画像の合成、画像合成領域に合成する画像に対する変倍・回転・トリミングなどの処理を行う。 The image processing unit 17 performs processing such as composition of a position detection pattern on a handwriting input sheet, composition of an image on an image composition area, and scaling, rotation, and trimming of an image to be synthesized on the image composition area.

なお、図2では、画像を合成する処理を画像処理部17で実行する構成とするが、手書き情報と画像データを入力し、手書き情報の時刻情報と画像データの時刻情報に基づいて手書き画像と画像データとを対応付け、手書き画像で特定される画像合成領域に画像データに基づく画像を合成して出力する一連の処理を、制御部11で動作する画像合成プログラムによって実行する構成としてもよい。 In FIG. 2, the image synthesizing process is performed by the image processing unit 17, but handwritten information and image data are input, and the handwritten image and the time information of the image data are input based on the time information of the handwritten information and the time information of the image data. A series of processes for associating with image data and synthesizing and outputting an image based on the image data in an image synthesis area specified by a handwritten image may be executed by an image synthesis program operating in the control unit 11.

[電子ペン]

図3に示すように、電子ペン20は、制御部21、通信部22、バッテリー23、操作部24、撮像部25、圧力検知部26、筆記部27、時計部28、データ記憶部29などで構成される。

[Electronic pen]

As shown in FIG. 3, the

制御部21は、CPUと、ROMやRAMなどのメモリとで構成され、CPUは、ROMに保存されている制御プログラムをRAMに展開して実行し、電子ペン20の全体制御を行う。

The control unit 21 includes a CPU and a memory such as a ROM or a RAM. The CPU expands and executes a control program stored in the ROM on the RAM and performs overall control of the

通信部22は、Bluetooth(登録商標)に代表される短距離無線通信や赤外線通信、有線通信により、画像合成装置10への手書き情報の送信を制御する。

The

バッテリー23は、一次電池または二次電池であり、電子ペン20の各部に電力を供給する。

The battery 23 is a primary battery or a secondary battery, and supplies power to each part of the

操作部24は、電子ペン20本体に設けられたボタンなどであり、手書きの開始/終了の指示、画像合成装置10への手書き情報の送信指示などを行う。

The

撮像部25は、位置検出用パターンを読み取るための小型のCCDまたはCMOS(Complementary Metal Oxide Semiconductor)ビデオカメラである。

The

圧力検知部26は、電子ペン20の筆圧を検知するための圧電素子などである。

The pressure detection unit 26 is a piezoelectric element or the like for detecting the writing pressure of the

筆記部27は、圧力検知部26が筆圧を検知した時に撮像部25が読み取った位置検出用パターンに基づいて、電子ペン20の手書き入力用紙上の位置を特定し、電子ペン20の移動軌跡で特定される手書き画像を生成する。なお、本明細書における手書き画像は、手書き入力用紙上で電子ペン20が移動した軌跡の全体で特定される画像ではなく、1つのオブジェクトとして認識可能な画像を意味する。例えば、電子ペン20が手書き入力用紙から離れることなく一筆書きで描画した文字や図形は、1つのオブジェクトとして認識でき、手書き画像の一単位を構成する。また、手書き画像の一単位は一筆書きにより得られる画像に限る必要はなく、たとえば電子ペン20が手書き入力用紙から離れるが、所定時間内に描画した文字や図形も1つの手書き画像と扱っても良い。更に、電子ペン20が手書き入力用紙から離れるが、個々の軌跡が所定の距離範囲内に集まっている文字や図形についても、1つの手書き画像として扱っても良い。従って、矩形のような図形は、一筆書きで描画しても、漢字の”口”のような筆順で描画しても、1つの手書き画像として扱ってもよい。

The writing unit 27 specifies the position of the

時計部28は、筆記部27が手書き画像を生成した時刻を特定する。

The

データ記憶部29は、フラッシュメモリなどであり、筆記部27が生成した手書き画像と時計部28が特定した時刻情報とを対応付けて記憶する。その際、各々の手書き画像に対して少なくとも1つの時刻情報が対応付け可能であればよい。例えば、撮像部25が位置検出用パターンを読み取る度に時刻情報を取得する場合は、手書き画像の各点に時刻情報を対応付けてもよいし、電子ペン20の移動軌跡の始点や終点などの特定の地点で時刻情報を取得する場合は、各々の手書き画像に地点数に応じた時刻情報を対応付けてもよい。

The data storage unit 29 is a flash memory or the like, and stores the handwritten image generated by the writing unit 27 and the time information specified by the

なお、電子ペン20は、用紙に印刷若しくは画面に表示される位置検出用パターンを認識して、用紙上若しくは画面上の位置を特定し、手書き画像と時刻情報とを対応付けて手書き情報として出力する機能を備えていればよく、その構成や形状、通信方法などは特に限定されない。

The

[デジタルカメラ]

図4に示すように、デジタルカメラ30は、制御部31、通信部32、バッテリー33、表示・操作部34、撮像部35、時計部36、データ記憶部37などで構成される。

[Digital camera]

As shown in FIG. 4, the

制御部31は、CPUと、ROMやRAMなどのメモリとで構成され、CPUは、ROMに保存されている制御プログラムをRAMに展開して実行し、デジタルカメラ30の全体制御を行う。

The

通信部32は、Bluetooth(登録商標)に代表される短距離無線通信や赤外線通信、有線通信により、画像合成装置10への画像データの送信を制御する。 The communication unit 32 controls transmission of image data to the image composition device 10 by short-range wireless communication represented by Bluetooth (registered trademark), infrared communication, or wired communication.

バッテリー33は、一次電池または二次電池であり、デジタルカメラ30の各部に電力を供給する。

The battery 33 is a primary battery or a secondary battery, and supplies power to each part of the

表示・操作部34は、LCDや有機ELディスプレイ上に透明電極が格子状に配置されたタッチパネルや、デジタルカメラ30本体に設けられたボタンなどであり、撮影の開始/終了の指示、画像データの保存の指示、画像合成装置10への画像データの送信指示などを行う。

The display /

撮像部35は、合成対象となる画像データを取得するためのCCDまたはCMOSビデオカメラである。 The imaging unit 35 is a CCD or CMOS video camera for acquiring image data to be combined.

時計部36は、画像を撮影した時刻や画像データを保存した時刻を特定する。 The clock unit 36 specifies the time when the image was captured and the time when the image data was saved.

データ記憶部37は、フラッシュメモリなどであり、撮像部35で取得した画像データに、時計部36で特定した時刻情報を付加(例えば、画像データのヘッダに時刻情報を記述)して記憶する。 The data storage unit 37 is a flash memory or the like, and adds the time information specified by the clock unit 36 to the image data acquired by the imaging unit 35 (for example, describes the time information in the header of the image data) and stores it.

なお、デジタルカメラ30は、画像データに時刻情報を付加して出力する機能を備えていればよく、その構成や形状、画像データの記録フォーマットなどは特に限定されない。また、本実施例では、デジタルカメラ30に画像データを保存する構成とするが、デジタルカメラ30で取得した画像データを画像合成装置10やサーバなどに保存してもよい。また、本実施例では、デジタルカメラ30から画像データを取得する構成とするが、デジタルカメラ機能を備えた携帯電話機から画像データを取得してもよいし、予め記憶された画像データに対してトリミングやサイズ変換、色変換などの画像処理を行うコンピュータ装置から画像処理の時刻情報を付加した画像データを取得してもよい。また、画像合成装置10の画像入力装置18(スキャナ)で取得した画像データのみを使用する場合は、デジタルカメラ30は不要である。

The

図5は、手書き入力用紙に印刷若しくは画面に表示されるアノト(登録商標)パターンの一例である。このアノト(登録商標)パターンは、格子状に配置されたドットパターンであり、各ドットは0.3mm間隔で直交する格子から上下左右いずれかの方向へ僅かにずれていて、撮像部25によって、1度に縦6×横6ドット、計36ドットのマトリクス単位で読み込まれる。このアノト(登録商標)パターンはどの点をとっても一意な値であり、電子ペン20で書かれた軌跡はすべて異なる位置情報として認識できる。

FIG. 5 is an example of an Anoto (registered trademark) pattern printed on handwritten input paper or displayed on the screen. This Anoto (registered trademark) pattern is a dot pattern arranged in a grid pattern, and each dot is slightly shifted from the grid perpendicular to each other at intervals of 0.3 mm in either the top, bottom, left, or right direction. The data is read in a matrix unit of 6 dots vertically and 6 dots horizontally, for a total of 36 dots. This Anoto (registered trademark) pattern is a unique value at any point, and the trajectory written with the

以下、本実施例の画像合成システムの動作について、図6、7、9、11乃至13、15のフローチャート図、及び、図8、10、14、16の説明図を参照して説明する。 Hereinafter, the operation of the image composition system of the present embodiment will be described with reference to the flowcharts of FIGS. 6, 7, 9, 11 to 13, and 15 and the explanatory diagrams of FIGS.

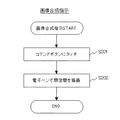

本実施例の画像合成システムの概略動作は図6に示す通りである。まず、画像合成装置10は、位置検出用パターンを印刷した手書き入力用紙を作成し(S100)、ユーザは、電子ペン20を用いて手書き入力用紙に手書きし、画像合成指示を入力する(S200)。次に、画像合成装置10は、電子ペン20から手書き情報の取り込みを行い(S300)、デジタルカメラ30や自装置、サーバなどから画像データの取り込み(又は画像データの保存場所情報の特定)を行う(S400)。そして、画像合成装置10は、手書き情報を解析して画像合成指示を認識し、時刻情報に基づいて画像合成領域に合成する画像データを選択し(S500)、画像合成領域に選択した画像データに基づく入力画像又は画像データの保存場所情報を合成して(S600)、合成画像を出力する(S700)。以下、各ステップについて、個別に説明する。

The schematic operation of the image composition system of this embodiment is as shown in FIG. First, the image synthesizing apparatus 10 creates a handwriting input sheet on which a position detection pattern is printed (S100), and the user performs handwriting on the handwriting input sheet using the

[S100の手書き入力用紙作成]

図7に示すように、ユーザが画像合成装置10の表示・操作部13を操作して、手書き入力用紙の作成を指示し(S101)、手書き入力用紙に合成する原稿画像を選択する(S102)。ここでは、原稿画像を合成するか否か、原稿画像を合成する場合は、ファイル名を指定してコンピュータ装置から入力するか、画像入力装置18(スキャナ)で画像を取り込むか、などが選択できるものとする。

[Create handwritten input paper in S100]

As shown in FIG. 7, the user operates the display /

次に、画像合成装置10のコントローラ部(制御部11)は、S102の選択結果に基づいて原稿画像を読み込んだ後、データ記憶部16に予め記憶された位置検出用パターンの中からそのページに印刷する位置検出用パターンを取得し(S103)、画像処理部17は、原稿画像に位置検出用パターンを合成する(S104)。そして、画像出力部15は、合成画像を画像出力装置19(プリンタ)に送り、画像出力装置19は、合成画像を手書き入力用紙に印刷する(S105)。この手書き入力用紙には、後述するように、入力画像の合成を指示するためのコマンドボタンなどが設けられている。その後、制御部11は、次のページがあるかを判断し(S106)、次のページがある場合は、S103に戻って同様の処理を繰り返す。

Next, the controller unit (control unit 11) of the image synthesizing apparatus 10 reads the document image based on the selection result of S102, and then selects the page from the position detection patterns stored in advance in the

図8は、上記手書き入力用紙作成処理を模式的に示す図である。データ記憶部16には、複数ページ分の位置検出用パターンが記憶されており、各ページに異なる位置検出用パターンが印刷される。また、手書き入力用紙には、S102で原稿画像なしを選択した場合は、位置検出用パターンのみが印刷され、S102でファイルを指定した場合は、プリント画像に位置検出用パターンを合成した合成画像が印刷され、S102で画像取り込みを選択した場合は、スキャン画像に位置検出用パターンを合成した合成画像が印刷される。

FIG. 8 is a diagram schematically showing the handwriting input paper creation process. The

なお、本実施例では、手書き入力用紙を印刷する構成としているが、画面上で手書きを行う場合は、位置検出用パターンのみの画像、プリント画像に位置検出用パターンを合成した画像、スキャン画像に位置検出用パターンを合成した画像などを表示部に表示させる構成としてもよい。 In this embodiment, the handwriting input sheet is printed. However, when handwriting is performed on the screen, an image of only the position detection pattern, an image obtained by combining the position detection pattern with the print image, and a scan image are used. An image obtained by combining the position detection patterns may be displayed on the display unit.

[S200の画像合成指示]

まず、ユーザは、合成したい写真や動画などをデジタルカメラ30で撮影し、撮影や保存の時刻情報を対応付けた画像データをデータ記憶部37や画像合成装置10、サーバなどに保存する。そして、撮影に並行して、手書き入力用紙を用いて画像合成指示を行う。具体的には、図9に示すように、その画像を取り込みたいページのコマンドボタンをタッチし(S201)、電子ペン20で閉領域ができるように描画することによって、画像合成を指示する(S202)。この処理を、合成する画像の数だけ繰り返す。この時、手書きペン20のデータ記憶部29には、撮像部25が認識した位置検出用パターンによって特定される一連の位置情報(手書き画像)と手書きを行った時刻情報とが対応付けて保存される。

[Image composition instruction in S200]

First, the user captures a photograph, a moving image, or the like to be combined with the

なお、画像の合成指示は、画像を取り込みたい場所や大きさを電子ペン20で入力することによって行うが、指示方法としては、例えば、図10に示す3つの指示方法が考えられる。

The image composition instruction is performed by inputting the location and size of the image to be captured with the

第1の指示方法は、図9のフローチャートで示した方法であり、手書き入力用紙に予め印刷されているコマンドボタンの部分を電子ペン20でタッチした後、閉領域の輪郭(ここでは円)を描画する方法である。この場合は、コマンドボタン入力とそれに続く閉領域の輪郭描画を検出した場合に、画像合成指示であると認識する。なお、以下に示す手書き情報の取り込みでは、この方法で画像合成が指示されたものとする。

The first instruction method is the method shown in the flowchart of FIG. 9. After touching the command button portion printed in advance on the handwritten input paper with the

第2の指示方法は、閉領域の輪郭(ここでは矩形)を描画し、その中に特定のマーク(ここではチェックマーク)を描画する方法である。この場合は、閉領域の輪郭が描画されたことを認識し、その中に特定のマークが続いて入力された場合に、画像合成指示であると認識する。 The second instruction method is a method of drawing an outline (here, a rectangle) of a closed region and drawing a specific mark (here, a check mark) therein. In this case, it is recognized that the outline of the closed region has been drawn, and when a specific mark is subsequently input therein, it is recognized as an image composition instruction.

第3の指示方法は、特定の文字(ここでは“photo”という文字)を描画し、その後、文字を囲むように閉領域の輪郭(ここでは矩形)を描画する方法である。この場合は、特定の文字を認識し、それに続いて閉領域の輪郭が入力された場合に、画像合成指示であると認識する。 The third instruction method is a method of drawing a specific character (here, the character “photo”), and then drawing a closed region outline (here, a rectangle) so as to surround the character. In this case, when a specific character is recognized and a contour of a closed region is subsequently input, it is recognized as an image synthesis instruction.

なお、画像合成指示の方法は上記に限定されない。例えば、第1の指示方法において、閉領域の輪郭を描画した後にコマンドボタンをタッチしてもよいし、第2の指示方法において、特定のマークを描画した後にそのマークを囲むように閉領域の輪郭を描画してもよいし、第3の指示方法において、閉領域の輪郭を描画した後にその中に特定の文字を描画にしてもよい。また、第1の指示方法では円を描画し、第2及び第3の指示方法では矩形を描画したが、閉領域の輪郭を表す図形であればどのような図形であってもよい。 The method for instructing image composition is not limited to the above. For example, in the first instruction method, the command button may be touched after drawing the outline of the closed area. In the second instruction method, the closed area is surrounded so as to surround the mark after drawing a specific mark. The contour may be drawn, or in the third instruction method, after the contour of the closed region is drawn, a specific character may be drawn therein. Further, although a circle is drawn in the first instruction method and a rectangle is drawn in the second and third instruction methods, any figure may be used as long as it represents a contour of the closed region.

[S300の手書き情報取り込み]

図11に示すように、まず、画像合成装置10のコントローラ(制御部11)は、無線通信、赤外線通信、有線通信などにより電子ペン20と交信して(S301)、電子ペン20に保存されている手書き情報(手書き画像及び時刻情報)を取得し(S302)、取得した手書き画像の位置情報から、ページを認識する(S303)。

[Capturing handwritten information in S300]

As shown in FIG. 11, first, the controller (control unit 11) of the image composition device 10 communicates with the

次に、制御部11は、手書き画像の位置情報が予め定義されたコマンドボタンの領域であるかを調べることにより、画像合成指示コマンドを検出する(S304)。画像合成指示コマンドが検出されなかった場合は、制御部11は、通常の手書き情報として手書き画像をデータ記憶部16に保存する(S309)。

Next, the control unit 11 detects an image composition instruction command by checking whether the position information of the handwritten image is a predefined command button region (S304). When the image composition instruction command is not detected, the control unit 11 stores the handwritten image in the

一方、画像合成指示コマンドが検出された場合は、制御部11は、手書き画像に対応付けられた時刻情報を読み取り(S305)、手書き画像で示される閉領域を検出する(S306)。そして、制御部11は、その閉領域の外接矩形の位置を計算し(S307)、ページ情報と、矩形のサイズ及び位置(座標)と、時刻情報とを記述した画像合成指示情報をリスト化して、データ記憶部16に保存する(S308)。 On the other hand, when the image composition instruction command is detected, the control unit 11 reads time information associated with the handwritten image (S305), and detects a closed region indicated by the handwritten image (S306). Then, the control unit 11 calculates the position of the circumscribed rectangle of the closed region (S307), and lists image composition instruction information describing page information, the size and position (coordinates) of the rectangle, and time information. The data is stored in the data storage unit 16 (S308).

次に、制御部11は、次の手書き情報があるかを判断し(S310)、次の手書き情報があればS302に戻って同様の処理を繰り返す。 Next, the control unit 11 determines whether there is next handwritten information (S310), and if there is next handwritten information, returns to S302 and repeats the same processing.

[S400の画像データ取り込み]

図12に示すように、画像合成装置10のコントローラ(制御部11)は、無線通信、赤外線通信、有線通信などにより画像データが保存されているデジタルカメラ30やサーバなどと交信し(S401)、表示・操作部13に、デジタルカメラ30のデータ記憶部37や自装置、サーバなどのフォルダを表示させる。次に、ユーザが表示・操作部13を操作して、画像データが保存されているフォルダを選択すると(S402)、制御部11は、選択されたフォルダから画像データを取得し(S403)、データ記憶部16に保存する(S404)。保存される画像データには、撮影時刻や保存時刻、ファイル名(ファイル番号)、画像サイズなどの情報が付加されている。

[Import image data in S400]

As shown in FIG. 12, the controller (control unit 11) of the image composition device 10 communicates with a

なお、ここでは、デジタルカメラ30のフォルダを表示・操作部13に表示させて、その中から所望のフォルダをユーザに選択させる構成としているが、フォルダの表示や選択を省略して、デジタルカメラ30に保存されている全ての画像データを取り込むようにしてもよい。また、ここでは、画像データを取り込んでデータ記憶部16に保存する構成とするが、後述する画像合成ステップで画像データの保存場所情報を合成する場合は、必ずしも画像データを取り込む必要はなく、画像データが保存されているフォルダのディレクトリ情報を取得してデータ記憶部16に保存すればよい。

Here, the folder of the

[S500の入力画像選択]

図13に示すように、画像合成装置10のコントローラ(制御部11)は、データ記憶部16から画像合成指示情報のリストを読み込み(S501)、その中から画像合成指示情報を1つ選択して、その指示情報に記述された時刻情報を取得する(S502)。次に、制御部11は、データ記憶部16に保存した(又はデジタルカメラ30のデータ記憶部37やサーバに保存されている)画像データに対応付けられた時刻情報を取得し(S503)、これらの時刻情報を比較して、画像合成指示情報に記述された時刻と同じ、若しくはそれよりも前で最も近い時刻の画像データを選択する(S504)。

[Select input image in S500]

As shown in FIG. 13, the controller (control unit 11) of the image composition device 10 reads a list of image composition instruction information from the data storage unit 16 (S501), selects one image composition instruction information from the list. Then, the time information described in the instruction information is acquired (S502). Next, the control unit 11 acquires time information associated with the image data stored in the data storage unit 16 (or stored in the data storage unit 37 or the server of the digital camera 30) (S503). Are compared with each other, and the image data at the time closest to or earlier than the time described in the image composition instruction information is selected (S504).

そして、制御部11は、選択した画像データのファイル名やサムネイル画像を表示・操作部13に表示してユーザに確認した後、選択した画像データのファイル名を画像合成指示情報のリストに追加して保存する(S506)。その後、制御部11は、次の画像合成指示情報があるかを判断し(S507)、次の画像合成指示情報があればS502に戻って同様の処理を繰り返す。

Then, the control unit 11 displays the file name and thumbnail image of the selected image data on the display /

なお、ここでは、選択した画像データのファイル名やサムネイル画像を表示・操作部13に表示してユーザに確認しているが、このステップを省略して直ちにリストに追加してもよい。また、ここでは、画像合成指示情報に記述された時刻と同じ、若しくはそれよりも前で最も近い時刻に撮影/保存された画像データを選択する構成としているが、その選択基準の詳細は別途ユーザが指定することも可能である。例えば、リストN番目の画像合成指示に対応する画像データを選択する場合に、(N−1)番目の画像合成指示の時刻からN番目の画像合成指示の時刻の間に撮影/保存された複数の画像データをリスト表示してユーザが選択する方法、画像合成指示の時刻と同じ、若しくはそれよりも後で最も近い時刻に撮影/保存された画像データを選択する方法などを用いることも可能である。

Here, the file name and thumbnail image of the selected image data are displayed on the display /

図14は、上記入力画像選択処理を模式的に示す図である。デジタルカメラ30などから取り込んだ(又はデジタルカメラ30や画像合成装置10、サーバなどに保存されている)画像データには撮影時刻や保存時刻などの時刻情報が対応付けられている。一方、電子ペン20から取り込んだ手書き情報にも手書きを行った時刻情報が対応付けられており、画像合成指示情報には、ページ情報と矩形のサイズ及び位置と時刻情報とが記述されている。そして、これらの時刻情報に基づいて手書きした矩形とその矩形に合成する入力画像との対応付けを行う。

FIG. 14 is a diagram schematically showing the input image selection process. Image data captured from the

例えば、No.1の矩形が手書きされた時刻は12:12であり、ファイル名が#1の画像データの撮影/保存時刻は12:12であり、手書きされた時刻と同じ時刻であることから、No.1の矩形に合成する画像データとして#1の画像データを選択し、そのファイル名#1を画像合成指示情報のリストに追加する。また、No.2の矩形が手書きされた時刻は13:01であり、ファイル名が#2の画像データの撮影/保存時刻は13:00であり、手書きされた時刻よりも前で最も近い時刻であることから、No.2の矩形に合成する画像データとして#2の画像データを選択し、そのファイル名#2を画像合成指示情報のリストに追加する。また、No.3、No.4の矩形に対しても同様の選択基準により#3、#5の画像データを選択し、そのファイル名#3、#5を画像合成指示情報のリストに追加する。

For example, the time when the rectangle No.1 was handwritten is 12:12, and the image data with the

[S600の画像合成]

図15に示すように、画像合成装置10のコントローラ(画像処理部17)は、データ記憶部16から、手書き画像と画像合成指示情報のリストとリストで指定された画像データ(又は画像データの保存場所情報)とを読み込む(S601〜S603)。次に、画像処理部17は、画像合成指示情報で規定された矩形のサイズとその矩形に合成する画像データに基づく画像のサイズとを比較し、その矩形に画像が適切に収まるように、センタリング、変倍などの値を決定する(S604)。そして、画像処理部17は、決定した値に基づいて、各々の画像に対して変倍処理、センタリング処理を行った後(S605、S606)、画像の合成処理を行い(S607)、合成画像データをデータ記憶部16に保存する(S608)。

[Image composition in S600]

As shown in FIG. 15, the controller (image processing unit 17) of the image synthesizing apparatus 10 stores, from the

図16は、上記画像合成処理を模式的に示す図である。例えば、合成する入力画像と矩形のサイズが異なる場合は、矩形に画像が収まるように画像を拡大/縮小し、合成する入力画像と矩形の縦横比が異なる場合は、矩形の略中央に画像が配置されるようにセンタリングを調整する。そして、原稿画像に入力画像(又は入力画像の保存場所情報)と手書き画像を合成してページ画像を生成する。なお、ここでは、原稿画像に入力画像と手書き画像を合成したが、原稿画像に入力画像のみを合成してもよいし、入力画像と手書き画像のみを合成してもよい。 FIG. 16 is a diagram schematically illustrating the image composition process. For example, if the size of the rectangle differs from the input image to be combined, the image is enlarged / reduced so that the image fits in the rectangle. If the aspect ratio of the input image to be combined and the rectangle is different, the image is approximately at the center of the rectangle. Adjust the centering so that it is positioned. Then, a page image is generated by combining the input image (or input image storage location information) and the handwritten image with the document image. Although the input image and the handwritten image are combined with the original image here, only the input image may be combined with the original image, or only the input image and the handwritten image may be combined.

[S700の合成画像出力]

画像合成装置10のコントローラ(制御部11)は、画像処理部17で生成した合成画像データを画像出力部15に送り、画像出力部15は画像出力装置19を制御して、原稿画像に入力画像(又は入力画像の保存場所情報)と手書き画像を合成した合成画像を印刷する。なお、ユーザのコンピュータ装置などに合成画像データを出力してコンピュータ装置の表示部に合成画像を表示してもよく、入力画像の保存場所情報を合成した場合は、その保存場所情報をクリックすることにより、その保存場所から画像データが取り込まれて入力画像が表示されるようにしてもよい。また、サーバやUSB(Universal Serial Bus)メモリなどに合成画像データを出力して合成画像データを保存してもよいし、合成画像データをメールに添付して送信してもよい。

[Composite image output in S700]

The controller (control unit 11) of the image composition device 10 sends the composite image data generated by the image processing unit 17 to the

以上説明したように、本実施例の画像合成装置10では、デジタルカメラ30などから画像データを取得すると共に、電子ペン20から手書き情報を取得すると、画像合成領域が手書きされているかを判断し、画像合成領域が手書きされている場合は、手書きした時刻と画像データの撮影/保存時刻とを比較し、予め定められたルールに従って、画像合成領域に合成する画像データを選択し、画像合成領域に画像データに基づく画像又は当該画像データの保存場所情報を合成した合成画像データを出力する制御を行うため、用紙や画面上の所定の位置に簡便に画像を合成することができる。

As described above, in the image composition device 10 according to the present embodiment, when image data is acquired from the

なお、本発明は上記実施例に限定されるものではなく、本発明の趣旨を逸脱しない限りにおいて、各装置の構成や制御は適宜変更可能である。 The present invention is not limited to the above-described embodiments, and the configuration and control of each device can be changed as appropriate without departing from the spirit of the present invention.

本発明は、用紙上や画面上の所定の位置に入力画像を合成する画像合成装置及び該画像合成装置を備えるシステムに利用可能である。 The present invention can be used for an image composition device that composes an input image at a predetermined position on a sheet or a screen and a system including the image composition device.

10 画像合成装置

11 制御部

12 通信部

13 表示・操作部

14 画像入力部

15 画像出力部

16 データ記憶部

17 画像処理部

18 画像入力装置

19 画像出力装置

20 電子ペン

21 制御部

22 通信部

23 バッテリー

24 操作部

25 撮像部

26 圧力検知部

27 筆記部

28 時計部

29 データ記憶部

30 デジタルカメラ

31 制御部

32 通信部

33 バッテリー

34 表示・操作部

35 撮像部

36 時計部

37 データ記憶部

DESCRIPTION OF SYMBOLS 10 Image composition apparatus 11 Control part 12

Claims (11)

前記手書き画像に対応付けられた少なくとも1つの時刻情報と前記画像データに対応付けられた時刻情報とに基づいて、各々の手書き画像に、当該手書き画像を手書きした時刻に最も近い時刻に撮影又は保存された画像データを対応付ける制御部と、

前記手書き画像で特定される閉領域内に、当該手書き画像に対応付けられた画像データに基づく入力画像又は当該画像データの保存場所情報を合成する画像処理部と、

合成結果を出力する出力部と、を少なくとも備える、

ことを特徴とする画像合成装置。 Time information is associated in advance with handwritten information in which one or a plurality of handwritten images representing the movement trajectory of the electronic pen on the paper or the screen and at least one time information specifying the time when the image is handwritten are associated with each other. was, the image data taken by a digital camera, and / or an input unit for repeatedly inputting the image data read by the scanner, and

Based on at least one time information associated with the handwritten image and time information associated with the image data, each handwritten image is captured or stored at a time closest to the time when the handwritten image is handwritten. A control unit for associating the processed image data ,

An image processing unit that synthesizes an input image based on image data associated with the handwritten image or storage location information of the image data in a closed region specified by the handwritten image;

An output unit that outputs a synthesis result,

An image composition device characterized by the above.

ことを特徴とする請求項1に記載の画像合成装置。 The control unit determines whether the handwritten image is a predetermined specific image, and associates the handwritten image with the image data when the handwritten image is the specific image.

The image synthesizing device according to claim 1.

ことを特徴とする請求項2に記載の画像合成装置。 The specific image is an image in which a contour of a closed region is drawn after pointing to a predetermined command region on paper or a screen, and an image in which a predetermined character or symbol is drawn in the closed region after the contour of the closed region is drawn , After drawing a predetermined character or symbol, any one of the images depicting the outline of the closed region surrounding the predetermined character or symbol,

The image synthesizing apparatus according to claim 2.

ことを特徴とする請求項1乃至3のいずれか一に記載の画像合成装置。 The image processing unit compares the size of the input image with the size of the closed region or a rectangle circumscribing the closed region, and adjusts the arrangement and / or magnification of the input image based on the comparison result .

The image synthesizing apparatus according to claim 1, wherein the image synthesizing apparatus is an image synthesizing apparatus.

ことを特徴とする請求項1乃至4のいずれか一に記載の画像合成装置。 The output unit prints an original image and a pattern that allows the electronic pen to recognize a position on the paper on a handwritten input paper, and outputs the input image or the input image within the closed region of the original image on the output paper. Printing an image obtained by combining the storage location information or an image obtained by combining a handwritten image other than the specific image ;

The image composition device according to claim 1, wherein

前記装置に、

前記入力部に、用紙上若しくは画面上の電子ペンの移動軌跡を表す1又は複数の手書き画像と当該画像を手書きした時刻を特定する少なくとも1つの時刻情報とが対応付けられた手書き情報と、予め時刻情報が対応付けられた、デジタルカメラで撮影した画像データ、及び/又は、スキャナで読み取った画像データと、を繰り返し入力させる第1の処理、

前記手書き画像に対応付けられた少なくとも1つの時刻情報と前記画像データに対応付けられた時刻情報とに基づいて、各々の手書き画像に、当該手書き画像を手書きした時刻に最も近い時刻に撮影又は保存された画像データを対応付ける第2の処理、

前記手書き画像で特定される閉領域内に、当該手書き画像に対応付けられた画像データに基づく入力画像又は当該画像データの保存場所情報を合成する第3の処理、

前記出力部に、合成結果を出力させる第4の処理、を実行させる、

ことを特徴とする画像合成プログラム。 An image synthesis program that operates on an apparatus including an input unit and an output unit,

In the device,

Handwritten information in which one or a plurality of handwritten images representing the movement locus of the electronic pen on the paper or the screen and at least one time information specifying the time when the image is handwritten are associated with the input unit; First processing for repeatedly inputting image data captured by a digital camera and / or image data read by a scanner, associated with time information;

Based on at least one time information associated with the handwritten image and time information associated with the image data, each handwritten image is captured or stored at a time closest to the time when the handwritten image is handwritten. A second process for associating the processed image data,

A third process for synthesizing the input image based on the image data associated with the handwritten image or the storage location information of the image data in the closed region specified by the handwritten image;

Causing the output unit to execute a fourth process of outputting a synthesis result ;

An image composition program characterized by that .

ことを特徴とする請求項6に記載の画像合成プログラム。 In the second process, it is determined whether the handwritten image is a predetermined specific image, and when the handwritten image is the specific image, the handwritten image is associated with the image data .

An image composition program according to claim 6 .

ことを特徴とする請求項7に記載の画像合成プログラム。 The specific image is an image in which a contour of a closed region is drawn after pointing to a predetermined command region on paper or a screen, and an image in which a predetermined character or symbol is drawn in the closed region after the contour of the closed region is drawn , After drawing a predetermined character or symbol, any one of the images depicting the outline of the closed region surrounding the predetermined character or symbol ,

The image composition program according to claim 7.

ことを特徴とする請求項6乃至8のいずれか一に記載の画像合成プログラム。 In the third process, the size of the input image is compared with the size of the closed region or a rectangle circumscribing the closed region, and the arrangement and / or magnification of the input image is adjusted based on the comparison result .

The image composition program according to any one of claims 6 to 8 .

前記入力部に、用紙上若しくは画面上の電子ペンの移動軌跡を表す1又は複数の手書き画像と当該画像を手書きした時刻を特定する少なくとも1つの時刻情報とが対応付けられた手書き情報と、予め時刻情報が対応付けられた、デジタルカメラで撮影した画像データ、及び/又は、スキャナで読み取った画像データと、を繰り返し入力させる第1の処理と、 Handwritten information in which one or a plurality of handwritten images representing the movement locus of the electronic pen on the paper or the screen and at least one time information specifying the time when the image is handwritten are associated with the input unit; A first process of repeatedly inputting image data captured by a digital camera and / or image data read by a scanner, associated with time information;

前記手書き画像に対応付けられた少なくとも1つの時刻情報と前記画像データに対応付けられた時刻情報とに基づいて、各々の手書き画像に、当該手書き画像を手書きした時刻に最も近い時刻に撮影又は保存された画像データを対応付ける第2の処理と、 Based on at least one time information associated with the handwritten image and time information associated with the image data, each handwritten image is captured or stored at a time closest to the time when the handwritten image is handwritten. A second process for associating the processed image data;

前記手書き画像で特定される閉領域内に、当該手書き画像に対応付けられた画像データに基づく入力画像又は当該画像データの保存場所情報を合成する第3の処理と、 A third process for synthesizing an input image based on image data associated with the handwritten image or storage location information of the image data in a closed region specified by the handwritten image;

前記出力部に、合成結果を出力させる第4の処理と、を実行する、 And a fourth process for causing the output unit to output a synthesis result.

ことを特徴とする画像合成方法。 An image composition method characterized by the above.

ことを特徴とする請求項10に記載の画像合成方法。 The image synthesizing method according to claim 10.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2010223451A JP5472019B2 (en) | 2010-10-01 | 2010-10-01 | Image composition apparatus, image composition program, and image composition method |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2010223451A JP5472019B2 (en) | 2010-10-01 | 2010-10-01 | Image composition apparatus, image composition program, and image composition method |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2012080316A JP2012080316A (en) | 2012-04-19 |

| JP5472019B2 true JP5472019B2 (en) | 2014-04-16 |

Family

ID=46240057

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2010223451A Expired - Fee Related JP5472019B2 (en) | 2010-10-01 | 2010-10-01 | Image composition apparatus, image composition program, and image composition method |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP5472019B2 (en) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20170226365A1 (en) * | 2014-08-26 | 2017-08-10 | Dainichiseika Color & Chemicals Mfg. Co., Ltd. | Coating liquid, coating film, and composite material |

Families Citing this family (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2018032954A (en) * | 2016-08-24 | 2018-03-01 | 株式会社沖データ | Information processing system |

| JP7201419B2 (en) * | 2018-12-19 | 2023-01-10 | オリンパス株式会社 | Image processing system, information processing device, information processing method and program |

| CN115809010B (en) * | 2023-02-10 | 2023-05-19 | 天迈极光(福建)科技有限公司 | Input description synthesis method and system of handwriting data recording device |

Family Cites Families (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH05292294A (en) * | 1992-04-09 | 1993-11-05 | Ricoh Co Ltd | Digital copying machine |

| JP2007133550A (en) * | 2005-11-09 | 2007-05-31 | Fuji Xerox Co Ltd | Information management system, and information management method |

-

2010

- 2010-10-01 JP JP2010223451A patent/JP5472019B2/en not_active Expired - Fee Related

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20170226365A1 (en) * | 2014-08-26 | 2017-08-10 | Dainichiseika Color & Chemicals Mfg. Co., Ltd. | Coating liquid, coating film, and composite material |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2012080316A (en) | 2012-04-19 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5656111B2 (en) | Image composition apparatus and image composition program | |

| EP2306270B1 (en) | Character input method and system | |

| US20110227951A1 (en) | Conference system, information processing apparatus, display method, and non-transitory computer-readable recording medium encoded with display program | |

| US7652785B2 (en) | Camera and printer system and method allowing capturing and formatting multiple images based on the number received | |

| KR20060133493A (en) | Image combining apparatus, and control method and program therefor | |

| JP5472019B2 (en) | Image composition apparatus, image composition program, and image composition method | |

| JP5577982B2 (en) | Image processing apparatus, control program thereof, and control method thereof | |

| JP4737766B2 (en) | Image processing apparatus, image processing apparatus control method, control program, and recording medium | |

| CN104135589A (en) | Image processing system, image processing apparatus, and portable information terminal | |

| JP4998590B2 (en) | Image display device, image display method, and program | |

| US7123274B2 (en) | Combining drawing system, combining drawing method, and recording medium | |

| JP2005005768A (en) | Image processing apparatus, image processing method, and program | |

| JP2006184415A (en) | Image processor, image processing program, and image processing method | |

| JP4674123B2 (en) | Image processing system and image processing method | |

| JP4826241B2 (en) | Copier, copier system, and computer program | |

| JP2004153513A (en) | Image processing apparatus and program thereof | |

| JP4690676B2 (en) | Image processing system, image processing method, and image processing program | |

| JP2007336528A (en) | Image generating and outputting apparatus | |

| JP3778293B2 (en) | Image processing system and image processing method | |

| JP2005086385A (en) | Image forming apparatus | |

| JP2006352794A (en) | Image composing apparatus, control method and program therefor | |

| JP5787495B2 (en) | Control device, control method, and program | |

| JP2023107402A (en) | Information processing apparatus, printing system, method for controlling information processing apparatus, and program | |

| JP4929643B2 (en) | Image alignment apparatus and program | |

| JP5548963B2 (en) | Image display device, image display method, and program |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A711 | Notification of change in applicant |

Free format text: JAPANESE INTERMEDIATE CODE: A712 Effective date: 20130417 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20130501 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20131004 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20131113 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20140107 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20140120 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 5472019 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| LAPS | Cancellation because of no payment of annual fees |