JP4032273B2 - 同期制御装置および方法、並びに記録媒体 - Google Patents

同期制御装置および方法、並びに記録媒体 Download PDFInfo

- Publication number

- JP4032273B2 JP4032273B2 JP37377999A JP37377999A JP4032273B2 JP 4032273 B2 JP4032273 B2 JP 4032273B2 JP 37377999 A JP37377999 A JP 37377999A JP 37377999 A JP37377999 A JP 37377999A JP 4032273 B2 JP4032273 B2 JP 4032273B2

- Authority

- JP

- Japan

- Prior art keywords

- phoneme

- phonological

- adjusting

- information

- operation time

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

- 238000000034 method Methods 0.000 title claims description 91

- 230000008569 process Effects 0.000 claims description 55

- 230000015572 biosynthetic process Effects 0.000 claims description 25

- 230000001360 synchronised effect Effects 0.000 claims description 25

- 238000003786 synthesis reaction Methods 0.000 claims description 25

- 210000000056 organ Anatomy 0.000 claims description 20

- 238000001514 detection method Methods 0.000 claims description 16

- 230000002194 synthesizing effect Effects 0.000 claims description 15

- 241001465754 Metazoa Species 0.000 claims description 9

- 230000005236 sound signal Effects 0.000 claims description 8

- 230000004044 response Effects 0.000 claims description 5

- 238000010586 diagram Methods 0.000 description 11

- 230000009471 action Effects 0.000 description 5

- 230000008859 change Effects 0.000 description 5

- 210000002105 tongue Anatomy 0.000 description 4

- 230000006870 function Effects 0.000 description 3

- 230000003287 optical effect Effects 0.000 description 2

- 239000004065 semiconductor Substances 0.000 description 2

- 230000001502 supplementing effect Effects 0.000 description 2

- 235000016496 Panda oleosa Nutrition 0.000 description 1

- 240000000220 Panda oleosa Species 0.000 description 1

- 230000000694 effects Effects 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L13/00—Speech synthesis; Text to speech systems

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L21/00—Speech or voice signal processing techniques to produce another audible or non-audible signal, e.g. visual or tactile, in order to modify its quality or its intelligibility

- G10L21/06—Transformation of speech into a non-audible representation, e.g. speech visualisation or speech processing for tactile aids

- G10L21/10—Transforming into visible information

- G10L2021/105—Synthesis of the lips movements from speech, e.g. for talking heads

Landscapes

- Engineering & Computer Science (AREA)

- Computational Linguistics (AREA)

- Health & Medical Sciences (AREA)

- Audiology, Speech & Language Pathology (AREA)

- Human Computer Interaction (AREA)

- Physics & Mathematics (AREA)

- Acoustics & Sound (AREA)

- Multimedia (AREA)

- Toys (AREA)

- Manipulator (AREA)

Description

【発明の属する技術分野】

本発明は、同期制御装置および方法、並びに記録媒体に関し、例えば、ロボットの頭部に設けられる調音器官の動きを模擬した部位の動作と、合成した音声の出力を同期させる場合に用いて好適な同期制御装置および方法、並びに記録媒体に関する。

【0002】

【従来の技術】

人や動物を模擬したロボットには、口や顎等を模擬した部位が可動するようなもの(例えば、顎を上下することにより口を開閉するようなもの)が存在し、口や顎等の動きとともに音声を出力するものも存在する。

【0003】

【発明が解決しようとする課題】

そのようなロボットにおいて、例えば、「あ」の音の出力タイミングのときには、口等が「あ」の音を発声する形をし、「い」の音の出力タイミングのときには、口等が「い」の音を発声する形をするように、発声する言葉に対応して口等を動作するようにすれば、よりリアルに人間等を模擬することになる。しかしながら、そのようなロボットは存在していない。

【0004】

本発明はこのような状況に鑑みてなされたものであり、音声合成による発声する言葉と発声タイミングに、調音器官を模擬した部位の動作を対応させることにより、よりリアルに人間等を模擬したロボットを実現することを目的とする。

【0005】

【課題を解決するための手段】

本発明の第1の同期制御装置は、言語情報を用いて複数の音韻からなる音韻情報を生成する音韻情報生成手段と、音韻情報生成手段が生成した音韻情報に対応して、音韻継続時間を算出する算出手段と、音韻情報生成手段が生成した音韻情報に対応して、可動部位の動作時間を演算する演算手段と、算出手段が算出した音韻継続時間と、演算手段が演算した動作時間を調整する調整手段と、調整手段が調整した音韻継続時間に基づいて、合成音声情報を生成する合成音声情報生成手段と、合成音声情報生成手段が生成した合成音声情報に基づいて、音声信号を合成する合成手段と、調整手段が調整した動作時間に基づいて、可動部位の動作を制御する動作制御手段とを含み、調整手段は、音韻毎に対応する音韻継続時間と動作時間を比較して、長い方を用いて短い方を置換して調整する処理、任意の音韻に対応する音韻継続時間と動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃えて調整する処理、全ての音韻に対応する音韻継続時間と動作時間のうちの一方を、他方で置換して調整する処理、音韻毎に対応する音韻継続時間と動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃え、不足する時間を無処理時間で補充して調整する処理、または、全ての音韻に対応する音韻継続時間と動作時間を比較して、短い方を比例的に伸張して調整する処理のうちの少なくとも1つの処理を行うことを特徴とする。

前記同期制御装置は、ロボットであるようにすることができる。

本発明の第1の同期制御装置は、ロボットの口の内部に物体が挿入されたことを検知する検知手段をさらに含むことができ、前記合成手段と前記動作制御手段のうち、少なくとも一方は、検知手段の検知結果に対応して実行中の処理を変更するようにすることができる。

【0006】

本発明の第1の同期制御方法は、言語情報を用いて複数の音韻からなる音韻情報を生成する音韻情報生成ステップと、音韻情報生成ステップの処理で生成された音韻情報に対応して、音韻継続時間を算出する算出ステップと、音韻情報生成ステップの処理で生成された音韻情報に対応して、可動部位の動作時間を演算する演算ステップと、算出ステップの処理で算出された音韻継続時間と、演算ステップの処理で演算された動作時間を調整する調整ステップと、調整ステップの処理で調整された音韻継続時間に基づいて、合成音声情報を生成する合成音声情報生成ステップと、合成音声情報生成ステップの処理で生成された合成音声情報に基づいて、音声信号を合成する合成ステップと、調整ステップの処理で調整された動作時間に基づいて、可動部位の動作を制御する動作制御ステップとを含み、調整ステップは、音韻毎に対応する音韻継続時間と動作時間を比較して、長い方を用いて短い方を置換して調整する処理、任意の音韻に対応する音韻継続時間と動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃えて調整する処理、全ての音韻に対応する音韻継続時間と動作時間のうちの一方を、他方で置換して調整する処理、音韻毎に対応する音韻継続時間と動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃え、不足する時間を無処理時間で補充して調整する処理、または、全ての音韻に対応する音韻継続時間と動作時間を比較して、短い方を比例的に伸張して調整する処理のうちの少なくとも1つの処理を行うことを特徴とする。

【0007】

本発明の第1の記録媒体は、言語情報を用いて複数の音韻からなる音韻情報を生成する音韻情報生成ステップと、音韻情報生成ステップの処理で生成された音韻情報に対応して、音韻継続時間を算出する算出ステップと、音韻情報生成ステップの処理で生成された音韻情報に対応して、可動部位の動作時間を演算する演算ステップと、算出ステップの処理で算出された音韻継続時間と、演算ステップの処理で演算された動作時間を調整する調整ステップと、調整ステップの処理で調整された音韻継続時間に基づいて、合成音声情報を生成する合成音声情報生成ステップと、合成音声情報生成ステップの処理で生成された合成音声情報に基づいて、音声信号を合成する合成ステップと、調整ステップの処理で調整された動作時間に基づいて、可動部位の動作を制御する動作制御ステップとを含み、調整ステップは、音韻毎に対応する音韻継続時間と動作時間を比較して、長い方を用いて短い方を置換して調整する処理、任意の音韻に対応する音韻継続時間と動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃えて調整する処理、全ての音韻に対応する音韻継続時間と動作時間のうちの一方を、他方で置換して調整する処理、音韻毎に対応する音韻継続時間と動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃え、不足する時間を無処理時間で補充して調整する処理、または、全ての音韻に対応する音韻継続時間と動作時間を比較して、短い方を比例的に伸張して調整する処理のうちの少なくとも1つの処理を行うことを特徴とする処理を同期制御装置のコンピュータに実行させるプログラムが記録されている。

【0008】

本発明の第1の同期制御装置、同期制御方法、および記録媒体のプログラムにおいては、言語情報を用いて複数の音韻からなる音韻情報が生成され、生成された音韻情報に対応して音韻継続時間が算出される。また、生成された音韻情報に対応して可動部位の動作時間が演算される。また、算出された音韻継続時間と演算された動作時間が調整され、調整された音韻継続時間に基づいて合成音声情報が生成され、生成された合成音声情報に基づいて音声信号が合成される。さらに、調整された動作時間に基づいて可動部位の動作が制御される。そして、前記調整では、音韻毎に対応する音韻継続時間と動作時間を比較して、長い方を用いて短い方を置換して調整する処理、任意の音韻に対応する音韻継続時間と動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃えて調整する処理、全ての音韻に対応する音韻継続時間と動作時間のうちの一方を、他方で置換して調整する処理、音韻毎に対応する音韻継続時間と動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃え、不足する時間を無処理時間で補充して調整する処理、または、全ての音韻に対応する音韻継続時間と動作時間を比較して、短い方を比例的に伸張して調整する処理のうちの少なくとも1つの処理が行われる。

【0009】

本発明の第2の同期制御装置は、言語情報を用いて複数の音韻からなる音韻情報を生成する音韻情報生成手段と、音韻情報生成手段が生成した音韻情報に対応して、音韻継続時間を算出する算出手段と、音韻情報生成手段が生成した音韻情報に対応して、可動部位の動作時間を演算する演算手段と、算出手段が算出した音韻継続時間と、演算手段が演算した動作時間を調整する調整手段と、調整手段が調整した音韻継続時間に基づいて、合成音声情報を生成する合成音声情報生成手段と、合成音声情報生成手段が生成した合成音声情報に基づいて、音声信号を合成する合成手段と、調整手段が調整した動作時間に基づいて、可動部位の動作を制御する動作制御手段とを含み、動作制御手段は、動物の調音器官の動きを模擬した可動部位の動作を制御することを特徴とする。

同期制御装置は、ロボットであるようにすることができる。

本発明の第2の同期制御装置は、ロボットの口の内部に物体が挿入されたことを検知する検知手段をさらに含むことができ、前記合成手段と前記動作制御手段のうち、少なくとも一方は、検知手段の検知結果に対応して実行中の処理を変更するようにすることができる。

【0010】

本発明の第2の同期制御方法は、言語情報を用いて複数の音韻からなる音韻情報を生成する音韻情報生成ステップと、音韻情報生成ステップの処理で生成された音韻情報に対応して、音韻継続時間を算出する算出ステップと、音韻情報生成ステップの処理で生成された音韻情報に対応して、可動部位の動作時間を演算する演算ステップと、算出ステップの処理で算出された音韻継続時間と、演算ステップの処理で演算された動作時間を調整する調整ステップと、調整ステップの処理で調整された音韻継続時間に基づいて、合成音声情報を生成する合成音声情報生成ステップと、合成音声情報生成ステップの処理で生成された合成音声情報に基づいて、音声信号を合成する合成ステップと、調整ステップの処理で調整された動作時間に基づいて、可動部位の動作を制御する動作制御ステップとを含み、動作制御ステップは、動物の調音器官の動きを模擬した可動部位の動作を制御することを特徴とする。

【0011】

本発明の第2の記録媒体は、言語情報を用いて複数の音韻からなる音韻情報を生成する音韻情報生成ステップと、音韻情報生成ステップの処理で生成された音韻情報に対応して、音韻継続時間を算出する算出ステップと、音韻情報生成ステップの処理で生成された音韻情報に対応して、可動部位の動作時間を演算する演算ステップと、算出ステップの処理で算出された音韻継続時間と、演算ステップの処理で演算された動作時間を調整する調整ステップと、調整ステップの処理で調整された音韻継続時間に基づいて、合成音声情報を生成する合成音声情報生成ステップと、合成音声情報生成ステップの処理で生成された合成音声情報に基づいて、音声信号を合成する合成ステップと、調整ステップの処理で調整された動作時間に基づいて、可動部位の動作を制御する動作制御ステップとを含み、動作制御ステップは、動物の調音器官の動きを模擬した可動部位の動作を制御することを特徴とする処理を同期制御装置のコンピュータに実行させるプログラムが記録されている。

【0012】

本発明の第2の同期制御装置、同期制御方法、および記録媒体のプログラムにおいては、言語情報を用いて複数の音韻からなる音韻情報が生成され、生成された音韻情報に対応して音韻継続時間が算出される。また、生成された音韻情報に対応して可動部位の動作時間が演算される。また、算出された音韻継続時間と演算された動作時間が調整され、調整された音韻継続時間に基づいて合成音声情報が生成され、生成された合成音声情報に基づいて音声信号が合成される。さらに、調整された動作時間に基づいて可動部位の動作が制御される。そして、前記動作制御では、動物の調音器官の動きを模擬した可動部位の動作が制御される。

【0017】

【発明の実施の形態】

図1は、本発明を適用したロボットの音声出力、および、顎、唇、喉、舌、鼻孔などの調音器官を模擬した部位の動作を制御する部分の構成例を示している。この構成例は、例えばロボットの頭部に設けられる。

【0018】

入力部1は、マイクロフォンと音声認識機能(いずれも不図示)を有し、マイクロフォンに入力される音声信号(例えば、「こんにちは」など、ロボットに復唱させる言葉、または、ロボットに対して問い掛ける言葉)を音声認識機能によりテキストデータに変換して、音声言語情報生成部2に供給する。なお、外部から音声言語情報生成部2に、テキストデータを入力するようにしてもよい。

【0019】

音声言語情報生成部2は、ロボットに対話させるときにおいて、入力部1から入力されるテキストデータに対して返事となる言葉の音声言語情報(発声する単語を表すもの)を生成して制御部3に出力する。音声言語情報生成部2はまた、ロボットに復唱させるときにおいて、入力部1から入力されるテキストデータをそのまま制御部3に出力する。音声言語情報は仮名文字、英文字、発音記号などのテキストデータを用いて表される。

【0020】

制御部3は、ドライブ11を制御して、磁気ディスク12、光ディスク13、光磁気ディスク14、または半導体メモリ15に記憶されている制御用プログラムを読み出し、読み出した制御用プログラムに基づいて各部を制御する。

【0021】

具体的には、制御部3は、音声言語情報生成部2から入力される音声言語情報としてのテキストデータを音声合成部4に供給し、音声合成部4からの音韻情報を調音動作生成部5に供給し、調音動作生成部5からの調音動作時間と、音声合成部4からの音韻情報および音韻継続時間を音声動作調整部6に供給する。制御部3はまた、音声動作調整部6からの調整済みの音韻継続時間を音声合成部4に供給し、音声動作調整部6からの調整済みの調音動作時間を調音動作実行部7に供給する。制御部3はさらに、音声合成部4からの合成音声データを音声出力部9に供給する。制御部3はさらに、外部センサ8からの検出情報に対応して、調音動作実行部7および音声出力部9の処理を停止、再開、または中断する。

【0022】

音声合成部4は、制御部3から入力される、音声言語情報生成部2からの音声言語情報としてのテキストデータ(例えば、「こんにちは」)から、図2に示すように、音韻情報(いまの場合、「K O X N I CH I W A」)を生成し、各音韻の音韻継続時間を算出して制御部3に出力する。音声合成部4はまた、制御部3から入力される、音声動作調整部6からの調整済みの音韻継続時間に基づき、合成音声データを生成する。生成される合成音声データは、一般的に知られる規則合成音声によるものや録音再生音によるものなどが挙げられる。

【0023】

調音動作生成部5は、制御部3から入力される、音声合成部4からの音韻情報に基づき、図3に示すように、各音韻に対応する調音動作命令(各調音器官を模擬した部位の動作を指示する命令)と、当該動作の動作時間である調音動作時間を算出して制御部3に出力する。図3の例においては、調音器官16として、顎、唇、喉、舌、鼻孔が記述され、調音動作命令として、顎の上下移動、唇の形状変化および開閉、舌の前後上下左右の移動、喉の振幅および上下移動、鼻の形状変化が記述されている。調音動作命令は、調音器官16のうちの1つに対して単独に指示するようにしてもよいし、調音器官16の複数を組み合わせて指示するようにしてもよい。

【0024】

音声動作調整部6は、制御部3から入力される、音声合成部4からの音韻継続時間と調音動作生成部5からの調音動作時間を、所定の方法(詳細は後述する)に従って調整し、制御部3に出力する。例えば、音韻継続時間と調音動作時間を、音韻毎に時間が長い方を用いて短い方を置換するという方法に従って、図2に示した音韻継続時間と、図3に示した調音動作時間を調整する場合、音韻継続時間については、図4に示すように音韻「X」、「I」、および「W」の各音韻継続時間が調音動作時間と等しくなるように延長される。

【0025】

調音動作実行部7は、制御部3から入力される、調音動作生成部5からの調音動作命令と、音声動作調整部6からの調整済みの調音動作時間に基づき、調音器官16を動作させる。

【0026】

外部センサ8は、例えば、調音器官16に含まれる口の内部に設けられ、口内に挿入された物体を検知して検知情報を制御部3に出力する。

【0027】

音声出力部9は、制御部3から入力される、音声合成部4からの合成音声データに対応する音声をスピーカ10に放音させる。

【0028】

調音器官16は、ロボットの頭部に設けられる顎、唇、喉、舌、鼻孔などを模擬した可動部位である。

【0029】

次に、ロボットの動作について、図5のフローチャートを参照して説明する。ステップS1において、入力部1のマイクロフォンに入力された音声信号は、テキストデータに変換されて音声言語情報生成部2に供給される。ステップS2において、音声言語情報生成部2は、入力部1から入力されたテキストデータに対応する音声言語情報を制御部3に出力する。制御部3は、音声言語情報生成部2から入力された音声言語情報としてのテキストデータ(例えば、「こんにちは」)を音声合成部4に供給する。

【0030】

ステップS3において、音声合成部4は、制御部3から供給された音声言語情報生成部2からの音声言語情報としてのテキストデータから、音韻情報(いまの場合、「K O X N I CH I W A」)を生成し、各音韻の音韻継続時間を算出して制御部3に出力する。制御部3は、音声合成部4からの音韻情報を調音動作生成部5に供給する。

【0031】

ステップS4において、調音動作生成部5は、制御部3から供給された音声合成部4からの音韻情報に基づき、各音韻に対応する調音動作命令と、調音動作時間を算出して制御部3に出力する。制御部3は、調音動作生成部5からの調音動作時間と、音声合成部4からの音韻情報および音韻継続時間を音声動作調整部6に供給する。

【0032】

ステップS5において、音声動作調整部6は、制御部3から供給された音声合成部4からの音韻継続時間と調音動作生成部5からの調音動作時間を、所定の規則に従って調整し、制御部3に出力する。

【0033】

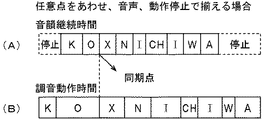

ここで、音韻継続時間と調音動作時間を調整する第1乃至第5の方法について、図6乃至図11を参照して説明する。なお、以下の説明においては、ステップS3で生成された音韻継続時間を図6(A)に示すものとし、ステップS4で生成された調音動作時間を図6(B)に示すものとする。

【0034】

第1の方法は、各音韻の音韻継続時間と調音動作時間を比較して、長い方の時間を用いて短い方の時間を置き換えて調整する方法である。図7は、第1の方法による調整結果を示している。例えば、図6の例において、音韻「K」、「CH」、「W」については、音韻継続時間の方が調音動作時間よりも長いので、図7(B)に示すように、韻継続時間が調音動作時間で置き換えられる。反対に、図6の例において、音韻「O」、「X」、「N」、「I」、「I」、および「A」については、調音動作時間の方が音韻継続時間よりも長いので、図7(A)に示すように、調音動作時間が韻継続時間で置き換えられる。

【0035】

第2の方法は、任意の音韻の開始タイミングまたは終了タイミングを同期させて調整する方法である。図8は、第2の方法による調整結果を示している。例えば、図8に示すように、音韻「X」の開始タイミングを同期させた場合、音韻「K」の音韻継続時間の開始タイミング以前と、音韻「A」の音韻継続時間の終了タイミング以降に不足部分が生じるが、それらの間は音声を発声せず、調音動作のみ実行するように調整する。なお、開始タイミングを同期させる音韻の指定は、ユーザが指定するようにしてもよいし、例えば、制御部3が所定の規則に基づいて決定するようにしてもよい。

【0036】

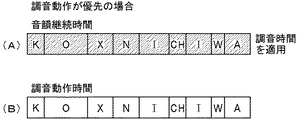

第3の方法は、全ての音韻に対して音韻継続時間または調音動作時間のうち、一方を他方で置き換えて調整する方法である。図9は、第3の方法により、調音動作時間を優先し、全ての音韻に対して音韻継続時間を調音動作時間で置き換えることによって調整した結果を示している。音韻継続時間または調音動作時間のうち、いずれを優先させるかについては、ユーザが選択するようにしてもよいし、例えば、制御部3が所定の規則に基づいて選択するようにしてもよい。

【0037】

第4の方法は、各音韻の開始タイミングまたは終了タイミングを音韻継続時間と調音動作時間で同期させ、不足する時間を空白(発声や調音動作を実行しない時間を指す)で埋めることにより調整する方法である。図10は、第4の方法による調整結果を示している。例えば、図10(B)に示すように、音韻「K」については、調音動作時間の開始タイミング以前に生じる不足する時間を空白で埋め、図10(A)に示すように、音韻「O」、「X」、「N」、および「I」については、音韻継続時間の開始タイミング以前に生じる不足する時間を空白で埋めるようにする。

【0038】

第5の方法は、音韻情報の中心に位置する音韻の開始タイミングまたは終了タイミングを揃えて、かつ、全音韻継続時間と全調音動作時間を比較して短い方の時間を長い方の時間に等しくなるように比例的に伸張する方法である。具体的には、例えば、音韻情報「K O X N I CH I W A」の中心に位置する音韻「I」の開始タイミングを揃え、いまの場合、全音韻継続時間(300ミリ秒)の方が調音動作時間(550ミリ秒)よりも短いので、音韻継続時間を550ミリ秒まで伸張する。より具体的には、音韻「I」以前の音韻「K」、「O」、「X」、および「N」の音韻継続時間を2(=300/150)倍に伸張し、音韻「I」以降の音韻「I」、「CH」、「I」、「W」、および「A」の音韻継続時間を1.25(=250/200)倍に伸張する。

【0039】

以上のように、第1乃至第4の方法のうちのいずれかの方法、あるいは第1乃至第4の方法を適宜組み合わせた方法によって、音韻継続時間と調音動作時間は調整されて制御部3に供給される。

【0040】

図5に戻り、ステップS6において、制御部3は、音声動作調整部6からの調整済みの音韻継続時間を音声合成部4に供給し、音声動作調整部6からの調整済みの調音動作時間と調音動作生成部5からの調音動作命令を調音動作実行部7に供給する。音声合成部4は、制御部3から入力された音声動作調整部6からの調整済みの音韻継続時間に基づき、合成音声データを生成して制御部3に出力する。制御部3はまた、音声合成部4からの合成音声データを音声出力部9に供給する。音声出力部9は、制御部3から入力された、音声合成部4からの合成音声データに対応する音声をスピーカ10に放音させる。それと同期して、調音動作実行部7は、制御部3から入力された、調音動作生成部5からの調音動作命令と、音声動作調整部6からの調整済みの調音動作時間に基づき、調音器官16を動作する。

【0041】

以上のように、ロボットが動作することにより、より自然に人や動物の発声動作を模擬することが可能となる。

【0042】

なお、ステップS6の処理を実行中、外部センサ8が調音器官16である口の内部に物体が挿入されたことを検知した場合、検知情報が制御部3に供給され、それに対応して、制御部3は、調音動作実行部7および音声出力部9の処理を停止、再開、または中断する。このようにすることで、物体が挿入されて口が動かせないときには、声が出せない状態となるので、よりリアリティを増すことができる。また、外部センサ8からの検出情報だけでなく、何らかの外力により、調音器官16の動作が妨げられた場合にも、音声出力部9の処理を停止、再開、または中断するようにしてもよい。

【0043】

このような制御は、いわば、調音動作の変更に対応して、発声処理を変更する制御であるが、反対に、例えば、発声する言葉が急に変更された場合、調音動作も直ちに変更されるような、いわば、発声処理の変更に対応して調音動作を変更するような制御を行うようにしてもよい。

【0044】

なお、本実施の形態においては、音声言語情報生成部2の出力を、例えば「こんにちは」のようなテキストデータとしたが、「K O X N I CH I W A」のような音韻情報を出力するようにしてもかまわない。

【0045】

また、本発明は、発声する音声の音韻と、調音器官以外の部位の動作を同期させる場合にも適用することが可能である。すなわち、例えば、図12に示すように、音声の音韻と首の動作、あるいは手の動作を同期させる場合にも適用することが可能である。

【0046】

さらに、本発明は、ロボットに限らず、例えば、コンピュータグラフィクスにより表現されるキャラクタの発声する音声の音韻と、当該キャラクタの動作を同期させる場合にも適用することが可能である。

【0047】

ところで、上述した一連の処理は、ハードウェアにより実行させることもできるが、ソフトウェアにより実行させることもできる。一連の処理をソフトウェアにより実行させる場合には、そのソフトウェアを構成するプログラムが、専用のハードウェアに組み込まれているコンピュータ、または、各種のプログラムをインストールすることで、各種の機能を実行することが可能な、例えば汎用のパーソナルコンピュータなどに、記録媒体からインストールされる。

【0048】

この記録媒体は、図1に示すように、コンピュータとは別に、ユーザにプログラムを提供するために配布される、プログラムが記録されている磁気ディスク12(フロッピディスクを含む)、光ディスク13(CD-ROM(Compact Disc-Read Only Memory)、DVD(Digital Versatile Disc)を含む)、光磁気ディスク14(MD(Mini Disc)を含む)、もしくは半導体メモリ15などよりなるパッケージメディアにより構成されるだけでなく、コンピュータに予め組み込まれた状態でユーザに提供される、プログラムが記録されているROMやハードディスクなどで構成される。

【0049】

なお、本明細書において、記録媒体に記録されるプログラムを記述するステップは、記載された順序に従って時系列的に行われる処理はもちろん、必ずしも時系列的に処理されなくとも、並列的あるいは個別に実行される処理をも含むものである。

【0050】

【発明の効果】

以上のように、本発明によれば、音声合成による発声する言葉と発声タイミングに、調音器官を模擬した部位の動作を同期させることが可能となり、よりリアルなロボットを実現することが可能となる。

【図面の簡単な説明】

【図1】本発明を適用したロボットの音声出力、および調音器官を模擬した部位の動作を制御する部分の構成例を示すブロック図である。

【図2】音韻情報および音韻継続時間の例を示す図である。

【図3】調音動作命令と調音動作時間の例を示す図である。

【図4】調整された音韻継続時間の例を示す図である。

【図5】本発明を適用してロボットの動作を説明するフローチャートである。

【図6】対応する音韻継続時間と調音動作時間の例を示す図である。

【図7】第1の方法によって調整された音韻継続時間と調音動作時間を示す図である。

【図8】第2の方法によって調整された音韻継続時間と調音動作時間を示す図である。

【図9】第3の方法によって調整された音韻継続時間と調音動作時間を示す図である。

【図10】第4の方法によって調整された音韻継続時間と調音動作時間を示す図である。

【図11】第5の方法によって調整された音韻継続時間と調音動作時間を示す図である。

【図12】音韻情報と調音器官以外の動作を同期させる例を示す図である。

【符号の説明】

1 入力部, 2 音声言語情報生成部, 3 制御部, 4 音声合成部,5 調音動作生成部, 6 音声動作調整部, 7 調音動作実行部, 8 外部センサ, 9 音声出力部, 10 スピーカ, 16 調音器官

Claims (10)

- 音声信号の出力と可動部位の動作を同期させる同期制御装置において、

言語情報を用いて複数の音韻からなる音韻情報を生成する音韻情報生成手段と、

前記音韻情報生成手段が生成した前記音韻情報に対応して、音韻継続時間を算出する算出手段と、

前記音韻情報生成手段が生成した前記音韻情報に対応して、前記可動部位の動作時間を演算する演算手段と、

前記算出手段が算出した前記音韻継続時間と、前記演算手段が演算した前記動作時間を調整する調整手段と、

前記調整手段が調整した音韻継続時間に基づいて、合成音声情報を生成する合成音声情報生成手段と、

前記合成音声情報生成手段が生成した前記合成音声情報に基づいて、前記音声信号を合成する合成手段と、

前記調整手段が調整した動作時間に基づいて、前記可動部位の動作を制御する

動作制御手段とを含み、

前記調整手段は、

前記音韻毎に対応する前記音韻継続時間と前記動作時間を比較して、長い方を用いて短い方を置換して調整する処理、

任意の前記音韻に対応する前記音韻継続時間と前記動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃えて調整する処理、

全ての前記音韻に対応する前記音韻継続時間と前記動作時間のうちの一方を、他方で置換して調整する処理、

前記音韻毎に対応する前記音韻継続時間と前記動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃え、不足する時間を無処理時間で補充して調整する処理、

または、全ての前記音韻に対応する前記音韻継続時間と前記動作時間を比較して、短い方を比例的に伸張して調整する処理

のうちの少なくとも1つの処理を行う

ことを特徴とする同期制御装置。 - 前記同期制御装置は、ロボットである

ことを特徴とする請求項1に記載の同期制御装置。 - 前記ロボットの口の内部に物体が挿入されたことを検知する検知手段をさらに含み、

前記合成手段と前記動作制御手段のうち、少なくとも一方は、前記検知手段の検知結果に対応して実行中の処理を変更する

ことを特徴とする請求項2に記載の同期制御装置。 - 音声信号の出力と可動部位の動作を同期させる同期制御装置の同期制御方法において、

言語情報を用いて複数の音韻からなる音韻情報を生成する音韻情報生成ステップと、

前記音韻情報生成ステップの処理で生成された前記音韻情報に対応して、音韻継続時間を算出する算出ステップと、

前記音韻情報生成ステップの処理で生成された前記音韻情報に対応して、前記可動部位の動作時間を演算する演算ステップと、

前記算出ステップの処理で算出された前記音韻継続時間と、前記演算ステップの処理で演算された前記動作時間を調整する調整ステップと、

前記調整ステップの処理で調整された音韻継続時間に基づいて、合成音声情報を生成する合成音声情報生成ステップと、

前記合成音声情報生成ステップの処理で生成された前記合成音声情報に基づいて、前記音声信号を合成する合成ステップと、

前記調整ステップの処理で調整された動作時間に基づいて、前記可動部位の動作を制御する動作制御ステップとを含み、

前記調整ステップは、

前記音韻毎に対応する前記音韻継続時間と前記動作時間を比較して、長い方を用いて短い方を置換して調整する処理、

任意の前記音韻に対応する前記音韻継続時間と前記動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃えて調整する処理、

全ての前記音韻に対応する前記音韻継続時間と前記動作時間のうちの一方を、他方で置換して調整する処理、

前記音韻毎に対応する前記音韻継続時間と前記動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃え、不足する時間を無処理時間で補充して調整する処理、

または、全ての前記音韻に対応する前記音韻継続時間と前記動作時間を比較して、短い方を比例的に伸張して調整する処理

のうちの少なくとも1つの処理を行う

ことを特徴とする同期制御方法。 - 音声信号の出力と可動部位の動作を同期させる同期制御装置の制御用のプログラムであって、

言語情報を用いて複数の音韻からなる音韻情報を生成する音韻情報生成ステップと、

前記音韻情報生成ステップの処理で生成された前記音韻情報に対応して、音韻継続時間を算出する算出ステップと、

前記音韻情報生成ステップの処理で生成された前記音韻情報に対応して、前記可動部位の動作時間を演算する演算ステップと、

前記算出ステップの処理で算出された前記音韻継続時間と、前記演算ステップの処理で演算された前記動作時間を調整する調整ステップと、

前記調整ステップの処理で調整された音韻継続時間に基づいて、合成音声情報を生成する合成音声情報生成ステップと、

前記合成音声情報生成ステップの処理で生成された前記合成音声情報に基づいて、前記音声信号を合成する合成ステップと、

前記調整ステップの処理で調整された動作時間に基づいて、前記可動部位の動作を制御する動作制御ステップとを含み、

前記調整ステップは、

前記音韻毎に対応する前記音韻継続時間と前記動作時間を比較して、長い方を用いて短い方を置換して調整する処理、

任意の前記音韻に対応する前記音韻継続時間と前記動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃えて調整する処理、

全ての前記音韻に対応する前記音韻継続時間と前記動作時間のうちの一方を、他方で置換して調整する処理、

前記音韻毎に対応する前記音韻継続時間と前記動作時間の開始タイミングまたは終了タイミングのうち、少なくとも一方を揃え、不足する時間を無処理時間で補充して調整する処理、

または、全ての前記音韻に対応する前記音韻継続時間と前記動作時間を比較して、短い方を比例的に伸張して調整する処理

のうちの少なくとも1つの処理を行う

ことを特徴とする処理を同期制御装置のコンピュータに実行させるプログラムが記録されている記録媒体。 - 音声信号の出力と可動部位の動作を同期させる同期制御装置において、

言語情報を用いて複数の音韻からなる音韻情報を生成する音韻情報生成手段と、

前記音韻情報生成手段が生成した前記音韻情報に対応して、音韻継続時間を算出する算出手段と、

前記音韻情報生成手段が生成した前記音韻情報に対応して、前記可動部位の動作時間を演算する演算手段と、

前記算出手段が算出した前記音韻継続時間と、前記演算手段が演算した前記動作時間を調整する調整手段と、

前記調整手段が調整した音韻継続時間に基づいて、合成音声情報を生成する合成音声情報生成手段と、

前記合成音声情報生成手段が生成した前記合成音声情報に基づいて、前記音声信号を合成する合成手段と、

前記調整手段が調整した動作時間に基づいて、前記可動部位の動作を制御する

動作制御手段とを含み、

前記動作制御手段は、動物の調音器官の動きを模擬した前記可動部位の動作を制御する

ことを特徴とする同期制御装置。 - 前記同期制御装置は、ロボットである

ことを特徴とする請求項6に記載の同期制御装置。 - 前記ロボットの口の内部に物体が挿入されたことを検知する検知手段をさらに含み、

前記合成手段と前記動作制御手段のうち、少なくとも一方は、前記検知手段の検知結果に対応して実行中の処理を変更する

ことを特徴とする請求項7に記載の同期制御装置。 - 音声信号の出力と可動部位の動作を同期させる同期制御装置の同期制御方法において、

言語情報を用いて複数の音韻からなる音韻情報を生成する音韻情報生成ステップと、

前記音韻情報生成ステップの処理で生成された前記音韻情報に対応して、音韻継続時間を算出する算出ステップと、

前記音韻情報生成ステップの処理で生成された前記音韻情報に対応して、前記可動部位の動作時間を演算する演算ステップと、

前記算出ステップの処理で算出された前記音韻継続時間と、前記演算ステップの処理で演算された前記動作時間を調整する調整ステップと、

前記調整ステップの処理で調整された音韻継続時間に基づいて、合成音声情報を生成する合成音声情報生成ステップと、

前記合成音声情報生成ステップの処理で生成された前記合成音声情報に基づいて、前記音声信号を合成する合成ステップと、

前記調整ステップの処理で調整された動作時間に基づいて、前記可動部位の動作を制御する動作制御ステップとを含み、

前記動作制御ステップは、動物の調音器官の動きを模擬した前記可動部位の動作を制御する

ことを特徴とする同期制御方法。 - 音声信号の出力と可動部位の動作を同期させる同期制御装置の制御用のプログラムであって、

言語情報を用いて複数の音韻からなる音韻情報を生成する音韻情報生成ステップと、

前記音韻情報生成ステップの処理で生成された前記音韻情報に対応して、音韻継続時間を算出する算出ステップと、

前記音韻情報生成ステップの処理で生成された前記音韻情報に対応して、前記可動部位の動作時間を演算する演算ステップと、

前記算出ステップの処理で算出された前記音韻継続時間と、前記演算ステップの処理で 演算された前記動作時間を調整する調整ステップと、

前記調整ステップの処理で調整された音韻継続時間に基づいて、合成音声情報を生成する合成音声情報生成ステップと、

前記合成音声情報生成ステップの処理で生成された前記合成音声情報に基づいて、前記音声信号を合成する合成ステップと、

前記調整ステップの処理で調整された動作時間に基づいて、前記可動部位の動作を制御する動作制御ステップとを含み、

前記動作制御ステップは、動物の調音器官の動きを模擬した前記可動部位の動作を制御する

ことを特徴とする処理を同期制御装置のコンピュータに実行させるプログラムが記録されている記録媒体。

Priority Applications (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP37377999A JP4032273B2 (ja) | 1999-12-28 | 1999-12-28 | 同期制御装置および方法、並びに記録媒体 |

| DE60019248T DE60019248T2 (de) | 1999-12-28 | 2000-12-21 | Sprachgesteuertes Mundanimationssystem |

| EP00403640A EP1113422B1 (en) | 1999-12-28 | 2000-12-21 | Voice driven mouth animation system |

| US09/749,214 US6865535B2 (en) | 1999-12-28 | 2000-12-27 | Synchronization control apparatus and method, and recording medium |

| US10/927,998 US7080015B2 (en) | 1999-12-28 | 2004-08-26 | Synchronization control apparatus and method, and recording medium |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP37377999A JP4032273B2 (ja) | 1999-12-28 | 1999-12-28 | 同期制御装置および方法、並びに記録媒体 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2001179667A JP2001179667A (ja) | 2001-07-03 |

| JP4032273B2 true JP4032273B2 (ja) | 2008-01-16 |

Family

ID=18502746

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP37377999A Expired - Fee Related JP4032273B2 (ja) | 1999-12-28 | 1999-12-28 | 同期制御装置および方法、並びに記録媒体 |

Country Status (4)

| Country | Link |

|---|---|

| US (2) | US6865535B2 (ja) |

| EP (1) | EP1113422B1 (ja) |

| JP (1) | JP4032273B2 (ja) |

| DE (1) | DE60019248T2 (ja) |

Families Citing this family (17)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| GB0028810D0 (en) * | 2000-11-25 | 2001-01-10 | Hewlett Packard Co | Voice communication concerning a local entity |

| JP3864918B2 (ja) | 2003-03-20 | 2007-01-10 | ソニー株式会社 | 歌声合成方法及び装置 |

| KR100906136B1 (ko) * | 2003-12-12 | 2009-07-07 | 닛본 덴끼 가부시끼가이샤 | 정보 처리용 로봇 |

| JP4661074B2 (ja) * | 2004-04-07 | 2011-03-30 | ソニー株式会社 | 情報処理システム、情報処理方法、並びにロボット装置 |

| JP4240001B2 (ja) * | 2005-05-16 | 2009-03-18 | コニカミノルタビジネステクノロジーズ株式会社 | データ収集装置及びプログラム |

| JP2008026463A (ja) * | 2006-07-19 | 2008-02-07 | Denso Corp | 音声対話装置 |

| US8510113B1 (en) | 2006-08-31 | 2013-08-13 | At&T Intellectual Property Ii, L.P. | Method and system for enhancing a speech database |

| US8510112B1 (en) * | 2006-08-31 | 2013-08-13 | At&T Intellectual Property Ii, L.P. | Method and system for enhancing a speech database |

| JP5045519B2 (ja) * | 2008-03-26 | 2012-10-10 | トヨタ自動車株式会社 | 動作生成装置、ロボット及び動作生成方法 |

| US7472061B1 (en) * | 2008-03-31 | 2008-12-30 | International Business Machines Corporation | Systems and methods for building a native language phoneme lexicon having native pronunciations of non-native words derived from non-native pronunciations |

| JP5178607B2 (ja) * | 2009-03-31 | 2013-04-10 | 株式会社バンダイナムコゲームス | プログラム、情報記憶媒体、口形状制御方法及び口形状制御装置 |

| FR2947923B1 (fr) * | 2009-07-10 | 2016-02-05 | Aldebaran Robotics | Systeme et procede pour generer des comportements contextuels d'un robot mobile |

| JP5531654B2 (ja) * | 2010-02-05 | 2014-06-25 | ヤマハ株式会社 | 制御情報生成装置および形状制御装置 |

| JP2012128440A (ja) * | 2012-02-06 | 2012-07-05 | Denso Corp | 音声対話装置 |

| JP2017213612A (ja) * | 2016-05-30 | 2017-12-07 | トヨタ自動車株式会社 | ロボットおよびロボットの制御方法 |

| WO2018006369A1 (zh) * | 2016-07-07 | 2018-01-11 | 深圳狗尾草智能科技有限公司 | 一种同步语音及虚拟动作的方法、系统及机器人 |

| CN106875947B (zh) * | 2016-12-28 | 2021-05-25 | 北京光年无限科技有限公司 | 用于智能机器人的语音输出方法和装置 |

Family Cites Families (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US4896357A (en) * | 1986-04-09 | 1990-01-23 | Tokico Ltd. | Industrial playback robot having a teaching mode in which teaching data are given by speech |

| US6332123B1 (en) * | 1989-03-08 | 2001-12-18 | Kokusai Denshin Denwa Kabushiki Kaisha | Mouth shape synthesizing |

| JP3254994B2 (ja) * | 1995-03-01 | 2002-02-12 | セイコーエプソン株式会社 | 音声認識対話装置および音声認識対話処理方法 |

| US6208356B1 (en) * | 1997-03-24 | 2001-03-27 | British Telecommunications Public Limited Company | Image synthesis |

| KR100240637B1 (ko) * | 1997-05-08 | 2000-01-15 | 정선종 | 다중매체와의 연동을 위한 텍스트/음성변환 구현방법 및 그 장치 |

| US6064960A (en) * | 1997-12-18 | 2000-05-16 | Apple Computer, Inc. | Method and apparatus for improved duration modeling of phonemes |

| JPH11224179A (ja) * | 1998-02-05 | 1999-08-17 | Fujitsu Ltd | 対話インタフェース・システム |

| US6539354B1 (en) * | 2000-03-24 | 2003-03-25 | Fluent Speech Technologies, Inc. | Methods and devices for producing and using synthetic visual speech based on natural coarticulation |

-

1999

- 1999-12-28 JP JP37377999A patent/JP4032273B2/ja not_active Expired - Fee Related

-

2000

- 2000-12-21 DE DE60019248T patent/DE60019248T2/de not_active Expired - Fee Related

- 2000-12-21 EP EP00403640A patent/EP1113422B1/en not_active Expired - Lifetime

- 2000-12-27 US US09/749,214 patent/US6865535B2/en not_active Expired - Fee Related

-

2004

- 2004-08-26 US US10/927,998 patent/US7080015B2/en not_active Expired - Fee Related

Also Published As

| Publication number | Publication date |

|---|---|

| US20010007096A1 (en) | 2001-07-05 |

| EP1113422A3 (en) | 2002-04-24 |

| JP2001179667A (ja) | 2001-07-03 |

| US7080015B2 (en) | 2006-07-18 |

| EP1113422B1 (en) | 2005-04-06 |

| DE60019248T2 (de) | 2006-02-16 |

| US20050027540A1 (en) | 2005-02-03 |

| EP1113422A2 (en) | 2001-07-04 |

| DE60019248D1 (de) | 2005-05-12 |

| US6865535B2 (en) | 2005-03-08 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP4032273B2 (ja) | 同期制御装置および方法、並びに記録媒体 | |

| JP4296714B2 (ja) | ロボット制御装置およびロボット制御方法、記録媒体、並びにプログラム | |

| JP2001154681A (ja) | 音声処理装置および音声処理方法、並びに記録媒体 | |

| JP2003271173A (ja) | 音声合成方法、音声合成装置、プログラム及び記録媒体、並びにロボット装置 | |

| JP2002304190A (ja) | 発音変化形生成方法及び音声認識方法 | |

| JP2003084800A (ja) | 音声による感情合成方法及び装置 | |

| JP5045519B2 (ja) | 動作生成装置、ロボット及び動作生成方法 | |

| JP2001188553A (ja) | 音声合成装置および方法、並びに記録媒体 | |

| CN113112575B (zh) | 一种口型生成方法、装置、计算机设备及存储介质 | |

| WO2002082423A1 (fr) | Dispositif d'elaboration de suites de mots | |

| WO2002086861A1 (fr) | Processeur de langage | |

| JP2003337592A (ja) | 音声合成方法及び音声合成装置及び音声合成プログラム | |

| JP5531654B2 (ja) | 制御情報生成装置および形状制御装置 | |

| JP3437064B2 (ja) | 音声合成装置 | |

| JP2003271172A (ja) | 音声合成方法、音声合成装置、プログラム及び記録媒体、並びにロボット装置 | |

| JP3785892B2 (ja) | 音声合成装置及び記録媒体 | |

| WO1999046732A1 (fr) | Dispositif de generation d'images en mouvement et dispositif d'apprentissage via reseau de controle d'images | |

| JP3742206B2 (ja) | 音声合成方法及び装置 | |

| JP2002258886A (ja) | 音声合成装置および音声合成方法、並びにプログラムおよび記録媒体 | |

| JP6911398B2 (ja) | 音声対話方法、音声対話装置およびプログラム | |

| JP2019184813A (ja) | ロボット及びロボット制御プログラム | |

| Matsuda et al. | Applying generation process model constraint to fundamental frequency contours generated by hidden-Markov-model-based speech synthesis | |

| JPH1166345A (ja) | 画像音響処理装置および記録媒体 | |

| KR20240052531A (ko) | 합성 데이터를 이용하여 텍스트 기반의 실시간 스트리밍 동영상을 생성하는 방법 및 이를 위한 장치 | |

| JP2002318590A (ja) | 音声合成装置および音声合成方法、並びにプログラムおよび記録媒体 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20060301 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20070717 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20070719 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20070905 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20070927 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20071010 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20101102 Year of fee payment: 3 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20101102 Year of fee payment: 3 |

|

| LAPS | Cancellation because of no payment of annual fees |