JP2023163706A - 動画識別装置、動画識別方法、および動画識別プログラム - Google Patents

動画識別装置、動画識別方法、および動画識別プログラム Download PDFInfo

- Publication number

- JP2023163706A JP2023163706A JP2022074778A JP2022074778A JP2023163706A JP 2023163706 A JP2023163706 A JP 2023163706A JP 2022074778 A JP2022074778 A JP 2022074778A JP 2022074778 A JP2022074778 A JP 2022074778A JP 2023163706 A JP2023163706 A JP 2023163706A

- Authority

- JP

- Japan

- Prior art keywords

- image

- video

- public

- target video

- cut

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

- 238000000034 method Methods 0.000 title claims description 39

- 238000012545 processing Methods 0.000 claims description 24

- 239000000470 constituent Substances 0.000 claims description 4

- 238000003780 insertion Methods 0.000 claims description 2

- 230000037431 insertion Effects 0.000 claims description 2

- 239000011159 matrix material Substances 0.000 claims description 2

- 230000009466 transformation Effects 0.000 claims description 2

- 230000001186 cumulative effect Effects 0.000 claims 1

- 230000000593 degrading effect Effects 0.000 claims 1

- 230000001419 dependent effect Effects 0.000 claims 1

- 230000002123 temporal effect Effects 0.000 claims 1

- 238000004891 communication Methods 0.000 description 9

- 238000010586 diagram Methods 0.000 description 8

- 238000000605 extraction Methods 0.000 description 7

- 238000001514 detection method Methods 0.000 description 5

- 239000000284 extract Substances 0.000 description 3

- 230000000694 effects Effects 0.000 description 2

- 230000009193 crawling Effects 0.000 description 1

- 238000012217 deletion Methods 0.000 description 1

- 230000037430 deletion Effects 0.000 description 1

- 230000006866 deterioration Effects 0.000 description 1

- 238000012986 modification Methods 0.000 description 1

- 230000004048 modification Effects 0.000 description 1

- 230000010355 oscillation Effects 0.000 description 1

- 230000002093 peripheral effect Effects 0.000 description 1

- 238000003672 processing method Methods 0.000 description 1

- 238000012360 testing method Methods 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F21/00—Security arrangements for protecting computers, components thereof, programs or data against unauthorised activity

- G06F21/10—Protecting distributed programs or content, e.g. vending or licensing of copyrighted material ; Digital rights management [DRM]

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06Q—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES; SYSTEMS OR METHODS SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES, NOT OTHERWISE PROVIDED FOR

- G06Q50/00—Information and communication technology [ICT] specially adapted for implementation of business processes of specific business sectors, e.g. utilities or tourism

- G06Q50/10—Services

- G06Q50/18—Legal services

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/40—Scenes; Scene-specific elements in video content

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Physics & Mathematics (AREA)

- Business, Economics & Management (AREA)

- General Physics & Mathematics (AREA)

- Technology Law (AREA)

- Tourism & Hospitality (AREA)

- Software Systems (AREA)

- Multimedia (AREA)

- Economics (AREA)

- Strategic Management (AREA)

- Primary Health Care (AREA)

- General Business, Economics & Management (AREA)

- Marketing (AREA)

- Human Resources & Organizations (AREA)

- General Health & Medical Sciences (AREA)

- Health & Medical Sciences (AREA)

- Computer Hardware Design (AREA)

- Computer Security & Cryptography (AREA)

- General Engineering & Computer Science (AREA)

- Information Retrieval, Db Structures And Fs Structures Therefor (AREA)

- Image Analysis (AREA)

Abstract

【課題】対象動画に依拠する動画を複数の公開動画の中から適切に検知する。【解決手段】動画識別装置10は、複数の公開動画RMの中から対象動画に依拠する動画を検知する。動画識別装置10は、対象動画画像記録部11と、公開動画画像選択部12と、判定部13と、を有する。対象動画画像記録部11は、対象動画から、その対象動画の時間軸方向の構成単位毎にその構成単位に含まれるフレームの画像を代表画像TMxとして記録する。公開動画画像選択部12は、複数の公開動画RMのそれぞれについて、その公開動画RMから所定時間毎にフレームの画像を切り取り画像RMxとして選択する。判定部13は、対象動画の代表画像TMxと公開動画RMの切り取り画像RMxとに基づいて、公開動画RMが対象動画に依拠している可能性にある動画であるか否かを判定する。【選択図】図1

Description

本発明は、複数の公開動画の中から対象動画に依拠する動画を検知する技術に関する。

インターネット上では、多くの動画のコンテンツが公開されている。他人の動画を盗用してサイトで公開し、広告収入を得るという不正行為が存在する。動画の正当な所有者は、そのような不正なサイトを発見し、発見した不正な動画の削除を依頼するなどの対処が必要となっている。

特許文献1には、個々の利用者から投稿されたコンテンツの相互の類似度を算出し、算出した相互の類似度に基づき、投稿されたコンテンツが著作権的に適切であるか否かの判定を行う技術が開示されている。

ドラマや映画など自身の動画コンテンツをテレビや映画あるいはインターネット等を通じて提供するコンテンツ提供者は、自身の動画コンテンツが他者に盗用され、不正に公開されれば、利益が害される。そのため、コンテンツ提供者は、自身の動画コンテンツが動画共有サイトなどで不正に公開されていた場合、できるだけ迅速に、それを見つけて公開を停止させる等の対処を行いたい。

しかし、特許文献1に開示された不適切コンテンツ検出方法では、投稿されたコンテンツ間の類似度を算出し、相互に類似しているコンテンツ群を著作権的に不適切なコンテンツとして検出する。したがって、特許文献1の方法は、コンテンツ提供者が自身の特定のコンテンツを対象として他者による盗用を見つけ出すという目的には適していない。

本開示の一つの目的は、対象動画に依拠する動画を複数の公開動画の中から適切に検知する技術を提供することである。

本発明の一つの実施例に従う動画識別装置は、複数の公開動画の中から対象動画に依拠する動画を検知する動画識別装置であって、前記対象動画から、該対象動画の時間軸方向の構成単位毎に該構成単位に含まれるフレームの画像を代表画像として記録する対象動画画像記録部と、前記複数の公開動画のそれぞれについて、該公開動画から所定時間毎にフレームの画像を切り取り画像として選択する公開動画画像選択部と、前記対象動画の前記代表画像と前記公開動画の前記切り取り画像とに基づいて、前記公開動画が前記対象動画に依拠している可能性にある動画であるか否かを判定する判定部と、を有する。

本発明によれば、対象動画に依拠する動画を複数の公開動画の中から適切に検知することが可能となる。

以下、本発明の実施形態について図面を参照して説明する。

図1は、動画識別装置の機能構成を示すブロック図である。図2は、動画識別装置のハードウェア構成を示すブロック図である。

動画識別装置10は、対象動画画像記録部11と、公開動画画像選択部12と、判定部13と、表示部14と、を備えている。

本実施例の動画識別装置10は、複数の公開動画RMの中から対象動画TM(図4参照)に依拠する動画を検知する装置である。公開動画RMは、ウェブサーバ91が提供する動画共有サイトなどのウェブページによって企業や個人などがインターネット等の通信ネットワーク90上に公開している動画である。対象動画TMは、インターネット上で盗用されていないか探索する対象となる著作権のある動画である。公開動画RMの中には、対象動画TMに依拠する動画が含まれていることが想定される。対象動画TMを基にして作成されている動画は、対象動画TMに依拠するものとなりうる。対象動画TMに依拠する動画を、対象動画TMの著作権者に無断で作成すると盗用になりうる。

動画識別装置10は、対象動画TMを盗用した公開動画RMを発見するために、対象動画TMと同一のものと推定される公開動画RMや対象動画TMに依拠していると推定される公開動画RMを探索する。

対象動画画像記録部11は、対象動画TMから、その対象動画TMの時間軸方向の構成単位であるシーン毎にそのシーンに含まれるフレームの画像を、そのシーンを代表する代表画像TMxとして記録する。即ち、対象動画TMは、複数の代表画像TMxを含んでいる。構成単位は、対象動画TMを構成するシーンの他、カット、またはショットであってもよい。フレームは、例えば、対象動画TMを構成する静止画像の全域である。

対象動画TMは、複数の種類の映像コンテンツでよい。映像コンテンツは、例えば、映画、演劇、文芸、アニメーション、スポーツ等の動画でよい。一例として、代表画像TMxは、対象動画TMの各シーンの先頭の画像である、代表画像TMxは、ユーザによって対象動画TMの中から選択された特徴のある画像でもよい。代表画像TMxには、例えば、サムネイル画像が含まれてよい。

公開動画画像選択部12は、複数の公開動画RMのそれぞれについて、その公開動画RMから所定時間毎にフレームの画像を切り取り画像RMxとして選択する。即ち、公開動画RMは、複数の切り取り画像RMxを含んでいる。所定時間は、例えば、10秒などの一定時間でよい。ここで、代表画像TMxは対象動画TMのシーンから選択されるのに対して、切り取り画像RMxは公開動画RMから所定時間毎に取得される。これは、公開動画RMが不正に作成されたものである場合、加工あるいは劣化などによってシーンの境界が判別しづらくなっている可能性があるからである。

公開動画画像選択部12は、公開動画RMから、公開動画RMのフレーム間に差し込まれた差し込み画像でない画像を切り取り画像RMxとして選択してよい。差し込み画像とは、対象動画TMの著作権者以外によって公開動画RMのフレーム間に検知を逃れのために差し込まれたコンテンツと無関係の画像である。

判定部13は、対象動画TMの代表画像TMxと公開動画RMの切り取り画像RMxとを比較することにより、公開動画RMが対象動画TMに依拠している可能性のある動画であるか否か判定する。その際、判定部13は、まず簡易的な一次判定により対象動画TMに依拠する可能性の極めて低い公開動画RMを除外し、残った公開動画RMについて対象動画TMに依拠する可能性があるか否か詳細な二次判定を行う。これにより判定に要する処理時間の短縮と判定結果の精度向上の両立が可能となっている。

図3は、判定部の機能構成を示すブロック図である。

判定部13は、より詳細には、特徴点抽出部131と、第一類似動画決定部132と、第二類似動画決定部133とを有する。

特徴点抽出部131は、対象動画TMの代表画像TMxおよび公開動画RMの切り取り画像RMxのそれぞれの特徴点を抽出する。また、特徴点抽出部131は、抽出した特徴点の特徴量を特定する。その際、特徴点抽出部131は、対象動画TMの代表画像TMxおよび公開動画RMの切り取り画像RMxのそれぞれの特徴点の周囲の輝度勾配から特徴量を特定してよい。

第一類似動画決定部132は、対象動画TMの全ての代表画像TMxの全ての特徴点をクラスタリングすることにより複数のグループを作成し、特徴点抽出部131により抽出された対象動画TMの代表画像TMxおよび公開動画RMの切り取り画像RMxのそれぞれの特徴点をグループに分類し、分類した結果に基づいて対象動画TMに類似する公開動画RMを決定する。尚、第一類似動画決定部132は、カテゴリ認識の一例としてのbag-of-featuresの手法を用いてよい。第一類似動画決定部132は、特徴点抽出部131により抽出された対象動画TMの代表画像TMxおよび公開動画RMの切り取り画像RMxのそれぞれの特徴点をその特徴点の周囲の輝度勾配に基づく特徴量によって分類してよい。

第一類似動画決定部132は、特徴点抽出部131により抽出された対象動画TMの代表画像TMxおよび公開動画RMの切り取り画像RMxのそれぞれの特徴点を分類してヒストグラムを作成し、作成した代表画像TMxのヒストグラムと切り取り画像RMxのヒストグラムとのバタチャリア距離に基づいて代表画像TMxと切り取り画像RMxとが類似するか否か判定する。これにより、対象動画TMに類似する公開動画RMを簡易比較することができる。

第二類似動画決定部133は、第一類似決定部132により一次判定で類似していないと判定された対象動画TMと公開動画RMの組合せを除外し、残った対象動画TMと公開動画RMの組合せについて、対象動画TMの代表画像TMxと公開動画RMの切り取り画像RMxとの特徴点を比較することにより画像間の類似度を算出し、その画像間の類似度に基づいて対象動画TMと公開動画RMの動画間の類似度を算出し、動画間の類似度に基づいて公開動画RMが対象動画TMに依拠するものか否か判定する。

その際、第二類似動画決定部133は、まず、第一類似動画決定部132による一次判定で除外されなかった対象動画TMと公開動画RMの組合せのそれぞれについて、代表画像TMxと切り取り画像RMxとの総当たりの組み合わせのそれぞれにおける代表画像TMxと切り取り画像RMxの互いの類似度(特徴点間類似度)を算出する。さらに、第二類似動画決定部133は、代表画像TMxと切り取り画像RMxとの総当たりの組み合わせ毎に、特徴点間類似度が所定の閾値を超える特徴点の対(類似特徴点対)を特定する。さらに、第二類似動画決定部133は、類似特徴点対の個数が所定のペアリング条件を満たす代表画像TMxと切り取り画像RMxとの組み合わせ(特徴点ペアリング画像対)を特定する。ペアリング条件は、同じシーンである可能性のある代表画像TMxと切り取り画像RMxとを対応づけるための条件である。そして、第二類似動画決定部133は、特徴点ペアリング画像対における類似特徴点対の個数に基づいて動画間の類似度のスコアを算出し、スコアに基づいて公開動画RMが対象動画TMに依拠している可能性があるか否かの二次判定を行う。

表示部14は、判定部13による判定結果を後述する表示装置26の画面に表示する。

本実施例によれば、対象動画TMと公開動画RMのそれぞれの動画を構成する画像TMx,RMxを用いて判定を行うので、複数の公開動画RMの中から対象動画TMに依拠する公開動画RMを適切かつ高速に検知することが可能となる。

特に、対象動画TMのコンテンツの構成単位に含まれる代表画像TMxと、複数の公開動画RMのそれぞれから所定時間毎に選択された切り取り画像RMxとを用いて判定を行うので、映像コンテンツとしての類似の度合いを考慮した判定を画像TMx,RMx同士の比較により実現することができる。

さらに、公開動画RMから差し込み画像以外の画像を選択して判定に用いるので、公開動画RMに無関係な画像が差し込まれていても、対象動画TMと公開動画RMとの類似の度合いを適切に評価することが可能となる。

本実施形態による動画識別装置10は、図1に示した各部の処理手順を規定したソフトウェアプログラムをコンピュータに実行させることにより実現することも可能である。図2には、動画識別装置を実現するコンピュータのハードウェア構成の一例が示されている。

図2を参照すると、動画識別装置10は、インターネット等の通信ネットワーク90経由でウェブサーバ91と接続可能である。ハードウェア構成として、動画識別装置10は、処理装置21と、メインメモリ22と、記憶装置23と、通信装置24と、入力装置25と、表示装置26とを有し、それらがバス27に接続されている。

記録装置23は、書き込みおよび読み出しが可能にデータを記録するものであって、この記憶装置23には動画識別装置10が処理に用いる公開動画RM(切り取り画像RMx),および対象動画TM(代表画像TMx)のデータが記録される。例えば、複数のウェブサーバ91から収集した公開動画RM(切り取り画像RMx)のデータは、記録装置23に蓄積される。また、その動画の盗用がされているか否か探索する対象となる対象動画TM(代表画像TMx)のデータも、記録装置23に記録される。

処理装置21は、記憶装置23に記録されたデータをメインメモリ22に読み出し、メインメモリ22を利用してソフトウェアプログラムの処理を実行するプロセッサである。処理装置21によって、図1に示した対象動画画像記録部11、公開動画画像選択部12、判定部13、および表示部14が実現される。

通信装置24は、処理装置21にて処理された情報を優先または無線あるいはそれら両方を含む通信ネットワーク0を介して送信し、また通信ネットワーク90を介して受信した情報を処理装置21に伝達する。受信した情報は、処理装置21にてソフトウェアの処理に利用される。

入力装置25は、キーボードやマウスなどオペレータによる操作入力による情報を受け付ける装置である。入力装置25に入力された情報は、処理装置21にてソフトウェア処理に利用される。

表示装置26は、処理装置21によるソフトウェア処理に伴って動画TMx,RM、画像TMx,RMxやテキストの情報をディスプレイ画面に表示する装置である。

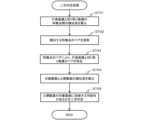

図4は、全体処理のフローチャートである。図5は、全体処理について説明するためのイメージ図である。

図4を参照すると、動画識別装置10は、まず、対象動画画像記録部11により対象動画画像記録処理を行う(ステップS401)。対象動画画像記録処理において、対象動画画像記録部11は、まず、盗用を探索する対象動画TMの隣接するフレーム間の画像の差分を算出し、算出された差分が所定の閾値を超える箇所をシーンの境界と特定する。更に、対象動画画像記録部11は、各シーンに含まれるフレームの画像から当該シーンを代表する画像を代表画像TMxとして選択し、選択された代表画像TMx(図5のTM1,TM2,TM3…)のデータを記憶装置23に格納する。例えば、シーンにおける所定の時間位置のフレームの画像をそのシーンの代表画像TMxとしてもよい。例えば、シーンの先頭フレームの画像を代表画像TMxとしてもよいし、先頭から所定の時間経過したフレームの画像を代表画像TMxとしてもよい。

次に、動画識別装置10は、公開動画画像選択部12により、公開動画画像選択処理を実行する(ステップS402)。公開動画画像選択処理にて、公開動画画像選択部12は、まず、通信ネットワーク90経由でウェブサーバ91の各ウェブサイトを巡回し、ウェブサイトに含まれるウェブページで公開されている公開動画RMのデータを収集(クローリング)し、収集した公開動画RMのデータを記録装置23に蓄積する。次に、公開動画画像選択部12は、公開動画RMから一定時間間隔で切り取り画像RMx(図5のRM1,RM2,RM3…)を選択し、選択した切り取り画像RMxのデータを記録装置23に蓄積する。

なお、本実施形態では、一例として対象動画画像記録処理を行った後に公開動画画像選択処理を行う例を示すが、この処理順序に限定されることはない。公開動画画像選択処理を対象動画画像記録処理の前に実行してもよい。

次に、動画識別装置10は、判定部13により、判定処理を実行する(ステップS403)。判定処理は、対象動画TMの代表画像TMxと公開動画RMの切り取り画像RMxとに基づいて、公開動画RMが対象動画TMに依拠している可能性にある動画であるか否かを判定する処理である。判定処理の詳細は後述する。

次に、動画識別装置10は、表示部14により、判定部13による判定結果を画面に表示する(ステップS404)。対象動画TMを盗用して作成したと推定される公開動画RMについて、判定に用いた類似度を表示してもよい。また、例えば、対象動画TMと、その対象動画TMを盗用して作成したと推定される公開動画RMとを並べて表示することにしてもよい。

次に、動画識別装置10は、対象動画TMを盗用して作成したと推定される公開動画RMの公開元に対して警告を通知する(ステップS405)。なお、警告の通知は、ユーザが判定部13による判定結果を判断し、判断結果に基づいて対象動画TMを盗用して作成したと推定される公開動画RMの公開元に対して警告を通知してよい。この場合、ステップS304の判定部13による判定結果の表示が省略されてもよい。

図6は、判定処理のフローチャートである。

図6を参照すると、判定処理にて、判定部13は、まず、記憶装置23から全代表画像TMxのデータを取得し、各代表画像TMxの特徴点を抽出し、特徴点の特徴量を特定する(ステップS601)。代表画像TMxの特徴点を抽出する方法は特に限定されないが、例えば、代表画像TMxにおけるコーナーの点を特徴点として抽出してもよい。また、各代表画像TMxの特徴点の特徴量を特定する方法も特に限定されないが、各特徴点の輝度勾配から特徴量を特定してもよい。

次に、判定部13は、記憶装置23から全切り取り画像RMxのデータを取得し、各切り取り画像RMxの特徴点を抽出し、特徴点の特徴量を特定する(ステップS602)。切り取り画像RMxの特徴点は、代表画像TMxの特徴点を抽出する方法と同じ方法で抽出すればよい。また、切り取り画像RMxの特徴点の特徴量は、代表画像TMxの特徴点の特徴量を特定する方法と同じ方法で特定すればよい。

次に、判定部13は、全ての代表画像TMxの全ての特徴点を特徴量によってクラスタリングすることにより複数のグループを作成する(ステップS603)。

次に、判定部13は、代表画像TMxの特徴点を、特徴量空間におけるクラスタ重心との最近傍探索によりグループに分類し、代表画像TMx毎の特徴点のヒストグラムを作成する(ステップS604)。

次に、判定部13は、切り取り画像RMxの特徴点を、特徴量空間におけるクラスタ重心との最近傍探索によりグループに分類し、切り取り画像RMx毎の特徴点のヒストグラムを作成する(ステップS605)。

次に、判定部13は、代表画像TMxの特徴点のヒストグラムと切り取り画像RMxの特徴点のヒストグラムを比較することにより、対象動画TMと公開動画RMとの類否の一次判定を行う(ステップS606)。

その際、判定部13は、まず、対象動画TMの全ての代表画像TMxと公開動画RMの全ての切り取り画像RMxとを総当たりで特徴点のヒストグラムの類似度(以下「画像間特徴点分類類似度」ともいう)を算出する。ヒストグラムの類似度はバタチャリア距離を基に定めてもよい。その場合、バタチャリア距離が短いほど類似度は高い。続いて、判定部13は、画像間特徴点分類類似度が所定の閾値を超える、あるいはバタチャリア距離が所定の閾値より短い代表画像TMxと切り取り画像RMxとの組み合わせ(以下「特徴点分類類似画像対」ともいう)を特定する。なお、判定部13は、画像間特徴点分類類似度が上位N位までの特徴点分類類似画像対を特定してもよい。更に、判定部13は、特徴点分類類似画像対の個数に基づいて、対象動画TMと公開動画RMの類否の一次判定を行う。この一次判定は、対象動画TMに依拠する可能性の極めて低い無関係な公開動画RMをヒストグラムの簡易比較によって短時間で除外するためのものである。例えば、特徴点分類類似画像対が0個であれば、公開動画RMが対象動画TMに依拠する可能性は極めて低いすなわち非類似と判定することにしてもよい。

次に、判定部13は、一次判定で非類似ではないと判定された対象動画TMと公開動画RMとの組み合わせについて、互いの特徴点を比較することにより、対象動画TMと公開動画RMとの類否の二次判定を行う(ステップS607)。ステップS607の処理を以下、二次判定処理ともいう。

図7は、二次判定処理のフローチャートである。

図7を参照すると、判定部13は、まず、一次判定で非類似でないと判定された対象動画TMと公開動画RMの組合せのそれぞれについて、全ての代表画像TMxと全ての切り取り画像RMxとの組み合わせのそれぞれにおける特徴点同士を総当たりで特徴点間の類似度(以下「特徴点間類似度」ともいう)を算出する(ステップS701)。特徴点間類似度は、例えば、特徴量間のユークリッド距離を基に定めてもよい。その場合、ユークリッド距離が短いほど特徴点間類似度は高い。

次に、判定部13は、代表画像TMxと切り取り画像RMxの特徴点間類似度が最大となる、すなわちユークリッド距離が最小となる特徴点の組合せ(以下「類似特徴点対」)を特定する(ステップS702)。この処理は、代表画像TMxと切り取り画像RMxとの、特徴点同士の対応点を探索する処理である。なお、判定部13は、任意の特徴点pについて、代表画像TMxと切り取り画像RMxの特徴点間類似度が最も近い組合せの距離が、二番目に近い組合せの距離をn倍(n<1)した距離よりも小さい場合、最も近い特徴点との対を類似特徴点対として特定し、この条件を満たさない類似特徴点対を削除してもよい(ratio test)。

次に、判定部13は、類似特徴点対の個数が所定のペアリング条件を満たす代表画像TMxと切り取り画像RMxとの対(以下「特徴点ペアリング画像対」ともいう)を特定する(ステップS703)。ここでペアリング条件は、例えば、類似特徴点対の個数が所定の閾値を超えかつその個数が切り取り画像RMxにとって最大であるという条件である。

次に、判定部13は、対象動画TMと公開動画RMの組み合わせにおける動画間の類似度を算出する(ステップS704)。その際、判定部13は、まず、各特徴点ペアリング画像対をなす対象動画TMと公開動画RMとの画像間の類似度の積算値と平均値とを動画間の類似度として算出する。以下、この対象動画TMと公開動画RMとの動画間の類似度を表す積算値をトータルスコアという場合がある。また、対象動画TMと公開動画RMとの動画間の類似度を表す平均値を平均スコアという場合がある。

上述した特徴点ペアリング画像対をなす対象動画TMと公開動画RMとの画像間の類似度は、類似特徴点対の個数に基づいて定められる。例えば、代表画像TMxにおける特徴点の総個数に占める、類似特徴点の個数の割合を、特徴点ペアリング画像対をなす代表画像TMxと切り取り画像RMxとの画像間の類似度としてもよい。なお、ここでは、代表画像TMxにおける特徴点の総個数に占める、類似特徴点の個数の割合を、特徴点ペアリング画像対をなす代表画像TMxと切り取り画像RMxとの画像間の類似度としたが、他の構成も可能である。例えば、公開画像RMxにおける特徴点の総個数に占める、類似特徴点の個数の割合を、特徴点ペアリング画像対をなす代表画像TMxと切り取り画像RMxとの画像間の類似度としてもよい。

次に、判定部13は、特徴点ペアリング画像対をなす代表画像TMxと切り取り画像RMxとの動画間のトータルスコアと平均スコアとに基づいて、公開動画RMが対象動画TMに依拠する可能性があるか否かの二次判定を行う(ステップS705)。

その際、判定部13は、トータルスコアと平均スコアが共にそれぞれの閾値を超えていたら、公開動画RMが対象動画TMに依拠する可能性があると判定してもよい。公開動画RMが対象動画TMに依拠したものであれば、類似するシーンが存在するため積算値を用いて判定することにより検知が可能となる。また、対象動画TMおよび公開動画RMが長時間にわたる動画であればシーン数が多くなるので、公開動画RMが対象動画TMに依拠したものでなかったとしても、偶然類似したシーンの画像間類似度が積算されて積算値(トータルスコア)が閾値を超える可能性がある。そのような場合も平均スコアを併用することで、平均値による判定により、対象動画TMに依拠しない公開画像RMが誤って検知されることを抑制することができる。また、同じあるいは似た場所で撮影されたシーンや同じあるいは似たものを撮影したシーンがあると、公開動画RMが対象動画TMに依拠したものでなくても特定のシーンだけが類似する場合がある。しかし、そのような場合も平均スコアによる判定で除外できる。

なお、上記の各閾値は、予め定めた固定値でもよいし、ユーザが設定したり変更したりできる値であってもよい。

上述した本発明の実施形態は、本発明の説明のための例示であり、本発明の範囲をそれらの実施形態にのみ限定する趣旨ではない。当業者は、本発明の要旨を逸脱することなしに、他の様々な態様で本発明を実施することができる。

例えば、上記した実施形態では、対象動画TMのフレーム画像をそのまま代表画像TMxとして用いたが、他の構成も可能である。対象動画TMを加工して盗用した公開動画RMの検知性を高めるために、予め対象動画TMのフレーム画像を加工して加工画像を作成し、加工画像を代表画像TMxと同様に用いて上述の処理を行うことにしてもよい。

加工画像は、代表画像TMxを、コンテンツに影響の少ない周辺部を切り落とした画像、左右反転した画像、分割した画像、補正(画素を低下)した画像などである。代表画像TMxを加工して盗用する場合に想定される加工方法で代表画像TMxを加工した加工画像を準備しておくことが好ましい。

この構成によれば、不正を行う者は、発見されにくくするために、盗用した動画に対して何らかの加工を行って公開する場合がある。何らかの加工が行われた動画は、元の対象動画TMとの類似度が低下し、特定が困難となる。本構成によれば、公開動画RMが対動画TMを加工した動画である可能性について容易に判定することができる。

また、対象動画TMを公開動画RMの画面上の一部に埋め込むことにより不正の検知を逃れようとする動画盗用手法が存在する。上述した実施形態にそのような埋め込みによる不正の検知性を高める変形を加えてもよい。

その場合、判定部13は、ステップS703にて特徴点ペアリング画像対を特定した後、切り取り画像RMxにおける盗用動画の画像が埋め込まれている領域を特定する処理を行い、ステップ704では、切り取り画像RMxにおける特定された領域に存在する類似特徴点対の個数に基づいて動画間の類似度を算出することにすればよい。

具体的には、最初の特徴点ペアリング画像対における類似特徴点対の座標を基に、代表画像TMxと切り取り画像RMxにおける盗用動画が埋め込まれた領域とを対応づける射影変換行列を作成し、2番目以降の特徴点ペアリング画像対については代表画像TMxと切り取り画像RMxにおける盗用動画が埋め込まれた領域との類似度特徴点対の個数に基づいて動画間の類似度を算出すればよい。

また、例えば、上記した実施形態では、公開動画画像選択部12は、ウェブサーバ91が提供するウェブページなどによって企業や個人などがインターネット等の通信ネットワーク90上に公開している公開動画RMから切り取り画像RMxを選択していた。これに限らず、公開動画画像選択部12は、複数の公開動画RMを公開する特定のウェブページから公開動画RMを選択してもよい。特定のウェブページは、例えば、個人などが投稿可能な動画投稿サイトのウェブページでよい。これにより、複数の公開動画RMの中から対象動画TMに依拠する公開動画RMを高速に検知することが可能となる。

公開動画画像選択部12は、複数の公開動画RMを公開する特定のウェブページにリンクする他のウェブページから公開動画RMを選択してもよい。これにより、複数の公開動画RMの中から対象動画TMに依拠する公開動画RMを検知する精度を高めることが可能となる。

10…動画識別装置、11…対象動画画像記録部、12…公開動画画像選択部、13…判定部、131…特徴点抽出部、132…第一類似動画部、133…第二類似動画部、RM…公開動画、RMx…切り取り画像、TM…対象動画、TMx…代表画像

Claims (15)

- 複数の公開動画の中から対象動画に依拠する動画を検知する動画識別装置であって、

前記対象動画から、該対象動画の時間方向の構成単位毎に該構成単位に含まれるフレームの画像を代表画像として記録する対象動画画像記録部と、

前記複数の公開動画のそれぞれについて、該公開動画から所定時間毎にフレームの画像を切り取り画像として選択する公開動画画像選択部と、

前記対象動画の前記代表画像と前記公開動画の前記切り取り画像とに基づいて、前記公開動画が前記対象動画に依拠している可能性にある動画であるか否かを判定する判定部と、

を有する動画識別装置。 - 前記判定部は、

前記対象動画の前記代表画像および前記公開動画の前記切り取り画像のそれぞれの特徴点を抽出し、

前記代表画像の特徴点を特徴量によってクラスタリングすることにより複数のグループを作成し、前記代表画像毎に該代表画像の特徴点を前記グループに分類し、前記切り取り画像毎に該切り取り画像の特徴点を前記グループに分類し、前記対象動画と前記公開動画の組合せのそれぞれについて、各グループへの特徴点の分類に基づく画像間特徴点分類類似度が所定の閾値を超える、あるいは該画像間特徴点分類類似度が上位N位までの代表画像と切り取り画像との対を特徴点分類類似画像対として特定し、前記特徴点分類類似画像対に基づいて前記対象動画と前記公開動画の類否の一次判定を行い、

前記一次判定で非類似でないと判定された対象動画と公開動画の組合せのそれぞれについて、代表画像と切り取り画像との組み合わせのそれぞれにおける前記代表画像と前記切り取り画像の互いに特徴点間類似度が最大となる特徴点の対を類似特徴点対として特定し、前記類似特徴点対の個数が所定のペアリング条件を満たす代表画像と切り取り画像との対を特徴点ペアリング画像対として特定し、前記特徴点ペアリング画像対における前記類似特徴点対の個数に基づいて前記公開動画が前記対象動画に依拠している可能性があるという二次判定を行う、

請求項1に記載の動画識別装置。 - 前記判定部は、

前記対象動画の前記代表画像および前記公開動画の前記切り取り画像のそれぞれの特徴点の周囲の輝度勾配に基づいて前記特徴点の前記特徴量を特定する、

請求項2に記載の動画識別装置。 - 前記判定部は、前記対象動画と前記公開動画のそれぞれについて、各グループへ分類される特徴点の度数の分布をヒストグラムに表し、前記ヒストグラムのバタチャリア距離を前記画像間特徴点分類類似度として前記特徴点分類類似画像対を特定する、

請求項2に記載の動画識別装置。 - 前記判定部は、前記特徴点ペアリング画像対における前記類似特徴点対の個数に基づいて、前記特徴点ペリング画像対の類似度である画像間特徴点類似度を算出し、前記画像間特徴点類似度の積算値と平均値とに基づいて、前記公開動画が前記対象動画に依拠している可能性があるという二次判定を行う、

請求項2に記載の動画識別装置。 - 前記画像間特徴点類似度は、前記対象動画の前記代表画像の前記特徴点の総数または前記公開画像の前記切り取り画像の前記特徴点の総数に占める前記類似特徴点対の数の割合である、

請求項5に記載の動画識別装置。 - 前記判定部は、前記累積値が第一閾値以上、且つ、前記平均値が第二閾値以上であれば前記公開動画が前記対象動画に依拠している可能性があるという二次判定を行う、

請求項5に記載の動画識別装置。 - 前記対象動画画像記録部は、前記対象動画を構成する代表画像と該代表画像に対して所定の加工を行った加工画像とを記録し、

前記判定部は、前記公開動画から選択された前記切り取り画像と、前記対象動画の前記代表画像および前記加工画像とに基づいて、前記公開動画が前記対象動画に依拠している可能性のある動画であるか否か判定する、

請求項1に記載の動画識別装置。 - 前記加工画像は、前記代表画像を劣化させた劣化画像である、

請求項9に記載の動画識別装置。 - 前記公開動画画像選択部は、前記公開動画から、前記公開動画のフレーム間に差し込まれた差し込み画像ではない画像を選択する、

請求項1に記載の動画識別装置。 - 前記構成単位は、前記対象動画を構成するシーンである、

請求項1に記載の動画識別装置。 - 前記判定部は、前記切り取り画像における前記対象動画に依拠している可能性にある前記公開動画の画像が埋め込まれている領域を特定し、前記切り取り画像における特定された領域に存在する前記類似特徴点対の個数に基づいて、前記画像間特徴点類似度を算出する、

請求項5に記載の動画識別装置。 - 前記判定部は、前記特徴点ペアリング画像対における前記類似特徴点対の座標に基づいて、前記代表画像と、前記切り取り画像における前記対象動画に依拠している可能性にある前記公開動画の画像が埋め込まれている領域とを対応づける射影変換行列を作成する、

請求項12に記載の動画識別装置。 - 対象動画から、該対象動画の時間軸方向の構成単位毎に該構成単位に含まれるフレームの画像を代表画像として記録する対象動画画像記録ステップと、

複数の公開動画のそれぞれについて、該公開動画から所定時間毎にフレームの画像を切り取り画像として選択する公開動画画像選択ステップと、

前記対象動画の前記代表画像と前記公開動画の前記切り取り画像とに基づいて、前記公開動画が前記対象動画に依拠している可能性にある動画であるか否かを判定する判定ステップと、

を有する動画識別方法。 - コンピュータが備える対象動画画像記録部に、対象動画から、該対象動画の時間軸方向の構成単位毎に該構成単位に含まれるフレームの画像を代表画像として記録させ、

前記コンピュータが備える公開動画画像選択部に、複数の公開動画のそれぞれについて、該公開動画から所定時間毎にフレームの画像を切り取り画像として選択させ、

前記コンピュータが備える判定部に、前記対象動画の前記代表画像と前記公開動画の前記切り取り画像とに基づいて、前記公開動画が前記対象動画に依拠している可能性にある動画であるか否かを判定させる動画識別プログラム。

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2022074778A JP2023163706A (ja) | 2022-04-28 | 2022-04-28 | 動画識別装置、動画識別方法、および動画識別プログラム |

| PCT/JP2023/003897 WO2023210095A1 (ja) | 2022-04-28 | 2023-02-07 | 動画識別装置、動画識別方法、および動画識別プログラム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2022074778A JP2023163706A (ja) | 2022-04-28 | 2022-04-28 | 動画識別装置、動画識別方法、および動画識別プログラム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2023163706A true JP2023163706A (ja) | 2023-11-10 |

Family

ID=88518339

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2022074778A Pending JP2023163706A (ja) | 2022-04-28 | 2022-04-28 | 動画識別装置、動画識別方法、および動画識別プログラム |

Country Status (2)

| Country | Link |

|---|---|

| JP (1) | JP2023163706A (ja) |

| WO (1) | WO2023210095A1 (ja) |

Family Cites Families (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4921847B2 (ja) * | 2006-05-02 | 2012-04-25 | 株式会社豊田中央研究所 | 対象物の三次元位置推定装置 |

| KR101373176B1 (ko) * | 2013-02-13 | 2014-03-11 | 서강대학교산학협력단 | 복제 동영상정보 검출방법 및 장치, 저장매체 |

| JP6429466B2 (ja) * | 2013-11-19 | 2018-11-28 | キヤノン株式会社 | 画像処理装置およびその制御方法、撮像装置、プログラム |

| JP2021039647A (ja) * | 2019-09-05 | 2021-03-11 | アズビル株式会社 | 画像データ分類装置および画像データ分類方法 |

-

2022

- 2022-04-28 JP JP2022074778A patent/JP2023163706A/ja active Pending

-

2023

- 2023-02-07 WO PCT/JP2023/003897 patent/WO2023210095A1/ja unknown

Also Published As

| Publication number | Publication date |

|---|---|

| WO2023210095A1 (ja) | 2023-11-02 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US8549627B2 (en) | Detection of objectionable videos | |

| JP5829662B2 (ja) | 処理方法、コンピュータプログラム及び処理装置 | |

| US10643667B2 (en) | Bounding box doubling as redaction boundary | |

| US9098807B1 (en) | Video content claiming classifier | |

| US10795928B2 (en) | Image search apparatus, system, and method | |

| CN112818149B (zh) | 一种基于时空轨迹数据的人脸聚类方法、装置及存储介质 | |

| US20210314635A1 (en) | System and method for providing image-based video service | |

| US8805123B2 (en) | System and method for video recognition based on visual image matching | |

| US11526586B2 (en) | Copyright detection in videos based on channel context | |

| US20100268604A1 (en) | Method and system for providing information based on logo included in digital contents | |

| US20130177252A1 (en) | Detecting Video Copies | |

| KR20170038040A (ko) | 비디오에서의 컴퓨터화된 현저한 인물 인식 | |

| CN101286230B (zh) | 图像处理设备和图像处理方法 | |

| WO2018068664A1 (zh) | 网络信息识别方法和装置 | |

| JP4740706B2 (ja) | 不正画像検出装置、方法、プログラム | |

| US8897484B1 (en) | Image theft detector | |

| US9332031B1 (en) | Categorizing accounts based on associated images | |

| CN111191591A (zh) | 一种水印检测、视频处理方法和相关设备 | |

| WO2023210095A1 (ja) | 動画識別装置、動画識別方法、および動画識別プログラム | |

| JP6244887B2 (ja) | 情報処理装置、画像探索方法、及びプログラム | |

| KR100981125B1 (ko) | 동영상 처리 방법 및 그 장치 | |

| JP7284196B2 (ja) | 情報処理装置、情報処理方法、及びプログラム | |

| KR101373849B1 (ko) | 동영상 데이터 관리 방법 및 동영상 데이터 관리 시스템 | |

| EP4391552A1 (en) | Method and system for generating video streaming content bookmarks | |

| CN117521159A (zh) | 敏感数据保护方法、设备及存储介质 |