JP2022051312A - 撮影制御装置、撮影制御方法、及びプログラム - Google Patents

撮影制御装置、撮影制御方法、及びプログラム Download PDFInfo

- Publication number

- JP2022051312A JP2022051312A JP2020157729A JP2020157729A JP2022051312A JP 2022051312 A JP2022051312 A JP 2022051312A JP 2020157729 A JP2020157729 A JP 2020157729A JP 2020157729 A JP2020157729 A JP 2020157729A JP 2022051312 A JP2022051312 A JP 2022051312A

- Authority

- JP

- Japan

- Prior art keywords

- angle

- view

- target subject

- human body

- value

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N7/00—Television systems

- H04N7/18—Closed-circuit television [CCTV] systems, i.e. systems in which the video signal is not broadcast

- H04N7/183—Closed-circuit television [CCTV] systems, i.e. systems in which the video signal is not broadcast for receiving images from a single remote source

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/69—Control of means for changing angle of the field of view, e.g. optical zoom objectives or electronic zooming

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/61—Control of cameras or camera modules based on recognised objects

- H04N23/611—Control of cameras or camera modules based on recognised objects where the recognised objects include parts of the human body

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/66—Remote control of cameras or camera parts, e.g. by remote control devices

- H04N23/661—Transmitting camera control signals through networks, e.g. control via the Internet

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/60—Control of cameras or camera modules

- H04N23/695—Control of camera direction for changing a field of view, e.g. pan, tilt or based on tracking of objects

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N7/00—Television systems

- H04N7/18—Closed-circuit television [CCTV] systems, i.e. systems in which the video signal is not broadcast

- H04N7/183—Closed-circuit television [CCTV] systems, i.e. systems in which the video signal is not broadcast for receiving images from a single remote source

- H04N7/185—Closed-circuit television [CCTV] systems, i.e. systems in which the video signal is not broadcast for receiving images from a single remote source from a mobile camera, e.g. for remote control

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Studio Devices (AREA)

- Closed-Circuit Television Systems (AREA)

Abstract

【課題】画角内の対象被写体と画角外の対象被写体とを含む画角を取得可能とする。【解決手段】撮影制御装置は、撮影装置が撮影した画像から画角に収める対象被写体を検出している場合、撮影装置の画角を、該対象被写体を収める画角に設定する検出判断手段(104)と、画角設定された撮影装置の画像から第1の対象被写体と第2の対象被写体を検出する第1,第2の検出手段(107、106)と、第1,第2の対象被写体を撮影装置が撮影したときのPTZ値を基に、第1,第2の対象被写体の画角内座標をPT座標値に変換する座標変換手段(108)と、PT座標値を保存する座標保存手段(110)と、PT座標値を基に第1と第2の対象被写体を収める画角を取得する画角取得手段(111)と、その画角を基に撮影装置の画角を調整する画角操作手段(112)とを有する。【選択図】 図1

Description

本発明は、画像を撮影する装置の制御技術に関する。

近年、講師が授業をするシーンを自動撮影するような撮影装置のニーズが高まっている。講義シーンを自動撮影して表示する場合、通常時には対象被写体である講師のアップ画像を表示し、講師が黒板等を指し示した時には講師とその指し示された指示領域の両対象被写体を含む画像を表示するような制御が行われる。特許文献1には、予め決められた広角の基準画角で教壇等を撮影し、その基準画角の画角内の座標から講師の重心座標と指示領域の重心座標とを求め、それら重心座標を基に講師と指示領域の両対象被写体を含む画角を計算する技術が開示されている。また特許文献1には、それら両対象被写体を含む画角の画像を、基準画角の撮影画像からデジタルPTZ処理により切り出す技術が開示されている。さらに特許文献1には、基準画角用のカメラと追尾用のカメラを用意し、両対象被写体を含む画角に応じて、追尾用カメラの画角をPTZ制御する技術が開示されている。なお、PTZとは、パン(P)・チルト(T)・ズーム(Z)を略した用語である。

しかしながら、特許文献1に記載の技術では、予め決められた基準画角内の画像しか取得することができない。例えば、講師等によって基準画角よりも外側のホワイトボードが指し示された場合、当該ホワイトボードに対応した基準画角内の座標がないため、講師とホワイトボードとを含む画角を計算することができない。すなわち特許文献1の技術では、予め決められた画角内の対象被写体と、そのとき画角外になっている別の対象被写体とを含む画角を計算することができないため、それら両対象被写体を含む画像を取得できない。

そこで本発明は、画角内の対象被写体とそのとき画角外になっていた対象被写体とを含む画角を取得可能として、それら対象被写体を含む画像を得られるようにすることを目的とする。

本発明の撮影制御装置は、撮影装置が撮影した画像から、画角に収める対象被写体を検出しているか判断し、前記画角に収める対象被写体を検出している場合、前記撮影装置の画角を、前記対象被写体を収める画角に設定する検出判断手段と、前記検出判断手段にて前記画角が設定された前記撮影装置が撮影した画像から第1の対象被写体を検出する第1の検出手段と、前記検出判断手段にて前記画角が設定された前記撮影装置が撮影した画像から第2の対象被写体を検出する第2の検出手段と、前記第1の対象被写体および前記第2の対象被写体を、前記撮影装置が撮影したときのパン値とチルト値とズーム値とを基に、当該第1の対象被写体および前記第2の対象被写体の画角内座標をパン座標値とチルト座標値とに変換する座標変換手段と、前記パン座標値およびチルト座標値を保存する座標保存手段と、前記保存されたパン座標値およびチルト座標値を基に、前記第1の対象被写体と前記第2の対象被写体とを収める画角を取得する画角取得手段と、前記画角取得手段が前記取得した画角を基に、前記撮影装置の画角を調整する画角操作手段と、を有することを特徴とする。

本発明によれば、画角内の対象被写体とそのとき画角外になっていた対象被写体とを含む画角を取得可能として、それら対象被写体を含む画像を得られるようになる。

以下、本発明の実施形態について、図面を参照して説明する。なお、以下の各実施形態において示す構成は一例であり、本発明は図示された構成に限定されるものではない。また以下の実施形態において、同一の構成や処理については同じ符号を付して説明する。

<第1実施形態>

第1実施形態に係る撮影制御装置の構成例について、図1を参照して説明する。図1は本実施形態に係る撮影制御装置である画角調整装置102を含んだ自動撮影システム100の機能構成を示すブロック図である。

本実施形態の自動撮影システム100は、画像取得装置101と、画角調整装置102と、モニタ装置114とを有して構成されている。なお、画角調整装置102とモニタ装置114は、ビデオインターフェースを介して接続されている。

第1実施形態に係る撮影制御装置の構成例について、図1を参照して説明する。図1は本実施形態に係る撮影制御装置である画角調整装置102を含んだ自動撮影システム100の機能構成を示すブロック図である。

本実施形態の自動撮影システム100は、画像取得装置101と、画角調整装置102と、モニタ装置114とを有して構成されている。なお、画角調整装置102とモニタ装置114は、ビデオインターフェースを介して接続されている。

画像取得装置101は、被写体およびその周囲を撮影して撮影画像を生成するカメラ等の撮影装置を有して構成されている。撮影装置は、ズーム光学系を有し、ズーム値が制御されることでズーム倍率を調整可能な構成を有している。また、撮像装置は、雲台を含み、その雲台に対するパン値が制御されることでパン方向の調整が可能となされ、同様にチルト値が制御されることでチルト方向の調整が可能となされている。したがって、撮影装置は、パン値、チルト値、ズーム値が制御されることにより画角調整が可能な構成となされている。画像取得装置101は、撮影装置が撮影した画像情報を、画角調整装置102へ出力する。

画角調整装置102は、画像取得装置101の撮影装置の画角を調整する撮影制御装置の機能を有する。本実施形態において、画角調整装置102は、画像取得装置101の撮影装置(以下、カメラとする)にて撮影された画像から、第1の対象被写体である例えば人体と、第2の対象被写体である物体とを検出する。例えば、講師が授業を行っているシーンを自動撮影する用途の場合、第1の対象被写体である人体は例えば授業を行っている講師とし、第2の対象被写体である物体は講義に用いられている黒板やホワイトボード等とすることができる。画角調整装置102は、人物を画角内に収めたときのその人体の画角内座標値と、物体を画角内に収めたときのその物体の画角内座標値とを、それぞれPT座標値(パン座標値・チルト座標値)に変換して保存しておく。その後、画角調整装置102は、人体が画角内でそのときの物体が画角外になっている場合でも、保存したPT座標値を用いて画角計算を行い、それら人体および物体が収まるような画角を取得し、その画角になるようにカメラの画角を調整する。そして、画角調整装置102による画角調整後の撮影画像は、モニタ装置114に出力されて表示される。

画角調整装置102は、画像取得装置101から画像情報が入力されると、対象被写体として画角に収める物体を検出したかどうかを判定する。画角調整装置102は、対象被写体の物体を検出していない場合にはプリセット機能を用いてカメラの画角を調整して、その対象被写体の物体を撮影した画像を用いて物体検出を行う。画角調整装置102は、対象被写体の物体を検出した場合、そのときの物体の画角内座標を、カメラのPTZ(パン・チルト・ズーム)値を用いてPT座標値に変換して保存する。また、画角調整装置102は、カメラの撮影画像内から対象被写体としての人体を検出し、前述した対象被写体の物体の場合と同様に、その人体の画角内座標をカメラのPTZ値を用いてPT座標値に変換して保存する。画角調整装置102は、このようにして得られて保存された人体と物体のPT座標値を基に、カメラの撮影時に画角内の人体とそのとき画角外となっている物体とを収める画角を計算し、その計算した画角に応じた画角調整を行う。その後、画角調整装置102は、画角調整した後に得られた画像情報をモニタ装置114へ出力する。

画角調整装置102は画像入力部103、検出判断部104、画角保存部105、物体検出部106、人体検出部107、座標変換部108、位置保存部109、座標保存部110、画角計算部111、画角操作部112、および画像出力部113を有する。

画像入力部103は、画像取得装置101から画像情報が入力され、その入力された画像情報を検出判断部104へ出力する。

画像入力部103は、画像取得装置101から画像情報が入力され、その入力された画像情報を検出判断部104へ出力する。

検出判断部104は、カメラの現在の画角において、当該画角に収める対象被写体となる物体が検出されているかどうかを判断する。検出判断部104は、カメラの現在の画角において対象被写体の物体が検出されていない場合、画像入力部103から入力された画像情報を、物体検出部106へ出力する。一方、検出判断部104は、カメラの現在の画角において対象被写体の物体が検出されている場合、画角保存部105に対し、まだ使用していないプリセット画角があるかどうかを問い合わせる。

画角保存部105は、ユーザ操作等によって入力された複数のプリセット画角の情報と、各プリセット画角が使用済みかどうかの情報とを保存しており、検出判断部104からの取得要求に応じてそれら情報を出力する。

プリセット画角について図2を用いて説明する。図2は、対象被写体となされる人体P1と、画角に収める別の対象被写体としての物体P2,P3とを示した図である。図2の図中一点鎖線で示す範囲はプリセット画角を表しており、画角D2は対象被写体の物体P2を収めたプリセット画角を、画角D3は対象被写体の物体P3を収めたプリセット画角を表しているとする。このようにプリセット画角は複数あり、それら複数のプリセット画角は複数の異なるプリセット位置とそれら各位置におけるカメラの撮影範囲とからなる。

検出判断部104は、画角保存部105に保存されている情報のなかに、まだ使用していないプリセット画角がない場合には、画像入力部103から入力された画像情報を、人体検出部107へ出力する。一方、検出判断部104は、画角保存部105に保存されている情報のなかに、まだ使用していないプリセット画角がある場合には、そのプリセット画角の情報を後述する画角操作部112へ出力する。つまり、検出判断部104は、プリセット画角の情報を画角操作部112へ出力することで、カメラの画角をプリセット画角に設定する。

物体検出部106は、検出判断部104から入力された画像情報から、画像中の物体を検出する物体検出処理を行う。物体検出処理には、Deep Learning(深層学習)をベースとした高精度でかつ高速な技術を用いることができる。Deep Learningをベースとした物体検出処理としては、例えば、Faster R-CNN、YOLO、SSD、Masked R-CNNなどが挙げられる。物体検出部106は、それら物体検出処理技術のうち何れかを用いるものとするが、これらに限定されるものではない。Faster R-CNN、YOLO、SSD、Masked R-CNNは公知の技術であるため、その詳細な説明は省略する。そして、物体検出部106は、画像中から物体を検出できた場合、その検出した物体の画角内座標値と画像情報とを、座標変換部108へ出力する。

人体検出部107は、検出判断部104から入力された画像情報から、画像中の人体を検出する人体検出処理を行う。人体の検出処理は、テンプレートマッチング法や意味的領域分割法等、人体が検出できるものであればどのような方法を用いてもよいものとする。テンプレートマッチング法や意味的領域分割法は公知の技術であるため、その詳細な説明は省略する。人体検出部107は、画像中から人体を検出できた場合、その検出した人体の画角内座標値と画像情報とを、座標変換部108へ出力する。本実施形態において、人体検出部107は、画像中から検出した人体を包含する矩形(検出矩形とする)の四つの頂点の座標値を、当該検出した人物の座標値として出力するものとする。

座標変換部108には、物体検出部106から物体の座標値および画像情報が入力され、人体検出部107から人体の座標値および画像情報が入力される。

また、位置保存部109は、カメラの現在のPTZ値を保存しており、そのPTZ値の情報を、座標変換部108へ出力する。

座標変換部108は、物体の座標値および画像情報と、人体の座標値および画像情報と、カメラの現在のPTZ値の情報とを基に、物体および人体の画角内座標をPT座標値に変換する。そして、座標変換部108は、物体および人体のPT座標値と画像情報とを、座標保存部110へ出力する。

また、位置保存部109は、カメラの現在のPTZ値を保存しており、そのPTZ値の情報を、座標変換部108へ出力する。

座標変換部108は、物体の座標値および画像情報と、人体の座標値および画像情報と、カメラの現在のPTZ値の情報とを基に、物体および人体の画角内座標をPT座標値に変換する。そして、座標変換部108は、物体および人体のPT座標値と画像情報とを、座標保存部110へ出力する。

座標変換部108が物体および人体の画角内座標をPT座標値に変換するPT座標変換処理の様子を、図3を用いて説明する。図3において、画像D21は、人体検出部107にて検出された人体の座標を画角内座標で表した画像である。また、画像D22は、画像D21において人体を表す画角内座標を、PT座標値で表した場合の画像である。すなわち画像D21内の人体P21と画像D22内の人体P22とは、同時刻における同一人物である。画像D21内で人体P21を囲った一点鎖線で示す矩形は、人体検出部107が検出した人体を示す検出矩形を表している。画像D21において、人体P21の検出矩形の画角内座標は、左上頂点、右上頂点、左下頂点、右下頂点の順に、(x1,y1)、(x2,y2)、(x3,y3)、(x4,y4)の四つの座標で表されるとする。また、当該人体が検出された画像を撮影したときのカメラのパン値をθ、チルト値をΦ、ズーム値をωで表すと、PTZ値は(θ,Φ,ω)で表されるとする。座標変換部108は、この画角内座標値とカメラのPTZ値とを用いて、人体および物体の画角内座標をPT座標値に変換する。

画角内座標をPT座標値に変換する変換処理は、平面座標から球面座標への変換、カメラの光軸に直交する任意の平面に投影した座標の算出、投影平面の座標をパン角およびチルト角の回転角に変換する技術等を用いて実現することができる。これらの技術は公知の技術であるため、その詳細な説明は省略する。またこれら技術を用いた変換処理は一例であり、画角内座標をPT座標値に変換できる方法であればどのような方法が用いられてもよい。人物P21の画角内座標を例にすると、変換後のPT座標値は、画像D22内の人物P22の矩形の左上、右上、左下、右下の各頂点の順に、(θ1,Φ1)、(θ2,Φ2)、(θ3,Φ3)、(θ4,Φ4)の四つの座標で表される。なお、画像D22内の座標(θ,Φ)は、画角中心P23のPT座標値を表している。

座標保存部110は、座標変換部108から入力された人体および物体のPT座標値と画像情報とを保存し、画角計算部111へ出力する。

画角計算部111は、座標保存部110から読み出された人体および物体のPT座標値と画像情報とを基に、カメラの現在の画角内の人体と画角外の物体とを収めることを可能にするカメラの画角を算出する。本実施形態の場合、画角計算部111は、現在の画角内の人体と画角外の物体とを収めることを可能にするカメラの画角を決めるためのPTZ値を算出する。

画角計算部111は、座標保存部110から読み出された人体および物体のPT座標値と画像情報とを基に、カメラの現在の画角内の人体と画角外の物体とを収めることを可能にするカメラの画角を算出する。本実施形態の場合、画角計算部111は、現在の画角内の人体と画角外の物体とを収めることを可能にするカメラの画角を決めるためのPTZ値を算出する。

画角計算部111が、カメラ現在の画角内の人体と画角外の物体とを収めるカメラの画角を決めるためのPTZ値を計算する様子を、図4と図5を用いて説明する。

図4において、画角D31は、カメラの現在の画角を表している。人体P31は図2で例示した人体P1に対応し、また、物体P32は図2の物体P2に、物体P33は図2の物体P3に対応しているとする。人体P31の矩形のPT座標値は、左上、右上、左下、右下の各頂点の順に、(θ1,Φ1)、(θ2,Φ2)、(θ3,Φ3)、(θ4,Φ4)の四つの座標値により表されるとする。また矩形の物体P33のPT座標値は、左上、右上、左下、右下の各頂点の順に、(θ5,Φ5)、(θ6,Φ6)、(θ7,Φ7)、(θ8,Φ8)の四つの座標値により表されるとする。同じく矩形の物体P32のPT座標値は、左上、右上、左下、右下の各頂点の順に、(θ9,Φ9)、(θ10,Φ10)、(θ11,Φ11)、(θ12,Φ12)の四つの座標値により表されるとする。図4に示したカメラの現在の画角D31は人体P31と物体P33とを収めるような画角になっており、物体P32はカメラの現在の画角外になっているとする。ただし、物体P32のPT座標値は、プリセット画角を用いた際のPT座標変換処理で取得されて座標保存部110に保存されているため、画角計算部111は、当該座標保存部110から物体P32のPT座標値を取得可能である。

図4において、画角D31は、カメラの現在の画角を表している。人体P31は図2で例示した人体P1に対応し、また、物体P32は図2の物体P2に、物体P33は図2の物体P3に対応しているとする。人体P31の矩形のPT座標値は、左上、右上、左下、右下の各頂点の順に、(θ1,Φ1)、(θ2,Φ2)、(θ3,Φ3)、(θ4,Φ4)の四つの座標値により表されるとする。また矩形の物体P33のPT座標値は、左上、右上、左下、右下の各頂点の順に、(θ5,Φ5)、(θ6,Φ6)、(θ7,Φ7)、(θ8,Φ8)の四つの座標値により表されるとする。同じく矩形の物体P32のPT座標値は、左上、右上、左下、右下の各頂点の順に、(θ9,Φ9)、(θ10,Φ10)、(θ11,Φ11)、(θ12,Φ12)の四つの座標値により表されるとする。図4に示したカメラの現在の画角D31は人体P31と物体P33とを収めるような画角になっており、物体P32はカメラの現在の画角外になっているとする。ただし、物体P32のPT座標値は、プリセット画角を用いた際のPT座標変換処理で取得されて座標保存部110に保存されているため、画角計算部111は、当該座標保存部110から物体P32のPT座標値を取得可能である。

図5は、画角計算部111が、それらPT座標値を基に、人体P31と物体P32を収める画角を計算する様子を説明する図である。

まず画角計算部111における画角の決め方について説明する。画角は中心点と水平画角値および垂直画角値が決まれば一意に決定される。また、水平画角値および垂直画角値はカメラの焦点距離によって変わり、本実施形態のようにズーム光学系を有するカメラの焦点距離はズーム倍率によって決まる。また一般的に、画像のアスペクト比に従って画像サイズが決まるため、水平画角値および垂直画角値はどちらか一方が定まれば他方も定まる。これらのことから、本実施形態において、画角計算部111は、画角を、中心点とズーム倍率に対応した水平画角値とを計算することで求めることにする。

まず画角計算部111における画角の決め方について説明する。画角は中心点と水平画角値および垂直画角値が決まれば一意に決定される。また、水平画角値および垂直画角値はカメラの焦点距離によって変わり、本実施形態のようにズーム光学系を有するカメラの焦点距離はズーム倍率によって決まる。また一般的に、画像のアスペクト比に従って画像サイズが決まるため、水平画角値および垂直画角値はどちらか一方が定まれば他方も定まる。これらのことから、本実施形態において、画角計算部111は、画角を、中心点とズーム倍率に対応した水平画角値とを計算することで求めることにする。

図5において、人体P41は図4の人体P31に対応し、同様に、物体P42は図4の物体P32に、物体P43は図4の物体P33に対応しているとする。このため、図5の人体P41、物体P42、物体P43のそれぞれのPT座標値は、図4の人体P31、物体P32、物体P33における各PT座標値と同一であるとする。また人体P41と物体P42とを収める画角の中心をP44とし、そのPT座標値を(θ',Φ')とし、水平画角値をP45とし、その値をω'とする。これら中心P44のPT座標値(θ',Φ')と、水平画角値ω'は、以下のようにして計算することができる。

水平画角値ω'は、式(1)のように、人体P41と物体P42とのP座標値(パン座標値)の差分値として算出することができる。

ω'=max(θ1,θ2,θ9,θ10)-min(θ1,θ2,θ9,θ10) 式(1)

なお式(1)において、max()はカッコ内の最大値を取得することを表し、min()はカッコ内の最小値を取得することを表すとする。

また、画角の中心P44のP座標値θ'は、式(2)のように、人体P41と物体P42のP座標値の平均値として算出することができる。

θ'=(max(θ1,θ2,θ9,θ10)+min(θ1,θ2,θ9,θ10))/2 式(2)

また、画角の中心P44のT座標値(チルト座標値)は、式(3)のように、人体P41と物体P42のT座標値の平均値として算出することができる。

Φ'=(max(Φ1,Φ2,Φ9,Φ10)+min(Φ1,Φ2,Φ9,Φ10))/2 式(3)

画角計算部111は、前述のようにして画角D41を計算し、その画角と画像情報とを画角操作部112へ出力する。本実施形態の場合、画角計算部111は、前述したような計算による画角取得処理の他にも、例えば予め複数の画角が用意されたテーブルの中から選択するような画角取得処理を行ってもよい。

画角操作部112は、画角計算部111から入力された画角と画像情報、または検出判断部104から入力されたプリセット画角と画像情報を用いて、カメラの画角を操作、つまりカメラの画角調整制御を行う。その後、画角操作部112からは、画角調整後の画像情報が、画像出力部113に出力される。

画像出力部113は、画角操作部112から入力された画像情報をモニタ装置114へ出力する。これにより、モニタ装置114は、画像出力部113から入力された画像情報に基づく映像をモニタ表示する。

画像出力部113は、画角操作部112から入力された画像情報をモニタ装置114へ出力する。これにより、モニタ装置114は、画像出力部113から入力された画像情報に基づく映像をモニタ表示する。

図6は、第1実施形態の自動撮影システム100に係る処理のうち、特に画角調整装置102における画角調整処理の流れを示したフローチャートである。なお、これ以降の各フローチャートの説明において、符号に付されたアルファベットのSは処理ステップを意味するものとする。自動撮影システム100は、ユーザ操作によって起動の指示が入力されると自動撮影のための処理を開始する。

まずS1において、画角調整装置102の画像入力部103は、画像取得装置101から画像情報を取得する。そして、画角調整装置102の処理はS2に進む。

まずS1において、画角調整装置102の画像入力部103は、画像取得装置101から画像情報を取得する。そして、画角調整装置102の処理はS2に進む。

S2において、検出判断部104は、画像入力部103から入力された画像情報を用いて、カメラの画角に収める対象物体を検出しているかどうか、つまり画像内に対象物体があるかどうかを判定する。S2において検出判断部104が判定する対象物体は、人体または物体の対象被写体である。検出判断部104は、S2の判定結果が真(S2でYES)の場合、つまり画角に収める対象物体を検出している場合、S4へ処理を進める。一方、S2の判定結果が偽(S2でNO)の場合、つまり画角に収める対象物体を検出していない場合、検出判断部104は画像情報を物体検出部106へ出力し、画角調整装置102の処理はS3へ進む。

S3に進むと、物体検出部106は、検出判断部104から入力された画像情報を用いて、例えば第2の対象被写体である物体の検出処理を行い、検出した物体の座標と画像情報を座標変換部108へ出力する。そして、画角調整装置102の処理はS7へ進む。

S4に進んだ場合、検出判断部104は、画角保存部105から取得したプリセット画角を使用したかどうかの情報を用いて、他に検出対象となる第2の対象被写体の物体が存在しないかを判定する。検出判断部104は、S4の判定結果が真(S4でYES)の場合、つまり他に検出対象となる物体が存在しない場合、画像情報を人体検出部107へ出力する。そして、画角調整装置102の処理はS6へ進む。一方、検出判断部104は、S4の判定結果が偽(S4でNO)の場合、つまり他に検出対象となる物体が存在する場合、S5へ処理を進める。

S4からS5に進むと、検出判断部104は、画角保存部105からプリセット画角の情報を取得する。そして、画角調整装置102の処理はS10へ進む。

S5からS10に進んだ場合、S10において、画角操作部112は、プリセット画角の情報を基に、そのプリセット画角内に物体が収まるように画角操作を行う。そして、画角調整装置102の処理はS11へ進む。

S5からS10に進んだ場合、S10において、画角操作部112は、プリセット画角の情報を基に、そのプリセット画角内に物体が収まるように画角操作を行う。そして、画角調整装置102の処理はS11へ進む。

S11において、画像出力部113は、画角操作部112から入力された画像情報をモニタ装置114へ出力する。これにより、モニタ装置114には、画像情報に基づく映像が表示される。そして、画角調整装置102の処理はS12へ進む。

S12に進むと、画角調整装置102は、ユーザ操作による不図示の自動撮影システムオン/オフ(On/Off)スイッチが操作されて自動撮影処理の停止操作が行われたかどうかを判別する。画角調整装置102は、S12の判定結果が偽(S12でNO)の場合、つまりオフのスイッチ操作がなされていないと判定した場合にはS1へ戻る。一方、S12の判定結果が真(S12でYES)の場合、つまりオフのスイッチ操作がなされたと判定した場合、画角調整装置102は、図6のフローチャートの処理を終了する。

前述したようにS4からS5へ進み、さらにS10、S11、S12の処理を経てS1に戻り、さらにS2からS3へ進んだ場合、物体検出部106は、プリセット画角で取得された画像情報を用いて物体検出処理を行うことになる。そして、物体検出部106は、プリセット画角内で検出された物体の座標と画像情報を座標変換部108へ出力する。

また、S4からS6に進んだ場合、人体検出部107は、検出判断部104から取得した画像情報を用いて人体の検出処理を行い、検出した人体の座標と画像情報とを座標変換部108へ出力する。そして、画角調整装置102の処理はS7へ進む。

S3からS7に進んだ場合、S7において、座標変換部108は、物体検出部106から得た物体の座標と画像情報、および位置保存部109から得たカメラの現在のPTZ値を基に、当該物体の画角内座標をPT座標値に変換する。また、S6からS7に進んだ場合、S7において、座標変換部108は、人体検出部107から得た人体の座標と画像情報、および位置保存部109から得たカメラの現在のPTZ値を基に、当該人体の画角内座標をPT座標値に変換する。そして、座標変換部108は、それら変換したPT座標値を、座標保存部110へ出力する。そして、画角調整装置102の処理はS8へ進む。

S8において、座標保存部110は、座標変換部108から取得したPT座標値を保存する。すなわち座標保存部110には、人体および物体のPT座標値が保存される。そして、画角調整装置102の処理はS9へ進む。

S9において、画角計算部111は、座標保存部110から取得した人体および物体のPT座標値から、画角内の人体とそのとき画角外となっている物体とが収まる画角を計算する。すなわち画角計算部111では、画角内の人体と、後段の画角操作部112で画角操作が行われる前には画角外であった物体とが、収まる画角を計算する。そして、画角計算部111は、その計算した画角の情報を画角操作部112へ出力する。その後、画角調整装置102の処理はS10へ進む。

S9において、画角計算部111は、座標保存部110から取得した人体および物体のPT座標値から、画角内の人体とそのとき画角外となっている物体とが収まる画角を計算する。すなわち画角計算部111では、画角内の人体と、後段の画角操作部112で画角操作が行われる前には画角外であった物体とが、収まる画角を計算する。そして、画角計算部111は、その計算した画角の情報を画角操作部112へ出力する。その後、画角調整装置102の処理はS10へ進む。

S10において、画角操作部112は、画角計算部111から取得した画角の情報に基づく画角操作を行う。すなわち画角操作部112では、人体と物体が収まるような画角操作が行われる。そして、画角調整装置102の処理はS11へ進む。

S11に進むと、画像出力部113は、画角操作部112から入力された画像情報をモニタ装置114へ出力し、これにより、モニタ装置114には画像情報に基づく映像が表示される。その後、S12に進むと、画角調整装置102は、自動撮影システムOn/Offスイッチの操作により停止操作が行われたかどうかを判別する。そして、画角調整装置102は、S12の判定結果が偽(S12でNO)の場合にはS1へ戻り、S12の判定結果が真(S12でYES)の場合には図6のフローチャートの処理を終了する。

第1実施形態の画角調整装置102は、プリセット画角等を用いて予め物体検出したときの画角内座標をPT座標値に変換して保存しておき、そのPT座標値を用いて画角内の人体とそのとき画角外であった物体とを収める画角を計算する。すなわち本実施形態においては、カメラの現在の画角に収めたい物体がその画角外に存在する場合、画角内の人体と画角外の物体を収める画角を計算して画角調整を行うことで、それら人体と物体を含む画像を取得することが可能となる。これにより、本実施形態によれば、例えば講師が授業をするシーンを自動撮影するような自動撮影システムにおいて、講師と物体とを収めて撮影し続けることが可能となる。

<第2実施形態>

以下、第2実施形態に係る撮影制御装置の構成例について、図7を参照して説明する。図7は本実施形態に係る撮影制御装置である画角調整装置202を含んだ自動撮影システム200の機能構成を示すブロック図である。第2実施形態の自動撮影システム200は、画像取得装置101、画角調整装置202、およびモニタ装置114を有している。画角調整装置202とモニタ装置114は、ビデオインターフェースを介して接続されている。なお、第2実施形態においても、講師が授業を行っているシーンを自動撮影する用途を例に挙げるとする。

以下、第2実施形態に係る撮影制御装置の構成例について、図7を参照して説明する。図7は本実施形態に係る撮影制御装置である画角調整装置202を含んだ自動撮影システム200の機能構成を示すブロック図である。第2実施形態の自動撮影システム200は、画像取得装置101、画角調整装置202、およびモニタ装置114を有している。画角調整装置202とモニタ装置114は、ビデオインターフェースを介して接続されている。なお、第2実施形態においても、講師が授業を行っているシーンを自動撮影する用途を例に挙げるとする。

第2実施形態の画角調整装置202は、撮影された画像から、人体と物体と当該物体上の注目領域とを検出して、それらの画角内座標値をPT座標値で保存し、そのPT座標値を用いて画角計算する際に注目領域が画角端になるようにする。すなわち第2実施形態の画角調整装置202は、人体と物体とを収める画角を取得する際に、人体が画角の端から余裕を持つ位置になるような画角を計算する。第2実施形態では、注目領域として板書領域を用いる例を挙げる。板書領域とは、例えば講義に用いられている黒板やホワイトボード等において、講義内容が書かれた領域であるとする。

第2実施形態の画角調整装置202は、画像取得装置101から画像情報が入力されると、対象被写体として画角に収める物体を検出したかを判定し、検出していなければプリセット機能を用いて画角を調整して撮影した画像から物体検出を行う。また、画角調整装置202は、そのときの物体の画角内座標をカメラのPTZ値を用いてPT座標値に変換して保存する。その後、画角調整装置202は、画像内の人体または板書領域を検出し、物体の場合と同様に画角内座標をPT座標値に変換する。そして、画角調整装置202は、人体と物体と板書領域のPT座標値を基に、板書領域を画角端にして人体が画角の端まで余裕を持った画角に調整することで、人体と物体を画角に収める。その後、画角調整装置202は、画角調整した画像情報をモニタ装置114へ出力して、その画像情報に基づく映像を表示させる。

画角調整装置202において、画像入力部103、検出判断部104、画角保存部105、物体検出部106、人体検出部107、座標変換部108、位置保存部109、画角操作部112、および画像出力部113は第1実施形態と同様である。第2実施形態の画角調整装置202の場合、座標保存部210と画角計算部211における処理と、領域抽出部215を有していることが、第1実施形態とは異なる。以下、第1実施形態とは異なる処理および構成について説明する。

領域抽出部215は、人体検出部107から入力された人体の座標値と画像情報、または物体検出部106から入力された物体の座標値と画像情報を用いて、板書領域の抽出を行う。板書領域の抽出方法は、動画の時間軸上で異なる時間のフレーム画像の輝度情報の差分を基に板書領域を抽出する方法や、文字認識結果や図形認識結果を基に板書領域を抽出するなどの公知の手法を用いればよく、その詳細な説明は省略する。そして、領域抽出部215は、画角内座標によって表される板書領域の座標値と人体の座標値と物体の座標値を、画像情報と共に座標変換部108へ出力する。

座標変換部108は、板書領域と人体と物体のそれぞれの画角内座標を、第1実施形態で説明したのと同様の処理によってPT座標値に変換する。

座標保存部210は、座標変換部108から入力された、人体のPT座標値、物体のPT座標値、板書領域のPT座標値、および画像情報を保存する。そして、座標保存部210は、それらPT座標値および画像情報を画角計算部211へ出力する。

座標保存部210は、座標変換部108から入力された、人体のPT座標値、物体のPT座標値、板書領域のPT座標値、および画像情報を保存する。そして、座標保存部210は、それらPT座標値および画像情報を画角計算部211へ出力する。

画角計算部211は、座標保存部210から入力された人体のPT座標値、物体のPT座標値、板書領域のPT座標値、および画像情報を基に、人体と物体を収めつつ、板書領域が画角端となり、人体が画角の端から余裕を持った画角を計算する。

図8は、座標保存部210から入力されたPT座標値を示した図である。人体P51は図2に示した人体P1に対応し、物体P52とP53は図2の物体P2とP3に対応しているとする。また図8の物体P52において点線で囲われた矩形領域は当該物体P52について抽出された板書領域P54であり、物体P53において点線で囲われた矩形領域は物体P53について抽出された板書領域P55であるとする。また図8において、人体P51を示す矩形のPT座標値は、前述の図4や図5の各PT座標と同様、左上、右上、左下、右下の各頂点の順に(θ1,Φ1)、(θ2,Φ2)、(θ3,Φ3)、(θ4,Φ4)であるとする。また物体P53のPT座標は、前述同様、左上、右上、左下、右下の各頂点順に(θ5,Φ5)、(θ6,Φ6)、(θ7,Φ7)、(θ8,Φ8)、物体P52のPT座標は(θ9,Φ9),(θ10,Φ10),(θ11,Φ11),(θ12,Φ12)とする。板書領域P54のPT座標値は、左上、右上、左下、右下の各頂点の順に(θ13,Φ13),(θ14,Φ14),(θ15,Φ15),(θ16,Φ16)であるとする。また板書領域P55のPT座標値は、左上、右上、左下、右下の各頂点の順に(θ17,Φ17),(θ18,Φ18),(θ19,Φ19),(θ20,Φ20)であるとする。

図9は、第2実施形態の画角計算部211が、それらのPT座標値を基に人体P51と板書領域P54を収める画角を計算する様子を表した図である。図9において、人体P61は図8に示した人体P51と対応し、物体P62と板書領域P63は図8の物体P52と板書領域P54に対応している。また、中心P64は、第1実施形態で説明した方法と同様にして計算した画角の中心P44に対応しており、そのPT座標値は(θ',Φ')であるとする。同様に、水平画角値P66は、第1実施形態で説明した方法と同様に計算した水平画角値P45に対応しており、その水平画角値はω'であるとする。そして、画角D61は、前述の図5に示した画角D41に対応しているとする。

ここで、画角D61の場合、人体P61が画角の端に位置しているため、移動等によって人体P61が画角外に出てしまい、見失ってしまう可能性が高い。

そのため、第2実施形態の場合、画角計算部211は、人体P61がある程度動いたとしても見失い難く、且つ、物体P62の板書領域P63が収まるような画角を計算する。

第2実施形態の場合、板書領域P63が収まり且つ画角の端に対して人体P61が収まる余裕を持たせるために、第1実施形態で説明した計算で得られた画角D61を、板書領域P63が画角端となるようにスライドした画角D62を計算する。図9に示した画角D62は、スライドした後の画角である。その画角D62の中心P65のPT座標値を(θ'',Φ'')とし、水平画角値P67をω''とすると、式(4)で表すことができる。そして画角計算部211は、その算出した画角D62と画像情報を画角操作部112へ出力する。

そのため、第2実施形態の場合、画角計算部211は、人体P61がある程度動いたとしても見失い難く、且つ、物体P62の板書領域P63が収まるような画角を計算する。

第2実施形態の場合、板書領域P63が収まり且つ画角の端に対して人体P61が収まる余裕を持たせるために、第1実施形態で説明した計算で得られた画角D61を、板書領域P63が画角端となるようにスライドした画角D62を計算する。図9に示した画角D62は、スライドした後の画角である。その画角D62の中心P65のPT座標値を(θ'',Φ'')とし、水平画角値P67をω''とすると、式(4)で表すことができる。そして画角計算部211は、その算出した画角D62と画像情報を画角操作部112へ出力する。

θ''=θ'+(θ13-θ9),

Φ''=Φ', 式(4)

ω''=ω'

Φ''=Φ', 式(4)

ω''=ω'

図10は、第2実施形態に係る自動撮影システム200における処理のうち、特に画角調整装置202における画角調整処理の流れを示したフローチャートである。自動撮影システム200は、ユーザ操作によって起動されると自動撮影のための処理を開始する。

まずS101において、画角調整装置202の画像入力部103は、画像取得装置101から画像情報を取得する。

次にS102において、検出判断部104は、画像入力部103から入力された画像情報を用いて画角に収める対象物体を検出しているかどうかを判定する。検出判断部104は、S102の判定結果が真(S102でYES)の場合、S104へ処理を進める。一方、S102の判定結果が偽(S102でNO)の場合、検出判断部104は、画像情報を物体検出部106へ出力し、画角調整装置202の処理はS103へ進む。

まずS101において、画角調整装置202の画像入力部103は、画像取得装置101から画像情報を取得する。

次にS102において、検出判断部104は、画像入力部103から入力された画像情報を用いて画角に収める対象物体を検出しているかどうかを判定する。検出判断部104は、S102の判定結果が真(S102でYES)の場合、S104へ処理を進める。一方、S102の判定結果が偽(S102でNO)の場合、検出判断部104は、画像情報を物体検出部106へ出力し、画角調整装置202の処理はS103へ進む。

S103に進むと、物体検出部106は、検出判断部104から入力された画像情報を用いて物体検出処理を行い、検出した物体の座標と画像情報を、領域抽出部215へ出力する。そして、画角調整装置202の処理はS107へ進む。

S104に進んだ場合、検出判断部104は、画角保存部105から取得したプリセット画角を使用したかどうかの情報を用いて、他に検出対象となる物体が存在しないかを判定する。検出判断部104は、S104の判定結果が真(S104でYES)の場合、画像情報を人体検出部107へ出力する。そして、画角調整装置202の処理はS106へ進む。一方、検出判断部104は、S104の判定結果が偽(S104でNO)の場合、S105へ処理を進める。

S105に進むと、検出判断部104は、画角保存部105からプリセット画角の情報を取得する。そして、画角調整装置202の処理はS111へ進む。S105からS111以降に進んだ場合の処理は、前述した図6のS5からS10以降に進んだ場合と同様である。

またS106に進んだ場合、人体検出部107は、検出判断部104から取得した画像情報を用いて人体を検出し、その検出した人体の座標と画像情報とを領域抽出部215へ出力する。そして、画角調整装置202の処理はS107へ進む。

S107において、領域抽出部215は、物体検出部106から入力された物体の座標と画像情報を用いて、板書領域を抽出する。そして、領域抽出部215は、抽出した板書領域の座標と画像情報、人体検出部107から入力された人体の座標と画像情報、物体検出部106から入力された物体の座標と画像情報を、座標変換部108へ出力する。そして、画角調整装置202の処理はS108へ進む。

S108において、座標変換部108は、領域抽出部215から得た板書領域の座標と画像情報、人体の座標と画像情報、物体の座標と画像情報、および位置保存部109から得たカメラの現在のPTZ値を基に、画角内座標をPT座標値に変換する。そして、座標変換部108は、その変換したPT座標値を、座標保存部210へ出力する。そして、画角調整装置202の処理はS109へ進む。

S109において、座標保存部210は、座標変換部108から取得したPT座標値を保存する。そして、画角調整装置202の処理はS110へ進む。

S110において、画角計算部211は、座標保存部210から取得した板書領域、人体および物体のPT座標値から、人体と物体が収まり且つ、板書領域が画角端で人体が画角端から余裕を持った画角を計算する。さらに画角計算部211は、その計算した画角の情報を画角操作部112へ出力する。そして、画角調整装置202の処理はS111へ進む。

S110において、画角計算部211は、座標保存部210から取得した板書領域、人体および物体のPT座標値から、人体と物体が収まり且つ、板書領域が画角端で人体が画角端から余裕を持った画角を計算する。さらに画角計算部211は、その計算した画角の情報を画角操作部112へ出力する。そして、画角調整装置202の処理はS111へ進む。

S111において、画角操作部112は、画角計算部211から取得した画角の情報を基に、人体と物体が収まり且つ板書領域が画角端で人体が画角端から余裕を持つ画角となるように画角調整を行う。そして、画角調整装置202の処理はS112へ進む。

S112において、画像出力部113は、画角操作部112から入力された画像情報をモニタ装置114へ出力する。これにより、モニタ装置114には、画像情報に基づく映像が表示される。そして、画角調整装置202の処理はS113へ進む。

S112において、画像出力部113は、画角操作部112から入力された画像情報をモニタ装置114へ出力する。これにより、モニタ装置114には、画像情報に基づく映像が表示される。そして、画角調整装置202の処理はS113へ進む。

S113に進むと、画角調整装置202は、ユーザ操作による自動撮影システムOn/Offスイッチが操作されて自動撮影処理の停止操作が行われたかどうかを判別する。画角調整装置202は、S113の判定結果が偽(S113でNO)の場合、S101へ戻る。一方、S113の判定結果が真(S113でYES)の場合、画角調整装置202は、図10のフローチャートの処理を終了する。

第2実施形態の画角調整装置202は、予め物体検出したときの画角内座標をPT座標値に変換して保存し、そのPT座標値を基に画角計算し、注目領域が画角端で且つ人体が画角端から余裕を持った画角に制御する。すなわち本実施形態によれば、カメラの現在の画角に収めたい物体がその画角外に存在する場合、それら画角内の人体と画角外の物体を画角に収めつつ板書領域が画像端で人体が画角端から余裕を持った画角で撮影し続けることが可能となる。

<第3実施形態>

以下、第3実施形態に係る撮影制御装置の構成例について、図11を参照して説明する。図11は本実施形態に係る撮影制御装置である画角調整装置302を含んだ自動撮影システム300の機能構成を示すブロック図である。第3実施形態の自動撮影システム300は、画像取得装置101、画角調整装置302、およびモニタ装置114を有している。画角調整装置302とモニタ装置114は、ビデオインターフェースを介して接続されている。なお、第3実施形態においても、講師が授業を行っているシーンを自動撮影する用途を例に挙げる。

以下、第3実施形態に係る撮影制御装置の構成例について、図11を参照して説明する。図11は本実施形態に係る撮影制御装置である画角調整装置302を含んだ自動撮影システム300の機能構成を示すブロック図である。第3実施形態の自動撮影システム300は、画像取得装置101、画角調整装置302、およびモニタ装置114を有している。画角調整装置302とモニタ装置114は、ビデオインターフェースを介して接続されている。なお、第3実施形態においても、講師が授業を行っているシーンを自動撮影する用途を例に挙げる。

第3実施形態の画角調整装置302は、撮影された画像から人体と物体を検出し、それらの画角内座標値をPT座標値で保存し、そのPT座標値を用いて画角計算する際に、人体が、画角端から人体の横幅分の余裕を持った画角になるようにする。すなわち第3実施形態の画角調整装置302は、人体と物体とを画角に収めるときに、人体が画角端から余裕を持つような画角調整を行う。

第3実施形態の画角調整装置302は、画像取得装置101から画像情報が入力されると、対象被写体として画角に収める物体を検出したかを判定し、検出していなければプリセット機能を用いて画角を調整して撮影した画像から物体検出を行う。また、画角調整装置302は、そのときの画角内座標をカメラのPTZ値を用いてPT座標値に変換して保存する。その後、画角調整装置302は、画像内の人体を検出し、物体の場合と同様に画角内座標をPT座標値に変換する。そして、画角調整装置302は、人体と物体のPT座標値を基に、人体が画角端から人体の横幅分だけ余裕を持った画角を計算して画角調整を行うことで、人体と物体を画角に収める。その後、画角調整装置302は、画角調整した後の画像情報をモニタ装置114へ出力してその画像情報に応じた映像を表示させる。

画角調整装置302において、画像入力部103、検出判断部104、画角保存部105、物体検出部106、人体検出部107、座標変換部108、位置保存部109、座標保存部110、画角操作部112、および画像出力部113は、前述同様である。第3実施形態の画角調整装置302の場合、画角計算部311における処理が、第1実施形態とは異なる。以下、第1実施形態とは異なる処理および構成について説明する。

画角計算部311は、座標保存部110から取得した人体および物体のPT座標値と画像情報を用いて、画角内の人体と画角外であった物体とを収めつつ、人体が画角端から人体の横幅分余裕を持った画角を計算する。

図12は、第3実施形態の画角計算部311が、それらのPT座標値を基に画角を計算する様子を表した図である。図12において、人体P71は例えば図5に示した人体P31と対応し、物体P72は図5の物体P42に対応している。また図12において、人体P71を示す矩形のPT座標値は、左上、右上、左下、右下の各頂点の順に、前述同様の(θ1,Φ1)、(θ2,Φ2)、(θ3,Φ3)、(θ4,Φ4)であるとする。また物体P72のPT座標は、左上、右上、左下、右下の各頂点の順に(θ9,Φ9),(θ10,Φ10),(θ11,Φ11),(θ12,Φ12)であるとする。画角D71は、人体P71と物体P72を収めつつ、人体P71が画角端から人体の横幅分(距離P75)だけ余裕を持った画角を表している。また画角D71における中心P73のPT座標値を(θ''',Φ''')とし、水平画角値P74をω'''とする。そして、人体P71を表す検出矩形と画角端までの距離P75をθdとすると、式(5)で表せる。

θd=θ2-θ1 式(5)

また画角の中心P73のP座標値θ'''は、人体P71のP座標値に人体の横幅分の距離P75を加算したP座標値と物体P72のP座標値との平均値として、式(6)により算出することができる。

θ'''=(max(θ1,θ2,θ9,θ10)+θd+min(θ1,θ2,θ9,θ10))/2 式(6)

また画角の中心P73のT座標値Φ'''は、人体P71のT座標値と物体P72のT座標値との平均値として、式(7)により算出することができる。

Φ'''=(max(Φ1,Φ2,Φ9,Φ10)+min(Φ1,Φ2,Φ9,Φ10))/2 式(7)

さらに水平画角値ω'''は、人体P71と物体P72のP座標値の差分値と、人体の横幅分の距離P75との加算値として、式(8)により算出することができる。

ω'''=max(θ1,θ2,θ9,θ10)-min(θ1,θ2,θ9,θ10)+θd 式(8)

そして画角計算部311は、それら算出した画角と画像情報を画角操作部112へ出力する。

図13は、第3実施形態に係る自動撮影システム300における処理のうち、特に画角調整装置302における画角調整処理の流れを示したフローチャートである。自動撮影システム300は、ユーザ操作によって起動されると自動撮影のための処理を開始する。

図13は、第3実施形態に係る自動撮影システム300における処理のうち、特に画角調整装置302における画角調整処理の流れを示したフローチャートである。自動撮影システム300は、ユーザ操作によって起動されると自動撮影のための処理を開始する。

まずS201において、画角調整装置302の画像入力部103は、画像取得装置101から画像情報を取得する。

次にS202において、検出判断部104は、画像入力部103から入力された画像情報を用いて画角に収める対象被写体の物体が検出されたかを判定する。検出判断部104は、S202の判定結果が真(S202でYES)の場合にはS204へ処理を進め、一方、S202の判定結果が偽(S202でNO)の場合には画像情報を物体検出部106へ出力する。そして、画角調整装置302の処理はS203へ進む。

次にS202において、検出判断部104は、画像入力部103から入力された画像情報を用いて画角に収める対象被写体の物体が検出されたかを判定する。検出判断部104は、S202の判定結果が真(S202でYES)の場合にはS204へ処理を進め、一方、S202の判定結果が偽(S202でNO)の場合には画像情報を物体検出部106へ出力する。そして、画角調整装置302の処理はS203へ進む。

S203に進むと、物体検出部106は、検出判断部104から入力された画像情報を用いて物体検出処理を行い、検出した物体の座標と画像情報を、座標変換部108へ出力する。そして、画角調整装置302の処理はS207へ進む。

S204に進んだ場合、検出判断部104は、画角保存部105から取得したプリセット画角を使用したかどうかの情報を用いて、他に検出対象となる物体が存在しないかを判定する。検出判断部104は、S204の判定結果が真(S204でYES)の場合、画像情報を人体検出部107へ出力し、その後、画角調整装置302の処理はS206へ進む。一方、検出判断部104は、S204の判定結果が偽(S204でNO)の場合、S205へ処理を進める。

S205に進むと、検出判断部104は画角保存部105からプリセット画角の情報を取得し、その後、画角調整装置302の処理はS210へ進む。S205からS210以降に進んだ場合の処理は、前述した図6のS5からS10以降に進んだ場合と同様である。

またS206に進んだ場合、人体検出部107は、検出判断部104から取得した画像情報を用いて人体を検出し、検出した人体の座標と画像情報とを座標変換部108へ出力する。その後、画角調整装置302の処理はS207へ進む。

またS206に進んだ場合、人体検出部107は、検出判断部104から取得した画像情報を用いて人体を検出し、検出した人体の座標と画像情報とを座標変換部108へ出力する。その後、画角調整装置302の処理はS207へ進む。

S207に進むと、座標変換部108は、人体の座標と画像情報、または物体の座標と画像情報、およびカメラの現在のPTZ値を基に、画角内座標をPT座標値に変換する。そして、座標変換部108は、その変換したPT座標値を、座標保存部110へ出力する。その後、画角調整装置302の処理はS208へ進む。

S208において、座標保存部110は、座標変換部108から取得したPT座標値を保存し、その後、画角調整装置302の処理はS209へ進む。

S208において、座標保存部110は、座標変換部108から取得したPT座標値を保存し、その後、画角調整装置302の処理はS209へ進む。

S209において、画角計算部311は、座標保存部110から取得した人体および物体のPT座標値から、物体が画角端で、人体が画角端から人体の横幅分余裕を持った画角を計算する。さらに画角計算部311は、その計算した画角の情報を画角操作部112へ出力する。その後、画角調整装置302の処理はS210へ進む。

S210において、画角操作部112は、画角計算部311から取得した画角の情報を基に、人体と物体が収まり且つ、物体が画角端で人体が画角端から人体の横幅分余裕を持った画角に応じた画角操作を行う。その後、画角調整装置302の処理はS211へ進む。

S210において、画角操作部112は、画角計算部311から取得した画角の情報を基に、人体と物体が収まり且つ、物体が画角端で人体が画角端から人体の横幅分余裕を持った画角に応じた画角操作を行う。その後、画角調整装置302の処理はS211へ進む。

S211において、画像出力部113は、画角操作部112から入力された画像情報をモニタ装置114へ出力する。これにより、モニタ装置114には、画像情報に基づく映像が表示される。

次にS212に進むと、画角調整装置302は、自動撮影システムOn/Offスイッチが操作されて自動撮影処理の停止操作が行われたかどうかを判別し、S212の判定結果が偽(S212でNO)の場合、S201へ戻る。一方、S212の判定結果が真(S212でYES)の場合、画角調整装置302は、図13のフローチャートの処理を終了する。

次にS212に進むと、画角調整装置302は、自動撮影システムOn/Offスイッチが操作されて自動撮影処理の停止操作が行われたかどうかを判別し、S212の判定結果が偽(S212でNO)の場合、S201へ戻る。一方、S212の判定結果が真(S212でYES)の場合、画角調整装置302は、図13のフローチャートの処理を終了する。

第3実施形態の画角調整装置302は、予め物体検出したときの画角内座標をPT座標値に変換して保存し、人体と物体のPT座標値に加え、人体の横幅をも用いて画角計算する。これにより本実施形態によれば、人体と物体を画角内に収めつつ人体が画角端から余裕を持った画角で撮影し続けることが可能となる。

<第4実施形態>

以下、第4実施形態に係る撮影制御装置の構成例について、図14を参照して説明する。図14は本実施形態に係る撮影制御装置である画角調整装置402を含んだ自動撮影システム400の機能構成を示すブロック図である。第4実施形態の自動撮影システム400は、画像取得装置101、画角調整装置402、およびモニタ装置114を有している。画角調整装置402とモニタ装置114は、ビデオインターフェースを介して接続されている。なお、第4実施形態においても、講師が授業を行っているシーンを自動撮影する用途を例に挙げる。

以下、第4実施形態に係る撮影制御装置の構成例について、図14を参照して説明する。図14は本実施形態に係る撮影制御装置である画角調整装置402を含んだ自動撮影システム400の機能構成を示すブロック図である。第4実施形態の自動撮影システム400は、画像取得装置101、画角調整装置402、およびモニタ装置114を有している。画角調整装置402とモニタ装置114は、ビデオインターフェースを介して接続されている。なお、第4実施形態においても、講師が授業を行っているシーンを自動撮影する用途を例に挙げる。

第4実施形態の画角調整装置402は、撮影された画像から人体と物体を検出し、それらの画角内座標値をPT座標値で保存し、一定期間内の人体の移動履歴と物体のPT座標値とを用いて画角計算する。すなわち本実施形態の画角調整装置402は、画角内の人体と画角外であった物体を収める画角を取得するときに、人体の移動履歴を考慮した画角計算を行う。

第4実施形態の画角調整装置402は、画像取得装置101から画像情報が入力されると、対象被写体として画角に収める物体を検出したかを判定し、検出していなければプリセット機能を用いて画角を調整して撮影した画像から物体検出を行う。また、画角調整装置402は、そのときの画角内座標をカメラのPTZ値を用いてPT座標値に変換して保存する。その後、画角調整装置402は、画像内の人体を検出し、物体と同様に画角内座標をPT座標値に変換する。またこのとき、画角調整装置402は、一定期間内で一定時間ごとに得られた人体のPT座標値を移動の履歴情報として保存する。そして、画角調整装置402は、一定期間内で一定時間ごとに得られた人体の移動履歴、および物体のPT座標値から、人体と物体を収める画角を計算して画像調整を行う。その後、画角調整装置402は、画角調整した後の画像情報をモニタ装置114へ出力してその画像情報に基づく映像を表示させる。

画角調整装置402の画像入力部103、検出判断部104、画角保存部105、物体検出部106、人体検出部107、座標変換部108、位置保存部109、画角操作部112、および画像出力部113は、前述同様である。第4実施形態の画角調整装置402の場合、座標保存部410と画角計算部411における処理と、操作判断部416を有していることが、第1実施形態とは異なる。以下、第1実施形態とは異なる処理および構成について説明する。

座標保存部410は、座標変換部108から入力された人体および物体のPT座標値を保存する。第4実施形態の座標保存部410は、人体のPT座標値を履歴情報として保存し、後述する操作判断部416から指定された期間の人体の履歴情報と物体のPT座標値とを出力する。

操作判断部416は、タイマー処理によって一定期間経過したかどうかを判定する。操作判断部416は、一定期間経過した場合、座標保存部410から物体のPT座標値と画像情報とその一定期間内の人体の履歴情報とを取得し、それらを画角計算部411へ出力する。なお、操作判断部416は、一定期間経過していない場合には、座標保存部410から取得した画像情報を画像出力部113へ出力する。

画角計算部411は、座標保存部410から入力された人体の履歴情報および物体のPT座標値と画像情報とを用いて、一定期間の人体の移動履歴を考慮して人体と物体を収める画角を計算する。

図15~図19は、第4実施形態の画角計算部411が、それら人体の履歴情報および物体のPT座標値と画像情報を基に画角を計算する様子を説明するための図である。本実施形態では、一定期間をtnとしているが、どんな値にしてもよいものとする。

図15において、範囲D81は、対象被写体となる人体と各物体を包含する範囲を表している。人体P81,P82,P83は、それぞれ時刻t1,t2,tnの時の人体を表している。つまり人体は移動しており、時刻t1の時には人体P81の位置に存在し、時刻t2の時には人体P82の位置に存在し、時刻tnの時には人体P83の位置に存在していたとする。物体P84,P85は、前述の図2に示した物体P2,P3に対応している。

図16は、図15に示した時刻ごとの人体(人体に対応した矩形)のPT座標値と、物体(図16ではobj1,obj2とする)のPT座標値とを表した図である。なお、図16では、人体と物体のPT座標値として、矩形の左上の座標(θ,Φ)と、幅(θd)と、高さ(Φd)を示している。

図17は、時刻t1からtnまでの期間内の人体の移動履歴を基にした画角計算の説明図である。

以下、画角計算部411における画角の計算方法について説明する。

時刻t1からtnまでの期間内に人体が移動していた位置は今後も当該人体が移動する可能性のある位置であるため、画角計算部411は、当該期間内の人体の移動履歴における位置全てと物体(この例では物体P94とする)とを収めるような画角を計算する。

以下、画角計算部411における画角の計算方法について説明する。

時刻t1からtnまでの期間内に人体が移動していた位置は今後も当該人体が移動する可能性のある位置であるため、画角計算部411は、当該期間内の人体の移動履歴における位置全てと物体(この例では物体P94とする)とを収めるような画角を計算する。

図17において、画角の中心P96のPT座標値は(θ4',Φ4')、水平画角値P97はω4'とする。画角の中心P96のP座標値θ4'は人体の移動履歴と物体P94のP座標値とから、式(9)により算出することができる。

θ4'=(max(θ1+θd1,θ2+θd2,…,θn+θdn,θo1+θdo1)+min(θ1,θ2,…,θn,θo1))/2 式(9)

また、画角の中心P96のT座標値Φ4'は、人体の移動履歴と物体P94のT座標値とから、式(10)により算出することができる。

Φ4'=(min(Φ1,Φ2,…,Φn,Φo1)+max(Φ1+Φd1,Φ2+Φd2,…,Φn+Φdn,Φo1+Φdo1))/2 式(10)

水平画角値ω4'は、人体の移動履歴と物体P94のP座標値との差分値として、式(11)により算出することができる。

ω4'=max(θ1+θd1,θ2+θd2,…,θn+θdn,θo1+θdo1)-min(θ1,θ2,…,θn,θo1) 式(11)

画角計算部411は、前述のような計算を行うことで、人物が移動する可能性のある各位置と、物体P94とを収めることができる図17の画角D91を得る。

図18と図19は、次の一定期間(時刻tn+1からt2n)における画角計算の様子を示した図である。

図18において、画角D101は、図17に示した画角D91と同じ大きさの画角である。物体P103,P104は、図15の物体P84,P85と同一である。人体P101,P102は、それぞれ時刻tn+1,t2nのときの人体を表している。

図18において、画角D101は、図17に示した画角D91と同じ大きさの画角である。物体P103,P104は、図15の物体P84,P85と同一である。人体P101,P102は、それぞれ時刻tn+1,t2nのときの人体を表している。

図19は、図18に例示した人体の移動履歴の情報を基に画角を計算した様子を示した図である。図19の人物P111,P112と物体P113,P114は、図18に示した人物P101,P102と物体P103,P104と同一である。

図19において、画角の中心P115のPT座標値は(θ5',Φ5')、水平画角値P116はω5'とする。中心P115のP座標値θ5'は人体の移動履歴と物体P113のP座標値とから、式(12)により算出することができる。

θ5'=(max(θn+1+θd(n+1),θn+2+θd(n+2),…,θ2n+θd2n,θo1+θdo1)+min(θn+1,θn+2,…,θ2n,θo1))/2 式(12)

画角の中心P115のT座標値Φ5'は、人体の移動履歴と物体P113のT座標値から、式(13)により算出することができる。

Φ5'=(min(Φn+1,Φn+2,…,Φ2n,Φo1)+max(Φn+1+Φd(n+1),Φn+2+Φd(n+2),…,Φ2n+Φd2n,Φo1+Φdo1))/2 式(13)

水平画角値ω5'は、人体の移動履歴と物体P113のP座標値の差分値として、式(14)により算出することができる。

ω5'=max(θn+1+θd(n+1),θn+2+θd(n+2),…,θ2n+θd2n,θo1+θdo1)-min(θn+1,θn+2,…,θ2n,θo1) 式(14)

画角計算部411は、前述のような計算を行うことで、人物が移動する可能性のある各位置と、物体P113とを収めることができる図19の画角D111を得る。

そして画角計算部411は、このようにして一定期間ごとに人体の移動履歴に合わせた画角を計算し、その計算した画角の情報と画像情報とを、画角操作部112へ出力する。

そして画角計算部411は、このようにして一定期間ごとに人体の移動履歴に合わせた画角を計算し、その計算した画角の情報と画像情報とを、画角操作部112へ出力する。

図20は、第4実施形態に係る自動撮影システム400における処理のうち、特に画角調整装置402における画角調整処理の流れを示したフローチャートである。自動撮影システム400は、ユーザ操作によって起動されると自動撮影のための処理を開始する。

まずS301において、画角調整装置402の画像入力部103は、画像取得装置101から画像情報を取得する。

次にS302において、検出判断部104は、画像入力部103から入力された画像情報を用いて画角に収める対象被写体の物体が検出されたかを判定する。検出判断部104は、S302の判定結果が真(S302でYES)の場合、S304へ処理を進め、一方、S302の判定結果が偽(S302でNO)の場合、画像情報を物体検出部106へ出力する。その後、画角調整装置402の処理はS303へ進む。

次にS302において、検出判断部104は、画像入力部103から入力された画像情報を用いて画角に収める対象被写体の物体が検出されたかを判定する。検出判断部104は、S302の判定結果が真(S302でYES)の場合、S304へ処理を進め、一方、S302の判定結果が偽(S302でNO)の場合、画像情報を物体検出部106へ出力する。その後、画角調整装置402の処理はS303へ進む。

S303に進むと、物体検出部106は、検出判断部104から入力された画像情報を用いて物体検出処理を行い、検出した物体の座標と画像情報を、座標変換部108へ出力する。そして、画角調整装置402の処理はS307へ進む。

S304に進んだ場合、検出判断部104は、画角保存部105から取得したプリセット画角を使用したかどうかの情報を用いて、他に検出対象となる物体が存在しないかを判定する。検出判断部104は、S304の判定結果が真(S304でYES)の場合、画像情報を人体検出部107へ出力し、その後、画角調整装置402の処理はS306へ進む。一方、検出判断部104は、S304の判定結果が偽(S304でNO)の場合、S305へ処理を進める。

S305に進むと、検出判断部104は画角保存部105からプリセット画角の情報を取得し、その後、画角調整装置402の処理はS311へ進む。S305からS311以降に進んだ場合の処理は、前述した図6のS5からS10以降に進んだ場合と同様である。

またS306に進んだ場合、人体検出部107は、検出判断部104から取得した画像情報を用いて人体を検出し、検出した人体の座標と画像情報とを座標変換部108へ出力する。その後、画角調整装置402の処理はS307へ進む。

S307に進むと、座標変換部108は、人体の座標と画像情報、または物体の座標と画像情報、およびカメラの現在のPTZ値を基に、画角内座標をPT座標値に変換する。そして、座標変換部108は、その変換したPT座標値を、座標保存部410へ出力する。その後、画角調整装置402の処理はS308へ進む。

S308において、座標保存部410は、座標変換部108から取得したPT座標値を保存する。そして、画角調整装置402の処理はS309へ進む。

S309において、操作判断部416は、タイマー処理によって一定期間経過したかどうかを判定する。操作判断部416は、S309の判断結果が真(S309でYES)の場合、座標保存部410から一定期間内の人体の移動履歴の情報と物体のPT座標値と画像情報とを取得し、画角計算部411へ出力する。そして、画角調整装置402の処理はS310へ進む。一方、操作判断部416は、S309の判断結果が偽(S309でNO)の場合、座標保存部410から画像情報を取得し、画像出力部113へ出力する。そして、画角調整装置402の処理はS312へ進む。

S310に進むと、画角計算部411は、座標保存部410から取得した物体のPT座標値と画像情報と一定期間内の人体の移動履歴情報とを基に、画角を計算する。すなわち画角計算部411は、一定期間内の人体の移動履歴を考慮して、人体と物体とが収まるような画角を計算する。さらに画角計算部411は、その計算した画角の情報を画角操作部112へ出力する。そして、画角調整装置402の処理はS311へ進む。

S311において、画角操作部112は、画角計算部411から取得した画角の情報を基に、一定期間内の人体の移動履歴を考慮した人体と物体とが収まる画角操作を行う。そして、画角調整装置402の処理はS312へ進む。

S312において、画像出力部113は、画角操作部112から入力された画像情報をモニタ装置114へ出力する。これにより、モニタ装置114には、画像情報に基づく映像が表示される。そして、画角調整装置402の処理はS313へ進む。

S313に進むと、画角調整装置402は、自動撮影システムOn/Offスイッチが操作されて自動撮影処理の停止操作が行われたかを判別し、S313の判定結果が偽(S313でNO)の場合にはS301へ戻る。一方、S313の判定結果が真(S313でYES)の場合、画角調整装置402は、図20のフローチャートの処理を終了する。

S313に進むと、画角調整装置402は、自動撮影システムOn/Offスイッチが操作されて自動撮影処理の停止操作が行われたかを判別し、S313の判定結果が偽(S313でNO)の場合にはS301へ戻る。一方、S313の判定結果が真(S313でYES)の場合、画角調整装置402は、図20のフローチャートの処理を終了する。

第4実施形態の画角調整装置402は、予め物体検出したときの画角内座標をPT座標値に変換して保存し、さらに人体のPT座標値については移動履歴情報としても保存する。そして画角調整装置402は、一定期間ごとの人体の移動履歴情報と、物体のPT座標値とに基づいて、移動する可能性のある人体と、物体とを収める画角に調整する。これにより、本実施形態によれば、直近の人体が移動した領域を画角に収め続けることが可能となる。

<第5実施形態>

以下、第5実施形態に係る撮影制御装置の構成例について、図21を参照して説明する。図21は本実施形態に係る撮影制御装置である画角調整装置502を含んだ自動撮影システム500の機能構成を示すブロック図である。第5実施形態の自動撮影システム500は、画像取得装置101、画角調整装置502、およびモニタ装置114を有している。画角調整装置502とモニタ装置114は、ビデオインターフェースを介して接続されている。なお、第5実施形態においても、講師が授業を行っているシーンを自動撮影する用途を例に挙げる。

以下、第5実施形態に係る撮影制御装置の構成例について、図21を参照して説明する。図21は本実施形態に係る撮影制御装置である画角調整装置502を含んだ自動撮影システム500の機能構成を示すブロック図である。第5実施形態の自動撮影システム500は、画像取得装置101、画角調整装置502、およびモニタ装置114を有している。画角調整装置502とモニタ装置114は、ビデオインターフェースを介して接続されている。なお、第5実施形態においても、講師が授業を行っているシーンを自動撮影する用途を例に挙げる。

第5実施形態の画角調整装置502は、撮影された画像から人体と物体を検出し、それらの画角内座標値をPT座標値で保存し、そのPT座標値とを用いて画角計算する際に、画像のアスペクト比を考慮した画角を求める。すなわち本実施形態の画角調整装置502は、画角内の人体と画角外であった物体とを収める画角を計算する際に、画像のアスペクト比を考慮して人体および物体がはみ出さないような画角を計算する。

第5実施形態の画角調整装置502は、画像取得装置101から画像情報が入力されると、画角に収める物体を検出したかを判定し、検出していなければプリセット機能を用いて画角を調整して撮影した画像から物体検出を行う。また、画角調整装置502は、そのときの画角内座標をカメラのPTZ値を用いてPT座標値に変換して保存する。その後、画角調整装置502は、画像内の人体を検出し、物体と同様に画角内座標をPT座標値に変換する。第5実施形態の画角調整装置502は、画角を計算する際に、人体および物体のP座標値から計算した水平画角値と、アスペクト比から算出した垂直画角値とを基に、人体または物体が画角からはみ出るかどうかを判定する。画角調整装置502は、画角からはみ出るようであれば、人体および物体のT座標値から垂直画角値を計算し、それとアスペクト比とから水平画角値を計算する。そして、画角調整装置502は、計算した画角に調整することによって、人体と物体を収める画角を計算して画角調整を行う。その後、画角調整装置502は、画角調整した後の画像情報をモニタ装置114へ出力する。

画角調整装置502の画像入力部103、検出判断部104、画角保存部105、物体検出部106、人体検出部107、座標変換部108、位置保存部109、座標保存部110、画角操作部112、および画像出力部113は、前述同様である。第5実施形態の画角調整装置502の場合、画角計算部511における処理と、アスペクト比保存部517を有していることが、第1実施形態とは異なる。以下、第1実施形態とは異なる処理および構成について説明する。

画角計算部511は、座標保存部110から入力された人体および物体のPT座標値と画像情報とアスペクト比保存部517から入力された画像アスペクト比とを用いて、人体および物体がはみ出ないような画角を計算する。

アスペクト比保存部517は、画像アスペクト比を保存しており、そのアスペクト比の情報を画角計算部511へ出力する。

アスペクト比保存部517は、画像アスペクト比を保存しており、そのアスペクト比の情報を画角計算部511へ出力する。

図22、図23は、第5実施形態の画角計算部511が、人体および物体のPT座標値と画像情報と画像アスペクト比とを基に画角を計算する様子を説明するための図である。

図22は、人体P121と物体P122と現在の画角D121とを示している。図22の例の場合、人体P121を示す矩形のPT座標値は、左上、右上、左下、右下の各頂点の順に(θ1,Φ1)、(θ2,Φ2)、(θ3,Φ3)、(θ4,Φ4)であるとする。また物体P122のPT座標は、左上、右上、左下、右下の各頂点の順に(θ9,Φ9),(θ10,Φ10),(θ11,Φ11),(θ12,Φ12)であるとする。また図22において、人体P121の端および物体P122の端が画角の端になるような画角D121における中心P123のPT座標値は(θ5',Φ5')であり、水平画角値P124はωh 5'とする。ここで、画角の中心P123のP座標値θ5'は、人体P121と物体P122のP座標値の平均値として、式(15)により算出することができる。

図22は、人体P121と物体P122と現在の画角D121とを示している。図22の例の場合、人体P121を示す矩形のPT座標値は、左上、右上、左下、右下の各頂点の順に(θ1,Φ1)、(θ2,Φ2)、(θ3,Φ3)、(θ4,Φ4)であるとする。また物体P122のPT座標は、左上、右上、左下、右下の各頂点の順に(θ9,Φ9),(θ10,Φ10),(θ11,Φ11),(θ12,Φ12)であるとする。また図22において、人体P121の端および物体P122の端が画角の端になるような画角D121における中心P123のPT座標値は(θ5',Φ5')であり、水平画角値P124はωh 5'とする。ここで、画角の中心P123のP座標値θ5'は、人体P121と物体P122のP座標値の平均値として、式(15)により算出することができる。

θ5'=(max(θ1,θ2,θ9,θ10)+min(θ1,θ2,θ9,θ10))/2 式(15)

また画角の中心P123のT座標値Φ5'は、人体P121のT座標値と物体P122のT座標値の平均値として、式(16)により算出することができる。

Φ5'=(max(Φ1,Φ2,Φ9,Φ10)+min(Φ1,Φ2,Φ9,Φ10))/2 式(16)

また水平画角値ωh

5'は、人体P121と物体P122のP座標値の差分値として、式(17)により算出することができる。

ωh

5'=max(θ1,θ2,θ9,θ10)-min(θ1,θ2,θ9,θ10) 式(17)

また垂直画角値P125の値をωv

5'とすると、当該垂直画角値ωv

5'は、水平画角値ωh

5'と画像アスペクト比とから式(18)により算出することができる。ここでは、画像アスペクト比を4:3(画角縦幅:画角横幅)とするが、この比率に限定するものではなく、16:9でもどんな比率でもよいものとする。

ωv

5'=2tan-1((3/4)tan((1/2)ωh

5')) 式(18)

前述した中心P123のPT座標値(θ5',Φ5')と水平画角値ωh

5'と垂直画角値ωv

5'とよって決めた画角が図22の画角D121となる。

ここで、第5実施形態において、画角計算部511は、画角の縦幅が垂直画角値のωv 5'であるときに、人体または物体が画角からはみ出ないかを、以下の式(19)によって判定する。

ここで、第5実施形態において、画角計算部511は、画角の縦幅が垂直画角値のωv 5'であるときに、人体または物体が画角からはみ出ないかを、以下の式(19)によって判定する。

(Φ5'-(1/2)ωv

5')>min(Φ1,Φ2,Φ9,Φ10)

又は、

(Φ5'+(1/2)ωv 5')<max(Φ1,Φ2,Φ9,Φ10) 式(19)

又は、

(Φ5'+(1/2)ωv 5')<max(Φ1,Φ2,Φ9,Φ10) 式(19)

そして、これを満たすときは人体または物体が画角外にはみ出ているので、画角計算部511は、垂直画角値を基準として画像アスペクト比から水平画角値を算出する。

図23は、画角計算部511が、垂直画角値を基準として画像アスペクト比から水平画角値を計算する様子を説明するための図である。

図23は、画角計算部511が、垂直画角値を基準として画像アスペクト比から水平画角値を計算する様子を説明するための図である。

図23において、人体P131は図22の人体P121と同一であり、物体P132は図22の物体P122と同一である。また、中心P133は図22の中心P123と同一である。すなわち、中心P133のPT座標値を(θ6',Φ6')とすると、式(20)に示すように図22の中心P123のPT座標値(θ5',Φ5')と同じ値である。

θ6'=θ5'

Φ6'=Φ5' 式(20)

Φ6'=Φ5' 式(20)

また垂直画角値P135の値をωv

6'とすると、当該垂直画角値ωv

6'は、人体P131と物体P132のT座標値の差分値として、式(21)により算出できる。

ωv

6'=max(Φ1,Φ2,Φ9,Φ10)-min(Φ1,Φ2,Φ9,Φ10) 式(21)

また水平画角値P134の値をωh

6'とすると、当該水平画角値ωh

6'は、垂直画角値ωv

6'と画像アスペクト比から、式(22)により算出できる。

ωh

6'=2tan-1((3/4)tan((1/2)ωv

6')) 式(22)

画角計算部511は、前述のようにして、図23に示すように人体と物体がはみ出さない画角を計算し、その画角の情報を、画角操作部112へ出力する。

図24は、第5実施形態に係る自動撮影システム500における処理のうち、特に画角調整装置502における画角調整処理の流れを示したフローチャートである。自動撮影システム500は、ユーザ操作によって起動されると自動撮影のための処理を開始する。

まずS401において、画角調整装置502の画像入力部103は、画像取得装置101から画像情報を取得する。

次にS402において、検出判断部104は、画像入力部103から入力された画像情報を用いて画角に収める対象被写体の物体が検出されたかを判定する。検出判断部104は、S402の判定結果が真(S402でYES)の場合、S404へ処理を進め、一方、S402の判定結果が偽(S402でNO)の場合、画像情報を物体検出部106へ出力する。その後、画角調整装置502の処理はS403へ進む。

次にS402において、検出判断部104は、画像入力部103から入力された画像情報を用いて画角に収める対象被写体の物体が検出されたかを判定する。検出判断部104は、S402の判定結果が真(S402でYES)の場合、S404へ処理を進め、一方、S402の判定結果が偽(S402でNO)の場合、画像情報を物体検出部106へ出力する。その後、画角調整装置502の処理はS403へ進む。

S403に進むと、物体検出部106は、検出判断部104から入力された画像情報を用いて物体検出処理を行い、検出した物体の座標と画像情報を、座標変換部108へ出力する。そして、画角調整装置502の処理はS407へ進む。

S404に進むと、検出判断部104は、画角保存部105から取得したプリセット画角を使用したかどうかの情報を用いて、他に検出対象となる物体が存在しないかを判定する。検出判断部104はS404の判定結果が真(S404でYES)の場合、画像情報を人体検出部107へ出力し、その後、画角調整装置502の処理はS406へ進む。一方、検出判断部104は、S404の判定結果が偽(S404でNO)の場合、S405へ処理を進める。

S405に進むと、検出判断部104は画角保存部105からプリセット画角の情報を取得し、その後、画角調整装置502の処理はS414へ進む。S405からS414に進んだ場合、画像出力部113は、画角操作部112から入力された画像情報をモニタ装置114へ出力する。

またS406に進んだ場合、人体検出部107は、検出判断部104から取得した画像情報を用いて人体を検出し、検出した人体の座標と画像情報とを座標変換部108へ出力する。そして、画角調整装置502の処理はS407へ進む。

S407において、座標変換部108は、人体の座標と画像情報、または物体の座標と画像情報、およびカメラの現在のPTZ値を基に、画角内座標をPT座標値に変換する。そして、座標変換部108は、その変換したPT座標値を、座標保存部410へ出力する。その後、画角調整装置502の処理はS408へ進む。

S408に進むと、座標保存部110は、座標変換部108から取得したPT座標値を保存する。そして、画角調整装置502の処理はS409へ進む。

S408に進むと、座標保存部110は、座標変換部108から取得したPT座標値を保存する。そして、画角調整装置502の処理はS409へ進む。

S409に進むと、アスペクト比保存部517は、カメラから画像のアスペクト比を取得して保存する。そして、画角調整装置502の処理はS410へ進む。

S410に進むと、画角計算部511は、座標保存部110から取得した人体および物体のPT座標値の最大値と最小値とから、P座標値とT座標値の差分値と中心点を算出し、その中心点を画角の中心とする。

S410に進むと、画角計算部511は、座標保存部110から取得した人体および物体のPT座標値の最大値と最小値とから、P座標値とT座標値の差分値と中心点を算出し、その中心点を画角の中心とする。

次にS411に進むと、画角計算部511は、P座標値の差分値を水平画角値とし、またアスペクト比保存部517から画像アスペクト比の情報を取得する。そして、画角計算部511は、水平画角値と画像アスペクト比とから垂直画角値を算出した場合に、人体または物体が画角外にはみ出るかどうかを判定する。画角計算部511は、S411の判定結果が真(S411でYES)の場合にはS413へ進み、一方、判定結果が偽(S411でNO)の場合にはS412へ進む。

S412に進むと、画角計算部511は、T座標値の差分値を垂直画角値とし、その垂直画角値と画像アスペクト比とから水平画角値を算出する。そして、画角調整装置502の処理はS413へ進む。

S413において、画角操作部112は、画角計算部511から取得した画角を用い、画像アスペクト比を考慮して人体と物体とが収まるように画角操作を行う。そして、画角調整装置502の処理はS414へ進む。

S414に進むと、画像出力部113は、画角操作部112から入力された画像情報をモニタ装置114へ出力する。これにより、モニタ装置114には、画像情報に基づく映像が表示される。そして、画角調整装置502の処理はS415へ進む。

S415に進むと、画角調整装置502は、自動撮影システムOn/Offスイッチが操作されて自動撮影処理の停止操作が行われたかどうかを判別し、S415の判定結果が偽(S415でNO)の場合、S401へ戻る。一方、S415の判定結果が真(S415でYES)の場合、画角調整装置502は、図24のフローチャートの処理を終了する。

S415に進むと、画角調整装置502は、自動撮影システムOn/Offスイッチが操作されて自動撮影処理の停止操作が行われたかどうかを判別し、S415の判定結果が偽(S415でNO)の場合、S401へ戻る。一方、S415の判定結果が真(S415でYES)の場合、画角調整装置502は、図24のフローチャートの処理を終了する。

第5実施形態の画角調整装置502は、PT座標値から画角を算出する際に、水平画角値を人体および物体のP座標値から算出し、垂直画角値を水平画角値と画像アスペクト比から算出し、人体および物体が画角からはみ出るかどうかを判定する。そして画角調整装置502は、人体および物体が画角はみ出る場合には、垂直画角値を人体および物体のT座標値から算出し、水平画角値を垂直画角値と画像アスペクト比から算出した画角に調整する。これにより、本実施形態によれば、人体および物体を画角に収め続けることが可能となる。

以上、本発明の好ましい実施形態について説明したが、本発明はこれらの各実施形態に限定されず、その要旨の範囲内で種々の変形及び変更が可能である。

例えば、第1実施形態において、画角計算部111は、画角計算の際に人体と物体のT座標値から垂直画角値を算出し、垂直画角値と画像アスペクト比から水平画角値を算出してもよい。また、画像取得装置と画角調整装置は、両方を一つの装置内に含んだ構成や、別々の装置に含んだ構成のどちらをとってもよいものとする。さらに、画角調整装置は、アプリケーションソフトウェアで実現されてもよい。

例えば、第1実施形態において、画角計算部111は、画角計算の際に人体と物体のT座標値から垂直画角値を算出し、垂直画角値と画像アスペクト比から水平画角値を算出してもよい。また、画像取得装置と画角調整装置は、両方を一つの装置内に含んだ構成や、別々の装置に含んだ構成のどちらをとってもよいものとする。さらに、画角調整装置は、アプリケーションソフトウェアで実現されてもよい。

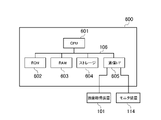

図25は、前述第1から第5実施形態で説明した画角調整装置がアプリケーションソフトウェアで実現される場合の情報処理装置600のハードウェア構成の一例を示した図である。なお、図25には、情報処理装置600(画像調整装置)に接続された画像取得装置101とモニタ装置114も示されている。

情報処理装置600は、CPU601、ROM602、RAM603、ストレージ604、および通信I/F605を備える。これらの各構成は、内部バス606に接続されており、相互に通信可能となされている。また通信I/F605には、外部装置として画像取得装置101とモニタ装置114が接続されているとする。

CPU601は、情報処理装置600における動作を統括的に制御する中央演算装置である。ROM602は、CPU601が処理を実行するために必要なプログラムや各種初期設定データなどを記憶する不揮発性メモリである。RAM603は、CPU601の主メモリ、ワークエリア等として機能する揮発性メモリであり、プログラムや画像データなどが一時的に格納される。CPU601は、処理の実行に際してROM602から必要なプログラム等をRAM603にロードし、当該プログラム等を実行することで各種の機能動作を実現する。

ストレージ604は、RAM603と比較して大容量な記録デバイスであり、例えばHDD(ハードディスクドライブ)やSSD(ソリッドステートドライブ)である。ストレージ604は、CPU601により実行されるOS(基本ソフトウェア)や、前述の各実施形態で説明した画角調整装置の処理に係る情報処理プログラム(アプリケーションプログラム)、その他各種のデータ等が格納されている。また、ストレージ604は、ネットワークを介して取得された画像データ等も記録可能である。

CPU601は、電源ON等の起動時、ROM602に格納されている起動用プログラムを実行する。この起動用プログラムは、ストレージ604に格納されているOSを読み出し、RAM603に展開するためのものである。CPU601は、OSの起動後、ユーザから実行開始指示が入力されると、ストレージ604から前述した各実施形態の何れかに係る情報処理プログラムを読みだしてRAM603に展開する。これにより、CPU601は、前述した各本実施形態に係る情報処理、つまり画角調整処理を実行可能な状態となる。また、CPU601は、各実施形態に係る情報処理プログラムの動作に用いられる各種データについてもRAM603上に格納して読み書きを行う。

通信I/F605は、例えばLAN(ローカルエリアネットワーク)のインターフェースであり、ネットワークを介して、ネットワークカメラや他のコンピュータ等との通信を行う。なお、本実施形態に係る処理にて扱う画像、当該処理を実行するための情報処理プログラム、および当該処理にて用いる各種データは、ネットワークを介して取得されてもよい。

また、情報処理装置600は、パーソナルコンピュータ(PC)やタブレットPCなどのように、1つの装置により構成することができる。ただし、実施形態の構成は、それぞれ別個もしくは幾つかが組み合わされたハードウェアによって構成されていてもよい。つまり、情報処理装置600は、複数の装置により構成されていてもよい。

また、情報処理装置600は、パーソナルコンピュータ(PC)やタブレットPCなどのように、1つの装置により構成することができる。ただし、実施形態の構成は、それぞれ別個もしくは幾つかが組み合わされたハードウェアによって構成されていてもよい。つまり、情報処理装置600は、複数の装置により構成されていてもよい。

本発明は、上述の実施形態の1以上の機能を実現するプログラムを、ネットワーク又は記憶媒体を介してシステム又は装置に供給し、そのシステム又は装置のコンピュータにおける一つ以上のプロセッサがプログラムを読出し実行する処理でも実現可能である。また、1以上の機能を実現する回路(例えば、ASIC)によっても実現可能である。

上述の実施形態は、何れも本発明を実施するにあたっての具体化の例を示したものに過ぎず、これらによって本発明の技術的範囲が限定的に解釈されてはならないものである。すなわち、本発明は、その技術思想、又はその主要な特徴から逸脱することなく、様々な形で実施することができる。

上述の実施形態は、何れも本発明を実施するにあたっての具体化の例を示したものに過ぎず、これらによって本発明の技術的範囲が限定的に解釈されてはならないものである。すなわち、本発明は、その技術思想、又はその主要な特徴から逸脱することなく、様々な形で実施することができる。

100:自動撮影システム、101:画像取得装置、102:画角調整装置、103:画像入力部、104:検出判断部、105:画角保存部、106:物体検出部、107:人体検出部、108:座標変換部、109:位置保存部、110:座標保存部、111:画角計算部、112:画角操作部、113:画像出力部、114:モニタ装置

Claims (20)

- 撮影装置が撮影した画像から、画角に収める対象被写体を検出しているか判断し、前記画角に収める対象被写体を検出している場合、前記撮影装置の画角を、前記対象被写体を収める画角に設定する検出判断手段と、

前記検出判断手段にて前記画角が設定された前記撮影装置が撮影した画像から第1の対象被写体を検出する第1の検出手段と、

前記検出判断手段にて前記画角が設定された前記撮影装置が撮影した画像から第2の対象被写体を検出する第2の検出手段と、

前記第1の対象被写体および前記第2の対象被写体を、前記撮影装置が撮影したときのパン値とチルト値とズーム値とを基に、当該第1の対象被写体および前記第2の対象被写体の画角内座標をパン座標値とチルト座標値とに変換する座標変換手段と、

前記パン座標値およびチルト座標値を保存する座標保存手段と、

前記保存されたパン座標値およびチルト座標値を基に、前記第1の対象被写体と前記第2の対象被写体とを収める画角を取得する画角取得手段と、

前記画角取得手段が前記取得した画角を基に、前記撮影装置の画角を調整する画角操作手段と、

を有することを特徴とする撮影制御装置。 - 前記検出判断手段は、前記撮影装置の現在の画角で検出している前記対象被写体の他に対象被写体が存在する場合、前記他の対象被写体を収めるプリセット画角を設定し、

前記画角操作手段は、前記撮影装置の画角を前記プリセット画角に調整することを特徴とする請求項1に記載の撮影制御装置。 - 前記検出判断手段が前記撮影装置の現在の画角で検出している前記対象被写体の他に対象被写体が存在しないと判断した場合、前記第1の検出手段は、前記撮影装置が撮影した画像から前記第1の対象被写体を検出する処理を行うことを特徴とする請求項1または請求項2に記載の撮影制御装置。

- 前記検出判断手段が前記撮影装置の現在の画角で前記対象被写体を検出していないと判断した場合、前記第2の検出手段は、前記撮影装置が撮影した画像から前記第2の対象被写体を検出する処理を行うことを特徴とする請求項2または請求項3に記載の撮影制御装置。

- 前記画角取得手段は、前記第1の対象被写体と前記第2の対象被写体を収める画角の中心となるパン座標値およびチルト座標値と、ズーム倍率とを算出して、前記第1の対象被写体と前記第2の対象被写体とを収める画角を取得することを特徴とする請求項1から請求項4のいずれか1項に記載の撮影制御装置。

- 前記撮影装置が撮影した画像から注目領域を抽出する領域抽出手段を有し、

前記画角取得手段は、前記第1の対象被写体と前記注目領域とを収める画角を取得することを特徴とする請求項1から請求項5のいずれか1項に記載の撮影制御装置。 - 前記領域抽出手段は、前記第2の注目領域から前記注目領域を抽出することを特徴とする請求項6に記載の撮影制御装置。

- 前記画角取得手段は、前記第1の対象被写体が画角端にならず、かつ前記注目領域が画角端になる前記画角を取得することを特徴とする請求項6または請求項7に記載の撮影制御装置。

- 前記画角取得手段は、前記第1の対象被写体と前記第2の対象被写体とを収めるように取得した画角を、前記注目領域が画像端になるようにスライドさせて、前記第1の対象被写体が画角端にならずかつ前記注目領域が画角端になる前記画角を取得することを特徴とする請求項8に記載の撮影制御装置。

- 前記領域抽出手段は、前記撮影装置が撮影した画像内の輝度情報を基に前記注目領域を抽出することを特徴とする請求項6から請求項9のいずれか1項に記載の撮影制御装置。

- 前記画角取得手段は、前記第1の対象被写体から画角端までが、当該第1の対象被写体の幅分の余裕を有する前記画角を取得することを特徴とする請求項1から請求項5のいずれか1項に記載の撮影制御装置。

- 前記画角取得手段は、一定期間内における前記第1の対象被写体の移動履歴を基に、前記第1の対象被写体および前記第2の対象被写体を収める前記画角を取得することを特徴とする請求項1から請求項5のいずれか1項に記載の撮影制御装置。

- 前記第1の対象被写体の移動履歴は、一定期間内で一定時間ごとに得られた前記第1の対象被写体のパン座標値およびチルト座標値からなり、

前記画角取得手段は、前記第1の対象被写体の移動履歴と、前記第2の対象被写体のパン座標値およびチルト座標値とに基づいて、前記第1の対象被写体と前記第2の対象被写体を収める前記画角を取得することを特徴とする請求項12に記載の撮影制御装置。 - 前記一定期間が経過したかどうかによって画角の調整を行うかを判断する操作判断手段を有し、

前記画角取得手段は、前記操作判断手段にて前記一定期間が経過したと判断された場合に、前記一定期間内の前記第1の対象被写体の移動履歴を用いて前記画角を取得する処理を行うことを特徴とする請求項12または請求項13に記載の撮影制御装置。 - 前記画角取得手段は、アスペクト比をも用いて、前記第1の対象被写体と前記第2の対象被写体を収める前記画角を取得することを特徴とする請求項1から請求項5のいずれか1項に記載の撮影制御装置。

- 前記画角取得手段は、前記アスペクト比を基に、前記第1の対象被写体および前記第2の対象被写体が現在の画角からはみ出すかどうかを判定し、前記はみ出すと判定した場合に前記はみ出さない画角を取得することを特徴とする請求項15に記載の撮影制御装置。

- 前記画角取得手段は、前記第1の対象被写体および前記第2の対象被写体のパン座標値の差分値を水平画角値として算出したズーム倍率を基に、前記第1の対象被写体および前記第2の対象被写体が前記画角からはみ出すかどうかを判定することを特徴とする請求項16に記載の撮影制御装置。

- 前記画角取得手段は、前記はみ出すと判定した場合には前記第1の対象被写体および前記第2の対象被写体のチルト座標値の差分値を垂直画角値として算出したズーム倍率に応じた前記画角を取得すことを特徴とする請求項17に記載の撮影制御装置。

- 撮影装置を制御する撮影制御装置が実行する撮影制御方法であって、

撮影装置が撮影した画像から、画角に収める対象被写体を検出しているか判断し、前記画角に収める対象被写体を検出している場合、前記撮影装置の画角を、前記対象被写体を収める画角に設定する検出判断工程と、

前記検出判断工程にて前記画角が設定された前記撮影装置が撮影した画像から第1の対象被写体を検出する第1の検出工程と、

前記検出判断工程にて前記画角が設定された前記撮影装置が撮影した画像から第2の対象被写体を検出する第2の検出工程と、

前記第1の対象被写体および前記第2の対象被写体を、前記撮影装置が撮影したときのパン値とチルト値とズーム値とを基に、当該第1の対象被写体および前記第2の対象被写体の画角内座標をパン座標値とチルト座標値とに変換する座標変換工程と、

前記パン座標値およびチルト座標値を保存する座標保存工程と、

前記保存されたパン座標値およびチルト座標値を基に、前記第1の対象被写体と前記第2の対象被写体とを収める画角を取得する画角取得工程と、

前記画角取得工程にて前記取得した画角を基に、前記撮影装置の画角を調整する画角操作工程と、

を有することを特徴とする撮影制御方法。 - コンピュータを、請求項1から請求項18のいずれか1項に記載の撮影制御装置の各手段として機能させるためのプログラム。

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2020157729A JP2022051312A (ja) | 2020-09-18 | 2020-09-18 | 撮影制御装置、撮影制御方法、及びプログラム |

| US17/474,754 US11445119B2 (en) | 2020-09-18 | 2021-09-14 | Image capturing control apparatus, image capturing control method, and storage medium |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2020157729A JP2022051312A (ja) | 2020-09-18 | 2020-09-18 | 撮影制御装置、撮影制御方法、及びプログラム |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2022051312A true JP2022051312A (ja) | 2022-03-31 |

| JP2022051312A5 JP2022051312A5 (ja) | 2023-09-06 |

Family

ID=80741857

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2020157729A Pending JP2022051312A (ja) | 2020-09-18 | 2020-09-18 | 撮影制御装置、撮影制御方法、及びプログラム |

Country Status (2)

| Country | Link |

|---|---|

| US (1) | US11445119B2 (ja) |

| JP (1) | JP2022051312A (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN115272483A (zh) * | 2022-07-22 | 2022-11-01 | 北京城市网邻信息技术有限公司 | 一种图像生成方法、装置、电子设备及存储介质 |

Family Cites Families (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US6281930B1 (en) * | 1995-10-20 | 2001-08-28 | Parkervision, Inc. | System and method for controlling the field of view of a camera |

| JP2007158680A (ja) | 2005-12-05 | 2007-06-21 | Victor Co Of Japan Ltd | 追尾撮像装置およびこれを利用した追尾撮像システム |

| JP6071436B2 (ja) * | 2012-11-05 | 2017-02-01 | オリンパス株式会社 | 撮像装置、撮像方法およびプログラム |

| WO2020019356A1 (zh) * | 2018-07-27 | 2020-01-30 | 华为技术有限公司 | 一种终端切换摄像头的方法及终端 |

| US10931863B2 (en) * | 2018-09-13 | 2021-02-23 | Genetec Inc. | Camera control system and method of controlling a set of cameras |

| CN109712193B (zh) * | 2018-12-04 | 2021-06-15 | 浙江大华技术股份有限公司 | 一种球机视场角的确定方法及装置 |

| JP2022051972A (ja) * | 2019-02-06 | 2022-04-04 | ソニーグループ株式会社 | 情報処理装置および方法、並びにプログラム |

-

2020

- 2020-09-18 JP JP2020157729A patent/JP2022051312A/ja active Pending

-

2021

- 2021-09-14 US US17/474,754 patent/US11445119B2/en active Active

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN115272483A (zh) * | 2022-07-22 | 2022-11-01 | 北京城市网邻信息技术有限公司 | 一种图像生成方法、装置、电子设备及存储介质 |

| CN115272483B (zh) * | 2022-07-22 | 2023-07-07 | 北京城市网邻信息技术有限公司 | 一种图像生成方法、装置、电子设备及存储介质 |

Also Published As

| Publication number | Publication date |

|---|---|

| US20220094855A1 (en) | 2022-03-24 |

| US11445119B2 (en) | 2022-09-13 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US8810673B2 (en) | Composition determination device, composition determination method, and program | |

| JP6106921B2 (ja) | 撮像装置、撮像方法および撮像プログラム | |

| JP4640456B2 (ja) | 画像記録装置、画像記録方法、画像処理装置、画像処理方法、プログラム | |

| CN103916587B (zh) | 用于生成合成图像的拍摄装置以及使用所述装置的方法 | |

| US11210796B2 (en) | Imaging method and imaging control apparatus | |

| WO2017014415A1 (en) | Image capturing apparatus and method of operating the same | |

| JP6481866B2 (ja) | 情報処理装置、撮像装置、情報処理方法、及び、プログラム | |

| JP6942940B2 (ja) | 画像処理装置、画像処理方法及びプログラム | |

| JP2009100301A (ja) | 構図判定装置、構図判定方法、プログラム | |

| CN106713740B (zh) | 定位跟踪摄像方法与系统 | |

| JP2013013063A (ja) | 撮像装置及び撮像システム | |

| JP2005051472A (ja) | 自動撮影制御装置、自動撮影用プログラム、カメラ | |

| US9628700B2 (en) | Imaging apparatus, imaging assist method, and non-transitory recoding medium storing an imaging assist program | |

| JP2013013062A (ja) | 撮像装置及び撮像システム | |

| JP2007251429A (ja) | 動画撮影装置及びズーム調整方法 | |

| KR102228663B1 (ko) | 촬영 가이드 제공 방법 및 이를 수행하는 시스템 | |

| JP2022051312A (ja) | 撮影制御装置、撮影制御方法、及びプログラム | |

| KR20160088719A (ko) | 이미지를 촬영하는 전자 장치 및 방법 | |

| US8665317B2 (en) | Imaging apparatus, imaging method and recording medium | |

| JP2011188258A (ja) | カメラシステム | |

| JP2013143592A (ja) | 情報処理装置、情報処理装置の情報処理方法およびプログラム | |

| US20150022559A1 (en) | Method and apparatus for displaying images in portable terminal | |

| JPH07160412A (ja) | 指示位置検出方法 | |

| JP5098917B2 (ja) | 構図判定装置、構図判定方法、プログラム | |

| CN114600162A (zh) | 用于捕捉摄像机图像的场景锁定模式 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20230829 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20230829 |