JP2020121375A - 制御装置、制御対象装置、制御方法及びプログラム - Google Patents

制御装置、制御対象装置、制御方法及びプログラム Download PDFInfo

- Publication number

- JP2020121375A JP2020121375A JP2019014743A JP2019014743A JP2020121375A JP 2020121375 A JP2020121375 A JP 2020121375A JP 2019014743 A JP2019014743 A JP 2019014743A JP 2019014743 A JP2019014743 A JP 2019014743A JP 2020121375 A JP2020121375 A JP 2020121375A

- Authority

- JP

- Japan

- Prior art keywords

- voice

- quiet

- unit

- control

- sound

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

- 238000000034 method Methods 0.000 title claims description 49

- 230000008569 process Effects 0.000 claims description 35

- 230000007613 environmental effect Effects 0.000 claims description 18

- 238000012937 correction Methods 0.000 claims description 2

- 238000005516 engineering process Methods 0.000 abstract description 3

- 230000004044 response Effects 0.000 abstract description 2

- 238000012545 processing Methods 0.000 description 26

- 230000015654 memory Effects 0.000 description 15

- 238000010586 diagram Methods 0.000 description 13

- 238000004891 communication Methods 0.000 description 9

- 230000033001 locomotion Effects 0.000 description 9

- 239000012636 effector Substances 0.000 description 6

- 230000006870 function Effects 0.000 description 6

- 101100274346 Drosophila melanogaster mora gene Proteins 0.000 description 3

- 230000009471 action Effects 0.000 description 3

- 239000000470 constituent Substances 0.000 description 3

- 238000001514 detection method Methods 0.000 description 3

- 230000010365 information processing Effects 0.000 description 3

- 241001417093 Moridae Species 0.000 description 2

- 230000003213 activating effect Effects 0.000 description 2

- 238000003491 array Methods 0.000 description 2

- 230000007423 decrease Effects 0.000 description 2

- 238000003384 imaging method Methods 0.000 description 2

- 230000004048 modification Effects 0.000 description 2

- 238000012986 modification Methods 0.000 description 2

- 210000001260 vocal cord Anatomy 0.000 description 2

- 241001391944 Commicarpus scandens Species 0.000 description 1

- 230000008859 change Effects 0.000 description 1

- 239000003086 colorant Substances 0.000 description 1

- 230000003247 decreasing effect Effects 0.000 description 1

- 230000000694 effects Effects 0.000 description 1

- 238000005401 electroluminescence Methods 0.000 description 1

- 239000000284 extract Substances 0.000 description 1

- 238000000605 extraction Methods 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- 230000004807 localization Effects 0.000 description 1

- 230000007774 longterm Effects 0.000 description 1

- 238000005259 measurement Methods 0.000 description 1

- 230000003287 optical effect Effects 0.000 description 1

- 238000000926 separation method Methods 0.000 description 1

- 239000007787 solid Substances 0.000 description 1

Images

Classifications

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J9/00—Programme-controlled manipulators

- B25J9/16—Programme controls

- B25J9/1694—Programme controls characterised by use of sensors other than normal servo-feedback from position, speed or acceleration sensors, perception control, multi-sensor controlled systems, sensor fusion

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J13/00—Controls for manipulators

- B25J13/003—Controls for manipulators by means of an audio-responsive input

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B25—HAND TOOLS; PORTABLE POWER-DRIVEN TOOLS; MANIPULATORS

- B25J—MANIPULATORS; CHAMBERS PROVIDED WITH MANIPULATION DEVICES

- B25J13/00—Controls for manipulators

- B25J13/08—Controls for manipulators by means of sensing devices, e.g. viewing or touching devices

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05B—CONTROL OR REGULATING SYSTEMS IN GENERAL; FUNCTIONAL ELEMENTS OF SUCH SYSTEMS; MONITORING OR TESTING ARRANGEMENTS FOR SUCH SYSTEMS OR ELEMENTS

- G05B19/00—Programme-control systems

- G05B19/02—Programme-control systems electric

- G05B19/04—Programme control other than numerical control, i.e. in sequence controllers or logic controllers

- G05B19/042—Programme control other than numerical control, i.e. in sequence controllers or logic controllers using digital processors

- G05B19/0426—Programming the control sequence

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/16—Sound input; Sound output

- G06F3/167—Audio in a user interface, e.g. using voice commands for navigating, audio feedback

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L25/00—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00

- G10L25/78—Detection of presence or absence of voice signals

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05B—CONTROL OR REGULATING SYSTEMS IN GENERAL; FUNCTIONAL ELEMENTS OF SUCH SYSTEMS; MONITORING OR TESTING ARRANGEMENTS FOR SUCH SYSTEMS OR ELEMENTS

- G05B2219/00—Program-control systems

- G05B2219/20—Pc systems

- G05B2219/23—Pc programming

- G05B2219/23181—Use of sound, acoustic, voice

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05B—CONTROL OR REGULATING SYSTEMS IN GENERAL; FUNCTIONAL ELEMENTS OF SUCH SYSTEMS; MONITORING OR TESTING ARRANGEMENTS FOR SUCH SYSTEMS OR ELEMENTS

- G05B2219/00—Program-control systems

- G05B2219/20—Pc systems

- G05B2219/23—Pc programming

- G05B2219/23386—Voice, vocal command or message

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L25/00—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00

- G10L25/78—Detection of presence or absence of voice signals

- G10L2025/783—Detection of presence or absence of voice signals based on threshold decision

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L25/00—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00

- G10L25/03—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 characterised by the type of extracted parameters

- G10L25/21—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 characterised by the type of extracted parameters the extracted parameters being power information

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L25/00—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00

- G10L25/48—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 specially adapted for particular use

- G10L25/51—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 specially adapted for particular use for comparison or discrimination

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Human Computer Interaction (AREA)

- Physics & Mathematics (AREA)

- Audiology, Speech & Language Pathology (AREA)

- Health & Medical Sciences (AREA)

- Robotics (AREA)

- Mechanical Engineering (AREA)

- Computational Linguistics (AREA)

- Acoustics & Sound (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Signal Processing (AREA)

- Automation & Control Theory (AREA)

- General Health & Medical Sciences (AREA)

- General Engineering & Computer Science (AREA)

- Manipulator (AREA)

Abstract

Description

[本開示の概略]

本開示を概略すると、制御装置は、ユーザによって発声された音声から抽出されたパラ言語情報に基づいて、制御対象装置(例えば、ロボット装置など)の可動部(例えば、関節部、エンドエフェクタなど)の作動速度を調整する。典型的には、制御装置は、制御対象装置内に内蔵されるか、あるいは、制御対象装置の外部にあって、制御対象装置に通信接続される。本発明の実施の形態において、パラ言語情報とは、声の大きさや高さ、話す速度、発声(phonation)の型などを指す。発声の型には、例えば、ささやき声(Whisper voice)や息もれ声(Breathy voice)が含まれる。また、声の大きさが小さい声、又は、ささやき声である声を、静穏声と呼ぶこととする。ここで、小さい声とは、制御対象装置の集音手段(例えば、マイクロフォンなど)とユーザとの間の距離に応じた減衰を除いたパワーが所定の閾値以下の発声として定義され、ささやき声とは、声帯を振動させない発声として定義されうる。同様に、声の大きさが大きい声、又は、怒鳴り声である声を、騒然声と呼ぶこととする。

[ロボット装置]

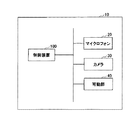

まず、図1及び2を参照して、本開示の一実施例によるロボット装置を説明する。図1は、本開示の一実施例によるロボット装置を示す概略図である。

[第1実施例]

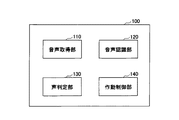

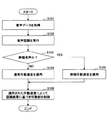

次に、図3〜7を参照して、本開示の第1実施例による制御装置を説明する。以下の実施例では、ロボット装置10による物体の移動処理に着目して説明する。ただし、本開示による制御装置100によって制御されるロボット装置10の処理はこれに限定されるものでない。また、本開示による制御装置100の制御処理は、ロボット装置10の用途に応じた他の処理に適用可能であることは当業者に理解されるであろう。

[第2実施例]

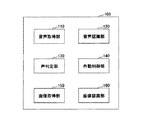

次に、図8〜10を参照して、本開示の第2実施例による制御装置を説明する。上述した第1実施例では、静穏声であると判定された場合にロボット装置10に適用される静穏作動モードでは、可動部40の各可動要素の作動速度が静穏作動速度に一律に設定された。他方、各可動要素は一般に異なる作動音を生じさせることが知られており、例えば、ロボット装置10を移動させる可動要素、過重負荷の大きな可動要素などは相対的に大きな作動音を生じさせる傾向がある。このため、第2実施例では、制御装置100は、相対的に作動音の小さな可動要素を優先的に作動させる。すなわち、制御装置100は、相対的に作動音の大きな可動要素を作動させることなく、タスクを実行するよう作動計画を決定する。

[第3実施例]

次に、図11を参照して、本開示の第3実施例による制御装置を説明する。第3実施例では、作動制御部140は、音声取得部110で取得した環境音の音圧レベルに応じて、ロボット装置10を制御する。具体的には、制御装置100は、作動計画実行中もマイクロフォン20によって収集されたロボット装置10から生じる作動音を取得し、静穏声により音声指示が発せられると、作動音の音圧レベルが所定値以下になるよう可動部40を制御する。すなわち、作動制御部140は、可動部40の作動中にロボット装置10において収集された音声を取得し、静穏声により音声指示が発せられると、取得した音声の音圧レベルが可動部40の非作動時の音圧レベルに対して所定の増加量以下となるよう可動部40の作動を制御する。ここで、ロボット装置10は、図8に示される構成と同じであってもよい。

[第4実施例]

次に、本開示の第4実施例による制御装置を説明する。第4実施例では、作動制御部140は、ロボット装置10と音声の発話者との間の距離に応じてロボット装置10を制御する。具体的には、声判定部130は、集音装置とユーザとの間の距離に応じて音声を補正し、補正した音声が静穏声であるか否かを判定する。音声が小さい声であるか否かの判定は、マイクロフォン20から取得された音声の音圧レベルが所定値未満であるか否かによって行われる。一方、遠方で発せられた音声は、マイクロフォン20に到達するまでに音圧レベルが低減する。このため、単に、マイクロフォン20において測定された音圧レベルに基づき音声が小さい声であるか否かを判定する方法では、ユーザによって実際に発せられた音声が小さい声であるか否かを判定することは難しい。このため、声判定部130は、ユーザとマイクロフォン20との間の距離に応じて判定対象となる音声の音圧レベルを補正してもよい。

[第5実施例]

次に、本開示の第5実施例による制御装置を説明する。第5実施例では、ロボット装置10は更に、ロボット装置10の周囲を照らすライト、ユーザに情報を提示するためのディスプレイなどの発光装置を有し、作動制御部140は、声判定部130の判定結果が静穏声である場合のロボット装置10の発光装置の光量が、声判定部130の判定結果が静穏声でない場合のロボット装置10の発光装置の光量より小さくなるように、ロボット装置10を制御する。具体的には、ユーザが静穏声により音声指示をした場合、作動制御部140は、ロボット装置10を静穏作動モードにより作動させ、ライトを通常作動モードより低い光量によって発光させるか、あるいは、ライトをオフにしてもよい。あるいは、ユーザが小さい声又はささやき声により音声指示をした場合、作動制御部140は、ロボット装置10を静穏作動モードにより作動させ、ディスプレイの輝度を通常作動モードより低くするか、あるいは、ディスプレイをオフにしてもよい。なお、発光装置の光量又は輝度の調整は、可動部40の作動速度の調整と組み合わせて行われてもよいし、あるいは、独立して行われてもよい。また、作動制御部140は、通常作動モードと静穏作動モードとにおいて発光装置を異なる色により発光させてもよい。

[第6実施例]

次に、本開示の第6実施例による制御装置を説明する。第6実施例では、音声取得部110は、集音装置で収集された音声を取得し、声判定部130は、音声が静穏声であるか否かを判定する。ロボット装置10は、車輪、足などの移動手段によって移動可能であり、作動制御部140は、音声が静穏声である場合、移動中のロボット装置10とユーザとの間の距離に応じて可動部40の作動速度を切り替える。具体的には、ロボット装置10が移動可能であるとき、作動制御部140は、ロボット装置10の近くにいるユーザから発せられた音声が静穏声である場合、まず可動部40を静穏作動速度により作動させ、その後に移動によってロボット装置10がユーザから離れると、可動部40を通常作動速度により作動させる。例えば、作動制御部140は、ユーザからの音声指示が静穏声であった場合、上述した第1実施例と同様に、可動部40の作動速度の最大値vmaxを静穏作動速度vwhisperにまず引き下げる。その後、ロボット装置10とユーザ又は音声指示を受信した位置との間の距離dが所定の閾値dcより大きくなると、作動制御部140は、作動速度の最大値vmaxを通常作動速度vnormal(>vwhisper)に引き上げる。すなわち、作動制御部140は、以下の式に従って作動速度の最大値vmaxを制御する。

[第7実施例]

次に、本開示の第7実施例による制御装置を説明する。第7実施例では、作動制御部140は、声判定部130の判定結果、及び、現在時刻に応じて、ロボット装置10を制御する。具体的には、作動制御部140は、ユーザからの音声指示が静穏声であって、かつ、現在時刻が所定の時間帯にある場合、可動部40の作動速度を静穏作動速度に設定する。例えば、ユーザは深夜、早朝などのロボット装置10を静穏に作動させたい時間帯を制御装置100に予め設定する。ユーザが静穏声により音声指示をした場合、作動制御部140は、当該音声指示が設定された時間帯に発せられたものであるか否かを判定し、当該音声指示が設定された時間帯に発せられたものである場合、可動部40の作動速度を静穏作動速度に設定する。他方、当該音声時が設定された時間帯以外に発せられたものである場合、作動制御部140は、可動部40の作動速度を通常作動速度に設定する。

[第8実施例]

次に、本開示の第8実施例による制御装置を説明する。第8実施例では、声判定部130は、音声が低発話速度の発声であるか否かを判定し、作動制御部140は、音声が低発話速度の発声であるか否かの判定結果に応じて、ロボット装置10を制御する。すなわち、音声指示が静穏声であるか否かの判定の代わりに又は加えて、声判定部130は、音声が低発話速度の発声であるか否かを判定し、作動制御部140は、音声が低発話速度の発声であるか否かに応じた作動速度と認識結果に従って、可動部40を作動させる。

[ロボット装置の変形例]

次に、図12を参照して、本開示の他の実施例によるロボット装置を説明する。図12は、本開示の他の実施例によるロボット装置を示す概略図である。

[制御装置のハードウェア構成]

実施形態における制御装置100において、各機能は、アナログ回路、デジタル回路又はアナログ・デジタル混合回路で構成された回路であってもよい。また、各機能の制御を行う制御回路を備えていてもよい。各回路の実装は、ASIC(Application Specific Integrated Circuit)、FPGA(Field Programmable Gate Array)等によるものであってもよい。

20 マイクロフォン

30 カメラ

40 可動部

100 制御装置

101 プロセッサ

102 主記憶装置

103 補助記憶装置

104 ネットワークインタフェース

105 デバイスインタフェース

110 音声取得部

120 音声認識部

130 声判定部

140 作動制御部

150 画像取得部

160 画像認識部

200 通信ネットワーク

300 外部装置

Claims (15)

- 音声を取得する音声取得部と、

前記音声を認識する音声認識部と、

前記音声が静穏声であるか否かを判定する声判定部と、

前記音声の認識結果に応じて、制御対象装置の可動部を制御する作動制御部と、を備え、

前記作動制御部は、前記声判定部の判定結果が静穏声である場合の前記制御対象装置の可動部が発する音の音圧レベルが、前記声判定部の判定結果が静穏声でない場合の前記制御対象装置の可動部が発する音の音圧レベルより小さくなるように、前記制御対象装置を制御する、

制御装置。 - 前記作動制御部は、前記声判定部の判定結果が静穏声である場合の前記制御対象装置の可動部の作動速度が、前記声判定部の判定結果が静穏声でない場合の前記制御対象装置の可動部の作動速度より小さくなるように、前記制御対象装置を制御する、

請求項1に記載の制御装置。 - 前記作動制御部は、前記声判定部の判定結果が静穏声である場合、前記制御対象装置の可動部の少なくとも1つの可動要素を停止させる、

請求項1乃至2の何れかに記載の制御装置。 - 前記作動制御部は、前記音声取得部で取得した環境音の音圧レベルに応じて、前記制御対象装置を制御する、

請求項1乃至3の何れか一項に記載の制御装置。 - 前記作動制御部は、前記声判定部の判定結果が静穏声である場合の前記制御対象装置の発光装置の光量が、前記声判定部の判定結果が静穏声でない場合の前記制御対象装置の発光装置の光量より小さくなるように、前記制御対象装置を制御する、

請求項1乃至4の何れか一項に記載の制御装置。 - 前記作動制御部は、前記制御対象装置と前記音声の発話者との間の距離に応じて、前記制御対象装置を制御する、

請求項1乃至5の何れか一項に記載の制御装置。 - 前記音声取得部は、集音装置で収集された前記音声を取得し、

前記声判定部は、前記集音装置と前記音声の発話者との間の距離に応じて、前記音声が静穏声であるか否かを判定する、

請求項1乃至6の何れか一項に記載の制御装置。 - 前記作動制御部は、前記声判定部の判定結果、及び、現在時刻に応じて、前記制御対象装置を制御する、

請求項1乃至7の何れか一項に記載の制御装置。 - 前記声判定部は、前記音声が低発話速度の発声であるか否かを判定し、

前記作動制御部は、前記音声が低発話速度の発声であるか否かの判定結果に応じて、前記制御対象装置を制御する、

請求項1乃至8の何れか一項に記載の制御装置。 - 前記静穏声は、ささやき声である、請求項1乃至9何れか一項に記載の制御装置。

- 前記静穏声は、小さい声である、請求項1乃至9何れか一項に記載の制御装置。

- 前記音声取得部は、集音装置で収集された前記音声を取得し、

前記声判定部は、前記集音装置と発話者との間の距離に応じて補正した後の前記音声の大きさに基づいて、前記音声が前記小さい声であるか否かを判定する、

請求項11に記載の制御装置。 - 請求項1乃至請求項12の何れか一項に記載の制御装置を備える、

制御対象装置。 - 音声を取得するステップと、

前記音声を認識するステップと、

前記音声が静穏声であるか否かを判定するステップと、

前記音声の認識結果に応じて、制御対象装置の可動部を制御するステップと、をプロセッサが実行し、

前記制御するステップは、前記判定するステップの判定結果が静穏声である場合の前記制御対象装置の可動部が発する音の音圧レベルが、前記判定するステップの判定結果が静穏声でない場合の前記制御対象装置の可動部が発する音の音圧レベルより小さくなるように、前記制御対象装置を制御するステップを含む、

制御方法。 - 音声を取得する処理と、

前記音声を認識する処理と、

前記音声が静穏声であるか否かを判定する処理と、

前記音声の認識結果に応じて、制御対象装置の可動部を制御する処理と、をプロセッサに実行させ、

前記制御する処理は、前記判定するステップの判定結果が静穏声である場合の前記制御対象装置の可動部が発する音の音圧レベルが、前記判定するステップの判定結果が静穏声でない場合の前記制御対象装置の可動部が発する音の音圧レベルより小さくなるように、前記制御対象装置を制御する処理を含む、

プログラム。

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2019014743A JP2020121375A (ja) | 2019-01-30 | 2019-01-30 | 制御装置、制御対象装置、制御方法及びプログラム |

| PCT/JP2019/049803 WO2020158231A1 (ja) | 2019-01-30 | 2019-12-19 | 制御装置、制御対象装置、制御方法及び記憶媒体 |

| US17/443,548 US20210354300A1 (en) | 2019-01-30 | 2021-07-27 | Controller, controlled apparatus, control method, and recording medium |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2019014743A JP2020121375A (ja) | 2019-01-30 | 2019-01-30 | 制御装置、制御対象装置、制御方法及びプログラム |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2020121375A true JP2020121375A (ja) | 2020-08-13 |

| JP2020121375A5 JP2020121375A5 (ja) | 2021-12-02 |

Family

ID=71840834

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2019014743A Pending JP2020121375A (ja) | 2019-01-30 | 2019-01-30 | 制御装置、制御対象装置、制御方法及びプログラム |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US20210354300A1 (ja) |

| JP (1) | JP2020121375A (ja) |

| WO (1) | WO2020158231A1 (ja) |

Families Citing this family (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US10866783B2 (en) * | 2011-08-21 | 2020-12-15 | Transenterix Europe S.A.R.L. | Vocally activated surgical control system |

| US20220152825A1 (en) * | 2020-11-13 | 2022-05-19 | Armstrong Robotics, Inc. | Automated manipulation of objects using a vision-based method for determining collision-free motion planning |

| JP2022102059A (ja) * | 2020-12-25 | 2022-07-07 | トヨタ自動車株式会社 | 制御装置、タスクシステム、制御方法及び制御プログラム |

Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2015181778A (ja) * | 2014-03-25 | 2015-10-22 | シャープ株式会社 | 自走式掃除機 |

| JP2016095635A (ja) * | 2014-11-13 | 2016-05-26 | パナソニックヘルスケアホールディングス株式会社 | 空中タッチパネルおよびこれを備えた手術用シミュレータ表示システム |

| JP2016153999A (ja) * | 2015-02-17 | 2016-08-25 | 横河電機株式会社 | 管理装置、管理システム、管理方法、管理プログラム、及び記録媒体 |

| WO2017098713A1 (ja) * | 2015-12-07 | 2017-06-15 | 川崎重工業株式会社 | ロボットシステム及びその運転方法 |

| JP2017151517A (ja) * | 2016-02-22 | 2017-08-31 | 富士ゼロックス株式会社 | ロボット制御システム |

| US20180122361A1 (en) * | 2016-11-01 | 2018-05-03 | Google Inc. | Dynamic text-to-speech provisioning |

| US20180317725A1 (en) * | 2015-10-27 | 2018-11-08 | Samsung Electronics Co., Ltd | Cleaning robot and method for controlling same |

| JP2018194832A (ja) * | 2017-05-12 | 2018-12-06 | ネイバー コーポレーションNAVER Corporation | 受信した音声入力の入力音量に基づいて出力される音の出力音量を調節するユーザ命令処理方法およびシステム |

Family Cites Families (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4468777B2 (ja) * | 2004-09-29 | 2010-05-26 | 本田技研工業株式会社 | 脚式歩行ロボットの制御装置 |

-

2019

- 2019-01-30 JP JP2019014743A patent/JP2020121375A/ja active Pending

- 2019-12-19 WO PCT/JP2019/049803 patent/WO2020158231A1/ja active Application Filing

-

2021

- 2021-07-27 US US17/443,548 patent/US20210354300A1/en active Pending

Patent Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2015181778A (ja) * | 2014-03-25 | 2015-10-22 | シャープ株式会社 | 自走式掃除機 |

| JP2016095635A (ja) * | 2014-11-13 | 2016-05-26 | パナソニックヘルスケアホールディングス株式会社 | 空中タッチパネルおよびこれを備えた手術用シミュレータ表示システム |

| JP2016153999A (ja) * | 2015-02-17 | 2016-08-25 | 横河電機株式会社 | 管理装置、管理システム、管理方法、管理プログラム、及び記録媒体 |

| US20180317725A1 (en) * | 2015-10-27 | 2018-11-08 | Samsung Electronics Co., Ltd | Cleaning robot and method for controlling same |

| WO2017098713A1 (ja) * | 2015-12-07 | 2017-06-15 | 川崎重工業株式会社 | ロボットシステム及びその運転方法 |

| JP2017151517A (ja) * | 2016-02-22 | 2017-08-31 | 富士ゼロックス株式会社 | ロボット制御システム |

| US20180122361A1 (en) * | 2016-11-01 | 2018-05-03 | Google Inc. | Dynamic text-to-speech provisioning |

| JP2018194832A (ja) * | 2017-05-12 | 2018-12-06 | ネイバー コーポレーションNAVER Corporation | 受信した音声入力の入力音量に基づいて出力される音の出力音量を調節するユーザ命令処理方法およびシステム |

Also Published As

| Publication number | Publication date |

|---|---|

| WO2020158231A1 (ja) | 2020-08-06 |

| US20210354300A1 (en) | 2021-11-18 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| WO2020158231A1 (ja) | 制御装置、制御対象装置、制御方法及び記憶媒体 | |

| US11430428B2 (en) | Method, apparatus, and storage medium for segmenting sentences for speech recognition | |

| JP5075664B2 (ja) | 音声対話装置及び支援方法 | |

| CN106463114B (zh) | 信息处理设备、控制方法及程序存储单元 | |

| JP6635049B2 (ja) | 情報処理装置、情報処理方法およびプログラム | |

| WO2017134935A1 (ja) | 情報処理装置、情報処理方法、及びプログラム | |

| US20210216134A1 (en) | Information processing apparatus and method, and program | |

| CN111868824A (zh) | 智能设备的情境感知控制 | |

| CN110892476A (zh) | 具有语音命令输入能力的装置 | |

| US10891946B2 (en) | Voice-controlled assistant volume control | |

| JP6844608B2 (ja) | 音声処理装置および音声処理方法 | |

| US10783903B2 (en) | Sound collection apparatus, sound collection method, recording medium recording sound collection program, and dictation method | |

| US11625956B2 (en) | Monitoring system | |

| JP2011071702A (ja) | 収音処理装置、収音処理方法、及びプログラム | |

| JP2005352154A (ja) | 感情状態反応動作装置 | |

| KR102629796B1 (ko) | 음성 인식의 향상을 지원하는 전자 장치 | |

| TW202121115A (zh) | 激活話音識別 | |

| US11656837B2 (en) | Electronic device for controlling sound and operation method therefor | |

| JPH06236196A (ja) | 音声認識方法および装置 | |

| CN112951222A (zh) | 电子装置及其控制方法 | |

| JP5365530B2 (ja) | 通信機器 | |

| US20210217439A1 (en) | Acoustic event recognition device, method, and program | |

| KR102168812B1 (ko) | 사운드를 제어하는 전자 장치 및 그 동작 방법 | |

| JP2013072904A (ja) | 音声認識方法および音声認識装置 | |

| US11600275B2 (en) | Electronic device and control method thereof |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20211022 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20211022 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20220802 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20221003 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20230131 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20230427 |

|

| C60 | Trial request (containing other claim documents, opposition documents) |

Free format text: JAPANESE INTERMEDIATE CODE: C60 Effective date: 20230427 |

|

| A911 | Transfer to examiner for re-examination before appeal (zenchi) |

Free format text: JAPANESE INTERMEDIATE CODE: A911 Effective date: 20230509 |

|

| A912 | Re-examination (zenchi) completed and case transferred to appeal board |

Free format text: JAPANESE INTERMEDIATE CODE: A912 Effective date: 20230602 |