JP2020052994A - 推奨方法及び現実感提示デバイス - Google Patents

推奨方法及び現実感提示デバイス Download PDFInfo

- Publication number

- JP2020052994A JP2020052994A JP2018228383A JP2018228383A JP2020052994A JP 2020052994 A JP2020052994 A JP 2020052994A JP 2018228383 A JP2018228383 A JP 2018228383A JP 2018228383 A JP2018228383 A JP 2018228383A JP 2020052994 A JP2020052994 A JP 2020052994A

- Authority

- JP

- Japan

- Prior art keywords

- user

- environment

- processing unit

- detection module

- reality

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06Q—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES; SYSTEMS OR METHODS SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES, NOT OTHERWISE PROVIDED FOR

- G06Q30/00—Commerce

- G06Q30/02—Marketing; Price estimation or determination; Fundraising

- G06Q30/0241—Advertisements

- G06Q30/0251—Targeted advertisements

- G06Q30/0269—Targeted advertisements based on user profile or attribute

- G06Q30/0271—Personalized advertisement

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06Q—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES; SYSTEMS OR METHODS SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES, NOT OTHERWISE PROVIDED FOR

- G06Q30/00—Commerce

- G06Q30/02—Marketing; Price estimation or determination; Fundraising

- G06Q30/0241—Advertisements

- G06Q30/0251—Targeted advertisements

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/14—Digital output to display device ; Cooperation and interconnection of the display device with other functional units

- G06F3/147—Digital output to display device ; Cooperation and interconnection of the display device with other functional units using display panels

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06Q—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES; SYSTEMS OR METHODS SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES, NOT OTHERWISE PROVIDED FOR

- G06Q30/00—Commerce

- G06Q30/02—Marketing; Price estimation or determination; Fundraising

- G06Q30/0282—Rating or review of business operators or products

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06Q—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES; SYSTEMS OR METHODS SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES, NOT OTHERWISE PROVIDED FOR

- G06Q30/00—Commerce

- G06Q30/06—Buying, selling or leasing transactions

- G06Q30/0601—Electronic shopping [e-shopping]

- G06Q30/0631—Item recommendations

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/161—Detection; Localisation; Normalisation

- G06V40/166—Detection; Localisation; Normalisation using acquisition arrangements

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/174—Facial expression recognition

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/18—Eye characteristics, e.g. of the iris

- G06V40/19—Sensors therefor

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L25/00—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00

- G10L25/48—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 specially adapted for particular use

- G10L25/51—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 specially adapted for particular use for comparison or discrimination

- G10L25/63—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 specially adapted for particular use for comparison or discrimination for estimating an emotional state

Abstract

【課題】 現実感提示デバイスに適用される推奨方法が開示される。【解決手段】 現実感提示デバイスは、第1の検知モジュール、第2の検知モジュール、及び処理ユニットを含む。推奨方法は、第1の検知モジュールが、現実感提示デバイスを装着しているユーザに対応するユーザ関連情報を検知するステップと、第2の検知モジュールが、ユーザが経験している環境に対応する環境関連情報を検知するステップと、処理ユニットが、ユーザ関連情報又は環境関連情報にしたがって、推奨される対象を生成して、ユーザにその推奨される対象を提示するステップと、を含む。【選択図】 図4

Description

本発明は、推奨方法及び現実感提示デバイスに関し、より具体的には、環境及びユーザの反応に基づいて、広告を適切にプッシュ型配信する(properly push advertisement)ことが可能である推奨方法及び現実感提示デバイスに関する。

技術の進歩及び発展に伴って、コンピュータとユーザとの間の対話(interactions)の必要性が増加している。例えば、体性感覚ゲーム(somatosensory games)、仮想現実感(virtual reality(VR))環境、拡張現実感(augmented reality(AR))環境、及び拡大現実感(extended reality(XR))環境等の人とコンピュータとの間の対話技術は、その生理学的機能及び娯楽的機能のために、普及が進んでいる。一方で、広告は、消費者に市販の製品を宣伝する1つの効果的な方法である。したがって、AR/VR/EX環境において広告をどのようにしてプッシュ型配信するかということは、この技術分野においては、1つの重要な目的である。

したがって、本発明の第1の目的は、環境及びユーザの反応に基づいて、広告を適切にプッシュ型配信することが可能である推奨方法及び現実感提示デバイスを提供することである。

本発明のある1つの実施形態は、現実感提示デバイスに適用される推奨方法であって、その現実感提示デバイスは、第1の検知モジュール、第2の検知モジュール、及び処理ユニットを含み、当該推奨方法は、第1の検知モジュールが、現実感提示デバイスを装着しているユーザに対応するユーザ関連情報を検知するステップと、第2の検知モジュールが、ユーザが経験している環境に対応する環境関連情報を検知するステップと、処理ユニットが、ユーザ関連情報又は環境関連情報にしたがって、推奨される対象を生成して、ユーザにその推奨される対象を提示するステップと、を含む、推奨方法を開示する。

本発明のある1つの実施形態は、現実感提示デバイスであって、当該現実感提示デバイスを装着しているユーザに対応するユーザ関連情報を検知するように構成される第1の検知モジュールと、ユーザが経験している環境に対応する環境関連情報を検知するように構成される第2の検知モジュールと、ユーザ関連情報又は環境関連情報にしたがって、推奨される対象を生成して、ユーザにその推奨される対象を提示する、ように構成される処理ユニットと、を含む、現実感提示デバイスを開示する。

様々な図表及び図面にしたがって解説される好適な実施形態の以下の詳細な説明を参照すると、本発明のこれらの及び他の目的は、当業者に明らかとなることは間違いないであろう。

図1は、本発明のある1つの実施形態にしたがった現実感提示デバイス10の機能的なブロック図である。図2は、現実感提示デバイス10のある1つの外観図である。現実感提示デバイス10は、仮想現実感(virtual reality (VR))デバイス、拡張現実感(augmented reality (AR))デバイス、複合現実感(mixed reality (MR))デバイス、又は拡大現実感(extended reality (XR))デバイスであってもよい。現実感提示デバイス10は、第1の検知モジュール12、第2の検知モジュール14、及び処理ユニット16を含む。第1の検知モジュール12は、現実感提示デバイス10を装着しているユーザに対応するユーザ関連情報(user-related information (US))を検知するように構成される。第2の検知モジュール14は、そのユーザが経験している環境に対応する環境関連情報(environment-related information (EN))を検知するように構成され、(そのユーザが経験している)環境は、実環境(real environment)、仮想環境(virtual environment)、又はそれらの環境の組み合わせ/混合の環境であってもよい。処理ユニット16は、第1の検知ユニット12及び第2の検知ユニット14に接続されて、ユーザ関連情報(user-related information (US))及び/又は環境関連情報(environment-related information (EN))にしたがって、推奨される対象(recommended object (RO))を生成して、ユーザにその推奨される対象(RO)を提示する、ように構成される。その推奨される対象(RO)は、ユーザのために生成される視認可能な対象又は可聴音であってもよい。ある1つの実施形態において、推奨される対象(RO)は、これらには限定されないが、視覚的に或いは聴覚的に生成される市販の製品の広告であってもよい。

例えば、図3は、室内で現実感提示デバイス10を装着しているユーザのある1つのシナリオのある1つの概略的な図である。現実感提示デバイス10を装着しているそのユーザが、例えば、図3が示しているような居間等のある特定の部屋に滞在している場合に、第2の検知モジュール14は、最初に、そのユーザが経験している環境に対応する環境関連情報を収集し/集めて(collect/gather)もよい。例えば、第2の検知モジュール14は、その環境の1つ又は複数の写真を撮ってもよく、第2の検知モジュール14が撮ったその環境の写真は、その環境関連情報の形態/タイプである。第2に、第2の検知モジュール14又は処理ユニット16は、その環境の1つ又は複数の写真等の環境関連情報にしたがって、ある種の人工知能(artificial intelligence (AI))アルゴリズムを使用して、その特定の部屋のある1つの環境タイプを認識し或いは識別してもよい。例えば、第2の検知モジュール14又は処理ユニット16は、図3に示されているそのユーザが滞在しているその部屋が居間であるということを認識し/識別してもよく、そして、その環境が居間であるということを示す環境タイプ情報を生成してもよい。ある1つの実施形態において、そのユーザは、その特定の部屋を歩き回ってもよく、それによって、第2の検知モジュール14は、その第2の検知モジュール14又は処理ユニット16がより良好な判断を実行するために、十分なデータ、すなわち、それらの写真或いは環境関連情報を収集してもよい。一方で、第1の検知モジュール12は、特に、その環境又はその特定の部屋に滞在している際に、ある種のビックデータ技術を使用して、例えば、顔の表情及び音声の中のトーン等のユーザの応答/反応を観測してもよく、そのユーザの関心を憶測し/推測してもよい。最終的に、処理ユニット16は、ユーザ関連情報(US)及び/又は環境関連情報(EN)にしたがって、例えば、現実感提示デバイス10の(図1及び図2に示されていない)マルチメディアインターフェイス等によって、そのユーザに推奨される対象(RO)を宣伝してもよい。したがって、そのユーザは、より関心がある情報を取得することが可能であるとともに、より良好なユーザイクスペアリアンスを経験することが可能である。その推奨される対象(RO)が広告である場合には、その広告のプッシュ型配信を成功させることが可能である。

さらに、ある1つの実施形態において、第1の検知モジュール12及び処理ユニット16は、協働して、そのユーザがその推奨される対象(RO)を好んでいるか否かを推測してもよい。そのユーザがその推奨される対象(RO)を好んでいない場合には、処理ユニット16は、他の推奨される対象(RO)を宣伝してもよい。そのユーザと現実感提示デバイス10との間の対話を通じて、及び/又は、処理ユニット16が実行する学習プロセスを通じて、その処理ユニット16は、そのユーザが好む最良の推奨される対象(RO)を宣伝してもよいということを予測することが可能である。広告の観点から、その広告のプッシュ型配信を成功させることが可能である。

加えて、環境タイプは、また、これらには限定されないが、台所、食堂、寝室、書斎、展示ホール、レストラン、コンサートホール、会議室、体育館、競技場、病院、学校、ショッピングモール、鉄道の駅、空港、市場等であってもよい。

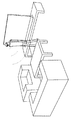

現実感提示デバイス10の動作を、図4に示されているプロセス40に要約することが可能である。そのプロセス40は、以下のステップを含む。

ステップ402: 第1の検知モジュール12は、現実感提示デバイス10を装着しているユーザに対応するユーザ関連情報(UR)を検知する。

ステップ404: 第2の検知モジュール14は、そのユーザが経験している環境に対応する環境関連情報(EN)を検知する。

ステップ406: 処理ユニット16は、ユーザ関連情報(US)又は環境関連情報(EN)にしたがって、推奨される対象(RO)を生成して、そのユーザにその推奨される対象(RO)を提示する。

ある1つの実施形態において、第1の検知モジュール12は、眼球追跡サブモジュールを含んでもよく、その眼球追跡サブモジュールは、そのユーザの目に対して眼球追跡動作を実行して、そのユーザに対応する眼球追跡結果を生成してもよい。この場合に、ユーザ関連情報(UR)は、その眼球追跡結果を含む。第1の検知モジュール12又は処理ユニット16は、その眼球追跡結果にしたがって、注目を集める小領域情報(attention-drawing spot information)を決定してもよい。処理ユニット16は、注目を集める小領域情報及び環境関連情報(EN)にしたがって、推奨される対象(RO)を生成してもよい。

具体的には、その眼球追跡結果にしたがって、現実感提示デバイス10は、ある時間的な期間の間にそのユーザが凝視するある小領域(点)の位置に関する情報を取得するであろう。そのユーザが凝視するその小領域は、そのユーザの注目をひいているということを暗に示しているということができ、その小領域は、注目を集める小領域と呼ばれる。注目を集める小領域情報と呼ばれるその注目を集める小領域の位置は、現実感提示デバイス10が表示する写真又はビデオフレームの中のその小領域の座標であってもよい。その環境又は環境関連情報(EN)にその注目を集める小領域情報を組み込むことによって、処理ユニット16は、その推奨される対象(RO)を宣伝してもよい。

例えば、現実感提示デバイス10を装着しているユーザは、居間に滞在していてもよい。プロセッサ40を使用して、第1の検知モジュール12によって、その現実感提示デバイス10が、そのユーザがその居間の空いている壁を凝視しているということを認識している場合に、処理ユニット16は、推奨される対象(RO)として、仮想的な絵画又はその壁につるされているポスターを宣伝してもよい。

ある1つの実施形態において、第1の検知モジュール12は、顔面走査サブモジュールを含んでもよく、その顔面走査サブモジュールは、そのユーザの顔面に対して顔面走査動作を実行して、そのユーザに対応する顔面走査結果を生成してもよい。この場合に、ユーザ関連情報(UR)は、その顔面走査結果を含む。第1の検知モジュール12又は処理ユニット16は、その顔面走査結果にしたがって感情情報を決定してもよい。処理ユニット16は、その感情情報にしたがって、推奨される対象(RO)を生成してもよい。

例えば、顔面走査結果は、その顔面の一部の写真又は顔面全体の写真であってもよい。第1の検知モジュール12又は処理ユニット16は、その顔面走査結果にしたがって、そのユーザの感情を決定して、感情情報を生成してもよい。第1の検知モジュール12又は処理モジュール16は、知られてはいるが本明細書においては解説されていないある種の人工知能(AI)アルゴリズム又はビックデータアルゴリズムを使用することによって、そのユーザの感情が、幸福である、驚いている、動転している、不安である等ということを決定してもよい。その感情情報に基づいて、処理ユニット16は、適切な推奨される対象(RO)を宣伝してもよい。

ある1つの実施形態において、第1の検知モジュール12は、トーン検知サブモジュールを含んでもよく、そのトーン検知サブモジュール122は、そのユーザの音声のトーンに対してトーン検知動作を実行して、そのユーザに対応するトーン検知結果を生成してもよい。この場合に、ユーザ関連情報(UR)は、トーン検知結果を含んでもよい。第1の検知モジュール12又は処理ユニット16は、そのトーン検知結果にしたがってトーン情報を決定してもよい。処理ユニット16は、そのトーン情報にしたがって、推奨される対象(RO)を生成してもよい。

例えば、トーン検知サブモジュールは、マイクロフォンを含んでもよく、そのトーン検知結果は、ユーザの音声の記録であってもよい。第1の検知モジュール12又は処理ユニット16は、そのユーザが興奮しているか又は失望しているかを示すトーン情報を決定してもよい。さらに、第1の検知モジュール12は、1つ又は複数の既存の音声認識アルゴリズムを使用することによって、"すごい! これは素晴らしい"又は"ううん、これは好きではない"等の音声コンテンツを認識して、その音声認識結果を含むトーン情報を生成してもよい。そのトーン情報に基づいて、処理ユニット16は、推奨される対象(RO)を宣伝してもよい。

要約すると、本発明は、ユーザ関連情報及び環境関連情報を利用して、推奨される対象を宣伝し、それによって、ユーザイクスペアリアンスを強化する。加えて、その環境及びユーザの反応に基づいて、広告のプッシュ型配信を成功させることが可能である。

当業者は、本発明の教示を確保しつつ、デバイス及び方法の数多くの修正及び変更を行うことが可能であるということに容易に気付くであろう。したがって、上記の開示は、添付の特許請求の範囲の境界及び限度によってのみ限定されると解釈されるべきである。

Claims (17)

- 現実感提示デバイスに適用される推奨方法であって、前記現実感提示デバイスは、第1の検知モジュール、第2の検知モジュール、及び処理ユニットを含み、当該推奨方法は、

前記第1の検知モジュールが、前記現実感提示デバイスを装着しているユーザに対応するユーザ関連情報を検知するステップと、

前記第2の検知モジュールが、前記ユーザが経験している環境に対応する環境関連情報を検知するステップと、

前記処理ユニットが、前記ユーザ関連情報又は前記環境関連情報にしたがって、推奨される対象を生成して、前記ユーザに前記推奨される対象を提示するステップと、を含む、

推奨方法。 - 前記現実感提示デバイスは、仮想現実感(VR)デバイス、拡張現実感(AR)デバイス、複合現実感(MR)デバイス、又は拡大現実感(XR)デバイスである、請求項1に記載の推奨方法。

- 前記第1の検知モジュールが、前記ユーザの目に対して眼球追跡動作を実行し、前記ユーザに対応する眼球追跡結果を取得するステップであって、前記ユーザ関連情報は、前記眼球追跡結果を含む、ステップと、

前記第1の検知モジュール又は前記処理ユニットが、前記眼球追跡結果にしたがって、注目を集める小領域情報を決定するステップと、

前記処理ユニットが、前記注目を集める小領域情報にしたがって、前記推奨される対象を生成するステップと、をさらに含む、請求項1に記載の推奨方法。 - 第1の検知モジュールが、前記ユーザの顔面に対して顔面走査動作を実行し、前記ユーザに対応する顔面走査結果を取得するステップであって、前記ユーザ関連情報は、前記顔面走査結果を含む、ステップと、

前記第1の検知モジュール又は前記処理ユニットが、前記顔面走査結果にしたがって感情情報を決定するステップと、

前記処理ユニットが、前記感情情報にしたがって前記推奨される対象を生成するステップと、をさらに含む、請求項1に記載の推奨方法。 - 前記第1の検知モジュールが、前記ユーザに対してトーン検知動作を実行し、トーン検知結果を取得するステップであって、前記ユーザ関連情報は、前記トーン検知結果を含む、ステップと、

前記第1の検知モジュール又は前記処理ユニットが、前記トーン検知結果にしたがってトーン情報を決定するステップと、

前記処理ユニットが、前記トーン情報にしたがって前記推奨される対象を生成するステップと、をさらに含む、請求項1に記載の方法。 - 前記第2の検知モジュール又は前記処理ユニットが、前記環境関連情報にしたがって前記環境の環境タイプ情報を識別するステップと、

前記処理ユニットが、前記環境タイプ情報にしたがって、前記推奨される対象を生成するステップと、をさらに含む、請求項1に記載の推奨方法。 - 前記推奨される対象は、市販用の製品の広告である、請求項1に記載の推奨方法。

- 前記ユーザが経験している前記環境は、実環境又は仮想環境を含む、請求項1に記載の推奨方法。

- 現実感提示デバイスであって、

当該現実感提示デバイスを装着しているユーザに対応するユーザ関連情報を検知するように構成される第1の検知モジュールと、

前記ユーザが経験している環境に対応する環境関連情報を検知するように構成される第2の検知モジュールと、

前記ユーザ関連情報又は前記環境関連情報にしたがって、推奨される対象を生成して、前記ユーザに前記推奨される対象を提示する、ように構成される処理ユニットと、を含む、

現実感提示デバイス。 - 当該現実感提示デバイスは、仮想現実感(VR)デバイス、拡張現実感(AR)デバイス、複合現実感(MR)デバイス、又は拡大現実感(XR)デバイスである、請求項9に記載の現実感提示デバイス。

- 前記第1の検知モジュールは、前記ユーザの目に対して眼球追跡動作を実行し、前記ユーザに対応する眼球追跡結果を取得し、前記ユーザ関連情報は、前記眼球追跡結果を含み、

前記第1の検知モジュール又は前記処理ユニットは、前記眼球追跡結果にしたがって、注目を集める小領域情報を決定し、

前記処理ユニットは、前記注目を集める小領域情報にしたがって、前記推奨される対象を生成する、請求項9に記載の現実感提示デバイス。 - 第1の検知モジュールは、前記ユーザの顔面に対して顔面走査動作を実行し、そして、前記ユーザに対応する顔面走査結果を取得し、前記ユーザ関連情報は、前記顔面走査結果を含み、

前記第1の検知モジュール又は前記処理ユニットは、前記顔面走査結果にしたがって感情情報を決定し、

前記処理ユニットは、前記感情情報にしたがって前記推奨される対象を生成する、請求項9に記載の現実感提示デバイス。 - 前記第1の検知モジュールは、前記ユーザに対してトーン検知動作を実行し、そして、トーン検知結果を取得し、前記ユーザ関連情報は、前記トーン検知結果を含み、

前記第1の検知モジュール又は前記処理ユニットは、前記トーン検知結果にしたがってトーン情報を決定し、

前記処理ユニットは、前記トーン情報にしたがって前記推奨される対象を生成する、請求項9に記載の現実感提示デバイス。 - 前記第2の検知モジュール又は前記処理ユニットは、前記環境関連情報にしたがって前記環境の環境タイプ情報を識別し、

前記処理ユニットは、前記環境タイプ情報にしたがって、前記推奨される対象を生成する、請求項9に記載の現実感提示デバイス。 - 前記推奨される対象は、市販用の製品の広告である、請求項9に記載の現実感提示デバイス。

- 前記ユーザが経験している前記環境は、実環境又は仮想環境を含む、請求項9に記載の現実感提示デバイス。

- コンピュータ読み取り可能な命令を含むコンピュータプログラムであって、前記コンピュータ読み取り可能な命令は、第1の検知モジュール、第2の検知モジュール、及び処理ユニットを含む現実感提示デバイスの前記処理ユニットで実行されると、前記コンピュータ読み取り可能な命令は、前記現実感提示デバイスに推奨方法を実行させ、前記推奨方法は、

前記第1の検知モジュールが、前記現実感提示デバイスを装着しているユーザに対応するユーザ関連情報を検知するステップと、

前記第2の検知モジュールが、前記ユーザが経験している環境に対応する環境関連情報を検知するステップと、

前記処理ユニットが、前記ユーザ関連情報又は前記環境関連情報にしたがって、推奨される対象を生成して、前記ユーザに前記推奨される対象を提示するステップと、を含む、

コンピュータプログラム。

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US16/141,938 US20200098012A1 (en) | 2018-09-25 | 2018-09-25 | Recommendation Method and Reality Presenting Device |

| US16/141,938 | 2018-09-25 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2020052994A true JP2020052994A (ja) | 2020-04-02 |

Family

ID=64755343

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2018228383A Pending JP2020052994A (ja) | 2018-09-25 | 2018-12-05 | 推奨方法及び現実感提示デバイス |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US20200098012A1 (ja) |

| EP (1) | EP3629280A1 (ja) |

| JP (1) | JP2020052994A (ja) |

| CN (1) | CN110942327A (ja) |

| TW (1) | TW202013286A (ja) |

Families Citing this family (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP6889304B1 (ja) * | 2020-03-31 | 2021-06-18 | 株式会社博報堂Dyホールディングス | 拡張現実表示システム、拡張現実表示方法、及びコンピュータプログラム |

| CN111400605A (zh) * | 2020-04-26 | 2020-07-10 | Oppo广东移动通信有限公司 | 基于眼球追踪的推荐方法及装置 |

Family Cites Families (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| TWI482108B (zh) * | 2011-12-29 | 2015-04-21 | Univ Nat Taiwan | To bring virtual social networks into real-life social systems and methods |

| CA3019672A1 (en) * | 2016-04-12 | 2017-10-19 | R-Stor Inc. | Method and apparatus for presenting advertisements in a virtualized environment |

| US20180232921A1 (en) * | 2017-02-14 | 2018-08-16 | Adobe Systems Incorporated | Digital Experience Content Personalization and Recommendation within an AR or VR Environment |

-

2018

- 2018-09-25 US US16/141,938 patent/US20200098012A1/en not_active Abandoned

- 2018-12-05 JP JP2018228383A patent/JP2020052994A/ja active Pending

- 2018-12-17 TW TW107145412A patent/TW202013286A/zh unknown

- 2018-12-19 CN CN201811558373.5A patent/CN110942327A/zh not_active Withdrawn

- 2018-12-21 EP EP18214995.5A patent/EP3629280A1/en not_active Withdrawn

Also Published As

| Publication number | Publication date |

|---|---|

| TW202013286A (zh) | 2020-04-01 |

| US20200098012A1 (en) | 2020-03-26 |

| EP3629280A1 (en) | 2020-04-01 |

| CN110942327A (zh) | 2020-03-31 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR101644421B1 (ko) | 사용자의 관심 정도에 기반한 컨텐츠 제공장치 및 방법 | |

| Brady et al. | Visual challenges in the everyday lives of blind people | |

| JP5859456B2 (ja) | プレゼンテーション用カメラ・ナビゲーション | |

| Brenton et al. | The uncanny valley: does it exist | |

| US7225414B1 (en) | Method and system for virtual touch entertainment | |

| US20190196576A1 (en) | Virtual reality device and a virtual reality server | |

| CN116203731A (zh) | 内容到空间3d环境的匹配 | |

| GB2543913A (en) | Virtual conference room | |

| US20130290994A1 (en) | Selection of targeted content based on user reactions to content | |

| WO2015173869A1 (ja) | 商品情報出力方法、商品情報出力プログラムおよび制御装置 | |

| Covaci et al. | How do we experience crossmodal correspondent mulsemedia content? | |

| Saleme et al. | The influence of human factors on 360∘ mulsemedia QoE | |

| Xambó et al. | Exploring social interaction with a tangible music interface | |

| JP2020052994A (ja) | 推奨方法及び現実感提示デバイス | |

| US9785884B2 (en) | System and method for enhancing user accessibility in a virtual universe | |

| Hehn et al. | Inducing context with immersive technologies in sensory consumer testing | |

| CN109671317B (zh) | 基于ar的脸谱互动教学方法 | |

| WO2023093329A1 (zh) | 信息输出方法、头戴式显示设备及可读存储介质 | |

| CN106113057A (zh) | 基于机器人的音视频宣传方法和系统 | |

| Nijholt | Humorous and playful social interactions in augmented reality | |

| Gillies et al. | Non-verbal communication for correlational characters | |

| Skaburskis et al. | Auramirror: Reflections on attention | |

| WO2024009748A1 (ja) | 情報処理装置、情報処理方法、および記録媒体 | |

| US20230162420A1 (en) | System and method for provision of personalized multimedia avatars that provide studying companionship | |

| WO2021070733A1 (ja) | 情報処理装置、情報処理方法、及び、プログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20181205 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20200225 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20200929 |