JP2019057255A - Customer ornament matching system - Google Patents

Customer ornament matching system Download PDFInfo

- Publication number

- JP2019057255A JP2019057255A JP2017194654A JP2017194654A JP2019057255A JP 2019057255 A JP2019057255 A JP 2019057255A JP 2017194654 A JP2017194654 A JP 2017194654A JP 2017194654 A JP2017194654 A JP 2017194654A JP 2019057255 A JP2019057255 A JP 2019057255A

- Authority

- JP

- Japan

- Prior art keywords

- customer

- clothing

- classification

- character strings

- images

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Abstract

Description

本発明は、顧客分類における従来の問題点を解決する顧客服飾品マッチングシステム及び方法、顧客分類プログラムに関する。The present invention relates to a customer clothing matching system and method and a customer classification program for solving the conventional problems in customer classification.

昨今、百貨店、専門店、オンラインショップにおいて、何十万種類という服飾品が販売されており、加えて、雑誌やブログなどを通してファッションに関わる情報も溢れており、選択の幅が広がった一方、消費者が限られた時間の中で、その中から自分に適した服飾品を選ぶことを大いに困難にしている。Nowadays, hundreds of thousands of clothing items are sold in department stores, specialty stores, and online shops. In addition, information related to fashion is also overflowing through magazines and blogs, etc. It is very difficult for a person to choose clothes suitable for him in a limited time.

この様な中、消費者は自らの好みなどを店舗の店員やオンライン上で伝えて選択を補助してもらうことができ、例えば、特許文献1では、ファッション商品の購入を希望する消費者が自身の希望条件に基づいたファッション商品の推薦を受けることとのできる、ファッション商品販売システムに関する技術が公開されており、また、特許文献2では、消費者によるソーシャルネットワーキングサービスや利用履歴により、消費者のファッション傾向を分析し、それに基づいたコーディネートを消費者へと提示する、コーディネート支援装置に関する技術が公開されており、また、特許文献3では、消費者がチャレンジした服飾品を聞き出し、推薦内容に反映させる内容が記されている。Under such circumstances, consumers can tell their preferences etc. on the store clerk or online to assist in the selection. For example, in Patent Document 1, a consumer who wants to purchase a fashion product himself The technology related to the fashion product sales system that can receive the recommendation of the fashion product based on the desired conditions is disclosed, and in Patent Document 2, the consumer's social networking service and usage history are used to The technology related to the coordination support device that analyzes the fashion trend and presents the coordination based on the trend is disclosed. Also, in Patent Document 3, the clothing items challenged by the consumer are heard and reflected in the recommended content. Contents to be made are written.

しかしながら、どの手法も前記問題の解決には至っておらず、現在、8割以上の人が服飾品選びを不快に感じることがあり、その内7割の人が頻繁に不快に感じると答え、その不快な経験を経て服飾品を購入するものの、5割を超える人が自分のクローゼットを見て何も着るものがないと頻繁に不満を感じると答え、結果として、持っている服飾品の1割程度を着まわしているとの報告されている。これは消費者が、前記補助のあるなしにかかわらず、自らの好みに依存して選択をしていることに大きく起因し、これは好みが、個々人の極めて限定された経験の中で形成されるもので、かつ、人間の本能的に自らとは違うタイプの人に憧れ、そのタイプの違う人に近づこう、無理になろうとするからであると説明される。However, none of the methods has solved the problem, and currently more than 80% of people may feel uncomfortable with choosing clothing items, and 70% of them often feel uncomfortable. Although more than 50% of people purchase clothing after an unpleasant experience, they often feel dissatisfied when they look at their closets and don't wear anything. As a result, 10% of the clothing they have It is reported that it is wearing a degree. This is largely due to consumers making choices depending on their own preferences, with or without the assistance, and preferences are formed within their very limited experience. It is explained that it is because of the instinct of human beings who are longing for a different type of person and trying to get closer to that type of person.

現在、この好みを基準に選ぶことを代替可能な手法は、科学的に似合う服飾品を推薦する方法であり、非特許文献3に示される骨格診断理論、カラー診断理論に代表される理論があり、イメージコンサルタントによりこれら理論に基づいた診断や付随したサービスが提供されているCurrently, a method that can replace the selection based on this preference is a method of recommending clothing that looks scientifically, and there are theories represented by skeletal diagnostic theory and color diagnostic theory shown in Non-Patent Document 3. Image consultants provide diagnostics and accompanying services based on these theories

消費者が従来の様に好みで服飾品を選ぶ場合でも、前記の様に科学的に似合う服飾品を選ぶ場合であっても、小売店による正確な推薦、消費者による正確な選択を可能にする為に重要なことは、顧客を的確に分析し、分類し、顧客と服飾品をマッチングすることであるが、現状、それは的確にできておらず、例えば、上述した特許文献1、特許文献2においても、様々な顧客属性を羅列するにとどまり、必ずしも効果的なマッチングを提示できず、正確な選択に寄与しないという問題点があった。Whether the consumer chooses clothing according to their preference as before, or when choosing clothing that looks scientifically as described above, it is possible to make an accurate recommendation by a retail store and an accurate selection by the consumer. The important thing to do is to accurately analyze and classify customers, and match customers and clothing, but at present, it has not been done accurately. For example, Patent Document 1 and Patent Document described above In the second example, various customer attributes are merely listed, and there is a problem that an effective matching cannot always be presented and the selection does not contribute to an accurate selection.

そこで本発明は、上述した問題点に鑑みて案出されたものであり、その目的とするところは、顧客服飾品マッチング結果を効果的に提示することで、小売店がより正確に服飾品を推薦でき、ユーザが正確に選択を出来る基礎となる顧客服飾品マッチングシステム及び方法、顧客分類プログラムを提供することにある。Accordingly, the present invention has been devised in view of the above-described problems, and the purpose of the present invention is to effectively present the customer clothing matching result so that the retail store can more accurately collect the clothing. The object is to provide a customer apparel matching system and method, and a customer classification program that can be recommended and can be accurately selected by the user.

本発明に係る顧客服飾品マッチングシステムは、予め取得した顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度を参照し、

音声入力又は手動入力又は自動入力により取得した顧客に関する画像及び/又は文字列及び/又は分類結果に応じた顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索手段とを備えることを特徴とする。The customer clothing matching system according to the present invention includes a reference image and / or character string and / or classification result relating to a customer acquired in advance, and a reference image and / or character string and / or classification result relating to clothing. Refer to the level of relevance

Customer-related images and / or character strings and / or classification results obtained by voice input, manual input, or automatic input, and / or character strings and / or classification results, and reference images regarding clothing And / or search means for searching for one or more customer clothing item matching results based on three or more levels of association with the character string and / or the classification result.

本発明に係る顧客服飾品マッチングシステムは、予め取得した顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度を参照し、

音声入力又は手動入力又は自動入力により取得した服飾品に関する画像及び/又は文字列及び/又は分類結果に応じた服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と、顧客に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索手段とを備えることを特徴とする。The customer clothing matching system according to the present invention includes a reference image and / or character string and / or classification result relating to a customer acquired in advance, and a reference image and / or character string and / or classification result relating to clothing. Refer to the level of relevance

Reference images and / or character strings and / or classification results for clothing according to images and / or character strings and / or classification results obtained by voice input, manual input or automatic input, and reference for customers Search means for searching for one or more customer clothing matching results based on three or more levels of association with images and / or character strings and / or classification results.

本発明に係る顧客服飾品マッチングシステムは、予め取得した顧客に関する複数の参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度を参照し、音声入力又は手動入力又は自動入力により取得した顧客に関する複数の画像及び/又は文字列及び/又は分類結果に応じた複数の顧客に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索手段とを備えることを特徴とする。The customer clothing product matching system according to the present invention includes a plurality of reference images and / or character strings and / or character strings and / or character strings and / or character strings and / or character strings and / or a combination of classification results. Reference images relating to a plurality of customers and / or character strings and / or a plurality of customers according to the classification results, which are obtained by voice input, manual input or automatic input with reference to three or more levels of association with the classification results And / or one or more customer clothing matching results based on a reference image and / or a string and / or classification result for each piece of clothing for a combination between character strings and / or classification results And a search means for searching for.

本発明に係る顧客服飾品マッチングシステムは、予め取得した顧客に関する複数の参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度を参照し、音声入力又は手動入力又は自動入力により取得した服飾品に関する複数の画像及び/又は文字列及び/又は分類結果に応じた複数の服飾品に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各顧客に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索手段とを備えることを特徴とする。The customer clothing matching system according to the present invention includes a reference image and / or a character string and / or a classification related to a clothing for a combination of a plurality of reference images and / or character strings and / or classification results regarding a customer acquired in advance. Refer to multiple images and / or character strings and / or multiple clothing items according to classification results by referring to three or more levels of relevance with the results and using speech input, manual input, or automatic input. One or more customer clothing matching results based on three or more levels of relevance with reference images and / or character strings and / or classification results for each customer for a combination between images and / or character strings and / or classification results And a search means for searching for.

本発明に係る顧客分類方法は、予め取得した顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度を参照し、

音声入力又は手動入力又は自動入力により取得した顧客に関する画像及び/又は文字列及び/又は分類結果に応じた顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索ステップとを有することを特徴とする。The customer classification method according to the present invention includes three or more stages of a reference image and / or character string and / or classification result relating to a customer acquired in advance, and a reference image and / or character string and / or classification result relating to clothing. See the relevance of

Customer-related images and / or character strings and / or classification results obtained by voice input, manual input, or automatic input, and / or character strings and / or classification results, and reference images regarding clothing And / or a search step for searching for one or more customer clothing item matching results based on three or more levels of association with the character string and / or the classification result.

本発明に係る顧客分類方法は、予め取得した顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度を参照し、

音声入力又は手動入力又は自動入力により取得した服飾品に関する画像及び/又は文字列及び/又は分類結果に応じた服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と、顧客に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索ステップとを有することを特徴とする。The customer classification method according to the present invention includes three or more stages of a reference image and / or character string and / or classification result relating to a customer acquired in advance, and a reference image and / or character string and / or classification result relating to clothing. See the relevance of

Reference images and / or character strings and / or classification results for clothing according to images and / or character strings and / or classification results obtained by voice input, manual input or automatic input, and reference for customers And a search step for searching for one or more customer clothing matching results based on three or more levels of association with images and / or character strings and / or classification results.

本発明に係る顧客分類方法は、予め取得した顧客に関する複数の参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度を参照し、音声入力又は手動入力又は自動入力により取得した顧客に関する複数の画像及び/又は文字列及び/又は分類結果に応じた複数の顧客に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索ステップとを有することを特徴とする。The customer classification method according to the present invention includes a plurality of reference images and / or character strings and / or reference images related to each piece of clothing and / or character strings and / or classification results for a combination of a plurality of reference images and customer results obtained in advance. And / or reference images related to a plurality of customers and / or character strings and / or classification results obtained by voice input, manual input or automatic input. Alternatively, search for one or more customer clothing matching results based on a reference image and / or a string and / or classification result for each piece of clothing for the combination between the character string and / or the classification result, and / or three or more levels of relevance. And a search step.

本発明に係る顧客分類方法は、予め取得した顧客に関する複数の参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度を参照し、音声入力又は手動入力又は自動入力により取得した服飾品に関する複数の画像及び/又は文字列及び/又は分類結果に応じた複数の服飾品に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各顧客に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索ステップとを有することを特徴とする。The customer classification method according to the present invention includes a reference image and / or a character string and / or a classification result for a clothing item for a combination of a plurality of reference images and / or character strings and / or a classification result regarding a customer acquired in advance. A plurality of images and / or reference images related to a plurality of clothing items according to character strings and / or classification results Search for one or more customer clothing matching results based on a reference image and / or a string and / or classification result for each customer for a combination between / and character strings and / or classification results And a search step.

本発明に係る顧客分類プログラムは、予め取得した顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度を参照し、

音声入力又は手動入力又は自動入力により取得した顧客に関する画像及び/又は文字列及び/又は分類結果に応じた顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索ステップとをコンピュータに実行させることを特徴とする。The customer classification program according to the present invention includes three or more stages of a reference image and / or character string and / or classification result relating to a customer acquired in advance, and a reference image and / or character string and / or classification result relating to clothing. See the relevance of

Customer-related images and / or character strings and / or classification results obtained by voice input, manual input, or automatic input, and / or character strings and / or classification results, and reference images regarding clothing And / or having the computer execute a search step for searching for one or more customer clothing matching results based on three or more levels of association with the character string and / or the classification result.

本発明に係る顧客分類プログラムは、予め取得した顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度を参照し、

音声入力又は手動入力又は自動入力により取得した服飾品に関する画像及び/又は文字列及び/又は分類結果に応じた服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と、顧客に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索ステップとをコンピュータに実行させることを特徴とする。The customer classification program according to the present invention includes three or more stages of a reference image and / or character string and / or classification result relating to a customer acquired in advance, and a reference image and / or character string and / or classification result relating to clothing. See the relevance of

Reference images and / or character strings and / or classification results for clothing according to images and / or character strings and / or classification results obtained by voice input, manual input or automatic input, and reference for customers And a search step for searching for one or more customer clothing matching results based on three or more levels of association with images and / or character strings and / or classification results.

本発明に係る顧客分類プログラムは、予め取得した顧客に関する複数の参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度を参照し、音声入力又は手動入力又は自動入力により取得した顧客に関する複数の画像及び/又は文字列及び/又は分類結果に応じた複数の顧客に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索ステップとをコンピュータに実行させることを特徴とする。The customer classification program according to the present invention includes a reference image and / or a character string and / or a classification result for each piece of clothing for a combination of a plurality of reference images and / or character strings and / or classification results regarding a customer acquired in advance. And / or reference images related to a plurality of customers and / or character strings and / or classification results obtained by voice input, manual input or automatic input. Alternatively, search for one or more customer clothing matching results based on a reference image and / or a string and / or classification result for each piece of clothing for the combination between the character string and / or the classification result, and / or three or more levels of relevance. And causing the computer to execute a search step.

本発明に係る顧客分類プログラムは、予め取得した顧客に関する複数の参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度を参照し、音声入力又は手動入力又は自動入力により取得した服飾品に関する複数の画像及び/又は文字列及び/又は分類結果に応じた複数の服飾品に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各顧客に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索ステップとをコンピュータに実行させることを特徴とする。The customer classification program according to the present invention includes a reference image and / or a character string and / or a classification result for a clothing item for a combination of a plurality of reference images and / or character strings and / or a classification result regarding a customer acquired in advance. A plurality of images and / or reference images related to a plurality of clothing items according to character strings and / or classification results Search for one or more customer clothing matching results based on a reference image and / or a string and / or classification result for each customer for a combination between / and character strings and / or classification results And causing the computer to execute a search step.

上述した構成からなる本発明によれば、基本情報を解析することで得られた画像及び/又は文字列から、これに見合った顧客服飾品マッチング結果を即座に選択し、これを出力することができる。その結果、服飾品の小売店によるより正確な推薦、消費者によるより正確な選択を実現することに貢献する。According to the present invention having the above-described configuration, it is possible to immediately select and output a customer clothing matching result corresponding to the image and / or character string obtained by analyzing the basic information. it can. As a result, it contributes to more accurate recommendation by clothing retailers and more accurate selection by consumers.

以下、本発明を適用した顧客服飾品マッチングシステムについて、図面を参照しながら詳細に説明をする。Hereinafter, a customer clothing matching system to which the present invention is applied will be described in detail with reference to the drawings.

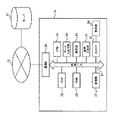

本発明を適用した顧客服飾品マッチングシステム1は、例えば図1に示すような構成により具現化される。この顧客服飾品マッチングシステム1は、システムを利用するユーザ用の携帯端末11と、この携帯端末11に対して公衆通信網12を介して接続されるサーバ13とを備えている。本実施形態におけるユーザとは、顧客に診断を依頼されたコンサルタント(スタイリスト、イメージコンサルタント等とも呼ばれる)及び/又は顧客及び/又は服飾品販売員である。A customer apparel matching system 1 to which the present invention is applied is embodied by, for example, a configuration as shown in FIG. The customer clothing matching system 1 includes a

公衆通信網12は、携帯端末11間及びサーバ13を通信回線を介して接続されるインターネット網等である。ちなみにこの携帯端末11を一定の狭いエリア内で運用する場合には、この公衆通信網12を、LAN(Local Area Network)で構成してもよい。また、この公衆通信網12につきいわゆる光ファイバ通信網で構成してもよい。また、この公衆通信網12は、有線通信網に限定されるものではなく、無線通信網で実現するようにしてもよい。The

携帯端末11は、例えば、携帯電話、スマートフォン、タブレット型端末、ウェアラブル端末、ノート型のパーソナルコンピュータ(PC)等であり、少なくともユーザの操作に基づいて公衆通信網12を介して通信可能なデバイスである。携帯端末11は、ユーザが携帯可能ととすることにより、常時持ち運びを可能とするデバイスであるが、これに限定されるものではなく、そえ置き型のPC等、あらゆる電子機器を含む概念である。The

なお、この携帯端末11は、後述する顧客服飾品マッチングプログラムを公衆通信網12を介してダウンロードすることなく、店頭で販売されているパッケージソフトをインストールする場合には、公衆通信網12を介した通信を行わない機器であってもよい。以下の例では、この携帯端末11につき、スマートフォンを適用する場合を例にとり説明をする。The

図2は、携帯端末11の具体的な構成例を示している。この携帯端末11は、ROM(Read Only Memory)22と、データの蓄積や展開等に使用する作業領域としてのRAM(Random Access Memory)23と、携帯端末11全体を制御するためのCPU(Central Processing Unit)24と、操作ボタンやキーボード等を介して各種制御用の指令を入力するための操作部25と、各種情報の表示を制御するための出力I/F16と、ハードディスク等に代表され、実行すべき検索を行うためのプログラムを格納するための記憶部27と、外部から携帯端末11内へデータを入力し、或いは携帯端末11において生成されたデータを外部へ出力するためのデータ入出力部29が内部バス21にそれぞれ接続されている。さらに、この内部バス21には、通信I/F28、音声入力部31が接続されている。また、出力I/F16には、実際に情報を表示するモニタとしての表示部26が接続されている。FIG. 2 shows a specific configuration example of the

ROM22は、携帯端末11全体のハードウェア資源を制御するためのプログラムが格納されている。RAM23は、携帯端末11全体のハードウェア資源を制御するときの各種命令を一時的に記憶する。The ROM 22 stores a program for controlling hardware resources of the entire

CPU24は、内部バス21を介して制御信号を送信することにより、携帯端末11内に実装された各構成要素を制御するためのいわゆる中央演算ユニットである。また、このCPU24は、操作部25を介したユーザの操作に応じて各種制御用の指令を内部バス21を介して伝達する。The

操作部25は、タッチパネル等で具体化され、ユーザが顧客又は服飾品に関する情報を入力する他、顧客服飾品マッチングプログラムを実行するための実行命令がユーザから入力される。この操作部25は、上記実行命令がユーザにより入力された場合には、これをCPU24に通知する。この通知を受けたCPU24は、上記プログラムを記憶部27から読み出して実行する。The

出力I/F16は、CPU24による制御に基づいて表示画像を作り出すグラフィックコントローラにより構成されている。この出力I/F16に接続される表示部26は、例えば、液晶ディスプレイ(LCD)等によって実現される。The output I / F 16 is configured by a graphic controller that creates a display image based on control by the

記憶部27は、ハードディスクで構成される場合において、CPU24による制御に基づき、各アドレスに対して所定の情報が書き込まれるとともに、必要に応じてこれが読み出される。また、この記憶部27には、本発明を実行するための顧客服飾品マッチングプログラムが格納されている。このプログラムはCPU24により読み出されて実行されることになる。When the

通信I/F28は、公衆通信網12と接続するための回線制御回路や、他の端末装置との間でデータ通信を行うための信号変換回路等が実装されている。通信I/F28は、内部バス21からの各種命令に変換処理を施してこれを公衆通信網12側へ送出するとともに、公衆通信網12からのデータを受信した場合にはこれに所定の変換処理を施して内部バス21、或いはCPU24へ送信する。The communication I / F 28 is mounted with a line control circuit for connecting to the

データ入出力部29は、PC等の電子機器との間でUSB接続するためのコード等が接続される。このデータ入出力部29を介して外部の機器との間でデータを入出力することが可能となる。The data input /

音声入力部31は、ユーザから入力された音声を電子データに変換するためのデバイスである。The

サーバ13には、所定のデータベースが構築されている。このデータベースには、公衆通信網12を介して送られてきた情報が蓄積される。また、このサーバ13は、携帯端末11からの要求に基づいて、この蓄積した情報を公衆通信網12を介して携帯端末11へと送信する。A predetermined database is constructed in the

なお、携帯端末11における何れか1以上の構成要素、或いはサーバ13は、人工知能により制御されるものであってもよい。本発明への人工知能の具体的な応用方法は、従来における全ての公知の人工知能に関する情報の何れか1以上に基づくものであってもよい。Note that any one or more components in the

本発明を適用した顧客服飾品マッチングシステム1は、携帯端末11内にインストールされた顧客服飾品マッチングプログラムを介して実行していくこととなる。即ち、ユーザは、携帯端末11を操作し、これにインストールされている顧客服飾品マッチングプログラムを通じ、顧客と服飾品をマッチングする。顧客服飾品マッチングプログラムは、携帯端末11にインストールして使用する場合に限定されるものではなく、サーバ13に記憶させておき、携帯端末11側から、使用の都度、サーバ13にアクセスして使用するようにしてもよいことは勿論である。The customer clothing matching system 1 to which the present invention is applied is executed through a customer clothing matching program installed in the

顧客服飾品マッチングにおいては、顧客又は服飾品に関する情報を、ユーザ自身が入力するところ又は他のプログラムを介して自動入力されるところ、から開始する。In the customer clothing matching, the information about the customer or the clothing is started from the place where the user himself / herself inputs or the information is automatically inputted through another program.

この入力される情報の例としては、顧客の情報の場合、画像、動画、そして、顧客のサイズ、首、胸板の厚み、手首の形状、鎖骨、ヒップなどの身体の特徴、肌、目、髪の毛などの色、自らの趣味趣向を表現したテキストデータ、並びに、現在の心理状況、将来の夢、重要な価値観などの心理的特徴を表現した画像及び/又はテキストデータ、並びに、現在所有している服飾品の下記に示されるデータ及びその利用実態に関するテキストデータ、そして、後述の顧客を分類した分類結果である。服飾品の情報の場合、画像、動画、そして、服飾品の種類、ブランド、サイズ、価格、生地、色、利用場面、服飾品のデザインの背景、良いところ等を表現したテキストデータ、そして、後述の服飾品を分類した分類結果である。このようにして入力された情報を、以下、基本情報という。Examples of this information include customer information, images, videos, customer size, neck, chest thickness, wrist shape, clavicle, hip and other body features, skin, eyes, hair Color data such as, text data that expresses hobbies and preferences, and image and / or text data that expresses psychological features such as current psychological situation, future dreams, and important values, and currently owned The data shown below and the text data on the actual use of the clothing items, and the classification results of classifying the customers described later. In the case of apparel information, images, videos, text data representing apparel types, brands, sizes, prices, fabrics, colors, usage scenes, apparel design backgrounds, good points, etc. It is the classification result which classified the clothing items. The information input in this way is hereinafter referred to as basic information.

前記分類結果は、例えば骨格診断理論における人物の分類結果、カラー診断理論における人物の分類結果、国際イメージコンサルタント連盟(AICI)が認める人物の分類結果、ファッションの種類の分類等、既に公知になっているあらゆる分類法を含む概念である。この顧客分類結果の例としては、例えば骨格診断理論における人物の分類結果であれば、ストレート、ウエーブ、ナチュラルに相当するものであり、ファッションの種類の分類であれば、その一例は、クラシック、モダン、マニッシュ、スポーティフ、アバンギャルド、エスニック、フェミニン、エレガント、クラッシックである。The classification results are already known, for example, the classification results of persons in skeletal diagnostic theory, the classification results of persons in color diagnosis theory, the classification results of persons recognized by the International Image Consultant Federation (AICI), the classification of fashion types, etc. It is a concept that includes all taxonomies. As an example of the customer classification result, for example, the classification result of a person in the skeletal diagnostic theory corresponds to straight, wave, and natural. For the classification of fashion type, an example is classic, modern Manish, sporty, avant-garde, ethnic, feminine, elegant, classic.

ユーザは、この基本情報の入力を携帯端末11における操作部25を介して手動で行い、又は音声入力部31を介して音声にて入力する。この入力において、他の携帯端末11やPC等の電子機器において作成した基本情報の全て又は一部をデータ入出力部29から入力するようにしてもよい。またユーザが他の携帯端末11やPC等の電子機器において作成したデータの全て又は一部を、公衆通信網12を介して実際に顧客服飾品マッチングプログラムがインストールされた携帯端末11に送信するようにしてもよい。このようにして送信又は入力された基本情報は、記憶部27に記憶されることとなる。The user manually inputs the basic information via the

特に前記心理的特徴を表現した画像及び/又はテキストデータの入手については、好みなどを聞き出す従来の手法とは異なり、顧客自身も認知していない潜在的な考え方や目指す姿を把握することができ有意義である。その画像及び/又はテキストデータの入手方法については公知の心理テストを用いて良く、必要な情報をもとにテストを選び、複数のテストの結果を併用することが望ましい。例えば、現在の顧客の状況、目指す将来の姿、現在から将来に至るまでに大切にしたい価値観、の三つに関する顧客の潜在的な考え方を把握するのに有意義な心理テストは、それぞれ、塗り絵テスト、コラージュテスト、バリューカードテストである。In particular, regarding the acquisition of images and / or text data that express the psychological features, unlike conventional methods that ask for preferences, etc., it is possible to grasp potential ideas and target figures that customers themselves do not recognize. Meaningful. As a method for obtaining the image and / or text data, a known psychological test may be used. It is desirable to select a test based on necessary information and use a plurality of test results in combination. For example, a psychological test that is meaningful for understanding the customer's potential thinking about the current customer situation, the future vision to be aimed at, and the values that we want to cherish from the present to the future, is a coloring book. Test, collage test, value card test.

テストの実施と、その結果のデータ化についての一例をあげる。各テストは操作部25にテストを表示する方法で行い、テストの性質上、顧客がこの操作部25を操作することで行われることが望ましい。塗り絵テストの場合は、操作部25に塗り絵の対象となる図柄を表示し、一般的な着色機能を用いて、ユーザが着色をする。コラージュテストにおいては、事前にユーザによって準備され記憶部27に記憶された画像、もしくは、インターネットなどで入手可能な画像を用い、一般的な切り抜き、貼り付けなどの機能を用いて行う。バリューカードテストは、事前に準備され記憶部27に保存される価値観の記された画像を提示し、一般的な画像移動機能を用いて行う。各テスト結果は、塗り絵テストにおいては、その色彩の種類と割合を文字列として、また、コラージュテストにおいては、その画像、及び、タグ付けされたキーワードを文字列として、バリューカードについては、選択された価値観とその優先順位を文字列として、データ化する。Here is an example of test execution and data conversion of the results. Each test is performed by displaying the test on the

前記所有している服飾品とその利用実績を表現したデータの利用については、好みなどを聞き出す、もしくは、購買履歴データのみを入手する従来の手法とは異なり、消費者自身も認知していない可能性もある実際の服飾品利用実態を把握することができ有意義である。このデータの入手方法については、似合った服を来た際に消費者が感じる「皆に見て欲しい」と言う気持ちを利用し、使い慣れているソーシャルネットワークへの写真や記事の投稿方法を模したインターフェイスを用意し、さらに、所持服飾品のタグ付けを手動、もしくは人工知能などを使って自動で行うようにし、さらに、実際に消費者の利用しているソーシャルネットワークへの投稿も可能にし、従来の利用実績の蓄積の方法と比較し、利便性を高める。投稿実績に応じてポイントを付与するなどの施策も有効である。Concerning the use of the data that expresses the possessed clothing and its usage results, it is possible that the consumer himself / herself is not aware of the preferences, or unlike the conventional method of obtaining only purchase history data It is meaningful to understand the actual use of clothing items. Regarding how to obtain this data, we used the feeling that consumers would like to see when they came to wear clothes that looked good, and imitated how to post photos and articles to familiar social networks. An interface is provided, and tagging of belongings can be done manually or automatically using artificial intelligence, etc., and posting to social networks actually used by consumers is also possible. Compared with the method of accumulating the usage record of, the convenience is enhanced. Measures such as giving points according to the posting results are also effective.

服飾品利用実態の把握と、その結果のデータ化についての一例をあげる。所持している服飾品のデータは、前記基本情報と同様に手動、もしくは、自動で入力され、記憶部27に記憶される。服飾品利用実績の入力は操作部25に前記インターフェイスを表示する方法で行われる。この服飾品利用実績は、毎回マッチングごとに入力するのではなく、過去の記録を記憶することが消費者の利便性向上の観点から望ましく、その際は、記憶部27、もしくは、サーバ13に記憶される。An example of grasping the actual use of clothing items and creating the data of the results will be given. The data of the clothing items possessed are input manually or automatically in the same manner as the basic information and stored in the

このようにして基本情報が入力された後に、実際に顧客服飾品マッチングプログラムが処理動作を実行していくこととなる。この顧客服飾品マッチングプログラムの処理動作フローを図4に示す。顧客服飾品マッチングプログラムは、ステップS11において入力された基本情報について解析を行う。(ステップS12)。この解析については、既存のあらゆるテキストマイニング技術、データマイニング技術、言語解析処理技術、画像解析処理技術等を用いるようにしてもよい。After the basic information is input in this way, the customer clothing matching program actually executes the processing operation. The processing operation flow of this customer clothing matching program is shown in FIG. The customer clothing matching program analyzes the basic information input in step S11. (Step S12). For this analysis, any existing text mining technology, data mining technology, language analysis processing technology, image analysis processing technology, or the like may be used.

次に、この顧客服飾品マッチングプログラムは、解析対象の基本情報のうち、テキストデータについては、単語、形態素、句、節等、あらゆる文法上の構造単位の中から何れか1以上の単位に亘り、文字列の抽出を行う。例えば、「骨太で鎖骨のあたりや手の骨もゴツゴツしていて気になっていて、いつも隠そうとしています」というテキストデータがあった場合には、「骨太」、「鎖骨」、「手」、「骨」、「ゴツゴツ」、「気になって」、「いつも」、「隠そう」等といった文字列を抽出することとなる。Next, this customer apparel matching program uses one or more units of all grammatical structural units such as words, morphemes, phrases, clauses, etc. for text data among the basic information to be analyzed. , Character string extraction. For example, if there is text data that says "I am worried because my bones are thick and my bones are clumsy and I am always worried about it," I am trying to hide it. ”,“ Bone ”,“ lumpy ”,“ interesting ”,“ always ”,“ let's hide ”, and the like.

或いは、この基本情報が断片的にキーワードや単語そのもので入力される場合もある。例えば「分厚い胸板」と入力された場合には、「分厚い」「胸板」という文字列を抽出することができる。また、この基本情報は、顧客の特徴が入力される以外に、その顧客が着用したい服飾品像が入力される場合がある。例えば、「自由なライフスタイルを追求する服」と入力される場合には、これをテキストマイニングにより解析することにより、「自由」「自由な」、「ライフ」、「スタイル」、「ライフスタイル」、「追求」等のように、文法上の構造単位の中から何れか1以上の単位に亘り、文字列の抽出が行われる。Alternatively, the basic information may be input as keywords or words in pieces. For example, when “thick chest plate” is input, the character strings “thick” and “chest plate” can be extracted. In addition to the customer's characteristics being input, the basic information may be input a clothing image that the customer wants to wear. For example, when “Clothes pursuing a free lifestyle” is input, by analyzing this by text mining, “Free”, “Free”, “Life”, “Style”, “Lifestyle” Like “Pursuit”, a character string is extracted from any one or more of grammatical structural units.

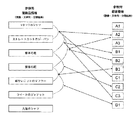

次に顧客服飾品マッチングプログラムは、ステップS13へ移行し、ステップS12において抽出した文字列及び面像群及び分類結果と、連関性の高い顧客服飾品マッチング結果の探索を開始する。この探索を行う前において、携帯端末11は、図5に示すように顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果の連関性を予め取得しておく。Next, the customer clothing matching program shifts to step S13, and starts searching for the character string, the face image group and the classification result extracted in step S12, and the highly correlated customer clothing matching result. Before performing this search, the

図5における、a11、b11、c11、・・・は、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果である。これに対し、A1、A2、A3、・・・は顧客に関する参照用画像及び/又は文字列及び/又は分類結果である。5, a11, b11, c11,... Are reference images and / or character strings and / or classification results related to clothing. On the other hand, A1, A2, A3,... Are reference images and / or character strings and / or classification results related to customers.

携帯端末11は、このような服飾品情報と顧客情報が互いにどの程度関連しているかの度合いを示す、連関性を取得しておく。この連関性の表現方法としては、例えば図5に示すような矢印で繋がっている服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果は、互いに連関しており、矢印で繋がっていない場合は、互いに連関していない形態で表現するようにしてもよい。例えば顧客に関する参照用画像及び/又は文字列及び/又は分類結果A2は、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果c11、a21には連関しているが、これ以外の顧客分類結果とは連関していないという形で表現するようにしてもよい。即ち、このケースでは、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果の連関の有無を真または偽の2値により、デジタル的に表現することとなる。The

これ以外の連関性の表現方法としては、アナログ的な表現方法を採用するようにしてもよい。例えば顧客に関する参照用画像及び/又は文字列及び/又は分類結果B3は、顧客に関する参照用画像及び/又は文字列及び/又は分類結果a21、b21には80%の割合で連関しており、更に顧客に関する参照用画像及び/又は文字列及び/又は分類結果c11が60%、顧客に関する参照用画像及び/又は文字列及び/又は分類結果b11が45%、顧客に関する参照用画像及び/又は文字列及び/又は分類結果c21が24%、顧客に関する参照用画像及び/又は文字列及び/又は分類結果a11が0%等の連関度として表現されていてもよい。An analog expression method may be adopted as a method for expressing other associations. For example, the reference image and / or the character string and / or the classification result B3 related to the customer are related to the reference image and / or the character string and / or the classification result a21 and b21 related to the customer at a rate of 80%, and Reference image and / or character string and / or classification result c11 related to customer is 60%, reference image and / or character string and / or classification result b11 related to customer is 45%, reference image and / or character string related to customer And / or the classification result c21 may be expressed as an association degree such as 24%, the reference image and / or character string related to the customer and / or the classification result a11 may be expressed as 0%.

また、顧客に関する参照用画像及び/又は文字列及び/又は分類結果が「会社役員」である場合には、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果として、「フォーマル」の顧客分類結果の連関度を90%等のように高く設定するようにしてもよい。In addition, when the reference image and / or character string and / or classification result relating to the customer is “company officer”, the reference image and / or character string and / or classification result relating to the apparel is “formal”. The relevance of the customer classification result may be set as high as 90%.

携帯端末11は、ステップS13の解析前までに、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果との連関性を自らの記憶部27等に記憶しておき、いつでも読み出せるようにしておく。このとき、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果との連関性を自らの記憶部27に記憶しない場合には、サーバ13に記憶させておき、実際にステップS13を実行する際にこのサーバ13にアクセスすることで実行するようにしてもよい。Prior to the analysis in step S13, the

ステップS13に移行後、顧客服飾品マッチングプログラムは、ステップS12において解析した基本情報から抽出した顧客又は服飾品に関する画像及び/又は文字列及び/又は分類結果から、顧客服飾品マッチング結果を1又は2以上に亘り選択する作業を行う。After shifting to step S13, the customer clothing matching program obtains the customer clothing matching result 1 or 2 from the image and / or character string and / or classification result related to the customer or clothing extracted from the basic information analyzed in step S12. The selection operation is performed as described above.

この基本情報から抽出した顧客又は服飾品に関する画像及び/又は文字列及び/又は分類結果から顧客服飾品マッチング結果の選択についても、予め取得した服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果との連関性を参照するようにしてもよい。例えば、基本情報から解析した文字列が「分厚い胸板」である場合には、参照用の顧客に関する画像及び/又は文字列及び/又は分類結果と服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との連関性を参照した場合、その「分厚い胸板」と連関性の高いのは「深いVネックのシャツ」である。このため、この解析した「分厚い胸板」という文字列に対して連関性の高い「深いVネックのシャツ」を顧客服飾品マッチング結果として探索することとなる。Regarding the selection of the customer clothing matching result from the image and / or character string and / or classification result extracted from this basic information, the reference image and / or character string and / or You may make it refer to the correlation of a classification result, the image for a reference regarding a customer, and / or a character string, and / or a classification result. For example, when the character string analyzed from the basic information is “thick chest plate”, the image and / or the character string and / or the reference image and / or the character string and / or the character string and / or the character string and / or the classification result for the reference customer. Or, when referring to the association with the classification result, it is the “deep V-neck shirt” that is highly associated with the “thick chest plate”. Therefore, a “deep V-neck shirt” that is highly related to the analyzed character string “thick chest plate” is searched as a customer clothing matching result.

また基本情報から解析した文字列が「銀行役員」である場合、全く同一の参照用文字列は無いものの、「会社役員」が参照用文字列として存在する場合には、これを参照し、顧客服飾品マッチング結果として「フォーマル」を探索してこれを提示するようにしてもよい。このように、基本情報からの画像及び/又は文字列及び/又は分類結果と参照用画像及び/又は文字列及び/又は分類結果が完全一致して無くても、この例のように「役員」のところで一部一致するものであれば、当該参照用画像及び/又は文字列及び/又は分類結果と連関性の高い顧客服飾品マッチング結果を探索するようにしてもよい。Also, if the character string analyzed from the basic information is “bank officer”, there is no identical reference character string, but if “company officer” exists as a reference character string, it will be referred to It is also possible to search for “formal” as the result of clothing matching and present it. In this way, even if the image and / or character string and / or classification result from the basic information and the reference image and / or character string and / or classification result do not completely match, the “officer” as in this example If there is a partial match, the customer clothing matching result that is highly related to the reference image and / or character string and / or classification result may be searched.

更に基本情報から解析した文字列が「取締役会」であり、これと完全一致又は一部一致する参照用文字列が仮に一つも無かった場合であっても、「会社役員」との間では、意味概念において類似性がある。この意味概念の類似性を予めシステム側において設定し、その類似性の高い参照用画像及び/又は文字列及び/又は分類結果と連関性の高い顧客服飾品マッチング結果を探索するようにしてもよい。Furthermore, the character string analyzed from the basic information is the “Board of Directors”, and even if there is no reference character string that completely or partially matches this, There are similarities in semantic concepts. The similarity of the semantic concept may be set in advance on the system side, and a customer clothing matching result that is highly related to the reference image and / or the character string and / or the classification result having a high similarity may be searched. .

即ち、この基本情報から解析した画像及び/又は文字列及び/又は分類結果は、参照用画像及び/又は文字列及び/又は分類結果と画像及び/又は文字列及び/又は分類結果が一部一致又は完全一致しているか否か、意味概念の類似性の度合いのみならず、基本情報からの画像及び/又は文字列及び/又は分類結果に対して何らかの対応関係がある参照用画像及び/又は文字列及び/又は分類結果であれば、その参照用画像及び/又は文字列及び/又は分類結果と連関性の高い顧客服飾品マッチング結果を探索するようにしてもよい。In other words, the image and / or character string and / or classification result analyzed from this basic information partially matches the reference image and / or character string and / or classification result with the image and / or character string and / or classification result. Or reference images and / or characters that have some correspondence to images and / or character strings and / or classification results from basic information as well as the degree of similarity of semantic concepts If the result is a column and / or classification result, a customer clothing matching result that is highly related to the reference image and / or character string and / or classification result may be searched.

上述した作業は、基本情報から解析した一つの文字列のみならず、他の複数の画像及び/又は文字列及び/又は分類結果についても同様に行っていくこととなる。その結果、一つの顧客服飾品マッチング結果のみならず、複数の顧客服飾品マッチング結果が選択される場合もある。The above-described work is performed not only on one character string analyzed from the basic information but also on a plurality of other images and / or character strings and / or classification results. As a result, not only one customer clothing matching result but also a plurality of customer clothing matching results may be selected.

解析した画像及び/又は文字列及び/又は分類結果と連関性のより高い顧客服飾品マッチング結果を判別する方法は、上述した方法に限定されるものではない。例えば、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果との間で予め連関度が設定されていてもよい。かかる場合には、顧客に関する参照用画像及び/又は文字列及び/又は分類結果としての「分厚い胸板」に対して、「深いVネックのシャツ」が84%、「丸首のシャツ」が25%、「タートルネックのセーター」が10%、「フォーマルなシャツ」が77%、「ポロシャツ」が43%等、予め服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果の間で連関度が設定されている。そして、基本情報から解析した画像及び/又は文字列及び/又は分類結果に応じて参照用文字列「分厚い胸板」が選択された場合には、上述した連関度の%の分だけ連関しているものと判断するようにしてもよい。そして連関度が所定の閾値以上の顧客分類結果を選択するようにしてもよい。The method of discriminating the customer clothing matching result that is more related to the analyzed image and / or character string and / or classification result is not limited to the method described above. For example, the degree of association may be set in advance between the reference image and / or character string and / or classification result related to clothing and the reference image and / or character string and / or classification result related to the customer. In such a case, 84% of the “deep V-neck shirt” and 25% of the “round neck shirt” with respect to the “thick chest plate” as the reference image and / or character string and / or classification result for the customer, “Turtleneck sweater” is 10%, “Formal shirt” is 77%, “Polo shirt” is 43%, etc. Reference images for clothing and / or character strings and / or classification results and reference images for customers An association degree is set between the character string and / or the classification result. When the reference character string “thick chest plate” is selected according to the image and / or character string analyzed from the basic information and / or the classification result, they are linked by the% of the above-mentioned relevance. You may make it judge. A customer classification result having an association degree equal to or higher than a predetermined threshold may be selected.

なお、この服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果との連関性のデータは、携帯端末11側においてダウンロードされているものであってもよいし、常時サーバ13に記憶させておき、必要に応じてサーバ13から読み出したり、携帯端末11にダウンロードするようにしてもよい。Note that the data on the association between the reference image and / or character string and / or classification result for the clothing item and the reference image and / or character string and / or classification result for the customer is downloaded on the

即ち、この顧客服飾品マッチングプログラムは、基本情報を解析することで得られた画像及び/又は文字列及び/又は分類結果から、これに見合った顧客服飾品マッチング結果を即座に選択し、これを出力することができる。顧客服飾品マッチング結果の出力は、出力I/F16を介して表示部26へ表示するようにしてもよいし、データ入出力部29を介して外部に送信してもよい。また顧客服飾品マッチング結果の出力は、通信I/F28を介して公衆通信網12からサーバ13へ記憶させるようにしてもよいし、他の携帯端末11へ送信するようにしてもよい。That is, this customer clothing matching program immediately selects a customer clothing matching result corresponding to the image and / or character string and / or classification result obtained by analyzing the basic information, and uses this. Can be output. The output of the customer clothing matching result may be displayed on the

ユーザはこのようにして出力された顧客服飾品マッチング結果をもとに、消費者に対して服飾品の推奨ができ、消費者はより正確な選択をすることができるようになる。The user can recommend clothing to the consumer based on the customer clothing matching result output in this way, and the consumer can make a more accurate selection.

上記推奨をさらに正確にするには、顧客及び服飾品の正確な分類が効果的である。本実施形態では、この顧客及び服飾品の分類は経験を積んだ人員によって作業が行われ、さらには、顧客と服飾品のカテゴリーの種類が一致するようにするか、カテゴリーの種類は一致しないものの、同じく経験を積んだ人員により作成され対応表により、分類結果が容易にマッチング可能な様に変換されるようにする。また、顧客服飾品マッチング結果を導き出すにあたり、画像及び/又は文字列及び/又は分類結果のうち、分類結果に重きをおき、他の画像、文字列の重要度を下げることもできる。To make the recommendations more accurate, accurate classification of customers and apparel is effective. In the present embodiment, this customer and apparel classification is performed by experienced personnel, and furthermore, the customer and apparel category types must match or the category types do not match. The classification results are converted so that they can be easily matched by the correspondence table created by the same experienced personnel. Moreover, in deriving the customer clothing matching result, it is possible to place importance on the classification result among the images and / or character strings and / or classification results, and to reduce the importance of other images and character strings.

上記顧客及び服飾品の分類については、上記の様に手動ではなく、人工知能などを使い、自動的に行われる様にすることが望ましい。The classification of the customer and the clothing is preferably performed automatically using artificial intelligence or the like, not manually as described above.

更に本発明によれば、基本情報から抽出された画像及び/又は文字列及び/又は分類結果、又は提案された顧客服飾品マッチング結果に基づいて具体的な服飾品のコーディネートを探索してこれを表示するようにしてもよい。或いは基本情報から抽出された画像及び/又は文字列及び/又は分類結果及び提案された顧客服飾品マッチング結果の双方に基づいて具体的なコーディネートを探索してこれを表示するようにしてもよい。何れの場合においても、これらの作業は人工知能を介して行うこととなる。Furthermore, according to the present invention, a search for specific clothing coordinates is performed based on the image and / or character string and / or classification result extracted from the basic information or the proposed customer clothing matching result. You may make it display. Or you may make it search for a specific coordination based on both the image extracted from basic information and / or a character string, and / or a classification result, and the proposed customer clothing matching result, and may display this. In any case, these operations are performed through artificial intelligence.

かかる場合において、顧客服飾品マッチング結果を参照し、これに対応する服飾品群の内、服飾品の種類(スカート、トップス等)が異なり、その他が同じかもしくは近い分類にある服飾品群が選ばれる。この探索をおこなうにあたり、携帯端末11は、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果とコーディネート結果との連関性を予め取得しておく。そして、上述の服飾品分類と同様の手法を用いてコーディネート結果を探索する。これにも人工知能をもちいることが可能である。In such a case, refer to the result of matching the customer's clothing items, and select the clothing item group that has the same or similar classification of the clothing items (skirts, tops, etc.) of the corresponding clothing item group. It is. In performing this search, the

次に、本発明を適用した顧客服飾品マッチングシステム1の他の実施の形態について説明をする。Next, another embodiment of the customer clothing matching system 1 to which the present invention is applied will be described.

図5の例では、あくまで一つの服飾品に関する参照用画像及び/又は文字列及び/又は分類結果に対して1又は2以上の顧客に関する参照用画像及び/又は文字列及び/又は分類結果の連関性を参照するものであるのに対して、図6の例では、複数の服飾品に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各顧客に関する参照用画像及び/又は文字列及び/又は分類結果との連関性を参照するものである。In the example of FIG. 5, reference images and / or character strings and / or classification results relating to one or more customers are associated with reference images and / or character strings and / or classification results related to one piece of clothing. In the example of FIG. 6, reference images and / or characters for each customer for a combination between a plurality of clothing items and / or character strings and / or classification results are used. Refers to associations with columns and / or classification results.

図6では、参照用文字列として、「Vネックのシャツ」、「ストレートカットのジーパン」、「表皮の靴」、「表皮の鞄」、「細かいニットのマフラー」、「ツイードのジャケット」、「丸首のシャツ」等があり、これらの組み合わせに対してそれぞれ顧客分類結果A1、A2、・・・が割り当てられている。実線がその連関性を示すものであり、点線はその組み合わせを示すものである。例えば、「Vネックのシャツ」と「ストレートカットのジーパン」とが互いに点線でつながっており、そこから実線が、A2、C1に伸びている。これは、「Vネックのシャツ」と「ストレートカットのジーパン」の組み合わせに対する連関性の高い顧客分類結果がA2、C1であることを示している。つまり参照用文字列が「Vネックのシャツ」のみであると、そのVネックのシャツが似合う顧客がマッチングされるのに対し、「Vネックのシャツ」と「ストレートカットのジーパン」が組み合わさると、この組み合わせが似合う顧客がマッチングされる。In FIG. 6, as reference character strings, “V-neck shirt”, “straight cut jeans”, “skin shoes”, “skin heels”, “fine knit scarf”, “tweed jacket”, “ Round neck shirts ", etc., and customer classification results A1, A2,... Are assigned to these combinations. A solid line indicates the association, and a dotted line indicates the combination. For example, “V-neck shirt” and “straight-cut jeans” are connected to each other by dotted lines, and solid lines extend from there to A2 and C1. This indicates that customer classification results having a high association with the combination of “V-neck shirt” and “straight cut jeans” are A2 and C1. In other words, if the reference character string is only “V-neck shirt”, customers who match the V-neck shirt are matched, whereas “V-neck shirt” and “straight-cut jeans” are combined. , Customers that match this combination are matched.

このような各服飾品に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する1以上の顧客に関する参照用画像及び/又は文字列及び/又は分類結果の連関性を上述した図5と同様に予め取得しておくことにより、実際に基本情報から解析した画像及び/又は文字列及び/又は分類結果から顧客服飾品マッチング結果を選択する際に、これを参照することが可能となる。特にこの参照用画像及び/又は文字列及び/又は分類結果単独よりも、これらを互いに組み合わせにより、意図している顧客服飾品マッチング結果をより絞り込むことができ、より正確な顧客服飾品マッチング結果を効果的に選択して提案することも可能となる。FIG. 5 illustrates the association of the reference image and / or the character string and / or the classification result with respect to one or more customers with respect to the combination between the reference image and / or the character string and / or the classification result with respect to each clothing item. By acquiring in advance in the same manner as above, it is possible to refer to this when selecting the customer clothing matching result from the image and / or character string and / or classification result actually analyzed from the basic information. . In particular, it is possible to further narrow down the intended customer clothing matching result by combining them with each other than the reference image and / or the character string and / or the classification result alone, and to obtain a more accurate customer clothing matching result. It is also possible to select and propose effectively.

実際にこの各服飾品に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する1以上の顧客に関する参照用画像及び/又は文字列及び/又は分類結果の連関性を参照する際には、基本情報から複数の画像及び/又は文字列及び/又は分類結果を抽出する。そして、この抽出した複数の画像及び/又は文字列及び/又は分類結果に応じた、複数の参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対して連関性が高い顧客服飾品マッチング結果を提案することとなる。かかる場合も上述と同様に、基本情報から解析した画像及び/又は文字列及び/又は分類結果は、参照用画像及び/又は文字列及び/又は分類結果と画像及び/又は文字が一部一致又は完全一致しているか否か、意味概念の類似性の度合いのみならず、基本情報からの画像及び/又は文字列及び/又は分類結果に対して何らかの対応関係がある参照用画像及び/又は文字列及び/又は分類結果であれば、その参照用画像及び/又は文字列及び/又は分類結果と連関性の高い顧客服飾品マッチング結果を探索するようにしてもよい。When referring to the relevance of one or more reference images and / or character strings and / or classification results to a combination between the reference images and / or character strings and / or classification results for each piece of clothing Extracts a plurality of images and / or character strings and / or classification results from the basic information. Then, the customer clothing items that are highly related to the combination of the plurality of reference images and / or character strings and / or classification results according to the extracted plurality of images and / or character strings and / or classification results. A matching result will be proposed. In such a case as well, as described above, the image and / or character string and / or classification result analyzed from the basic information may partially match the reference image and / or character string and / or classification result with the image and / or character. Reference images and / or character strings that have some correspondence to images and / or character strings and / or classification results from basic information, as well as whether or not they match completely, the degree of similarity of semantic concepts And if it is a classification result, you may make it search the customer's clothing matching result highly relevant with the reference image and / or character string and / or classification result.

このとき、複数の参照用文字列間の組み合わせは、名詞−動詞、名詞−形容詞、形容詞−動詞、名詞−名詞の何れかの組み合わせとされていてもよい。基本情報から文字列を抽出する際には、単語又は句として名詞−動詞、名詞−形容詞、形容詞−動詞、名詞−名詞の何れか1以上の組み合わせで構成される複数の文字列を抽出し、参照用文字列における同じ品詞の組み合わせを参照しながら顧客服飾品マッチング結果を探索するようにしてもよい。At this time, the combination between the reference character strings may be any combination of noun-verb, noun-adjective, adjective-verb, and noun-noun. When extracting a character string from basic information, a plurality of character strings composed of one or more combinations of noun-verb, noun-adjective, adjective-verb, and noun-noun as words or phrases are extracted, The customer clothing matching result may be searched while referring to the same part of speech combination in the reference character string.

また、サーバ13が人工知能により制御される場合には、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果との連関性を学習させるようにしてもよい。つまり、図5に示すような服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果との連関性、図6に示すような服飾品に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせと顧客に関する参照用画像及び/又は文字列及び/又は分類結果との連関性を人工知能による学習により随時更新していく。人工知能は、外部からサーバ13に対して公衆通信網12を介して提供された情報に基づいて学習を行う。このサーバ13に対して外部から提供される情報は、例えば本システムを使用する携帯端末11から送信されるものであってもよい。In addition, when the

携帯端末11により、本発明を適用した顧客服飾品マッチングプログラムが使用される結果、ユーザにより選択された服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果の関係、或いはユーザにより選択されなかった服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果の関係等、過去の履歴情報を携帯端末11側において記録しておく。そして、これら過去の履歴情報を携帯端末11からサーバ13へ送信する。サーバ13を制御する人工知能は、この送信されてきた過去の履歴情報に基づいて、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果との連関性を更新する。つまり、ユーザにより選択された服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果の関係については連関性を高く更新し、またユーザにより選択されなかった服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果の関係は連関性をより低く更新する。この更新については、ニューラルネットワーク等を利用してもよい。As a result of using the customer clothing matching program to which the present invention is applied by the

このような過去の履歴情報を、本システムを利用する全ての携帯端末11からサーバ13へ集められることにより、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果との連関性は、大量のデータに基づいて随時学習がなされ、よりユーザが受け入れ易く、また解決に最も近道となるような顧客服飾品マッチング結果を提供しやすくなる。By collecting such past history information from all the

サーバ13における服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と顧客に関する参照用画像及び/又は文字列及び/又は分類結果との連関性の学習を、携帯端末11側に実装した人工知能に行わせるようにしてもよいことは勿論である。Learning of the association between the reference image and / or character string and / or classification result related to clothing and the reference image and / or character string and / or classification result related to the customer in the

ちなみに、この人工知能が学習する上での外部からのデータは、上述した本システムを利用した携帯端末11の過去の履歴情報のみならず、公衆通信網を介して取得可能な全てのインターネット情報、ビッグデータを利用するものであってもよい。Incidentally, external data for learning by this artificial intelligence includes not only the past history information of the

例えば、「Vネックのシャツ」と「ストレートカットのジーパン」という2つの文字列をand条件でインターネットで検索した場合、ホームページが出てくる。そのホームページに記載されている画像及び/又は文字列情報を取得し、これを画像解析し、テキストマイニングすることで、いかなる顧客服飾品マッチング結果に対応するのかを人工知能により見出していく。For example, if two character strings “V-neck shirt” and “straight-cut jeans” are searched on the Internet under the AND condition, a home page appears. The image and / or character string information described in the homepage is acquired, image analysis is performed, and text mining is performed to find out what customer clothing matching result corresponds to using artificial intelligence.

また、本発明によれば、基本情報から解析した顧客又は服飾品に関する画像及び/又は文字列及び/又は分類結果と、それぞれの参照用画像及び/又は文字列及び/又は分類結果との対応関係を人工知能により学習させるようにしてもよい。この人工知能による学習は、携帯端末11側又はサーバ13側の何れにおいて実行するようにしてもよい。In addition, according to the present invention, the correspondence relationship between the image and / or character string and / or classification result related to the customer or clothing analyzed from the basic information and the respective reference image and / or character string and / or classification result May be learned by artificial intelligence. This learning by artificial intelligence may be executed on either the

基本情報から解析した顧客又は服飾品に関する画像及び/又は文字列及び/又は分類結果と、それぞれの参照用画像及び/又は文字列及び/又は分類結果との対応関係は、画像及び/又は文字が一部一致又は完全一致しているか否か以外に、意味概念の類似性の度合いについても、インターネットから取得した情報、或いは外部から読み込んだ文書から人工知能により学習させるようにしてもよい。例えば「骨太」と「ゴツゴツ」は、文言上は一致する所は無いものの一つのホームページ内、一つの文書内において共に出願する確率が高い場合には、意味概念が類似のものとして、新たに参照用文字列「骨太」に対応する文言として登録するようにしてもよい。The correspondence between images and / or character strings and / or classification results relating to customers or clothing analyzed from the basic information and the respective reference images and / or character strings and / or classification results is the relationship between images and / or characters. The degree of similarity of semantic concepts may be learned by artificial intelligence from information acquired from the Internet or from a document read from the outside, in addition to whether or not they partially match or completely match. For example, if you have a high probability of filing both within a single homepage and within a single document, “Bone” and “Rug” are newly referred to as having similar semantic concepts. It may be registered as a word corresponding to the character string “bone thick”.

また本発明によれば、ユーザに対して新たに基本情報の入力を促すプロセスを導入するようにしてもよい。この基本情報の入力の促進は、基本情報をマイニングすることで抽出した画像及び/又は文字列及び/又は分類結果、又はステップS13における顧客服飾品マッチング結果の探索結果に応じて行うようにしてもよい。Further, according to the present invention, a process for prompting the user to input basic information may be introduced. The input of the basic information is promoted according to the image and / or character string extracted by mining the basic information and / or the classification result, or the search result of the customer clothing matching result in step S13. Good.

例えば、基本情報から抽出した文字列が、単に「骨太」、「ゴツゴツ」のみであった場合、さらに情報を入手し特定しないと顧客服飾品マッチング結果が絞り込めない場合がある。かかる場合には、更なる基本情報の入力を促すようにしてもよい。For example, if the character strings extracted from the basic information are only “bone” and “lumpy”, the customer clothing matching result may not be narrowed down unless further information is obtained and specified. In such a case, input of further basic information may be prompted.

また、「骨太」、「鎖骨」、「手」、「骨」が基本情報から抽出できた場合には、顧客が骨太で鎖骨のみならず、手も骨感があることは読み取ることができる。特に図6に示すような複数の参照用文字列の組み合わせに対して連関性の高い顧客分類結果を絞り込む上で、どうしてもその解決課題に関する情報があると更に望ましい場合があるとする。かかる場合において、基本情報をマイニングした結果、適切な顧客服飾品マッチング結果が出てこなかった場合には、その結果を特定するために、更なる基本情報の入力を促すようにしてもよい。顧客服飾品マッチング結果に対応する画像及び/又は文字列の有無の判断は、例えば「色」、「シルエット」、「スタイル」等のグループ毎に、これらを示す画像及び/又は文字列を予め登録しておき、その登録した文字列と全部一致又は一部一致する画像及び/又は文字列が基本情報内にあるか否かを判断するようにしてもよい。また、分類結果については、必須の情報としても良い。Further, when “bone thick”, “clavicle”, “hand”, and “bone” can be extracted from the basic information, it can be read that the customer is thick and not only the clavicle but also the hand has a feeling of bone. In particular, when narrowing down a highly related customer classification result for a combination of a plurality of reference character strings as shown in FIG. In such a case, if an appropriate customer clothing matching result is not obtained as a result of mining the basic information, input of further basic information may be prompted in order to specify the result. The presence / absence of images and / or character strings corresponding to customer clothing matching results is pre-registered for each group such as “color”, “silhouette”, “style”, etc. In addition, it may be determined whether the basic information includes an image and / or character string that matches all or part of the registered character string. The classification result may be essential information.

また、ステップS13における顧客服飾品マッチングの結果、顧客がマッチング結果の中から服飾品を選択しなかった場合、又はマッチング結果に異論が出ている場合、もう少し詳細な情報の入力を促してもよい。Further, as a result of the customer clothing matching in step S13, if the customer does not select the clothing from the matching results, or if there is an objection to the matching result, input of more detailed information may be prompted. .

本発明においては、これらの判断を人工知能を介して実行するようにしてもよい。この入力の促進は、表示部26を介して表示することで実現するようにしてもよいし、図示しない音声出力部を介して音声により行うようにしてもよい。In the present invention, these determinations may be executed via artificial intelligence. This input promotion may be realized by displaying through the

1 顧客服飾品マッチングシステム

11 携帯端末

12 公衆通信網

13 サーバ

21 内部バス

22 ROM

23 RAM

24 CPU

25 操作部

26 表示部

27 記憶部

28 通信IF

29 データ入出力部

31 音声入力部DESCRIPTION OF SYMBOLS 1 Customer

23 RAM

24 CPU

25

29 Data input /

Claims (26)

音声入力又は手動入力又は自動入力により取得した顧客に関する画像及び/又は文字列及び/又は分類結果に応じた顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索手段とを備えること、

を特徴とする顧客服飾品マッチングシステム。Refer to a reference image and / or character string and / or classification result relating to a customer acquired in advance and a degree of association of three or more stages between a reference image and / or character string and / or classification result relating to clothing,

Customer-related images and / or character strings and / or classification results obtained by voice input, manual input, or automatic input, and / or character strings and / or classification results, and reference images regarding clothing And / or a search means for searching for one or more customer clothing matching results based on three or more levels of association with the character string and / or the classification result,

Customer clothing matching system.

音声入力又は手動入力又は自動入力により取得した服飾品に関する画像及び/又は文字列及び/又は分類結果に応じた服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と、顧客に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索手段とを備えること、

を特徴とする顧客服飾品マッチングシステム。Refer to a reference image and / or character string and / or classification result relating to a customer acquired in advance and a degree of association of three or more stages between a reference image and / or character string and / or classification result relating to clothing,

Reference images and / or character strings and / or classification results for clothing according to images and / or character strings and / or classification results obtained by voice input, manual input or automatic input, and reference for customers Search means for searching for one or more customer clothing matching results based on three or more levels of association with images and / or character strings and / or classification results;

Customer clothing matching system.

音声入力又は手動入力又は自動入力により取得した顧客に関する複数の画像及び/又は文字列及び/又は分類結果に応じた複数の顧客に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索手段とを備えること

を特徴とする顧客服飾品マッチングシステム。The relationship between the reference image and / or the character string and / or the classification result for each piece of clothing for the combination between the plurality of reference images and / or the character string and / or the classification result regarding the customer acquired in advance is three or more steps. Browse

For a combination of multiple images and / or character strings and / or classification images and / or reference images and / or character strings and / or classification results for a plurality of customers according to the results obtained by voice input or manual input or automatic input And a search means for searching for one or more customer clothing matching results based on three or more levels of relevance with reference images and / or character strings and / or classification results for each clothing item. Apparel matching system.

音声入力又は手動入力又は自動入力により取得した服飾品に関する複数の画像及び/又は文字列及び/又は分類結果に応じた複数の服飾品に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各顧客に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索手段とを備えること

を特徴とする顧客服飾品マッチングシステム。Refer to three or more levels of association with reference images and / or character strings and / or classification results related to clothing for a combination of a plurality of reference images and / or character strings and / or classification results related to customers acquired in advance. And

Between a plurality of images and / or character strings and / or classification images and / or character strings and / or classification results according to a plurality of clothing and / or character strings and / or classification results obtained by voice input or manual input or automatic input Search means for searching for one or more customer clothing matching results based on three or more levels of relevance with reference images and / or character strings and / or classification results for each customer for the combination Customer clothing matching system.

を特徴とする請求項1から4のうち何れか1項記載の顧客服飾品マッチングシステム。5. The customer clothing matching system according to claim 1, wherein the mining means and the search means are provided in a portable information terminal.

を特徴とする請求項1から4のうち何れか1項記載の顧客服飾品マッチングシステム。The customer clothing matching system according to any one of claims 1 to 4, wherein the mining means and / or the search means are controlled by artificial intelligence.

を特徴とする請求項5記載の顧客服飾品マッチングシステム。A server capable of wireless communication with the portable information terminal via a communication network, wherein the server records the relevance to be referred to and transmits it to the portable information terminal; The customer clothing matching system according to claim 5.

を特徴とする請求項7記載の顧客服飾品マッチングシステム。The server is controlled by artificial intelligence, and based on information provided from the outside, images and / or character strings and / or classification results for customers, images and / or character strings and / or classification results for clothing The customer clothing matching system according to claim 7, wherein learning is performed so that the relationship is reflected in the association degree to be referred to.

を特徴とする請求項7又は8記載の顧客服飾品マッチングシステム。The server is controlled by artificial intelligence, and the customer-related image and / or character string and / or classification result obtained by the voice input or manual input or automatic input, the reference image and / or character string and / or the customer 9. The customer clothing matching system according to claim 7 or 8, wherein a correspondence relationship with the classification result is learned.

を特徴とする請求項7又は8記載の顧客服飾品マッチングシステム。The server is controlled by artificial intelligence, and the image and / or character string and / or classification result related to the clothing acquired by the voice input or manual input or automatic input, the reference image and / or the character string related to the clothing, and 9. The customer clothing matching system according to claim 7 or 8, wherein a correspondence relationship with the classification result is learned.

を特徴とする請求項1から6のうち何れか1項記載の顧客服飾品マッチングシステム。The search means is controlled by artificial intelligence, and the relationship between the reference image and / or character string and / or classification result related to the customer selected by the user and the reference image and / or character string and / or classification result related to the clothing item 7. The customer clothing matching system according to claim 1, wherein the past history information is provided from outside and learning is performed so that the past history information is reflected in the relevance to be referred to.

を特徴とする請求項1から6のうち何れか1項記載の顧客服飾品マッチングシステム。The search means is controlled by artificial intelligence, and a plurality of images and / or character strings and / or classification results related to a customer acquired by voice input or manual input or automatic input, and a reference image and / or character string related to a customer and 7. The customer apparel matching system according to claim 1, wherein the correspondence relationship with the classification result is learned.

を特徴とする請求項1から6のうち何れか1項記載の顧客服飾品マッチングシステム。The search means is controlled by artificial intelligence, and a plurality of images and / or character strings and / or classification results relating to clothing items acquired by voice input, manual input or automatic input, and reference images and / or characters relating to clothing items. The customer clothing matching system according to any one of claims 1 to 6, wherein a correspondence relationship with a column and / or a classification result is learned.

を特徴とする請求項1から4項のうちいずれか1項記載の顧客服飾品マッチングシステム。The search means is controlled by artificial intelligence, and a plurality of images and / or character strings and / or classification results related to a customer acquired by voice input, manual input, or automatic input, and / or a reference image related to the searched clothing item 5. The customer clothing matching system according to claim 1, wherein coordinates of the clothing are searched based on a character string and / or a classification result and displayed.

を特徴とする請求項1から14のうち何れか1項記載の顧客服飾品マッチングシステム。A plurality of images and / or character strings and / or classification results relating to customers acquired by voice input, manual input or automatic input, and / or reference images and / or character strings and / or classification results relating to the searched clothing items The customer clothing matching system according to any one of claims 1 to 14, further comprising an input promoting unit that prompts the user to input information related to the customer.

を特徴とする請求項15記載の顧客服飾品マッチングシステム。16. The customer clothing matching system according to claim 15, wherein the input promoting means is controlled by artificial intelligence.

を特徴とする請求項1から16のうち何れか1項記載の顧客服飾品マッチングシステム。The customer according to any one of claims 1 to 16, wherein the search means uses a customer's desire at a deep psychological level and / or potential desire and / or values as customer information. Apparel matching system.

を特徴とする請求項1から17のうち何れか1項記載の顧客服飾品マッチングシステム。The above search means has an interface imitating the article posting means to social network sites etc. in order to grasp the customer's use status of clothing items, in addition to tagging means for possession items and actually one or more social items The customer clothing matching system according to any one of claims 1 to 17, further comprising means for posting to a network.

音声入力又は手動入力又は自動入力により取得した顧客に関する画像及び/又は文字列及び/又は分類結果に応じた顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を顧客服飾品マッチングシステムにより探索する探索ステップとを有すること、

を特徴とする顧客服飾品マッチング方法。Refer to a reference image and / or character string and / or classification result relating to a customer acquired in advance and a degree of association of three or more stages between a reference image and / or character string and / or classification result relating to clothing,

Customer-related images and / or character strings and / or classification results obtained by voice input, manual input, or automatic input, and / or character strings and / or classification results, and reference images regarding clothing And / or a search step of searching for one or more customer clothing matching results by the customer clothing matching system based on three or more levels of association with the character string and / or the classification result,

A customer clothing matching method characterized by:

音声入力又は手動入力又は自動入力により取得した服飾品に関する画像及び/又は文字列及び/又は分類結果に応じた服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と、顧客に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を顧客服飾品マッチングシステムにより探索する探索ステップとを有すること、

を特徴とする顧客服飾品マッチング方法。Refer to a reference image and / or character string and / or classification result relating to a customer acquired in advance and a degree of association of three or more stages between a reference image and / or character string and / or classification result relating to clothing,

Reference images and / or character strings and / or classification results for clothing according to images and / or character strings and / or classification results obtained by voice input, manual input or automatic input, and reference for customers A search step of searching for one or more customer clothing matching results by a customer clothing matching system based on three or more levels of association with images and / or character strings and / or classification results;

A customer clothing matching method characterized by:

音声入力又は手動入力又は自動入力により取得した顧客に関する複数の画像及び/又は文字列及び/又は分類結果に応じた複数の顧客に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を顧客服飾品マッチングシステムにより探索する探索ステップとを有すること、

を特徴とする顧客服飾品マッチング方法。The relationship between the reference image and / or the character string and / or the classification result for each piece of clothing for the combination between the plurality of reference images and / or the character string and / or the classification result regarding the customer acquired in advance is three or more steps. Browse

For a combination of multiple images and / or character strings and / or classification images and / or reference images and / or character strings and / or classification results for a plurality of customers according to the results obtained by voice input or manual input or automatic input A search step of searching for one or more customer clothing matching results by the customer clothing matching system based on three or more levels of relevance with reference images and / or character strings and / or classification results for each clothing about,

A customer clothing matching method characterized by:

音声入力又は手動入力又は自動入力により取得した服飾品に関する複数の画像及び/又は文字列及び/又は分類結果に応じた複数の服飾品に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各顧客に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を顧客服飾品マッチングシステムにより探索する探索ステップとを有すること、

を特徴とする顧客服飾品マッチング方法。Refer to three or more levels of association with reference images and / or character strings and / or classification results related to clothing for a combination of a plurality of reference images and / or character strings and / or classification results related to customers acquired in advance. And

Between a plurality of images and / or character strings and / or classification images and / or character strings and / or classification results according to a plurality of clothing and / or character strings and / or classification results obtained by voice input or manual input or automatic input A search step of searching for one or more customer clothing matching results by a customer clothing matching system based on three or more levels of association with reference images and / or character strings and / or classification results for each customer for the combination; Having

A customer clothing matching method characterized by:

音声入力又は手動入力又は自動入力により取得した顧客に関する画像及び/又は文字列及び/又は分類結果に応じた顧客に関する参照用画像及び/又は文字列及び/又は分類結果と、服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索ステップをコンピュータに実行させること、

を特徴とする顧客服飾品マッチングプログラム。Refer to a reference image and / or character string and / or classification result relating to a customer acquired in advance and a degree of association of three or more stages between a reference image and / or character string and / or classification result relating to clothing,

Customer-related images and / or character strings and / or classification results obtained by voice input, manual input, or automatic input, and / or character strings and / or classification results, and reference images regarding clothing And / or causing the computer to execute a search step for searching for one or more customer clothing matching results based on three or more levels of association with the character string and / or the classification result;

A customer clothing matching program.

音声入力又は手動入力又は自動入力により取得した服飾品に関する画像及び/又は文字列及び/又は分類結果に応じた服飾品に関する参照用画像及び/又は文字列及び/又は分類結果と、顧客に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索ステップをコンピュータに実行させること、

を特徴とする顧客服飾品マッチングプログラム。Refer to a reference image and / or character string and / or classification result relating to a customer acquired in advance and a degree of association of three or more stages between a reference image and / or character string and / or classification result relating to clothing,

Reference images and / or character strings and / or classification results for clothing according to images and / or character strings and / or classification results obtained by voice input, manual input or automatic input, and reference for customers Causing a computer to execute a search step for searching for one or more customer clothing matching results based on three or more levels of association with images and / or character strings and / or classification results;

A customer clothing matching program.

音声入力又は手動入力又は自動入力により取得した顧客に関する複数の画像及び/又は文字列及び/又は分類結果に応じた複数の顧客に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各服飾品に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索ステップをコンピュータに実行させること、

を特徴とする顧客服飾品マッチングプログラム。The relationship between the reference image and / or the character string and / or the classification result for each piece of clothing for the combination between the plurality of reference images and / or the character string and / or the classification result regarding the customer acquired in advance is three or more steps. Browse

For a combination of multiple images and / or character strings and / or classification images and / or reference images and / or character strings and / or classification results for a plurality of customers according to the results obtained by voice input or manual input or automatic input Causing the computer to execute a search step for searching for one or more customer clothing matching results based on three or more levels of relevance with reference images and / or character strings and / or classification results for each clothing item;

A customer clothing matching program.

音声入力又は手動入力又は自動入力により取得した服飾品に関する複数の画像及び/又は文字列及び/又は分類結果に応じた複数の服飾品に関する参照用画像及び/又は文字列及び/又は分類結果間の組み合わせに対する各顧客に関する参照用画像及び/又は文字列及び/又は分類結果との3段階以上の連関度に基づき、1以上の顧客服飾品マッチング結果を探索する探索ステップをコンピュータに実行させること、

を特徴とする顧客服飾品マッチングプログラム。Refer to three or more levels of association with reference images and / or character strings and / or classification results related to clothing for a combination of a plurality of reference images and / or character strings and / or classification results related to customers acquired in advance. And

Between a plurality of images and / or character strings and / or classification images and / or character strings and / or classification results according to a plurality of clothing and / or character strings and / or classification results obtained by voice input or manual input or automatic input Causing the computer to execute a search step for searching for one or more customer clothing matching results based on three or more levels of association with reference images and / or character strings and / or classification results for each customer for the combination;

A customer clothing matching program.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2017194654A JP2019057255A (en) | 2017-09-19 | 2017-09-19 | Customer ornament matching system |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2017194654A JP2019057255A (en) | 2017-09-19 | 2017-09-19 | Customer ornament matching system |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2019057255A true JP2019057255A (en) | 2019-04-11 |

Family

ID=66107717

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2017194654A Pending JP2019057255A (en) | 2017-09-19 | 2017-09-19 | Customer ornament matching system |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2019057255A (en) |

Cited By (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN111387719A (en) * | 2020-05-26 | 2020-07-10 | 宁波市成大机械研究所 | Lifting type intelligent wardrobe and using method thereof |

| JP2021009517A (en) * | 2019-06-28 | 2021-01-28 | パナソニックIpマネジメント株式会社 | Dress learning system, dress evaluation system, dress learning evaluation system, electron mirror, dress learning method, dress evaluation method, and program |

| JP2021039638A (en) * | 2019-09-05 | 2021-03-11 | Assest株式会社 | Estimation program for moving cost and system |

-

2017