JP2016535382A - 元の画像の低品質バージョン及びエピトミから元の画像の推定を構築する方法及び装置 - Google Patents

元の画像の低品質バージョン及びエピトミから元の画像の推定を構築する方法及び装置 Download PDFInfo

- Publication number

- JP2016535382A JP2016535382A JP2016550997A JP2016550997A JP2016535382A JP 2016535382 A JP2016535382 A JP 2016535382A JP 2016550997 A JP2016550997 A JP 2016550997A JP 2016550997 A JP2016550997 A JP 2016550997A JP 2016535382 A JP2016535382 A JP 2016535382A

- Authority

- JP

- Japan

- Prior art keywords

- patch

- original image

- image

- version

- low quality

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/146—Data rate or code amount at the encoder output

- H04N19/147—Data rate or code amount at the encoder output according to rate distortion criteria

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/176—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a block, e.g. a macroblock

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/189—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the adaptation method, adaptation tool or adaptation type used for the adaptive coding

- H04N19/19—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the adaptation method, adaptation tool or adaptation type used for the adaptive coding using optimisation based on Lagrange multipliers

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/30—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using hierarchical techniques, e.g. scalability

- H04N19/36—Scalability techniques involving formatting the layers as a function of picture distortion after decoding, e.g. signal-to-noise [SNR] scalability

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/44—Decoders specially adapted therefor, e.g. video decoders which are asymmetric with respect to the encoder

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/593—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving spatial prediction techniques

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/60—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding

- H04N19/61—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using transform coding in combination with predictive coding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/90—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using coding techniques not provided for in groups H04N19/10-H04N19/85, e.g. fractals

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/90—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using coding techniques not provided for in groups H04N19/10-H04N19/85, e.g. fractals

- H04N19/99—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using coding techniques not provided for in groups H04N19/10-H04N19/85, e.g. fractals involving fractal coding

Abstract

Description

- 前記元画像の低解像度バージョンを生成し;

- 画像の低解像度バージョンをエンコードし;

- 画像の低解像度バージョンをデコードし;及び

- 前記元画像の解像度に合致する解像度を有する前記元画像の低品質バージョンを得るために、デコードされた低解像度バージョンの画像を補間する;

ことにより、取得される。

- 少なくとも1つのパッチペアを有する辞書を取得する手段であって、各々のパッチペアは、第1パッチと呼ばれるエピトミのパッチと、第2パッチと呼ばれる前記元画像の低品質バージョンのパッチとを有し、パッチペアは、前記エピトミの各パッチについて、前記エピトミからのパッチと前記低品質画像からのものとをインプレースマッチングすることにより取り出される、手段;

- 前記元画像の低品質バージョンの各パッチについて、パッチペアの前記辞書のうちの少なくとも1つのパッチペアを選択する手段であって、各々のパッチペアは、前記元画像の低品質バージョンのパッチと選択されるパッチペアの第2パッチとに関わる基準に従って選択される、手段;

- 選択される前記少なくとも1つのパッチペアからマッピング関数を取得する手段;及び

- 前記マッピング関数を利用して、前記元画像の低品質バージョンのパッチを、最終的なパッチに投影する手段;を有する。

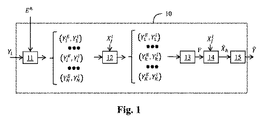

K個の選択されたパッチペアの第2パッチYk lを列の中に含む行列を、Mlとする。

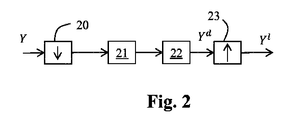

ステップ20において、元画像の低解像度バージョンが、ローパスフィルタリング及びダウンサンプリングを利用して生成される。典型的には、2であるダウンサンプリング因子が使用される。

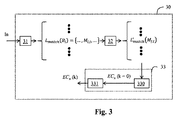

Ecur=Σi=1 nECiに含まれるテクスチャ情報及び拡張候補ΔEmにより構築される場合の画素当たりの平均予測誤差を示す。初期化サブステップ330で行われるように、画像ピクセルが、現在のエピトミによっても拡張候補ΔEmによっても影響を受けない場合、ゼロの値が指定される。評価基準(2)の第2項REcur+ΔEは、エピトミを構成する場合の画素当たりのレートに対応し、現在のエピトミEcur及びその拡張候補における画素数を画像In内の総画素数で除算したものとして大まかに推定される。

- 例えばディジタル信号プロセッサ(DSP)であるマイクロプロセッサ72(又はCPU);

- リードオンリメモリ(ROM)73;

- ランダムアクセスメモリ(RAM)74;

- データの受信、アプリケーションからの送信等のためのI/Oインターフェース75;及び

- バッテリ76。

Claims (12)

- 元画像の低品質バージョンと画像から算出されたエピトミとにより、元画像の推定を構築する方法であって:

少なくとも1つのパッチペアを有する辞書を取得するステップであって、各々のパッチペアは、第1パッチと呼ばれるエピトミのパッチと、第2パッチと呼ばれる前記元画像の低品質バージョンのパッチとを有し、パッチペアは、前記エピトミの各パッチについて、前記エピトミからのパッチと前記低品質バージョンからのものとをインプレースマッチングすることにより取り出される、ステップ;

前記元画像の低品質バージョンの各パッチについて、パッチペアの前記辞書のうちの少なくとも1つのパッチペアを選択するステップであって、各々のパッチペアは、前記元画像の低品質バージョンのパッチと選択されるパッチペアの第2パッチとに関わる基準に従って選択される、ステップ;

選択された前記少なくとも1つのパッチペアからマッピング関数を取得するステップ;及び

前記マッピング関数を利用して、前記元画像の低品質バージョンのパッチを、最終的なパッチに投影するステップ;

を有する方法。 - 前記最終的なパッチは或るピクセルで互いにオーバーラップする場合、前記方法は、前記元画像の推定のピクセル値を与えるために、或るピクセルで前記最終的なパッチを平均化するステップを更に有する、請求項1に記載の方法。

- 選択された前記少なくとも1つのパッチペアは、前記元画像の低品質バージョンのパッチのうち最も近い近隣である、請求項1又は2に記載の方法。

- 前記マッピング関数は、選択された前記少なくとも1つのパッチペアによる学習により取得される、請求項1ないし3のうち何れか一項に記載の方法。

- 前記マッピング関数の学習は、選択された前記少なくとも1つのパッチペアの前記第1パッチ及び前記第2パッチの間の最小二乗誤差を最小化することにより決定される、請求項4に記載の方法。

- 前記元画像の低品質バージョンは、前記元画像の解像度を有する画像である、請求項1ないし5のうち何れか一項に記載の方法。

- 前記元画像の低品質バージョンは:

前記元画像の低解像度バージョンを生成し;

画像の低解像度バージョンをエンコードし;

画像の低解像度バージョンをデコードし;及び

前記元画像の解像度に合致する解像度を有する前記元画像の低品質バージョンを得るために、デコードされた低解像度バージョンの画像を補間する;

ことにより、取得される請求項6に記載の方法。 - 前記エピトミは前記元画像から取得される、請求項1ないし7のうちの何れか一項に記載の方法。

- 前記エピトミは前記元画像の低解像度バージョンから取得される、請求項1ないし7のうちの何れか一項に記載の方法。

- 前記元画像の推定は低解像度画像空間に反復的に逆投影され、反復tにおける前記推定の逆投影されたバージョンは、前記元画像の低解像度バージョンと比較される、請求項1ないし9のうちの何れか一項に記載の方法。

- 前記辞書及び前記マッピング関数を取得するために使用される前記元画像の低品質バージョンは、前記元画像の現在の推定を低解像度画像空間に逆投影することにより、及び、反復tにおける前記現在の推定の逆投影されたバージョンと前記元画像の低解像度バージョンとの間で算出される誤差を前記現在の推定に加算することにより、反復的に更新される、請求項1ないし9のうちの何れか一項に記載の方法。

- 元画像の低品質バージョンと画像から算出されたエピトミとにより、元画像の推定を構築する装置であって:

少なくとも1つのパッチペアを有する辞書を取得する手段であって、各々のパッチペアは、第1パッチと呼ばれるエピトミのパッチと、第2パッチと呼ばれる前記元画像の低品質バージョンのパッチとを有し、パッチペアは、前記エピトミの各パッチについて、前記エピトミからのパッチと前記低品質画像からのものとをインプレースマッチングすることにより取り出される、手段;

前記元画像の低品質バージョンの各パッチについて、パッチペアの前記辞書のうちの少なくとも1つのパッチペアを選択する手段であって、各々のパッチペアは、前記元画像の低品質バージョンのパッチと選択されるパッチペアの第2パッチとに関わる基準に従って選択される、手段;

選択された前記少なくとも1つのパッチペアからマッピング関数を取得する手段;及び

前記マッピング関数を利用して、前記元画像の低品質バージョンのパッチを、最終的なパッチに投影する手段;

を有する装置。

Applications Claiming Priority (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP13290274.3 | 2013-11-08 | ||

| EP13290274 | 2013-11-08 | ||

| EP14305637.2 | 2014-04-29 | ||

| EP14305637.2A EP2941005A1 (en) | 2014-04-29 | 2014-04-29 | Method and apparatus for building an estimate of an original image from a low-quality version of the original image and an epitome |

| PCT/EP2014/073311 WO2015067518A1 (en) | 2013-11-08 | 2014-10-30 | Method and apparatus for building an estimate of an original image from a low-quality version of the original image and an epitome |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2016535382A true JP2016535382A (ja) | 2016-11-10 |

| JP2016535382A5 JP2016535382A5 (ja) | 2017-11-30 |

Family

ID=51844716

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2016550997A Pending JP2016535382A (ja) | 2013-11-08 | 2014-10-30 | 元の画像の低品質バージョン及びエピトミから元の画像の推定を構築する方法及び装置 |

Country Status (6)

| Country | Link |

|---|---|

| US (1) | US20160277745A1 (ja) |

| EP (1) | EP3066834A1 (ja) |

| JP (1) | JP2016535382A (ja) |

| KR (1) | KR20160078984A (ja) |

| CN (1) | CN105684449B (ja) |

| WO (1) | WO2015067518A1 (ja) |

Families Citing this family (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP3154021A1 (en) * | 2015-10-09 | 2017-04-12 | Thomson Licensing | Method and apparatus for de-noising an image using video epitome |

| US10296605B2 (en) * | 2015-12-14 | 2019-05-21 | Intel Corporation | Dictionary generation for example based image processing |

| WO2019088435A1 (ko) * | 2017-11-02 | 2019-05-09 | 삼성전자 주식회사 | 로우-퀄리티 부호화 모드에 따라 영상을 부호화하는 방법 및 장치, 및 영상을 복호화하는 방법 및 장치 |

| CN110856048B (zh) * | 2019-11-21 | 2021-10-08 | 北京达佳互联信息技术有限公司 | 视频修复方法、装置、设备及存储介质 |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2008009782A (ja) * | 2006-06-29 | 2008-01-17 | Toyota Motor Corp | 画像処理装置及び画像処理プログラム |

| JP2009219073A (ja) * | 2008-03-12 | 2009-09-24 | Nec Corp | 画像配信方法及びそのシステムと、サーバ、端末及びプログラム |

| JP2013021635A (ja) * | 2011-07-14 | 2013-01-31 | Sony Corp | 画像処理装置、画像処理方法、プログラム、及び記録媒体 |

| WO2013089265A1 (ja) * | 2011-12-12 | 2013-06-20 | 日本電気株式会社 | 辞書作成装置、画像処理装置、画像処理システム、辞書作成方法、画像処理方法及びプログラム |

Family Cites Families (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8204338B2 (en) * | 2008-02-14 | 2012-06-19 | Microsoft Corporation | Factoring repeated content within and among images |

| EP2666298A1 (en) * | 2011-01-21 | 2013-11-27 | Thomson Licensing | Method of coding an image epitome |

| US8675999B1 (en) * | 2012-09-28 | 2014-03-18 | Hong Kong Applied Science And Technology Research Institute Co., Ltd. | Apparatus, system, and method for multi-patch based super-resolution from an image |

-

2014

- 2014-10-30 CN CN201480060433.4A patent/CN105684449B/zh not_active Expired - Fee Related

- 2014-10-30 EP EP14792469.0A patent/EP3066834A1/en not_active Withdrawn

- 2014-10-30 JP JP2016550997A patent/JP2016535382A/ja active Pending

- 2014-10-30 WO PCT/EP2014/073311 patent/WO2015067518A1/en active Application Filing

- 2014-10-30 KR KR1020167011972A patent/KR20160078984A/ko not_active Application Discontinuation

- 2014-10-30 US US15/034,932 patent/US20160277745A1/en not_active Abandoned

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2008009782A (ja) * | 2006-06-29 | 2008-01-17 | Toyota Motor Corp | 画像処理装置及び画像処理プログラム |

| JP2009219073A (ja) * | 2008-03-12 | 2009-09-24 | Nec Corp | 画像配信方法及びそのシステムと、サーバ、端末及びプログラム |

| JP2013021635A (ja) * | 2011-07-14 | 2013-01-31 | Sony Corp | 画像処理装置、画像処理方法、プログラム、及び記録媒体 |

| WO2013089265A1 (ja) * | 2011-12-12 | 2013-06-20 | 日本電気株式会社 | 辞書作成装置、画像処理装置、画像処理システム、辞書作成方法、画像処理方法及びプログラム |

Non-Patent Citations (1)

| Title |

|---|

| YOAV HACOHEN; RAANAN FATTAL; DANI LISCHINSKI: "Image upsampling via texture hallucination", 2010 IEEE INTERNATIONAL CONFERENCE ON COMPUTATIONAL PHOTOGRAPHY (ICCP), JPN6018052304, 29 March 2010 (2010-03-29), US, ISSN: 0004086124 * |

Also Published As

| Publication number | Publication date |

|---|---|

| WO2015067518A1 (en) | 2015-05-14 |

| KR20160078984A (ko) | 2016-07-05 |

| CN105684449B (zh) | 2019-04-09 |

| EP3066834A1 (en) | 2016-09-14 |

| CN105684449A (zh) | 2016-06-15 |

| US20160277745A1 (en) | 2016-09-22 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| Minnen et al. | Joint autoregressive and hierarchical priors for learned image compression | |

| US10880551B2 (en) | Method and apparatus for applying deep learning techniques in video coding, restoration and video quality analysis (VQA) | |

| US11221990B2 (en) | Ultra-high compression of images based on deep learning | |

| US10623775B1 (en) | End-to-end video and image compression | |

| US20230075490A1 (en) | Lapran: a scalable laplacian pyramid reconstructive adversarial network for flexible compressive sensing reconstruction | |

| US11544606B2 (en) | Machine learning based video compression | |

| US20190098312A1 (en) | Image prediction method and related device | |

| Jamil et al. | Learning-driven lossy image compression: A comprehensive survey | |

| CN115375589B (zh) | 一种去除图像阴影模型及其构建方法、装置及应用 | |

| JP2016535382A (ja) | 元の画像の低品質バージョン及びエピトミから元の画像の推定を構築する方法及び装置 | |

| Manju et al. | AC coefficient and K‐means cuckoo optimisation algorithm‐based segmentation and compression of compound images | |

| Beygi et al. | An efficient algorithm for compression-based compressed sensing | |

| CN107231556B (zh) | 一种图像云储存设备 | |

| EP2941005A1 (en) | Method and apparatus for building an estimate of an original image from a low-quality version of the original image and an epitome | |

| Hou et al. | Low-latency compression of mocap data using learned spatial decorrelation transform | |

| US11895330B2 (en) | Neural network-based video compression with bit allocation | |

| US20230274467A1 (en) | Image encoding apparatus, image encoding method and program | |

| Turkan | Novel texture synthesis methods and their application to image prediction and image inpainting | |

| EP3046326A1 (en) | Method and device of construction of an epitome, coding and decoding methods and coding and decoding devices | |

| WO2024017173A1 (en) | Method, apparatus, and medium for visual data processing | |

| WO2023138687A1 (en) | Method, apparatus, and medium for data processing | |

| Yuan et al. | Image compression via sparse reconstruction | |

| WO2024083248A1 (en) | Method, apparatus, and medium for visual data processing | |

| WO2023138686A1 (en) | Method, apparatus, and medium for data processing | |

| WO2023165596A1 (en) | Method, apparatus, and medium for visual data processing |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20171023 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20171023 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20181126 |

|

| RD03 | Notification of appointment of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7423 Effective date: 20181220 |

|

| RD04 | Notification of resignation of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7424 Effective date: 20181227 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20190109 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20190731 |