JP2016528811A - マルチチャネル・オーディオ・デコーダ、マルチチャネル・オーディオ・エンコーダ、レンダリングされたオーディオ信号を使用する方法、コンピュータ・プログラムおよび符号化オーディオ表現 - Google Patents

マルチチャネル・オーディオ・デコーダ、マルチチャネル・オーディオ・エンコーダ、レンダリングされたオーディオ信号を使用する方法、コンピュータ・プログラムおよび符号化オーディオ表現 Download PDFInfo

- Publication number

- JP2016528811A JP2016528811A JP2016528443A JP2016528443A JP2016528811A JP 2016528811 A JP2016528811 A JP 2016528811A JP 2016528443 A JP2016528443 A JP 2016528443A JP 2016528443 A JP2016528443 A JP 2016528443A JP 2016528811 A JP2016528811 A JP 2016528811A

- Authority

- JP

- Japan

- Prior art keywords

- audio

- rendered

- signal

- channel

- signals

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S3/00—Systems employing more than two channels, e.g. quadraphonic

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L19/00—Speech or audio signals analysis-synthesis techniques for redundancy reduction, e.g. in vocoders; Coding or decoding of speech or audio signals, using source filter models or psychoacoustic analysis

- G10L19/008—Multichannel audio signal coding or decoding using interchannel correlation to reduce redundancy, e.g. joint-stereo, intensity-coding or matrixing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S3/00—Systems employing more than two channels, e.g. quadraphonic

- H04S3/008—Systems employing more than two channels, e.g. quadraphonic in which the audio signals are in digital form, i.e. employing more than two discrete digital channels

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S3/00—Systems employing more than two channels, e.g. quadraphonic

- H04S3/02—Systems employing more than two channels, e.g. quadraphonic of the matrix type, i.e. in which input signals are combined algebraically, e.g. after having been phase shifted with respect to each other

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S2400/00—Details of stereophonic systems covered by H04S but not provided for in its groups

- H04S2400/03—Aspects of down-mixing multi-channel audio to configurations with lower numbers of playback channels, e.g. 7.1 -> 5.1

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S2400/00—Details of stereophonic systems covered by H04S but not provided for in its groups

- H04S2400/11—Positioning of individual sound objects, e.g. moving airplane, within a sound field

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04S—STEREOPHONIC SYSTEMS

- H04S2420/00—Techniques used stereophonic systems covered by H04S but not provided for in its groups

- H04S2420/03—Application of parametric coding in stereophonic audio systems

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Acoustics & Sound (AREA)

- Signal Processing (AREA)

- Multimedia (AREA)

- Mathematical Physics (AREA)

- Audiology, Speech & Language Pathology (AREA)

- Human Computer Interaction (AREA)

- Computational Linguistics (AREA)

- Health & Medical Sciences (AREA)

- Algebra (AREA)

- General Physics & Mathematics (AREA)

- Mathematical Analysis (AREA)

- Mathematical Optimization (AREA)

- Pure & Applied Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Stereophonic System (AREA)

Abstract

Description

図1は、本発明の実施の形態によるマルチチャネル・オーディオ・デコーダ100のブロック概略図を示す。

図2は、本発明の実施の形態によるマルチチャネル・オーディオ・エンコーダ200のブロック概略図を示す。マルチチャネル・オーディオ・エンコーダ200は、2つ以上の入力オーディオ信号210,212を受信し、それに基づいて符号化表現214を供給するように構成される。マルチチャネル・オーディオ・エンコーダは、少なくとも2つ以上の入力オーディオ信号210,212に基づいて、1つ以上のダウンミックス信号222を供給するように構成されるダウンミックス信号プロバイダ220を含む。さらに、マルチチャネル・オーディオ・エンコーダ200は、少なくとも2つの入力オーディオ信号210,214の間の関係(例えば、相互相関、相互共分散、レベル差等)を記述している1つ以上のパラメータ232を供給するように構成されるパラメータ・プロバイダ230を含む。

図3は、符号化表現に基づいて少なくとも2つの出力オーディオ信号を供給するための方法300のフローチャートを示す。方法は、複数のレンダリングされたオーディオ信号を得るために、1つ以上のレンダリング・パラメータに基づいて得られた複数の復号化オーディオをレンダリングするステップ310を含む。方法300は、また、レンダリングされたオーディオ信号から1つ以上の非相関化オーディオ信号を導出するステップ320を含む。方法300は、また、出力オーディオ信号332を得るために、レンダリングされたオーディオ信号またはそのスケール化バージョンと1つ以上の非相関化オーディオ信号とを結合するステップ330を含む。

図4は、少なくとも2つの入力オーディオ信号に基づく符号化表現を供給するための方法400のフローチャートを示す。方法400は、少なくとも2つの入力オーディオ信号に基づく1つ以上のダウンミックス信号を供給するステップ410を含む。さらに、方法400は、少なくとも2つの入力オーディオ信号412の間の関係を記述している1つ以上のパラメータを供給するステップ420と、オーディオ・デコーダのサイドで使用される複数の非相関化モードのうちの非相関化モードを記述している非相関化方法パラメータを供給するステップ430とを含む。従って、好ましくは、1つ以上のダウンミックス信号の符号化表現、少なくとも2つの入力オーディオ信号の間の関係を記述している1つ以上のパラメータ、および非相関化方法パラメータを含む符号化表現432が供給される。

図5は、本発明の実施の形態による符号化オーディオ表現500の概略図を示す。

図6は、本発明の実施の形態によるマルチチャネル非相関器600のブロック概略図を示す。

図7は本発明の実施の形態によるマルチチャネル・オーディオ・デコーダ700のブロック概略図を示す。

図8は、本発明の実施の形態によるマルチチャネル・オーディオ・エンコーダ800のブロック概略図を示す。マルチチャネル・オーディオ・エンコーダ800は、少なくとも2つの入力オーディオ信号810,812を受信し、それに基づいて、入力オーディオ信号810,812によって表わされるオーディオ・コンテンツの符号化表現814を供給するように構成される。

図9は、複数の非相関器入力信号に基づいて、複数の非相関信号を供給するような方法900のフローチャートを示す。

図10は、符号化表現に基づいて少なくとも2つの出力オーディオ信号を供給するための方法1000のフローチャートを示す。

図11は、少なくとも2つの入力オーディオ信号に基づいて符号化表現を供給する方法1100のフローチャートを示す。

図12は、本発明の実施の形態による符号化オーディオ表現の概略図を示す。符号化オーディオ表現は、ダウンミックス信号の符号化表現1210、少なくとも2つの入力オーディオ信号の間の関係を記述している1つ以上のパラメータの符号化表現1220、およびオーディオ・デコーダのサイドにおいて使用される非相関化の複雑さを記述している符号化非相関化複雑さパラメータ1230を含む。従って、符号化オーディオ表現1200は、改良された復号化効率、および改良されたオーディオ品質または符号化効率とオーディオ品質とのトレードオフの改良の可能性をもたらすマルチチャネル・オーディオ・デコーダによって使用される非相関化の複雑さを調整することを許容する。さらに、符号化オーディオ表現1200は、本願明細書において記載されるようにマルチチャネル・オーディオ・エンコーダによって供給されえ、そして、本願明細書において記載されるようにマルチチャネル・オーディオ・エンコーダによって使用されうる点に留意されたい。従って、符号化オーディオ表現1200は、マルチチャネル・オーディオ・エンコーダに関しておよびマルチチャネル・オーディオ・デコーダに関して記載される特徴のいずれかによって補充されうる。

近年では、複数のオーディオ・オブジェクトを含んでいるオーディオ・シーンのビットレートの効果的な伝送/格納のためのパラメータの技術は、オーディオ符号化の分野(例えば、参考文献[BCC][JSC][SAOC][SAOC1][SAOC2]を参照)およびインフォームド(informed)音源分離の分野(例えば、参考文献[ISS1][ISS2][ISS3][ISS4][ISS5][ISS6]を参照)において提案されている。これらの技術は、伝送され/格納されたオーディオ・シーンおよび/またはオーディオ・シーンにおける音源オブジェクトを記述している追加のサイド情報に基づいて、所望の出力オーディオ・シーンまたはオーディオ音源オブジェクトを再構成することを意図する。この再構成は、パラメータのインフォームド音源分離を使用してデコーダにおいて生じる。さらに、参照は、例えば、国際標準ISO/IEC 23003−1:2007において記載されるいわゆる「MPEG Surround(MPEGサラウンド)」のコンセプトにもなされる。さらに、参照は、国際標準ISO/IEC 23003−2:2010において記載されるいわゆる「Spatial Audio Object Coding(空間オーディオ・オブジェクト符号化)」にもなされる。さらに、参照は、国際規格ISO/IEC 23003−3:2012において記載されるいわゆる「Unified Speech and Audio Coding(音声音響統合符号化方式)」にもなされる。これらの標準からのコンセプトは、例えば、本願明細書において記載されるマルチチャネル・オーディオ・エンコーダおよび本願明細書において記載されるマルチチャネル・オーディオ・デコーダにおいて、本発明による実施の形態において使用される。ここで、いくつかの適応は必要とされうる。

一般的なパラメータ分離システムは、(例えば、内部チャネル相関値、内部チャネルレベル差値、内部オブジェクト相関値および/またはオブジェクト・レベル差情報のような)補助的なパラメータ情報を使用して信号混合(ダウンミックス)からオーディオ音源の数を推定することを意図する。この作業の典型的な解決は、最小2乗平均誤差(Minimum Mean Squared Error:MMSE)推定アルゴリズムのアプリケーションに基づく。SAOC技術は、パラメトリックオーディオ符号化/復号化システムのような1つの実施例である。

不完全なパラメトリック再構成の場合、出力信号は、元のオブジェクトと比較して低いエネルギーを示しうる。共分散行列の対角要素の誤差は、(理想的な参照出力と比較して)聞き取れるレベル差、および歪められた空間音像における非対角要素での誤差を結果として得る。提案された方法は、この課題を解決するための目的を有する。

結論として、表記法に関する概要が提供された。さらに、パラメトリック分離システムは、本発明による実施の形態がベースであることが述べられた。さらに、最小2乗平均誤差推定に適用される直交原理が概説された。さらに、再構成誤差XErrorの存在において適用する共分散行列EXの算出のための方程式が提供された。また、例えば、本発明による実施の形態において、(パラメトリックサイド情報において含まれうる)内部オブジェクト相関値から所望の共分散特性(または相関特性)を導出し、そして、おそらくオブジェクト・レベル差を形成するために適用されうる、いわゆる内部オブジェクト相関および共分散行列EXの要素との間の関係が提供された。さらに、再構成オブジェクト信号の特性が、不完全な再構成のため、所望の特性と異なることが概説された。さらに、課題を取り扱う既存の解決策が、いくつかの特定の出力構成に限られており、従来の解決策の変更できない標準ブロックの特定の結合に依拠することが概説された。

14.1 コンセプトの概要

本発明による実施の形態は、任意の数のダウンミックス/アップミックスチャネルのための非相関化の解決策を有するパラメトリックオーディオ分離方式において使用されるMMSEパラメトリック再構成方法を拡張する。例えば、発明の装置および発明の方法のような本発明による実施の形態は、パラメトリック再構成の間のエネルギー損失を補償することができ、そして、推定されたオブジェクトの相関特性を復元しうる。

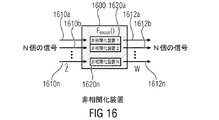

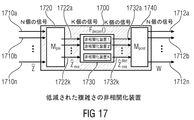

以下に、非相関器1590に関する若干の詳細が記載される。しかしながら、いくつか後述されるように、異なる非相関器が使用されうる点に留意されたい。

以下に、コンセプトが、合理的に良好な聴覚印象を得るように、出力オーディオ信号1552a〜1552nの共分散特性を調整することを記載している。

C=REXRH

として、定義される。

ES=VQVH,C=UTUH

として、例えば、特異値分解(SVD)を使用して表わされ、TおよびQは、それぞれCおよびESの特異値を有する対角行列であり、UおよびVは、特異ベクトルに対応するユニタリ行列である。

このセクションにおいて、前述の混合行列Fのための2つの変形例の構造は、その値を決定するための典型的なアルゴリズムとともに記載される。2つの変形例は、異なる入力コンテンツ(例えば、オーディオ・コンテンツ)のために設計される。

− 高い相関コンテンツ(例えば、異なるチャネル対の間の高い相関を伴うチャネル・ベースの入力)のための共分散調整方法

− 独立入力信号(例えば、たいてい独立とみなされる、オブジェクト・ベースの入力)のためのエネルギー補償方法

ΔE=UTUH,EW=VQVH

として、例えば、特異値分解(SVD)を使用して表わされ、TおよびQは、それぞれΔEおよびEWの特異値を有する対角行列であり、UおよびVは、対応する特異ベクトルを含むユニタリ行列である。

時々(アプリケーション・シナリオに応じて)、(例えば、レンダリングされたオーディオ信号の)パラメトリック再構成または非相関化信号の混合を許容することを望まないが、しかし、個々に、各パラメータ的に再構成された信号(例えば、レンダリングされたオーディオ信号)とそれ自身の非相関化信号のみを混合することが望ましい。

ここで、λDecは、出力信号(例えば、λDec=4)に加えられる非相関化の構成要素の量を制限するために用いられる0以上の閾値である。

以下に、混合行列F、セクション14.3および14.4において記載されているその導出は、低下を回避する必要性を満たすと説明される。

によって、与えられ、そして、所望の共分散行列は、

C=REXRH=DEXDH=EY

である。

混合行列Fを得るために、結合信号Sの共分散行列ESの情報が必要とされるか、または、少なくとも価値がある。

として、簡略化された形式を使用して表されうる。

として、推定される。

以下に、特に、有利なコンセプトが記載され、そして、それは、本願明細書において記載される他のコンセプトと組み合わされうる。

による設定によって、記載されうる。

以下に、本発明による実施の形態において使用される非相関器の複雑さがどのように低減されうるかが記載される。

SAOCデコーダ(または、さらに一般的にいえば、マルチチャネル・オーディオ・デコーダ)が、外部の第2のレンダラ/フォーマット変換器と共に使用される場合、以下において、提案されたコンセプト(方法または装置)に対する変更が、使用されうる。

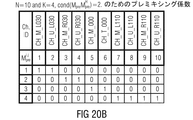

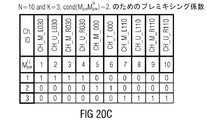

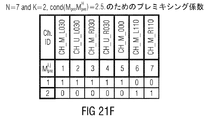

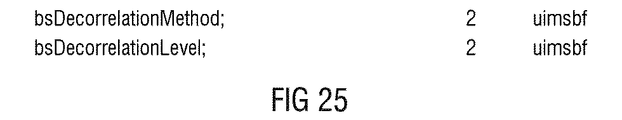

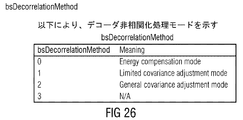

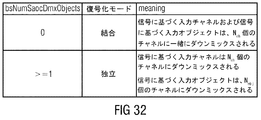

以下において、追加の信号伝達情報がビットストリームにおいて(または、オーディオ・コンテンツの符号化表現において、同等に)使用されうることが記載される。本発明による実施の形態において、非相関化の方法は、所望の品質レベルを確実にするためのビットストリームに信号を送信されうる。このような方法で、ユーザ(またはオーディオ・エンコーダ)は、コンテンツに基づいて方法を選択するように、より多くの柔軟性を有する。この目的のために、MPEG SAOCビットストリーム構文は、例えば、使用された非相関化の方法を特定するための2ビットおよび/または構造(または複雑さ)を特定するための2ビットによって延長されうる。

オーディオ・シーンの人間の認識のためのより大きな重要性である導かれた方法の目的のうちの1つが、オーディオ・キューを復元することである点に留意されたい。本発明による実施の形態は、エネルギーのレベルおよび相関特性の再構成の正確さを改良し、従って、最後の出力信号の知覚的なオーディオ品質を増加させる。本発明による実施の形態は、任意の数のダウンミックス/アップミックスチャネルのために適用されうる。さらに、本願明細書において記載される方法および装置は、既存のパラメータのソース分離アルゴリズムと結合されうる。本発明による実施の形態は、適用される非相関化の機能の数における設定の制約によってシステムの計算の複雑さを制御することを許容する。本発明による実施の形態は、MPSとトランスコーディング・ステップを取り除くことによって、SAOCのようなオブジェクト・ベースのパラメトリック構造アルゴリズムの簡略化に通じうる。

以下において、本発明によるコンセプトにおけるオーディオ符号化/復号化の環境が記載される。

プレレンダラ/ミキサ2910は、符号化前に、チャネルに加えて、オブジェクト入力シーンをチャネル・シーンに変換するために任意に使用されうる。機能的に、例えば、それは、後述するオブジェクト・レンダラ/ミキサと同一もありうる。

スピーカチャネル信号、個々のオブジェクト信号、オブジェクト・ダウンミックス信号およびプレレンダリングされた信号のための主要部のコーデック2930,3020は、MPEG−D USAC技術に基づく。それは、入力チャネルおよびオブジェクト割り当ての幾何学的および意味論的な情報に基づくチャネルおよびオブジェクト・マッピング情報による多数の信号の復号化を扱う。このマッピング情報は、どのように、入力チャネルおよびオブジェクトがUSACチャネル要素(CPE,SCE,LFE)にマッピングされるか、そして、対応する情報は、デコーダに送信されるかを記載する。

オブジェクト信号のためのSAOCエンコーダ2940およびSAOCデコーダ3060は、MPEG SAOC技術に基づく。システムは、送信されたチャネルおよび付加的なパラメータ・データ(オブジェクト・レベル差OLD、内部オブジェクト相関IOC、ダウンミックス・ゲインDMG)より少ない数に基づいて、オーディオ・オブジェクトの数を再形成し、修正し、そしてレンダリングすることができる。付加的なパラメータのデータは、復号化を非常に効率的にし、個々に、すべてのオブジェクトを送信するための必要であるより著しく低いデータレートを示す。SAOCエンコーダは、モノラル波形としてオブジェクト/チャネル信号を入力し、そして、(3Dオーディオ・ビットストリーム2932,3010に圧縮される)パラメトリック情報および(単一のチャネル要素を使用して符号化され、送信される)SAOCトランスポート・チャネルを出力する。SAOCデコーダ3000は、復号化SAOCトランスポート・チャネル3028およびパラメータの情報3030からオブジェクト/チャネル信号を再構成し、再構成レイアウト、展開されたオブジェクト・メタデータ情報およびユーザ相互作用情報のオプションに基づいて、出力オーディオ・シーンを生成する。

オブジェクト毎に、3D空間におけるオブジェクトの幾何学的な位置および量を特定する関連するメタデータは、時間および空間のオブジェクト特性の量子化によって、効率よく符号化される。圧縮されたオブジェクト・メタデータcOAM2954,3032は、サイド情報として受信機に送信される。

オブジェクト・レンダラは、所与の再構成フォーマットに従ってオブジェクト波形を生成するために、展開されたオブジェクト・メタデータOAM3044を利用する。各オブジェクトは、そのメタデータに従って、特定の出力チャネルにレンダリングされる。このブロックの出力は、部分的な結果の合計から結果を得る。

各入力チャネルが仮想音源によって表されるように、バイノーラル・レンダラ・モジュール3080は、マルチチャネル・オーディオ材料のバイノーラルのダウンミックスを生じる。処理は、QMF領域にフレームごとに実行される。バイノーラル化は、測定されたバイノーラルの部屋のインパルス応答に基づく。

スピーカ・レンダラ3090は、送信されたチャネル構成および所望の再生フォーマットとの間で変換する。以下において、それは、「フォーマット変換器」と呼ばれる。フォーマット変換器は、より少ない数の出力チャネルに変換する、すなわち、ダウンミックスを生成する。システムは、自動的に入出力フォーマットの所与の組み合わせのための最適化されたダウンミックス行列を生成して、ダウンミックス処理においてこれらの行列を適用する。フォーマット変換器は、標準のスピーカの構成と同様に、非標準のスピーカの位置を有するランダムな構成を許容する。

さらに、本願明細書において記載されたコンセプト、例えば、オーディオ・デコーダ100、オーディオ・エンコーダ200、マルチチャネル非相関器600、マルチチャネル・オーディオ・デコーダ700、オーディオ・エンコーダ800またはオーディオ・デコーダ1550が、オーディオ・エンコーダ2900および/またはオーディオ・デコーダ3000において使用されうる点に留意されたい。例えば、前述のオーディオ・エンコーダ/デコーダは、SAOCエンコーダ2940の一部としておよび/またはSAOCデコーダ3060の一部として使用されうる。一方、前述のコンセプトは、3Dオーディオ・デコーダ3000および/またはオーディオ・エンコーダ2900の他の位置でも使用されうる。

20.1 はじめに

以下において、本発明による他の実施の形態が、記載される。

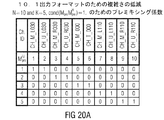

ISO/IEC 23003−1:2007に記載されているハイブリッド・フィルタバンクが適用される。DMG、OLD、IOCパラメータの逆量子化は、ISO/IEC 23003−2:2010の7.1.2において定義されるように同じ規則に従う。

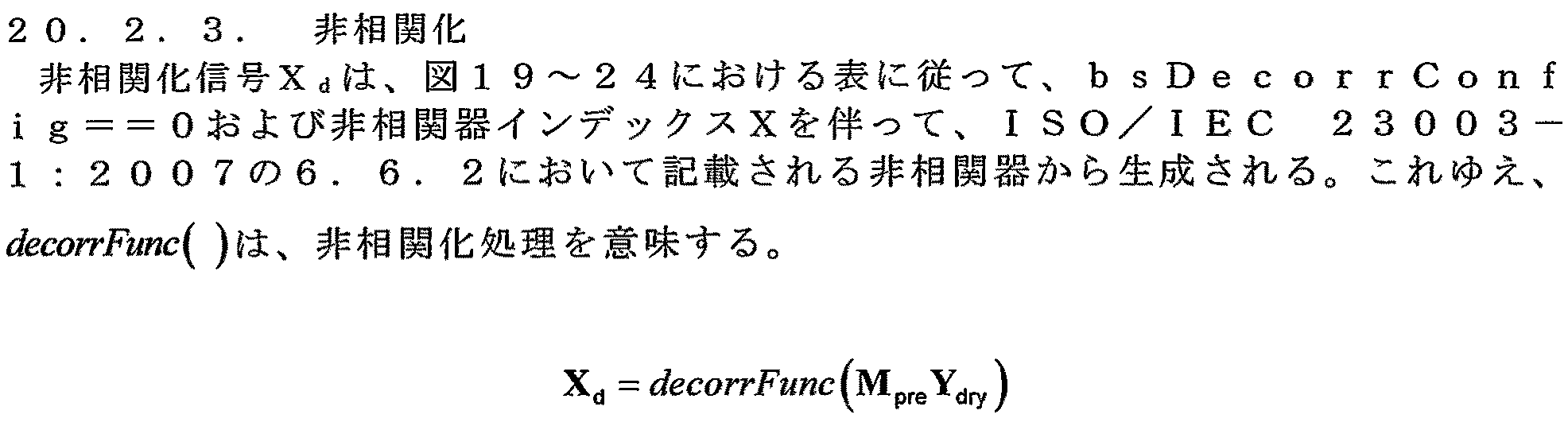

オーディオ信号は、あらゆる時間枠nおよびあらゆるハイブリッド・サブバンドkに対して定義される。対応するSAOC 3Dパラメータは、各パラメータ時間枠lおよび処理バンドmに対して定義される。ハイブリッドおよびパラメータ領域間の次のマッピングは、ISO/IEC 23003−1:2007の表A.31によって特定される。それゆえ、すべての計算は、特定の時間/バンド・インデックスに関して実行され、そして、対応する次元は、各導入変数に対して暗に定義される。

OLDi=DOLD(i,l,m),IOCi,j=DIOC(i,j,l,m)

として、得られる。

DMGi,j=DDMG(i,j,l)

として、得られる。

SAOC 3Dパラメータおよびレンダリング情報を用いて出力信号を得るための方法が記載される。SAOC 3Dデコーダは、例えば、SAOC 3Dパラメータ・プロセッサおよびSAOC 3Dダウンミックス・プロセッサから構成されうる。

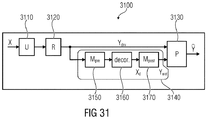

(ハイブリッドQMF領域において表される)ダウンミックス・プロセッサの出力信号は、SAOC 3Dデコーダの最後の出力を得ている、ISO/IEC 23003−1:2007において記載されるように、対応する合成フィルタバンクに供給される。ダウンミックス・プロセッサの詳細な構造は、図31において表現される。

結合復号化モードの場合において、パラメトリック・アンミキシング行列Uは、

U=ED*J

によって、与えられる。

エネルギー補償モードは、パラメトリック再構成においてエネルギーの損失に対して補償するために、非相関化信号を使用する。混合行列PdryおよびPwetは、

によって、与えられる。

ここで、λDec=4は、出力信号に加えられる非相関化要素の量を制限するために使用される定数である。

更なる概念および付加的な詳細に関して、参照は、セクション20.2.4.2〜20.2.4.4にもなされる。

異なる表記法が本出願の範囲内で用いられる点に留意する点に留意されたい。一方、特定の方程式に適用される表記法は、前後関係から明確である。

いくつかの態様が、装置との関連で記載されるが、これらの態様も、対応する方法の説明を表わすことは明らかであり、ブロックあるいは装置は、方法のステップ、または方法のステップの特徴に対応する。類似して、方法のステップとの関連で記載される態様は、装置に対応する、ブロック、アイテムまたは特徴の説明を表す。方法のステップのいくつかまたは全ては、たとえば、マイクロプロセッサ、プログラム可能なコンピュータ、または電子回路のようなハードウェアによって(または使用して)実行されうる。いくつかの実施の形態において、最も重要な方法のステップの1つ以上は、この種の装置によって実行されうる。

[BCC] C. Faller and F. Baumgarte, "Binaural Cue Coding - Part II: Schemes and applications," IEEE Trans. on Speech and Audio Proc., vol. 11, no. 6, Nov. 2003.

[Blauert] J. Blauert, "Spatial Hearing - The Psychophysics of Human Sound Localization", Revised Edition, The MIT Press, London, 1997.

[JSC] C. Faller, "Parametric Joint-Coding of Audio Sources", 120th AES Convention, Paris, 2006.

[ISS1] M. Parvaix and L. Girin: "Informed Source Separation of underdetermined instantaneous Stereo Mixtures using Source Index Embedding", IEEE ICASSP, 2010.

[ISS2] M. Parvaix, L. Girin, J.-M. Brossier: "A watermarking-based method for informed source separation of audio signals with a single sensor", IEEE Transactions on Audio, Speech and Language Processing, 2010.

[ISS3] A. Liutkus and J. Pinel and R. Badeau and L. Girin and G. Richard: "Informed source separation through spectrogram coding and data embedding", Signal Processing Journal, 2011.

[ISS4] A. Ozerov, A. Liutkus, R. Badeau, G. Richard: "Informed source separation: source coding meets source separation", IEEE Workshop on Applications of Signal Processing to Audio and Acoustics, 2011.

[ISS5] S. Zhang and L. Girin: "An Informed Source Separation System for Speech Signals", INTERSPEECH, 2011.

[ISS6] L. Girin and J. Pinel: "Informed Audio Source Separation from Compressed Linear Stereo Mixtures", AES 42nd International Conference: Semantic Audio, 2011.

[MPS] ISO/IEC, "Information technology - MPEG audio technologies - Part 1: MPEG Surround," ISO/IEC JTC1/SC29/WG11 (MPEG) international Standard 23003-1:2006.

[OCD] J. Vilkamo, T. Baeckstroem, and A. Kuntz. "Optimized covariance domain framework for time-frequency processing of spatial audio", Journal of the Audio Engineering Society, 2013. in press.

[SAOC1] J. Herre, S. Disch, J. Hilpert, O. Hellmuth: "From SAC To SAOC - Recent Developments in Parametric Coding of Spatial Audio", 22nd Regional UK AES Conference, Cambridge, UK, April 2007.

[SAOC2] J. Engdegard, B. Resch, C. Falch, O. Hellmuth, J. Hilpert, A. Hoelzer, L. Terentiev, J. Breebaart, J. Koppens, E. Schuijers and W. Oomen: " Spatial Audio Object Coding (SAOC) - The Upcoming MPEG Standard on Parametric Object Based Audio Coding", 124th AES Convention, Amsterdam 2008.

[SAOC] ISO/IEC, "MPEG audio technologies - Part 2: Spatial Audio Object Coding (SAOC)," ISO/IEC JTC1/SC29/WG11 (MPEG) International Standard 23003-2.

International Patent No. WO/2006/026452, "MULTICHANNEL DECORRELATION IN SPATIAL AUDIO CODING" issued on 9 March 2006.

Claims (49)

- 符号化表現(110;710;1516a;1516b;1518)に基づいて、少なくとも2つの出力オーディオ信号(112,114;712,714;1552a−1552n;3012)を供給するためのマルチチャネル・オーディオ・デコーダ(100;700;1550;3000)であって、

前記マルチチャネル・オーディオ・デコーダは、前記レンダリングされたオーディオ信号から1つ以上の非相関化オーディオ信号(142,144;1592a−1592n)を導出する(140;1590)ように構成され、

前記マルチチャネル・オーディオ・デコーダは、前記出力オーディオ信号を得るために、前記レンダリングされたオーディオ信号またはそのスケール化バージョンと前記1つ以上の非相関化オーディオ信号とを結合する(150;1598)ように構成される、マルチチャネル・オーディオ・デコーダ。 - 前記マルチチャネル・オーディオ・デコーダは、パラメトリック再構成(120;1560)を使用して、前記複数のレンダリングされたオーディオ信号を得るためにレンダリングされた前記復号化されたオーディオ信号を得るように構成される、請求項1に記載のマルチチャネル・オーディオ・デコーダ。

- 前記復号化オーディオ信号は、再構成オブジェクト信号であり、

前記マルチチャネル・オーディオ・デコーダは、サイド情報(1518)を使用して、1つ以上のダウンミックス信号(1516a,1516b)から前記再構成オブジェクト信号を導出するように構成される、請求項2に記載のマルチチャネル・オーディオ・デコーダ。 - 前記マルチチャネル・オーディオ・デコーダは、前記サイド情報からアンミキシング係数を導出し、前記アンミキシング係数を使用して、前記1つ以上のダウンミックス信号から前記再構成オブジェクト信号を導出するための前記アンミキシング係数を適用するように構成される、請求項3に記載のマルチチャネル・オーディオ・デコーダ。

- 前記マルチチャネル・オーディオ・デコーダは、前記出力オーディオ信号の所望の相関特性または共分散特性を少なくとも部分的に達成するように、前記レンダリングされたオーディオ信号と前記1つ以上の非相関化オーディオ信号とを結合するように構成される、請求項1ないし請求項4のいずれかに記載のマルチチャネル・オーディオ・デコーダ。

- 前記マルチチャネル・オーディオ・デコーダは、前記複数のレンダリングされたオーディオ信号を得るためにレンダリングされた前記復号化オーディオ信号(122;1562a−1562n)のパラメトリック再構成(120;1560)の間のエネルギー損失のために少なくとも部分的に補償するように、前記レンダリングされたオーディオ信号と前記1つ以上の非相関化オーディオ信号とを結合するように構成される、請求項1ないし請求項5のいずれかに記載のマルチチャネル・オーディオ・デコーダ。

- 前記マルチチャネル・オーディオ・デコーダは、前記出力オーディオ信号の所望の相関特性または所望の共分散特性を決定するように構成され、

前記得られた出力オーディオ信号の相関特性または共分散特性が、前記所望の相関特性または所望の共分散特性(C)に近似するかまたは等しいように、前記マルチチャネル・オーディオ・デコーダは、前記出力オーディオ信号を得るために、前記レンダリングされたオーディオ信号と前記1つ以上の非相関化オーディオ信号との結合(150;1598)を調整するように構成される、請求項1ないし請求項6のいずれかに記載のマルチチャネル・オーディオ・デコーダ。 - 前記マルチチャネル・オーディオ・デコーダは、複数のオーディオ・オブジェクトの特性および/または複数のオーディオ・オブジェクトの間における関係を記述しているオブジェクト相関情報またはオブジェクト共分散情報(EX)に基づいて、前記所望の相関特性または所望の共分散特性(C)を決定するように構成される、請求項7または請求項8に記載のマルチチャネル・オーディオ・デコーダ。

- 前記マルチチャネル・オーディオ・デコーダは、前記符号化表現に含まれるサイド情報(1518)に基づいて、前記オブジェクト相関情報またはオブジェクト共分散情報(EX)を決定するように構成される、請求項9に記載のマルチチャネル・オーディオ・デコーダ。

- 前記マルチチャネル・オーディオ・デコーダは、前記レンダリングされたオーディオ信号および前記1つ以上の非相関化オーディオ信号の現実の相関特性または共分散特性(ES)を決定するように、および

前記レンダリングされたオーディオ信号および前記1つ以上の非相関化オーディオ信号の前記現実の相関特性または共分散特性(ES)に基づいて、前記出力オーディオ信号を得るために、前記レンダリングされたオーディオ信号と前記1つ以上の非相関化オーディオ信号との結合(150;1598)を調整するように構成される、請求項7ないし請求項10のいずれかに記載のマルチチャネル・オーディオ・デコーダ。 - 前記マルチチャネル・オーディオ・デコーダは、前記混合行列Pおよび前記混合行列Mを一緒に算出するように構成される、請求項12または請求項13に記載のマルチチャネル・オーディオ・デコーダ。

- 前記マルチチャネル・オーディオ・デコーダは、前記混合行列Pおよび前記混合行列Mを一緒に算出するように構成される、請求項17または請求項18に記載のマルチチャネル・オーディオ・デコーダ。

- 前記マルチチャネル・オーディオ・デコーダは、前記出力オーディオ信号に前記レンダリングされたオーディオ信号の貢献が制限されるように、前記第1の相関マトリックスを決定するように構成され、および/または

前記マルチチャネル・オーディオ・デコーダは、前記出力オーディオ信号に前記非相関化オーディオ信号の貢献が制限されるように、前記第2の相関マトリックスを決定するように構成される、請求項17ないし請求項21のいずれかに記載のマルチチャネル・オーディオ・デコーダ。 - 前記マルチチャネル・オーディオ・デコーダは、前記出力オーディオ信号に前記レンダリングされたオーディオ信号の貢献が制限されるように、前記レンダリングされたオーディオ信号の特性に基づいて、および/または、前記非相関化オーディオ信号の特性に基づいて、および/または、所望の出力オーディオ信号の特性に基づいて、および/または、混合されレンダリングされたオーディオ信号の推定された特性に基づいて、および/または、混合された非相関化オーディオ信号の推定された特性に基づいて、前記第1の相関マトリックスを決定するように構成され、および/または

前記マルチチャネル・オーディオ・デコーダは、前記出力オーディオ信号に前記非相関化オーディオ信号の貢献が制限されるように、前記レンダリングされたオーディオ信号の特性に基づいて、および/または、前記非相関化オーディオ信号の特性に基づいて、および/または、所望の出力オーディオ信号の特性に基づいて、および/または、混合されレンダリングされたオーディオ信号の推定された特性に基づいて、および/または、混合された非相関化オーディオ信号の推定された特性に基づいて、前記第2の相関マトリックスを決定するように構成される、請求項17ないし請求項22のいずれかに記載のマルチチャネル・オーディオ・デコーダ。 - 前記レンダリングされたオーディオ信号、および/または、前記非相関化オーディオ信号、および/または、前記所望の出力オーディオ信号、および/または、前記混合されレンダリングされたオーディオ信号、および/または、前記混合された非相関化オーディオ信号の前記特性は、エネルギー特性、または、相関特性、または、共分散特性である、請求項23に記載のマルチチャネル・オーディオ・デコーダ。

- 前記閾値は、予め定められた固定閾値であるか、または、前記閾値は、たとえば、エネルギー特性、相関特性、および/または共分散特性のような信号特性に基づく時間変数、および/または周波数変数である、請求項25に記載のマルチチャネル・オーディオ・デコーダ。

- 前記マルチチャネル・オーディオ・デコーダは、単位行列であるか、またはその倍数である混合行列Pを設定し、そして、前記混合行列Mを算出するように構成される、請求項12または請求項13に記載のマルチチャネル・オーディオ・デコーダ。

- 前記マルチチャネル・オーディオ・デコーダは、所与のレンダリングされたオーディオ信号が、前記所与のレンダリングされたオーディオ信号自身の非相関化バージョンとともに混合されるのみという制約のもとに、前記混合行列P,Mを決定するように構成される、請求項12または請求項13に記載のマルチチャネル・オーディオ・デコーダ。

- 相互相関値または相互共分散値が不変である間、レンダリングされたオーディオ信号の自己相関値のみまたは自己共分散値のみが修正されるように、前記マルチチャネル・オーディオ・デコーダは、前記レンダリングされたオーディオ信号と前記1つ以上の非相関化オーディオ信号とを結合するように構成される、請求項12または請求項13または請求項32に記載のマルチチャネル・オーディオ・デコーダ。

- 前記マルチチャネル・オーディオ・デコーダは、単位行列であるか、またはその倍数である前記混合行列Pを設定し、そして、Mが対角行列であるという制限のもと、前記混合行列Mを算出するように構成される、請求項12または請求項13または請求項32または請求項33に記載のマルチチャネル・オーディオ・デコーダ。

- 前記レンダリングされたオーディオ信号またはそのスケール化バージョンと前記1つ以上の非相関化オーディオ信号とを結合するための方法を決定する場合、前記マルチチャネル・オーディオ・デコーダは、前記非相関化オーディオ信号の相関特性または共分散特性を考慮するように構成される、請求項1ないし請求項36のいずれかに記載のマルチチャネル・オーディオ・デコーダ。

- 所与の出力オーディオ信号が2つ以上のレンダリングされたオーディオ信号および少なくとも1つの非相関化オーディオ信号に基づいて供給されるように、前記マルチチャネル・オーディオ・デコーダは、レンダリングされたオーディオ信号と非相関化オーディオ信号とを混合するように構成される、請求項1ないし請求項28、または請求項37のいずれかに記載のマルチチャネル・オーディオ・デコーダ。

- 前記出力オーディオ信号を得るために、前記レンダリングされたオーディオ信号またはそのスケール化バージョンと前記1つ以上の非相関化オーディオ信号とを結合するための方法を決定するために、異なる制約が適用される場合において、前記マルチチャネル・オーディオ・デコーダは、異なるモードの間で切り替えるように構成される、請求項1ないし請求項38のいずれかに記載のマルチチャネル・オーディオ・デコーダ。

- 前記マルチチャネル・オーディオ・デコーダは、

前記レンダリングされたオーディオ信号またはそのスケール化バージョンと前記1つ以上の非相関化オーディオ信号とを結合する場合に、異なるレンダリングされたオーディオ信号の間における混合が許容される、第1のモード、

前記レンダリングされたオーディオ信号またはそのスケール化バージョンと前記1つ以上の非相関化オーディオ信号とを結合する場合に、異なるレンダリングされたオーディオ信号の間における混合が許容されず、そして、前記出力オーディオ信号の相互相関特性または相互共分散特性を調整するために、所与の非相関化信号が、同じもしくは異なるスケール化、複数のレンダリングされたオーディオ信号、またはそのスケール化バージョンと結合されることが許容される、第2のモード、および

前記レンダリングされたオーディオ信号またはそのスケール化バージョンと前記1つ以上の非相関化オーディオ信号とを結合する場合に、異なるレンダリングされたオーディオ信号の間における混合が許容されず、そして、所与の非相関化信号が、前記所与の非相関化信号から導出されたレンダリングされたオーディオ信号以外のレンダリングされたオーディオ信号と結合されることが許容されない、第3のモード、

の間で切り替えるように構成される、請求項1ないし請求項39のいずれかに記載のマルチチャネル・オーディオ・デコーダ。 - 前記マルチチャネル・オーディオ・デコーダは、前記レンダリングされたオーディオ信号またはそのスケール化バージョンと前記1つ以上の非相関化オーディオ信号とを結合するための前記3つのモードが使用されるかについて指し示す前記符号化表現のビットストリーム要素を評価し、そして、前記ビットストリーム要素に基づいて前記モードを選択するように構成される、請求項39または請求項40に記載のマルチチャネル・オーディオ・デコーダ。

- 少なくとも2つの入力オーディオ信号(210,212;1512a−1512n;2912,2914)に基づいて符号化表現(214;1516a,1516b,1518;2932)を供給するためのマルチチャネル・オーディオ・エンコーダ(200;1510;2900)であって、

ここで、前記マルチチャネル・オーディオ・エンコーダは、前記少なくとも2つの入力オーディオ信号に基づき、1つ以上のダウンミックス信号(222;1516a,1516b)を供給する(220)ように構成され、

前記マルチチャネル・オーディオ・エンコーダは、前記少なくとも2つの入力オーディオ信号の間の関係を記述している1つ以上のパラメータ(232;1518)を供給する(230)ように構成され、そして、

前記マルチチャネル・オーディオ・エンコーダは、オーディオ・デコーダのサイドで使用される複数の非相関化モードのうちの非相関化モードを記述している非相関化方法パラメータ(242;1518)を供給する(240)ように構成される、マルチチャネル・オーディオ・エンコーダ。 - 前記マルチチャネル・オーディオ・エンコーダは、前記非相関化方法パラメータを選択的に供給し、オーディオ・デコーダの処理のための、

前記レンダリングされたオーディオ信号またはそのスケール化バージョンと前記1つ以上の非相関化オーディオ信号とを結合する場合に、異なるレンダリングされたオーディオ信号の間における混合が許容される、第1のモード、

前記レンダリングされたオーディオ信号またはそのスケール化バージョンと前記1つ以上の非相関化オーディオ信号とを結合する場合に、異なるレンダリングされたオーディオ信号の間における混合が許容されず、そして、前記出力オーディオ信号の相互相関特性または相互共分散特性を調整するために、所与の非相関化信号が、同じもしくは異なるスケール化、複数のレンダリングされたオーディオ信号、またはそのスケール化バージョンと結合されることが許容される、第2のモード、および

前記レンダリングされたオーディオ信号またはそのスケール化バージョンと前記1つ以上の非相関化オーディオ信号とを結合する場合に、異なるレンダリングされたオーディオ信号の間における混合が許容されず、そして、所与の非相関化信号が、前記所与の非相関化信号から導出されたレンダリングされたオーディオ信号以外のレンダリングされたオーディオ信号と結合されることが許容されない、第3のモード、

である以上に示す3つのモードの1つの信号を送信するように構成される、請求項42に記載のマルチチャネル・オーディオ・エンコーダ。 - 前記マルチチャネル・オーディオ・エンコーダは、前記入力オーディオ信号が比較的高い相関または比較的低い相関を含むかどうかに基づいて、前記非相関化方法パラメータを選択するように構成される、請求項42または請求項43に記載のマルチチャネル・オーディオ・エンコーダ。

- 前記マルチチャネル・オーディオ・エンコーダは、前記入力オーディオ信号の間の相関が比較的高い場合、前記第1のモードまたは前記第2のモードを指定するための前記非相関化方法パラメータを選択するように構成され、

前記マルチチャネル・オーディオ・エンコーダは、前記入力オーディオ信号の間の相関が比較的低い場合、前記第3のモードを指定するための前記非相関化方法パラメータを選択するように構成される、請求項43に記載のマルチチャネル・オーディオ・エンコーダ。 - 符号化表現に基づく少なくとも2つの出力オーディオ信号を供給するための方法(300)であって、前記方法は、

複数のレンダリングされたオーディオ信号を得るために、1つ以上のレンダリング・パラメータに基づいて、前記符号化表現に基づいて得られた複数の復号化オーディオ信号をレンダリングするステップ(310)と、

前記レンダリングされたオーディオ信号から1つ以上の非相関化オーディオ信号を導出するステップ(320)と、

前記出力オーディオ信号を得るために、前記レンダリングされたオーディオ信号またはそのスケール化バージョンと前記1つ以上の非相関化オーディオ信号とを結合するステップ(330)と、を含む、方法。 - 少なくとも2つの入力オーディオ信号に基づく符号化表現を供給するための方法(400)であって、前記方法は、

前記少なくとも2つの入力オーディオ信号に基づく1つ以上のダウンミックス信号を供給するステップ(410)と、

前記少なくとも2つの入力オーディオ信号の間の関係を記述している1つ以上のパラメータを供給するステップ(420)と、

オーディオ・デコーダのサイドで使用される複数の非相関化モードのうちの非相関化モードを記述している非相関化方法パラメータを供給するステップ(430)と、を含む、方法。 - コンピュータ・プログラムがコンピュータ上で実行されると、前記コンピュータが請求項46、または請求項47に記載の方法を実行する、コンピュータ・プログラム。

- 符号化オーディオ表現(500)は、

ダウンミックス信号の符号化表現(510)、

前記少なくとも2つの入力オーディオ信号の間の関係を記述している1つ以上のパラメータの符号化表現(520)、および

オーディオ・デコーダのサイドで使用される複数の非相関化モードのうちの非相関化モードを記述している符号化非相関化方法パラメータ(530)を含む、符号化オーディオ表現。

Applications Claiming Priority (7)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP13177374 | 2013-07-22 | ||

| EP13177374.9 | 2013-07-22 | ||

| EP20130189345 EP2830334A1 (en) | 2013-07-22 | 2013-10-18 | Multi-channel audio decoder, multi-channel audio encoder, methods, computer program and encoded audio representation using a decorrelation of rendered audio signals |

| EP13189345.5 | 2013-10-18 | ||

| EP14161611.0 | 2014-03-25 | ||

| EP14161611 | 2014-03-25 | ||

| PCT/EP2014/065397 WO2015011015A1 (en) | 2013-07-22 | 2014-07-17 | Multi-channel audio decoder, multi-channel audio encoder, methods, computer program and encoded audio representation using a decorrelation of rendered audio signals |

Related Child Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2018173594A Division JP6777700B2 (ja) | 2013-07-22 | 2018-09-18 | マルチチャネル・オーディオ・デコーダ、マルチチャネル・オーディオ・エンコーダ、レンダリングされたオーディオ信号を使用する方法、コンピュータ・プログラムおよび符号化オーディオ表現 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2016528811A true JP2016528811A (ja) | 2016-09-15 |

| JP6449877B2 JP6449877B2 (ja) | 2019-01-09 |

Family

ID=52392762

Family Applications (2)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2016528443A Active JP6449877B2 (ja) | 2013-07-22 | 2014-07-17 | マルチチャネル・オーディオ・デコーダ、マルチチャネル・オーディオ・エンコーダ、レンダリングされたオーディオ信号を使用する方法、コンピュータ・プログラムおよび符号化オーディオ表現 |

| JP2018173594A Active JP6777700B2 (ja) | 2013-07-22 | 2018-09-18 | マルチチャネル・オーディオ・デコーダ、マルチチャネル・オーディオ・エンコーダ、レンダリングされたオーディオ信号を使用する方法、コンピュータ・プログラムおよび符号化オーディオ表現 |

Family Applications After (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2018173594A Active JP6777700B2 (ja) | 2013-07-22 | 2018-09-18 | マルチチャネル・オーディオ・デコーダ、マルチチャネル・オーディオ・エンコーダ、レンダリングされたオーディオ信号を使用する方法、コンピュータ・プログラムおよび符号化オーディオ表現 |

Country Status (17)

| Country | Link |

|---|---|

| US (2) | US10431227B2 (ja) |

| EP (1) | EP3022949B1 (ja) |

| JP (2) | JP6449877B2 (ja) |

| KR (1) | KR101829822B1 (ja) |

| CN (1) | CN105612766B (ja) |

| AU (1) | AU2014295207B2 (ja) |

| BR (1) | BR112016001250B1 (ja) |

| CA (1) | CA2919080C (ja) |

| ES (1) | ES2653975T3 (ja) |

| MX (1) | MX361115B (ja) |

| MY (1) | MY195412A (ja) |

| PL (1) | PL3022949T3 (ja) |

| PT (1) | PT3022949T (ja) |

| RU (1) | RU2665917C2 (ja) |

| SG (1) | SG11201600466PA (ja) |

| TW (1) | TWI601408B (ja) |

| WO (1) | WO2015011015A1 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2022537026A (ja) * | 2019-06-14 | 2022-08-23 | フラウンホファー ゲセルシャフト ツール フェールデルンク ダー アンゲヴァンテン フォルシュンク エー.ファオ. | パラメータの符号化および復号 |

Families Citing this family (23)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP4092670A1 (en) * | 2014-09-30 | 2022-11-23 | Sony Group Corporation | Transmitting device, transmission method, receiving device, and receiving method |

| CN106303897A (zh) | 2015-06-01 | 2017-01-04 | 杜比实验室特许公司 | 处理基于对象的音频信号 |

| CN110447243B (zh) * | 2017-03-06 | 2021-06-01 | 杜比国际公司 | 基于音频数据流渲染音频输出的方法、解码器系统和介质 |

| WO2018162472A1 (en) * | 2017-03-06 | 2018-09-13 | Dolby International Ab | Integrated reconstruction and rendering of audio signals |

| CN109688497B (zh) * | 2017-10-18 | 2021-10-01 | 宏达国际电子股份有限公司 | 声音播放装置、方法及非暂态存储介质 |

| BR112020015835A2 (pt) | 2018-04-11 | 2020-12-15 | Dolby International Ab | Métodos, aparelho e sistemas para renderização de áudio 6dof e representações de dados e estruturas de fluxo de bits para renderização de áudio 6dof |

| CN111955020B (zh) | 2018-04-11 | 2022-08-23 | 杜比国际公司 | 用于音频渲染的预渲染信号的方法、设备和系统 |

| EP3588495A1 (en) * | 2018-06-22 | 2020-01-01 | FRAUNHOFER-GESELLSCHAFT zur Förderung der angewandten Forschung e.V. | Multichannel audio coding |

| EP3818524B1 (en) * | 2018-07-02 | 2023-12-13 | Dolby Laboratories Licensing Corporation | Methods and devices for generating or decoding a bitstream comprising immersive audio signals |

| BR112020026967A2 (pt) * | 2018-07-04 | 2021-03-30 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Codificação de áudio de multissinal usando branqueamento de sinal como pré-processamento |

| WO2020257331A1 (en) * | 2019-06-20 | 2020-12-24 | Dolby Laboratories Licensing Corporation | Rendering of an m-channel input on s speakers (s<m) |

| GB201909133D0 (en) * | 2019-06-25 | 2019-08-07 | Nokia Technologies Oy | Spatial audio representation and rendering |

| TWI703559B (zh) * | 2019-07-08 | 2020-09-01 | 瑞昱半導體股份有限公司 | 音效編碼解碼電路及音頻資料的處理方法 |

| KR102300177B1 (ko) * | 2019-09-17 | 2021-09-08 | 난징 트월링 테크놀로지 컴퍼니 리미티드 | 몰입형 오디오 렌더링 방법 및 시스템 |

| FR3101741A1 (fr) * | 2019-10-02 | 2021-04-09 | Orange | Détermination de corrections à appliquer à un signal audio multicanal, codage et décodage associés |

| EP3809709A1 (en) * | 2019-10-14 | 2021-04-21 | Koninklijke Philips N.V. | Apparatus and method for audio encoding |

| GB2594265A (en) * | 2020-04-20 | 2021-10-27 | Nokia Technologies Oy | Apparatus, methods and computer programs for enabling rendering of spatial audio signals |

| BR112022025161A2 (pt) | 2020-06-11 | 2022-12-27 | Dolby Laboratories Licensing Corp | Codificação de sinais de áudio de multicanal compreendendo a mixagem de rebaixamento de um canal de entrada primário e de dois ou mais canais de entrada não primária |

| CN114067810B (zh) * | 2020-07-31 | 2025-12-12 | 华为技术有限公司 | 音频信号渲染方法和装置 |

| CN116830192A (zh) * | 2020-12-02 | 2023-09-29 | 杜比实验室特许公司 | 利用自适应下混策略的沉浸式语音和音频服务(ivas) |

| WO2023147864A1 (en) * | 2022-02-03 | 2023-08-10 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Apparatus and method to transform an audio stream |

| WO2023210978A1 (ko) * | 2022-04-28 | 2023-11-02 | 삼성전자 주식회사 | 다채널 오디오 신호 처리 장치 및 방법 |

| GB2634513A (en) * | 2023-10-09 | 2025-04-16 | Sony Interactive Entertainment Europe Ltd | A method for decorrelating a set of simulated audio signals in a virtual environment |

Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2008511044A (ja) * | 2004-08-25 | 2008-04-10 | ドルビー・ラボラトリーズ・ライセンシング・コーポレーション | 空間オーディオコーディングにおける複数チャンネルデコリレーション |

| JP2012505575A (ja) * | 2008-10-07 | 2012-03-01 | フラウンホーファー−ゲゼルシャフト・ツール・フェルデルング・デル・アンゲヴァンテン・フォルシュング・アインゲトラーゲネル・フェライン | 多チャネルオーディオ信号のバイノーラル・レンダリング |

| WO2013064957A1 (en) * | 2011-11-01 | 2013-05-10 | Koninklijke Philips Electronics N.V. | Audio object encoding and decoding |

Family Cites Families (50)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CA2992051C (en) | 2004-03-01 | 2019-01-22 | Dolby Laboratories Licensing Corporation | Reconstructing audio signals with multiple decorrelation techniques and differentially coded parameters |

| US8437868B2 (en) * | 2002-10-14 | 2013-05-07 | Thomson Licensing | Method for coding and decoding the wideness of a sound source in an audio scene |

| WO2005098821A2 (en) | 2004-04-05 | 2005-10-20 | Koninklijke Philips Electronics N.V. | Multi-channel encoder |

| US7720230B2 (en) | 2004-10-20 | 2010-05-18 | Agere Systems, Inc. | Individual channel shaping for BCC schemes and the like |

| SE0402652D0 (sv) * | 2004-11-02 | 2004-11-02 | Coding Tech Ab | Methods for improved performance of prediction based multi- channel reconstruction |

| SE0402649D0 (sv) | 2004-11-02 | 2004-11-02 | Coding Tech Ab | Advanced methods of creating orthogonal signals |

| EP1866913B1 (en) | 2005-03-30 | 2008-08-27 | Koninklijke Philips Electronics N.V. | Audio encoding and decoding |

| CA2610430C (en) | 2005-06-03 | 2016-02-23 | Dolby Laboratories Licensing Corporation | Channel reconfiguration with side information |

| US8626503B2 (en) * | 2005-07-14 | 2014-01-07 | Erik Gosuinus Petrus Schuijers | Audio encoding and decoding |

| KR20070025905A (ko) * | 2005-08-30 | 2007-03-08 | 엘지전자 주식회사 | 멀티채널 오디오 코딩에서 효과적인 샘플링 주파수비트스트림 구성방법 |

| WO2007029412A1 (ja) | 2005-09-01 | 2007-03-15 | Matsushita Electric Industrial Co., Ltd. | マルチチャンネル音響信号処理装置 |

| US8073703B2 (en) | 2005-10-07 | 2011-12-06 | Panasonic Corporation | Acoustic signal processing apparatus and acoustic signal processing method |

| KR100888474B1 (ko) * | 2005-11-21 | 2009-03-12 | 삼성전자주식회사 | 멀티채널 오디오 신호의 부호화/복호화 장치 및 방법 |

| KR101218776B1 (ko) | 2006-01-11 | 2013-01-18 | 삼성전자주식회사 | 다운믹스된 신호로부터 멀티채널 신호 생성방법 및 그 기록매체 |

| KR100803212B1 (ko) * | 2006-01-11 | 2008-02-14 | 삼성전자주식회사 | 스케일러블 채널 복호화 방법 및 장치 |

| TWI469133B (zh) * | 2006-01-19 | 2015-01-11 | Lg Electronics Inc | 媒體訊號處理方法及裝置 |

| KR100773560B1 (ko) | 2006-03-06 | 2007-11-05 | 삼성전자주식회사 | 스테레오 신호 생성 방법 및 장치 |

| TW200742275A (en) | 2006-03-21 | 2007-11-01 | Dolby Lab Licensing Corp | Low bit rate audio encoding and decoding in which multiple channels are represented by fewer channels and auxiliary information |

| WO2007111568A2 (en) * | 2006-03-28 | 2007-10-04 | Telefonaktiebolaget L M Ericsson (Publ) | Method and arrangement for a decoder for multi-channel surround sound |

| KR101001835B1 (ko) | 2006-03-28 | 2010-12-15 | 프라운호퍼 게젤샤프트 쭈르 푀르데룽 데어 안겐반텐 포르슝 에. 베. | 멀티 채널 오디오 재구성에서 신호 셰이핑을 위한 개선 방법 |

| ATE543343T1 (de) | 2006-04-03 | 2012-02-15 | Srs Labs Inc | Tonsignalverarbeitung |

| US8027479B2 (en) * | 2006-06-02 | 2011-09-27 | Coding Technologies Ab | Binaural multi-channel decoder in the context of non-energy conserving upmix rules |

| EP2082397B1 (en) | 2006-10-16 | 2011-12-28 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Apparatus and method for multi -channel parameter transformation |

| AU2007312598B2 (en) | 2006-10-16 | 2011-01-20 | Dolby International Ab | Enhanced coding and parameter representation of multichannel downmixed object coding |

| EP2102856A4 (en) | 2006-12-07 | 2010-01-13 | Lg Electronics Inc | METHOD AND DEVICE FOR PROCESSING AN AUDIO SIGNAL |

| CA2684975C (en) | 2007-04-26 | 2016-08-02 | Dolby Sweden Ab | Apparatus and method for synthesizing an output signal |

| WO2009039897A1 (en) | 2007-09-26 | 2009-04-02 | Fraunhofer - Gesellschaft Zur Förderung Der Angewandten Forschung E.V. | Apparatus and method for extracting an ambient signal in an apparatus and method for obtaining weighting coefficients for extracting an ambient signal and computer program |

| JP5391203B2 (ja) * | 2007-10-09 | 2014-01-15 | コーニンクレッカ フィリップス エヌ ヴェ | バイノーラル音声信号を生成するための方法と装置 |

| JP5883561B2 (ja) | 2007-10-17 | 2016-03-15 | フラウンホッファー−ゲゼルシャフト ツァ フェルダールング デァ アンゲヴァンテン フォアシュンク エー.ファオ | アップミックスを使用した音声符号器 |

| EP2093911A3 (en) | 2007-11-28 | 2010-01-13 | Lg Electronics Inc. | Receiving system and audio data processing method thereof |

| US8126172B2 (en) | 2007-12-06 | 2012-02-28 | Harman International Industries, Incorporated | Spatial processing stereo system |

| JP5243554B2 (ja) * | 2008-01-01 | 2013-07-24 | エルジー エレクトロニクス インコーポレイティド | オーディオ信号の処理方法及び装置 |

| US8335331B2 (en) * | 2008-01-18 | 2012-12-18 | Microsoft Corporation | Multichannel sound rendering via virtualization in a stereo loudspeaker system |

| US20090194756A1 (en) | 2008-01-31 | 2009-08-06 | Kau Derchang | Self-aligned eletrode phase change memory |

| CN101946526B (zh) * | 2008-02-14 | 2013-01-02 | 杜比实验室特许公司 | 声音再现方法和系统以及立体声扩展方法 |

| JP5366104B2 (ja) * | 2008-06-26 | 2013-12-11 | オランジュ | マルチチャネル・オーディオ信号の空間合成 |

| EP2144229A1 (en) | 2008-07-11 | 2010-01-13 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Efficient use of phase information in audio encoding and decoding |

| MX2011011399A (es) | 2008-10-17 | 2012-06-27 | Univ Friedrich Alexander Er | Aparato para suministrar uno o más parámetros ajustados para un suministro de una representación de señal de mezcla ascendente sobre la base de una representación de señal de mezcla descendete, decodificador de señal de audio, transcodificador de señal de audio, codificador de señal de audio, flujo de bits de audio, método y programa de computación que utiliza información paramétrica relacionada con el objeto. |

| JP5358691B2 (ja) * | 2009-04-08 | 2013-12-04 | フラウンホッファー−ゲゼルシャフト ツァ フェルダールング デァ アンゲヴァンテン フォアシュンク エー.ファオ | 位相値平滑化を用いてダウンミックスオーディオ信号をアップミックスする装置、方法、およびコンピュータプログラム |

| CN102804747B (zh) | 2009-04-15 | 2014-04-02 | 弗兰霍菲尔运输应用研究公司 | 多通道回波对消器 |

| MX2011013829A (es) | 2009-06-24 | 2012-03-07 | Fraunhofer Ges Forschung | Decodificador de señales de audio, metodo para decodificar una señal de audio y programa de computacion que utiliza etapas en cascada de procesamiento de objetos de audio. |

| ES2690164T3 (es) | 2009-06-25 | 2018-11-19 | Dts Licensing Limited | Dispositivo y método para convertir una señal de audio espacial |

| JP5793675B2 (ja) | 2009-07-31 | 2015-10-14 | パナソニックIpマネジメント株式会社 | 符号化装置および復号装置 |

| TWI433137B (zh) * | 2009-09-10 | 2014-04-01 | Dolby Int Ab | 藉由使用參數立體聲改良調頻立體聲收音機之聲頻信號之設備與方法 |

| JP5604933B2 (ja) | 2010-03-30 | 2014-10-15 | 富士通株式会社 | ダウンミクス装置およびダウンミクス方法 |

| JP5753899B2 (ja) * | 2010-07-20 | 2015-07-22 | ファーウェイ テクノロジーズ カンパニー リミテッド | オーディオ信号合成器 |

| SG2014006738A (en) | 2010-08-25 | 2014-03-28 | Fraunhofer Ges Forschung | An apparatus for encoding an audio signal having a plurality of channels |

| US9749473B2 (en) | 2012-03-23 | 2017-08-29 | Dolby Laboratories Licensing Corporation | Placement of talkers in 2D or 3D conference scene |

| EP2956935B1 (en) | 2013-02-14 | 2017-01-04 | Dolby Laboratories Licensing Corporation | Controlling the inter-channel coherence of upmixed audio signals |

| EP2830333A1 (en) | 2013-07-22 | 2015-01-28 | Fraunhofer-Gesellschaft zur Förderung der angewandten Forschung e.V. | Multi-channel decorrelator, multi-channel audio decoder, multi-channel audio encoder, methods and computer program using a premix of decorrelator input signals |

-

2014

- 2014-07-17 CN CN201480052113.4A patent/CN105612766B/zh active Active

- 2014-07-17 RU RU2016105755A patent/RU2665917C2/ru active

- 2014-07-17 JP JP2016528443A patent/JP6449877B2/ja active Active

- 2014-07-17 EP EP14739483.7A patent/EP3022949B1/en active Active

- 2014-07-17 PT PT147394837T patent/PT3022949T/pt unknown

- 2014-07-17 CA CA2919080A patent/CA2919080C/en active Active

- 2014-07-17 ES ES14739483.7T patent/ES2653975T3/es active Active

- 2014-07-17 PL PL14739483T patent/PL3022949T3/pl unknown

- 2014-07-17 BR BR112016001250-0A patent/BR112016001250B1/pt active IP Right Grant

- 2014-07-17 AU AU2014295207A patent/AU2014295207B2/en active Active

- 2014-07-17 MY MYPI2016000111A patent/MY195412A/en unknown

- 2014-07-17 WO PCT/EP2014/065397 patent/WO2015011015A1/en not_active Ceased

- 2014-07-17 SG SG11201600466PA patent/SG11201600466PA/en unknown

- 2014-07-17 MX MX2016000902A patent/MX361115B/es active IP Right Grant

- 2014-07-17 KR KR1020167004482A patent/KR101829822B1/ko active Active

- 2014-07-21 TW TW103124985A patent/TWI601408B/zh active

-

2016

- 2016-01-22 US US15/004,548 patent/US10431227B2/en active Active

-

2018

- 2018-08-09 US US16/059,832 patent/US12374342B2/en active Active

- 2018-09-18 JP JP2018173594A patent/JP6777700B2/ja active Active

Patent Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2008511044A (ja) * | 2004-08-25 | 2008-04-10 | ドルビー・ラボラトリーズ・ライセンシング・コーポレーション | 空間オーディオコーディングにおける複数チャンネルデコリレーション |

| JP2012505575A (ja) * | 2008-10-07 | 2012-03-01 | フラウンホーファー−ゲゼルシャフト・ツール・フェルデルング・デル・アンゲヴァンテン・フォルシュング・アインゲトラーゲネル・フェライン | 多チャネルオーディオ信号のバイノーラル・レンダリング |

| WO2013064957A1 (en) * | 2011-11-01 | 2013-05-10 | Koninklijke Philips Electronics N.V. | Audio object encoding and decoding |

Non-Patent Citations (2)

| Title |

|---|

| BREEBAART ET AL.: ""MPEG Spatial Audio Coding / MPEG Surround: Overview and Current Status"", AUDIO ENGINEERING SOCIETY CONVENTION PAPER, vol. 119th Convention, JPN6017021368, 7 October 2005 (2005-10-07), pages 1 - 17, ISSN: 0003576425 * |

| ENGDEGARD ET AL.: ""Spatial Audio Object Coding (SAOC) - The Upcoming MPEG Standard on Parametric Object Based Audio Co", AUDIO ENGINEERING SOCIETY CONVENTION PAPER, vol. 124th Convention, JPN6017021366, 17 May 2008 (2008-05-17), pages 1 - 15, ISSN: 0003576424 * |

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2022537026A (ja) * | 2019-06-14 | 2022-08-23 | フラウンホファー ゲセルシャフト ツール フェールデルンク ダー アンゲヴァンテン フォルシュンク エー.ファオ. | パラメータの符号化および復号 |

| JP2024029071A (ja) * | 2019-06-14 | 2024-03-05 | フラウンホファー ゲセルシャフト ツール フェールデルンク ダー アンゲヴァンテン フォルシュンク エー.ファオ. | パラメータの符号化および復号 |

| JP7471326B2 (ja) | 2019-06-14 | 2024-04-19 | フラウンホファー ゲセルシャフト ツール フェールデルンク ダー アンゲヴァンテン フォルシュンク エー.ファオ. | パラメータの符号化および復号 |

| JP7696986B2 (ja) | 2019-06-14 | 2025-06-23 | フラウンホファー ゲセルシャフト ツール フェールデルンク ダー アンゲヴァンテン フォルシュンク エー.ファオ. | パラメータの符号化および復号 |

Also Published As

| Publication number | Publication date |

|---|---|

| ES2653975T3 (es) | 2018-02-09 |

| KR101829822B1 (ko) | 2018-03-29 |

| JP6777700B2 (ja) | 2020-10-28 |

| TW201521469A (zh) | 2015-06-01 |

| MX2016000902A (es) | 2016-05-31 |

| US20160247507A1 (en) | 2016-08-25 |

| CA2919080A1 (en) | 2015-01-29 |

| BR112016001250B1 (pt) | 2022-07-26 |

| PT3022949T (pt) | 2018-01-23 |

| JP6449877B2 (ja) | 2019-01-09 |

| RU2665917C2 (ru) | 2018-09-04 |

| CA2919080C (en) | 2018-06-05 |

| MX361115B (es) | 2018-11-28 |

| RU2016105755A (ru) | 2017-08-25 |

| CN105612766A (zh) | 2016-05-25 |

| PL3022949T3 (pl) | 2018-04-30 |

| SG11201600466PA (en) | 2016-02-26 |

| AU2014295207A1 (en) | 2016-03-10 |

| JP2019032541A (ja) | 2019-02-28 |

| KR20160039634A (ko) | 2016-04-11 |

| AU2014295207B2 (en) | 2017-02-02 |

| CN105612766B (zh) | 2018-07-27 |

| BR112016001250A2 (ja) | 2017-07-25 |

| EP3022949B1 (en) | 2017-10-18 |

| US10431227B2 (en) | 2019-10-01 |

| US20180350375A1 (en) | 2018-12-06 |

| WO2015011015A1 (en) | 2015-01-29 |

| EP3022949A1 (en) | 2016-05-25 |

| TWI601408B (zh) | 2017-10-01 |

| MY195412A (en) | 2023-01-19 |

| US12374342B2 (en) | 2025-07-29 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6777700B2 (ja) | マルチチャネル・オーディオ・デコーダ、マルチチャネル・オーディオ・エンコーダ、レンダリングされたオーディオ信号を使用する方法、コンピュータ・プログラムおよび符号化オーディオ表現 | |

| JP7000488B2 (ja) | マルチチャネル非相関器、マルチチャネル・オーディオ・デコーダ、マルチチャネル・オーディオ・エンコーダおよび非相関器入力信号のリミックスを使用したコンピュータ・プログラム | |

| HK40002401B (en) | Multi-channel decorrelator, multi-channel audio encoder, method and computer program using a premix of decorrelator input signals | |

| HK40002400A (en) | Multi-channel decorrelator, method and computer program using a premix of decorrelator input signals | |

| HK40002400B (en) | Multi-channel decorrelator, method and computer program using a premix of decorrelator input signals | |

| HK1224867B (en) | Multi-channel audio decoder, multi-channel audio encoder, methods, computer program and encoded audio representation using a decorrelation of rendered audio signals | |

| HK1224867A1 (en) | Multi-channel audio decoder, multi-channel audio encoder, methods, computer program and encoded audio representation using a decorrelation of rendered audio signals |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A529 | Written submission of copy of amendment under article 34 pct |

Free format text: JAPANESE INTERMEDIATE CODE: A529 Effective date: 20160322 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20160322 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20170613 |

|

| A601 | Written request for extension of time |

Free format text: JAPANESE INTERMEDIATE CODE: A601 Effective date: 20170907 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20171213 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20180515 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20180918 |

|

| A911 | Transfer to examiner for re-examination before appeal (zenchi) |

Free format text: JAPANESE INTERMEDIATE CODE: A911 Effective date: 20181024 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20181113 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20181206 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6449877 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |