JP2010054568A - 感情識別装置、感情識別方法およびプログラム - Google Patents

感情識別装置、感情識別方法およびプログラム Download PDFInfo

- Publication number

- JP2010054568A JP2010054568A JP2008216418A JP2008216418A JP2010054568A JP 2010054568 A JP2010054568 A JP 2010054568A JP 2008216418 A JP2008216418 A JP 2008216418A JP 2008216418 A JP2008216418 A JP 2008216418A JP 2010054568 A JP2010054568 A JP 2010054568A

- Authority

- JP

- Japan

- Prior art keywords

- emotion

- speaker

- correction value

- stress

- influence

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Withdrawn

Links

Images

Landscapes

- Measurement Of The Respiration, Hearing Ability, Form, And Blood Characteristics Of Living Organisms (AREA)

Abstract

【課題】発話者の発話行為に対して影響を与えうる要因による影響を補正し、発話者の感情の識別や評価を、より正確に行うことが可能な感情識別装置、感情識別方法およびプログラムを提供する。

【解決手段】本発明に係る感情識別装置に、音声特徴量またはその変化量に基づいて、所定の感情カテゴリの感情適合度を算出する感情適合度算出部と、発話者に対してストレスを与えうる要因を表す特徴量、または、その変化量を用いて、ストレスを与えうる要因が発話者の発声に与える影響度を、所定の基準に基づいて数値化する影響度算出部と、ストレスを与えうる要因と、ストレスを与えうる要因が所定の感情カテゴリに与える影響の度合いを数値化した補正値と、が互いに関連付けられた補正値データベースが予め記録された記憶部と、算出された影響度と補正値データベースとを用いて、算出された感情適合度を補正する感情適合度補正部と、を設けた。

【選択図】図1

【解決手段】本発明に係る感情識別装置に、音声特徴量またはその変化量に基づいて、所定の感情カテゴリの感情適合度を算出する感情適合度算出部と、発話者に対してストレスを与えうる要因を表す特徴量、または、その変化量を用いて、ストレスを与えうる要因が発話者の発声に与える影響度を、所定の基準に基づいて数値化する影響度算出部と、ストレスを与えうる要因と、ストレスを与えうる要因が所定の感情カテゴリに与える影響の度合いを数値化した補正値と、が互いに関連付けられた補正値データベースが予め記録された記憶部と、算出された影響度と補正値データベースとを用いて、算出された感情適合度を補正する感情適合度補正部と、を設けた。

【選択図】図1

Description

本発明は、感情識別装置、感情識別方法およびプログラムに関する。

近年、発話者が発した音声を解析することで、発話者の感情を検出したり識別したりする試みがなされている。例えば、特許文献1には、音声データのスペクトル分析等を行い、音声の強度、音声のテンポ、音声の抑揚といった特徴量またはその変化量に基づいて、感情を判断する技術が開示されている。また、特許文献2には、緊急性を表すパラメータとして、音声のパワーや、音声のピッチや、音声の発声速度を含む複数のパラメータを併用する技術が開示されている。

また、例えば特許文献3に示したように、人体抵抗などのバイオ信号の周期性を利用して音声パターンの修正を行い、感情の影響を軽減し音声認識精度を向上させる技術に対する試みもなされている。

上述のような感情の識別処理を精度良く行う際には、外部物理環境、発話者に対する各種のストレスといった、様々な要因を総合的に考慮する必要がある。しかしながら、このような要因による影響が除外された音声特徴量を得ることは、困難であるという問題があった。

そこで、本発明は、このような問題に鑑みてなされたもので、その目的は、発話者の発話行為に対して影響を与えうる要因による影響を補正し、発話者の感情の識別や評価を、より正確に行うことが可能な、新規かつ改良された感情識別装置、感情識別方法およびプログラムを提供することにある。

上記課題を解決するために、本発明のある観点によれば、発話者の音声から得られた音声スペクトル、音声強度、ピッチ周波数または発話速度の少なくとも何れかを含む音声特徴量または当該特徴量の変化量に基づいて、前記発話者の感情が所定の感情カテゴリに適合しているかを表す感情適合度を算出する感情識別装置であって、前記音声特徴量または前記音声特徴量の変化量に基づいて、前記所定の感情カテゴリの前記感情適合度を算出する感情適合度算出部と、取得した前記発話者に対してストレスを与えうる要因を表す特徴量、または、当該ストレスを与えうる要因を表す特徴量の変化量を用いて、前記ストレスを与えうる要因が前記発話者の発声に与える影響度を、所定の基準に基づいて数値化する影響度算出部と、前記ストレスを与えうる要因と、前記ストレスを与えうる要因が前記所定の感情カテゴリに与える影響の度合いを数値化した補正値と、が互いに関連付けられた補正値データベースが予め記録された記憶部と、算出された前記影響度と前記補正値データベースとを用いて、算出された前記感情適合度を補正する感情適合度補正部と、を備える感情識別装置が提供される。

かかる構成によれば、感情適合度算出部は、音声特徴量または当該特徴量の変化量に基づいて、所定の感情カテゴリの前記感情適合度を算出する。また、影響度算出部は、取得した発話者に対してストレスを与えうる要因を表す特徴量、または、当該ストレスを与えうる要因の特徴量の変化量を用いて、ストレスを与えうる要因が発話者の発声に与える影響度を、所定の基準に基づいて数値化する。また、記憶部は、ストレスを与えうる要因と、前記ストレスを与えうる要因が前記所定の感情カテゴリに与える影響の度合いを数値化した補正値と、が互いに関連付けられた補正値データベースが予め記録されており、感情適合度補正部は、算出された影響度と前記補正値データベースとを用いて、算出された感情適合度を補正する。これにより、本発明に係る感情識別装置は、発話者を取り巻く様々な状況の影響を考慮して環境適合度を補正することができ、発話者の感情をより正確に識別することができる。

前記影響度算出部は、前記ストレスを与えうる要因による前記感情適合度への影響度と、前記補正値データベースに記載された前記所定の感情カテゴリにおける補正値との積を、前記感情適合度の補正値としてもよい。

前記感情適合度補正部は、前記補正値データベースに記載された、前記ストレスを与えうる要因が前記所定の感情カテゴリに与える影響の度合いを数値化した補正値を、取得した前記感情適合度または前記感情適合度の補正値に基づいて修正する補正値データベース修正部を更に備えてもよい。

前記補正値データベース修正部は、前記発話者から直接前記感情適合度の補正値が入力された場合に、前記補正値データベースを修正してもよい。

前記補正値データベース修正部は、算出された前記感情適合度が属する前記感情カテゴリとは異なる感情カテゴリの前記感情適合度が最大値となる前記感情適合度の補正値が、前記発話者から直接入力された場合に、前記補正値データベースを修正してもよい。

前記補正値データベース修正部は、前記発話者から直接入力された前記感情適合度の補正値と、前記感情適合度補正部が算出した前記感情適合度の補正値との差分を、前記影響度と前記補正値データベースに記載された前記所定の感情カテゴリにおける補正値との積で比例配分した値を用いて、前記影響の度合いを数値化した補正値を修正してもよい。

前記補正値データベース修正部は、前記発話者から直接入力された補正値を用いて算出された前記感情適合度と、前記感情適合度補正部により算出された前記感情適合度との差分を用いて、前記影響の度合いを数値化した補正値を修正してもよい。

前記発話者に対してストレスを与えうる要因は、前記発話者の身体的な特徴に起因する要因、前記発話者のストレス特性、前記発話者が置かれた外部環境に起因する要因および前記発話者の社会的状況に起因する要因の少なくとも何れか一つであることが好ましい。

前記発話者の身体的な特徴に起因する要因は、前記発話者の体温、脈拍、アルコール濃度および人体の電気抵抗の少なくとも何れか一つであることが好ましい。

前記発話者が置かれた外部環境に起因する要因は、前記発話者が置かれた外部環境の騒音レベル、照度、温度、湿度、風圧および人体加速度の少なくとも何れか一つであることが好ましい。

前記発話者が置かれた社会的状況に起因する要因は、前記発話者が存在する場所に関する位置情報、時刻情報および前記発話者の就業スケジュール情報の少なくとも何れか一つであることが好ましい。

上記課題を解決するために、本発明の別の観点によれば、発話者の音声から得られた音声スペクトル、音声強度、ピッチ周波数または発話速度の少なくとも何れかを含む音声特徴量または当該特徴量の変化量に基づいて、前記発話者の感情が所定の感情カテゴリに適合しているかを表す感情適合度を算出する感情識別方法にであって、前記音声特徴量または前記音声特徴量の変化量に基づいて、所定の感情カテゴリの前記感情適合度を算出する感情適合度算出ステップと、取得した前記発話者に対してストレスを与えうる要因を表す特徴量、または、当該ストレスを与えうる要因を表す特徴量の変化量を用いて、前記ストレスを与えうる要因が前記発話者の発声に与える影響度を、所定の基準に基づいて数値化する影響度算出ステップと、前記ストレスを与えうる要因と、前記ストレスを与えうる要因が前記所定の感情カテゴリに与える影響の度合いを数値化した補正値と、が互いに関連付けられた補正値データベースと、算出された前記影響度とを用いて、算出された前記感情適合度を補正する感情適合度補正ステップと、を含む感情識別方法が提供される。

上記課題を解決するために、本発明の更に別の観点によれば、コンピュータを、発話者の音声から得られた音声スペクトル、音声強度、ピッチ周波数または発話速度の少なくとも何れかを含む音声特徴量または当該特徴量の変化量に基づいて、前記発話者の感情が所定の感情カテゴリに適合しているかを表す感情適合度を算出する感情識別装置として機能させるためのプログラムであって、前記音声特徴量または前記音声特徴量の変化量に基づいて、所定の感情カテゴリの前記感情適合度を算出する感情適合度算出機能と、取得した前記発話者に対してストレスを与えうる要因を表す特徴量、または、当該ストレスを与えうる要因を表す特徴量の変化量を用いて、前記ストレスを与えうる要因が前記発話者の発声に与える影響度を、所定の基準に基づいて数値化する影響度算出機能と、前記ストレスを与えうる要因と、前記ストレスを与えうる要因が前記所定の感情カテゴリに与える影響の度合いを数値化した補正値と、が互いに関連付けられた補正値データベースと、算出された前記影響度とを用いて、算出された前記感情適合度を補正する感情適合度補正機能と、をコンピュータに実現させるためのプログラムが提供される。

かかる構成によれば、コンピュータプログラムは、コンピュータが備える記憶部に格納され、コンピュータが備えるCPUに読み込まれて実行されることにより、そのコンピュータを上記の感情識別装置として機能させる。また、コンピュータプログラムが記録された、コンピュータで読み取り可能な記録媒体も提供することができる。記録媒体は、例えば、磁気ディスク、光ディスク、光磁気ディスク、フラッシュメモリなどである。また、上記のコンピュータプログラムは、記録媒体を用いずに、例えばネットワークを介して配信してもよい。

本発明によれば、発話者の発話行為に対して影響を与えうる要因による影響を補正し、発話者の感情の識別や評価を、より正確に行うことが可能である。

以下に添付図面を参照しながら、本発明の好適な実施の形態について詳細に説明する。なお、本明細書及び図面において、実質的に同一の機能構成を有する構成要素については、同一の符号を付することにより重複説明を省略する。

発話行為において、発話者の心的感情以外に、騒音レベル、照度、発話者の人体の加速度、温度、湿度、風圧などの外部物理環境の影響を受けて、音声のピッチ、発声速度、音声強度等は変化する。また、これらの外部物理環境だけでなく、身体のストレスも、音声特徴量に影響を与える要因の一つである。また、社会的な状況例えば、面接諮問時の受け答えを実施している、講演会等での発表中である、顧客先での対応中である、自宅で一人くつろいでいるなど、社会的な状況(換言すれば、社会的なストレス)が変化すると、音声特徴量に変化が生じる。

これらのストレスに対する耐性は個人差があり、様々なストレスが音声特徴量に与える影響や、ストレスを受けた際の音声特徴量の変化は、音響パラメータ空間で個人差を正規化する処理を行ったとしても、取り除くことは困難であり、個人差に影響されない理想的な音声特徴量(音声パラメータ)を抽出することは困難である。そのため、必要とする勘定識別精度に応じて、このような個人耐性を考慮することが必要となる。

そこで、本願発明者は、上述のような問題を解決するために鋭意研究を行った結果、以下で説明するような本実施形態に係る感情識別装置および感情識別方法に想到した。

なお、説明は、以下の順序で行うものとする。

(1)第1の実施形態

(1−1)感情識別装置の構成について

(1−2)感情識別方法について

(2)本発明の各実施形態に係る感情識別装置のハードウェア構成について

(3)まとめ

(1)第1の実施形態

(1−1)感情識別装置の構成について

(1−2)感情識別方法について

(2)本発明の各実施形態に係る感情識別装置のハードウェア構成について

(3)まとめ

(第1の実施形態)

<感情識別装置について>

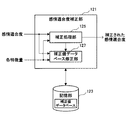

まず、図1および図2を参照しながら、本発明の第1の実施形態に係る感情識別装置について、詳細に説明する。図1は、本実施形態に係る感情識別装置の構成を説明するためのブロック図である。図2は、本実施形態に係る感情適合度補正部を説明するためのブロック図である。

<感情識別装置について>

まず、図1および図2を参照しながら、本発明の第1の実施形態に係る感情識別装置について、詳細に説明する。図1は、本実施形態に係る感情識別装置の構成を説明するためのブロック図である。図2は、本実施形態に係る感情適合度補正部を説明するためのブロック図である。

本実施形態に係る感情識別装置は、例えば図1に示したように、音声特徴量取得部101と、感情適合度算出部103と、バイオ特徴量取得部105と、バイオ特徴影響度算出部107と、ストレス特性取得部109と、ストレス影響度算出部111と、外部環境特徴量取得部113と、外部環境影響度算出部115と、社会的状況パラメータ取得部117と、社会的状況影響度算出部119と、感情適合度補正部121と、記憶部123と、を主に備える。

音声特徴量取得部101は、例えば、CPU(Central Processing Unit)、ROM(Read Only Memory)、RAM(Random Access Memory)、マイク等の入力装置などから構成されている。音声特徴量取得部101は、マイク等の入力装置を介して入力された発話者の音声をAD(Analog−to−Digital)変換してデジタル音声情報とするとともに、デジタル音声情報の中から、音声特徴量を取得する。このような音声特徴量の例として、例えば、音声スペクトル、音声強度、音声のピッチ(ピッチ周波数)、抑揚、発話速度(テンポ)、フォルマント周波数等を挙げることができる。また、上述の音声特徴量以外にも、デジタル音声情報の中から任意の音声特徴量を取得することが可能である。また、これらの音声特徴量の取得方法は、これらの音声特徴量を取得できる方法であれば任意の方法を利用することが可能であり、特に限定されるわけではない。

また、音声特徴量取得部101は、これらの音声特徴量だけでなく、取得した音声特徴量を利用して、音声特徴量の変化量(例えば、音声特徴量の時間変化量など)を取得することも可能である。

音声特徴量取得部101は、例えば、男女差、個人差、言語属性等に応じて、取得した音声特徴量やその変化量を正規化してもよい。

音声特徴量取得部101は、取得した音声特徴量やその変化量を、後述する感情適合度算出部103へと出力する。また、音声特徴量取得部101は、取得した音声特徴量を、後述する記憶部123に記録してもよい。

感情適合度算出部103は、例えば、CPU、ROM、RAM等から構成されており、音声特徴量取得部101から伝送された音声特徴量や音声特徴量の変化量に基づいて、所定の感情カテゴリの感情適合度を算出する。感情カテゴリは、例えば、喜び、悲しみ、怒りなどの感情を表す範疇である。また、本実施形態に係る感情カテゴリは、上記のものに限定されるわけではなく、任意の感情を含む。また、感情適合度は、発話者の感情が所定の感情カテゴリにどのくらい適合しているかを表す度合いであって、ある数値として表される。

感情適合度算出部103は、後述する記憶部123等に記録されている各種のパラメータやプログラムやデータベース等を利用しながら、所定の方法に則って感情適合度を算出する。音声特徴量やその変化量から、ある感情カテゴリの感情適合度を算出する方法は、任意の方法を利用することが可能である。このような方法の例として、例えば、音声特徴量やその変化量と、ある感情状態(すなわち、感情カテゴリ)とが関連付けられた感情パターンデータベース等を予め記憶部123等に保持しておき、伝送された音声特徴量やその変化量に基づいて、この感情パターンデータベースを参照することで、各感情カテゴリにおける感情適合度を算出することが可能である。また、この方法以外にも、例えば、特許文献1に記載の方法を用いることも可能である。

感情適合度算出部103は、算出した感情適合度を、後述する感情適合度補正部121に伝送する。また、感情適合度算出部103は、算出した感情適合度を、例えば算出した時刻情報等と関連付けて、後述する記憶部123等に記録してもよい。

バイオ特徴量取得部105は、例えば、CPU、ROM、RAM、入力装置、通信装置、接続ポート等から構成されており、発話者の身体的な特徴であるバイオ特徴量や、その変化量を取得する。このようなバイオ特徴量の一例として、例えば、人体の電気抵抗値、微小電圧値、脈拍、体温、アルコール濃度、血圧、呼吸数などを挙げることができる。また、これらの特徴量以外にも、任意の身体的特徴量を取得することが可能である。

バイオ特徴量取得部105は、当該バイオ特徴量取得部105が備える、電気抵抗測定装置、微小電圧測定装置、体温計、脈拍計、血圧計、アルコール濃度の測定装置などから出力された値を取得してもよい。また、本実施形態に係る感情識別装置10に接続された他の測定機器から出力された値を取得してもよい。また、発話者が入力装置等を介して手動で入力した値を用いることも可能である。

また、バイオ特徴量取得部105は、必要に応じて、取得したバイオ特徴量を、地域属性、季節、時刻情報などにより、正規化してもよい。

バイオ特徴量取得部105は、取得したバイオ特徴量やその変化量を、後述するバイオ特徴影響度算出部107に出力する。また、バイオ特徴量取得部105は、取得したバイオ特徴量やその変化量を、取得した時刻情報等と関連付けて、後述する記憶部123に記録してもよい。

影響度算出部の一例であるバイオ特徴影響度算出部107は、例えば、CPU、ROM、RAM等から構成されている。バイオ特徴影響度算出部107は、バイオ特徴量取得部105から伝送されたバイオ特徴量を所定の基準や数値範囲等と比較して、発話者の身体的なストレスが感情に与える影響を数値化したものであるバイオ特徴影響度を算出する。

バイオ特徴影響度を含む各種の影響度は、影響の度合いに応じて所定数のレベルに区分されている。例えば、影響の度合いに応じて、以下のように3つのレベルに区分されていてもよい。また、レベル数を細かく設定する(すなわち、所定の基準や数値範囲を細かく区分する)ことで、影響度をより細かく設定することができる。

影響度 −1 : 影響が減少・抑圧される

影響度 ±0 : 影響なし・不明

影響度 +1 : 影響が増加・増幅する

影響度 ±0 : 影響なし・不明

影響度 +1 : 影響が増加・増幅する

例えば、バイオ特徴影響度では、以下のような基準を設定することが可能である。

[体温の基準]

37.5度以上、または、36度以下 : −1

上記範囲以外、または、不明 : ±0

37.5度以上、または、36度以下 : −1

上記範囲以外、または、不明 : ±0

[脈拍の基準]

90回/分以上 : −1

上記範囲以外、または、不明 : ±0

90回/分以上 : −1

上記範囲以外、または、不明 : ±0

[アルコール濃度の基準]

正常、または、不明 : ±0

ほろ酔い以上 : +1

正常、または、不明 : ±0

ほろ酔い以上 : +1

なお、これらの基準は、あくまでも一例であって、基準値は上述のものに限定されるわけではない。また、他のバイオ特徴量についても、同様に基準値(基準範囲)と、対応する影響度とを設定することが可能である。

バイオ特徴影響度算出部107は、これらの基準値と影響度とが関連付けられたデータベース等を、後述する記憶部123に保持していてもよく、バイオ特徴影響度算出部107自身に保持していてもよい。

バイオ特徴影響度算出部107は、通知された特徴量に基づいて算出した影響度の和を、バイオ特徴影響度として後述する感情適合度補正部121に出力する。また、通知されなかった特徴量に起因する影響度は、±0として算出処理を行う。

例えば、上述の基準の下で、バイオ特徴量取得部105から「体温、脈拍、アルコール濃度」に関する特徴量が伝送されてきた場合を考える。体温に起因する影響度が−1であり、脈拍に起因する影響度が−1であり、アルコール濃度に起因する影響度が±0である場合には、バイオ特徴影響度算出部107は、(−1)+(−1)+0=(−2)を、バイオ特徴影響度として、後述する感情適合度補正部121に出力する。

また、バイオ特徴影響度算出部107は、算出したバイオ特徴影響度を、算出した時刻情報等と関連付けて、後述する記憶部123に記録してもよい。

ストレス特性取得部109は、例えば、CPU、ROM、RAM、入力装置、通信装置、接続ポート等から構成されており、発話者のストレス特性情報を取得する。ストレス特性情報の取得は、ストレス特性を判定するためのアンケートに対して発話者が回答することにより行うことができる。ストレス特性を判定するためのアンケートとアンケートの回答の解析方法は、アプリケーションとしてストレス特性取得部109や記憶部123が保持していてもよい。また、ストレス特性取得部109に対して、アンケートの判定結果を発話者が自身で入力してもよい。また、ストレス特性取得部109は、感情識別装置10に接続されたコンピュータ等の他の装置から、ストレス特性の判定結果を取得してもよい。

ストレス特性取得部109は、取得したストレス特性に関する情報を、後述するストレス影響度算出部111に出力する。また、ストレス特性取得部109は、取得したストレス特性に関する情報を、取得した時刻情報等と関連付けて、後述する記憶部123に記録してもよい。

影響度算出部の一例であるストレス影響度算出部111は、例えば、CPU、ROM、RAM等から構成されている。ストレス影響度算出部111は、ストレス特性取得部109から伝送されたストレス特性に関する情報を所定の基準や数値範囲等と比較して、発話者のストレス特性が発声に与える影響を数値化したものであるストレス影響度を算出する。ストレス影響度を算出する際の基準として、例えば以下のようなものを挙げることができる。

[ストレスの有無]

ストレス少 : −1

ストレスなし、または、不明 : ±0

ストレス多 : +1

ストレス少 : −1

ストレスなし、または、不明 : ±0

ストレス多 : +1

[ストレス耐性]

ストレスに強い : −1

普通、または、不明 : ±0

ストレスに弱い : +1

ストレスに強い : −1

普通、または、不明 : ±0

ストレスに弱い : +1

なお、これらの基準は、あくまでも一例であって、基準値は上述のものに限定されるわけではない。

ストレス影響度算出部111は、これらの基準値と影響度とが関連付けられたデータベース等を、後述する記憶部123に保持していてもよく、ストレス影響度算出部111自身に保持していてもよい。

ストレス影響度算出部111は、通知された特徴量に基づいて算出した影響度の和を、ストレス影響度として後述する感情適合度補正部121に出力する。また、通知されなかった特徴量に起因する影響度は、±0として算出処理を行う。また、ストレス影響度算出部111は、算出したストレス影響度を、算出した時刻情報等と関連付けて、後述する記憶部123に記録してもよい。

外部環境特徴量取得部113は、例えば、CPU、ROM、RAM、入力装置、通信装置、接続ポート等から構成されている。外部環境特徴量取得部113は、発話者が発話行為を行っている際の外部物理環境を特徴付ける特徴量である外部環境特徴量や、その変化量を取得する。このような外部環境特徴量の一例として、例えば、騒音レベル、照度、人体の加速度、温度、湿度、風圧などを挙げることができる。また、これらの特徴量以外にも、任意の外部環境特徴量を取得することが可能である。

外部環境特徴量取得部113は、当該外部環境特徴量取得部113が備える、騒音計、照度計、加速度センサ、温度計、湿度計、風圧計などから出力された値を取得してもよい。また、本実施形態に係る感情識別装置10に接続された他の測定機器から出力された値を取得してもよい。また、発話者が入力装置等を介して手動で入力した値を用いることも可能である。

また、外部環境特徴量取得部113は、必要に応じて、取得した外部環境特徴量を、地域属性、季節、時刻情報などにより、正規化してもよい。

外部環境特徴量取得部113は、取得した外部環境特徴量やその変化量を、後述する外部環境影響度算出部115に出力する。また、外部環境特徴量取得部113は、取得した外部環境特徴量やその変化量を、取得した時刻情報等と関連付けて、後述する記憶部123に記録してもよい。

影響度算出部の一例である外部環境影響度算出部115は、例えば、CPU、ROM、RAM等から構成されている。外部環境影響度算出部115は、外部環境特徴量取得部113から伝送された外部環境特徴量やその変化量を所定の基準や数値範囲等と比較して、発話者の置かれた外部環境が発声に与える影響を数値化したものである外部環境影響度を算出する。外部環境影響度を算出する際の基準として、例えば以下のようなものを挙げることができる。

[温度の基準]

10℃以下、または、30℃以上 : −1

上記範囲以外、または、不明 : ±0

10℃以下、または、30℃以上 : −1

上記範囲以外、または、不明 : ±0

[湿度の基準]

80%以上、または、20%以上 : −1

上記範囲以外、または、不明 : ±0

80%以上、または、20%以上 : −1

上記範囲以外、または、不明 : ±0

[風圧の基準]

15m/s以上 : −1

上記範囲以外、または、不明 : ±0

15m/s以上 : −1

上記範囲以外、または、不明 : ±0

[騒音レベルの基準]

70dB以上 : −1

35dB以下 : +1

上記範囲以外、または、不明 : ±0

70dB以上 : −1

35dB以下 : +1

上記範囲以外、または、不明 : ±0

[照度の基準]

1万カンデラ以上、または、200カンデラ以下 : −1

上記範囲以外、または、不明 : ±0

1万カンデラ以上、または、200カンデラ以下 : −1

上記範囲以外、または、不明 : ±0

[人体加速度の基準]

3m/sec以上 : −1

上記範囲以外、または、不明 : ±0

3m/sec以上 : −1

上記範囲以外、または、不明 : ±0

なお、これらの基準は、あくまでも一例であって、基準値は上述のものに限定されるわけではない。

外部環境影響度算出部115は、これらの基準値と影響度とが関連付けられたデータベース等を、後述する記憶部123に保持していてもよく、ストレス影響度算出部111自身に保持していてもよい。

外部環境影響度算出部115は、通知された特徴量に基づいて算出した影響度の和を、外部環境影響度として後述する感情適合度補正部121に出力する。また、通知されなかった特徴量に起因する影響度は、±0として算出処理を行う。また、外部環境影響度算出部115は、算出したストレス影響度を、算出した時刻情報等と関連付けて、後述する記憶部123に記録してもよい。

社会的状況パラメータ取得部117は、例えば、CPU、ROM、RAM、入力装置、通信装置、接続ポート等から構成されている。社会的状況パラメータ取得部117は、発話者の位置情報、時刻情報、就業・作業スケジュール等から得られる社会的状況パラメータを取得する。また、これらのパラメータ以外にも、任意の社会的状況パラメータを取得することが可能である。

社会的状況パラメータ取得部117は、感情識別装置10や、感情識別装置10に接続されたコンピュータ等の他の情報処理装置などから出力された値を取得してもよい。より詳細には、社会的状況パラメータ取得部117は、感情識別装置10や、感情識別装置10に接続されたコンピュータ等の他の情報処理装置が保持するスケジュール管理アプリケーションからの出力や、発話者が保持している携帯電話等の携帯機器から得られるGPSデータ等を取得することが可能である。また、発話者が入力装置等を介して手動で入力した結果を用いることも可能である。

このような社会的状況パラメータの一例として、例えば、スケジュール管理アプリケーションから得られる発話者のスケジュール状況を利用することが考えられる。スケジュール状況の例として、例えば、業務中、休み時間、会議中、移動中、警備中、商談中などの状況が考えられる。これらのスケジュール状況と、スケジュール情報に含まれるスケジュールの実施場所等に関する詳細情報とを利用することで、発話者の位置情報、時刻情報、就業・作業スケジュール等を得ることができる。

社会的状況パラメータ取得部117は、取得した社会的状況パラメータを、後述する社会的状況影響度算出部119に出力する。また、社会的状況パラメータ取得部117は、取得した社会的状況パラメータを、取得した時刻情報等と関連付けて、後述する記憶部123に記録してもよい。

影響度算出部の一例である社会的状況影響度算出部119は、例えば、CPU、ROM、RAM等から構成されている。社会的状況影響度算出部119は、社会的状況パラメータ取得部117から伝送された社会的状況パラメータを所定の基準や数値範囲等と比較して、発話者の置かれた社会的状況が発声に与える影響を数値化したものである社会的状況影響度を算出する。社会的状況影響度を算出する際の基準として、例えば以下のようなものを挙げることができる。

[発話者の就業・作業スケジュールに関する基準]

社内会議中 : −1

社内重要会議中 : ±0

商談会議中 : +1

移動中 : ±0

プライベート、または、不明 : ±0

社内会議中 : −1

社内重要会議中 : ±0

商談会議中 : +1

移動中 : ±0

プライベート、または、不明 : ±0

なお、これらの基準は、あくまでも一例であって、基準値は上述のものに限定されるわけではない。

社会的状況影響度算出部119は、これらの基準値と影響度とが関連付けられたデータベース等を、後述する記憶部123に保持していてもよく、社会的状況影響度算出部119自身に保持していてもよい。

社会的状況影響度算出部119は、通知されたパラメータに基づいて算出した影響度の和を、社会的状況影響度として後述する感情適合度補正部121に出力する。また、通知されなかった特徴量に起因する影響度は、±0として算出処理を行う。また、社会的状況影響度算出部119は、算出した社会的状況影響度を、算出した時刻情報等と関連付けて、後述する記憶部123に記録してもよい。

感情適合度補正部121は、例えば、CPU、ROM、RAM等から構成されている。感情適合度補正部121は、後述する記憶部123に記録されている、ストレスを与えうる要因とストレスを与えうる要因が所定の感情カテゴリに与える影響の度合いを数値化した補正値とが互いに関連付けられた補正値データベースを利用して、それぞれの影響度算出部から伝送された影響度に基づき、感情適合度を補正する。また、感情適合度補正部121は、補正値データベースに記載された内容を、取得した感情適合度に基づいて修正する。

この感情適合度補正部121は、例えば図2に示したように、補正処理部125と、補正値データベース修正部127と、を更に備える。

補正処理部125は、バイオ特徴影響度算出部107、ストレス影響度算出部111、外部環境影響度算出部115、社会的状況影響度算出部119から伝送された影響度に基づき、後述する記憶部123に記録された補正値データベースを利用して、感情適合度算出部103から伝送された感情適合度を補正する。

ここで、感情適合度算出部103から伝送された感情カテゴリyの感情適合度をEyvとし、1番目からn番目の影響度をFi(i=1,2,・・・,n)とし、感情カテゴリyとi番目の影響度Fiとの関係性を示した補正値データベースの値(補正値)をEA(i,y)とする。補正処理部125は、これらの値を用いて、補正された感情適合度Eyaを、以下の式1に基づいて算出する。ここで、Wyは、感情カテゴリyに対する感情補正項の重み付け係数である。

記憶部123に記録されている補正値データベースの例を、以下の表1に示す。補正値データベースは、以下の表1に示したように、ある特徴量と、当該特徴量に基づく所定の感情カテゴリそれぞれにおける補正量との関係が規定されたデータベースである。以下の表1では、特徴量の一例として、バイオ特徴量(Fbaio)を取り上げ、このバイオ特徴量と、「喜び」、「怒り」、「哀しみ」、「楽しみ」という4つの感情カテゴリにおける補正量との関係が規定されている。また、以下の表1では、[体温の基準]に関する項目しか記載されていないが、この項目以外にも、バイオ特徴量として利用可能な基準全てに対して、補正量が設定されている。

例えば、感情カテゴリ「喜びp」の感情適合度をEpvとし、補正後の喜びの感情適合度をEpaとした場合に、外部環境特徴量である温度に起因する影響度Ftempによる補正処理は、以下の式2のようになる。ここで、EA(temp,p)は、喜びpと温度影響度との関係性を表した補正値データベースの値である。

また、感情適合度補正部121に、温度に起因する影響度だけでなく、湿度に起因する影響度が伝送された場合には、上記式2に対して、湿度影響度に関する補正項が追加され、以下の式3のようになる。ここで、EA(moist,p)は、喜びpと湿度影響度との関係性を表した補正値データベースの値であり、Fmoistは、湿度影響度である。

本実施形態に係る各影響度算出部では、各影響度の判定条件において、影響を与えない要因や影響が不明な要因は、影響度がゼロとなるように設定されている。そのため、本実施形態に係る感情適合度の補正処理では、バイオ特徴量、個人ストレス特性、外部環境特徴量、社会的状況パラメータの一部または全部が取得できない場合に、取得できなかった特徴量に起因する影響度はゼロとなる。これにより、感情適合度の補正処理になんら悪影響を及ぼすことはない。すなわち、本実施形態に係る感情適合度の補正処理は、様々な実装上の制約等により、ケースバイケースで取得することができた特徴量の種類や属性のばらつきに係らず、感情適合度の補正を行うことができる。

補正値データベース修正部127は、補正値データベースに記載された補正値を、取得した感情適合度または感情適合度の補正値に基づいて修正する。

記憶部123に記録されている補正値データベースは、多数の学習サンプルに対するEyaとEyvとFiとから、多変数統計解析による統計量を利用することで設定することができる。また、先見的・経験的な知識から定性的に補正値データベースの補正値を設定することも可能である。

以下の説明では、それぞれの影響度には相関はないものとして定式化を行ったが、各影響度の相関を加味した修正方法を行っても良い。その場合には、各影響度の相関が十分に推定できるだけの学習サンプルが必要となる。

以下の説明では、まず、発話者本人から、直接的な訂正や指示が与えられ、感情適合度Eyaの補正値E’yaが得られた場合について説明する。このような場合に、本実施形態に係る補正値データベース修正部127は、以下の式4で定義される差分ΔEyaを用いて、補正値データベースに記載されている補正値を修正する。かかる方法を用いることで、多変数統計解析を再度実行することなく、補正値データベースの内容を更新することが可能となる。

具体的には、補正値データベース修正部127は、得られた差分を{EA(i,y)×Fi}2の大きさで比例配分し、補正値データベースに記載されている補正値の修正を行う。式5に示したようにパラメータQを定義すると、差分ΔEyaから補正値データベースの補正値を修正するための式は、以下の式6のように表される。

このような計算を行うことで、補正値データベース修正部127は、記憶部123に記録されている補正値データベースを、簡易な方法で更新することが可能となる。

また、発話者が算出された感情適合度を参照すると、「現在の感情は、感情カテゴリyではなく、y’に近い」という示唆をする場合がある。そこで、本実施形態に係る補正値データベース修正部127は、このような発話者の直感的な訂正に対して、以下のような方法で、補正値データベースの修正を行う。

発話者が上述のような直感的な訂正を行う場合には、「感情yの感情適合度Eyaよりも、他の感情y’の感情適合度Ey’aの方が大きい」ということを意味している。換言すれば、「現在の感情識別方法では、Eya>Ey’aとなっている」という指摘を意味している。そこで、補正値データベース修正部127は、まず、以下の式7に示すようなパラメータPを定義する。続いて、補正値データベース修正部127は、パラメータPを用いて、感情yおよび感情y’における差分ΔEyaおよびΔEy’aを、以下の式8および式9のように定義する。ここで、式7における正の定数θは、逆転定数を表し、EyaとEy’aとの大小関係をθ分だけ逆転させるために用いられる定数である。

次に、補正値データベース修正部127は、算出した差分ΔEyaおよびΔEy’aを用いて、上述の式6を実行することで、それぞれの感情カテゴリにおける補正値データベースを修正することができる。

また、上記式7に替えて、以下に示す式7’を用いることも可能である。以下に示す式7’において、1より大きな定数γが、感情適合度の大小関係を逆転させるための逆転定数となる。

なお、以上の修正方法に関する説明では、1回の発話者の指摘のみで感情判定に反映させる(すなわち、補正値データベースの修正を行う)場合について説明したが、n回の指摘を受けた後に初めて補正値データベースの修正を行うようにしてもよい。この場合には、差分ΔEyaを1/nにした値で、上記式5および式6を実行すればよい。

また、以上の説明では、補正値データベースに記載されている補正値を、得られた差分に基づいて修正する場合について説明したが、発話者から得られた直接的な訂正や指示を、新たな学習サンプルと考え、多変数統計解析を再度実行してもよい。また、得られた差分ΔEyaを用いて、感情適合度Eyvを補正する処理を行うことも可能である。

記憶部123には、感情適合度補正部121が感情適合度の補正に用いる補正値データベースが格納されている。また、記憶部123には、感情適合度算出部103が音声特徴量に基づいて感情適合度を算出する際に利用される、感情パターンデータベースが格納されていてもよい。また、記憶部123には、本実施形態に係る各影響度算出部が影響度の算出に利用する、判断基準等の記載されたデータベースやテーブルが格納されていてもよい。また、記憶部123には、本実施形態に係る感情識別装置10が、何らかの処理を行う際に保存する必要が生じた様々なパラメータや処理の途中経過等、または、各種のデータベースやプログラム等が、適宜記録されてもよい。この記憶部123は、音声特徴量取得部101、感情適合度算出部103、バイオ特徴量取得部105、バイオ特徴影響度算出部107、ストレス特性取得部109、ストレス影響度算出部111、外部環境特徴量取得部113、外部環境影響度算出部115、社会的状況パラメータ取得部117、社会的状況影響度算出部119、感情適合度補正部121等が、自由に読み書きを行うことが可能である。

以上、本実施形態に係る感情識別装置10の機能の一例を示した。上記の各構成要素は、汎用的な部材や回路を用いて構成されていてもよいし、各構成要素の機能に特化したハードウェアにより構成されていてもよい。また、各構成要素の機能を、CPU等が全て行ってもよい。従って、本実施形態を実施する時々の技術レベルに応じて、適宜、利用する構成を変更することが可能である。

<感情識別方法について>

続いて、図3を参照しながら、本実施形態に係る感情識別装置が実施する感情識別方法について、詳細に説明する。図3は、本実施形態に係る感情識別方法を説明するための流れ図である。

続いて、図3を参照しながら、本実施形態に係る感情識別装置が実施する感情識別方法について、詳細に説明する。図3は、本実施形態に係る感情識別方法を説明するための流れ図である。

まず、本実施形態に係る感情識別装置10の音声特徴量取得部101は、発話者が発した音声をデジタル音声情報に変換した上で、所定の方法を用いて音声特徴量を取得する(ステップS101)。音声特徴量取得部101は、取得した音声特徴量を、感情適合度算出部103に伝送する。

続いて、感情適合度算出部103は、伝送された音声特徴量と、記憶部123に記録されている感情パターンデータベース等を利用して、所定の方法により感情適合度を算出する(ステップS103)。感情適合度算出部103は、算出した感情適合度を、感情適合度補正部121に伝送する。

続いて、本実施形態に係る感情識別装置10が備える特徴量取得部(例えば、バイオ特徴量取得部105、ストレス特性取得部109、外部環境特徴量取得部113、社会的状況パラメータ取得部117)は、それぞれの特徴量取得部で取得可能な特徴量の取得を試みる(ステップS105)。特徴量を取得できた特徴量取得部は、取得した特徴量を、対応する影響度算出部に伝送する。

次に、各影響度算出部(例えば、バイオ特徴影響度算出部107、ストレス影響度算出部111、外部環境影響度算出部115、社会的状況影響度算出部119)は、伝送された特徴量と、所定の基準とを比較して、各特徴量に基づく影響度を算出する(ステップS107)。各影響度算出部は、算出した影響度を、感情適合度補正部121に伝送する。

続いて、感情適合度補正部121は、各影響度算出部から伝送された影響度に基づき、記憶部123に記録されている補正値データベースを参照しながら、補正後の感情適合度を、式1により算出する(ステップS109)。その後、感情適合度補正部121は、算出した補正後の感情適合度を、出力する(ステップS111)。

このような方法を経ることで、本実施形態に係る感情識別方法は、発話者の発話行為に対して影響を与えうる要因による影響を補正し、発話者の感情の識別や評価を、より正確に行うことができる。

また、本実施形態に係る感情識別方法では、上述のステップS111の後に、補正値データベース修正部127によるデータベースの修正処理を行うことが可能である。

なお、上述の説明では、音声特徴量の後に、各種の特徴量の取得が行われる場合について説明したが、音声特徴量の取得と、各種の特徴量の取得は、平行して行われてもよく、音声特徴量の取得の前に、各種の特徴量の取得が行われてもよい。

<ハードウェア構成について>

次に、図4を参照しながら、本発明の各実施形態に係る感情識別装置10のハードウェア構成について、詳細に説明する。図4は、本発明の各実施形態に係る感情識別装置のハードウェア構成を説明するためのブロック図である。

次に、図4を参照しながら、本発明の各実施形態に係る感情識別装置10のハードウェア構成について、詳細に説明する。図4は、本発明の各実施形態に係る感情識別装置のハードウェア構成を説明するためのブロック図である。

感情識別装置10は、主に、CPU901と、ROM903と、RAM905と、ホストバス907と、ブリッジ909と、外部バス911と、インターフェース913と、入力装置915と、出力装置917と、ストレージ装置919と、ドライブ921と、接続ポート923と、通信装置925とを備える。

CPU901は、演算処理装置および制御装置として機能し、ROM903、RAM905、ストレージ装置919、またはリムーバブルメディア927に記録された各種プログラムに従って、感情識別装置10内の動作全般またはその一部を制御する。ROM903は、CPU901が使用するプログラムや演算パラメータ等を記憶する。RAM905は、CPU901の実行において使用するプログラムや、その実行において適宜変化するパラメータ等を一次記憶する。これらはCPUバス等の内部バスにより構成されるホストバス907により相互に接続されている。

ホストバス907は、ブリッジ909を介して、PCI(Peripheral Component Interconnect/Interface)バスなどの外部バス911に接続されている。

入力装置915は、例えば、マウス、キーボード、タッチパネル、ボタン、スイッチおよびレバーなどユーザが操作する操作手段である。また、入力装置915は、例えば、赤外線やその他の電波を利用したリモートコントロール手段(いわゆる、リモコン)であってもよいし、感情識別装置10の操作に対応した携帯電話やPDA等の外部接続装置929であってもよい。さらに、入力装置915は、例えば、上記の操作手段を用いてユーザにより入力された情報に基づいて入力信号を生成し、CPU901に出力する入力制御回路などから構成されている。感情識別装置10のユーザは、この入力装置915を操作することにより、感情識別装置10に対して各種のデータを入力したり処理動作を指示したりすることができる。

出力装置917は、例えば、CRTディスプレイ装置、液晶ディスプレイ装置、プラズマディスプレイ装置、ELディスプレイ装置などの表示装置や、スピーカおよびヘッドホンなどの音声出力装置や、プリンタ装置、携帯電話、ファクシミリなど、取得した情報をユーザに対して視覚的または聴覚的に通知することが可能な装置で構成される。出力装置917は、例えば、感情識別装置10が行った各種処理により得られた結果を出力する。具体的には、表示装置は、感情識別装置10が行った各種処理により得られた結果を、テキストまたはイメージで表示する。他方、音声出力装置は、再生された音声データや音響データ等からなるオーディオ信号をアナログ信号に変換して出力する。

ストレージ装置919は、感情識別装置10の記憶部の一例として構成されたデータ格納用の装置であり、例えば、HDD(Hard Disk Drive)等の磁気記憶部デバイス、半導体記憶デバイス、光記憶デバイス、または光磁気記憶デバイス等により構成される。このストレージ装置919は、CPU901が実行するプログラムや各種データ、および外部から取得した各種の特徴量やデータなどを格納する。

ドライブ921は、記録媒体用リーダライタであり、感情識別装置10に内蔵、あるいは外付けされる。ドライブ921は、装着されている磁気ディスク、光ディスク、光磁気ディスク、または半導体メモリ等のリムーバブルメディア927に記録されている情報を読み出して、RAM905に出力する。また、ドライブ921は、装着されている磁気ディスク、光ディスク、光磁気ディスク、または半導体メモリ等のリムーバブルメディア927に記録を書き込むことも可能である。リムーバブルメディア927は、例えば、DVDメディア、HD−DVDメディア、Blu−rayメディア、コンパクトフラッシュ(登録商標)(CompactFlash:CF)、メモリースティック、または、SDメモリカード(Secure Digital memory card)等である。また、リムーバブルメディア927は、例えば、非接触型ICチップを搭載したICカード(Integrated Circuit card)または電子機器等であってもよい。

接続ポート923は、例えば、USB(Universal Serial Bus)ポート、i.Link等のIEEE1394ポート、SCSI(Small Computer System Interface)ポート、RS−232Cポート、光オーディオ端子、HDMI(High−Definition Multimedia Interface)ポート等の、機器を感情識別装置10に直接接続するためのポートである。この接続ポート923に外部接続装置929を接続することで、感情識別装置10は、外部接続装置929から直接各種の特徴量やデータ等を取得したり、外部接続装置929に各種のデータ等を提供したりする。

通信装置925は、例えば、通信網931に接続するための通信デバイス等で構成された通信インターフェースである。通信装置925は、例えば、有線または無線LAN(Local Area Network)、Bluetooth、またはWUSB(Wireless USB)用の通信カード、光通信用のルータ、ADSL(Asymmetric Digital Subscriber Line)用のルータ、または、各種通信用のモデム等である。この通信装置925は、例えば、インターネットや他の通信機器との間で、例えばTCP/IP等の所定のプロトコルに則して信号等を送受信することができる。また、通信装置925に接続される通信網931は、有線または無線によって接続されたネットワーク等により構成され、例えば、インターネット、家庭内LAN、赤外線通信、ラジオ波通信または衛星通信等であってもよい。

以上、本発明の各実施形態に係る感情識別装置10の機能を実現可能なハードウェア構成の一例を示した。上記の各構成要素は、汎用的な部材を用いて構成されていてもよいし、各構成要素の機能に特化したハードウェアにより構成されていてもよい。従って、本実施形態を実施する時々の技術レベルに応じて、適宜、利用するハードウェア構成を変更することが可能である。

<まとめ>

以上説明したように、本発明の各実施形態に係る感情識別装置は、発話者に対してストレスを与えうる要因を表す特徴量に基づいて、各要因に対応した影響度を算出する。感情識別装置は、ストレスを与えうる要因と、ストレスを与えうる要因が所定の感情カテゴリに与える影響の度合いを数値化した補正値と、が互いに関連付けられた補正値データベースを参照しながら、算出された影響度に基づいて、感情適合度の補正を適正に行う。これにより、本発明の各実施形態に係る感情識別装置は、外部物理環境、身体のストレス、社会的ストレス、個人のストレス耐性要因など感情に関係する要因を統合して補正し、発話者の感情の識別や評価を、より正確に行うことができる。

以上説明したように、本発明の各実施形態に係る感情識別装置は、発話者に対してストレスを与えうる要因を表す特徴量に基づいて、各要因に対応した影響度を算出する。感情識別装置は、ストレスを与えうる要因と、ストレスを与えうる要因が所定の感情カテゴリに与える影響の度合いを数値化した補正値と、が互いに関連付けられた補正値データベースを参照しながら、算出された影響度に基づいて、感情適合度の補正を適正に行う。これにより、本発明の各実施形態に係る感情識別装置は、外部物理環境、身体のストレス、社会的ストレス、個人のストレス耐性要因など感情に関係する要因を統合して補正し、発話者の感情の識別や評価を、より正確に行うことができる。

本発明の各実施形態に係る感情識別装置は、識別結果を発話者にインタラクティブにフィードバックするサービス、例えば、ゲームアプリケーションや対面ロボットのサービス、受付応答サービスなどに利用することが可能である。

以上、添付図面を参照しながら本発明の好適な実施形態について説明したが、本発明はかかる例に限定されないことは言うまでもない。当業者であれば、特許請求の範囲に記載された範疇内において、各種の変更例または修正例に想到し得ることは明らかであり、それらについても当然に本発明の技術的範囲に属するものと了解される。

10 感情識別装置

101 音声特徴量取得部

103 感情適合度算出部

105 バイオ特徴量取得部

107 バイオ特徴影響度算出部

109 ストレス特性取得部

111 ストレス影響度算出部

113 外部環境特徴量取得部

115 外部環境影響度算出部

117 社会的状況パラメータ取得部

119 社会的状況影響度算出部

121 感情適合度補正部

123 記憶部

125 補正処理部

127 補正値データベース修正部

101 音声特徴量取得部

103 感情適合度算出部

105 バイオ特徴量取得部

107 バイオ特徴影響度算出部

109 ストレス特性取得部

111 ストレス影響度算出部

113 外部環境特徴量取得部

115 外部環境影響度算出部

117 社会的状況パラメータ取得部

119 社会的状況影響度算出部

121 感情適合度補正部

123 記憶部

125 補正処理部

127 補正値データベース修正部

Claims (13)

- 発話者の音声から得られた音声スペクトル、音声強度、ピッチ周波数または発話速度の少なくとも何れかを含む音声特徴量または当該特徴量の変化量に基づいて、前記発話者の感情が所定の感情カテゴリに適合しているかを表す感情適合度を算出する感情識別装置であって、

前記音声特徴量または前記音声特徴量の変化量に基づいて、前記所定の感情カテゴリの前記感情適合度を算出する感情適合度算出部と、

取得した前記発話者に対してストレスを与えうる要因を表す特徴量、または、当該ストレスを与えうる要因を表す特徴量の変化量を用いて、前記ストレスを与えうる要因が前記発話者の発声に与える影響度を、所定の基準に基づいて数値化する影響度算出部と、

前記ストレスを与えうる要因と、前記ストレスを与えうる要因が前記所定の感情カテゴリに与える影響の度合いを数値化した補正値と、が互いに関連付けられた補正値データベースが予め記録された記憶部と、

算出された前記影響度と前記補正値データベースとを用いて、算出された前記感情適合度を補正する感情適合度補正部と、

を備えることを特徴とする、感情識別装置。 - 前記影響度算出部は、前記ストレスを与えうる要因による前記感情適合度への影響度と、前記補正値データベースに記載された前記所定の感情カテゴリにおける補正値との積を、前記感情適合度の補正値とする

ことを特徴とする、請求項1に記載の感情識別装置。 - 前記感情適合度補正部は、前記補正値データベースに記載された、前記ストレスを与えうる要因が前記所定の感情カテゴリに与える影響の度合いを数値化した補正値を、取得した前記感情適合度または前記感情適合度の補正値に基づいて修正する補正値データベース修正部を更に備える

ことを特徴とする、請求項1に記載の感情識別装置。 - 前記補正値データベース修正部は、前記発話者から直接前記感情適合度の補正値が入力された場合に、前記補正値データベースを修正する

ことを特徴とする、請求項3に記載の感情識別装置。 - 前記補正値データベース修正部は、算出された前記感情適合度が属する前記感情カテゴリとは異なる感情カテゴリの前記感情適合度が最大値となる前記感情適合度の補正値が、前記発話者から直接入力された場合に、前記補正値データベースを修正する

ことを特徴とする、請求項3に記載の感情識別装置。 - 前記補正値データベース修正部は、前記発話者から直接入力された前記感情適合度の補正値と、前記感情適合度補正部が算出した前記感情適合度の補正値との差分を、前記影響度と前記補正値データベースに記載された前記所定の感情カテゴリにおける補正値との積で比例配分した値を用いて、前記影響の度合いを数値化した補正値を修正する

ことを特徴とする、請求項4に記載の感情識別装置。 - 前記補正値データベース修正部は、前記発話者から直接入力された補正値を用いて算出された前記感情適合度と、前記感情適合度補正部により算出された前記感情適合度との差分を用いて、前記影響の度合いを数値化した補正値を修正する

ことを特徴とする、請求項5に記載の感情識別装置。 - 前記発話者に対してストレスを与えうる要因は、前記発話者の身体的な特徴に起因する要因、前記発話者のストレス特性、前記発話者が置かれた外部環境に起因する要因および前記発話者の社会的状況に起因する要因の少なくとも何れか一つである

ことを特徴とする、請求項1〜7のいずれかに記載の感情識別装置。 - 前記発話者の身体的な特徴に起因する要因は、前記発話者の体温、脈拍、アルコール濃度および人体の電気抵抗の少なくとも何れか一つである

ことを特徴とする、請求項8に記載の感情識別装置。 - 前記発話者が置かれた外部環境に起因する要因は、前記発話者が置かれた外部環境の騒音レベル、照度、温度、湿度、風圧および人体加速度の少なくとも何れか一つである

ことを特徴とする、請求項8に記載の感情識別装置。 - 前記発話者が置かれた社会的状況に起因する要因は、前記発話者が存在する場所に関する位置情報、時刻情報および前記発話者の就業スケジュール情報の少なくとも何れか一つである

ことを特徴とする、請求項8に記載の感情識別装置。 - 発話者の音声から得られた音声スペクトル、音声強度、ピッチ周波数または発話速度の少なくとも何れかを含む音声特徴量または当該特徴量の変化量に基づいて、前記発話者の感情が所定の感情カテゴリに適合しているかを表す感情適合度を算出する感情識別方法にであって、

前記音声特徴量または前記音声特徴量の変化量に基づいて、所定の感情カテゴリの前記感情適合度を算出する感情適合度算出ステップと、

取得した前記発話者に対してストレスを与えうる要因を表す特徴量、または、当該ストレスを与えうる要因を表す特徴量の変化量を用いて、前記ストレスを与えうる要因が前記発話者の発声に与える影響度を、所定の基準に基づいて数値化する影響度算出ステップと、

前記ストレスを与えうる要因と、前記ストレスを与えうる要因が前記所定の感情カテゴリに与える影響の度合いを数値化した補正値と、が互いに関連付けられた補正値データベースと、算出された前記影響度とを用いて、算出された前記感情適合度を補正する感情適合度補正ステップと、

を含むことを特徴とする、感情識別方法。 - コンピュータを、発話者の音声から得られた音声スペクトル、音声強度、ピッチ周波数または発話速度の少なくとも何れかを含む音声特徴量または当該特徴量の変化量に基づいて、前記発話者の感情が所定の感情カテゴリに適合しているかを表す感情適合度を算出する感情識別装置として機能させるためのプログラムであって、

前記音声特徴量または前記音声特徴量の変化量に基づいて、所定の感情カテゴリの前記感情適合度を算出する感情適合度算出機能と、

取得した前記発話者に対してストレスを与えうる要因を表す特徴量、または、当該ストレスを与えうる要因を表す特徴量の変化量を用いて、前記ストレスを与えうる要因が前記発話者の発声に与える影響度を、所定の基準に基づいて数値化する影響度算出機能と、

前記ストレスを与えうる要因と、前記ストレスを与えうる要因が前記所定の感情カテゴリに与える影響の度合いを数値化した補正値と、が互いに関連付けられた補正値データベースと、算出された前記影響度とを用いて、算出された前記感情適合度を補正する感情適合度補正機能と、

をコンピュータに実現させるためのプログラム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2008216418A JP2010054568A (ja) | 2008-08-26 | 2008-08-26 | 感情識別装置、感情識別方法およびプログラム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2008216418A JP2010054568A (ja) | 2008-08-26 | 2008-08-26 | 感情識別装置、感情識別方法およびプログラム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2010054568A true JP2010054568A (ja) | 2010-03-11 |

Family

ID=42070610

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2008216418A Withdrawn JP2010054568A (ja) | 2008-08-26 | 2008-08-26 | 感情識別装置、感情識別方法およびプログラム |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2010054568A (ja) |

Cited By (13)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN101937678A (zh) * | 2010-07-19 | 2011-01-05 | 东南大学 | 一种针对烦躁情绪的可据判的自动语音情感识别方法 |

| JP2012239892A (ja) * | 2011-05-13 | 2012-12-10 | Fujitsu Ltd | 複合ストレス指数の計算及びモニタリング |

| JP2013022180A (ja) * | 2011-07-20 | 2013-02-04 | Electronic Navigation Research Institute | 自律神経の状態評価システム |

| JP2015169702A (ja) * | 2014-03-05 | 2015-09-28 | ソフトバンク株式会社 | 感情判断装置および感情判断方法 |

| WO2016088557A1 (ja) * | 2014-12-01 | 2016-06-09 | ヤマハ株式会社 | 会話評価装置および方法 |

| JP2017156688A (ja) * | 2016-03-04 | 2017-09-07 | ヤマハ株式会社 | 会話評価装置およびプログラム |

| US10832687B2 (en) | 2017-09-13 | 2020-11-10 | Fujitsu Limited | Audio processing device and audio processing method |

| JP2020201334A (ja) * | 2019-06-07 | 2020-12-17 | 株式会社Nttドコモ | 感情推定装置、及び、感情推定システム |

| JP2021012285A (ja) * | 2019-07-05 | 2021-02-04 | 株式会社Nttドコモ | 感情推定装置、及び、感情推定システム |

| WO2022059852A1 (ko) * | 2020-09-21 | 2022-03-24 | 주식회사 반디아이씨티 | 상담 노동자를 위한 스트레스 대응 시스템 및 방법 |

| CN114817566A (zh) * | 2022-04-29 | 2022-07-29 | 天津大学 | 基于情绪嵌入的情绪原因对抽取方法 |

| WO2022180862A1 (ja) * | 2021-02-26 | 2022-09-01 | 株式会社I’mbesideyou | ビデオセッション評価端末、ビデオセッション評価システム及びビデオセッション評価プログラム |

| WO2023162410A1 (ja) * | 2022-02-28 | 2023-08-31 | Necソリューションイノベータ株式会社 | 感情補正装置、感情推定装置、感情補正方法、感情推定方法、及びプログラム |

-

2008

- 2008-08-26 JP JP2008216418A patent/JP2010054568A/ja not_active Withdrawn

Cited By (19)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN101937678A (zh) * | 2010-07-19 | 2011-01-05 | 东南大学 | 一种针对烦躁情绪的可据判的自动语音情感识别方法 |

| JP2012239892A (ja) * | 2011-05-13 | 2012-12-10 | Fujitsu Ltd | 複合ストレス指数の計算及びモニタリング |

| JP2013022180A (ja) * | 2011-07-20 | 2013-02-04 | Electronic Navigation Research Institute | 自律神経の状態評価システム |

| JP2015169702A (ja) * | 2014-03-05 | 2015-09-28 | ソフトバンク株式会社 | 感情判断装置および感情判断方法 |

| US10553240B2 (en) | 2014-12-01 | 2020-02-04 | Yamaha Corporation | Conversation evaluation device and method |

| US10229702B2 (en) | 2014-12-01 | 2019-03-12 | Yamaha Corporation | Conversation evaluation device and method |

| WO2016088557A1 (ja) * | 2014-12-01 | 2016-06-09 | ヤマハ株式会社 | 会話評価装置および方法 |

| JP2016105142A (ja) * | 2014-12-01 | 2016-06-09 | ヤマハ株式会社 | 会話評価装置およびプログラム |

| JP2017156688A (ja) * | 2016-03-04 | 2017-09-07 | ヤマハ株式会社 | 会話評価装置およびプログラム |

| US10832687B2 (en) | 2017-09-13 | 2020-11-10 | Fujitsu Limited | Audio processing device and audio processing method |

| JP7279287B2 (ja) | 2019-06-07 | 2023-05-23 | 株式会社Nttドコモ | 感情推定装置、及び、感情推定システム |

| JP2020201334A (ja) * | 2019-06-07 | 2020-12-17 | 株式会社Nttドコモ | 感情推定装置、及び、感情推定システム |

| JP2021012285A (ja) * | 2019-07-05 | 2021-02-04 | 株式会社Nttドコモ | 感情推定装置、及び、感情推定システム |

| JP7379788B2 (ja) | 2019-07-05 | 2023-11-15 | 株式会社Nttドコモ | 感情推定装置、及び、感情推定システム |

| WO2022059852A1 (ko) * | 2020-09-21 | 2022-03-24 | 주식회사 반디아이씨티 | 상담 노동자를 위한 스트레스 대응 시스템 및 방법 |

| WO2022180862A1 (ja) * | 2021-02-26 | 2022-09-01 | 株式会社I’mbesideyou | ビデオセッション評価端末、ビデオセッション評価システム及びビデオセッション評価プログラム |

| WO2023162410A1 (ja) * | 2022-02-28 | 2023-08-31 | Necソリューションイノベータ株式会社 | 感情補正装置、感情推定装置、感情補正方法、感情推定方法、及びプログラム |

| CN114817566A (zh) * | 2022-04-29 | 2022-07-29 | 天津大学 | 基于情绪嵌入的情绪原因对抽取方法 |

| CN114817566B (zh) * | 2022-04-29 | 2023-03-10 | 天津大学 | 基于情绪嵌入的情绪原因对抽取方法 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP2010054568A (ja) | 感情識別装置、感情識別方法およびプログラム | |

| CN107818798B (zh) | 客服服务质量评价方法、装置、设备及存储介质 | |

| CN109389971B (zh) | 基于语音识别的保险录音质检方法、装置、设备和介质 | |

| Pramono et al. | A cough-based algorithm for automatic diagnosis of pertussis | |

| US8078470B2 (en) | System for indicating emotional attitudes through intonation analysis and methods thereof | |

| TWI403304B (zh) | 隨身語能偵知方法及其裝置 | |

| CA3155809A1 (en) | Acoustic and natural language processing models for speech-based screening and monitoring of behavioral health conditions | |

| US7315821B2 (en) | System and method for health care information processing based on acoustic features | |

| Wang et al. | Automatic prediction of intelligible speaking rate for individuals with ALS from speech acoustic and articulatory samples | |

| CN104240696B (zh) | 语音处理设备及方法 | |

| CN114206361A (zh) | 一种用于语音属性的机器学习的系统和方法 | |

| JP2005348872A (ja) | 感情推定装置及び感情推定プログラム | |

| JP2012059107A (ja) | 感情推定装置、感情推定方法およびプログラム | |

| US20210125149A1 (en) | Adaptability job vacancies matching system and method | |

| US20160217322A1 (en) | System and method for inspecting emotion recognition capability using multisensory information, and system and method for training emotion recognition using multisensory information | |

| JP7389421B2 (ja) | 精神・神経系疾患を推定する装置 | |

| EP3726453A1 (en) | Information processing device, information processing method, and program | |

| Eyben et al. | Audiovisual classification of vocal outbursts in human conversation using long-short-term memory networks | |

| JP2018169506A (ja) | 会話満足度推定装置、音声処理装置および会話満足度推定方法 | |

| CN112232276A (zh) | 一种基于语音识别和图像识别的情绪检测方法和装置 | |

| Bayerl et al. | Detecting vocal fatigue with neural embeddings | |

| WO2021134250A1 (zh) | 情绪管理方法、设备及计算机可读存储介质 | |

| JP2019051129A (ja) | 嚥下機能解析システム及びプログラム | |

| JP2006230548A (ja) | 体調判定装置およびそのプログラム | |

| WO2019235190A1 (ja) | 情報処理装置、情報処理方法、プログラム及び対話システム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A300 | Application deemed to be withdrawn because no request for examination was validly filed |

Free format text: JAPANESE INTERMEDIATE CODE: A300 Effective date: 20111101 |