JP2010014718A - 対象物を3dデジタル化するための方法及び装置 - Google Patents

対象物を3dデジタル化するための方法及び装置 Download PDFInfo

- Publication number

- JP2010014718A JP2010014718A JP2009160969A JP2009160969A JP2010014718A JP 2010014718 A JP2010014718 A JP 2010014718A JP 2009160969 A JP2009160969 A JP 2009160969A JP 2009160969 A JP2009160969 A JP 2009160969A JP 2010014718 A JP2010014718 A JP 2010014718A

- Authority

- JP

- Japan

- Prior art keywords

- feature points

- feature

- determined

- point

- coordinates

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Classifications

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01B—MEASURING LENGTH, THICKNESS OR SIMILAR LINEAR DIMENSIONS; MEASURING ANGLES; MEASURING AREAS; MEASURING IRREGULARITIES OF SURFACES OR CONTOURS

- G01B11/00—Measuring arrangements characterised by the use of optical techniques

- G01B11/24—Measuring arrangements characterised by the use of optical techniques for measuring contours or curvatures

- G01B11/25—Measuring arrangements characterised by the use of optical techniques for measuring contours or curvatures by projecting a pattern, e.g. one or more lines, moiré fringes on the object

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/50—Depth or shape recovery

- G06T7/55—Depth or shape recovery from multiple images

- G06T7/593—Depth or shape recovery from multiple images from stereo images

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01B—MEASURING LENGTH, THICKNESS OR SIMILAR LINEAR DIMENSIONS; MEASURING ANGLES; MEASURING AREAS; MEASURING IRREGULARITIES OF SURFACES OR CONTOURS

- G01B2210/00—Aspects not specifically covered by any group under G01B, e.g. of wheel alignment, caliper-like sensors

- G01B2210/52—Combining or merging partially overlapping images to an overall image

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10004—Still image; Photographic image

- G06T2207/10012—Stereo images

Landscapes

- Engineering & Computer Science (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Length Measuring Devices By Optical Means (AREA)

- Testing, Inspecting, Measuring Of Stereoscopic Televisions And Televisions (AREA)

Abstract

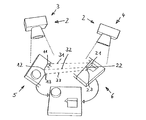

【解決手段】対象物1を撮影した写真から対象物1の2D特徴点11,12,13;21,22,23を決定する。これら2D特徴点の3D座標を決定する。一の写真と別の写真との間で互いに対応する2D特徴点からなる2D点対応組31,32,33を複数組決定する。これら2D点対応組の中から複数組の2D点対応組を選択して3D変換対象を決定する。該3D変換対象の品質を、2D特徴点の3D座標を参照して決定して、該3D変換対象の中から有効3D特徴点を決定する。その有効3D特徴点の3D座標を、対象物1のカメラ画像を組み合わせるために使用する。

【選択図】図1

Description

2 センサ

5,6 写真

11,12,13 2D特徴点

21,22,23 2D特徴点

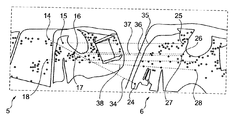

14,15,16,17,18 2D特徴点

24,25,26,27,28 2D特徴点

31,32,33 2D点対応組

34,35,36,37,38 2D点対応組

Claims (9)

- 対象物(1)の複数のカメラ画像を記録して組み合わせて、前記対象物(1)の3D座標を決定する、対象物を3Dデジタル化するための方法であって、

前記対象物(1)を撮影した写真(5,6)から、前記対象物(1)の2D特徴点(11,12,13;21,22,23;14,15,16,17,18;24,25,26,27,28)を決定し、

前記2D特徴点の3D座標を決定し、

一の写真と別の写真との間で互いに対応する2D特徴点からなる2D点対応組(31,32,33;34,35,36,37,38)を複数組決定し、

前記決定した複数組の2D点対応組の中から複数組の2D点対応組を選択して3D変換対象を決定し、

前記3D変換対象の品質を、前記2D特徴点の前記3D座標を参照して決定して、該3D変換対象の中から有効3D特徴点を決定し、

前記有効3D特徴点の3D座標を、前記対象物の前記カメラ画像を組み合わせるために使用することを特徴とする方法。 - 請求項1記載の方法において、

各写真(5,6)において対象物領域を決定し、

前記対象物領域内の2D特徴点(14,15,16,17,18;24,25,26,27,28)を使用することを特徴とする方法。 - 請求項1又は2記載の方法において、

格納された前記2D特徴点、格納された前記3D特徴点、及び、格納された特徴ベクトルのうちの少なくとも1つを使用することを特徴とする方法。 - 請求項1〜3のいずれか1つに記載の方法において、

前記2D特徴点、前記3D特徴点、及び、特徴ベクトルのうちの少なくとも1つを、前記対象物のCADデータの描画から決定することを特徴とする方法。 - 請求項1〜4のいずれか1つに記載の方法において、

前記対象物のCADデータの描画から決定した、前記2D特徴点、前記3D特徴点、及び、特徴ベクトルのうちの少なくとも1つを使用することを特徴とする方法。 - 対象物を3Dデジタル化する方法を実施するための装置であって、

前記対象物(1)に対して光パターン又はレーザ光パターンを投影するための投影機と、

前記対象物のカメラ画像を記録するための1つ又は複数のカメラと、

前記対象物の前記カメラ画像を組み合わせ、前記対象物の3D座標を決定するための手段と、

前記対象物の写真を作成するためのカメラと、

前記対象物の2D特徴点を決定し、かつ、前記対象物の前記2D特徴点の3D座標を決定し、かつ、一の写真と別の写真との間で互いに対応する2D特徴点からなる2D点対応組を複数組決定し、かつ、前記決定した複数組の2D点対応組の中から複数組の2D点対応組を選択して3D変換対象を決定し、かつ、前記3D変換対象の品質を、前記2D特徴点の3D座標を参照して決定し、かつ、有効3D特徴点を決定するための手段とを備えることを特徴とする装置。 - 請求項6記載の装置において、

前記写真の対象物領域を決定するための手段を更に備えることを特徴とする装置。 - 請求項6又は7記載の装置において、

前記2D特徴点、前記3D特徴点、及び、特徴ベクトルの少なくとも1つを格納するための記憶装置を更に備えることを特徴とする装置。 - 請求項6〜8のいずれか1つに記載の装置において、

前記2D特徴点、前記3D特徴点、及び、特徴ベクトルを、前記対象物のCADデータの描画から決定するための手段を更に備えることを特徴とする装置。

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| DE102008031942.2 | 2008-06-07 | ||

| DE102008031942A DE102008031942A1 (de) | 2008-07-07 | 2008-07-07 | Verfahren und Vorrichtung zur 3D-Digitalisierung eines Objekts |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2010014718A true JP2010014718A (ja) | 2010-01-21 |

| JP5453000B2 JP5453000B2 (ja) | 2014-03-26 |

Family

ID=41019838

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2009160969A Expired - Fee Related JP5453000B2 (ja) | 2008-07-07 | 2009-07-07 | 対象物を3dデジタル化するための方法及び装置 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US8330803B2 (ja) |

| EP (1) | EP2144036B1 (ja) |

| JP (1) | JP5453000B2 (ja) |

| DE (1) | DE102008031942A1 (ja) |

Cited By (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20150259811A1 (en) * | 2013-09-06 | 2015-09-17 | Permelec Electrode Ltd. | Production method for electrode for electrolysis |

| JP2016048239A (ja) * | 2014-08-27 | 2016-04-07 | ステインビッヒラー オプトテヒニク ゲゼルシャフト ミット ベシュレンクテル ハフツング | 物体の3d座標を測定するための方法および装置 |

| JP2022520754A (ja) * | 2019-02-12 | 2022-04-01 | ボリュームグラフィックス ゲーエムベーハー | 測定データにおいて表面を決定するためのコンピュータ実装方法 |

Families Citing this family (23)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US9479768B2 (en) | 2009-06-09 | 2016-10-25 | Bartholomew Garibaldi Yukich | Systems and methods for creating three-dimensional image media |

| DE102010034987A1 (de) | 2010-08-20 | 2012-03-01 | Steinbichler Optotechnik Gmbh | Verfahren zur 3D-Digitalisierung eines Objekts mit veränderlicher Oberfläche |

| US8754929B1 (en) * | 2011-05-23 | 2014-06-17 | John Prince | Real time vergence control for 3D video capture and display |

| EP2698763A1 (de) * | 2012-08-14 | 2014-02-19 | Hölscher & Leuschner GmbH & Co. | Verfahren zur Analyse eines lebenden Nutztieres |

| DE102012024012A1 (de) * | 2012-12-06 | 2014-06-26 | Audi Ag | Verfahren zur Bestimmung eines Parameters zum Einstellen einer optischen Messeinrichtung sowie Vorrichtung und Computerprogrammprodukt zur Durchführung eines derartigen Verfahrens |

| JP6566768B2 (ja) * | 2015-07-30 | 2019-08-28 | キヤノン株式会社 | 情報処理装置、情報処理方法、プログラム |

| DE102016211657A1 (de) | 2016-06-28 | 2017-12-28 | Carl Zeiss Industrielle Messtechnik Gmbh | Verfahren und Vorrichtung zur Erzeugung eines resultierenden Abbildes einer Oberfläche |

| FR3063172A1 (fr) | 2017-02-21 | 2018-08-24 | Yann Viellard | Dispositif et procede pour la numerisation 3d sans contact d'un objet. |

| EP3444780A1 (de) | 2017-08-18 | 2019-02-20 | a.tron3d GmbH | Verfahren zum registrieren von wenigstens zwei verschiedenen 3d-modellen |

| US11199397B2 (en) | 2017-10-08 | 2021-12-14 | Magik Eye Inc. | Distance measurement using a longitudinal grid pattern |

| CN108195314B (zh) * | 2018-01-17 | 2019-11-05 | 杨佳苗 | 基于多视场拼接的反射式条纹三维面形测量方法 |

| WO2019182871A1 (en) | 2018-03-20 | 2019-09-26 | Magik Eye Inc. | Adjusting camera exposure for three-dimensional depth sensing and two-dimensional imaging |

| KR102843952B1 (ko) | 2018-06-06 | 2025-08-08 | 매직 아이 인코포레이티드 | 고밀도 프로젝션 패턴들을 사용한 거리 측정 방법 |

| US11475584B2 (en) | 2018-08-07 | 2022-10-18 | Magik Eye Inc. | Baffles for three-dimensional sensors having spherical fields of view |

| CN113272624B (zh) | 2019-01-20 | 2024-11-26 | 魔眼公司 | 包括具有多个通带的带通滤波器的三维传感器 |

| WO2020197813A1 (en) | 2019-03-25 | 2020-10-01 | Magik Eye Inc. | Distance measurement using high density projection patterns |

| EP3970362A4 (en) * | 2019-05-12 | 2023-06-21 | Magik Eye Inc. | MAPPING OF THREE-DIMENSIONAL DEPTH MAP DATA TO TWO-DIMENSIONAL IMAGES |

| CN110018174B (zh) * | 2019-05-22 | 2021-10-22 | 合肥联宝信息技术有限公司 | 一种检测物体外观的方法和装置 |

| EP4065929A4 (en) | 2019-12-01 | 2023-12-06 | Magik Eye Inc. | IMPROVING TRIANGULATION-BASED THREE-DIMENSIONAL DISTANCE MEASUREMENTS WITH TIME OF FLIGHT INFORMATION |

| JP7598381B2 (ja) | 2019-12-29 | 2024-12-11 | マジック アイ インコーポレイテッド | 3次元座標と2次元特徴点との関連付け |

| WO2021138677A1 (en) | 2020-01-05 | 2021-07-08 | Magik Eye Inc. | Transferring the coordinate system of a three-dimensional camera to the incident point of a two-dimensional camera |

| DE102020201097B4 (de) * | 2020-01-30 | 2023-02-16 | Carl Zeiss Industrielle Messtechnik Gmbh | Anordnung und Verfahren zur optischen Objektkoordinatenermittlung |

| CN111586449B (zh) * | 2020-04-15 | 2021-11-19 | 中影华夏电影科技(北京)有限公司 | 一种主副服务器影片同步播放的方法及系统 |

Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH09212643A (ja) * | 1996-02-05 | 1997-08-15 | Meidensha Corp | 三次元物体認識方法及びその装置 |

| JP2003006618A (ja) * | 2001-06-27 | 2003-01-10 | Minolta Co Ltd | 3次元モデルの生成方法および装置並びにコンピュータプログラム |

| JP2005202945A (ja) * | 2003-12-17 | 2005-07-28 | United Technol Corp <Utc> | Cadモデリングシステム及び方法 |

Family Cites Families (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2000194863A (ja) * | 1998-12-28 | 2000-07-14 | Nippon Telegr & Teleph Corp <Ntt> | 3次元構造獲得・復元方法、装置、および3次元構造獲得・復元プログラムを記録した記録媒体 |

| JP3751770B2 (ja) * | 1999-07-08 | 2006-03-01 | 富士通株式会社 | 3次元形状生成装置 |

| US7327857B2 (en) * | 2004-03-09 | 2008-02-05 | General Electric Company | Non-contact measurement method and apparatus |

| AU2006222458B2 (en) * | 2005-03-11 | 2011-06-02 | Creaform Inc. | Auto-referenced system and apparatus for three-dimensional scanning |

| US20070052700A1 (en) * | 2005-09-07 | 2007-03-08 | Wheeler Frederick W | System and method for 3D CAD using projection images |

| JP5362189B2 (ja) * | 2006-05-10 | 2013-12-11 | 株式会社トプコン | 画像処理装置及びその処理方法 |

| US7925049B2 (en) * | 2006-08-15 | 2011-04-12 | Sri International | Stereo-based visual odometry method and system |

-

2008

- 2008-07-07 DE DE102008031942A patent/DE102008031942A1/de not_active Withdrawn

-

2009

- 2009-06-29 EP EP09008467.4A patent/EP2144036B1/de not_active Not-in-force

- 2009-07-06 US US12/459,640 patent/US8330803B2/en not_active Expired - Fee Related

- 2009-07-07 JP JP2009160969A patent/JP5453000B2/ja not_active Expired - Fee Related

Patent Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH09212643A (ja) * | 1996-02-05 | 1997-08-15 | Meidensha Corp | 三次元物体認識方法及びその装置 |

| JP2003006618A (ja) * | 2001-06-27 | 2003-01-10 | Minolta Co Ltd | 3次元モデルの生成方法および装置並びにコンピュータプログラム |

| JP2005202945A (ja) * | 2003-12-17 | 2005-07-28 | United Technol Corp <Utc> | Cadモデリングシステム及び方法 |

Cited By (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20150259811A1 (en) * | 2013-09-06 | 2015-09-17 | Permelec Electrode Ltd. | Production method for electrode for electrolysis |

| US9903031B2 (en) * | 2013-09-06 | 2018-02-27 | De Nora Permelec Ltd | Production method for electrode for electrolysis |

| JP2016048239A (ja) * | 2014-08-27 | 2016-04-07 | ステインビッヒラー オプトテヒニク ゲゼルシャフト ミット ベシュレンクテル ハフツング | 物体の3d座標を測定するための方法および装置 |

| US10502554B2 (en) | 2014-08-27 | 2019-12-10 | Carl Zeiss Optotechnik GmbH | Process and device for determining the 3D coordinates of an object |

| JP2022520754A (ja) * | 2019-02-12 | 2022-04-01 | ボリュームグラフィックス ゲーエムベーハー | 測定データにおいて表面を決定するためのコンピュータ実装方法 |

Also Published As

| Publication number | Publication date |

|---|---|

| JP5453000B2 (ja) | 2014-03-26 |

| EP2144036A3 (de) | 2011-04-06 |

| US8330803B2 (en) | 2012-12-11 |

| US20100007719A1 (en) | 2010-01-14 |

| DE102008031942A1 (de) | 2010-01-14 |

| EP2144036A2 (de) | 2010-01-13 |

| EP2144036B1 (de) | 2018-09-05 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP5453000B2 (ja) | 対象物を3dデジタル化するための方法及び装置 | |

| US9569873B2 (en) | Automated iterative image-masking based on imported depth information | |

| US9396542B2 (en) | Method of estimating imaging device parameters | |

| EP3382645B1 (en) | Method for generation of a 3d model based on structure from motion and photometric stereo of 2d sparse images | |

| JP6793151B2 (ja) | オブジェクトトラッキング装置、オブジェクトトラッキング方法およびオブジェクトトラッキングプログラム | |

| US20150369593A1 (en) | Orthographic image capture system | |

| CN107465906B (zh) | 场景的全景拍摄方法、装置及终端设备 | |

| US12395751B2 (en) | Auxiliary focusing method, apparatus, and system for generating auxiliary focus image based on depth information | |

| TW201118791A (en) | System and method for obtaining camera parameters from a plurality of images, and computer program products thereof | |

| WO2012096747A1 (en) | Forming range maps using periodic illumination patterns | |

| JP2010287174A (ja) | 家具シミュレーション方法、装置、プログラム、記録媒体 | |

| JP2010219825A (ja) | 三次元計測用画像撮影装置 | |

| US20200364900A1 (en) | Point marking using virtual fiducial elements | |

| CN116524022B (zh) | 偏移数据计算方法、图像融合方法、装置及电子设备 | |

| JP6541920B1 (ja) | 情報処理装置、プログラム及び情報処理方法 | |

| CN110189343B (zh) | 图像标注方法、装置及系统 | |

| CN111489384A (zh) | 基于互视角的遮挡评估方法及装置、设备、系统和介质 | |

| CN109934873B (zh) | 标注图像获取方法、装置及设备 | |

| CN113724365B (zh) | 一种三维重建方法及装置 | |

| US20240406363A1 (en) | Handling blur in multi-view imaging | |

| US10360719B2 (en) | Method and apparatus for obtaining high-quality textures | |

| JP2002135807A (ja) | 3次元入力のためのキャリブレーション方法および装置 | |

| CN113287151B (zh) | 信息处理装置、计算机能读取的记录介质和信息处理方法 | |

| CN115797995A (zh) | 人脸活体检测方法、电子设备及存储介质 | |

| JP2021093712A (ja) | 撮像制御装置、評価システム、撮像制御方法及びプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20120618 |

|

| RD02 | Notification of acceptance of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7422 Effective date: 20120913 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20130628 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20130723 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20131022 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20131217 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20140106 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 5453000 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| LAPS | Cancellation because of no payment of annual fees |