JP2006202205A - Speech dialog system - Google Patents

Speech dialog system Download PDFInfo

- Publication number

- JP2006202205A JP2006202205A JP2005015619A JP2005015619A JP2006202205A JP 2006202205 A JP2006202205 A JP 2006202205A JP 2005015619 A JP2005015619 A JP 2005015619A JP 2005015619 A JP2005015619 A JP 2005015619A JP 2006202205 A JP2006202205 A JP 2006202205A

- Authority

- JP

- Japan

- Prior art keywords

- voice

- user

- unit

- dialogue

- search

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Withdrawn

Links

Images

Abstract

Description

本発明は、音声対話システムに関し、より特定的には、音声対話装置と、当該音声対話装置を利用する第1のユーザ及び他の機器を利用する第2のユーザの間の対話を制御する対話制御装置とを備える音声対話システムに関する。 The present invention relates to a voice dialogue system, and more specifically, a dialogue for controlling a dialogue between a voice dialogue device and a first user who uses the voice dialogue device and a second user who uses another device. The present invention relates to a voice interaction system including a control device.

近年、会話ボタンを押すだけで1人以上の相手と通信できるプッシュツートーク(以下、PTT(Push To Talk)と称する)機能が、例えば携帯電話のような音声対話装置に搭載され始めている。このようなPTT機能により、あるユーザから発せられた音声は、デジタルネットワークを介し、予めグループ化された全ての人が携帯する音声対話装置に届く。また、PTTでは、上記のようにして開始される音声は半二重通信でやりとりされる。

しかしながら、上述のような音声対話装置には、対話相手は、予めグループ化されて登録されている必要があるので、音声対話装置のユーザは、たとえ1度しか対話しない相手であっても煩わしい登録操作をしなければならないという問題点がある。 However, since the conversation partners need to be grouped and registered in advance in the voice interaction apparatus as described above, the user of the voice interaction apparatus is troublesome even if it is a partner who only interacts once. There is a problem of having to operate.

さらに言えば、たとえ1度しか対話しない相手であっても、音声対話装置に登録する必要があるため、音声対話装置が備える記憶装置の容量を浪費する場合があるという問題点がある。 Furthermore, there is a problem that the capacity of the storage device included in the voice interactive apparatus may be wasted because it is necessary to register with the voice interactive apparatus even if the other party interacts only once.

それ故に、本発明の目的は、ユーザが登録操作の煩わしさを感じにくい音声対話システムを提供することである。 Therefore, an object of the present invention is to provide a voice dialogue system in which a user does not feel the troublesome registration operation.

上記目的を達成するために、本発明の第1の局面は、音声対話システムに向けられている。音声対話システムは、音声対話装置と、当該音声対話装置を利用する第1のユーザ及び他の機器を利用する第2のユーザの間の対話を制御する対話制御装置とを備える。また、音声対話装置は、第1のユーザが対話を開始するために操作する対話開始部と、対話開始部が操作された後、少なくとも、第1のユーザにより検索内容を表す音声が入力され、入力された検索内容を表す音声データを出力するマイクと、マイクから出力された音声データと共に、第2のユーザを検索するために必要な付加情報を取得する取得部と、取得部により取得された音声データと付加情報とをネットワークに送出するユーザ側送信部とを備える。音声対話制御装置は、音声対話装置から、ネットワークを介して送信されてくる音声データと付加情報とを受信する受信部と、受信部により受信された音声データと付加情報とを検索キーとして、第2のユーザを検索可能に構成されたデータベースを格納する格納部と、受信部により受信された音声データ及び付加情報を使って、格納部に格納されたデータベースを検索して、第1のユーザが今回対話可能な第2のユーザを特定する検索部と、検索部により特定された第2のユーザを1グループ化して、第1及び第2のユーザ間の対話が終了するまでの間は少なくとも、グループに登録された第2のユーザを保持するグループ化部とを備える。 In order to achieve the above object, a first aspect of the present invention is directed to a voice interaction system. The voice dialogue system includes a voice dialogue device and a dialogue control device that controls a dialogue between a first user who uses the voice dialogue device and a second user who uses another device. In addition, the voice interaction device is configured such that a dialogue start unit operated by the first user to start the dialogue, and after the dialogue start unit is operated, at least a voice representing a search content is input by the first user, A microphone that outputs audio data representing the input search content, an acquisition unit that acquires additional information necessary for searching for the second user together with the audio data output from the microphone, and acquired by the acquisition unit A user-side transmitter that transmits the audio data and the additional information to the network. The voice conversation control device receives a voice data and additional information transmitted from the voice dialogue device via the network, and uses the voice data and additional information received by the receiver as search keys. The storage unit storing the database configured to be searchable by the two users, and the database stored in the storage unit using the audio data and the additional information received by the receiving unit, the first user searches At least until the dialogue between the first user and the second user is completed by grouping the second user specified by the search unit and the second user specified by the search unit into a group, A grouping unit for holding second users registered in the group.

また、音声対話装置がプッシュツートーク機能を実装している場合、対話開始部は典型的には、第1のユーザにより操作されるボタンである。 In addition, when the voice interactive apparatus has a push-to-talk function, the dialog start unit is typically a button operated by the first user.

また、音声対話装置が車両に搭載可能な場合において、付加情報は、音声対話装置の現在位置、進行方位、移動速度、目的地及び目的地までの経路を含むグループから選ばれた少なくとも1個を含む。また、検索部は、付加情報を参照して、音声対話装置の現在位置付近、目的地付近及び/又は目的地までの経路付近にいる第2のユーザを検索する。 Further, when the voice interactive device can be mounted on the vehicle, the additional information is at least one selected from the group including the current position, traveling direction, moving speed, destination, and route to the destination of the voice interactive device. Including. The search unit refers to the additional information to search for a second user near the current position of the voice interactive apparatus, near the destination, and / or near the route to the destination.

また、データベースは好ましくは、他の機器の現状を示す状況情報を含んでいる。この場合において、検索部は、データベースに含まれる状況情報を参照して、第2のユーザを検索する。 Also, the database preferably includes status information indicating the current status of other equipment. In this case, the search unit searches for the second user with reference to the situation information included in the database.

また、状況情報は典型的には、他の機器が利用中か否かを示している。この場合において、検索部は、データベースに含まれる状況情報を参照して、現在利用中でない機器の第2のユーザを検索する。 The status information typically indicates whether another device is in use. In this case, the search unit searches for a second user of a device that is not currently in use with reference to the situation information included in the database.

また、音声対話制御装置は好ましくは、受信部により受信された音声データをバッファリングする音声蓄積部と、グループ化部によりグループ化された第2のユーザが利用する機器と、音声対話装置との間のコネクションを確立した後、音声蓄積部にバッファされている音声データを、グループ化部によりグループ化された第2のユーザ側の機器に送信するために、ネットワークに送出する制御装置側送信部をさらに備える。 The voice interaction control device preferably includes an audio storage unit that buffers the audio data received by the receiving unit, a device used by the second user grouped by the grouping unit, and the voice interaction device. After the connection is established, the control device side transmission unit that transmits the audio data buffered in the audio storage unit to the network in order to transmit to the second user side device grouped by the grouping unit Is further provided.

また、音声対話装置は好ましくは、音声対話装置と現在コネクションが確立されている機器のいずれかに対して、第1のユーザの操作に応答して、コネクションの解放を要求するための解放要求信号を出力する解放要求部をさらに備える。ここで、ユーザ側送信部はさらに、解放要求部からの解放要求信号をネットワークに送出し、受信部はさらに、音声対話装置から、ネットワークを介して送信されてくる解放要求信号を受信する。また、対話制御部はさらに、受信部により受信された解放要求信号により指定された機器とのコネクションを解放する。 Further, the voice interaction device preferably has a release request signal for requesting release of the connection in response to the operation of the first user to any of the devices that are currently connected to the voice interaction device. Is further provided. Here, the user side transmission unit further sends a release request signal from the release request unit to the network, and the reception unit further receives a release request signal transmitted from the voice interactive apparatus via the network. The dialogue control unit further releases the connection with the device specified by the release request signal received by the receiving unit.

また、音声対話装置は好ましくは、音声対話装置と現在コネクションが確立されている機器のいずれかのみに対して、第1のユーザの操作に応答して、コネクションの維持を要求するための維持要求信号を出力する維持要求部をさらに備える。ここで、ユーザ側送信部はさらに、維持要求部からの維持要求信号をネットワークに送出し、受信部はさらに、音声対話装置から、ネットワークを介して送信されてくる維持要求信号を受信する。また、対話制御部はさらに、受信部により受信された維持要求信号により指定された機器以外とのコネクションを解放する。 Further, the voice interaction device preferably has a maintenance request for requesting only one of the devices that are currently connected to the voice interaction device to maintain the connection in response to the operation of the first user. A maintenance request unit for outputting a signal is further provided. Here, the user side transmission unit further sends a maintenance request signal from the maintenance request unit to the network, and the reception unit further receives a maintenance request signal transmitted from the voice interactive apparatus via the network. Further, the dialogue control unit further releases a connection with a device other than the device specified by the maintenance request signal received by the receiving unit.

また、本発明の第2の局面は、音声対話装置を利用する第1のユーザ及び他の機器を利用する第2のユーザの間の対話を制御する対話制御装置に向けられており、音声対話装置は、第1のユーザが対話を開始するために操作する対話開始部と、対話開始部が操作された後、少なくとも、第1のユーザにより検索内容を表す音声が入力され、入力された検索内容を表す音声データを出力するマイクと、マイクから出力された音声データと共に、第2のユーザを検索するために必要な付加情報を取得する取得部と、取得部により取得された音声データと付加情報とをネットワークに送出する送信部とを備える。音声対話制御装置は、音声対話装置から、ネットワークを介して送信されてくる音声データと付加情報とを受信する受信部と、受信部により受信された音声データと付加情報とを検索キーとして、第2のユーザを検索可能に構成されたデータベースを格納する格納部と、受信部により受信された音声データ及び付加情報を使って、格納部に格納されたデータベースを検索して、第1のユーザが今回対話可能な第2のユーザを特定する検索部と、検索部により特定された第2のユーザを1グループ化して、第1及び第2のユーザ間の対話が終了するまでの間は少なくとも、グループに登録された第2のユーザを保持するグループ化部とを備える。 The second aspect of the present invention is directed to a dialog control device that controls a dialog between a first user who uses a voice dialog device and a second user who uses another device. The apparatus includes: a dialog start unit operated by a first user to start a dialog; and a search that is input with at least a voice representing a search content input by the first user after the dialog start unit is operated A microphone that outputs audio data representing the contents, an acquisition unit that acquires additional information necessary for searching for the second user together with the audio data output from the microphone, and the audio data acquired by the acquisition unit and the addition A transmission unit for transmitting information to the network. The voice conversation control device receives a voice data and additional information transmitted from the voice dialogue device via the network, and uses the voice data and additional information received by the receiver as search keys. The storage unit storing the database configured to be searchable by the two users, and the database stored in the storage unit using the audio data and the additional information received by the receiving unit, the first user searches At least until the dialogue between the first user and the second user is completed by grouping the second user specified by the search unit and the second user specified by the search unit into a group, A grouping unit for holding second users registered in the group.

また、本発明の第3の局面は、音声対話装置を利用する第1のユーザ及び他の機器を利用する第2のユーザの間の対話を制御する対話制御方法に向けられており、対話制御方法は、第1のユーザによる対話を開始するために操作に応答して、音声対話装置により実行される対話開始ステップと、音声対話装置側で実行され、対話開始ステップが操作された後、少なくとも、第1のユーザにより検索内容を表す音声が入力され、入力された検索内容を表す音声データを出力する音声入力ステップと、音声対話装置側で実行され、音声入力ステップで出力された音声データと共に、第2のユーザを検索するために必要な付加情報を取得する取得ステップと、音声対話装置側で実行され、取得ステップにより取得された音声データと付加情報とをネットワークに送出する送信ステップと、 The third aspect of the present invention is directed to a dialog control method for controlling a dialog between a first user who uses a voice dialog device and a second user who uses another device. The method is responsive to an operation for initiating a dialogue by a first user, wherein a dialogue start step executed by the voice interaction device is executed on the side of the voice interaction device, and at least after the dialogue start step is operated A voice input step for outputting the voice data representing the search content inputted by the first user and a voice input step for outputting the voice data representing the inputted search content, together with the voice data outputted in the voice input step. The acquisition step for acquiring the additional information necessary for searching for the second user, and the voice data and the additional information acquired by the acquisition step executed on the voice interaction device side A transmission step of transmitting to the network,

音声対話制御装置側で実行され、音声対話装置から、ネットワークを介して送信されてくる音声データと付加情報とを受信する受信ステップと、音声対話制御装置に格納されるデータベースを、受信ステップにより受信された音声データと付加情報とを検索キーとして検索して、第1のユーザが今回対話可能な第2のユーザを特定する検索ステップと、音声対話制御装置側で実行され、検索ステップにより特定された第2のユーザを1グループ化して、第1及び第2のユーザ間の対話が終了するまでの間は少なくとも、グループに登録された第2のユーザを保持するグループ化ステップとを備える。 A reception step for receiving voice data and additional information transmitted from the voice interaction device via the network, and a database stored in the voice interaction control device are received by the reception step. A search step for searching the voice data and the additional information as a search key to identify a second user who can interact with the first user at this time; A grouping step for holding the second users registered in the group at least until the second user is grouped into one group and the dialogue between the first and second users ends.

また、本発明の第4の局面は、音声対話装置を利用する第1のユーザ及び他の機器を利用する第2のユーザの間の対話を制御するためのコンピュータプログラムに向けられており、音声対話装置は、第1のユーザが対話を開始するために操作する対話開始部と、対話開始部が操作された後、少なくとも、第1のユーザにより検索内容を表す音声が入力され、入力された検索内容を表す音声データを出力するマイクと、マイクから出力された音声データと共に、第2のユーザを検索するために必要な付加情報を取得する取得部と、取得部により取得された音声データと付加情報とをネットワークに送出する送信部とを備える。ここで、コンピュータプログラムは、音声対話制御装置側で実行され、音声対話装置から、ネットワークを介して送信されてくる音声データと付加情報とを受信する受信ステップと、音声対話制御装置に格納されるデータベースを、受信ステップにより受信された音声データと付加情報とを検索キーとして検索して、第1のユーザが今回対話可能な第2のユーザを特定する検索ステップと、音声対話制御装置側で実行され、検索ステップにより特定された第2のユーザを1グループ化して、第1及び第2のユーザ間の対話が終了するまでの間は少なくとも、グループに登録された第2のユーザを保持するグループ化ステップとを備える。 The fourth aspect of the present invention is directed to a computer program for controlling a dialogue between a first user who uses a voice interaction device and a second user who uses another device. The dialogue device includes a dialogue start unit that is operated by the first user to start the dialogue, and after the dialogue start unit is operated, at least a voice representing a search content is input and input by the first user. A microphone that outputs audio data representing the search contents, an acquisition unit that acquires additional information necessary for searching for the second user together with the audio data output from the microphone, and the audio data acquired by the acquisition unit A transmission unit that transmits the additional information to the network. Here, the computer program is executed on the side of the voice interaction control device, and receives the voice data and additional information transmitted from the voice interaction device via the network, and is stored in the voice interaction control device. The database is searched by using the voice data and the additional information received in the receiving step as search keys, and the search step for specifying the second user who can interact with the first user this time is executed on the side of the voice dialog control device. The group that holds the second users registered in the group at least until the second user specified by the search step is grouped and the dialogue between the first and second users ends. And a conversion step.

以上説明したように、本発明の各局面によれば、ネットワーク上の音声対話制御装置は、音声対話装置からの音声データに応答して、音声対話装置の代理で、検索により特定した対話相手の情報を保持する。従って、第1のユーザは、対話相手となる第2のユーザを音声対話装置に、予めグループ化して登録しておく必要がなくなる。さらに、第2のユーザを音声対話装置に登録する必要がなくなるので、音声対話装置が備える記憶装置の容量を浪費しなくても済むことになる。 As described above, according to each aspect of the present invention, the voice interaction control device on the network responds to the voice data from the voice interaction device, and acts on behalf of the conversation partner specified by the search on behalf of the voice interaction device. Keep information. Therefore, the first user does not need to group and register the second user as the conversation partner in advance in the voice interaction apparatus. Furthermore, since it is not necessary to register the second user in the voice interactive apparatus, it is not necessary to waste the capacity of the storage device provided in the voice interactive apparatus.

本発明の上記及びその他の目的、特徴、局面及び利点は、以下に述べる本発明の詳細な説明を添付の図面とともに理解したとき、より明らかになる。 The above and other objects, features, aspects and advantages of the present invention will become more apparent when the detailed description of the present invention described below is understood in conjunction with the accompanying drawings.

(実施形態)

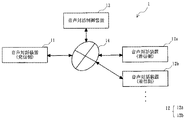

図1は、本発明の実施形態に係る音声対話システム1の全体構成を示す模式図である。図1において、音声対話システム1は、音声対話装置(発信側)11、1台以上の音声対話装置(着信側)12、及び音声対話制御装置13を少なくとも備える。音声対話装置11及び12並びに音声対話制御装置13は、例えばインターネット及び/又はセルラー網のようなネットワーク14を介して、相互に通信可能に接続される。なお、図1には、1台以上の音声対話装置(着信側)12の例として、2台の音声対話装置12a及び12bが示されている。

(Embodiment)

FIG. 1 is a schematic diagram showing an overall configuration of a voice interaction system 1 according to an embodiment of the present invention. In FIG. 1, the voice dialogue system 1 includes at least a voice dialogue device (transmitting side) 11, one or more voice dialogue devices (incoming side) 12, and a voice

音声対話装置11は、例示的には、ハンズフリー機能を有する携帯電話15(図2を参照)と接続された車載端末装置であり、PTT(Push−to−Talk)機能を備えている。このような車載端末装置の例としては、車両に設置可能なナビゲーション装置がある。

The

各音声対話装置12a及び12bは、例示的には、レストランのような施設又は店舗に設置されるPOS(Point Of Sale)端末装置である。具体例と挙げると、音声対話装置12aは店舗Aに設置され、音声対話装置12bは、別の店舗Bに設置される。また、これら音声対話装置12a及び12bは、PTT機能により音声対話装置11から発信された呼を受け付け、その後、音声対話装置11との間で音声通信を行う。

Each of the voice

音声対話制御装置13は、典型的には、呼制御を行うサーバ又はセルラー網におけるパケット交換機に組み込まれ、音声対話装置11のユーザ(以下、発信側ユーザ)と、音声対話装置12a及び12bそれぞれのユーザ(以下、着信側ユーザ)との間で1対多の音声対話(PTT)を制御する装置である。

The voice

次に、音声対話装置11について説明する。図2は、図1に示す音声対話装置11の詳細な構成を示すブロック図である。図2において、音声対話装置11は、通信部111、マイク112、スピーカ113、対話開始部114、CODEC115、付加情報取得部116、制御部117及びメッセージ生成部118を備えている。

Next, the

通信部111は、ネットワーク14に接続されており、音声対話装置11で生成された発信側メッセージ(詳細は後述する)をネットワーク14に送出し、ネットワーク14を介して送られてくる着信側メッセージ(詳細は後述)を受信する。

The communication unit 111 is connected to the

マイク112には、本音声対話装置11のユーザが検索したい対話相手を音声対話制御装置13が検索可能な音声(以下、検索内容と称する)が少なくともユーザにより入力される。その後に続くユーザの話し言葉がマイク112には入力される。このような入力音声をマイク112はアナログ音声信号に変換し、CODEC115に出力する。

The

スピーカ113は、後述するCODEC115から送られてくるアナログ音声信号に従って、対話相手からの話し言葉を出力する。

The

対話開始部114は、典型的にはPTTボタンである。ユーザは、このような対話開始部114を操作した後、より具体的には対話開始部114を操作しながら、マイク112に向かって声を発する。これによって、マイク112からは、入力音声を表すアナログ音声情報がCODEC115に出力される。

The

CODEC115は、マイク112からのアナログ音声信号をデジタル音声信号に変換して、制御部117に出力する。CODEC115はさらに、通信部111により受信されたデジタル音声信号を、制御部117を介して取得し、取得したデジタル音声信号をアナログ音声信号に変換して、スピーカ113に出力する。

The

付加情報取得部116は、ユーザの現在位置を特定可能な位置情報、及び/又はユーザを特定可能な個人情報を、付加情報として取得する。

The additional

位置情報は、現在位置そのもの、現在走行中の道路の名称、現在位置する交差点の名称、目的地の位置、ユーザの移動速度、ユーザの進行方位、又は、目的地に到達するまでの経路若しくは、これらのグループから選ばれた2個以上の組み合わせである。なお、以上のような位置情報を、付加情報取得部116は典型的には、周知のナビゲーションシステムから取得することができる。

The position information is the current position itself, the name of the road that is currently traveling, the name of the intersection where the current position is located, the position of the destination, the user's moving speed, the user's traveling direction, or the route to the destination, or A combination of two or more selected from these groups. Note that the position information as described above can be typically acquired by the additional

また、個人情報は、ユーザの氏名、年齢、住所、電話番号、メールアドレス、ニックネーム又は嗜好情報、若しくは、これらのグループから選ばれたいずれか2個以上の組み合わせである。このような個人情報は、音声対話装置11自身に内蔵されるか、音声対話装置11に接続される記憶装置(図示せず)に格納される。なお、このような個人情報の一部は、不特定の音声対話装置12に送信されないように、音声対話装置11により制御されることが好ましい。具体的には、ユーザが予め許可した項目のみ(例えばニックネーム)が不特定の音声対話装置12に送信されるよう制御される。

The personal information is the user's name, age, address, telephone number, e-mail address, nickname or preference information, or a combination of any two or more selected from these groups. Such personal information is built into the

制御部117は、例えばCPU、ROM及びRAMから構成され、音声対話装置11の各構成を制御する。

The

メッセージ生成部118は、まず、CODEC115から出力されたデジタル音声信号を、制御部117を通じて取得する。さらに、メッセージ生成部118は、付加情報取得部116から出力された付加情報を、制御部117を通じて取得する。メッセージ生成部118は基本的には、取得したデジタル音声信号及び/又は付加情報とを少なくとも含む発信側メッセージを作成して、通信部111に出力する。具体的には、発信側メッセージには、検索内容を表すデジタル音声信号が含まれる。

The

次に、音声対話装置12について説明する。各音声対話装置12は、ネットワーク14に接続されており、PTTベースの対話を行うことが可能な機器である。また、音声対話装置12は、音声対話装置11と同様にして、内部で作成された着信側メッセージをネットワーク14に送出する。ここで、着信側メッセージには、各音声対話装置12のユーザの話し言葉を表すデジタル音声信号が含まれる。また、音声対話装置12は、音声対話装置11により送出された発信側メッセージに含まれるデジタル音声信号を、ネットワーク14を介して受信する。音声対話装置12は、音声対話装置11と同様にして、受信したデジタル音声信号を処理して、それにより表される音声を出力する。

Next, the

次に、音声対話制御装置13について説明する。図3は、図1に示す音声対話制御装置13の詳細な構成を示すブロック図である。図3において、音声対話制御装置13は、音声対話装置11と、1以上の音声対話装置12との間で行われる音声通信を制御するために、通信部131、メッセージ解読部132、データベース格納部133、検索部134、グループ化部135、対話制御部136、メッセージ蓄積部137及び制御部138を備えている。

Next, the voice

通信部131は、ネットワーク14に接続されており、音声対話装置11から送出された発信側メッセージ、及び音声対話装置12から送出された着信側メッセージを、ネットワーク14を介して受信する。

The

また、通信部131は、後述する対話制御部136の処理に従って、コネクション確立要求と共に音声対話装置11から送られてきたデジタル音声信号をネットワーク14に送出する。

Further, the

メッセージ解読部132は、送受信部131により受信された発信側メッセージを取得し、取得したものに含まれるデジタル音声情報及び付加情報を取り出す。取り出されたデジタル音声情報及び付加情報は制御部138に送られる。

The

データベース格納部133は、ネットワーク14に接続されている各音声対話装置12について各種情報を含むデータベースを格納する。ここで、図4は、データベースを構成するレコードの構造を示す模式図である。図4において、レコードは、例示的に1つの音声対話装置12に割り当てられており、識別情報と、店舗名と、アドレスと、位置情報と、店舗情報と、状況情報とを含む。

The

識別情報は、対象となる音声対話装置12を一意に特定可能な情報である。

The identification information is information that can uniquely identify the target

店舗名は、対象となる音声対話装置12が店舗に設置されている場合、その店舗の名称である。

The store name is the name of the store when the target

アドレスは、音声対話装置11が音声対話装置12とPTTで音声対話する前に実行されるグループ化処理(詳細は後述)に必要な情報である。このような情報としては、例えば、対象となる音声対話装置12に割り当てられているグループID、IP(Internet Protocol)アドレス、URI(Uniform Resource Identifier)又は電話番号が挙げられる。

The address is information necessary for a grouping process (details will be described later) executed before the

位置情報は、対象となる音声対話装置12が設置されている位置を示す情報である。

The position information is information indicating the position where the target voice

店舗情報は、対象となる音声対話装置12が店舗に設置されている場合、その店舗が音声対話装置11のユーザに提供可能なサービスを表す情報である。このような店舗情報は、好ましくは、その店舗が提供可能なサービスを大略的に表す概略情報と、それをより具体的に表す詳細情報とを含んでいる。概略情報としては、例えば、「飲食店」があり、詳細情報としては、例えば、「中華料理店」又は「フランス料理店」がある。なお、概略情報及び詳細情報は、図4には特に図示されていない。

The store information is information representing a service that can be provided to the user of the

状況情報は、対象となる音声対話装置12が現在PTTで音声対話を行っているか否かを示す情報である。具体的には、対象となる音声対話装置12と、ある音声対話装置11との間でコネクションが確立されると、つまり音声対話が始まると、例えば「利用中」と、使用状況は対話制御部136により設定される。逆に、コネクションが解放されると、使用状況は、例えば「使用可能」と対話制御部136により設定される。他にも、状況情報としては、対象となる音声対話装置12の電源が入っていないことを示しても構わない。

The status information is information indicating whether or not the target

以上のようなレコードが集まって、データベースは構成される。なお、本実施形態では、便宜上、1つの音声対話装置12に1つのレコードが割り当てられるとして説明するが、場合によっては、複数の音声対話装置12に1つのレコードが割り当てられてもよい。

The database consists of the above records. In the present embodiment, for convenience, one record is assigned to one voice

ここで、再度図3を参照する。検索部134は、メッセージ解読部132により取り出されたデジタル音声情報のうち、最初に送られてくるもの、つまり検索内容をキーワードとして、データベース格納部133に格納されたデータベースを検索する。また、好ましくは、検索部134は、検索内容とともに送られてくる付加情報をさらに使って、データベースを検索する。このような検索で得られた識別情報により、発信側ユーザが今回対話可能な着信側ユーザを、検索部134は特定する。

Here, FIG. 3 will be referred to again. The search unit 134 searches the database stored in the

グループ化部135は、発信側メッセージに含まれる検索内容及び付加情報に加え、検索部134により検索された識別情報(つまり、発信側ユーザが今回対話可能な着信側ユーザ)をグループ化して保持する。

The

対話制御部136は、発信側ユーザと、グループ化部135でグループ化された着信側ユーザとの間でプッシュツートークを行うためのコネクションを確立する。対話制御部136は、例えばSIP(Session Initiation Protocol)のような呼制御プロトコルを使い、検索内容を送った音声対話装置11及びデータベースから検索された音声対話装置12との間でコネクションを確立する。コネクション確立後、音声対話装置11及び音声対話装置12は、音声対話制御装置13を介さずに直接、PTTベースの音声通信を行うことができるが、対話制御部136は、この音声通信を監視することもできる。対話制御部136は、コネクションが確立されると、対象となる音声対話装置12に割り当てられたレコードの状況情報を「使用中」に設定し、コネクションが解放されると、対象となる状況情報を「使用可能」に設定する。

The

音声蓄積部137は、音声対話装置11から送出された発信側メッセージから取り出された検索内容を蓄積する。

The

制御部138は、例えばCPU、ROM及びRAMから構成され、ROMに予め格納されているコンピュータプログラムに従って、音声対話制御装置13の各構成要素を制御する。

The

次に、本実施形態に係る音声対話システムの動作について図面を参照し説明する。図5は、本実施形態に係る音声対話システムにおいて、発信側ユーザ及び着信側ユーザにおける音声対話が始まるまでの音声対話装置11、音声対話制御装置13及び音声対話装置12のそれぞれの動作を示すシーケンス図である。

Next, the operation of the voice interaction system according to the present embodiment will be described with reference to the drawings. FIG. 5 is a sequence diagram showing respective operations of the

まず、音声対話装置11において、メッセージ生成部20は、発信側メッセージを生成する(シーケンスS11)。最初の発信側メッセージには、前述したように、検索内容を表すデジタル音声情報と、付加情報とが少なくとも含まれている。ステップS11で生成された発信側メッセージは、通信部111及び携帯電話15を介してネットワーク14に送出され、音声対話制御装置13へと送信される(シーケンスS12)。

First, in the

音声対話制御装置2において、メッセージ解読部132は、今回受信した発信側メッセージを解読し、それに含まれる検索内容及び付加情報を得る(シーケンスS13)。検索内容及び付加情報は、制御部138に渡され、制御部138は、検索内容をメッセージ蓄積部137に格納し、検索内容及び付加情報を検索部134に渡す。

In the spoken dialogue control apparatus 2, the

次に、検索部134は、受け取った検索内容及び付加情報を使って、データベース格納部133に格納されるデータベースを検索し(シーケンスS14及びS15)、これによって、発信側ユーザが今回音声対話する候補の着信側ユーザ(つまり、音声対話装置12)を選択する。例えば、検索内容が、中華料理店を食べたいであり、付加情報が例えば発信側ユーザの現在位置である場合、検索部134は、データベースの店舗情報及び位置情報をチェックし、発信側ユーザの現在位置周辺の中華料理店に割り当てられたレコードを、少なくとも1つ検索する。なお、PTTベースの音声対話では同報通信が可能であるので、好ましくは、複数のレコードが検索される。さらに好ましくは、検索処理において、検索部134は、状況情報をチェックし、状況情報が「使用可能」と設定されているレコードを検索し、それが「使用不可」と設定されているレコードを検索しない。

Next, the search unit 134 searches the database stored in the

ここで、図6は、検索部134による検索処理の詳細な処理手順を示すフローチャートである。なお、以下では、検索内容は「中華料理を食べたい。」であり、付加情報が発信側ユーザの現在位置であると仮定して、検索処理を説明する。 Here, FIG. 6 is a flowchart showing a detailed processing procedure of search processing by the search unit 134. In the following, the search process will be described on the assumption that the search content is “I want to eat Chinese food” and the additional information is the current location of the user on the transmission side.

まず、検索部134は、データベースにおける「位置情報」のフィールドと、付加情報と比較し、発信者側ユーザの現在位置周辺にある店舗を全て探索する(ステップS40)。この探索で1以上のレコードが見つかった場合には(ステップS41でYes)、検索部134は、ステップS42に処理を移す。レコードが1件も見つからなかった場合には(S41でNo)、検索部134は、ステップS47へ処理を移し、抽出を完了(0件)し、処理を終了する。 First, the search unit 134 compares the “location information” field in the database with the additional information, and searches all stores near the current location of the sender user (step S40). When one or more records are found in this search (Yes in step S41), the search unit 134 moves the process to step S42. If no record is found (No in S41), the search unit 134 moves the process to step S47, completes the extraction (zero), and ends the process.

ステップS42では、検索内容と、ステップS41で見つかったレコードの「店舗情報」フィールドを比較し、検索要求である「中華料理」の条件を満たす店舗のレコードを探索する。もし1以上のレコードが存在すれば(ステップS43でYes)、検索部134はステップS44に処理を移す。逆に、レコードが1つも見つからなかった場合には(ステップS43でNo)、前述のステップS47へ処理を移す。 In step S42, the contents of the search and the “store information” field of the record found in step S41 are compared, and a record of a store that satisfies the condition of “Chinese cuisine” as the search request is searched. If there is one or more records (Yes in step S43), the search unit 134 moves the process to step S44. Conversely, if no record is found (No in step S43), the process proceeds to step S47 described above.

次に、検索部134は、見つかったレコードの状況情報をチェックして、「使用可能」が設定されているレコードを探す(ステップS44)。もし1以上のレコードが存在する場合には(ステップS45でYes)、検索部134はステップS46に処理を移し、今回の対話相手となる着信側ユーザの抽出を完了(1件以上)し(ステップS46)、処理を終了する。逆に、1件も見つからなかった場合には(ステップS45でNo)、検索部134は、S47へ処理を移す。 Next, the search unit 134 checks the status information of the found record and searches for a record for which “usable” is set (step S44). If there is one or more records (Yes in step S45), the search unit 134 moves the process to step S46, and completes extraction (one or more) of the incoming side users who will be the current conversation partner (step 1). S46), the process ends. On the other hand, if none is found (No in step S45), the search unit 134 moves the process to S47.

なお、上述の説明では、上記ではステップS40→S42→S44の順番で検索処理が行われていたが、この順番は変更されても構わない。さらに、一度に検索処理が行われても構わない。 In the above description, the search processing is performed in the order of steps S40 → S42 → S44. However, this order may be changed. Furthermore, the search process may be performed at a time.

また、上述の説明では、付加情報が現在位置であるとして説明したがが、これに限らず、付加情報は、上述のように、現在位置、現在走行中の道路の名称、現在位置する交差点の名称、目的地の位置、ユーザの移動速度、ユーザの進行方位、又は、目的地に到達するまでの経路若しくは、これらのグループから選ばれた2個以上の組み合わせであればよい。このような場合、検索部134は、これらの付加情報を参照して、音声対話装置11(発信側ユーザ)の現在位置付近、目的地付近及び/又は目的地までの経路付近にいる前記第2のユーザを、データベースから検索する。他にも、音声対話装置11が車載用ナビゲーション装置に実装されている場合は、車両が市街地走行か郊外走行かを判断し、市街地なら検索エリアを狭め、郊外走行なら検索エリアを広げたりすることができる。車載用ナビゲーション装置に現在表示されている地図の縮尺情報を基に、画面に表示されているエリア内に存在する着信側ユーザを検索することも、検索部134は可能である。さらに、今回の検索で見つかった着信側ユーザの数が少ない場合、検索部134は、次回の検索では、広範囲のエリアから着信側ユーザを検索し、逆に、検索により得られた着信側ユーザ数が多い場合には、検索部134は、徐々に検索エリアを縮小して検索することもできる。

In the above description, the additional information is described as the current position. However, the present invention is not limited to this, and as described above, the additional information includes the current position, the name of the currently traveling road, and the intersection at the current position. The name, the position of the destination, the moving speed of the user, the traveling direction of the user, the route to reach the destination, or a combination of two or more selected from these groups may be used. In such a case, the search unit 134 refers to the additional information, and the second part that is near the current position, near the destination, and / or near the route to the destination of the voice interaction device 11 (the user on the transmission side). Search the database for users. In addition, when the voice

以上のような検索処理で今回得られたレコードは2個で、そのレコードが割り当てられている店舗には、音声対話装置12a及び12bが設置されていると仮定する。

It is assumed that the number of records obtained this time by the search processing as described above is two, and that the voice

次に、グループ化部135は、今回発信側メッセージを送ってきた音声対話装置11と、今回検索された音声対話装置12とを1グループ化して、保持する(シーケンスS16)。

Next, the

さらに、対話制御部136は、ステップS16でグループ化された音声対話装置11と、音声対話装置12との間でPTTベースの音声通信を行うためのコネクションを確立する(シーケンスS17−S20)。その後、発信側ユーザは、音声対話装置11を使って、着信側ユーザは、音声対話装置12を使って、音声対話を始める(シーケンスS21)。前述の仮定下では、音声対話装置11と、音声対話装置12a及び12bとの間でコネクションが確立され、それらの間で、音声通信が始まる。

Furthermore, the

また、コネクションが確立されると、グループ化された音声対話装置12は音声通信中になるので、対話制御部136は、データベースにおいて、音声通信を開始した音声対話装置12に割り当てられているレコードの状況情報を「使用不可」に設定する。また、上述のように、対話制御部136は、音声対話装置11及び音声対話装置12の間の音声通信を監視できるので、その音声通信が終了すると、対象となるレコードの状況情報を「使用可能」に設定する。

When the connection is established, the grouped

なお、ステップS14の検索処理において、レコードを1つも検索することができなかった場合、音声対話制御装置13は、予め定められた接続先、例えばコンシェルジェサービスセンタへ接続するようにすれば良い。このとき、この接続先と、音声対話装置11とがグループ化される。

If no record can be searched in the search process of step S14, the voice

また、グループ化部135によってグループ化された後、コネクションを確立する前に、音声対話制御装置13が、発信側ユーザに対して、検索により得られた着信側ユーザと音声対話を行うか否か問い合わせても構わない。これにより、発信側ユーザは、音声対話を拒否することができる。この場合、音声対話制御装置13はコネクション確立処理(シーケンスS17−S20)を行わない。

Whether or not the voice

前述のようなコネクション確立処理を行った後、音声対話装置11、音声対話制御装置12及び音声対話装置13の間で行われる音声通信について説明する。図7は、コネクション確立処理後における図1に示す音声対話装置11、音声対話制御装置13及び音声対話装置12のそれぞれの動作を示すシーケンス図である。

The voice communication performed between the

まず、前述したように、発信側ユーザは、音声対話装置11の対話開始部114を操作しながら、検索内容を表す音声をマイク112に入力する。検索内容を表す音声としては、「中華を食べたい。」が例示される。これに応答して、音声対話装置11では、図5を参照して説明したような最初の発信者メッセージが作成される。また、音声対話制御装置12は、この発信者メッセージに含まれる検索内容をメッセージ蓄積部137に蓄積し、さらに、この発信者メッセージを使って、図5を参照して説明したように、発信側ユーザと今回対話すべき着信側ユーザが検索され、音声対話装置11及び12の間でコネクションが確立される。

First, as described above, the calling-side user inputs the voice representing the search content to the

その後、図7に示すように、音声対話制御装置13は、自身のメッセージ蓄積部137に格納される検索内容を表すデジタル音声情報を、対象となる音声対話装置12a及び12bに送信する(シーケンスS22)

このようなデジタル音声情報を受けると、音声対話装置12aの着信側ユーザ、及び音声対話装置12b側の着信側ユーザは、それぞれ、独自に返答を行う。それぞれの返答内容は、音声対話装置12a及び12bのそれぞれから、着信側メッセージが送信され、音声対話装置12aから送出された着信側メッセージは、音声対話装置11及び12bに送信される(シーケンスS23)。また、音声対話装置12bからの着信側メッセージは、音声対話装置11及び12aに送信される(シーケンスS24)。

After that, as shown in FIG. 7, the voice

Upon receiving such digital voice information, the receiving user of the

また、着信側ユーザは、着信側メッセージそれぞれに応答して、返答を音声対話装置11に入力する。応じて、音声対話装置11は、入力された返答に基づき、さらなる発信者メッセージを生成し、音声対話装置12a及び12bに送信する(シーケンスS25)。以降、音声対話が終了するまで、同様のシーケンスが繰り返される(シーケンスS26−S29)。

In addition, the receiving side user inputs a response to the voice

以上説明したように、本実施形態に係る音声対話システムによれば、ネットワーク14上の音声対話制御装置13は、音声対話装置11からの第1回目の発信者側メッセージに応答して、それに含まれる検索内容及び付加情報を使って、着信側ユーザを検索し、検索により得られた着信側ユーザと発信側ユーザとを、音声対話装置11の代理でグループ化して保持する。従って、発信側ユーザは、対話相手となる着信側ユーザを音声対話装置11に、予めグループ化して登録しておく必要がなくなる。さらに、着信側ユーザを音声対話装置11に登録する必要がなくなるので、音声対話装置11が備える記憶装置の容量を浪費しなくても済むことになる。

As described above, according to the voice dialogue system according to the present embodiment, the voice

また、本音声対話装置11を車載端末装置として実現することで、ユーザの情報検索という操作負荷を軽減したり、店舗のアドレス情報を知らなくても検索することができたりする。

Further, by realizing the

なお、ある音声対話装置12からの着信側メッセージは、他の音声対話装置12への届くので、着信側ユーザにとっては常に、発信側ユーザと対話することにはならず、お互いが混乱することも考えられる。このため、音声対話装置12の間では、着信側メッセージのやりとりを禁止するよう制御されても構わない。

In addition, since a receiving side message from a certain voice

また、音声対話装置11が車載用ナビゲーション装置に実装されている場合、着信側メッセージの位置情報を取得することで、車載用ナビゲーション装置は、現在位置から、着信側ユーザの店舗まで経路探索し、着信側ユーザの店舗まで発信側ユーザを案内することができる。

In addition, when the

また、以上の実施形態では、音声対話装置12は、音声対話装置11と同様の構成であり、同様の処理を行うとして説明したが、これに限らず、音声対話装置12は、Bluetoothに代表されるような近距離無線通信プロトコルを実装している場合、複数のヘッドセットが音声対話装置12の介して音声対話に対応することができるようになる。この場合、データベースにおいて、対象となるレコードには、音声対話装置12にアクセス可能なヘッドセット毎の状況情報が付加されることになる。

In the above embodiment, the

また、音声対話装置11に備わる入力装置の一つ(図示せず)に、発信者側のユーザの操作に応答して、現在コネクションが確立されている音声対話装置12のいずれか1個以上に対して、コネクションの解放を要求するための解放要求信号を出力する解放要求機能が割り当てられていることが好ましい。この場合、発信側ユーザが、対象となる入力装置を操作すると、図8に示すように、音声対話装置11の通信部111からは、入力装置からの解放要求信号がネットワーク14に送出され、音声対話制御装置13に送信される(シーケンスS31)。音声対話制御装置13において、通信部131はさらに、ネットワーク14を介して送信されてくる解放要求信号を受信し、対話制御部136は、受信された解放要求信号により指定された音声対話装置12とのコネクションを解放する(シーケンスS31及びS32)。これによって、音声対話装置11は、今回コネクションの解放対象にならなかった残りの音声対話装置12との間でのみ音声通信を継続することになる(シーケンスS33)。

In addition, one of the input devices (not shown) provided in the

他にも、音声対話装置11に備わる入力装置の一つ(図示せず)に、発信側ユーザの操作に応答して、現在コネクションが確立されている音声対話装置12のいずれかのみに対して、コネクションの維持を要求するための維持要求信号を出力する維持要求機能が割り当てられていることが好ましい。この場合、発信側ユーザが、対象となる入力装置を操作すると、音声対話装置11の通信部111からは、入力装置からの維持要求信号がネットワーク14に送出され、音声対話制御装置13に送信される。音声対話制御装置13において、対話制御部136は、今回受信された維持要求信号により指定された音声対話装置12以外とのコネクションを解放する。これによって、音声対話装置11は、今回コネクションの解放対象にならなかった残りの音声対話装置12との間でのみ音声通信を継続することになる。

In addition, one of the input devices (not shown) provided in the

以上の2つの方法により、発信側ユーザは、もはや対話することが不要になった着信側ユーザとの音声対話を打ち切ることが可能となる。 With the above two methods, the calling user can terminate the voice conversation with the called user who no longer needs to talk.

さらに、音声対話制御装置13は、音声対話装置11及び12間の音声通信を監視しているので、両者の間で流れるデジタル音声データが無くなった場合、つまり、一定時間の無音区間が発生した場合には、対話は終了したと判断し、コネクションを自動的に解放するようにしても良い。

Furthermore, since the voice

また、音声対話装置11が車載用ナビゲーション装置に実装されている場合、音声対話装置12の店舗情報から設定された目的地に到着するまでは、対象となる音声対話装置12とのコネクションを維持し、目的地に到着するとコネクションを自動的に解放するようにしても良い。

Further, when the voice

一方、音声対話装置11は移動体である場合があるので、グループに属する音声対話装置12は、時間の経過とともに、つまり移動と共に、発信側ユーザの対話相手としてふさわしくなくなるという状況が発生する。例えば、検索内容が「中華料理を食べたい。」であり、付加情報が現在位置である場合、移動に伴い検索時点での現在位置から発信側ユーザが遠く離れてしまったにも係らず、まだ検索時点の現在地周辺でグループ化された着信側ユーザと音声対話を続けているような状況である。このような状況を回避するために、音声対話制御装置2は、音声対話が行われている間、定期的に音声対話装置11から付加情報を送信してもらうことで、グループ化された音声対話装置11及び12の間に確立されているコネクションの解放、再グループ化を行うことができる。これにより、時々刻々と変動する音声対話装置11の位置情報に応じて、発信側ユーザの検索要求を満たすことのできるグループを保つことができる。

On the other hand, since the

また、制御部138は、上述のようにROMに予め格納されるコンピュータプログラムに従って行っていた。しかし、これに限らず、上述のような処理はハードウェアで実現されても構わない。また、コンピュータプログラムは、CD−ROMのような記憶媒体に記録された状態で頒布されても構わない。他にも、コンピュータプログラムは、ネットワークに接続されたサーバ装置に、端末装置がダウンロード又は可能に格納されていても構わない。

Moreover, the

また、以上の実施形態では、PTTベースの音声対話装置11について説明したので、対話開始部114はボタンであるとして説明した。しかし、これに限らず、音声入力におり対話が開始されるのであれば、対話開始部114は、音声入力装置となる。

In the above embodiment, since the PTT-based

以上、本発明を詳細に説明したが、上記説明はあらゆる意味において例示的なものであり限定的なものではない。本発明の範囲から逸脱することなしに多くの他の改変例及び変形例が可能であることが理解される。 As mentioned above, although this invention was demonstrated in detail, the said description is an illustration in all the meanings, and is not restrictive. It will be appreciated that many other modifications and variations are possible without departing from the scope of the invention.

本発明に係る音声対話システムは、ユーザが登録操作の煩わしさを感じにくいという技術的効果が要求されるPTTベースの音声対話装置等に特に有用である。 The voice interaction system according to the present invention is particularly useful for a PTT-based voice interaction device or the like that requires a technical effect that the user is less likely to feel the troublesome registration operation.

1 音声対話システム

11 音声対話装置(発信側)

12 音声対話装置(着信側)

13 音声対話制御装置

14 ネットワーク

1

12 Spoken dialogue device (incoming side)

13 Spoken

Claims (11)

前記音声対話システムは、音声対話装置と、当該音声対話装置を利用する第1のユーザ及び他の機器を利用する第2のユーザの間の対話を制御する対話制御装置とを備え、

前記音声対話装置は、

前記第1のユーザが対話を開始するために操作する対話開始部と、

前記対話開始部が操作された後、少なくとも、前記第1のユーザにより検索内容を表す音声が入力され、入力された検索内容を表す音声データを出力するマイクと、

前記マイクから出力された音声データと共に、前記第2のユーザを検索するために必要な付加情報を取得する取得部と、

前記取得部により取得された音声データと付加情報とをネットワークに送出するユーザ側送信部とを備え、

前記音声対話制御装置は、

前記音声対話装置から、前記ネットワークを介して送信されてくる音声データと付加情報とを受信する受信部と、

前記受信部により受信された音声データと付加情報とを検索キーとして、前記第2のユーザを検索可能に構成されたデータベースを格納する格納部と、

前記受信部により受信された音声データ及び付加情報を使って、前記格納部に格納されたデータベースを検索して、前記第1のユーザが今回対話可能な第2のユーザを特定する検索部と、

前記検索部により特定された第2のユーザを1グループ化して、前記第1及び前記第2のユーザ間の対話が終了するまでの間は少なくとも、グループに登録された第2のユーザを保持するグループ化部とを備える、音声対話システム。 A spoken dialogue system,

The voice dialogue system includes a voice dialogue device, and a dialogue control device that controls a dialogue between a first user who uses the voice dialogue device and a second user who uses another device,

The voice interaction device

A dialogue start unit operated by the first user to start a dialogue;

After the dialogue start unit is operated, at least a voice representing search content is input by the first user, and a microphone that outputs voice data representing the input search content;

An acquisition unit that acquires additional information necessary for searching for the second user together with audio data output from the microphone;

A user-side transmission unit that transmits the audio data and additional information acquired by the acquisition unit to a network;

The voice interaction control device

A receiving unit for receiving voice data and additional information transmitted from the voice interaction device via the network;

A storage unit for storing a database configured to be able to search for the second user using the audio data and additional information received by the receiving unit as search keys;

A search unit that searches the database stored in the storage unit using the audio data and additional information received by the reception unit, and identifies a second user that the first user can interact with at this time;

The second user specified by the search unit is grouped into one group, and at least the second user registered in the group is held until the dialogue between the first and second users is ended. A voice dialogue system comprising a grouping unit.

前記検索部は、前記付加情報を参照して、前記音声対話装置の現在位置付近、目的地付近及び/又は目的地までの経路付近にいる前記第2のユーザを検索する、請求項1に記載の音声対話システム。 When the voice interactive device can be mounted on a vehicle, the additional information is at least one selected from the group including the current position, traveling direction, moving speed, destination, and route to the destination of the voice interactive device. Including

2. The search unit according to claim 1, wherein the search unit searches for the second user near the current position of the voice interactive apparatus, near the destination and / or near the route to the destination with reference to the additional information. Voice dialogue system.

前記検索部は、前記データベースに含まれる状況情報を参照して、前記第2のユーザを検索する、請求項1に記載の音声対話システム。 The database includes status information indicating the current status of the other device,

The spoken dialogue system according to claim 1, wherein the search unit searches for the second user with reference to status information included in the database.

前記検索部は、前記データベースに含まれる状況情報を参照して、現在利用中でない機器の第2のユーザを検索する、請求項4に記載の音声対話システム。 The status information indicates whether the other device is in use,

The spoken dialogue system according to claim 4, wherein the search unit searches for a second user of a device that is not currently in use by referring to status information included in the database.

前記受信部により受信された音声データをバッファリングする音声蓄積部と、

前記グループ化部によりグループ化された第2のユーザが利用する機器と、前記音声対話装置との間のコネクションを確立する対話制御部と、

前記対話制御部によりコネクションが確立されると、前記音声蓄積部にバッファされている音声データを、前記グループ化部によりグループ化された第2のユーザの機器に送信するために、前記ネットワークに送出する制御装置側送信部をさらに備える、請求項1に記載の音声対話システム。 The voice interaction control device

An audio storage unit for buffering audio data received by the receiving unit;

A dialogue control unit that establishes a connection between the device used by the second user grouped by the grouping unit and the voice dialogue device;

When a connection is established by the dialog control unit, the audio data buffered in the audio storage unit is sent to the network for transmission to a second user device grouped by the grouping unit. The spoken dialogue system according to claim 1, further comprising a control device-side transmission unit.

前記ユーザ側送信部はさらに、前記解放要求部からの解放要求信号をネットワークに送出し、

前記受信部はさらに、前記音声対話装置から、前記ネットワークを介して送信されてくる解放要求信号を受信し、

前記対話制御部はさらに、前記受信部により受信された解放要求信号により指定された機器とのコネクションを解放する、請求項6に記載の音声対話システム。 The voice interaction device sends a release request signal for requesting release of a connection to one of the devices currently connected to the voice interaction device in response to the operation of the first user. It further includes a release request part for outputting,

The user side transmission unit further sends a release request signal from the release request unit to the network,

The receiving unit further receives a release request signal transmitted from the voice interaction device via the network,

The voice dialogue system according to claim 6, wherein the dialogue control unit further releases the connection with the device specified by the release request signal received by the receiving unit.

前記ユーザ側送信部はさらに、前記維持要求部からの維持要求信号をネットワークに送出し、

前記受信部はさらに、前記音声対話装置から、前記ネットワークを介して送信されてくる維持要求信号を受信し、

前記対話制御部はさらに、前記受信部により受信された維持要求信号により指定された機器以外とのコネクションを解放する、請求項6に記載の音声対話システム。 The voice interaction apparatus is a maintenance request signal for requesting only one of the devices that are currently connected to the voice interaction apparatus to maintain the connection in response to the operation of the first user. Is further provided with a maintenance request unit that outputs

The user side transmission unit further sends a maintenance request signal from the maintenance request unit to the network,

The receiving unit further receives a maintenance request signal transmitted from the voice interaction device via the network,

The voice dialogue system according to claim 6, wherein the dialogue control unit further releases a connection with a device other than the device designated by the maintenance request signal received by the receiving unit.

前記音声対話装置は、

前記第1のユーザが対話を開始するために操作する対話開始部と、

前記対話開始部が操作された後、少なくとも、前記第1のユーザにより検索内容を表す音声が入力され、入力された検索内容を表す音声データを出力するマイクと、

前記マイクから出力された音声データと共に、前記第2のユーザを検索するために必要な付加情報を取得する取得部と、

前記取得部により取得された音声データと付加情報とをネットワークに送出する送信部とを備え、

前記音声対話制御装置は、

前記音声対話装置から、前記ネットワークを介して送信されてくる音声データと付加情報とを受信する受信部と、

前記受信部により受信された音声データと付加情報とを検索キーとして、前記第2のユーザを検索可能に構成されたデータベースを格納する格納部と、

前記受信部により受信された音声データ及び付加情報を使って、前記格納部に格納されたデータベースを検索して、前記第1のユーザが今回対話可能な第2のユーザを特定する検索部と、

前記検索部により特定された第2のユーザを1グループ化して、前記第1及び前記第2のユーザ間の対話が終了するまでの間は少なくとも、グループに登録された第2のユーザを保持するグループ化部とを備える、対話制御装置。 A dialogue control device for controlling a dialogue between a first user who uses a voice dialogue device and a second user who uses another device,

The voice interaction device

A dialogue start unit operated by the first user to start a dialogue;

After the dialogue start unit is operated, at least a voice representing search content is input by the first user, and a microphone that outputs voice data representing the input search content;

An acquisition unit that acquires additional information necessary for searching for the second user together with audio data output from the microphone;

A transmission unit that sends the audio data and additional information acquired by the acquisition unit to a network;

The voice interaction control device

A receiving unit for receiving voice data and additional information transmitted from the voice interaction device via the network;

A storage unit for storing a database configured to be able to search for the second user using the audio data and additional information received by the receiving unit as search keys;

A search unit that searches the database stored in the storage unit using the audio data and additional information received by the reception unit, and identifies a second user that the first user can interact with at this time;

The second user specified by the search unit is grouped into one group, and at least the second user registered in the group is held until the dialogue between the first and second users is ended. A dialog control device comprising a grouping unit.

前記第1のユーザによる対話を開始するために操作に応答して、前記音声対話装置により実行される対話開始ステップと、

前記音声対話装置側で実行され、前記対話開始ステップが操作された後、少なくとも、前記第1のユーザにより検索内容を表す音声が入力され、入力された検索内容を表す音声データを出力する音声入力ステップと、

前記音声対話装置側で実行され、前記音声入力ステップで出力された音声データと共に、前記第2のユーザを検索するために必要な付加情報を取得する取得ステップと、

前記音声対話装置側で実行され、前記取得ステップにより取得された音声データと付加情報とをネットワークに送出する送信ステップと、

前記音声対話制御装置側で実行され、前記音声対話装置から、前記ネットワークを介して送信されてくる音声データと付加情報とを受信する受信ステップと、

前記音声対話制御装置に格納されるデータベースを、前記受信ステップにより受信された音声データと付加情報とを検索キーとして検索して、前記第1のユーザが今回対話可能な第2のユーザを特定する検索ステップと、

前記音声対話制御装置側で実行され、前記検索ステップにより特定された第2のユーザを1グループ化して、前記第1及び前記第2のユーザ間の対話が終了するまでの間は少なくとも、グループに登録された第2のユーザを保持するグループ化ステップとを備える、対話制御方法。 A dialog control method for controlling a dialog between a first user using a voice dialog device and a second user using another device,

An interaction start step executed by the voice interaction device in response to an operation to start an interaction by the first user;

Voice input that is executed on the side of the voice interaction device and after the dialogue start step is operated, at least a voice representing the search content is inputted by the first user, and voice data representing the inputted search content is output. Steps,

An acquisition step for acquiring additional information necessary for searching for the second user together with the voice data output in the voice input step and executed on the voice interaction device side;

A transmission step executed on the side of the voice interaction device and transmitting the voice data and additional information acquired in the acquisition step to a network;

A reception step executed on the side of the voice interaction control device and receiving voice data and additional information transmitted from the voice interaction device via the network;

The database stored in the voice interaction control device is searched using the voice data received in the receiving step and the additional information as a search key, and the second user who can interact with the first user is specified. A search step;

The second user, which is executed on the side of the voice interaction control device and specified by the search step, is grouped into one group, and at least until the dialogue between the first and second users is completed, And a grouping step for holding a registered second user.

前記音声対話装置は、

前記第1のユーザが対話を開始するために操作する対話開始部と、

前記対話開始部が操作された後、少なくとも、前記第1のユーザにより検索内容を表す音声が入力され、入力された検索内容を表す音声データを出力するマイクと、

前記マイクから出力された音声データと共に、前記第2のユーザを検索するために必要な付加情報を取得する取得部と、

前記取得部により取得された音声データと付加情報とをネットワークに送出する送信部とを備え、

前記コンピュータプログラムは、

前記音声対話制御装置側で実行され、前記音声対話装置から、前記ネットワークを介して送信されてくる音声データと付加情報とを受信する受信ステップと、

前記音声対話制御装置に格納されるデータベースを、前記受信ステップにより受信された音声データと付加情報とを検索キーとして検索して、前記第1のユーザが今回対話可能な第2のユーザを特定する検索ステップと、

前記音声対話制御装置側で実行され、前記検索ステップにより特定された第2のユーザを1グループ化して、前記第1及び前記第2のユーザ間の対話が終了するまでの間は少なくとも、グループに登録された第2のユーザを保持するグループ化ステップとを備える、コンピュータプログラム。 A computer program for controlling a dialogue between a first user using a voice interaction device and a second user using another device,

The voice interaction device

A dialogue start unit operated by the first user to start a dialogue;

After the dialogue start unit is operated, at least a voice representing search content is input by the first user, and a microphone that outputs voice data representing the input search content;

An acquisition unit that acquires additional information necessary for searching for the second user together with audio data output from the microphone;

A transmission unit that sends the audio data and additional information acquired by the acquisition unit to a network;

The computer program is

A reception step executed on the side of the voice interaction control device and receiving voice data and additional information transmitted from the voice interaction device via the network;

The database stored in the voice interaction control device is searched using the voice data received in the receiving step and the additional information as a search key, and the second user who can interact with the first user is specified. A search step;

The second user, which is executed on the side of the voice interaction control device and specified by the search step, is grouped into one group, and at least until the dialogue between the first and second users is completed, A computer program comprising: a grouping step for holding a registered second user.

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2005015619A JP2006202205A (en) | 2005-01-24 | 2005-01-24 | Speech dialog system |

| US11/317,195 US20060159238A1 (en) | 2004-12-28 | 2005-12-27 | Voice talk system, voice talk control apparatus, voice talk control method, and voice talk control program |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2005015619A JP2006202205A (en) | 2005-01-24 | 2005-01-24 | Speech dialog system |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2006202205A true JP2006202205A (en) | 2006-08-03 |

| JP2006202205A5 JP2006202205A5 (en) | 2007-02-22 |

Family

ID=36960134

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2005015619A Withdrawn JP2006202205A (en) | 2004-12-28 | 2005-01-24 | Speech dialog system |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2006202205A (en) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2009079950A (en) * | 2007-09-26 | 2009-04-16 | Toshiba Corp | Information processor |

-

2005

- 2005-01-24 JP JP2005015619A patent/JP2006202205A/en not_active Withdrawn

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2009079950A (en) * | 2007-09-26 | 2009-04-16 | Toshiba Corp | Information processor |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US20060159238A1 (en) | Voice talk system, voice talk control apparatus, voice talk control method, and voice talk control program | |

| US7280849B1 (en) | Voice activated dialing for wireless headsets | |

| KR101134256B1 (en) | Sharing profile data between telecommunication devices | |

| JP4282721B2 (en) | Mobile terminal device | |

| EP2262322A1 (en) | Method, system and equipment for shifting call based on a mobile terminal with the same number and a soft terminal | |

| JP2007096838A (en) | Group voice communication controller, voice communication apparatus, and group voice communication system | |

| MXPA06011460A (en) | Conversion of calls from an ad hoc communication network. | |

| US20070225049A1 (en) | Voice controlled push to talk system | |

| JP2008099330A (en) | Information processor, and portable telephone set | |

| JP2006101048A (en) | Ptt communication system, portable terminal device, and conversation start method used for them and program thereof | |

| JP5186922B2 (en) | Push-to-talk terminal, server device, and speaking right acquisition terminal notification method | |

| JP2008258844A (en) | Communication terminal | |

| US20020077826A1 (en) | Voice communication concerning a local entity | |

| US20080045256A1 (en) | Eyes-free push-to-talk communication | |

| JP4440166B2 (en) | Telephone, server device and communication method | |

| US7444160B1 (en) | Silent mode for mobile terminal push-to-talk | |

| KR20110065513A (en) | Network system, communication device, communication method, and communication program | |

| JP2006202205A (en) | Speech dialog system | |

| JP2013110450A (en) | Mobile communication system, terminal device, and communication relay method | |

| JP2012075047A (en) | Ip exchange system and ip exchanger | |

| JP2006186893A (en) | Voice conversation control apparatus | |

| JP5051368B2 (en) | Communication terminal and communication progress display method in communication terminal | |

| WO2017070323A1 (en) | Attentive assistant | |

| WO2008053836A1 (en) | Communication control method, communication system, communication controller, communication terminal, and program | |

| JP2008072195A (en) | Call management device, system and program |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20070105 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20070105 |

|

| A761 | Written withdrawal of application |

Free format text: JAPANESE INTERMEDIATE CODE: A761 Effective date: 20090420 |