EP1606792B1 - Procede d analyse d informations de frequence fondament ale et procede et systeme de conversion de voix mettant en oeuvre un tel procede d analyse - Google Patents

Procede d analyse d informations de frequence fondament ale et procede et systeme de conversion de voix mettant en oeuvre un tel procede d analyse Download PDFInfo

- Publication number

- EP1606792B1 EP1606792B1 EP04716265A EP04716265A EP1606792B1 EP 1606792 B1 EP1606792 B1 EP 1606792B1 EP 04716265 A EP04716265 A EP 04716265A EP 04716265 A EP04716265 A EP 04716265A EP 1606792 B1 EP1606792 B1 EP 1606792B1

- Authority

- EP

- European Patent Office

- Prior art keywords

- fundamental frequency

- spectral

- voice

- samples

- speaker

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Lifetime

Links

- 238000000034 method Methods 0.000 title claims abstract description 57

- 238000004458 analytical method Methods 0.000 title claims abstract description 35

- 238000006243 chemical reaction Methods 0.000 title claims description 28

- 238000001228 spectrum Methods 0.000 claims abstract description 31

- 230000015572 biosynthetic process Effects 0.000 claims abstract description 9

- 230000003595 spectral effect Effects 0.000 claims description 71

- 230000009466 transformation Effects 0.000 claims description 39

- 239000000203 mixture Substances 0.000 claims description 10

- 230000001131 transforming effect Effects 0.000 claims description 8

- 238000002156 mixing Methods 0.000 claims description 6

- 238000003786 synthesis reaction Methods 0.000 claims description 6

- 238000007476 Maximum Likelihood Methods 0.000 claims description 4

- 230000001360 synchronised effect Effects 0.000 claims description 4

- 238000004364 calculation method Methods 0.000 claims description 2

- 238000012512 characterization method Methods 0.000 claims 1

- 239000000523 sample Substances 0.000 description 12

- 239000013598 vector Substances 0.000 description 7

- 238000004422 calculation algorithm Methods 0.000 description 4

- 238000000354 decomposition reaction Methods 0.000 description 3

- 238000010606 normalization Methods 0.000 description 3

- 230000001755 vocal effect Effects 0.000 description 3

- 238000010586 diagram Methods 0.000 description 2

- 239000011159 matrix material Substances 0.000 description 2

- 238000012986 modification Methods 0.000 description 2

- 230000000737 periodic effect Effects 0.000 description 2

- 230000008569 process Effects 0.000 description 2

- 238000013139 quantization Methods 0.000 description 2

- 238000009877 rendering Methods 0.000 description 2

- 241000282414 Homo sapiens Species 0.000 description 1

- 230000001427 coherent effect Effects 0.000 description 1

- 238000004590 computer program Methods 0.000 description 1

- 235000021183 entrée Nutrition 0.000 description 1

- 230000005284 excitation Effects 0.000 description 1

- 230000009021 linear effect Effects 0.000 description 1

- 238000004519 manufacturing process Methods 0.000 description 1

- 239000000463 material Substances 0.000 description 1

- 230000004048 modification Effects 0.000 description 1

- 230000000051 modifying effect Effects 0.000 description 1

- 230000005236 sound signal Effects 0.000 description 1

- 230000002194 synthesizing effect Effects 0.000 description 1

- 210000001260 vocal cord Anatomy 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L25/00—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00

- G10L25/90—Pitch determination of speech signals

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L21/00—Processing of the speech or voice signal to produce another audible or non-audible signal, e.g. visual or tactile, in order to modify its quality or its intelligibility

- G10L21/003—Changing voice quality, e.g. pitch or formants

- G10L21/007—Changing voice quality, e.g. pitch or formants characterised by the process used

- G10L21/013—Adapting to target pitch

- G10L2021/0135—Voice conversion or morphing

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L25/00—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00

- G10L25/03—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 characterised by the type of extracted parameters

- G10L25/24—Speech or voice analysis techniques not restricted to a single one of groups G10L15/00 - G10L21/00 characterised by the type of extracted parameters the extracted parameters being the cepstrum

Landscapes

- Engineering & Computer Science (AREA)

- Computational Linguistics (AREA)

- Signal Processing (AREA)

- Health & Medical Sciences (AREA)

- Audiology, Speech & Language Pathology (AREA)

- Human Computer Interaction (AREA)

- Physics & Mathematics (AREA)

- Acoustics & Sound (AREA)

- Multimedia (AREA)

- Compression, Expansion, Code Conversion, And Decoders (AREA)

- Machine Translation (AREA)

Description

- La présente invention concerne un procédé d'analyse d'informations de fréquence fondamentale contenues dans des échantillons vocaux, et un procédé et un système de conversion de voix mettant en oeuvre ce procédé d'analyse.

- Suivant la nature des sons à émettre, la production de la parole et notamment des sons voisés, peut faire intervenir la vibration des cordes vocales, ce qui se manifeste par la présence dans le signal de parole, d'une structure périodique de période fondamentale dont l'inverse est appelé fréquence fondamentale ou "pitch".

- Dans certaines applications, tels que la conversion de voix, le rendu auditif est primordial et pour obtenir une qualité acceptable, il convient de bien maîtriser les paramètres liés à la prosodie et parmi ces derniers, la fréquence fondamentale.

- Ainsi, il existe aujourd'hui de nombreux procédés d'analyse des informations de fréquence fondamentale contenues dans des échantillons vocaux.

- Ces analyses permettent de déterminer et de modéliser des caractéristiques de la fréquence fondamentale. Par exemple, il existe des procédés permettant de déterminer la pente, ou encore une échelle d'amplitude de la fréquence fondamentale sur l'ensemble d'une base de données d'échantillons vocaux.

- La connaissance de ces paramètres permet d'effectuer des modifications de signaux de parole, par exemple par des mises à l'échelle de fréquence fondamentale entre des locuteurs source et cible, de manière à respecter globalement la moyenne et la variation de la fréquence fondamentale du locuteur cible.

- Cependant, ces analyses ne permettent d'obtenir que des représentations globales et pas de représentations paramétrables de la fréquence fondamentale et ne sont donc pas pertinentes notamment pour des locuteurs dont les styles d'élocution sont différents.

- Par ailleurs, le document « Fundamental Frequency Estimation and Tracking Using Maximum Likelihood Harmonic Matching and HMMs ». Proceedings of ICASSP 1993, 27-30 Apr. 1993, p.I.221-I.224, XP010110214 décrit un procédé d'analyse d'informations de fréquence fondamentale contenues dans des échantillons sonores en utilisant des pics spectraux.

- Le document « A system for voice conversion based on probabilisitc classification and a harmonic plus noise model », Proceedings of ICASSP 1998, 12 mai 1998, p.281-284, XP10279158 décrit un procédé et un système de conversion de voix.

- Le but de la présente invention est de remédier à ce problème, en définissant un procédé d'analyse d'informations de fréquence fondamentale d'échantillons vocaux, permettant la définition d'une représentation paramétrable de la fréquence fondamentale.A cet effet, la présente invention a pour objet un procédé d'analyse d'informations de fréquence fondamentale contenues dans des échantillons vocaux, caractérisé en ce qu'il comporte au moins :

- une étape d'analyse des échantillons vocaux regroupés en trames pour obtenir, pour chaque trame d'échantillons, une représentation d'enveloppe spectrale apte à être transformée dans le cadre de la conversion de voix entre deux locuteurs et la fréquence fondamentale;

- une étape de détermination d'un modèle de densité jointe de la représentation de l'enveloppe spectrale et de la fréquence fondamentale de tous les échantillons; et

- une étape de détermination, à partir de ce modèle et des échantillons vocaux, d'une fonction de prédiction de la fréquence fondamentale en fonction uniquement de la représentation d'enveloppe spectrale.

- Suivant d'autres caractéristiques de ce procédé d'analyse:

- la représentation d'enveloppe spectrale est exprimée sous la forme de coefficients cepstraux ;

- ladite étape d'analyse comporte :

- une sous-étape de modélisation des échantillons vocaux selon une somme d'un signal harmonique et d'un signal de bruit ;

- une sous-étape d'estimation de paramètres de fréquence et au moins de la fréquence fondamentale des échantillons vocaux ;

- une sous-étape d'analyse synchronisée de chaque trame d'échantillons sur sa fréquence fondamentale ; et

- une sous-étape d'estimation des paramètres de représentation d'enveloppe spectrale de chaque trame d'échantillons;

- il comporte en outre une étape de normalisation de la fréquence fondamentale de chaque trame d'échantillons par rapport à la moyenne des fréquences fondamentales des échantillons analysés ;

- ladite étape de détermination d'un modèle correspond à la détermination d'un modèle par mélange de densités gaussiennes ;

- ladite étape de détermination d'un modèle comprend :

- une sous-étape de détermination d'un modèle correspondant à un mélange de densités gaussiennes: et

- une sous-étape d'estimation des paramètres du mélange de densités gaussiennes à partir de l'estimation du maximum de vraisemblance entre les informations de spectre et de fréquence fondamentale des échantillons et du modèle;

- ladite étape de détermination d'une fonction de prédiction est réalisée à partir d'un estimateur de la réalisation de la fréquence fondamentale sachant les informations de spectre des échantillons;

- ladite étape de détermination de la fonction de prédiction de la fréquence fondamentale comprend une sous-étape de détermination de l'espérance conditionnelle de la réalisation de la fréquence fondamentale sachant les informations de spectre à partir de la probabilité a posteriori que les informations de spectre soient obtenues à partir du modèle, l'espérance conditionnelle formant ledit estimateur.

- L'invention a également pour objet un procédé de conversion d'un signal vocal selon la revendication 9 prononcé par un locuteur source en un signal vocal converti dont les caractéristiques ressemblent à celles d'un locuteur cible, comportant au moins :

- une étape de détermination d'une fonction de transformation d'une représentation d'enveloppe spectrale du locuteur source en une représentation d'enveloppe spectrale du locuteur cible, réalisée à partir d'échantillons vocaux du locuteur source et du locuteur cible; et

- une étape de transformation des informations de spectre du signal de voix du locuteur source à convertir à l'aide de ladite fonction de transformation,

- une étape de détermination d'une fonction de prédiction de la fréquence fondamentale en fonction uniquement d'une représentation d'enveloppe spectrale pour le locuteur cible, ladite fonction de prédiction étant obtenue à l'aide d'un procédé d'analyse selon l'une quelconques des revendications 1 à 8; et

- une étape de prédiction de la fréquence fondamentale du signal de voix à convertir par l'application de ladite fonction de prédiction de la fréquence fondamentale auxdites informations de spectres transformés du signal de voix du locuteur source.

- Suivant d'autres caractéristiques de ce procédé de conversion :

- ladite étape de détermination d'une fonction de transformation est réalisée à partir d'un estimateur de la réalisation des caractéristiques spectrales cibles sachant les caractéristiques spectrales source ;

- ladite étape de détermination d'une fonction de transformation comporte :

- une sous-étape de modélisation des échantillons vocaux source et cible selon un modèle de somme d'un signal harmonique et d'un signal de bruit;

- une sous-étape d'alignement entre les échantillons source et cible; et

- une sous-étape de détermination de ladite fonction de transformation à partir du calcul de l'espérance conditionnelle de la réalisation des caractéristiques spectrales cibles sachant la réalisation des caractérisations spectrales sources, l'espérance conditionnelle formant ledit estimateur.

- ladite fonction de transformation est une fonction de transformation d'une représentation de l'enveloppe spectrale ;

- il comporte en outre une étape d'analyse du signal de voix à convertir adaptée pour délivrer lesdites informations relatives au spectre et à la fréquence fondamentale ;

- il comporte en outre une étape de synthèse permettant de former un signal de voix converti à partir au moins des informations de spectre transformées et des informations de fréquence fondamentale prédites.

- L'invention a encore pour objet un système de conversion selon la revendication 15 d'un signal vocal prononcé par un locuteur source en un signal vocal converti dont les caractéristiques ressemblent à celles d'un locuteur cible, système comportant au moins

- des moyens de détermination d'une fonction de transformation de caractéristiques spectrales du locuteur source en caractéristiques spectrales du locuteur cible, recevant en entrée des échantillons vocaux du locuteur source et du locuteur cible ; et

- des moyens de transformation des informations de spectre du signal de voix du locuteur source à convertir par l'application de ladite fonction de transformation délivrée par les moyens,

- des moyens de détermination d'une fonction de prédiction de la fréquence fondamentale en fonction uniquement d'informations relatives au spectre pour le locuteur cible, adaptés pour la mise en oeuvre d'un procédé d'analyse selon l'une quelconque des revendications 1 à 8; et

- des moyens de prédiction de la fréquence fondamentale dudit signal de voix à convertir, par l'application de ladite fonction de prédiction déterminée par lesdits moyens de détermination d'une fonction de prédiction auxdites informations de spectre transformé délivrées par lesdits moyens de transformation.

- Suivant d'autres caractéristiques de ce système :

- il comporte en outre :

- des moyens d'analyse du signal de voix à convertir, adaptés pour délivrer en sortie des informations relatives au spectre et à la fréquence fondamentale du signal de voix à convertir ; et

- des moyens de synthèse permettant de former un signal de voix converti à partir au moins des informations de spectre transformé délivrées par les moyens et des informations de fréquence fondamentale prédites délivrées par les moyens;

- lesdits moyens de détermination d'une fonction de transformation sont adaptés pour délivrer une fonction de transformation de l'enveloppe spectrale ;

- il est adapté pour la mise en oeuvre d'un procédé de conversion de voix tel que défini précédemment.

- L'invention sera mieux comprise à la lecture de la description qui va suivre, donnée uniquement à titre d'exemple et faite en se référant aux dessins annexés, sur lesquels :

- la

Fig.1 est un organigramme d'un procédé d'analyse selon l'invention ; - la

Fig.2 est un organigramme d'un procédé de conversion de voix mettant en oeuvre le procédé d'analyse de l'invention ; et - la

Fig.3 est un schéma bloc fonctionnel d'un système de conversion de voix, permettant la mise en oeuvre du procédé de l'invention décrit à lafigure 2 . - Le procédé de l'invention représenté sur la

figure 1 , est mis en oeuvre à partir d'une base de données d'échantillons vocaux contenant des séquences de parole naturelle. - Le procédé débute par une étape 2 d'analyse des échantillons en les regroupant par trame, afin d'obtenir pour chaque trame d'échantillons, des informations relatives au spectre et notamment à l'enveloppe spectrale et des informations relatives à la fréquence fondamentale.

- Dans le mode de réalisation décrit, cette étape 2 d'analyse est basée sur l'utilisation d'un modèle d'un signal sonore sous la forme d'une somme d'un signal harmonique avec un signal de bruit selon un modèle communément appelé "HNM" (en anglais : Harmonic plus Noise Model).

- En outre, le mode de réalisation décrit est fondé sur une représentation de l'enveloppe spectrale par le cepstre discret.

- En effet, une représentation cepstrale permet de séparer, dans le signal de parole, la composante relative au conduit vocal de la composante résultant de la source, correspondant aux vibrations des cordes vocales et caractérisée par la fréquence fondamentale.

- Ainsi, l'étape 2 d'analyse comporte une sous-étape 4 de modélisation de chaque trame de signal vocal en une partie harmonique représentant la composante périodique du signal, constituée d'une somme de L sinusoïdes harmoniques d'amplitude Al et de phase φl, et d'une partie bruitée représentant le bruit de friction et la variation de l'excitation glottale.

-

- Le terme h(n) représente donc l'approximation harmonique du signal s(n).

- L'étape 2 comporte ensuite une sous-étape 5 d'estimation pour chaque trame, de paramètres de fréquence et notamment de la fréquence fondamentale, par exemple au moyen d'une méthode d'autocorrélation.

- De manière classique, cette analyse HNM délivre la fréquence maximale de voisement. En variante, cette fréquence peut être fixée arbitrairement ou être estimée par d'autres moyens connus.

- Cette sous-étape 5 est suivie d'une sous-étape 6 d'analyse synchronisée de chaque trame sur sa fréquence fondamentale, qui permet d'estimer les paramètres de la partie harmonique ainsi que les paramètres du bruit du signal.

- Dans le mode de réalisation décrit; cette analyse synchronisée correspond à la détermination des paramètres des harmoniques par minimisation d'un critère de moindres carrés pondérés entre le signal complet et sa décomposition harmonique correspondant dans le mode de réalisation décrit, au signal de bruit estimé. Le critère noté E est égal à :

- Dans cette équation, w (n) est la fenêtre d'analyse et Ti est la période fondamentale de la trame courante.

- Ainsi, la fenêtre d'analyse est centrée autour de la marque de la période fondamentale et a pour durée deux fois cette période.

- L'étape 2 d'analyse comporte enfin une sous-étape 7 d'estimation des paramètres des composantes de l'enveloppe spectrale du signal en utilisant par exemple une méthode de cepstre discret régularisé et une transformation en échelle de Bark pour reproduire le plus fidèlement possible les propriétés de l'oreille humaine.

- Ainsi, l'étape 2 d'analyse délivre, pour chaque trame de rang n d'échantillons de signal de parole, un scalaire noté xn comprenant des informations de fréquence fondamentale et un vecteur noté yn comprenant des informations de spectre sous la forme d'une séquence de coefficients cepstraux.

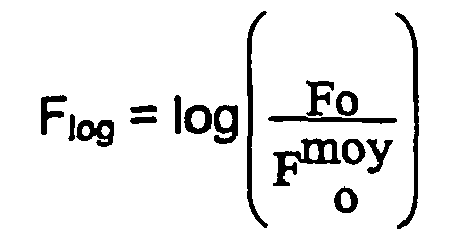

- Avantageusement, l'étape 2 d'analyse est suivie par une étape 10 de normalisation de la valeur de la fréquence fondamentale de chaque trame par rapport à la fréquence fondamentale moyenne afin de remplacer pour chaque trame d'échantillons vocaux, la valeur de la fréquence fondamentale par une valeur de fréquence fondamentale normalisée selon la formule suivante :

-

- Cette normalisation permet de modifier l'échelle des variations des scalaires de fréquence fondamentale afin de la rendre cohérente avec l'échelle des variations des coefficients cepstraux.

- L'étape 10 de normalisation est suivie d'une étape 20 de détermination d'un modèle représentant les caractéristiques communes de cepstre et de fréquence fondamentale de tous les échantillons analysés.

- Dans le mode de réalisation décrit, il s'agit d'un modèle probabiliste de la fréquence fondamentale et du cepstre discret, selon un modèle de mélange de densités gaussiennes couramment noté "GMM", dont les paramètres sont estimés à partir de la densité jointe de la fréquence fondamentale normalisée et du cepstre discret.

-

- Dans cette formule, N(z ; µi ; Σi) est la densité de probabilité de la loi normale de moyenne µi et de matrice de covariance Σi et les coefficients αi sont les coefficients du mélange.

- Ainsi, le coefficient αi correspond à la probabilité a priori que la variable aléatoire z soit générée par la ième gaussienne du mélange.

-

- Dans ces équations, x = [x1, x2, ... xN] correspond à la séquence des scalaires contenant les informations de fréquence fondamentale normalisée pour N trames d'échantillons vocaux et y = [y1, y2,... yN], correspond à la séquence des vecteurs de coefficients cepstraux correspondants.

- L'étape 20 comporte ensuite une sous-étape 24 d'estimation de paramètres GMM (α, µ, Σ) de la densité p(z). Cette estimation peut être réalisée, par exemple, à l'aide d'un algorithme classique de type dit "EM" (Expectation - Maximisation), correspondant à une méthode itérative conduisant à l'obtention d'un estimateur de maximum de vraisemblance entre les données des échantillons de parole et le modèle de mélange de gaussienne.

- La détermination des paramètres initiaux du modèle GMM est obtenue à l'aide d'une technique classique de quantification vectorielle.

- L'étape 20 de détermination de modèle délivre ainsi les paramètres d'un mélange de densités gaussiennes représentatifs des caractéristiques communes des spectres, représentées par les coefficients cepstraux, et des fréquences fondamentales des échantillons vocaux analysés.

- Le procédé comporte ensuite une étape 30 de détermination, à partir du modèle et des échantillons vocaux, d'une fonction de prédiction de la fréquence fondamentale en fonction uniquement d'informations de spectre fournies par le cepstre du signal.

- Cette fonction de prédiction est déterminée à partir d'un estimateur de la réalisation de la fréquence fondamentale étant donné le cepstre des échantillons vocaux, formé dans le mode de réalisation décrit, par l'espérance conditionnelle.

-

- Dans ces équations, Pi(y) correspond à la probabilité a posteriori que le vecteur y de cepstre soit généré par la ième composante du mélange de gaussiennes du modèle, défini lors de l'étape 20 par la matrice de covariance Σi et la loi normale µi.

- La détermination de l'espérance conditionnelle permet ainsi d'obtenir la fonction de prédiction de la fréquence fondamentale à partir des informations de cepstre.

- En variante, l'estimateur mis en oeuvre lors de l'étape 30 peut être un critère de maximum a posteriori, dit "MAP" et correspondant à la réalisation du calcul de l'espérance uniquement pour le modèle représentant le mieux le vecteur source.

- Il apparaît donc que le procédé d'analyse de l'invention permet, à partir du modèle et des échantillons vocaux, d'obtenir une fonction de prédiction de la fréquence fondamentale en fonction uniquement d'informations de spectre fournies, dans le mode de réalisation décrit, par le cepstre.

- Une telle fonction de prédiction permet ensuite de déterminer la valeur de la fréquence fondamentale pour un signal de parole, uniquement à partir d'informations de spectre de ce signal, permettant ainsi une prédiction pertinente de la fréquence fondamentale notamment pour des sons qui ne sont pas dans les échantillons vocaux analysés.

- En référence à la

figure 2 , on va maintenant décrire l'utilisation d'un procédé d'analyse selon l'invention dans le cadre de la conversion de voix. - La conversion de voix consiste à modifier le signal vocal d'un locuteur de référence appelé " locuteur source " de façon que le signal produit semble avoir été prononcé par un autre locuteur nommé " locuteur cible".

- Ce procédé est mis en oeuvre à partir d'une base de données d'échantillons vocaux prononcés par le locuteur source et le locuteur cible.

- De manière classique, un tel procédé comporte une étape 50 de détermination d'une fonction de transformation des caractéristiques spectrales des échantillons vocaux du locuteur source pour les faire ressembler aux caractéristiques spectrales des échantillons vocaux du locuteur cible.

- Dans le mode de réalisation décrit, cette étape 50 est basée sur une analyse de type HNM permettant de déterminer les relations existantes entre les caractéristiques de l'enveloppe spectrale des signaux de parole des locuteurs source et cible.

- Pour cela, il est nécessaire de disposer d'enregistrements vocaux source et cible correspondant à la réalisation acoustique de la même séquence phonétique.

- L'étape 50 comporte une sous-étape 52 de modélisation des échantillons vocaux selon un modèle HNM, de somme de signaux harmoniques et de bruit.

- La sous-étape 52 est suivie d'une sous-étape 54 d'alignement entre les signaux source et cible à l'aide par exemple d'un algorithme classique d'alignement dit "DTW" (en anglais " Dynamic Time Warping").

- L'étape 50 comporte ensuite une sous-étape 56 de détermination d'un modèle tel qu'un modèle de type GMM représentant les caractéristiques communes des spectres des échantillons vocaux des locuteurs source et cible.

- Dans le mode de réalisation décrit, on utilise un modèle GMM à 64 composantes et un unique vecteur contenant les paramètres cepstraux de la source et de la cible, de sorte que l'on peut définir une fonction de transformation spectrale correspondant à un estimateur de la réalisation des paramètres spectraux de cible notés t, sachant les paramètres spectraux de source notés s.

-

- La détermination précise de cette fonction est obtenue par la maximisation de la vraisemblance entre les paramètres de la source et de la cible, obtenue par un algorithme de type EM.

- En variante, l'estimateur peut être formé d'un critère de maximum a posteriori.

- La fonction ainsi définie permet donc de modifier l'enveloppe spectrale d'un signal de parole issue du locuteur source afin de la faire ressembler à l'enveloppe spectrale du locuteur cible.

- Préalablement à cette maximisation, les paramètres du modèle GMM représentant les caractéristiques spectrales communes de la source et de la cible sont initialisés, par exemple, à l'aide d'un algorithme de quantification vectorielle.

- Parallèlement, le procédé d'analyse de l'invention est mis en oeuvre lors d'une étape 60 d'analyse des seuls échantillons vocaux du locuteur cible.

- Ainsi que cela a été décrit à la référence à la

figure 1 , l'étape 60 d'analyse selon l'invention permet d'obtenir, pour le locuteur cible, une fonction de prédiction de la fréquence fondamentale en fonction uniquement d'informations de spectres. - Le procédé de conversion comporte ensuite une étape 65 d'analyse d'un signal de voix à convertir prononcé par le locuteur source, lequel signal à convertir est différent des signaux vocaux utilisés lors des étapes 50 et 60.

- Cette étape d'analyse 65 est réalisée, par exemple, à l'aide d'une décomposition selon le modèle HNM permettant de délivrer des informations de spectre sous la forme de coefficients cepstraux, des informations de fréquence fondamentale ainsi que des informations de phase et de fréquence maximale de voisement.

- Cette étape 65 est suivie d'une étape 70 de transformation des caractéristiques spectrales du signal de voix à convertir par l'application de la fonction de transformation déterminée à l'étape 50, aux coefficients cepstraux définis lors de l'étape 65.

- Cette étape 70 permet notamment la modification de l'enveloppe spectrale du signal de voix à convertir.

- A l'issue de l'étape 70, chaque trame d'échantillons du signal à convertir du locuteur source est ainsi associée à des informations spectrales transformées dont les caractéristiques sont similaires aux caractéristiques spectrales des échantillons du locuteur cible.

- Le procédé de conversion comporte ensuite une étape 80 de prédiction de la fréquence fondamentale pour les échantillons vocaux du locuteur source, par l'application de la fonction de prédiction déterminée selon le procédé de l'invention lors de l'étape 60, aux seules informations spectrales transformées associées au signal de voix à convertir du locuteur source.

- En effet, les échantillons vocaux du locuteur source étant associés à des informations spectrales transformées dont les caractéristiques sont similaires à celles du locuteur cible, la fonction de prédiction définie lors de l'étape 60 permet d'obtenir une prédiction pertinente de la fréquence fondamentale.

- De manière classique, le procédé de conversion comporte ensuite une étape 90 de synthèse du signal de sortie réalisée, dans l'exemple décrit, par une synthèse de type HNM qui délivre directement le signal de voix converti à partir des informations d'enveloppe spectrale transformées délivrées par l'étape 70, des informations de fréquence fondamentale prédites issues de l'étape 80 et des informations de phase et de fréquence maximale de voisement délivrées par l'étape 65.

- Le procédé de conversion mettant en oeuvre le procédé d'analyse de l'invention, permet ainsi d'obtenir une conversion de voix réalisant des modifications de spectres ainsi qu'une prédiction de fréquence fondamentale, de manière à obtenir un rendu auditif de bonne qualité.

- Notamment, l'efficacité d'un tel procédé peut être évaluée à partir d'échantillons vocaux identiques prononcés par le locuteur source et le locuteur cible.

- Le signal vocal prononcé par le locuteur source est converti à l'aide du procédé tel que décrit et la ressemblance du signal converti avec le signal prononcé par le locuteur cible, est évaluée.

- Par exemple, cette ressemblance est calculée sous la forme d'un ratio entre la distance acoustique séparant le signal converti du signal cible et la distance acoustique séparant le signal cible du signal source.

- En calculant la distance acoustique à partir des coefficients cepstraux ou du spectre d'amplitude des signaux obtenu à l'aide de ces coefficients cepstraux, le ratio obtenu pour un signal converti à l'aide du procédé de l'invention est de l'ordre de 0,3 à 0,5.

- Sur la

figure 3 , on a représenté un schéma bloc fonctionnel d'un système de conversion des voix mettant en oeuvre le procédé décrit en référence à lafigure 2 . - Ce système utilise en entrée une base de données 100 d'échantillons vocaux prononcés par le locuteur source et une base de données 102 contenant au moins les mêmes échantillons vocaux prononcés par le locuteur cible.

- Ces deux bases de données sont utilisées par un module 104 de détermination d'une fonction de transformation de caractéristiques spectrales du locuteur source en caractéristiques spectrales du locuteur cible.

- Ce module 104 est adapté pour la mise en oeuvre de l'étape 50 du procédé tel que décrit en référence à la

figure 2 et permet donc la détermination d'une fonction de transformation de l'enveloppe spectrale. - Par ailleurs, le système comporte un module 106 de détermination d'une fonction de prédiction de la fréquence fondamentale en fonction uniquement d'informations relatives au spectre. Le module 106 reçoit pour cela en entrée les échantillons vocaux du seul locuteur cible, contenus dans la base de données 102.

- Le module 106 est adapté pour la mise en oeuvre de l'étape 60 du procédé décrit en référence à la

figure 2 et correspondant au procédé d'analyse de l'invention tel que décrit en référence à lafigure 1 . - Avantageusement, la fonction de transformation délivrée par le module 104 et la fonction de prédiction délivrée par le module 106, sont mémorisées en vue d'une utilisation ultérieure.

- Le système de conversion de voix reçoit en entrée un signal de voix 110 correspondant à un signal de parole prononcé par le locuteur source et destiné à être converti.

- Le signal 110 est introduit dans un module 112 d'analyse du signal, mettant en oeuvre, par exemple, une décomposition de type HNM et permettant de dissocier des informations de spectre du signal 110 sous la forme de coefficients cepstraux et d'informations de fréquence fondamentale. Le module 112 délivre également des informations de phase et de fréquence maximale de voisement obtenues par l'application du modèle HNM.

- Le module 112 met donc en oeuvre l'étape 65 du procédé décrit précédemment.

- Eventuellement cette analyse peut être faite au préalable et les informations sont stockées pour être utilisées ultérieurement

- Les coefficients cepstraux délivrés par le module 112, sont ensuite introduits dans un module 114 de transformation adapté pour appliquer la fonction de transformation déterminée par le module 104.

- Ainsi, le module 114 de transformation met en oeuvre l'étape 70 du procédé décrit en référence à la

figure 2 et délivre des coefficients cepstraux transformés dont les caractéristiques sont similaires aux caractéristiques spectrales du locuteur cible. - Le module 114 réalise ainsi une modification de l'enveloppe spectrale du signal de voix 110.

- Les coefficients cepstraux transformés délivrés par le module 114, sont ensuite introduits dans un module 116 de prédiction de la fréquence fondamentale adaptés pour mettre en oeuvre la fonction de prédiction déterminée par le module 106.

- Ainsi, le module 116 met en oeuvre l'étape 80 du procédé décrit en référence à la

figure 2 et délivre en sortie des informations de fréquence fondamentale prédites à partir uniquement des informations de spectre transformées. - Le système comporte ensuite un module 118 de synthèse recevant en entrée les coefficients cepstraux transformés issus du module 114 et correspondant à l'enveloppe spectrale, les informations de fréquence fondamentale prédites issues du module 116, et les informations de phase et de fréquence maximale de voisement délivrées par le module 112.

- Le module 118 met ainsi en oeuvre l'étape 90 du procédé décrit en référence à la

figure 2 et délivre un signal 120 correspondant au signal de voix 110 du locuteur source, mais dont les caractéristiques de spectre et de fréquence fondamentale ont été modifiées afin d'être similaires à celles du locuteur cible. - Le système décrit peut être mis en oeuvre de diverses manières et notamment à l'aide d'un programme informatique adapté et relié à des moyens matériels d'acquisition sonore.

- Bien entendu, d'autres modes de réalisation que celui décrit peuvent être envisagés.

- Notamment, les modèles HNM et GMM peuvent être remplacés par d'autres techniques et modèles connus de l'homme de l'art, tels que par exemple les techniques dites LSF (Line Spectral Frequencies), LPC (Linear Predictif Coding) ou encore des paramètres relatifs aux formants.

Claims (18)

- Procédé d'analyse d'informations de fréquence fondamentale contenues dans des échantillons vocaux, caractérisé en ce qu'il comporte au moins :- une étape (2) d'analyse des échantillons vocaux regroupés en trames pour obtenir, pour chaque trame d'échantillons, une représentation d'enveloppe spectrale apte à être transformée dans le cadre de la conversion de voix entre deux locuteurs et la fréquence fondamentale;- une étape (20) de détermination d'un modèle de densité jointe de la représentation de l'enveloppe spectrale et de la fréquence fondamentale de tous les échantillons; et- une étape (30) de détermination, à partir de ce modèle et des échantillons vocaux, d'une fonction de prédiction de la fréquence fondamentale en fonction uniquement de la représentation d'enveloppe spectrale.

- Procédé selon la revendication 1, caractérisé en ce que la représentation d'enveloppe spectrale est exprimée sous la forme de coefficients cepstraux.

- Procédé selon l'une quelconque des revendications 1 ou 2, caractérisé en ce que ladite étape d'analyse (2) comporte :- une sous-étape (4) de modélisation des échantillons vocaux selon une somme d'un signal harmonique et d'un signal de bruit ;- une sous-étape (5) d'estimation de paramètres de fréquence et au moins de la fréquence fondamentale des échantillons vocaux;- une sous-étape (6) d'analyse synchronisée de chaque trame d'échantillons sur sa fréquence fondamentale; et- une sous-étape (7) d'estimation des paramètres de représentation d'enveloppe spectrale de chaque trame d'échantillons.

- Procédé selon l'une quelconque des revendications 1 à 3, caractérisé en ce qu'il comporte en outre une étape (10) de normalisation de la fréquence fondamentale de chaque trame d'échantillons par rapport à la moyenne des fréquences fondamentales des échantillons analysés.

- Procédé selon l'une quelconque des revendications 1 à 4, caractérisé en ce que ladite étape (20) de détermination d'un modèle correspond à la détermination d'un modèle par mélange de densités gaussiennes.

- Procédé selon la revendication 5, caractérisé en ce que ladite étape de détermination (20) d'un modèle comprend :- une sous-étape (22) de détermination d'un modèle correspondant à un mélange de densités gaussiennes; et- une sous-étape (24) d'estimation des paramètres du mélange de densités gaussiennes à partir de l'estimation du maximum de vraisemblance entre les informations de spectre et de fréquence fondamentale des échantillons et du modèle.

- Procédé selon l'une quelconque des revendications 1 à 6, caractérisé en ce que ladite étape (30) de détermination d'une fonction de prédiction est réalisée à partir d'un estimateur de la réalisation de la fréquence fondamentale sachant les informations de spectre des échantillons.

- Procédé selon la revendication 7, caractérisé en ce que ladite étape (30) de détermination de la fonction de prédiction de la fréquence fondamentale comprend une sous-étape (32) de détermination de l'espérance conditionnelle de la réalisation de la fréquence fondamentale sachant les informations de spectre à partir de la probabilité a posteriori que les informations de spectre soient obtenues à partir du modèle, l'espérance conditionnelle formant ledit estimateur.

- Procédé de conversion d'un signal vocal prononcé par un locuteur source en un signal vocal converti dont les caractéristiques ressemblent à celles d'un locuteur cible, comportant au moins :- une étape (50) de détermination d'une fonction de transformation d'une représentation d'enveloppe spectrale du locuteur source en une représentation d'enveloppe spectrale du locuteur cible, réalisée à partir d'échantillons vocaux du locuteur source et du locuteur cible; et- une étape (70) de transformation des informations de spectre du signal de voix du locuteur source à convertir à l'aide de ladite fonction de transformation,caractérisé en ce qu'il comporte en outre :- une étape (60) de détermination d'une fonction de prédiction de la fréquence fondamentale en fonction uniquement d'une représentation d'enveloppe spectrale pour le locuteur cible, ladite fonction de prédiction étant obtenue à l'aide d'un procédé d'analyse selon l'une quelconque des revendications 1 à 8; et- une étape (80) de prédiction de la fréquence fondamentale du signal de voix à convertir par l'application de ladite fonction de prédiction de la fréquence fondamentale à la représentation d'enveloppe spectrale transformée du signal de voix du locuteur source.

- Procédé selon la revendication 9, caractérisé en ce que ladite étape (50) de détermination d'une fonction de transformation est réalisée à partir d'un estimateur de la réalisation des caractéristiques spectrales cibles sachant les caractéristiques spectrales source.

- Procédé selon la revendication 10, caractérisé en ce que ladite étape (50) de détermination d'une fonction de transformation comporte :- une sous-étape (52) de modélisation des échantillons vocaux source et cible selon un modèle de somme d'un signal harmonique et d'un signal de bruit;- une sous-étape (54) d'alignement entre les échantillons source et cible; et- une sous-étape (56) de détermination de ladite fonction de transformation à partir du calcul de l'espérance conditionnelle de la réalisation des caractéristiques spectrales cibles sachant la réalisation des caractérisations spectrales sources, l'espérance conditionnelle formant ledit estimateur.

- Procédé selon l'une quelconque des revendications 9 à 11, caractérisé en ce que ladite fonction de transformation est une fonction de transformation d'une représentation de l'enveloppe spectrale.

- Procédé selon l'une quelconque des revendications 9 à 12, caractérisé en ce qu'il comporte en outre une étape (65) d'analyse du signal de voix à convertir adaptée pour délivrer lesdites informations relatives au spectre et à la fréquence fondamentale.

- Procédé selon l'une quelconque des revendications 9 à 13, caractérisé en ce qu'il comporte en outre une étape (90) de synthèse permettant de former un signal de voix converti au moins à partir des informations de spectre transformées et des informations de fréquence fondamentale prédites.

- Système de conversion d'un signal vocal (110) prononcé par un locuteur source en un signal vocal (120) converti dont les caractéristiques ressemblent à celles d'un locuteur cible, système comportant au moins :- des moyens (104) de détermination d'une fonction de transformation de caractéristiques spectrales du locuteur source en caractéristiques spectrales du locuteur cible, recevant en entrée des échantillons vocaux du locuteur source (100) et du locuteur cible (102) : et- des moyens (114) de transformation des informations de spectre du signal de voix (110) du locuteur source à convertir par l'application de ladite fonction de transformation délivrée par les moyens (104),caractérisé en ce qu'il comporte en outre :- des moyens (106) de détermination d'une fonction de prédiction de la fréquence fondamentale en fonction uniquement d'informations relatives au spectre pour le locuteur cible, adaptés pour la mise en oeuvre d'un procédé d'analyse selon l'une quelconque des revendications 1 à 8, à partir d'échantillons vocaux (102) du locuteur cible ; et- des moyens (116) de prédiction de la fréquence fondamentale dudit signal de voix à convertir (110), par l'application de ladite fonction de prédiction déterminée par lesdits moyens (106) de détermination d'une fonction de prédiction auxdites informations de spectre transformé délivrées par lesdits moyens de transformation (114).

- Système selon la revendication 15, caractérisé en ce qu'il comporte en outre :- des moyens (112) d'analyse du signal de voix à convertir (110), adaptés pour délivrer en sortie des informations relatives au spectre et à la fréquence fondamentale du signal de voix à convertir ; et- des moyens (118) de synthèse permettant de former un signal de voix converti à partir au moins des informations de spectre transformé délivrées par les moyens (114) et des informations de fréquence fondamentale prédites délivrées par les moyens (116).

- Système selon l'une quelconque des revendications 15 et 16, caractérisé en ce que lesdits moyens (104) de détermination d'une fonction de transformation sont adaptés pour délivrer une fonction de transformation de l'enveloppe spectrale.

- Système selon l'une quelconque des revendications 15 à 17, caractérisé en ce qu'il est adapté pour la mise en oeuvre d'un procédé de conversion de voix selon l'une quelconque des revendications 9 à 12.

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| FR0303790 | 2003-03-27 | ||

| FR0303790A FR2853125A1 (fr) | 2003-03-27 | 2003-03-27 | Procede d'analyse d'informations de frequence fondamentale et procede et systeme de conversion de voix mettant en oeuvre un tel procede d'analyse. |

| PCT/FR2004/000483 WO2004088633A1 (fr) | 2003-03-27 | 2004-03-02 | Procede d'analyse d'informations de frequence fondamentale et procede et systeme de conversion de voix mettant en oeuvre un tel procede d'analyse |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| EP1606792A1 EP1606792A1 (fr) | 2005-12-21 |

| EP1606792B1 true EP1606792B1 (fr) | 2008-05-14 |

Family

ID=32947218

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| EP04716265A Expired - Lifetime EP1606792B1 (fr) | 2003-03-27 | 2004-03-02 | Procede d analyse d informations de frequence fondament ale et procede et systeme de conversion de voix mettant en oeuvre un tel procede d analyse |

Country Status (8)

| Country | Link |

|---|---|

| US (1) | US7643988B2 (fr) |

| EP (1) | EP1606792B1 (fr) |

| JP (1) | JP4382808B2 (fr) |

| CN (1) | CN100583235C (fr) |

| AT (1) | ATE395684T1 (fr) |

| DE (1) | DE602004013747D1 (fr) |

| FR (1) | FR2853125A1 (fr) |

| WO (1) | WO2004088633A1 (fr) |

Families Citing this family (17)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4241736B2 (ja) * | 2006-01-19 | 2009-03-18 | 株式会社東芝 | 音声処理装置及びその方法 |

| CN101064104B (zh) * | 2006-04-24 | 2011-02-02 | 中国科学院自动化研究所 | 基于语音转换的情感语音生成方法 |

| US20080167862A1 (en) * | 2007-01-09 | 2008-07-10 | Melodis Corporation | Pitch Dependent Speech Recognition Engine |

| JP4966048B2 (ja) * | 2007-02-20 | 2012-07-04 | 株式会社東芝 | 声質変換装置及び音声合成装置 |

| US8131550B2 (en) * | 2007-10-04 | 2012-03-06 | Nokia Corporation | Method, apparatus and computer program product for providing improved voice conversion |

| JP4577409B2 (ja) * | 2008-06-10 | 2010-11-10 | ソニー株式会社 | 再生装置、再生方法、プログラム、及び、データ構造 |

| CN102063899B (zh) * | 2010-10-27 | 2012-05-23 | 南京邮电大学 | 一种非平行文本条件下的语音转换方法 |

| CN102664003B (zh) * | 2012-04-24 | 2013-12-04 | 南京邮电大学 | 基于谐波加噪声模型的残差激励信号合成及语音转换方法 |

| ES2432480B2 (es) * | 2012-06-01 | 2015-02-10 | Universidad De Las Palmas De Gran Canaria | Método para la evaluación clínica del sistema fonador de pacientes con patologías laríngeas a través de una evaluación acústica de la calidad de la voz |

| US9570087B2 (en) * | 2013-03-15 | 2017-02-14 | Broadcom Corporation | Single channel suppression of interfering sources |

| CN105551501B (zh) * | 2016-01-22 | 2019-03-15 | 大连民族大学 | 谐波信号基频估计算法及装置 |

| WO2018138543A1 (fr) * | 2017-01-24 | 2018-08-02 | Hua Kanru | Procédé probabiliste pour estimation de fréquence fondamentale |

| CN108766450B (zh) * | 2018-04-16 | 2023-02-17 | 杭州电子科技大学 | 一种基于谐波冲激分解的语音转换方法 |

| CN108922516B (zh) * | 2018-06-29 | 2020-11-06 | 北京语言大学 | 检测调域值的方法和装置 |

| CN111179902B (zh) * | 2020-01-06 | 2022-10-28 | 厦门快商通科技股份有限公司 | 基于高斯模型模拟共鸣腔的语音合成方法、设备及介质 |

| CN112750446A (zh) * | 2020-12-30 | 2021-05-04 | 标贝(北京)科技有限公司 | 语音转换方法、装置和系统及存储介质 |

| CN115148225A (zh) * | 2021-03-30 | 2022-10-04 | 北京猿力未来科技有限公司 | 语调评分方法、语调评分系统、计算设备及存储介质 |

Family Cites Families (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO1993018505A1 (fr) * | 1992-03-02 | 1993-09-16 | The Walt Disney Company | Systeme de transformation vocale |

| ATE277405T1 (de) * | 1997-01-27 | 2004-10-15 | Microsoft Corp | Stimmumwandlung |

-

2003

- 2003-03-27 FR FR0303790A patent/FR2853125A1/fr active Pending

-

2004

- 2004-03-02 EP EP04716265A patent/EP1606792B1/fr not_active Expired - Lifetime

- 2004-03-02 JP JP2006505682A patent/JP4382808B2/ja not_active Expired - Fee Related

- 2004-03-02 CN CN200480014488.8A patent/CN100583235C/zh not_active Expired - Fee Related

- 2004-03-02 AT AT04716265T patent/ATE395684T1/de not_active IP Right Cessation

- 2004-03-02 DE DE602004013747T patent/DE602004013747D1/de not_active Expired - Lifetime

- 2004-03-02 US US10/551,224 patent/US7643988B2/en not_active Expired - Fee Related

- 2004-03-02 WO PCT/FR2004/000483 patent/WO2004088633A1/fr active IP Right Grant

Also Published As

| Publication number | Publication date |

|---|---|

| CN1795491A (zh) | 2006-06-28 |

| FR2853125A1 (fr) | 2004-10-01 |

| ATE395684T1 (de) | 2008-05-15 |

| US7643988B2 (en) | 2010-01-05 |

| EP1606792A1 (fr) | 2005-12-21 |

| WO2004088633A1 (fr) | 2004-10-14 |

| JP4382808B2 (ja) | 2009-12-16 |

| JP2006521576A (ja) | 2006-09-21 |

| US20060178874A1 (en) | 2006-08-10 |

| DE602004013747D1 (de) | 2008-06-26 |

| CN100583235C (zh) | 2010-01-20 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| EP1606792B1 (fr) | Procede d analyse d informations de frequence fondament ale et procede et systeme de conversion de voix mettant en oeuvre un tel procede d analyse | |

| US7765101B2 (en) | Voice signal conversation method and system | |

| US7792672B2 (en) | Method and system for the quick conversion of a voice signal | |

| Ris et al. | Assessing local noise level estimation methods: Application to noise robust ASR | |

| Helander et al. | Voice conversion using dynamic kernel partial least squares regression | |

| US9368103B2 (en) | Estimation system of spectral envelopes and group delays for sound analysis and synthesis, and audio signal synthesis system | |

| McLoughlin | Line spectral pairs | |

| Acero | Formant analysis and synthesis using hidden Markov models | |

| Le Cornu et al. | Generating intelligible audio speech from visual speech | |

| Milner et al. | Prediction of fundamental frequency and voicing from mel-frequency cepstral coefficients for unconstrained speech reconstruction | |

| EP1526508B1 (fr) | Procédé de sélection d'unités de synthèse | |

| Motlıcek | Feature extraction in speech coding and recognition | |

| Radfar et al. | Monaural speech segregation based on fusion of source-driven with model-driven techniques | |

| Jokinen et al. | Estimating the spectral tilt of the glottal source from telephone speech using a deep neural network | |

| Khonglah et al. | Speech enhancement using source information for phoneme recognition of speech with background music | |

| Al-Radhi et al. | Continuous vocoder applied in deep neural network based voice conversion | |

| EP1846918B1 (fr) | Procede d'estimation d'une fonction de conversion de voix | |

| Orphanidou et al. | Wavelet-based voice morphing | |

| Ou et al. | Probabilistic acoustic tube: a probabilistic generative model of speech for speech analysis/synthesis | |

| Gupta et al. | A new framework for artificial bandwidth extension using H∞ filtering | |

| Grumiaux et al. | Efficient bandwidth extension of musical signals using a differentiable harmonic plus noise model | |

| Sreehari et al. | Automatic short utterance speaker recognition using stationary wavelet coefficients of pitch synchronised LP residual | |

| Orphanidou et al. | Voice morphing using the generative topographic mapping | |

| Huang et al. | Bandwidth-adjusted LPC analysis for robust speech recognition | |

| Ye | Efficient Approaches for Voice Change and Voice Conversion Systems |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PUAI | Public reference made under article 153(3) epc to a published international application that has entered the european phase |

Free format text: ORIGINAL CODE: 0009012 |

|

| 17P | Request for examination filed |

Effective date: 20050921 |

|

| AK | Designated contracting states |

Kind code of ref document: A1 Designated state(s): AT BE BG CH CY CZ DE DK EE ES FI FR GB GR HU IE IT LI LU MC NL PL PT RO SE SI SK TR |

|

| AX | Request for extension of the european patent |

Extension state: AL LT LV MK |

|

| DAX | Request for extension of the european patent (deleted) | ||

| RIN1 | Information on inventor provided before grant (corrected) |

Inventor name: ROSEC, OLIVIER Inventor name: EN-NAJJARY, TAOUFIK |

|

| GRAP | Despatch of communication of intention to grant a patent |

Free format text: ORIGINAL CODE: EPIDOSNIGR1 |

|

| RIC1 | Information provided on ipc code assigned before grant |

Ipc: G10L 21/00 20060101ALN20070817BHEP Ipc: G10L 11/04 20060101AFI20070817BHEP |

|

| GRAS | Grant fee paid |

Free format text: ORIGINAL CODE: EPIDOSNIGR3 |

|

| GRAA | (expected) grant |

Free format text: ORIGINAL CODE: 0009210 |

|

| AK | Designated contracting states |

Kind code of ref document: B1 Designated state(s): AT BE BG CH CY CZ DE DK EE ES FI FR GB GR HU IE IT LI LU MC NL PL PT RO SE SI SK TR |

|

| REG | Reference to a national code |

Ref country code: GB Ref legal event code: FG4D Free format text: NOT ENGLISH |

|

| REG | Reference to a national code |

Ref country code: CH Ref legal event code: EP |

|

| REG | Reference to a national code |

Ref country code: IE Ref legal event code: FG4D |

|

| REF | Corresponds to: |

Ref document number: 602004013747 Country of ref document: DE Date of ref document: 20080626 Kind code of ref document: P |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: SI Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: FI Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 Ref country code: ES Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080825 |

|

| NLV1 | Nl: lapsed or annulled due to failure to fulfill the requirements of art. 29p and 29m of the patents act | ||

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: NL Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 Ref country code: AT Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 Ref country code: PL Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 |

|

| REG | Reference to a national code |

Ref country code: IE Ref legal event code: FD4D |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: IE Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 Ref country code: CZ Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 Ref country code: DK Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 Ref country code: PT Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20081014 Ref country code: SE Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080814 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: RO Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 Ref country code: SK Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 |

|

| PLBE | No opposition filed within time limit |

Free format text: ORIGINAL CODE: 0009261 |

|

| STAA | Information on the status of an ep patent application or granted ep patent |

Free format text: STATUS: NO OPPOSITION FILED WITHIN TIME LIMIT |

|

| 26N | No opposition filed |

Effective date: 20090217 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: BG Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080814 Ref country code: EE Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: IT Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 |

|

| BERE | Be: lapsed |

Owner name: FRANCE TELECOM Effective date: 20090331 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: MC Free format text: LAPSE BECAUSE OF NON-PAYMENT OF DUE FEES Effective date: 20090331 |

|

| REG | Reference to a national code |

Ref country code: CH Ref legal event code: PL |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: LI Free format text: LAPSE BECAUSE OF NON-PAYMENT OF DUE FEES Effective date: 20090331 Ref country code: CH Free format text: LAPSE BECAUSE OF NON-PAYMENT OF DUE FEES Effective date: 20090331 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: BE Free format text: LAPSE BECAUSE OF NON-PAYMENT OF DUE FEES Effective date: 20090331 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: GR Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080815 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: LU Free format text: LAPSE BECAUSE OF NON-PAYMENT OF DUE FEES Effective date: 20090302 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: HU Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20081115 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: TR Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: CY Free format text: LAPSE BECAUSE OF FAILURE TO SUBMIT A TRANSLATION OF THE DESCRIPTION OR TO PAY THE FEE WITHIN THE PRESCRIBED TIME-LIMIT Effective date: 20080514 |

|

| REG | Reference to a national code |

Ref country code: FR Ref legal event code: PLFP Year of fee payment: 13 |

|

| PGFP | Annual fee paid to national office [announced via postgrant information from national office to epo] |

Ref country code: DE Payment date: 20160218 Year of fee payment: 13 |

|

| PGFP | Annual fee paid to national office [announced via postgrant information from national office to epo] |

Ref country code: GB Payment date: 20160223 Year of fee payment: 13 Ref country code: FR Payment date: 20160219 Year of fee payment: 13 |

|

| REG | Reference to a national code |

Ref country code: DE Ref legal event code: R119 Ref document number: 602004013747 Country of ref document: DE |

|

| GBPC | Gb: european patent ceased through non-payment of renewal fee |

Effective date: 20170302 |

|

| REG | Reference to a national code |

Ref country code: FR Ref legal event code: ST Effective date: 20171130 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: FR Free format text: LAPSE BECAUSE OF NON-PAYMENT OF DUE FEES Effective date: 20170331 Ref country code: DE Free format text: LAPSE BECAUSE OF NON-PAYMENT OF DUE FEES Effective date: 20171003 |

|

| PG25 | Lapsed in a contracting state [announced via postgrant information from national office to epo] |

Ref country code: GB Free format text: LAPSE BECAUSE OF NON-PAYMENT OF DUE FEES Effective date: 20170302 |