CN112802440B - 一种显示设备及声音低延迟处理方法 - Google Patents

一种显示设备及声音低延迟处理方法 Download PDFInfo

- Publication number

- CN112802440B CN112802440B CN201911032598.1A CN201911032598A CN112802440B CN 112802440 B CN112802440 B CN 112802440B CN 201911032598 A CN201911032598 A CN 201911032598A CN 112802440 B CN112802440 B CN 112802440B

- Authority

- CN

- China

- Prior art keywords

- audio data

- data

- audio

- chip

- processor

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000003672 processing method Methods 0.000 title claims abstract description 10

- 239000000872 buffer Substances 0.000 claims description 55

- 238000000034 method Methods 0.000 claims description 21

- 230000008569 process Effects 0.000 claims description 18

- 238000012545 processing Methods 0.000 abstract description 30

- 230000005540 biological transmission Effects 0.000 abstract description 28

- 238000002156 mixing Methods 0.000 abstract description 11

- 230000000694 effects Effects 0.000 abstract description 8

- 230000006870 function Effects 0.000 description 55

- 238000004891 communication Methods 0.000 description 50

- 238000010586 diagram Methods 0.000 description 20

- 238000006243 chemical reaction Methods 0.000 description 18

- 238000005070 sampling Methods 0.000 description 10

- 230000003993 interaction Effects 0.000 description 8

- 238000001514 detection method Methods 0.000 description 6

- 230000009977 dual effect Effects 0.000 description 6

- 230000005236 sound signal Effects 0.000 description 6

- 230000009467 reduction Effects 0.000 description 5

- 238000003860 storage Methods 0.000 description 5

- 230000002452 interceptive effect Effects 0.000 description 4

- 230000004044 response Effects 0.000 description 4

- 230000009471 action Effects 0.000 description 3

- 230000008859 change Effects 0.000 description 3

- 230000003287 optical effect Effects 0.000 description 3

- 238000005457 optimization Methods 0.000 description 3

- 230000001755 vocal effect Effects 0.000 description 3

- 239000008186 active pharmaceutical agent Substances 0.000 description 2

- 230000003321 amplification Effects 0.000 description 2

- 238000004458 analytical method Methods 0.000 description 2

- 238000013473 artificial intelligence Methods 0.000 description 2

- 230000015572 biosynthetic process Effects 0.000 description 2

- 230000003139 buffering effect Effects 0.000 description 2

- 238000003199 nucleic acid amplification method Methods 0.000 description 2

- 238000003909 pattern recognition Methods 0.000 description 2

- 230000002093 peripheral effect Effects 0.000 description 2

- 230000001360 synchronised effect Effects 0.000 description 2

- 238000003786 synthesis reaction Methods 0.000 description 2

- 238000012360 testing method Methods 0.000 description 2

- 230000006399 behavior Effects 0.000 description 1

- 230000008901 benefit Effects 0.000 description 1

- 230000000903 blocking effect Effects 0.000 description 1

- 239000002131 composite material Substances 0.000 description 1

- 238000007796 conventional method Methods 0.000 description 1

- 238000005520 cutting process Methods 0.000 description 1

- 230000006837 decompression Effects 0.000 description 1

- 238000013461 design Methods 0.000 description 1

- 238000011161 development Methods 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 238000012905 input function Methods 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- 230000007246 mechanism Effects 0.000 description 1

- 239000000203 mixture Substances 0.000 description 1

- 238000012986 modification Methods 0.000 description 1

- 230000004048 modification Effects 0.000 description 1

- 238000012544 monitoring process Methods 0.000 description 1

- 238000003825 pressing Methods 0.000 description 1

- 230000006641 stabilisation Effects 0.000 description 1

- 238000011105 stabilization Methods 0.000 description 1

- 238000006467 substitution reaction Methods 0.000 description 1

- 230000002194 synthesizing effect Effects 0.000 description 1

- 238000012546 transfer Methods 0.000 description 1

- 230000000007 visual effect Effects 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10H—ELECTROPHONIC MUSICAL INSTRUMENTS; INSTRUMENTS IN WHICH THE TONES ARE GENERATED BY ELECTROMECHANICAL MEANS OR ELECTRONIC GENERATORS, OR IN WHICH THE TONES ARE SYNTHESISED FROM A DATA STORE

- G10H1/00—Details of electrophonic musical instruments

- G10H1/36—Accompaniment arrangements

- G10H1/361—Recording/reproducing of accompaniment for use with an external source, e.g. karaoke systems

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10H—ELECTROPHONIC MUSICAL INSTRUMENTS; INSTRUMENTS IN WHICH THE TONES ARE GENERATED BY ELECTROMECHANICAL MEANS OR ELECTRONIC GENERATORS, OR IN WHICH THE TONES ARE SYNTHESISED FROM A DATA STORE

- G10H1/00—Details of electrophonic musical instruments

- G10H1/36—Accompaniment arrangements

- G10H1/361—Recording/reproducing of accompaniment for use with an external source, e.g. karaoke systems

- G10H1/365—Recording/reproducing of accompaniment for use with an external source, e.g. karaoke systems the accompaniment information being stored on a host computer and transmitted to a reproducing terminal by means of a network, e.g. public telephone lines

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10H—ELECTROPHONIC MUSICAL INSTRUMENTS; INSTRUMENTS IN WHICH THE TONES ARE GENERATED BY ELECTROMECHANICAL MEANS OR ELECTRONIC GENERATORS, OR IN WHICH THE TONES ARE SYNTHESISED FROM A DATA STORE

- G10H1/00—Details of electrophonic musical instruments

- G10H1/36—Accompaniment arrangements

- G10H1/361—Recording/reproducing of accompaniment for use with an external source, e.g. karaoke systems

- G10H1/366—Recording/reproducing of accompaniment for use with an external source, e.g. karaoke systems with means for modifying or correcting the external signal, e.g. pitch correction, reverberation, changing a singer's voice

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10H—ELECTROPHONIC MUSICAL INSTRUMENTS; INSTRUMENTS IN WHICH THE TONES ARE GENERATED BY ELECTROMECHANICAL MEANS OR ELECTRONIC GENERATORS, OR IN WHICH THE TONES ARE SYNTHESISED FROM A DATA STORE

- G10H1/00—Details of electrophonic musical instruments

- G10H1/36—Accompaniment arrangements

- G10H1/361—Recording/reproducing of accompaniment for use with an external source, e.g. karaoke systems

- G10H1/368—Recording/reproducing of accompaniment for use with an external source, e.g. karaoke systems displaying animated or moving pictures synchronized with the music or audio part

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Acoustics & Sound (AREA)

- Multimedia (AREA)

- General Engineering & Computer Science (AREA)

- Controls And Circuits For Display Device (AREA)

Abstract

本申请实施例示出一种显示设备及声音低延迟处理方法,尤其适用于一种社交电视。该显示设备包括:第一芯片,包括第一音频处理器,接收音频数据,将音频数据中的多媒体音频数据与人声数据进行混音,得到第三音频数据,并将第三音频数据通过HDMI或网络传输至第二芯片;第二芯片,包括第二音频处理器,接收并处理来自第一音频处理器输出的第三音频数据,声音再现器,接收并再现来自于第二音频处理器输出的处理后的第三音频数据。本申请提供的显示设备通过第一音频处理器与第二音频处理器优化了音频数据传输的耗时,减少了声音的延迟,给5G网络传输预留了更多的时间,保证了显示设备K歌连麦的低延时体验效果。

Description

技术领域

本申请实施例涉及显示技术。更具体地讲,涉及一种显示设备及声音低延迟处理方法。

背景技术

当前,由于显示设备可以为用户提供诸如音频、视频、图片等的播放画面,受到用户的广泛关注。随着大数据与人工智能的发展,用户对显示设备的功能需求与日俱增。例如,用户想要在显示设备的K歌应用中,与至少一位其他用户进行视频和语音的互动,实现“边看边唱”的需求。

为了迎合5G网络市场,社交电视上,为优化K歌体验,增加K歌新需求,实现在K歌时能异地双方的实时连麦唱歌,及实现双方可以同唱一首歌,音频数据通过5G网络传输给对方APK处理后输出。然而现有显示设备的K歌应用容易出现K歌连麦时声音的延迟,影响用户的使用体验。

发明内容

基于上述技术问题,本申请的目的在于提供一种显示设备及声音低延迟处理方法。

本申请实施例第一方面示出一种显示设备,包括:

第一芯片,所述第一芯片包括:

声音采集器,被配置为采集人声数据;

外部多媒体数据输入接口,被配置为接收视频数据和音频数据;

第一音频处理器,被配置为将所述音频数据与所述人声数据进行混音,得到第三音频数据;

第一视频处理器,被配置为将所述视频数据透传出去;

第二芯片,所述第二芯片包括:

第二音频处理器,被配置为接收并处理来自所述第一音频处理器输出的第三音频数据;

第二视频处理器,被配置为接收并处理来自于所述第一视频处理器输出的视频数据;

声音再现器,被配置为接收并再现来自于所述第二音频处理器输出的处理后的第三音频数据;

显示器,被配置为接收并显示来自于所述第二视频处理器输出的处理后的视频数据。

本申请实施例第二方面示出一种声音低延迟处理方法,所述方法应用于显示设备,所述显示设备包括:声音再现器,第一芯片和第二芯片;

所述第一芯片接收音频数据和采集人声数据;

将所述音频数据和人声数据进行混音,得到第三音频数据;

所述第二芯片接收并处理所述第三音频数据,将处理后的第三音频数据发送至所述声音再现器。

由以上技术方案可知,本申请实施例示出一种显示设备及声音低延迟处理方法。第一芯片的声音采集器采集人声数据,且第一芯片的第一音频处理器接收音频数据,将接收的音频数据与人声数据进行混音,得到第三音频数据,并将第三音频数据通过HDMI或网络传输至第二芯片;第二芯片的第二音频处理器接收并处理第一音频处理器输出的第三音频数据;声音再现器接收并再现来自第二音频处理器输出的处理后的第三音频数据。本申请通过第一音频处理器与第二音频处理器对多媒体音频数据与人声数据进行处理,优化音频数据传输的耗时,减少声音的延迟,给5G网络传输预留更多的时间,以保证K歌连麦的低延时体验效果。

附图说明

为了更清楚地说明本申请实施例或现有技术中的技术方案,下面将对实施例中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本申请的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

图1中示例性示出了根据实施例中显示设备与控制装置之间操作场景的示意图;

图2中示例性示出了根据实施例中控制装置100的硬件配置框图;

图3中示例性示出了根据实施例中显示设备200的硬件配置框图;

图4中示例性示出了根据图3显示设备200的硬件架构框图;

图5中示例性示出了根据实施例中显示设备200的功能配置示意图;

图6a中示例性示出了根据实施例中显示设备200中软件配置示意图;

图6b中示例性示出了根据实施例中显示设备200中应用程序的配置示意图;

图7中示例性示出了根据实施例中显示设备200中用户界面的示意图;

图8为根据一可选实施例示出的一种显示设备的结构框图;

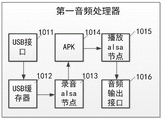

图9为根据一可选实施例示出的显示设备中第一音频处理器的结构框图;

图10为根据一可选实施例示出的显示设备中第二音频处理器的结构框图;

图11中示例性示出了K歌延时不稳定的示意图;

图12为根据一可选实施例示出的显示设备优化后的K歌延迟稳定的示意图;

图13为根据一可选实施例示出的另一种显示设备的结构框图;

图14为根据一可选实施例示出的显示设备中第一音频处理器的另一结构框图;

图15为根据一可选实施例示出的一种声音低延迟处理方法的流程图。

具体实施方式

为使本申请示例性实施例的目的、技术方案和优点更加清楚,下面将结合本申请示例性实施例中的附图,对本申请示例性实施例中的技术方案进行清楚、完整地描述,显然,所描述的示例性实施例仅是本申请一部分实施例,而不是全部的实施例。

为便于用户使用,显示设备上通常会设置各种外部装置接口,以便于连接不同的外设设备或线缆以实现相应的功能。而在显示设备的接口上连接有高清晰度的摄像头时,如果显示设备的硬件系统没有接收源码的高像素摄像头的硬件接口,那么就会导致无法将摄像头接收到的数据呈现到显示设备的显示屏上。

并且,受制于硬件结构,传统显示设备的硬件系统仅支持一路硬解码资源,且通常最大仅能支持4K分辨率的视频解码,因此当要实现边观看网络电视边进行视频聊天时,为了不降低网络视频画面清晰度,就需要使用硬解码资源(通常是硬件系统中的GPU)对网络视频进行解码,而在此情况下,只能采取由硬件系统中的通用处理器(例如CPU)对视频进行软解码的方式处理视频聊天画面。

采用软解码处理视频聊天画面,会大大增加CPU的数据处理负担,当CPU的数据处理负担过重时,可能会出现画面卡顿或者不流畅的问题。进一步的,受制于CPU的数据处理能力,当采用CPU软解码处理视频聊天画面时,通常无法实现多路视频通话,当用户想要再同一聊天场景同时与多个其他用户进行视频聊天时,会出现接入受阻的情况。

基于上述各方面的考虑,为克服上述缺陷,本申请公开了一种双硬件系统架构,以实现多路视频聊天数据(至少一路本地视频)。

下面首先结合附图对本申请所涉及的概念进行说明。在此需要指出的是,以下对各个概念的说明,仅为了使本申请的内容更加容易理解,并不表示对本申请保护范围的限定。

本申请各实施例中使用的术语“模块”,可以是指任何已知或后来开发的硬件、软件、固件、人工智能、模糊逻辑或硬件或/和软件代码的组合,能够执行与该元件相关的功能。

本申请各实施例中使用的术语“遥控器”,是指电子设备(如本申请中公开的显示设备)的一个组件,该组件通常可在较短的距离范围内无线控制电子设备。该组件一般可以使用红外线和/或射频(RF)信号和/或蓝牙与电子设备连接,也可以包括WiFi、无线USB、蓝牙、动作传感器等功能模块。例如:手持式触摸遥控器,是以触摸屏中用户界面取代一般遥控装置中的大部分物理内置硬键。

本申请各实施例中使用的术语“手势”,是指用户通过一种手型的变化或手部运动等动作,用于表达预期想法、动作、目的/或结果的用户行为。

本申请各实施例中使用的术语“硬件系统”,可以是指由集成电路(IntegratedCircuit,IC)、印刷电路板(Printed circuit board,PCB)等机械、光、电、磁器件构成的具有计算、控制、存储、输入和输出功能的实体部件。在本申请各个实施例中,硬件系统通常也会被称为主板(motherboard)或芯片。

图1中示例性示出了根据实施例中显示设备与控制装置之间操作场景的示意图。如图1所示,用户可通过控制装置100来操作显示设备200。

其中,控制装置100可以是遥控器100A,其可与显示设备200之间通过红外协议通信、蓝牙协议通信、紫蜂(ZigBee)协议通信或其他短距离通信方式进行通信,用于通过无线或其他有线方式来控制显示设备200。用户可以通过遥控器上按键、语音输入、控制面板输入等输入用户指令,来控制显示设备200。如:用户可以通过遥控器上音量加减键、频道控制键、上/下/左/右的移动按键、语音输入按键、菜单键、开关机按键等输入相应控制指令,来实现控制显示设备200的功能。

控制装置100也可以是智能设备,如移动终端100B、平板电脑、计算机、笔记本电脑等,其可以通过本地网(LAN,Local Area Network)、广域网(WAN,Wide Area Network)、无线局域网((WLAN,Wireless Local Area Network)或其他网络与显示设备200之间通信,并通过与显示设备200相应的应用程序实现对显示设备200的控制。例如,使用在智能设备上运行的应用程序控制显示设备200。该应用程序可以在与智能设备关联的屏幕上通过直观的用户界面(UI,User Interface)为用户提供各种控制。

示例的,移动终端100B与显示设备200均可安装软件应用,从而可通过网络通信协议实现二者之间的连接通信,进而实现一对一控制操作的和数据通信的目的。如:可以使移动终端100B与显示设备200建立控制指令协议,将遥控控制键盘同步到移动终端100B上,通过控制移动终端100B上用户界面,实现控制显示设备200的功能;也可以将移动终端100B上显示的音视频内容传输到显示设备200上,实现同步显示功能。

如图1所示,显示设备200还可与服务器300通过多种通信方式进行数据通信。在本申请各个实施例中,可允许显示设备200通过局域网、无线局域网或其他网络与服务器300进行通信连接。服务器300可以向显示设备200提供各种内容和互动。

示例的,显示设备200通过发送和接收信息,以及电子节目指南(EPG,ElectronicProgram Guide)互动,接收软件程序更新,或访问远程储存的数字媒体库。服务器300可以是一组,也可以是多组,可以是一类或多类服务器。通过服务器300提供视频点播和广告服务等其他网络服务内容。

显示设备200,一方面讲,可以是液晶显示器、OLED(Organic Light EmittingDiode)显示器、投影显示设备;另一方面讲,显示设备被可以是智能电视或显示器和机顶盒组成的显示系统。具体显示设备类型,尺寸大小和分辨率等不作限定,本领技术人员可以理解的是,显示设备200可以根据需要做性能和配置上的一些改变。

显示设备200除了提供广播接收电视功能之外,还可以附加提供计算机支持功能的智能网络电视功能。示例的包括,网络电视、智能电视、互联网协议电视(IPTV)等。在一些实施例中,显示设备可以不具备广播接收电视功能。

如图1所述,显示设备上可以连接或设置有摄像头,用于将摄像头拍摄到的画面呈现在本显示设备或其他显示设备的显示界面上,以实现用户之间的交互聊天。具体的,摄像头拍摄到的画面可在显示设备上全屏显示、半屏显示、或者显示任意可选区域。

作为一种可选的连接方式,摄像头通过连接板与显示器后壳连接,固定安装在显示器后壳的上侧中部,作为可安装的方式,可以固定安装在显示器后壳的任意位置,能保证其图像采集区域不被后壳遮挡即可,例如,图像采集区域与显示设备的显示朝向相同。

作为另一种可选的连接方式,摄像头通过连接板或者其他可想到的连接器可升降的与显示后壳连接,连接器上安装有升降马达,当用户要使用摄像头或者有应用程序要使用摄像头时,再升出显示器之上,当不需要使用摄像头时,其可内嵌到后壳之后,以达到保护摄像头免受损坏。

作为一种实施例,本申请所采用的摄像头可以为1600万像素,以达到超高清显示目的。在实际使用中,也可采用比1600万像素更高或更低的摄像头。

当显示设备上安装有摄像头以后,显示设备不同应用场景所显示的内容可得到多种不同方式的融合,从而达到传统显示设备无法实现的功能。

示例性的,用户可以在边观看视频节目的同时,与至少一位其他用户进行视频聊天。视频节目的呈现可作为背景画面,视频聊天的窗口显示在背景画面之上。形象的,可以称该功能为“边看边聊”。

可选的,在“边看边聊”的场景中,在观看直播视频或网络视频的同时,跨终端的进行至少一路的视频聊天。

另一示例中,用户可以在边进入教育应用学习的同时,与至少一位其他用户进行视频聊天。例如,学生在学习教育应用程序中内容的同时,可实现与老师的远程互动。形象的,可以称该功能为“边学边聊”。

另一示例中,用户在玩纸牌游戏时,与进入游戏的玩家进行视频聊天。例如,玩家在进入游戏应用参与游戏时,可实现与其他玩家的远程互动。形象的,可以称该功能为“边看边玩”。

可选的,游戏场景与视频画面进行融合,将视频画面中人像进行抠图,显示在游戏画面中,提升用户体验。

可选的,在体感类游戏中(如打球类、拳击类、跑步类、跳舞类等),通过摄像头获取人体姿势和动作,肢体检测和追踪、人体骨骼关键点数据的检测,再与游戏中动画进行融合,实现如体育、舞蹈等场景的游戏。

另一示例中,用户可以在K歌应用中,与至少一位其他用户进行视频和语音的交互。形象的,可以称该功能为“边看边唱”。可选的,当至少一位用户在聊天场景进入该应用时,可多个用户共同完成一首歌的录制。

另一个示例中,用户可在本地打开摄像头获取图片和视频,形象的,可以称该功能为“照镜子”。

在另一些示例中,还可以再增加更多功能或减少上述功能。本申请对该显示设备的功能不作具体限定。

图2中示例性示出了根据示例性实施例中控制装置100的配置框图。如图2所示,控制装置100包括控制器110、通信器130、用户输入/输出接口140、存储器190、供电电源180。

控制装置100被配置为可控制所述显示设备200,以及可接收用户的输入操作指令,且将操作指令转换为显示设备200可识别和响应的指令,起到用户与显示设备200之间交互中介作用。如:用户通过操作控制装置100上频道加减键,显示设备200响应频道加减的操作。

在一些实施例中,控制装置100可是一种智能设备。如:控制装置100可根据用户需求安装控制显示设备200的各种应用。

在一些实施例中,如图1所示,移动终端100B或其他智能电子设备,可在安装操控显示设备200的应用之后,起到控制装置100类似功能。如:用户可以通过安装应用,在移动终端100B或其他智能电子设备上可提供的图形用户界面的各种功能键或虚拟按钮,以实现控制装置100实体按键的功能。

控制器110包括处理器112、RAM113和ROM114、通信接口以及通信总线。控制器110用于控制控制装置100的运行和操作,以及内部各部件之间通信协作以及外部和内部的数据处理功能。

通信器130在控制器110的控制下,实现与显示设备200之间控制信号和数据信号的通信。如:将接收到的用户输入信号发送至显示设备200上。通信器130可包括WIFI模块131、蓝牙模块132、NFC模块133等通信模块中至少一种。

用户输入/输出接口140,其中,输入接口包括麦克风141、触摸板142、传感器143、按键144等输入接口中至少一者。如:用户可以通过语音、触摸、手势、按压等动作实现用户指令输入功能,输入接口通过将接收的模拟信号转换为数字信号,以及数字信号转换为相应指令信号,发送至显示设备200。

输出接口包括将接收的用户指令发送至显示设备200的接口。在一些实施例中,可以是红外接口,也可以是射频接口。如:红外信号接口时,需要将用户输入指令按照红外控制协议转化为红外控制信号,经红外发送模块进行发送至显示设备200。再如:射频信号接口时,需将用户输入指令转化为数字信号,然后按照射频控制信号调制协议进行调制后,由射频发送端子发送至显示设备200。

在一些实施例中,控制装置100包括通信器130和输出接口中至少一者。控制装置100中配置通信器130,如:WIFI、蓝牙、NFC等模块,可将用户输入指令通过WIFI协议、或蓝牙协议、或NFC协议编码,发送至显示设备200.

存储器190,用于在控制器110的控制下存储驱动和控制控制装置100的各种运行程序、数据和应用。存储器190,可以存储用户输入的各类控制信号指令。

供电电源180,用于在控制器110的控制下为控制装置100各元件提供运行电力支持。可以电池及相关控制电路。

图3中示例性示出了根据示例性实施例中显示设备200中硬件系统的硬件配置框图。

在采用双硬件系统架构时,硬件系统的机构关系可以图3所示。为便于表述以下将双硬件系统架构中的一个硬件系统称为第一硬件系统或A系统、A芯片,并将另一个硬件系统称为第二硬件系统或N系统、N芯片。A芯片包含A芯片的控制器及通过各类接口与A芯片的控制器相连的各类模块,N芯片则包含N芯片的控制器及通过各类接口与N芯片的控制器相连的各类模块。A芯片及N芯片中可以各自安装有相对独立的操作系统,A芯片的操作系统和N芯片的操作系统可以通过通信协议相互通信,示例性的:A芯片的操作系统的framework层和N芯片的操作系统的framework层可以进行通信进行命令和数据的传输,从而使显示设备200中存在两个在独立但又存在相互关联的子系统。

如图3所示,A芯片与N芯片之间可以通过多个不同类型的接口实现连接、通信及供电。A芯片与N芯片之间接口的接口类型可以包括通用输入输出接口(General-purposeinput/output,GPIO)、USB接口、HDMI接口、UART接口等。A芯片与N芯片之间可以使用这些接口中的一个或多个进行通信或电力传输。例如图3所示,在双硬件系统架构下,可以由外接的电源(power)为N芯片供电,而A芯片则可以不由外接电源,而由N芯片供电。

除用于与N芯片进行连接的接口之外,A芯片还可以包含用于连接其他设备或组件的接口,例如图3中所示的用于连接摄像头(Camera)的MIPI接口,蓝牙接口等。

类似的,除用于与N芯片进行连接的接口之外,N芯片还可以包含用于连接显示屏TCON(Timer Control Register)的VBY接口,用于连接功率放大器(Amplifier,AMP)及扬声器(Speaker)的i2S接口;以及IR/Key接口,USB接口,Wifi接口,蓝牙接口,HDMI接口,Tuner接口等。

下面结合图4对本申请双硬件系统架构进行进一步的说明。需要说明的是图4仅仅是对本申请双硬件系统架构的一个示例性说明,并不表示对本申请的限定。在实际应用中,两个硬件系统均可根据需要包含更多或更少的硬件或接口。

图4中示例性示出了根据图3显示设备200的硬件架构框图。如图4所示,显示设备200的硬件系统可以包括A芯片和N芯片,以及通过各类接口与A芯片或N芯片相连接的模块。

N芯片可以包括调谐解调器220、通信器230、外部装置接口250、控制器210、存储器290、聊天输入接口、视频处理器260-1、显示器280、音频输出接口270、供电电源。在其他实施例中N芯片也可以包括更多或更少的模块。

其中,调谐解调器220,用于对通过有线或无线方式接收广播电视信号,进行放大、混频和谐振等调制解调处理,从而从多个无线或有线广播电视信号中解调出用户所选择电视频道的频率中所携带的音视频信号,以及附加信息(例如EPG数据信号)。根据电视信号广播制式不同,调谐解调器220的信号途径可以有很多种,诸如:地面广播、有线广播、卫星广播或互联网广播等;以及根据调制类型不同,所述信号的调整方式可以数字调制方式,也可以模拟调制方式;以及根据接收电视信号种类不同,调谐解调器220可以解调模拟信号和/或数字信号。

调谐解调器220,还用于根据用户选择,以及由控制器210控制,响应用户选择的电视频道频率以及该频率所携带的电视信号。

在其他一些示例性实施例中,调谐解调器220也可在外置设备中,如外置机顶盒等。这样,机顶盒通过调制解调后输出电视音视频信号,经过外部装置接口250输入至显示设备200中。

通信器230是用于根据各种通信协议类型与外部设备或外部服务器进行通信的组件。例如: 通信器230可以包括WIFI模块231,蓝牙通信协议模块232,有线以太网通信协议模块233,及红外通信协议模块等其他网络通信协议模块或近场通信协议模块。

显示设备200可以通过通信器230与外部控制设备或内容提供设备之间建立控制信号和数据信号的连接。例如,通信器可根据控制器的控制接收遥控器100的控制信号。

外部装置接口250,是提供N芯片控制器210和A芯片及外部其他设备间数据传输的组件。外部装置接口可按照有线/无线方式与诸如机顶盒、游戏装置、笔记本电脑等的外部设备连接,可接收外部设备的诸如视频信号(例如运动图像)、音频信号(例如音乐)、附加信息(例如EPG)等数据。

其中,外部装置接口250可以包括:高清多媒体接口(HDMI)端子也称之为HDMI251、复合视频消隐同步(CVBS)端子也称之为AV252、模拟或数字分量端子也称之为分量253、通用串行总线(USB)端子254、红绿蓝(RGB)端子(图中未示出)等任一个或多个。本申请不对外部装置接口的数量和类型进行限制。

控制器210,通过运行存储在存储器290上的各种软件控制程序(如操作系统和/或各种应用程序),来控制显示设备200的工作和响应用户的操作。

如图4所示,控制器210包括只读存储器RAM213、随机存取存储器ROM214、图形处理器216、CPU处理器212、通信接口218、以及通信总线。其中,RAM213和ROM214以及图形处理器216、CPU处理器212、通信接口218通过总线相连接。

ROM213,用于存储各种系统启动的指令。如在收到开机信号时,显示设备200电源开始启动,CPU处理器212运行ROM中系统启动指令,将存储在存储器290的操作系统拷贝至RAM214中,以开始运行启动操作系统。当操作系统启动完成后,CPU处理器212再将存储器290中各种应用程序拷贝至RAM214中,然后,开始运行启动各种应用程序。

图形处理器216,用于产生各种图形对象,如:图标、操作菜单、以及用户输入指令显示图形等。包括运算器,通过接收用户输入各种交互指令进行运算,根据显示属性显示各种对象。以及包括渲染器,产生基于运算器得到的各种对象,进行渲染的结果显示在显示器280上。

CPU处理器212,用于执行存储在存储器290中操作系统和应用程序指令。以及根据接收外部输入的各种交互指令,来执行各种应用程序、数据和内容,以便最终显示和播放各种音视频内容。

在一些示例性实施例中,CPU处理器212,可以包括多个处理器。所述多个处理器中可包括一个主处理器以及多个或一个子处理器。主处理器,用于在预加电模式中执行显示设备200一些操作,和/或在正常模式下显示画面的操作。多个或一个子处理器,用于执行在待机模式等状态下的一种操作。

通信接口,可包括第一接口218-1到第n接口218-n。这些接口可以是经由网络被连接到外部设备的网络接口。

控制器210可以控制显示设备200的整体操作。例如: 响应于接收到用于选择在显示器280上显示UI对象的用户命令,控制器210便可以执行与由用户命令选择的对象有关的操作。

其中,所述对象可以是可选对象中的任何一个,例如超链接或图标。与所选择的对象有关操作,例如:显示连接到超链接页面、文档、图像等操作,或者执行与图标相对应程序的操作。用于选择UI对象用户命令,可以是通过连接到显示设备200的各种输入装置(例如,鼠标、键盘、触摸板等)输入命令或者与由用户说出语音相对应的语音命令。

存储器290,包括存储用于驱动和控制显示设备200的各种软件模块。如:存储器290中存储的各种软件模块,包括:基础模块、检测模块、通信模块、显示控制模块、浏览器模块、和各种服务模块等。

其中,基础模块是用于显示设备200中各个硬件之间信号通信、并向上层模块发送处理和控制信号的底层软件模块。检测模块是用于从各种传感器或聊天输入接口中收集各种信息,并进行数模转换以及分析管理的管理模块。

例如:语音识别模块中包括语音解析模块和语音指令数据库模块。显示控制模块是用于控制显示器280进行显示图像内容的模块,可以用于播放多媒体图像内容和UI界面等信息。通信模块,是用于与外部设备之间进行控制和数据通信的模块。浏览器模块,是用于执行浏览服务器之间数据通信的模块。服务模块,是用于提供各种服务以及各类应用程序在内的模块。

同时,存储器290还用于存储接收外部数据和用户数据、各种用户界面中各个项目的图像以及焦点对象的视觉效果图等。

聊天输入接口,用于将用户的输入信号发送给控制器210,或者,将从控制器输出的信号传送给用户。示例性的,控制装置(例如移动终端或遥控器)可将用户输入的诸如电源开关信号、频道选择信号、音量调节信号等输入信号发送至聊天输入接口,再由聊天输入接口转送至控制器;或者,控制装置可接收经控制器处理从聊天输入接口输出的音频、视频或数据等输出信号,并且显示接收的输出信号或将接收的输出信号输出为音频或振动形式。

在一些实施例中,用户可在显示器280上显示的图形用户界面(GUI)输入用户命令,则聊天输入接口通过图形用户界面(GUI)接收用户输入命令。或者,用户可通过输入特定的声音或手势进行输入用户命令,则聊天输入接口通过传感器识别出声音或手势,来接收用户输入命令。

视频处理器260-1,用于接收视频信号,根据输入信号的标准编解码协议,进行解压缩、解码、缩放、降噪、帧率转换、分辨率转换、图像合成等视频数据处理,可得到直接在显示器280上显示或播放的视频信号。

示例的,视频处理器260-1,包括解复用模块、视频解码模块、图像合成模块、帧率转换模块、显示格式化模块等。

其中,解复用模块,用于对输入音视频数据流进行解复用处理,如输入MPEG-2,则解复用模块进行解复用成视频信号和音频信号等。

视频解码模块,用于对解复用后的视频信号进行处理,包括解码和缩放处理等。

图像合成模块,如图像合成器,其用于将图形生成器根据用户输入或自身生成的GUI信号,与缩放处理后视频画面进行叠加混合处理,以生成可供显示的图像信号。

帧率转换模块,用于对输入视频的帧率进行转换,如将输入的24Hz、25Hz、30Hz、60Hz视频的帧率转换为60Hz、120Hz或240Hz的帧率,其中,输入帧率可以与源视频流有关,输出帧率可以与显示器的更新率有关。输入有通常的格式采用如插帧方式实现。

显示格式化模块,用于将帧率转换模块输出的信号,改变为符合诸如显示器显示格式的信号,如将帧率转换模块输出的信号进行格式转换以输出RGB数据信号。

显示器280,用于接收源自视频处理器260-1输入的图像信号,进行显示视频内容和图像以及菜单操控界面。显示器280包括用于呈现画面的显示器组件以及驱动图像显示的驱动组件。显示视频内容,可以来自调谐解调器220接收的广播信号中的视频,也可以来自通信器或外部设备接口输入的视频内容。显示器280,同时显示显示设备200中产生且用于控制显示设备200的用户操控界面UI。

以及,根据显示器280类型不同,还包括用于驱动显示的驱动组件。或者,倘若显示器280为一种投影显示器,还可以包括一种投影装置和投影屏幕。

得到可以在扬声器272中播放的音频信号。

音频输出接口270,用于在控制器210的控制下音频输出接口可包括扬声器272,或输出至外接设备的发生装置的外接音响输出端子274,如:外接音响端子或耳机输出端子等。

在其他一些示例性实施例中,视频处理器260-1可以包括一个或多个芯片组成。

以及,在其他一些示例性实施例中,视频处理器260-1,可以为单独的芯片,也可以与控制器210一起集成在一个或多个芯片中。

供电电源,用于在控制器210控制下,将外部电源输入的电力为显示设备200提供电源供电支持。供电电源可以包括安装显示设备200内部的内置电源电路,也可以是安装在显示设备200外部的电源,如在显示设备200中提供外接电源的电源接口。

与N芯片相类似,如图4所示,A芯片可以包括控制器310、通信器330、检测器340、存储器390。在某些实施例中还可以包括聊天输入接口、视频处理器、音频处理器、显示器、音频输出接口。在某些实施例中,也可以存在独立为A芯片供电的供电电源。

通信器330是用于根据各种通信协议类型与外部设备或外部服务器进行通信的组件。例如: 通信器330可以包括WIFI模块331,蓝牙通信协议模块332,有线以太网通信协议模块333,及红外通信协议模块等其他网络通信协议模块或近场通信协议模块。

A芯片的通信器330和N芯片的通信器230也有相互交互。例如,N芯片硬件系统内的WiFi模块231用于连接外部网络,与外部服务器等产生网络通信。A芯片硬件系统内的WiFi模块331用于连接至N芯片的WiFi模块231,而不与外界网络等产生直接连接,A芯片通过N芯片连接外部网络。因此,对于用户而言,一个如上述实施例中的显示设备至对外显示一个WiFi账号。

检测器340,是显示设备A芯片用于采集外部环境或与外部交互的信号的组件。检测器340可以包括光接收器342,用于采集环境光线强度的传感器,可以通过采集环境光来自适应显示参数变化等;还可以包括图像采集器341,如相机、摄像头等,可以用于采集外部环境场景,以及用于采集用户的属性或与用户交互手势,可以自适应变化显示参数,也可以识别用户手势,以实现与用户之间互动的功能。

外部装置接口350,提供控制器310与N芯片或外部其他设备间数据传输的组件。外部装置接口可按照有线/无线方式与诸如机顶盒、游戏装置、笔记本电脑等的外部设备连接。

视频处理器360-1,用于处理相关视频信号。

音频处理器360-2,用于处理相关音频信号

控制器310,通过运行存储在存储器390上的各种软件控制程序(如用安装的第三方应用等),以及与N芯片的交互,来控制显示设备200的工作和响应用户的操作。

如图4所示,控制器310包括只读存储器ROM313、随机存取存储器RAM314、图形处理器316、CPU处理器312、通信接口318、以及通信总线。其中,ROM313和RAM314以及图形处理器316、CPU处理器312、通信接口318通过总线相连接。

ROM313,用于存储各种系统启动的指令。CPU处理器312运行ROM中系统启动指令,将存储在存储器390的操作系统拷贝至RAM314中,以开始运行启动操作系统。当操作系统启动完成后,CPU处理器312再将存储器390中各种应用程序拷贝至RAM314中,然后,开始运行启动各种应用程序。

CPU处理器312,用于执行存储在存储器390中操作系统和应用程序指令,和与N芯片进行通信、信号、数据、指令等传输与交互,以及根据接收外部输入的各种交互指令,来执行各种应用程序、数据和内容,以便最终显示和播放各种音视频内容。

通信接口318为多个。这些接口可以是经由网络被连接到外部设备的网络接口,也可以是经由网络被连接到N芯片的网络接口。

音频处理器360-2,用于接收音频信号,根据输入信号的标准编解码协议,进行解压缩和解码,以及降噪、数模转换、和放大处理等音频数据处理。

控制器310可以控制显示设备200的整体操作。例如: 响应于接收到用于选择在显示器280上显示UI对象的用户命令,控制器210便可以执行与由用户命令选择的对象有关的操作。

图形处理器316,用于产生各种图形对象,如:图标、操作菜单、以及用户输入指令显示图形等。包括运算器,通过接收用户输入各种交互指令进行运算,根据显示属性显示各种对象。以及包括渲染器,产生基于运算器得到的各种对象,进行渲染的结果显示在显示器280上。

A芯片的图形处理器316与N芯片的图形处理器216均能产生各种图形对象。区别性的,若应用1安装于A芯片,应用2安装在N芯片,当用户在应用1的界面,且在应用1内进行用户输入的指令时,由A芯片图形处理器316产生图形对象。当用户在应用2的界面,且在应用2内进行用户输入的指令时,由N芯片的图形处理器216产生图形对象。

图5中示例性示出了根据示例性实施例中显示设备的功能配置示意图。

如图5所示,A芯片的存储器390和N芯片的存储器290分别用于存储操作系统、应用程序、内容和用户数据等,在A芯片的控制器310和N芯片的控制器210的控制下执行驱动显示设备200的系统运行以及响应用户的各种操作。A芯片的存储器390和N芯片的存储器290可以包括易失性和/或非易失性存储器。

对于N芯片,存储器290,具体用于存储驱动显示设备200中控制器210的运行程序,以及存储显示设备200内置各种应用程序,以及用户从外部设备下载的各种应用程序、以及与应用程序相关的各种图形用户界面,以及与图形用户界面相关的各种对象,用户数据信息,以及各种支持应用程序的内部数据。存储器290用于存储操作系统(OS)内核 、中间件和应用等系统软件,以及存储输入的视频数据和音频数据、及其他用户数据。

存储器290,具体用于存储视频处理器260-1、显示器280、通信器230、调谐解调器220、输入/输出接口等驱动程序和相关数据。

在一些实施例中,存储器290可以存储软件和/或程序,用于表示操作系统(OS)的软件程序包括,例如:内核、中间件、应用编程接口(API)和/或应用程序。示例性的,内核可控制或管理系统资源,或其它程序所实施的功能(如所述中间件、API或应用程序),以及内核可以提供接口,以允许中间件和API,或应用访问控制器,以实现控制或管理系统资源。

示例的,存储器290,包括广播接收模块2901、频道控制模块2902、音量控制模块2903、图像控制模块2904、显示控制模块2905、第一音频控制模块2906、外部指令识别模块2907、通信控制模块2908、光接收模块2909、电力控制模块2910、操作系统2911、以及其他应用程序2912、浏览器模块等等。控制器210通过运行存储器290中各种软件程序,来执行诸如:广播电视信号接收解调功能、电视频道选择控制功能、音量选择控制功能、图像控制功能、显示控制功能、音频控制功能、外部指令识别功能、通信控制功能、光信号接收功能、电力控制功能、支持各种功能的软件操控平台、以及浏览器功能等各类功能。

存储器390,包括存储用于驱动和控制显示设备200的各种软件模块。如:存储器390中存储的各种软件模块,包括:基础模块、检测模块、通信模块、显示控制模块、浏览器模块、和各种服务模块等。由于存储器390与存储器290的功能比较相似,相关之处参见存储器290即可,在此就不再赘述。

示例的,存储器390,包括图像控制模块3904、第二音频控制模块3906、外部指令识别模块3907、通信控制模块3908、光接收模块3909、操作系统3911、以及其他应用程序3912、浏览器模块等等。控制器210通过运行存储器290中各种软件程序,来执行诸如:图像控制功能、显示控制功能、音频控制功能、外部指令识别功能、通信控制功能、光信号接收功能、电力控制功能、支持各种功能的软件操控平台、以及浏览器功能等各类功能。

区别性的,N芯片的外部指令识别模块2907和A芯片的外部指令识别模块3907可识别不同的指令。

示例性的,由于摄像头等图像接收设备与A芯片连接,因此,A芯片的外部指令识别模块3907可包括图形识别模块2907-1,图形识别模块3907-1内存储有图形数据库,摄像头接收到外界的图形指令时,与图形数据库中的指令进行对应关系,以对显示设备作出指令控制。而由于语音接收设备以及遥控器与N芯片连接,因此,N芯片的外部指令识别模块2907可包括语音识别模块2907-2,语音识别模块2907-2内存储有语音数据库,语音接收设备等接收到外界的语音指令或时,与语音数据库中的指令进行对应关系,以对显示设备作出指令控制。同样的,遥控器等控制装置100与N芯片连接,由按键指令识别模块2907-3与控制装置100进行指令交互。

图6a中示例性示出了根据示例性实施例中显示设备200中软件系统的配置框图。

对N芯片,如图6a中所示,操作系统2911,包括用于处理各种基础系统服务和用于实施硬件相关任务的执行操作软件,充当应用程序和硬件组件之间完成数据处理的媒介。

一些实施例中,部分操作系统内核可以包含一系列软件,用以管理显示设备硬件资源,并为其他程序或软件代码提供服务。

其他一些实施例中,部分操作系统内核可包含一个或多个设备驱动器,设备驱动器可以是操作系统中的一组软件代码,帮助操作或控制显示设备关联的设备或硬件。驱动器可以包含操作视频、音频和/或其他多媒体组件的代码。示例的,包括显示器、摄像头、Flash、WiFi和音频驱动器。

其中,可访问性模块2911-1,用于修改或访问应用程序,以实现应用程序的可访问性和对其显示内容的可操作性。

通信模块2911-2,用于经由相关通信接口和通信网络与其他外设的连接。

用户界面模块2911-3,用于提供显示用户界面的对象,以供各应用程序访问,可实现用户可操作性。

控制应用程序2911-4,用于控制进程管理,包括运行时间应用程序等。

事件传输系统2914,可在操作系统2911内或应用程序2912中实现。一些实施例中,一方面在在操作系统2911内实现,同时在应用程序2912中实现,用于监听各种用户输入事件,将根据各种事件指代响应各类事件或子事件的识别结果,而实施一组或多组预定义的操作的处理程序。

其中,事件监听模块2914-1,用于监听聊天输入接口输入事件或子事件。

事件识别模块2914-2,用于对各种聊天输入接口输入各类事件的定义,识别出各种事件或子事件,且将其传输给处理用以执行其相应一组或多组的处理程序。

其中,事件或子事件,是指显示设备200中一个或多个传感器检测的输入,以及外界控制设备(如控制装置100等)的输入。如:语音输入各种子事件,手势识别的手势输入子事件,以及控制装置的遥控按键指令输入的子事件等。示例的,遥控器中一个或多个子事件包括多种形式,包括但不限于按键按上/下/左右/、确定键、按键按住等中一个或组合。以及非实体按键的操作,如移动、按住、释放等操作。

界面布局管理模块2913,直接或间接接收来自于事件传输系统2914监听到各用户输入事件或子事件,用于更新用户界面的布局,包括但不限于界面中各控件或子控件的位置,以及容器的大小或位置、层级等与界面布局相关各种执行操作。

由于A芯片的操作系统3911与N芯片的操作系统2911的功能比较相似,相关之处参见操作系统2911即可,在此就不再赘述。

如图6b中所示,显示设备的应用程序层包含可在显示设备200执行的各种应用程序。

N芯片的应用程序层2912可包含但不限于一个或多个应用程序,如:视频点播应用程序、应用程序中心、游戏应用等。A芯片的应用程序层3912可包含但不限于一个或多个应用程序,如:直播电视应用程序、媒体中心应用程序等。需要说明的是,A芯片和N芯片上分别包含什么应用程序是根据操作系统和其他设计确定的,本发明无需对A芯片和N芯片上所包含的应用程序做具体的限定和划分。

直播电视应用程序,可以通过不同的信号源提供直播电视。例如,直播电视应用程可以使用来自有线电视、无线广播、卫星服务或其他类型的直播电视服务的输入提供电视信号。以及,直播电视应用程序可在显示设备200上显示直播电视信号的视频。

视频点播应用程序,可以提供来自不同存储源的视频。不同于直播电视应用程序,视频点播提供来自某些存储源的视频显示。例如,视频点播可以来自云存储的服务器端、来自包含已存视频节目的本地硬盘储存器。

媒体中心应用程序,可以提供各种多媒体内容播放的应用程序。例如,媒体中心,可以为不同于直播电视或视频点播,用户可通过多媒体中心应用程序访问各种图像或音频所提供服务。

应用程序中心,可以提供储存各种应用程序。应用程序可以是一种游戏、应用程序,或某些和计算机系统或其他设备相关但可以在显示设备中运行的其他应用程序。应用程序中心可从不同来源获得这些应用程序,将它们储存在本地储存器中,然后在显示设备200上可运行。

图7中示例性示出了根据示例性实施例中显示设备200中用户界面的示意图。如图7所示,用户界面包括多个视图显示区,示例的,第一视图显示区201和播放画面202,其中,播放画面包括布局一个或多个不同项目。以及用户界面中还包括指示项目被选择的选择器,可通过用户输入而移动选择器的位置,以改变选择不同的项目。

需要说明的是,多个视图显示区可以呈现不同层级的显示画面。如,第一视图显示区可呈现视频聊天项目内容,第二视图显示区可呈现应用层项目内容(如,网页视频、VOD展示、应用程序画面等)。

可选的,不同视图显示区的呈现存在优先级区别,优先级不同的视图显示区之间,视图显示区的显示优先级不同。如,系统层的优先级高于应用层的优先级,当用户在应用层使用获取选择器和画面切换时,不遮挡系统层的视图显示区的画面展示;以及,根据用户的选择使应用层的视图显示区的大小和位置发生变化时,系统层的视图显示区的大小和位置不受影响。

基于用户上述“边看边唱”的需求,可以在显示设备上安装一麦克风,通过麦克风采集用户的人声数据。在实际应用中,A芯片与N芯片中数据主要通过网络、HDMI和USB输出,USB主要作用是将摄像头的图像数据通过USB传输给N芯片,网络接口的主要作用是N芯片和A芯片可以同时上网,并且遥控器的按键也是通过网口传送给A芯片,HDMI主要是将A芯片中的音视频数据,通过HDMI接口传输给N芯片,该HDMI接口不向用户开放。

在社交电视上,android应用安装于A芯片中,A芯片仅仅承担声音的透传功能,对声音不做任何音效处理;N芯片主要承担着图像的展示和声音的处理及播放功能。因此,用户在显示设备上K歌时,A芯片将接收到的音频数据通过5G网络传输给N芯片处理后输出,但是目前无法确认5G网络的传输速率,为了给网络传输预留更多的时间,需要尽量压缩电视上K歌的耗时时间,来保证K歌连麦功能的低延时体验效果。

基于上述技术问题,本申请示出第一方面提供的一种显示设备,如图8所示,本申请实施例提供的显示设备包括:第一芯片101、第二芯片201与声音再现器301,其中,

第一芯片101包括:

声音采集器101-3,被配置为采集人声数据;

外部多媒体数据输入接口101-5,被配置为接收视频数据和音频数据;其中,外部多媒体数据输入接口包括HDMI接口、USB接口等。

第一音频处理器101-1,第一音频处理器101-1被配置为,被配置为将所述音频数据与所述人声数据进行混音,得到第三音频数据。

本示例中,音频数据为来源于网络或本地存储的音频数据,如电视播放音乐的伴奏音,而人声数据是用户自己演唱的声音数据。当用户打开K歌应用后,用户输入了自己演唱的声音数据的同时,K歌应用还同时播放音乐的伴奏音,最终呈现出来的是这两个声音数据的混合声音。

第一视频处理器101-4,被配置为将视频数据透传出去。第一芯片101对视频数据并不做处理,而是直接透传给第二芯片102,在第二芯片102上进行相关的画质处理。这里的视频数据主要是K歌应用后面的背景图片,以及显示的歌曲信息等。

第二芯片201包括:

第二音频处理器201-2,第二音频处理器201-2被配置为,接收并处理来自第一音频处理器101-1输出的第三音频数据;

第二视频处理器201-3,被配置为接收并处理来自于第一视频处理器101-4输出的视频数据

声音再现器301,被配置为,接收并再现来自于第二音频处理器201-2输出的处理后的第三音频数据。

显示器401,被配置为接收并显示来自于所述第二视频处理器201-3输出的处理后的视频数据。第二视频处理器201-3主要进行对视频数据的画质处理,例如伽马调整、色域调整、对比度调整等,这里不再详细展开。

其中,为了描述方便,图4和图5中第一芯片310与图8中的第一芯片101对应,图4和图5中第二芯片210与图8中的第二芯片201对应,图4中扬声器272与图8中声音再现器301对应,以下不再指出。

由于,本申请实施例示出的技术方案适用于“边看边唱”的应用场景,在“边看边唱”的应用场景下显示设备传输音频数据时易出现延迟,导致电视上K歌的耗时时间较长,影响K歌连麦功能的低延时体验效果。基于上述问题,本申请示出的方案通过第一芯片的第一音频处理器与第二芯片的第二音频处理器优化音频传输的耗时,减少声音的延迟,以满足K歌等低延迟要求。

下面对音频数据的处理过程作以详细的说明。

如图9所示,第一音频处理器101-1设有依次连接的USB接口1011、USB缓存器1012、录音alsa节点1013、APK1014、播放alsa节点1015与音频输出接口1016,其中,外接mic连接该USB接口1011,即外接麦克风(MIC)采集用户的人声数据,将人声数据通过USB接口1011送入第一音频处理器101-1中;USB接口1011处还设有USB dongle,用于保护USB接口1011输入的音频数据。然后,USB接口1011接收的人声数据缓存至USB缓存器1012内,USB缓存器1012内的人声数据传输至第一音频处理器101-1声卡的录音alsa节点1013内;之后APK1014读取录音alsa节点1013内的人声数据,将人声数据与K歌应用的多媒体音频数据(如伴奏音等)进行混合和降噪处理,得到第三音频数据;之后APK输出第三音频数据至播放alsa节点1015里,通过音频输出接口1016将播放alsa节点1015内的第三音频数据输出,第三音频数据可通过HDMII或网络传输传送至第二芯片201内。

第三音频数据通过HDMI传输至第二芯片201时,第一芯片101设有HDMI发送端口101-1,第二芯片201设有HDMI接收端口201-1,HDMI发送端口101-1与HDMI接收端口201-1信号连接,第三音频数据通过HDMI发送端口101-1与HDMI接收端口201-1传输至第二芯片201。即第一音频处理器101-1的APK1014将第三音频数据写到声卡播放alsa节点1015里,之后通过音频输出接口1016将播放alsa节点1015里的第三音频数据传输至第一芯片101的HDMI发送端口101-2,通过HDMI发送端口101-2将第三音频数据传输至第二芯片201,第二芯片201的HDMI接收端口201-1接收HDMI发送端口101-2输出的第三音频数据,之后HDMI接收端口201-1将第三音频数据传输至第二音频处理器201-1进行处理。

如图10所示,第二音频处理器201-1包括第一缓存器(HDMI缓存器)2011、SRC采样率转换模块2012、第二缓存器(HWBUF)2013与音频输出节点2014,其中, HDMI接收端口201-1将接收的第三音频数据缓存至HDMI 缓存器2011中,SRC采样率转换模块2012读取HDMI缓存器2011中的第三音频数据,对第三音频数据进行采样率转换,以使第三音频数据的采样频率满足第二芯片201的输出频率;之后完成频率转换后的第三音频数据缓存至HWBUF2013中,HWBUF2013中只能存储一定的音频数据,采用硬件中断的方式,即每次中断的间隔为音频输出节点2014输出一个BUF大小的音频数据的播放时间,在HWBUF2013内填满音频数据时将HWBUF2013中的音频数据送往音频输出节点2014,之后音频数据由功放喇叭输出,或同轴设备输出至声音再现器301。

综上,HDMI传输K歌音频数据的流程图为:Mic(麦克风)→第一芯片的USB dongle→USB BUF→alsa read→K歌APK混音→alsa write→SPDIFOUT→HDMI Tx→第二芯片的HDMI Rx→HDMI BUF→SRC采样率转换→HWBUF→out0→AMP(功放)→speaker。也就是说,K歌时,麦克风采集人声,通过dongle设备送入第一芯片的声卡录音的alsa节点里,APK可以读取录音alsa节点里的数据并与多媒体音频数据进行混音和降噪处理,得到第三音频数据,并将第三音频数据写到声卡播放alsa节点里,经过音频输出接口处理,使能HDMI输出,把第三音频数据通过DMA从alsa节点送往HDMI发射端口输出;第二芯片的HDMI接收端口接收到第三音频数据后,优化采样率转换模块,将第三音频数据缓存至HWBUF,采用硬件中断的方式,将HWBUF中的数据送往音频输出节点由功放喇叭输出,或同轴设备输出至声音再现器。

为方便区分每首歌曲的起播与结束,第一芯片101的APK混音得到第三音频数据时,对第三音频数据设置标志位,标志位包括第一标志位与第二标志位,第一标志位用于标识第三音频数据起播,即在K歌时,在歌曲数据起播字节处配置第一标志位;第二标志位用于标识第三音频数据播放结束,即在K歌时,在歌曲数据播放结束字节处配置第二标志位。再通过HDMI发送端口101-1将第三音频数据发送至HDMI接收端口201-1时,同时将第三音频数据的标志位传输至第二芯片201。

但是,如图11所示,每次K歌起播时,当HDMI接收完数据,发送到声音再现器301(例如扬声器)前,扬声器会先产生一次中断,导致扬声器内多填入了一个空数据,播放时,空数据优先播放后才能播放K歌数据,使得K歌起播时需要等待HWBUF 2013填满音频数据的时间与输出节点传输空数据的时间,造成扬声器播放音频数据延时。如,HWBUF 2013填满音频数据的时间为10.666ms,输出节点传输空数据的时间为21.333ms,使得扬声器播放音频数据的延迟时间latency=缓存器延迟时间+输出等待延迟时间=hdmi buffering time + outwaiting time=10.666ms+21.333ms=32ms,造成K歌的声音延迟。

为了优化上述问题引起的K歌音频数据延迟,在每首歌曲起播时,先清空缓存buf里的数据,包含HDMI缓存器2011和HWBUF 2013内的数据,具体地,HDMI缓存器2011接收到音频数据后,判断输出音频数据的标志位,若在HDMI缓存器2011中检测到第一标志位与第二标志位,说明HDMI缓存器2011接收的音频数据为两首歌曲的数据,则清除HDMI缓存器2011中配置有第二标志位的音频数据与配置有第一标志位的音频数据之间的数据,以保证最新的人声数据尽快发送给输出节点out,和防止切歌时有杂音问题,优化每次起播时声音延迟不一致的问题。

同理,HWBUF2013中的音频数据也要清除配置有第二标志位的音频数据与配置有第一标志位的音频数据之间的数据,以保证HWBUF2013中最新的人声数据尽快发送给输出节点out,和防止切歌时有杂音问题,优化每次起播时声音延迟不一致的问题。

另外,HWBUF 2013中的第三音频数据采用输出中断方式发送至输出节点out0时,可能会出现中断产生时机和HWBUF 2013填满数据的时机不匹配,例如,HWBUF2013填满数据需要10.666ms,每填满10.666ms的数据就会将HWBUF 2013中的数据发送至输出节点out0,输出节点发起中断后,将HWBUF 2013中的数据发送至扬声器进行播放,然而输出节点发起中断时,可能会出现HWBUF 2013未填满数据,则HWBUF 2013会继续缓存数据,等HWBUF 2013中的数据填满,在下一次输出中断时将数据发送至扬声器,如此,造成数据播放的延迟。

为了优化上述问题引起的K歌音频数据延迟,第二音频处理器201-2还被配置为,检测输出终端产生时机是否与HWBUF 2013填满音频数据时机匹配,若该中断产生的时机和HWBUF 2013的数据填充不匹配,会导致数据至少要多等待0-1个BUF的数据耗时才能输出,因此检测到中断产生时机与HWBUF 2013填满数据不匹配时,重置该终端,以保证输入HWBUF的数据填满后,及时来中断把数据取走,以优化每次开机K歌耗时波动的问题。

优化后的状态为:HDMI数据收集完一笔10.666ms的资料后,马上紧接着输出节点发起中断,将HWBUF 2013内的音频数据传输至扬声器,HWBUF 2013会被填入现在正在播放的下一块,因此只需等当前10.666ms(播完现在这块缓存所需的时间),数据就会被播放。

本示例以具体实施例进行说明:

如输出节点发起中断时,HWBUF 2013内缓存有5ms的音频数据,则此次中断不能将HWBUF 2013内的音频数据输出至扬声器,优化前,HWBUF 2013继续缓存数据,等下一次中断时再将10.666ms的音频数据输出至扬声器,如此需要等待10.666ms。而优化后,检测到HWBUF 2013填满数据与输出中断产生时机不匹配,则重置该中断,等HWBUF 2013内的数据填满后,输出节点再次发起中断,将HWBUF 2013内的音频数据输出至扬声器,如此需要等待5.666ms,大大降低了声音延时。

如此,如图12所示,当HDMI接收完数据,将音频数据输出至扬声器,扬声器会把数据放在下个预计播放的位置,如此K歌起播时需要等待HWBUF 2013填满音频数据的时间与输出节点传输空数据的时间,即声音延迟时间latency=缓存器延迟时间+输出等待延迟时间=hdmi buffering time + output waiting time=10.666ms+10.666ms=21.333ms,相比现有的通过HDMI传输K歌音频数据,大大减少了音频数据等待时间。

使用本申请实施例提供的显示设备时,K歌整机的测试延迟由正常下耗时140ms减少到57-63ms,其中K歌APK耗时约为15-20ms,其余基本为搬移音频数据耗时,减少了音频数据等待和K歌延迟不稳定问题,保证了K歌连续功能的低延时体验效果。

以上介绍了第一芯片和第二芯片通过HDMI进行数据传输的方案,接下来介绍第一芯片和第二芯片通过网线进行数据传输,具体如下:

第三音频数据通过网络传输将第三音频数据传输至第二芯片201时,如图13所示,和图8相比,第一芯片101还包括socket缓存器102与第一网口103,第二芯片201还包括第二网口203与节点服务器202,socket缓存器102被配置为,第一音频处理器101-1输出的第三音频数据存入socket缓存器102,socket缓存器102中的第三音频数据输出至第一网口103,第一网口103与第一网口203通过网线连接,以将socket缓存器102内的第三音频数据通过网线传输至第二芯片201,第二芯片201的第二网口203接收第一网口103输出的第三音频数据,并将第三音频数据传送至节点服务器202;节点服务器202被配置为,打开第二芯片201的播放alsa节点,来接收socket缓存器102传输的第三音频数据。第二音频处理器201-2将处理后的第三音频数据输出给声音再现器301进行声音的播放。

其他部分都参考前文的相关介绍,这里不再重复说明。

参考图14,外接mic连接第一芯片101的USB接口1011,即外接麦克风(MIC)采集用户的人声数据,将人声数据通过USB接口1011送入第一音频处理器101-1中;USB接口1011处还设有USB dongle,用于保护USB接口1011输入的音频数据。然后,USB接口1011接收的人声数据缓存至USB缓存器1012内,USB缓存器1012内的人声数据传输至第一音频处理器101-1声卡的录音alsa节点1013内;之后APK1014读取录音alsa节点1013内的人声数据,将人声数据与K歌应用的多媒体音频数据(如伴奏音等)进行混合和降噪处理,得到第三音频数据,之后将第三音频数据存入socket缓存器102中,在每次填满设置传输的门槛后,通过第一网口103与第二网口203将socket缓存器102中的第三音频数据传输至第二芯片201的节点服务器202,节点服务器202控制第三音频数据写入第二芯片的播放alsa节点,SRC采样率转换模块读取播放alsa节点中的第三音频数据,对第三音频数据进行采样率转换,以使第三音频数据的采样频率满足第二芯片201的输出频率。

采样后的第三音频数据缓存至HWBUF中,HWBUF2013中只能存储一定的音频数据,采用硬件中断的方式,即每次中断的间隔为音频输出节点2014输出一个BUF大小的音频数据的播放时间,在HWBUF2013内填满音频数据时将HWBUF2013中的音频数据送往音频输出节点2014,之后音频数据由功放喇叭输出,或同轴设备输出至声音再现器301。

综上,网络传输K歌音频数据的流程图为: Mic(麦克风)→第一芯片的USBdongle→USB BUF→alsa read→K歌APK混音→Socket BUF→第二芯片的节点服务器→alsa write→SRC采样率转换→HWBUF→out0→AMP(功放)→speaker。也就是说,K歌时,麦克风采集人声,通过dongle设备送入第一芯片的声卡录音的alsa节点里,APK可以读取录音alsa节点里的数据并与多媒体音频数据进行混音和降噪处理,得到第三音频数据;之后将第三音频数据缓存入socket缓存器中,在每次填满设置传输的门槛后,通过网络传输将第三音频数据传送至第二芯片的节点服务器中,节点服务器控制将第三音频数据写入播放alsa节点,优化采样率转换模块,将第三音频数据缓存至HWBUF,采用硬件中断的方式,将HWBUF中的数据送往音频输出节点由功放喇叭输出,或同轴设备输出至声音再现器。

本申请实施例提供的显示设备采用网络传输K歌音频数据,即采集的人声数据与多媒体音频数据经过APK处理后,直接传输给第二芯片的播放alsa节点,减少了第一芯片及HDMI的耗时;另外,由于只有第二芯片进行音频处理,不需要考虑双芯片的HDMI缓存器匹配问题,可以适当的减少录入alsa节点和播放alsa节点的周期大小,可以优化耗时约10ms。

采用网络传输K歌音频数据时,第一芯片101的APK输出第三音频数据时,在每首歌曲起播的字节内设置start命令字节,在每首歌曲结束的字节内设置stop命令字节,socket缓存器102接收到第三音频数据时,检测音频数据的开始字节,检测到stop字节时,说明用户要停止K歌,将socket缓存器102中的数据清空,以保证下次用户K歌时接收最新的人声数据,保证声音延迟的稳定性。

另外,由于有socket缓存器102缓存数据,socket缓存器102内的数据有新的数据存入,也有部分老的数据缓存,若socket缓存器102内老的数据一直缓存于缓存器内,可能会导致新的数据无法存取socket缓存器内,因此可以判断socket缓存器中的数据,如果有积攒较多的风险,可以在不影响数据播放效果的前提下及时少量删除部分老的音频数据,在没有断音的风险下,保证声音延时的稳定性。

通过网络传输实现双芯片的K歌数据传输,和单板上K歌基本相同,网络延时耗时很小,越2-5ms,测试声音从麦克风到整机喇叭剥除的延时约为45ms,减少了音频数据等待和K歌延迟不稳定的问题。

本申请实施例提供的双系统显示设备,第一芯片用于接收用户K歌时的人声数据,并将人声数据与多媒体音频数据混音后生成第三音频数据,第三音频数据可通过HDMI输出至第二芯片,第二芯片对第三音频数据进行优化处理,如优化每次起播时声音延迟不一致,优化每次开机时K歌耗时波动等,将优化后发送至扬声器,减少了音频数据等待和K歌延迟不稳定问题;第三音频数据也可通过网络传输输出至第二芯片,减少了第一芯片音频处理及HDMI传输的耗时。通过上述优化压缩了双系统显示设备上K歌的耗时时间,给5G网络传输预留了更多了时间,保证了K歌连麦功能的低延时体验效果。

基于上述实施例所述的显示设备,本申请实施例还提供了一种声音低延迟处理方法,该方法应用于上述实施例提供的显示设备,所述显示设备包括第一芯片、第二芯片与声音再现器,参考图15,基于该显示设备的声音低延迟处理方法包括:

S100:所述第一芯片接收音频数据和采集人声数据。

S200:将所述多媒体音频数据和人声数据进行混音,得到第三音频数据,并将第三音频数据输出至第二芯片。

S300:第二芯片接收并处理所述第三音频数据,将处理后的第三音频数据发送至所述声音再现器。

第一芯片用于采集用户K歌时的人声数据,并将人声数据传输至第一芯片的APK,APK对人声数据与多媒体音频数据进行混音和降噪处理,得到第三音频数据,第三音频数据可通过HDMI或网络传输至第二芯片,第二芯片通过HDMI接收第三音频数据时,将第三音频数据缓存至HDMI缓存器 与HWBUF,在每首歌曲起播时,先清空HDMI缓存器与HWBUF里的数据,以保证最先的人声数据尽快发送至扬声器,优化了每次起播时声音延迟不一致的问题;每次开机后检测输出中断产生时机是否和HWBUF填满数据匹配,若检测到不匹配,则重置该终端,以保证HWBUF数据填满后,及时来中断把数据取走,优化了每次开机K歌耗时波动的问题。第二芯片通过网络传输接收第三音频数据时,第三音频数据通过网络传输直接由第一芯片传输至第二芯片,和单板上K歌基本相同,网络延时耗时很小,减少了第一芯片及HDMI的耗时,大大减少了K歌耗时。

具体的可以参考前文装置类的相关介绍,这里不再重复说明。

应当理解,本申请中说明书和权利要求书及上述附图中的术语“第一”、“第二”、“第三”等是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。应该理解这样使用的数据在适当情况下可以互换,例如能够根据本申请实施例图示或描述中给出那些以外的顺序实施。

此外,术语“包括”和“具有”以及他们的任何变形,意图在于覆盖但不排他的包含,例如,包含了一系列组件的产品或设备不必限于清楚地列出的那些组件,而是可包括没有清楚地列出的或对于这些产品或设备固有的其它组件。

最后应说明的是:以上各实施例仅用以说明本申请的技术方案,而非对其限制;尽管参照前述各实施例对本申请进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分或者全部技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本申请各实施例技术方案的范围。

Claims (8)

1.一种显示设备,其特征在于,包括:

第一芯片,所述第一芯片包括:

声音采集器,被配置为采集人声数据;

外部多媒体数据输入接口,被配置为接收视频数据和音频数据;

第一音频处理器,被配置为将所述音频数据与所述人声数据进行混音,得到第三音频数据;

第一视频处理器,被配置为将所述视频数据透传出去;

第二芯片,所述第二芯片包括:

第二音频处理器,被配置为接收并处理来自所述第一音频处理器输出的第三音频数据,所述第三音频数据被配置有第一标志位与第二标志位,所述第一标志位用于标识所述第三音频数据起播,所述第二标志位用于标识所述第三音频数据播放结束;

所述第二音频处理器包括:

第一缓存器,所述第一缓存器被配置为当检测所述第一缓存器输入音频数据存在所述第一标志位和所述第二标志位时,清除配置有第二标志位的音频数据与配置有第一标志位的音频数据之间的数据;

第二视频处理器,被配置为接收并处理来自于所述第一视频处理器输出的视频数据;

音频输出接口,被配置为输出来自于所述第二音频处理器输出的处理后的第三音频数据;

显示器,被配置为接收并显示来自于所述第二视频处理器输出的处理后的视频数据。

2.根据权利要求1所述的显示设备,其特征在于,所述第二音频处理器包括:

第二缓存器,所述第二缓存器被配置为当检测所述第二缓存器输入音频数据存在所述第一标志位和所述第二标志位时,清除配置有第二标志位的音频数据与配置有第一标志位的音频数据之间的数据。

3.根据权利要求2所述的显示设备,其特征在于,所述第二音频处理器还被配置为:

检测输出中断产生时机是否与第二缓存器填满第三音频数据时机相匹配,当输出中断产生时机与第二缓存器填满第三音频数据时机不匹配时,重置所述输出中断。

4.根据权利要求1所述的显示设备,其特征在于,所述第二音频处理器还被配置为,对接收的所述第三音频数据进行采样率转换,并缓存频率转换后的第三音频数据。

5.根据权利要求1所述的显示设备,其特征在于,所述第一芯片设有HDMI发送端口,所述第二芯片设有HDMI接收端口,所述HDMI发送端口与所述HDMI接收端口信号连接;所述第三音频数据通过所述HDMI发送端口与所述HDMI接收端口传输至所述第二芯片。

6.根据权利要求1所述的显示设备,其特征在于,所述第一芯片还包括第一网口,所述第二芯片还包括第二网口,所述第一网口和所述第二网口通过网线连接,所述第三音频数据通过所述网线进行传输。

7.根据权利要求6所述的显示设备,其特征在于,所述第一芯片还包括socket缓存器,所述socket缓存器被配置为,所述第一音频处理器输出的第三音频数据存入所述socket缓存器;

所述第二音频处理器还包括节点服务器,所述节点服务器被配置为,打开所述第二芯片的播放节点;

所述socket缓存器内的音频数据通过所述网线传输至所述节点服务器,所述节点服务器内的音频数据传输至所述播放节点。

8.一种声音低延迟处理方法,其特征在于,所述方法应用于显示设备,所述显示设备包括:

第一芯片,所述第一芯片包括:

声音采集器,被配置为采集人声数据;

外部多媒体数据输入接口,被配置为接收视频数据和音频数据;

第一音频处理器,被配置为将所述音频数据与所述人声数据进行混音,得到第三音频数据;

第一视频处理器,被配置为将所述视频数据透传出去;

第二芯片,所述第二芯片包括:

第二音频处理器,被配置为接收并处理来自所述第一音频处理器输出的第三音频数据,所述第三音频数据被配置有第一标志位与第二标志位,所述第一标志位用于标识所述第三音频数据起播,所述第二标志位用于标识所述第三音频数据播放结束;

所述第二音频处理器包括:

第一缓存器,所述第一缓存器被配置为当检测所述第一缓存器输入音频数据存在所述第一标志位和所述第二标志位时,清除配置有第二标志位的音频数据与配置有第一标志位的音频数据之间的数据;

第二视频处理器,被配置为接收并处理来自于所述第一视频处理器输出的视频数据;

音频输出接口,被配置为输出来自于所述第二音频处理器输出的处理后的第三音频数据;

显示器,被配置为接收并显示来自于所述第二视频处理器输出的处理后的视频数据。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN201911032598.1A CN112802440B (zh) | 2019-10-28 | 2019-10-28 | 一种显示设备及声音低延迟处理方法 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN201911032598.1A CN112802440B (zh) | 2019-10-28 | 2019-10-28 | 一种显示设备及声音低延迟处理方法 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| CN112802440A CN112802440A (zh) | 2021-05-14 |

| CN112802440B true CN112802440B (zh) | 2022-10-28 |

Family

ID=75803308

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201911032598.1A Active CN112802440B (zh) | 2019-10-28 | 2019-10-28 | 一种显示设备及声音低延迟处理方法 |

Country Status (1)

| Country | Link |

|---|---|

| CN (1) | CN112802440B (zh) |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN113472764B (zh) * | 2021-06-24 | 2024-03-08 | 深圳市亚昱科技有限公司 | 电子设备和音频传输方法 |

Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN1735005A (zh) * | 2004-08-02 | 2006-02-15 | 富士通株式会社 | 使用基准信号进行同步数据传输的装置和方法 |

| CN104780420A (zh) * | 2015-03-26 | 2015-07-15 | 成都市斯达鑫辉视讯科技有限公司 | 机顶盒的节目播放方法 |

| CN105491302A (zh) * | 2014-09-16 | 2016-04-13 | 中兴通讯股份有限公司 | 音频信号输出方法、装置、终端及系统 |

| CN106528040A (zh) * | 2016-11-02 | 2017-03-22 | 福建星网视易信息系统有限公司 | 改进安卓设备音质的方法及装置 |

| CN106559706A (zh) * | 2015-09-28 | 2017-04-05 | 青岛海信电器股份有限公司 | 一种音频数据的处理方法、装置和系统 |

| CN107637088A (zh) * | 2016-07-07 | 2018-01-26 | 北京小米移动软件有限公司 | 音频播放系统、外接扩展设备、音频播放方法及装置 |

| CN108347529A (zh) * | 2018-01-31 | 2018-07-31 | 维沃移动通信有限公司 | 一种音频播放方法及移动终端 |

| CN109565620A (zh) * | 2016-08-04 | 2019-04-02 | 推特公司 | 低延迟http实时流传输 |

Family Cites Families (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4252593B2 (ja) * | 2006-09-19 | 2009-04-08 | 株式会社ソニー・コンピュータエンタテインメント | オーディオ処理装置、入出力処理装置および情報処理装置 |

| US9311243B2 (en) * | 2012-11-30 | 2016-04-12 | Intel Corporation | Emulated message signaled interrupts in multiprocessor systems |

-

2019

- 2019-10-28 CN CN201911032598.1A patent/CN112802440B/zh active Active

Patent Citations (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN1735005A (zh) * | 2004-08-02 | 2006-02-15 | 富士通株式会社 | 使用基准信号进行同步数据传输的装置和方法 |

| CN105491302A (zh) * | 2014-09-16 | 2016-04-13 | 中兴通讯股份有限公司 | 音频信号输出方法、装置、终端及系统 |

| CN104780420A (zh) * | 2015-03-26 | 2015-07-15 | 成都市斯达鑫辉视讯科技有限公司 | 机顶盒的节目播放方法 |

| CN106559706A (zh) * | 2015-09-28 | 2017-04-05 | 青岛海信电器股份有限公司 | 一种音频数据的处理方法、装置和系统 |

| CN107637088A (zh) * | 2016-07-07 | 2018-01-26 | 北京小米移动软件有限公司 | 音频播放系统、外接扩展设备、音频播放方法及装置 |

| CN109565620A (zh) * | 2016-08-04 | 2019-04-02 | 推特公司 | 低延迟http实时流传输 |

| CN106528040A (zh) * | 2016-11-02 | 2017-03-22 | 福建星网视易信息系统有限公司 | 改进安卓设备音质的方法及装置 |

| CN108347529A (zh) * | 2018-01-31 | 2018-07-31 | 维沃移动通信有限公司 | 一种音频播放方法及移动终端 |

Non-Patent Citations (1)

| Title |

|---|

| 24通道高精度A/D数据采集模块的研制;彭辉;《现代电子技术》;20080715(第14期);全文 * |

Also Published As

| Publication number | Publication date |

|---|---|

| CN112802440A (zh) | 2021-05-14 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN112073797B (zh) | 一种音量调节方法及显示设备 | |

| CN112399243A (zh) | 一种播放方法及显示设备 | |

| CN112073778A (zh) | 显示设备及按键传递的容错方法 | |

| CN112073662A (zh) | 一种显示设备 | |

| CN112068987A (zh) | 一种快速进行恢复出厂设置的方法及装置 | |

| CN112463267B (zh) | 在显示设备屏幕上呈现屏保信息的方法及显示设备 | |

| CN112073789B (zh) | 一种声音处理法及显示设备 | |

| CN112528051B (zh) | 一种演唱作品的发布方法、显示设备及服务器 | |

| CN113448529B (zh) | 显示设备和音量调节方法 | |

| CN112533056B (zh) | 一种显示设备及声音再现方法 | |

| CN112073769A (zh) | 显示设备及应用共同显示的方法 | |

| CN112802440B (zh) | 一种显示设备及声音低延迟处理方法 | |

| CN112068855A (zh) | 一种双系统下应用的升级方法及系统 | |

| CN112073812B (zh) | 一种智能电视上的应用管理方法及显示设备 | |

| CN112738576B (zh) | 一种显示设备及声音低延迟处理方法 | |

| CN112073803A (zh) | 一种声音再现方法及显示设备 | |

| CN112399245A (zh) | 一种播放方法及显示设备 | |

| CN112073808A (zh) | 一种色彩空间切换方法及显示装置 | |

| CN112073777A (zh) | 一种语音交互方法及显示设备 | |

| CN112073666A (zh) | 一种显示设备的电源控制方法及显示设备 | |

| CN113448530A (zh) | 显示设备和音量控制方法 | |

| CN112073816A (zh) | 双系统usb升级方法、装置及显示设备 | |

| CN112073773A (zh) | 一种屏幕互动方法、装置及显示设备 | |

| CN112995113B (zh) | 一种显示设备、端口控制方法及存储介质 | |

| CN112073779B (zh) | 显示设备及按键传递的容错方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication | ||

| SE01 | Entry into force of request for substantive examination | ||

| SE01 | Entry into force of request for substantive examination | ||

| GR01 | Patent grant | ||

| GR01 | Patent grant |