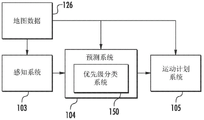

CN111133485B - 自主交通工具的对象预测优先级排序系统和方法 - Google Patents

自主交通工具的对象预测优先级排序系统和方法 Download PDFInfo

- Publication number

- CN111133485B CN111133485B CN201880061470.5A CN201880061470A CN111133485B CN 111133485 B CN111133485 B CN 111133485B CN 201880061470 A CN201880061470 A CN 201880061470A CN 111133485 B CN111133485 B CN 111133485B

- Authority

- CN

- China

- Prior art keywords

- priority

- computing system

- predicted future

- determining

- objects

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000000034 method Methods 0.000 title claims abstract description 65

- 238000012913 prioritisation Methods 0.000 title abstract description 3

- 230000008447 perception Effects 0.000 claims description 70

- 238000013439 planning Methods 0.000 claims description 51

- 230000003993 interaction Effects 0.000 claims description 20

- 238000012549 training Methods 0.000 claims description 14

- 230000001133 acceleration Effects 0.000 claims description 6

- 238000010801 machine learning Methods 0.000 description 15

- 238000013528 artificial neural network Methods 0.000 description 14

- 230000006870 function Effects 0.000 description 12

- 238000004891 communication Methods 0.000 description 9

- 238000010586 diagram Methods 0.000 description 8

- 230000008901 benefit Effects 0.000 description 7

- 238000012545 processing Methods 0.000 description 7

- 230000004044 response Effects 0.000 description 7

- 230000008569 process Effects 0.000 description 5

- 238000001514 detection method Methods 0.000 description 4

- 238000011161 development Methods 0.000 description 4

- 230000000306 recurrent effect Effects 0.000 description 4

- 230000010354 integration Effects 0.000 description 3

- 238000012986 modification Methods 0.000 description 3

- 230000004048 modification Effects 0.000 description 3

- 230000003287 optical effect Effects 0.000 description 3

- 230000001413 cellular effect Effects 0.000 description 2

- 239000004020 conductor Substances 0.000 description 2

- 238000003066 decision tree Methods 0.000 description 2

- 230000000694 effects Effects 0.000 description 2

- 230000009467 reduction Effects 0.000 description 2

- 238000004904 shortening Methods 0.000 description 2

- 238000012706 support-vector machine Methods 0.000 description 2

- 238000001429 visible spectrum Methods 0.000 description 2

- 230000009471 action Effects 0.000 description 1

- 238000007792 addition Methods 0.000 description 1

- 230000004075 alteration Effects 0.000 description 1

- 230000006399 behavior Effects 0.000 description 1

- 238000005538 encapsulation Methods 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 238000003384 imaging method Methods 0.000 description 1

- 230000006872 improvement Effects 0.000 description 1

- 230000035484 reaction time Effects 0.000 description 1

- 238000012552 review Methods 0.000 description 1

- 230000003068 static effect Effects 0.000 description 1

- 238000011144 upstream manufacturing Methods 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/82—Arrangements for image or video recognition or understanding using pattern recognition or machine learning using neural networks

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W30/00—Purposes of road vehicle drive control systems not related to the control of a particular sub-unit, e.g. of systems using conjoint control of vehicle sub-units

- B60W30/08—Active safety systems predicting or avoiding probable or impending collision or attempting to minimise its consequences

- B60W30/095—Predicting travel path or likelihood of collision

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W30/00—Purposes of road vehicle drive control systems not related to the control of a particular sub-unit, e.g. of systems using conjoint control of vehicle sub-units

- B60W30/08—Active safety systems predicting or avoiding probable or impending collision or attempting to minimise its consequences

- B60W30/095—Predicting travel path or likelihood of collision

- B60W30/0956—Predicting travel path or likelihood of collision the prediction being responsive to traffic or environmental parameters

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W40/00—Estimation or calculation of non-directly measurable driving parameters for road vehicle drive control systems not related to the control of a particular sub unit, e.g. by using mathematical models

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W50/00—Details of control systems for road vehicle drive control not related to the control of a particular sub-unit, e.g. process diagnostic or vehicle driver interfaces

- B60W50/06—Improving the dynamic response of the control system, e.g. improving the speed of regulation or avoiding hunting or overshoot

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W60/00—Drive control systems specially adapted for autonomous road vehicles

- B60W60/001—Planning or execution of driving tasks

- B60W60/0027—Planning or execution of driving tasks using trajectory prediction for other traffic participants

- B60W60/00276—Planning or execution of driving tasks using trajectory prediction for other traffic participants for two or more other traffic participants

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05D—SYSTEMS FOR CONTROLLING OR REGULATING NON-ELECTRIC VARIABLES

- G05D1/00—Control of position, course, altitude or attitude of land, water, air or space vehicles, e.g. using automatic pilots

- G05D1/0088—Control of position, course, altitude or attitude of land, water, air or space vehicles, e.g. using automatic pilots characterized by the autonomous decision making process, e.g. artificial intelligence, predefined behaviours

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05D—SYSTEMS FOR CONTROLLING OR REGULATING NON-ELECTRIC VARIABLES

- G05D1/00—Control of position, course, altitude or attitude of land, water, air or space vehicles, e.g. using automatic pilots

- G05D1/02—Control of position or course in two dimensions

- G05D1/021—Control of position or course in two dimensions specially adapted to land vehicles

- G05D1/0212—Control of position or course in two dimensions specially adapted to land vehicles with means for defining a desired trajectory

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05D—SYSTEMS FOR CONTROLLING OR REGULATING NON-ELECTRIC VARIABLES

- G05D1/00—Control of position, course, altitude or attitude of land, water, air or space vehicles, e.g. using automatic pilots

- G05D1/02—Control of position or course in two dimensions

- G05D1/021—Control of position or course in two dimensions specially adapted to land vehicles

- G05D1/0212—Control of position or course in two dimensions specially adapted to land vehicles with means for defining a desired trajectory

- G05D1/0221—Control of position or course in two dimensions specially adapted to land vehicles with means for defining a desired trajectory involving a learning process

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/764—Arrangements for image or video recognition or understanding using pattern recognition or machine learning using classification, e.g. of video objects

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/50—Context or environment of the image

- G06V20/56—Context or environment of the image exterior to a vehicle by using sensors mounted on the vehicle

- G06V20/58—Recognition of moving objects or obstacles, e.g. vehicles or pedestrians; Recognition of traffic objects, e.g. traffic signs, traffic lights or roads

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/01—Detecting movement of traffic to be counted or controlled

- G08G1/0104—Measuring and analyzing of parameters relative to traffic conditions

- G08G1/0108—Measuring and analyzing of parameters relative to traffic conditions based on the source of data

- G08G1/0112—Measuring and analyzing of parameters relative to traffic conditions based on the source of data from the vehicle, e.g. floating car data [FCD]

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W50/00—Details of control systems for road vehicle drive control not related to the control of a particular sub-unit, e.g. process diagnostic or vehicle driver interfaces

- B60W50/06—Improving the dynamic response of the control system, e.g. improving the speed of regulation or avoiding hunting or overshoot

- B60W2050/065—Improving the dynamic response of the control system, e.g. improving the speed of regulation or avoiding hunting or overshoot by reducing the computational load on the digital processor of the control computer

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W2554/00—Input parameters relating to objects

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W2554/00—Input parameters relating to objects

- B60W2554/40—Dynamic objects, e.g. animals, windblown objects

- B60W2554/402—Type

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05D—SYSTEMS FOR CONTROLLING OR REGULATING NON-ELECTRIC VARIABLES

- G05D1/00—Control of position, course, altitude or attitude of land, water, air or space vehicles, e.g. using automatic pilots

- G05D1/02—Control of position or course in two dimensions

- G05D1/021—Control of position or course in two dimensions specially adapted to land vehicles

- G05D1/0231—Control of position or course in two dimensions specially adapted to land vehicles using optical position detecting means

-

- G—PHYSICS

- G05—CONTROLLING; REGULATING

- G05D—SYSTEMS FOR CONTROLLING OR REGULATING NON-ELECTRIC VARIABLES

- G05D1/00—Control of position, course, altitude or attitude of land, water, air or space vehicles, e.g. using automatic pilots

- G05D1/02—Control of position or course in two dimensions

- G05D1/021—Control of position or course in two dimensions specially adapted to land vehicles

- G05D1/0257—Control of position or course in two dimensions specially adapted to land vehicles using a radar

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N20/00—Machine learning

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/01—Detecting movement of traffic to be counted or controlled

- G08G1/0104—Measuring and analyzing of parameters relative to traffic conditions

- G08G1/0125—Traffic data processing

- G08G1/0129—Traffic data processing for creating historical data or processing based on historical data

-

- G—PHYSICS

- G08—SIGNALLING

- G08G—TRAFFIC CONTROL SYSTEMS

- G08G1/00—Traffic control systems for road vehicles

- G08G1/01—Detecting movement of traffic to be counted or controlled

- G08G1/0104—Measuring and analyzing of parameters relative to traffic conditions

- G08G1/0125—Traffic data processing

- G08G1/0133—Traffic data processing for classifying traffic situation

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Automation & Control Theory (AREA)

- Evolutionary Computation (AREA)

- Medical Informatics (AREA)

- Artificial Intelligence (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Software Systems (AREA)

- Health & Medical Sciences (AREA)

- Multimedia (AREA)

- Transportation (AREA)

- Mechanical Engineering (AREA)

- Computing Systems (AREA)

- Radar, Positioning & Navigation (AREA)

- Remote Sensing (AREA)

- Aviation & Aerospace Engineering (AREA)

- General Health & Medical Sciences (AREA)

- Databases & Information Systems (AREA)

- Mathematical Physics (AREA)

- Business, Economics & Management (AREA)

- Game Theory and Decision Science (AREA)

- Analytical Chemistry (AREA)

- Chemical & Material Sciences (AREA)

- Human Computer Interaction (AREA)

- General Engineering & Computer Science (AREA)

- Data Mining & Analysis (AREA)

- Traffic Control Systems (AREA)

- Control Of Driving Devices And Active Controlling Of Vehicle (AREA)

Abstract

Description

Claims (19)

Applications Claiming Priority (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US201762549407P | 2017-08-23 | 2017-08-23 | |

| US62/549,407 | 2017-08-23 | ||

| US15/811,865 US10216189B1 (en) | 2017-08-23 | 2017-11-14 | Systems and methods for prioritizing object prediction for autonomous vehicles |

| US15/811,865 | 2017-11-14 | ||

| PCT/US2018/047032 WO2019040349A1 (en) | 2017-08-23 | 2018-08-20 | SYSTEMS AND METHODS FOR PRIORITIZE PREDICTION PRIORITIZATION FOR AUTONOMOUS VEHICLES |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| CN111133485A CN111133485A (zh) | 2020-05-08 |

| CN111133485B true CN111133485B (zh) | 2022-06-14 |

Family

ID=65410911

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201880061470.5A Active CN111133485B (zh) | 2017-08-23 | 2018-08-20 | 自主交通工具的对象预测优先级排序系统和方法 |

Country Status (5)

| Country | Link |

|---|---|

| US (3) | US10216189B1 (zh) |

| EP (1) | EP3673470B1 (zh) |

| JP (1) | JP7199421B2 (zh) |

| CN (1) | CN111133485B (zh) |

| WO (1) | WO2019040349A1 (zh) |

Families Citing this family (69)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2018176000A1 (en) | 2017-03-23 | 2018-09-27 | DeepScale, Inc. | Data synthesis for autonomous control systems |

| US10671349B2 (en) | 2017-07-24 | 2020-06-02 | Tesla, Inc. | Accelerated mathematical engine |

| US11157441B2 (en) | 2017-07-24 | 2021-10-26 | Tesla, Inc. | Computational array microprocessor system using non-consecutive data formatting |

| US11409692B2 (en) | 2017-07-24 | 2022-08-09 | Tesla, Inc. | Vector computational unit |

| US11893393B2 (en) | 2017-07-24 | 2024-02-06 | Tesla, Inc. | Computational array microprocessor system with hardware arbiter managing memory requests |

| US10768626B2 (en) | 2017-09-30 | 2020-09-08 | Tusimple, Inc. | System and method for providing multiple agents for decision making, trajectory planning, and control for autonomous vehicles |

| EP3495220B1 (en) * | 2017-12-11 | 2024-04-03 | Volvo Car Corporation | Path prediction for a vehicle |

| US11161464B2 (en) | 2018-01-12 | 2021-11-02 | Uatc, Llc | Systems and methods for streaming processing for autonomous vehicles |

| US11561791B2 (en) | 2018-02-01 | 2023-01-24 | Tesla, Inc. | Vector computational unit receiving data elements in parallel from a last row of a computational array |

| US10906536B2 (en) | 2018-04-11 | 2021-02-02 | Aurora Innovation, Inc. | Control of autonomous vehicle based on determined yaw parameter(s) of additional vehicle |

| US10990096B2 (en) * | 2018-04-27 | 2021-04-27 | Honda Motor Co., Ltd. | Reinforcement learning on autonomous vehicles |

| JP6988698B2 (ja) * | 2018-05-31 | 2022-01-05 | トヨタ自動車株式会社 | 物体認識装置 |

| US11215999B2 (en) | 2018-06-20 | 2022-01-04 | Tesla, Inc. | Data pipeline and deep learning system for autonomous driving |

| US11035943B2 (en) * | 2018-07-19 | 2021-06-15 | Aptiv Technologies Limited | Radar based tracking of slow moving objects |

| US10909866B2 (en) * | 2018-07-20 | 2021-02-02 | Cybernet Systems Corp. | Autonomous transportation system and methods |

| US11361457B2 (en) | 2018-07-20 | 2022-06-14 | Tesla, Inc. | Annotation cross-labeling for autonomous control systems |

| US11636333B2 (en) | 2018-07-26 | 2023-04-25 | Tesla, Inc. | Optimizing neural network structures for embedded systems |

| US11562231B2 (en) | 2018-09-03 | 2023-01-24 | Tesla, Inc. | Neural networks for embedded devices |

| WO2020077117A1 (en) | 2018-10-11 | 2020-04-16 | Tesla, Inc. | Systems and methods for training machine models with augmented data |

| US11196678B2 (en) | 2018-10-25 | 2021-12-07 | Tesla, Inc. | QOS manager for system on a chip communications |

| US11256263B2 (en) * | 2018-11-02 | 2022-02-22 | Aurora Operations, Inc. | Generating targeted training instances for autonomous vehicles |

| US11403492B2 (en) | 2018-11-02 | 2022-08-02 | Aurora Operations, Inc. | Generating labeled training instances for autonomous vehicles |

| US11816585B2 (en) | 2018-12-03 | 2023-11-14 | Tesla, Inc. | Machine learning models operating at different frequencies for autonomous vehicles |

| US11537811B2 (en) | 2018-12-04 | 2022-12-27 | Tesla, Inc. | Enhanced object detection for autonomous vehicles based on field view |

| US10814870B2 (en) * | 2018-12-04 | 2020-10-27 | GM Global Technology Operations LLC | Multi-headed recurrent neural network (RNN) for multi-class trajectory predictions |

| DE112019006282T5 (de) | 2018-12-18 | 2021-10-14 | Motional Ad Llc | Betrieb eines Fahrzeugs unter Verwendung mehrerer Bewegungsbeschränkungen |

| DE112019004832T5 (de) | 2018-12-18 | 2021-06-24 | Motional Ad Llc | Betrieb eines Fahrzeugs unter Verwendung von Bewegungsplanung mit maschinellem Lernen |

| US11610117B2 (en) | 2018-12-27 | 2023-03-21 | Tesla, Inc. | System and method for adapting a neural network model on a hardware platform |

| US11150664B2 (en) | 2019-02-01 | 2021-10-19 | Tesla, Inc. | Predicting three-dimensional features for autonomous driving |

| US10997461B2 (en) | 2019-02-01 | 2021-05-04 | Tesla, Inc. | Generating ground truth for machine learning from time series elements |

| US11567514B2 (en) | 2019-02-11 | 2023-01-31 | Tesla, Inc. | Autonomous and user controlled vehicle summon to a target |

| US10956755B2 (en) | 2019-02-19 | 2021-03-23 | Tesla, Inc. | Estimating object properties using visual image data |

| US10741070B1 (en) * | 2019-03-04 | 2020-08-11 | GM Global Technology Operations LLC | Method to prioritize transmission of sensed objects for cooperative sensor sharing |

| US11335189B2 (en) | 2019-04-04 | 2022-05-17 | Geotab Inc. | Method for defining road networks |

| US11341846B2 (en) | 2019-04-04 | 2022-05-24 | Geotab Inc. | Traffic analytics system for defining road networks |

| US11403938B2 (en) | 2019-04-04 | 2022-08-02 | Geotab Inc. | Method for determining traffic metrics of a road network |

| US10699564B1 (en) | 2019-04-04 | 2020-06-30 | Geotab Inc. | Method for defining intersections using machine learning |

| US11335191B2 (en) | 2019-04-04 | 2022-05-17 | Geotab Inc. | Intelligent telematics system for defining road networks |

| RU2750152C1 (ru) * | 2019-04-25 | 2021-06-22 | Общество с ограниченной ответственностью "Яндекс Беспилотные Технологии" | Способы и системы для определения порядка оценивания траекторий транспортных средств |

| WO2020226085A1 (ja) * | 2019-05-09 | 2020-11-12 | ソニー株式会社 | 情報処理装置、情報処理方法、及びプログラム |

| US20200363800A1 (en) * | 2019-05-13 | 2020-11-19 | Great Wall Motor Company Limited | Decision Making Methods and Systems for Automated Vehicle |

| US11772643B1 (en) * | 2019-05-20 | 2023-10-03 | Zoox, Inc. | Object relevance determination |

| US11526729B2 (en) * | 2019-05-22 | 2022-12-13 | International Business Machines Corporation | Discovering higher-level actions from expert's action demonstration |

| US11643115B2 (en) * | 2019-05-31 | 2023-05-09 | Waymo Llc | Tracking vanished objects for autonomous vehicles |

| US11634162B2 (en) | 2019-08-16 | 2023-04-25 | Uatc, Llc. | Full uncertainty for motion planning in autonomous vehicles |

| US11340622B2 (en) * | 2019-08-30 | 2022-05-24 | Waymo Llc | Determining respective impacts of agents |

| DE102019213222B4 (de) * | 2019-09-02 | 2022-09-29 | Volkswagen Aktiengesellschaft | Verfahren zum Vorhersagen einer zukünftigen Fahr-Situation eines am Straßenverkehr teilnehmenden Fremd-Objektes, Vorrichtung, Fahrzeug |

| US11577722B1 (en) * | 2019-09-30 | 2023-02-14 | Zoox, Inc. | Hyper planning based on object and/or region |

| DE102019216025A1 (de) * | 2019-10-17 | 2021-04-22 | Robert Bosch Gmbh | Verfahren und Steuergerät zum automatischen Selektieren von Datensätzen für ein Verfahren zum maschinellen Lernen |

| DE102019216074A1 (de) * | 2019-10-18 | 2021-04-22 | Robert Bosch Gmbh | Verfahren zum Bereitstellen einer Objektnachricht über ein in einer Umgebung eines Verkehrsteilnehmers erkanntes Objekt in einem Kommunikationsnetzwerk zur Kommunikation mit anderen Verkehrsteilnehmern |

| US11636715B2 (en) * | 2019-12-24 | 2023-04-25 | GM Cruise Holdings LLC. | Using dynamic triggers in dangerous situations to view sensor data for autonomous vehicle passengers |

| KR102193776B1 (ko) * | 2019-12-26 | 2020-12-22 | 성균관대학교 산학협력단 | 강화학습 기반 센서 데이터 관리 방법 및 시스템 |

| KR20210114792A (ko) * | 2020-03-11 | 2021-09-24 | 현대자동차주식회사 | 라이다 센서 기반의 객체 추적 장치 및 그 방법 |

| EP3913551B1 (en) * | 2020-05-19 | 2024-10-09 | GEOTAB Inc. | Method for defining road networks |

| CN111814970B (zh) * | 2020-06-28 | 2021-02-23 | 盾钰(上海)互联网科技有限公司 | 基于神经网络的实时物理引擎增强计算方法、介质及系统 |

| US11926343B2 (en) | 2020-07-20 | 2024-03-12 | Tusimple, Inc. | Classification and prioritization of objects for autonomous driving |

| CN114500736B (zh) * | 2020-10-23 | 2023-12-05 | 广州汽车集团股份有限公司 | 一种智能终端运动轨迹决策方法及其系统、存储介质 |

| US20220169282A1 (en) * | 2020-12-01 | 2022-06-02 | Gm Cruise Holdings Llc | Autonomous vehicle high-priority data offload system |

| US11884296B2 (en) | 2020-12-21 | 2024-01-30 | Qualcomm Incorporated | Allocating processing resources to concurrently-executing neural networks |

| WO2022183329A1 (zh) * | 2021-03-01 | 2022-09-09 | 华为技术有限公司 | 一种智能驾驶方法、装置、存储介质及计算机程序 |

| US12046013B2 (en) | 2021-05-26 | 2024-07-23 | Ford Global Technologies Llc | Using relevance of objects to assess performance of an autonomous vehicle perception system |

| WO2022251769A1 (en) * | 2021-05-26 | 2022-12-01 | Argo AI, LLC | Using relevance of objects to assess performance of an autonomous vehicle perception system |

| US11884304B2 (en) * | 2021-09-08 | 2024-01-30 | Ford Global Technologies, Llc | System, method, and computer program product for trajectory scoring during an autonomous driving operation implemented with constraint independent margins to actors in the roadway |

| WO2023205444A1 (en) | 2022-04-22 | 2023-10-26 | Velo.Ai, Inc. | Artificially intelligent mobility safety system |

| WO2023218583A1 (ja) * | 2022-05-12 | 2023-11-16 | 三菱電機株式会社 | 割当結果決定装置及び割当結果決定方法 |

| US20240175710A1 (en) * | 2022-11-30 | 2024-05-30 | Argo AI, LLC | Low Latency Vector Map Updates |

| GB2625324A (en) * | 2022-12-14 | 2024-06-19 | Aptiv Technoologies Ag | Perception sensor processing method and processing unit for performing the same |

| CN116767224B (zh) * | 2023-07-03 | 2024-01-23 | 小米汽车科技有限公司 | 确定可行驶区域的方法、装置、车辆、及存储介质 |

| CN116588125B (zh) * | 2023-07-17 | 2023-09-19 | 四川中普盈通科技有限公司 | 一种车载边缘侧数据处理系统 |

Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8767186B2 (en) * | 2007-11-07 | 2014-07-01 | Magna Electronics Inc. | Object detection system |

| JP2014157522A (ja) * | 2013-02-18 | 2014-08-28 | East Nippon Expressway Co Ltd | プローブデータを活用した道路交通管制システム |

| US9164511B1 (en) * | 2013-04-17 | 2015-10-20 | Google Inc. | Use of detected objects for image processing |

| CN105358397A (zh) * | 2013-05-03 | 2016-02-24 | 谷歌公司 | 对控制车辆的速度的预测性推理 |

| CN105679021A (zh) * | 2016-02-02 | 2016-06-15 | 重庆云途交通科技有限公司 | 基于交通大数据的行程时间融合预测及查询方法 |

| CN106428009A (zh) * | 2015-07-31 | 2017-02-22 | 福特全球技术公司 | 车辆轨迹确定 |

| CN106504530A (zh) * | 2016-10-31 | 2017-03-15 | 合肥工业大学 | 一种用户出行路径诱导与管控系统及其方法 |

| CN107024215A (zh) * | 2016-01-29 | 2017-08-08 | 福特全球技术公司 | 追踪动态环境内的对象以改进定位 |

| CN108292356A (zh) * | 2015-11-04 | 2018-07-17 | 祖克斯有限公司 | 用于实施自主车辆中的主动安全系统的系统 |

Family Cites Families (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8255144B2 (en) | 1997-10-22 | 2012-08-28 | Intelligent Technologies International, Inc. | Intra-vehicle information conveyance system and method |

| US9373149B2 (en) | 2006-03-17 | 2016-06-21 | Fatdoor, Inc. | Autonomous neighborhood vehicle commerce network and community |

| US9302678B2 (en) | 2006-12-29 | 2016-04-05 | Robotic Research, Llc | Robotic driving system |

| US8917904B2 (en) * | 2008-04-24 | 2014-12-23 | GM Global Technology Operations LLC | Vehicle clear path detection |

| US8605947B2 (en) | 2008-04-24 | 2013-12-10 | GM Global Technology Operations LLC | Method for detecting a clear path of travel for a vehicle enhanced by object detection |

| US8126642B2 (en) | 2008-10-24 | 2012-02-28 | Gray & Company, Inc. | Control and systems for autonomously driven vehicles |

| US9440647B1 (en) | 2014-09-22 | 2016-09-13 | Google Inc. | Safely navigating crosswalks |

| US10745003B2 (en) * | 2015-11-04 | 2020-08-18 | Zoox, Inc. | Resilient safety system for a robotic vehicle |

| CN108431549B (zh) * | 2016-01-05 | 2020-09-04 | 御眼视觉技术有限公司 | 具有施加的约束的经训练的系统 |

-

2017

- 2017-11-14 US US15/811,865 patent/US10216189B1/en active Active

-

2018

- 2018-08-20 WO PCT/US2018/047032 patent/WO2019040349A1/en unknown

- 2018-08-20 JP JP2020510567A patent/JP7199421B2/ja active Active

- 2018-08-20 CN CN201880061470.5A patent/CN111133485B/zh active Active

- 2018-08-20 EP EP18782225.9A patent/EP3673470B1/en active Active

- 2018-12-06 US US16/211,376 patent/US11099569B2/en active Active

-

2021

- 2021-08-23 US US17/408,728 patent/US11710303B2/en active Active

Patent Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8767186B2 (en) * | 2007-11-07 | 2014-07-01 | Magna Electronics Inc. | Object detection system |

| JP2014157522A (ja) * | 2013-02-18 | 2014-08-28 | East Nippon Expressway Co Ltd | プローブデータを活用した道路交通管制システム |

| US9164511B1 (en) * | 2013-04-17 | 2015-10-20 | Google Inc. | Use of detected objects for image processing |

| CN105358397A (zh) * | 2013-05-03 | 2016-02-24 | 谷歌公司 | 对控制车辆的速度的预测性推理 |

| CN106428009A (zh) * | 2015-07-31 | 2017-02-22 | 福特全球技术公司 | 车辆轨迹确定 |

| CN108292356A (zh) * | 2015-11-04 | 2018-07-17 | 祖克斯有限公司 | 用于实施自主车辆中的主动安全系统的系统 |

| CN107024215A (zh) * | 2016-01-29 | 2017-08-08 | 福特全球技术公司 | 追踪动态环境内的对象以改进定位 |

| CN105679021A (zh) * | 2016-02-02 | 2016-06-15 | 重庆云途交通科技有限公司 | 基于交通大数据的行程时间融合预测及查询方法 |

| CN106504530A (zh) * | 2016-10-31 | 2017-03-15 | 合肥工业大学 | 一种用户出行路径诱导与管控系统及其方法 |

Also Published As

| Publication number | Publication date |

|---|---|

| CN111133485A (zh) | 2020-05-08 |

| US11099569B2 (en) | 2021-08-24 |

| US20210382488A1 (en) | 2021-12-09 |

| US20190064815A1 (en) | 2019-02-28 |

| US20190146507A1 (en) | 2019-05-16 |

| JP7199421B2 (ja) | 2023-01-05 |

| WO2019040349A1 (en) | 2019-02-28 |

| JP2020531993A (ja) | 2020-11-05 |

| US10216189B1 (en) | 2019-02-26 |

| EP3673470A1 (en) | 2020-07-01 |

| EP3673470B1 (en) | 2023-12-06 |

| US11710303B2 (en) | 2023-07-25 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN111133485B (zh) | 自主交通工具的对象预测优先级排序系统和方法 | |

| US11713006B2 (en) | Systems and methods for streaming processing for autonomous vehicles | |

| US12045054B2 (en) | Discrete decision architecture for motion planning system of an autonomous vehicle | |

| US11822337B2 (en) | Autonomous vehicles featuring machine-learned yield model | |

| US11467586B2 (en) | Gridlock solver for motion planning system of an autonomous vehicle | |

| US11899453B2 (en) | Systems and methods to control autonomous vehicle motion | |

| US10654453B2 (en) | Systems and methods for low-latency braking action for an autonomous vehicle |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication | ||

| SE01 | Entry into force of request for substantive examination | ||

| SE01 | Entry into force of request for substantive examination | ||

| GR01 | Patent grant | ||

| GR01 | Patent grant | ||

| CP03 | Change of name, title or address |

Address after: Pennsylvania, USA Patentee after: Uatc Co.,Ltd. Country or region after: U.S.A. Address before: California, USA Patentee before: Uatc Co.,Ltd. Country or region before: U.S.A. |

|

| CP03 | Change of name, title or address | ||

| TR01 | Transfer of patent right |

Effective date of registration: 20240430 Address after: Pennsylvania, USA Patentee after: Aurora operations Country or region after: U.S.A. Address before: Pennsylvania, USA Patentee before: Uatc Co.,Ltd. Country or region before: U.S.A. |

|

| TR01 | Transfer of patent right |