KR20140089847A - 전자 장치 및 그 제어 방법 - Google Patents

전자 장치 및 그 제어 방법 Download PDFInfo

- Publication number

- KR20140089847A KR20140089847A KR1020130001776A KR20130001776A KR20140089847A KR 20140089847 A KR20140089847 A KR 20140089847A KR 1020130001776 A KR1020130001776 A KR 1020130001776A KR 20130001776 A KR20130001776 A KR 20130001776A KR 20140089847 A KR20140089847 A KR 20140089847A

- Authority

- KR

- South Korea

- Prior art keywords

- voice

- identification tag

- user

- tag

- electronic device

- Prior art date

Links

- 238000000034 method Methods 0.000 title claims description 40

- 230000006870 function Effects 0.000 description 12

- 238000010586 diagram Methods 0.000 description 10

- 230000002452 interceptive effect Effects 0.000 description 7

- 230000004044 response Effects 0.000 description 7

- 238000004891 communication Methods 0.000 description 5

- 238000005516 engineering process Methods 0.000 description 4

- 238000009877 rendering Methods 0.000 description 3

- 238000000605 extraction Methods 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/41—Structure of client; Structure of client peripherals

- H04N21/422—Input-only peripherals, i.e. input devices connected to specially adapted client devices, e.g. global positioning system [GPS]

- H04N21/42203—Input-only peripherals, i.e. input devices connected to specially adapted client devices, e.g. global positioning system [GPS] sound input device, e.g. microphone

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/16—Sound input; Sound output

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

- G10L15/22—Procedures used during a speech recognition process, e.g. man-machine dialogue

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/47—End-user applications

- H04N21/472—End-user interface for requesting content, additional data or services; End-user interface for interacting with content, e.g. for content reservation or setting reminders, for requesting event notification, for manipulating displayed content

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS TECHNIQUES OR SPEECH SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING TECHNIQUES; SPEECH OR AUDIO CODING OR DECODING

- G10L15/00—Speech recognition

- G10L15/22—Procedures used during a speech recognition process, e.g. man-machine dialogue

- G10L2015/223—Execution procedure of a spoken command

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Human Computer Interaction (AREA)

- Signal Processing (AREA)

- Health & Medical Sciences (AREA)

- Audiology, Speech & Language Pathology (AREA)

- Physics & Mathematics (AREA)

- Acoustics & Sound (AREA)

- Computational Linguistics (AREA)

- Databases & Information Systems (AREA)

- Theoretical Computer Science (AREA)

- User Interface Of Digital Computer (AREA)

- General Health & Medical Sciences (AREA)

- General Engineering & Computer Science (AREA)

- General Physics & Mathematics (AREA)

Abstract

전자 장치가 개시된다. 전자 장치는, 사용자 음성을 입력받는 음성 입력부, 적어도 하나의 객체를 포함하는 UI 화면을 제공하는 디스플레이부 및 객체에 대해 사용자 음성에 의한 호출 가능 여부를 판단하고, 판단 결과에 기초하여 객체를 식별하기 위한 식별 태그를 객체에 부여하여 디스플레이하는 제어부;를 포함한다.

Description

본 발명은 전자 장치 및 그 제어 방법에 관한 것으로 더욱 상세하게는 사용자의 음성에 따라 제어되는 전자 장치 및 그 제어 방법에 관한 것이다.

전자 기술의 발달에 힘입어 다양한 종류의 전자 장치가 개발되어 보급되고 사용자의 요구에 따라 점차 다양한 기능을 구비하게 되었다. 특히, TV의 경우, 최근에는 인터넷과 연결되어 인터넷 서비스까지 지원하고, 사용자는 TV를 통해 많은 수의 디지털 방송 채널까지 시청할 수 있게 되었다.

한편, 최근에는 전자 장치를 조금 더 편리하고 직관적으로 제어하기 위하여 음성 인식을 이용한 기술이 개발되고 있다. 특히, TV의 경우, 사용자의 음성을 인식하고, 볼륨 조절 또는 채널 변경과 같이 사용자의 음성에 대응되는 기능을 수행할 수 있게 되었다.

하지만 종래의 음성 인식을 이용한 제어 방법에 따르면, 제한된 네비게이션 명령어를 이용하여 포커스로 화면 상의 메뉴를 일일이 탐색하여야 하므로 사용성이 떨어진다는 문제점이 있었다.

본 발명은 상술한 필요성에 따른 것으로, 본 발명의 목적은 음성 인식 기술을 이용한 객체 호출을 용이하게 하는 전자 장치 및 그 제어 방법을 제공함에 있다.

이상과 같은 목적을 달성하기 위한 본 발명의 일 실시 예에 따른 사용자의 음성에 의해 제어되는 전자 장치는, 사용자 음성을 입력받는 음성 입력부, 적어도 하나의 객체를 포함하는 UI 화면을 제공하는 디스플레이부 및, 상기 객체에 대해 상기 사용자 음성에 의한 호출 가능 여부를 판단하고, 상기 판단 결과에 기초하여 상기 객체를 식별하기 위한 식별 태그를 상기 객체에 부여하여 디스플레이하는 제어부를 포함한다.

또한, 상기 제어부는, 객체에 대한 음성 호출이 가능하도록 하는 텍스트 항목이 상기 객체에 태깅되어 있지 않은 경우, 상기 식별 태그를 부여하여 디스플레이할 수 있다.

이 경우, 상기 텍스트 항목이 태깅되어 있지 않은 객체는, 썸네일 속성 또는 리스트 속성을 갖는 객체가 될 수 있다.

또한, 상기 제어부는, 상기 사용자 음성에 의해 상기 식별 태그가 호출되면, 상기 식별 태그가 부여된 객체에 대한 태스크를 수행할 수 있다.

또한, 상기 제어부는, 상기 UI 화면 상에서 상기 객체가 디스플레이된 순서에 기초하여 순차적으로 상기 식별 태그를 부여하여 디스플레이할 수 있다.

이 경우, 상기 식별 태그는, 기설정된 순서를 갖는 숫자 태그 및 알파벳 태그 중 적어도 하나가 될 수 있다.

또한, 상기 제어부는, 상기 식별 태그 및 상기 사용자 음성에 의해 호출이 가능한 텍스트 항목 중 적어도 하나에 음성 호출이 가능함을 나타내는 기설정된 GUI를 부가하여 디스플레이할 수 있다.

한편, 본 발명의 일 실시 예에 따른 사용자의 음성에 의해 제어되는 전자 장치의 제어 방법은, 적어도 하나의 객체를 포함하는 UI 화면을 제공하기 위한 사용자 명령을 입력받는 단계, 상기 객체에 대해 사용자 음성에 의한 호출 가능 여부를 판단하는 단계 및, 상기 판단 결과에 기초하여 상기 객체를 식별하기 위한 식별 태그를 상기 객체에 부여하여 디스플레이하는 단계를 포함한다.

이 경우, 상기 호출 가능 여부를 판단하는 단계는, 객체에 대한 음성 호출이 가능하도록 하는 텍스트 항목이 상기 객체에 태깅되어 있지 않은 경우 호출이 불가능하다고 판단하고, 상기 디스플레이하는 단계는, 상기 호출이 불가능하다고 판단된 객체에 상기 식별 태그를 부여하여 디스플레이할 수 있다.

여기서, 상기 텍스트 항목이 태깅되어 있지 않은 객체는, 썸네일 속성 또는 리스트 속성을 갖는 객체가 될 수 있다.

또한, 상기 사용자 음성에 의해 상기 식별 태그가 호출되면, 상기 식별 태그가 부여된 객체에 대한 태스크를 수행하는 단계를 더 포함할 수 있다.

또한, 상기 디스플레이하는 단계는, 상기 UI 화면 상에서 상기 객체가 디스플레이된 순서에 기초하여 순차적으로 상기 식별 태그를 부여하여 디스플레이할 수 있다.

이 경우, 상기 식별 태그는, 기설정된 순서를 갖는 숫자 태그 및 알파벳 태그 중 적어도 하나가 될 수 있다.

또한, 상기 디스플레이하는 단계는, 상기 식별 태그 및 상기 사용자 음성에 의해 호출이 가능한 텍스트 항목 중 적어도 하나에 음성 호출이 가능함을 나타내는 기설정된 GUI를 부가하여 디스플레이할 수 있다.

이상과 같은 본 발명의 다양한 실시 예에 따르면, 음성 인식 기술을 이용하여 전자 장치를 편리하게 제어할 수 있게 된다.

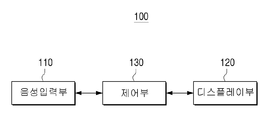

도 1은 본 발명의 일 실시 예에 따른 전자 장치의 구성을 나타내는 블럭도이다.

도 2는 본 발명의 다른 실시 예에 따른, 전자 장치의 구성을 나타내는 블럭도를 도시한 도면이다.

도 3은 본 발명의 일 실시 예에 따른 저장부에 저장된 소프트웨어 구성을 설명하기 위한 도면이다.

도 4는 본 발명의 일 실시 예에 따른 대화형 시스템을 설명하기 위한 도면이다.

도 5 내지 7은 본 발명의 다양한 실시 예에 따른 UI 제공 방법에 대해 설명하기 위한 도면들이다.

도 8은 본 발명의 일 실시 예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도이다.

도 2는 본 발명의 다른 실시 예에 따른, 전자 장치의 구성을 나타내는 블럭도를 도시한 도면이다.

도 3은 본 발명의 일 실시 예에 따른 저장부에 저장된 소프트웨어 구성을 설명하기 위한 도면이다.

도 4는 본 발명의 일 실시 예에 따른 대화형 시스템을 설명하기 위한 도면이다.

도 5 내지 7은 본 발명의 다양한 실시 예에 따른 UI 제공 방법에 대해 설명하기 위한 도면들이다.

도 8은 본 발명의 일 실시 예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도이다.

이하에서는 첨부된 도면을 참조하여 본 발명을 보다 상세하게 설명한다.

도 1은 본 발명의 일 실시 예에 따른 전자 장치의 구성을 나타내는 블럭도이다.

도 1에 따르면, 전자 장치(100)는 음성 입력부(110), 디스플레이부(120) 및 제어부(130)를 포함한다.

전자 장치(100)는 스마트 TV일 수 있으나, 이는 일 실시 예에 불과할 뿐 스마트 폰, 태블릿 PC, 노트북 PC 등과 같은 다양한 전자 장치로 구현될 수 있다.

전자 장치(100)는 사람의 자연스러운 발성에 의한 음성을 인식하여 실행 명령어로서 받아들이는 음성 인식 기능을 수행하도록 구현될 수 있다. 여기서, 음성 인식이란, 자동적 수단에 의하여 음성으로부터 언어적 의미 내용을 식별하는 것으로, 구체적으로 음성 파형을 입력하여 단어나 단어열을 식별하고 의미를 추출하는 처리 과정이며, 크게 음성 분석, 음소 인식, 단어 인식, 문장 해석, 의미 추출하는 과정에 의해 수행될 수 있는데 이에 대한 자세한 설명은 생략하도록 한다.

음성 입력부(110)는 사용자가 발화(utterance)한 음성을 입력받는다. 음성 입력부(110)는 입력된 음성 신호를 전기 신호로 변환하여 제어부(130)로 출력한다. 예를 들어, 음성 입력부(110)는 마이크로폰으로 구현될 수 있다. 또한, 음성 입력부(110)는 전자 장치(100)와 일체형(all-in-one)뿐만 아니라 분리된 형태로 구현될 수 있다. 분리된 음성 입력부(110)는 전자 장치(100)와 유선 또는 무선 네트워크를 통하여 연결될 수 있다.

디스플레이부(120)는 방송 수신부를 통해 수신된 방송 신호에 대응되는 영상을 표시한다. 디스플레이부(120)는 외부 단자 입력부를 통해 입력되는 영상 데이터(예를 들어, 동영상)를 표시할 수 있다.

특히, 디스플레이부(120)는 다양한 객체를 포함하는 UI 화면을 디스플레이할 수 있다. 예를 들어, 디스플레이부(120)는 복수의 영화 컨텐츠를 제공하는 UI 화면에서 영화 컨텐츠 각각에 대응되는 복수의 썸네일을 포함하는 UI 화면을 디스플레이할 수 있다.

제어부(130)는 음성 입력부(110) 및 디스플레이부(120)를 제어한다. 여기서, 제어부(130)는 CPU(central processing unit) 및 전자 장치(100)를 제어하기 위한 모듈 및 데이터를 저장하는 ROM(Read Only Memory) 및 RAM(Random Access Memory)을 포함할 수 있다.

특히, 제어부(130)는 디스플레이부(120)에 디스플레이되는 객체에 대해 사용자 음성에 의한 호출 가능 여부를 판단하고 판단 결과에 기초하여 객체를 식별하기 위한 식별 태그를 객체에 부여하여 디스플레이할 수 있다.

구체적으로, 제어부(130)는 객체에 대한 음성 호출이 가능하도록 하는 텍스트 항목이 객체에 태깅되어 있지 않은 경우, 사용자 음성에 의한 호출이 불가능하다고 판단하고 식별 태그를 부여하여 디스플레이할 수 있다.

예를 들어, 썸네일 속성을 갖는 객체나 리스트 속성을 갖는 객체는 일반적으로 사용자가 이를 음성으로 호출할 수 있는 텍스트 항목을 갖지 못한다. 이에 따라 사용자가 이를 식별하여 호출할 수 있는 식별 태그를 부여하여 사용자의 음성 호출이 가능하도록 할 수 있다.

이 경우, 제어부(130)는 UI 화면 상에서 객체가 디스플레이된 순서에 기초하여 순차적으로 식별 태그를 부여하여 디스플레이할 수 있다. 여기서, 식별 태그는 식별 태그는, 기설정된 순서를 갖는 숫자 태그 및 알파벳 태그 중 적어도 하나가 될 수 있지만, 이에 한정되는 것은 아니다.

예를 들어, 화면 상에 5개의 영화 썸네일이 디스플레이되는 경우 디스플레이된 순서에 따라 1 내지 5의 식별 태그를 부여하여 사용자가 식별 태그를 이용하여 원하는 영화 썸네일을 음성으로 호출가능하도록 할 수 있다.

또한, 제어부(130)는 음성 호출이 가능한 호출 텍스트에 호출이 가능함을 나타내는 기설정된 GUI를 부가하여 디스플레이할 수 있다. 이 경우, 음성 호출이 가능한 텍스트 항목에는 상술한 식별 태그가 포함될 수 있음은 물론이다. 하지만, 식별 태그 외에도 음성 호출이 가능한 다른 텍스트 항목들이 포함될 수 있음은 물론이다.

예를 들어, 특정 메뉴 항목이 음성 호출이 가능한 "Sub category" 라는 텍스트로 구성되는 경우 해당 텍스트에 기설정된 GUI를 부가하여 디스플레이할 수 있다. 여기서, 호출이 가능함을 나타내는 기설정된 GUI는, 따옴표 형태의 GUI가 될 수 있으나, 이에 한정되는 것은 아니다. 예를 들어, 말풍선 형태의 GUI와 같은 사용자에게 호출가능함을 인식시킬 수 있는 GUI라면 이에 한정되지 않고 적용가능하다.

또한, 제어부(130)는 음성 입력부(110)를 통해 입력된 사용자의 음성에 의해 식별 태그가 호출되면 식별 태그가 부여된 객체를 호출하도록 제어할 수 있다. 예를 들어, 제어부(130)는 사용자 음성에 의해 "1"이 호출되면, "1"이라는 식별 태그가 부여된 객체가 호출된 것으로 판단하고 해당 객체에 대응되는 태스크를 수행할 수 있다. 여기서, 해당 객체에 대응되는 태스크는 해당 객체를 호출함에 의해 기기에 의해 수행 가능한 기 정의된 작업으로 예를 들어, "1"이라는 식별 태그가 부여된 컨텐츠가 동영상 컨텐츠인 경우 해당 컨텐를 재생하거나, 해당 컨텐츠의 세부 항목을 디스플레이하는 작업이 될 수 있다.

이하에서는 제어부(130)가 음성 입력부(110)를 통해 입력된 사용자 음성을 인식하는 방법에 대해 간략히 설명하도록 한다.

제어부(130)는 음성 입력부(110)를 통해 음성이 입력되는 경우, 음성 인식 모듈 및 음성 데이터베이스를 이용하여 음성을 인식한다. 음성 인식(voice recognition)은 입력되는 음성의 형태에 따라, 각각의 단어를 구분하여 발화한 음성을 인식하는 고립단어 인식(isolated word recognition), 연속단어, 연속문장 및 대화체 음성을 인식하는 연속 음성 인식(continuous speech recognition) 및 고립단어 인식과 연속음성 인식의 중간형태로, 미리 정해진 핵심어를 검출하여 인식하는 핵심어 검출(keyword spotting)으로 구분될 수 있다.

사용자 음성이 입력되는 경우, 제어부(130)는 입력된 음성 신호 내에서 사용자가 발화한 음성의 시작과 끝을 검출하여 음성 구간을 판단한다. 제어부(130)는 입력된 음성 신호의 에너지를 계산하고, 계산된 에너지에 따라 음성 신호의 에너지 레벨을 분류하여, 동적 프로그래밍을 통해 음성 구간을 검출할 수 있다. 제어부(140)는 검출된 음성 구간 내의 음성 신호에서 음향 모델(Acoustic Model)을 기초로 음성의 최소 단위인 음소를 검출하여 음소 데이터를 생성한다. 제어부(130)는 생성된 음소 데이터에 HMM(Hidden Markov Model) 확률 모델을 적용하여 텍스트 정보를 생성한다. 그러나, 상술한 바와 같이, 사용자의 음성을 인식하는 방법은 일 실시 예에 불과할 뿐, 다른 방법을 이용하여 사용자 음성을 인식할 수 있다. 이에 따라, 제어부(130)는 음성 신호 중에 포함된 사용자의 음성을 인식할 수 있다. 제어부(130)는 상술한 바와 같이, 인식된 음성을 이용하여, 전자 장치(100)의 태스크(task)를 수행하게 된다.

도 2는 본 발명의 다른 실시 예에 따른, 전자 장치의 구성을 나타내는 블럭도를 도시한 도면이다. 도 2를 참조하면, 전자 장치(100')는 음성 입력부(110), 디스플레이부(120), 제어부(130), 저장부(140), 방송 수신부(150), 외부단자 입력부(160), 리모컨 신호 수신부(170), 통신부(180), 음성 입력부(190) 및 오디오 출력부(195)를 포함한다.

한편, 도 2에 도시된 구성요소 중 도 1에 도시된 구성요소와 중복되는 부분에 대해서는 자세한 설명을 생략하도록 한다.

제어부(130)는 RAM(131), ROM(132), 메인 CPU(133), 그래픽 처리부(134), 제1 내지 n 인터페이스(135-1 ~ 135-n), 버스(136)를 포함한다.

RAM(131), ROM(132), 메인 CPU(133), 그래픽 처리부(134), 제1 내지 n 인터페이스(135-1 ~ 135-n) 등은 버스(136)를 통해 서로 연결될 수 있다.

제1 내지 n 인터페이스(135-1 내지 135-n)는 상술한 각종 구성요소들과 연결된다. 인터페이스들 중 하나는 네트워크를 통해 외부 장치와 연결되는 네트워크 인터페이스가 될 수도 있다.

메인 CPU(133)는 저장부(140)에 액세스하여, 저장부(140)에 저장된 O/S를 이용하여 부팅을 수행한다. 그리고, 저장부(140)에 저장된 각종 프로그램, 컨텐츠, 데이터 등을 이용하여 다양한 동작을 수행한다.

ROM(132)에는 시스템 부팅을 위한 명령어 세트 등이 저장된다. 턴온 명령이 입력되어 전원이 공급되면, 메인 CPU(133)는 ROM(132)에 저장된 명령어에 따라 저장부(140)에 저장된 O/S를 RAM(131)에 복사하고, O/S를 실행시켜 시스템을 부팅시킨다. 부팅이 완료되면, 메인 CPU(133)는 저장부(140)에 저장된 각종 어플리케이션 프로그램을 RAM(131)에 복사하고, RAM(131)에 복사된 어플리케이션 프로그램을 실행시켜 각종 동작을 수행한다.

그래픽 처리부(134)는 연산부(미도시) 및 렌더링부(미도시)를 이용하여 아이콘, 이미지, 텍스트 등과 같은 다양한 객체를 포함하는 화면을 생성한다. 연산부(미도시)는 화면의 레이아웃에 따라 각 객체들이 표시될 좌표값, 형태, 크기, 컬러 등과 같은 속성값을 연산한다. 렌더링부(미도시)는 연산부(미도시)에서 연산한 속성값에 기초하여 객체를 포함하는 다양한 레이아웃의 화면을 생성한다. 렌더링부(미도시)에서 생성된 화면은 디스플레이부(110)의 디스플레이 영역 내에 표시된다.

저장부(140)는 전자 장치(100')를 구동하고 제어하기 위한 다양한 데이터 및 프로그램을 저장한다. 저장부(140)는 음성 입력부(110)를 통해 입력된 음성을 인식하기 위한 음성 인식 모듈 및 음성 데이터베이스를 포함할 수 있다. 여기서, 음성 데이터베이스는 기 설정된 음성 및 기 설정된 음성에 매칭되는 음성 태스크가 기록된 데이터베이스를 의미한다.

방송 수신부(150)는 유, 무선으로 외부로부터 방송 신호를 수신한다. 방송 신호는 영상(video), 오디오(audio) 및 부가 데이터(예를 들어, EPG)를 포함한다. 방송 수신부(150)는 지상파 방송, 케이블 방송, 위성 방송, 인터넷 방송 등과 같이 다양한 소스로부터 방송 신호를 수신할 수 있다.

외부단자 입력부(160)는 전자 장치(100')의 외부로부터 영상 데이터(예를 들어, 동영상 사진 등), 오디오 데이터(예를 들어, 음악 등) 등을 수신한다. 외부 단자 입력부(160)는 HDMI입력 단자(High-Definition Multimedia Interface input), 컴포넌트 입력 단자, PC 입력 단자, 또는 USB 입력 단자 중 적어도 하나를 포함할 수 있다. 리모컨 신호 수신부(170)는 외부의 리모컨으로부터 입력되는 리모컨 신호를 수신한다. 리모컨 신호 수신부(170)는 전자 장치(100')가 음성 태스크 모드이거나 모션 태스크 모드에서도 리모컨 신호를 수신할 수 있다.

통신부(180)는 제어부(140)의 제어에 의해 전자 장치(100')와 외부 장치(미도시)를 연결할 수 있다. 구체적으로, 통신부(180)는 이더넷(Ethernet)(181), 무선랜(182) 및 블루투스(bluetooth)(183) 등의 통신 방식을 제공할 수 있으나, 이에 한정되는 것은 아니다.

여기서, 외부 장치는 대화형 서비스를 제공하기 위한 ASR(Automathic Speech Recognition) 서버 및 대화형 서버 등으로 구현 가능하다.

즉, 본 발명에 따른 전자 장치(100')는 단순히 음성 인식에 따른 태스크 수행 뿐 아니라, 다양한 대화형 서비스를 제공하도록 구현될 수 있는데 이에 대해서는 도 4를 참고하여 후술하도록 한다.

또한, 외부 장치는 어플리케이션을 다운로드 하거나 웹 브라우징을 할 수 있는 서버로 구현되는 것도 가능하다.

오디오 출력부(190)는 제어부(130)의 제어에 의해 방송 신호에 대응되는 음성을 출력한다. 오디오 출력부(190)는 스피커(191), 헤드폰 출력 단자(192) 또는 S/PDIF 출력 단자(193) 중 적어도 하나를 포함할 수 있다.

도 3은 본 발명의 일 실시 예에 따른 저장부에 저장된 소프트웨어 구성을 설명하기 위한 도면이다.

저장부(140)는 도 3에 도시된 바와 같이, 전원 제어 모듈(140a), 채널 제어 모듈(140b), 볼륨 제어 모듈(140c), 외부입력 제어 모듈(140d), 화면 제어 모듈(140e), 오디오 제어 모듈(140f), 인터넷 제어 모듈(140g), 어플리케이션 모듈(140h), 검색 제어 모듈(140i), UI 처리 모듈(140j), 음성 인식 모듈(140k), 음성 데이터베이스(140l)를 포함한다. 이들 모듈들(140a 내지 140l)은 각각 전원 제어 기능, 채널 제어 기능, 볼륨 제어 기능, 외부 입력 제어 기능, 화면 제어 기능, 오디오 제어 기능, 인터넷 제어 기능, 어플리케이션 실행 기능, 검색 제어 기능, UI 처리 기능을 수행하기 위하여 소프트웨어로 구현될 수 있다. 제어부(130)는 저장부(140)에 저장된 이들 소프트웨어를 실행시켜 해당 기능을 수행할 수 있다. 예를 들어, 제어부(130)는 음성 인식 모듈(140k) 및 음성 데이터베이스(140l)를 이용하여 사용자 음성을 인식하고 그에 대응되는 태스크를 수행할 수 있다.

도 4는 본 발명의 일 실시 예에 따른 대화형 시스템(1000)을 설명하기 위한 도면이다. 도 1에 도시된 바와 같이, 대화형 시스템은 전자 장치(100'), 제1 서버(200) 및 제2 서버(300)를 포함한다.

전자 장치(100')는 도 2에 도시된 전자 장치(100')로 구현 가능하며, 사용자 음성에 따라 다양한 태스크를 수행할 수 있다.

구체적으로, 전자 장치(100')는 사용자의 음성에 대응되는 응답 메시지를 출력하거나, 사용자의 음성에 대응되는 태스크를 수행할 수 있다.

이를 위해, 필요한 경우 전자 장치(100')는 수집된 사용자의 음성을 제1 서버(200)(예를 들어, ASR 서버)로 전송한다. 제1 서버(200)는 전자 장치(100')로부터 사용자의 음성이 수신되면 수신된 사용자의 음성을 텍스트 정보(또는, 텍스트)로 변환하고, 텍스트 정보를 전자 장치(100')로 전송한다.

그리고, 전자 장치(100')는 제1 서버(200)로부터 수신된 텍스트 정보를 제2 서버(300)로 전송한다. 제2 서버(300)(예를 들어, 대화형 서버)는 전자 장치(100')로부터 텍스트 정보가 수신되면 수신된 텍스트 정보에 대응되는 응답 정보를 생성하여 전자 장치(100)로 전송한다.

전자 장치(100')는 제2 서버(300)로부터 수신된 응답 정보에 기초하여, 다양한 동작을 수행할 수 있다.

구체적으로, 전자 장치(100')는 사용자의 음성에 대응되는 응답 메시지를 출력할 수 있다. 여기에서, 응답 메시지는 음성 및 텍스트 중 적어도 하나로 출력될 수 있다. 예를 들어, 전자 장치(100')는 특정 프로그램의 방송 시간을 문의하는 사용자의 음성이 입력되면, 해당 프로그램의 방송 시간을 음성 또는 텍스트 형태로 출력하거나, 이들의 조합으로 출력할 수 있다.

또한, 전자 장치(100')는 사용자의 음성에 대응되는 태스크를 수행할 수 있다. 예를 들어, 전자 장치(100)는 채널 변경을 위한 사용자의 음성이 입력되면, 해당 채널을 선국하여 디스플레이할 수 있다.

이 경우, 전자 장치(100')는 해당 태스크에 대응되는 응답 메시지를 함께 제공할 수도 있다. 즉, 전자 장치(100')는 사용자의 음성에 따라 수행된 태스크에 대한 정보를 음성 또는 텍스트 형태로 출력하거나, 이들의 조합으로 출력할 수 있다. 상술한 예의 경우, 전자 장치(100')는 변경된 채널에 대한 정보 또는 채널 변경이 완료되었음을 나타내는 메시지를 음성 및 텍스트 중 적어도 하나로 출력할 수 있다.

이하에서는 도 5 내지 7을 참고하여 본 발명의 다양한 실시 예에 따른 UI 제공 방법에 대해 설명하도록 한다.

도 5는 본 발명의 일 실시 예에 따른 UI 제공 방법을 설명하기 위한 도면이다.

도 5(a)와 같이 화면 상에 복수의 객체(511 내지 518)를 포함하는 UI 화면이 디스플레이될 수 있다.

도시된 UI 화면에서 영화 썸네일을 나타내는 객체 511 내지 517은 음성 호출이 가능하도록 하는 호출 텍스트가 태깅되어 있지 않은 객체이며 특정 메뉴 항목을 나타내는 객체 518은 음성 호출이 가능하도록 하는 호출 텍스트가 태깅된 경우로 가정하도록 한다.

이 경우, 영화 썸네일을 나타내는 객체 511 내지 517에는 해당 객체들을 식별하기 위한 식별 태그(511-1 내지 517-1)가 부여될 수 있다. 여기서, 식별 태그는 음성으로 해당 객체들을 식별하기 위한 태그로서 사용자에게 용이하게 인식 가능한 숫자 형태로 부여될 수 있지만, 이에 한정되는 것은 아니다.

한편, 특정 메뉴 항목을 나타내는 객체 518은 Sub category 라는 호출 텍스트가 태깅된 경우로서 별도의 식별 태그가 부여되지 않을 수 있다.

도 5(b)는 도 5(a)에 도시된 UI 페이지에서 다음 UI 페이지를 디스플레이하기 위한 아이템(520) 선택에 의해 다음 UI 페이지가 디스플레이된 상태를 도시한다.

도 5(b)에 도시된 UI 페이지 상에서 도 5(a)에 도시된 UI 페이지 상에 디스플레이된 복수의 영화 썸 네일 객체들(511 내지 517)과 다른 영화 썸네일 객체(521 내지 527)가 디스플레이될 수 있다.

이 경우, 해당 썸네일 객체(521 내지 527) 상에도 해당 객체들을 식별하기 위한 식별 태그가 부여될 수 있다. 도시된 바와 같이 식별 태그는 도 5(a)에 도시된 식별 태그와 동일한 형태인 1 내지 7의 숫자 태그가 될 수 있다. 이는 식별 태그는 단순히 현재 디스플레이된 화면 상에서 디스플레이된 객체들을 음성으로 호출이 용이하도록 식별하기 위한 것이므로 이전에 디스플레이된 화면에서 사용된 식별 태그인지 여부와 관계없이 할지라도 다시 사용될 수 있기 때문이다.

다만, 이는 일 실시 예에 불과하며, 경우에 따라서는 해당 썸네일 객체(521 내지 527) 상에는 도 5(a)에 도시된 식별 태그의 다음 순서인 8 내지 14의 숫자 태그가 부여되는 것도 가능하다.

도 6은 본 발명의 다른 실시 예에 따른 UI 제공 방법을 설명하기 위한 도면이다.

도 6에 도시된 바에 따르면, 호출할 수 있는 텍스트 항목에는 해당 텍스트가 호출가능함을 나타내는 기설정된 GUI 가 부가될 수 있다.

예를 들어 도시된 바와 같이 각 썸네일 객체(511 내지 517)에 부가된 식별 태그에는 쌍따옴표 형태의 GUI가 부가(611 내지 617)될 수 있다. 이에 따라 사용자는 해당 식별 태그가 음성으로 호출 가능한 텍스트임을 직관적으로 인식할 수 있게 된다.

또한, Sub category라는 호출 텍스트가 태깅된 특정 메뉴 항목을 나타내는 객체 518의 경우에도 Sub category가 호출가능한 텍스트임을 나타내도록 "Sub category"의 형태로 디스플레이될 수 있다.

도 7은 본 발명의 또 다른 실시 예에 따른 UI 제공 방법을 설명하기 위한 도면이다.

도 7에 도시된 바와 같이 음성 호출이 가능하도록 하는 호출 텍스트가 태깅되어 있지 않은 썸 네일 객체에 알파벳 태그를 부여하여 음성 호출이 가능하도록 할 수 있다.

즉, 객체에 부가되는 식별 태그는 사용자에게 쉽게 인식될 수 있는 것이라면 숫자에 한정되지 않게 다양한 형태로 적용될 수 있다.

한편, 상술한 실시 예들에서는 썸 네일 이미지를 사용자 음성에 의해 호출이 불가능한 객체의 예로써 설명하였지만, 이는 일 실시 예에 불과하며 리스트 등과 같이 사용자 호출이 불가능한 다른 객체에도 본 발명이 적용될 수 있음을 물론이다.

도 8은 본 발명의 일 실시 예에 따른 전자 장치의 제어 방법을 설명하기 위한 흐름도이다.

도 8에 도시된 전자 장치의 제어 방법에 따르면, 우선, 한편, 본 발명의 일 실시 예에 따른 사용자의 음성에 의해 제어되는 전자 장치의 제어 방법은, 우선 적어도 하나의 객체를 포함하는 UI 화면을 제공하기 위한 사용자 명령을 수신한다(S810),

이어서, UI 화면에 포함된 객체에 대해 사용자 음성에 의한 호출 가능 여부를 판단한다(S820).

이 후 S820 단계의 판단 결과에 기초하여 객체를 식별하기 위한 식별 태그를 객체에 부여하여 디스플레이한다(S830).

이 경우, 호출 가능 여부를 판단하는 S820 단계에서는, 객체에 대한 음성 호출이 가능하도록 하는 텍스트 항목이 객체에 태깅되어 있지 않은 경우 호출이 불가능하다고 판단할 수 있다. 여기서, 텍스트 항목이 태깅되어 있지 않은 객체는, 썸네일 속성 또는 리스트 속성을 갖는 객체가 될 수 있다.

또한, 디스플레이하는 S830 단계에서는, S820 단계에서 호출이 불가능하다고 판단된 객체에 식별 태그를 부여하여 디스플레이할 수 있다.

구체적으로, UI 화면 상에서 객체가 디스플레이된 순서에 기초하여 순차적으로 식별 태그를 부여하여 디스플레이할 수 있다. 이 경우, 식별 태그는, 기설정된 순서를 갖는 숫자 태그 및 알파벳 태그 중 적어도 하나가 될 수 있다.

또한, 사용자 음성에 의해 객체에 부여된 식별 태그가 호출되면, 식별 태그가 부여된 객체가 호출된 것으로 판단하고, 해당 객체에 대한 태스크를 수행할 수 있다.

또한, 디스플레이하는 S830 단계에서는, 객체에 부여된 식별 태그 및 사용자 음성에 의해 호출이 가능한 텍스트 항목 중 적어도 하나에 음성 호출이 가능함을 나타내는 기설정된 GUI를 부가하여 디스플레이할 수 있다. 여기서, 사용자 음성에 의해 호출이 가능한 텍스트 항목이란, 음성 인식이 가능한 텍스트 항목을 의미하는 것으로 예를 들어, 기설정된 메뉴 항목에 부여된 메뉴 타이틀 항목 등이 이에 해당될 수 있다.

이에 따라 음성 인식을 통한 객체 선택시 추가적인 포커스 조작 없이 원하는 객체를 선택할 수 있게 된다.

한편, 상술한 다양한 실시 예에 따른 전자 장치의 제어 방법은 프로그램으로 구현되어 전자 장치에 제공될 수 있다.

일 예로, 적어도 하나의 객체를 포함하는 UI 화면을 제공하기 위한 사용자 명령을 수신하면 객체에 대해 사용자 음성에 의한 호출 가능 여부를 판단하고, 판단 결과에 기초하여 객체를 식별하기 위한 식별 태그를 객체에 부여하여 디스플레이하는 구성을 수행하는 프로그램이 저장된 비일시적 판독 가능 매체(non-transitory computer readable medium)가 제공될 수 있다.

비일시적 판독 가능 매체란 레지스터, 캐쉬, 메모리 등과 같이 짧은 순간 동안 데이터를 저장하는 매체가 아니라 반영구적으로 데이터를 저장하며, 기기에 의해 판독(reading)이 가능한 매체를 의미한다. 구체적으로는, 상술한 다양한 어플리케이션 또는 프로그램들은 CD, DVD, 하드 디스크, 블루레이 디스크, USB, 메모리카드, ROM 등과 같은 비일시적 판독 가능 매체에 저장되어 제공될 수 있다.

또한, 전자 장치에 대해 도시한 상술한 블록도에서는 버스(bus)를 미도시하였으나, 전자 장치에서 각 구성요소 간의 통신은 버스를 통해 이루어질 수도 있다. 또한, 각 디바이스에는 상술한 다양한 단계를 수행하는 CPU, 마이크로 프로세서 등과 같은 프로세서가 더 포함될 수도 있다.

또한, 이상에서는 본 발명의 바람직한 실시 예에 대하여 도시하고 설명하였지만, 본 발명은 상술한 특정의 실시 예에 한정되지 아니하며, 청구범위에서 청구하는 본 발명의 요지를 벗어남이 없이 당해 발명이 속하는 기술분야에서 통상의 지식을 가진자에 의해 다양한 변형실시가 가능한 것은 물론이고, 이러한 변형실시들은 본 발명의 기술적 사상이나 전망으로부터 개별적으로 이해되어져서는 안될 것이다.

100 : 전자 장치 110 : 음성 입력부

120 : 디스플레이부 130 : 제어부

120 : 디스플레이부 130 : 제어부

Claims (14)

- 사용자의 음성에 의해 제어되는 전자 장치에 있어서,

사용자 음성을 입력받는 음성 입력부;

적어도 하나의 객체를 포함하는 UI 화면을 제공하는 디스플레이부; 및

상기 객체에 대해 상기 사용자 음성에 의한 호출 가능 여부를 판단하고, 상기 판단 결과에 기초하여 상기 객체를 식별하기 위한 식별 태그를 상기 객체에 부여하여 디스플레이하는 제어부;를 포함하는 전자 장치. - 제1항에 있어서,

상기 제어부는,

객체에 대한 음성 호출이 가능하도록 하는 텍스트 항목이 상기 객체에 태깅되어 있지 않은 경우, 상기 식별 태그를 부여하여 디스플레이하는 것을 특징으로 하는 전자 장치. - 제2항에 있어서,

상기 텍스트 항목이 태깅되어 있지 않은 객체는,

썸네일 속성 또는 리스트 속성을 갖는 객체인 것을 특징으로 하는 전자 장치. - 제1항에 있어서,

상기 제어부는,

상기 사용자 음성에 의해 상기 식별 태그가 호출되면, 상기 식별 태그가 부여된 객체에 대한 태스크를 수행하는 것을 특징으로 하는 전자 장치. - 제1항에 있어서,

상기 제어부는,

상기 UI 화면 상에서 상기 객체가 디스플레이된 순서에 기초하여 순차적으로 상기 식별 태그를 부여하여 디스플레이하는 것을 특징으로 하는 전자 장치. - 제5항에 있어서,

상기 식별 태그는,

기설정된 순서를 갖는 숫자 태그 및 알파벳 태그 중 적어도 하나인 것을 특징으로 하는 전자 장치. - 제1항에 있어서,

상기 제어부는,

상기 식별 태그 및 상기 사용자 음성에 의해 호출이 가능한 텍스트 항목 중 적어도 하나에 음성 호출이 가능함을 나타내는 기설정된 GUI를 부가하여 디스플레이하는 것을 특징으로 하는 전자 장치. - 사용자의 음성에 의해 제어되는 전자 장치의 제어 방법에 있어서,

적어도 하나의 객체를 포함하는 UI 화면을 제공하기 위한 사용자 명령을 수신하는 단계;

상기 객체에 대해 사용자 음성에 의한 호출 가능 여부를 판단하는 단계; 및

상기 판단 결과에 기초하여 상기 객체를 식별하기 위한 식별 태그를 상기 객체에 부여하여 디스플레이하는 단계;를 포함하는 제어 방법. - 제8항에 있어서,

상기 호출 가능 여부를 판단하는 단계는,

객체에 대한 음성 호출이 가능하도록 하는 텍스트 항목이 상기 객체에 태깅되어 있지 않은 경우 호출이 불가능하다고 판단하고,

상기 디스플레이하는 단계는,

상기 호출이 불가능하다고 판단된 객체에 상기 식별 태그를 부여하여 디스플레이하는 것을 특징으로 하는 제어 방법. - 제9항에 있어서,

상기 텍스트 항목이 태깅되어 있지 않은 객체는,

썸네일 속성 또는 리스트 속성을 갖는 객체인 것을 특징으로 하는 제어 방법. - 제8항에 있어서,

상기 사용자 음성에 의해 상기 식별 태그가 호출되면, 상기 식별 태그가 부여된 객체에 대한 태스크를 수행하는 단계;를 더 포함하는 것을 특징으로 하는 제어 방법. - 제8항에 있어서,

상기 디스플레이하는 단계는,

상기 UI 화면 상에서 상기 객체가 디스플레이된 순서에 기초하여 순차적으로 상기 식별 태그를 부여하여 디스플레이하는 것을 특징으로 하는 제어 방법. - 제12항에 있어서,

상기 식별 태그는,

기설정된 순서를 갖는 숫자 태그 및 알파벳 태그 중 적어도 하나인 것을 특징으로 하는 제어 방법. - 제8항에 있어서,

상기 디스플레이하는 단계는,

상기 식별 태그 및 상기 사용자 음성에 의해 호출이 가능한 텍스트 항목 중 적어도 하나에 음성 호출이 가능함을 나타내는 기설정된 GUI를 부가하여 디스플레이하는 것을 특징으로 하는 제어 방법.

Priority Applications (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020130001776A KR20140089847A (ko) | 2013-01-07 | 2013-01-07 | 전자 장치 및 그 제어 방법 |

| PCT/KR2013/009606 WO2014106986A1 (en) | 2013-01-07 | 2013-10-25 | Electronic apparatus controlled by a user's voice and control method thereof |

| EP13869992.1A EP2941896A4 (en) | 2013-01-07 | 2013-10-25 | ELECTRONIC APPARATUS CONTROLLED BY THE VOICE OF A USER AND METHOD FOR CONTROLLING THE SAME |

| US14/149,574 US10250935B2 (en) | 2013-01-07 | 2014-01-07 | Electronic apparatus controlled by a user's voice and control method thereof |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020130001776A KR20140089847A (ko) | 2013-01-07 | 2013-01-07 | 전자 장치 및 그 제어 방법 |

Related Child Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020170057482A Division KR20170054367A (ko) | 2017-05-08 | 2017-05-08 | 전자 장치 및 그 제어 방법 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20140089847A true KR20140089847A (ko) | 2014-07-16 |

Family

ID=51062063

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020130001776A KR20140089847A (ko) | 2013-01-07 | 2013-01-07 | 전자 장치 및 그 제어 방법 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US10250935B2 (ko) |

| EP (1) | EP2941896A4 (ko) |

| KR (1) | KR20140089847A (ko) |

| WO (1) | WO2014106986A1 (ko) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11720324B2 (en) | 2018-01-05 | 2023-08-08 | Samsung Electronics Co., Ltd. | Method for displaying electronic document for processing voice command, and electronic device therefor |

Families Citing this family (11)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP6102588B2 (ja) * | 2013-07-10 | 2017-03-29 | ソニー株式会社 | 情報処理装置、情報処理方法およびプログラム |

| CN104599669A (zh) * | 2014-12-31 | 2015-05-06 | 乐视致新电子科技(天津)有限公司 | 一种语音控制方法和装置 |

| US11019884B2 (en) | 2016-11-23 | 2021-06-01 | Nike, Inc. | Sole structure having a midsole component with movable traction members |

| EP3401797A1 (en) | 2017-05-12 | 2018-11-14 | Samsung Electronics Co., Ltd. | Speech navigation for multilingual web pages |

| KR102482589B1 (ko) | 2018-02-12 | 2022-12-30 | 삼성전자주식회사 | 음성 인식 서비스 운용 방법 및 이를 지원하는 전자 장치 |

| CN108491179A (zh) * | 2018-03-13 | 2018-09-04 | 黄玉玲 | 一种文字输入的方法及系统 |

| KR102563314B1 (ko) | 2018-08-30 | 2023-08-04 | 삼성전자주식회사 | 전자 장치 및 단축 명령어의 바로가기 생성 방법 |

| CN110968375B (zh) * | 2018-09-29 | 2023-01-31 | Tcl科技集团股份有限公司 | 界面控制方法、装置、智能终端及计算机可读存储介质 |

| US20210209147A1 (en) * | 2020-01-06 | 2021-07-08 | Strengths, Inc. | Precision recall in voice computing |

| US11922096B1 (en) | 2022-08-30 | 2024-03-05 | Snap Inc. | Voice controlled UIs for AR wearable devices |

| CN116564280B (zh) * | 2023-07-05 | 2023-09-08 | 深圳市彤兴电子有限公司 | 基于语音识别的显示器控制方法、装置以及计算机设备 |

Family Cites Families (16)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| IL119948A (en) * | 1996-12-31 | 2004-09-27 | News Datacom Ltd | Voice activated communication system and program guide |

| US6615176B2 (en) * | 1999-07-13 | 2003-09-02 | International Business Machines Corporation | Speech enabling labeless controls in an existing graphical user interface |

| KR20010015934A (ko) | 2000-03-11 | 2001-03-05 | 김하철 | 음성인식을 이용한 응용프로그램의 메뉴 실행방법 |

| US20030005461A1 (en) * | 2001-07-02 | 2003-01-02 | Sony Corporation | System and method for linking closed captioning to web site |

| US20050210416A1 (en) * | 2004-03-16 | 2005-09-22 | Maclaurin Matthew B | Interactive preview of group contents via axial controller |

| US20050268214A1 (en) | 2004-05-31 | 2005-12-01 | De-Jen Lu | Simple input method for a web browser |

| JP2007142840A (ja) * | 2005-11-18 | 2007-06-07 | Canon Inc | 情報処理装置及び情報処理方法 |

| JP2009169883A (ja) | 2008-01-21 | 2009-07-30 | Ict Solutions:Kk | Webブラウザの簡易操作方法 |

| GB0911353D0 (en) * | 2009-06-30 | 2009-08-12 | Haq Saad U | Discrete voice command navigator |

| KR101597102B1 (ko) * | 2009-09-29 | 2016-02-24 | 엘지전자 주식회사 | 휴대 단말기 및 그 제어방법 |

| KR101604843B1 (ko) * | 2009-12-30 | 2016-03-21 | 엘지전자 주식회사 | 휴대 단말기 및 그 동작 제어방법 |

| US8572177B2 (en) * | 2010-03-10 | 2013-10-29 | Xmobb, Inc. | 3D social platform for sharing videos and webpages |

| KR20120091496A (ko) * | 2010-12-23 | 2012-08-20 | 한국전자통신연구원 | 방송 서비스 제공 시스템 및 방송 서비스 제공 방법 |

| US20120260167A1 (en) * | 2011-04-07 | 2012-10-11 | Sony Corporation | User interface for audio video display device such as tv |

| US9183832B2 (en) | 2011-06-07 | 2015-11-10 | Samsung Electronics Co., Ltd. | Display apparatus and method for executing link and method for recognizing voice thereof |

| KR101897492B1 (ko) | 2011-06-07 | 2018-09-13 | 삼성전자주식회사 | 디스플레이 장치 및 이의 하이퍼링크 실행 방법 및 음성 인식 방법 |

-

2013

- 2013-01-07 KR KR1020130001776A patent/KR20140089847A/ko active Application Filing

- 2013-10-25 WO PCT/KR2013/009606 patent/WO2014106986A1/en active Application Filing

- 2013-10-25 EP EP13869992.1A patent/EP2941896A4/en not_active Withdrawn

-

2014

- 2014-01-07 US US14/149,574 patent/US10250935B2/en active Active

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11720324B2 (en) | 2018-01-05 | 2023-08-08 | Samsung Electronics Co., Ltd. | Method for displaying electronic document for processing voice command, and electronic device therefor |

Also Published As

| Publication number | Publication date |

|---|---|

| EP2941896A4 (en) | 2016-07-06 |

| US20140196087A1 (en) | 2014-07-10 |

| WO2014106986A1 (en) | 2014-07-10 |

| US10250935B2 (en) | 2019-04-02 |

| EP2941896A1 (en) | 2015-11-11 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR20140089847A (ko) | 전자 장치 및 그 제어 방법 | |

| US20210152870A1 (en) | Display apparatus, server apparatus, display system including them, and method for providing content thereof | |

| US9733895B2 (en) | Method for controlling electronic apparatus based on voice recognition and motion recognition, and electronic apparatus applying the same | |

| CN117056622A (zh) | 语音控制方法及显示设备 | |

| KR20170014353A (ko) | 음성 기반의 화면 내비게이션 장치 및 방법 | |

| KR20130016024A (ko) | 전자 장치 및 전자 장치의 ui 제공방법 | |

| KR20150089145A (ko) | 음성 제어를 수행하는 디스플레이 장치 및 그 음성 제어 방법 | |

| US20180151178A1 (en) | Interactive question-answering apparatus and method thereof | |

| KR101713784B1 (ko) | 전자 장치 및 그 제어 방법 | |

| CN113468351A (zh) | 一种智能设备及图像处理方法 | |

| KR20170054367A (ko) | 전자 장치 및 그 제어 방법 | |

| KR20220143622A (ko) | 전자 장치 및 그 제어 방법 | |

| US11930236B2 (en) | Content playback device using voice assistant service and operation method thereof | |

| US20130174101A1 (en) | Electronic apparatus and method of controlling the same | |

| TW202001541A (zh) | 人機互動及電視操作控制方法、裝置、設備以及儲存媒體 | |

| KR102463066B1 (ko) | 디스플레이 장치, 서버 장치 및 이들을 포함하는 디스플레이 시스템과 그 컨텐츠 제공 방법들 | |

| KR102326067B1 (ko) | 디스플레이 장치, 서버 장치 및 이들을 포함하는 디스플레이 시스템과 그 컨텐츠 제공 방법들 | |

| KR101508444B1 (ko) | 디스플레이 장치 및 이를 이용한 하이퍼링크 실행 방법 | |

| CN113076427B (zh) | 一种媒资资源搜索方法、显示设备及服务器 | |

| US20140195014A1 (en) | Electronic apparatus and method for controlling electronic apparatus | |

| KR20160022326A (ko) | 디스플레이 장치 및 그의 제어 방법 | |

| KR20150136315A (ko) | 디스플레이 장치 및 이의 제어 방법 | |

| KR20220129927A (ko) | 음성 인식 서비스를 제공하는 전자 장치 및 방법 | |

| CN115862615A (zh) | 一种显示设备、语音搜索方法及存储介质 | |

| KR20190077268A (ko) | 디스플레이 장치 및 그의 제어 방법 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A201 | Request for examination | ||

| E601 | Decision to refuse application | ||

| AMND | Amendment | ||

| A107 | Divisional application of patent |