JP3694663B2 - Mobile simulation experience apparatus and method - Google Patents

Mobile simulation experience apparatus and method Download PDFInfo

- Publication number

- JP3694663B2 JP3694663B2 JP2001309668A JP2001309668A JP3694663B2 JP 3694663 B2 JP3694663 B2 JP 3694663B2 JP 2001309668 A JP2001309668 A JP 2001309668A JP 2001309668 A JP2001309668 A JP 2001309668A JP 3694663 B2 JP3694663 B2 JP 3694663B2

- Authority

- JP

- Japan

- Prior art keywords

- data

- video

- output

- video data

- walking

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

Images

Description

【0001】

【発明の属する技術分野】

本発明は、動作に伴って風景等の映像を変化させて表示する移動疑似体験装置に関し、特に撮像の解説を音声で報知する移動疑似体験装置に関する。

【0002】

【従来の技術】

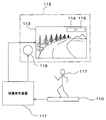

従来、この種の移動疑似体験装置として特開昭63−315078号公報、特開平9−56845号公報、特開平9−325674号公報及び特開平11−333023号公報に各々開示されるものがある。図10ないし図12に前記各従来装置の構成ブロック図を示す。

【0003】

前記図10に記載の従来装置は、走行装置110上で走行又は歩行の足踏み運動をすると、その足踏み(以下「走行」という)の速度情報が映像発生装置111に伝送される。映像発生装置111はビデオディスク等の記録媒体と、当該記録媒体に記憶されている映像を再生する手段を有しており、その再生出力が大型のテレビジョン受像機等の表示装置112の画面113に景色として映し出される。この景色は走行に応じて変化する。又、この景色には走行装置110からのパルス情報に基づいて算出された走行距離114と走行速度115も多重表示される。前記映像発生装置111は前記記録媒体から音声も再生し、スピーカ116で放声する。この音声には、別途音声メモリに記憶された音声(かけ声等)が随時多用される。

従って、走行者117は走行装置110上で走行すれば前方に走行と共に変化する景色が映し出され、音声も聞こえる快適な状態で走行運動ができる。

【0004】

前記図11に記載の他の従来装置は、所望の散歩道の映像と散歩道の路面の傾斜を記録したCD−ROM201と、このCD−ROM201を再生するCD−ROM読取装置202と、利用者の脈拍と血圧を計測するセンサ203と、その上を利用者が歩行するスピードと傾斜を変化できる歩行マシン204と、CD−ROM201の映像を表示するTVモニタ205と、データ処理装置206と、CD−ROM読取装置202とデータ処理装置206とのインターフェースをとるCD−ROMインターフェース部207と、センサ203とデータ処理装置206とのインターフェースをとるセンサ入力部208と、歩行マシン204とデータ処理装置206とのインターフェースをとる歩行マシンインターフェース部209と、TVモニタ205とデータ処理装置206とのインターフェースをとるTVモニタインターフェース210とから構成される。

【0005】

このように他の従来装置は、歩行マシン204の傾斜、スピードとTVモニタ205に表示される映像との間に、映像に基づいて歩行マシン204の傾斜を変えたり、歩行マシン204のスピードに応じてTVモニタ205の映像の動きの早さを変えるようにして相互に関連づけたのでバーチャルリアリティの世界を実感でき、楽しみながら健康増進を図ることができる。

【0006】

前記図12に記載の他の従来装置は、記憶装置が記憶する表示データにより表示される画像と音声に応答して子供がマットスイッチ301上の複数のスイッチ領域302、303、304、305のうち所定のスイッチ領域を踏むと、このマットスイッチ301からの入力データを基に次の画像と音声による表示がCRTモニタ308から行われるための所定入力条件が満たされたか否かが演算され、この演算結果に基づいた表示データが出力され、画像音声表示装置307により画像と音声による表示がCRTモニタ308から行われる。従って、子供は音楽等からなる音声のみならず画像による表示に応答してマットスイッチ301の上で体を動かすこととなり、楽しみながら基礎体力をつけ、ひいては基礎的な学習効果を得ることができる。

【0007】

【発明が解決しようとする課題】

前記各従来装置は以上のように構成されていたことから、歩行等の動作状態が停止した場合に映像の変化が停止すると共に、音声の出力も停止することとなることから、中断した動作状態での疑似的な再現性が十分に得られないという課題を有していた。特に、音声出力が映像内容等の解説の場合には、動作状態を再開すると中断された音声の解説が途中から出力されることとなり、解説内容の理解が困難となる課題を有する。

【0008】

また、前記各従来装置は歩行等の動作状態に伴って出力される映像及び音声が単一の内容で構成されていたことから、歩行ルート等の動作状態が多岐に亘る場合にはこれらを選択することができず、仮に複数の動作状態を選択してもこれに対応する映像及び音声を出力できないという課題を有していた。

また、歩行する歩行ルートの沿道に存在する店舗等の詳細が明確でなく、旅行等の予備知識として予め旅行先の詳細な情報が得にくいという課題を有する。

【0009】

本発明は、前記課題を解消するためになされたもので、動作状態に伴う疑似体験の解説を違和感なく明瞭に出力し、また各種動作ルートの選択及びこの選択された動作ルートの解説を行うことができる移動疑似体験装置を提供することを目的とする。

【0010】

【課題を解決するための手段】

本発明に係る移動疑似体験装置は、利用者の動作状態を検知して動作検知信号を出力する動作状態検知手段と、前記動作状態に応じて変化するデータ内容が所定のデータ長のデータブロックに区分された映像データ及び音声データを格納する映像音声記録手段と、前記映像データを表示画面上に出力すると共に音声データを音声で報知する出力手段と、前記動作検知信号に基づいて前記各データブロック毎の映像データ及び音声データを前記出力手段に出力し、前記動作検知信号により動作が中断されていると判断されている間に当該中断時において出力手段で表示される映像データを静止画として継続出力すると共に、前記動作の中断時における出力手段から出力されているデータブロックに含まれる総ての音声データを出力するように出力手段を制御する制御手段とを備えるものである。

【0011】

このように本発明においては、動作状態検知手段で検知した利用者の動作状態による動作検知信号に基づいて、制御手段が映像音声記録手段に格納される映像データ及び音声データを読出して出力手段から出力し、利用者が動作を中断した場合に中断時の映像データを静止画として継続出力すると共に、中断時の出力されているデータブロックの音声データを総て出力するように制御手段が制御するようにしているので、動作の中断が生じた場合においても停止状態及び再開時の映像に対応した音声信号の再生ができることとなり、疑似体験の解説を違和感なく明瞭に出力できる。

【0012】

また、本発明に係る移動疑似体験装置は必要に応じて、映像データが動作ルートの風景をデータ内容とし、前記音声データが映像データの風景を解説するデータ内容とするものである。このように本発明においては、利用者の動作に伴って変化する動作ルートの風景を映像データとし、この映像データの解説を音声データとしていることから、例えば旅行先等の予備知識を疑似体験として修得できる。

【0013】

また、本発明に係る移動疑似体験装置は必要に応じて、映像データ及び音声データが1又は複数に分岐された動作ルートのデータ内容とするものである。このように本発明においては、1又は複数に分岐された動作ルートをデータ内容とする映像データ及び音声データとしていることから、利用者が現場を実際に動作すると同様に動作ルートの変更が可能となり、疑似体験による動作の臨場感を高めることができる。

【0014】

また、本発明に係る移動疑似体験装置は必要に応じて、音声データが解説文における1又は複数のパラグラフ毎に区分したデータブロックで形成されるものである。このように本発明においては、音声データの各データブロックを1又は複数のパラグラフ毎に区切って形成していることから、動作中断時及び動作再開時の音声データによる解説がより違和感なく明瞭の出力できる。ここで、前記パラグラフは、文章の段落、文節、文の句切り等からなり、一又は複数の文章が表現する文意により区分される単位をいう。

【0015】

また、本発明に係る移動疑似体験装置は必要に応じて、映像データ及び音声データが地図上の異なる動作ルートに関するデータ内容として映像音声記録手段に複数格納され、前記複数の映像データ及び音声データのうち既に利用者が利用した映像データ及び音声データの動作ルートを地図上に表示するように出力手段から出力するものである。このように本発明においては、映像音声記録手段に地図上の異なる動作ルートに関する複数の映像データ及び音声データを格納し、この複数の映像データ及び音声データのうち既に利用した動作ルートを地図上に表示して出力手段から出力するようにしているので、利用者が過去に動作した動作実績を認識できることとなり、利用者の動作に対する実行意欲を向上させることができる。

【0016】

また、本発明に係る移動疑似体験装置は必要に応じて、利用者の脈拍数を検出する脈拍検出手段を備え、予め入力されている年齢や性別等の個人データに基づいて最適脈拍数等の診断結果を表示画面上に出力し、動作中において脈拍検出手段から脈拍検出信号が制御部へ入力され、制御部は当該脈拍検出信号より脈拍数を表示画面上に出力すると共に、前記診断結果と当該脈拍数とに基づいて利用者に休憩、注意及び警告等の指示を促すものである。このように本発明においては、予め年齢や性別等の個人データから診断結果を求め表示画面に出力し、動作中には脈拍検出手段から脈拍数を取得して表示画面に出力し、更に前記最適脈拍数と当該脈拍数とに基づいて利用者に休憩、注意及び警告等の指示を促しているので、利用者が自分に応じた運動を行うことができる。

【0017】

また、本発明に係る移動疑似体験装置は、利用者の動作状態を検知して、前記動作状態に応じて変化するデータ内容が所定のデータ長のデータブロックに区分された映像データ及び音声データを格納し、前記映像データを表示画面上に表示すると共に音声データを音声で報知し、前記検知結果に基づいて前記各データブロック毎の映像データ及び音声データを表示画面上に出力し、前記検知結果により動作が中断されていると判断されている間に当該中断時において表示画面に表示される映像データを静止画として継続表示すると共に、前記動作の中断時に出力されているデータブロックに含まれる総ての音声データを報知するように制御するものである。

【0018】

【発明の実施の形態】

(本発明の第1の実施形態)

以下、本発明の第1の実施形態に係る移動疑似体験装置を図1ないし図9に基づいて利用者の動作状態が歩行状態の場合に説明する。この図1は本実施形態に係る移動疑似体験装置の全体ブロック構成図、図2及び図3は図1記載の移動疑似体験装置における動作疑似体験の動作フローチャート、図4は図2に記載の体調管理動作の詳細動作フローチャート、図5は図1に記載の運動入力部の外観正面図、図6は図5に記載の歩行状態検出部の外観斜視図及びその他の動作状態を検出する各種の運動入力部の外観斜視図、図7及び図8は図1に記載のCRTモニタにおける各表示態様図、図9は歩行中断状態におけるビデオ映像及びナレーションの出力動作タイミングテャートを示す。

【0019】

前記各図において本実施形態に係る移動疑似体験装置は、利用者の動作状態である歩行状態を検知して歩行検知信号を出力する歩行状態検知部1と、前記歩行状態に応じて変化するデータ内容が所定のデータ長のデータブロックに区分された映像データ及び音声データを格納する映像音声記録部2と、前記映像データをCRT31の表示画面上に出力すると共に音声データをスピーカ32から音声で報知する出力部3と、前記歩行検知信号に基づいて前記各データブロック毎の映像データ及び音声データを前記出力部3に出力し、前記歩行検知信号により歩行が中断されていると判断されている間にこの中断時において出力部3で表示される映像データを静止画として継続出力すると共に、前記歩行の中断時における出力部3から出力されているデータブロックに含まれる総ての音声データを出力するように出力部3を制御する制御部4と、歩行状態検知部1の種類毎に、年齢、性別、体重、身長の違いによる消費カロリーデータをデータベース化して(図示せず)格納する補助情報記録部5を備える構成である。

【0020】

前記制御部4は、歩行検知信号に基づいて映像音声記録部2から映像データ及び音声データの読出し、読出された映像データ及び音声データの出力を各々制御し、装置全体の制御演算動作を実行する入出力演算制御部41と、この入出力演算制御部41の制御に基づいて映像音声記録部2から読出された映像データ及び音声データを格納するバッファメモリ42と、このバッファメモリ42に格納された映像データをCRT31から出力する表示制御を行う表示制御部43と、前記バッファメモリ42に格納された音声データをスピーカ32から出力する報知制御を行う音声制御部44とを備える構成である。

【0021】

前記歩行状態検知部1は、通信ケーブル17等の有線(又は図示を省略する送受信部による無線)で制御部4へ接続され、図5に示すようにマットスイッチであり押圧動作を検知する左・右スイッチ部11、12のからなり、利用者の歩行動作により歩行の速さ、歩行の停止等の各動作に応じた歩行検知信号が出力される構成である。また、歩行状態検知部1は、CRT31に表示される数値のカウントアップ又はカウントダウンを指令する矢印キー13、14とCRT31に表示される数値の内容等に対して「Yes」、「No」の指令を入力するYesキー15、Noキー16とを備える構成である。さらに歩行状態検知部1は、前記マットスイッチ以外に、図6に示すようなステッパー、ウォークマシン、自転車エルゴメータ又は歩数計等の動作状態を検知するものとすることもできる。 前記補助情報記録部5は、マットスイッチ、ステッパー、ウォークマシン、自転車エルゴメータ又は歩数計等の歩行状態検知部1の種類毎の消費カロリーデータ及び/又はそれら歩行状態検知部1の負荷毎の消費カロリーデータをデータベース化して格納している。

【0022】

次に、前記構成に基づく本実施形態に係る移動疑似体験装置の歩行疑似体験動作について説明する。まず、装置全体を起動状態にし、利用者が脈拍検出計1aを装着し、歩行状態検知部1から矢印キー13、14を操作して自己の年齢、性別、その他場合によっては体重、身長を入力し、この入力された年齢を図7(A)に示すようにCRT31に表示する。この年齢がCRT31に表示された後にCRT31上には図7(B)に示すような歩行コースのメニュー画面が表示され利用者が歩行状態検知部1の矢印キー13、14を操作を介して選択する(ステップ0)。例えば、図7(B)中の「八坂神社〜清水寺 1.7kmコース」を選択した場合について説明する。

【0023】

この状態で利用者が歩行状態検知部1上で歩行動作を開始し、この歩行状態検知部1から歩行検知信号が制御部4へ入力されることとなる(ステップ1)。この歩行検知信号の入力と共に、脈拍検出計1aから脈拍検出信号が制御部4の入出力演算制御部41へ入力され利用者の体調管理の動作が実行される(ステップ2)。この体調管理動作(ステップ2)は、前記入力された利用者の年齢から最適脈拍数を入出力演算制御部41が演算し(ステップ201)、この演算結果を表示制御部43を介してCRT31に表示する(ステップ202)。また、前記脈拍検出計1aから出力される検出結果に基づいて利用者の現在の脈拍数を前記最適脈拍数と併記してCRT31に図7(C)に示すように表示する(ステップ203)。

【0024】

この表示される利用者の現在の脈拍数が最適脈拍数を超えているか否かを入出力演算制御部41が判断し(ステップ204)、この最適脈拍数を超えていると判断された場合には図7(D)に示すようにCRT31に「注意!!脈拍数が上がりすぎています。一休みしてください。」等の歩行動作を中断する旨の指示をCRT31に表示する(ステップ205)。

また、前記歩行状態検知部1から歩行検知信号の入力があったか否かを入出力演算制御部41が判断し(ステップ3)、入力があったと判断された場合には、この入力された歩行検知信号に基づいて利用者の消費カロリーを入出力演算制御部41が現在使用している歩行状態検知部1の種類に該当する消費カロリーデータを補助情報記録部5より読み出し、この読み出した消費カロリーデータより演算する(ステップ4)。

また、入出力演算制御部41は入力される歩行検知信号から利用者の歩数を算出し(ステップ5)、前記選択された歩行コースに対応した映像データ及び音声データを映像音声記録部2からバッファメモリ42へ読出し、この読出された映像データを表示制御部43の制御により出力部3のCRT31で表示してビデオ映像Viとして再生を開始する(ステップ6)。

【0025】

前記ステップ3及びステップ6の後に前記映像データ及び音声データによるCRT31及びスピーカ32からの再生が終了したか否かが入出力演算制御部41で判断される(ステップ7)。再生が終了していないと判断された場合には、入出力演算制御部41は映像データの再生と並行してBGMを音声制御部44を介してスピーカ32から音声データに基づいて出力する(ステップ8)。この映像データ及びBGMが再生された後に、入出力演算制御部41はCRT31で既に再生された時間から前記選択された歩行コースの残り距離を演算し(ステップ9)、この残りの距離を表示制御部43を介してCRT31に図7(C)に示すように表示する(ステップ10)。また、入出力演算制御部41は、前記ステップ4において算出した利用者の消費カロリーを図7(C)に示すようにCRT31に表示する(ステップ11)。

【0026】

また、入出力演算制御部41は、前記ステップ6で映像データの再生開始から現時点までの時間をTiとして積算し、この積算時間Tiに基づいて利用者の歩行時間を演算する(ステップ12)。この演算された歩行時間は、図7(C)に示すようにCRT31に表示され(ステップ13)、この歩行時間と共に(ステップ5で演算した)現在までの積算値として現在の歩数もCRT31に表示される(ステップ14)。

【0027】

この現在の歩数をCRT31に表示した後に、入出力演算制御部41は、映像データに基づいて再生される各ビデオ映像Viに対応して予め設定された再生時間tiの積算値を前記ステップ6で積算される積算時間Tiからポーズ時間Piの積算値を差し引いた値が経過したか否かを判断する(ステップ15)。この積算時間Tiからポーズ時間Piの積算値を差し引いた値が再生時間tiの積算値を経過したと判断された場合には、入出力演算制御部41は映像音声記録部2から映像データ及び音声データをバッファメモリ42に読出し、この読出された音声データに基づいて音声制御部44の制御によりスピーカ32からCRT31で表示される前記ビデオ映像Viの解説としてのナレーションBiを再生する(ステップ16)。

【0028】

前記ステップ15で積算時間Tiからポーズ時間Piの積算値を差し引いた値が経過していないと判断され、又は前記ステップ16でナレーションBiを再生した後に、歩行コースの分岐点に到達したか否かについて入出力演算制御部41が判断する(ステップ17)。この分岐点に到達したと判断された場合には、利用者に対して分岐点からの分岐された歩行コースの選択を図8(A)に示すようにCRT31に表示して要求し、この要求に応じて利用者が歩行状態検知部1の矢印キー13、14を操作することによりいずれかを選択して入力し、Yesキー15で決定する(ステップ18)。 前記ビデオ映像ViがCRT31で再生され、ナレーションBiがスピーカ32から出力されている間には、歩行状態検知部1からの歩行検知信号が入出力演算制御部41へ所定時間PT以上入力されてないか否かが判断される(ステップ19)。この入出力演算制御部41で歩行検知信号の入力が所定時間PT以上入力されていないと判断された場合(ポーズ状態)には、入力されなくなった時点に再生されているビデオ映像Viを静止画像として出力し、以降の続くビデオ映像Viの再生を停止する(ステップ20)。このビデオ映像Viを静止画像として出力している間も、ナレーションBiはスピーカ32より継続して再生される(ステップ21)。

【0029】

このステップ20及びステップ21の映像再生動作、音声再生動作は、図9に示すように映像データの先頭であるビデオ映像V01の再生開始時からビデオ映像再生の積算時間Tiを演算し、この積算時間Tiからポーズ時間Piの積算値を差し引いた値が再生時間tiの積算値となった場合に順次ビデオ映像V01、V02、・・・の再生が実行される。ここで、ビデオ映像V01の再生が中断して静止画像となり、ポーズ状態が所定時間P1だけ継続した場合にもナレーションB1を再生し続けられることとなる。このように常に特定のビデオ映像Viが始まる時に、そのビデオ映像Viに対応したナレーションBiが再生されることとなる。

このようにビデオ映像Viを静止画像とし、ナレーションBiを連続再生している間に、歩行検知信号が入出力演算制御部41へ入力されたか否かが判断される(ステップ22)。この歩行検知信号の入力がないと判断された場合には、前記ステップ20及び21の動作を繰り返すことなる。

【0030】

前記ステップ22で歩行検知信号の入力があったと判断された場合、又は前記ステップ15で積算時間Tiが経過していないと判断された場合には、前記Noキー16を2回押圧することにより強制終了指令の入力がなされたか否かを入出力演算制御部41が判断し(ステップ23)、入力がなされていないと判断された場合には、前記ステップ2へ戻り前記動作を繰り返すこととなる。一方ステップ23で強制終了指令が入力されたと判断された場合及び前記ステップ7で映像データにより総てのビデオ映像Viの再生が終了したと判断された場合には、CRT31からゴール到着を内容とする映像を図8(B)に示すように出力する(ステップ24)。

【0031】

さらに、ゴール到着の映像出力がなされた後に、入出力演算制御部41は今回利用した歩行コースに基づく歩行距離を積算歩行距離として記憶するか否かを判断するため図8(C)に示すようにCRT31に表示して利用者に選択させる(ステップ25)。記憶することを利用者が選択したと判断された場合には、歩行コースを記憶する(ステップ26)と共に、この歩行コースによる歩行距離を積算して記憶する(ステップ27)。この歩行コースによる歩行距離の記憶後又はステップ25で記憶しないと判断された場合には、歩行動作の制御が完了する(ステップ28)。

【0032】

(本発明の他の実施形態)

なお、前記各実施形態に係る移動疑似体験装置においては映像データ及び音声データを単一の再生速度で実行することとしたが、歩行速度、年齢により映像データ及び音声データの再生速度を変化させることができる。

また、利用者のカルテ等に基づいて目標脈拍数をCRT31に表示する構成とすることもできる。さらに、動作前において脈拍検出計1aから脈拍検出信号が制御部4へ入力され、制御部4は予め入力されている年齢や性別等の個人データと当該脈拍検出信号とに基づいて最適脈拍数等の診断結果をCRT31に出力し、動作中において脈拍検出計1aから脈拍検出信号が制御部4へ入力され、制御部4は当該脈拍検出信号より脈拍数をCRT31に出力すると共に、前記診断結果と当該脈拍数とに基づいて利用者に休憩、注意及び警告等の指示を促すこともできる。

【0033】

また、利用者が既に利用した歩行コースを地図上に表示し、未だに利用していない歩行コースと区別して表示することもできる。この表示に併せて過去に利用した歩行コースによる積算歩行距離等の各履歴を表示することもできる。前記利用していない歩行コース及び利用した歩行コースのどちらか一方に対して、色を異ならせたり、点滅表示にしたり、点線にしたり又は薄くすることで、他方と区別して表示することができる。

また、各歩行コースの映像データに対して史跡解説、風景解説、グルメ解説、歴史解説等複数の種類のナレーションを予め用意し、利用者が選択できる構成とすることもできる。

また、各歩行コースの映像データは、実写映像、コンピュータグラフィックス及び各種映像を合成した合成映像とすることもできる。

【0034】

また、前記各実施形態に係る移動疑似体験装置においては各種データを映像音声記録部2に格納する構成としたが、これらの映像音声記録部2を設けることなくインターネットに接続され、このインターネットを介して映像データ又は音声データのいずれか少なくとも一つをサーバ側からダウンロードする構成とすることもできる。

また、前記各実施形態に係る移動疑似体験装置においては各種データを映像音声記録部2に格納する構成としたが、これらの映像音声記録部2を設けることなく電波を受信して映像データ又は音声データ取得する構成とすることもできる。さらに、双方向テレビ又はVOD(Video On Demand)等により利用者側からの要求により映像データ及び音声データの配信を受ける構成とすることもできる。

また、本実施形態に係る移動疑似体験装置により任意の歩行コースを実際体験した際の写真をビデオ映像に挿入する構成とすることもできる。

【0035】

【発明の効果】

本発明においては、歩行状態検知手段で検知した利用者の歩行状態による歩行検知信号に基づいて、制御手段が映像音声記録手段に格納される映像データ及び音声データを読出して出力手段から出力し、利用者が歩行を中断した場合に中断時の映像データを静止画として継続出力すると共に、中断時の出力されているデータブロックの音声データを総て出力するように制御手段が制御するようにしているので、歩行の中断が生じた場合においても停止状態及び再開時の映像に対応した音声信号の再生ができることとなり、疑似体験の解説を違和感なく明瞭に出力できるという効果を奏する。

【0036】

また、本発明においては、利用者の歩行に伴って変化する歩行ルートの風景を映像データとし、この映像データの解説を音声データとしていることから、例えば旅行先等の予備知識を疑似体験として修得できるという効果を有する。

【0037】

また、本発明においては、1又は複数に分岐された歩行ルートをデータ内容とする映像データ及び音声データとしていることから、利用者が現場を実際に歩行すると同様に歩行ルートの変更が可能となり、疑似体験による歩行の臨場感を高めることができるという効果を有する。

また、本発明においては、音声データの各データブロックを1又は複数のパラグラフ毎に区切って形成していることから、歩行中断時及び歩行再開時の音声データによる解説がより違和感なく明瞭の出力できるという効果を有する。

【0038】

さらに、本発明においては、映像音声記録手段に地図上の異なる歩行ルートに関する複数の映像データ及び音声データを格納し、この複数の映像データ及び音声データのうち既に利用した歩行ルートを地図上に表示して出力手段から出力するようにしているので、利用者が過去に歩行した歩行実績を認識できることとなり、利用者の歩行動作に対する実行意欲を向上させることができるという効果を有する。

【0039】

さらにまた、本発明においては、予め年齢や性別等の個人データから診断結果を求め表示画面に出力し、動作中には脈拍検出手段から脈拍数を取得して表示画面に出力し、更に前記診断結果と当該脈拍数とに基づいて利用者に休憩、注意及び警告等の指示を促しているので、利用者が自分に応じた運動を行うことができるという効果を有する。

【図面の簡単な説明】

【図1】本発明の第1の実施形態に係る移動疑似体験装置の全体ブロック構成図である。

【図2】図1記載の移動疑似体験装置における歩行疑似体験の動作フローチャートである。

【図3】図1記載の移動疑似体験装置における歩行疑似体験の動作フローチャートである。

【図4】図2に記載の体調管理動作の詳細動作フローチャートである。

【図5】図1に記載の運動入力部の外観正面図である。

【図6】図5に記載の歩行状態検出部の外観斜視図及びその他の動作状態を検出する各種の運動入力部の外観斜視図である。

【図7】図1に記載のCRTモニタにおける各表示態様図である。

【図8】図1に記載のCRTモニタにおける各表示態様図である。

【図9】歩行中断状態におけるビデオ映像及びナレーションの出力動作タイミングテャートである。

【図10】従来の移動疑似体験装置。

【図11】従来の移動疑似体験装置。

【図12】従来の移動疑似体験装置。

【符号の説明】

1 歩行状態検知部

1a 脈拍検出計

2 映像音声記録部

3 出力部

4 制御部

5 補助情報記録部

11、12 左・右スイッチ部

13、14 矢印キー

15 Yesキー

16 Noキー

17 通信ケーブル

31、308 CRT

32 スピーカ

41 入出力演算制御部

42 バッファメモリ

43 表示制御部

44 音声制御部

110 走行装置

111 映像発生装置

112 映像表示装置

113 画面

114 走行距離

115 走行速度

116 スピーカ

117 走行者

201 CD−ROM

202 CD−ROM読取装置

203 センサ

204 走行マシン

205 TVモニタ

206 データ処理装置

207 CD−ROMインターフェース

208 センサ入力部

209 歩行マシンインターフェース

210 TVモニタインターフェース

301 マットスイッチ

302、303、304、305 スイッチ領域

307 画像音声表示装置

308 CRTモニタ[0001]

BACKGROUND OF THE INVENTION

The present invention relates to a moving pseudo-experience device that changes and displays an image of a landscape or the like in accordance with an operation, and more particularly, to a moving pseudo-experience device that informs an explanation of imaging by voice.

[0002]

[Prior art]

Conventionally, as this type of moving simulation experience apparatus, there are those disclosed in Japanese Patent Application Laid-Open No. 63-315078, Japanese Patent Application Laid-Open No. 9-56845, Japanese Patent Application Laid-Open No. 9-325684, and Japanese Patent Application Laid-Open No. 11-333023, respectively. . FIG. 10 to FIG. 12 show block diagrams of the respective conventional devices.

[0003]

In the conventional apparatus shown in FIG. 10, when a stepping motion of running or walking is performed on the

Accordingly, if the traveling

[0004]

The other conventional apparatus shown in FIG. 11 includes a CD-

[0005]

As described above, another conventional apparatus changes the inclination of the

[0006]

In the other conventional device shown in FIG. 12, the child responds to the image and the sound displayed by the display data stored in the storage device, and the child is out of the plurality of switch areas 302, 303, 304, 305 on the mat switch 301. When a predetermined switch area is stepped on, it is calculated based on the input data from the mat switch 301 whether or not a predetermined input condition for displaying the next image and sound from the CRT monitor 308 is satisfied. Display data based on the result is output, and the image and sound display device 307 displays the image and sound from the CRT monitor 308. Therefore, the child moves his / her body on the mat switch 301 in response to not only the voice composed of music or the like but also the display by the image, so that the basic physical strength can be applied while having fun, and the basic learning effect can be obtained.

[0007]

[Problems to be solved by the invention]

Since each of the conventional devices is configured as described above, when the operation state such as walking stops, the change of the video stops and the output of the sound also stops. However, there was a problem that the pseudo reproducibility could not be obtained sufficiently. In particular, in the case where the audio output is an explanation of the video content or the like, when the operation state is resumed, the explanation of the interrupted audio is output from the middle, which makes it difficult to understand the explanation content.

[0008]

In addition, since each conventional device is composed of a single content of video and audio output in accordance with the operating state such as walking, these are selected when the operating state such as the walking route is diverse. However, even if a plurality of operation states are selected, there is a problem that video and audio corresponding to the selected operation states cannot be output.

In addition, the details of stores and the like existing along the walking route are not clear, and there is a problem that it is difficult to obtain detailed information on the travel destination in advance as preliminary knowledge such as travel.

[0009]

The present invention has been made to solve the above-described problems, and clearly outputs a description of the simulated experience associated with the operation state without any sense of incongruity, and selects various operation routes and explains the selected operation route. An object is to provide a mobile simulated experience device that can be used.

[0010]

[Means for Solving the Problems]

The mobile simulation experience device according to the present invention includes an operation state detection unit that detects an operation state of a user and outputs an operation detection signal, and a data block that changes data contents according to the operation state into a data block having a predetermined data length. Video / audio recording means for storing the divided video data and audio data, output means for outputting the video data on a display screen and notifying the audio data by voice, and each data block based on the operation detection signal Each video data and audio data is output to the output means, and the video data displayed on the output means at the time of interruption is continued as a still image while it is determined that the operation is interrupted by the operation detection signal. And outputs all audio data included in the data block output from the output means when the operation is interrupted. In which a control means for controlling the means.

[0011]

As described above, in the present invention, the control means reads the video data and the audio data stored in the video / audio recording means from the output means based on the operation detection signal based on the user's operation state detected by the operation state detection means. When the user interrupts the operation, the control means controls so that the video data at the time of interruption is continuously output as a still image, and all the audio data of the data block output at the time of interruption is output. Thus, even when the operation is interrupted, it is possible to reproduce the audio signal corresponding to the video at the stop state and at the time of resumption, and the explanation of the pseudo experience can be clearly output without a sense of incongruity.

[0012]

In addition, the mobile simulated experience apparatus according to the present invention is configured such that the video data has a scene of the operation route as the data content and the audio data has the data content explaining the scene of the video data as necessary. As described above, in the present invention, the scenery of the operation route that changes with the user's action is used as video data, and the explanation of this video data is used as audio data. Can be learned.

[0013]

In addition, the mobile simulated experience device according to the present invention uses the data content of an operation route in which video data and audio data are branched into one or a plurality as required. As described above, in the present invention, since the operation route branched into one or more is used as the video data and the audio data, the operation route can be changed in the same manner as when the user actually operates the site. , You can enhance the realistic feeling of the action by simulated experience.

[0014]

Moreover, the mobile simulated experience apparatus according to the present invention is formed by data blocks in which audio data is divided into one or a plurality of paragraphs in the commentary as necessary. As described above, in the present invention, each data block of the audio data is divided into one or more paragraphs, so that the explanation by the audio data when the operation is interrupted and when the operation is resumed can be output more clearly and clearly. it can. Here, the paragraph is a unit made up of paragraphs of sentences, paragraphs, punctuation of sentences, and the like, which are classified according to the meaning of one or more sentences.

[0015]

The mobile simulated experience apparatus according to the present invention stores a plurality of video data and audio data in the video and audio recording means as data contents relating to different operation routes on the map as necessary, and the plurality of video data and audio data. Among them, the operation means of the video data and audio data already used by the user is output from the output means so as to be displayed on the map. As described above, in the present invention, a plurality of video data and audio data relating to different operation routes on the map are stored in the video / audio recording means, and the already used operation route among the plurality of video data and audio data is stored on the map. Since the information is displayed and output from the output means, the user can recognize the operation results that have been operated in the past, and the user's willingness to execute can be improved.

[0016]

Moreover, the mobile simulated experience device according to the present invention includes a pulse detection means for detecting the user's pulse rate as necessary, and the optimal pulse rate and the like based on personal data such as age and sex input in advance. A diagnostic result is output on the display screen, and a pulse detection signal is input from the pulse detection means to the control unit during operation, and the control unit outputs a pulse rate from the pulse detection signal on the display screen, and the diagnosis result and Based on the pulse rate, the user is prompted to take a break, attention, warning, or the like. As described above, in the present invention, a diagnosis result is obtained in advance from personal data such as age and gender and output to the display screen. During operation, the pulse rate is obtained from the pulse detecting means and output to the display screen. Based on the pulse rate and the pulse rate, the user is prompted to take a break, attention, warning, or the like, so that the user can exercise according to his / her own.

[0017]

In addition, the mobile simulated experience device according to the present invention detects the user's operation state, and outputs video data and audio data in which data content that changes according to the operation state is divided into data blocks having a predetermined data length. Storing, displaying the video data on the display screen and informing the audio data by voice, outputting video data and audio data for each data block on the display screen based on the detection result, and detecting the result While the operation is determined to be interrupted, the video data displayed on the display screen at the time of the interruption is continuously displayed as a still image, and the total data included in the data block output when the operation is interrupted is displayed. Control is performed so as to notify all audio data.

[0018]

DETAILED DESCRIPTION OF THE INVENTION

(First embodiment of the present invention)

Hereinafter, the mobile simulated experience apparatus according to the first embodiment of the present invention will be described based on FIGS. 1 to 9 when the user's operation state is a walking state. 1 is an overall block diagram of the mobile simulated experience apparatus according to the present embodiment, FIGS. 2 and 3 are operational flowcharts of the simulated simulated experience in the mobile simulated experience apparatus shown in FIG. 1, and FIG. 4 is a physical condition described in FIG. FIG. 5 is an external front view of the motion input unit shown in FIG. 1, FIG. 6 is an external perspective view of the walking state detection unit shown in FIG. 5, and various exercises for detecting other operation states. FIG. 7 and FIG. 8 are diagrams showing each display mode in the CRT monitor shown in FIG. 1, and FIG. 9 shows a video image and narration output operation timing chart in the walking interruption state.

[0019]

In each of the drawings, the simulated mobile experience apparatus according to the present embodiment includes a walking

[0020]

The control unit 4 reads out video data and audio data from the video /

[0021]

The walking

[0022]

Next, the simulated walking experience of the mobile simulated experience apparatus according to this embodiment based on the above configuration will be described. First, the entire device is activated, the user wears the

[0023]

In this state, the user starts walking motion on the walking

[0024]

The input / output

Further, the input / output

Further, the input / output

[0025]

After

[0026]

Further, the input / output

[0027]

After displaying the current number of steps on the

[0028]

Whether or not the value obtained by subtracting the accumulated value of the pause time Pi from the accumulated time Ti in

[0029]

As shown in FIG. 9, the video playback operation and the audio playback operation in steps 20 and 21 are performed by calculating the video video playback integration time Ti from the start of playback of the video video V01 which is the head of the video data. When the value obtained by subtracting the integrated value of the pause time Pi from Ti becomes the integrated value of the reproduction time ti, the video images V01, V02,. Here, the reproduction of the video image V01 is interrupted to become a still image, and the narration B1 can be reproduced even when the pause state continues for a predetermined time P1. Thus, when a specific video image Vi always starts, the narration Bi corresponding to the video image Vi is reproduced.

In this way, it is determined whether or not the walking detection signal is input to the input / output

[0030]

If it is determined in step 22 that a walking detection signal has been input, or if it is determined in

[0031]

Further, after the goal arrival video is output, the input / output

[0032]

(Other embodiments of the present invention)

In the mobile simulated experience device according to each of the above embodiments, the video data and the audio data are executed at a single reproduction speed, but the reproduction speed of the video data and the audio data is changed depending on the walking speed and the age. Can do.

Moreover, it can also be set as the structure which displays a target pulse rate on CRT31 based on a user's medical record. Further, before the operation, a pulse detection signal is input to the control unit 4 from the

[0033]

In addition, the walking course already used by the user can be displayed on the map, and can be displayed separately from the walking course that has not been used yet. In addition to this display, it is also possible to display each history such as an accumulated walking distance by a walking course used in the past. Different colors can be displayed, blinked, dotted, or lightened for either one of the unused walking course and the used walking course.

In addition, a plurality of types of narration such as historical site commentary, landscape commentary, gourmet commentary, and historical commentary can be prepared in advance for the video data of each walking course, and the user can select a configuration.

Further, the video data of each walking course can be a composite video obtained by combining a live-action video, computer graphics, and various videos.

[0034]

In the mobile simulation experience apparatus according to each of the above embodiments, various types of data are stored in the video /

In the mobile simulation experience apparatus according to each of the above embodiments, various types of data are stored in the video /

Moreover, it can also be set as the structure which inserts the photograph at the time of actually experiencing arbitrary walk courses by the movement simulation experience apparatus which concerns on this embodiment in a video image.

[0035]

【The invention's effect】

In the present invention, based on the walking detection signal based on the walking state of the user detected by the walking state detection unit, the control unit reads out the video data and the audio data stored in the video / audio recording unit and outputs them from the output unit, When the user interrupts walking, the control means controls so that the video data at the time of interruption is continuously output as a still image and all the audio data of the data block output at the time of interruption is output. Therefore, even when walking is interrupted, it is possible to reproduce the audio signal corresponding to the video at the stop state and at the time of resumption, and it is possible to output the explanation of the pseudo experience clearly and without a sense of incongruity.

[0036]

In the present invention, the scenery of the walking route that changes as the user walks is used as video data, and the explanation of this video data is used as audio data. It has the effect of being able to.

[0037]

In addition, in the present invention, since it is video data and audio data whose data content is a walking route branched into one or more, it becomes possible to change the walking route in the same manner as when the user actually walks on the site, It has the effect of enhancing the realistic sensation of walking through simulated experience.

In the present invention, each data block of audio data is divided into one or a plurality of paragraphs, so that explanations by audio data at the time of walking interruption and at the time of resuming walking can be output more clearly and comfortably. It has the effect.

[0038]

Furthermore, in the present invention, a plurality of video data and audio data relating to different walking routes on the map are stored in the video / audio recording means, and the already used walking route among the plurality of video data and audio data is displayed on the map. Since the output means outputs the result, it is possible to recognize the walking results that the user has walked in the past, and to improve the user's willingness to execute the walking motion.

[0039]

Furthermore, in the present invention, a diagnosis result is obtained in advance from personal data such as age and gender and output on the display screen. During operation, the pulse rate is obtained from the pulse detecting means and output on the display screen. Since the user is prompted to take a break, attention, warning, or the like based on the result and the pulse rate, the user can exercise according to his / her own.

[Brief description of the drawings]

FIG. 1 is an overall block configuration diagram of a mobile simulated experience device according to a first embodiment of the present invention.

FIG. 2 is an operational flowchart of a simulated walking experience in the moving simulated experience apparatus shown in FIG. 1;

FIG. 3 is an operation flowchart of a walking simulation experience in the mobile simulation experience apparatus shown in FIG. 1;

FIG. 4 is a detailed operation flowchart of the physical condition management operation described in FIG. 2;

5 is an external front view of the motion input unit shown in FIG. 1. FIG.

6 is an external perspective view of the walking state detection unit shown in FIG. 5 and an external perspective view of various motion input units for detecting other operation states. FIG.

7 is a view showing each display in the CRT monitor shown in FIG. 1. FIG.

8 is a diagram showing each display in the CRT monitor shown in FIG. 1. FIG.

FIG. 9 is an output operation timing chart of video images and narration in a walking interruption state.

FIG. 10 shows a conventional mobile simulation experience apparatus.

FIG. 11 shows a conventional mobile simulation experience apparatus.

FIG. 12 shows a conventional mobile simulation experience apparatus.

[Explanation of symbols]

1 Walking state detector

1a Pulse detector

2 Video / audio recording unit

3 Output section

4 Control unit

5 Auxiliary information recording part

11, 12 Left / Right switch

13, 14 Arrow keys

15 Yes key

16 No key

17 Communication cable

31, 308 CRT

32 Speaker

41 Input / output calculation control unit

42 Buffer memory

43 Display controller

44 Voice control unit

110 Traveling device

111 Video generator

112 Video display device

113 screens

114 mileage

115 Traveling speed

116 Speaker

117 runner

201 CD-ROM

202 CD-ROM reader

203 Sensor

204 Traveling machine

205 TV monitor

206 Data processing device

207 CD-ROM interface

208 Sensor input unit

209 Walking machine interface

210 TV monitor interface

301 Matt switch

302, 303, 304, 305 Switch area

307 image / audio display device

308 CRT monitor

Claims (7)

前記動作状態に応じて変化するデータ内容が所定のデータ長のデータブロックに区分された映像データ及び音声データを格納する映像音声記録手段と、

前記映像データを表示画面上に表示すると共に音声データを音声で報知する出力手段と、

前記動作検知信号に基づいて前記各データブロック毎の映像データ及び音声データを前記出力手段に出力し、前記動作検知信号により動作が中断されていると判断されている間に当該中断時において出力手段で表示される映像データを静止画として継続表示すると共に、前記動作の中断時における出力手段から出力されているデータブロックに含まれる総ての音声データを出力するように出力手段を制御する制御手段とを備えることを

特徴とする移動疑似体験装置。An operation state detection means for detecting an operation state of the user and outputting an operation detection signal;

Video and audio recording means for storing video data and audio data in which the data content changing according to the operating state is divided into data blocks of a predetermined data length;

Output means for displaying the video data on a display screen and notifying the audio data by voice;

Based on the operation detection signal, the video data and audio data for each data block are output to the output unit, and the output unit at the time of the interruption is determined that the operation is interrupted by the operation detection signal. The control means for continuously displaying the video data displayed in the above as a still image and controlling the output means so as to output all audio data included in the data block output from the output means at the time of the interruption of the operation A mobile simulated experience device characterized by comprising:

前記映像データが動作ルートの風景をデータ内容とし、前記音声データが映像データの風景を解説するデータ内容とすることを

特徴とする移動疑似体験装置。In the mobile simulated experience device according to claim 1,

A moving pseudo-experience apparatus, wherein the video data has a scene of an operation route as data content, and the audio data has a data content explaining a scene of video data.

前記映像データ及び音声データが1又は複数に分岐された動作ルートのデータ内容とすることを

特徴とする移動疑似体験装置。In the movement simulation experience device according to claim 1 or 2,

A moving pseudo-experience device characterized in that the video data and audio data are data contents of an operation route branched into one or a plurality.

前記音声データが解説文における1又は複数のパラグラフ毎に区分したデータブロックで形成されることを

特徴とする移動疑似体験装置。In the movement simulation experience device according to any one of claims 1 to 3,

The moving pseudo-experience device, wherein the voice data is formed by data blocks divided into one or more paragraphs in a commentary sentence.

前記映像データ及び音声データが地図上の異なる動作ルートに関するデータ内容として映像音声記録手段に複数格納され、

前記複数の映像データ及び音声データのうち既に利用者が利用した映像データ及び音声データの動作ルートを地図上に表示するように出力手段から出力することを

特徴とする移動疑似体験装置。In the movement simulation experience device according to any one of claims 1 to 4,

A plurality of video data and audio data are stored in the video and audio recording means as data contents relating to different operation routes on the map,

A moving pseudo-experience apparatus for outputting the operation route of video data and audio data already used by a user from the output means among the plurality of video data and audio data from the output means.

利用者の脈拍数を検出する脈拍検出手段を備え、

予め保有する年齢や性別等のデータに基づいて利用者の最適脈拍数を導出して表示画面上に出力し、

動作中において脈拍検出手段から脈拍検出信号が制御部へ入力され、制御部は当該脈拍検出信号より脈拍数を表示画面上に出力すると共に、前記最適脈拍数と当該脈拍数とに基づいて利用者に休憩、注意及び警告等の指示を促すことを

特徴とする移動疑似体験装置。In the movement simulation experience device according to any one of claims 1 to 5,

Comprising a pulse detection means for detecting the user's pulse rate;

Deriving the user's optimal pulse rate based on data such as age and gender held in advance and outputting it on the display screen,

During operation, a pulse detection signal is input from the pulse detection means to the control unit, and the control unit outputs a pulse rate on the display screen from the pulse detection signal, and the user is based on the optimal pulse rate and the pulse rate. A moving simulation experience device characterized by prompting instructions such as a break, caution and warning.

前記動作状態に応じて変化するデータ内容が所定のデータ長のデータブロックに区分された映像データ及び音声データを格納し、

前記映像データを表示画面上に表示すると共に音声データを音声で報知し、

前記検知結果に基づいて前記各データブロック毎の映像データ及び音声データを表示画面上に出力し、前記検知結果により動作が中断されていると判断されている間に当該中断時において表示画面に表示される映像データを静止画として継続表示すると共に、前記動作の中断時に出力されているデータブロックに含まれる総ての音声データを報知するように制御することを

特徴とする移動疑似体験方法。Detecting the user's operating state,

Stores video data and audio data in which data content that changes according to the operating state is divided into data blocks of a predetermined data length;

Displaying the video data on the display screen and informing the voice data by voice,

Based on the detection result, video data and audio data for each data block are output on the display screen and displayed on the display screen at the time of the interruption while the operation is determined to be interrupted by the detection result. The moving pseudo-experience method is characterized in that the video data to be displayed is continuously displayed as a still image, and all the audio data included in the data block output when the operation is interrupted is controlled.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2001309668A JP3694663B2 (en) | 2001-10-05 | 2001-10-05 | Mobile simulation experience apparatus and method |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2001309668A JP3694663B2 (en) | 2001-10-05 | 2001-10-05 | Mobile simulation experience apparatus and method |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2003111867A JP2003111867A (en) | 2003-04-15 |

| JP3694663B2 true JP3694663B2 (en) | 2005-09-14 |

Family

ID=19128779

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2001309668A Expired - Fee Related JP3694663B2 (en) | 2001-10-05 | 2001-10-05 | Mobile simulation experience apparatus and method |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP3694663B2 (en) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8717411B2 (en) | 2008-02-05 | 2014-05-06 | Olympus Imaging Corp. | Virtual image generating apparatus, virtual image generating method, and recording medium storing virtual image generating program |

Families Citing this family (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2006113474A (en) * | 2004-10-18 | 2006-04-27 | Matsushita Electric Works Ltd | Image experience support system |

| JP3756920B1 (en) * | 2004-10-18 | 2006-03-22 | 有限会社ラルゴ | Foot motion support system, musical tone generator used in the system, foot motion support processing program, and music distribution method |

| CN101541387B (en) * | 2007-02-14 | 2013-04-17 | 耐克国际有限公司 | Collection and display of athletic information |

| CA2691992C (en) * | 2007-06-04 | 2016-07-05 | Shimane Prefectural Government | Information inputting device, information outputting device and method |

| JP5124886B2 (en) | 2007-12-03 | 2013-01-23 | 島根県 | Image recognition apparatus and image recognition method |

| JP4965475B2 (en) * | 2008-02-05 | 2012-07-04 | オリンパス株式会社 | Virtual moving display device |

| KR101390957B1 (en) | 2009-09-04 | 2014-05-02 | 나이키 인터내셔널 엘티디. | Monitoring and tracking athletic activity |

| JP5674566B2 (en) * | 2010-06-28 | 2015-02-25 | ナイキ イノベイト セー. フェー. | How to monitor and track athletic activity |

| JP5298214B2 (en) * | 2012-03-28 | 2013-09-25 | オリンパス株式会社 | Virtual moving display device |

Family Cites Families (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH05220237A (en) * | 1992-02-17 | 1993-08-31 | Ricoh Elemex Corp | Fixed-position running device |

| JPH0623067A (en) * | 1992-04-10 | 1994-02-01 | Matsushita Electric Works Ltd | Display device for amount of exercise |

| JP3469410B2 (en) * | 1996-11-25 | 2003-11-25 | 三菱電機株式会社 | Wellness system |

| JP2000051390A (en) * | 1998-08-07 | 2000-02-22 | Tyo:Kk | Training management system |

| JP2000069442A (en) * | 1998-08-24 | 2000-03-03 | Sharp Corp | Moving picture system |

| JP2000333106A (en) * | 1999-05-21 | 2000-11-30 | Canon Inc | Image file management device, its method and computer- readable storage medium |

| JP2001017565A (en) * | 1999-07-08 | 2001-01-23 | Erugotekku:Kk | Simulation system |

-

2001

- 2001-10-05 JP JP2001309668A patent/JP3694663B2/en not_active Expired - Fee Related

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8717411B2 (en) | 2008-02-05 | 2014-05-06 | Olympus Imaging Corp. | Virtual image generating apparatus, virtual image generating method, and recording medium storing virtual image generating program |

| US9412204B2 (en) | 2008-02-05 | 2016-08-09 | Olympus Corporation | Virtual image generating apparatus, virtual image generating method, and recording medium storing virtual image generating program |

| US9807354B2 (en) | 2008-02-05 | 2017-10-31 | Olympus Corporation | Virtual image generating apparatus, virtual image generating method, and recording medium storing virtual image generating program |

| US10027931B2 (en) | 2008-02-05 | 2018-07-17 | Olympus Corporation | Virtual image generating apparatus, virtual image generating method, and recording medium storing virtual image generating program |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2003111867A (en) | 2003-04-15 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US6881176B2 (en) | Exercise assistance apparatus | |

| US20050075213A1 (en) | Exercise device independent, variable display rate visual exercise system | |

| US7022048B1 (en) | Video fitness machine | |

| KR101017664B1 (en) | Training system based on on-line virtual reality | |

| US6004243A (en) | Dynamic real time exercise video apparatus and method | |

| KR101666811B1 (en) | Cycle running simulation apparatus to simulate real environment and fitness management method using the apparatus | |

| JP3694663B2 (en) | Mobile simulation experience apparatus and method | |

| US20070229397A1 (en) | Virtual reality system | |

| JP2003102868A (en) | Exercising support method and apparatus therefor | |

| JPH1132284A (en) | Image photograph reproduction system, method and recording medium recording image reproduction program | |

| US11951377B2 (en) | Leaderboard with irregularity flags in an exercise machine system | |

| EP1011816A2 (en) | Dynamic real time exercise video apparatus and method | |

| KR20110099301A (en) | Game device, game processing method, information recording medium, and program | |

| JPH11137719A (en) | Training system | |

| KR20100089780A (en) | Exercising system having image display function | |

| WO2012161542A2 (en) | Bicycle having a device for a virtual riding course image and method for driving the bicycle | |

| JP2000102523A (en) | Method and device for judging ability to balance | |

| KR100535845B1 (en) | Game device and storage medium that program is recorded | |

| JP2004121592A (en) | Training machine | |

| WO2015033446A1 (en) | Running assistance system and head mount display device used in same | |

| JP2005058383A (en) | Game information processor and computer program thereof | |

| KR101953909B1 (en) | System and method for managing user participative virtual cycle game | |

| JPH10263110A (en) | Cycling simulation system | |

| JPH06231A (en) | Fitness cycling system | |

| JPH0623067A (en) | Display device for amount of exercise |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A711 | Notification of change in applicant |

Free format text: JAPANESE INTERMEDIATE CODE: A711 Effective date: 20040210 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A821 Effective date: 20040212 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20050121 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20050302 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20050621 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20050627 |

|

| R150 | Certificate of patent or registration of utility model |

Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20080701 Year of fee payment: 3 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20090701 Year of fee payment: 4 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20090701 Year of fee payment: 4 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20100701 Year of fee payment: 5 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20100701 Year of fee payment: 5 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20110701 Year of fee payment: 6 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20120701 Year of fee payment: 7 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20120701 Year of fee payment: 7 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20120701 Year of fee payment: 7 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20130701 Year of fee payment: 8 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| LAPS | Cancellation because of no payment of annual fees |