WO2025041253A1 - 情報処理装置、情報処理システム、情報処理方法及び記録媒体 - Google Patents

情報処理装置、情報処理システム、情報処理方法及び記録媒体 Download PDFInfo

- Publication number

- WO2025041253A1 WO2025041253A1 PCT/JP2023/030113 JP2023030113W WO2025041253A1 WO 2025041253 A1 WO2025041253 A1 WO 2025041253A1 JP 2023030113 W JP2023030113 W JP 2023030113W WO 2025041253 A1 WO2025041253 A1 WO 2025041253A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- learning

- target region

- input image

- information

- target

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/18—Eye characteristics, e.g. of the iris

Definitions

- This disclosure relates to an information processing device, an information processing system, an information processing method, and a recording medium.

- Patent Document 1 discloses a normalization technique for deep neural networks.

- an input data set is input to a deep neural network.

- the normalization method includes normalizing a feature map set output by a network layer in the deep neural network in at least one dimension, and obtaining the variance of at least one dimension and the mean value of at least one dimension.

- the feature map set includes at least one feature map and corresponds to at least one channel, each channel corresponding to at least one feature map.

- the target feature map set after normalization is identified based on the variance of at least one dimension and the mean of at least one dimension.

- normalization along at least one dimension includes statistical information for each dimension through the normalization operation, ensuring high robustness to statistics for each dimension while not being overly dependent on batch size.

- the information processing device includes: An object information acquisition means for acquiring object information relating to an object region in an input image; a calculation means for calculating correction parameters for correcting parameters included in a feature amount extraction model that extracts features of the target region based on the target information; an extraction means for extracting a feature of the target region by using the feature extraction model corrected by the correction parameters; The image processing device further includes a comparison means for outputting a result of comparing the feature amount of the target area with registered information that has been registered in advance.

- the information processing system includes: An object information acquisition means for acquiring object information relating to an object region in an input image; a calculation means for calculating correction parameters for correcting parameters included in a feature amount extraction model that extracts features of the target region based on the target information; an extraction means for extracting a feature of the target region by using the feature extraction model corrected by the correction parameters;

- the image processing device further includes a comparison means for outputting a result of comparing the feature amount of the target area with registered information that has been registered in advance.

- the information processing method includes: One or more computers obtaining object information for a region of interest in the input image; calculating correction parameters for correcting parameters included in a feature amount extraction model that extracts features of the target region based on the target information; extracting features of the target region using the feature extraction model corrected by the correction parameters; The feature amount of the target region is compared with pre-registered information, and the result is output.

- the recording medium in the present disclosure is On one or more computers, obtaining object information for a region of interest in the input image; calculating correction parameters for correcting parameters included in a feature amount extraction model that extracts features of the target region based on the target information; extracting features of the target region using the feature extraction model corrected by the correction parameters; A program for executing a process of outputting a result of matching the feature amount of the target region with pre-registered registration information is recorded.

- FIG. 1 is a block diagram showing a configuration of a first information processing device according to the present disclosure.

- 1 is a block diagram showing a configuration of a first information processing system according to the present disclosure.

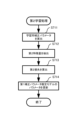

- 5 is a flowchart showing a processing operation of the first information processing device according to the present disclosure.

- FIG. 2 is a diagram showing an example of a binocular image as an input image according to the present disclosure.

- FIG. 2 is a diagram illustrating an example of an iris region as a target region according to the present disclosure.

- FIG. 2 is a diagram illustrating an example of a physical configuration of a first information processing apparatus according to the present disclosure.

- FIG. 2 is a block diagram showing a configuration of a second information processing system and a second information processing device according to the present disclosure.

- FIG. 2 is a diagram illustrating an example of a rectangular iris region that is a target region converted into a predetermined shape in accordance with the present disclosure.

- 10 is a flowchart showing a processing operation of a second information processing device according to the present disclosure.

- FIG. 13 is a block diagram showing a configuration of a third information processing system and a third information processing device according to the present disclosure. 13 is a flowchart showing a processing operation of a third information processing device according to the present disclosure.

- FIG. 13 is a block diagram showing a configuration of a fourth information processing system and a fourth information processing device according to the present disclosure.

- FIG. 13 is a block diagram illustrating an example configuration of a fourth calculation unit according to the present disclosure.

- FIG. 13 is a flowchart showing a processing operation of a fourth information processing device according to the present disclosure.

- 13 is a flowchart illustrating an example of a correction parameter calculation process included in the processing operation of the fourth information processing device according to the present disclosure.

- FIG. 13 is a block diagram showing the configuration of a fifth information processing system and a fifth information processing device according to the present disclosure.

- FIG. 13 is a block diagram illustrating an example configuration of a fifth calculation unit according to the present disclosure.

- FIG. 13 is a block diagram showing the configuration of a sixth information processing system and a sixth information processing device according to the present disclosure.

- FIG. 13 is a block diagram showing a configuration of a learning unit included in a sixth information processing device according to the present disclosure.

- FIG. 13 is a flowchart illustrating an example of a learning process executed by a sixth information processing device according to the present disclosure.

- FIG. 13 is a block diagram showing the configuration of a seventh information processing system and a seventh information processing device according to the present disclosure.

- 13 is a block diagram showing a configuration of a first learning unit included in a seventh information processing device according to the present disclosure.

- 13 is a flowchart illustrating an example of a first learning process executed by a seventh information processing device according to the present disclosure.

- 13 is a flowchart illustrating an example of a second learning process executed by a seventh information processing device according to the present disclosure.

- FIG. 13 is a block diagram showing a configuration of a learning unit included in a ninth information processing device according to the present disclosure.

- 13 is a flowchart illustrating an example of a learning process executed by a ninth information processing device according to the present disclosure.

- FIG. 13 is a block diagram showing the configuration of a tenth information processing system and a tenth information processing device according to the present disclosure.

- 13 is a flowchart illustrating an example of a first learning process executed by a tenth information processing device according to the present disclosure.

- 13 is a flowchart illustrating an example of a second learning process executed by a tenth information processing device according to the present disclosure.

- iris authentication For example, in iris authentication, generally, when the quality of the image used for iris authentication, particularly the iris region, is low, such as when the image resolution is low, the authentication accuracy may decrease. Therefore, in iris authentication, it is desirable to photograph the authentication target using an image capturing device capable of capturing high-quality images, such as high resolution images, but it may be difficult to use an image capturing device capable of capturing high-quality images due to the installation space, cost, etc. of the image capturing device.

- the normalization technique described in Patent Document 1 may be able to obtain high robustness against statistics of each dimension without being overly dependent on batch size. However, even if the normalization technique described in Patent Document 1 is used, it is difficult to obtain image features that improve authentication accuracy from low-quality input images.

- image super-resolution technology that improves image resolution (see, for example, JP 2009-282925 A).

- image super-resolution technology generally requires a large amount of processing time, memory consumption, and other processing costs.

- One of the problems that the invention disclosed herein aims to solve is to perform authentication with high accuracy while suppressing increases in processing costs.

- the information processing device 100 includes a target information acquisition unit 115, a calculation unit 116, an extraction unit 117, and a collation unit 118.

- the information processing system SYS1 includes a target information acquisition unit 115, a calculation unit 116, an extraction unit 117, and a collation unit 118.

- the target information acquisition unit 115 acquires target information related to the target region in the input image.

- the calculation unit 116 calculates correction parameters for correcting parameters included in a feature extraction model that extracts features of the target region based on the target information.

- the extraction unit 117 extracts features of the target region using the feature extraction model corrected with the correction parameters.

- the matching unit 118 outputs the results of matching the features of the target area with the pre-registered registration information.

- this information processing device 100 it is possible to extract features of a target region using a feature extraction model corrected with correction parameters based on target information relating to the target region.

- this information processing system SYS1 makes it possible to perform authentication with high accuracy while suppressing increases in processing costs.

- the information processing device 100 executes information processing as shown in FIG.

- the target information acquisition unit 115 acquires target information related to the target region in the input image (step S115).

- the calculation unit 116 calculates correction parameters for correcting parameters included in a feature extraction model that extracts features of the target region based on the target information (step S116).

- the extraction unit 117 extracts features of the target region using the feature extraction model corrected with the correction parameters (step S117).

- the matching unit 118 outputs the result of matching the features of the target area with the pre-registered registration information (step S118).

- This information processing makes it possible to extract features of a target region using a feature extraction model corrected with correction parameters based on target information about the target region.

- the present disclosure may be realized by a program for causing one or more computers to execute information processing, a recording medium on which the program is recorded, or the like.

- the input image is an image that includes a target region to be used for matching.

- the target region is an image of a region of the input image that is to be used for matching.

- the input image may be, for example, a binocular image including both eyes, a monocular image including one of a predetermined pair of eyes, a facial image including a face, or a vein image including veins, or other biometric images.

- the target area may be, for example, an iris area (i.e., an image of the area showing the iris), a face area (i.e., an image of the area showing the face), a fingerprint area (i.e., an image of the area showing the fingerprint of a finger), a vein area (i.e., an image of the area showing the veins), etc.

- iris area i.e., an image of the area showing the iris

- a face area i.e., an image of the area showing the face

- a fingerprint area i.e., an image of the area showing the fingerprint of a finger

- a vein area i.e., an image of the area showing the veins

- iris authentication, face authentication, and vein authentication are examples of biometric authentication.

- the authentication according to the present disclosure is not limited to biometric authentication. Therefore, the input image is not limited to a biometric image.

- the iris, face, etc. are typically those of a human, but may also be those of an animal such as a dog or snake.

- the input image is a binocular image (see FIG. 4) that includes both human eyes.

- the target region is the iris region (see FIG. 5).

- the target information is information related to the target region.

- the target information is information including at least one value according to the quality of the target region in the input image.

- the value included in the target information is, for example, a continuous value.

- the target information may include, for example, at least one of quality information of the target region, intermediate features of the target region, and statistics related to the target region.

- the quality information of the target area is information that indicates the quality of the target area.

- the quality information of the target area may include one or more of the following: the resolution of the target area, focus blur when the input image is captured by a photographing device such as a camera, motion blur, brightness of the target area, information on eyeglass reflection, etc.

- the resolution may be, for example, the iris diameter when the input image includes an iris.

- the iris diameter may be, for example, the diameter of the iris or the radius of the iris.

- the iris diameter may be expressed, for example, by the number of pixels.

- the iris diameter may be either the short diameter or the long diameter of the iris, or both.

- the method of expressing the iris diameter is not limited to the number of pixels, and may be, for example, a value according to the size of the iris region.

- the information related to the eyeglasses reflection may include, for example, at least one of the intensity, area, and proportion of the area of the eyeglasses reflection.

- the intensity of the eyeglasses reflection may be, but is not limited to, the average value, maximum value, etc. of the intensity of the eyeglasses reflection included in the target region.

- the area or proportion of the eyeglasses reflection may be, but is not limited to, the area or proportion of the region of the iris region that includes the eyeglasses reflection. Note that the quality information is not limited to those exemplified here.

- the target information acquisition unit 115 may acquire the target information, for example, using a quality estimation model for estimating the quality information of the target region.

- the quality estimation model outputs the quality information of the target region.

- the target information when the target information includes quality information, an example will be described in which the quality information is iris diameter.

- the target information acquisition unit 115 acquires the target information using an intermediate feature extraction model for extracting intermediate features (image features) of the target region.

- the intermediate feature extraction model outputs intermediate features of the target region.

- Intermediate features are, for example, features extracted in the feature extraction model at a stage before the final features described below are extracted.

- Image features such as intermediate features may be represented, for example, as a numerical vector.

- the feature extraction model is a learning model for extracting features (image features) of a target region. When a target region or intermediate features of the target region are input, the feature extraction model extracts and outputs the features of the target region.

- the input to the feature extraction model is, for example, the intermediate features of the target region.

- the feature extraction model and intermediate feature extraction model may be configured, for example, as a series of neural networks that, when the target region is input, output features of the target region (i.e., features used for matching) in the entire model.

- the intermediate feature extraction model and feature extraction model may be the front and back stages, respectively, when the series of neural networks is divided into two.

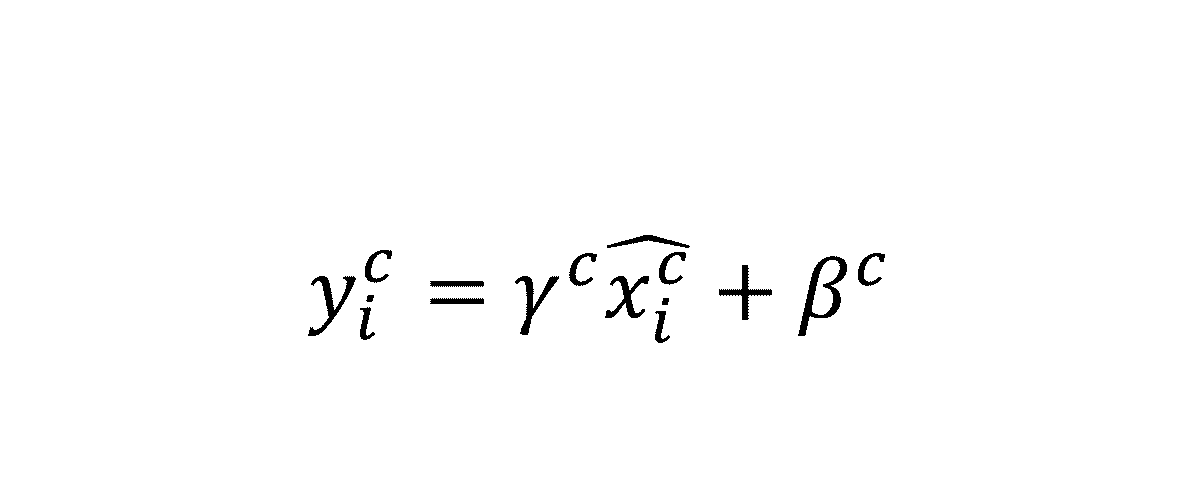

- the correction parameters are values for correcting ⁇ c , ⁇ c , ⁇ c , and ⁇ c for each channel C below.

- xic represents the feature map of channel C of sample i.

- ⁇ c and ⁇ c represent the mean and variance of channel C of the batch norm, respectively.

- ⁇ c and ⁇ c represent the shift and scale parameters of channel C, respectively.

- correction using the correction parameters may be performed when the resolution of the target area is low, equal to or lower than a predetermined threshold.

- the calculation unit 116 may determine whether the target area is low resolution or not, and calculate the correction parameters if the target area is low resolution. If the target area is not low resolution, the calculation unit 116 does not need to calculate the correction parameters.

- the extraction unit 117 may extract features of the target area using a feature extraction model that has not been corrected with the correction parameters (i.e., a feature extraction model whose parameters are default values).

- the matching result is a result of matching the feature of the target region (final feature) with the registered information registered in advance. That is, the matching unit 118 matches the feature of the target region with the registered information registered in advance and outputs the matching result.

- the matching result may include at least one of information including a similarity (e.g., cosine similarity) between the final feature and the feature included in the registered information, and information indicating whether the similarity satisfies a predetermined matching condition.

- the matching condition is, for example, that the similarity is equal to or greater than a predetermined matching threshold. If the similarity satisfies the matching condition, the matching result may be, for example, information indicating successful authentication. If the similarity does not satisfy the matching condition, the matching result may be, for example, information indicating failed authentication.

- the matching result may include information indicating at least one degree of certainty, such as the degree of similarity or a determination result as to whether or not the matching condition is satisfied. Note that the matching result is not limited to the examples given here.

- the matching result may be output by displaying it on a display unit (not shown), or by transmitting it to another device (not shown).

- the matching unit 118 may display the matching result on a display unit provided in the information processing device 100 or provided in another device (not shown) (for example, a mobile terminal used by a user).

- the matching unit 118 may transmit the matching result via the network NT to another device (not shown) (for example, an information processing device that uses the matching result).

- the information processing device 100 may start information processing, for example, when it acquires an input image.

- the trigger for the information processing device 100 to start information processing is not limited to this.

- the information processing device 100 physically includes a bus 2010, a processor 2020, a memory 2030, a storage device 2040, a network interface 2050, an input interface 2060, and an output interface 2070, as shown in FIG.

- the bus 2010 is a data transmission path for the processor 2020, memory 2030, storage device 2040, network interface 2050, input interface 2060, and output interface 2070 to transmit and receive data to and from each other.

- the method of connecting the processor 2020 and the like to each other is not limited to a bus connection.

- the processor 2020 is a processor realized by a CPU (Central Processing Unit) or a GPU (Graphics Processing Unit), etc.

- Memory 2030 is a main storage device realized by RAM (Random Access Memory) or the like.

- the storage device 2040 is an auxiliary storage device realized by a hard disk drive (HDD), a solid state drive (SSD), a memory card, a read only memory (ROM), or the like.

- the storage device 2040 stores program modules for realizing the functions of the information processing device 100.

- the processor 2020 loads each of these program modules into the memory 2030 and executes them to realize the function corresponding to that program module.

- the network interface 2050 is an interface for connecting the information processing device 100 to the network NT.

- the network NT is a communications network for transmitting and receiving information to and from other devices (not shown), and may be configured as a wired or wireless network or a combination of these.

- the input interface 2060 is an interface through which the user inputs information, and is composed of, for example, a touch panel, a keyboard, a mouse, etc.

- the output interface 2070 is an interface for presenting information to the user, and is composed of, for example, a liquid crystal panel, an organic EL (Electro-Luminescence) panel, etc.

- the information processing device 100 may also be composed of multiple devices (e.g., computers, etc.) that transmit and receive information to each other via, for example, a network NT.

- the multiple devices may work together to execute information processing.

- the input image is an image including an iris region, which is a target region.

- the feature extraction model is configured with a neural network including at least one normalization layer.

- the parameters corrected using the correction parameters are the parameters used in the normalization layer.

- the normalization layer can suppress variations in the distribution of intermediate features that can arise due to variations in the quality of the input images, and features of the target region can be extracted.

- features of the target region can be extracted with high accuracy regardless of the quality of the input image, and matching results can be obtained using these features.

- the processing cost for extracting such accurate features of the target region is smaller than when applying general image super-resolution technology.

- the target information includes at least one of quality information of the target region, intermediate features of the target region, and statistics related to the target region.

- the target information includes quality information of a target region estimated by inputting the target region into a quality estimation model for estimating quality information of the target region in an input image, and a correction parameter is calculated by inputting the target information into a first correction parameter estimation model for estimating the correction parameter.

- the information processing system SYS2 includes an imaging device 201 and an information processing device 200.

- the information processing device 200 includes a target position estimation unit 211, a target area generation unit 212, a target information acquisition unit 215, a calculation unit 216, an extraction unit 117, and a matching unit 118.

- the imaging device 201 is a device that captures an image of a subject and generates an input image.

- the imaging device 201 is, for example, a visible light camera, an infrared camera, a near-infrared camera, or the like.

- the image capturing device 201 when the image capturing device 201 receives a signal indicating that a person is in a specified position from a sensor such as a human presence sensor (not shown), it captures an image of the vicinity of both of the person's eyes and generates a binocular image.

- the image capturing device 201 may output the generated binocular image.

- the target position estimation unit 211 estimates the position of the target area in the input image.

- the target position estimation unit 211 estimates the eye position including the position of the pupil center, the pupil diameter, and the iris diameter as the position of the target region.

- the pupil diameter may be the diameter of the pupil or the radius of the pupil.

- the pupil diameter may be expressed, for example, by the number of pixels. Note that the method of expressing the pupil diameter is not limited to the number of pixels.

- the technique for estimating the position of the target area may be a general technique such as pattern matching or a machine learning model.

- the target position estimation unit 211 may use an input image as input and estimate the position of the target area in the input image using a learning model that has been trained to estimate the position of the target area from a learning input image.

- supervised learning may be performed using the learning input image and training data that includes the position of the target area in the learning input image.

- eye position and the techniques for estimating it are not limited to those exemplified here.

- the target area generation unit 212 generates a target area (an image showing only the target area) based on the input image and the estimated position of the target area.

- the target region generating unit 212 may generate a target region (for example, a roughly circular iris region as shown in FIG. 5) by cutting out the target region from the input image.

- the target region generating unit 212 may also generate a target region with a predetermined shape (for example, a roughly rectangular iris region as shown in FIG. 8) by cutting out the target region from the input image and further performing a predetermined transformation.

- the iris region may change from a circular or rectangular shape to a shape in which the part covered by the eyelids or the like is missing.

- the target information acquisition unit 215 acquires quality information about the target area in the input image as target information.

- the target information acquisition unit 215 acquires estimated quality information of the target region by inputting the target region into a quality estimation model.

- the quality estimation model is a learning model for estimating quality information of the target region in the input image.

- the quality estimation model may output quality information of the target region.

- the quality information may be, for example, the iris diameter.

- supervised learning can be performed using training input images and training data that includes quality information on the training input images.

- the technology for estimating quality information is not limited to the one exemplified here. Furthermore, if the quality information is determined by the target position estimation unit 211, such as when the quality information is the iris diameter, the target information acquisition unit 215 may acquire the quality information from the target position estimation unit 211.

- the calculation unit 216 calculates correction parameters for correcting the parameters included in the feature extraction model based on the quality information.

- the calculation unit 216 calculates the correction parameters by inputting the quality information to a first correction parameter estimation model.

- the first correction parameter estimation model is a learning model for estimating the correction parameters. For example, when the quality information of the target region is input, the first correction parameter estimation model outputs the correction parameters.

- the correction parameters are, for example, the average ⁇ c , variance ⁇ c , shift ⁇ c , and scale parameter ⁇ c for each channel as described above.

- the first correction parameter estimation model may be constructed using, for example, a neural network such as a convolutional neural network, an attention mechanism, etc.

- the information processing device 200 executes information processing as shown in Fig. 9.

- the information processing device 200 acquires an input image from the photographing device 201, for example, it is preferable to start the information processing.

- the target position estimation unit 211 estimates the position of the target area in the input image based on the input image generated by the imaging device 201 (step S211).

- the target area generation unit 212 generates a target area (an image showing only the target area) based on the input image generated by the imaging device 201 and the position of the target area estimated in step S211 (step S212).

- the target information acquisition unit 215 acquires quality information of the target area, which is the target information, by inputting the target area generated in step S212 into a quality estimation model (step S215).

- the calculation unit 216 calculates the correction parameters by inputting the quality information acquired in step S215 into the first correction parameter estimation model (step S216).

- the extraction unit 117 extracts features of the target region using the feature extraction model corrected with the correction parameters (step S117).

- the extraction unit 117 extracts features of the target region by inputting the target region generated in step S212 into the feature extraction model corrected with the correction parameters calculated in step S216.

- the matching unit 118 outputs the result of matching the features of the target area extracted in step S117 with the pre-registered registration information (step S118), and ends the information processing.

- the target information includes quality information estimated by inputting the target area into a quality estimation model for estimating quality information of the target area.

- the correction parameters are calculated by inputting the target information into a first correction parameter estimation model for estimating the correction parameters.

- the target information includes intermediate features extracted by inputting a pre-element region into an intermediate feature extraction model for extracting intermediate features of a target region in an input image, and a correction parameter is calculated by inputting the target information into a second correction parameter estimation model for estimating the correction parameter.

- the information processing system SYS3 includes an imaging device 201 and an information processing device 300.

- the information processing device 300 includes a target position estimation unit 211, a target area generation unit 212, a target information acquisition unit 315, a calculation unit 316, an extraction unit 117, and a matching unit 118.

- the target information acquisition unit 315 acquires intermediate features of the target region in the input image as target information.

- the target information acquisition unit 315 acquires intermediate features of the target region by inputting the target region into the intermediate feature extraction model described above.

- the calculation unit 316 calculates correction parameters for correcting the parameters included in the feature extraction model based on the intermediate features of the target region.

- the calculation unit 316 calculates the correction parameters by inputting the intermediate feature of the target region to the second correction parameter estimation model.

- the second correction parameter estimation model is a learning model for estimating the correction parameters. For example, when the intermediate feature of the target region is input, the second correction parameter estimation model outputs the correction parameters.

- the correction parameters are, for example, the average ⁇ c , variance ⁇ c , shift ⁇ c , and scale parameter ⁇ c for each channel as described above.

- the second correction parameter estimation model may be constructed using, for example, a neural network such as a convolutional neural network, an attention mechanism, etc.

- the method for learning the second correction parameter estimation model will be described in another embodiment. Note that the norm of the intermediate features may be used instead of the intermediate features.

- the information processing device 300 executes information processing as shown in Fig. 11.

- the information processing device 300 acquires an input image from the photographing device 201, for example, it is preferable to start the information processing.

- the target information acquisition unit 315 acquires target information including intermediate features of the target region by inputting the target region generated in step S212 into the intermediate feature extraction model (step S315).

- the calculation unit 316 calculates the correction parameters by inputting the intermediate features of the target region acquired in step S315 into the second correction parameter estimation model (step S316).

- the extraction unit 117 extracts features of the target region using the feature extraction model corrected with the correction parameters (step S117).

- the extraction unit 117 extracts features of the target region by inputting the intermediate features acquired in step S315 to a feature extraction model corrected with the correction parameters calculated in step S316.

- the matching unit 118 outputs the result of matching the features of the target area extracted in step S117 with the pre-registered registration information (step S118), and ends the information processing.

- the target information includes intermediate features extracted by inputting the target region to an intermediate feature extraction model for extracting intermediate features of the target region, and the correction parameters are calculated by inputting the target information to a second correction parameter estimation model for estimating the correction parameters.

- the quality of an image there is a correlation between the quality of an image and the norm of the feature vector extracted from that image; for example, the higher the quality of an image, the larger the norm of the feature vector extracted from that image.

- Intermediate features also hold quality information that indicates the quality of the image from which they were extracted. For example, the quality information can be estimated by calculating the norm.

- the correction parameters can be estimated by using a correction parameter estimation model with the norm of the intermediate features or the intermediate features themselves as input.

- the target information includes quality information of the target region or intermediate features of the target region.

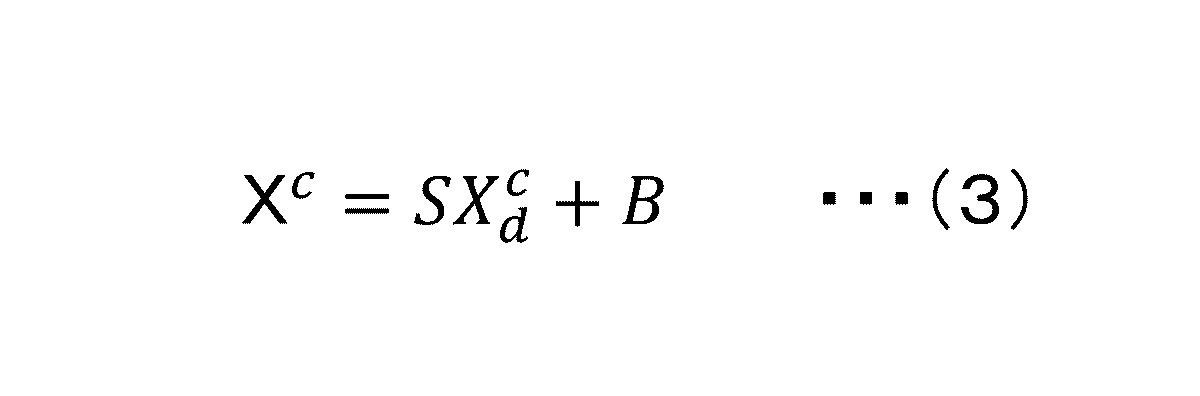

- the correction parameters are calculated by applying correction coefficients S and B acquired by inputting the target information to a correction coefficient estimation model for estimating the correction coefficients S and B, and dictionary parameters ⁇ d c , ⁇ d c , ⁇ d c , and ⁇ d c stored in advance to a predetermined first relationship.

- the information processing system SYS4 includes an imaging device 201 and an information processing device 400.

- the information processing device 400 includes a target position estimation unit 211, a target area generation unit 212, a target information acquisition unit 415, a calculation unit 416, an extraction unit 117, and a matching unit 118.

- the target information acquisition unit 415 acquires target information in the input image.

- the target information in this embodiment is quality information or intermediate features of the target region.

- the target information acquisition unit 415 may have the same functions as the target information acquisition unit 215 described in embodiment 2.

- the target information acquisition unit 415 may have the same functions as the target information acquisition unit 315 described in embodiment 3.

- the calculation unit 416 calculates correction parameters for correcting the parameters included in the feature extraction model based on the target information acquired by the target information acquisition unit 415.

- the calculation unit 416 includes a dictionary parameter storage unit 416a, a correction coefficient acquisition unit 416b, and a correction parameter calculation unit 416c.

- the correction coefficient acquisition unit 416b acquires the correction coefficients S and B used to calculate the correction parameters based on the target information (quality information or intermediate features).

- the correction coefficient acquisition unit 416b acquires the correction coefficients S and B by inputting the target information (quality information or intermediate feature amount) to a correction coefficient estimation model.

- the correction coefficient estimation model is a learning model for estimating the correction coefficients S and B.

- the correction coefficient estimation model outputs the correction coefficients S and B.

- the correction parameter calculation unit 416c calculates the correction parameters by applying the dictionary parameters and the correction coefficients stored in advance to a first relationship that is determined in advance.

- the correction parameters are, for example, the mean ⁇ c , the variance ⁇ c , the shift ⁇ c , and the scale parameter ⁇ c for each channel as described above.

- the first relationship is defined, for example, by the following formula (3).

- X in formula (3) represents each of ⁇ , ⁇ , ⁇ , and ⁇ . Note that the first relationship is not limited to the example given here, and may be defined, for example, by another relational expression or by a multidimensional matrix.

- the information processing device 400 executes information processing as shown in Fig. 14.

- the information processing device 400 acquires an input image from the photographing device 201, for example, it is preferable to start the information processing.

- the target information acquisition unit 415 acquires target information (quality information or intermediate features of the target area) using the target area generated in step S212 and the quality estimation model or intermediate feature extraction model (step S415).

- the correction coefficient acquisition unit 416b calculates correction parameters based on the target information (quality information or intermediate features) acquired in step S415 (step S416).

- the correction coefficient acquisition unit 416b acquires the correction coefficients S and B by inputting the target information (quality information or intermediate feature amount) into the correction coefficient estimation model (step S416a).

- the correction parameter calculation unit 416c substitutes the dictionary parameters and the correction coefficients S and B into an equation in which X in equation (3) is replaced with ⁇ , ⁇ , ⁇ , and ⁇ , respectively, to calculate the average ⁇ c , variance ⁇ c , shift ⁇ c , and scale parameter ⁇ c for each channel.

- the extraction unit 117 extracts features of the target region using the feature extraction model corrected with the correction parameters as described above (step S117).

- the extraction unit 117 may extract features of the target region by inputting the target region generated in step S212 into the feature extraction model corrected with the correction parameters.

- the extraction unit 117 may extract features of the target region by inputting the intermediate features acquired in step S315 to a feature extraction model corrected with the correction parameters.

- the matching unit 118 outputs the result of matching the features of the target area extracted in step S117 with the pre-registered registration information (step S118), and ends the information processing.

- the target information includes quality information of the target region or intermediate feature amounts of the target region.

- the correction parameters are calculated by applying the correction coefficients obtained by inputting the target information into the correction coefficient estimation model and the dictionary parameters stored in advance to a predetermined first relationship.

- the correction parameters are calculated using the correction coefficients, so the number of coefficients estimated based on the target information can be made smaller than the number of correction parameters. This makes it possible to reduce the amount of processing required for estimation based on the target information.

- the feature extraction model corrected with the correction parameters can be used to extract features from the target region, even if the input image is of low quality, it is possible to extract features from the target region with high accuracy and obtain matching results using those features.

- the target information includes statistics regarding the target region calculated using intermediate features of the target region, and the correction parameters are calculated by applying the statistics regarding the target region and a dictionary parameter stored in advance to a predetermined second relationship.

- the information processing system SYS5 includes an imaging device 201 and an information processing device 500.

- the information processing device 500 includes a target position estimation unit 211, a target area generation unit 212, a target information acquisition unit 515, a calculation unit 516, an extraction unit 117, and a matching unit 118.

- the target information acquisition unit 515 acquires statistics relating to a target region in an input image as target information.

- the statistics relating to the target region are, for example, the mean ⁇ c and variance ⁇ c of the intermediate feature amounts for each channel.

- the target information acquisition unit 515 has a function similar to that of the target information acquisition unit 315 described in embodiment 3, and thereby acquires intermediate features of the target region, i.e., intermediate features for each channel related to the target region.

- the target information acquisition unit 515 performs statistical processing on the intermediate features to calculate the average ⁇ *C and variance ⁇ *C of the intermediate features for each channel.

- the calculation unit 516 calculates correction parameters for correcting the parameters included in the feature extraction model based on the target information acquired by the target information acquisition unit 415.

- the calculation unit 516 includes a dictionary parameter storage unit 416a and a correction parameter calculation unit 516b.

- the correction parameter calculation unit 516b calculates the correction parameter by applying the statistics related to the target region and the dictionary parameters stored in advance to a predetermined second relationship.

- the second relationship is defined, for example, by the following formula (4).

- Y represents ⁇ and ⁇ .

- the second relationship is not limited to the one exemplified here, and may be defined, for example, by another relational expression or a multidimensional matrix.

- m is a weight that is determined appropriately, and is, for example, 0 ⁇ m ⁇ 1.

- the target information includes statistics regarding the target region calculated using intermediate features of the target region, and the correction parameters are calculated by applying the statistics regarding the target region and the dictionary parameters stored in advance to a second relationship determined in advance.

- the target information acquisition unit 515 calculates intermediate features for each channel related to the target region, and the average ⁇ *C and variance ⁇ *C of the intermediate features for each channel.

- the calculation unit 516 may further include a function similar to that of the calculation unit 316 described in the third embodiment, in addition to the function described in the fifth embodiment. This allows the calculation unit 516 to calculate correction parameters based on the intermediate features of the target region and statistics related to the target region.

- the extraction unit 117 may extract features of the target region by inputting the intermediate features to a feature extraction model in which some of the parameters of the feature extraction model are corrected by correction parameters based on statistics and the remaining parameters are corrected by correction parameters based on the intermediate features.

- the parameters corrected by the correction parameters based on statistics may be, for example, at least one of the mean ⁇ c and the variance ⁇ c .

- the target information includes intermediate feature amounts of the target region and statistics regarding the target region.

- the correction parameters are calculated based on the intermediate feature amounts of the target region and the statistics regarding the target region.

- the information processing system SYS6 includes an imaging device 201 and an information processing device 600.

- the information processing device 600 includes a learning unit 619 in addition to the functions of the information processing device 200.

- the learning calculation unit 619a inputs quality information of the learning input image contained in the training data into the first correction parameter estimation model and calculates the learning correction parameters.

- the information processing performed by the information processing device 600 may further include a learning process as shown in Fig. 20 in addition to the information processing described in the second embodiment.

- the learning process may be started, for example, upon receiving an instruction from a user.

- the training data may be prepared before starting the learning process. Note that the trigger for starting the learning process is not limited to this.

- the learning calculation unit 619a inputs quality information regarding the target region in the learning input image into the first correction parameter estimation model to calculate the learning correction parameters (step S601).

- the quality information regarding the learning input image may be acquired, for example, using the functions of the target area generation unit 212 and the target information acquisition unit 215, or may be included in the training data.

- the learning unit 619 may further include an image degradation unit (not shown) that degrades the learning input image to an appropriate quality specified by the user.

- the quality information regarding the learning input image is the quality specified by the user, and may be acquired from the image degradation unit.

- the learning feature extraction unit 619b inputs the learning input image into the feature extraction model corrected with the learning correction parameters calculated in step S601, and extracts learning features (step S602).

- the update unit 619d updates the parameters included in the feature extraction model and the first correction parameter estimation model based on the loss calculated in step S603 (step S604), and ends the learning process.

- the information processing device 600 includes the learning unit 619 that uses training data to learn the feature extraction model and the first correction parameter estimation model.

- the second training data includes a second input image that is an input image for learning.

- the second training data may further include a second correct label that is a correct label associated with the second input image.

- the first learning unit 720 and the second learning unit 721 use first training data and second training data that include learning images with different image quality to individually learn the feature extraction model and the first correction parameter estimation model.

- the first learning unit 720 includes a first feature amount extracting unit 720a, a first loss calculating unit 720b, and a first updating unit 720c.

- the first feature extraction unit 720a inputs the first input image into a feature extraction model to extract a first feature.

- the first feature is a feature of a target region contained in the first input image, and the same applies below.

- the first loss calculation unit 720b calculates the loss based on the first correct label and the first feature.

- the loss function a general loss function such as the sum of squares error or the cross entropy error may be used.

- the first update unit 720c updates the parameters included in the feature extraction model based on the first loss. This update may use a general optimization method such as gradient descent or stochastic gradient descent.

- the second learning unit 721 includes a learning calculation unit 721a, a second feature amount extraction unit 721b, a second loss calculation unit 721c, and a second update unit 721d.

- the learning calculation unit 721a inputs the quality information of the second input image into the first correction parameter estimation model and calculates the learning correction parameters.

- the quality information regarding the second input image may be acquired, for example, using the functions of the target area generation unit 212 and the target information acquisition unit 215, and may be included in the second training data. Furthermore, if the second input image is created using an image degradation unit (not shown), the quality information regarding the second input image is the quality specified by the user, and may be acquired from the image degradation unit.

- the second feature extraction unit 721b inputs the second input image to a trained feature extraction model that has been corrected using the learning correction parameters, and extracts the second feature.

- the second feature is a feature of the target region contained in the second input image, and the same applies below.

- the second loss calculation unit 721c calculates the second loss based on the second correct label and the second feature.

- the loss function a general loss function such as the sum of squares error or the cross entropy error may be used.

- the second update unit 721d updates the parameters included in the first correction parameter estimation model based on the second loss.

- This update may use a general optimization method such as gradient descent or stochastic gradient descent.

- the information processing executed by the information processing device 700 may further include a first learning process and a second learning process as shown in FIGS. 24 and 25, in addition to the information processing described in the second embodiment, for example.

- the first learning process is a process for learning a feature extraction model.

- the second learning process is a process for learning a first correction parameter estimation model.

- the second learning process is performed using a feature extraction model that has already been learned by executing the first learning process. Therefore, it is preferable to execute the second learning process after the first learning process.

- the first learning process may be started, for example, upon receiving an instruction from a user.

- the second learning process may be executed automatically following the first learning process, or may be started upon receiving an instruction from a user.

- the first training data and the second training data may be prepared before starting the learning process. Note that the trigger for starting the learning process is not limited to this.

- the first feature extraction unit 720a inputs a first input image to a feature extraction model and extracts a first feature (step S701).

- the first loss calculation unit 720b calculates the loss based on the first correct label and the first feature (step S702).

- the first update unit 720c updates the parameters included in the feature extraction model based on the first loss (step S703), and ends the first learning process. This completes the learning of the feature extraction model.

- a feature extraction model that has been trained by executing the first learning process that is, a trained feature extraction model, is used.

- the learning calculation unit 721a inputs the quality information of the second input image to the first correction parameter estimation model to calculate learning correction parameters (step S711).

- the second feature extraction unit 721b inputs the second input image into the trained feature extraction model that has been corrected with the learning correction parameters, and extracts the second feature (step S712).

- the second loss calculation unit 721c calculates the second loss based on the second correct label and the second feature (step S713).

- the second update unit 721d updates the parameters included in the first correction parameter estimation model based on the second loss (step S714), and ends the second learning process. This completes the learning of the first correction parameter estimation model.

- the information processing device 700 includes a first learning unit 720 that uses first training data to learn a feature extraction model, and a second learning unit 721 that uses second training data to learn a first correction parameter estimation model.

- the first training data includes a first input image that is an input image for learning.

- the second training data includes a second input image that is an input image for learning.

- the target region in the first input image is of higher quality than the target region in the second input image.

- the information processing system SYS8 includes an imaging device 201 and an information processing device 800.

- the information processing device 800 includes a first learning unit 820 and a second learning unit 821 in addition to the functions of the information processing device 200.

- the first learning unit 820 uses first training data prepared in advance to learn the feature extraction model.

- the second learning unit 821 uses second training data prepared in advance to learn the first correction parameter estimation model.

- the first training data includes a first input image that is an input image for learning.

- the first training data may further include a first correct answer label that is a correct answer label associated with the first input image, and a first correct answer norm.

- the first correct norm is, for example, the correct value of the norm of the feature extracted from the target region in the first input image.

- the feature norm is the norm of a vector (feature vector) that represents the feature, and the same applies below.

- the second training data includes a second input image that is an input image for learning.

- the second training data may further include a second correct answer label that is a correct answer label associated with the second input image, and a second correct answer norm.

- the second correct norm is, for example, the correct value of the norm of the feature extracted from the target region in the second input image.

- the target area in the first input image is of higher quality than the target area in the second input image.

- a second input image may be prepared by an appropriate method, as described in the seventh embodiment. That is, for example, the second input image may be obtained by degrading the image quality of the first input image using an image degradation unit (not shown) provided in the information processing device 800. Note that the method of preparing the second input image is not limited to this.

- the first learning unit 820 and the second learning unit 821 use first training data and second training data that include learning images with different image quality to individually learn the feature extraction model and the first correction parameter estimation model.

- the first learning unit 820 includes a first feature extractor 720a, a first loss calculator 720b, a first norm calculator 820c, a first norm loss calculator 820d, a loss integrator 820e, and a first updater 820f.

- the first norm calculation unit 820c calculates the first norm, which is the norm of the first feature (feature vector).

- the first norm loss calculation unit 820d calculates the first norm loss based on the first correct answer norm included in the first training data and the first norm.

- the loss function a general loss function such as the sum of squares error or the cross entropy error may be used.

- the loss integration unit 820e calculates an integrated loss by integrating the first loss and the first norm loss. For example, the loss integration unit 820e calculates the integrated loss by multiplying each of the first loss and the first norm loss by a predetermined weight and then adding them together.

- the first update unit 820f updates the parameters included in the feature extraction model. This update may use a general optimization method such as gradient descent or stochastic gradient descent.

- the second learning unit 821 includes a learning calculation unit 721a, a second feature extraction unit 721b, a second norm calculation unit 821c, a second norm loss calculation unit 821d, and a second update unit 821e.

- the second norm calculation unit 821c calculates the second norm, which is the norm of the second feature.

- the second norm loss calculation unit 821d calculates the second norm loss based on the ground truth norm included in the second training data and the second norm.

- the loss function a general loss function such as the sum of squares error or the cross entropy error may be used.

- the second update unit 821e updates the parameters included in the first correction parameter estimation model based on the second norm loss.

- This update may use a general optimization method such as gradient descent or stochastic gradient descent.

- the information processing executed by the information processing device 800 may further include a first learning process and a second learning process as shown in FIGS. 29 and 30, respectively, in addition to the information processing described in the second embodiment, for example.

- the first learning process is a process for learning a feature extraction model.

- the second learning process is a process for learning a first correction parameter estimation model.

- the second learning process is performed using a feature extraction model that has already been learned by executing the first learning process. Therefore, it is preferable to execute the second learning process after the first learning process.

- the first learning process may be started, for example, upon receiving an instruction from a user.

- the second learning process may be executed automatically following the first learning process, or may be started upon receiving an instruction from a user.

- the first training data and the second training data may be prepared before starting the learning process. Note that the trigger for starting the learning process is not limited to this.

- Steps S701 to S702 described in the seventh embodiment are executed.

- the first norm calculation unit 820c calculates the first norm, which is the norm of the first feature (step S803).

- the first norm loss calculation unit 820d calculates the first norm loss based on the first correct answer norm included in the first training data and the first norm (step S804).

- the first update unit 820f updates the parameters included in the feature extraction model (step S806) and ends the first learning process. This completes the learning of the feature extraction model.

- Steps S711 to S712 described in the seventh embodiment are executed.

- It includes a learning calculation unit 721a, a second feature extraction unit 721b, a second norm calculation unit 821c, a second norm loss calculation unit 821d, and a second update unit 821e.

- the second norm calculation unit 821c calculates the second norm, which is the norm of the second feature (step S813).

- the second norm loss calculation unit 821d calculates the second norm loss based on the correct answer norm included in the second training data and the second norm calculated in step S813 (step S814).

- the second update unit 821e updates the parameters included in the first correction parameter estimation model based on the second norm loss (step S815), and ends the second learning process. This completes the learning of the first correction parameter estimation model.

- the information processing device 800 includes a first learning unit 820 and a second learning unit 821 .

- the first learning unit 820 includes a first feature extraction unit 720a, a first loss calculation unit 720b, a first norm calculation unit 820c, a first norm loss calculation unit 820d, a loss integration unit 820e, and a first update unit 820f.

- the first feature extraction unit 720a inputs a first input image into a feature extraction model and extracts a first feature, which is a feature of the first input image.

- the first loss calculation unit 720b calculates a first loss based on the correct label included in the first training data and the first feature.

- the first norm calculation unit 820c calculates the first norm, which is the norm of the first feature.

- the first norm loss calculation unit 820d calculates the first norm loss based on the ground truth norm included in the first training data and the first norm.

- the loss integration unit 820e calculates an integrated loss by integrating the first loss and the first norm loss.

- the first update unit 820f updates the parameters included in the feature extraction model based on the integrated loss.

- the second learning unit 821 includes a learning calculation unit 721a, a second feature extraction unit 721b, a second norm calculation unit 821c, a second norm loss calculation unit 821d, and a second update unit 821e.

- the learning calculation unit 721a inputs quality information of the second input image into the first correction parameter estimation model to calculate the learning correction parameters.

- the second feature extraction unit 721b inputs the second input image into a trained feature extraction model that has been corrected with the learning correction parameters, and extracts the second feature, which is a feature of the second input image.

- the second norm calculation unit 821c calculates the second norm, which is the norm of the second feature.

- the second norm loss calculation unit 821d calculates the second norm loss based on the ground-truth norm included in the second training data and the second norm.

- the second update unit 821e updates the parameters included in the first correction parameter estimation model based on the second norm loss.

- first input image a high-quality training image

- second input image a low-quality training image

- the correct norm included in the second training data used in step S814 is the correct value of the norm of the feature amount extracted from the target region in the second input image.

- the correct norm included in the second training data is not limited to this.

- the higher the quality of an image the longer the norm of the features extracted from that image, and the lower the error rate of the authentication result using that image. Therefore, by training the first correction parameter estimation model to obtain correction parameters that use a feature extraction model to obtain a longer norm length of the features extracted from the image, it is possible to reduce the error rate of the authentication result using that image.

- the average value of the correct answer norms included in the first training data may be used as the correct answer norm included in the second training data (hereinafter referred to as the "second correct answer norm").

- the first input image is of higher quality than the second input image. Therefore, by using such second training data, it is possible to train the first correction parameter estimation model so as to obtain a correction parameter that brings the length of the norm of the feature extracted from a low-quality image close to the same length as that when extracted from a high-quality image. This makes it possible to perform authentication with high accuracy.

- the information processing system SYS9 includes an imaging device 201 and an information processing device 900.

- the information processing device 900 includes a learning unit 919 in addition to the functions of the information processing device 300.

- the learning unit 919 uses training data prepared in advance to train the feature extraction model, the second correction parameter estimation model, and the intermediate feature extraction model.

- the learning unit 919 uses training data common to the feature extraction model and the first correction parameter estimation model to simultaneously train the feature extraction model and the first correction parameter estimation model in an end-to-end manner.

- the training data may include, for example, a learning input image and a correct answer label.

- the learning unit 919 includes a learning target information acquisition unit 919a, a learning calculation unit 919b, a learning feature extraction unit 919c, a loss calculation unit 919d, and an update unit 919e.

- the learning target information acquisition unit 919a inputs the learning input image into the intermediate feature extraction model and extracts the learning intermediate features.

- the learning intermediate features are the intermediate features of the target region in the learning input image.

- the learning calculation unit 919b inputs the learning intermediate features into the second correction parameter estimation model and calculates the learning correction parameters.

- the learning feature extraction unit 919c inputs the learning intermediate features into a feature extraction model corrected with the learning correction parameters, and extracts the learning features.

- the learning features are the features of the target region in the learning input image.

- the loss calculation unit 919d calculates the loss based on the correct label and learning features included in the training data.

- the loss function it is preferable to use a general loss function such as the sum of squares error or the cross entropy error.

- the update unit 919e updates the parameters included in the feature extraction model, the second correction parameter estimation model, and the intermediate feature extraction model based on the loss.

- This update may use a general optimization method such as gradient descent or stochastic gradient descent.

- the information processing performed by the information processing device 600 may further include a learning process as shown in FIG. 33 in addition to the information processing described in the third embodiment.

- the learning process may be started, for example, upon receiving an instruction from a user.

- the training data may be prepared before starting the learning process. Note that the trigger for starting the learning process is not limited to this.

- the learning target information acquisition unit 919a inputs the learning input image into the intermediate feature extraction model and extracts the learning intermediate features (step S901).

- the learning calculation unit 919b inputs the learning intermediate features into the second correction parameter estimation model and calculates the learning correction parameters (step S902).

- the learning feature extraction unit 919c inputs the learning intermediate features into a feature extraction model corrected with the learning correction parameters, and extracts the learning features (step S903).

- the loss calculation unit 919d calculates the loss based on the correct label and learning features contained in the training data (step S904).

- the update unit 919e updates the parameters included in the feature extraction model, the second correction parameter estimation model, and the intermediate feature extraction model based on the loss (step S905), and ends the learning process.

- the information processing device 900 includes the learning unit 919 that uses training data to learn the feature extraction model, the second correction parameter estimation model, and the intermediate feature extraction model.

- the information processing system SYS10 includes an imaging device 201 and an information processing device 1000.

- the information processing device 1000 includes a first learning unit 1020 and a second learning unit 1021 in addition to the functions of the information processing device 300.

- the first learning unit 1020 uses first training data prepared in advance to learn the feature extraction model.

- the second learning unit 1021 uses second training data prepared in advance to learn the second correction parameter estimation model.

- the first training data and the second training data may be similar to the first training data and the second training data described in embodiment 8. That is, for example, the first training data may include a first input image that is an input image for learning, and a first correct answer label. Also, for example, the second training data may include a second input image that is an input image for learning, and a second correct answer label.

- the target area in the first input image is of higher quality than the target area in the second input image.

- the method for preparing such a second input image may be the same as the method described in embodiment 8.

- the first learning unit 1020 and the second learning unit 1021 use first training data and second training data that include learning images with different image quality to individually learn the feature extraction model and the first correction parameter estimation model.

- the first learning unit 1020 includes a first learning object information acquisition unit 1020a, a first feature amount extraction unit 1020b, a first loss calculation unit 1020c, and a first update unit 1020d.

- the first learning target information acquisition unit 1020a inputs the first input image into an intermediate feature extraction model and extracts a first intermediate feature.

- the first intermediate feature is an intermediate feature of a target region included in the first input image.

- the first feature extraction unit 1020b inputs the first intermediate feature into a feature extraction model and extracts the first feature.

- the first loss calculation unit 1020c calculates the first loss based on the first correct label and the first feature.

- the loss function a general loss function such as the sum of squares error or the cross entropy error may be used.

- the first update unit 1020d updates the parameters included in each of the intermediate feature extraction model and the feature extraction model based on the first loss. This update may use a general optimization method such as gradient descent or stochastic gradient descent.

- the second learning unit 1021 includes a second learning object information acquisition unit 1021a, a learning calculation unit 1021b, a second feature extraction unit 1021c, a second loss calculation unit 1021d, and a second update unit 1021e.

- the second learning target information acquisition unit 1021a inputs the second input image into a trained intermediate feature extraction model to extract second intermediate features.

- the second intermediate features are intermediate features of the target region included in the second input image.

- the learning calculation unit 1021b inputs the second intermediate feature amount into the second correction parameter estimation model to calculate the learning correction parameters.

- the second feature extraction unit 1021c inputs the second input image into a trained feature extraction model that has been corrected using the learning correction parameters, and extracts the second feature.

- the second loss calculation unit 1021d calculates the second loss based on the second correct label and the second feature.

- the loss function a general loss function such as the sum of squares error or the cross entropy error may be used.

- the second update unit 1021e updates the parameters included in the second correction parameter estimation model based on the second loss.

- This update may use a general optimization method such as gradient descent or stochastic gradient descent.

- the information processing executed by the information processing device 1000 may further include a first learning process and a second learning process as shown in FIGS. 37 and 38, respectively, in addition to the information processing described in the third embodiment, for example.

- the first learning process is a process for learning an intermediate feature extraction model and a feature extraction model.

- the second learning process is a process for learning a second correction parameter estimation model.

- the second learning process is performed using the intermediate feature extraction model and the feature extraction model that have been learned by executing the first learning process. Therefore, it is preferable to execute the second learning process after the first learning process.

- the first learning process may be started, for example, upon receiving an instruction from a user.

- the second learning process may be executed automatically following the first learning process, or may be started upon receiving an instruction from a user.

- the first training data and the second training data may be prepared before starting the learning process. Note that the trigger for starting the learning process is not limited to this.

- the first learning target information acquisition unit 1020a inputs a first input image to an intermediate feature extraction model and extracts a first intermediate feature (step S1001).

- the first feature extraction unit 1020b inputs the first intermediate feature into a feature extraction model and extracts the first feature (step S1002).

- the first loss calculation unit 1020c calculates the first loss based on the first correct label and the first feature (step S1003).

- the first update unit 1020d updates the parameters included in the intermediate feature extraction model and the feature extraction model based on the first loss (step S1004), and ends the first learning process. This completes the learning of the intermediate feature extraction model and the feature extraction model.

- the intermediate feature extraction model and the feature extraction model learned by executing the first learning process that is, the trained intermediate feature extraction model and the feature extraction model, are used.

- the second learning target information acquisition unit 1021a inputs the second input image to the trained intermediate feature extraction model and extracts second intermediate features (step S1011).

- the learning calculation unit 1021b inputs the second intermediate feature amount into the second correction parameter estimation model to calculate the learning correction parameters (step S1012).