WO2023053364A1 - 情報処理装置、情報処理方法及び情報処理プログラム - Google Patents

情報処理装置、情報処理方法及び情報処理プログラム Download PDFInfo

- Publication number

- WO2023053364A1 WO2023053364A1 PCT/JP2021/036195 JP2021036195W WO2023053364A1 WO 2023053364 A1 WO2023053364 A1 WO 2023053364A1 JP 2021036195 W JP2021036195 W JP 2021036195W WO 2023053364 A1 WO2023053364 A1 WO 2023053364A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- information processing

- machine learning

- heat map

- input image

- attributes

- Prior art date

Links

- 230000010365 information processing Effects 0.000 title claims abstract description 57

- 238000003672 processing method Methods 0.000 title claims description 5

- 238000010801 machine learning Methods 0.000 claims abstract description 87

- 230000006870 function Effects 0.000 claims description 5

- 238000011156 evaluation Methods 0.000 description 24

- 238000000034 method Methods 0.000 description 22

- 238000010586 diagram Methods 0.000 description 14

- 238000012545 processing Methods 0.000 description 13

- 238000013527 convolutional neural network Methods 0.000 description 12

- 230000015572 biosynthetic process Effects 0.000 description 6

- 238000003786 synthesis reaction Methods 0.000 description 6

- 238000012549 training Methods 0.000 description 6

- 230000002194 synthesizing effect Effects 0.000 description 4

- 238000000605 extraction Methods 0.000 description 3

- 238000013528 artificial neural network Methods 0.000 description 1

- 238000004364 calculation method Methods 0.000 description 1

- 238000013145 classification model Methods 0.000 description 1

- 238000004891 communication Methods 0.000 description 1

- 238000004590 computer program Methods 0.000 description 1

- 238000001514 detection method Methods 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 239000012467 final product Substances 0.000 description 1

- 238000010191 image analysis Methods 0.000 description 1

- 238000003709 image segmentation Methods 0.000 description 1

- 230000001788 irregular Effects 0.000 description 1

- 230000003287 optical effect Effects 0.000 description 1

- 238000010422 painting Methods 0.000 description 1

- 238000011160 research Methods 0.000 description 1

- 230000004044 response Effects 0.000 description 1

- 239000007787 solid Substances 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/10—Segmentation; Edge detection

- G06T7/11—Region-based segmentation

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/40—Extraction of image or video features

- G06V10/44—Local feature extraction by analysis of parts of the pattern, e.g. by detecting edges, contours, loops, corners, strokes or intersections; Connectivity analysis, e.g. of connected components

- G06V10/443—Local feature extraction by analysis of parts of the pattern, e.g. by detecting edges, contours, loops, corners, strokes or intersections; Connectivity analysis, e.g. of connected components by matching or filtering

- G06V10/449—Biologically inspired filters, e.g. difference of Gaussians [DoG] or Gabor filters

- G06V10/451—Biologically inspired filters, e.g. difference of Gaussians [DoG] or Gabor filters with interaction between the filter responses, e.g. cortical complex cells

- G06V10/454—Integrating the filters into a hierarchical structure, e.g. convolutional neural networks [CNN]

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/77—Processing image or video features in feature spaces; using data integration or data reduction, e.g. principal component analysis [PCA] or independent component analysis [ICA] or self-organising maps [SOM]; Blind source separation

- G06V10/80—Fusion, i.e. combining data from various sources at the sensor level, preprocessing level, feature extraction level or classification level

- G06V10/806—Fusion, i.e. combining data from various sources at the sensor level, preprocessing level, feature extraction level or classification level of extracted features

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/82—Arrangements for image or video recognition or understanding using pattern recognition or machine learning using neural networks

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20081—Training; Learning

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20084—Artificial neural networks [ANN]

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20112—Image segmentation details

- G06T2207/20132—Image cropping

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30196—Human being; Person

Definitions

- the present invention relates to an information processing device, an information processing method, and an information processing program.

- Non-Patent Document 1 describes a so-called image cropping, that is, an image processing technique for extracting important parts in an image, in which an attention map in a convolutional neural network is used to obtain an aesthetic value, and such an aesthetic evaluation is performed. It describes obtaining the frame of the main part to be extracted based on the value.

- Non-Patent Document 1 determines the position of the main part in the image by a single evaluation criterion (aesthetic evaluation value in Non-Patent Document 1). are doing.

- the essential parts of the image are originally different depending on the purpose for which the image is used. For example, even if the photographic image shows the same scene, if the photographic image is used as a landscape painting, the main part will be in the background objects in the image, and such a photographic image will be used as a portrait. If it is used, the main part will exist in the image of the person reflected in the foreground in the image. Similarly, even if it is a photographic image of the same person, if such a photographic image is used to identify the person, there will be an important part in the person's face, and such a photographic image will be used to introduce fashion. If used, there should be an essential part of the clothing of the person in the image.

- the present invention has been made in view of such circumstances, and its purpose is to appropriately perform image cropping according to the purpose of the image.

- Information having a plurality of machine learning models each outputting an intermediate heat map for an input image, and a generation unit generating a heat map based on the attributes of the input image and the intermediate heat map. processing equipment.

- the information processing according to (1) including a machine learning model selection unit that selects at least one machine learning model from the plurality of machine learning models as an input target of the input image based on the attribute. Device.

- an intermediate heatmap selection unit that selects at least one intermediate heatmap from among the plurality of intermediate heatmaps output to the plurality of machine learning models based on the attribute, Information processing equipment.

- a computer using one or more machine learning models, an output unit that outputs one or more intermediate heatmaps for an input image, and based on the attributes of the input image and the intermediate heatmaps

- An information processing program that functions as a generation unit that generates a heat map using the

- FIG. 1 is a functional conceptual diagram of an information processing device commonly conceived in various preferred embodiments of the present invention; It is an example of an input image. It is an example of various "important parts" in an input image.

- FIG. 10 is an example of an intermediate heatmap showing CTR prediction;

- FIG. 10 is an example of an intermediate heat map showing aesthetic evaluation values;

- It is an example of an intermediate heat map showing clothing.

- It is an example of an intermediate heat map showing a bag.

- An example of a generated heatmap It is a figure explaining an example of the process performed by the extraction part. It is an example of the main part obtained. It is a figure which shows the processing flow performed by an extraction part.

- 1 is a configuration diagram showing a typical physical configuration of a general computer;

- FIG. 1 is a diagram showing a functional configuration of an information processing apparatus according to a first embodiment of the present invention

- FIG. FIG. 7 is a diagram showing the functional configuration of an information processing apparatus according to a second embodiment of the present invention

- FIG. 10 is a diagram showing the functional configuration of an information processing apparatus according to a third embodiment of the present invention

- FIG. 4 is a diagram showing a common processing flow executed by the information processing apparatus according to the present invention

- FIG. 1 is a functional conceptual diagram of an information processing device 100 commonly conceived in various preferred embodiments of the present invention.

- the information processing apparatus 100 is realized by realizing the functions shown in the figure by appropriate physical means, for example, a computer executing appropriate computer programs.

- the information processing device 100 is a kind of image processing device that includes a machine learning model group 10, an output unit 12, a generation unit 20, and a clipping unit 30. More specifically, the machine learning model group 10 includes a plurality of trained machine learning models 11, each of which can output an intermediate heat map based on the input of the input image. The output unit 12 obtains the same number of intermediate heat maps by inputting the input image to at least one machine learning model 11 . Whether or not the input image is input to all of the multiple machine learning models 11 depends on the mode of implementation. Become.

- the generation unit 20 generates a heat map based on at least one obtained intermediate heat map. Normally, the generation unit 20 obtains a heat map by synthesizing a plurality of intermediate heat maps by a predetermined method, and directly or indirectly uses the attributes of the input image. That is, the generator 20 generates a heat map based on the intermediate heat map based on the attributes of the input image.

- the information processing device 100 may use the heat map output by the generating unit 20 as the final product. However, here, it is assumed that the clipping unit 30 is further provided.

- the clipping unit 30 clips a main part, which is a part of the input image, based on the heat map obtained by the generating unit 20 .

- the information processing apparatus 100 can be said to be a device that clips the main part of the input image based on the attributes of the input image.

- Fig. 2 is an example of an input image.

- the figure shows a photograph of a person, but the subject is not particularly limited. etc.).

- the format of the input image is not particularly limited, and the distinction between raster image and vector image, resolution, and format are arbitrary, but at least when the input image is input to the machine learning model group 10,

- the input image is prepared as electronic data.

- the "important part" of an input image can differ depending on how the input image is used. As a specific example, if a human figure is requested as the "important part" of the input image shown in FIG. 3, which is the same as that shown in FIG. The area within the frame is considered appropriate. However, if clothing (or fashion) is required as the "essential part", the area within the frame indicated by the dashed line B in the figure would be appropriate. is required, the area within the frame indicated by the chain double-dashed line C in the figure would be appropriate.

- the "important part" of the input image must be determined based on information indicating how the input image is to be used, and such information is given by some method separately from the input image.

- Such information is hereinafter referred to as “attributes" of the input image.

- Attributes of the input image may be given based on structural data, such as some text data associated with the input image.

- the attribute of the input image may be selected from at least one attribute obtained by inputting the input image into some object detection model or image classification model. At this time, these models refer to trained machine learning models, for example.

- heatmaps In the technical field of image analysis, it is already known that by preparing appropriate learning data, it is possible to create an evaluation image that numerically indicates the evaluation of the importance of each pixel that constitutes the image. Such evaluation images are hereinafter referred to as "heatmaps" herein.

- the resolution of the heat map does not necessarily have to match that of the input image, and individual evaluation values may be indicated by a plurality of pixels such as 3 ⁇ 3 or 5 ⁇ 5.

- the viewpoint (that is, attribute) on which such a heat map is generated depends on the prepared machine learning learning data, so different heat maps are output according to various attributes. It is usually not possible to prepare a machine learning model to discriminate. It is possible to imagine a machine learning model that outputs a heatmap with attributes as input in addition to the input image, but it is not easy to prepare training data for training such a machine learning model. Therefore, in the information processing apparatus 100, as the machine learning model group 10, a plurality of learned machine learning models 11 that are relatively easy to implement are prepared.

- the machine learning model 11 outputs a heat map from a specific point of view determined for each machine learning model 11, instead of the ultimately required heat map, which may differ depending on the attributes of the input image.

- the heat map that is finally obtained in line with the attributes of the input image is simply referred to as a heat map

- the heat map from a single viewpoint obtained by the individual machine learning model 11 is referred to as an intermediate heat map.

- An intermediate heat map corresponds to an output such as an attention map or attention image generated using an attention model included in an individual machine learning model, for example.

- the machine learning model uses the attention model based on the feature quantity map output by a feature extractor such as a CNN (convolutional neural network) included in the machine learning model, and outputs an attention map, attention image, etc. as an intermediate heatmap.

- a feature extractor such as a CNN (convolutional neural network) included in the machine learning model

- the attention map here may be a map generated based on the attention model, or may be a map generated without being based on the attention model.

- an attention map as an intermediate heat map in CTR prediction or aesthetic evaluation value prediction corresponds to an attention map generated based on an attention model.

- 4 to 7 are examples of intermediate heat maps for the input image illustrated in FIG.

- the intermediate heatmap in Figure 4 is the CTR (click-through rate) prediction.

- the machine learning model 11 that outputs the CTR prediction as an intermediate heat map uses, for example, a machine learning architecture known as CNN, and is trained using images annotated with scores corresponding to CTR as training data. Obtainable. Such learning data can be obtained, for example, by tracking user operations on images displayed on an EC (electronic commerce) site.

- the intermediate heat map in Figure 5 is the aesthetic evaluation value.

- a machine learning model 11 such as a CNN using learning data.

- the learning data is created by annotating the images in such a manner. Note that the aesthetic evaluation value here can be rephrased as an aesthetic score.

- the intermediate heat map in Figure 6 shows clothing. That is, it is an image indicating a portion corresponding to "clothing" in the image, and indicates an area in the input image in which clothes worn by a person are shown.

- dedicated learning data may be created one by one. are extracted and labeled, and the machine learning model 11 is trained using the data of the region labeled “clothes” as learning data.

- image segmentation techniques those known as R-CNN or Faster R-CNN are well known and can be used.

- R-CNN or Faster R-CNN may be used directly as the machine learning model 11, extracting only the data of the region labeled "clothes” and using it as an intermediate heat map.

- the intermediate heat map in FIG. 7 shows the bag, and its meaning indicates the area in the input image in which the bag is shown.

- the same process as that described for the clothing in FIG. 6 may be performed for the bag.

- any desired number of types of machine learning models 11 are prepared so that the necessary number of types of intermediate heatmaps can be obtained.

- these intermediate heat maps are shown as if they were binary images. bit depth grayscale image.

- the architecture of the machine learning model is not limited to this. Not only DNN (deep neural network) such as CNN, but also other machine learning methods may be used, and the architecture is different for each intermediate heat map to be obtained, that is, for each machine learning model 11. may be Also, the format of the input image is converted according to the machine learning model 11 to be input. For example, it is converted into a raster image of a predetermined size and resolution.

- DNN deep neural network

- the architecture is different for each intermediate heat map to be obtained, that is, for each machine learning model 11.

- the format of the input image is converted according to the machine learning model 11 to be input. For example, it is converted into a raster image of a predetermined size and resolution.

- the obtained multiple intermediate heatmaps are passed to the generation unit 20, which directly or indirectly creates a heatmap from the multiple intermediate heatmaps based on the attributes.

- "directly based on attributes” means that, for example, when a heat map is created from a plurality of intermediate maps by synthesis, an intermediate heat map to be used for synthesis is selected according to the attribute, or the difference in synthesis is determined. It refers to using attributes in some way when creating a heat map from a plurality of intermediate heat maps delivered to the generation unit 20, such as by varying the weighting according to the attributes.

- indirectly based on the attribute means that the intermediate heat map to be created to be passed to the generation unit 20 is prepared in advance using the attribute in some form, such as being selected according to the attribute. It means that a plurality of intermediate maps are passed to the generation unit 20 and used to generate a heat map.

- FIG. 8 and 9 are examples of heat maps generated by the generation unit 20.

- FIG. The heat map shown in FIG. 8 designates clothing as an attribute

- the heat map shown in FIG. 9 designates bags as an attribute, both of which are generated based on the same input image shown in FIG. It can be seen that completely different heatmaps are generated when the specified attributes are different.

- the heat map shown in FIG. 8 and the intermediate heat map showing clothing shown in FIG. 6, the two are not the same, and the intermediate heat map in FIG.

- an area centering on the clothing portion and including a moderate area around it is shown. It can be seen that an appropriate region is selected as the region showing In the heat map shown in FIG. 9, it can be seen that similarly appropriate regions are appropriately selected.

- the clipping unit 30 clips a main portion, which is a part of the input image, based on the heat map generated by the generating unit 20.

- the term "cut out” means to specify the position and shape of the main portion, which is a part of the input image, and to delete the portion other than the main portion from the image data itself of the input image. is not necessarily required. This is because even if all the image data of the input image is saved, if the position and shape of the main part are specified, it is possible to display only the main part when displaying the image. be.

- the shape of the main portion is rectangular, but the shape of the main portion may be any shape, such as elliptical, star-shaped, or other irregular shape.

- FIG. 10A and 10B are diagrams illustrating an example of processing performed by the clipping unit 30.

- FIG. 10 As the method described here, a method called sliding window is used.

- the clipping unit 30 sets various clipping windows W having different sizes and shapes on the heat map.

- W Al , W Bm , and W Cn shown in FIG. 10 are all part of the cutting window W.

- the subscripts of the first letter after W (A, B, C...) indicate the size and shape of the cut-out window W

- the subscripts of the second letter (l, m, n...) are The position of the cutout window W on the heat map is shown.

- a window suitable for the main part W opt is selected.

- the method shown in Equation 2 below may be used.

- Equation 2 means selecting the smallest clipping window W included in the candidate window Wcand . It is a thing.

- the main part W opt is obtained, and the input image is trimmed using this main part W opt as an outer frame, An image is obtained by extracting only the portion considered to be important from the input image.

- the method of selecting a window suitable for the main part W opt from the cutout windows W included in W cand is not limited to the above.

- Equation 3 is to select the window W included in W cand that has the largest aesthetic evaluation value. Note that in the present embodiment, any score based on the sum of one or more scores for the clipping window W may be treated as the aesthetic evaluation value in Equation (3).

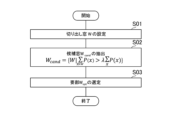

- FIG. 12 is a diagram showing the processing flow executed by the clipping unit 30 in the example described above.

- the clipping unit 30 sets the clipping windows W of various sizes, shapes, and positions in step S01 as already described, and in step S02, by the method shown in Equation 1 or other similar methods. Extract the candidate window W cand .

- a suitable W opt for the main part is selected by the method shown in Equation 2 or Equation 3 or other methods.

- the size, shape, and position of the frame indicated by the selected main part W opt indicate the region from which the input image should be cut out.

- the clipping unit 30 may obtain the main part W opt by executing another process.

- a machine learning model preferably a trained R-CNN

- R-CNN may be used to output the size, shape and position of the main part W opt directly from the heat map.

- a machine learning model it can be trained with training data showing various examples of heatmaps and corresponding W opts .

- a method called sliding window which was described as the processing performed by the clipping unit 30 above, may be used.

- FIG. 13 is a configuration diagram showing a typical physical configuration of such a general computer 1. As shown in FIG.

- a computer 1 has a CPU (Central Processing Unit) 1a, a RAM (Random Access Memory) 1b, an external storage device 1c, a GC (Graphics Controller) 1d, an input device 1e and an I/O (Input/Output) 1f via a data bus 1g. They are connected so that they can exchange electrical signals with each other.

- the external storage device 1c is a device capable of statically recording information, such as an HDD (Hard Disk Drive) or an SSD (Solid State Drive).

- a signal from the GC 1d is output to a monitor 1h, such as a CRT (Cathode Ray Tube) or a so-called flat panel display, on which the user visually recognizes an image, and displayed as an image.

- a monitor 1h such as a CRT (Cathode Ray Tube) or a so-called flat panel display, on which the user visually recognizes an image, and displayed as an image.

- the input device 1e is a device such as a keyboard, mouse, touch panel, etc., for a user to input information

- the I/O 1f is an interface for the computer 1 to exchange information with external devices.

- a plurality of CPUs 1a may be prepared to perform parallel operations.

- An application program containing a sequence of instructions for causing the computer 1 to function as the information processing device 100 is installed in the external storage device 1c, read out to the RAM 1b as necessary, and executed by the CPU 1a. Further, such a program may be provided by being recorded on an appropriate computer-readable information recording medium such as an appropriate optical disk, magneto-optical disk, or flash memory, or may be provided via an information communication line such as the Internet.

- an interface related to the computer 1 itself may be implemented so that the user may directly operate the computer 1, or a web interface may be used on another computer. It may be a so-called cloud computing method in which general-purpose software such as a browser is used and functions are provided from the computer 1 via the I/O1f. interface), the computer 1 may operate as the information processing apparatus 100 in response to a request from another computer.

- FIG. 14 is a diagram showing the functional configuration of the information processing device 200 according to the first embodiment of the present invention.

- the first embodiment is an example in which the generation unit 220 generates a heat map indirectly based on the attributes of the input image.

- the machine learning models 211c and 211d are selected based on the attributes of the input image. That is, the machine learning model 211c that outputs the intermediate heat map of clothing and the machine learning model 211d that outputs the intermediate heat map of bags are switched between the presence or absence of the input image according to the attribute.

- the machine learning model 211c is selected and an intermediate heat map for clothes is output, while the machine learning model 211d is not selected and an intermediate heat map for bags is output. No map is generated.

- Such selection is performed by the machine learning model selection unit 212 schematically indicated by a switch in FIG.

- the machine learning model selection unit 212 selects at least one machine learning model from a plurality of machine learning models, here the machine learning model 211c and the machine learning model 211d, as an input target of the input image.

- the dashed line indicates that the machine learning model 211d was not selected.

- the machine learning models 211a and 211b are not selected according to their attributes, and are configured to always output intermediate heatmaps.

- Such a configuration may be adjusted according to the specific purpose of the information processing device 200 and the like. For example, there may or may not be machine learning models that are always used without being selected based on attributes, and there is no limit to the number of machine learning models that are selected based on attributes. Also, a plurality of machine learning models may be selected for a specific attribute, or the number of machine learning models selected for each attribute may be different. In this embodiment, as an example, a machine learning model that outputs an intermediate heat map for CTR and aesthetic evaluation values is treated as not being selected depending on attributes, and a machine learning model that outputs an intermediate heat map for clothing and accessories. We are treating the model as being selected by attributes.

- the number of obtained intermediate heat maps is the same as the number of machine learning models 211a to 211c to which the input image is input. These are combined in the generation unit 220 to obtain the final heat map.

- the method of this synthesis is not particularly limited, but one example is a method of multiplying the respective intermediate heat maps by appropriate weights and adding them. That is, the finally obtained heat map H0 is obtained by the method shown in Equation 4 below.

- Hk is the kth intermediate heatmap and wk is the weighting factor for each intermediate heatmap.

- wk may be determined dynamically as in the third embodiment described later, it may be given as a fixed value in advance. For example, it may be 0.3 for intermediate heatmaps for CTR and aesthetic ratings, and 0.4 for intermediate heatmaps for clothing and bags.

- the clipping unit 230 clips the main portion, which is a part of the input image. This clipping process may be as already described as common to each embodiment.

- FIG. 15 is a diagram showing the functional configuration of an information processing device 300 according to the second embodiment of the present invention.

- the second embodiment is one of the examples in which the generation unit 320 generates a heat map directly based on the attribute of the input image.

- the information processing device 300 is configured such that at least one intermediate heat map is selected from a plurality of intermediate heat maps. That is, either the intermediate heat map of clothes or the intermediate heat map of bags is selected by the intermediate heat map selection unit 321 schematically indicated by a switch in FIG. Such selection is based on attributes, and intermediate heatmaps that are not selected are not used in generator 320 .

- the intermediate heatmaps for CTR and aesthetic evaluation values are not selected according to their attributes, and are always used to synthesize the final heatmap.

- Such a configuration may also be adjusted according to the specific purpose of the information processing apparatus 300 and the like. For example, there may or may not be intermediate heatmaps that are always used without being selected based on attributes, and there is no limit to the number of intermediate heatmaps that are selected based on attributes. Also, a plurality of intermediate heat maps may be selected for a specific attribute, or the number of intermediate heat maps selected for each attribute may be different.

- the number of intermediate heatmaps used for synthesizing heatmaps, including the selected intermediate heatmaps, is equal to or less than the number of machine learning models 311a to 311d to which the input image is input. These are combined in the generation unit 320 to obtain the final heat map.

- the method of synthesis may be similar to that of the previous embodiment. Also, based on the heat map obtained in this way, the clipping unit 330 may clip a main part, which is a part of the input image.

- FIG. 16 is a diagram showing the functional configuration of an information processing device 400 according to the third embodiment of the present invention.

- the third embodiment is another example in which the generating unit 420 generates a heat map based directly on the attributes of the input image.

- the information processing device 400 is configured to use weights based on the attributes of the input image when generating a heat map by synthesizing a plurality of intermediate heat maps in the generation unit 420 . That is, in principle, the input image is input to a plurality of machine learning models 411a to 411d prepared in the machine learning model group 410, and the same number of intermediate heat maps as the plurality of machine learning models 411a to 411d are obtained. The weights used when synthesizing the intermediate heatmaps are made different according to the attributes.

- the generator 420 generates at least part of the weight based on the attribute. Specifically, if the attribute is "clothing", the weights corresponding to the intermediate heat maps for CTR, aesthetic evaluation value, clothing, and bags are set to 0.3, 0.3, 0.3, and 0.1. , and if the attribute is "bag", the weights are similarly assigned as 0.3, 0.3, 0.1, 0.3.

- the attribute items do not necessarily correspond to a specific machine learning model. For example, it is possible to provide "fashion item” as an attribute and assign corresponding weights such as 0.3, 0.3, 0.2, 0.2.

- the weight for the intermediate heatmap corresponding to the CTR and the aesthetic evaluation value is always assigned 0.3 without change.

- the weight may be given in advance as a constant.

- the machine learning model selection unit 212 is provided to At least one machine learning model to be used as an input target for the input image may be selected.

- the intermediate heat map selection unit 321 is provided to select at least one intermediate heat map based on the attribute, and the generation unit 420 , or may have both configurations.

- FIG. 17 is a diagram showing a common processing flow of information processing methods executed by the information processing apparatuses 100 to 400 according to each embodiment of the present invention.

- step S11 one or more intermediate heatmaps are output with respect to the input of the input image.

- steps are performed by the machine learning model group 10 shown in FIG. 1 as common to each embodiment, and have already been described. Further, in each embodiment, the processing executed by the machine learning model group 210 shown in FIG. 14, the machine learning model group 310 shown in FIG. 15, and the machine learning model group 410 shown in FIG. do.

- step S12 a heat map is generated based on the attributes of the input image and the intermediate heat map.

- steps have already been described as being performed by the generation unit 20 shown in FIG. 1 as common to each embodiment.

- the processing executed by the generation unit 220 shown in FIG. 14, the generation unit 320 shown in FIG. 15, and the generation unit 420 shown in FIG. 16 corresponds.

- the selection of the machine learning model by the machine learning model selection unit 212 shown in FIG. this is realized by selection of the intermediate heat map by the intermediate heat map selection unit shown in FIG. 15, and by determination of the weight by the generation unit 420 shown in FIG. 16 in the third embodiment.

- step S13 based on the heat map, a main portion, which is a part of the input image, is cut out.

- steps have already been described as being performed by the clipping unit 30 shown in FIG. is similar.

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Evolutionary Computation (AREA)

- Health & Medical Sciences (AREA)

- Artificial Intelligence (AREA)

- General Health & Medical Sciences (AREA)

- Multimedia (AREA)

- Computing Systems (AREA)

- Software Systems (AREA)

- Medical Informatics (AREA)

- Databases & Information Systems (AREA)

- Life Sciences & Earth Sciences (AREA)

- Molecular Biology (AREA)

- Biomedical Technology (AREA)

- Biodiversity & Conservation Biology (AREA)

- Image Analysis (AREA)

Abstract

入力画像の入力に対して中間ヒートマップをそれぞれが出力する複数の機械学習モデル(11)と、前記入力画像の属性及び前記中間ヒートマップに基づいてヒートマップを生成する生成部(20)と、を有する情報処理装置(100)。

Description

本発明は、情報処理装置、情報処理方法及び情報処理プログラムに関する。

非特許文献1には、いわゆるイメージクロッピング、すなわち、画像中の要部を抜き出す画像処理技術であって、畳み込みニューラルネットワークにおけるアテンションマップを活用して美的評価値(aesthetic value)を求め、かかる美的評価値に基づいて抜き出すべき要部の枠を求めるものが記載されている。

Wenguan Wang、Jianbing Shen、"Deep Cropping via Attention Box Prediction and Aesthetics Assessment"、[online]、ICCV-2017、[令和3年8月13日検索]、インターネット<URL: https://openaccess.thecvf.com/content_ICCV_2017/papers/Wang_Deep_Cropping_via_ICCV_2017_paper.pdf>

非特許文献1に示されているものを含め、これまで知られているイメージクロッピングの技術では、単一の評価基準(非特許文献1では美的評価値)により画像中の要部の位置を決定している。

しかしながら、画像の要部は、本来、その画像が用いられる目的に応じて異なるものである。例えば、同じ情景を写した写真画像であっても、かかる写真画像が風景画として用いられるならば、画像中の背景に映る事物に要部が存在するであろうし、かかる写真画像が人物画として用いられるならば、画像中の手前に映りこむ人物像に要部が存在することになる。同様に、同じ人物を映した写真画像であっても、かかる写真画像が人物の特定に用いられるならば、人物の顔部分に要部が存在するであろうし、かかる写真画像がファッションの紹介に用いられるならば、画像中の人物の服飾に要部が存在することになるはずである。

しかしながら、画像の目的に応じて適切にイメージクロッピングを行う技術は、これまで知られていない。

本発明は、かかる事情に鑑みてなされたものであり、その目的は、画像の目的に応じて適切にイメージクロッピングを行うことである。

上記課題を解決すべく本出願において開示される発明は種々の側面を有しており、それら側面の代表的なものの概要は以下のとおりである。

(1)入力画像の入力に対して中間ヒートマップをそれぞれが出力する複数の機械学習モデルと、前記入力画像の属性及び前記中間ヒートマップに基づいてヒートマップを生成する生成部と、を有する情報処理装置。

(2)(1)において、前記属性に基づいて、前記複数の機械学習モデルの中から少なくとも一の機械学習モデルを、前記入力画像の入力対象として選択する機械学習モデル選択部を有する、情報処理装置。

(3)(1)において、前記属性に基づいて、前記複数の機械学習モデルに出力された複数の前記中間ヒートマップの中から少なくとも一の中間ヒートマップを選択する中間ヒートマップ選択部を有する、情報処理装置。

(4)(1)~(3)のいずれかにおいて、前記生成部は、複数の前記中間ヒートマップのそれぞれに重みを付け合成してヒートマップを生成する、情報処理装置。

(5)(4)において、前記生成部は、前記属性に基づいて、少なくとも一部の前記重みを決定する、情報処理装置。

(6)(1)~(5)において、前記ヒートマップに基づいて、前記入力画像の一部分である主要部分を切り出す切り出し部を有する、情報処理装置。

(7)1又は複数の機械学習モデルを用いて入力画像の入力に対して1又は複数の中間ヒートマップを出力する中間ヒートマップ出力ステップと、前記入力画像の属性と前記中間ヒートマップに基づいてヒートマップを生成する生成ステップと、をコンピュータに実行させる、情報処理方法。

(8)コンピュータを、1又は複数の機械学習モデルを用いて、入力画像の入力に対して1又は複数の中間ヒートマップを出力する出力部と、前記入力画像の属性と前記中間ヒートマップに基づいてヒートマップを生成する生成部と、として機能させる、情報処理プログラム。

図1は、本発明の好適な種々の実施形態において共通に観念される、情報処理装置100の機能的な観念図である。情報処理装置100は、同図に示された機能を適切な物理的手段、例えば、適切なコンピュータプログラムを実行するコンピュータ、によって実現することによって実現される。

情報処理装置100は、機械学習モデル群10、出力部12、生成部20、切り出し部30を備える一種の画像処理装置である。より具体的には、機械学習モデル群10には、学習済みの複数の機械学習モデル11が含まれており、それぞれ、入力画像の入力に基づいて中間ヒートマップを出力することができる。出力部12は、少なくとも一の機械学習モデル11に入力画像を入力することで同数の中間ヒートマップを得る。複数の機械学習モデル11の全てに入力画像を入力するか否かは、実施の態様に依存するが、複数の機械学習モデル11に入力画像を入力すると、同数の中間ヒートマップが得られることになる。

得られた少なくとも一の中間ヒートマップに基づいて、生成部20はヒートマップを生成する。通常は、生成部20は、複数の中間ヒートマップを所定の手法により合成してヒートマップを得、この際に、直接的又は間接的に入力画像の属性を利用する。すなわち、生成部20は、入力画像の属性に基づいて、中間ヒートマップに基づいてヒートマップを生成する。

情報処理装置100は、生成部20により出力されるヒートマップを最終生成物としてもよく、この場合には情報処理装置100は、例えば、機械学習モデル群10と生成部20の2つの構成を少なくとも備えることとなるが、ここでは、さらに、切り出し部30を備えるものとして説明する。切り出し部30は、生成部20によって得られたヒートマップに基づいて、入力画像の一部分である主要部分を切り出す。すなわち、情報処理装置100が切り出し部30まで備える場合には、情報処理装置100は、入力画像の主要部を、入力画像の属性に基づいて切り出す装置である、ということができる。

ここで、上述の情報処理装置100の技術上及び実用上の意義、及び、本明細書において用いられる用語の意味について併せて説明する。

図2は入力画像の例である。同図に示したものは、人物の写真であるが、被写体がどのようなものであるかは特に限定されるものではなく、また、入力画像が実写によるものであるかそれ以外のもの(イラストレーションなど)であるかも問わない。また、入力画像のフォーマットも特に限定されるものではなく、ラスタ画像、ベクトル画像の別や解像度、フォーマットも任意であるが、少なくとも、入力画像が機械学習モデル群10に入力される際には、入力画像は電子データとして用意されることになる。

さて、ここで情報処理装置100が目指すものは、図2に示したような入力画像の要部を切り出すか、若しくは要部を示すことのできるヒートマップを得ることである。ところが、例に示した単純な入力画像に対しても、その「要部」を一律に定めることは実はできない。

というのも、ある入力画像の「要部」は、その入力画像をどのように用いるかにより異なり得るからである。具体例で示すと、図3に示す図2と同じ入力画像に対して、「要部」として、人物像が要求されているならば、不要な余白が除去された、図中破線Aで示される枠内の領域が妥当と考えられる。しかしながら、「要部」として、服飾(あるいはファッション)が要求されているならば、「要部」は図中一点鎖線Bで示される枠内の領域が妥当であろうし、「要部」として鞄が要求されているならば、図中二点鎖線Cで示される枠内の領域が妥当となるであろう。

したがって、入力画像の「要部」は、その入力画像をどのように用いるかを示す情報に基づいて定められなければならず、かかる情報は入力画像とは別に、何らかの手法により与えられる。かかる情報を、以降、入力画像の「属性」と称する。図3に即して挙げるならば、「人物像」、「服飾」、「鞄」はいずれも属性の具体例である。入力画像の属性は、入力画像と対応する何らかのテキストデータなどの構造データに基づき与えられてよい。また、入力画像の属性は、入力画像を何らかの物体検出モデルや画像分類モデルに入力することで得られる少なくとも一の属性から選択されてもよい。このとき、これらのモデルは、例えば、学習済みの機械学習モデルを指す。

画像解析の技術分野において、適切な学習データを用意することにより、画像を構成する画素単位で重要性の評価を数値的にしめす評価画像を作成できることはすでに知られている。本明細書では、かかる評価画像を以降、「ヒートマップ」と称する。ヒートマップの解像度は必ずしも入力画像と一致している必要はなく、個々の評価値は、3×3や、5×5など、複数画素ごとに示されるものであっても構わない。

しかしながら、かかるヒートマップがどのような観点(すなわち、属性)に基づいて生成されるかは、用意された機械学習の学習データに依存するため、種々の属性に応じて、互いに異なるヒートマップを出力し分ける機械学習モデルを用意することは通常できない。入力画像に加え、属性をも入力としてヒートマップを出力する機械学習モデルを観念することもできるが、そのような機械学習モデルを訓練するための学習データを用意するのは容易ではない。そこで、情報処理装置100では、機械学習モデル群10として、比較的実現の容易な学習済みの機械学習モデル11を複数用意している。

ここで、機械学習モデル11は、入力画像の属性に応じて異なり得る、最終的に必要となるヒートマップではなく、機械学習モデル11毎に定められた、特定の観点におけるヒートマップを出力するものである。以降、本明細書では、入力画像の属性に即した、最終的に得られるヒートマップを単にヒートマップと称し、個別の機械学習モデル11により得られる、単観点によるヒートマップを中間ヒートマップと称し、両者を区別することとする。中間ヒートマップは、例えば、個別の機械学習モデルに含まれるAttentionモデルを用いて生成されるAttentionマップやAttention画像などの出力に相当する。このとき、機械学習モデルは、その機械学習モデルに含まれるCNN(畳み込みニューラルネットワーク)などの特徴抽出器により出力された特徴量マップに基づき、Attentionモデルを用いて、AttentionマップやAttention画像などの出力を中間ヒートマップとして生成する。なお、ここでのAttentionマップとは、Attentionモデルに基づいて生成されるマップであってよく、Attentionモデルに基づかずに生成されるマップであってよもよい。例えば、CTR予測や美的評価値予測における中間ヒートマップとしてのAttentionマップは、Attentionモデルに基づいて生成されるAttentionマップに相当する。

図4~図7は、図2に例示的に示した入力画像に対する、中間ヒートマップの例である。

図4の中間ヒートマップは、CTR(クリックスルーレート)予測である。中間ヒートマップとして、CTR予測を出力する機械学習モデル11は、例えば、CNNとして知られる機械学習のアーキテクチャを用い、学習データとして、CTRに相当するスコアがアノテーションされた画像を用いて学習させることで得ることができる。かかる学習データは、例えばEC(電子商取引)サイト上に表示させる画像に対するユーザ操作をトラッキングすることにより入手可能である。

図5の中間ヒートマップは、美的評価値である。中間ヒートマップとして、美的評価値を出力する機械学習モデル11を得るための学習データは、研究用或いは実用用として無償或いは有償でインターネット上に公開されているものが既に存在しているため、かかる学習データを用いて例えばCNNなどの機械学習モデル11を訓練することにより得ることができる。一般に、かかる学習データにおいては、美的評価値として、特に用途などを限定することなく、画像において観者の注意をひきやすい部分に高い評価をつけ、あまり注意をひかない部分には低い評価をつけるなどして画像に対するアノテーションを行うことで学習データを作成するものとなっている。なお、ここでの美的評価値とは審美性スコアと換言することができる。

図6の中間ヒートマップは、服飾を示している。すなわち、画像中、「服飾」に該当する部分を示す画像であり、入力画像中、人物が着用している服が写っている領域を示している。かかる中間ヒートマップを出力する機械学習モデル11を得るには、専用の学習データを逐一作成してもよいが、より簡便には、例えば、画像のセグメンテーション技術を用い、任意の画像に対し、領域の抽出とラベリングを行って、「服」のラベル付けがなされた領域のデータを学習データとして用い、機械学習モデル11を訓練すればよい。そのような画像のセグメンテーション技術としては、R-CNN、あるいは、Faster R-CNNとして知られているものが著名であり、これらを用いることができる。あるいは、R-CNNやFaster R-CNNを直接、機械学習モデル11として用い、「服」のラベル付けがなされた領域のデータのみを取り出して中間ヒートマップとして用いてもよい。

図7の中間ヒートマップは、鞄を示しており、その意味は、入力画像中、鞄が写っている領域を示すものである。かかる中間ヒートマップを出力する機械学習モデル11を得るには、図6において服飾について説明したと同様のことを鞄について行えばよい。

同様にして、任意の必要な数の種類の機械学習モデル11を用意し、必要な数の種類の中間ヒートマップを得られるようにしておく。なお、図4~図7に示した中間ヒートマップの例では、図示の都合上、これら中間ヒートマップが二値画像であるかのように示しているが、これに限定するものではなく、任意のビット数のグレースケール画像であってよい。

また、機械学習モデル11は、上の例示ではCNNを用いるものとして説明したが、機械学習モデルのアーキテクチャはこれに限られない。CNNのようなDNN(ディープニューラルネットワーク)だけでなく、他の機械学習手法を用いるものであっても差し支えないし、得ようとする中間ヒートマップ毎、すなわち、機械学習モデル11毎にそのアーキテクチャは異なっていてもよい。また、入力画像のフォーマットは、入力しようとする機械学習モデル11に応じて変換される。例えば、所定のサイズ、所定の解像度のラスタ画像に変換されるなどである。

得られた複数の中間ヒートマップは、生成部20へと受け渡され、生成部20では、直接的または間接的に属性に基づいて、複数の中間ヒートマップからヒートマップを作成する。ここで、直接的に属性に基づくとは、例えば、複数の中間マップからヒートマップを例えば合成により作成する際に、合成に使用する中間ヒートマップを属性に応じて選択したり、合成の差異の重みづけを属性に応じて異ならせたりするなど、生成部20に受け渡された複数の中間ヒートマップからヒートマップを作成する際に、何らかの形で属性を用いることを指す。これに対し、間接的に属性に基づくとは、そもそも、生成部20に受け渡すために作成する中間ヒートマップが、属性に応じて選択されるなど、あらかじめ何らかの形で属性を用いて用意された複数の中間マップが生成部20に受け渡され、ヒートマップの作製に用いられることを指す。

図8及び図9は、生成部20により生成されたヒートマップの例である。図8に示したヒートマップは、属性として服飾を指定したもの、図9に示したヒートマップは、属性として鞄を指定したものであり、いずれも同じ図2に示した入力画像に基づいて生成されたものであり、指定された属性が異なると、全く異なるヒートマップが生成されていることがわかる。一方で、例えば、図8に示したヒートマップと、図6に示した服飾を示す中間ヒートマップとを比較すると、両者は同一でなく、図6の中間ヒートマップでは服飾のみを示す領域が示されているのに対し、図8に示すヒートマップでは、服飾部分を中心としつつ、その周囲の適度な領域をも含む領域が示され、入力画像を服飾を示す画像として用いるにあたり、その要部を示す領域として妥当な領域が選択されていることがわかる。図9に示したヒートマップにおいても同様に妥当と考えられる領域が適切に選択されていることがわかる。

切り出し部30は、生成部20により生成されたヒートマップに基づいて、入力画像の一部分である主要部分を切り出す。ここで、「切り出す」という用語の意味としては、入力画像の一部分である主要部分の位置及び形状を特定することを指しており、入力画像の画像データそのものから主要部分以外の部分を削除することは必ずしも要さない。なぜなら、入力画像の画像データ全てが保存されていたとしても、主要部分の位置及び形状が特定されていれば、画像を表示する際に、主要部分のみを表示するようにすることができるからである。本明細書に示す例では、主要部分の形状は矩形であるが、楕円や星型その他不定形状など、主要部分の形状は任意のものであって差し支えない。

図10は、切り出し部30で実行される処理の一例を説明する図である。ここで説明する手法としては、スライディングウィンドウと呼称される方法を用いている。まず、切り出し部30は、ヒートマップに対し、大きさと形状の異なる種々の切り出し窓Wを設定する。例えば、図10に示すWAl、WBm、WCnはいずれも切り出し窓Wの一部である。ここで、Wの後の一文字目の添え字(A、B、C・・・)は切り出し窓Wのサイズ及び形状を示し、二文字目の添え字(l,m,n・・・)は切り出し窓Wのヒートマップ上の位置を示している。

すなわち、あるサイズ及び形状の切り出し窓、例えばWAが、ヒートマップ上の全ての領域を覆うように、位置をずらしながらWA1・・・WAlのl個設定される。同様に、WBはm個、WCはn個設定される。ここでは説明のため、切り出し窓Wのサイズ及び形状として、WA~WCの3種のみを示したが、より多数の種々のサイズ及び形状の切り出し窓についても同様に設定する。

このようにして設定された切り出し窓Wのうち、次の条件を満足するものを候補窓Wcandとして抽出する。

ここで、xはヒートマップに含まれる画素、P(x)は画素xにおけるヒートマップの値、λは0<λ<1である任意の閾値である。すなわち、上の数1は結局、ヒートマップ全ての画素xについての値の総計に対して、切り出し窓Wに含まれる画素xについての値の総計の割合がλより大きくなるWを候補窓Wcandとして抽出することをいうものである。なお、ラムダの値は任意の固定値、例えば0.7などとして与えてもよいし、全ての切り出し窓Wのうち上位の任意割合、例えば5%が候補窓Wcandとして抽出されるように設定してもよい。

その後、候補窓Wcandの中から、要部Woptとして適したものを選び出す。一例として、次の数2に示される方法を用いてよい。

ここで、|W|は切り出し窓Wに含まれる画素数を示しているから、数2は結局、候補窓Wcandに含まれる切り出し窓Wのうち、最もサイズの小さいものを選択することをいうものである。このようにして、最終的には、例えば、図11に示されるように、要部Woptが得られ、入力画像に対して、この要部Woptを外枠とするトリミングを施すことで、入力画像から重要と考えられる部分のみを抜き出した画像が得られることになる。

なお、Wcandに含まれる切り出し窓Wから要部Woptとして適したものを選び出す方法は上述のものに限定されない。例えば、図5に関して説明した美的評価値を出力する機械学習モデル11を用いて、Wcandに含まれる切り出し窓Wのうち、最も高い美的評価値を含むものを、次の数3のようにして選択してもよい。

ここで、Q(W)は、美的評価値についての中間マップにおける美的評価値を示す。すなわち、数3は、Wcandに含まれる切り出し窓Wにおいて、美的評価値が最も大きいものを選び出すことをいうものである。なお、本実施形態では、切り出し窓Wについての1又は複数のスコアの総計に基づく何らかのスコアを数3における美的評価値として扱ってよい。

図12は、以上説明した例における、切り出し部30で実行される処理フローを示す図である。切り出し部30は、処理を開始すると、すでに説明したように種々の大きさと形状および位置の切り出し窓WをステップS01にて設定し、ステップS02で数1に示した方法又は類似するその他の方法により候補窓Wcandを抽出する。その後ステップS03にて、数2又は数3に示した方法或いはその他の方法により、要部Woptとして適したものを選定する。選定された要部Woptが示す枠の大きさと形状および位置が、入力画像を切り出すべき領域を示していることになる。

あるいは、切り出し部30では、別の処理を実行することにより要部Woptを求めてもよい。その一例としては、機械学習モデル、好適には学習済みのR-CNNを用いて、ヒートマップから直接要部Woptの大きさと形状および位置を出力させるようにしてもよい。機械学習モデルを得るためには、種々のヒートマップの例と、対応する要部Woptを示す学習データを用いて訓練すればよい。かかる学習データを得るために、上の切り出し部30で行われる処理として説明したスライディングウィンドウと呼称される方法を用いてもよい。

以上説明した情報処理装置100は、物理的には、一般的なコンピュータを用いて実現して良い。図13はそのような一般的なコンピュータ1の代表的な物理構成を示す構成図である。

コンピュータ1は、CPU(Central Processing Unit)1a、RAM(Random Access Memory)1b、外部記憶装置1c、GC(Graphics Controller)1d、入力デバイス1e及びI/O(Inpur/Output)1fがデータバス1gにより相互に電気信号のやり取りができるよう接続されている。ここで、外部記憶装置1cはHDD(Hard Disk Drive)やSSD(Solid State Drive)などの静的に情報を記録できる装置である。またGC1dからの信号はCRT(Cathode Ray Tube)やいわゆるフラットパネルディスプレイなどの、使用者が視覚的に画像を認識するモニタ1hに出力され、画像として表示される。入力デバイス1eはキーボードやマウス、タッチパネルなどの、ユーザが情報を入力するための機器であり、I/O1fはコンピュータ1が外部の機器と情報をやり取りするためのインタフェースである。CPU1aはコンピュータ1が必要とする情報処理の負荷に応じて、複数用意されて並列演算がなされるように構成されていてもよい。

コンピュータ1を情報処理装置100として機能させるための命令列を含むアプリケーションプログラムは、外部記憶装置1cにインストールされ、必要に応じてRAM1bに読みだされてCPU1aにより実行される。また、かかるプログラムは、適宜の光ディスク、光磁気ディスク、フラッシュメモリなどの適宜のコンピュータ可読情報記録媒体に記録されて提供されても、インターネットなどの情報通信回線を介して提供されてもよい。また、情報処理装置100を使用者が使用するためのインタフェースは、コンピュータ1自身にかかるインタフェースが実装され、使用者が直接コンピュータ1を操作するものであってもよいし、他のコンピュータ上でwebブラウザのような汎用のソフトウェアを用い、I/O1fを介してコンピュータ1から機能が提供される、いわゆるクラウドコンピューティングの方法によってもよく、さらに、コンピュータ1が他のコンピュータに対してAPI(アプリケーションプログラミングインタフェース)を利用可能に提供することにより、他のコンピュータからの求めに応じてコンピュータ1が情報処理装置100として動作するものであってもよい。

以上が、以下に説明する種々の実施形態において共通に観念される、情報処理装置100の全体的な説明である。続いて、情報処理装置100のより具体的な実施形態について個別に説明する。

図14は、本発明の第1の実施形態に係る情報処理装置200の機能上の構成を示す図である。第1の実施形態は、生成部220において、入力画像の属性に間接的に基づいてヒートマップが生成される例である。

情報処理装置200では、機械学習モデル群210に含まれる少なくとも複数の機械学習モデル211、図14の例では機械学習モデル211c及び211dが、入力画像の属性に基づいて選択される構成となっている。すなわち、服飾の中間ヒートマップを出力する機械学習モデル211cと、鞄の中間ヒートマップを出力する機械学習モデル211dとは、属性に応じて入力画像の入力の有無が切り替えられる。

図14では、属性として「服飾」が与えられているため、機械学習モデル211cが選択され、服飾についての中間ヒートマップが出力される一方、機械学習モデル211dは選択されず、鞄についての中間ヒートマップは生成されない。かかる選択は、図14に模式的にスイッチで示された機械学習モデル選択部212によって行われる。機械学習モデル選択部212は、複数の機械学習モデル、ここでは機械学習モデル211c及び機械学習モデル211dの中から少なくとも一の機械学習モデルを、入力画像の入力対象として選択している。なお、同図においては、破線により、機械学習モデル211dが選択されなかったことを示している。

一方で、機械学習モデル211a及び211bは属性如何によって選択はされず、常に中間ヒートマップを出力するものとして構成されている。

かかる構成は、情報処理装置200の具体的目的などに応じて調整すればよい。例えば、属性に基づいて選択されることなく常に使用される機械学習モデルは存在してもしなくともよいし、属性に基づいて選択される機械学習モデルの数にも制限はない。また、特定の属性に対して、複数の機械学習モデルを選択するようにしてもよいし、属性ごとに選択される機械学習モデルの数が異なっていても構わない。本実施形態では、一実施例として、CTR及び美的評価値についての中間ヒートマップを出力する機械学習モデルを、属性によっては選択されないものとして取り扱い、服飾及び鞄についての中間ヒートマップを出力する機械学習モデルを、属性によって選択されるものとして取り扱っている。

得られた中間ヒートマップは、入力画像が入力された機械学習モデル211a~cと同数となる。これを生成部220において合成し、最終的なヒートマップを得る。この合成の方法は特に限定するものではないが、一例として、それぞれの中間ヒートマップに適宜の重みを乗じて加算する方法が挙げられる。すなわち、最終的に得られるヒートマップH0は、次の数4に示される方法により得られることになる。

ここで、Hkはk番目の中間ヒートマップ、wkはそれぞれの中間ヒートマップに対する重み係数である。wkは後述する第3の実施形態のように動的に定めてもよいが、あらかじめ固定値として与えておいてよい。例えば、CTR及び美的評価値についての中間ヒートマップに対しては0.3、服飾及び鞄についての中間ヒートマップに対しては0.4のように定めてよい。

このようにして得られたヒートマップに基づいて、切り出し部230は、入力画像の一部分である主要部分を切り出す。この切り出しの処理については、各実施形態に共通のものとしてすでに説明した通りのものであってよい。

図15は、本発明の第2の実施形態に係る情報処理装置300の機能上の構成を示す図である。第2の実施形態は、生成部320において、入力画像の属性に直接的に基づいてヒートマップが生成される例の一つとなっている。

情報処理装置300では、複数の中間ヒートマップの中から少なくとも一の中間ヒートマップが選択される構成となっている。すなわち、服飾の中間ヒートマップと、鞄の中間ヒートマップのいずれかが、図15に模式的にスイッチで示された中間ヒートマップ選択部321によって選択される。かかる選択は属性に基づいて行われ、選択されなかった中間ヒートマップは、生成部320において使用されない。

図15では、属性として「服飾」が与えられているため、服飾の中間ヒートマップが選択され、服飾についての中間ヒートマップが最終的に得られるヒートマップの合成に用いられる一方、鞄についての中間ヒートマップは選択されず、かかる合成には用いられない。なお、同図においては、破線により、鞄についての中間ヒートマップが選択されなかったことを示している。

一方で、CTR及び美的評価値についての中間ヒートマップは属性如何による選択はされず、常に最終的に得られるヒートマップの合成に用いられるものとして構成されている。

かかる構成もまた、情報処理装置300の具体的目的などに応じて調整すればよい。例えば、属性に基づいて選択されることなく常に使用される中間ヒートマップは存在してもしなくともよいし、属性に基づいて選択される中間ヒートマップの数にも制限はない。また、特定の属性に対して、複数の中間ヒートマップを選択するようにしてもよいし、属性ごとに選択される中間ヒートマップの数が異なっていても構わない。

選択された中間ヒートマップを含む、ヒートマップの合成に用いられる中間ヒートマップは、入力画像が入力された機械学習モデル311a~d以下の数となる。これを生成部320において合成し、最終的なヒートマップを得る。この合成の方法は先の実施形態のものと同様であってよい。また、このようにして得られたヒートマップに基づいて、切り出し部330によって、入力画像の一部分である主要部分を切り出すとよい。

図16は、本発明の第3の実施形態に係る情報処理装置400の機能上の構成を示す図である。第3の実施形態は、生成部420において、入力画像の属性に直接的に基づいてヒートマップが生成されるもう一つの例となっている。

情報処理装置400では、複数の中間ヒートマップを生成部420で合成してヒートマップを生成する際に、入力画像の属性に基づく重みを用いる構成となっている。すなわち、入力画像は、原則として、機械学習モデル群410に用意された複数の機械学習モデル411a~411dに入力され、複数の機械学習モデル411a~411dと同数の中間ヒートマップが得られるが、これら中間ヒートマップを合成する際の重みが、属性に応じて異なるものとされるのである。

すなわち、情報処理装置400では、生成部420は、属性に基づいて重みの少なくとも一部を生成している。具体的には、属性が「服飾」であれば、CTR、美的評価値、服飾、鞄についての中間ヒートマップにそれぞれ対応する重みを0.3,0.3,0.3,0.1のように割り振り、属性が「鞄」であれば、同様に、重みを0.3,0.3,0.1,0.3のように割り振るなどである。ここで、属性の項目は必ずしも特定の機械学習モデルに対応するものでなくてもよい。例えば、属性として「ファッションアイテム」を設け、対応する重みを0.3,0.3,0.2,0.2のように割り振ることも可能である。

また、上の説明では、CTR及び美的評価値に対応する中間ヒートマップに対する重みは常に変わらず0.3を割り当てていたが、このように属性に依存せず重みを固定値とする中間ヒートマップに対しては、重みをあらかじめ定数として与えておいてよい。

機械学習モデル群410及び切り出し部430については、先の実施形態においてすでに説明したものと同様のものを用いてよい。

なお、第3の実施形態に係る情報処理装置400において、第1の実施形態に係る情報処理装置200に関して図14で説明したように、機械学習モデル選択部212を設けて、属性に基づいて、入力画像の入力対象として用いられる少なくとも一の機械学習モデルを選択するようにしてもよい。あるいは、第2の実施形態に係る情報処理装置300に関して図15で説明したように、中間ヒートマップ選択部321を設けて、属性に基づいて、少なくとも一の中間ヒートマップを選択して生成部420で用いるようにしてもよいし、その両方の構成を備えるものとすることもできる。

図17は、本発明の各実施形態に係る情報処理装置100~400で実行される情報処理方法の共通の処理フローを示す図である。

かかる情報処理方法においては、まず、ステップS11において、入力画像の入力に対して1又は複数の中間ヒートマップを出力する。かかるステップは、各実施形態に共通のものとして図1に示された機械学習モデル群10により行われるものであり、すでに説明したとおりである。また、各実施形態においては、図14に示された機械学習モデル群210、図15に示された機械学習モデル群310及び図16に示された機械学習モデル群410により実行される処理が該当する。

続いて、ステップS12において、入力画像の属性と中間ヒートマップに基づいてヒートマップを生成する。かかるステップは、各実施形態に共通のものとして図1に示された生成部20により行われるものとして、すでに説明したとおりである。各実施形態においては、図14に示された生成部220、図15に示された生成部320及び図16に示された生成部420により実行される処理が該当する。また、ヒートマップの生成が入力画像の属性に基づいている点に関しては、第1の実施形態においては図14に示した機械学習モデル選択部212による機械学習モデルの選択により、また、第2の実施形態においては図15に示した中間ヒートマップ選択部による中間ヒートマップの選択により、さらに、第3の実施形態においては図16に示した生成部420による重みの決定により、実現されている。

最後に、ステップS13において、ヒートマップに基づいて、入力画像の一部分である主要部分を切り出す。かかるステップは、各実施形態に共通のものとして図1に示された切り出し部30により行われるものとして、すでに説明したとおりであり、各実施形態における切り出し部230、330及び430において実行される処理は同様のものである。

Claims (8)

- 入力画像の入力に対して中間ヒートマップをそれぞれが出力する複数の機械学習モデルと、

前記入力画像の属性及び前記中間ヒートマップに基づいてヒートマップを生成する生成部と、

を有する情報処理装置。 - 前記属性に基づいて、前記複数の機械学習モデルの中から少なくとも一の機械学習モデルを、前記入力画像の入力対象として選択する機械学習モデル選択部を有する、

請求項1に記載の情報処理装置。 - 前記属性に基づいて、前記複数の機械学習モデルに出力された複数の前記中間ヒートマップの中から少なくとも一の中間ヒートマップを選択する中間ヒートマップ選択部を有する、

請求項1に記載の情報処理装置。 - 前記生成部は、複数の前記中間ヒートマップのそれぞれに重みを付け合成してヒートマップを生成する、

請求項1~3のいずれか1項に記載の情報処理装置。 - 前記生成部は、前記属性に基づいて、少なくとも一部の前記重みを決定する、

請求項4に記載の情報処理装置。 - 前記ヒートマップに基づいて、前記入力画像の一部分である主要部分を切り出す切り出し部を有する、

請求項1~5のいずれか1項に記載の情報処理装置。 - 1又は複数の機械学習モデルを用いて入力画像の入力に対して1又は複数の中間ヒートマップを出力する中間ヒートマップ出力ステップと、

前記入力画像の属性及び前記中間ヒートマップに基づいてヒートマップを生成する生成ステップと、

をコンピュータに実行させる情報処理方法。 - コンピュータを、

1又は複数の機械学習モデルを用いて、入力画像の入力に対して1又は複数の中間ヒートマップを出力する出力部と、

前記入力画像の属性及び前記中間ヒートマップに基づいてヒートマップを生成する生成部と、

として機能させる情報処理プログラム。

Priority Applications (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP21950363.8A EP4184432A4 (en) | 2021-09-30 | 2021-09-30 | INFORMATION PROCESSING APPARATUS, INFORMATION PROCESSING METHOD AND INFORMATION PROCESSING PROGRAM |

| PCT/JP2021/036195 WO2023053364A1 (ja) | 2021-09-30 | 2021-09-30 | 情報処理装置、情報処理方法及び情報処理プログラム |

| JP2022557886A JP7395767B2 (ja) | 2021-09-30 | 2021-09-30 | 情報処理装置、情報処理方法及び情報処理プログラム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/JP2021/036195 WO2023053364A1 (ja) | 2021-09-30 | 2021-09-30 | 情報処理装置、情報処理方法及び情報処理プログラム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| WO2023053364A1 true WO2023053364A1 (ja) | 2023-04-06 |

Family

ID=85782009

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| PCT/JP2021/036195 WO2023053364A1 (ja) | 2021-09-30 | 2021-09-30 | 情報処理装置、情報処理方法及び情報処理プログラム |

Country Status (3)

| Country | Link |

|---|---|

| EP (1) | EP4184432A4 (ja) |

| JP (1) | JP7395767B2 (ja) |

| WO (1) | WO2023053364A1 (ja) |

Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2021005301A (ja) * | 2019-06-27 | 2021-01-14 | 株式会社パスコ | 建物抽出処理装置及びプログラム |

| WO2021130856A1 (ja) * | 2019-12-24 | 2021-07-01 | 日本電気株式会社 | 物体識別装置、物体識別方法、学習装置、学習方法、及び、記録媒体 |

Family Cites Families (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2000075889A (ja) | 1998-09-01 | 2000-03-14 | Oki Electric Ind Co Ltd | 音声認識システム及び音声認識方法 |

| US8009921B2 (en) | 2008-02-19 | 2011-08-30 | Xerox Corporation | Context dependent intelligent thumbnail images |

| GB201705876D0 (en) | 2017-04-11 | 2017-05-24 | Kheiron Medical Tech Ltd | Recist |

| JP7149692B2 (ja) | 2017-08-09 | 2022-10-07 | キヤノン株式会社 | 画像処理装置、画像処理方法 |

| US10521927B2 (en) | 2017-08-15 | 2019-12-31 | Siemens Healthcare Gmbh | Internal body marker prediction from surface data in medical imaging |

| CN110930547A (zh) | 2019-02-28 | 2020-03-27 | 上海商汤临港智能科技有限公司 | 车门解锁方法及装置、系统、车、电子设备和存储介质 |

| JP7334432B2 (ja) | 2019-03-15 | 2023-08-29 | オムロン株式会社 | 物体追跡装置、監視システムおよび物体追跡方法 |

| CN111629212B (zh) * | 2020-04-30 | 2023-01-20 | 网宿科技股份有限公司 | 一种对视频进行转码的方法和装置 |

| CN112802034B (zh) * | 2021-02-04 | 2024-04-12 | 精英数智科技股份有限公司 | 图像分割、识别方法、模型构建方法、装置及电子设备 |

-

2021

- 2021-09-30 EP EP21950363.8A patent/EP4184432A4/en active Pending

- 2021-09-30 WO PCT/JP2021/036195 patent/WO2023053364A1/ja active Application Filing

- 2021-09-30 JP JP2022557886A patent/JP7395767B2/ja active Active

Patent Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2021005301A (ja) * | 2019-06-27 | 2021-01-14 | 株式会社パスコ | 建物抽出処理装置及びプログラム |

| WO2021130856A1 (ja) * | 2019-12-24 | 2021-07-01 | 日本電気株式会社 | 物体識別装置、物体識別方法、学習装置、学習方法、及び、記録媒体 |

Non-Patent Citations (2)

| Title |

|---|

| See also references of EP4184432A4 |

| WENGUAN WANGJIANBING SHEN, DEEP CROPPING VIA ATTENTION BOX PREDICTION AND AESTHETICS ASSESSMENT, 13 August 2021 (2021-08-13) |

Also Published As

| Publication number | Publication date |

|---|---|

| JPWO2023053364A1 (ja) | 2023-04-06 |

| EP4184432A4 (en) | 2023-10-11 |

| EP4184432A1 (en) | 2023-05-24 |

| JP7395767B2 (ja) | 2023-12-11 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US9501724B1 (en) | Font recognition and font similarity learning using a deep neural network | |

| JP2019091434A (ja) | 複数のディープ・ラーニング・ニューラル・ネットワークを動的に重み付けすることによるフォント認識の改善 | |

| WO2016054778A1 (en) | Generic object detection in images | |

| CN107784288B (zh) | 一种基于深度神经网络的迭代定位式人脸检测方法 | |

| US8718365B1 (en) | Text recognition for textually sparse images | |

| CN104392241B (zh) | 一种基于混合回归的头部姿态估计方法 | |

| CN111274981B (zh) | 目标检测网络构建方法及装置、目标检测方法 | |

| JP2020166397A (ja) | 画像処理装置、画像処理方法、及びプログラム | |

| Montserrat et al. | Logo detection and recognition with synthetic images | |

| JP2018206252A (ja) | 画像処理システム、評価モデル構築方法、画像処理方法及びプログラム | |

| US20230153965A1 (en) | Image processing method and related device | |

| JP2023527615A (ja) | 目標対象検出モデルのトレーニング方法、目標対象検出方法、機器、電子機器、記憶媒体及びコンピュータプログラム | |

| JP2022185144A (ja) | 対象検出方法、対象検出モデルのレーニング方法および装置 | |

| CN116802683A (zh) | 图像的处理方法和系统 | |

| WO2023053364A1 (ja) | 情報処理装置、情報処理方法及び情報処理プログラム | |

| KR20220080341A (ko) | 비지도 6d 포즈 추정을 위한 3d 대조학습 장치 및 방법 | |

| CN109447021B (zh) | 一种属性检测方法及属性检测装置 | |

| Kumar et al. | Performance analysis of KNN, SVM and ANN techniques for gesture recognition system | |

| KR20200134813A (ko) | 기계 학습을 위한 이미지 처리 장치 및 방법 | |

| JPWO2019241265A5 (ja) | ||

| JP5413156B2 (ja) | 画像処理プログラム及び画像処理装置 | |

| JP7265686B1 (ja) | 情報処理装置、情報処理方法及び情報処理プログラム | |

| JP7265690B2 (ja) | 情報処理装置、情報処理方法及び情報処理プログラム | |

| US11288534B2 (en) | Apparatus and method for image processing for machine learning | |

| KR102636217B1 (ko) | 가중 국소변환을 이용한 3차원 데이터 증강 방법 및 이를 위한 장치 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| WWE | Wipo information: entry into national phase |

Ref document number: 2022557886 Country of ref document: JP |

|

| ENP | Entry into the national phase |

Ref document number: 2021950363 Country of ref document: EP Effective date: 20230123 |