WO2023032954A1 - 情報処理方法、プログラム及び画像診断装置 - Google Patents

情報処理方法、プログラム及び画像診断装置 Download PDFInfo

- Publication number

- WO2023032954A1 WO2023032954A1 PCT/JP2022/032521 JP2022032521W WO2023032954A1 WO 2023032954 A1 WO2023032954 A1 WO 2023032954A1 JP 2022032521 W JP2022032521 W JP 2022032521W WO 2023032954 A1 WO2023032954 A1 WO 2023032954A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- point

- image

- degree

- line

- region

- Prior art date

Links

- 230000010365 information processing Effects 0.000 title claims abstract description 22

- 238000003672 processing method Methods 0.000 title claims abstract description 19

- 238000003745 diagnosis Methods 0.000 title description 9

- 210000000481 breast Anatomy 0.000 claims abstract description 54

- 238000003384 imaging method Methods 0.000 claims abstract description 37

- 238000002059 diagnostic imaging Methods 0.000 claims description 65

- 238000000034 method Methods 0.000 claims description 34

- 239000000284 extract Substances 0.000 claims description 18

- 238000010276 construction Methods 0.000 claims description 15

- 238000000605 extraction Methods 0.000 claims description 14

- 210000003205 muscle Anatomy 0.000 claims description 8

- 210000000062 pectoralis major Anatomy 0.000 claims description 8

- 238000010606 normalization Methods 0.000 claims description 6

- 238000004364 calculation method Methods 0.000 claims description 3

- 238000009499 grossing Methods 0.000 claims description 3

- 230000007423 decrease Effects 0.000 claims description 2

- 238000012545 processing Methods 0.000 abstract description 55

- 238000001514 detection method Methods 0.000 description 78

- 238000010586 diagram Methods 0.000 description 21

- 238000012549 training Methods 0.000 description 18

- 230000006870 function Effects 0.000 description 16

- 210000005075 mammary gland Anatomy 0.000 description 16

- 238000004891 communication Methods 0.000 description 11

- 230000003902 lesion Effects 0.000 description 8

- 210000001519 tissue Anatomy 0.000 description 8

- 238000002604 ultrasonography Methods 0.000 description 8

- 238000002591 computed tomography Methods 0.000 description 6

- 238000012937 correction Methods 0.000 description 6

- 238000010801 machine learning Methods 0.000 description 6

- 238000012986 modification Methods 0.000 description 6

- 230000004048 modification Effects 0.000 description 6

- 210000002445 nipple Anatomy 0.000 description 6

- 206010028980 Neoplasm Diseases 0.000 description 4

- 230000005540 biological transmission Effects 0.000 description 4

- 238000013527 convolutional neural network Methods 0.000 description 4

- 238000009607 mammography Methods 0.000 description 4

- XLYOFNOQVPJJNP-UHFFFAOYSA-N water Substances O XLYOFNOQVPJJNP-UHFFFAOYSA-N 0.000 description 4

- 206010006187 Breast cancer Diseases 0.000 description 3

- 208000026310 Breast neoplasm Diseases 0.000 description 3

- 238000013528 artificial neural network Methods 0.000 description 3

- 238000004040 coloring Methods 0.000 description 3

- 239000012141 concentrate Substances 0.000 description 3

- 208000037265 diseases, disorders, signs and symptoms Diseases 0.000 description 3

- 238000007781 pre-processing Methods 0.000 description 3

- 238000001914 filtration Methods 0.000 description 2

- 230000012447 hatching Effects 0.000 description 2

- 210000002569 neuron Anatomy 0.000 description 2

- 238000012706 support-vector machine Methods 0.000 description 2

- 238000012935 Averaging Methods 0.000 description 1

- 230000002159 abnormal effect Effects 0.000 description 1

- 238000013459 approach Methods 0.000 description 1

- 238000004422 calculation algorithm Methods 0.000 description 1

- 238000003066 decision tree Methods 0.000 description 1

- 238000013135 deep learning Methods 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 230000005484 gravity Effects 0.000 description 1

- 238000007689 inspection Methods 0.000 description 1

- 230000010354 integration Effects 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- 239000000203 mixture Substances 0.000 description 1

- 238000012821 model calculation Methods 0.000 description 1

- 230000002093 peripheral effect Effects 0.000 description 1

- 238000007637 random forest analysis Methods 0.000 description 1

- 230000003068 static effect Effects 0.000 description 1

Images

Classifications

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B8/00—Diagnosis using ultrasonic, sonic or infrasonic waves

- A61B8/08—Clinical applications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

Definitions

- the present invention relates to an information processing method, a program, and an image diagnosis apparatus in ultrasound image diagnosis.

- a diagnostic system using non-invasive ultrasound is widely used in the medical field as a technology for diagnosing information inside a subject because it does not require a surgical operation that involves direct incision and observation of the living body.

- Ultrasound CT Computed Tomography

- a method of ultrasonic diagnosis irradiates the subject with ultrasonic waves and creates a tomographic image of the subject using scattered waves and transmitted waves.

- Patent Literature 1 a large number of ultrasonic transducers for transmission and reception are arranged in a ring shape so as to surround a subject, and three-dimensional imaging is automatically performed while moving the transducer vertically.

- the acquired tomographic image is interpreted by a diagnostician.

- a doctor makes a diagnosis by detecting predetermined diagnostic imaging findings.

- As a device to support image interpretation it acquires inspection images from a medical imaging device, detects abnormal areas such as tumors in the images through image processing and machine learning processing, and supports image diagnosis by presenting them to doctors.

- a diagnostic support device has been developed to

- a normal construction model representing the normal structure (direction) of the mammary gland from the nipple inside the breast to the pectoralis major muscle is calculated from the mammary X-ray image, and a Gabor Filter is applied to the mammary X-ray image. is applied to extract the direction of the mammary gland, and by comparing the direction of the original normal mammary gland with the extracted mammary gland direction, it is possible to determine whether there is disorder in mammary gland architecture.

- Breast image lesion detection Systems and the like are disclosed.

- Disordered mammary gland architecture is one of the imaging findings of breast cancer, and the spicule structure observed when tissue around the tumor concentrates on the tumor serves as one indicator for detection.

- Tomographic imaging by ultrasonic CT has the characteristics of a scattered image using reflected waves obtained by a conventional handheld ultrasonic device, and can acquire a 3D volumetric image of the entire target site like X-ray CT. .

- diagnostic imaging findings for breast cancer look different depending on the type of imaging device. For example, the mammary glands and lesions appear white in X-ray mammography, but the mammary glands are white and the lesions are dark in ultrasound images.

- the reflected wave image obtained by the existing handheld ultrasonic device part of the surrounding tissue cannot be observed due to the posterior shadow of the lesion, but in the ultrasonic CT, the whole structure of the surrounding tissue of the lesion can be imaged.

- ultrasonic waves are transmitted to the lesion from one side, so the opposite side of the lesion is shadowed when viewed from the transmitting array. because it cancels out. Therefore, in ultrasonic CT images, it is desired to have a diagnostic support function for easily identifying diagnostic findings corresponding to diagnostic findings in existing diagnostic images.

- An object of one aspect is to provide an information processing method and the like that can suitably identify structural disturbances such as spicules in three-dimensional ultrasonic imaging.

- An information processing method acquires a plurality of frame images obtained by imaging a cross section of a breast at a plurality of positions, calculates a line concentration degree indicating the degree of concentration of line structures for each point in each frame image, extracting from each of the frame images an area where the degree of line concentration is greater than or equal to a certain level, and determining whether or not the construction disturbance in each of the frame images is a false positive according to the amount of movement of the extracted area between the frame images;

- the computer executes the process of determining

- FIG. 1 is a block diagram showing a configuration example of an image processing apparatus;

- FIG. FIG. 4 is an explanatory diagram showing an outline of a detection model;

- FIG. 10 is an explanatory diagram regarding false positive determination processing;

- FIG. 4 is an explanatory diagram showing a process of calculating a line concentration degree;

- FIG. 10 is an explanatory diagram showing a process of calculating a line concentration degree according to the distance between a point of interest and each point;

- FIG. 10 is an explanatory diagram relating to correction processing of the line concentration degree according to the directional distribution;

- FIG. 10 is an explanatory diagram relating to center bias correction processing;

- FIG. 11 is an explanatory diagram showing a display screen of a spicule detection result; 7 is a flow chart showing the procedure of detection model generation processing. 4 is a flowchart showing the procedure of spicule detection processing; FIG. 10 is an explanatory diagram showing another example of the process of calculating the degree of line concentration; FIG. 11 is a flowchart showing another example of the procedure of spicule detection processing; FIG.

- FIG. 1 is an explanatory diagram showing a configuration example of a diagnostic imaging system.

- an image diagnostic system for detecting spicules (arrangement disorder) from an image obtained by imaging a cross-section of a subject's breast will be described.

- the diagnostic imaging system includes a server 1 and a diagnostic imaging device 2 .

- the server 1 and the diagnostic imaging apparatus 2 are connected via a network N for communication.

- a breast is given as an example of a body part targeted for image diagnosis, but other body parts may be used.

- the event to be detected may be a disturbance in the architecture of the mammary gland, and the disturbance in the architecture is not limited to what is called a spicula.

- the server 1 is a server computer capable of various information processing and transmission/reception of information.

- a device corresponding to the server 1 is not limited to a server computer, and may be, for example, a personal computer.

- the server 1 performs machine learning to learn predetermined training data, so that when a plurality of frame images obtained by imaging a cross-section of the breast at a plurality of positions is input, an area with spicules (hereinafter referred to as " It functions as a generation device that generates a detection model 50 (see FIG. 4) for detecting the "spicule region".

- the data of the detection model 50 generated by the server 1 is installed in the diagnostic imaging apparatus 2, and the diagnostic imaging apparatus 2 uses the detection model 50 to detect the spicule region from the captured image.

- the diagnostic imaging apparatus 2 is an imaging diagnostic apparatus for ultrasonic echo examination, and includes an image processing device 20 and an imaging device 30 .

- the image processing apparatus 20 is a computer that functions as a console for the diagnostic imaging apparatus 2, and generates (reconstructs) and displays an ultrasound image of a breast section. Note that the image processing apparatus 20 is not limited to a computer (console) for ultrasonic image diagnosis, and may be a general-purpose computer such as a personal computer.

- the imaging device 30 is an imaging device that transmits and receives ultrasonic signals. As shown in FIG. 1, the imaging device 30 is configured to be able to image the breast of the subject lying face down. Specifically, the imaging device 30 has a bed-like shape, and a top plate 31 is provided with a hole 32 for inserting a breast. A water tank 33 is provided below the hole 32 , and the subject inserts the breast into the water tank 33 through the hole 32 .

- a ring array 34 is provided in the water tank 33 .

- the ring array 34 is a ring-shaped transducer array including a plurality of ultrasonic elements (transducers).

- a plurality of ultrasonic elements are arranged at equal intervals in the ring array 34, and each ultrasonic element transmits an ultrasonic signal and receives a reflected wave.

- the image processing apparatus 20 reconstructs reflected wave data in a plurality of directions obtained from each ultrasonic element to generate an ultrasonic image (frame image) of one section. Since the intensity of the reflected wave signal varies depending on the difference in acoustic impedance that occurs at the tissue boundary, the reconstructed reflected wave image expresses tissue and lesion boundary information and tissue density in terms of brightness.

- the ring array 34 is configured to be vertically movable, and the diagnostic imaging apparatus 2 vertically moves the ring array 34 to capture ultrasound images at each position (height) of the breast.

- the ultrasonic diagnostic system described in Cited Document 1 can be adopted as the diagnostic imaging apparatus 2 according to the present embodiment.

- the diagnostic imaging apparatus 2 is not limited to the above configuration.

- an image diagnostic device using a handy scanner may be used instead of the bed-type imaging device 30, an image diagnostic device using a handy scanner.

- ultrasound images are used as images of the breast, but images of other modalities such as X-ray images (mammography, etc.) may be used.

- This is an apparatus for acquiring a plurality of frame images obtained by imaging a cross section of a subject at a plurality of positions, and for imaging a continuous biological structure, wherein the slice images of the XY plane are continuously reconstructed on the third axis. Any three-dimensional medical image that

- the imaging device 2 uses the imaging device 30 to image a cross-section of the breast that is substantially perpendicular to the direction from the nipple to the pectoralis major muscle.

- the image diagnostic apparatus 2 uses the above-described detection model 50 to detect a spicule region in which mammary gland architecture is disturbed from a captured image.

- the image diagnostic apparatus 2 detects the spicule region by inputting to the detection model 50 three-dimensional volume data composed of frame images obtained by imaging a cross section of the breast at a plurality of positions. By inputting a plurality of frame images as one piece of data to the detection model 50, it is possible to detect the spicule region while referring to the information of the preceding and succeeding frames.

- the image diagnostic apparatus 2 determines whether the detection result of the spicule region by the detection model 50 is valid, that is, whether it is false positive, as will be described later. Specifically, the image diagnostic apparatus 2 calculates a line concentration degree indicating the degree of concentration of line structures for each point in each frame image. Then, the image diagnostic apparatus 2 determines whether or not the spicule region detected by the detection model 50 is a false positive, according to the amount of movement between frames of the region with a certain degree of line concentration or more.

- the server 1 generates (learns) the detection model 50, but the local diagnostic imaging apparatus 2 may generate the detection model 50.

- the diagnostic imaging apparatus 2 detects the spicule region and determines the false positive, but the server 1 on the cloud may perform the processing. In other words, the distinction between the two is for convenience, and a single computer may perform a series of processes.

- a cross section of the breast that is substantially perpendicular to the direction from the nipple to the pectoralis major muscle is imaged, but cross sections in other directions (eg, sagittal cross section, axial cross section) are imaged.

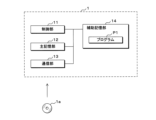

- FIG. 2 is a block diagram showing a configuration example of the server 1.

- the server 1 includes a control section 11 , a main storage section 12 , a communication section 13 and an auxiliary storage section 14 .

- the control unit 11 has a processor such as one or more CPU (Central Processing Unit), MPU (Micro-Processing Unit), GPU (Graphics Processing Unit), etc., and reads out the program P1 stored in the auxiliary storage unit 14. By executing it, various information processing is performed.

- the main storage unit 12 is a temporary storage area such as SRAM (Static Random Access Memory), DRAM (Dynamic Random Access Memory), etc., and temporarily stores data necessary for the control unit 11 to execute arithmetic processing.

- the communication unit 13 is a communication module for performing processing related to communication, and transmits and receives information to and from the outside.

- the auxiliary storage unit 14 is a non-volatile storage area such as a large-capacity memory or hard disk, and stores a program P1 and other data necessary for the control unit 11 to execute processing.

- the auxiliary storage unit 14 may be an external storage device connected to the server 1.

- the server 1 may be a multicomputer consisting of a plurality of computers, or may be a virtual machine virtually constructed by software.

- the server 1 is not limited to the configuration described above, and may include, for example, an input unit for receiving operation inputs, a display unit for displaying images, and the like.

- the server 1 may also include a reader for reading a non-temporary computer-readable recording medium 1a, and read the program P1 from the recording medium 1a.

- the program P1 may be executed on a single computer, or may be executed on a plurality of computers interconnected via a network N.

- FIG. 3 is a block diagram showing a configuration example of the image processing device 20.

- the image processing apparatus 20 includes a control section 21 , a main storage section 22 , a communication section 23 , a display section 24 , an input section 25 , a transmission/reception section 26 , an image processing section 27 and an auxiliary storage section 28 .

- the control unit 21 has one or more processors such as CPUs, and performs various information processing by reading and executing the program P2 stored in the auxiliary storage unit 28 .

- the main storage unit 22 is a temporary storage area such as a RAM, and temporarily stores data necessary for the control unit 21 to execute arithmetic processing.

- the communication unit 23 is a communication module for performing processing related to communication, and transmits and receives information to and from the outside.

- the display unit 24 is a display screen such as a liquid crystal display, and displays images.

- the input unit 25 is an operation interface such as a keyboard and a mouse, and receives operation input from the user.

- the transmitter/receiver 26 controls the ultrasonic elements of the ring array 34 and transmits/receives ultrasonic signals.

- the image processing unit 27 is a module that performs image processing, reconstructs reflected wave data received by the ultrasonic element, and generates an ultrasonic image.

- the auxiliary storage unit 28 is a non-volatile storage area such as a hard disk or large-capacity memory, and stores the program P2 and other data necessary for the control unit 21 to execute processing.

- the auxiliary storage unit 28 also stores a detection model 50 .

- the detection model 50 is a machine learning model that has already learned predetermined training data, and has been trained to detect a spicule region in which structural disturbance occurs when three-dimensional volume data consisting of a plurality of frame images is input. is a model of The detection model 50 is assumed to be used as a program module forming part of artificial intelligence software.

- the image processing apparatus 20 may include a reading unit that reads the non-temporary computer-readable recording medium 2a, and may read the program P2 from the recording medium 2a. Also, the program P2 may be executed on a single computer, or may be executed on a plurality of computers interconnected via a network N.

- FIG. 4 is an explanatory diagram showing an overview of the detection model 50. FIG. The outline of this embodiment will be described below.

- FIG. 4 illustrates how a spicule region is detected when a plurality of frame images obtained by imaging cross sections of a breast at a plurality of positions are input to the detection model 50 .

- the detection model 50 is a trained model that detects a spicule area when three-dimensional volume data consisting of a plurality of frame images is input.

- the detection model 50 is a neural network generated by deep learning, and is a Faster R-CNN, which is a type of CNN (Convolution Neural Network).

- the detection model 50 may be a neural network other than Faster R-CNN. Also, the detection model 50 may be a model based on other learning algorithms such as a decision tree, random forest, SVM (Support Vector Machine), or the like.

- the server 1 generates the detection model 50 by using the training data labeled with the correct spicule region for the training 3D volume data group.

- the three-dimensional volume data is image data obtained by imaging the breast of the subject with the imaging device 30, and is a group of frame images obtained by imaging cross sections of the breast at a plurality of positions.

- the server 1 uses, as a three-dimensional volume data group for training, a group of frame images obtained by imaging the breasts of each of a plurality of subjects along one direction (the direction from the nipple to the pectoralis major muscle).

- the label given to the three-dimensional volume data is data indicating the correct coordinate range of the spicule area, and is a label set by a medical professional (doctor, etc.) so as to surround the spicule area for each frame image, for example. .

- the server 1 generates a detection model 50 using training data labeled with a spicule area for each frame image that constitutes the three-dimensional volume data.

- the server 1 generates a detection model 50 that detects a spicule region from three-dimensional volume data by providing the detection model 50 with a plurality of frame images as one input data set. That is, the server 1 uses three-dimensional data obtained by arranging each two-dimensional frame image along the imaging position (the height of the ring array 34) as an input for the detection model 50, as shown on the left side of FIG. This makes it possible to detect the spicule area in each frame image by referring to the features (construction disturbance) of the preceding and succeeding frame images.

- the detection model 50 When three-dimensional volume data is input, the detection model 50 outputs the detection result of the spicule region. Specifically, the detection model 50 outputs a rectangular bounding box surrounding the spicule region and a mask representing the inside of the boundary of the spicule region for each frame image. Since the detection model 50 according to the present embodiment is Faster R-CNN, the detection model 50 outputs both the bounding box and the mask, but the detection model 50 outputs only one of them. good too.

- the server 1 detects the spicule region by inputting the training 3D volume data into the detection model 50 .

- the server 1 compares the detected spicule region with the correct label, and updates parameters such as weights between neurons so that the two approximate each other.

- the server 1 sequentially inputs each piece of three-dimensional volume data for training to the detection model 50 to update the parameters, and finally generates the detection model 50 with optimized parameters.

- the data of the detection model 50 generated by the server 1 is installed in the diagnostic imaging apparatus 2 .

- the diagnostic imaging device 2 uses the detection model 50 to detect the spicule region. That is, the image diagnostic apparatus 2 detects the spicule region by inputting three-dimensional volume data composed of a plurality of frame images into the detection model 50 .

- FIG. 5 is an explanatory diagram regarding false positive determination processing.

- the diagnostic imaging apparatus 2 determines whether or not the detection result of the spicule region by the detection model 50 is valid, that is, whether or not it is false positive, based on the amount of movement between frames of the region where line structures are concentrated. Judge accordingly.

- the image diagnostic apparatus 2 calculates the degree of line concentration at each point in each frame image, and determines how much the region having the calculated degree of line concentration above a certain level moves between frames. Calculate When the image diagnostic apparatus 2 determines that the amount of movement is equal to or greater than a predetermined threshold value, the image diagnostic apparatus 2 determines that the spicule region corresponding to that region is false positive.

- FIG. 5 a map representing the degree of line concentration of each point in a frame image (hereinafter referred to as a “line concentration degree map”) is shown on the left side, and the movement path between frames of areas where the degree of line concentration is equal to or greater than a certain level is shown. Frame images are shown on the right. Based on FIG. 5, the outline of the false positive determination process will be described.

- the diagnostic imaging apparatus 2 calculates the degree of line concentration of each point in the frame image for each frame image.

- the line convergence degree is a numerical value indicating the degree of concentration of line structures.

- a line structure is a linear structure (edge) that appears in a frame image, and corresponds to a linear tissue such as a mammary gland. Since spicules are concentrated in tumors in peripheral tissues such as mammary glands, it is possible to extract a region that is strongly suspected to be spicules depending on the degree of line concentration.

- the diagnostic imaging apparatus 2 calculates the degree of line concentration by applying a predetermined image filter to the frame image.

- the diagnostic imaging apparatus 2 uses a Gabor filter for extracting a specific direction component from an image as an image filter.

- the filter function g(x, y) of the Gabor filter is defined by the following equation (1).

- ⁇ x and ⁇ y represent the standard deviation of the Gaussian function

- f 0 represents the frequency of the trigonometric function. Since the Gabor filter (filter function g) itself is not much different from a known one, detailed description is omitted in this embodiment.

- the diagnostic imaging apparatus 2 applies the Gabor filter to the frame image to extract the direction and intensity of the line structure at each point in the frame image.

- the image diagnostic apparatus 2 applies a plurality of Gabor filters with different extraction directions ⁇ (Orientation) to the frame image, and extracts the filter function g(x, y) corresponding to each direction ⁇ and the A direct product h(x, y) with the pixel value f(x, y) is calculated.

- the image diagnostic apparatus 2 extracts the maximum value of h(x, y) as the strength of the line structure, and extracts the direction ⁇ in which h(x, y) is maximum as the direction of the line structure.

- the diagnostic imaging apparatus 2 has 8 angles of 0°, 22.5°, 45°, .

- a directional Gabor filter is provided.

- the diagnostic imaging apparatus 2 extracts the direction and intensity of the line structure by applying eight types of Gabor filters to one frame image.

- the diagnostic imaging apparatus 2 calculates the degree of line concentration of each point (each point of interest) in the frame image based on the direction and intensity of the line structure extracted above. A specific method for calculating the degree of line concentration will be described later.

- the diagnostic imaging apparatus 2 generates a line-concentration degree map representing the line-concentration degree of each point, as shown on the left side of FIG.

- the actual line concentration map is represented by a heat map in which the value of each point (pixel) changes continuously, in FIG. , and other portions are shown in white.

- the diagnostic imaging apparatus 2 extracts a region with a certain or higher line concentration degree from the generated line concentration degree map. That is, the diagnostic imaging apparatus 2 extracts a region where there is a high possibility that spicules (disordered construction) have occurred.

- the diagnostic imaging apparatus 2 determines whether or not the spicule region detected by the detection model 50 is false positive according to the amount of movement of the extracted region between frames. Specifically, the image diagnostic apparatus 2 identifies the center (center of gravity) coordinates of an area where the degree of line concentration is equal to or greater than a certain value from each frame image, and determines the moving distance and/or moving speed between frames of the identified center Accordingly, it is determined whether the spicule region is a false positive.

- the moving path of the center of the area where the degree of line concentration is equal to or higher than a certain value is illustrated by a polygonal line.

- the image diagnostic apparatus 2 extracts a predetermined number of continuous frame images, and averages the total moving distance (total length of polygonal line) of the center from the first frame to the last frame and/or the moving speed between two adjacent frames. Calculate the value.

- the image diagnostic apparatus 2 determines whether or not the calculated moving distance and/or moving speed are equal to or greater than a predetermined threshold. If the moving distance and/or moving speed are equal to or greater than the threshold, the diagnostic imaging apparatus 2 determines that the result is false positive. If the moving distance and/or moving speed are less than the threshold, the diagnostic imaging apparatus 2 determines positive.

- the diagnostic imaging apparatus 2 compares the spicule region detected by the detection model 50 with regions where the degree of line concentration is equal to or greater than a certain value, and identifies the latter region that overlaps with the spicule region.

- the image diagnostic apparatus 2 determines whether or not the spicule region is false positive according to the amount of movement of the specified region. For example, the diagnostic imaging apparatus 2 outputs (displays) the spicule region determined as not false-positive as the final detection result of the spicule region (see FIG. 10). Note that the image diagnostic apparatus 2 may output the spicule region determined to be false positive so as to be identifiable from the spicule region determined not to be false positive.

- erroneous detection can be reduced by judging an area with a movement amount equal to or greater than a threshold value as a false positive. For example, when applying a learner trained with a data set in which the average and median values of the amount of movement are 10 mm or less when the slice interval is 1 mm, a spicule with a movement amount of 10 mm or more at a slice interval of 1 mm is false. Determine positive.

- FIG. 6 is an explanatory diagram showing the process of calculating the degree of line concentration.

- FIG. 6 conceptually illustrates the process of calculating the line concentration degree according to the present embodiment.

- the image diagnostic apparatus 2 performs several processes on the line structure extraction result by the Gabor filter and then calculates the line concentration degree for the purpose of detecting spicules. A method for calculating the degree of line concentration will be described with reference to FIG.

- the diagnostic imaging apparatus 2 extracts the direction (Orientation) and strength (Magnitude) of the line structure at each point in the frame image from each frame image.

- an intensity map (intensity distribution) and a direction map (direction distribution) of the line structure in the frame image are generated as shown in the second row from the top of FIG.

- the actual intensity map and direction map are represented by heat maps, in FIG. 6, the intensity of the line structure is shown by a line and the direction of the line structure is shown by an arrow for convenience.

- the diagnostic imaging apparatus 2 performs predetermined preprocessing on the intensity map. Specifically, for each point (pixel) in the frame image, the image diagnostic apparatus 2 calculates the average value of the intensity of each point and the intensity of the surrounding points of each point. and the intensity of For example, the diagnostic imaging apparatus 2 uses the average intensity of 6 ⁇ 6 points (pixels) including the target point as the intensity of each target point.

- the diagnostic imaging apparatus 2 binarizes the intensity of each point according to whether the averaged intensity of each point is equal to or greater than a predetermined threshold. Specifically, the diagnostic imaging apparatus 2 sets a threshold from the intensity distribution of the entire frame image using the Otsu Method, sets the intensity of points above the threshold to "1", and assigns the intensity of points below the threshold to "1". Set to '0'. Note that the values to be binarized are not limited to “1” and “0”, and may be different values depending on whether they are equal to or greater than the threshold.

- the diagnostic imaging apparatus 2 calculates the product of the binarized intensity of each point and the direction of each point. That is, the diagnostic imaging apparatus 2 generates a new map by multiplying the binarized intensity map shown in FIG. 6 by the direction map. Since the intensity is binarized, the map means a directional distribution in which line structures of points with intensities below the threshold are reduced (abstracted) and line structures with intensities above the threshold are emphasized.

- the product of the binarized intensity and direction is referred to as the "Masked Orientation" in the sense of the direction in which the line structure whose intensity is less than the threshold is reduced (abstracted).

- the diagnostic imaging apparatus 2 generates a mask direction map (distribution of mask direction) that emphasizes line structures whose intensity is equal to or greater than the threshold.

- the diagnostic imaging apparatus 2 generates the final line concentration degree map shown in the bottom of FIG. 6 based on the generated mask direction map.

- the mask direction is extracted by taking the product of the direction of the line structure and the intensity, and the line concentration degree is calculated from the distribution of the mask direction.

- the line concentration degree may be calculated from the directional distribution of line structures obtained primarily. That is, the diagnostic imaging apparatus 2 only needs to be able to extract at least the direction of the line structure from the frame image and calculate the line concentration degree based on the direction of the extracted line structure. is not essential.

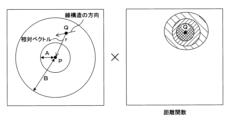

- FIG. 7 is an explanatory diagram showing the process of calculating the line concentration degree according to the distance between the point of interest and each point. Based on FIG. 7, the details of processing when calculating the degree of line concentration from the mask direction will be described.

- the image diagnostic apparatus 2 takes each point in the frame image as a point of interest, and obtains a relative vector connecting the point of interest and each point other than the point of interest.

- the diagnostic imaging apparatus 2 calculates the line concentration degree by taking the inner product value of the relative vector and the mask direction (line structure direction) at another point that is the starting point of the relative vector.

- the diagnostic imaging apparatus 2 selects a point Q within a certain distance from the target point P, specifically, from a predetermined inner diameter A to an outer diameter B

- the line concentration is calculated based on the mask direction at the point Q within the range of .

- the image diagnostic apparatus 2 obtains a relative vector between the target point P and the point Q, and calculates an inner product value of the relative vector and the mask direction at the point Q.

- FIG. The diagnostic imaging apparatus 2 calculates the inner product values for all the points Q within the range from the inner diameter A to the outer diameter B, and calculates the average value of the inner product values for each point Q.

- FIG. The image diagnostic apparatus 2 uses the calculated average value as the line concentration degree of the target point P.

- the image diagnostic apparatus 2 when calculating the degree of line concentration as described above, the image diagnostic apparatus 2 weights the inner product value of each point Q so that line structures closer to the point of interest P are more important. I do. Specifically, when calculating the inner product value of the relative vector and the mask direction for each point Q, the image diagnostic apparatus 2 multiplies the value by a distance function d(r) that increases as the distance r from the point Q decreases. Thus, weighting is performed.

- the distance function d(r) is defined, for example, by Equation (2) below.

- ⁇ in formula (2) is a constant.

- the image diagnostic apparatus 2 multiplies the distance function d(r), which is designed to increase as the distance r is shorter, to calculate the line concentration degree with more emphasis placed on the line structure closer to the target point P. make it

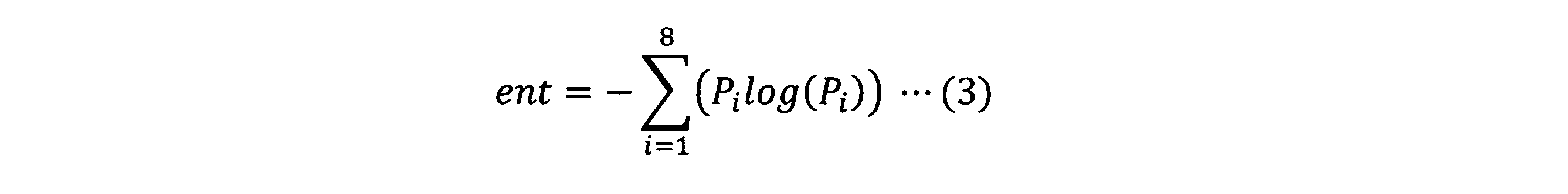

- FIG. 8 is an explanatory diagram relating to correction processing of the line concentration degree according to the directional distribution.

- the image diagnostic apparatus 2 performs weighting according to the variation (distribution) of line structures toward the point of interest in order to extract an area where line structures are concentrated from all directions. Specifically, the image diagnostic apparatus 2 calculates an index value for evaluating the degree to which the line structures directed toward the point of interest are evenly distributed in all directions (a plurality of directions), and determines whether the calculated index value is large or small. corrects the line convergence according to

- the diagnostic imaging apparatus 2 corrects the degree of line concentration of the target point P according to the calculated entropy. Specifically, the diagnostic imaging apparatus 2 corrects the line concentration to be higher as the entropy is larger.

- index value is not limited to this, and may be another value (for example, the average value of probability values Pi ).

- FIG. 9 is an explanatory diagram relating to center bias correction processing.

- the image diagnostic apparatus 2 further performs correction in order to reduce the influence of a tendency (bias) in which line structures such as mammary glands concentrate toward the center of the breast in a region closer to the center of the breast.

- bias a tendency in which line structures such as mammary glands concentrate toward the center of the breast in a region closer to the center of the breast.

- the diagnostic imaging apparatus 2 images a cross section that is substantially perpendicular to the direction from the papilla to the pectoralis major muscle.

- the mammary glands radiate from the nipple toward the circumference, in the image captured by the imaging device 30, line structures naturally concentrate toward the center of the breast regardless of the presence or absence of spicules. It will be.

- spicule detection based on line convergence without correction produces many false positives in the central region of the breast. Therefore, the image diagnostic apparatus 2 performs the following processing in order to reduce the influence of line structures concentrating on the center of the breast.

- the diagnostic imaging apparatus 2 normalizes the line concentration degree so that the line concentration degree is constant (for example, 1) when the line structure faces the point of interest at all points.

- the image diagnostic apparatus 2 first detects the boundary between the breast and the area other than the breast from the frame image, and generates a map (upper left) in which the breast and the area other than the breast are binarized.

- the image diagnostic apparatus 2 multiplies (weights) this map by a predetermined distance function so that the map becomes higher as it approaches the center of the breast. Generate a map for customization (upper right).

- the diagnostic imaging apparatus 2 normalizes the line concentration degree by dividing the line concentration degree map (bottom left) by the generated normalization map. That is, the image diagnostic apparatus 2 corrects the line concentration degree by dividing the line concentration degree of each point in the line concentration degree map by the value of each point in the normalization map. As a result, the value is normalized to 1 when the line structure faces the point of interest at all points, and the influence of the center bias is reduced.

- the diagnostic imaging apparatus 2 performs certain processing on the extraction result of the Gabor filter in accordance with the spicule detection, and then calculates the degree of line concentration. As described with reference to FIG. 5, the diagnostic imaging apparatus 2 extracts from the line-concentration degree map a region having a line-concentration degree greater than or equal to a certain level, and the spicules detected by the detection model 50 are calculated according to the amount of movement of the region between frames. Determine if the region is a false positive.

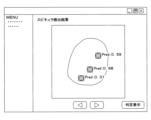

- FIG. 10 is an explanatory diagram showing the display screen of the spicule detection result.

- the image diagnostic apparatus 2 displays the screen illustrated in FIG. 10 .

- the image diagnostic apparatus 2 displays a breast image on which a label representing the spicule area is superimposed on the screen. Specifically, the image diagnostic apparatus 2 displays a frame image in which a bounding box surrounding the spicule region and a translucent mask for coloring the inside of the spicule region are superimposed. In FIG. 10, for the sake of convenience, the state in which the spicule area is colored is illustrated by hatching. The diagnostic imaging apparatus 2 superimposes a bounding box and a mask on the spicule regions detected by the detection model 50, excluding the spicule regions determined as false positives.

- the image diagnostic apparatus 2 displays a probability value (indicated by "Pred” in FIG. 10) representing the probability of the detection result of the spicule region, output from the detection model 50, in association with each spicule region. Furthermore, the diagnostic imaging apparatus 2 highlights spicule regions with probability values equal to or greater than a predetermined value (eg, 90% or greater). For example, as shown in FIG. 10, the diagnostic imaging apparatus 2 thickens the bounding box corresponding to the spicule region whose probability value is greater than or equal to a predetermined value, and changes the mask color of the spicule region. For example, the image diagnostic apparatus 2 displays a change button 101 at the bottom of the screen, and switches to another frame image according to an operation input to the change button 101 .

- a predetermined value eg, 90% or greater

- the image diagnostic apparatus 2 displays a display button 102 for displaying the positive/false positive judgment result of the spicule area on the screen.

- the diagnostic imaging apparatus 2 displays the positive/false positive determination result of the spicule region based on the line concentration degree on the breast image.

- the image diagnostic apparatus 2 superimposes and displays the movement path object (folded line) illustrated on the right side of FIG. 5 on the breast image illustrated on the right side of FIG.

- the image diagnostic apparatus 2 displays the inter-frame movement path of the area where the degree of line concentration is equal to or greater than a certain value.

- a medical professional who browses breast images can objectively determine why the labeled region was determined as positive and why the other regions were determined as false positive.

- the image diagnostic apparatus 2 determines the display mode of the object (for example, line color) may be changed.

- two-dimensional frame images are displayed as final detection results. may be generated and a label representing the spicule area may be superimposed on the three-dimensional image.

- the image diagnostic apparatus 2 superimposes a grid-shaped bounding box surrounding the three-dimensional spicule region and superimposes a three-dimensional mask for coloring the spicule region.

- the image diagnostic apparatus 2 only needs to be able to display breast images on which labels representing spicule regions are superimposed based on captured images (a plurality of frame images), and the breast images are not limited to two-dimensional frame images. .

- a spicule region is detected from a plurality of frame images, and whether or not the spicule region is a false positive is determined according to the amount of movement between frames of a region with a high degree of line concentration. judge.

- the spicule region is a false positive is determined according to the amount of movement between frames of a region with a high degree of line concentration. judge.

- the diagnostic imaging apparatus 2 uses a machine learning model (detection model 50) as means for detecting the spicule region, but the spicule region may be detected based on rules.

- the diagnostic imaging apparatus 2 may detect a region having a certain degree of line concentration or more as a spicule region.

- the diagnostic imaging apparatus 2 determines whether or not the spicule region detected by its own device is a false positive. It may be determined whether or not the spicule region designated by (medical worker) is a false positive. That is, the image diagnostic apparatus 2 only needs to be able to determine whether or not the spicule region (construction disorder) in each frame image is a false positive, and the configuration for detecting the spicule region to be determined is not essential. .

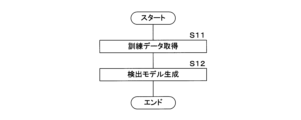

- FIG. 11 is a flow chart showing the procedure of generation processing of the detection model 50 . Based on FIG. 11, processing for generating the detection model 50 by machine learning will be described.

- the control unit 11 of the server 1 acquires training data to which a label representing a correct spicule region is added to a group of three-dimensional volume data for training (step S11).

- the three-dimensional volume data for training is a group of frame images obtained by imaging cross-sections of the subject's breast at a plurality of positions.

- the control unit 11 acquires training data in which a label representing the correct coordinate range of the spicule area is assigned to each frame image that constitutes the three-dimensional volume data.

- the control unit 11 Based on the training data, the control unit 11 generates a detection model 50 that detects a spicule area in which construction is disturbed when three-dimensional volume data consisting of a plurality of frame images is input (step S12). For example, the control unit 11 generates Faster R-CNN as the detection model 50 . The control unit 11 detects the spicule region by inputting the three-dimensional volume data for training to the detection model 50 . The control unit 11 generates a detection model 50 by comparing the detected spicule region with the correct label and optimizing the weights between neurons so that the two approximate each other. The control unit 11 ends the series of processes.

- FIG. 12 is a flow chart showing the procedure of spicule detection processing. Based on FIG. 12, processing for detecting the spicule region will be described.

- the control unit 21 of the image diagnostic apparatus 2 acquires a plurality of frame images obtained by capturing cross sections of the breast at a plurality of positions (step S31). Specifically, as described above, the control unit 21 generates a group of frame images obtained by transmitting/receiving an ultrasonic signal and capturing a plurality of cross-sections perpendicular to the direction from the papilla to the pectoralis major muscle. get.

- the control unit 21 detects the spicule region in which the construction is disturbed by inputting the three-dimensional volume data composed of the acquired multiple frame images into the detection model 50 (step S32).

- the control unit 21 extracts the direction and intensity of the line structure at each point in the frame image from each frame image (step S33). Specifically, the control unit 21 applies a plurality of Gabor filters with different extraction directions ⁇ to the frame image to obtain the direction (orientation) of the line structure at each point in the frame image and the strength of the line structure ( Magnitude) and extract.

- the control unit 21 calculates the degree of line concentration at each point in each frame image based on the direction and intensity of the extracted line structure (step S34). Specifically, the control unit 21 calculates the average value of the intensity of each point and the intensity of the points surrounding each point, and determines whether or not the calculated average value is equal to or greater than a predetermined threshold value. Binarize the intensity of each point in the image. The control unit 21 extracts the mask direction by taking the product of the binarized intensity and the direction extracted in step S33. The control unit 21 takes each point in the frame image as a point of interest, obtains a relative vector between each point within a predetermined distance from the point of interest and the point of interest, and calculates the relative vector and the inner product value of the mask direction.

- control unit 21 weights the inner product value corresponding to each point using a distance function that becomes higher as the distance between the point of interest and other points is shorter.

- the control unit 21 calculates the line concentration degree of the point of interest by calculating the average value of the weighted inner product values.

- the control unit 21 corrects the line concentration degree so that the line structure toward the point of interest is more evenly distributed in all directions (a plurality of directions) (step S35). Specifically, the control unit 21 divides the circular region centered on the point of interest into a plurality of fan-shaped regions corresponding to a plurality of extraction directions ⁇ , and determines the direction of the line structure at each point in each fan-shaped region. , the probability value of the line structure directed from each direction to the point of interest is calculated. Based on the calculated probability value, the control unit 21 calculates an index value (entropy) representing the degree to which the line structure toward the point of interest is evenly distributed in each direction, Correct concentration.

- an index value entropy

- the control unit 21 normalizes (corrects) the line concentration degree so that the line concentration degree is constant when the line structure faces the point of interest at all points (step S36). Specifically, the control unit 21 generates a normalization map in which the value of each point in the frame image is set such that the value increases from the periphery to the center of the breast, and each point in the normalization map The line concentration is corrected by dividing the line concentration at each point by the value of the point.

- the control unit 21 extracts from each frame image an area with a certain degree of line concentration or higher (step S37). Then, the control unit 21 determines whether or not the spicule region detected in step S32 is a false positive according to the inter-frame movement amount of the extracted region (step S38). Specifically, as described above, the control unit 21 determines that the spicule region is a false positive when the movement distance and/or movement speed between frames of the spicule region is equal to or greater than a predetermined threshold value.

- the control unit 21 displays, on the display unit 24, a breast image in which a label is superimposed on the spicule region determined not to be false positive (step S39). Specifically, the control unit 21 displays a frame image in which a bounding box surrounding the spicule region and a translucent mask for coloring the inside of the spicule region are superimposed. Further, the control unit 21 superimposes an object (folded line) representing the inter-frame movement path of the region with the degree of line concentration equal to or higher than a certain level on the frame image. The control unit 21 ends the series of processes.

- FIG. 13 is an explanatory diagram showing another example of the process of calculating the degree of line concentration.

- the image diagnostic apparatus 2 extracts the direction and intensity of the line structure at each point in the image from each generated integrated image, and as shown in the third row from the top in FIG. Generate intensity and orientation maps of the structure.

- the integrated image is generated, for example, by calculating the average value of the brightness (pixel value) of each pixel of the frame images for each five frame images, and using the calculated average value as the pixel value of each pixel.

- the number of frame images for which the integrated image is generated is not limited to 5, and may be any number from 3 to 7, or the integrated image may be generated by another method.

- FIG. 14 is a flowchart showing another example of the procedure of spicule detection processing.

- the process shown in FIG. 14 is obtained by adding steps S41 to S49 between steps S31 and S32 in the process shown in FIG. Description of the same steps as in FIG. 12 will be omitted.

- step S31 when a plurality of frame images obtained by imaging cross sections of a plurality of positions of the breast are acquired (step S31), the control unit 21 of the image diagnostic apparatus 2 integrates the acquired frame images every predetermined number. An integrated image is generated (step S41). For example, when 3D volume data of 60 frame images is obtained in step S31, the control unit 21 performs the above-described integration process every 5 images to generate 12 integrated images. Then, the control unit 21 executes the processes of steps S42 to S47 based on the generated integrated images (for example, 12 integrated images). The processing of steps S42-S47 is the same as that of steps S32-S37.

- the detection model used for detecting the spicule region in the integrated image has the same configuration as the detection model 50 shown in FIG. is a model learned using training data to which a label representing a spicule region in the integrated image is assigned to each integrated image that constitutes the three-dimensional volume data for training.

- the three-dimensional volume data for training here is an integrated image group obtained by integrating a plurality of frame images captured by the imaging device 30 for each predetermined number of images. is the label integrated into .

- the labels accumulated for each predetermined number of frames are data including, for example, all of the correct coordinate ranges of the spicule regions indicated by the labels assigned to each frame image.

- a detection model for detecting a spicule region is generated when three-dimensional volume data composed of a plurality of integrated images is input.

- Such a detection model is also generated by the server 1 and installed in the diagnostic imaging apparatus 2 . Therefore, the control unit 21 of the image diagnostic apparatus 2 detects the spicule region by inputting the three-dimensional volume data of the multiple accumulated images generated in step S41 to such a detection model (step S42).

- control unit 21 extracts the direction and intensity of the line structure at each point in the integrated image generated in step S41 from each integrated image (step S43), and based on the extracted direction and intensity of the line structure, each A line concentration degree at each point in the integrated image is calculated (step S44). In addition, the control unit 21 corrects the line concentration degree so that the more evenly the line structures toward the point of interest are distributed in all directions (a plurality of directions), the higher the line concentration (step S45). The degree of line concentration is normalized so that the degree of line concentration is constant when facing the point of interest (step S46). Then, the control unit 21 extracts a region having a certain degree of line concentration or more from each integrated image (step S47).

- step S47 the control unit 21 determines whether or not a region with a certain or more line concentration degree is extracted from the integrated image (whether or not there is an extraction region) (step S48), and determines that there is no extraction region. If so (step S48: NO), the series of processes is terminated.

- step S48 the control unit 21 selects the frame image used for generating the integrated image for which it is determined that there is an extraction region as the processing target in the false positive determination processing in step S38.

- the image is identified (step S49). Note that the control unit 21 selects, in addition to the integrated image determined to have an extraction region, the frame images used to generate three integrated images including the integrated image and the two integrated images whose imaging positions are before and after the frame image to be processed. You can specify the image. After that, the control unit 21 executes the processing of steps S32 to S39 on the frame image specified as the processing target.

- the imaging device 30 continuously images the subject's breast cross section at a plurality of positions.

- the image diagnostic apparatus 2 generates images of coronal, sagittal, and axial slices of the breast based on three-dimensional volume data composed of a plurality of frame images captured in succession.

- the diagnostic imaging apparatus 2 calculates the degree of line concentration for each point in the generated cross-sectional image. Then, the image diagnostic apparatus 2 calculates the total line concentration degree of each point in the frame image based on the line concentration degree of each image. For example, the image diagnostic apparatus 2 calculates the comprehensive line concentration degree according to the following formula (4).

- Line concentration (line concentration of coronal section) x 2 + (line concentration of sagittal section) x 1 + (line concentration of axial section) x 1 ... (4)

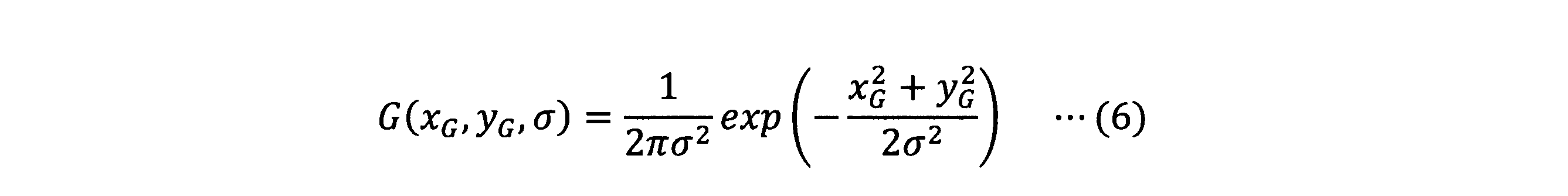

- Modification 3 Before applying a Gabor filter (image filter) to a frame image, an image is smoothed by applying an edge extraction filter as preprocessing.

- a predetermined DoG (Difference of Gaussians) filter for example, is applied to the edge extraction filtering process.

- Structural disturbances such as spicula tend to have a certain degree of contrast, such as higher or lower brightness compared to the surroundings.

- this local contrast is detected by applying a DoG filter.

- preprocessing means described in the following non-patent document can be applied.

- T. Handa, X. Zhang, N.Homma, T. Ishibashi, Y. Kawasumi, M. Abe, N. Sugita and M. Yoshizawa “DoG-Based Datection of Architectural Distortion in Mammographic Images for Computer-Aided Detection”, Proc of SICE Annual Conference, 2012, p.762-767, https://ieeexplore.ieee.org/abstract/document/6318541

- the image diagnostic apparatus 2 first generates a smoothed image L( x , y, ⁇ ).

- L(x, y, ⁇ ) G( xG , yG , ⁇ )*I(x, y) (5)

- x G and y G represent the kernel distances to the target position (x, y), respectively.

- the Gaussian kernel is defined by the following equation (6).

- ⁇ is the standard deviation of the two-dimensional Gaussian kernel. Regions with locally high contrast in the breast frame image have high values on the image Dk after DoG filtering. Therefore, it becomes easier to detect structural disturbances such as spicules.

Landscapes

- Engineering & Computer Science (AREA)

- Health & Medical Sciences (AREA)

- Life Sciences & Earth Sciences (AREA)

- Physics & Mathematics (AREA)

- Medical Informatics (AREA)

- Animal Behavior & Ethology (AREA)

- Radiology & Medical Imaging (AREA)

- Nuclear Medicine, Radiotherapy & Molecular Imaging (AREA)

- Biomedical Technology (AREA)

- Heart & Thoracic Surgery (AREA)

- Biophysics (AREA)

- Molecular Biology (AREA)

- Surgery (AREA)

- Pathology (AREA)

- General Health & Medical Sciences (AREA)

- Public Health (AREA)

- Veterinary Medicine (AREA)

- Computer Vision & Pattern Recognition (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Image Analysis (AREA)

- Ultra Sonic Daignosis Equipment (AREA)

Abstract

情報処理方法は、乳房の断面を複数位置で撮像した複数のフレーム画像を取得し、各フレーム画像内の各点について、線構造の集中度合いを示す線集中度を算出し、前記線集中度が一定以上の領域を前記各フレーム画像から抽出し、抽出した領域の前記各フレーム画像間の移動量に応じて、前記各フレーム画像における構築の乱れが偽陽性であるか否かを判定する処理をコンピュータが実行する。

Description

本発明は、超音波画像診断における、情報処理方法、プログラム及び画像診断装置に関する。

非侵襲性である超音波による診断システムは、生体を直接切開して観察する外科手術の必要がないため、被検体内部の情報を診断する技術として医療分野で広く用いられている。

超音波診断の一手法である超音波CT(Computed Tomography)は、超音波を被検体に照射し、散乱波や透過波を用いて被検体の断層画像を作成するものであり、近年の研究により、乳癌の検出に有用性があることが示されている。例えば、特許文献1では、送受信を行う多数の超音波振動子をリング状に被検体を取り囲むように配置し、これを上下方向に移動させながら、自動的に三次元撮像を行う。

取得された断層像は、診断医によって読影される。医師は所定の画像診断所見を検出する事で診断を行う。読影を支援する装置として、医療画像撮像装置から検査画像を取得し、画像処理や機械学習処理を通じて画像中に含まれる腫瘍等の異常領域を検出し、医師等に提示することにより画像診断を支援する診断支援装置が開発されている。

例えば特許文献2では、乳房内部の乳頭から大胸筋へ向かう乳腺の正常な構造(方向)を表す正常構築モデルを乳房X線画像から計算すると共に、乳房X線画像にガボールフィルタ(Gabor Filter)を適用することで乳腺の方向を抽出し、本来の正常な乳腺の方向と、抽出した乳腺の方向とを比較することで、乳腺の構築の乱れがあるか否かを判定する乳房画像病変検出システム等が開示されている。乳腺の構築の乱れは、乳癌の画像診断所見の一つであり、腫瘍周辺の組織が腫瘍に集中することで観察されるスピキュラ構造が、検出のための1つの指標となる。

超音波CTによる断層撮像では、従来のハンドヘルド型超音波装置によって得られる反射波を用いた散乱像の特徴を有しつつ、X線CTのように対象部位全体を3D撮像したボリューム画像を取得できる。しかしながら、乳癌用画像診断所見は撮像装置種類により見え方がことなる。例えば、X線マンモグラフィでは乳腺と病変が白く映るが、超音波画像では乳腺は白く病変は暗い。また、既存のハンドヘルド超音波装置による反射波像では、病変の後方陰影により周辺組織の一部が観測できないが、超音波CTでは、病変の周辺組織の全容が撮像される。これは、前者は、病変に対し一方から超音波が送信されるため、送信アレイから見て病変の反対側が陰となるが、後者は、病変を取り囲む全方位から超音波を照射するため影が打ち消されるからである。従って、超音波CT画像においては、既存の診断画像の診断所見に相当する診断所見を容易に特定するための診断支援機能が望まれる。

一つの側面では、3次元超音波撮像においてスピキュラ等の構築の乱れを好適に特定することができる情報処理方法等を提供することを目的とする。

一つの側面に係る情報処理方法は、乳房の断面を複数位置で撮像した複数のフレーム画像を取得し、各フレーム画像内の各点について、線構造の集中度合いを示す線集中度を算出し、前記線集中度が一定以上の領域を前記各フレーム画像から抽出し、抽出した領域の前記各フレーム画像間の移動量に応じて、前記各フレーム画像における構築の乱れが偽陽性であるか否かを判定する処理をコンピュータが実行する。

一つの側面では、スピキュラ等の構築の乱れを好適に特定することができる。

以下、本発明をその実施の形態を示す図面に基づいて詳述する。

(実施の形態)

図1は、画像診断システムの構成例を示す説明図である。本実施の形態では、被検者の乳房の断面を撮像した画像からスピキュラ(構築の乱れ)を検出する画像診断システムについて説明する。画像診断システムは、サーバ1及び画像診断装置2を含む。サーバ1及び画像診断装置2は、ネットワークNを介して通信接続されている。

(実施の形態)

図1は、画像診断システムの構成例を示す説明図である。本実施の形態では、被検者の乳房の断面を撮像した画像からスピキュラ(構築の乱れ)を検出する画像診断システムについて説明する。画像診断システムは、サーバ1及び画像診断装置2を含む。サーバ1及び画像診断装置2は、ネットワークNを介して通信接続されている。

なお、本実施の形態では画像診断の対象とする生体部位の一例として乳房を挙げるが、他の生体部位であってもよい。

また、本実施の形態では検出対象として「スピキュラ」を挙げるが、検出対象となる事象は乳腺の構築の乱れであればよく、構築の乱れはスピキュラと呼ばれるものに限定されない。

サーバ1は、種々の情報処理、情報の送受信が可能なサーバコンピュータである。なお、サーバ1に相当する装置はサーバコンピュータに限定されず、例えばパーソナルコンピュータ等であってもよい。本実施の形態においてサーバ1は、所定の訓練データを学習する機械学習を行うことで、乳房の断面を複数位置で撮像した複数のフレーム画像を入力した場合に、スピキュラがある領域(以下、「スピキュラ領域」と呼ぶ)を検出する検出モデル50(図4参照)を生成する生成装置として機能する。サーバ1が生成した検出モデル50のデータは画像診断装置2にインストールされており、画像診断装置2は、検出モデル50を用いて撮像画像からスピキュラ領域を検出する。

画像診断装置2は、超音波エコー検査のための画像診断装置であり、画像処理装置20及び撮像装置30を備える。画像処理装置20は、画像診断装置2のコンソールとして機能するコンピュータであり、乳房断面の超音波画像を生成(再構成)して表示する。なお、画像処理装置20は超音波画像診断用のコンピュータ(コンソール)に限定されず、パーソナルコンピュータ等の汎用コンピュータであってもよい。

撮像装置30は、超音波信号の送受信を行う撮像装置である。図1に示すように、撮像装置30は、被検者がうつ伏せになった状態で乳房を撮像可能に構成されている。具体的には、撮像装置30はベッド状の形状を有し、天板31に乳房を挿入するための孔32が設けられている。孔32の下方には水槽33が設けられ、被検者は孔32から水槽33に乳房を挿入する。

水槽33には、リングアレイ34が設けられている。リングアレイ34は、複数の超音波素子(トランスデューサ)を備えるリング状の振動子アレイである。リングアレイ34には複数の超音波素子が等間隔で配置され、各超音波素子は超音波信号を送信すると共に、反射波を受信する。画像処理装置20は、各超音波素子から得た複数方向の反射波データを再構成することで、一断面の超音波画像(フレーム画像)を生成する。反射波信号は組織の境界線に生じる音響インピーダンスの差によって強度が異なる為、再構成された反射波像では、組織や病変の境界情報、組織内の密度が輝度で表現される。リングアレイ34は上下方向に移動可能に構成されており、画像診断装置2はリングアレイ34を上下に移動させて乳房の各位置(高さ)における超音波画像を撮像する。

本実施の形態に係る画像診断装置2として、引用文献1に記載の超音波診断システムを採用することができる。

なお、画像診断装置2は上記の構成に限定されない。例えばベッド型の撮像装置30に代えて、ハンディスキャナを用いた画像診断装置としてもよい。

また、本実施の形態では乳房の撮像画像として超音波画像を用いるが、X線画像(マンモグラフィ等)のように、他のモダリティの画像を用いてもよい。ようは、被検体の断面を複数位置で撮像した複数のフレーム画像を取得し、連続した生体構造を撮像する装置であって、XY面のスライス画像を第三の軸上に連続して再構成する三次元医療画であればよい。

画像診断装置2は撮像装置30により、乳頭から大胸筋に向かう方向とほぼ直交する乳房の断面を撮像する。本実施の形態において画像診断装置2は、上述の検出モデル50を用いて、乳腺の構築の乱れが生じているスピキュラ領域を撮像画像から検出する。具体的には、画像診断装置2は、乳房の断面を複数位置で撮像した各フレーム画像から成る3次元ボリュームデータを検出モデル50に入力することで、スピキュラ領域を検出する。複数のフレーム画像を一のデータとして検出モデル50に入力することで、前後のフレームの情報を参照しながらスピキュラ領域を検出することができる。

更に画像診断装置2は、後述の如く、検出モデル50によるスピキュラ領域の検出結果が妥当であるか否か、すなわち偽陽性でないかを判定する。具体的には、画像診断装置2は、各フレーム画像内の各点について、線構造の集中度合いを示す線集中度を算出する。そして画像診断装置2は、線集中度が一定以上の領域のフレーム間の移動量に応じて、検出モデル50で検出したスピキュラ領域が偽陽性であるか否かを判定する。

なお、本実施の形態ではサーバ1が検出モデル50の生成(学習)を行うものとするが、ローカルの画像診断装置2が検出モデル50を生成するようにしてもよい。また、本実施の形態では画像診断装置2がスピキュラ領域の検出及び偽陽性の判定を行うものとするが、クラウド上のサーバ1が当該処理を実行するようにしてもよい。すなわち、両者の区別は便宜的なものであり、単一のコンピュータが一連の処理を行うようにしてもよい。

また、本実施の形態では乳頭から大胸筋に向かう方向とほぼ直交する乳房の断面(いわゆるコロナル断面)を撮像するものとするが、他の方向の断面(例えばサジタル断面、アキシャル断面)を撮像してもよい。

図2は、サーバ1の構成例を示すブロック図である。サーバ1は、制御部11、主記憶部12、通信部13、及び補助記憶部14を備える。

制御部11は、一又は複数のCPU(Central Processing Unit)、MPU(Micro-Processing Unit)、GPU(Graphics Processing Unit)等のプロセッサを有し、補助記憶部14に記憶されたプログラムP1を読み出して実行することにより、種々の情報処理を行う。主記憶部12は、SRAM(Static Random Access Memory)、DRAM(Dynamic Random Access Memory)等の一時記憶領域であり、制御部11が演算処理を実行するために必要なデータを一時的に記憶する。通信部13は、通信に関する処理を行うための通信モジュールであり、外部と情報の送受信を行う。補助記憶部14は、大容量メモリ、ハードディスク等の不揮発性記憶領域であり、制御部11が処理を実行するために必要なプログラムP1、その他のデータを記憶している。

制御部11は、一又は複数のCPU(Central Processing Unit)、MPU(Micro-Processing Unit)、GPU(Graphics Processing Unit)等のプロセッサを有し、補助記憶部14に記憶されたプログラムP1を読み出して実行することにより、種々の情報処理を行う。主記憶部12は、SRAM(Static Random Access Memory)、DRAM(Dynamic Random Access Memory)等の一時記憶領域であり、制御部11が演算処理を実行するために必要なデータを一時的に記憶する。通信部13は、通信に関する処理を行うための通信モジュールであり、外部と情報の送受信を行う。補助記憶部14は、大容量メモリ、ハードディスク等の不揮発性記憶領域であり、制御部11が処理を実行するために必要なプログラムP1、その他のデータを記憶している。

なお、補助記憶部14はサーバ1に接続された外部記憶装置であってもよい。また、サーバ1は複数のコンピュータからなるマルチコンピュータであっても良く、ソフトウェアによって仮想的に構築された仮想マシンであってもよい。

また、本実施の形態においてサーバ1は上記の構成に限られず、例えば操作入力を受け付ける入力部、画像を表示する表示部等を含んでもよい。また、サーバ1は、非一時的なコンピュータ読取可能な記録媒体1aを読み取る読取部を備え、記録媒体1aからプログラムP1を読み込んでもよい。また、プログラムP1は単一のコンピュータ上で実行されてもよく、ネットワークNを介して相互接続された複数のコンピュータ上で実行されてもよい。

図3は、画像処理装置20の構成例を示すブロック図である。画像処理装置20は、制御部21、主記憶部22、通信部23、表示部24、入力部25、送受信部26、画像処理部27、及び補助記憶部28を備える。

制御部21は、一又は複数のCPU等のプロセッサを有し、補助記憶部28に記憶されたプログラムP2を読み出して実行することにより、種々の情報処理を行う。主記憶部22は、RAM等の一時記憶領域であり、制御部21が演算処理を実行するために必要なデータを一時的に記憶する。通信部23は、通信に関する処理を行うための通信モジュールであり、外部と情報の送受信を行う。表示部24は、液晶ディスプレイ等の表示画面であり、画像を表示する。入力部25は、キーボード、マウス等の操作インターフェイスであり、ユーザから操作入力を受け付ける。送受信部26は、リングアレイ34の超音波素子を制御し、超音波信号を送受信する。画像処理部27は、画像処理を行うモジュールであり、超音波素子で受信した反射波データを再構成し、超音波画像を生成する。

制御部21は、一又は複数のCPU等のプロセッサを有し、補助記憶部28に記憶されたプログラムP2を読み出して実行することにより、種々の情報処理を行う。主記憶部22は、RAM等の一時記憶領域であり、制御部21が演算処理を実行するために必要なデータを一時的に記憶する。通信部23は、通信に関する処理を行うための通信モジュールであり、外部と情報の送受信を行う。表示部24は、液晶ディスプレイ等の表示画面であり、画像を表示する。入力部25は、キーボード、マウス等の操作インターフェイスであり、ユーザから操作入力を受け付ける。送受信部26は、リングアレイ34の超音波素子を制御し、超音波信号を送受信する。画像処理部27は、画像処理を行うモジュールであり、超音波素子で受信した反射波データを再構成し、超音波画像を生成する。

補助記憶部28は、ハードディスク、大容量メモリ等の不揮発性記憶領域であり、制御部21が処理を実行するために必要なプログラムP2、その他のデータを記憶している。また、補助記憶部28は、検出モデル50を記憶している。検出モデル50は、所定の訓練データを学習済みの機械学習モデルであり、複数のフレーム画像から成る3次元ボリュームデータを入力した場合に、構築の乱れが生じているスピキュラ領域を検出するよう学習済みのモデルである。検出モデル50は、人工知能ソフトウェアの一部を構成するプログラムモジュールとしての利用が想定される。

なお、画像処理装置20は、非一時的なコンピュータ読取可能な記録媒体2aを読み取る読取部を備え、記録媒体2aからプログラムP2を読み込んでもよい。また、プログラムP2は単一のコンピュータ上で実行されてもよく、ネットワークNを介して相互接続された複数のコンピュータ上で実行されてもよい。

図4は、検出モデル50の概要を示す説明図である。以下では本実施の形態の概要を説明する。

図4では、乳房の断面を複数位置で撮像した複数のフレーム画像を検出モデル50に入力した場合に、スピキュラ領域を検出する様子を図示している。検出モデル50は、複数のフレーム画像から成る3次元ボリュームデータを入力した場合に、スピキュラ領域を検出するよう学習済みのモデルである。例えば検出モデル50は、深層学習により生成されるニューラルネットワークであり、CNN(Convolution Neural Network;畳み込みニューラルネットワーク)の一種であるFaster R-CNNである。

なお、検出モデル50はFaster R-CNN以外のニューラルネットワークであってもよい。また、検出モデル50は、決定木、ランダムフォレスト、SVM(Support Vector Machine)等の他の学習アルゴリズムに基づくモデルであってもよい。

サーバ1は、訓練用の3次元ボリュームデータ群に対し、正解のスピキュラ領域を示すラベルが付与された訓練データを用いて、検出モデル50を生成する。3次元ボリュームデータは、被検者の乳房を撮像装置30で撮像した画像データであり、乳房の複数位置の断面を撮像したフレーム画像群である。サーバ1は、複数の被検者それぞれの乳房を一方向(乳頭から大胸筋に向かう方向)に沿って撮像したフレーム画像群を、訓練用の3次元ボリュームデータ群として用いる。3次元ボリュームデータに付与されるラベルは、スピキュラ領域の正解の座標範囲を示すデータであり、例えば医療従事者(医師等)が各フレーム画像に対してスピキュラ領域を囲むように設定したラベルである。サーバ1は、3次元ボリュームデータを構成する各フレーム画像に対し、スピキュラ領域を表すラベルが付与された訓練データを用いて検出モデル50を生成する。

サーバ1は、複数のフレーム画像を一の入力データセットとして検出モデル50に与えることで、3次元ボリュームデータからスピキュラ領域を検出する検出モデル50を生成する。すなわち、サーバ1は、図4左側に示すように、2次元の各フレーム画像を撮像位置(リングアレイ34の高さ)に沿って並べた3次元データを、検出モデル50の入力に用いる。これにより、前後のフレーム画像の特徴(構築の乱れ)を参照して、各フレーム画像におけるスピキュラ領域を検出することができる。

3次元ボリュームデータが入力された場合、検出モデル50は、スピキュラ領域の検出結果を出力する。具体的には、検出モデル50は、スピキュラ領域を囲む矩形状のバウンディングボックスと、スピキュラ領域の境界内部を表すマスクとをフレーム画像毎に出力する。なお、本実施の形態に係る検出モデル50がFaster R-CNNであるため、検出モデル50はバウンディングボックス及びマスクの双方を出力するが、検出モデル50は何れか一方のみを出力するものであってもよい。

サーバ1は、訓練用の3次元ボリュームデータを検出モデル50に入力することで、スピキュラ領域を検出する。サーバ1は、検出したスピキュラ領域を正解のラベルと比較し、両者が近似するように、ニューロン間の重み等のパラメータを更新する。サーバ1は、訓練用の各3次元ボリュームデータを検出モデル50に順次入力してパラメータを更新し、最終的にパラメータを最適化した検出モデル50を生成する。

画像診断装置2には、サーバ1が生成した検出モデル50のデータがインストールされている。撮像装置30により被検者の乳房を撮像した場合、画像診断装置2は、検出モデル50を用いてスピキュラ領域を検出する。すなわち、画像診断装置2は、複数のフレーム画像から成る3次元ボリュームデータを検出モデル50に入力することで、スピキュラ領域を検出する。

図5は、偽陽性判定処理に関する説明図である。本実施の形態において画像診断装置2は、検出モデル50によるスピキュラ領域の検出結果が妥当であるか否か、すなわち偽陽性でないかを、線構造が集中している領域のフレーム間の移動量に応じて判定する。

具体的には、画像診断装置2は、各フレーム画像内の各点における線集中度を算出し、算出した線集中度が一定以上の領域がフレーム間でどの程度移動しているか、その移動量を算出する。そして画像診断装置2は、移動量が所定の閾値以上であると判定した場合、その領域に対応するスピキュラ領域が偽陽性であると判定する。

図5では、フレーム画像内の各点の線集中度を表すマップ(以下、「線集中度マップ」と呼ぶ)を左側に、線集中度が一定以上の領域のフレーム間における移動経路を表したフレーム画像を右側に図示する。図5に基づき、偽陽性判定処理の概要を説明する。

画像診断装置2は、フレーム画像内の各点の線集中度を、フレーム画像毎に算出する。線集中度は、線構造の集中度合いを示す数値である。線構造は、フレーム画像に現れる線状の構造(エッジ)であり、乳腺等の線状組織に相当する。スピキュラは、乳腺等の周辺組織が腫瘍に集中するものであるため、線集中度の高低により、スピキュラの疑いが強い領域を抽出することができる。

画像診断装置2は、フレーム画像に所定の画像フィルタを適用することで線集中度を算出する。本実施の形態において画像診断装置2は、画像フィルタとして、特定方向成分を画像から抽出するガボールフィルタを用いる。画像の横軸をx軸、縦軸をy軸とした場合、ガボールフィルタのフィルタ関数g(x,y)は、以下の式(1)で規定される。

なお、σx及びσyはガウス関数の標準偏差、f0は三角関数の周波数を表す。ガボールフィルタ(フィルタ関数g)自体は公知のものと大きな差異はないため、本実施の形態では詳細な説明省略する。

画像診断装置2は、ガボールフィルタをフレーム画像に適用することで、フレーム画像内の各点における線構造の方向及び強度を抽出する。具体的には、画像診断装置2は、抽出方向θ(Orientation)が互いに異なる複数のガボールフィルタをフレーム画像に適用し、各方向θに対応するフィルタ関数g(x,y)と、フレーム画像の画素値f(x,y)との直積h(x,y)を算出する。例えば画像診断装置2は、h(x,y)の最大値を線構造の強度、h(x,y)が最大となる方向θを線構造の方向として抽出する。

本実施の形態において画像診断装置2は、画像の水平方向(x軸方向)を0°として、0°、22.5°、45°、…157.5°の、22.5°刻みの8方向のガボールフィルタを用意してある。画像診断装置2は、一のフレーム画像に対し8通りのガボールフィルタを適用することで、線構造の方向及び強度を抽出する。

画像診断装置2は、上記で抽出した線構造の方向及び強度に基づき、フレーム画像内の各点(各注目点)の線集中度を算出する。具体的な線集中度の算出方法については後述する。

上述の処理により、画像診断装置2は、図5左側に示すように、各点の線集中度を表す線集中度マップを生成する。なお、実際の線集中度マップは各点(画素)の値が連続的に変化するヒートマップで表現されるが、図5では図示の便宜上、線集中度が高い部分(領域)にハッチングを付し、その他の部分を白抜きで図示している。

画像診断装置2は、生成した線集中度マップから、線集中度が一定以上の領域を抽出する。すなわち、画像診断装置2は、スピキュラ(構築の乱れ)が生じている可能性が高い領域を抽出する。

画像診断装置2は、抽出した領域のフレーム間の移動量に応じて、検出モデル50が検出したスピキュラ領域が偽陽性であるか否かを判定する。具体的には、画像診断装置2は、線集中度が一定以上の領域の中心(重心)座標を各フレーム画像から特定し、特定した中心座標のフレーム間の移動距離、及び/又は移動速度に応じて、スピキュラ領域が偽陽性であるか否かを判定する。

図5右側には、線集中度が一定以上である領域の中心の移動経路を、折れ線で図示している。例えば画像診断装置2は、連続する所定数のフレーム画像を取り出し、最初のフレームから最後のフレームに至る中心の総移動距離(折れ線の総長)、及び/又は隣り合う2フレーム間の移動速度の平均値を算出する。画像診断装置2は、算出した移動距離及び/又は移動速度が所定の閾値以上であるか否かを判定する。移動距離及び/又は移動速度が閾値以上である場合、画像診断装置2は偽陽性であると判定する。移動距離及び/又は移動速度が閾値未満である場合、画像診断装置2は陽性であると判定する。

例えば画像診断装置2は、検出モデル50が検出したスピキュラ領域と、線集中度が一定以上である領域とを比較して、スピキュラ領域と重複する後者の領域を特定する。画像診断装置2は、特定した領域の移動量に応じて、スピキュラ領域が偽陽性であるか否かを判定する。例えば画像診断装置2は、偽陽性でないと判定したスピキュラ領域を、最終的なスピキュラ領域の検出結果として出力(表示)する(図10参照)。なお、画像診断装置2は、偽陽性であると判定したスピキュラ領域も、偽陽性でないと判定したスピキュラ領域と識別可能に出力するようにしてもよい。スピキュラの中心がフレーム間で大きく移動することは考えにくいため、移動量が閾値以上の領域を偽陽性と判定することで、誤検出を減らすことができる。例えば、スライス間隔1mmのとき、移動量の平均値・中央値は10mm以下となるデータセットで学習した学習器を適用する場合、スライス間隔1mmで移動量が10mm以上移動しているスピキュラは、偽陽性と判定する。

図6は、線集中度の算出過程を示す説明図である。図6では、本実施の形態に係る線集中度の算出過程を概念的に図示している。本実施の形態において画像診断装置2は、スピキュラの検出という目的に合わせて、ガボールフィルタによる線構造の抽出結果にいくつかの処理を施した上で、線集中度を算出する。図6に基づき、当該線集中度の算出方法について説明する。

上述の如く、画像診断装置2は、フレーム画像内の各点における線構造の方向(Orientation)及び強度(Magnitude)を各フレーム画像から抽出する。これにより、図6の上から2段目に図示するように、フレーム画像内の線構造の強度マップ(強度の分布)と、方向マップ(方向の分布)とが生成される。なお、実際の強度マップ及び方向マップはヒートマップで表現されるが、図6では便宜上、線構造の強度を線で、線構造の方向を矢印で図示している。

ここで画像診断装置2は、強度マップに対して所定の前処理を行う。具体的には、画像診断装置2は、フレーム画像内の各点(画素)について、各点の強度と、各点の周辺点の強度との平均値を算出し、算出した点を対象の点の強度とする。例えば画像診断装置2は、対象の点を含む6×6の点(画素)の強度の平均値を、各対象点の強度とする。

更に画像診断装置2は、平均化した各点の強度が所定の閾値以上であるか否かに応じて、各点の強度を二値化する。具体的には、画像診断装置2は大津法(Otsu Method)を用いてフレーム画像全体の強度分布から閾値を設定し、当該閾値以上の点の強度を「1」、閾値未満の点の強度を「0」に設定する。なお、二値化する値は「1」及び「0」に限定されず、閾値以上であるか否かに応じて異なる値であればよい。

スピキュラの発見に、線自体の明るさ、太さ等は関係性が低いと考えられる。そのため、強度を二値化(及び平均化)することで偽陽性を減らすことが期待できる。

画像診断装置2は、二値化した各点の強度と、各点の方向との積を算出する。すなわち、画像診断装置2は、図6に示す二値化後の強度マップと、方向マップとを乗算した、新たなマップを生成する。強度が二値化されているため、当該マップは、強度が閾値未満の点の線構造を低減(捨象)し、強度が閾値以上の線構造を強調した方向分布を意味する。

以下の説明では便宜上、二値化した強度と方向との積を、強度が閾値未満の線構造を低減(捨象)した方向という意味で、「マスク方向」(Masked Orientation)と呼ぶ。

このように、画像診断装置2は、強度が閾値以上の線構造を強調したマスク方向マップ(マスク方向の分布)を生成する。画像診断装置2は、生成したマスク方向マップに基づき、図6最下段に示す最終的な線集中度マップを生成する。

なお、本実施の形態では線構造の方向及び強度の積を取ることでマスク方向を抽出し、そのマスク方向の分布から線集中度を算出するものとするが、強度に応じた方向(マスク方向)の抽出を行わず、一次的に取得した線構造の方向分布から線集中度を算出するものとしてもよい。すなわち、画像診断装置2は、フレーム画像から少なくとも線構造の方向を抽出し、抽出した線構造の方向に基づいて線集中度を算出可能であればよく、線構造の強度も用いて線集中度を算出する構成は必須ではない。

図7は、注目点と各点との距離に応じた線集中度の算出過程を示す説明図である。図7に基づき、マスク方向から線集中度を算出する際の処理内容について説明する。

画像診断装置2は、フレーム画像内の各点を注目点として、当該注目点と、注目点以外の他の各点とを結ぶ相対ベクトルを取る。画像診断装置2は、当該相対ベクトルと、相対ベクトルの始点である他の点でのマスク方向(線構造の方向)との内積値を取ることで、線集中度を算出する。

具体的な算出過程を、図7左側に概念的に図示する。フレーム画像内の任意の注目点Pについて線集中度を算出する場合、画像診断装置2は、注目点Pから一定の距離内にある点Q、具体的には、所定の内径Aから外径Bの範囲内にある点Qでのマスク方向を元に線集中度を算出する。画像診断装置2は、注目点Pと点Qとの相対ベクトルを取り、当該相対ベクトルと、点Qでのマスク方向との内積値を算出する。画像診断装置2は、内径Aから外径Bの範囲内にある全ての点Qについて内積値を算出し、各点Qに係る内積値の平均値を算出する。画像診断装置2は、算出した平均値を注目点Pの線集中度とする。

本実施の形態において画像診断装置2は、上記のようにして線集中度を算出する場合に、注目点Pに近い位置にある線構造ほど重視するように、各点Qに係る内積値の重み付けを行う。具体的には、画像診断装置2は、各点Qについて相対ベクトルとマスク方向との内積値を算出する際に、点Qからの距離rが近いほど高くなる距離関数d(r)を乗算することで、重み付けを行う。距離関数d(r)は、例えば以下の式(2)で規定される。

なお、式(2)のβは定数である。図7右側に、点Qからの距離rに応じて距離関数d(r)が変化する様子を、ハッチングで概念的に図示している。画像診断装置2は、距離rが近いほど高くなるように設計された距離関数d(r)を乗算することで、注目点Pに近い位置にある線構造ほど重視して線集中度を算出するようにする。

図8は、方向分布に応じた線集中度の補正処理に関する説明図である。画像診断装置2は更に、全方位から線構造が集中する領域を抽出するべく、注目点に向かう線構造のばらつき(分布)に応じた重み付けを行う。具体的には、画像診断装置2は、注目点に向かう線構造が全方位(複数の方向)に均等に分布している度合いを評価するための指標値を算出し、算出した指標値の大小に応じて、線集中度を補正する。

例えば画像診断装置2は、図8に示すように、注目点Pを中心とする所定距離内の円領域を、ガボールフィルタの抽出方向θに合わせて、所定角度(22.5°)ずつ複数の扇状領域に分割する。そして画像診断装置2は、扇状領域内の各点における線構造から、注目点Pに向かう方向成分を抽出することで、扇状領域内の各点から注目点Pに向かう線構造の確率値Pi(iは各扇状領域の番号。i=1,2,3,…8)を算出する。画像診断装置2は、注目点Pに向かう線構造が全ての扇状領域に均等に分布しているか、その度合いを表す指標値として、以下の式(3)で示すエントロピーを算出する。

画像診断装置2は、算出したエントロピーの大小に応じて、注目点Pの線集中度を補正する。具体的には、画像診断装置2は、エントロピーが大きいほど線集中度を高く補正する。

なお、本実施の形態では指標値としてエントロピーを用いるが、指標値はこれに限定されるものではなく、他の値(例えば確率値Piの平均値等)であってもよい。

図9は、中心バイアスの補正処理に関する説明図である。画像診断装置2は更に、乳房の中心にある領域ほど乳腺等の線構造が乳房の中心に向かって集中する傾向(バイアス)の影響を低減すべく、補正を行う。

上述の如く、画像診断装置2は、乳頭から大胸筋に向かう方向とほぼ直交する断面を撮像する。一方で、当該断面視において乳腺は乳頭から周囲に向かって放射状に広がっているため、撮像装置30によって撮像した画像では、スピキュラの有無にかかわらず、乳房の中心に向かって自ずと線構造が集中することになる。その結果、補正を行わずに線集中度に基づきスピキュラの検出を行うと、乳房の中心領域に多くの偽陽性が発生する。そこで画像診断装置2は、乳房中心に線構造が集中することによる影響を低減するため、以下の処理を行う。

具体的には、画像診断装置2は、全ての点で線構造が注目点を向く場合に線集中度が一定(例えば1)となるよう、線集中度の正規化を行う。画像診断装置2はまず、フレーム画像から乳房と乳房以外の領域との境界を検出し、乳房及び乳房以外の領域を二値化したマップ(左上)を生成する。画像診断装置2は当該マップに、乳房の中心に近いほど高くなるように所定の距離関数を乗算する(重み付けする)ことで、乳房の周縁から中心に向かって値が高くなるように設定した正規化用マップを生成する(右上)。

画像診断装置2は、生成した正規化用マップで線集中度マップ(左下)を除算することで、線集中度を正規化する。すなわち、画像診断装置2は、正規化用マップにおける各点の値で、線集中度マップにおける各点の線集中度を除算することで、線集中度を補正する。これにより、全ての点で線構造が注目点を向いた場合の値が1になるように正規化され、中心バイアスの影響が低減される。

以上より、画像診断装置2は、スピキュラ検出に合わせてガボールフィルタの抽出結果に一定の処理を施した上で、線集中度を算出する。図5で説明したように、画像診断装置2は、線集中度が一定以上の領域を線集中度マップから抽出し、当該領域のフレーム間の移動量に応じて、検出モデル50が検出したスピキュラ領域が偽陽性であるか否かを判定する。

図10は、スピキュラの検出結果の表示画面を示す説明図である。乳房の撮像画像からスピキュラ領域を検出した場合、画像診断装置2は、図10で例示する画面を表示する。

例えば画像診断装置2は、スピキュラ領域を表すラベルを重畳した乳房画像を当該画面に表示する。具体的には、画像診断装置2は、スピキュラ領域を囲むバウンディングボックスと、スピキュラ領域内部を色付けする半透明マスクとを重畳したフレーム画像を表示する。なお、図10では便宜上、スピキュラ領域が色付けされている様子をハッチングで図示する。画像診断装置2は、検出モデル50が検出したスピキュラ領域のうち、偽陽性と判定されたスピキュラ領域を除外したスピキュラ領域に対し、バウンディングボックス及びマスクを重畳する。