WO2016200043A1 - 비디오 코딩 시스템에서 가상 참조 픽처 기반 인터 예측 방법 및 장치 - Google Patents

비디오 코딩 시스템에서 가상 참조 픽처 기반 인터 예측 방법 및 장치 Download PDFInfo

- Publication number

- WO2016200043A1 WO2016200043A1 PCT/KR2016/004209 KR2016004209W WO2016200043A1 WO 2016200043 A1 WO2016200043 A1 WO 2016200043A1 KR 2016004209 W KR2016004209 W KR 2016004209W WO 2016200043 A1 WO2016200043 A1 WO 2016200043A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- reference picture

- vrp

- information

- virtual reference

- picture

- Prior art date

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/105—Selection of the reference unit for prediction within a chosen coding or prediction mode, e.g. adaptive choice of position and number of pixels used for prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/137—Motion inside a coding unit, e.g. average field, frame or block difference

- H04N19/139—Analysis of motion vectors, e.g. their magnitude, direction, variance or reliability

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/176—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a block, e.g. a macroblock

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/46—Embedding additional information in the video signal during the compression process

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/513—Processing of motion vectors

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/59—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving spatial sub-sampling or interpolation, e.g. alteration of picture size or resolution

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

Definitions

- the present invention relates to video coding technology, and more particularly, to a virtual reference picture based inter prediction method and apparatus in a video coding system.

- the demand for high resolution and high quality images such as high definition (HD) images and ultra high definition (UHD) images is increasing in various fields.

- the higher the resolution and the higher quality of the image data the more information or bit rate is transmitted than the existing image data. Therefore, the image data can be transmitted by using a medium such as a conventional wired / wireless broadband line or by using a conventional storage medium. In the case of storage, the transmission cost and the storage cost are increased.

- a high efficiency image compression technique is required to effectively transmit, store, and reproduce high resolution, high quality image information.

- An object of the present invention is to provide a method and apparatus for improving video coding efficiency.

- Another technical problem of the present invention is to provide a method and apparatus for improving inter prediction performance.

- Another technical problem of the present invention is to provide a method and apparatus for generating a virtual reference picture.

- Another technical problem of the present invention is to increase the accuracy of a prediction signal by using a virtual reference picture.

- Another technical problem of the present invention is to provide a method and apparatus for generating a virtual reference picture using homography information.

- Another technical problem of the present invention is to provide a method and apparatus for generating a virtual reference picture through filtering.

- Another technical problem of the present invention is to provide a method and apparatus for managing a virtual reference picture.

- an inter prediction method performed by a decoding apparatus may include configuring a reference picture set for a current picture and generating a virtual reference picture corresponding to an original reference picture in the reference picture set. Deriving a motion vector for a current block in the current picture, and generating a predictive sample for the current block based on the motion vector and the virtual reference picture.

- a decoding apparatus for performing inter prediction.

- the decoding apparatus configures a decoding unit for obtaining information about an inter prediction mode for a current block from a bitstream, a reference picture set for a current picture, and an original reference picture in the reference picture set. generate a virtual reference picture corresponding to the picture, derive a motion vector for the current block in the current picture, and predict the current block based on the motion vector and the virtual reference picture. And a predictor for generating a sample.

- an image encoding method performed by an encoding apparatus may include configuring a reference picture set for a current picture and generating a virtual reference picture corresponding to an original reference picture in the reference picture set. Deriving a motion vector and a prediction sample for the current block in the current picture based on the virtual reference picture, deriving a residual sample based on the original sample and the prediction sample for the current block, and And encoding and outputting information about the motion vector and the information about the residual sample.

- an encoding apparatus for performing image encoding.

- the encoding apparatus configures a reference picture set for the current picture, generates a virtual reference picture corresponding to an original reference picture in the reference picture set, and A predictor which derives a motion vector and a prediction sample for a current block in the current picture based on a virtual reference picture, and derives a residual sample based on the original sample and the prediction sample for the current block, and the motion vector

- an encoding unit for encoding and outputting information about the residual sample and the information about the residual sample.

- the performance of inter prediction may be improved based on a virtual reference picture having a higher correlation with the current picture, thereby reducing the amount of data allocated to the residual signal and improving the overall coding efficiency.

- FIG. 1 is a block diagram schematically illustrating a video encoding apparatus according to an embodiment of the present invention.

- FIG. 2 is a block diagram schematically illustrating a video decoding apparatus according to an embodiment of the present invention.

- 3 exemplarily shows DPB and reference pictures for inter prediction.

- FIG. 5 shows a decoding procedure considering a virtual reference picture.

- FIG. 7 shows an example of a virtual reference picture generation procedure according to the present invention.

- FIG. 8 exemplarily shows a reference picture set or a reference picture list structure.

- FIG. 9 schematically illustrates an example of an image coding method according to the present invention.

- FIG 10 schematically illustrates an example of an inter prediction method according to the present invention.

- each of the components in the drawings described in the present invention are shown independently for the convenience of description of the different characteristic functions in the video encoding apparatus / decoding apparatus, each component is a separate hardware or separate software It does not mean that it is implemented.

- two or more of each configuration may be combined to form one configuration, or one configuration may be divided into a plurality of configurations.

- Embodiments in which each configuration is integrated and / or separated are also included in the present invention without departing from the spirit of the present invention.

- FIG. 1 is a block diagram schematically illustrating a video encoding apparatus according to an embodiment of the present invention.

- the encoding apparatus 100 may include a picture divider 105, a predictor 110, a transformer 115, a quantizer 120, a reordering unit 125, an entropy encoding unit 130, An inverse quantization unit 135, an inverse transform unit 140, a filter unit 145, and a memory 150 are provided.

- the picture dividing unit 105 may divide the input picture into at least one processing unit block.

- the block as the processing unit may be a prediction unit (PU), a transform unit (TU), or a coding unit (CU).

- a picture may be composed of a plurality of coding tree units (CTUs), and each CTU may be split into CUs in a quad-tree structure.

- a CU may be divided into quad tree structures with CUs of a lower depth.

- PU and TU may be obtained from a CU.

- a PU may be partitioned from a CU into a symmetrical or asymmetrical square structure.

- the TU may also be divided into quad tree structures from the CU.

- the CTU may correspond to a coding tree block (CTB), the CU may correspond to a coding block (CB), the PU may correspond to a prediction block (PB), and the TU may correspond to a transform block (TB).

- CTB coding tree block

- the predictor 110 includes an inter predictor for performing inter prediction and an intra predictor for performing intra prediction, as described below.

- the prediction unit 110 performs prediction on the processing unit of the picture in the picture division unit 105 to generate a prediction block including a prediction sample (or a prediction sample array).

- the processing unit of the picture in the prediction unit 110 may be a CU, a TU, or a PU.

- the prediction unit 110 may determine whether the prediction performed on the processing unit is inter prediction or intra prediction, and determine specific contents (eg, prediction mode, etc.) of each prediction method.

- the processing unit in which the prediction is performed and the processing unit in which the details of the prediction method and the prediction method are determined may be different.

- the method of prediction and the prediction mode may be determined in units of PUs, and the prediction may be performed in units of TUs.

- a prediction block may be generated by performing prediction based on information of at least one picture of a previous picture and / or a subsequent picture of the current picture.

- a prediction block may be generated by performing prediction based on pixel information in a current picture.

- a skip mode, a merge mode, an advanced motion vector prediction (AMVP), and the like can be used.

- a reference picture may be selected for a PU and a reference block corresponding to the PU may be selected.

- the reference block may be selected in units of integer pixels (or samples) or fractional pixels (or samples).

- a predictive block is generated in which a residual signal with the PU is minimized and the size of the motion vector is also minimized.

- a pixel, a pel, and a sample may be mixed with each other.

- the prediction block may be generated in integer pixel units, or may be generated in sub-pixel units such as 1/2 pixel unit or 1/4 pixel unit.

- the motion vector may also be expressed in units of integer pixels or less.

- Information such as an index of a reference picture selected through inter prediction, a motion vector difference (MVD), a motion vector predictor (MVD), and a residual signal may be entropy encoded and transmitted to a decoding apparatus.

- the prediction block may be a reconstruction block, the residual may not be generated, transformed, quantized, or transmitted.

- a prediction mode When performing intra prediction, a prediction mode may be determined in units of PUs, and prediction may be performed in units of PUs. In addition, a prediction mode may be determined in units of PUs, and intra prediction may be performed in units of TUs.

- the prediction mode may have, for example, 33 directional prediction modes and at least two non-directional modes.

- the non-directional mode may include a DC prediction mode and a planner mode (Planar mode).

- a prediction block may be generated after applying a filter to a reference sample.

- whether to apply the filter to the reference sample may be determined according to the intra prediction mode and / or the size of the current block.

- the residual value (the residual block or the residual signal) between the generated prediction block and the original block is input to the converter 115.

- the prediction mode information, the motion vector information, etc. used for the prediction are encoded by the entropy encoding unit 130 together with the residual value and transmitted to the decoding apparatus.

- the transform unit 115 performs transform on the residual block in units of transform blocks and generates transform coefficients.

- the transform block is a rectangular block of samples to which the same transform is applied.

- the transform block can be a transform unit (TU) and can have a quad tree structure.

- the transformer 115 may perform the transformation according to the prediction mode applied to the residual block and the size of the block.

- the residual block is transformed using a discrete sine transform (DST), otherwise the residual block is transformed into a DCT (Discrete). Can be transformed using Cosine Transform.

- DST discrete sine transform

- DCT Discrete

- the transform unit 115 may generate a transform block of transform coefficients by the transform.

- the quantization unit 120 may generate quantized transform coefficients by quantizing the residual values transformed by the transform unit 115, that is, the transform coefficients.

- the value calculated by the quantization unit 120 is provided to the inverse quantization unit 135 and the reordering unit 125.

- the reordering unit 125 rearranges the quantized transform coefficients provided from the quantization unit 120. By rearranging the quantized transform coefficients, the encoding efficiency of the entropy encoding unit 130 may be increased.

- the reordering unit 125 may rearrange the quantized transform coefficients in the form of a 2D block into a 1D vector form through a coefficient scanning method.

- the entropy encoding unit 130 entropy-codes a symbol according to a probability distribution based on the quantized transform values rearranged by the reordering unit 125 or the encoding parameter value calculated in the coding process, thereby performing a bitstream. You can output The entropy encoding method receives a symbol having various values and expresses it as a decodable column while removing statistical redundancy.

- the symbol means a syntax element, a coding parameter, a value of a residual signal, etc., to be encoded / decoded.

- An encoding parameter is a parameter necessary for encoding and decoding, and may include information that may be inferred in the encoding or decoding process as well as information encoded by an encoding device and transmitted to the decoding device, such as a syntax element. It means the information you need when you do.

- the encoding parameter may be, for example, a value such as an intra / inter prediction mode, a moving / motion vector, a reference image index, a coding block pattern, a residual signal presence, a transform coefficient, a quantized transform coefficient, a quantization parameter, a block size, block partitioning information, or the like. May include statistics.

- the residual signal may mean a difference between the original signal and the prediction signal, and a signal in which the difference between the original signal and the prediction signal is transformed or a signal in which the difference between the original signal and the prediction signal is converted and quantized It may mean.

- the residual signal may be referred to as a residual block in the block unit, and the residual sample in the sample unit.

- Encoding methods such as exponential golomb, context-adaptive variable length coding (CAVLC), and context-adaptive binary arithmetic coding (CABAC) may be used for entropy encoding.

- the entropy encoding unit 130 may store a table for performing entropy encoding, such as a variable length coding (VLC) table, and the entropy encoding unit 130 may store the variable length coding. Entropy encoding can be performed using the (VLC) table.

- the entropy encoding unit 130 derives the binarization method of the target symbol and the probability model of the target symbol / bin, and then uses the derived binarization method or the probability model to entropy. You can also perform encoding.

- the entropy encoding unit 130 may apply a constant change to a parameter set or syntax to be transmitted.

- the inverse quantizer 135 inversely quantizes the quantized values (quantized transform coefficients) in the quantizer 120, and the inverse transformer 140 inversely transforms the inverse quantized values in the inverse quantizer 135.

- the residual value (or the residual sample or the residual sample array) generated by the inverse quantizer 135 and the inverse transform unit 140 and the prediction block predicted by the predictor 110 are added together to reconstruct the sample (or the reconstructed sample array).

- a reconstructed block including a may be generated.

- a reconstructed block is generated by adding a residual block and a prediction block through an adder.

- the adder may be viewed as a separate unit (restore block generation unit) for generating a reconstruction block.

- the filter unit 145 may apply a deblocking filter, an adaptive loop filter (ALF), and a sample adaptive offset (SAO) to the reconstructed picture.

- ALF adaptive loop filter

- SAO sample adaptive offset

- the deblocking filter may remove distortion generated at the boundary between blocks in the reconstructed picture.

- the adaptive loop filter may perform filtering based on a value obtained by comparing the reconstructed image with the original image after the block is filtered through the deblocking filter. ALF may be performed only when high efficiency is applied.

- the SAO restores the offset difference from the original image on a pixel-by-pixel basis for the residual block to which the deblocking filter is applied, and is applied in the form of a band offset and an edge offset.

- the filter unit 145 may not apply filtering to the reconstructed block used for inter prediction.

- the memory 150 may store the reconstructed block or the picture calculated by the filter unit 145.

- the reconstructed block or picture stored in the memory 150 may be provided to the predictor 110 that performs inter prediction.

- the video decoding apparatus 200 includes an entropy decoding unit 210, a reordering unit 215, an inverse quantization unit 220, an inverse transform unit 225, a prediction unit 230, and a filter unit 235.

- Memory 240 may be included.

- the input bitstream may be decoded according to a procedure in which image information is processed in the video encoding apparatus.

- the entropy decoding unit 210 may entropy decode the input bitstream according to a probability distribution to generate symbols including symbols in the form of quantized coefficients.

- the entropy decoding method is a method of generating each symbol by receiving a binary string.

- the entropy decoding method is similar to the entropy encoding method described above.

- VLC variable length coding

- 'VLC' variable length coding

- CABAC CABAC

- the CABAC entropy decoding method receives a bin corresponding to each syntax element in a bitstream, and decodes syntax element information and decoding information of neighboring and decoding target blocks or information of symbols / bins decoded in a previous step.

- the context model may be determined using the context model, the probability of occurrence of a bin may be predicted according to the determined context model, and arithmetic decoding of the bin may be performed to generate a symbol corresponding to the value of each syntax element. have.

- the CABAC entropy decoding method may update the context model by using the information of the decoded symbol / bin for the context model of the next symbol / bean after determining the context model.

- Information for generating the prediction block among the information decoded by the entropy decoding unit 210 is provided to the predictor 230, and a residual value where entropy decoding is performed by the entropy decoding unit 210, that is, a quantized transform coefficient It may be input to the reordering unit 215.

- the reordering unit 215 may reorder the information of the bitstream entropy decoded by the entropy decoding unit 210, that is, the quantized transform coefficients, based on the reordering method in the encoding apparatus.

- the reordering unit 215 may reorder the coefficients expressed in the form of a one-dimensional vector by restoring the coefficients in the form of a two-dimensional block.

- the reordering unit 215 scans the coefficients based on the prediction mode applied to the current block (transform block) and the size of the transform block to generate an array of coefficients (quantized transform coefficients) in the form of a two-dimensional block. Can be.

- the inverse quantization unit 220 may perform inverse quantization based on the quantization parameter provided by the encoding apparatus and the coefficient values of the rearranged block.

- the inverse transform unit 225 may perform inverse DCT and / or inverse DST on the DCT and the DST performed by the transform unit of the encoding apparatus with respect to the quantization result performed by the video encoding apparatus.

- the inverse transformation may be performed based on a transmission unit determined by the encoding apparatus or a division unit of an image.

- the DCT and / or DST in the encoding unit of the encoding apparatus may be selectively performed according to a plurality of pieces of information, such as a prediction method, a size and a prediction direction of the current block, and the inverse transformer 225 of the decoding apparatus may be Inverse transformation may be performed based on the performed transformation information.

- the prediction unit 230 may include prediction samples (or prediction sample arrays) based on prediction block generation related information provided by the entropy decoding unit 210 and previously decoded block and / or picture information provided by the memory 240.

- a prediction block can be generated.

- intra prediction When the prediction mode for the current PU is an intra prediction mode, intra prediction that generates a prediction block based on pixel information in the current picture may be performed.

- inter prediction on the current PU may be performed based on information included in at least one of a previous picture or a subsequent picture of the current picture.

- motion information required for inter prediction of the current PU provided by the video encoding apparatus for example, a motion vector, a reference picture index, and the like, may be derived by checking a skip flag, a merge flag, and the like received from the encoding apparatus.

- a prediction block may be generated such that a residual signal with a current block is minimized and a motion vector size is also minimized.

- the motion information derivation scheme may vary depending on the prediction mode of the current block.

- Prediction modes applied for inter prediction may include an advanced motion vector prediction (AMVP) mode, a merge mode, and the like.

- AMVP advanced motion vector prediction

- the encoding apparatus and the decoding apparatus may generate a merge candidate list by using the motion vector of the reconstructed spatial neighboring block and / or the motion vector corresponding to the Col block, which is a temporal neighboring block.

- the motion vector of the candidate block selected from the merge candidate list is used as the motion vector of the current block.

- the encoding apparatus may transmit, to the decoding apparatus, a merge index indicating a candidate block having an optimal motion vector selected from candidate blocks included in the merge candidate list. In this case, the decoding apparatus may derive the motion vector of the current block by using the merge index.

- the encoding device and the decoding device use a motion vector corresponding to a motion vector of a reconstructed spatial neighboring block and / or a Col block, which is a temporal neighboring block, and a motion vector.

- a predictor candidate list may be generated. That is, the motion vector of the reconstructed spatial neighboring block and / or the Col vector, which is a temporal neighboring block, may be used as a motion vector candidate.

- the encoding apparatus may transmit the predicted motion vector index indicating the optimal motion vector selected from the motion vector candidates included in the list to the decoding apparatus. In this case, the decoding apparatus may select the predicted motion vector of the current block from the motion vector candidates included in the motion vector candidate list using the motion vector index.

- the encoding apparatus may obtain a motion vector difference MVD between the motion vector MV of the current block and the motion vector predictor MVP, and may encode the same and transmit the encoded motion vector to the decoding device. That is, MVD may be obtained by subtracting MVP from MV of the current block.

- the decoding apparatus may decode the received motion vector difference and derive the motion vector of the current block through the addition of the decoded motion vector difference and the motion vector predictor.

- the encoding apparatus may also transmit a reference picture index or the like indicating the reference picture to the decoding apparatus.

- the decoding apparatus may predict the motion vector of the current block using the motion information of the neighboring block, and may derive the motion vector for the current block using the residual received from the encoding apparatus.

- the decoding apparatus may generate a prediction sample (or a prediction sample array) for the current block based on the derived motion vector and the reference picture index information received from the encoding apparatus.

- the decoding apparatus may generate a reconstructed sample (or reconstructed sample array) by adding a predictive sample (or a predictive sample array) and a residual sample (residual sample array) obtained from transform coefficients transmitted from the encoding apparatus. Based on this, a reconstruction block and a reconstruction picture may be generated.

- the motion information of the reconstructed neighboring block and / or the motion information of the call block may be used to derive the motion information of the current block.

- the encoding apparatus does not transmit syntax information such as residual to the decoding apparatus other than information indicating which block motion information to use as the motion information of the current block.

- the reconstruction block may be generated using the prediction block generated by the predictor 230 and the residual block provided by the inverse transform unit 225.

- the reconstructed block is generated by combining the prediction block and the residual block in the adder.

- the adder may be viewed as a separate unit (restore block generation unit) for generating a reconstruction block.

- the reconstruction block includes a reconstruction sample (or reconstruction sample array) as described above

- the prediction block includes a prediction sample (or a prediction sample array)

- the residual block is a residual sample (or a residual sample). Array).

- a reconstructed sample (or reconstructed sample array) may be expressed as the sum of the corresponding predictive sample (or predictive sample array) and the residual sample (residual sample array).

- the residual is not transmitted for the block to which the skip mode is applied, and the prediction block may be a reconstruction block.

- the reconstructed block and / or picture may be provided to the filter unit 235.

- the filter unit 235 may apply deblocking filtering, sample adaptive offset (SAO), and / or ALF to the reconstructed block and / or picture.

- SAO sample adaptive offset

- the memory 240 may store the reconstructed picture or block to use as a reference picture or reference block and provide the reconstructed picture to the output unit.

- Components directly related to the decoding of an image for example, an entropy decoding unit 210, a reordering unit 215, an inverse quantization unit 220, an inverse transform unit 225, a prediction unit 230, and a filter unit ( 235) and the like may be distinguished from other components by a decoder or a decoder.

- the decoding apparatus 200 may further include a parsing unit (not shown) for parsing information related to the encoded image included in the bitstream.

- the parsing unit may include the entropy decoding unit 210 or may be included in the entropy decoding unit 210. Such a parser may also be implemented as one component of the decoder.

- the motion vector for the current block can be derived, and the prediction samples for the current block can be derived using the reconstructed samples of the reference block indicated by the motion vector on the reference picture.

- the MV of the best merge candidate among the merge candidate lists generated based on the candidate blocks is used as the MV for the current block.

- the encoding apparatus encodes merge index information indicating the selected merge candidate in the merge candidate list and transmits the merge index information to the decoding apparatus through a bitstream.

- the decoding apparatus may derive the MV of the merge candidate block selected from the merge candidate list as the MV for the current block based on the merge index information transmitted from the encoding apparatus.

- the encoding apparatus may derive the reference block on the reference picture based on the MV of the current block and use the reference block as a prediction block for the current block. That is, samples in the reference block may be used as prediction samples for the current block.

- an optimal MVP for the current block is selected from an MVP candidate list including motion vector predictor (MVP) candidates derived from candidate blocks.

- the encoding apparatus derives an optimal MVP from the MVP candidate list based on the MV of the current block derived by performing motion estimation, and calculates an MVD obtained by subtracting the MVP from the MV.

- the encoding apparatus encodes the bitstream by encoding MVP index information indicating which MVP candidate is the MVP for the current block among the MVP candidates included in the MVP candidate list, and MVD information indicating the x-axis value and the y-axis value of the obtained MVD. Through the transmission to the decoding device.

- the decoding apparatus may derive the MVP for the current block from the MVP candidate list based on the MVP index information and the MVD information transmitted from the encoding apparatus, and derive the MV of the current block by adding the MVD to the derived MVP.

- a reference block on a reference picture may be derived based on the MV of the current block, and the reference block may be used as a prediction block for the current block. That is, samples in the reference block may be used as prediction samples for the current block.

- the decoding apparatus may receive the information about the residual sample from the encoding apparatus to generate the residual samples.

- the information about the residual sample may include information about transform coefficients.

- the decoding apparatus may receive transform coefficients from the encoding apparatus through a bitstream, and inversely transform the transform coefficients to generate a residual block (or residual samples).

- the residual sample may indicate a difference between the original sample and the prediction sample

- the residual block may indicate a difference between the original block including the original samples and the prediction block including the prediction samples.

- the prediction performance is improved, the data amount for the residual signal can be reduced, thereby improving the overall coding efficiency.

- the present invention in order to reduce the amount of data for the residual signal by increasing the performance of motion estimation and motion compensation, it is more similar to the current picture (or more useful for prediction performance) than a general reference picture.

- Virtual reference pictures can be created and used. Through this, an image compression ratio improvement effect can be obtained.

- a reference picture For inter picture coding, that is, inter prediction, a reference picture is required.

- previously decoded pictures i.e., reconstructed pictures that precede the current picture in decoding order

- DPB decoded picture buffer

- the DPB may be included in the memory of the encoding device / decoding device described above. Some pictures of the reconstructed pictures stored in the DBP may be used as reference pictures for the current picture.

- 3 exemplarily shows DPB and reference pictures for inter prediction.

- 0, 1, 2, 3, 4, and 5 indicate an output order of decoded pictures.

- various numbers of reference pictures may be used according to DPB sizes allowed by the decoding apparatus.

- 3 shows an example in which pictures 0, 3, 4, and 5 are used as reference pictures of the current picture.

- the prediction within the current picture instead of inter prediction (even if the motion vector is considered) You will be more likely to choose intra prediction.

- the intra prediction requires a higher cost than the inter prediction. Therefore, when intra prediction is applied, the compression ratio is lower than that when the inter prediction is applied. Examples of the above-described low correlation between the current picture and reference pictures include complex motions that cannot be represented as translation motions between pictures, severely different focusing / defocusing, or sudden changes in brightness. There may be a variety of cases, such as occurs.

- a virtual reference picture (VRP) having a high correlation with the current picture is temporarily generated by using various methods, and interlinked with the current block.

- the existing reference picture may be called an original reference picture separately from the virtual reference picture.

- the generated virtual reference picture may not be stored in the DPB and may be removed after the current picture is encoded / decoded.

- the generated virtual reference picture may be stored in the DPB to perform a series of predetermined procedures after the current picture is encoded / decoded. It may therefore be marked as "unused for reference” and then removed.

- pictures 0, 3, 4, and 5 which are original reference pictures are reference pictures configured according to a reference picture set (RPS) in a DPB, and pictures 0 ', 3', 4 ', and 5' are original pictures.

- the virtual reference pictures are temporarily generated to increase the compression efficiency of the current picture from the reference pictures.

- These virtual reference pictures may be removed from memory after encoding / decoding the current picture and may not be used when encoding / decoding other pictures.

- Advantages of using such a virtual reference picture include: i) temporary creation of various types of virtual reference pictures, and ii) compression efficiency of the current picture by using a virtual reference picture with high correlation with the current picture. (Ie, coding efficiency), and iii) DPB memory usage may not increase even if the number of total reference pictures increases due to the virtual reference pictures. Therefore, based on these advantages, the coding efficiency can be improved without major changes to the existing system architecture.

- FIG. 5 shows a decoding procedure considering a virtual reference picture.

- the decoding apparatus parses VRP_use_flag (S500).

- the VRP_use_flag indicates whether to use a virtual reference picture (VRP) when decoding.

- the VRP_use_flag is a syntax element and is a video parameter set (VPS) syntax, a sequence parameter set (SPS) syntax, a picture parameter set (PPS) syntax, or a tile parameter set. It can be transmitted through various parameter set syntaxes such as (tile parameter set, TPS) syntax.

- the parameter sets may be received via a bitstream, and the decoding apparatus may parse and obtain the VRP_use_flag from the bitstream.

- the bitstream may be received from an encoding device via a network or a storage medium.

- the decoding apparatus configures a reference picture set (RPS) for inter prediction (S510).

- RPS may include original reference pictures for inter prediction of the current picture.

- the original reference pictures may be reconstructed (or decoded) pictures that precede the decoding picture in the decoding order as described above.

- the decoding apparatus checks whether the value of the VRP_use_flag is 1 (S520). If the value of the VRP_use_flag is 1 in S520, the decoding apparatus parses VRP information from the bitstream (S530) and generates a VRP based on the VRP information (S540).

- the VRP information is information necessary for the decoding apparatus to generate the VRP, and may include homography matrix related information or illuminance compensation information, which will be described later.

- the decoding apparatus may generate one or more VRPs based on the VRP information.

- the decoding apparatus adds the generated VRP to the RPS (S550), and decodes the blocks within the current slice or the current picture based on the RPS to which the VRP is added (S560).

- decoding the blocks may include generating reconstructed samples for the blocks.

- decoding may be performed using the VRP on prediction units (PUs) included in the current slice or the current picture.

- PUs prediction units

- the temporarily generated VRP may be removed from the memory and the decoding procedure may be completed.

- the decoding apparatus decodes the current slice or blocks in the current picture based on the RPS to which the VRP is not added (S560).

- the performance of inter prediction may be improved based on the virtual reference picture, the amount of data allocated to the residual signal may be reduced, and the overall coding efficiency may be improved.

- inter prediction may be performed in units of PUs. That is, a motion vector may be obtained by using a PU as a current block, and prediction samples of the current block may be generated based on reconstructed samples of the reference block indicated by the motion vector on the original / virtual reference picture indicated by the reference picture index.

- one or a plurality of PUs may be partitioned from a CU. In this case, for example, whether inter prediction or intra prediction is applied may be determined in units of CUs.

- a specific inter prediction mode for example, a merge mode or an AMVP mode, is applied Whether or not may be determined in units of PUs.

- the reference picture index for the current block may be obtained from a neighboring block.

- the reference picture index for the current block may be signaled from the encoding apparatus.

- the reference picture index may indicate an original / virtual reference picture used for inter prediction of the current block in a reference picture set (or reference picture list).

- the reference picture index for the VRP may be determined as follows.

- the reference picture index for the VRP may have a higher value than the reference picture index for the original reference pictures.

- the original reference pictures may be first indexed based on picture order count (POC) and then indexed for VRP.

- POC picture order count

- reference picture indexes of original reference pictures 0, 3, 4, and 5 of the current block in FIG. 4 are 3, 2, 1, and 0, respectively, 0 ', 3', 4 ', and 5' VRP.

- the reference picture indexes of these may be assigned 7, 6, 5, 4. Therefore, when the current block performs inter prediction using one of the 0 ', 3', 4 ', and 5' VRPs, one of reference picture indexes 7, 6, 5, and 4 may be indicated for the current block. have.

- a separate reference picture index may not be allocated to the VRP, and the VRP may be indicated by signaling a separate flag on a PU basis.

- pu_VRP_use_flag may be transmitted in units of PUs, thereby indicating whether a value of a reference picture index indicates an original reference picture or a virtual reference picture. For example, when a value of pu_VRP_use_flag is 0, a reference picture index of any value may indicate an original reference picture, and when a value of pu_VRP_use_flag is 1, a reference picture index of any value may indicate a virtual reference picture. For example, it may be assumed that the reference picture index of the original reference picture 5 is 0 in FIG. 4.

- the reference picture index 0 may indicate the original reference picture 5

- the reference picture index 0 may indicate the virtual reference picture 5 '. .

- the VRP information for generating the above-described VRP includes the following, for example.

- the encoding apparatus may generate a VRP based on a homography transform, and in this case, the homography transform-related information, such as the following equation, may be included in the VRP information.

- a total of eight coefficients h11 to h32 in the homography matrix may be encoded into the VRP information and transmitted to the decoding apparatus.

- the decoding apparatus may restore the homography matrix based on the coefficients, and generate a virtual reference picture corresponding to the original reference picture by using samples according to each (x, y) coordinate in the original reference picture. .

- the coefficients may not be directly signaled, but may transmit location information mapped using a mapping relationship of the following feature points.

- c00 to c11 indicate positions of four corners of the current picture.

- R00 to r11 on the original reference picture correspond to c00 to c11, respectively.

- the r00 to r11 represent points at which the c00 to c11 are homography converted by the homography matrix.

- the decoding apparatus may generate a homography matrix based on the location information.

- the position information of 00 to r11 is not encoded and transmitted as it is. Instead, the difference value between c00 and r00, the difference value between c01 and r01, the difference value between c02 and r02, and the difference value between c03 and r03 are coded. Therefore, more efficient VRP information transmission is possible by reducing the amount of information to be coded.

- corresponding points in the original reference picture are obtained based on the current picture.

- a position corresponding to four corners of the original reference picture is determined by the homography matrix. It may also transmit the location information about whether matches.

- the encoding apparatus and the decoding apparatus may generate the VRP based on the homography related information.

- the encoding apparatus and the decoding apparatus may generate the VRP through the following procedure based on the derived homography matrix. Can be.

- FIG. 7 shows an example of a virtual reference picture generation procedure according to the present invention.

- the pel to be generated when the pel to be produced is located at or closest to the fractional pel position, the pel to be generated through interpolation of the surrounding integer pels of the fractional pel position. be generated) '.

- various interpolation methods may be used.

- the pels to be generated may be generated through 2D bi-cubic filtering using 36 integer pels around the fountain pel position. have.

- a pel of finer fractional pel position may be generated through bi-linear filtering.

- the fractional pel value may be calculated as in the following equation.

- Pel represents the value of the fractional pel (or the value of the pel to be produced).

- x0 represents the distance from the fountain pel position to the half pel a

- y0 represents the distance from the fountain pel position to the half pel b.

- the encoding apparatus may generate a VRP based on illumination compensation, and in this case, the VRP information may include information on illumination compensation or change.

- the illuminance compensation equation may be represented, for example, as follows.

- Y represents luminance / chrominance information of the current picture

- X represents luminance / color difference information of the original reference picture.

- a and b correspond to weights and offsets, respectively, and a and b may be values representing the entire picture or may be assigned different values for each region.

- a and b may be obtained based on a relationship between a corresponding reference block in consideration of a PU and a motion vector. In this case, an average or median of weight and offset values for all PUs in the picture or region may be obtained. The a and b may be obtained based on the median) value.

- the filter information related thereto may be included in the VRP information.

- the generated VRP may be inserted at various positions of the previously generated reference picture set (VPS) or the reference picture list.

- VRP previously generated reference picture set

- the VRP may be inserted at the first position of the reference picture set or the reference picture list (ie, reference picture index 0).

- the VRP may be positioned at the end of the reference picture set or the reference picture list to reduce the amount of bits consumed in the reference picture index.

- the configuration of the reference picture set or the reference picture list may be determined by the encoding apparatus, and may be indicated at a picture level or a slice level.

- FIG. 8 exemplarily shows a reference picture set or a reference picture list structure.

- a warped ref picture corresponds to the above-described virtual reference picture.

- the virtual reference picture may be inserted at the last position (or after the original reference pictures) of the reference picture set or reference picture list as shown, or may be inserted at the first position of the reference picture set or the reference picture list. have.

- the encoding apparatus inserts the virtual reference picture at various positions of the reference picture set or the reference picture list to perform performance evaluation through encoding, and then selects an optimal position to insert the virtual reference picture. Derived and may transmit the position information of the virtual reference picture to the decoding device. The decoding apparatus may insert the virtual reference picture into the reference picture set or the reference picture list based on the received position information of the virtual reference picture.

- the location information of the virtual reference picture may be transmitted in the form of a syntax element, and the syntax element may be transmitted at a slice level or a picture level.

- the location information of the virtual reference picture may correspond to a VRP_pos_in_rps (or VRP_pos_in_rpl) syntax element.

- the syntax element indicates the position of the virtual reference picture in a reference picture set (or list). If the value of the aforementioned VRP_use_flag is 0, the VRP_pos_in_rps (or VRP_pos_in_rpl) syntax element may not be transmitted.

- FIG. 9 schematically illustrates an example of an image coding method according to the present invention.

- the method disclosed in FIG. 9 may be performed by an encoding device.

- the encoding apparatus configures a reference picture set (RPS) for the current picture (S900).

- the reference picture set may include reconstructed (or decoded) pictures preceding the current picture in decoding order as original reference pictures.

- the encoding apparatus generates a virtual reference picture corresponding to the original reference picture in the reference picture (S910).

- the virtual reference picture may be generated based on a homography transform on the original reference picture.

- the homography transformation is performed based on a homography matrix, and the homography matrix may be derived based on the positional relationship between four corner pixels of the current picture and corresponding pixels of the original reference picture.

- the encoding apparatus may encode the VRP information including the position information of the corresponding pixels and output the encoded VRP information in the form of a bitstream.

- the location information of the pixels may include a difference value between the P1 and the P2.

- the VRP information may include coefficients of the homography matrix.

- the virtual reference picture may be generated based on illumination compensation of the original reference picture.

- the VRP information may include a weight value and an offset value for the illumination compensation.

- the encoding apparatus derives a motion vector for the current block in the current picture based on the virtual picture and generates a predictive sample (prediction sample array) (S920). In this case, the encoding apparatus may determine whether inter prediction is applied to the current block, and if inter prediction is applied to the current block, determine whether a merge mode or an AMVP mode is applied as a specific inter prediction mode. The encoding apparatus may derive the reference block most similar to the current block based on the motion estimation and the like, and may derive an optimal motion vector for the current block.

- a predictive sample prediction sample array

- the encoding apparatus may construct a reference picture list including the virtual reference picture.

- the encoding apparatus may set a reference picture index to point to the virtual reference picture on the reference picture list. If the inter prediction mode for the current block is an AMVP mode, the encoding apparatus may encode and output a syntax element related to the reference picture index in the bitstream form.

- the reference picture list may include a plurality of original reference pictures and the virtual reference picture.

- the index of the virtual reference picture may have a lower value than the indexes of the original reference pictures.

- the reference picture index indicating the virtual reference picture may indicate 0.

- the index of the virtual reference picture may have a higher value than the indexes of the original reference pictures based on an RD cost.

- the encoding apparatus may set a value of a pu_VRP_use_flag syntax element and output the pu_VRP_use_flag syntax element through the bitstream.

- the reference picture list may include the original reference picture and the virtual reference picture. In this case, when the value of the pu_VRP_use_flag syntax element is 1, the reference picture index indicates the virtual reference picture and the value of the pu_VRP_use_flag syntax element. If 0, the reference picture index may indicate the original reference picture.

- the encoding apparatus derives a residual sample (or residual sample array) for the current block based on the original sample and the prediction sample for the current block (S930).

- the encoding apparatus encodes and outputs the information about the motion vector and the information about the residual sample (S940).

- the encoding device may encode the information and output the encoded information in the form of the bitstream.

- the bitstream may be transmitted to a decoding apparatus via a network or a storage medium.

- the information about the motion vector may include a merge index when the inter prediction mode for the current block is a merge mode.

- the information about the motion vector may include an mvp index and a motion vector difference (MVD) when the inter prediction mode for the current block is an AMVP mode.

- the information about the residual sample may include transform coefficients regarding the residual sample.

- the encoding apparatus may set a value of a VRP_use_flag syntax element based on whether the virtual reference picture is available and output the VRP_use_flag syntax element through the bitstream.

- the encoding apparatus may set a value of a VRP_pos_in_rps syntax element indicating a position of the virtual reference picture in the reference picture set, and output the VRP_pos_in_rps syntax element through the bitstream.

- the VRP_pos_in_rps syntax element may be transmitted only when the value of the VRP_use_flag syntax element is 1.

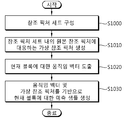

- FIG. 10 schematically illustrates an example of an inter prediction method according to the present invention.

- the method disclosed in FIG. 10 may be performed by a decoding apparatus.

- the decoding apparatus configures a reference picture set for a current picture (S1000).

- the reference picture set may include reconstructed (or decoded) pictures preceding the current picture in decoding order as original reference pictures.

- the decoding apparatus generates a virtual reference picture corresponding to the original reference picture in the reference picture (S1010).

- the decoding apparatus may implicitly generate the virtual reference picture through the same reference as the encoding apparatus, or may obtain VRP information from the bitstream and generate the most reference picture based on the VRP information.

- the virtual reference picture may be generated based on a homography transform on the original reference picture.

- the homography transformation is performed based on a homography matrix, and the homography matrix may be derived based on the positional relationship between four corner pixels of the current picture and corresponding pixels of the original reference picture.

- the VRP information may include location information of the corresponding pixels.

- the VRP information may include coefficients of the homography matrix.

- the virtual reference picture may be generated based on illumination compensation of the original reference picture.

- the VRP information may include a weight value and an offset value for the illumination compensation.

- the decoding apparatus may parse and acquire a VRP_use_flag syntax element from the bitstream.

- the decoding apparatus may generate the virtual reference picture when the value of the VRP_use_flag syntax element is 1.

- the decoding apparatus may parse and acquire, from the bitstream, a VRP_pos_in_rps syntax element indicating the position of the virtual reference picture within the reference picture set.

- the VRP_pos_in_rps syntax element may be parsed and obtained only when the value of the VRP_use_flag syntax element is 1.

- the decoding apparatus derives a motion vector for the current block in the current picture (S1020).

- the decoding apparatus may use the motion vector of one of the merge candidate lists as the motion vector of the current block (in the case of merge mode), or use the motion vector of the motion vector predictor candidate list as the motion vector predictor.

- the MVD obtained from the bitstream may be added to a vector predictor to derive a motion vector of the current block (in case of AMVP mode).

- Information about the inter prediction mode may be obtained through the bitstream.

- the decoding apparatus may construct a reference picture list including the virtual reference picture.

- the decoding apparatus may derive a reference picture index for the current block.

- the reference picture index may be derived based on the reference picture index of the merge candidate selected from the merge candidate list (in case of merge mode), or may parse and obtain a syntax element regarding the reference picture index from the bitstream.

- the reference picture list may include a plurality of original reference pictures and the virtual reference picture.

- the index of the virtual reference picture may have a lower value than the indexes of the original reference pictures.

- the reference picture index indicating the virtual reference picture may indicate 0.

- the index of the virtual reference picture may have a higher value than the indexes of the original reference pictures based on an RD cost.

- the decoding apparatus may parse and acquire a pu_VRP_use_flag syntax element from the bitstream.

- the reference picture list may include the original reference picture and the virtual reference picture.

- the reference picture index indicates the virtual reference picture and the value of the pu_VRP_use_flag syntax element. If 0, the reference picture index may indicate the original reference picture.

- the decoding apparatus generates a prediction sample (or a prediction sample array) for the current block based on the derived motion vector of the current block and the virtual reference picture (S1030).

- the decoding apparatus may derive a reference block indicated by the motion vector on the virtual reference picture, and use a reconstructed sample in the reference block as a prediction sample for the current block.

- the decoding device may receive information about the residual sample for the current block from the bitstream.

- the information about the residual sample may include transform coefficients regarding the residual sample.

- the decoding apparatus may derive the residual sample (or residual sample array) for the current block based on the information about the residual sample.

- the decoding apparatus may generate a reconstructed sample based on the prediction sample and the residual sample, and may derive a reconstructed block or a reconstructed picture based on the reconstructed sample. Thereafter, as described above, the decoding apparatus may apply an in-loop filtering procedure, such as a deblocking filtering and / or SAO procedure, to the reconstructed picture in order to improve subjective / objective picture quality as necessary.

- an in-loop filtering procedure such as a deblocking filtering and / or SAO procedure

- the performance of inter prediction can be improved based on a virtual reference picture that is more correlated with the current picture, thereby reducing the amount of data allocated to the residual signal and improving the overall coding efficiency. have.

- the above-described method may be implemented as a module (process, function, etc.) for performing the above-described function.

- the module may be stored in memory and executed by a processor.

- the memory may be internal or external to the processor and may be coupled to the processor by various well known means.

- the processor may include application-specific integrated circuits (ASICs), other chipsets, logic circuits, and / or data processing devices.

- the memory may include read-only memory (ROM), random access memory (RAM), flash memory, memory card, storage medium and / or other storage device.

Abstract

본 발명에 따른 디코딩 장치에 의하여 수행되는 인터 예측 방법은 현재 픽처에 대한 참조 픽처 세트를 구성하는 단계, 상기 참조 픽처 세트 내의 원본 참조 픽처에 대응하는 가상 참조 픽처를 생성하는 단계, 상기 현재 픽처 내의 현재 블록에 대한 움직임 벡터를 도출하는 단계, 및 상기 움직임 벡터 및 상기 가상 참조 픽처를 기반으로 상기 현재 블록에 대한 예측 샘플을 생성하는 단계를 포함함을 특징으로 한다. 본 발명에 따르면, 현재 픽처와 보다 상관관계가 높은 가상 참조 픽처를 기반으로 인터 예측의 성능을 높일 수 있으며, 이를 통하여 레지듀얼 신호에 할당되는 데이터량을 줄이고, 전반적인 코딩 효율을 향상시킬 수 있다.

Description

본 발명은 비디오 코딩 기술에 관한 것으로서 보다 상세하게는 비디오 코딩 시스템에서 가상 참조 픽처 기반 인터 예측 방법 및 장치에 관한 것이다.

최근 HD(High Definition) 영상 및 UHD(Ultra High Definition) 영상과 같은 고해상도, 고품질의 영상에 대한 수요가 다양한 분야에서 증가하고 있다. 영상 데이터가 고해상도, 고품질이 될수록 기존의 영상 데이터에 비해 상대적으로 전송되는 정보량 또는 비트량이 증가하기 때문에 기존의 유무선 광대역 회선과 같은 매체를 이용하여 영상 데이터를 전송하거나 기존의 저장 매체를 이용해 영상 데이터를 저장하는 경우, 전송 비용과 저장 비용이 증가된다.

이에 따라, 고해상도, 고품질 영상의 정보를 효과적으로 전송하거나 저장하고, 재생하기 위해 고효율의 영상 압축 기술이 요구된다.

본 발명의 기술적 과제는 비디오 코딩 효율을 높이는 방법 및 장치를 제공함에 있다.

본 발명의 다른 기술적 과제는 인터 예측 성능을 높이는 방법 및 장치를 제공함에 있다.

본 발명의 또 다른 기술적 과제는 가상 참조 픽처를 생성하는 방법 및 장치를 제공함에 있다.

본 발명의 또 다른 기술적 과제는 가상 참조 픽처를 활용하여 예측 신호의 정확도를 높임에 있다.

본 발명의 또 다른 기술적 과제는 호모그래피(homography) 정보를 이용하여 가상 참조 픽처를 생성하는 방법 및 장치를 제공함에 있다.

본 발명의 또 다른 기술적 과제는 필터링을 통하여 가상 참조 픽처를 생성하는 방법 및 장치를 제공함에 있다.

본 발명의 또 다른 기술적 과제는 가상 참조 픽처를 관리하는 방법 및 장치를 제공함에 있다.

본 발명의 일 실시예에 따르면, 디코딩 장치에 의하여 수행되는 인터 예측 방법을 제공한다. 상기 인터 예측 방법은 현재 픽처에 대한 참조 픽처 세트(reference picture set)를 구성하는 단계, 상기 참조 픽처 세트 내의 원본 참조 픽처(original reference picture)에 대응하는 가상 참조 픽처(virtual reference picture)를 생성하는 단계, 상기 현재 픽처 내의 현재 블록에 대한 움직임 벡터를 도출하는 단계, 및 상기 움직임 벡터 및 상기 가상 참조 픽처를 기반으로 상기 현재 블록에 대한 예측 샘플을 생성하는 단계를 포함함을 특징으로 한다.

본 발명의 다른 일 실시예에 따르면, 인터 예측을 수행하는 디코딩 장치를 제공한다. 상기 디코딩 장치는 비트스트림으로부터 현재 블록에 대한 인터 예측 모드에 관한 정보를 획득하는 디코딩부, 현재 픽처에 대한 참조 픽처 세트(reference picture set)를 구성하고, 상기 참조 픽처 세트 내의 원본 참조 픽처(original reference picture)에 대응하는 가상 참조 픽처(virtual reference picture)를 생성하고, 상기 현재 픽처 내의 상기 현재 블록에 대한 움직임 벡터를 도출하고, 및 상기 움직임 벡터 및 상기 가상 참조 픽처를 기반으로 상기 현재 블록에 대한 예측 샘플을 생성하는 예측부를 포함함을 특징으로 한다.

본 발명의 또 다른 일 실시예에 따르면, 인코딩 장치에 의하여 수행되는 영상 인코딩 방법이 제공된다. 상기 영상 인코딩 방법은 현재 픽처에 대한 참조 픽처 세트(reference picture set)를 구성하는 단계, 상기 참조 픽처 세트 내의 원본 참조 픽처(original reference picture)에 대응하는 가상 참조 픽처(virtual reference picture)를 생성하는 단계, 상기 가상 참조 픽처를 기반으로 상기 현재 픽처 내의 현재 블록에 대한 움직임 벡터 및 예측 샘플을 도출하는 단계, 상기 현재 블록에 대한 원본 샘플 및 상기 예측 샘플을 기반으로 레지듀얼 샘플을 도출하는 단계, 및 상기 움직임 벡터에 관한 정보 및 상기 레지듀얼 샘플에 관한 정보를 인코딩하여 출력하는 단계를 포함함을 특징으로 한다.

본 발명의 또 다른 일 실시예에 따르면, 영상 인코딩을 수행하는 인코딩 장치가 제공된다. 상기 인코딩 장치는 현재 픽처에 대한 참조 픽처 세트(reference picture set)를 구성하는 단계, 상기 참조 픽처 세트 내의 원본 참조 픽처(original reference picture)에 대응하는 가상 참조 픽처(virtual reference picture)를 생성하고, 상기 가상 참조 픽처를 기반으로 상기 현재 픽처 내의 현재 블록에 대한 움직임 벡터 및 예측 샘플을 도출하고, 상기 현재 블록에 대한 원본 샘플 및 상기 예측 샘플을 기반으로 레지듀얼 샘플을 도출하는 예측부, 및 상기 움직임 벡터에 관한 정보 및 상기 레지듀얼 샘플에 관한 정보를 인코딩하여 출력하는 인코딩부를 포함함을 특징으로 한다.

본 발명에 따르면, 현재 픽처와 보다 상관관계가 높은 가상 참조 픽처를 기반으로 인터 예측의 성능을 높일 수 있으며, 이를 통하여 레지듀얼 신호에 할당되는 데이터량을 줄이고, 전반적인 코딩 효율을 향상시킬 수 있다.

도 1은 본 발명의 일 실시예에 따른 비디오 인코딩 장치를 개략적으로 도시한 블록도이다.

도 2는 본 발명의 일 실시예에 따른 비디오 디코딩 장치를 개략적으로 도시한 블록도이다.

도 3은 인터 예측을 위한 DPB 및 참조 픽처들을 예시적으로 나타낸다.

도 4는 가상 참조 픽처에 대한 개념을 예시적으로 나타낸다.

도 5는 가상 참조 픽처를 고려하는 디코딩 절차를 나타낸다.

도 6은 호모그래피 메트릭스에 따른 현재 픽처와 원본 참조 픽처 간 매핑관계를 나타낸다.

도 7은 본 발명에 따른 가상 참조 픽처 생성 절차의 일 예를 나타낸다.

도 8은 참조 픽처 세트 또는 참조 픽처 리스트 구성을 예시적으로 나타낸다.

도 9는 본 발명에 따른 영상 코딩 방법의 일 예를 개략적으로 나타낸다.

도 10은 본 발명에 따른 인터 예측 방법의 일 예를 개략적으로 나타낸다.

본 발명은 다양한 변경을 가할 수 있고 여러 가지 실시예를 가질 수 있는 바, 특정 실시예들을 도면에 예시하고 상세하게 설명하고자 한다. 그러나, 이는 본 발명을 특정한 실시 형태에 대해 한정하려는 것이 아니다. 본 명세서에서 사용하는 용어는 단지 특정한 실시예를 설명하기 위해 사용된 것으로, 본 발명의 기술적 사상을 한정하려는 의도로 사용되는 것은 아니다. 단수의 표현은 문맥상 명백하게 다르게 뜻하지 않는 한, 복수의 표현을 포함한다. 본 명세서에서, "포함하다" 또는 "가지다" 등의 용어는 명세서상에 기재된 특징, 숫자, 단계, 동작, 구성 요소, 부품 또는 이들을 조합한 것이 존재함을 지정하려는 것이지, 하나 또는 그 이상의 다른 특징들이나 숫자, 단계, 동작, 구성 요소, 부품 또는 이들을 조합한 것들의 존재 또는 부가 가능성을 미리 배제하지 않는 것으로 이해되어야 한다.

한편, 본 발명에서 설명되는 도면상의 각 구성들은 비디오 인코딩 장치/디코딩 장치에서 서로 다른 특징적인 기능들에 관한 설명의 편의를 위해 독립적으로 도시된 것으로서, 각 구성들이 서로 별개의 하드웨어나 별개의 소프트웨어로 구현된다는 것을 의미하지는 않는다. 예컨대, 각 구성 중 두 개 이상의 구성이 합쳐져 하나의 구성을 이룰 수도 있고, 하나의 구성이 복수의 구성으로 나뉘어질 수도 있다. 각 구성이 통합 및/또는 분리된 실시예도 본 발명의 본질에서 벗어나지 않는 한 본 발명에 포함된다.

이하, 첨부한 도면들을 참조하여, 본 발명의 실시예를 보다 상세하게 설명하고자 한다.

도 1은 본 발명의 일 실시예에 따른 비디오 인코딩 장치를 개략적으로 도시한 블록도이다.

도 1을 참조하면, 인코딩 장치(100)는 픽처 분할부(105), 예측부(110), 변환부(115), 양자화부(120), 재정렬부(125), 엔트로피 인코딩부(130), 역양자화부(135), 역변환부(140), 필터부(145) 및 메모리(150)를 구비한다.

픽처 분할부(105)는 입력된 픽처를 적어도 하나의 처리 단위 블록으로 분할할 수 있다. 이때, 처리 단위로서의 블록은 예측 유닛(Prediction Unit, PU)일 수도 있고, 변환 유닛(Transform Unit, TU)일 수도 있으며, 코딩 유닛(Coding Unit, CU)일 수도 있다. 픽처는 복수의 코딩 트리 유닛(Coding Tree Unit, CTU)들로 구성될 수 있으며, 각각의 CTU는 쿼드 트리(quad-tree) 구조로 CU들로 분할(split)될 수 있다. CU는 보다 하위(deeper) 뎁스의 CU들로 쿼드 트리 구조로 분할될 수도 있다. PU 및 TU는 CU로부터 획득될 수 있다. 예를 들어, PU는 CU로부터 대칭 또는 비대칭 사각형 구조로 파티셔닝(partitioning)될 수 있다. 또한 TU는 CU로부터 쿼드 트리 구조로 분할될 수도 있다. CTU는 CTB(coding tree block)에 대응될 수 있고, CU는 CB(coding block)에 대응될 수 있고, PU는 PB(prediction block)에 대응될 수 있고, TU는 TB(transform block)에 대응될 수 있다.

예측부(110)는 후술하는 바와 같이, 인터 예측을 수행하는 인터 예측부와 인트라 예측을 수행하는 인트라 예측부를 포함한다. 예측부(110)는, 픽처 분할부(105)에서 픽처의 처리 단위에 대하여 예측을 수행하여 예측 샘플(또는 예측 샘플 어레이)을 포함하는 예측 블록을 생성한다. 예측부(110)에서 픽처의 처리 단위는 CU일 수도 있고, TU일 수도 있고, PU일 수도 있다. 또한, 예측부(110)는 해당 처리 단위에 대하여 실시되는 예측이 인터 예측인지 인트라 예측인지를 결정하고, 각 예측 방법의 구체적인 내용(예컨대, 예측 모드 등)을 정할 수 있다. 이때, 예측이 수행되는 처리 단위와 예측 방법 및 예측 방법의 구체적인 내용이 정해지는 처리 단위는 다를 수 있다. 예컨대, 예측의 방법과 예측 모드 등은 PU 단위로 결정되고, 예측의 수행은 TU 단위로 수행될 수도 있다.

인터 예측을 통해서는 현재 픽처의 이전 픽처 및/또는 이후 픽처 중 적어도 하나의 픽처의 정보를 기초로 예측을 수행하여 예측 블록을 생성할 수 있다. 또한, 인트라 예측을 통해서는 현재 픽처 내의 픽셀 정보를 기초로 예측을 수행하여 예측 블록을 생성할 수 있다.

인터 예측의 방법으로서, 스킵(skip) 모드, 머지(merge) 모드, AMVP(Advanced Motion Vector Prediction) 등을 이용할 수 있다. 인터 예측에서는 PU에 대하여, 참조 픽처를 선택하고 PU에 대응하는 참조 블록을 선택할 수 있다. 참조 블록은 정수 픽셀(또는 샘플) 또는 분수 픽셀(또는 샘플) 단위로 선택될 수 있다. 이어서, PU와의 레지듀얼(residual) 신호가 최소화되며 움직임 벡터 크기 역시 최소가 되는 예측 블록이 생성된다. 본 명세서에서 픽셀(pixel), 펠(pel) 및 샘플(sample)은 서로 혼용될 수 있다.

예측 블록은 정수 픽셀 단위로 생성될 수도 있고, 1/2 픽셀 단위 또는 1/4 픽셀 단위와 같이 정수 이하 픽셀 단위로 생성될 수도 있다. 이때, 움직임 벡터 역시 정수 픽셀 이하의 단위로 표현될 수 있다.

인터 예측을 통해 선택된 참조 픽처의 인덱스, 움직임 벡터 차분(motion vector difference, MVD), 움직임 벡터 예측자(motion vector predictor, MVP), 레지듀얼 신호 등의 정보는 엔트로피 인코딩되어 디코딩 장치에 전달될 수 있다. 스킵 모드가 적용되는 경우에는 예측 블록을 복원 블록으로 할 수 있으므로, 레지듀얼을 생성, 변환, 양자화, 전송하지 않을 수 있다.

인트라 예측을 수행하는 경우에는, PU 단위로 예측 모드가 정해져서 PU 단위로 예측이 수행될 수 있다. 또한, PU 단위로 예측 모드가 정해지고 TU 단위로 인트라 예측이 수행될 수도 있다.

인트라 예측에서 예측 모드는 예를 들어 33개의 방향성 예측 모드와 적어도 2개 이상의 비방향성 모드를 가질 수 있다. 비방향성 모드는 DC 예측 모드 및 플래너 모드(Planar 모드)을 포함할 수 있다.

인트라 예측에서는 참조 샘플에 필터를 적용한 후 예측 블록을 생성할 수 있다. 이때, 참조 샘플에 필터를 적용할 것인지는 현재 블록의 인트라 예측 모드 및/또는 사이즈에 따라 결정될 수 있다.

생성된 예측 블록과 원본 블록 사이의 레지듀얼 값(레지듀얼 블록 또는 레지듀얼 신호)은 변환부(115)로 입력된다. 또한, 예측을 위해 사용한 예측 모드 정보, 움직임 벡터 정보 등은 레지듀얼 값과 함께 엔트로피 인코딩부(130)에서 인코딩되어 디코딩 장치에 전달된다.

변환부(115)는 변환 블록 단위로 레지듀얼 블록에 대한 변환을 수행하고 변환 계수를 생성한다.

변환 블록은 샘플들의 직사각형 블록으로서 동일한 변환이 적용되는 블록이다. 변환 블록은 변환 유닛(TU)일 수 있으며, 쿼드 트리(quad tree) 구조를 가질 수 있다.

변환부(115)는 레지듀얼 블록에 적용된 예측 모드와 블록의 크기에 따라서 변환을 수행할 수 있다.

예컨대, 레지듀얼 블록에 인트라 예측이 적용되었고 블록이 4x4의 레지듀얼 배열(array)이라면, 레지듀얼 블록을 DST(Discrete Sine Transform)를 이용하여 변환하고, 그 외의 경우라면 레지듀얼 블록을 DCT(Discrete Cosine Transform)를 이용하여 변환할 수 있다.

변환부(115)는 변환에 의해 변환 계수들의 변환 블록을 생성할 수 있다.

양자화부(120)는 변환부(115)에서 변환된 레지듀얼 값들, 즉 변환 계수들을 양자화하여 양자화된 변환 계수를 생성할 수 있다. 양자화부(120)에서 산출된 값은 역양자화부(135)와 재정렬부(125)에 제공된다.

재정렬부(125)는 양자화부(120)로부터 제공된 양자화된 변환 계수를 재정렬한다. 양자화된 변환 계수를 재정렬함으로써 엔트로피 인코딩부(130)에서의 인코딩 효율을 높일 수 있다.

재정렬부(125)는 계수 스캐닝(Coefficient Scanning) 방법을 통해 2차원 블록 형태의 양자화된 변환 계수들을 1차원의 벡터 형태로 재정렬할 수 있다.

엔트로피 인코딩부(130)는 재정렬부(125)에 의해 재정렬된 양자화된 변환 값들 또는 코딩 과정에서 산출된 인코딩 파라미터 값 등을 기초로 심볼(symbol)을 확률 분포에 따라 엔트로피 코딩하여 비트스트림(bitstream)을 출력할 수 있다. 엔트로피 인코딩 방법은 다양한 값을 갖는 심볼을 입력 받아, 통계적 중복성을 제거하면서, 디코딩 가능한 2진수의 열로 표현하는 방법이다.

여기서, 심볼이란 인코딩/디코딩 대상 구문 요소(syntax element) 및 코딩 파라미터(coding parameter), 레지듀얼 신호(residual signal)의 값 등을 의미한다. 인코딩 파라미터는 인코딩 및 디코딩에 필요한 매개변수로서, 구문 요소와 같이 인코딩 장치에서 인코딩되어 디코딩 장치로 전달되는 정보뿐만 아니라, 인코딩 혹은 디코딩 과정에서 유추될 수 있는 정보를 포함할 수 있으며 영상을 인코딩하거나 디코딩할 때 필요한 정보를 의미한다. 인코딩 파라미터는 예를 들어 인트라/인터 예측모드, 이동/움직임 벡터, 참조 영상 색인, 코딩 블록 패턴, 잔여 신호 유무, 변환 계수, 양자화된 변환 계수, 양자화 파라미터, 블록 크기, 블록 분할 정보 등의 값 또는 통계를 포함할 수 있다. 또한 잔여 신호는 원신호와 예측 신호의 차이를 의미할 수 있고, 또한 원신호와 예측 신호의 차이가 변환(transform)된 형태의 신호 또는 원신호와 예측 신호의 차이가 변환되고 양자화된 형태의 신호를 의미할 수도 있다. 잔여 신호는 블록 단위에서는 잔여 블록이라 할 수 있고, 샘플 단위에서는 잔여 샘플이라고 할 수 있다.

엔트로피 인코딩이 적용되는 경우, 높은 발생 확률을 갖는 심볼에 적은 수의 비트가 할당되고 낮은 발생 확률을 갖는 심볼에 많은 수의 비트가 할당되어 심볼이 표현됨으로써, 인코딩 대상 심볼들에 대한 비트열의 크기가 감소될 수 있다. 따라서 엔트로피 인코딩을 통해서 영상 인코딩의 압축 성능이 높아질 수 있다.

엔트로피 인코딩을 위해 지수 골룸(exponential golomb), CAVLC(Context-Adaptive Variable Length Coding), CABAC(Context-Adaptive Binary Arithmetic Coding)과 같은 인코딩 방법이 사용될 수 있다. 예를 들어, 엔트로피 인코딩부(130)에는 가변 길이 코딩(VLC: Variable Length Coding/Code) 테이블과 같은 엔트로피 인코딩을 수행하기 위한 테이블이 저장될 수 있고, 엔트로피 인코딩부(130)는 저장된 가변 길이 코딩(VLC) 테이블을 사용하여 엔트로피 인코딩을 수행할 수 있다. 또한 엔트로피 인코딩부(130)는 대상 심볼의 이진화(binarization) 방법 및 대상 심볼/빈(bin)의 확률 모델(probability model)을 도출(derive)한 후, 도출된 이진화 방법 또는 확률 모델을 사용하여 엔트로피 인코딩을 수행할 수도 있다.

또한, 엔트로피 인코딩부(130)는 필요한 경우에, 전송하는 파라미터 셋(parameter set) 또는 신택스에 일정한 변경을 가할 수도 있다.

역양자화부(135)는 양자화부(120)에서 양자화된 값(양자화된 변환 계수)들을 역양자화하고, 역변환부(140)는 역양자화부(135)에서 역양자화된 값들을 역변환한다.

역양자화부(135) 및 역변환부(140)에서 생성된 레지듀얼 값(또는 레지듀얼 샘플 또는 레지듀얼 샘플 어레이)과 예측부(110)에서 예측된 예측 블록이 합쳐져 복원 샘플(또는 복원 샘플 어레이)를 포함하는 복원 블록(Reconstructed Block)이 생성될 수 있다.

도 1에서는 가산기를 통해서, 레지듀얼 블록과 예측 블록이 합쳐져 복원 블록이 생성되는 것으로 설명하고 있다. 이때, 가산기를 복원 블록을 생성하는 별도의 유닛(복원 블록 생성부)로 볼 수도 있다.

필터부(145)는 디블록킹 필터, ALF(Adaptive Loop Filter), SAO(Sample Adaptive Offset)를 복원된 픽처에 적용할 수 있다.

디블록킹 필터는 복원된 픽처에서 블록 간의 경계에 생긴 왜곡을 제거할 수 있다. ALF(Adaptive Loop Filter)는 디블록킹 필터를 통해 블록이 필터링된 후 복원된 영상과 원래의 영상을 비교한 값을 기초로 필터링을 수행할 수 있다. ALF는 고효율을 적용하는 경우에만 수행될 수도 있다. SAO는 디블록킹 필터가 적용된 레지듀얼 블록에 대하여, 픽셀 단위로 원본 영상과의 오프셋 차이를 복원하며, 밴드 오프셋(Band Offset), 엣지 오프셋(Edge Offset) 등의 형태로 적용된다.

한편, 인터 예측에 사용되는 복원 블록에 대해서 필터부(145)는 필터링을 적용하지 않을 수도 있다.

메모리(150)는 필터부(145)를 통해 산출된 복원 블록 또는 픽처를 저장할 수 있다. 메모리(150)에 저장된 복원 블록 또는 픽처는 인터 예측을 수행하는 예측부(110)에 제공될 수 있다.

도 2는 본 발명의 일 실시예에 따른 비디오 디코딩 장치를 개략적으로 나타낸 블록도이다. 도 2를 참조하면, 비디오 디코딩 장치(200)는 엔트로피 디코딩부(210), 재정렬부(215), 역양자화부(220), 역변환부(225), 예측부(230), 필터부(235) 메모리(240)를 포함할 수 있다.

비디오 인코딩 장치에서 영상 비트스트림이 입력된 경우, 입력된 비트스트림은 비디오 인코딩 장치에서 영상 정보가 처리된 절차에 따라서 디코딩될 수 있다.

엔트로피 디코딩부(210)는, 입력된 비트스트림을 확률 분포에 따라 엔트로피 디코딩하여, 양자화된 계수(quantized coefficient) 형태의 심볼을 포함한 심볼들을 생성할 수 있다. 엔트로피 디코딩 방법은 2진수의 열을 입력 받아 각 심볼들을 생성하는 방법이다. 엔트로피 디코딩 방법은 상술한 엔트로피 인코딩 방법과 유사하다.

예컨대, 비디오 인코딩 장치에서 엔트로피 인코딩을 수행하기 위해 CAVLC 등의 가변 길이 코딩(Variable Length Coding: VLC, 이하 'VLC' 라 함)가 사용된 경우에, 엔트로피 디코딩부(210)도 인코딩 장치에서 사용한 VLC 테이블과 동일한 VLC 테이블로 구현하여 엔트로피 디코딩을 수행할 수 있다. 또한, 비디오 인코딩 장치에서 엔트로피 인코딩을 수행하기 위해 CABAC을 이용한 경우에, 엔트로피 디코딩부(210)는 이에 대응하여 CABAC을 이용한 엔트로피 디코딩을 수행할 수 있다.

보다 상세하게, CABAC 엔트로피 디코딩 방법은, 비트스트림에서 각 구문 요소에 해당하는 빈을 수신하고, 디코딩 대상 구문 요소 정보와 주변 및 디코딩 대상 블록의 디코딩 정보 혹은 이전 단계에서 디코딩된 심볼/빈의 정보를 이용하여 문맥(context) 모델을 결정하고, 결정된 문맥 모델에 따라 빈(bin)의 발생 확률을 예측하여 빈의 산술 디코딩(arithmetic decoding)를 수행하여 각 구문 요소의 값에 해당하는 심볼을 생성할 수 있다. 이때, CABAC 엔트로피 디코딩 방법은 문맥 모델 결정 후 다음 심볼/빈의 문맥 모델을 위해 디코딩된 심볼/빈의 정보를 이용하여 문맥 모델을 업데이트할 수 있다.

엔트로피 디코딩부(210)에서 디코딩된 정보 중 예측 블록을 생성하기 위한 정보는 예측부(230)로 제공되고, 엔트로피 디코딩부(210)에서 엔트로피 디코딩이 수행된 레지듀얼 값, 즉 양자화된 변환 계수는 재정렬부(215)로 입력될 수 있다.

재정렬부(215)는 엔트로피 디코딩부(210)에서 엔트로피 디코딩된 비트스트림의 정보, 즉 양자화된 변환 계수를 인코딩 장치에서 재정렬한 방법을 기초로 재정렬할 수 있다.

재정렬부(215)는 1차원 벡터 형태로 표현된 계수들을 다시 2차원의 블록 형태의 계수로 복원하여 재정렬할 수 있다. 재정렬부(215)는 현재 블록(변환 블록)에 적용된 예측 모드와 변환 블록의 크기를 기반으로 계수에 대한 스캐닝을 수행하여 2 차원 블록 형태의 계수(양자화된 변환 계수) 배열(array)을 생성할 수 있다.

역양자화부(220)는 인코딩 장치에서 제공된 양자화 파라미터와 재정렬된 블록의 계수값을 기초로 역양자화를 수행할 수 있다.

역변환부(225)는 비디오 인코딩 장치에서 수행된 양자화 결과에 대해, 인코딩 장치의 변환부가 수행한 DCT 및 DST에 대해 역DCT 및/또는 역DST를 수행할 수 있다.

역변환은 인코딩 장치에서 결정된 전송 단위 또는 영상의 분할 단위를 기초로 수행될 수 있다. 인코딩 장치의 변환부에서 DCT 및/또는 DST는 예측 방법, 현재 블록의 크기 및 예측 방향 등 복수의 정보에 따라 선택적으로 수행될 수 있고, 디코딩 장치의 역변환부(225)는 인코딩 장치의 변환부에서 수행된 변환 정보를 기초로 역변환을 수행할 수 있다.

예측부(230)는 엔트로피 디코딩부(210)에서 제공된 예측 블록 생성 관련 정보와 메모리(240)에서 제공된 이전에 디코딩된 블록 및/또는 픽처 정보를 기초로 예측 샘플(또는 예측 샘플 어레이)를 포함하는 예측 블록을 생성할 수 있다.

현재 PU에 대한 예측 모드가 인트라 예측(intra prediction) 모드인 경우에, 현재 픽처 내의 픽셀 정보를 기초로 예측 블록을 생성하는 인트라 예측을 수행할 수 있다.

현재 PU에 대한 예측 모드가 인터 예측(inter prediction) 모드인 경우에, 현재 픽처의 이전 픽처 또는 이후 픽처 중 적어도 하나의 픽처에 포함된 정보를 기초로 현재 PU에 대한 인터 예측을 수행할 수 있다. 이때, 비디오 인코딩 장치에서 제공된 현재 PU의 인터 예측에 필요한 움직임 정보, 예컨대 움직임 벡터, 참조 픽처 인덱스 등에 관한 정보는 인코딩 장치로부터 수신한 스킵 플래그, 머지 플래그 등을 확인하고 이에 대응하여 유도될 수 있다.

현재 픽처에 대한 인터 예측 시, 현재 블록과의 레지듀얼(residual) 신호가 최소화되며 움직임 벡터 크기 역시 최소가 되도록 예측 블록을 생성할 수 있다.

한편, 움직임 정보 도출 방식은 현재 블록의 예측 모드에 따라 달라질 수 있다. 인터 예측을 위해 적용되는 예측 모드에는 AMVP(Advanced Motion Vector Prediction) 모드, 머지(merge) 모드 등이 있을 수 있다.

일 예로, 머지 모드가 적용되는 경우, 인코딩 장치 및 디코딩 장치는 복원된 공간적 주변 블록의 움직임 벡터 및/또는 시간적 주변 블록인 Col 블록에 대응하는 움직임 벡터를 이용하여, 머지 후보 리스트를 생성할 수 있다. 머지 모드에서는 머지 후보 리스트에서 선택된 후보 블록의 움직임 벡터가 현재 블록의 움직임 벡터로 사용된다. 인코딩 장치는 상기 머지 후보 리스트에 포함된 후보 블록들 중에서 선택된 최적의 움직임 벡터를 갖는 후보 블록을 지시하는 머지 인덱스를 디코딩 장치로 전송할 수 있다. 이 때, 디코딩 장치는 상기 머지 인덱스를 이용하여, 현재 블록의 움직임 벡터를 도출할 수 있다.

다른 예로, AMVP(Advanced Motion Vector Prediction) 모드가 적용되는 경우, 인코딩 장치 및 디코딩 장치는 복원된 공간적 주변 블록의 움직임 벡터 및/또는 시간적 주변 블록인 Col 블록에 대응하는 움직임 벡터를 이용하여, 움직임 벡터 예측자 후보 리스트를 생성할 수 있다. 즉, 복원된 공간적 주변 블록의 움직임 벡터 및/또는 시간적 주변 블록인 Col 블록에 대응하는 움직임 벡터는 움직임 벡터 후보로 사용될 수 있다. 인코딩 장치는 상기 리스트에 포함된 움직임 벡터 후보 중에서 선택된 최적의 움직임 벡터를 지시하는 예측 움직임 벡터 인덱스를 디코딩 장치로 전송할 수 있다. 이 때, 디코딩 장치는 상기 움직임 벡터 인덱스를 이용하여, 움직임 벡터 후보 리스트에 포함된 움직임 벡터 후보 중에서, 현재 블록의 예측 움직임 벡터를 선택할 수 있다.

인코딩 장치는 현재 블록의 움직임 벡터(MV)와 움직임 벡터 예측자(MVP) 간의 움직임 벡터 차분(MVD)을 구할 수 있고, 이를 인코딩하여 디코딩 장치로 전송할 수 있다. 즉, MVD는 현재 블록의 MV에서 MVP를 뺀 값으로 구해질 수 있다. 이 때, 디코딩 장치는 수신된 움직임 벡터 차분을 디코딩할 수 있고, 디코딩된 움직임 벡터 차분과 움직임 벡터 예측자의 가산을 통해 현재 블록의 움직임 벡터를 도출할 수 있다.

인코딩 장치는 또한 참조 픽처를 지시하는 참조 픽처 인덱스 등을 디코딩 장치에 전송할 수 있다.

디코딩 장치는 주변 블록의 움직임 정보들을 이용하여 현재 블록의 움직임 벡터를 예측하고, 인코딩 장치로부터 수신한 레지듀얼을 이용하여 현재 블록에 대한 움직임 벡터를 유도할 수 있다. 디코딩 장치는 유도한 움직임 벡터와 인코딩 장치로부터 수신한 참조 픽처 인덱스 정보를 기반으로 현재 블록에 대한 예측 샘플(또는 예측 샘플 어레이)을 생성할 수 있다.

디코딩 장치는 예측 샘플(또는 예측 샘플 어레이)과 인코딩 장치로부터 전송되는 변환 계수들로부터 획득한 레지듀얼 샘플(레지듀얼 샘플 어레이)을 더하여 복원 샘플(또는 복원 샘플 어레이)를 생성할 수 있다. 이를 기반으로 복원 블록 및 복원 픽처가 생성될 수 있다.