WO2014097596A1 - 画像符号化方法、画像復号方法、画像符号化装置および画像復号装置 - Google Patents

画像符号化方法、画像復号方法、画像符号化装置および画像復号装置 Download PDFInfo

- Publication number

- WO2014097596A1 WO2014097596A1 PCT/JP2013/007350 JP2013007350W WO2014097596A1 WO 2014097596 A1 WO2014097596 A1 WO 2014097596A1 JP 2013007350 W JP2013007350 W JP 2013007350W WO 2014097596 A1 WO2014097596 A1 WO 2014097596A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- slice

- flag

- sao

- unit

- image

- Prior art date

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/174—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a slice, e.g. a line of blocks or a group of blocks

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/105—Selection of the reference unit for prediction within a chosen coding or prediction mode, e.g. adaptive choice of position and number of pixels used for prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/117—Filters, e.g. for pre-processing or post-processing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

Definitions

- the present invention relates to an image encoding method and an image encoding device for encoding an image, and an image decoding method and an image decoding device for decoding an image.

- Non-Patent Document 1 There is a technique described in Non-Patent Document 1 as a technique related to an image encoding method and an image encoding apparatus for encoding an image (including a moving image), and an image decoding method and an image decoding apparatus for decoding an image.

- JCT-VC Join Collaborative Team on Video Coding

- the present invention provides an image encoding method and an image encoding device that efficiently encode an image, and an image decoding method and an image decoding device that efficiently decode an image.

- An image encoding method is an image encoding method for encoding an image into a bitstream, the division step of dividing the image into a plurality of slices, and a current slice to be encoded

- a first flag indicating permission or prohibition with respect to the reference of the reference target pixel is generated, and the reference target pixel is A second flag indicating permission or prohibition of reference to the reference target pixel when included in a second slice adjacent to the lower side or the right side of the current slice, wherein the second flag is different from the first flag.

- Filtering a boundary between a generation step to generate and a slice adjacent to the current slice and the current slice Filtering step, and in the filtering step, when the first flag indicates permission for reference to the reference target pixel, the first boundary between the current slice and the first slice If the second flag indicates permission for reference to the reference target pixel, filtering is performed on the second boundary between the current slice and the second slice.

- An image decoding method is an image decoding method for decoding an image from a bitstream, wherein a reference target pixel of a current slice that is a decoding target is adjacent to an upper side or a left side of the current slice.

- a first flag indicating permission or prohibition of reference to the reference target pixel is acquired, and the reference target pixel is included in a second slice adjacent to the lower side or the right side of the current slice

- the first flag indicates permission for reference to the reference target pixel

- filtering is performed on a first boundary between the current slice and the first slice

- the second flag is When permission is given to the reference of the reference target pixel, filtering is performed on a second boundary between the current slice and the second slice.

- a recording medium such as an apparatus, a system, an integrated circuit, a computer program, or a computer-readable CD-ROM for executing the above-described method.

- the present invention may be realized by any combination of an integrated circuit, a computer program, and a recording medium.

- the image encoding method, the image encoding device, the image decoding method, and the image decoding device of the present invention can efficiently encode or decode an image.

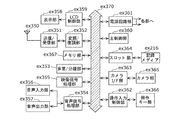

- FIG. 1 is a block diagram illustrating an example of a configuration of an image encoding device according to the first embodiment.

- FIG. 2 is a flowchart illustrating an example of a processing procedure of the image encoding method according to the first embodiment.

- FIG. 3 is a block diagram showing an internal configuration of the SAO processing unit 110 according to the first embodiment.

- FIG. 4 is a flowchart showing an example of the processing procedure (overall) of the SAO processing in the first embodiment.

- FIG. 5 is a flowchart showing an example of the processing procedure of the SAO processing (SAO offset addition) in the first embodiment.

- FIG. 6 is a block diagram showing an example of an internal configuration of the picture data encoding unit in the first embodiment.

- FIG. 1 is a block diagram illustrating an example of a configuration of an image encoding device according to the first embodiment.

- FIG. 2 is a flowchart illustrating an example of a processing procedure of the image encoding method according to the first embodiment.

- FIG. 3

- FIG. 7 is a flowchart illustrating an example of a processing procedure for encoding picture data according to the first embodiment.

- FIG. 8 is a flowchart illustrating an example of a processing procedure for encoding a slice boundary reference permission flag according to the first embodiment.

- FIG. 9 is a flowchart illustrating an example of a processing procedure of SAO parameter encoding in the first embodiment.

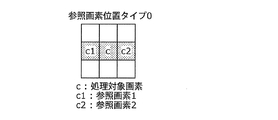

- FIG. 10A is a diagram illustrating a relationship between a processing target pixel and a reference pixel in the reference pixel position type 0.

- FIG. 10B is a diagram illustrating a relationship between the processing target pixel and the reference pixel in the reference pixel position type 1.

- FIG. 10C is a diagram illustrating a relationship between the processing target pixel and the reference pixel in the reference pixel position type 2.

- FIG. 10D is a diagram illustrating a relationship between the processing target pixel and the reference pixel in the reference pixel position type 3.

- FIG. 11 is a diagram illustrating a relationship between slice_loop_filter_cross_slices_enabled_flag and whether or not SAO processing is executed.

- FIG. 12 is a block diagram illustrating an example of a configuration of the image decoding device according to the second embodiment.

- FIG. 13 is a flowchart illustrating an example of a processing procedure of the image decoding method according to the second embodiment.

- FIG. 14 is a block diagram illustrating an example of an internal configuration of the SAO processing unit according to the second embodiment.

- FIG. 15 is a flowchart illustrating an example of a processing procedure of SAO processing according to the second embodiment.

- FIG. 16 is a block diagram showing an example of an internal configuration of a picture data decoding unit in the second embodiment.

- FIG. 17 is a flowchart illustrating an example of a picture data decoding process procedure according to the second embodiment.

- FIG. 18 is a flowchart illustrating an example of a processing procedure for decoding a slice boundary reference permission flag according to the second embodiment.

- FIG. 19 is a flowchart illustrating an example of a processing procedure of SAO parameter decoding according to the second embodiment.

- FIG. 20 is a block diagram illustrating an example of the configuration of the image encoding device according to the third embodiment.

- FIG. 21 is a flowchart illustrating an example of a processing procedure of the image encoding method according to the third embodiment.

- FIG. 22 is a flowchart illustrating an example of a processing procedure for decoding a slice boundary reference permission flag according to the third embodiment.

- FIG. 23 is a flowchart illustrating an example of a processing procedure for decoding a slice boundary reference permission flag according to the fourth embodiment.

- FIG. 24 is a block diagram illustrating an example of a configuration of an image encoding device according to the fifth embodiment.

- FIG. 25 is a flowchart illustrating an example of a processing procedure of the image coding method according to the fifth embodiment.

- FIG. 26 is a block diagram showing an internal configuration of the SAO processing unit in the fifth embodiment.

- FIG. 27 is a flowchart illustrating an example of a processing procedure of SAO processing (entire) in the fifth embodiment.

- FIG. 28 is a flowchart illustrating an example of a processing procedure for encoding a slice boundary reference permission flag according to the fifth embodiment.

- FIG. 29 is a flowchart illustrating an example of a processing procedure for decoding a slice boundary reference permission flag according to the sixth embodiment.

- FIG. 30 is a block diagram illustrating an example of the configuration of the image encoding device according to the present embodiment.

- FIG. 31 is a flowchart illustrating an example of a processing procedure of the image coding method according to the present embodiment.

- FIG. 32 is a block diagram showing an internal configuration of the SAO processing unit.

- FIG. 33 is a flowchart illustrating an example of a processing procedure of SAO processing (entire).

- FIG. 34 is a block diagram illustrating an example of an internal configuration of a picture data encoding unit.

- FIG. 35 is a flowchart illustrating an example of a processing procedure for encoding a slice boundary reference permission flag.

- FIG. 36 is a block diagram illustrating an example of a configuration of the image decoding device according to the present embodiment.

- FIG. 37 is a block diagram illustrating an example of an internal configuration of the SAO processing unit.

- FIG. 38 is a flowchart illustrating an example of a processing procedure of the SAO processing according to the present embodiment.

- FIG. 39 is a block diagram illustrating an example of an internal configuration of the picture data decoding unit.

- FIG. 40 is a flowchart illustrating an example of a processing procedure for decoding a slice boundary reference permission flag according to the present embodiment.

- FIG. 41 is an overall configuration diagram of a content supply system that realizes a content distribution service.

- FIG. 42 is an overall configuration diagram of a digital broadcasting system.

- FIG. 43 is a block diagram illustrating a configuration example of a television.

- FIG. 44 is a block diagram illustrating a configuration example of an information reproducing / recording unit that reads and writes information from and on a recording medium that is an optical disk.

- FIG. 45 is a diagram illustrating a structure example of a recording medium that is an optical disk.

- FIG. 46A is a diagram illustrating an example of a mobile phone.

- FIG. 46B is a block diagram illustrating a configuration example of a mobile phone.

- FIG. 47 is a diagram showing a structure of multiplexed data.

- FIG. 41 is an overall configuration diagram of a content supply system that realizes a content distribution service.

- FIG. 42 is an overall configuration diagram of a digital broadcasting system.

- FIG. 43 is a block diagram illustrating a configuration example

- FIG. 48 is a diagram schematically showing how each stream is multiplexed in the multiplexed data.

- FIG. 49 is a diagram showing in more detail how the video stream is stored in the PES packet sequence.

- FIG. 50 is a diagram showing the structure of TS packets and source packets in multiplexed data.

- FIG. 51 is a diagram illustrating a data structure of the PMT.

- FIG. 52 is a diagram showing an internal configuration of multiplexed data information.

- FIG. 53 shows the internal structure of stream attribute information.

- FIG. 54 is a diagram showing steps for identifying video data.

- FIG. 55 is a block diagram illustrating a configuration example of an integrated circuit that implements the moving picture coding method and the moving picture decoding method according to each embodiment.

- FIG. 56 is a diagram showing a configuration for switching the drive frequency.

- FIG. 57 is a diagram showing steps for identifying video data and switching between driving frequencies.

- FIG. 58 is a diagram showing an example of a look-up table in which video data standards are associated with drive frequencies.

- FIG. 59A is a diagram illustrating an example of a configuration for sharing a module of a signal processing unit.

- FIG. 59B is a diagram illustrating another example of a configuration for sharing a module of a signal processing unit.

- H.264 As an image coding standard, H.264 is used. H.264 / AVC (MPEG-4 AVC) is available, but the HEVC (High Efficiency Video Coding) standard is being studied as the next generation standard.

- MPEG-4 AVC MPEG-4 AVC

- Non-Patent Document 1 includes a process called SAO (Sample Adaptive Offset).

- SAO processing (hereinafter abbreviated as “SAO” where appropriate) is processing for adding an offset value to each pixel of an image decoded from a code string. By performing the SAO processing, it is possible to more faithfully reproduce the original image before encoding and reduce image quality deterioration due to encoding.

- the processing target pixel is classified into a plurality of categories, and an offset value corresponding to each category is added. Classification of categories is performed with reference to the upper / lower pixels, left / right pixels, upper left / lower right pixels, and upper right / lower left pixels to be processed according to a classification method specified separately.

- Encoding and decoding processes are executed for each unit called a slice obtained by dividing one input image.

- the pixel to be referenced is a pixel of a slice different from the slice of the pixel to be processed, it is determined whether or not to perform the SAO processing by slice_loop_filter_cross_slices_enabled_flag specified for each slice.

- FIG. 11 is a diagram illustrating a relationship between slice_loop_filter_cross_slices_enabled_flag and whether or not SAO processing is executed.

- FIG. 11 illustrates an example in which slice_loop_filter_cross_slices_enabled_flag of slice 2 is designated as 0.

- a slice whose slice_loop_filter_cross_slices_enabled_flag is 0 does not perform SAO processing on a pixel whose reference pixel is another slice.

- a pixel adjacent to the processing target pixel is referred to.

- SAO is not performed on the pixels adjacent to the slice boundary among the pixels in slice 2, depending on the position of the reference pixel. Note that the SAO is not performed when the reference pixel is a different slice in order to prohibit the reference of the pixel between the slices and eliminate the dependency between the slices.

- slice_loop_filter_cross_slices_enabled_flag of slice 1 and slice 2 needs to be set to 0.

- the SAO processing is not executed on the pixels adjacent to the slice 3 in the slice 2 (SAO off).

- the pixels adjacent to slice 0 in slice 1 are also turned off by SAO depending on the reference pixel position. If the SAO is turned off unnecessarily, the image quality will deteriorate.

- FIG. 1 is a block diagram illustrating an example of a configuration of an image encoding device according to the present embodiment.

- an image coding apparatus 100A includes a slice division unit 101, a code block division unit 102, a subtraction unit 103, a conversion unit 104, a picture data coding unit 105, an inverse conversion unit 106, An addition unit 107, a frame memory, a DBF processing unit 109, a SAO processing unit 110, a prediction unit 111, a DBF_SAO processing determination unit 120, and a slice boundary reference determination unit 130 are provided.

- FIG. 2 is a flowchart illustrating an example of a processing procedure of the image encoding method according to the present embodiment.

- the slice dividing unit 101 divides the input image into slices (S101), and the code block dividing unit 102 divides the slice into code blocks (S102).

- the DBF_SAO processing determination unit 120 determines whether or not to execute DBF (Deblock Filter) and SAO processing for the processing target slice (current slice) (S103).

- SAO processing includes processing for luminance (Luma) component pixels (hereinafter referred to as “SAO-Luma” as appropriate) and processing for color difference (Chroma) component pixels (hereinafter referred to as “SAO-Chroma” as appropriate). It is.

- the characteristics of the input image, the degree of image quality improvement when the process is executed, and the like are used.

- dbf_flag is 1 when the DBF process is executed, and 0 when the DBF process is not executed.

- sao_luma_flag is 1 when SAO-Luma is executed, and 0 when it is not executed.

- sao_chroma_flag is 1 when SAO-Chroma is executed, and is 0 when SAO-Chroma is not executed.

- the slice boundary reference determining unit 130 determines whether to permit or prohibit the reference of pixels of another slice across the upper boundary and the left boundary of the processing target slice.

- the slice boundary reference determination unit 130 sets slice_loop_filter_cross_license_enabled_flag of the processing target slice to 1 when it is determined to permit in S104, and sets slice_loop_filter_cross_slices_enabled_flag (104) of the processing target slice to 0 when it is determined to prohibit.

- slice_loop_filter_cross_slices_enabled_flag exists for each slice.

- the prediction unit 111 generates a prediction block of the processing target code block (S105).

- the subtraction unit 103 generates a difference block between the prediction block and the code block (S106).

- the conversion unit 104 frequency-converts the difference block to generate a conversion coefficient (S107).

- the conversion unit 104 performs inverse frequency conversion on the code block after conversion (S108). Thereafter, the adding unit 107 generates a decoded block obtained by adding the code block subjected to inverse frequency conversion and the prediction block generated by the prediction unit 111, and stores the decoded block in the frame memory 108 (S109).

- next code block is set as a processing target (S110), and S105 to S111 are repeated until the processing of all the code blocks in the slice is completed (S111).

- S111 processing target

- S112 processing target slice

- S103 to S113 are repeated until processing of all slices in the picture is completed.

- the slice boundary reference determining unit 130 sets loop_filter_cross_slices_enabled_flag (S114).

- the loop_filter_cross_slices_enabled_flag is 1 when there is at least one slice_loop_filter_cross_slices_enabled_flag of each slice in the picture, and 0 when all 0s.

- One loop_filter_cross_slices_enabled_flag exists in one picture.

- the SAO processing unit 110 performs SAO processing on the luminance component pixel of the slice (S118).

- sao_chroma_flag of the slice to be processed is 1 (SAO Chroma execution flag is on) (Yes in S119)

- the SAO processing unit 110 performs SAO processing on the color difference component pixels (Cb and Cr) of the slice (S120, S121). Details of the SAO processing will be described later.

- next code block is set as a processing target (S122), and S115 to S123 are repeated until the processing of all the code blocks in the slice is completed (S123). Furthermore, when processing of all code blocks in one slice is completed (Yes in S213), the next slice is set as a processing target slice (S124), and S115 to S125 are processed until processing of all slices in the picture is completed. Is repeated (S125).

- the picture data encoding unit 105 encodes picture data (S126). Details of the picture data encoding will be described later.

- FIG. 3 is a block diagram illustrating an example of an internal configuration of the SAO processing unit 110.

- the SAO processing unit 110 includes a SAO parameter determination unit 110a, a slice boundary reference determination unit 110b, and a SAO offset addition unit 110c.

- FIG. 4 is a flowchart illustrating an example of the processing procedure of the SAO processing (entire). The flags used in Luma, Cr, and Cb are different, but the SAO processing method is the same.

- the SAO parameter determination unit 110a determines whether or not to perform SAO on the processing target code block (S131).

- the SAO parameter determination unit 110a uses a pixel or a code block generated as a result of executing the DBF process, and determines whether to execute the DBF process according to the degree of image quality improvement when the DBF process is executed.

- the SAO parameter determination unit 110a sets sao_type_idx_luma when the SAO processing target is Luma.

- the SAO parameter determination unit 110a sets sao_type_idx_chroma when the target of SAO processing is Chroma (Cb / Cr).

- the SAO parameter determination unit 110a sets these flags to 0 if SAO processing is not executed, and 1 if executed.

- the SAO parameter determination unit 110a performs S133 and subsequent steps when sao_type_idx_luma or sao_type_idx_chroma is 1 (when executing SAO processing), and ends SAO processing when 0.

- the SAO parameter determination unit 110a determines the reference pixel position type (S133).

- S133 the reference pixel position type

- 10A to 10D are diagrams showing the relationship between the reference pixel position type and the reference pixel, respectively.

- 10A to 10D show the processing target pixel c, the reference pixel c1, and the reference pixel c2.

- the reference pixel position type 0 shown in FIG. 10A the pixel adjacent to the left side of the processing target pixel c is set as the reference pixel c1, and the pixel adjacent to the right side is set as the reference pixel c2.

- the reference pixel position type 1 shown in FIG. 10B the pixel adjacent to the upper side of the processing target pixel c is set as the reference pixel c1, and the pixel adjacent to the lower side is set as the reference pixel c2.

- the pixel adjacent to the upper left side of the processing target pixel c is set as the reference pixel c1

- the pixel adjacent to the lower right side is set as the reference pixel c2.

- a pixel adjacent to the upper right side of the processing target pixel c is set as the reference pixel c1

- a pixel adjacent to the lower left side is set as the reference pixel c2.

- the SAO parameter determination unit 110a determines the SAO offset value of each category (S134). Details of the category will be described in the next SAO offset addition process (1-5).

- the SAO offset addition unit 110c determines the reference pixel position type and the SAO offset value based on the degree of image quality improvement when the SAO process is executed using the pixels and code blocks resulting from the DBF process.

- the slice boundary reference determination unit 110b determines whether or not to refer to the reference pixel according to the position of the reference pixel determined in S133, and does not perform the SAO offset addition process when the reference pixel should not be referred to. (S135 to S138). That is, the SAO process is not performed.

- the slice boundary reference determination unit 110b determines whether at least one of the two reference pixels is a pixel of another slice (S135). When at least one of the two reference pixels is another slice (Yes in S135), the slice boundary reference determination unit 110b determines whether the slice including the reference pixel has been subjected to SAO processing before the target slice. Is determined (S136). If the slice including the reference pixel has been previously subjected to SAO processing (Yes in S136), the slice boundary reference determination unit 110b slice_loop_filter_cross_slices_enabled_flag of this processing target slice (corresponds to the first flag in this embodiment). (S137).

- the slice boundary reference determination unit 110b determines the slice_loop_filter_cross_licenses_enabled_flag (in this embodiment) of the slice including the reference pixel. , Corresponding to the second flag), it is determined whether or not the reference can be made (S138). If slice_loop_filter_cross_slices_enabled_flag is 0 (No in S137 and No in S138), the slice boundary reference determination unit 110b does not perform SAO processing because the reference is prohibited.

- the permission and prohibition of the reference of the upper boundary and the left boundary of the processing target slice are determined by the slice_loop_filter_cross_slices_enabled_flag of the processing target slice, and the permission and prohibition of the reference of the lower boundary and the right boundary are the slices below the processing target slice, Judgment is made by slice_loop_filter_cross_slices_enabled_flag of the right slice.

- the boundary between slice 1 and slice 2 is determined by slice_loop_filter_cross_slices_enabled_flag of slice 2

- the boundary between slice 2 and slice 3 is determined by slice_loop_filter_cross_slices_enabled_flag of slice 3.

- the SAO offset addition unit 110c adds the SAO offset value to the pixel value of the pixel generated as a result of the DBF processing (S139). Details will be described later.

- the SAO parameter determination unit 110a, the slice boundary reference determination unit 110b, and the SAO offset addition unit 110c perform S135 to S139 on all the pixels in the code block (S140).

- FIG. 5 is a flowchart illustrating an example of a processing procedure of SAO processing (SAO offset addition).

- the SAO offset addition unit 110c divides into 0 to 4 categories using the magnitude relationship between the pixel values of the two reference pixels and the processing target pixel (S141 to S151).

- the SAO offset addition unit 110c The pixel to be processed is classified into category 1 (S147).

- the unit 110c sets the processing target pixel to category 2. Classify (S148).

- the unit 110c sets the processing target pixel to category 2. Classify (S149).

- the SAO offset addition unit 110c sets the processing target pixel as a category. 4 (S150).

- the SAO offset addition unit 110c classifies the pixel to be processed into category 0 (S150) when none of the above cases applies (No in S146).

- the SAO offset addition unit 110c When the category of the pixel to be processed is classified into a category other than category 0 (Yes in S152), the SAO offset addition unit 110c generates an offset value corresponding to the category of the pixel to be processed as a result of the DBF process. The added pixel value is added (S153). By adding the offset value, the pixel value generated as a result of the DBF process is brought closer to the pixel value of the input image. In the present embodiment, SAO offset addition section 110c does not add an offset value to pixels classified in category 0.

- FIG. 6 is a block diagram illustrating an example of an internal configuration of the picture data encoding unit.

- the picture data encoding unit 105 includes a transform coefficient encoding unit 105a, a prediction information encoding unit 105b, a SAO parameter encoding unit 105c, a slice boundary reference encoding unit 105d, and a DBF_SAO execution flag code. And a conversion unit 105e.

- FIG. 7 is a flowchart illustrating an example of a processing procedure for encoding picture data.

- the slice boundary reference encoding unit 105d encodes loop_filter_cross_slices_enabled_flag (S161).

- the DBF_SAO execution flag encoding unit 105e encodes dbf_flag, sao_luma_flag, and sao_chroma_flag (S162).

- slice boundary reference encoding unit 105d encodes slice_loop_filter_cross_slices_enabled_flag (S163). Details are described in 1-8.

- the SAO parameter encoding unit 105c encodes the SAO parameter (S165). Details will be described in 1-9. When both sao_luma_flag and sao_chroma_flag are 0, the SAO process is not performed, so the SAO parameter is not encoded.

- the prediction information encoding unit 105b encodes the prediction information (S166).

- the prediction information is information for generating a prediction block, and is information such as a motion vector for inter-screen prediction and a prediction direction for intra-screen prediction.

- the transform coefficient encoding unit 105a encodes the transform coefficient (S167).

- the data encoded in S164 to S167 is output as a code string.

- the picture data encoding unit 105 sets the next code block as a processing target (S168), and repeats S164 to S169 until processing of all code blocks in the slice is completed (S169). Further, when the processing of all the code blocks in one slice is completed (Yes in S169), the picture data encoding unit 105 sets the next slice as a processing target (S170), and the processing of all the slices in the picture is completed. Steps S162 to S171 are repeated until this is done (S171).

- FIG. 8 is a flowchart illustrating an example of a processing procedure for encoding a slice boundary reference permission flag.

- the slice boundary reference encoding unit 105d sets 0 to slice_loop_filter_cross_slices_enabled_flag and ends the processing (S175).

- the slice_loop_filter_cross_slices_enabled_flag is a flag for setting permission / prohibition of reference across the boundary between the upper boundary and the left boundary of the slice. However, since the upper boundary and the left boundary of the first slice in the picture are the ends of the picture, reference across the boundary is not necessarily permitted (always prohibited).

- the slice boundary reference encoding unit 105d sets slice_loop_filter_access_slices_enabled_flag to 0 and ends the processing (S175). This is because when the loop_filter_cross_slices_enabled_flag is 0, the slice_loop_filter_cross_slices_enabled_flag of all slices in the picture is 0.

- FIG. 9 is a flowchart illustrating an example of a procedure for encoding SAO parameters.

- the SAO parameter encoding unit 105c encodes sao_merge_left_flag and sao_merge_up_flag (S176 to S186).

- the SAO parameter encoding unit 105c initializes sao_merge_left_flag to 0 (S176).

- the SAO parameter encoding unit 105c has the SAO parameter of the processing target code block the same as the SAO parameter of the left code block. It is determined whether or not (S178).

- the SAO parameter encoding unit 105c sets 1 to sao_merge_left_flag (S179).

- the SAO parameter encoding unit 105c encodes sao_merge_left_flag (S180). When the left code block adjacent to the left side does not belong to the same slice as the processing target code block (No in S177), sao_merge_left_flag is not encoded.

- the SAO parameter encoding unit 105c initializes sao_merge_up_flag to 0 (S181). If sao_merge_left_flag is not 1 (No in S182), the SAO parameter encoding unit 105c determines whether the upper code block adjacent on the upper side belongs to the same slice as the processing target code block (S183). When the upper code block adjacent on the upper side belongs to the same slice as the processing target code block (Yes in S183), the SAO parameter encoding unit 105c has the SAO parameter of the processing target code block the same as the SAO parameter of the upper code block. It is determined whether or not (S184).

- the SAO parameter encoding unit 105c sets 1 to sao_merge_up_flag (S185).

- the SAO parameter encoding unit 105c encodes sao_merge_up_flag (S186). If sao_merge_left_flag is 1 (Yes in S182), or if the upper code block adjacent to the upper side does not belong to the same slice as the processing target code block (No in S183), sao_merge_up_flag is not encoded.

- sao_merge_left_flag and sao_merge_up_flag are flags that are set to 1 when the processing target code block uses the same SAO parameter as the left or upper code block, as described above. For this reason, when the same SAO parameter is used, only this flag is encoded, and the SAO parameter is not encoded, thereby reducing the code amount.

- the SAO parameter encoding unit 105c ends the process without performing the encoding of the SAO parameters after S113.

- the left or upper code block is a block of another slice (S177 or S183)

- this flag is not encoded, and the SAO parameter is always encoded.

- both sao_merge_left_flag and sao_merge_up_flag will never be 1. Therefore, when sao_merge_left_flag is 1, only sao_merge_left_flag is encoded, and sao_merge_up_flag is not encoded (S182).

- the SAO on flag (sao_type_idx_luma / chroma), the SAO offset value (sao_offset_luma / cb / cr), and the SAO reference pixel position type (sao_eo_class_luma / chroma) are encoded (S113 to S123).

- the SAO parameter encoding unit 105c encodes sao_type_idx_luma when the sao_luma_flag of the processing target slice is 1, that is, when SAO Luma is on (Yes in S188) (S189). .

- the SAO parameter encoding unit 105c encodes four categories of sao_offset_luma when sao_type_idx_luma is not 0, that is, when SAO Luma of the processing target code block is off (No in S190) (S191).

- the SAO parameter encoding unit 105c encodes sao_eo_class_luma (S192).

- the SAO parameter encoding unit 105c encodes sao_eo_class_luma when SAO Luma is off (No in S188), when SAO Luma of the processing target code block is on (Yes in S190), or (S192). Later, the process proceeds to S193.

- the SAO parameter encoding unit 105c encodes sao_type_idx_chroma when the sao_chroma_flag of the slice to be processed is 1, that is, when SAO Chroma is on (Yes in S193) (S194). Further, the SAO parameter encoding unit 105c encodes four categories of sao_offset_cb when sao_type_idx_chroma is not 0, that is, when SAO Chroma of the processing target code block is off (No in S195) (S196). . The SAO parameter encoding unit 105c encodes sao_eo_class_chroma (S197). The SAO parameter encoding unit 105c encodes four categories of sao_offset_cr (S198).

- sao_type_idx_luma / chroma is a flag indicating that SAO processing is executed when it is 1, and that SAO is not executed when it is 0.

- sao_offset_luma / cb / cr and sao_eo_class_luma / chroma are not encoded (S190, S195).

- the SAO parameter is not encoded (S188, S193).

- sao_offset_luma / cb / cr four categories of offset values are encoded. Note that sao_type_idx_chroma and sao_eo_class_chroma use a common value for Cb and Cr, sao_offset_cb is used for Cb, and sao_offset_cr is used for the SAO of Cr.

- the permission and prohibition of reference to the upper boundary and the left boundary of the processing target slice are determined by slice_loop_filter_cross_slices_enabled_flag of the processing target slice, and permission and prohibition of reference to the lower boundary and the right boundary are determined by the slice below the processing target slice. Judgment is made based on the slice_loop_filter_cross_slices_enabled_flag of the right slice.

- slice_loop_filter_cross_ slices_enabled_flag of the processing target slice is set to 0, and when reference to the lower boundary and the right boundary is permitted, slice_loop_filter_slash_sl_sl Setting to 1 makes this possible.

- slice_loop_filter_cross_slices_enabled_flag of slice 2 is set to 0, and slice_loop_filter_cross_slices_edge_slices_edge_slices_edge_slices_edge_slice It became possible to realize by setting. By doing so, it becomes possible to perform SAO at all boundaries other than reference prohibition, leading to an improvement in image quality.

- the amount of code is reduced by not using the slice_loop_filter_cross_slices_enabled_flag of the first slice in the picture as a slice_loop_filter_cross_slices_enabled_flag as the upper and left boundaries of the slice.

- the upper boundary and the left boundary are always at the picture end, so the boundary reference is always prohibited, and slice_loop_filter_cross_slices_enabled_flag is unnecessary.

- loop_filter_cross_slices_enabled_flag is set to slice_loop_filter_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl_sl.

- DBF and SAO are performed after the decoding blocks of all code blocks in the picture are generated.

- the present invention is not limited to this, and as soon as the pixels and parameters used for DBF and SAO are ready, , SAO may be started, or may be started before all decoded blocks are generated.

- DBF and SAO on / off determination is performed before the generation of the decoded block.

- the determination may be made using the pixel value of the decoded block, the difference from the input image, or the like. Good.

- slice_loop_filter_cross_slices_enabled_flag is not encoded for the first slice in a picture. However, this is not always necessary, and in the case of a system in which it is desired to reduce the amount of processing for determining whether it is the first slice, Even in the case of slices, slice_loop_filter_cross_slices_enabled_flag may be encoded.

- processing in the present embodiment may be realized by software.

- the software may be distributed by downloading or the like. Further, this software may be recorded on a recording medium such as a CD-ROM and distributed. This also applies to other embodiments in this specification.

- FIG. 12 is a block diagram illustrating an example of the configuration of the image decoding apparatus according to the present embodiment.

- an image decoding apparatus 200A includes a picture data decoding unit 201, an inverse conversion unit 202, an addition unit 203, a frame memory 204, a DBF processing unit 205, an SAO processing unit 206, and a motion A compensation unit 207 is provided.

- FIG. 13 is a flowchart illustrating an example of a processing procedure of the image decoding method according to the present embodiment.

- the picture data decoding unit 201 decodes picture data from the code string (S201). Details will be described later.

- the motion compensation unit 207 generates a prediction block from the prediction information decoded from the picture data and the decoded block of the previous processing target code block stored in the frame memory 204 described later (S202).

- the inverse transform unit 202 performs inverse frequency transform on the transform coefficient of the processing target code block decoded from the picture data (S203).

- the adding unit 203 adds the processing target code block and the prediction block that have been subjected to the inverse frequency conversion to generate a decoded block, and stores the decoded block in the frame memory 204 (S204).

- the image decoding apparatus 200A sets the next code block as a processing target code block (S205), and repeats S202 to S206 until the processing of all code blocks in the slice is completed (S206). Further, when the processing of all the code blocks in one slice is completed (Yes in S206), the image decoding apparatus 200A sets the next slice as a processing target (S207) until the processing of all the slices in the picture is completed. S202 to S208 are repeated (S208). Note that code blocks and slices are set as processing targets in the order of raster scanning from the upper left to the lower right of the picture.

- the DBF process and the SAO process are performed in subsequent steps S115 to S125, but the processing procedure is the same as that in the first embodiment, and the description thereof is omitted.

- the data decoded by the picture data decoding unit 201 is used for dbf_flag, sao_luma_flag, and sao_chroma_flag used for processing.

- FIG. 14 is a block diagram illustrating an example of an internal configuration of the SAO processing unit 206.

- the SAO processing unit 206 includes a slice boundary reference determination unit 206a and an SAO offset addition unit 206b.

- the SAO processing unit 206 of the present embodiment is different from the SAO processing unit 110 of the first embodiment in that the SAO parameter determination unit 110a is not provided.

- FIG. 15 is a flowchart illustrating an example of a processing procedure of the SAO processing according to the present embodiment.

- the SAO processing flow shown in FIG. 15 is the same as the SAO processing flow of the first embodiment (FIG. 4), the determination of sao_type_idx_luma / chroma processed by the SAO parameter determination unit 110a, the determination of sao_eo_class_luma / chroma, and sao_offset_luma Although different in that there is no processing relating to the determination of cb / cr, the other processing is the same and will not be described. In the present embodiment, these parameters use data decoded by the picture data decoding unit 201.

- the SAO offset addition process is the same as that in the first embodiment (FIG. 5), and thus the description thereof is omitted.

- FIG. 16 is a block diagram illustrating an example of an internal configuration of the picture data decoding unit 201.

- the picture data decoding unit 201 includes a transform coefficient decoding unit 201a, a prediction information decoding unit 201b, a SAO parameter decoding unit 201c, a slice boundary reference decoding unit 201d, and a DBF_SAO execution flag decoding unit 201e. Yes.

- FIG. 17 is a flowchart illustrating an example of a processing procedure of picture data decoding.

- the slice boundary reference decoding unit 201d decodes loop_filter_cross_slices_enabled_flag (S211).

- the DBF_SAO execution flag decoding unit 201e decodes dbf_flag, sao_luma_flag, and sao_chroma_flag (S212).

- the slice boundary reference decoding unit 201d decodes slice_loop_filter_cross_slices_enabled_flag (S213). Details will be described later.

- the picture data decoding unit 201 decodes the SAO parameter by the SAO parameter decoding unit 201c (S215), and the prediction information decoding unit 201b converts the prediction information. Decoding is performed (S216), and the transform coefficient decoding unit 201a decodes the transform coefficient (S217). If both sao_luma_flag and sao_chroma_flag are 0 (Yes in S214), the SAO is not performed, so the picture data decoding unit 201 does not decode the SAO parameter.

- the prediction information is information for generating a prediction block, and is information such as a motion vector for inter-screen prediction and a prediction direction for intra-screen prediction.

- next code block is set as a processing target (S218), and S104 to S109 are repeated until the processing of all the code blocks in the slice is completed (S219).

- the next slice is set as a processing target (S220), and S102 to S111 are repeated until processing of all slices in the picture is completed (S220). S111).

- FIG. 18 is a flowchart illustrating an example of a processing procedure for decoding a slice boundary reference permission flag according to the present embodiment. Note that the decoding flow of the slice boundary reference permission flag shown in FIG. 18 is the same as the decoding flow of the slice boundary reference permission flag in FIG. To do.

- the slice boundary reference decoding unit 201d decodes slice_loop_filter_cross_slices_enabled_flag from the picture data.

- FIG. 19 is a flowchart illustrating an example of a procedure for decoding SAO parameters.

- the SAO parameter decoding unit 201c decodes sao_merge_left_flag and sao_merge_up_flag from the picture data (S231 to S240).

- the SAO parameter decoding unit 201c initializes sao_merge_left_flag to 0 (S231), and further initializes sao_merge_up_flag to 0 (S232).

- the SAO parameter decoding unit 201c decodes sao_merge_left_flag (S234).

- the SAO parameter decoding unit 201c determines whether the upper code block belongs to the same slice as the processing target code block (S236). When the upper code block belongs to the same slice as the processing target code block (S236), the SAO parameter decoding unit 201c decodes sao_merge_up_flag (S237). Furthermore, when sao_merge_up_flag is 1 (Yes in S238), the SAO parameter decoding unit 201c copies the SAO parameter of the upper code block as the SAO parameter of the processing target code block (S239).

- the SAO parameter decoding unit 201c copies the SAO parameter of the left code block as the SAO parameter of the processing target code block (S240).

- the SAO parameter decoding unit 201c ends the process when one of sao_merge_left_flag and sao_merge_up_flag is 1 (Yes in S241).

- sao_merge_left_flag and sao_merge_up_flag are flags that become 1 when the processing target code block uses the same SAO parameter as the left code block or the upper code block. Therefore, when the same SAO parameter is used, only this flag is decoded and the SAO parameter is not decoded.

- the SAO parameter decoding unit 201c always decodes the SAO parameter without decoding this flag (S233, S236). Also, both sao_merge_left_flag and sao_merge_up_flag will never be 1.

- SAO parameter decoding unit 201c decodes only sao_merge_left_flag and does not decode sao_merge_up_flag (S235).

- the SAO parameter decoding unit 201c decodes the SAO on flag (sao_type_idx_luma / chroma), the SAO offset value (sao_offset_luma / cb / cr), and the SAO reference pixel position type (sao_eo_class_luma / chroma) S (step S113).

- the SAO parameter decoding unit 201c determines whether sao_luma_flag of the processing target slice is 1 (S242).

- the SAO parameter decoding unit 201c decodes sao_type_idx_luma that is the SAO on flag of the luminance (S243).

- the SAO parameter decoding unit 201c decodes the four categories of sao_offset_luma (S245) and sao_eo_class_luma (S246).

- the SAO parameter decoding unit 201c decodes the SAO_type_idx_chroma that is the SAO on flag of the color difference (S248).

- the SAO parameter decoding unit 201c When the decoded sao_type_idx_chroma is not 0 (No in S249), the SAO parameter decoding unit 201c performs four categories of sao_offset_cb and (S250), sao_eo_class_chroma (S251), and four categories of sao_offset25 and (s251). .

- sao_type_idx_luma / chroma is a flag indicating that SAO processing is executed when it is 1, and that SAO is not executed when it is 0.

- sao_offset_luma / cb / cr and sao_eo_class_luma / chroma are not decrypted (S244, S249).

- sao_luma_flag and sao_chroma_flag of the processing target slice are 0 (when SAO processing is not executed), the SAO parameter is not decoded (S242, S247).

- sao_offset_luma / cb / cr four categories of offset values are decoded. Note that sao_type_idx_chroma and sao_eo_class_chroma use a common value for Cb and Cr, sao_offset_cb is used for Cb, and sao_offset_cr is used for the SAO of Cr.

- FIG. 20 is a block diagram illustrating an example of the configuration of the image encoding device according to the present embodiment.

- the image coding apparatus 100B includes a slice division unit 101, a code block division unit 102, a subtraction unit 103, a conversion unit 104, a picture data coding unit 105, an inverse conversion unit 106, An addition unit 107, a frame memory, a DBF processing unit 109, a SAO processing unit 110, a prediction unit 111, a DBF_SAO processing determination unit 120, and a slice boundary reference determination unit 130 are provided.

- the DBF_SAO processing determining unit 120 outputs the processing result to the slice boundary reference determining unit 130, as compared with the image encoding device 100A according to the first embodiment (FIG. 1). Is different.

- FIG. 21 is a flowchart illustrating an example of a processing procedure of the image encoding method according to the present embodiment.

- the overall flow of the image coding method according to the present embodiment shown in FIG. 21 is different from the overall flow of the image coding method according to the first embodiment (FIG. 2) only in S301 and S302 performed by the slice boundary reference determination unit 130. Therefore, the part will be described.

- S301 is executed after S103.

- the processing target slice DBF, SAO Luma, and SAO Croma are set to ON or OFF.

- the slice boundary reference determination unit 130 determines slice_loop_filter_cross_slices_enabled_flag as in the first embodiment (S104).

- the slice boundary reference determination unit 130 does not perform the determination process of slice_loop_filter_cross_slices_enabled_flag (S104), and sets it to 0 (prohibits boundary reference).

- Set (S302) That is, when both DBF and SAO are off, pixel reference across the upper and left boundaries of the slice is always prohibited.

- the configuration of the SAO processing unit, the flow of SAO processing, the flow of SAO offset addition processing, the configuration of the picture data encoding unit, and the coding flow of picture data of this embodiment are the same as the configuration of the SAO processing unit of Embodiment 1 ( 3), SAO processing flow (FIG. 4), SAO offset addition processing flow (FIG. 5), picture data encoding unit configuration (FIG. 6), and picture data encoding flow (FIG. 7). Therefore, the description is omitted.

- FIG. 22 is a flowchart illustrating an example of a processing procedure for encoding a slice boundary reference permission flag.

- the encoding flow of the slice boundary reference permission flag of the present embodiment is different from that of the first embodiment only in S303 performed by the slice boundary reference encoding unit 105d.

- S303 is executed when it is determined in S173 in FIG. 8 that loop_filter_cross_slices_enabled_flag is 1 (Yes in S173).

- the slice boundary reference encoding unit 105d encodes slice_loop_filter_cross_slices_enabled_flag as in the first embodiment (S174).

- the slice boundary reference encoding unit 105d does not encode slice_loop_filter_cross_license_enabled_flag, and always sets it to 0 (forbids boundary reference). (S175).

- slice_loop_filter_cross_licenses_enabled_flag is always treated as 0 without being decoded. Therefore, it can be normally decoded.

- SAO parameter encoding The SAO parameter encoding flow according to the present embodiment is the same as the SAO parameter encoding flow according to the first embodiment (FIG. 9), and a description thereof will be omitted.

- slice_loop_filter_cross_slices_enabled_flag is always set to 0 (no boundary reference is allowed) without encoding, thereby improving the image quality while reducing the code amount. realizable.

- slice_loop_filter_cross_slices_enabled_flag is not included in the code string, and therefore the code amount can be reduced.

- slice_loop_filter_cross_slices_enabled_flag is 0, so that decoding can be performed normally.

- slice_loop_filter_cross_slices_enabled_flag is targeted for pixel reference at the upper boundary and left boundary of the slice, and the pixel of the processing target slice may be referred to by the SAO of the upper slice and the left slice of the processing target slice. Is determined by slice_loop_filter_cross_slices_enabled_flag of the slice to be processed.

- slice_loop_filter_cross_slices_enabled_flag is always set to 0 when the DBF and SAO of the processing target slice are off, the SAO of the upper slice and the left slice cannot always refer to the pixels of the processing target slice. For example, in FIG.

- FIG. 23 is a flowchart illustrating an example of a processing procedure for decoding a slice boundary reference permission flag according to the present embodiment.

- the decoding flow of the slice boundary reference permission flag of this embodiment shown in FIG. 23 differs from the decoding flow of the slice boundary reference permission flag of Embodiment 2 shown in FIG.

- step S401 is executed when it is determined in step S173 that loop_filter_cross_slices_enabled_flag is 1.

- the slice boundary reference decoding unit 201d does not decode slice_loop_filter_cross_slices_enabled_flag and always sets it to 0 (indicating boundary reference).

- the slice boundary reference decoding unit 201d decodes slice_loop_filter_cross_slices_enabled_flag (S222).

- SAO parameter decoding Operation (SAO parameter decoding)>

- the SAO parameter decoding flow according to the present embodiment is the same as the SAO parameter decoding flow according to the second embodiment (FIG. 19), and a description thereof will be omitted.

- FIG. 24 is a block diagram illustrating an example of the configuration of the image encoding device according to the present embodiment.

- the image coding apparatus 100C includes a slice division unit 101, a code block division unit 102, a subtraction unit 103, a conversion unit 104, a picture data coding unit 105, an inverse conversion unit 106, An addition unit 107, a frame memory, a DBF processing unit 109, a SAO processing unit 110, a prediction unit 111, a DBF_SAO processing determination unit 120, a slice boundary reference determination unit 130, and a SAO dummy flag setting unit 140 are provided.

- the image coding apparatus 100C according to the present embodiment is different from the image coding apparatus 100A according to the first embodiment (FIG. 1) in that a SAO dummy flag setting unit 140 is newly provided.

- FIG. 25 is a flowchart illustrating an example of a processing procedure of the image encoding method according to the present embodiment.

- the overall flow of the image coding method of the present embodiment shown in FIG. 25 is different from the overall flow of the image coding method of the first embodiment (FIG. 2) only in S501 to S505 performed by SAO dummy flag setting unit 140. Therefore, the part will be described.

- S501 is executed after setting the loop_filter_cross_slices_enabled_flag in S114.

- the SAO dummy flag setting unit 140 first initializes the SAO dummy flag to 0 (S501). The SAO dummy flag setting unit 140 determines that if the processing target slice DBF and SAO are both off (Yes in S502), and if the slice_loop of the slice_loop_filter_access_enabled_flag and the loop_filter_access_sliced_enabled_flag is different from the _s in the _s_s in the s_s_a and s_s in the s Is set to 1 (Luma's SAO is on), and the SAO dummy flag is set to 1.

- FIG. 26 is a block diagram showing an internal configuration of the SAO processing unit.

- the SAO processing unit 110 of this embodiment is different from the SAO processing unit 110 of Embodiment 1 (FIG. 3) in that an SAO dummy flag is input to the SAO parameter determination unit 110a.

- FIG. 27 is a flowchart illustrating an example of the processing procedure of the SAO processing (entire).

- the SAO processing flow of the present embodiment is different from the SAO processing flow of the first embodiment (FIG. 4) only in S511 and S512.

- S501 is executed immediately after the start of the SAO processing flow.

- the SAO parameter determination unit 110a performs a determination process for determining SAO on or SAO off as in the first embodiment (S131).

- the SAO parameter determination unit 110a does not perform the SAO on or SAO off determination process, and the code block to be processed is always SAO off (sao_type_idx_luma / chroma is set to 0). (S512).

- SAO offset addition processing flow picture data encoding unit configuration, picture data encoding flow>

- the SAO offset addition process flow, the configuration of the picture data encoding unit 105, and the picture data encoding flow according to the present embodiment are the SAO offset addition process flow (FIG. 5) and the picture data encoding unit according to the first embodiment. (FIG. 6) and the picture data encoding flow (FIG. 7) are the same as those in FIG.

- FIG. 28 is a flowchart illustrating an example of a processing procedure for encoding a slice boundary reference permission flag.

- the coding flow of the slice boundary reference permission flag of the present embodiment differs from that of the third embodiment (FIG. 22) only in S521 performed by the slice boundary reference coding unit 105d, and will be described with reference to that portion.

- the slice boundary reference encoding unit 105d sets slice_loop_filter_cross_slices_enabled_flag to 0 when the processing target slice is the first slice in the picture (Yes in S172) (S175).

- the slice boundary reference encoding unit 105d proceeds to S173 when the processing target slice is not the first slice in the picture (No in S172).

- the slice boundary reference encoding unit 105d performs slice_loop_filter_cross_sliced_encoded_17 encoded (S4) when loop_filter_cross_license_enabled_flag is 1 (Yes in S173) and both DBF and SAO are not off (No in S303).

- the slice boundary reference encoding unit 105d encodes slice_loop_filter_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_sliced_slable_

- slice_loop_filter_cross_sliced_encoded_encoded_encoded_encoded_encoding_sliced_encoded_encoded_encoding_sliced_encoded_encoded_encoding_sliced_encoded_encoded_encoded_encoded_encoded_encoded_encoded_encoded_encoded_encoded_encoded_encoded_encoding Without using the value of loop_filter_cross_slices_enabled_flag, the decoding can be performed normally.

- SAO parameter encoding The SAO parameter encoding flow according to the present embodiment is the same as the SAO parameter encoding flow according to the first embodiment (FIG. 9), and a description thereof will be omitted.

- the slice boundary reference flag can be encoded even when both DBF and SAO are off, and the flexibility is improved. More specifically, when both DBF and SAO are OFF, the code amount is reduced by copying and using the loop_filter_cross_slices_enabled_flag without encoding the slice_loop_filter_cross_slices_enabled_flag during normal times.

- sao_luma_flag of the slice is forcibly set to 1 (SAO Luma on), and slice_loop_filter_cross_slices_enabled_flag is encoded.

- the sao_luma_flag of the slice is set to 1 (on), but by setting all the sao_type_idx_luma to be set to 0 (off) for each code block, the operation is actually the same as when SAO is turned off in units of slices. To be. That is, SAO is set on a slice basis, but SAO off is set on a code block basis, and actually the movement is SAO off on a slice basis. By doing so, it becomes possible to freely set the values of SAO on / off and slice_loop_filter_cross_slices_enabled_flag, and the flexibility can be improved.

- the Luma SAO (sao_luma_flag) of the slice is forcibly turned on (1 is set), but the Chroma SAO (sao_chroma_flag) is forcibly turned on (1 is set). Good. In that case, it goes without saying that sao_type_idx_chroma of the code block is turned off (set to 0).

- FIG. 29 is a flowchart illustrating an example of a processing procedure for decoding a slice boundary reference permission flag according to the present embodiment.

- the decoding flow of the slice boundary reference permission flag of the present embodiment is different from the decoding flow of the slice boundary reference permission flag of the fourth embodiment (FIG. 23) only in S601 performed by the slice boundary reference decoding unit 201d. explain.

- the slice boundary reference decoding unit 201d sets slice_loop_filter_cross_slices_enabled_flag to 0 when the processing target slice is the first slice in the picture (Yes in S172) (S175).

- the slice boundary reference decoding unit 201d proceeds to S173 when the processing target slice is not the first slice in the picture (No in S172).

- the slice boundary reference decoding unit 201d encodes slice_loop_filter_cross_slices_enable4 (encoded_slable_17) when loop_filter_cross_license_enabled_flag is 1 (Yes in S173) and DBF and SAO are not off (No in S401).

- the slice boundary reference decoding unit 201d sets the value of the slice_loop_filter_slice_enabled_slice to the slice_loop_filter_slice_enabled_slice, if the loop_filter_access_slices_enabled_flag is 0 (No in S173), or if both DBF and SAO are off (Yes in s401). (S601).

- SAO parameter decoding Operation (SAO parameter decoding)>

- the SAO parameter encoding flow of the present embodiment is the same as the SAO parameter encoding flow of the second embodiment (FIG. 19), and thus the description thereof is omitted.

- FIG. 30 is a block diagram showing an example of the configuration of the image encoding device 100D in the present embodiment.

- the image encoding device 100D includes a slice division unit 101, a code block division unit 102, a subtraction unit 103, a conversion unit 104, a picture data encoding unit 105, an inverse conversion unit 106, An addition unit 107, a frame memory, a DBF processing unit 109, a SAO processing unit 110, a prediction unit 111, a DBF_SAO processing determination unit 120, and a slice boundary reference determination unit 130 are provided.

- the image coding apparatus 100D according to the present embodiment is different from the image coding apparatus 100A according to the first embodiment (FIG. 1) in that the slice boundary reference determination unit 130 performs the SAO processing unit 110 and the picture data coding unit 105.

- slice_loop_filter_cross_slices_enabled_flag corresponding to the first flag in the present embodiment

- slice_loop_filter_cross_br_slices_enabled_flag (corresponding to the second flag in the present embodiment) is output.

- FIG. 31 is a flowchart illustrating an example of a processing procedure of the image coding method according to the present embodiment.

- the overall flow of the image coding method according to the present embodiment shown in FIG. 31 is different from the overall flow of the image coding method according to Embodiment 1 (FIG. 2) in that the slice boundary reference determining unit 130 replaces S104 with S701. Since it differs in the point which performs, it demonstrates about the part.

- the slice boundary reference determination unit 130 determines whether to allow or prohibit reference to pixels of another slice across the upper boundary and the left boundary of the processing target slice. Furthermore, when it is determined that the reference is permitted, the slice boundary reference determination unit 130 sets slice_loop_filter_cross_license_enabled_flag of the processing target slice to 1, and when it is determined to prohibit the slice boundary reference determination unit 130 sets slice_loop_filter_cross_slices_enabled_flag to 0.

- the slice boundary reference determination unit 130 determines whether to permit or prohibit the reference of pixels of another slice across the lower boundary and the right boundary of the slice. Furthermore, when it is determined that the reference is permitted, the slice boundary reference determination unit 130 sets slice_loop_filter_cross_br_slices_enabled_flag of the processing target slice to 1, and when it is determined to prohibit, the slice boundary reference determination unit 130 sets the slice_loop_filter_cross_br_sliced_enabled_enabled0 to the slice_enabled0. slice_loop_filter_cross_slices_enabled_flag and slice_loop_filter_cross_br_slices_enabled_flag exist for each slice.

- FIG. 32 is a block diagram showing an internal configuration of the SAO processing unit.

- the SAO processing unit 110 includes a SAO parameter determination unit 110a, a slice boundary reference determination unit 110b, and a SAO offset addition unit 110c.

- the SAO processing unit 110 of the present embodiment is different from the SAO processing unit 110 of the first embodiment (FIG. 3) in that slice_loop_filter_cross_br_slices_enabled_flag is input to the slice boundary reference determination unit 110b.

- FIG. 33 is a flowchart illustrating an example of a processing procedure of SAO processing (entire). Since the SAO processing flow of the present embodiment is different in that S701 is performed instead of S138 of the SAO processing flow of the first embodiment (FIG. 4), this portion will be described.

- the slice boundary reference determination unit 110b determines whether or not the reference pixel may be referred to by slice_loop_filter_cross_br_slices_enabled_flag of the processing target slice (S702).

- slice_loop_filter_cross_ slices_enabled_flag of slice 2 the boundary between slice 1 and slice 2 is determined by slice_loop_filter_cross_br_slices_gb_slices_gb_slices_grate_slice_g_slice_g_slice_g_slice

- FIG. 34 is a block diagram illustrating an example of an internal configuration of a picture data encoding unit.

- the picture data encoding unit 105 includes a transform coefficient encoding unit 105a, a prediction information encoding unit 105b, a SAO parameter encoding unit 105c, a slice boundary reference encoding unit 105d, and a DBF_SAO execution flag code. And a conversion unit 105e.

- the picture data encoding unit 105 of the present embodiment differs from the picture data encoding unit 105 of the first embodiment (FIG. 6) in that slice_loop_filter_cross_br_slices_enabled_flag is input to the slice boundary reference encoding unit 105d.

- the picture data encoding flow of the present embodiment is the same as the picture data encoding flow of the first embodiment (FIG. 7), and thus the description thereof is omitted.

- FIG. 35 is a flowchart illustrating an example of a processing procedure for encoding a slice boundary reference permission flag.

- the coding flow of the slice boundary reference permission flag of the present embodiment is different from the coding flow of the slice boundary reference permission flag of the third embodiment (FIG. 22) in that the processing of S711 to S714 is added. Therefore, the part will be described.

- the slice boundary reference encoding unit 105d executes S701 to S704 to set slices_loop_filter_bress_sl_sl_sl_7 To S714).

- the slice boundary reference encoding unit 105d sets the slice_loop_filter_cross_grate_slice_g_sliced_0_less_encoded_slice_loop_filter_cross_gly_sliced_less_gly_sliced_0_slice_loop_sliced_sl_less_encoding_sl Is used (S714).

- the slice boundary reference encoding unit 105d performs slice_loop_filter_cross_br_sliced_13_sliced_sliced_sliced_slice_13_sliced_sliced_sliced_sliced_sliced_sliced_sl_13_encoded_sliced_sliced_sl_13_sliced_sliced_sliced_sliced_sliced_sliced_sl_13_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sl_13_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sliced_sl

- loop_filter_cross_licenses_enabled_flag is 1, and when at least one of DBF and SAO is on, slice_loop_filter_cross_br_licenses_enabled_flag is decoded.

- SAO parameter encoding The SAO parameter encoding flow according to the present embodiment is the same as the SAO parameter encoding flow according to the first embodiment (FIG. 9), and a description thereof will be omitted.

- slice_loop_filter_cross_br_slices_enabled_flag of slice 1 and slice_loop_filter_cross_slices_edge_slice_edge_slice0 This can be realized by setting slice_loop_filter_cross_br_slices_enabled_flag of slice_slice_loop_filter_cross_slice_enabled_flag of slice 3 to 1. By doing so, it becomes possible to perform SAO at all boundaries other than reference prohibition, leading to an improvement in image quality.

- a pixel included in a slice may refer to a pixel in another slice based on a flag in its own slice, to reduce dependency between slices, and to process each slice in parallel It was a useful structure. More specifically, if the determination of whether the SAO may refer to a pixel of another slice is made based on the flag of another slice including the reference pixel, in the case of an image decoding apparatus, SAO cannot start processing until the flag is decoded, and it becomes necessary to monitor the processing status of another slice. In this case, there is a demerit such that a monitoring process for another slice is necessary or a waiting time occurs when each slice is processed in parallel. In this embodiment, the disadvantage can be eliminated.

- slice_loop_filter_cross_slices_enabled_flag and slice_loop_filter_cross_br_slices_enabled_flag of the slice can be used from another slice, so it is not necessary to reduce the coding amount.

- slice_loop_filter_access_slices_enabled_flag and slice_loop_filter_sl_sl_used_sl_ are used.

- the value of loop_filter_cross_slices_enabled_flag may be copied and used, as shown in the fifth embodiment (FIG. 28).

- FIG. 36 is a block diagram illustrating an example of a configuration of the image decoding device according to the present embodiment.

- the image decoding apparatus 200D includes a picture data decoding unit 201, an inverse conversion unit 202, an addition unit 203, a frame memory 204, a DBF processing unit 205, a SAO processing unit 206, and a motion A compensation unit 207 is provided.

- the picture data decoding unit 201 further decodes slice_loop_filter_cross_br_slices_enabled_flag and outputs it to the SAO processing unit 206 as compared with the image decoding device 200A according to the second embodiment (FIG. 12). It is different in point.

- FIG. 37 is a block diagram illustrating an example of the internal configuration of the SAO processing unit 206.

- the SAO processing unit 206 of the present embodiment includes a slice boundary reference determination unit 206a and an SAO offset addition unit 206b.

- the SAO processing unit 206 of the present embodiment is different from the SAO processing unit 206 of the second embodiment (FIG. 14) in that slice_loop_filter_cross_br_slices_enabled_flag is input to the slice boundary reference determination unit 206a.

- FIG. 38 is a flowchart illustrating an example of a processing procedure of the SAO processing according to the present embodiment.

- the SAO process flow shown in FIG. 38 is different from the SAO process flow (FIG. 33) of the seventh embodiment in determining sao_type_idx_luma / chroma processed by the SAO parameter determining unit 110a, determining sao_eo_class_luma / chroma, and sao_offset_luma / c / b.

- these parameters use data decoded by the picture data decoding unit 201.

- the SAO offset addition process is the same as that in the first embodiment (FIG. 5), and thus the description thereof is omitted.

- FIG. 39 is a block diagram illustrating an example of an internal configuration of the picture data decoding unit 201.

- the picture data decoding unit 201 includes a transform coefficient decoding unit 201a, a prediction information decoding unit 201b, an SAO parameter decoding unit 201c, a slice boundary reference decoding unit 201d, and a DBF_SAO execution flag decoding unit 201e. Yes.

- the picture data decoding unit 201 of the present embodiment is different from the picture data decoding unit 201 of the second embodiment (FIG. 16) in that the slice boundary reference decoding unit 201d further decodes and outputs slice_loop_filter_cross_br_slices_enabled_flag. Different.

- the picture data decoding flow according to the present embodiment is the same as the picture data decoding flow according to the second embodiment (FIG. 17), and a description thereof will be omitted.

- FIG. 40 is a flowchart illustrating an example of a processing procedure for decoding the slice boundary reference permission flag according to the present embodiment.

- the decoding flow of the slice boundary reference permission flag of the present embodiment is the same as that of the seventh embodiment except that S222 and S801 are executed instead of S174 and S713, and thus the description thereof is omitted.

- the slice boundary reference decoding unit 201d decodes slice_loop_filter_cross_slices_enabled_flag. Note that S222 is the same as S222 in the second embodiment shown in FIG.

- the slice boundary reference decoding unit 201d decodes slice_loop_filter_cross_br_slices_enabled_flag.

- SAO parameter decoding Operation (SAO parameter decoding)>

- the SAO parameter decoding flow according to the present embodiment is the same as the SAO parameter decoding flow according to the second embodiment (FIG. 19), and a description thereof will be omitted.

- each of the functional blocks can usually be realized by an MPU, a memory, or the like. Further, the processing by each of the functional blocks can be usually realized by software (program), and the software is recorded in a recording medium such as a ROM. Such software may be distributed by downloading or the like, or may be recorded on a recording medium such as a CD-ROM for distribution. Naturally, each functional block can be realized by hardware (dedicated circuit).

- each embodiment may be realized by performing centralized processing using a single device (system), or may be realized by performing distributed processing using a plurality of devices.

- the computer that executes the program may be singular or plural. That is, centralized processing may be performed, or distributed processing may be performed.

- the present invention is not limited to the above embodiment.

- the information for determining the SAO process is described as a flag.

- the present invention is not limited to binary information of 0 and 1, and a plurality of processes. It may be a multivalued value that selectively determines. It goes without saying that such various modifications are possible and are included in the scope of the present invention.

- the storage medium may be any medium that can record a program, such as a magnetic disk, an optical disk, a magneto-optical disk, an IC card, and a semiconductor memory.

- the system has an image encoding / decoding device including an image encoding device using an image encoding method and an image decoding device using an image decoding method.

- image encoding / decoding device including an image encoding device using an image encoding method and an image decoding device using an image decoding method.

- Other configurations in the system can be appropriately changed according to circumstances.

- FIG. 41 is a diagram showing an overall configuration of a content supply system ex100 that realizes a content distribution service.