WO2013175748A1 - 動画像符号化方法、動画像復号方法、動画像符号化装置、動画像復号装置、および動画像符号化復号装置 - Google Patents

動画像符号化方法、動画像復号方法、動画像符号化装置、動画像復号装置、および動画像符号化復号装置 Download PDFInfo

- Publication number

- WO2013175748A1 WO2013175748A1 PCT/JP2013/003158 JP2013003158W WO2013175748A1 WO 2013175748 A1 WO2013175748 A1 WO 2013175748A1 JP 2013003158 W JP2013003158 W JP 2013003158W WO 2013175748 A1 WO2013175748 A1 WO 2013175748A1

- Authority

- WO

- WIPO (PCT)

- Prior art keywords

- information

- sao

- decoding

- offset

- encoding

- Prior art date

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/105—Selection of the reference unit for prediction within a chosen coding or prediction mode, e.g. adaptive choice of position and number of pixels used for prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/117—Filters, e.g. for pre-processing or post-processing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/13—Adaptive entropy coding, e.g. adaptive variable length coding [AVLC] or context adaptive binary arithmetic coding [CABAC]

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/132—Sampling, masking or truncation of coding units, e.g. adaptive resampling, frame skipping, frame interpolation or high-frequency transform coefficient masking

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/46—Embedding additional information in the video signal during the compression process

- H04N19/463—Embedding additional information in the video signal during the compression process by compressing encoding parameters before transmission

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/90—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using coding techniques not provided for in groups H04N19/10-H04N19/85, e.g. fractals

- H04N19/91—Entropy coding, e.g. variable length coding [VLC] or arithmetic coding

-

- H—ELECTRICITY

- H03—ELECTRONIC CIRCUITRY

- H03M—CODING; DECODING; CODE CONVERSION IN GENERAL

- H03M13/00—Coding, decoding or code conversion, for error detection or error correction; Coding theory basic assumptions; Coding bounds; Error probability evaluation methods; Channel models; Simulation or testing of codes

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/80—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation

- H04N19/82—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation involving filtering within a prediction loop

Definitions

- the present invention relates to a moving image encoding method and decoding method.

- Non-patent Document 1 High Efficiency Video Coding

- ITU-T International Telecommunication Union Telecommunication Standardization Sector

- ISO / IEC ISO / IEC standard

- MPEG-x MPEG-x.

- the latest and most advanced image coding standard is currently H.264.

- H.264 / AVC or MPEG-4 AVC is being studied as a standard next to the standard (see Non-Patent Document 2).

- SAO Sample Adaptive Offset

- SAO is an offset process that adds an offset value for each predetermined region, section, or type in order to reduce coding degradation, and is performed on a provisional decoded image (reconstructed image) (Non-Patent Document). 3).

- JCT-VC Joint Collaborative Team on Video Coding

- JCT-VC Advanced Video Coding for Generic Audiovisual Services

- the present invention provides a moving image encoding method and a moving image decoding method capable of improving the processing efficiency.

- a moving image encoding method is a moving image encoding method for generating a bitstream by encoding an input image, and is included in an image generated by encoding the input image.

- the first information of a plurality of types of SAO information used for SAO (Sample Adaptive Offset), which is a process of giving an offset value to the pixel value of a pixel, is encoded by context adaptive arithmetic coding using a variable probability value.

- the second information and the third information of the plurality of types of SAO information are continuously encoded by bypass arithmetic encoding using a fixed probability value, and are encoded in the bitstream.

- the encoded second information and third information are arranged after the first information.

- a recording medium such as a system, a method, an integrated circuit, a computer program, or a computer-readable CD-ROM (Compact Disc Only Memory). You may implement

- the moving picture encoding method and moving picture decoding method of the present invention can improve the processing efficiency.

- FIG. 1A is a diagram showing information used for offset processing called SAO.

- FIG. 1B is a diagram showing other information used for offset processing called SAO.

- FIG. 1C is a diagram showing other information used for offset processing called SAO.

- FIG. 1D is a diagram showing other information used for offset processing called SAO.

- FIG. 2 is a block diagram showing a functional configuration of the SAO information decoding unit.

- FIG. 3 is a flowchart showing an operation flow of the SAO information decoding unit.

- FIG. 4 is a flowchart showing context adaptive arithmetic decoding.

- FIG. 5 is a flowchart showing bypass arithmetic decoding.

- FIG. 6 is a flowchart showing normalization processing of the arithmetic decoding method.

- FIG. 1A is a diagram showing information used for offset processing called SAO.

- FIG. 1B is a diagram showing other information used for offset processing called SAO.

- FIG. 1C is a diagram showing other information used for

- FIG. 7 is a block diagram showing an example of the configuration of the video decoding apparatus according to Embodiment 1.

- FIG. 8 is a block diagram showing a functional configuration of the SAO information decoding unit according to the first embodiment.

- FIG. 9 is a flowchart showing arithmetic decoding by the SAO information decoding unit according to Embodiment 1.

- FIG. 10A is a diagram for describing an example of a list of parameters included in the SAO information and a decoding order of the parameters in the first embodiment.

- FIG. 10B is a diagram for explaining an example of the arrangement of parameters included in the SAO information and the decoding order of the parameters, corresponding to the flowchart of FIG. 3.

- FIG. 10A is a diagram for describing an example of a list of parameters included in the SAO information and a decoding order of the parameters in the first embodiment.

- FIG. 10B is a diagram for explaining an example of the arrangement of parameters included in the SAO information and the decoding order of the parameters, corresponding to

- FIG. 10C is a diagram for describing another example of the arrangement of parameters included in the SAO information and the decoding order of the parameters in Embodiment 1.

- FIG. 11 is a block diagram illustrating an example of a configuration of a video encoding apparatus according to Embodiment 2.

- FIG. 12 is a flowchart showing arithmetic coding by the SAO information coding unit according to Embodiment 2.

- FIG. 13A is a diagram illustrating a syntax for generating a conventional bitstream.

- FIG. 13B is a diagram illustrating a syntax for generating a bitstream according to Embodiment 2.

- FIG. 14 is a diagram illustrating a syntax for generating another bitstream in the second embodiment.

- FIG. 15A is a flowchart of a video encoding method in the embodiment.

- FIG. 15B is a block diagram of the video encoding apparatus in the embodiment.

- FIG. 15C is a flowchart of the moving image decoding method according to the embodiment.

- FIG. 15D is a block diagram of the video decoding device in the embodiment.

- FIG. 16 is an overall configuration diagram of a content supply system that realizes a content distribution service.

- FIG. 17 is an overall configuration diagram of a digital broadcasting system.

- FIG. 18 is a block diagram illustrating a configuration example of a television.

- FIG. 19 is a block diagram illustrating a configuration example of an information reproducing / recording unit that reads and writes information from and on a recording medium that is an optical disk.

- FIG. 20 is a diagram illustrating a structure example of a recording medium that is an optical disk.

- FIG. 21A is a diagram illustrating an example of a mobile phone.

- FIG. 21B is a block diagram illustrating a configuration example of a mobile phone.

- FIG. 22 is a diagram showing a structure of multiplexed data.

- FIG. 23 is a diagram schematically showing how each stream is multiplexed in the multiplexed data.

- FIG. 24 is a diagram showing in more detail how the video stream is stored in the PES packet sequence.

- FIG. 25 is a diagram illustrating the structure of TS packets and source packets in multiplexed data.

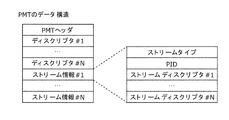

- FIG. 26 is a diagram illustrating a data structure of the PMT.

- FIG. 27 is a diagram showing an internal configuration of multiplexed data information.

- FIG. 28 shows the internal structure of stream attribute information.

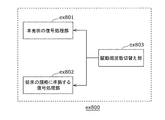

- FIG. 29 is a diagram illustrating steps for identifying video data.

- FIG. 30 is a block diagram illustrating a configuration example of an integrated circuit that realizes the moving image encoding method and the moving image decoding method according to each embodiment.

- FIG. 31 is a diagram showing a configuration for switching the driving frequency.

- FIG. 32 is a diagram illustrating steps for identifying video data and switching between driving frequencies.

- FIG. 33 is a diagram showing an example of a look-up table in which video data standards are associated with drive frequencies.

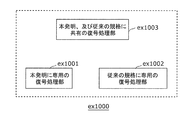

- FIG. 34A is a diagram illustrating an example of a configuration for sharing a module of a signal processing unit.

- FIG. 34B is a diagram illustrating another example of a configuration for sharing a module of a signal processing unit.

- 1A to 1D are diagrams showing four types of information used in offset processing called SAO. These four types of information (parameters) are SAO type information (sao_type_idx), SAO pixel value width position information (sao_band_position), SAO offset value (sao_offset [i]), and SAO offset sign (sao_offset_sign [i]). These pieces of information are collectively referred to as SAO information.

- SAO type information indicates that no offset processing is performed or the type of offset processing performed as shown in FIG. 1A.

- the offset processing includes an edge offset for performing offset processing on the pattern in the edge direction and a band offset for performing offset processing on pixel values included in a certain fixed width (predetermined pixel value range). .

- the edge offset is further classified into several types according to the direction of the edge. For example, in Non-Patent Document 3, the content indicated by the SAO type information is classified into six types as shown in FIG. 1A. A part of this SAO type information is arithmetically encoded (context adaptive arithmetic encoding) using a context corresponding to a variable probability value, and recorded in the bitstream.

- SAO pixel value width position information is information used for band offset. For example, the level width of the image signal to be handled (0 to 255 in the case of 8 bits) is divided into 32 sections.

- the SAO pixel value width position information indicates from which point of the 32 sections the band offset is applied to the section (at least one continuous section). For example, in Non-Patent Document 3, the number of consecutive sections is four.

- the SAO pixel value width position information indicates 1 and an 8-bit image signal

- the SAO pixel value width position information includes pixel values 8 to 15, 16 to 23, 24 to 31, and 32 to 39, respectively. Indicates that offset processing is to be performed for each category.

- the SAO pixel value width position information has a fixed length of 5 bits and is encoded by a method called bypass arithmetic encoding using a fixed probability value without using a variable probability value. And recorded in the bitstream.

- the SAO offset value (sao_offset [i]) is an offset value that is actually given to the type of edge offset indicated by the SAO type information or the division (at least one continuous division) indicated by the SAO pixel value width position information. Indicates. Note that i represents the type or category described above. That is, the SAO offset value indicates the offset value for the type of edge offset or band offset indicated by i for each i. For example, in Non-Patent Document 3, i takes four types from 0 to 3. That is, in the case of the edge offset value, the SAO offset value is a pattern (for example, saddle type, ⁇ type, / type, ⁇ type) for each of the aforementioned edge directions (0, 45, 90, and 135 degrees).

- the values of 0 to 7 are shown as offset values for the four types.

- the SAO offset value indicates a value from 0 to 7 as an offset value for each of the above-described four sections. Then, at least a part of the SAO offset value is arithmetically encoded using the above-described context and recorded in the bitstream (see FIG. 1C).

- SAO offset sign indicates the sign of the SAO offset value described above.

- i is the same as i used for the aforementioned SAO offset value, and associates the SAO offset value with the SAO offset sign.

- the SAO type information indicates an edge offset

- the SAO sign is not used, and the offset value indicated by the SAO offset value is always treated as positive. Therefore, this SAO offset sign is not described in the bit stream.

- the SAO type information indicates a band offset

- a SAO offset sign is used for each of the four sections of the SAO offset value. Therefore, each SAO offset positive / negative code is encoded by the method of bypass arithmetic encoding described above and recorded in the bit stream (see FIG. 1D).

- FIG. 2 is a block diagram showing a functional configuration of the SAO information decoding unit.

- the SAO information decoding unit A01 includes SAO type information (sao_type_idx), SAO pixel value width position information (sao_band_position), SAO offset value (sao_offset [i]), and SAO offset sign (sao_offset_sign [signo] which are part of SAO information. ]) Variable length decoding (arithmetic decoding).

- the SAO information decoding unit A01 includes a Sao_Type decoding unit A02 that decodes SAO type information, a Sao_Type determination unit A03 that determines the type of offset processing indicated by the SAO type information, switches A04, A05, A06, and SAO pixels.

- Sao_band_position decoding unit A07 that decodes the value width position information

- Sao_Offset decoding unit A08 that decodes the SAO offset value

- Sao_offset_sign decoding unit A09 that decodes the SAO offset sign

- a data storage position setting unit A10 and a data storage unit A11

- the SAO information is restored from the bitstream BS.

- FIG. 3 is a flowchart showing an example of the operation flow of the SAO information decoding unit A01.

- the Sao_Type decoding unit A02 of the SAO information decoding unit A01 decodes the SAO type information (sao_type_idx) from the bit stream BS (SB01).

- the Sao_Type determination unit A03 determines whether or not sao_type_idx indicates a band offset for performing offset processing on a pixel value included in a certain fixed width (predetermined pixel value range) (SB02).

- the Sao_Type determination unit A03 sets the switch A04 to ON.

- the Sao_band_position decoding unit A07 decodes the SAO pixel value width position information (sao_band_position) (SB03).

- the data storage position setting unit A10 determines a storage location in the data storage unit A11 based on the decoded SAO pixel value width position information. On the other hand, when it is determined that the band offset is not indicated (NO in SB02), the Sao_Type determination unit A03 sets the switch A04 to OFF. Next, the Sao_Type determination unit A03 determines whether the sao_type_idx indicates that the offset process is not performed (Sao off) (SB04). If it is determined that Sao is off (YES in SB04), the Sao_Type determination unit A03 sets the switches A04, A05, and A06 to OFF, and ends the SAO information decoding process.

- the Sao_Type determination unit A03 sets the switch A05 to ON.

- the Sao_Offset decoding unit A08 decodes the SAO offset value (sao_offset) from the bit stream BS (SB05).

- the decrypted SAO offset value is stored at the position of the data storage unit A11 set by the data storage position setting unit A10.

- the decoding in step SB05 is continued until a predetermined number of SAO offset values are decoded (while NO in SB06).

- the Sao_Type determination unit A03 determines whether sao_type_idx indicates a band offset (SB07). When it is determined that the band offset is indicated (YES in SB07), the Sao_Type determination unit A03 sets the switch A06 to ON.

- the Sao_offset_sign decoding unit A09 decodes the SAO offset sign corresponding to the SAO offset value (SB09). In this case, the SAO offset value in the data storage unit A11 is updated with the decoded SAO offset sign.

- the decoded SAO offset value is zero (YES in SB08)

- the SAO offset plus / minus sign has no particular meaning, so the Sao_offset_sign decoding unit A09 skips decoding.

- the Sao_offset_sign decoding unit A09 continues decoding until the SAO offset sign for a predetermined number of SAO offset values is decoded (while NO in SB10).

- the SAO information decoding unit A01 ends decoding of the SAO information.

- the parameter that is information decoded in the steps surrounded by the double frame in FIG. 3 is a parameter that is decoded by bypass arithmetic decoding that does not require a variable probability value.

- a parameter that is information decoded in steps surrounded by a normal frame line is a parameter that is information that is decoded using a variable probability value, and is scattered in the bitstream.

- variable length coding such as context adaptive arithmetic coding using variable probability values and bypass arithmetic coding not using variable probability values

- CABAC Context Adaptive Binary Arithmetic Coding

- FIG. 4 is a flowchart showing context adaptive arithmetic decoding.

- FIG. 4 is extracted from Non-Patent Document 2, and is as described in Non-Patent Document 2 unless otherwise specified.

- a context (ctxIdx) determined based on a signal type is input.

- a value “qCodIRRangeIdx” is calculated from the first parameter “codIRRange” indicating the current state in the arithmetic decoding apparatus, and a pStateIdx that is a state value corresponding to ctxIdx is obtained.

- the codIRangeLPS is obtained by referring to (rangeTableLPS). This codIRrangeLPS means that in the arithmetic decoding device when LPS (indicating a symbol with a low probability of occurrence among symbols 0 and 1) occurs for the first parameter “codIRrange” indicating the state in the arithmetic decoding device. This parameter indicates the status of

- codIRRange a value obtained by subtracting the above-mentioned codIRrangeLPS from the current codIRrange is set (step SC01).

- the calculated codIRRange is compared with the second parameter “codIOoffset” indicating the state in the arithmetic decoding device (step SC02).

- codIOoffset is equal or larger (Yes in SC02)

- a value obtained by subtracting codIRRange is set in the second parameter “codIOoffset” indicating the state in the arithmetic decoding apparatus. Since LPS has occurred in the first parameter “codIRrange” indicating the state in the arithmetic decoding apparatus, the value of codIRrangeLPS calculated in step SC01 is set (step SC03).

- pStateIdx is not 0 (No in step SC05)

- pStateIdx is updated based on the conversion table “transIdxLPS” when LPS occurs (step SC07).

- codIOoffset is small (No in SC02), it is determined that an MPS symbol has been generated, valMPS is set in the decoded output value binVal, and pStateIdx is converted into the conversion table “transIdxMPS when MPS occurs. Is updated based on "(step SC04).

- step SC08 normalization processing (RenormD) is performed (step SC08), and context adaptive arithmetic decoding is terminated.

- a plurality of symbol occurrence probabilities which are occurrence probabilities of binary symbols, are stored in association with context indexes, and are switched according to conditions (for example, refer to values of adjacent blocks). It is necessary to maintain the order of processing.

- FIG. 5 is a flowchart of bypass arithmetic decoding.

- FIG. 5 is extracted from Non-Patent Document 2, and is as described in Non-Patent Document 2 unless otherwise specified.

- the second parameter “codIOoffset” indicating the current state of the arithmetic decoding device is shifted left (doubled), 1 bit is read from the bit stream, and if the read bit is 1, further +1, 0 If so, the value of (doubled) is set as it is (SD01).

- codIOoffset is equal to or larger than the first parameter “codIRrange” indicating the state in the arithmetic decoding apparatus (Yes in SD02)

- “1” is set to binVal which is a decoding output value

- codIRange is set to codIOoffset. Is set (step SD03).

- codIOoffset is smaller than the first parameter “codIRRange” indicating the state in the arithmetic decoding apparatus (No in SD02)

- “0” is set to binVal which is a decoded output value (step SD04).

- FIG. 6 is a flowchart for explaining in detail the normalization process (RenormD) shown in step SC08 of FIG. This drawing is extracted from Non-Patent Document 2, and is as described in Non-Patent Document 2 unless otherwise specified.

- codIRrange When the first parameter “codIRrange” indicating the state in the arithmetic decoding apparatus is smaller than 0x100 (hexadecimal: 256 (decimal)) in context adaptive arithmetic decoding (Yes in step SE01), codIRrange is set to the left. Shift (twice), left-shift (twice) the second parameter “codIOoffset” indicating the state in the arithmetic decoding device, read 1 bit from the bitstream, and if the read bit is 1, then +1, If it is 0, the value (twice) is set as it is (SE02).

- Non-Patent Document 3 places importance on improving data storability, so that the degree of parallelism in arithmetic encoding or arithmetic decoding, the arrangement of encoded bits, etc. are insufficient. In addition, an extra bit length is required, and as a result, there is a problem that a burden is imposed on encoding and decoding of SAO information.

- the present invention can improve the processing efficiency without reducing the encoding efficiency while maintaining the data storage property when the SAO information, which is the information necessary for the SAO, is arithmetically encoded or arithmetically decoded.

- the SAO information which is the information necessary for the SAO

- arithmetically encoded or arithmetically decoded Provided are a possible video encoding method, video encoding device, video decoding method, video decoding device, and the like.

- encoding may be used in the meaning of encoding.

- a moving image encoding method is a moving image encoding method for generating a bitstream by encoding an input image, and is included in an image generated by encoding the input image.

- the first information of a plurality of types of SAO information used for SAO (Sample Adaptive Offset), which is a process of giving an offset value to the pixel value of a pixel, is encoded by context adaptive arithmetic coding using a variable probability value.

- the second information and the third information of the plurality of types of SAO information are continuously encoded by bypass arithmetic encoding using a fixed probability value, and are encoded in the bitstream.

- the encoded second information and third information are arranged after the first information.

- the context adaptive arithmetic coding cannot be processed in parallel, and the bypass arithmetic coding can be processed in bit units in parallel. Therefore, in the moving picture coding method according to an aspect of the present invention, the second information bypass arithmetic coding and the third information bypass arithmetic coding are performed by context adaptive arithmetic coding of the first information. Since it is performed continuously without being performed intermittently, the amount of information that can be continuously processed in parallel can be increased, and as a result, the efficiency of the parallel processing can be improved. For example, the degree of parallelism can be increased by increasing the number of bits in which bypass arithmetic coding is performed in parallel.

- bypass arithmetic coding since the probability value is fixed, before obtaining the symbol to be coded, arithmetic coding when the symbol is 0 and arithmetic coding when the symbol is 1 are performed. It can be done in parallel in advance. That is, for each symbol generation pattern, arithmetic coding according to the generation pattern can be performed in advance. In other words, pre-read processing can be performed in bypass arithmetic coding. Therefore, by performing the bypass arithmetic encoding of the second information and the bypass arithmetic encoding of the third information in succession, the above-described prefetched processing can be effectively used.

- the second information and the third information that are subjected to bypass arithmetic coding are encoded by context adaptive arithmetic coding. Therefore, the moving picture decoding apparatus can easily decode the second information and the third information successively by bypass arithmetic decoding because the first information is not divided and is arranged after the first information. can do. As a result, the efficiency of parallel processing can be improved even when decoding. Further, in the bitstream, the first information encoded by the context adaptive arithmetic coding is preceded by the second information and the third information encoded by the bypass arithmetic coding.

- the decoding apparatus can start context adaptive arithmetic decoding of the first information before bypass arithmetic decoding of the second information and the third information, so that decoding of the first information is performed. Before the end, decoding of the second information and the third information can be started. As a result, the processing speed can be increased.

- one of the second information and the third information may be sao_band_position indicating a range of pixel values to which the SAO is applied.

- sao_band_position can be efficiently encoded.

- the first information is sao_offset indicating the absolute value of the offset value

- sao_band_position is arranged after sao_offset in the bitstream.

- sao_band_position is decoded after sao_offset. Therefore, even if sao_offset is decoded, but sao_band_position is not decoded, the decoded sao_offset is converted to the pixel value range indicated by sao_band_position (the range of pixel values indicated by sao_band_position).

- the pixel value included in the pixel value range indicated by the sao_band_position is determined by sao_offset.

- the absolute value of the indicated offset value can be applied appropriately. As a result, SAO can be appropriately performed while improving processing efficiency.

- the other of the second information and the third information may be sao_offset_sign indicating whether an offset value given to the pixel value to which the SAO is applied is positive or negative. Good.

- sao_offset_sign can be efficiently encoded.

- sao_offset_sign is arranged after sao_offset in the bitstream.

- the absolute value of the offset value indicated by sao_offset is 0, the sao_offset_sign can be omitted. As a result, the encoding efficiency can be improved.

- the sao_band_position may be encoded after the sao_offset_sign is encoded.

- the first information is sao_offset indicating the absolute value of the offset value

- the pieces of information are arranged in the order of sao_offset, sao_offset_sign, and sao_band_position in the bitstream.

- the video decoding device can decode sao_offset and sao_offset_sign prior to sao_band_position, and as a result, can quickly determine an offset value to be given to the pixel value without waiting for decoding of sao_band_position. .

- the offset value can be easily stored in the memory.

- the pixel to which the SAO is applied has a plurality of types of components, and for each component, the first information corresponding to the component is encoded, the second information corresponding to the component, and the second information 3 information may be encoded.

- the encoded first information applied to the luminance and the first information applied to the luminance are included in the bitstream.

- 2 information and 3rd information are arranged together, the encoded 1st information applied to a color difference, and the encoded 2nd information applied to a color difference, and the 3rd information Arranged together.

- the moving image decoding apparatus can decode only one of the SAO information applied to luminance and the SAO information applied to color difference as necessary. That is, when SAO is performed only for luminance, it is possible to prevent decoding even SAO information applied to unnecessary color differences. As a result, processing efficiency can be improved.

- the second information and the third information are encoded, the second information and the third information are encoded in the plurality of types of SAO information.

- the at least one other information may be encoded by the bypass arithmetic encoding.

- the first information may be a part of sao_type_idx indicating that the SAO is not performed or the type of the SAO.

- a moving picture decoding method is a moving picture decoding method for decoding an encoded image included in a bitstream, and includes a pixel of an image generated by decoding the encoded image.

- Context adaptive arithmetic in which variable probability values are used as the first information among a plurality of types of SAO information used in SAO (Sample Adaptive Offset), which is a process of giving an offset value to a pixel value.

- SAO Sample Adaptive Offset

- the second information and the third information after the first information in the bitstream are decoded by bypass arithmetic decoding using a fixed probability value. Decrypt continuously.

- the second information bypass arithmetic decoding and the third information bypass arithmetic decoding are intermittently performed by the context adaptive arithmetic decoding of the first information. Therefore, the amount of information that can be continuously processed in parallel can be increased, and as a result, the efficiency of the parallel processing can be improved. For example, the degree of parallelism can be increased by increasing the number of bits in which bypass arithmetic decoding is performed in parallel.

- bypass arithmetic decoding since the probability value is fixed, before acquiring data to be decoded, arithmetic decoding when the data is 0 and arithmetic decoding when the data is 1 are performed in parallel in advance. Can be done. That is, for each data generation pattern, arithmetic decoding according to the generation pattern can be performed in advance. In other words, in the bypass arithmetic decoding, the prefetched process can be performed. Therefore, by performing the bypass arithmetic decoding of the second information and the bypass arithmetic decoding of the third information in succession, the above-described prefetched processing can be effectively utilized.

- the first information encoded by the context adaptive arithmetic encoding is preceded by the second information and the third information encoded by the bypass arithmetic encoding.

- Context adaptive arithmetic decoding of one information can be started before bypass arithmetic decoding of the second information and the third information, and as a result, before the decoding of the first information ends, Decoding of the second information and the third information can be started. As a result, the processing speed can be increased.

- one of the second information and the third information may be sao_band_position indicating a range of pixel values to which the SAO is applied.

- sao_band_position can be efficiently decoded.

- the first information is sao_offset indicating the absolute value of the offset value

- sao_band_position is arranged after sao_offset in the bitstream.

- the decoded sao_offset is associated with a range (position) of pixel values indicated by sao_band_position. Cannot be stored in the memory storage location.

- the pixel value included in the pixel value range indicated by the sao_band_position is determined by sao_offset.

- the absolute value of the indicated offset value can be applied appropriately. As a result, SAO can be appropriately performed while improving processing efficiency.

- the other of the second information and the third information may be sao_offset_sign indicating whether an offset value given to the pixel value to which the SAO is applied is positive or negative. Good.

- sao_offset_sign can be efficiently decoded.

- sao_offset_sign is arranged after sao_offset in the bitstream.

- the absolute value of the offset value indicated by sao_offset is 0, the sao_offset_sign is omitted.

- the sao_band_position may be decoded after the sao_offset_sign is decoded.

- sao_offset indicating the absolute value of the offset value

- sao_bandset and sao_offset_sign can be decoded before sao_band_position, and as a result, without waiting for decoding of sao_band_position.

- the offset value given to the pixel value can be determined quickly. As a result, the offset value can be easily stored in the memory.

- the pixel to which the SAO is applied has a plurality of types of components, and for each component, the first information corresponding to the component is decoded, the second information corresponding to the component, and the third information The information may be decrypted.

- the plurality of types of components are the luminance and color difference indicated by cIdx

- only one of SAO information applied to luminance and SAO information applied to color difference is required. It can be decrypted accordingly. That is, when SAO is performed only for luminance, it is possible to prevent decoding even SAO information applied to unnecessary color differences. As a result, processing efficiency can be improved.

- At least one of the plurality of types of SAO information is continuously included in the decoding of the second information and the third information.

- One piece of other information may be decoded by the bypass arithmetic decoding.

- the first information may be a part of sao_type_idx indicating that the SAO is not performed or the type of the SAO.

- FIG. 7 is a block diagram illustrating an example of a configuration of the video decoding device 100 according to Embodiment 1.

- the moving image decoding apparatus 100 decodes the encoded image data that has been compression encoded. For example, the moving image decoding apparatus 100 receives encoded image data (bit stream) as a decoding target signal (input signal) for each block. The moving image decoding apparatus 100 restores image data by performing variable length decoding, inverse quantization, and inverse transform on the input decoding target signal.

- the video decoding device 100 includes an entropy decoding unit 110, an inverse quantization / inverse conversion unit 120, an adder 125, a loop filter 130, a memory 140, an intra prediction unit 150, A motion compensation unit 160 and an intra / inter switch 170 are provided.

- the entropy decoding unit 110 restores the quantized coefficient by variable length decoding the input signal.

- the input signal is a signal to be decoded and corresponds to data for each block of the encoded image data. Further, the entropy decoding unit 110 acquires motion data from the input signal and outputs the acquired motion data to the motion compensation unit 160. Furthermore, the entropy decoding unit 110 restores the above-described SAO information by variable-length decoding the input signal, and outputs the SAO information to the loop filter 130.

- the inverse quantization / inverse transform unit 120 restores the transform coefficient by inversely quantizing the quantized coefficient restored by the entropy decoding unit 110. Then, the inverse quantization / inverse transform unit 120 restores the prediction error by inversely transforming the restored transform coefficient.

- the adder 125 generates a decoded image by adding the restored prediction error and the prediction signal.

- the loop filter 130 performs loop filter processing on the generated decoded image.

- the decoded image subjected to the loop filter process is output as a decoded signal.

- This loop filter process includes the SAO described above.

- the memory 140 is a memory for storing a reference image used for motion compensation. Specifically, the memory 140 stores a decoded image that has been subjected to loop filter processing.

- the intra prediction unit 150 generates a prediction signal (intra prediction signal) by performing intra prediction. Specifically, the intra prediction unit 150 generates an intra prediction signal by performing intra prediction with reference to images around the block to be decoded (input signal) in the decoded image generated by the adder 125. .

- the motion compensation unit 160 generates a prediction signal (inter prediction signal) by performing motion compensation based on the motion data output from the entropy decoding unit 110.

- the intra / inter switch 170 selects either the intra prediction signal or the inter prediction signal, and outputs the selected signal to the adder 125 as a prediction signal.

- the moving image decoding apparatus 100 decodes encoded image data that is compression-encoded image data.

- the entropy decoding unit 110 includes a SAO information decoding unit that decodes SAO information.

- FIG. 8 is a block diagram illustrating a functional configuration of the SAO information decoding unit according to the first embodiment.

- the SAO information decoding unit 101 restores the SAO information from the bit stream BS. That is, the SAO information decoding unit 101 performs SAO type information (sao_type_idx), SAO pixel value width position information (sao_band_position), SAO offset value (sao_offset [i]), which are part of SAO information, which are each variable-length encoded.

- SAO offset sign (sao_offset_sign [i]) is variable-length decoded.

- the SAO information decoding unit 101 includes a Sao_Type decoding unit 102 that decodes SAO type information, a Sao_Type determination unit 103 that determines the type of offset processing indicated by the SAO type information, switches 104 and 105, A Sao_band_position decoding unit 107 that decodes SAO pixel value width position information, a Sao_Offset decoding unit 108 that decodes SAO offset values, a Sao_offset_sign decoding unit 109 that decodes SAO offset positive / negative codes, and a data storage unit 111 are provided.

- a Sao_Type decoding unit 102 that decodes SAO type information

- a Sao_Type determination unit 103 that determines the type of offset processing indicated by the SAO type information

- switches 104 and 105 switches 104 and 105

- a Sao_band_position decoding unit 107 that decodes SAO pixel value width position information

- a Sao_Offset decoding unit 108 that decodes SAO

- FIG. 9 is a flowchart showing an example of the flow of arithmetic decoding by the SAO information decoding unit 101.

- the Sao_Type decoding unit 102 of the SAO information decoding unit 101 decodes SAO type information (sao_type_idx) from the bitstream BS (S201).

- the Sao_Type determination unit 103 determines whether or not sao_type_idx indicates that SAO is not performed (Sao off) (S202). If it is determined that SAO is not performed (YES in S202), the Sao_Type determination unit 103 sets the switches 104 and 105 to OFF because there is no SAO information other than SAO type information in the bitstream BS. To complete arithmetic decoding of SAO information.

- the Sao_Type determination unit 103 sets the switch 105 to ON. Accordingly, the Sao_Offset decoding unit 108 decodes the SAO offset value (sao_offset) from the bitstream BS (S203). The Sao_Offset decoding unit 108 stores the decoded SAO offset value in an offset register or a memory portion reserved in advance in the data storage unit 111. Here, the Sao_Offset decoding unit 108 continues the decoding in step S203 until a predetermined number of SAO offset values are decoded (NO in S204).

- the Sao_Type determination unit 103 performs an offset process on the pixel values included in a certain fixed width (predetermined pixel value range). It is determined whether or not sao_type_idx indicates a band offset for performing (S205).

- the Sao_Type determination unit 103 sets the switch 104 to OFF and ends the arithmetic decoding of all the SAO information.

- the Sao_Type determination unit 103 sets the switch 104 to ON.

- the Sao_offset_sign decoding unit 109 If the decoded SAO offset value is zero (YES in S206), the SAO offset plus / minus sign has no particular meaning, so the Sao_offset_sign decoding unit 109 skips decoding. Here, the Sao_offset_sign decoding unit 109 continues decoding until the SAO offset sign for the predetermined number of SAO offset values is decoded (while NO in S208). When all the SAO offset signs are decoded (YES in S208), the Sao_band_position decoding unit 107 decodes the SAO pixel value width position information (sao_band_position) (S209).

- the SAO pixel value width position information is recorded in the data storage unit 111 in order to indicate which pixel value width (section) the SAO offset value is the offset value by this SAO pixel value width position information.

- the storage position in the data storage unit 111 is changed based on the SAO pixel value width position information. With this process, the SAO information can be correctly decoded.

- the SAO type information is always decoded from the bitstream BS here, but the present invention is not limited to this.

- the SAO type information may be decoded by deriving the SAO type information of the area to be processed according to a predetermined rule (for example, using the same SAO type information as the left area).

- the SAO type information is not necessarily described in the bitstream.

- the processing amount is reduced, the processing efficiency is improved, and the coding efficiency is improved. Appropriate decoding of the bitstream can be achieved.

- the parameter which is the information decoded in the steps surrounded by the double frame in FIG. 9 is the parameter decoded by the above-described bypass arithmetic decoding.

- a parameter that is information that is decoded in steps surrounded by a normal frame line is a parameter that is context-adaptive arithmetically decoded by using a probability value in which at least a part of the parameter is variable.

- the amount of processing can be reduced by performing bypass arithmetic decoding on the SAO offset sign corresponding to the SAO offset value and the SAO pixel value width position information (see FIG. 5).

- this bypass arithmetic decoding normalization processing is executed according to the flow shown in FIG.

- FIG. 10A is a diagram for describing an example of the arrangement of parameters included in the SAO information and the decoding order of the parameters in the present embodiment.

- FIG. 10A shows an example when decoding for SAO information is performed in parallel.

- these pieces of information (parameters) included in the bitstream BS are decoded in the order of SAO_OFFSET, SAO_OFFSET_SIGN, and SAO_BAND_POSITION.

- the SAO offset value is shown as SAO_OFFSET

- the SAO offset sign is shown as SAO_OFFSET_SIGN

- the SAO pixel value width position information is shown as SAO_BAND_POSITION.

- SAO_OFFSET_SIGN and SAO_BAND_POSITION surrounded by a thick frame in FIG. 10A are all bypass arithmetic decoded.

- high-speed processing is required as the image resolution to be used increases and high-speed real-time communication becomes widespread.

- SAO_OFFSET since at least a part of SAO_OFFSET is context adaptive arithmetic coded, it is necessary to sequentially read and update the symbol occurrence probability. Therefore, the arithmetic decoding of the SAO_OFFSET cannot be performed in parallel. Therefore, the parts subjected to bypass arithmetic decoding are decoded in parallel in bit units as shown in FIG. 10A (b).

- bypass arithmetic decoding when the bypass arithmetic decoding is performed in parallel, the bypass arithmetic decoding can be performed in advance without depending on the internal state of the video decoding device 100. As soon as the information is acquired, the bypass arithmetic decoding may be started even if the context adaptive arithmetic decoding is not completed. As a result, higher-speed decoding is possible.

- FIG. 10B is a diagram for describing an example of the arrangement of parameters included in the SAO information and the decoding order of the parameters for performing the operation illustrated in FIG. 3.

- 10A corresponds to (a) in FIG. 10A

- (b) in FIG. 10B corresponds to (b) in FIG. 10A.

- context adaptive arithmetic decoding for SAO_OFFSET is a sequential process

- bypass arithmetic decoding for SAO_BAND_POSITION and SAO_OFFSET_SIGN can be parallelized.

- bypass arithmetic decoding portion before and after the context arithmetic decoding portion a portion where parallel processing is possible is interrupted. Therefore, the arrangement of the parameters in the present embodiment shown in FIG.

- the video decoding apparatus can know the position of the band offset (SAO pixel value width position information) in advance, the storage position in the memory where the SAO offset value is stored is stored. There is an advantage that it can be determined in advance according to the SAO pixel value width position information.

- the above-described storage position is determined regardless of the band offset position (SAO pixel value width position information), and when applying SAO, the SAO pixel value width position information indicating the band offset position is used. It is passed to the loop filter 130. Thereby, according to the order of each parameter shown to FIG. 10A, those parameters can be decoded without a problem.

- SAO_OFFSET even when all of SAO_OFFSET is context arithmetic coded or only a part thereof is context arithmetic coded, there are i SAO_OFFSETs (i is an integer of 2 or more). Are decoded in the order in which they are included in the bitstream BS.

- the present invention is not limited to this, and the PREFIX part configured by collecting only a part of each SAO_OFFSET and the SUFIX part configured by collecting only the remaining part of each SAO_OFFSET are sequentially decoded. May be.

- FIG. 10C is a diagram for explaining an example of the arrangement of parameters included in the SAO information and the decoding order of each parameter when i SAO_OFFSETs are configured by a PREFIX part and a SUFIX part.

- the SURFIX part follows the PREFIX part.

- these parameters are continuously included, including not only SAO_OFFSET_SIGN and SAO_BAND_POSITION, but also SAO_OFFSET_SURFIX which is a SURFIX part.

- SAO_OFFSET_SURFIX which is a SURFIX part.

- context adaptive arithmetic decoding is performed on a predetermined type of information among a plurality of types of information included in the SAO information, and other types of information are converted.

- bypass arithmetic decoding by performing bypass arithmetic decoding continuously, a portion that can be processed in parallel can be made longer, so that efficient parallel processing, that is, high-speed decoding can be performed.

- band offset related information sao_band_position

- sao_offset the band offset related information after sao_offset

- decoding applied to the parameter is switched between context adaptive arithmetic decoding and bypass arithmetic decoding.

- the present invention is not limited to this.

- the effect of reducing a certain amount of processing can be expected only by switching the decoding applied to the part between the context adaptive arithmetic decoding and the bypass arithmetic decoding. In this case, it is possible to realize not only the above-described effect in the present embodiment but also the reduction of the internal memory.

- a Huffman code may be derived from a mode number obtained according to the occurrence frequency, a table may be generated from the code, and a portion with a biased occurrence probability may be selected as the prefix portion.

- the binarization column may be a fixed length. This is because SAO information is used for loop filter processing, and thus affects the image quality of the output image. Since the part subjected to bypass arithmetic decoding is directly related to the code amount, when the moving image encoder selects regardless of the code amount, the fixed length is used so that the moving image encoder matches the video characteristics. Information can be selected. As a result, a high-quality decoded image can be provided.

- the present invention is not limited to this. Even if all of these parameters are bypass arithmetic coded, decoding can be performed at high speed by parallelizing bypass arithmetic decoding using the order of the present embodiment different from the conventional method. Furthermore, there is an effect that it is possible to reduce the processing for determining whether or not it is a band offset, and the processing load can be reduced.

- the moving picture coding apparatus generates a bit stream BS that is decoded by the moving picture decoding apparatus 100 according to the first embodiment by coding a moving picture.

- FIG. 11 is a block diagram showing an example of the configuration of the moving picture coding apparatus 200 according to the second embodiment.

- the moving image coding apparatus 200 includes a subtracter 205, a transform / quantization unit 210, an entropy coding unit 220, an inverse quantization / inverse transform unit 230, an adder 235, A loop filter 240, a memory 250, an intra prediction unit 260, a motion detection unit 270, a motion compensation unit 280, and an intra / inter switch 290 are provided.

- the subtracter 205 calculates a difference between an input signal indicating an image and a prediction signal, that is, a prediction error.

- the transform / quantization unit 210 generates a frequency domain transform coefficient by transforming a spatial domain prediction error. For example, the transform / quantization unit 210 generates a transform coefficient by performing DCT (Discrete Cosine Transform) transform on the prediction error. Furthermore, the transform / quantization unit 210 generates a quantized coefficient by quantizing the transform coefficient.

- DCT Discrete Cosine Transform

- the entropy encoding unit 220 generates an encoded signal (bit stream) by variable-length encoding the quantization coefficient.

- the entropy encoding unit 220 encodes the motion data (for example, a motion vector) detected by the motion detection unit 270, and outputs the encoded data by including it in the encoded signal. Furthermore, the entropy encoding unit 220 performs variable length encoding on the SAO information used in the loop filter 240, and includes the variable length encoded SAO information in the encoded signal.

- the inverse quantization / inverse transform unit 230 restores the transform coefficient by inverse quantization of the quantized coefficient. Further, the inverse quantization / inverse transform unit 230 restores the prediction error by inversely transforming the restored transform coefficient. Note that the restored prediction error does not match the prediction error generated by the subtractor 205 because information is lost due to quantization. That is, the restored prediction error includes a quantization error.

- the adder 235 generates a local decoded image (temporary decoded image) by adding the restored prediction error and the prediction signal.

- the loop filter 240 performs a loop filter process on the generated local decoded image.

- This loop filter process includes the SAO described above. That is, the loop filter 240 performs SAO on the local decoded image using SAO information, and outputs the SAO information to the entropy encoding unit 220.

- the memory 250 is a memory for storing a reference image used for motion compensation. Specifically, the memory 250 stores a locally decoded image that has been subjected to loop filter processing.

- the intra prediction unit 260 generates a prediction signal (intra prediction signal) by performing intra prediction. Specifically, the intra prediction unit 260 performs intra prediction with reference to an image around the block to be encoded (input signal) in the local decoded image generated by the adder 235, thereby obtaining an intra prediction signal. Generate.

- the motion detector 270 detects motion data (for example, a motion vector) between the input signal and the reference image stored in the memory 250.

- motion data for example, a motion vector

- the motion compensation unit 280 generates a prediction signal (inter prediction signal) by performing motion compensation based on the detected motion data.

- the intra / inter switch 290 selects either the intra prediction signal or the inter prediction signal, and outputs the selected signal to the subtracter 205 and the adder 235 as a prediction signal.

- the moving image encoding apparatus 200 compresses and encodes image data.

- the entropy encoding unit 220 includes a SAO information encoding unit that encodes SAO information.

- the arithmetic coding method by the SAO information coding unit of the present embodiment is a context adaptive arithmetic coding of a predetermined parameter included in SAO information and is included in SAO information. It is characterized in that a plurality of other kinds of parameters are successively subjected to bypass arithmetic coding. Thus, efficient parallel processing can be realized, and SAO information can be encoded at high speed.

- FIG. 12 is a flowchart showing the flow of arithmetic coding by the SAO information coding unit according to the second embodiment.

- the SAO information encoding unit encodes sao_type_idx (S501).

- sao_type_idx does not have to be the information itself shown in FIG. 1A.

- sao_type_idx is not limited to the information shown in FIG. 1A as long as it is information for specifying SAO type information such as a flag indicating that the same SAO type information as that of the left target area is used.

- the present embodiment is characterized in the order of encoding of subsequent bit streams.

- the SAO information encoding unit when sao_type_idx indicates that SAO is not to be performed (Sao off) (YES in S502), the SAO information encoding unit does not need to encode any more SAO information. End encoding.

- the SAO information encoding unit encodes the SAO offset value (sao_offset) (S503).

- sao_offset is context arithmetic coded and included in the bitstream by a predetermined method (S503).

- the SAO information encoding unit repeatedly executes the encoding in step S503 until all the predetermined number of sao_offsets are encoded (while NO in S504). If all the sao_offsets have been encoded (YES in S504), the SAO information encoding unit determines whether sao_type_idx indicates a band offset (S505). If it is determined that sao_type_idx does not indicate a band offset (NO in S505), the SAO information encoding unit ends encoding of SAO information.

- the SAO information encoding unit determines whether the already encoded sao_offset value is zero (S506).

- the SAO information encoding unit encodes the SAO offset positive / negative code for the sao_offset (S507).

- This SAO offset sign is bypass arithmetic coded.

- the details of bypass arithmetic coding are the same as CABAC coding described in Non-Patent Documents 1 to 3, and bypass arithmetic coding is a process that can be compared with bypass arithmetic decoding.

- the SAO information encoding unit skips encoding.

- the SAO information encoding unit repeats steps S506 and S507 for all the values of sao_offset (S508), and when the processing for all the values of sao_offset is completed (YES in S508), the SAO pixel value width position information (sao_band_position) Is encoded (S509).

- This parameter is also a parameter that is bypass arithmetic coded as described above. This completes the encoding of the SAO information.

- the parameter that is information encoded in the steps surrounded by the double frame in FIG. 12 is a parameter encoded by bypass arithmetic encoding.

- the probability value is fixed in bypass arithmetic coding applied to these parameters, each of these parameters can be coded in parallel.

- bypass arithmetic coding is arithmetic coding that does not require update of the probability value, and may be arithmetic coding different from those described in Non-Patent Documents 1 and 2.

- FIG. 13A is a diagram showing a syntax for generating a conventional bitstream shown in Non-Patent Document 3.

- the process for generating the bitstream includes a determination step for determining whether sao_type_idx indicates a band offset. Therefore, high-speed encoding is difficult.

- FIG. 13B is a diagram illustrating a syntax for generating a bitstream according to the present embodiment.

- the moving picture coding method according to the present embodiment is significant.

- FIG. 14 is a diagram showing a syntax for generating another bit stream in the present embodiment.

- the SAO offset value (sao_offset) is divided into a PREFIX part that is context arithmetic coded and a SURFIX part that is bypass arithmetic coded. In this case, encoding can be performed at a higher speed as shown in FIG. 10C.

- the present invention is not limited to this. Even if all of these parameters are bypass arithmetic encoded, they can be encoded at high speed by parallelization of bypass arithmetic encoding using the order of the present embodiment different from the conventional method. Furthermore, there is an effect that it is possible to reduce the processing for determining whether or not it is a band offset, and the processing load can be reduced.

- FIG. 15A is a flowchart of a moving picture coding method according to another embodiment.

- This moving image encoding method is a moving image encoding method that generates a bit stream by encoding an input image, and includes steps S11 and S12.

- step S11 among the plurality of types of SAO information (parameters) used for SAO (Sample Adaptive Offset), which is a process of giving an offset value to the pixel value of a pixel included in an image generated by encoding an input image. 1 information is encoded by context adaptive arithmetic coding using variable probability values.

- step S12 the second information and the third information of the plurality of types of SAO information are continuously encoded by bypass arithmetic coding using a fixed probability value. As a result, in the bit stream, the encoded second information and the third information are arranged after the encoded first information.

- FIG. 15B is a block diagram of a moving picture coding apparatus according to another embodiment.

- the moving image encoding device 10 is a moving image encoding device that generates a bit stream by encoding an input image, and includes a context adaptive arithmetic encoding unit 11 and a bypass arithmetic encoding unit 12.

- the context adaptive arithmetic coding unit 11 uses a plurality of types of SAO information (parameters) used in SAO (Sample Adaptive Offset), which is a process of giving an offset value to a pixel value of a pixel included in an image generated by encoding an input image. ) Is encoded by context adaptive arithmetic coding using a variable probability value.

- SAO Sample Adaptive Offset

- the bypass arithmetic encoding unit 12 continuously encodes the second information and the third information of the plurality of types of SAO information by bypass arithmetic encoding using a fixed probability value. As a result, in the bit stream, the encoded second information and the third information are arranged after the encoded first information.

- FIG. 15C is a flowchart of a moving picture decoding method according to another embodiment.

- This moving image decoding method is a moving image decoding method for decoding an encoded image included in a bit stream, and includes steps S21 and S22.

- step S21 multiple types of SAO information included in the bitstream used for SAO (Sample Adaptive Offset), which is a process of giving an offset value to the pixel value of a pixel included in an image generated by decoding the encoded image

- First information of (parameter) is decoded by context adaptive arithmetic decoding using a variable probability value.

- step S22 the second information and the third information after the first information in the bit stream among the plurality of types of SAO information are successively obtained by bypass arithmetic decoding using a fixed probability value. Decrypt.

- FIG. 15D is a block diagram of a video decoding device according to another embodiment.

- the video decoding device 20 is a video decoding device that decodes an encoded image included in a bitstream, and includes a context adaptive arithmetic decoding unit 21 and a bypass arithmetic decoding unit 22.

- the context adaptive arithmetic decoding unit 21 is used for SAO (Sample Adaptive Offset), which is a process for giving an offset value to a pixel value of a pixel included in an image generated by decoding a coded image, and includes a plurality of bits included in the bit stream.

- SAO Sample Adaptive Offset

- First information of the SAO information (parameter) of the seed is decoded by context adaptive arithmetic decoding using a variable probability value.

- the bypass arithmetic decoding unit 22 performs the second information and the third information after the first information in the bitstream among the plurality of types of SAO information by bypass arithmetic decoding using a fixed probability value. Decrypt continuously.

- each component may be configured by dedicated hardware or may be realized by executing a software program suitable for each component.

- Each component may be realized by a program execution unit such as a CPU or a processor reading and executing a software program recorded on a recording medium such as a hard disk or a semiconductor memory.

- the software that realizes the moving picture coding apparatus according to each of the above embodiments is a program that causes a computer to execute the steps shown in FIG. 15A.

- achieves the moving image decoding apparatus of each said embodiment is a program which makes a computer perform each step shown to FIG. 15C.

- the storage medium may be any medium that can record a program, such as a magnetic disk, an optical disk, a magneto-optical disk, an IC card, and a semiconductor memory.

- the system has an image encoding / decoding device including an image encoding device using an image encoding method and an image decoding device using an image decoding method.

- image encoding / decoding device including an image encoding device using an image encoding method and an image decoding device using an image decoding method.

- Other configurations in the system can be appropriately changed according to circumstances.

- FIG. 16 is a diagram showing an overall configuration of a content supply system ex100 that realizes a content distribution service.

- a communication service providing area is divided into desired sizes, and base stations ex106, ex107, ex108, ex109, and ex110, which are fixed wireless stations, are installed in each cell.

- This content supply system ex100 includes a computer ex111, a PDA (Personal Digital Assistant) ex112, a camera ex113, a mobile phone ex114, a game machine ex115 via the Internet ex101, the Internet service provider ex102, the telephone network ex104, and the base stations ex106 to ex110. Etc. are connected.

- PDA Personal Digital Assistant

- each device may be directly connected to the telephone network ex104 without going from the base station ex106, which is a fixed wireless station, to ex110.

- the devices may be directly connected to each other via short-range wireless or the like.

- the camera ex113 is a device that can shoot moving images such as a digital video camera

- the camera ex116 is a device that can shoot still images and movies such as a digital camera.

- the mobile phone ex114 is a GSM (registered trademark) (Global System for Mobile Communications) system, a CDMA (Code Division Multiple Access) system, a W-CDMA (Wideband-Code Division Multiple Access) system, or an LTE (Long Terminal Term Evolution). It is possible to use any of the above-mentioned systems, HSPA (High Speed Packet Access) mobile phone, PHS (Personal Handyphone System), or the like.

- the camera ex113 and the like are connected to the streaming server ex103 through the base station ex109 and the telephone network ex104, thereby enabling live distribution and the like.

- live distribution content that is shot by a user using the camera ex113 (for example, music live video) is encoded as described in each of the above embodiments (that is, in one aspect of the present invention).

- the streaming server ex103 stream-distributes the content data transmitted to the requested client. Examples of the client include a computer ex111, a PDA ex112, a camera ex113, a mobile phone ex114, and a game machine ex115 that can decode the encoded data.

- Each device that receives the distributed data decodes the received data and reproduces it (that is, functions as an image decoding device according to one embodiment of the present invention).

- the captured data may be encoded by the camera ex113, the streaming server ex103 that performs data transmission processing, or may be shared with each other.

- the decryption processing of the distributed data may be performed by the client, the streaming server ex103, or may be performed in common with each other.

- still images and / or moving image data captured by the camera ex116 may be transmitted to the streaming server ex103 via the computer ex111.

- the encoding process in this case may be performed by any of the camera ex116, the computer ex111, and the streaming server ex103, or may be performed in a shared manner.

- these encoding / decoding processes are generally performed in the computer ex111 and the LSI ex500 included in each device.

- the LSI ex500 may be configured as a single chip or a plurality of chips.

- moving image encoding / decoding software is incorporated into some recording medium (CD-ROM, flexible disk, hard disk, etc.) that can be read by the computer ex111, etc., and encoding / decoding processing is performed using the software. May be.

- moving image data acquired by the camera may be transmitted.

- the moving image data at this time is data encoded by the LSI ex500 included in the mobile phone ex114.

- the streaming server ex103 may be a plurality of servers or a plurality of computers, and may process, record, and distribute data in a distributed manner.

- the encoded data can be received and reproduced by the client.

- the information transmitted by the user can be received, decrypted and reproduced by the client in real time, and personal broadcasting can be realized even for a user who does not have special rights or facilities.

- the digital broadcast system ex200 also includes at least the video encoding device (video encoding device) or video decoding according to each of the above embodiments. Any of the devices (image decoding devices) can be incorporated.

- video encoding device video encoding device

- image decoding devices any of the devices (image decoding devices) can be incorporated.

- the broadcast station ex201 multiplexed data obtained by multiplexing music data and the like on video data is transmitted to a communication or satellite ex202 via radio waves.

- This video data is data encoded by the moving image encoding method described in each of the above embodiments (that is, data encoded by the image encoding apparatus according to one aspect of the present invention).

- the broadcasting satellite ex202 transmits a radio wave for broadcasting, and this radio wave is received by a home antenna ex204 capable of receiving satellite broadcasting.

- the received multiplexed data is decoded and reproduced by an apparatus such as the television (receiver) ex300 or the set top box (STB) ex217 (that is, functions as an image decoding apparatus according to one embodiment of the present invention).

- a reader / recorder ex218 that reads and decodes multiplexed data recorded on a recording medium ex215 such as a DVD or a BD, or encodes a video signal on the recording medium ex215 and, in some cases, multiplexes and writes it with a music signal. It is possible to mount the moving picture decoding apparatus or moving picture encoding apparatus described in the above embodiments. In this case, the reproduced video signal is displayed on the monitor ex219, and the video signal can be reproduced in another device or system using the recording medium ex215 on which the multiplexed data is recorded.

- a moving picture decoding apparatus may be mounted in a set-top box ex217 connected to a cable ex203 for cable television or an antenna ex204 for satellite / terrestrial broadcasting and displayed on the monitor ex219 of the television.

- the moving picture decoding apparatus may be incorporated in the television instead of the set top box.

- FIG. 18 is a diagram illustrating a television (receiver) ex300 that uses the video decoding method and the video encoding method described in each of the above embodiments.

- the television ex300 obtains or outputs multiplexed data in which audio data is multiplexed with video data via the antenna ex204 or the cable ex203 that receives the broadcast, and demodulates the received multiplexed data.

- the modulation / demodulation unit ex302 that modulates multiplexed data to be transmitted to the outside, and the demodulated multiplexed data is separated into video data and audio data, or the video data and audio data encoded by the signal processing unit ex306 Is provided with a multiplexing / demultiplexing unit ex303.

- the television ex300 also decodes the audio data and the video data, or encodes the information, the audio signal processing unit ex304, the video signal processing unit ex305 (the image encoding device or the image according to one embodiment of the present invention) A signal processing unit ex306 that functions as a decoding device), a speaker ex307 that outputs the decoded audio signal, and an output unit ex309 that includes a display unit ex308 such as a display that displays the decoded video signal. Furthermore, the television ex300 includes an interface unit ex317 including an operation input unit ex312 that receives an input of a user operation. Furthermore, the television ex300 includes a control unit ex310 that performs overall control of each unit, and a power supply circuit unit ex311 that supplies power to each unit.

- the interface unit ex317 includes a bridge unit ex313 connected to an external device such as a reader / recorder ex218, a recording unit ex216 such as an SD card, and an external recording unit such as a hard disk.

- a driver ex315 for connecting to a medium, a modem ex316 for connecting to a telephone network, and the like may be included.

- the recording medium ex216 is capable of electrically recording information by using a nonvolatile / volatile semiconductor memory element to be stored.

- Each part of the television ex300 is connected to each other via a synchronous bus.

- the television ex300 receives a user operation from the remote controller ex220 or the like, and demultiplexes the multiplexed data demodulated by the modulation / demodulation unit ex302 by the multiplexing / demultiplexing unit ex303 based on the control of the control unit ex310 having a CPU or the like. Furthermore, in the television ex300, the separated audio data is decoded by the audio signal processing unit ex304, and the separated video data is decoded by the video signal processing unit ex305 using the decoding method described in each of the above embodiments.

- the decoded audio signal and video signal are output from the output unit ex309 to the outside. At the time of output, these signals may be temporarily stored in the buffers ex318, ex319, etc. so that the audio signal and the video signal are reproduced in synchronization. Also, the television ex300 may read multiplexed data from recording media ex215 and ex216 such as a magnetic / optical disk and an SD card, not from broadcasting. Next, a configuration in which the television ex300 encodes an audio signal or a video signal and transmits the signal to the outside or to a recording medium will be described.

- the television ex300 receives a user operation from the remote controller ex220 and the like, encodes an audio signal with the audio signal processing unit ex304, and converts the video signal with the video signal processing unit ex305 based on the control of the control unit ex310. Encoding is performed using the encoding method described in (1).