RU2534005C2 - Method and system for converting screenshot into metafile - Google Patents

Method and system for converting screenshot into metafile Download PDFInfo

- Publication number

- RU2534005C2 RU2534005C2 RU2013104245/08A RU2013104245A RU2534005C2 RU 2534005 C2 RU2534005 C2 RU 2534005C2 RU 2013104245/08 A RU2013104245/08 A RU 2013104245/08A RU 2013104245 A RU2013104245 A RU 2013104245A RU 2534005 C2 RU2534005 C2 RU 2534005C2

- Authority

- RU

- Russia

- Prior art keywords

- text

- screenshot

- fragments

- module

- smoothed

- Prior art date

Links

- 238000000034 method Methods 0.000 title claims abstract description 53

- 239000012634 fragment Substances 0.000 claims abstract description 64

- 230000011218 segmentation Effects 0.000 claims description 8

- 238000011156 evaluation Methods 0.000 claims description 5

- 238000003066 decision tree Methods 0.000 claims description 4

- 238000001514 detection method Methods 0.000 claims description 3

- 230000000877 morphologic effect Effects 0.000 claims description 3

- 238000007637 random forest analysis Methods 0.000 claims description 3

- 238000012706 support-vector machine Methods 0.000 claims description 3

- 239000011159 matrix material Substances 0.000 claims description 2

- 230000000694 effects Effects 0.000 abstract description 4

- 238000009877 rendering Methods 0.000 abstract description 2

- 239000000126 substance Substances 0.000 abstract 1

- 238000013459 approach Methods 0.000 description 12

- 238000012545 processing Methods 0.000 description 7

- 238000010586 diagram Methods 0.000 description 5

- 238000005516 engineering process Methods 0.000 description 5

- 230000000007 visual effect Effects 0.000 description 5

- 238000004422 calculation algorithm Methods 0.000 description 4

- 238000009499 grossing Methods 0.000 description 4

- 230000006835 compression Effects 0.000 description 3

- 238000007906 compression Methods 0.000 description 3

- 238000004458 analytical method Methods 0.000 description 2

- 238000012800 visualization Methods 0.000 description 2

- 238000007792 addition Methods 0.000 description 1

- 238000006243 chemical reaction Methods 0.000 description 1

- 230000007423 decrease Effects 0.000 description 1

- 238000013461 design Methods 0.000 description 1

- 238000011161 development Methods 0.000 description 1

- 230000018109 developmental process Effects 0.000 description 1

- 230000006870 function Effects 0.000 description 1

- 238000003709 image segmentation Methods 0.000 description 1

- 230000002452 interceptive effect Effects 0.000 description 1

- 239000000463 material Substances 0.000 description 1

- 238000003909 pattern recognition Methods 0.000 description 1

- 238000010187 selection method Methods 0.000 description 1

- 238000006467 substitution reaction Methods 0.000 description 1

- 238000012360 testing method Methods 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N1/00—Scanning, transmission or reproduction of documents or the like, e.g. facsimile transmission; Details thereof

- H04N1/387—Composing, repositioning or otherwise geometrically modifying originals

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T5/00—Image enhancement or restoration

- G06T5/40—Image enhancement or restoration using histogram techniques

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/10—Segmentation; Edge detection

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Facsimile Image Signal Circuits (AREA)

- Image Processing (AREA)

Abstract

Description

Изобретение относится к области обработки цифровых сигналов, а именно к способам преобразования растрового изображения в метафайл, в частности к преобразованию моментального снимка экрана (скриншота) в метафайл посредством сегментации и векторизации скриншота.The invention relates to the field of digital signal processing, and in particular to methods for converting a raster image to a metafile, in particular, to converting a screen shot (screenshot) to a metafile by segmenting and vectorizing a screenshot.

Векторизация текстовой информации на растровом изображении скриншота позволяет существенно улучшить качество текста для печати и визуализации. Частичная векторизация скриншота является перспективным подходом к решению задачи и заключается в том, что обнаруженные области рисунков и области текста обрабатываются разными способами. Текстовую часть переводят в последовательность прямых и кривых отрезков с информацией о цвете символов и окружающем фоне. Оставшаяся часть информации исходного скриншота хранится как растровое изображение.Vectorization of textual information on a screenshot bitmap can significantly improve the quality of text for printing and visualization. Partial vectorization of a screenshot is a promising approach to solving the problem and lies in the fact that the detected areas of the drawings and text areas are processed in different ways. The text part is translated into a sequence of straight and curved segments with information about the color of the characters and the surrounding background. The rest of the information in the original screenshot is stored as a bitmap.

Способ, раскрытый в патенте США №8,270,722 [1], предусматривает обработку изображения с выборочной векторизацией символов и графических областей. Целью изобретения является достижение наилучшей степени компрессии при высоком качестве изображения, содержащего как области текста, так и графики. Если пиксели символа в области теста перекрываются графической областью, то сначала векторизуется графическая область, если перекрытия нет - сначала векторизуется область текста.The method disclosed in US patent No. 8,270,722 [1], provides for image processing with selective vectorization of characters and graphic areas. The aim of the invention is to achieve the best degree of compression with high quality images containing both areas of text and graphics. If the pixels of the symbol in the test area are overlapped by the graphics area, then the graphics area is vectorized, if there is no overlap, the text area is vectorized first.

Способ, раскрытый в патенте США №7,873,218 [2], заключается в аппроксимации символа для преобразования бинарного изображении в контурные данные с использованием кривых Безье. Способ включает сегментацию растрового изображения для извлечения областей символов и извлечения символов из этих областей. Процесс векторизации выполняется независимо от других нетекстовых частей изображения.The method disclosed in US patent No. 7,873,218 [2], is to approximate a symbol to convert a binary image into contour data using Bezier curves. The method includes raster image segmentation for extracting symbol regions and extracting symbols from these regions. The vectorization process is performed independently of other non-text parts of the image.

Вышеупомянутые способы позволяют улучшать визуальное качество изображения посредством векторизации, но не могут быть напрямую применены для векторизации растрового изображения скриншота, который обладает рядом особенностей: а именно низким разрешением символов и применением эффекта сглаживания (антиалиасинга) текстовых символов. Данное сглаживание улучшает качество изображения на дисплее, но искажает скриншот при печати.The above methods can improve the visual quality of the image by vectorization, but cannot be directly used to vectorize a bitmap image of a screenshot that has a number of features: namely, low resolution of characters and the application of the effect of smoothing (anti-aliasing) of text characters. This anti-aliasing improves the image quality on the display, but distorts the screenshot when printing.

Способ, раскрытый в патенте США №7,079,686 [3], описывает подход, основанный на классификации пикселей на изображении документа для увеличения изображения. Для каждого пикселя изображения генерируется вектор признаков. Каждый пиксель классифицируется как текст или рисунок в зависимости от соответствующего вектора признаков. Дальнейшая обработка может включать улучшение на пиксельном уровне, которая состоит из фильтра повышения резкости границ для пикселей текста и фильтра сглаживания для пикселей рисунков.The method disclosed in US patent No. 7,079,686 [3] describes an approach based on the classification of pixels in an image of a document for enlarging an image. A feature vector is generated for each pixel in the image. Each pixel is classified as text or picture depending on the corresponding feature vector. Further processing may include pixel-level enhancement, which consists of a border sharpening filter for text pixels and a smoothing filter for picture pixels.

Способ, раскрытый в патенте США №7,177,049 [4], сводится к обработке цифровых изображений, причем процесс повышения качества текста включает в себя обработку черного текста на белом фоне с увеличением резкости и контраста такого текста за счет перераспределения яркости между темными и светлыми пикселями в пределах предопределенной маски.The method disclosed in US patent No. 7,177,049 [4], is reduced to the processing of digital images, and the process of improving the quality of the text includes the processing of black text on a white background with increasing sharpness and contrast of such text due to the redistribution of brightness between dark and light pixels within predefined masks.

Описанные выше способы ориентированы на улучшение изображения, особенно областей текста исключительно перед печатью. Эти способы также не пригодны для скриншотов, поскольку разработаны для сканированных изображений.The methods described above are aimed at improving the image, especially areas of the text exclusively before printing. These methods are also not suitable for screenshots, as they are designed for scanned images.

Задача, на решение которой направлено заявляемое изобретение, заключается в том, чтобы разработать усовершенствованный способ обработки сглаженного текста (текста с антиалиасингом) на скриншоте. При этом такой способ должен обеспечить повышение резкости/четкости и контраста символов и быть применимым как для печати скриншотов, так и для сохранении скриншотов в метафайл.The problem to which the claimed invention is directed is to develop an improved method for processing smoothed text (text with anti-aliasing) in the screenshot. Moreover, this method should provide sharpening / clarity and contrast of characters and be applicable both for printing screenshots and for saving screenshots in a metafile.

Технический результат достигается за счет применения заявляемого способа, включающего в себя операции по обнаружению сглаженных символов на скриншоте и улучшению визуального представления этих символов за счет векторизации и оценки цвета заливки. При этом заявляемый способ преобразования скриншота в метафайл включает в себя выполнение следующих этапов:The technical result is achieved through the application of the proposed method, which includes operations to detect smoothed characters in the screenshot and improve the visual presentation of these characters through vectorization and color estimation of the fill. In this case, the claimed method of converting a screenshot into a metafile includes the following steps:

- обнаруживают фрагменты текста на скриншоте;- detect fragments of text in the screenshot;

- оценивают цвет фона и цвет символов на каждом фрагменте;- evaluate the background color and the color of the characters on each fragment;

- векторизуют контуры символов;- vectorize the outline of the characters;

- модифицируют скриншот за счет заполнения фрагментов текста цветом фона;- modify the screenshot by filling in the text fragments with the background color;

- создают метафайл на основе модифицированного скриншота и векторизованных контуров, заполненных цветом текста.- create a metafile based on a modified screenshot and vectorized outlines filled with text color.

Заявляемый способ обеспечивает повышение резкости/четкости и контраста символов и может быть применен как при печати скриншотов, так и при сохранении скриншотов в метафайл, например PDF или XPS.The inventive method provides increased sharpness / sharpness and contrast of characters and can be applied both when printing screenshots, and when saving screenshots to a metafile, such as PDF or XPS.

Далее существо заявляемого изобретения поясняется в деталях со ссылками на соответствующие графические материалы.Further, the essence of the claimed invention is explained in detail with reference to the relevant graphic materials.

Фиг.1. Иллюстрация заявляемого способа в сравнении с существующими подходами.Figure 1. Illustration of the proposed method in comparison with existing approaches.

Фиг.2. Структурная схема способа преобразования скриншота в метафайл.Figure 2. A block diagram of a method for converting a screenshot into a metafile.

Фиг.3. Блок-схема системы преобразования скриншота в метафайл.Figure 3. A block diagram of a system for converting a screenshot into a metafile.

Фиг.4. Иллюстрация способа обнаружения фрагментов со сглаженным текстом.Figure 4. Illustration of a method for detecting fragments with smoothed text.

Фиг.5. Иллюстрация вычисления признаков сглаженного текста.Figure 5. Illustration of computing signs of smoothed text.

Фиг.6. Блок-схема векторизации символа.6. Block diagram of vectorized symbol.

Фиг.7. Иллюстрация векторизации символа.7. Illustration of a vectorized symbol.

Фиг.8. Создание карты сегментированного текста.Fig. 8. Create a segmented text map.

Фиг.9. Иллюстрация результата заявляемого способа.Fig.9. Illustration of the result of the proposed method.

На Фиг.1 проиллюстрировано различие между существующим подходом (прототипом), известным из уровня техники, и заявляемым способом. Скриншот 103 захватывается с экрана дисплея посредством копирования видеопамяти в промежуточный буфер. Результатом такого копирования является представление текущего кадра, визуализируемого на дисплее, в виде растрового изображения. Дисплеем может являться модуль визуализации любого цифрового вычислительного устройства, например: персонального компьютера 101, ноутбука, смартфона 102, планшетного компьютера и т.д. Особенностью скриншота является то, что представленная на нем текстовая информация обычно визуализируется с помощью технологии сглаживания (antialiasing), использующейся с целью сделать границы символов визуально более гладкими, убирая «зубцы», возникающие при растеризации на краях объектов. В этом случае пикселы, соседние с граничным пикселом изображения, принимают промежуточное значение между цветом изображения и цветом фона, визуально размывая границу. Технологии сглаживания, используемые при визуализации текста на дисплее, напрямую зависят от размера отображаемых символов и разрешения отображения, поэтому при увеличении/уменьшении масштаба перестраивают пиксельное отображение символов. Кроме того, подобные сглаживания существенно отличаются от аналогичных технологий, используемых при печати текста. Скриншот в виде растрового изображения сохраняется в каком-либо файле/формате 104, соответственно для текстовых областей становится недоступным корректное применение технологий сглаживания при отображении или печати. Это ведет к нежелательным визуальным искажениям внешнего вида текста. В соответствии с вышесказанным можно отметить следующие недостатки известного из уровня техники подхода:Figure 1 illustrates the difference between the existing approach (prototype), known from the prior art, and the claimed method. The

- поскольку скриншот сохраняется в файл в виде растрового изображения, следовательно, будут потеряны такие преимущества обычного представления текстовой информации на дисплее, как инвариантность к масштабу и гладкое отображение очертания символов независимо от их размера. Вместо этого масштабирование растрового изображения текста будет сопровождаться такими мешающими факторами, как появление «зазубренных» краев и размытие границ;- since the screenshot is saved to a file as a raster image, therefore, such advantages of the usual presentation of textual information on the display as invariance to scale and smooth display of the outline of characters regardless of their size will be lost. Instead, scaling the bitmap of the text will be accompanied by such interfering factors as the appearance of “jagged” edges and blurred borders;

- проявляется негативный эффект сглаживания символов, свойственный для текста, визуализируемого на дисплее. Результатом такого эффекта является искажение оригинального цвета и формы символов при печати или изменении масштаба визуализации.- the negative effect of anti-aliasing of characters appears, which is characteristic for text displayed on the display. The result of this effect is a distortion of the original color and shape of the characters when printing or zooming out.

Заявляемый способ 105 основан на сегментации скриншота на текстовые и нетекстовые области и векторизации текстовых областей. Подход позволяет отображать и печатать метафайл при измененном масштабе без потери качества текстовой информации.The

На Фиг.2 проиллюстрированы основные шаги заявляемого способа. На шаге 201 выполняется обнаружение фрагментов текста на скриншоте и создают карту сегментированного текста. В предпочтительном варианте реализации заявленного способа данные фрагменты включают в себя последовательность символов, которые соответствуют одному или нескольким словам и части окружающего фона, а карта является растровым изображением такого же размера, как и исходный скриншот, где каждый пиксел кодируется как относящийся или не относящийся к области текста. Оценка цвета для символов и фона указанных текстовых фрагментов выполняется на шаге 202. В предпочтительном варианте осуществления заявленного способа скриншот представлен в цветовом пространстве RGB и, соответственно каждый его пиксел описывается тремя цветовыми компонентами красного, зеленого и синего цветов. Оценка каждой из трех компонент цвета (красной, зеленой, синей) происходит раздельно по гистограммам этих компонент. Крайний правый или левый столбец (группа столбцов) гистограммы с наибольшим значением (суммарным значением) соответствует цвету фона, противоположному цвету символа. На шаге 203 происходит векторизация контуров символов на карте текста путем их преобразования в последовательность отрезков прямых и кривых. Процесс проиллюстрирован на Фиг.6 и Фиг.7. На шаге 204 скриншот модифицируется посредством заполнения областей обнаруженного текста соответствующим цветом фона. Для сложного фона предпочтительно использовать более совершенный способ заполнения области текста, например технику «inpainting», т.е. закрашивания ("Bertalmio М., Sapiro G., Caselles V., Ballester С. Image inpainting // In Proc. ACM Conf. Comp. Graphics (SIGGRAPH), pages 417-424, 2000) [5]. На шаге 205 создается метафайл из соответствующих записей метафайла, сохраненных в определенной последовательности. Метафайл может быть представлен в формате: PDF, XPS, PS, EMF и др. Модифицированное изображение скриншота сохраняется в метафайл как растровое изображение. Символы сохраняются в векторном виде соответствующими графическими командами метафайла, определяющими параметры замкнутых последовательностей аппроксимирующих отрезков прямых и кривых и информацию о цвете заливки. Для оптимизации размера метафайла может быть применен алгоритм сжатия без потерь применительно к векторным записям метафайла, и алгоритм сжатия с потерями или без потерь для растровых изображений. Заявляемый подход обеспечивает эффективное хранение метафайла с точки зрения «визуальное качество/размер», так как каждый тип визуальной информации хранится оптимальным образом. Более того, заявляемый подход позволяет предотвратить искажение сглаженного текста на скриншоте при печати или визуализации при увеличенном масштабе. Это становится возможным за счет замены сглаженных символов скриншота векторными аналогами.Figure 2 illustrates the main steps of the proposed method. At

На Фиг.3 показана блок-схема системы преобразования скриншота в метафайл. Модуль 301 сегментации текста сегментирует текст, создает размеченную карту сегментированного текста и определяет координаты фрагментов, содержащих текст. На вход данного модуля поступает исходное растровое изображение скриншота. Карта сегментированного текста передается в модуль 304 векторизации и модуль 303 ретуширования текста, координаты фрагментов передаются в модуль 302 оценки цвета. Модуль оценки цвета выполнен с возможностью определения цвета фона и текста для каждого фрагмента. На вход данного модуля поступают координаты фрагментов и исходный скриншот. Информация о цвете фона передается в модуль 303 ретуширования, информация о цвете текста передается в модуль 305 создания метафайла. Модуль 304 векторизации выполняет аппроксимацию контуров символов на карте сегментированного текста замкнутой последовательностью отрезков прямых и кривых. На вход данного модуля подается карта из модуля 301 сегментации. Координаты фрагментов, последовательность отрезков прямых и кривых передается в модуль создания метафайла. Модуль 303 ретуширования текста модифицирует исходное растровое изображение скриншота посредством закрашивания области фрагментов с текстом соответствующим цветом фона. На вход данного модуля поступает информация о цвете фона для каждого фрагмента. Модифицированный скриншот передается в модуль 305 создания метафайла, выполненный с возможностью формирования метафайла из следующих записей: модифицированного скриншота, замкнутых последовательностей отрезков прямых и кривых, заполненных соответствующим цветом символа.Figure 3 shows a block diagram of a system for converting a screenshot into a metafile. The

Все перечисленные модули системы могут быть реализованы в виде SoC, FPGA или ASIC. Функции модулей понятны из их описания и описания существующих способов. Проиллюстрированы только те признаки, которые упомянуты в описании. Однако следует понимать, что вычислительная система может иметь дополнительные признаки, которые не были проиллюстрированы.All of the listed system modules can be implemented as SoC, FPGA or ASIC. The functions of the modules are clear from their descriptions and descriptions of existing methods. Only those features that are mentioned in the description are illustrated. However, it should be understood that a computing system may have additional features that have not been illustrated.

Имеет смысл детально рассмотреть два возможных подхода для обнаружения текста. Первый алгоритм быстрее и предназначен для обнаружения сглаженного текста, который типичен для дисплеев. Второй алгоритм более общий, подходит для обнаружения как сглаженного текста, так и текста без сглаживания.It makes sense to consider in detail two possible approaches for detecting text. The first algorithm is faster and is designed to detect smoothed text, which is typical for displays. The second algorithm is more general, suitable for detecting both smoothed text and text without smoothing.

Первый подход обнаружения текстовых фрагментов включает в себя следующие шаги:The first approach to detect text fragments includes the following steps:

- обнаруживают соседние пиксели с большой производной в горизонтальном направлении;- detect adjacent pixels with a large derivative in the horizontal direction;

- объединяют соседние пиксели в фрагменты;- combine adjacent pixels into fragments;

- анализируют гистограммы фрагментов с целью обнаружения сглаженного текста;- analyze histograms of fragments in order to detect smoothed text;

- выделяют фрагменты с признаками сглаженного текста.- extract fragments with signs of a smoothed text.

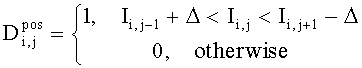

Фиг.4 иллюстрирует первый подход к обнаружению фрагментов сглаженного текста на скриншоте для последующего анализа. Иллюстрация показывает результат обнаружения горизонтального градиента для одного малого фрагмента 401 скриншота. Вычисленное общее значение горизонтального градиента

Где Ii,j - яркость изображения в точке i, j; Δ - заданный порог.Where I i, j is the brightness of the image at the point i, j; Δ is a given threshold.

Результат обнаружения градиента - бинарное изображение 402, ненулевые элементы которого показывают наличие градиента. По причине слабой связности соседних элементов на бинарном изображении выполняется процедура расширения (дилатации) с горизонтальным структурирующим элементом 403. На следующем шаге выделяются отдельные фрагменты 404 по крайним точкам связанных ненулевых пикселей.The result of the gradient detection is a

Далее анализируется гистограмма каждого выделенного фрагмента с целью обнаружения признаков сглаженного текста и выделения фрагментов, содержащих символы. На Фиг.5 показана иллюстрация анализа гистограммы всех трех компонент цвета (красный, зеленый, синий) цветового пространства RGB для обнаружения признаков сглаженного текста: число ненулевых b+ столбцов гистограммы и нулевых b0. Гистограмма фрагмента 504, содержащего нетекстовые данные, характеризуется полностью непрерывным распределением 501-503 для каждой компоненты цвета. Гистограмма фрагмента 508, содержащего сглаженный текст, состоит всего из нескольких b+ (например, для технологии MS ClearType экспериментальным путем получено b+=7) ненулевых столбцов, которые равномерно распределены между цветом фона и текста (SOS-SOT). В предпочтительном варианте изобретения, если и b0>6, тогда фрагмент классифицируется как текстовый, иначе - как нетекстовый 509.Next, a histogram of each selected fragment is analyzed in order to detect signs of smoothed text and highlight fragments containing symbols. Figure 5 shows an illustration of the analysis of the histogram of all three color components (red, green, blue) of the RGB color space to detect signs of smoothed text: the number of nonzero b + histogram columns and zero b 0 . The histogram of

Второй подход к обнаружению фрагментов с текстом включает следующие шаги:The second approach to detecting fragments with text includes the following steps:

- разделяют изображения на прямоугольные блоки с перекрытием;- divide images into rectangular blocks with overlapping;

- вычисляют признаки для каждого блока;- calculate the characteristics for each block;

- классифицируют каждый блок;- classify each block;

- объединяют соседние блоки в фрагменты текста. В предпочтительном варианте реализации размер блока составляет 7×7 или 9×9 пикселей. Перекрытие блоков может составлять 1, или 2, или 3 пикселя.- combine adjacent blocks into fragments of text. In a preferred embodiment, the block size is 7 × 7 or 9 × 9 pixels. Overlapping blocks can be 1, or 2, or 3 pixels.

Для каждого блока вычисляют следующие признаки:For each block, the following characteristics are calculated:

- число ненулевых столбцов и нулевых столбцов гистограммы раздельно для каждого канала;- the number of non-zero columns and zero columns of the histogram separately for each channel;

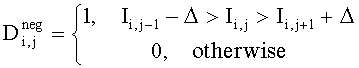

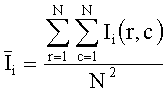

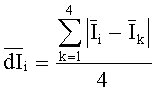

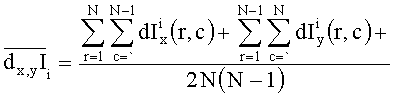

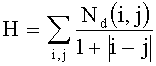

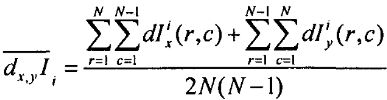

- средняя яркость блока:

- средняя разность средней яркости блока средняя разность средних яркостей блоков Ik в 4-связном соседстве с блоком Ii:

- среднее значение вертикальных

- однородность блока:

- процент пикселей с градиентом выше порога:

- процент изменений яркостей пикселей на изображении

Для классификации на два подмножества (текст и рисунок), основанной на перечисленных выше признаках, может быть использован один из следующих способов: бустинг комитета решающих деревьев (Yoav Freund and Robert E.Schapire. 1997. A decision-theoretic generalization of on-line learning and an application to boosting. J. Comput. Syst. Sci. 55, 1 (August 1997), 119-139.), случайный лес решающих деревьев (Leo Breiman. 2001. Random Forests. Mach. Learn. 45, 1 (October 2001), 5-32.), машина опорных векторов (Corinna Cortes and Vladimir Vapnik. 1995. Support-Vector Networks. Mach. Learn. 20, 3 (September 1995), 273-297.), способ К-ближайших соседей (D.Coomans, D.L.Massart, Alternative k-nearest neighbour rules in supervised pattern recognition: Part 1. k-Nearest neighbour classification by using alternative voting rules, Analytica Chimica Acta, Volume 136, 1982, Pages 15-27).One of the following methods can be used to classify into two subsets (text and figure) based on the above criteria: boosting the decision tree committee (Yoav Freund and Robert E. Schapire. 1997. A decision-theoretic generalization of on-line learning and an application to boosting. J. Comput. Syst. Sci. 55, 1 (August 1997), 119-139.), random forest of decision trees (Leo Breiman. 2001. Random Forests. Mach. Learn. 45, 1 (October 2001), 5-32.), A support vector machine (Corinna Cortes and Vladimir Vapnik. 1995. Support-Vector Networks. Mach. Learn. 20, 3 (September 1995), 273-297.), Method of K-nearest neighbors ( D.Coomans, DLMassart, Alternative k-nearest neighbor rules in supervised pattern recognition: Part 1. k-Nearest neigh bour classification by using alternative voting rules, Analytica Chimica Acta, Volume 136, 1982, Pages 15-27).

На Фиг.6 показана блок-схема процесса векторизации. После обнаружения фрагментов скриншота, содержащих текст, цветные фрагменты трансформируются в полутоновые изображения 601 и увеличиваются на коэффициент к 602. В предпочтительном варианте реализации заявленного способа применяется билинейная интерполяция, так как исходное разрешение символа на скриншоте мало. Например, при разрешении экрана 1920×1080 пикселей высота строчного символа шрифта Times New Roman 12-го кегля при 100% масштабе составляет 7-8 пикселей. Далее полутоновые фрагменты повышенного разрешения бинаризуются 603. В предпочтительном варианте реализации для определения порога сегментации используется метод Отцу (N.Otsu, "А threshold selection method from grey level histogram", IEEE Transactions on System Man Cybernetics, vol. 9 no. 1, 1979, pp.62-66.). Bсe бинаризованные фрагменты объединяются в соответствии с их координатами на скриншоте для формирования карты сегментированного текста. В предпочтительном варианте реализации использован коэффициент к равный трем.Figure 6 shows a block diagram of the vectorization process. After detecting screenshot fragments containing text, color fragments are transformed into

На шаге 604 отслеживаются внешние и внутренние контура каждого текстового фрагмента для получения траектории контуров данного фрагмента. На данном этапе контур представляет собой замкнутую последовательность точек (вершин), связанных линейными сегментами минимальной длины, равной одному пикселю. Процедура отслеживания идет от начальной вершины вдоль контурной линии по заданному направлению, пока начальная вершина не будет достигнута снова. На следующем шаге 605 уменьшается количество вершин за счет аппроксимации контурной траектории многоугольником. Многоугольник преобразуется в сглаженный контур на шаге 606 за счет аппроксимации замкнутой последовательностью отрезков прямых и кривых. В предпочтительном варианте реализации заявленного способа используются кубические кривые Безье (Piegl, L.Fundamental Developments of Computer Aided Geometric Design. San Diego, CA: Academic Press, 1993). В общем случае, аппроксимация линейными отрезками основана на определении координат концов отрезков. Аппроксимация кривыми отрезками требует определения концов отрезков и соответствующих опорных точек. Например, в соответствии с иллюстрацией на Фиг.7, угол 703 между краями 701-703 и 703-706 полинома может быть аппроксимирован кубической кривой Безье 705, ограниченной точками 702 и 704. Пример аппроксимации символа 707 показан на 708.At

Иллюстрация преобразования текста скриншота из исходного растрового вида к векторному показана на Фиг.8 в соответствии с шагами 201, 203 и 204. Фрагмент 801 сглаженного текста увеличивается (802) для улучшения разрешения и преобразовывается в бинарное избражение 803. Результирующий векторизованный фрагмент представлен на 804.An illustration of the conversion of the screenshot text from the initial raster view to a vector one is shown in Fig. 8 in accordance with

Фиг.9 демонстрирует результат применения заявленного способа. Первый фрагмент 901 соответствует исходному скриншоту. Второй - фрагменту 902 напечатанного скриншота. Третий фрагмент 903 получен печатью скриншота с повышенным с помощью билинейной интерполяции разрешением. И для сравнения четвертым приведен фрагмент 904 напечатанного скриншота после обработки заявленным способом. Текст выглядит более четким и контрастным.Figure 9 shows the result of applying the claimed method. The

Дальнейшие аспекты изобретения могут быть получены из рассмотрения иллюстраций и описания предпочтительных вариантов реализации. Специалистам ясно, что возможны разные варианты осуществления изобретения, добавления и замены, не выходящие за рамки притязаний и смысла настоящего изобретения, раскрытых в прилагаемой формуле изобретения.Further aspects of the invention can be obtained from consideration of the illustrations and description of preferred embodiments. It is clear to those skilled in the art that various embodiments of the invention, additions and substitutions are possible, without departing from the claims and meaning of the present invention disclosed in the attached claims.

Заявляемый способ и система предназначены для реализации в драйвере принтера или поддерживающего программного обеспечения для черно-белых и цветных принтеров или МФУ. Кроме того способ может быть реализован в виде программного приложения для печати.The inventive method and system are intended to be implemented in a printer driver or supporting software for black-and-white and color printers or MFPs. In addition, the method can be implemented as a software application for printing.

Claims (9)

- обнаруживают фрагменты сглаженного текста на снимке экрана;

- оценивают цвет фона и цвет символов сглаженного текста на каждом фрагменте на основе определения крайних столбцов гистограммы фрагмента;

- векторизуют контуры символов сглаженного текста;

- модифицируют снимок экрана за счет замещения фрагментов сглаженного текста цветом фона;

- создают метафайл на основе модифицированного снимка экрана и векторизованных контуров, заполненных цветом символов сглаженного текста;

- визуализируют созданный метафайл посредством отображения на дисплее или посредством печати.1. A method of converting a screenshot into a metafile, including the following operations:

- detect fragments of smoothed text in a screenshot;

- evaluate the background color and the color of the characters of the smoothed text on each fragment based on the definition of the extreme columns of the fragment histogram;

- vectorize the outline of the characters of the smoothed text;

- modify the screenshot by replacing fragments of the smoothed text with the background color;

- create a metafile based on a modified screenshot and vectorized outlines filled with the color of the characters of the smoothed text;

- visualize the created metafile by displaying or by printing.

- обнаруживают соседние пиксели с высоким значением горизонтального градиента;

- объединяют соседние пиксели во фрагменты;

- анализируют гистограммы фрагментов на предмет обнаружения признаков сглаженного текста;

- выделяют фрагменты с признаками сглаженного текста.2. Method according to claim 1, characterized i in that the anti-aliased text fragments on the screen shot is detected by performing the following operations:

- detect neighboring pixels with a high value of the horizontal gradient;

- combine adjacent pixels into fragments;

- analyze the histograms of fragments for the detection of signs of a smoothed text;

- extract fragments with signs of a smoothed text.

- делят снимок экрана на пересекающиеся прямоугольные блоки;

- вычисляют признаки для каждого блока;

- классифицируют каждый блок как текстовый или нетекстовый;

- объединяют соседние блоки во фрагменты текста.5. The method according to claim 1, characterized in that fragments of the smoothed text in the screenshot are detected by performing the following operations:

- divide the screenshot into intersecting rectangular blocks;

- calculate the characteristics for each block;

- classify each block as text or non-text;

- combine adjacent blocks into fragments of text.

- число ненулевых столбцов b + и нулевых столбцов b 0 раздельно для каждого канала цветового пространства RGB;

- среднюю яркость блока: , где I i (r,c) - яркость пикселя, расположенного в строке r и столбце c, N - количество пикселей в блоке;

- среднюю разность средних яркостей блоков I k в 4-связном соседстве с блоком ;

- среднее значение вертикальных и горизонтальных производных по блокам: ;

- однородность блока: , где N d - это нормированная матрица вхождений, d - определяет пространственную связь;

- процент пикселей с градиентом выше порога: вычисляется как квадратный корень из суммы квадратов горизонтальных и вертикальных производных;

- процент изменений яркостей пикселей на изображении , полученном в результате применения операции морфологического открытия к бинарному изображению , полученному бинаризацией с пороговым значением 128: .6. The method according to claim 5, characterized in that for each block the following characteristic features are calculated:

- the number of non-zero columns b + and zero columns b 0 separately for each channel of the RGB color space;

- average brightness of the block: where I i (r, c) is the brightness of the pixel located in row r and column c , N is the number of pixels in the block;

- the average difference in the average brightness of the blocks I k in a 4-connected neighborhood with the block ;

- average value of vertical and horizontal derivatives in blocks: ;

- homogeneity of the block: where N d is the normalized matrix of occurrences, d - defines the spatial relationship;

- percentage of pixels with a gradient above the threshold: calculated as the square root of the sum of the squares of the horizontal and vertical derivatives;

- percentage of changes in brightness of pixels in the image obtained by applying the morphological discovery operation to a binary image obtained by binarization with a threshold value of 128: .

- преобразуют фрагмент текста в полутоновое изображение;

- повышают разрешение полутонового изображения;

- бинаризуют фрагмент повышенного разрешения;

- отслеживают точки контуров символов в пределах фрагментов для описания траектории контуров;

- сокращают числа вершин контуров;

- аппроксимируют траекторию контуров с сокращенным числом вершин последовательностью отрезков прямых и кривых;8. The method according to claim 1, characterized in that the vector outlines of the characters of the smoothed text by performing the following operations:

- convert a fragment of text into a grayscale image;

- increase the resolution of the grayscale image;

- binarize a fragment of high resolution;

- track the points of the contours of the characters within the fragments to describe the path of the contours;

- reduce the number of vertex contours;

- approximate the path of the contours with a reduced number of vertices by a sequence of line segments and curves;

- модуль сегментации текста, выполненный с возможностью сегментации текста, создания размеченной карты сегментированного текста и определения координат фрагментов, содержащих сглаженный текст; причем на вход модуля поступает исходное растровое изображение снимка экрана, выходы модуля сегментации текста подключены к входам модулей векторизации и ретуширования, куда передается карта, а также к входу модуля оценки цвета, куда передаются координаты фрагментов и исходный снимок экрана;

- модуль оценки цвета, выполненный с возможностью определения цвета фона и текста для каждого фрагмента; на вход модуля поступают с выхода модуля сегментации текста координаты фрагментов и исходный снимок экрана; выходы модуля оценки цвета подключены к входу модуля ретуширования и входу модуля создания метафайла;

- модуль векторизации, выполненный с возможностью аппроксимации контуров символов на карте сегментированного текста замкнутой последовательностью отрезков прямых и кривых; вход модуля подключен к выходу модуля сегментации с возможностью получения карты; выход модуля векторизации подключен к входу модуля создания метафайла;

- модуль ретуширования текста, выполненный с возможностью модификации исходного растрового изображения снимка экрана посредством закрашивания области фрагментов с текстом соответствующим цветом фона; вход модуля подключен к выходу модуля оценки цвета; выход модуля подключен к входу модуля создания метафайла, куда передается модифицированный снимок экрана;

- модуль создания метафайла, выполненный с возможностью формирования метафайла из следующих записей: модифицированного снимка экрана, замкнутых последовательностей отрезков прямых и кривых, заполненных соответствующим цветом символа. 9. A system for converting a screenshot into a metafile, including:

- text segmentation module, configured to segment text, create a marked-up map of segmented text and determine the coordinates of fragments containing smoothed text; moreover, the input bitmap image of the screenshot is input to the module, the outputs of the text segmentation module are connected to the inputs of the vectorization and retouching modules, where the map is transferred, as well as to the input of the color estimation module, where the coordinates of the fragments and the original screenshot are transmitted;

- color evaluation module, configured to determine the background color and text for each fragment; the coordinates of the fragments and the initial screenshot are received from the output of the text segmentation module; the outputs of the color evaluation module are connected to the input of the retouching module and the input of the metafile creation module;

- a vectorization module, configured to approximate the contours of characters on a segmented text map with a closed sequence of line segments and curves; the input of the module is connected to the output of the segmentation module with the possibility of obtaining a card; the output of the vectorization module is connected to the input of the metafile creation module;

- text retouching module, configured to modify the initial bitmap image of the screen shot by filling in the area of fragments with the text with the corresponding background color; the input of the module is connected to the output of the color evaluation module; the output of the module is connected to the input of the metafile creation module, where the modified screenshot is transmitted;

- a metafile creation module, configured to generate a metafile from the following entries: a modified screen shot, closed sequences of line segments and curves filled with the corresponding symbol color.

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| RU2013104245/08A RU2534005C2 (en) | 2013-02-01 | 2013-02-01 | Method and system for converting screenshot into metafile |

| KR1020140003340A KR101887929B1 (en) | 2013-02-01 | 2014-01-10 | Image Processing Apparatus, Image Processing Method, Computer Readable Recording Medium and Image Forming Apparatus |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| RU2013104245/08A RU2534005C2 (en) | 2013-02-01 | 2013-02-01 | Method and system for converting screenshot into metafile |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| RU2013104245A RU2013104245A (en) | 2014-08-10 |

| RU2534005C2 true RU2534005C2 (en) | 2014-11-27 |

Family

ID=51354900

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| RU2013104245/08A RU2534005C2 (en) | 2013-02-01 | 2013-02-01 | Method and system for converting screenshot into metafile |

Country Status (2)

| Country | Link |

|---|---|

| KR (1) | KR101887929B1 (en) |

| RU (1) | RU2534005C2 (en) |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| RU2669063C2 (en) * | 2015-10-29 | 2018-10-08 | Сяоми Инк. | Method and device for image acquisition |

| RU2782162C2 (en) * | 2017-12-11 | 2022-10-21 | Гуандун Оппо Мобайл Телекоммьюникейшнс Корп., Лтд. | Method for obtainment of screenshot and related products |

Families Citing this family (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR102053659B1 (en) | 2017-09-13 | 2019-12-09 | (주)다비오 | Apparatus of manufacturing map based on machine learning and image processing |

| CN110930302B (en) * | 2018-08-30 | 2024-03-26 | 珠海金山办公软件有限公司 | Picture processing method and device, electronic equipment and readable storage medium |

| CN110727495B (en) * | 2019-10-18 | 2022-12-23 | 深圳市比量科技传媒有限公司 | Automatic segmentation screenshot method and system for interface elements |

Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US6169607B1 (en) * | 1996-11-18 | 2001-01-02 | Xerox Corporation | Printing black and white reproducible colored test documents |

| JP2003324604A (en) * | 2002-05-07 | 2003-11-14 | Sharp Corp | Image processing apparatus, image forming apparatus, image processing method, program, and recording medium |

| US20040145592A1 (en) * | 2001-01-09 | 2004-07-29 | Twersky Irving Yitzchak | Apparatus and methods for replacing decorative images with text and/or graphical patterns |

| KR20080095743A (en) * | 2007-04-25 | 2008-10-29 | 히타치 오므론 터미널 솔루션즈 가부시키가이샤 | Image processing program and image processing device |

| US20090148043A1 (en) * | 2007-12-06 | 2009-06-11 | International Business Machines Corporation | Method for extracting text from a compound digital image |

| US20110170801A1 (en) * | 2010-01-09 | 2011-07-14 | Microsoft Corporation | Resizing of digital images |

| CN102194114A (en) * | 2011-06-25 | 2011-09-21 | 电子科技大学 | Method for recognizing iris based on edge gradient direction pyramid histogram |

| RU2433477C1 (en) * | 2007-07-30 | 2011-11-10 | Долби Лэборетериз Лайсенсинг Корпорейшн | Image dynamic range expansion |

| RU2469400C1 (en) * | 2011-11-17 | 2012-12-10 | Корпорация "САМСУНГ ЭЛЕКТРОНИКС Ко., Лтд." | Method to convert bitmapped image into metafile |

Family Cites Families (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP3446794B2 (en) * | 1996-08-26 | 2003-09-16 | 株式会社日本デジタル研究所 | Polygon approximation method and character recognition device for character recognition |

| JP5047051B2 (en) * | 2008-05-02 | 2012-10-10 | キヤノン株式会社 | Image processing apparatus and image encoding method |

| JP5159588B2 (en) * | 2008-12-05 | 2013-03-06 | キヤノン株式会社 | Image processing apparatus, image processing method, and computer program |

| JP2012003480A (en) * | 2010-06-16 | 2012-01-05 | Nippon Hoso Kyokai <Nhk> | Telop character area detector and program |

-

2013

- 2013-02-01 RU RU2013104245/08A patent/RU2534005C2/en not_active IP Right Cessation

-

2014

- 2014-01-10 KR KR1020140003340A patent/KR101887929B1/en not_active Expired - Fee Related

Patent Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US6169607B1 (en) * | 1996-11-18 | 2001-01-02 | Xerox Corporation | Printing black and white reproducible colored test documents |

| US20040145592A1 (en) * | 2001-01-09 | 2004-07-29 | Twersky Irving Yitzchak | Apparatus and methods for replacing decorative images with text and/or graphical patterns |

| JP2003324604A (en) * | 2002-05-07 | 2003-11-14 | Sharp Corp | Image processing apparatus, image forming apparatus, image processing method, program, and recording medium |

| KR20080095743A (en) * | 2007-04-25 | 2008-10-29 | 히타치 오므론 터미널 솔루션즈 가부시키가이샤 | Image processing program and image processing device |

| RU2433477C1 (en) * | 2007-07-30 | 2011-11-10 | Долби Лэборетериз Лайсенсинг Корпорейшн | Image dynamic range expansion |

| US20090148043A1 (en) * | 2007-12-06 | 2009-06-11 | International Business Machines Corporation | Method for extracting text from a compound digital image |

| US20110170801A1 (en) * | 2010-01-09 | 2011-07-14 | Microsoft Corporation | Resizing of digital images |

| CN102194114A (en) * | 2011-06-25 | 2011-09-21 | 电子科技大学 | Method for recognizing iris based on edge gradient direction pyramid histogram |

| RU2469400C1 (en) * | 2011-11-17 | 2012-12-10 | Корпорация "САМСУНГ ЭЛЕКТРОНИКС Ко., Лтд." | Method to convert bitmapped image into metafile |

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| RU2669063C2 (en) * | 2015-10-29 | 2018-10-08 | Сяоми Инк. | Method and device for image acquisition |

| US10530836B2 (en) | 2015-10-29 | 2020-01-07 | Xiaomi Inc. | Methods and apparatuses for acquiring image |

| RU2782162C2 (en) * | 2017-12-11 | 2022-10-21 | Гуандун Оппо Мобайл Телекоммьюникейшнс Корп., Лтд. | Method for obtainment of screenshot and related products |

| RU2782162C9 (en) * | 2017-12-11 | 2022-12-26 | Гуандун Оппо Мобайл Телекоммьюникейшнс Корп., Лтд. | Method for obtainment of screenshot and related products |

Also Published As

| Publication number | Publication date |

|---|---|

| KR20140099183A (en) | 2014-08-11 |

| KR101887929B1 (en) | 2018-08-13 |

| RU2013104245A (en) | 2014-08-10 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6998198B2 (en) | Multi-binary image processing | |

| US9042649B2 (en) | Color document image segmentation and binarization using automatic inpainting | |

| US10423827B1 (en) | Image text recognition | |

| US11587216B2 (en) | Detection and identification of objects in images | |

| US20110075936A1 (en) | Methods for image processing | |

| US10509959B2 (en) | Method and device for segmenting lines in line chart | |

| US8456711B2 (en) | SUSAN-based corner sharpening | |

| RU2534005C2 (en) | Method and system for converting screenshot into metafile | |

| JP2004166007A (en) | Device, method and program for image processing, and storage medium | |

| US8259374B2 (en) | Image processing apparatus and image forming apparatus | |

| Walha et al. | Resolution enhancement of textual images: a survey of single image‐based methods | |

| CA2790210C (en) | Resolution adjustment of an image that includes text undergoing an ocr process | |

| US9741142B2 (en) | Method and apparatus for enabling text editing in a scanned document while maintaining fidelity of the appearance of the text | |

| US10460219B2 (en) | Generating an object map from a plurality of binary images | |

| JP5335581B2 (en) | Image processing apparatus, image processing method, and program | |

| US9225876B2 (en) | Method and apparatus for using an enlargement operation to reduce visually detected defects in an image | |

| Ramadhan et al. | Text detection in natural image by connected component labeling | |

| JP2025015415A (en) | Information processing device and information processing method for processing overlay image | |

| US9648208B2 (en) | Method and apparatus and using an enlargement operation to reduce visually detected defects in an image | |

| JP3952188B2 (en) | Image interpolation apparatus, image interpolation method, and image interpolation program | |

| US20120159292A1 (en) | Method of processing an object-based image file with content type dependent image processing algorithms | |

| RU2520407C1 (en) | Method and system of text improvement at digital copying of printed documents | |

| US20060233452A1 (en) | Text enhancement methodology in scanned images of gray-scale documents | |

| Kurilin et al. | Generation of PDF with vector symbols from scanned document | |

| JP5718728B2 (en) | Character readability evaluation method |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PD4A | Correction of name of patent owner | ||

| PC41 | Official registration of the transfer of exclusive right |

Effective date: 20170921 |

|

| PD4A | Correction of name of patent owner | ||

| MM4A | The patent is invalid due to non-payment of fees |

Effective date: 20200202 |