KR20230079199A - Ibc 및 인트라 예측을 갖는 기하학적 파티션 모드에 대한 인트라 예측 모드 정보 전파 - Google Patents

Ibc 및 인트라 예측을 갖는 기하학적 파티션 모드에 대한 인트라 예측 모드 정보 전파 Download PDFInfo

- Publication number

- KR20230079199A KR20230079199A KR1020237014995A KR20237014995A KR20230079199A KR 20230079199 A KR20230079199 A KR 20230079199A KR 1020237014995 A KR1020237014995 A KR 1020237014995A KR 20237014995 A KR20237014995 A KR 20237014995A KR 20230079199 A KR20230079199 A KR 20230079199A

- Authority

- KR

- South Korea

- Prior art keywords

- prediction mode

- current block

- mode

- partition

- intra

- Prior art date

Links

- 238000005192 partition Methods 0.000 title claims abstract description 121

- 238000000034 method Methods 0.000 claims abstract description 103

- 238000012545 processing Methods 0.000 claims description 41

- 238000009795 derivation Methods 0.000 claims description 20

- 230000000644 propagated effect Effects 0.000 claims description 6

- 230000033001 locomotion Effects 0.000 description 67

- 239000000523 sample Substances 0.000 description 47

- 239000013598 vector Substances 0.000 description 36

- 230000008569 process Effects 0.000 description 35

- 230000006835 compression Effects 0.000 description 30

- 238000007906 compression Methods 0.000 description 30

- 230000002123 temporal effect Effects 0.000 description 20

- 238000010586 diagram Methods 0.000 description 16

- 239000000872 buffer Substances 0.000 description 15

- 238000005516 engineering process Methods 0.000 description 13

- 238000004891 communication Methods 0.000 description 12

- 230000005540 biological transmission Effects 0.000 description 9

- 238000013139 quantization Methods 0.000 description 8

- 230000006870 function Effects 0.000 description 6

- 241000023320 Luma <angiosperm> Species 0.000 description 5

- OSWPMRLSEDHDFF-UHFFFAOYSA-N methyl salicylate Chemical compound COC(=O)C1=CC=CC=C1O OSWPMRLSEDHDFF-UHFFFAOYSA-N 0.000 description 5

- 230000002093 peripheral effect Effects 0.000 description 5

- 239000013074 reference sample Substances 0.000 description 5

- 238000009877 rendering Methods 0.000 description 5

- 238000000638 solvent extraction Methods 0.000 description 5

- 230000003044 adaptive effect Effects 0.000 description 4

- 230000007246 mechanism Effects 0.000 description 4

- 230000004044 response Effects 0.000 description 4

- 230000011664 signaling Effects 0.000 description 4

- 230000000007 visual effect Effects 0.000 description 4

- 230000008901 benefit Effects 0.000 description 3

- 238000013507 mapping Methods 0.000 description 3

- 230000003287 optical effect Effects 0.000 description 3

- VBRBNWWNRIMAII-WYMLVPIESA-N 3-[(e)-5-(4-ethylphenoxy)-3-methylpent-3-enyl]-2,2-dimethyloxirane Chemical compound C1=CC(CC)=CC=C1OC\C=C(/C)CCC1C(C)(C)O1 VBRBNWWNRIMAII-WYMLVPIESA-N 0.000 description 2

- 230000001413 cellular effect Effects 0.000 description 2

- 238000009826 distribution Methods 0.000 description 2

- 239000012634 fragment Substances 0.000 description 2

- 230000004927 fusion Effects 0.000 description 2

- 239000011159 matrix material Substances 0.000 description 2

- 238000002156 mixing Methods 0.000 description 2

- 238000005457 optimization Methods 0.000 description 2

- 238000004549 pulsed laser deposition Methods 0.000 description 2

- 238000005070 sampling Methods 0.000 description 2

- 238000013403 standard screening design Methods 0.000 description 2

- PXFBZOLANLWPMH-UHFFFAOYSA-N 16-Epiaffinine Natural products C1C(C2=CC=CC=C2N2)=C2C(=O)CC2C(=CC)CN(C)C1C2CO PXFBZOLANLWPMH-UHFFFAOYSA-N 0.000 description 1

- 241000282412 Homo Species 0.000 description 1

- 230000004075 alteration Effects 0.000 description 1

- 235000014121 butter Nutrition 0.000 description 1

- 238000010276 construction Methods 0.000 description 1

- 238000012937 correction Methods 0.000 description 1

- 230000008878 coupling Effects 0.000 description 1

- 238000010168 coupling process Methods 0.000 description 1

- 238000005859 coupling reaction Methods 0.000 description 1

- 238000013461 design Methods 0.000 description 1

- 238000011161 development Methods 0.000 description 1

- 238000002474 experimental method Methods 0.000 description 1

- 238000001914 filtration Methods 0.000 description 1

- 239000011521 glass Substances 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- 230000007774 longterm Effects 0.000 description 1

- 238000010295 mobile communication Methods 0.000 description 1

- 230000002085 persistent effect Effects 0.000 description 1

- 230000009467 reduction Effects 0.000 description 1

- 230000035945 sensitivity Effects 0.000 description 1

- 239000000779 smoke Substances 0.000 description 1

- 239000007787 solid Substances 0.000 description 1

- 230000000153 supplemental effect Effects 0.000 description 1

- 238000012360 testing method Methods 0.000 description 1

- 210000003813 thumb Anatomy 0.000 description 1

- 230000001052 transient effect Effects 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/157—Assigned coding mode, i.e. the coding mode being predefined or preselected to be further used for selection of another element or parameter

- H04N19/159—Prediction type, e.g. intra-frame, inter-frame or bidirectional frame prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/11—Selection of coding mode or of prediction mode among a plurality of spatial predictive coding modes

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/119—Adaptive subdivision aspects, e.g. subdivision of a picture into rectangular or non-rectangular coding blocks

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/172—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a picture, frame or field

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/176—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a block, e.g. a macroblock

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/593—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving spatial prediction techniques

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Compression Or Coding Systems Of Tv Signals (AREA)

Abstract

방법에서, 비디오의 현재 픽처 내의 현재 블록의 코딩된 정보는 코딩된 비디오 비트스트림으로부터 수신된다. 코딩된 정보는 현재 블록이 기하학적 파티션 모드(GPM)에 기초하여 적어도 제1 파티션 및 제2 파티션으로 파티셔닝되는 것을 나타낸다. 제1 파티션은 인트라 블록 복사(IBC) 예측 모드와 연관되고, 제2 파티션은 인트라 예측 모드와 연관된다. 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보가 저장된다. 예측 모드 정보는 제1 서브블록이 IBC 예측 모드, 인트라 예측 모드, 및 IBC 예측 모드와 인트라 예측 모드 둘 다 중 하나와 연관되는지에 기초하여 DC 모드, 평면 모드, 및 인트라 예측 모드 중 하나를 포함한다.

Description

인용에 의한 포함

본 출원은 2021년 8월 31일자로 출원된 미국 가출원 제63/239,221호, "Intra Prediction Mode Information Propagation for Geometric Partition Mode with IBC and Intra Prediction"에 대한 우선권의 이익을 주장하는, 2022년 8월 29일자로 출원된 미국 특허 출원 제17/898,447호, "INTRA PREDICTION MODE INFORMATION PROPAGATION FOR GEOMETRIC PARTITION MODE WITH IBC AND INTRA PREDICTION"에 대한 우선권의 이익을 주장한다. 선행 출원들의 개시내용들은 이로써 그 전체가 참조로 포함된다.

기술분야

본 개시내용은 일반적으로 비디오 코딩에 관련된 실시예들을 설명한다.

본 명세서에서 제공되는 배경기술 설명은 본 개시내용의 맥락을 일반적으로 제시하기 위한 것이다. 현재 명명된 발명자들의 연구- 그 연구가 이 배경기술 섹션에 설명되어 있는 한 -뿐만 아니라 출원 시에 종래 기술로서 달리 자격이 주어질 수 없는 설명의 양태들은, 명시적으로든 묵시적으로든 본 개시내용에 대한 종래 기술로서 인정되지 않는다.

압축되지 않은 디지털 이미지들 및/또는 비디오는 일련의 픽처들을 포함할 수 있으며, 각각의 픽처는, 예를 들어, 1920 x 1080 루미넌스 샘플들(luminance samples) 및 연관된 크로미넌스 샘플들(chrominance samples)의 공간적 차원을 갖는다. 일련의 픽처들은, 예를 들어 초당 60 픽처 또는 60 Hz의, 고정된 또는 가변적인 픽처 레이트(비공식적으로 프레임 레이트라고도 알려짐)를 가질 수 있다. 압축되지 않은 이미지 및/또는 비디오는 특정 비트레이트(bitrate) 요건들을 갖는다. 예를 들어, 샘플 당 8 비트에서의 1080p60 4:2:0 비디오(60 Hz 프레임 레이트에서의 1920x1080 루미넌스 샘플 해상도)는 1.5 Gbit/s 대역폭에 가까운 것을 요구한다. 한 시간 분량의 그와 같은 비디오는 600 GBytes를 초과하는 저장 공간을 요구한다.

이미지 및/또는 비디오 코딩 및 디코딩의 하나의 목적은, 압축을 통한, 입력 이미지 및/또는 비디오 신호에서의 중복성의 감소일 수 있다. 압축은 전술된 대역폭 및/또는 저장 공간 요건들을, 일부 경우들에서, 두 자릿수 이상 감소시키는 것을 도울 수 있다. 본 명세서에서의 설명들이 예시적인 예들로서 비디오 인코딩/디코딩을 사용하지만, 동일한 기법들이 본 개시내용의 사상으로부터 벗어나지 않고 유사한 방식으로 이미지 인코딩/디코딩에 적용될 수 있다. 무손실 압축(lossless compression) 및 손실 압축(lossy compression) 둘 다뿐만 아니라, 이들의 조합이 이용될 수 있다. 무손실 압축은 압축된 원래의 신호로부터 원래의 신호의 정확한 사본이 재구성될 수 있는 기법들을 지칭한다. 손실 압축을 사용할 때, 재구성된 신호는 원래의 신호와 동일하지 않을 수 있지만, 원래의 신호와 재구성된 신호 사이의 왜곡은 재구성된 신호를 의도된 애플리케이션에 유용하게 만들 정도로 충분히 작다. 비디오의 경우, 손실 압축이 널리 이용된다. 용인되는 왜곡의 양은 애플리케이션에 의존하고; 예를 들어, 특정 소비자 스트리밍 애플리케이션들의 사용자들은 텔레비전 배포 애플리케이션들의 사용자들보다 더 높은 왜곡을 용인할 수 있다. 달성가능한 압축비는 더 높은 허용가능/용인가능 왜곡이 더 높은 압축비를 산출할 수 있음을 반영할 수 있다.

비디오 인코더 및 디코더는, 예를 들어, 모션 보상, 변환 프로세싱, 양자화, 및 엔트로피 코딩을 포함하는 여러 광범위한 카테고리들로부터의 기법들을 활용할 수 있다.

비디오 코덱 기술들은 인트라 코딩으로 알려진 기법들을 포함할 수 있다. 인트라 코딩에서, 샘플 값들은 이전에 재구성된 참조 픽처들로부터의 샘플들 또는 다른 데이터를 참조하지 않고 표현된다. 일부 비디오 코덱들에서, 픽처는 샘플들의 블록들로 공간적으로 세분된다. 샘플들의 모든 블록들이 인트라 모드로 코딩될 때, 그 픽처는 인트라 픽처일 수 있다. 인트라 픽처들 및 독립 디코더 리프레시 픽처들과 같은 그들의 도출들은, 디코더 상태를 리셋하기 위해 사용될 수 있고, 따라서, 코딩된 비디오 비트스트림 및 비디오 세션에서 제1 픽처로서, 또는 정지 이미지로서 사용될 수 있다. 인트라 블록의 샘플들은 변환에 노출될 수 있고, 변환 계수들은 엔트로피 코딩 전에 양자화될 수 있다. 인트라 예측은 사전 변환 도메인(pre-transform domain)에서 샘플 값들을 최소화하는 기법일 수 있다. 일부 경우들에서, 변환 후의 DC 값이 더 작을수록, 그리고 AC 계수들이 더 작을수록, 주어진 양자화 스텝 사이즈(quantization step size)에서 엔트로피 코딩 후의 블록을 표현하기 위해 요구되는 비트들이 더 적다.

예를 들어, MPEG-2세대 코딩 기술들에서 사용되는 전통적인 인트라 코딩은, 인트라 예측을 사용하지 않는다. 그러나, 일부 더 새로운 비디오 압축 기술들은, 예를 들어, 데이터의 블록들의 인코딩 및/또는 디코딩 동안 획득된 주변 샘플 데이터 및/또는 메타데이터에 기초하여 예측을 수행하려고 시도하는 기법들을 포함한다. 그러한 기법들은 이후 "인트라 예측(intra prediction)" 기법들로 불린다. 적어도 일부 경우들에서, 인트라 예측은 참조 픽처들로부터가 아니라 재구성 중인 현재 픽처로부터의 참조 데이터만을 사용한다는 점에 유의한다.

많은 상이한 형태들의 인트라 예측이 있을 수 있다. 그러한 기법들 중 하나보다 많은 기법이 주어진 비디오 코딩 기술에서 사용될 수 있을 때, 사용 중인 특정 기법은 특정 기법을 사용하는 특정 인트라 예측 모드로서 코딩될 수 있다. 특정 경우들에서, 인트라 예측 모드들은 서브모드들 및/또는 파라미터들을 가질 수 있으며, 여기서 서브모드들 및/또는 파라미터들은 개별적으로 코딩되거나 또는 사용되는 예측 모드를 정의하는 모드 코드워드(codeword)에 포함될 수 있다. 주어진 모드, 서브모드, 및/또는 파라미터 조합에 대해 어느 코드워드를 사용할지는 인트라 예측을 통한 코딩 효율성 이득에 영향을 미칠 수 있고, 코드워드들을 비트스트림으로 변환하는 데 사용되는 엔트로피 코딩 기술도 마찬가지이다.

인트라 예측의 특정 모드가 H.264로 도입되었고, H.265에서 정교화되었으며, 공동 탐사 모델(joint exploration model, JEM), 다목적 비디오 코딩(versatile video coding, VVC), 및 벤치마크 세트(benchmark set, BMS)와 같은 더 새로운 코딩 기술들에서 추가로 정교화되었다. 예측기 블록은 이미 이용가능한 샘플들의 이웃 샘플 값들을 사용하여 형성될 수 있다. 이웃 샘플들의 샘플 값들은 방향에 따라 예측기 블록에 복사된다. 사용 중인 방향에 대한 참조는 비트스트림에서 코딩될 수 있거나 그 자체가 예측될 수 있다.

도 1a를 참조하면, 우측 하부에는 H.265에서 정의된 33개의 가능한 예측기 방향(35개의 인트라 모드 중 33개의 각도 모드에 대응함)으로부터 알려진 9개의 예측기 방향의 서브세트가 묘사되어 있다. 화살표들이 수렴하는 포인트(101)는 예측되고 있는 샘플을 표현한다. 화살표들은 샘플이 예측되고 있는 방향을 표현한다. 예를 들어, 화살표(102)는 샘플(101)이 샘플 또는 샘플들로부터 우측 상부로, 수평으로부터 45도 각도로 예측되는 것을 나타낸다. 유사하게, 화살표(103)는 샘플(101)이 샘플 또는 샘플들로부터 샘플(101)의 좌측 하부로, 수평으로부터 22.5도 각도로 예측되는 것을 나타낸다.

여전히 도 1a를 참조하면, 좌측 상단에, 4 x 4 샘플들의 정사각형 블록(104)(파선, 볼드체 라인으로 나타남)이 묘사되어 있다. 정사각형 블록(104)은 각각 "S", Y 차원에서의 그것의 포지션(예를 들어, 행 인덱스) 및 X 차원에서의 그것의 포지션(예를 들어, 열 인덱스)로 라벨링된 16개의 샘플을 포함한다. 예를 들어, 샘플 S21은 Y 차원에서의 제2 샘플(상부로부터) 및 X 차원에서의 제1(좌측으로부터) 샘플이다. 유사하게, 샘플 S44는 Y 차원 및 X 차원 둘 다에서 블록(104)에서의 제4 샘플이다. 블록이 크기가 4 x 4 샘플들이므로, S44는 우측 하단에 있다. 유사한 넘버링 방식을 따르는 참조 샘플들이 추가로 도시된다. 참조 샘플이 블록(104)에 대해 R, 그것의 Y 포지션(예를 들어, 행 인덱스) 및 X 포지션(열 인덱스)로 라벨링된다. H.264 및 H.265 둘 다에서, 예측 샘플들은 재구성 중인 블록에 이웃하고; 따라서, 음의 값들이 사용될 필요가 없다.

인트라 픽처 예측은 시그널링된 예측 방향에 의해 나타낸 이웃 샘플들로부터 참조 샘플 값들을 복사함으로써 작동할 수 있다. 예를 들어, 코딩된 비디오 비트스트림이, 이 블록에 대해, 화살표(102)와 일치하는 예측 방향- 즉, 샘플들은 샘플들로부터 우측 상부로, 수평으로부터 45도 각도로 예측됨 -을 나타내는 시그널링을 포함한다고 가정한다. 그 경우, 샘플들 S41, S32, S23, 및 S14는 동일한 참조 샘플 R05로부터 예측된다. 그 후 샘플 S44는 참조 샘플 R08로부터 예측된다.

특정 경우들에서, 특히 방향들이 45도로 균일하게 분할가능하지 않을 때, 다수의 참조 샘플들의 값들은, 참조 샘플을 계산하기 위해, 예를 들어 보간(interpolation)을 통해 조합될 수 있다.

비디오 코딩 기술이 발전함에 따라 가능한 방향들의 수가 증가하였다. H.264(2003년)에서, 9개의 상이한 방향이 표현될 수 있다. 이는 H.265(2013년)에서 33으로 증가하였다. 현재, JEM/VVC/BMS는 최대 65개의 방향을 지원할 수 있다. 가장 가능성 있는 방향들을 식별하기 위한 실험들이 수행되었고, 엔트로피 코딩에서의 특정 기법들은 그러한 가능성 있는 방향들을 적은 수의 비트들로 표현하는 데 사용되어, 가능성이 적은 방향들에 대한 특정 페널티를 수용한다. 또한, 방향들 자체는 때때로 이웃하는, 이미 디코딩된 블록들에서 사용되는 이웃하는 방향들로부터 예측될 수 있다.

도 1b는 시간에 따라 증가하는 수의 예측 방향들을 예시하기 위해 JEM에 따른 65개의 인트라 예측 방향을 묘사하는 개략도(110)를 도시한다.

코딩된 비디오 비트스트림에서의 방향을 표현하는 인트라 예측 방향 비트들의 맵핑은 비디오 코딩 기술마다 상이할 수 있다. 그러한 맵핑은, 예를 들어, 단순한 직접 맵핑들로부터, 코드워드들까지, 가장 가능성 있는 모드들을 수반하는 복잡한 적응적 방식들, 및 유사한 기법들까지의 범위일 수 있다. 그러나, 대부분의 경우에, 비디오 콘텐츠에서 발생할 가능성이 통계적으로 특정 다른 방향들보다 적은 특정 방향들이 존재할 수 있다. 비디오 압축의 목표는 중복성의 감소이므로, 잘 작동하는 비디오 코딩 기술에서, 그러한 가능성이 더 적은 방향들은, 가능성이 더 많은 방향들보다 더 많은 수의 비트들로 표현될 것이다.

이미지 및/또는 비디오 코딩 및 디코딩은 모션 보상을 갖는 인터-픽처 예측(inter-picture prediction)을 사용하여 수행될 수 있다. 모션 보상은 손실 압축 기법일 수 있고, 이전에 재구성된 픽처 또는 그의 부분(참조 픽처)으로부터의 샘플 데이터의 블록이, 모션 벡터(motion vector)(이하 MV)에 의해 나타낸 방향으로 공간적으로 시프트된 후에, 새롭게 재구성된 픽처 또는 픽처 부분의 예측을 위해 사용되는 기법들과 관련될 수 있다. 일부 경우들에서, 참조 픽처는 현재 재구성 중인 픽처와 동일할 수 있다. MV들은 2개의 차원 X 및 Y, 또는 3개의 차원을 가질 수 있고, 세 번째는 사용 중인 기준 픽처의 표시이다(후자는, 간접적으로, 시간 차원일 수 있음).

일부 비디오 압축 기법들에서, 샘플 데이터의 특정 영역에 적용가능한 MV는 다른 MV들로부터, 예를 들어, 재구성 중인 영역에 공간적으로 인접한 샘플 데이터의 다른 영역에 관련되고, 디코딩 순서로 그 MV에 선행하는 것들로부터 예측될 수 있다. 그렇게 하는 것은 MV를 코딩하기 위해 요구되는 데이터의 양을 실질적으로 감소시킬 수 있고, 그렇게 함으로써 중복성을 제거하고 압축을 증가시킨다. MV 예측은, 예를 들어, 카메라로부터 도출된 입력 비디오 신호(자연 비디오(natural video)로 알려짐)를 코딩할 때, 단일 MV가 적용가능한 영역보다 큰 영역들이 유사한 방향으로 이동하는 통계적 가능성이 있기 때문에, 효과적으로 작동할 수 있고, 따라서, 일부 경우들에서 이웃 영역의 MV들로부터 도출된 유사한 모션 벡터를 사용하여 예측될 수 있다. 이는 주어진 영역에 대해 발견된 MV가 주변 MV들로부터 예측된 MV와 유사하거나 동일하게 되는 것을 초래하고, 이는 결국, 엔트로피 코딩 후에, MV를 직접 코딩하는 경우에 사용될 것보다 더 적은 수의 비트들로 표현될 수 있다. 일부 경우들에서, MV 예측은 원래의 신호(즉: 샘플 스트림)로부터 도출된 신호(즉: MV들)의 무손실 압축의 예일 수 있다. 다른 경우들에서, MV 예측 자체는, 예를 들어, 여러 주변 MV들로부터 예측기를 계산할 때 반올림 오차들 때문에 손실이 있을 수 있다.

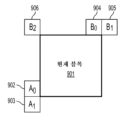

다양한 MV 예측 메커니즘들이 H.265/HEVC(ITU-T Rec. H.265, "고효율 비디오 코딩(High Efficiency Video Coding)", 2016년 12월)에 설명되어 있다. H.265가 제공하는 많은 MV 예측 메커니즘들 중에서, 도 2를 참조하여 설명되는 것은 이후 "공간적 병합(spatial merge)"로 지칭되는 기법이다.

도 2를 참조하면, 현재 블록(201)은 공간적으로 시프트된 동일한 크기의 이전 블록으로부터 예측가능한 것으로 모션 탐색 프로세스 동안 인코더에 의해 발견된 샘플들을 포함한다. 해당 MV를 직접 코딩하는 대신에, MV는 하나 이상의 참조 픽처와 연관된 메타데이터로부터, 예를 들어, 가장 최근(디코딩 순서에서)의 참조 픽처로부터, A0, A1, 및 B0, B1, B2(각각, 202 내지 206)로 표기된 5개의 주위 샘플들 중 어느 하나와 연관된 MV를 사용하여 도출될 수 있다. H.265에서, MV 예측은 이웃 블록이 사용하고 있는 동일한 참조 픽처로부터의 예측기들을 사용할 수 있다.

본 개시내용의 양태들은 비디오 인코딩/디코딩을 위한 방법들 및 장치들을 제공한다. 일부 예들에서, 비디오 디코딩을 위한 장치는 프로세싱 회로를 포함한다.

본 개시내용의 양태에 따르면, 비디오 디코더에서 수행되는 비디오 디코딩 방법이 제공된다. 이 방법에서, 비디오의 현재 픽처 내의 현재 블록의 코딩된 정보가 코딩된 비디오 비트스트림으로부터 수신될 수 있다. 코딩된 정보는 현재 블록이 기하학적 파티션 모드(geometric partition mode, GPM)에 기초하여 적어도 제1 파티션 및 제2 파티션으로 파티셔닝되는 것을 나타낼 수 있다. 제1 파티션은 인트라 블록 복사(intra block copy, IBC) 예측 모드와 연관될 수 있고, 제2 파티션은 인트라 예측 모드와 연관될 수 있다. 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보가 저장될 수 있다. 예측 모드 정보는 제1 서브블록이 IBC 예측 모드, 인트라 예측 모드, 및 IBC 예측 모드와 인트라 예측 모드 둘 다 중 하나와 연관되는지에 기초하여 DC 모드, 평면 모드, 및 인트라 예측 모드 중 하나를 포함할 수 있다.

이 방법에서, 저장된 예측 모드 정보를 사용하여 현재 블록의 이웃 블록에 대한 최고 확률 모드(most probable mode, MPM) 도출이 수행될 수 있다.

일부 실시예들에서, 제1 서브블록이 IBC 예측 모드와 연관되는 것에 기초하여, 예측 모드 정보를 저장하는 것은 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보에 평면 모드만을 저장하는 것을 포함할 수 있다.

일부 실시예들에서, 제1 서브블록이 인트라 예측 모드와 연관되는 것에 기초하여, 예측 모드 정보를 저장하는 것은 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보에 인트라 예측 모드만을 저장하는 것을 포함할 수 있다.

일부 실시예들에서, 제1 서브블록이 IBC 예측 모드 및 인트라 예측 모드 둘 다와 연관되는 것에 기초하여, 예측 모드 정보를 저장하는 것은 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보에 인트라 예측 모드만을 저장하는 것을 포함할 수 있다.

일 실시예에서, DC 모드는 현재 블록의 제1 파티션이 IBC 예측 모드와 연관되는 것, 및 현재 블록의 제2 파티션이 인트라 예측 모드와 연관되는 것에 기초하여 현재 블록의 복수의 서브블록 각각에 대해 저장될 수 있다.

일 실시예에서, 평면 모드는 현재 블록의 제1 파티션이 IBC 예측 모드와 연관되는 것, 및 현재 블록의 제2 파티션이 인트라 예측 모드와 연관되는 것에 기초하여 현재 블록의 복수의 서브블록들 각각에 대해 저장될 수 있다.

일 실시예에서, 인트라 예측 모드는 현재 블록의 제1 파티션이 IBC 예측 모드와 연관되는 것, 및 현재 블록의 제2 파티션이 인트라 예측 모드와 연관되는 것에 기초하여 현재 블록의 복수의 서브블록 각각에 대해 저장될 수 있다.

일부 실시예들에서, 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보는 현재 블록의 이웃 블록의 MPM 도출을 위한 전파된 인트라 모드일 수 있고, 이웃 블록은 IBC 예측 모드에 의해 예측된다.

일부 실시예들에서, 현재 블록의 복수의 서브블록들 각각은 각자의 4 x 4 픽셀 유닛일 수 있다.

본 개시내용의 다른 양태에 따르면, 장치가 제공된다. 장치는 프로세싱 회로를 포함한다. 프로세싱 회로는, 비디오 인코딩/디코딩을 위한 방법들 중 임의의 것을 수행하도록 구성될 수 있다.

본 개시내용의 양태들은 또한, 비디오 디코딩을 위해 컴퓨터에 의해 실행될 때 컴퓨터로 하여금 비디오 인코딩/디코딩을 위한 방법들 중 임의의 것을 수행하게 하는 명령어들을 저장한 비일시적 컴퓨터 판독가능 매체를 제공한다.

개시된 주제의 추가적인 특징들, 본질, 및 다양한 이점들은 다음의 상세한 설명 및 첨부 도면들로부터 더 명백해질 것이다.

도 1a는 인트라 예측 모드들의 예시적인 서브세트의 개략적 예시이다.

도 1b는 예시적인 인트라 예측 방향들의 예시이다.

도 2는 일 예에서 현재 블록 및 그 주위의 공간적 병합 후보들의 개략적 예시이다.

도 3은 일 실시예에 따른 통신 시스템(300)의 단순화된 블록도의 개략적 예시이다.

도 4는 일 실시예에 따른 통신 시스템(400)의 단순화된 블록도의 개략적 예시이다.

도 5는 일 실시예에 따른 디코더의 단순화된 블록도의 개략적 예시이다.

도 6은 일 실시예에 따른 인코더의 단순화된 블록도의 개략적 예시이다.

도 7은 다른 실시예에 따른 인코더의 블록도를 도시한다.

도 8은 다른 실시예에 따른 디코더의 블록도를 도시한다.

도 9는 다른 실시예를 갖는 공간적 병합 후보들의 예시적인 포지션들을 도시한다.

도 10은 공간적 병합 후보들의 예시적인 중복 검사를 도시한다.

도 11은 일 실시예에 따른 시간적 병합 후보에 대한 모션 벡터 스케일링의 개략적 예시를 도시한다.

도 12는 일 실시예에 따른 시간적 병합 후보들에 대한 예시적인 후보 포지션들을 도시한다.

도 13은 일 실시예에 따른 기하학적 파티션 모드(GPM)의 예시적인 각도 분포들을 도시한다.

도 14는 일 실시예에 따른 GPM에 대한 예시적인 파티션 라인들을 도시한다.

도 15는 본 개시내용의 일부 실시예들에 따른 예시적인 디코딩 프로세스를 약술하는 흐름도를 도시한다.

도 16은 본 개시내용의 일부 실시예들에 따른 예시적인 인코딩 프로세스를 약술하는 흐름도를 도시한다.

도 17은 일 실시예에 따른 컴퓨터 시스템의 개략적 예시이다.

도 1a는 인트라 예측 모드들의 예시적인 서브세트의 개략적 예시이다.

도 1b는 예시적인 인트라 예측 방향들의 예시이다.

도 2는 일 예에서 현재 블록 및 그 주위의 공간적 병합 후보들의 개략적 예시이다.

도 3은 일 실시예에 따른 통신 시스템(300)의 단순화된 블록도의 개략적 예시이다.

도 4는 일 실시예에 따른 통신 시스템(400)의 단순화된 블록도의 개략적 예시이다.

도 5는 일 실시예에 따른 디코더의 단순화된 블록도의 개략적 예시이다.

도 6은 일 실시예에 따른 인코더의 단순화된 블록도의 개략적 예시이다.

도 7은 다른 실시예에 따른 인코더의 블록도를 도시한다.

도 8은 다른 실시예에 따른 디코더의 블록도를 도시한다.

도 9는 다른 실시예를 갖는 공간적 병합 후보들의 예시적인 포지션들을 도시한다.

도 10은 공간적 병합 후보들의 예시적인 중복 검사를 도시한다.

도 11은 일 실시예에 따른 시간적 병합 후보에 대한 모션 벡터 스케일링의 개략적 예시를 도시한다.

도 12는 일 실시예에 따른 시간적 병합 후보들에 대한 예시적인 후보 포지션들을 도시한다.

도 13은 일 실시예에 따른 기하학적 파티션 모드(GPM)의 예시적인 각도 분포들을 도시한다.

도 14는 일 실시예에 따른 GPM에 대한 예시적인 파티션 라인들을 도시한다.

도 15는 본 개시내용의 일부 실시예들에 따른 예시적인 디코딩 프로세스를 약술하는 흐름도를 도시한다.

도 16은 본 개시내용의 일부 실시예들에 따른 예시적인 인코딩 프로세스를 약술하는 흐름도를 도시한다.

도 17은 일 실시예에 따른 컴퓨터 시스템의 개략적 예시이다.

도 3은 통신 시스템(300)의 예시적인 블록도를 예시한다. 통신 시스템(300)은, 예를 들어, 네트워크(350)를 통해, 서로 통신할 수 있는 복수의 단말 디바이스를 포함한다. 예를 들어, 통신 시스템(300)은 네트워크(350)를 통해 상호접속된 제1 쌍의 단말 디바이스들(310 및 320)을 포함한다. 도 3의 예에서, 제1 쌍의 단말 디바이스들(310 및 320)은 데이터의 단방향 송신을 수행한다. 예를 들어, 단말 디바이스(310)는 네트워크(350)를 통해 다른 단말 디바이스(320)로의 송신을 위해 비디오 데이터(예를 들어, 단말 디바이스(310)에 의해 캡처되는 비디오 픽처들의 스트림)를 코딩할 수 있다. 인코딩된 비디오 데이터는 하나 이상의 코딩된 비디오 비트스트림의 형태로 송신될 수 있다. 단말 디바이스(320)는 네트워크(350)로부터 코딩된 비디오 데이터를 수신하고, 코딩된 비디오 데이터를 디코딩하여 비디오 픽처들을 복구하고 복구된 비디오 데이터에 따라 비디오 픽처들을 디스플레이할 수 있다. 단방향 데이터 송신은 미디어 서빙 애플리케이션들 등에서 일반적일 수 있다.

다른 예에서, 통신 시스템(300)은, 예를 들어, 화상회의 동안, 코딩된 비디오 데이터의 양방향 송신을 수행하는 제2 쌍의 단말 디바이스들(330 및 340)을 포함한다. 데이터의 양방향 송신을 위해, 일 예에서, 단말 디바이스들(330 및 340) 중 각각의 단말 디바이스는 네트워크(350)를 통해 단말 디바이스들(330 및 340) 중 다른 단말 디바이스로의 송신을 위해 비디오 데이터(예를 들어, 단말 디바이스에 의해 캡처되는 비디오 픽처들의 스트림)를 코딩할 수 있다. 단말 디바이스들(330 및 340)의 각각의 단말 디바이스는 또한 단말 디바이스들(330 및 340) 중 다른 단말 디바이스에 의해 송신된 코딩된 비디오 데이터를 수신할 수 있고, 코딩된 비디오 데이터를 디코딩하여 비디오 픽처들을 복구할 수 있고 복구된 비디오 데이터에 따라 액세스가능한 디스플레이 디바이스에서 비디오 픽처들을 디스플레이할 수 있다.

도 3의 예에서, 단말 디바이스들(310, 320, 330 및 340)은 각각 서버들, 개인용 컴퓨터들 및 스마트폰들로서 예시되지만, 본 개시내용의 원리들은 그렇게 제한되지 않을 수 있다. 본 개시내용의 실시예들은 랩톱 컴퓨터들, 태블릿 컴퓨터들, 미디어 플레이어들, 및/또는 전용 화상 회의 장비(dedicated video conferencing equipment)를 갖는 애플리케이션을 찾는다. 네트워크(350)는, 예를 들어 유선(와이어링됨) 및/또는 무선 통신 네트워크들을 포함하는, 단말 디바이스들(310, 320, 330 및 340) 중에 코딩된 비디오 데이터를 전달하는 임의의 수의 네트워크들을 표현한다. 통신 네트워크(350)는 회선 교환 및/또는 패킷 교환 채널들에서 데이터를 교환할 수 있다. 대표적인 네트워크들은 전기통신 네트워크들, 로컬 영역 네트워크들, 광역 네트워크들 및/또는 인터넷을 포함한다. 본 논의를 목적으로, 네트워크(350)의 아키텍처 및 토폴로지는 본 명세서에서 아래에 설명되지 않는 한 본 개시내용의 동작에 중요하지 않을 수 있다.

도 4는 개시된 주제에 대한 애플리케이션의 예로서, 스트리밍 환경에서의 비디오 인코더 및 비디오 디코더를 예시한다. 개시된 주제는, 예를 들어, 화상 회의(video conferencing), 디지털 TV, 스트리밍 서비스들, CD, DVD, 메모리 스틱 등을 포함하는 디지털 매체들 상의 압축된 비디오의 저장 등을 포함하는 다른 비디오 가능 애플리케이션들에 동등하게 적용가능할 수 있다.

스트리밍 시스템은, 예를 들어 압축되지 않은 비디오 픽처들의 스트림(402)을 생성하는 비디오 소스(401), 예를 들어 디지털 카메라를 포함할 수 있는, 캡처 서브시스템(413)을 포함할 수 있다. 일 예에서, 비디오 픽처들의 스트림(402)은 디지털 카메라에 의해 촬영되는 샘플들을 포함한다. 인코딩된 비디오 데이터(404)(또는 코딩된 비디오 비트스트림들)와 비교할 때 높은 데이터 볼륨을 강조하기 위해 굵은 선으로 묘사된, 비디오 픽처들의 스트림(402)은, 비디오 소스(401)에 결합된 비디오 인코더(403)를 포함하는 전자 디바이스(420)에 의해 프로세싱될 수 있다. 비디오 인코더(403)는, 아래에서 더 상세히 설명되는 바와 같이 개시된 주제의 양태들을 가능하게 하거나 구현하기 위해 하드웨어, 소프트웨어, 또는 이들의 조합을 포함할 수 있다. 비디오 픽처들의 스트림(402)과 비교할 때 더 낮은 데이터 볼륨을 강조하기 위해 얇은 선으로 묘사된, 인코딩된 비디오 데이터(404)(또는 인코딩된 비디오 비트스트림)는, 향후 사용을 위해 스트리밍 서버(405) 상에 저장될 수 있다. 도 4의 클라이언트 서브시스템들(406 및 408)과 같은 하나 이상의 스트리밍 클라이언트 서브시스템은 스트리밍 서버(405)에 액세스하여 인코딩된 비디오 데이터(404)의 사본들(407 및 409)을 검색할 수 있다. 클라이언트 서브시스템(406)은, 예를 들어, 전자 디바이스(430)에 비디오 디코더(410)를 포함할 수 있다. 비디오 디코더(410)는 인코딩된 비디오 데이터의 착신 사본(407)을 디코딩하고, 디스플레이(412)(예를 들어, 디스플레이 스크린) 또는 다른 렌더링 디바이스(묘사되지 않음) 상에 렌더링될 수 있는 비디오 픽처들의 발신 스트림(411)을 생성한다. 일부 스트리밍 시스템들에서, 인코딩된 비디오 데이터(404, 407 및 409)(예를 들어, 비디오 비트스트림들)는 특정 비디오 코딩/압축 표준들에 따라 인코딩될 수 있다. 그러한 표준들의 예들은 ITU-T 권고안 H.265를 포함한다. 일 예에서, 개발 중인 비디오 코딩 표준은 다목적 비디오 코딩(Versatile Video Coding, VVC)으로서 비공식적으로 알려져 있다. 개시된 주제는 VVC의 컨텍스트에서 사용될 수 있다.

전자 디바이스들(420 및 430)은 다른 컴포넌트들(도시되지 않음)을 포함할 수 있다는 점에 유의한다. 예를 들어, 전자 디바이스(420)는 비디오 디코더(도시되지 않음)를 포함할 수 있고, 전자 디바이스(430)는 또한 비디오 인코더(도시되지 않음)를 포함할 수 있다.

도 5는 비디오 디코더(510)의 예시적인 블록도를 도시한다. 비디오 디코더(510)는 전자 디바이스(530)에 포함될 수 있다. 전자 디바이스(530)는 수신기(531)(예를 들어, 수신 회로)를 포함할 수 있다. 비디오 디코더(510)는 도 4의 예에서의 비디오 디코더(410) 대신에 사용될 수 있다.

수신기(531)는 비디오 디코더(510)에 의해 디코딩될 하나 이상의 코딩된 비디오 시퀀스를 수신할 수 있다. 일 실시예에서, 하나의 코딩된 비디오 시퀀스가 한 번에 수신되고, 여기서 각각의 코딩된 비디오 시퀀스의 디코딩은 다른 코딩된 비디오 시퀀스들의 디코딩과 독립적이다. 코딩된 비디오 시퀀스는, 인코딩된 비디오 데이터를 저장하는 저장 디바이스에 대한 하드웨어/소프트웨어 링크일 수 있는, 채널(501)로부터 수신될 수 있다. 수신기(531)는 인코딩된 비디오 데이터를 다른 데이터, 예를 들어, 코딩된 오디오 데이터 및/또는 보조 데이터 스트림들과 함께 수신할 수 있고, 이들은 그들 각자의 사용 엔티티들(묘사되지 않음)에 포워딩될 수 있다. 수신기(531)는 코딩된 비디오 시퀀스를 다른 데이터로부터 분리할 수 있다. 네트워크 지터(network jitter)를 방지하기 위해, 수신기(531)와 엔트로피 디코더/파서(520)(이하 "파서(520)") 사이에 버퍼 메모리(515)가 결합될 수 있다. 특정 애플리케이션들에서, 버퍼 메모리(515)는 비디오 디코더(510)의 일부이다. 다른 것들에서, 그것은 비디오 디코더(510)의 외부에 있을 수 있다(묘사되지 않음). 또 다른 것들에서, 예를 들어 네트워크 지터를 방지하기 위해, 비디오 디코더(510)의 외부에 버퍼 메모리(묘사되지 않음)가 있을 수 있고, 추가로, 예를 들어 재생 타이밍을 핸들링하기 위해, 비디오 디코더(510) 내부에 다른 버퍼 메모리(515)가 있을 수 있다. 수신기(531)가 충분한 대역폭 및 제어가능성의 저장/포워드 디바이스로부터, 또는 동기식 네트워크(isosynchronous network)로부터 데이터를 수신하고 있을 때, 버퍼 메모리(515)는 필요하지 않을 수 있거나, 작을 수 있다. 인터넷과 같은 최선 노력 패킷 네트워크들(best effort packet networks) 상에서의 사용을 위해, 버퍼 메모리(515)가 요구될 수 있고, 비교적 클 수 있고, 유리하게는 적응적 크기일 수 있고, 비디오 디코더(510) 외부의 운영 체제 또는 유사한 요소들(묘사되지 않음)에서 적어도 부분적으로 구현될 수 있다.

비디오 디코더(510)는 코딩된 비디오 시퀀스로부터 심벌들(521)을 재구성하기 위해 파서(520)를 포함할 수 있다. 그러한 심벌들의 카테고리들은 비디오 디코더(510)의 동작을 관리하기 위해 사용되는 정보, 및 잠재적으로, 도 5에 도시된 바와 같이, 전자 디바이스(530)의 일체 부분은 아니지만 전자 디바이스(530)에 결합될 수 있는 렌더링 디바이스(512)(예를 들어, 디스플레이 스크린)와 같은 렌더링 디바이스를 제어하기 위한 정보를 포함한다. 렌더링 디바이스(들)에 대한 제어 정보는 보충적 향상 정보(Supplemental Enhancement Information, SEI) 메시지들 또는 비디오 사용가능성 정보(Video Usability Information, VUI) 파라미터 세트 프래그먼트들(묘사되지 않음)의 형태일 수 있다. 파서(520)는 수신되는 코딩된 비디오 시퀀스를 파싱/엔트로피 디코딩할 수 있다. 코딩된 비디오 시퀀스의 코딩은 비디오 코딩 기술 또는 표준에 따를 수 있고, 가변 길이 코딩, 허프만 코딩(Huffman coding), 컨텍스트 감도(context sensitivity)를 갖거나 갖지 않는 산술 코딩 등을 포함하는 다양한 원리들을 추종할 수 있다. 파서(520)는, 코딩된 비디오 시퀀스로부터, 그룹에 대응하는 적어도 하나의 파라미터에 기초하여, 비디오 디코더 내의 픽셀들의 서브그룹들 중 적어도 하나에 대한 서브그룹 파라미터들의 세트를 추출할 수 있다. 서브그룹들은 픽처 그룹(Group of Pictures, GOP)들, 픽처들, 타일들, 슬라이스들, 매크로블록들, 코딩 유닛(Coding Unit, CU)들, 블록들, 변환 유닛(Transform Unit, TU)들, 예측 유닛(Prediction Unit, PU)들 등을 포함할 수 있다. 파서(520)는 또한 코딩된 비디오 시퀀스로부터 변환 계수들, 양자화기 파라미터 값들, 모션 벡터들 등과 같은 정보를 추출할 수 있다.

파서(520)는 버퍼 메모리(515)로부터 수신된 비디오 시퀀스에 대해 엔트로피 디코딩/파싱 동작을 수행하여, 심벌들(521)을 생성할 수 있다.

심벌들(521)의 재구성은 코딩된 비디오 픽처 또는 그의 부분들의 타입(예컨대: 인터 및 인트라 픽처, 인터 및 인트라 블록), 및 다른 인자들에 의존하는 다수의 상이한 유닛들을 수반할 수 있다. 어느 유닛들이 수반되는지, 그리고 어떻게 수반되는지는 파서(520)에 의해 코딩된 비디오 시퀀스로부터 파싱된 서브그룹 제어 정보에 의해 제어될 수 있다. 파서(520)와 아래의 다수의 유닛 사이의 그러한 서브그룹 제어 정보의 흐름은 명확성을 위해 묘사되지 않는다.

이미 언급된 기능 블록들 이외에, 비디오 디코더(510)는 아래에서 설명되는 바와 같이 다수의 기능 유닛들로 개념적으로 세분될 수 있다. 상업적 제약들 하에서 동작하는 실제 구현에서, 이러한 유닛들 중 다수는 서로 밀접하게 상호작용하고, 적어도 부분적으로, 서로 통합될 수 있다. 그러나, 개시된 주제를 설명할 목적으로, 아래의 기능 유닛들로의 개념적 세분이 적절하다.

제1 유닛은 스케일러/역변환 유닛(551)이다. 스케일러/역변환 유닛(551)은 파서(520)로부터의 심벌(들)(521)로서, 어느 변환을 사용할지, 블록 크기, 양자화 인자, 양자화 스케일링 행렬들 등을 포함하는 제어 정보뿐만 아니라 양자화된 변환 계수를 수신한다. 스케일러/역변환 유닛(551)은 집계기(555)에 입력될 수 있는 샘플 값들을 포함하는 블록들을 출력할 수 있다.

일부 경우들에서, 스케일러/역변환 유닛(551)의 출력 샘플들은 인트라 코딩된 블록에 관련될 수 있다. 인트라 코딩된 블록은, 이전에 재구성된 픽처들로부터의 예측 정보를 사용하는 것이 아니라, 현재 픽처의 이전에 재구성된 부분들로부터의 예측 정보를 사용할 수 있는 블록이다. 그러한 예측 정보는 인트라 픽처 예측 유닛(552)에 의해 제공될 수 있다. 일부 경우들에서, 인트라 픽처 예측 유닛(552)은 현재 픽처 버퍼(558)로부터 페치(fetch)된 주위의 이미 재구성된 정보를 사용하여, 재구성 중인 블록의 동일한 크기 및 형상의 블록을 생성한다. 현재 픽처 버퍼(558)는, 예를 들어, 부분적으로 재구성된 현재 픽처 및/또는 완전히 재구성된 현재 픽처를 버퍼링한다. 집계기(aggregator)(555)는, 일부 경우들에서, 샘플당 기준으로, 인트라 예측 유닛(552)이 생성한 예측 정보를 스케일러/역변환 유닛(551)에 의해 제공된 출력 샘플 정보에 추가한다.

다른 경우들에서, 스케일러/역변환 유닛(551)의 출력 샘플들은 인터 코딩되고, 잠재적으로 모션 보상된 블록에 관련될 수 있다. 그러한 경우에, 모션 보상 예측 유닛(553)은 참조 픽처 메모리(557)에 액세스하여 예측에 사용되는 샘플들을 페치할 수 있다. 블록에 관련된 심벌들(521)에 따라 페치된 샘플들을 모션 보상한 후에, 이러한 샘플들은 집계기(555)에 의해 스케일러/역변환 유닛(551)의 출력(이 경우 잔차(residual) 샘플들 또는 잔차 신호라고 불림)에 추가되어 출력 샘플 정보를 생성할 수 있다. 모션 보상 예측 유닛(553)이 예측 샘플들을 페치하는 참조 픽처 메모리(557) 내의 어드레스들은, 예를 들어 X, Y, 및 참조 픽처 컴포넌트들을 가질 수 있는 심벌들(521)의 형태로 모션 보상 예측 유닛(553)에 이용가능한, 모션 벡터들에 의해 제어될 수 있다. 모션 보상은 또한 서브샘플 정확한 모션 벡터(sub-sample exact motion vector)들이 사용 중일 때 참조 픽처 메모리(557)로부터 페치된 샘플 값들의 보간, 모션 벡터 예측 메커니즘들 등을 포함할 수 있다.

집계기(555)의 출력 샘플들은 루프 필터 유닛(556) 내의 다양한 루프 필터링 기법들의 대상이 될 수 있다. 비디오 압축 기술들은, 코딩된 비디오 시퀀스(코딩된 비디오 비트스트림이라고도 지칭됨)에 포함되고 파서(520)로부터의 심벌들(521)로서 루프 필터 유닛(556)에 이용가능하게 되는 파라미터들에 의해 제어되는 인-루프 필터(in-loop filter) 기술들을 포함할 수 있다. 비디오 압축은 또한 코딩된 픽처 또는 코딩된 비디오 시퀀스의 이전(디코딩 순서에서) 부분들의 디코딩 동안 획득된 메타 정보에 응답적일 뿐만 아니라, 이전에 재구성되고 루프 필터링된 샘플 값들에 응답적일 수 있다.

루프 필터 유닛(556)의 출력은 렌더링 디바이스(512)에 출력될 뿐만 아니라 향후 인터-픽처 예측에서 사용하기 위해 참조 픽처 메모리(557)에 저장될 수 있는 샘플 스트림일 수 있다.

특정 코딩된 픽처들은, 완전히 재구성되면, 향후 예측을 위한 참조 픽처들로서 사용될 수 있다. 예를 들어, 현재 픽처에 대응하는 코딩된 픽처가 완전히 재구성되고 코딩된 픽처가 참조 픽처로서 식별되면(예를 들어, 파서(520)에 의해), 현재 픽처 버퍼(558)는 참조 픽처 메모리(557)의 일부가 될 수 있고, 후속하는 코딩된 픽처의 재구성을 시작하기 전에 새로운 현재 픽처 버퍼가 재할당될 수 있다.

비디오 디코더(510)는, ITU-T Rec. H.265와 같은 미리 결정된 비디오 압축 기술 또는 표준에 따라 디코딩 동작들을 수행할 수 있다. 코딩된 비디오 시퀀스가 비디오 압축 기술 또는 표준의 신택스(syntax) 및 비디오 압축 기술 또는 표준에 문서화된 프로파일들 둘 다를 고수한다는 점에서, 코딩된 비디오 시퀀스는 사용 중인 비디오 압축 기술 또는 표준에 의해 특정된 신택스에 준수할 수 있다. 구체적으로, 프로파일은 비디오 압축 기술 또는 표준에서 이용가능한 모든 툴들로부터 그 프로파일 하에서 사용하기 위해 이용가능한 유일한 툴들로서 특정 툴들을 선택할 수 있다. 또한 준수를 위해 필요한 것은 코딩된 비디오 시퀀스의 복잡도가 비디오 압축 기술 또는 표준의 레벨에 의해 정의된 경계들 내에 있다는 것일 수 있다. 일부 경우들에서, 레벨들은 최대 픽처 크기, 최대 프레임 레이트, 최대 재구성 샘플 레이트(예를 들어, 초당 메가샘플들로 측정됨), 최대 참조 픽처 크기 등을 제한한다. 레벨들에 의해 설정된 한계들은, 일부 경우들에서, 가상 참조 디코더(Hypothetical Reference Decoder, HRD) 사양들 및 코딩된 비디오 시퀀스에서 시그널링된 HRD 버퍼 관리를 위한 메타데이터를 통해 추가로 제한될 수 있다.

일 실시예에서, 수신기(531)는 인코딩된 비디오와 함께 추가적인(중복) 데이터를 수신할 수 있다. 추가적인 데이터는 코딩된 비디오 시퀀스(들)의 일부로서 포함될 수 있다. 추가적인 데이터는 데이터를 적절하게 디코딩하고/하거나 원래의 비디오 데이터를 더 정확하게 재구성하기 위해 비디오 디코더(510)에 의해 사용될 수 있다. 부가적인 데이터는, 예를 들어, 시간적, 공간적, 또는 신호 잡음비(signal noise ratio, SNR) 향상 계층들, 중복 슬라이스들, 중복 픽처들, 순방향 오류 정정 코드들 등의 형태일 수 있다.

도 6은 비디오 인코더(603)의 예시적인 블록도를 도시한다. 비디오 인코더(603)는 전자 디바이스(620)에 포함된다. 전자 디바이스(620)는 송신기(640)(예를 들어, 송신 회로)를 포함한다. 비디오 인코더(603)는 도 4의 예에서의 비디오 인코더(403) 대신에 사용될 수 있다.

비디오 인코더(603)는 비디오 인코더(603)에 의해 코딩될 비디오 이미지(들)를 캡처할 수 있는 비디오 소스(601)(도 6의 예에서 전자 디바이스(620)의 일부가 아님)로부터 비디오 샘플들을 수신할 수 있다. 다른 예에서, 비디오 소스(601)는 전자 디바이스(620)의 일부이다.

비디오 소스(601)는 임의의 적합한 비트 심도(예를 들어: 8 비트, 10 비트, 12 비트, …), 임의의 색공간(예를 들어, BT.601 Y CrCB, RGB, …), 및 임의의 적합한 샘플링 구조(예를 들어, Y CrCb 4:2:0, Y CrCb 4:4:4)일 수 있는 디지털 비디오 샘플 스트림의 형태로 비디오 인코더(603)에 의해 코딩될 소스 비디오 시퀀스를 제공할 수 있다. 미디어 서빙 시스템에서, 비디오 소스(601)는 이전에 준비된 비디오를 저장하는 저장 디바이스일 수 있다. 화상회의 시스템에서, 비디오 소스(601)는 비디오 시퀀스로서 로컬 이미지 정보를 캡처하는 카메라일 수 있다. 비디오 데이터는 순차적으로 볼 때 모션을 부여하는 복수의 개별 픽처로서 제공될 수 있다. 픽처들 자체는 픽셀들의 공간적 어레이로서 조직될 수 있고, 여기서 각각의 픽셀은 사용 중인 샘플링 구조, 색 공간 등에 의존하는 하나 이상의 샘플을 포함할 수 있다. 본 기술분야의 통상의 기술자는 픽셀들과 샘플들 사이의 관계를 쉽게 이해할 수 있다. 아래의 설명은 샘플들에 초점을 맞춘다.

일 실시예에 따르면, 비디오 인코더(603)는 소스 비디오 시퀀스의 픽처들을 실시간으로 또는 필요에 따라 임의의 다른 시간 제약들 하에서 코딩된 비디오 시퀀스(643)로 코딩 및 압축할 수 있다. 적절한 코딩 속도를 시행하는 것은 제어기(650)의 하나의 기능이다. 일부 실시예들에서, 제어기(650)는 아래에 설명되는 바와 같이 다른 기능 유닛들을 제어하고 다른 기능 유닛들에 기능적으로 결합된다. 결합은 명확성을 위해 묘사되지 않는다. 제어기(650)에 의해 설정된 파라미터들은 레이트 제어 관련 파라미터들(픽처 스킵, 양자화기, 레이트 왜곡 최적화 기법들의 람다 값, …), 픽처 크기, 픽처 그룹(GOP) 레이아웃, 최대 모션 벡터 탐색 범위 등을 포함할 수 있다. 제어기(650)는 특정 시스템 설계에 최적화된 비디오 인코더(603)에 관련된 다른 적합한 기능들을 갖도록 구성될 수 있다.

일부 실시예들에서, 비디오 인코더(603)는 코딩 루프에서 동작하도록 구성된다. 과도하게 단순화된 설명으로서, 일 예에서, 코딩 루프는 소스 코더(630)(예를 들어, 코딩될 입력 픽처, 및 참조 픽처(들)에 기초하여, 심벌 스트림과 같은, 심벌들을 생성하는 것을 담당함), 및 비디오 인코더(603)에 임베딩된 (로컬) 디코더(633)를 포함할 수 있다. 디코더(633)는 (원격) 디코더가 또한 생성하는 것과 유사한 방식으로 샘플 데이터를 생성하기 위해 심벌들을 재구성한다. 재구성된 샘플 스트림(샘플 데이터)은 참조 픽처 메모리(634)에 입력된다. 심벌 스트림의 디코딩이, 디코더 위치(로컬 또는 원격)와는 독립적으로 비트-정확한 결과들(bit-exact results)로 이어지기 때문에, 참조 픽처 메모리(634) 내의 콘텐츠 또한 로컬 인코더와 원격 인코더 사이에서 비트 정확(bit exact)하다. 다시 말해서, 인코더의 예측 부분은, 디코딩 동안 예측을 사용할 때 디코더가 "보는" 것과 정확히 동일한 샘플 값들을 참조 픽처 샘플들로서 "본다". 참조 픽처 동기성의 이러한 기본 원리(그리고 예를 들어, 채널 오류들 때문에 동기성이 유지될 수 없는 경우, 결과적인 드리프트)는 일부 관련 기술들에서도 사용된다.

"로컬" 디코더(633)의 동작은 비디오 디코더(510)와 같은 "원격" 디코더의 동작과 동일할 수 있고, 이는 도 5와 관련하여 위에서 이미 상세히 설명되었다. 그러나, 또한 도 5를 간략히 참조하면, 심벌들이 이용가능하고 엔트로피 코더(645) 및 파서(520)에 의한 코딩된 비디오 시퀀스로의 심벌들의 인코딩/디코딩이 무손실일 수 있기 때문에, 버퍼 메모리(515), 및 파서(520)를 포함하는, 비디오 디코더(510)의 엔트로피 디코딩 부분들은 로컬 디코더(633)에서 완전히 구현되지 않을 수 있다.

일 실시예에서, 디코더에 존재하는 파싱/엔트로피 디코딩을 제외한 디코더 기술은, 대응하는 인코더에 동일하거나 실질적으로 동일한 기능 형태로 존재한다. 따라서, 개시된 주제는 디코더 동작에 초점을 맞춘다. 인코더 기술들의 설명은 포괄적으로 설명된 디코더 기술들의 반대이기 때문에 축약될 수 있다. 특정 영역들에서, 더 상세한 설명이 아래에 제공된다.

동작 동안, 일부 예들에서, 소스 코더(630)는, "참조 픽처들"로서 지정된 비디오 시퀀스로부터의 하나 이상의 이전에 코딩된 픽처를 참조하여 예측적으로 입력 픽처를 코딩하는, 모션 보상된 예측 코딩을 수행할 수 있다. 이러한 방식으로, 코딩 엔진(632)은 입력 픽처의 픽셀 블록들과 입력 픽처에 대한 예측 참조(들)로서 선택될 수 있는 참조 픽처(들)의 픽셀 블록들 사이의 차이들을 코딩한다.

로컬 비디오 디코더(633)는, 소스 코더(630)에 의해 생성된 심벌들에 기초하여, 참조 픽처들로서 지정될 수 있는 픽처들의 코딩된 비디오 데이터를 디코딩할 수 있다. 코딩 엔진(632)의 동작들은 유리하게는 손실 프로세스들일 수 있다. 코딩된 비디오 데이터가 비디오 디코더(도 6에 도시되지 않음)에서 디코딩될 수 있을 때, 재구성된 비디오 시퀀스는 전형적으로 일부 오류들을 갖는 소스 비디오 시퀀스의 복제본(replica)일 수 있다. 로컬 비디오 디코더(633)는 참조 픽처들에 대해 비디오 디코더에 의해 수행될 수 있고 재구성된 참조 픽처들로 하여금 참조 픽처 메모리(634)에 저장되게 할 수 있는 디코딩 프로세스들을 복제한다. 이러한 방식으로, 비디오 인코더(603)는 (송신 오류들 없이) 원단(far-end) 비디오 디코더에 의해 획득될 재구성된 참조 픽처들로서 공통 콘텐츠를 갖는 재구성된 참조 픽처들의 사본들을 로컬로 저장할 수 있다.

예측기(635)는 코딩 엔진(632)에 대한 예측 탐색들을 수행할 수 있다. 즉, 코딩될 새로운 픽처에 대해, 예측기(635)는, 새로운 픽처들에 대한 적절한 예측 참조로서 역할을 할 수 있는 참조 픽처 모션 벡터들, 블록 형상들 등과 같은 특정 메타데이터 또는 샘플 데이터(후보 참조 픽셀 블록들로서)에 대한 참조 픽처 메모리(634)를 탐색할 수 있다. 예측기(635)는 적절한 예측 참조들을 찾기 위해 샘플 블록-바이-픽셀 블록(sample block-by-pixel block) 기준으로 동작할 수 있다. 일부 경우들에서, 예측기(635)에 의해 획득된 탐색 결과들에 의해 결정되는 바와 같이, 입력 픽처는 참조 픽처 메모리(634)에 저장된 다수의 참조 픽처들로부터 도출된 예측 참조들을 가질 수 있다.

제어기(650)는, 예를 들어, 비디오 데이터를 인코딩하기 위해 사용되는 파라미터들 및 서브그룹 파라미터들의 설정을 포함하여, 소스 코더(630)의 코딩 동작들을 관리할 수 있다.

전술한 모든 기능 유닛들의 출력은 엔트로피 코더(645)에서 엔트로피 코딩의 대상이 될 수 있다. 엔트로피 코더(645)는 허프만 코딩, 가변 길이 코딩, 산술 코딩 등과 같은 기술들에 따라 심벌들에 무손실 압축을 적용함으로써, 다양한 기능 유닛들에 의해 생성된 심벌들을 코딩된 비디오 시퀀스로 변환한다.

송신기(640)는, 엔트로피 코더(645)에 의해 생성된 코딩된 비디오 시퀀스(들)를 버퍼링하여, 인코딩된 비디오 데이터를 저장할 저장 디바이스로의 하드웨어/소프트웨어 링크일 수 있는, 통신 채널(660)을 통한 송신을 준비할 수 있다. 송신기(640)는 비디오 인코더(603)로부터의 코딩된 비디오 데이터를 송신될 다른 데이터, 예를 들어, 코딩된 오디오 데이터 및/또는 보조 데이터 스트림들(소스들이 도시되지 않음)과 병합할 수 있다.

제어기(650)는 비디오 인코더(603)의 동작을 관리할 수 있다. 코딩 동안, 제어기(650)는, 각자의 픽처에 적용될 수 있는 코딩 기법들에 영향을 미칠 수 있는, 특정 코딩된 픽처 타입을 각각의 코딩된 픽처에 배정할 수 있다. 예를 들어, 픽처들은 종종 다음의 픽처 타입들 중 하나로서 배정될 수 있다:

인트라 픽처(Intra Picture)(I 픽처)는 예측의 소스로서 시퀀스 내의 임의의 다른 픽처를 사용하지 않고 코딩 및 디코딩될 수 있는 것일 수 있다. 일부 비디오 코덱들은, 예를 들어, 독립적 디코더 리프레시(Independent Decoder Refresh)("IDR") 픽처들을 포함하는, 상이한 타입들의 인트라 픽처들을 허용한다. 본 기술분야의 통상의 기술자는 I 픽처들의 그러한 변형들 및 그들 각자의 애플리케이션들 및 특징들을 알고 있다.

예측 픽처(predictive picture)(P 픽처)는 각각의 블록의 샘플 값들을 예측하기 위해 많아야 하나의 모션 벡터 및 참조 인덱스를 사용하는 인트라 예측 또는 인터 예측을 사용하여 코딩 및 디코딩될 수 있는 것일 수 있다.

양방향 예측 픽처(bi-directionally predictive picture)(B 픽처)는 각각의 블록의 샘플 값들을 예측하기 위해 많아야 2개의 모션 벡터 및 참조 인덱스를 사용하는 인트라 예측 또는 인터 예측을 사용하여 코딩 및 디코딩될 수 있는 것일 수 있다. 유사하게, 다수의 예측 픽처는 단일 블록의 재구성을 위해 2개보다 많은 참조 픽처들 및 연관된 메타데이터를 사용할 수 있다.

소스 픽처들은 일반적으로 복수의 샘플 블록(예를 들어, 각각 4x4, 8x8, 4x8, 또는 16x16 샘플들의 블록들)으로 공간적으로 세분되고 블록-바이-블록(block-by-block) 기반으로 코딩될 수 있다. 블록들은 블록들의 각자의 픽처들에 적용되는 코딩 배정에 의해 결정되는 다른(이미 코딩된) 블록들을 참조하여 예측적으로 코딩될 수 있다. 예를 들어, I 픽처들의 블록들은 비예측적으로 코딩될 수 있거나 또는 이들은 동일한 픽처의 이미 코딩된 블록들을 참조하여 예측적으로 코딩될 수 있다(공간적 예측 또는 인트라 예측). P 픽처들의 픽셀 블록들은, 하나의 이전에 코딩된 참조 픽처를 참조하여 공간적 예측을 통해 또는 시간적 예측을 통해 예측적으로 코딩될 수 있다. B 픽처들의 블록들은, 하나 또는 2개의 이전에 코딩된 참조 픽처를 참조하여 공간적 예측을 통해 또는 시간적 예측을 통해 예측적으로 코딩될 수 있다.

비디오 인코더(603)는, ITU-T Rec. H.265와 같은 미리 결정된 비디오 코딩 기술 또는 표준에 따라 코딩 동작들을 수행할 수 있다. 그것의 동작에서, 비디오 인코더(603)는, 입력 비디오 시퀀스에서 시간적 및 공간적 중복성들을 이용하는 예측 코딩 동작들을 포함하는 다양한 압축 동작들을 수행할 수 있다. 따라서, 코딩된 비디오 데이터는, 사용중인 비디오 코딩 기술 또는 표준에 의해 특정된 신택스를 준수할 수 있다.

일 실시예에서, 송신기(640)는 인코딩된 비디오와 함께 추가 데이터를 송신할 수 있다. 소스 코더(630)는 코딩된 비디오 시퀀스의 일부로서 그러한 데이터를 포함할 수 있다. 추가적인 데이터는 시간적/공간적/SNR 향상 계층들, 중복 픽처들 및 슬라이스들과 같은 다른 형태들의 중복 데이터, SEI 메시지들, VUI 파라미터 세트 프래그먼트들 등을 포함할 수 있다.

비디오는 시간적 시퀀스에서 복수의 소스 픽처들(비디오 픽처들)로서 캡처될 수 있다. 인트라-픽처 예측(종종 인트라 예측으로 축약됨)은 주어진 픽처에서 공간적 상관관계를 사용하고, 인터-픽처 예측은 픽처들 사이의 (시간적 또는 다른) 상관관계를 사용한다. 일 예에서, 현재 픽처라고 지칭되는, 인코딩/디코딩 중인 특정 픽처가 블록들로 파티셔닝된다. 현재 픽처 내의 블록이 비디오 내의 이전에 코딩되고 여전히 버퍼링된 참조 픽처 내의 참조 블록과 유사할 때, 현재 픽처 내의 블록은 모션 벡터라고 지칭되는 벡터에 의해 코딩될 수 있다. 모션 벡터는 참조 픽처 내의 참조 블록을 가리키고, 다수의 참조 픽처가 사용 중인 경우에, 참조 픽처를 식별하는 제3 차원을 가질 수 있다.

일부 실시예들에서, 인터-픽처 예측에서 양방향 예측 기법이 사용될 수 있다. 양방향 예측 기법에 따르면, 둘 다 비디오에서의 현재 픽처보다 디코딩 순서에서 앞서는(그러나, 디스플레이 순서에서, 각각 과거 및 미래에 있을 수 있는) 제1 참조 픽처 및 제2 참조 픽처와 같은 2개의 참조 픽처가 사용된다. 현재 픽처 내의 블록은 제1 참조 픽처 내의 제1 참조 블록을 가리키는 제1 모션 벡터, 및 제2 참조 픽처 내의 제2 참조 블록을 가리키는 제2 모션 벡터에 의해 코딩될 수 있다. 블록은 제1 참조 블록과 제2 참조 블록의 조합에 의해 예측될 수 있다.

추가로, 코딩 효율을 개선하기 위해 인터-픽처 예측에서 병합 모드 기법이 사용될 수 있다.

본 개시내용의 일부 실시예들에 따르면, 인터-픽처 예측들 및 인트라-픽처 예측들과 같은 예측들이 블록들의 유닛으로 수행된다. 예를 들어, HEVC 표준에 따르면, 비디오 픽처들의 시퀀스 내의 픽처는 압축을 위해 코딩 트리 유닛(coding tree unit, CTU)들로 파티셔닝되고, 픽처 내의 CTU들은 64x64 픽셀들, 32x32 픽셀들, 또는 16x16 픽셀들과 같은 동일한 크기를 갖는다. 일반적으로, CTU는 3개의 코딩 트리 블록(coding tree block, CTB)을 포함하고, 이는 하나의 루마(luma) CTB 및 2개의 크로마(chroma) CTB이다. 각각의 CTU는 하나 또는 다수의 코딩 유닛(CU)로 재귀적 쿼드트리 분할될 수 있다. 예를 들어, 64x64 픽셀들의 CTU는 64x64 픽셀들의 하나의 CU, 또는 32x32 픽셀들의 4개의 CU, 또는 16x16 픽셀들의 16개의 CU로 분할될 수 있다. 일 예에서, 각각의 CU는 인터 예측 타입 또는 인트라 예측 타입과 같은 CU에 대한 예측 타입을 결정하기 위해 분석된다. CU는 시간적 및/또는 공간적 예측가능성에 따라 하나 이상의 예측 유닛(PU)으로 분할된다. 일반적으로, 각각의 PU는 루마 예측 블록(PB) 및 2개의 크로마 PB를 포함한다. 일 실시예에서, 코딩(인코딩/디코딩)에서의 예측 동작은 예측 블록의 유닛으로 수행된다. 예측 블록의 예로서 루마 예측 블록을 사용하면, 예측 블록은 8x8 픽셀들, 16x16 픽셀들, 8x16 픽셀들, 16x8 픽셀들 등과 같은 픽셀들에 대한 값들(예를 들어, 루마 값들)의 행렬을 포함한다.

도 7은 비디오 인코더(703)의 예시적인 도면을 도시한다. 비디오 인코더(703)는 비디오 픽처들의 시퀀스에서 현재 비디오 픽처 내의 샘플 값들의 프로세싱 블록(예를 들어, 예측 블록)을 수신하고, 프로세싱 블록을 코딩된 비디오 시퀀스의 일부인 코딩된 픽처로 인코딩하도록 구성된다. 일 예에서, 비디오 인코더(703)는 도 4의 예에서의 비디오 인코더(403) 대신에 사용된다.

HEVC 예에서, 비디오 인코더(703)는, 8x8 샘플들의 예측 블록 등과 같은 프로세싱 블록에 대한 샘플 값들의 행렬 등을 수신한다. 비디오 인코더(703)는 프로세싱 블록이, 예를 들어, 레이트 왜곡 최적화를 사용하여 인트라 모드, 인터 모드, 또는 양방향 예측 모드 중 어느 것을 사용하여 최선으로 코딩되는지를 결정한다. 프로세싱 블록이 인트라 모드로 코딩될 때, 비디오 인코더(703)는 인트라 예측 기법을 사용하여 프로세싱 블록을 코딩된 픽처로 인코딩할 수 있고; 프로세싱 블록이 인터 모드 또는 양방향 예측 모드로 코딩될 때, 비디오 인코더(703)는 인터 예측 또는 양방향 예측 기법을 각각 사용하여 프로세싱 블록을 코딩된 픽처로 인코딩할 수 있다. 특정 비디오 코딩 기술들에서, 병합 모드는 예측기들 외부의 코딩된 모션 벡터 성분의 혜택 없이 모션 벡터가 하나 이상의 모션 벡터 예측기로부터 도출되는 인터 픽처 예측 서브모드일 수 있다. 특정 다른 비디오 코딩 기술들에서, 대상 블록에 적용가능한 모션 벡터 컴포넌트가 존재할 수 있다. 일 예에서, 비디오 인코더(703)는 프로세싱 블록들의 모드를 결정하기 위한 모드 결정 모듈(도시되지 않음)과 같은 다른 컴포넌트들을 포함한다.

도 7의 예에서, 비디오 인코더(703)는 도 7에 도시된 바와 같이 함께 결합된 인터 인코더(730), 인트라 인코더(722), 잔차 계산기(723), 스위치(726), 잔차 인코더(724), 일반 제어기(721), 및 엔트로피 인코더(725)를 포함한다.

인터 인코더(730)는 현재 블록(예를 들어, 프로세싱 블록)의 샘플들을 수신하고, 블록을 참조 픽처들 내의 하나 이상의 참조 블록(예를 들어, 이전 픽처들 및 나중 픽처들 내의 블록들)과 비교하고, 인터 예측 정보(예를 들어, 인터 인코딩 기법에 따른 중복 정보의 설명, 모션 벡터들, 병합 모드 정보)를 생성하고, 임의의 적합한 기법을 사용하여 인터 예측 정보에 기초하여 인터 예측 결과들(예를 들어, 예측된 블록)을 계산하도록 구성된다. 일부 예들에서, 참조 픽처들은 인코딩된 비디오 정보에 기초하여 디코딩되는 디코딩된 참조 픽처들이다.

인트라 인코더(722)는 현재 블록(예를 들어, 프로세싱 블록)의 샘플들을 수신하고, 일부 경우들에서 블록을 동일한 픽처에서 이미 코딩된 블록들과 비교하고, 변환 후 양자화된 계수들을 생성하고, 일부 경우들에서 또한 인트라 예측 정보(예를 들어, 하나 이상의 인트라 인코딩 기법에 따른 인트라 예측 방향 정보)를 생성하도록 구성된다. 일 예에서, 인트라 인코더(722)는 또한 동일한 픽처 내의 인트라 예측 정보 및 참조 블록들에 기초하여 인트라 예측 결과들(예를 들어, 예측된 블록)을 계산한다.

일반 제어기(721)는 일반 제어 데이터를 결정하고 일반 제어 데이터에 기초하여 비디오 인코더(703)의 다른 컴포넌트들을 제어하도록 구성된다. 일 예에서, 일반 제어기(721)는 블록의 모드를 결정하고, 모드에 기초하여 스위치(726)에 제어 신호를 제공한다. 예를 들어, 모드가 인트라 모드일 때, 일반 제어기(721)는 잔차 계산기(723)에 의한 사용을 위해 인트라 모드 결과를 선택하도록 스위치(726)를 제어하고, 인트라 예측 정보를 선택하고 인트라 예측 정보를 비트스트림에 포함시키도록 엔트로피 인코더(725)를 제어하고; 모드가 인터 모드일 때, 일반 제어기(721)는 잔차 계산기(723)에 의한 사용을 위해 인터 예측 결과를 선택하도록 스위치(726)를 제어하고, 인터 예측 정보를 선택하고 인터 예측 정보를 비트스트림에 포함시키도록 엔트로피 인코더(725)를 제어한다.

잔차 계산기(723)는 수신된 블록과 인트라 인코더(722) 또는 인터 인코더(730)로부터 선택된 예측 결과들 사이의 차이(잔차 데이터)를 계산하도록 구성된다. 잔차 인코더(724)는 잔차 데이터에 기초하여 동작하여 잔차 데이터를 인코딩하여 변환 계수들을 생성하도록 구성된다. 일 예에서, 잔차 인코더(724)는 잔차 데이터를 공간적 도메인으로부터 주파수 도메인으로 변환하고, 변환 계수들을 생성하도록 구성된다. 그 후 변환 계수들은 양자화 프로세싱의 대상이 되어 양자화된 변환 계수들을 획득한다. 다양한 실시예들에서, 비디오 인코더(703)는 또한 잔차 디코더(728)를 포함한다. 잔차 디코더(728)는 역변환을 수행하고, 디코딩된 잔차 데이터를 생성하도록 구성된다. 디코딩된 잔차 데이터는 인트라 인코더(722) 및 인터 인코더(730)에 의해 적합하게 사용될 수 있다. 예를 들어, 인터 인코더(730)는 디코딩된 잔차 데이터 및 인터 예측 정보에 기초하여 디코딩된 블록들을 생성할 수 있고, 인트라 인코더(722)는 디코딩된 잔차 데이터 및 인트라 예측 정보에 기초하여 디코딩된 블록들을 생성할 수 있다. 디코딩된 블록들은 디코딩된 픽처들을 생성하기 위해 적절하게 프로세싱되고, 디코딩된 픽처들은 메모리 회로(도시되지 않음)에 버퍼링되어 일부 예들에서 참조 픽처들로서 사용될 수 있다.

엔트로피 인코더(725)는 인코딩된 블록을 포함하도록 비트스트림을 포맷하도록 구성된다. 엔트로피 인코더(725)는 HEVC 표준과 같은 적절한 표준에 따라 다양한 정보를 비트스트림에 포함시키도록 구성된다. 일 예에서, 엔트로피 인코더(725)는 일반 제어 데이터, 선택된 예측 정보(예를 들어, 인트라 예측 정보 또는 인터 예측 정보), 잔차 정보, 및 다른 적합한 정보를 비트스트림에 포함시키도록 구성된다. 개시된 주제에 따르면, 인터 모드 또는 양방향 예측 모드 중 어느 하나의 병합 서브모드에서 블록을 코딩할 때, 잔차 정보가 없다는 점에 유의한다.

도 8은 비디오 디코더(810)의 예시적인 도면을 도시한다. 비디오 디코더(810)는 코딩된 비디오 시퀀스의 일부인 코딩된 픽처들을 수신하고, 코딩된 픽처들을 디코딩하여 재구성된 픽처들을 생성하도록 구성된다. 일 예에서, 비디오 디코더(810)는 도 4의 예에서의 비디오 디코더(410) 대신에 사용된다.

도 8의 예에서, 비디오 디코더(810)는 도 8에 도시된 바와 같이 함께 결합된 엔트로피 디코더(871), 인터 디코더(880), 잔차 디코더(873), 재구성 모듈(874), 및 인트라 디코더(872)를 포함한다.

엔트로피 디코더(871)는, 코딩된 픽처로부터, 코딩된 픽처가 구성되는 신택스 요소들을 표현하는 특정 심벌들을 재구성하도록 구성될 수 있다. 이러한 심벌들은, 예를 들어, 블록이 코딩되는 모드(예를 들어, 인트라 모드, 인터 모드, 양방향 예측 모드, 병합 서브모드 또는 다른 서브모드에서 후자 두 개와 같은) 및 인트라 디코더(872) 또는 인터 디코더(880) 각각에 의한 예측에 사용되는 특정 샘플 또는 메타데이터를 식별할 수 있는 예측 정보(예를 들어, 인트라 예측 정보 또는 인터 예측 정보와 같은)를 포함할 수 있다. 심벌들은 또한, 예를 들어, 양자화된 변환 계수들 등의 형태의 잔차 정보를 포함할 수 있다. 일 예에서, 예측 모드가 인터 또는 양방향 예측 모드일 때, 인터 예측 정보는 인터 디코더(880)에 제공되고; 예측 타입이 인트라 예측 타입일 때, 인트라 예측 정보는 인트라 디코더(872)에 제공된다. 잔차 정보는 역양자화의 대상이 될 수 있고 이는 잔차 디코더(873)에 제공된다.

인터 디코더(880)는 인터 예측 정보를 수신하고, 인터 예측 정보에 기초하여 인터 예측 결과들을 생성하도록 구성된다.

인트라 디코더(872)는 인트라 예측 정보를 수신하고, 인트라 예측 정보에 기초하여 예측 결과들을 생성하도록 구성된다.

잔차 디코더(873)는 역양자화(inverse quantization)를 수행하여 탈양자화(de-quantized)된 변환 계수들을 추출하고, 탈양자화된 변환 계수들을 프로세싱하여 잔차 정보를 주파수 도메인으로부터 공간적 도메인으로 전환하도록 구성된다. 잔차 디코더(873)는 또한 (양자화기 파라미터(Quantizer Parameter, QP)를 포함하도록) 특정 제어 정보를 요구할 수 있고, 그 정보는 엔트로피 디코더(871)에 의해 제공될 수 있다(이는 단지 저용량 제어 정보일 수 있기 때문에 데이터 경로가 묘사되지 않음).

재구성 모듈(874)은, 공간적 도메인에서, 잔차 디코더(873)에 의해 출력된 잔차 정보와 예측 결과들(경우에 따라 인터 또는 인트라 예측 모듈들에 의해 출력된 것)을 조합하여 재구성된 블록을 형성하도록 구성되고, 재구성된 블록은 재구성된 픽처의 일부일 수 있고, 재구성된 픽처는 결국 재구성된 비디오의 일부일 수 있다. 시각적 품질을 개선하기 위해, 디블록킹 동작 등과 같은 다른 적합한 동작들이 수행될 수 있다는 점에 유의한다.

비디오 인코더들(403, 603, 및 703), 및 비디오 디코더들(410, 510, 및 810)은 임의의 적합한 기법을 사용하여 구현될 수 있다는 점에 유의한다. 일 실시예에서, 비디오 인코더들(403, 603, 및 703), 및 비디오 디코더들(410, 510, 및 810)은 하나 이상의 집적 회로를 사용하여 구현될 수 있다. 다른 실시예에서, 비디오 인코더들(403, 603, 및 603), 및 비디오 디코더들(410, 510, 및 810)은 소프트웨어 명령어들을 실행하는 하나 이상의 프로세서를 사용하여 구현될 수 있다.

본 개시내용은, 인트라 블록 복사(IBC)를 이용하는 기하학적 파티션 모드(GPM), 예컨대, IBC의 BV 정보를 시그널링하고, 프로세싱하고, 저장하는 것, 및 IBC를 이용하는 GPM의 BV 병합 후보 리스트를 핸들링하는 것에 관련된 실시예들을 포함한다.

ITU-T VCEG(Q6/16) 및 ISO/IEC MPEG(JTC 1/SC 29/WG 11)는 2013년(버전 1), 2014년(버전 2), 2015년(버전 3), 및 2016년(버전 4)에 H.265/HEVC(High Efficiency Video Coding) 표준을 발표했다. 2015년에, 두 표준 조직은 HEVC를 넘어서는 다음 비디오 코딩 표준을 개발할 가능성을 탐구하기 위해 JVET(Joint Video Exploration Team)를 공동으로 구성했다. 2017년 10월에, 2개의 표준 조직은 HEVC를 넘어서는 능력을 갖는 비디오 압축에 대한 제안들을 위한 공동 호출(Call for Proposal, CfP)을 발행하였다. 2018년 2월 15일까지, 표준 동적 범위(standard dynamic range, SDR)에 대한 22개의 CfP 응답, 높은 동적 범위(high dynamic range, HDR)에 대한 12개의 CfP 응답, 및 360개의 비디오 카테고리에 대한 12개의 CfP 응답이 각각 제출되었다. 2018년 4월에, 수신된 모든 CfP 응답들은 122 MPEG/10차 JVET 미팅에서 평가되었다. 이 미팅의 결과로서, JVET는 HEVC를 넘어서 차세대 비디오 코딩의 표준화 프로세스를 공식적으로 론칭하였고, 새로운 표준은 다목적 비디오 코딩(Versatile Video Coding, VVC)으로 명명되었고, JVET는 공동 비디오 전문가 팀(Joint Video Experts Team)으로 재명명되었다. 2020년에, ITU-T VCEG(Q6/16) 및 ISO/IEC MPEG(JTC 1/SC 29/WG 11)는 VVC 비디오 코딩 표준(버전 1)을 발표했다.

인터 예측에서, 각각의 인터-예측된 코딩 유닛(CU)에 대해, 모션 파라미터들은, 예를 들어, 인터-예측된 샘플 생성에 사용될 VVC의 코딩 특징들에 대해 요구된다. 모션 파라미터들은 모션 벡터들, 참조 픽처 인덱스들, 참조 픽처 리스트 사용 인덱스, 및/또는 추가 정보를 포함할 수 있다. 모션 파라미터들은 명시적 또는 암시적 방식으로 시그널링될 수 있다. CU가 스킵 모드로 코딩될 때, CU는 하나의 PU와 연관될 수 있고, 유효 잔차 계수(significant residual coefficient), 코딩된 모션 벡터 델타, 및/또는 참조 픽처 인덱스가 요구되지 않을 수 있다. CU가 병합 모드로 코딩될 때, CU에 대한 모션 파라미터들은 이웃 CU들로부터 획득될 수 있다. 이웃 CU들은 공간적 및 시간적 후보들, 및 VVC에 도입된 것과 같은 추가적인 스케줄들(또는 추가적인 후보들)을 포함할 수 있다. 병합 모드는 스킵 모드뿐만 아니라 임의의 인터-예측된 CU에 적용될 수 있다. 병합 모드에 대한 대안은 모션 파라미터들의 명시적 송신이며, 여기서 모션 벡터, 각각의 참조 픽처 리스트에 대한 대응하는 참조 픽처 인덱스, 참조 픽처 리스트 사용 플래그, 및/또는 다른 필요한 정보는 CU마다 명시적으로 시그널링될 수 있다.

VVC에서, VVC 테스트 모델(VTM) 참조 소프트웨어는 다음 중 하나 이상을 포함할 수 있는 다수의 새롭고 정교화된 인터 예측 코딩 툴을 포함할 수 있다:

(1) 확장된 병합 예측

(2) 병합 모션 벡터 차이(merge motion vector difference, MMVD)

(3) 대칭 MVD 시그널링을 이용하는 AMVP 모드

(4) 아핀 모션 보상 예측

(5) 서브블록 기반 시간적 모션 벡터 예측(subblock-based temporal motion vector prediction, SbTMVP)

(6) 적응적 모션 벡터 해상도(adaptive motion vector resolution, AMVR)

(7) 모션 필드 저장: 1/16번째 루마 샘플 MV 저장 및 8x8 모션 필드 압축

(8) CU 레벨 가중치들을 이용하는 양방향 예측(bi-prediction with CU-level weights, BCW)

(9) 양방향 광학 흐름(bi-directional optical flow, BDOF)

(10) 디코더 측 모션 벡터 정교화(decoder side motion vector refinement, DMVR)

(11) 조합된 인터 및 인트라 예측(combined inter and intra prediction, CIIP)

(12) 기하학적 파티셔닝 모드(GPM)

병합 후보 리스트는 VTM 4에서와 같이 5개 타입의 후보를 포함함으로써 구성될 수 있다. 병합 후보 리스트는 다음과 같은 순서로 구성될 수 있다:

1)

공간적 이웃 CU들로부터의 공간적 MVP,

2)

병치된 CU들로부터의 시간적 MVP,

3)

FIFO 테이블로부터의 이력 기반 MVP,

4)

쌍별(pairwise) 평균 MVP, 및

5)

제로 MV들.

병합 리스트의 크기는 슬라이스 헤더에서 시그널링될 수 있다. 병합 리스트의 최대 허용 크기는 VTM 4에서와 같이 6일 수 있다. 병합 모드로 코딩된 각각의 CU에 대해, 최선의 병합 후보의 인덱스는, 예를 들어 절단된 단항 이진화(truncated unary binarization)를 사용하여 인코딩될 수 있다. 병합 인덱스의 제1 빈(bin)이 컨텍스트(context)로 코딩될 수 있고 바이패스 코딩이 다른 빈들에 대해 사용될 수 있다.

공간적 후보 도출에서, 예를 들어 VVC에서, 공간적 병합 후보들의 도출은 HEVC에서의 공간적 병합 후보들의 도출과 동일하거나 유사할 수 있다. 예를 들어, 도 9에 예시된 포지션들에 위치된 후보들 중에서 최대 수의 병합 후보들(예를 들어, 4개의 병합 후보)이 선택될 수 있다. 도 9에 도시된 바와 같이, 현재 블록(901)은 포지션들 A0, A1, B0, B1, 및 B2에 각각 위치된 이웃 블록들(902-906)을 포함할 수 있다. 공간적 병합 후보들의 도출 순서는 B1, A1, B0, A0, 및 B2일 수 있다. 포지션 B2는 포지션 A0, B0, B1, 또는 A1에서의 임의의 CU(또는 블록)가 이용가능하지 않거나(예를 들어, CU가 다른 슬라이스 또는 타일에 속하기 때문에) 인트라 코딩될 때에만 고려될 수 있다. 포지션 A1에서의 후보(또는 블록)가 추가된 후에, 나머지 후보들(또는 블록들)의 추가는 중복 검사의 대상이 될 수 있다. 중복 검사는 코딩 효율이 개선되도록 동일한 모션 정보를 갖는 후보들이 병합 리스트로부터 배제되는 것을 보장할 수 있다. 계산 복잡도를 감소시키기 위해, 중복 검사는 모든 가능한 후보 쌍들을 고려하지 않을 수 있다. 대신에, 도 10에서 화살표로 링크된 후보 쌍들만이 고려될 수 있다. 예를 들어, 중복 검사는, A1 및 B1의 후보 쌍 및 A1 및 A0의 후보 쌍과 같은 5개의 후보 쌍에 적용될 수 있다. 중복 검사에 사용되는 대응하는 후보가 동일한 모션 정보를 포함하지 않는 경우에만 후보가 병합 리스트에 추가될 수 있다. 예를 들어, 후보 B0은, 대응하는 후보 B1이 동일한 모션 정보를 포함하지 않는 경우에만 병합 리스트에 추가될 수 있다.

시간적 후보 도출에서, 하나의 후보만이 병합 리스트에 추가될 수 있다. 예를 들어, 도 11에 도시된 바와 같이, 현재 CU(1114)에 대한 시간적 병합 후보의 도출에서, 스케일링된 모션 벡터는 병치된 참조 픽처(1112)에 속하는 병치된 CU(1104)에 기초하여 도출될 수 있다. 공동 위치된 CU(1104)의 도출에 사용되는 참조 픽처 리스트는 슬라이스 헤더에서 명시적으로 시그널링될 수 있다. 시간적 병합 후보에 대한 스케일링된 모션 벡터는, 픽처 순서 카운트(picture order count, POC) 거리들 tb 및 td를 사용하여 공동 위치된 CU(1104)의 모션 벡터로부터 스케일링되는, 도 11에서의 점선(1102)에 의해 예시된 바와 같이 획득될 수 있다. tb는 현재 픽처(예를 들어, Curr_ref)(1106)의 참조 픽처와 현재 픽처(예를 들어, Curr_pic)(1108) 사이의 POC 차이로서 정의될 수 있다. td는 공동 위치된 픽처(예를 들어, Col_ref)(1110)의 참조 픽처와 공동 위치된 픽처(예를 들어, Col_pic)(1112) 사이의 POC 차이로서 정의될 수 있다. 시간적 병합 후보의 참조 픽처 인덱스는 0과 동일하게 설정될 수 있다.

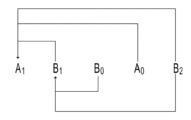

시간적 후보에 대한 포지션은, 도 12에 도시된 바와 같이 후보들 C0과 C1 사이에서 선택될 수 있다. 예를 들어, 포지션 C0에서의 CU가 이용가능하지 않거나, 인트라 코딩되거나, CTU들의 현재 행 외부에 있는 경우, 포지션 C1이 사용될 수 있다. 그렇지 않으면, 포지션 C0은 시간적 병합 후보의 도출에 사용될 수 있다.

GPM은 인터 예측에 적용될 수 있다. GPM은 특정 크기들의 CU들, 예를 들어 8x8의 크기 또는 8x8보다 큰 크기를 갖는 CU들에만 적용될 수 있다. GPM은, 예를 들어 CU 레벨 플래그를 사용하여 시그널링될 수 있고, 한 종류의 병합 모드로서 작용할 수 있다. 다른 병합 모드들은 정규 병합 모드, MMVD 모드, CIIP 모드, 및/또는 서브블록 병합 모드를 포함할 수 있다.

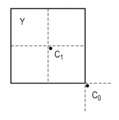

GPM이 사용될 때, CU는 복수의 파티션 방식 중 하나를 사용하여 2개의 기하학적 형상의 파티션으로 분할될 수 있다. 파티셔닝 방식들은 각도들 및/또는 에지들에 의해 구별될 수 있다. 일 실시예에서, 64개의 상이한 파티셔닝 방식이 GPM에서 적용될 수 있다. 64개의 상이한 파티셔닝 방식은 CU의 중심에 대해 최대 4개의 에지 및 0과 360°사이에서 불균일하게 양자화되는 24개의 각도에 의해 구별될 수 있다. 도 13은 GPM에 적용된 24개의 예시적인 각도를 도시한다. 도 14는 CU(1402)에서 3의 인덱스를 갖는 각도와 연관된 4개의 예시적인 가능한 파티션 에지를 도시하며, 여기서 파티션 에지들 각각은 각자의 거리 인덱스와 연관될 수 있다. 거리 인덱스는 CU(1402)의 중심에 대한 거리를 나타낼 수 있다. GPM에서, CU 내의 각각의 기하학적 파티션은 각자의 모션 벡터를 사용하여 인터-예측될 수 있다. 또한, 각각의 파티션에 대해 단방향 예측만이 허용될 수 있다. 예를 들어, 각각의 파티션은 하나의 모션 벡터 및 하나의 참조 인덱스를 가질 수 있다. 각각의 파티션에 대해 단방향 예측 모션만이 허용된다는 제약은 각각의 CU에 대해 2개의 모션 보상된 예측만이 필요하다는 것을 보장할 수 있으며, 이는 또한 종래의 양방향 예측에 적용된다.

GPM이 현재 CU에 대해 사용되는 경우, 기하학적 파티션 인덱스, 및 2개의 병합 인덱스(각각의 파티션에 대해 하나씩)를 나타내는 신호가 추가로 시그널링될 수 있다. 최대 GPM 후보 크기는, 예를 들어 슬라이스 레벨에서 명시적으로 시그널링될 수 있다. 최대 GPM 후보 크기는 GPM 병합 인덱스들에 대한 신택스 이진화를 특정할 수 있다. 2개의 기하학적 파티션 각각이 예측된 후에, 기하학적 파티션 에지를 따르는 샘플 값들은 적응적 가중치들을 갖는 블렌딩 프로세스를 사용하여 조정될 수 있다. 전체 CU에 대한 예측 신호는 블렌딩 프로세스 후에 그에 따라 생성될 수 있다. 변환 및 양자화 프로세스는 다른 예측 모드들에서 전체 CU에 추가로 적용될 수 있다. 또한, GPM을 사용하여 예측되는 CU의 모션 필드가 저장될 수 있다.

IBC의 구현 비용은 현재 픽처의 이미 재구성된 영역 전체에 대해 높을 수 있다. 예를 들어, HEVC에서의 IBC 개념의 단점은 디코딩된 픽처 버터(decoded picture butter, DPB)에서 추가적인 메모리의 필요성이다. 따라서, IBC의 하드웨어 구현에서 외부 메모리가 통상적으로 이용된다. 추가적인 외부 메모리 액세스는 증가된 메모리 대역폭을 수반할 수 있다.

특정 구현들에서 구현 비용을 감소시키는 것이 필요할 수 있다. 예를 들어, VVC는 메모리 대역폭 요건 및 하드웨어 복잡성을 상당히 감소시키기 위해 온-칩(on-chip) 메모리를 사용함으로써 IBC를 실현할 수 있는 고정 메모리를 사용할 수 있다. 더욱이, IBC의 블록 벡터(BV) 코딩은 인터 예측을 위해 병합 리스트의 개념을 이용할 수 있다. IBC 리스트 구성 프로세스는 2개의 공간적 이웃의 BV들 및 5개의 이력 기반 BV(history-based BV, HBVP)를 고려할 수 있으며, 여기서 제1 HBVP가 후보 리스트(또는 IBC 리스트)에 추가될 때 제1 HBVP만이 공간적 후보들(예를 들어, 2개의 공간적 후보의 BV들)과 비교될 수 있다.

VVC에서와 같이 압축 효율을 추가로 개선하기 위해, 디코더 측에서 모션을 정교화하는 템플릿 매칭(template matching, TM)이 활용될 수 있다. TM 모드에서, 좌측 및 위의 이웃하는 재구성된 샘플들로부터 템플릿을 구성함으로써 모션이 정교화되고, 현재 픽처 내의 템플릿과 참조 프레임 사이에서 가장 가까운 매칭이 결정될 수 있다.

TM은 GPM에 적용될 수 있다. CU가 GPM으로 코딩될 때, TM이 기하학적 파티션에 대한 각각의 모션을 정교화하기 위해 적용되는지가 결정될 수 있다. TM이 선택될 때, 템플릿은 좌측 및 위의 이웃 샘플들을 사용하여 구성될 수 있고, 모션은 현재 템플릿과 참조 프레임내의 동일한 템플릿 패턴을 갖는 참조 영역 사이의 최선의 매칭을 발견함으로써 추가로 정교화될 수 있다. 정교화된 모션은 기하학적 파티션에 대한 모션 보상을 수행하기 위해 사용될 수 있고, 모션 필드에 추가로 저장될 수 있다.

GPM은 인터 및 인트라 예측을 지원하기 위해 적용되어 VVC를 넘어 코딩 성능을 향상시킬 수 있다. 예를 들어, 기하학적 파티션 라인에 대한(또는 그에 관한) 미리 정의된 인트라 예측 모드들은 GPM-적용된 CU 내의 각각의 기하학적 파티션에 대한 병합 후보 리스트로부터의 모션 벡터들에 더하여 선택될 수 있다. 플래그에 기초하여 각각의 기하학적 파티션에 대해 인트라 예측 모드 또는 인터 예측 모드가 결정될 수 있다. 인터 예측이 선택될 때, 단방향 예측 신호가 병합 후보 리스트로부터 MV들에 의해 생성될 수 있다. 그렇지 않고, 인트라 예측 모드가 선택되는 경우, 인트라 예측 모드의 특정된 인덱스로부터 예측되는 이웃 샘플들로부터 단방향 예측 신호가 생성될 수 있다. 가능한 인트라 예측 모드들의 변동은 기하학적 형상들에 의해 제한될 수 있다. 마지막으로, 2개의 단방향 예측 신호는 통상의 GPM과 동일한 방식으로 블렌딩될 수 있다.

복잡도 및 시그널링 오버헤드를 감소시키기 위해, 가능한 인트라 예측 모드들의 변동이 연구(또는 정의)될 수 있다. 예를 들어, 인터 및 인트라 예측을 갖는 GPM에 대한 가능한 인트라 예측 모드들의 변동의 영향이 2개의 예시적인 구성에 대해 연구되었다. 제1 구성은 기하학적 파티션 라인에 대하여(또는 그에 관하여) 평행 및 수직 인트라 방향성 모드들만을 시도했다. 기하학적 파티션 라인에 대한(또는 그에 관한) 평행 및 수직 인트라 각도 모드들에 더하여, 제2 구성에서 평면 모드도 테스트되었다. 2개 또는 3개의 가능한 인트라 예측 모드가 인터 및 인트라 예측으로 GPM에서의 기하학적 파티션에 대해 테스트되었다.

템플릿 기반 인트라 모드 도출(template-based intra mode derivation, TIMD)에서, 예를 들어 JVET-V0098에서, MPM들에서의 각각의 인트라 모드에 대해, 현재 CU의 템플릿 영역의 예측 및 재구성 샘플들 사이의 절대 변환된 차이들의 합(sum of absolute transformed differences, SATD)이 계산될 수 있고, 가장 작은 SATD 비용을 갖는 인트라 모드가 현재 CU에 대해 선택될 수 있다. 가장 작은 SATD 비용을 갖는 단 하나의 인트라 모드를 선택하는 대신에, 예를 들어 JVET-W0123에서, TIMD로 도출되는 가장 작은 SATD 비용들을 갖는 처음 2개의 모드가 또한 현재 CU에 대해 선택될 수 있다. 2개의 선택된 모드는 가중치들과 추가로 융합될 수 있고, 가중된 인트라 예측은 현재 CU에 대한 인트라 예측기로서 사용될 수 있다. 2개의 선택된 모드에서, 가장 작은 SATD 비용을 갖는 선택된 인트라 모드의 비용이 다른 선택된 인트라 모드의 비용의 절반 값보다 큰 경우, 융합이 적용될 수 있다. 그렇지 않으면, 가장 작은 SATD 비용을 갖는 인트라 모드만이 선택될 수 있다. 융합이 적용되는 경우, 가중치 값은 2개의 모드의 SATD 비용들로부터 도출될 수 있다.

본 개시내용에서, IBC 및 인트라 예측 모드를 갖는 GPM은 IBC 및 인트라 예측 모드에 대해 각각 생성되는 2개의 기하학적 파티션을 조합하기 위해 제공될 수 있다.

코딩 효율을 개선하기 위해, 인터 예측을 갖는 CU 내의 인트라 모드들(예를 들어, MODE_INTER 예측 모드)의 사용은, 예를 들어 JVET-W0123에서, CU의 이웃 블록의 MPM 도출을 위한 이웃 인트라 정보로서 저장되고 전파될 수 있다. 그러나, IBC를 갖는 CU 내의 인트라 모드의 사용은 또한 IBC 블록이 IBC 및 인트라를 갖는 GPM으로서 인코딩될 때 MPM 도출을 위한 이웃 인트라 정보로서 저장되고 전파될 수 있다.

본 개시내용에서, IBC 및 인트라 예측을 갖는 GPM의 인트라 예측 모드 정보가 저장될 수 있다. 예를 들어, 현재 블록은 제1 파티션 및 제2 파티션으로 파티셔닝될 수 있다. 제1 파티션은 IBC 코딩될 수 있고 제2 파티션은 인트라 코딩될 수 있다. 제2 파티션을 예측하기 위해 적용되는 인트라 예측 모드와 같은, 제2 파티션의 인트라 예측 모드 정보가 저장될 수 있다. 저장된 인트라 모드 정보는 현재의 이웃 블록의 예측 모드가 IBC일 때 이웃 인트라 모드 정보로서 추가로 사용될 수 있다. 따라서, 저장된 인트라 모드 정보는 IBC 코딩된 이웃 블록에 대한 전파된 인트라 모드로서 사용될 수 있다. 이웃 블록이 블록의 참조 블록일 때, 저장된 인트라 예측 모드 정보로부터 블록에 대한 인트라 모드가 도출될 수 있다. 저장된 인트라 예측 모드 정보는 또한 IBC 및 인트라를 갖는 GPM으로서 인코딩되는 현재 블록의 MPM 도출에 적용될 수 있다.

일 실시예에서, IBC 및 인트라를 갖는 GPM에 대한 인트라 예측 모드 정보는 현재 블록의 N×N 유닛들(예를 들어, 4×4 샘플 유닛들)에 저장될 수 있다. 예를 들어, 현재 블록은 복수의 NxN 유닛으로 분할될 수 있다. 복수의 NxN 유닛 각각에 대한 인트라 예측 모드 정보는 대응하는 메모리 유닛들(또는 셀들)에 저장될 수 있다.

일 실시예에서, 평면 모드 또는 CU(또는 현재 블록)에서 인트라 예측을 갖는 기하학적 파티션에 사용되는 선택된 인트라 모드는 각각의 기하학적 파티션에 대해 현재 블록의 N×N 유닛들(예를 들어, 4×4 유닛들)에 저장될 수 있다. 일 예에서, GPM에 기초한 현재 블록의 기하학적 파티션이 IBC로 생성되는 경우(또는 기하학적 파티션이 IBC에 기초하여 예측되는 경우), 평면 모드는 기하학적 파티션의 대응하는 N×N 유닛들(예를 들어, 4×4 유닛들)에 저장될 수 있다. 따라서, IBC로 생성되는 기하학적 파티션 내의 N×N 유닛들에 대해, 평면 모드는 기하학적 파티션에 포지셔닝된 N×N 유닛들 각각에 대해 저장될 수 있다. 다른 예에서, GPM에 기초한 현재 블록의 기하학적 파티션이 인트라 예측으로 생성될 때, 인코딩된 인트라 모드(또는 기하학적 파티션을 예측하기 위해 적용되는 인트라 모드)는 기하학적 파티션의 대응하는 N×N 유닛들(예를 들어, 4×4 유닛들)에 저장될 수 있다. 따라서, 인트라 예측으로 생성되는 기하학적 파티션에 포지셔닝된 NxN 유닛들에 대해, 인코딩된 인트라 모드는 기하학적 파티션에 포지셔닝된 NxN 유닛들 각각에 대해 저장될 수 있다. 인코딩된 인트라 모드는 DC 모드, 평면 모드, 또는 각도 모드일 수 있다. 또 다른 예에서, GPM에 기초한 현재 블록의 기하학적 경계를 따르는(또는 가로지르는) N×N 유닛들에 대해, 현재 블록에서의 인트라 예측을 갖는 기하학적 파티션에 사용되는 인코딩된 인트라 모드가 기하학적 경계를 따르는 N×N 유닛들에 대해 저장될 수 있다. 따라서, 제1 파티션이 IBC 코딩되고 제2 파티션이 인트라 코딩되는 현재 블록의 기하학적 경계를 가로지르는 NxN 유닛에 대해, 제2 파티션을 예측하기 위해 적용되는 인트라 모드가 저장될 수 있다.

다른 실시예에서, CU가 IBC 및 인트라 모드를 갖는 GPM으로 인코딩될 때 CU(또는 현재 블록) 내의 모든 NxN 유닛들(예를 들어, 4x4 유닛들)에 대해 DC 모드가 저장될 수 있다. 따라서, DC 모드는 현재 블록 내의 N×N 유닛들 각각에 대해 저장될 수 있다. 대응하는 NxN 유닛은 IBC로 코딩된 파티션에, 인트라 모드로 코딩된 파티션에, 또는 IBC로 코딩된 파티션 및 인트라 모드로 코딩된 파티션의 기하형상(geometry) 경계를 따라 포지셔닝될 수 있다.

다른 실시예에서, 평면 모드는 CU가 IBC 및 인트라 모드를 이용하여 GPM에서 인코딩될 때 CU 내의 모든 NxN 유닛들(예를 들어, 4x4 유닛들)에 대해 저장될 수 있다. NxN 유닛들 각각은 IBC로 코딩된 파티션에, 인트라 모드로 코딩된 파티션에, 또는 IBC로 코딩된 파티션 및 인트라 모드로 코딩된 파티션의 기하형상 경계를 따라 포지셔닝될 수 있다.

또 다른 실시예에서, CU 내의 모든 NxN 유닛들(예를 들어, 4x4 유닛들)에 대해 CU 내의 인트라 예측을 갖는 기하학적 파티션에 사용되는 선택된 인트라 모드만이 저장될 수 있다. CU는 IBC 및 인트라 모드를 이용하여 GPM에서 인코딩될 수 있다. 선택된 인트라 모드는 DC 모드, 평면 모드, 또는 IBC 및 인트라 모드를 이용하여 GPM에서 인코딩된 CU의 기하학적 파티션을 예측하기 위해 적용되는 각도 모드일 수 있다. 따라서, CU 내의 NxN 유닛들 각각에 대해, 선택된 인트라 모드는 대응하는 NxN 유닛에 대해 저장될 수 있다. 대응하는 NxN 유닛은 IBC로 코딩된 파티션에, 인트라 모드로 코딩된 파티션에, 또는 IBC로 코딩된 파티션 및 인트라 모드로 코딩된 파티션의 기하형상 경계를 따라 포지셔닝될 수 있다.

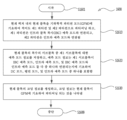

도 15는 본 개시내용의 일부 실시예들에 따른 예시적인 디코딩 프로세스(1500)를 약술하는 흐름도를 도시한다. 도 16은 본 개시내용의 일부 실시예들에 따른 예시적인 인코딩 프로세스(1600)를 약술하는 흐름도를 도시한다. 제안된 프로세스들은 개별적으로 사용되거나 임의의 순서로 조합될 수 있다. 또한, 각각의 프로세스들(또는 실시예들), 인코더, 및 디코더는 프로세싱 회로(예를 들어, 하나 이상의 프로세서 또는 하나 이상의 집적 회로)에 의해 구현될 수 있다. 일 예에서, 하나 이상의 프로세서는 비일시적 컴퓨터 판독가능 매체에 저장되는 프로그램을 실행한다.

프로세스들(예를 들어, (1500) 및 (1600))의 동작들은 원하는 대로 임의의 양 또는 순서로 조합 또는 배열될 수 있다. 실시예들에서, 프로세스들(예를 들어, (1500) 및 (1600))의 동작들 중 2개 이상은 병렬로 수행될 수 있다.

프로세스들(예를 들어, (1500) 및 (1600))은 재구성 중인 블록에 대한 예측 블록을 생성하기 위해, 블록의 재구성 및/또는 인코딩에서 사용될 수 있다. 다양한 실시예들에서, 프로세스들(예를 들어, (1500) 및 (1600))은 단말 디바이스들(310), (320), (330) 및 (340) 내의 프로세싱 회로, 비디오 인코더(403)의 기능들을 수행하는 프로세싱 회로, 비디오 디코더(410)의 기능들을 수행하는 프로세싱 회로, 비디오 디코더(510)의 기능들을 수행하는 프로세싱 회로, 비디오 인코더(603)의 기능들을 수행하는 프로세싱 회로 등과 같은 프로세싱 회로에 의해 실행된다. 일부 실시예들에서, 프로세스들(예를 들어, (1500) 및 (1600))은 소프트웨어 명령어들로 구현되고, 따라서 프로세싱 회로가 소프트웨어 명령어들을 실행할 때, 프로세싱 회로는 프로세스들(예를 들어, (1500) 및 (1600))을 수행한다.

도 15에 도시된 바와 같이, 프로세스(1500)는 (S1501)로부터 시작하여 (S1510)로 진행할 수 있다. (S1510)에서, 비디오의 현재 픽처 내의 현재 블록의 코딩된 정보가 코딩된 비디오 비트스트림으로부터 수신될 수 있다. 코딩된 정보는 현재 블록이 기하학적 파티션 모드(GPM)에 기초하여 적어도 제1 파티션 및 제2 파티션으로 파티셔닝되는 것을 나타낼 수 있다. 제1 파티션은 인트라 블록 복사(IBC) 예측 모드와 연관될 수 있고, 제2 파티션은 인트라 예측 모드와 연관될 수 있다.

(S1520)에서, 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보가 저장될 수 있다. 예측 모드 정보는 제1 서브블록이 IBC 예측 모드, 인트라 예측 모드, 및 IBC 예측 모드와 인트라 예측 모드 둘 다 중 하나와 연관되는지에 기초하여 DC 모드, 평면 모드, 및 인트라 예측 모드 중 하나를 포함할 수 있다.

프로세스(1500)에서, 저장된 예측 모드 정보를 사용하여 현재 블록의 이웃 블록에 대한 최고 확률 모드(MPM) 도출이 수행될 수 있다.

일부 실시예들에서, 제1 서브블록이 IBC 예측 모드와 연관되는 것에 기초하여, 예측 모드 정보를 저장하는 단계는 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보에 평면 모드만을 저장하는 단계를 포함할 수 있다.

일부 실시예들에서, 제1 서브블록이 인트라 예측 모드와 연관되는 것에 기초하여, 예측 모드 정보를 저장하는 단계는 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보에 인트라 예측 모드만을 저장하는 단계를 포함할 수 있다.

일부 실시예들에서, 제1 서브블록이 IBC 예측 모드 및 인트라 예측 모드 둘 다와 연관되는 것에 기초하여, 예측 모드 정보를 저장하는 단계는 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보에 인트라 예측 모드만을 저장하는 단계를 포함할 수 있다.

일 실시예에서, DC 모드는 현재 블록의 제1 파티션이 IBC 예측 모드와 연관되는 것, 및 현재 블록의 제2 파티션이 인트라 예측 모드와 연관되는 것에 기초하여 현재 블록의 복수의 서브블록 각각에 대해 저장될 수 있다.

일 실시예에서, 평면 모드는 현재 블록의 제1 파티션이 IBC 예측 모드와 연관되는 것, 및 현재 블록의 제2 파티션이 인트라 예측 모드와 연관되는 것에 기초하여 현재 블록의 복수의 서브블록들 각각에 대해 저장될 수 있다.

일 실시예에서, 인트라 예측 모드는 현재 블록의 제1 파티션이 IBC 예측 모드와 연관되는 것, 및 현재 블록의 제2 파티션이 인트라 예측 모드와 연관되는 것에 기초하여 현재 블록의 복수의 서브블록 각각에 대해 저장될 수 있다.

일부 실시예들에서, 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보는 현재 블록의 이웃 블록의 MPM 도출을 위한 전파된 인트라 모드일 수 있고, 이웃 블록은 IBC 예측 모드에 의해 예측된다.

일부 실시예들에서, 현재 블록의 복수의 서브블록들 각각은 각자의 4 x 4 픽셀 유닛일 수 있다.

(S1520) 후에, 프로세스는 (S1599)로 진행하고 종료한다.

프로세스(1500)는 적합하게 적응될 수 있다. 프로세스(1500)에서의 단계(들)는 수정 및/또는 생략될 수 있다. 추가적인 단계(들)가 추가될 수 있다. 구현의 임의의 적합한 순서가 사용될 수 있다.

도 16에 도시된 바와 같이, 프로세스(1600)는 (S1601)로부터 시작하여 (S1610)로 진행할 수 있다. (S1610)에서, 현재 픽처 내의 현재 블록은 기하학적 파티션 모드(GPM)에 기초하여 적어도 제1 파티션 및 제2 파티션으로 파티셔닝될 수 있다. 제1 파티션은 인트라 블록 복사(IBC) 예측 모드와 연관될 수 있고, 제2 파티션은 인트라 예측 모드와 연관될 수 있다.

(S1620)에서, 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보가 저장될 수 있다. 예측 모드 정보는 제1 서브블록이 IBC 예측 모드, 인트라 예측 모드, 및 IBC 예측 모드와 인트라 예측 모드 둘 다 중 하나와 연관되는지에 기초하여 DC 모드, 평면 모드, 및 인트라 예측 모드 중 하나를 포함할 수 있다.

(S1630)에서, 현재 블록의 코딩 정보가 생성될 수 있다. 코딩 정보는 현재 블록이 GPM에 기초하여 파티셔닝된다는 것을 나타낼 수 있다.

그 후, 프로세스는 (S1699)으로 진행하여 종료한다.

프로세스(1600)는 적합하게 적응될 수 있다. 프로세스(1600)에서의 단계(들)는 수정 및/또는 생략될 수 있다. 추가적인 단계(들)가 추가될 수 있다. 구현의 임의의 적합한 순서가 사용될 수 있다.

위에서 설명된 기법들은 컴퓨터 판독가능 명령어들을 사용하여 컴퓨터 소프트웨어로서 구현되고 하나 이상의 컴퓨터 판독가능 매체에 물리적으로 저장될 수 있다. 예를 들어, 도 17은 개시된 주제의 특정 실시예들을 구현하기에 적합한 컴퓨터 시스템(1700)을 도시한다.

컴퓨터 소프트웨어는, 하나 이상의 컴퓨터 중앙 프로세싱 유닛(CPU), 그래픽 프로세싱 유닛(GPU) 등에 의해 직접, 또는 해석(interpretation), 마이크로 코드 실행 등을 통해 실행될 수 있는 명령어들을 포함하는 코드를 생성하기 위한 어셈블리, 컴파일(compilation), 링킹(linking), 또는 유사한 메커니즘들의 대상이 될 수 있는 임의의 적합한 머신 코드 또는 컴퓨터 언어를 사용하여 코딩될 수 있다.

명령어들은, 예를 들어, 개인용 컴퓨터들, 태블릿 컴퓨터들, 서버들, 스마트폰들, 게임 디바이스들, 사물 인터넷 디바이스들 등을 포함하는, 다양한 타입들의 컴퓨터들 또는 그 컴포넌트들 상에서 실행될 수 있다.

컴퓨터 시스템(1700)에 대한 도 17에 도시된 컴포넌트들은 본질적으로 예시적인 것이고, 본 개시내용의 실시예들을 구현하는 컴퓨터 소프트웨어의 사용 또는 기능성의 범위에 대한 임의의 제한을 암시하도록 의도되지 않는다. 컴포넌트들의 구성이 컴퓨터 시스템(1700)의 예시적인 실시예에 예시된 컴포넌트들 중 임의의 하나 또는 이들의 조합과 관련하여 임의의 종속성 또는 요건을 갖는 것으로서 해석되어서도 안된다.

컴퓨터 시스템(1700)은 특정 인간 인터페이스 입력 디바이스들을 포함할 수 있다. 그러한 인간 인터페이스 입력 디바이스는, 예를 들어, 촉각 입력(예컨대: 키스트로크들(keystrokes), 스와이프들(swipes), 데이터 글러브 움직임들(data glove movements)), 오디오 입력(예컨대: 음성, 박수), 시각 입력(예컨대: 제스처들), 후각 입력(묘사되지 않음)을 통한, 하나 이상의 인간 사용자에 의한 입력에 응답적일 수 있다. 인간 인터페이스 디바이스들은 또한 오디오(예컨대: 스피치, 음악, 주변 사운드), 이미지들(예컨대: 스캐닝된 이미지들, 정지 이미지 카메라로부터 획득된 사진 이미지들), 비디오(예컨대 2차원 비디오, 입체적(stereoscopic) 비디오를 포함하는 3차원 비디오)와 같은, 인간에 의한 의식적인 입력에 반드시 직접 관련되지는 않는 특정 매체들을 캡처하는 데 사용될 수 있다.

입력 인간 인터페이스 디바이스들은: 키보드(1701), 마우스(1702), 트랙패드(1703), 터치 스크린(1710), 데이터-글러브(도시되지 않음), 조이스틱(1705), 마이크로폰(1706), 스캐너(1707), 카메라(1708) 중 하나 이상(각각의 하나만이 묘사됨)을 포함할 수 있다.

컴퓨터 시스템(1700)은 또한 특정 인간 인터페이스 출력 디바이스들을 포함할 수 있다. 그러한 인간 인터페이스 출력 디바이스들은, 예를 들어, 촉각 출력, 사운드, 광, 및 냄새/맛을 통해 하나 이상의 인간 사용자들의 감각들을 자극하는 것일 수 있다. 그러한 인간 인터페이스 출력 디바이스들은 촉각 출력 디바이스들(예를 들어, 터치-스크린(1710), 데이터-글러브(도시되지 않음), 또는 조이스틱(1705)에 의한 촉각 피드백이지만, 입력 디바이스들로서 역할하지 않는 촉각 피드백 디바이스들도 있을 수 있음), 오디오 출력 디바이스들(예컨대: 스피커들(1709), 헤드폰들(묘사되지 않음)), 시각적 출력 디바이스들(예컨대: 각각 터치-스크린 입력 능력이 있거나 없고, 각각 촉각 피드백 능력이 있거나 없는, CRT 스크린들, LCD 스크린들, 플라즈마 스크린들, OLED 스크린들을 포함하는 스크린들(1710)- 이들 중 일부는 스테레오그래픽 출력; 가상 현실 안경(묘사되지 않음), 홀로그래픽 디스플레이들 및 연기 탱크들(묘사되지 않음)과 같은 수단을 통해 2차원 시각적 출력 또는 3차원 초과의 출력을 출력할 수 있음 -), 및 프린터들(묘사되지 않음)을 포함할 수 있다.

컴퓨터 시스템(1700)은 인간 액세스가능 저장 디바이스들 및 그들의 연관된 매체들, 예컨대 CD/DVD 또는 유사 매체(1721)를 갖는 CD/DVD ROM/RW(1720)를 포함하는 광학 매체들, 썸 드라이브(thumb-drive)(1722), 이동식 하드 드라이브 또는 솔리드 스테이트 드라이브(1723), 테이프 및 플로피 디스크(묘사되지 않음)와 같은 레거시 자기 매체들(legacy magnetic media), 보안 동글들(묘사되지 않음)과 같은 특수화된 ROM/ASIC/PLD 기반 디바이스들 등을 또한 포함할 수 있다.

본 기술분야의 통상의 기술자들은 또한 현재 개시된 주제와 관련하여 사용되는 바와 같은 "컴퓨터 판독가능 매체"라는 용어가 송신 매체들, 반송파들, 또는 다른 일시적 신호들을 포괄하지 않는다는 것을 이해해야 한다.

컴퓨터 시스템(1700)은 또한 하나 이상의 통신 네트워크(1755)에 대한 인터페이스(1754)를 포함할 수 있다. 네트워크들은, 예를 들어, 무선, 유선, 광학일 수 있다. 네트워크들은 추가로 로컬, 광역, 대도시, 차량 및 산업, 실시간, 지연 용인(delay-tolerant) 등일 수 있다. 네트워크들의 예들은 이더넷, 무선 LAN들과 같은 로컬 영역 네트워크들, GSM, 3G, 4G, 5G, LTE 등을 포함하는 셀룰러 네트워크들, 케이블 TV, 위성 TV, 및 지상파 방송 TV를 포함하는 TV 유선 또는 무선 광역 디지털 네트워크들, CANBus를 포함하는 차량 및 산업 등을 포함한다. 특정 네트워크들은 일반적으로 특정 범용 데이터 포트들 또는 주변 버스들(1749)(예컨대, 예를 들어, 컴퓨터 시스템(1700)의 USB 포트들)에 부착되는 외부 네트워크 인터페이스 어댑터들을 요구하고; 다른 것들은 일반적으로 아래에 설명되는 바와 같은 시스템 버스에의 부착에 의해 컴퓨터 시스템(1700)의 코어에 통합된다(예를 들어, PC 컴퓨터 시스템으로의 이더넷 인터페이스 또는 스마트폰 컴퓨터 시스템으로의 셀룰러 네트워크 인터페이스). 이러한 네트워크들 중 임의의 것을 사용하여, 컴퓨터 시스템(1700)은 다른 엔티티들과 통신할 수 있다. 그러한 통신은 단방향성 수신 전용(예를 들어, 방송 TV), 단방향성 전송 전용(예를 들어, 특정 CANbus 디바이스들로의 CANbus), 또는, 예를 들어, 로컬 영역 또는 광역 디지털 네트워크들을 사용하는 다른 컴퓨터 시스템들에 대한 양방향성일 수 있다. 특정 프로토콜들 및 프로토콜 스택들은 위에서 설명한 바와 같이 그러한 네트워크들 및 네트워크 인터페이스들 각각에서 사용될 수 있다.

전술한 인간 인터페이스 디바이스들, 인간 액세스가능 저장 디바이스들, 및 네트워크 인터페이스들은 컴퓨터 시스템(1700)의 코어(1740)에 부착될 수 있다.

코어(1740)는 하나 이상의 중앙 프로세싱 유닛(CPU)(1741), 그래픽 프로세싱 유닛(GPU)(1742), 필드 프로그래머블 게이트 영역(FPGA)(1743)의 형태로 특수화된 프로그래밍가능 프로세싱 유닛들, 특정 태스크들에 대한 하드웨어 가속기들(1744), 그래픽 어댑터들(1750) 등을 포함할 수 있다. 이러한 디바이스들은, 판독 전용 메모리(ROM)(1745), 랜덤 액세스 메모리(1746), 내부 비사용자 액세스가능 하드 드라이브들, SSD들 등과 같은 내부 대용량 저장소(1747)와 함께, 시스템 버스(1748)를 통해 접속될 수 있다. 일부 컴퓨터 시스템들에서, 시스템 버스(1748)는 추가적인 CPU들, GPU 등에 의한 확장들을 가능하게 하기 위해 하나 이상의 물리적 플러그의 형태로 액세스가능할 수 있다. 주변 디바이스들은 코어의 시스템 버스(1748)에 직접, 또는 주변 버스(1749)를 통해 부착될 수 있다. 일 예에서, 스크린(1710)은 그래픽 어댑터(1750)에 접속될 수 있다. 주변 버스를 위한 아키텍처들은 PCI, USB 등을 포함한다.

CPU들(1741), GPU들(1742), FPGA들(1743), 및 가속기들(1744)은, 조합하여, 전술한 컴퓨터 코드를 구성할 수 있는 특정 명령어들을 실행할 수 있다. 그 컴퓨터 코드는 ROM(1745) 또는 RAM(1746)에 저장될 수 있다. 과도기적 데이터가 또한 RAM(1746)에 저장될 수 있는 반면, 영구적 데이터는, 예를 들어, 내부 대용량 저장소(1747)에 저장될 수 있다. 메모리 디바이스들 중 임의의 것에 대한 고속 저장 및 검색은, 하나 이상의 CPU(1741), GPU(1742), 대용량 저장소(1747), ROM(1745), RAM(1746) 등과 밀접하게 연관될 수 있는 캐시 메모리의 사용을 통해 가능하게 될 수 있다.

컴퓨터 판독가능 매체는 다양한 컴퓨터 구현 동작들을 수행하기 위한 컴퓨터 코드를 가질 수 있다. 매체 및 컴퓨터 코드는 본 개시내용의 목적들을 위해 특수하게 설계되고 구성된 것들일 수 있거나, 또는 그것들은 컴퓨터 소프트웨어 기술분야의 통상의 기술자들에게 잘 알려지고 이용가능한 종류의 것일 수 있다.

제한이 아닌 예로서, 아키텍처를 갖는 컴퓨터 시스템(1700), 및 구체적으로 코어(1740)는 프로세서(들)(CPU들, GPU들, FPGA, 가속기들 등을 포함함)가 하나 이상의 유형의(tangible) 컴퓨터 판독가능 매체에 구현된 소프트웨어를 실행하는 결과로서 기능성을 제공할 수 있다. 그러한 컴퓨터 판독가능 매체들은 위에서 소개된 바와 같은 사용자 액세스가능 대용량 저장소뿐만 아니라, 코어 내부 대용량 저장소(1747) 또는 ROM(1745)과 같은 비일시적인 본질의 것인 코어(1740)의 특정 저장소와 연관된 매체일 수 있다. 본 개시내용의 다양한 실시예들을 구현하는 소프트웨어는 그러한 디바이스들에 저장되고 코어(1740)에 의해 실행될 수 있다. 컴퓨터 판독가능 매체는 특정한 요구들에 따라 하나 이상의 메모리 디바이스 또는 칩을 포함할 수 있다. 소프트웨어는 코어(1740) 및 구체적으로 그 내부의 프로세서들(CPU, GPU, FPGA 등을 포함함)로 하여금, RAM(1746)에 저장된 데이터 구조들을 정의하는 것 및 소프트웨어에 의해 정의된 프로세스들에 따라 그러한 데이터 구조들을 수정하는 것을 포함하여, 본 명세서에 설명된 특정한 프로세스들 또는 특정한 프로세스들의 특정한 부분들을 실행하게 할 수 있다. 추가로 또는 대안으로서, 컴퓨터 시스템은 회로(예를 들어: 가속기(1744))에 하드와이어링되거나 다른 방식으로 구현된 로직의 결과로서 기능성을 제공할 수 있고, 이는 본 명세서에 설명된 특정한 프로세스들 또는 특정한 프로세스들의 특정한 부분들을 실행하기 위해 소프트웨어 대신에 또는 그와 함께 동작할 수 있다. 소프트웨어에 대한 참조는, 적절한 경우, 로직을 포함할 수 있고, 그 반대도 마찬가지이다. 컴퓨터 판독가능 매체들에 대한 참조는, 적절한 경우, 실행을 위한 소프트웨어를 저장하는 회로(예컨대, 집적 회로(IC)), 실행을 위한 로직을 구현하는 회로, 또는 둘 다를 포괄할 수 있다. 본 개시내용은 하드웨어 및 소프트웨어의 임의의 적합한 조합을 포괄한다.

부록 A: 두문자어들

JEM: joint exploration model

VVC: versatile video coding

BMS: benchmark set

MV: Motion Vector

HEVC: High Efficiency Video Coding

SEI: Supplementary Enhancement Information

VUI: Video Usability Information

GOPs: Groups of Pictures

TUs: Transform Units

PUs: Prediction Units

CTUs: Coding Tree Units

CTBs: Coding Tree Blocks

PB: Prediction Block

HRD: Hypothetical Reference Decoder

SNR: Signal Noise Ratio

CPUs: Central Processing Units

GPUs: Graphics Processing Units

CRT: Cathode Ray Tube

LCD: Liquid-Crystal Display

OLED: Organic Light-Emitting Diode

CD: Compact Disc

DVD: Digital Video Disc

ROM: Read-Only Memory

RAM: Random Access Memory

ASIC: Application-Specific Integrated Circuit

PLD: Programmable Logic Device

LAN: Local Area Network

GSM: Global System for Mobile communications

LTE: Long-Term Evolution

CANBus: Controller Area Network Bus

USB: Universal Serial Bus

PCI: Peripheral Component Interconnect

FPGA: Field Programmable Gate Areas

SSD: solid-state drive

IC: Integrated Circuit

CU: Coding Unit

본 개시내용이 여러 예시적인 실시예들을 설명하였지만, 본 개시내용의 범위 내에 속하는 변경들, 치환들, 및 다양한 대체 등가물들이 있다. 따라서, 본 기술분야의 통상의 기술자들은, 본 명세서에 명시적으로 도시되거나 설명되지는 않았지만, 본 개시내용의 원리들을 구현하고 따라서 본 개시내용의 사상 및 범위 내에 있는 다수의 시스템들 및 방법들을 고안할 수 있을 것이라는 점이 이해될 것이다.

Claims (20)

- 비디오 디코더에서 수행되는 비디오 디코딩 방법으로서,

코딩된 비디오 비트스트림으로부터 비디오의 현재 픽처 내의 현재 블록의 코딩된 정보를 수신하는 단계- 상기 코딩된 정보는 상기 현재 블록이 기하학적 파티션 모드(GPM)에 기초하여 적어도 제1 파티션 및 제2 파티션으로 파티셔닝되는 것을 나타내고, 상기 제1 파티션은 인트라 블록 복사(IBC) 예측 모드와 연관되고, 상기 제2 파티션은 인트라 예측 모드와 연관됨 -; 및

상기 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보를 저장하는 단계- 상기 예측 모드 정보는 상기 제1 서브블록이 상기 IBC 예측 모드, 상기 인트라 예측 모드, 및 상기 IBC 예측 모드와 상기 인트라 예측 모드 둘 다 중 하나와 연관되는지에 기초하여 DC 모드, 평면 모드, 및 인트라 예측 모드 중 하나를 포함함 -를 포함하는, 방법. - 제1항에 있어서,

상기 저장된 예측 모드 정보를 사용하여 상기 현재 블록의 이웃 블록에 대해 최고 확률 모드(MPM) 도출을 수행하는 단계를 추가로 포함하는, 방법. - 제1항에 있어서,

상기 제1 서브블록이 상기 IBC 예측 모드와 연관되는 것에 기초하여, 상기 예측 모드 정보를 저장하는 단계는 상기 현재 블록의 상기 복수의 서브블록 중 상기 제1 서브블록에 대한 상기 예측 모드 정보에 상기 평면 모드만을 저장하는 단계를 포함하는, 방법. - 제1항에 있어서,

상기 제1 서브블록이 상기 인트라 예측 모드와 연관되는 것에 기초하여, 상기 예측 모드 정보를 저장하는 단계는 상기 현재 블록의 상기 복수의 서브블록 중 상기 제1 서브블록에 대한 상기 예측 모드 정보에 상기 인트라 예측 모드만을 저장하는 단계를 포함하는, 방법. - 제1항에 있어서,

상기 제1 서브블록이 상기 IBC 예측 모드 및 상기 인트라 예측 모드 둘 다와 연관되는 것에 기초하여, 상기 예측 모드 정보를 저장하는 단계는 상기 현재 블록의 상기 복수의 서브블록 중 상기 제1 서브블록에 대한 상기 예측 모드 정보에 상기 인트라 예측 모드만을 저장하는 단계를 포함하는, 방법. - 제1항에 있어서,

상기 현재 블록의 상기 제1 파티션이 상기 IBC 예측 모드와 연관되고, 상기 현재 블록의 상기 제2 파티션이 상기 인트라 예측 모드와 연관되는 것에 기초하여 상기 현재 블록의 상기 복수의 서브블록 각각에 대한 상기 DC 모드를 저장하는 단계를 추가로 포함하는, 방법. - 제1항에 있어서,

상기 현재 블록의 상기 제1 파티션이 상기 IBC 예측 모드와 연관되고, 상기 현재 블록의 상기 제2 파티션이 상기 인트라 예측 모드와 연관되는 것에 기초하여 상기 현재 블록의 상기 복수의 서브블록 각각에 대한 상기 평면 모드를 저장하는 단계를 추가로 포함하는, 방법. - 제1항에 있어서,

상기 현재 블록의 상기 제1 파티션이 상기 IBC 예측 모드와 연관되고, 상기 현재 블록의 상기 제2 파티션이 상기 인트라 예측 모드와 연관되는 것에 기초하여 상기 현재 블록의 상기 복수의 서브블록 각각에 대한 상기 인트라 예측 모드를 저장하는 단계를 추가로 포함하는, 방법. - 제2항에 있어서, 상기 현재 블록의 상기 복수의 서브블록 중 상기 제1 서브블록에 대한 상기 예측 모드 정보는 상기 현재 블록의 상기 이웃 블록의 MPM 도출을 위한 전파된 인트라 모드이고, 상기 이웃 블록은 상기 IBC 예측 모드에 의해 예측되는, 방법.

- 장치로서,

프로세싱 회로를 포함하고, 상기 프로세싱 회로는:

코딩된 비디오 비트스트림으로부터 비디오의 현재 픽처 내의 현재 블록의 코딩된 정보를 수신하고- 상기 코딩된 정보는 상기 현재 블록이 기하학적 파티션 모드(GPM)에 기초하여 적어도 제1 파티션 및 제2 파티션으로 파티셔닝되는 것을 나타내고, 상기 제1 파티션은 인트라 블록 복사(IBC) 예측 모드와 연관되고, 상기 제2 파티션은 인트라 예측 모드와 연관됨 -;

상기 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보를 저장하도록- 상기 예측 모드 정보는 상기 제1 서브블록이 상기 IBC 예측 모드, 상기 인트라 예측 모드, 및 상기 IBC 예측 모드와 상기 인트라 예측 모드 둘 다 중 하나와 연관되는지에 기초하여 DC 모드, 평면 모드, 및 인트라 예측 모드 중 하나를 포함함 - 구성되는, 장치. - 제10항에 있어서, 상기 프로세싱 회로는:

상기 저장된 예측 모드 정보를 사용하여 상기 현재 블록의 이웃 블록에 대해 최고 확률 모드(MPM) 도출을 수행하도록 구성되는, 장치. - 제10항에 있어서, 상기 프로세싱 회로는:

상기 제1 서브블록이 상기 IBC 예측 모드와 연관되는 것에 기초하여, 상기 현재 블록의 상기 복수의 서브블록 중 상기 제1 서브블록에 대한 상기 예측 모드 정보에 상기 평면 모드만을 저장하도록 구성되는, 장치. - 제10항에 있어서, 상기 프로세싱 회로는:

상기 제1 서브블록이 상기 인트라 예측 모드와 연관되는 것에 기초하여,

상기 현재 블록의 상기 복수의 서브블록 중 상기 제1 서브블록에 대한 상기 예측 모드 정보에 상기 인트라 예측 모드만을 저장하도록 구성되는, 장치. - 제10항에 있어서, 상기 프로세싱 회로는:

상기 제1 서브블록이 상기 IBC 예측 모드 및 상기 인트라 예측 모드 둘 다와 연관되는 것에 기초하여, 상기 현재 블록의 상기 복수의 서브블록 중 상기 제1 서브블록에 대한 상기 예측 모드 정보에 상기 인트라 예측 모드만을 저장하도록 구성되는, 장치. - 제10항에 있어서, 상기 프로세싱 회로는:

상기 현재 블록의 상기 제1 파티션이 상기 IBC 예측 모드와 연관되고, 상기 현재 블록의 상기 제2 파티션이 상기 인트라 예측 모드와 연관되는 것에 기초하여 상기 현재 블록의 상기 복수의 서브블록 각각에 대한 상기 DC 모드를 저장하도록 구성되는, 장치. - 제10항에 있어서, 상기 프로세싱 회로는:

상기 현재 블록의 상기 제1 파티션이 상기 IBC 예측 모드와 연관되고, 상기 현재 블록의 상기 제2 파티션이 상기 인트라 예측 모드와 연관되는 것에 기초하여 상기 현재 블록의 상기 복수의 서브블록 각각에 대한 상기 평면 모드를 저장하도록 구성되는, 장치. - 제10항에 있어서, 상기 프로세싱 회로는:

상기 현재 블록의 상기 제1 파티션이 상기 IBC 예측 모드와 연관되고, 상기 현재 블록의 상기 제2 파티션이 상기 인트라 예측 모드와 연관되는 것에 기초하여 상기 현재 블록의 상기 복수의 서브블록 각각에 대한 상기 인트라 예측 모드를 저장하도록 구성되는, 장치. - 제11항에 있어서, 상기 현재 블록의 상기 복수의 서브블록 중 상기 제1 서브블록에 대한 상기 예측 모드 정보는 상기 현재 블록의 상기 이웃 블록의 MPM 도출을 위한 전파된 인트라 모드이고, 상기 이웃 블록은 상기 IBC 예측 모드에 의해 예측되는, 장치.

- 명령어들을 저장한 비일시적 컴퓨터 판독가능 저장 매체로서,

상기 명령어들은, 적어도 하나의 프로세서에 의해 실행될 때, 상기 적어도 하나의 프로세서로 하여금:

코딩된 비디오 비트스트림으로부터 비디오의 현재 픽처 내의 현재 블록의 코딩된 정보를 수신하는 것- 상기 코딩된 정보는 상기 현재 블록이 기하학적 파티션 모드(GPM)에 기초하여 적어도 제1 파티션 및 제2 파티션으로 파티셔닝되는 것을 나타내고, 상기 제1 파티션은 인트라 블록 복사(IBC) 예측 모드와 연관되고, 상기 제2 파티션은 인트라 예측 모드와 연관됨 -; 및

상기 현재 블록의 복수의 서브블록 중 제1 서브블록에 대한 예측 모드 정보를 저장하는 것- 상기 예측 모드 정보는 상기 제1 서브블록이 상기 IBC 예측 모드, 상기 인트라 예측 모드, 및 상기 IBC 예측 모드와 상기 인트라 예측 모드 둘 다 중 하나와 연관되는지에 기초하여 DC 모드, 평면 모드, 및 인트라 예측 모드 중 하나를 포함함 -을 수행하게 하는, 비일시적 컴퓨터 판독가능 저장 매체. - 제19항에 있어서, 상기 명령어들은, 상기 적어도 하나의 프로세서에 의해 실행될 때, 상기 적어도 하나의 프로세서로 하여금:

상기 제1 서브블록이 상기 IBC 예측 모드와 연관되는 것에 기초하여, 상기 현재 블록의 상기 복수의 서브블록 중 상기 제1 서브블록에 대한 상기 예측 모드 정보에 상기 평면 모드만을 저장하는 것;

상기 제1 서브블록이 상기 인트라 예측 모드와 연관되는 것에 기초하여, 상기 현재 블록의 상기 복수의 서브블록 중 상기 제1 서브블록에 대한 상기 예측 모드 정보에 상기 인트라 예측 모드만을 저장하는 것; 및

상기 제1 서브블록이 상기 IBC 예측 모드 및 상기 인트라 예측 모드 둘 다와 연관되는 것에 기초하여, 상기 현재 블록의 상기 복수의 서브블록 중 상기 제1 서브블록에 대한 상기 예측 모드 정보에 상기 인트라 예측 모드만을 저장하는 것 중 하나를 수행하게 하는, 비일시적 컴퓨터 판독가능 저장 매체.

Applications Claiming Priority (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US202163239221P | 2021-08-31 | 2021-08-31 | |

| US63/239,221 | 2021-08-31 | ||

| US17/898,447 | 2022-08-29 | ||

| US17/898,447 US11876978B2 (en) | 2021-08-31 | 2022-08-29 | Intra prediction mode information propagation for geometric partition mode with IBC and intra prediction |

| PCT/US2022/075666 WO2023034798A1 (en) | 2021-08-31 | 2022-08-30 | Intra prediction mode information propagation for geometric partition mode with ibc and intra prediction |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20230079199A true KR20230079199A (ko) | 2023-06-05 |

Family

ID=85385943

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020237014995A KR20230079199A (ko) | 2021-08-31 | 2022-08-30 | Ibc 및 인트라 예측을 갖는 기하학적 파티션 모드에 대한 인트라 예측 모드 정보 전파 |

Country Status (6)

| Country | Link |

|---|---|

| US (2) | US11876978B2 (ko) |

| EP (1) | EP4209008A4 (ko) |

| JP (1) | JP2023550038A (ko) |

| KR (1) | KR20230079199A (ko) |

| CN (1) | CN116325745B (ko) |

| WO (1) | WO2023034798A1 (ko) |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2024211853A1 (en) * | 2023-04-05 | 2024-10-10 | Beijing Dajia Internet Information Technology Co., Ltd | Methods and devices for intra block copy and intra template matching |

Family Cites Families (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US9503715B2 (en) | 2013-08-30 | 2016-11-22 | Qualcomm Incorporated | Constrained intra prediction in video coding |

| KR102416257B1 (ko) * | 2016-08-03 | 2022-07-04 | 주식회사 케이티 | 비디오 신호 처리 방법 및 장치 |

| US11284066B2 (en) * | 2018-10-10 | 2022-03-22 | Tencent America LLC | Method and apparatus for intra block copy in intra-inter blending mode and triangle prediction unit mode |

| US11178396B2 (en) | 2018-11-14 | 2021-11-16 | Tencent America LLC | Constrained intra prediction and unified most probable mode list generation |

| US11240516B2 (en) * | 2019-03-20 | 2022-02-01 | Tencent America LLC | Coding mode signaling for small blocks |

| WO2020232355A1 (en) | 2019-05-16 | 2020-11-19 | Bytedance Inc. | Intra block copy for screen content coding |

| WO2020244503A1 (en) * | 2019-06-03 | 2020-12-10 | Beijing Bytedance Network Technology Co., Ltd. | Intra block copy with triangular partitions |

| WO2020259426A1 (en) | 2019-06-22 | 2020-12-30 | Beijing Bytedance Network Technology Co., Ltd. | Motion candidate list construction for intra block copy mode |

-

2022

- 2022-08-29 US US17/898,447 patent/US11876978B2/en active Active

- 2022-08-30 KR KR1020237014995A patent/KR20230079199A/ko active Search and Examination

- 2022-08-30 JP JP2023528172A patent/JP2023550038A/ja active Pending

- 2022-08-30 CN CN202280006777.1A patent/CN116325745B/zh active Active

- 2022-08-30 WO PCT/US2022/075666 patent/WO2023034798A1/en active Application Filing

- 2022-08-30 EP EP22865732.6A patent/EP4209008A4/en active Pending

-

2023

- 2023-12-01 US US18/526,300 patent/US20240098279A1/en active Pending

Also Published As

| Publication number | Publication date |

|---|---|

| US20240098279A1 (en) | 2024-03-21 |

| JP2023550038A (ja) | 2023-11-30 |

| US20230073917A1 (en) | 2023-03-09 |

| EP4209008A4 (en) | 2024-03-20 |

| CN116325745B (zh) | 2024-10-29 |

| WO2023034798A1 (en) | 2023-03-09 |

| EP4209008A1 (en) | 2023-07-12 |

| US11876978B2 (en) | 2024-01-16 |

| CN116325745A (zh) | 2023-06-23 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US11949863B2 (en) | Geometric partition mode with intra block copy | |

| EP3777138A1 (en) | Methods and apparatuses for video coding | |

| KR20230101870A (ko) | 병합 후보의 그룹화 기반 적응적 재정렬 | |

| US20240323420A1 (en) | Constraint of intra mode for geometric partition mode with inter and intra prediction | |

| US20240098279A1 (en) | Storage of intra mode information in geometric partition mode | |

| KR20210124474A (ko) | 비디오 코딩을 위한 방법 및 장치 | |

| EP3864849A1 (en) | Signaling of cu based interpolation filter selection | |

| US20230108504A1 (en) | On geometric partition mode with intra and inter prediction | |

| KR20240068714A (ko) | 인트라 템플릿 매칭 예측의 모션 정보를 이용하는 인트라 블록 복사(ibc) 후보 리스트 구성 | |

| KR20230104682A (ko) | 템플릿-정합을 이용하는 것에 의한 대안적인 모션 벡터 차이를 갖는 병합 모드 | |

| EP4189957A1 (en) | Geometric partition based intra prediction | |

| AU2022434052B2 (en) | Motion vector restriction for out-of-frame boundary conditions | |

| US20230079960A1 (en) | On propagating intra prediction mode information of ibc block by using block vector | |

| WO2023229663A1 (en) | Subblock-based motion vector predictor with mv offset derived by template matching | |

| KR20230127307A (ko) | 제한된 템플릿 매칭 | |

| WO2023064665A1 (en) | Improvement on intra mode propagation | |

| EP3939294A1 (en) | Temporal motion vector derivation in shared merge region at picture boundary |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A201 | Request for examination |