KR20180098367A - 얼굴 생체 검증 방법 및 장치 - Google Patents

얼굴 생체 검증 방법 및 장치 Download PDFInfo

- Publication number

- KR20180098367A KR20180098367A KR1020187021514A KR20187021514A KR20180098367A KR 20180098367 A KR20180098367 A KR 20180098367A KR 1020187021514 A KR1020187021514 A KR 1020187021514A KR 20187021514 A KR20187021514 A KR 20187021514A KR 20180098367 A KR20180098367 A KR 20180098367A

- Authority

- KR

- South Korea

- Prior art keywords

- feature point

- error

- face

- face image

- transformation matrix

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F21/00—Security arrangements for protecting computers, components thereof, programs or data against unauthorised activity

- G06F21/30—Authentication, i.e. establishing the identity or authorisation of security principals

- G06F21/31—User authentication

- G06F21/32—User authentication using biometric data, e.g. fingerprints, iris scans or voiceprints

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/168—Feature extraction; Face representation

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F21/00—Security arrangements for protecting computers, components thereof, programs or data against unauthorised activity

- G06F21/30—Authentication, i.e. establishing the identity or authorisation of security principals

- G06F21/45—Structures or tools for the administration of authentication

-

- G06K9/00268—

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/10—Segmentation; Edge detection

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/74—Image or video pattern matching; Proximity measures in feature spaces

- G06V10/75—Organisation of the matching processes, e.g. simultaneous or sequential comparisons of image or video features; Coarse-fine approaches, e.g. multi-scale approaches; using context analysis; Selection of dictionaries

- G06V10/757—Matching configurations of points or features

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/161—Detection; Localisation; Normalisation

- G06V40/167—Detection; Localisation; Normalisation using comparisons between temporally consecutive images

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/172—Classification, e.g. identification

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/40—Spoof detection, e.g. liveness detection

- G06V40/45—Detection of the body part being alive

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30196—Human being; Person

- G06T2207/30201—Face

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Health & Medical Sciences (AREA)

- Multimedia (AREA)

- Oral & Maxillofacial Surgery (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Human Computer Interaction (AREA)

- General Health & Medical Sciences (AREA)

- Computer Security & Cryptography (AREA)

- Software Systems (AREA)

- Computer Hardware Design (AREA)

- General Engineering & Computer Science (AREA)

- Databases & Information Systems (AREA)

- Evolutionary Computation (AREA)

- Medical Informatics (AREA)

- Computing Systems (AREA)

- Artificial Intelligence (AREA)

- Image Analysis (AREA)

- Collating Specific Patterns (AREA)

- Image Processing (AREA)

Abstract

Description

도 1a는 본 출원의 실시 예에 의해 제공되는 살아 있는 인간 얼굴 검증 방법의 장면(scene) 개략도이다.

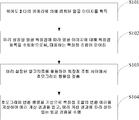

도 1b는 본 출원의 실시 예에 의해 제공되는 살아 있는 인간 얼굴 검증 방법의 흐름도이다.

도 2a는 본 출원의 실시 예에 의해 제공되는 살아 있는 인간 얼굴 검증 방법의 흐름도이다.

도 2b는 본 출원의 실시 예에 의해 제공되는 살아 있는 인간 얼굴 검증 방법에서의 특징점 등록의 개략도이다.

도 3a는 본 출원의 실시 예에 의해 제공되는 살아 있는 인간 얼굴 검증 장치의 구조 개략도이다.

도 3b는 본 출원의 실시 예에 의해 제공되는 살아 있는 인간 얼굴 검증 장치의 다른 구조 개략도이다.

도 4는 본 출원의 실시 예에 의해 제공되는 서버의 구조 개략도이다.

Claims (18)

- 살아 있는(live) 인간 얼굴 검증 방법으로서,

컴퓨팅 장치가, 적어도 2대의 카메라에 의해 캡처된 얼굴 이미지를 획득하는(acquire) 단계;

상기 컴퓨팅 장치가, 미리 설정된 얼굴 특징점에 따라 상기 얼굴 이미지에 대해 특징점 등록을 수행하여 상기 얼굴 이미지의 대응하는 특징점 조합을 얻는(obtain) 단계;

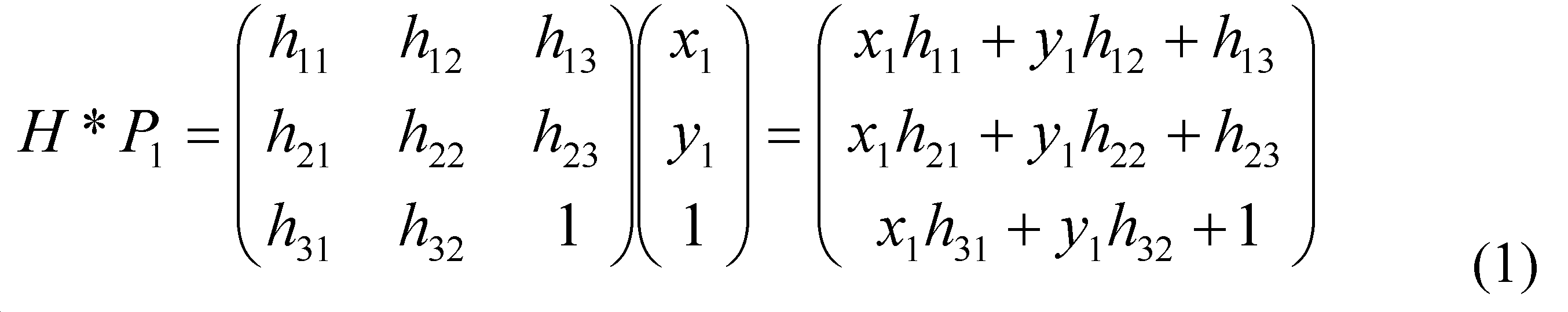

상기 컴퓨팅 장치가, 미리 설정된 알고리즘을 활용(utilize)하여 상기 특징점 조합 사이에서 호모그래피 변환 행렬(homography transformation matrix)을 갖추는(fit out) 단계;

상기 컴퓨팅 장치가, 상기 호모그래피 변환 행렬을 사용하여 상기 특징점 조합의 변환 에러(error)를 계산하여 에러 계산 결과를 얻는 단계; 및

상기 컴퓨팅 장치가, 상기 에러 계산 결과에 따라 상기 얼굴 이미지의 살아 있는 인간 얼굴 검증을 수행하는 단계

를 포함하는 얼굴 검증 방법. - 제1항에 있어서,

상기 적어도 2대의 카메라에 의해 캡처된 얼굴 이미지를 획득하는 단계는,

적어도 두 대의 카메라에 의해 캡처된 이미지 데이터를 획득하는 단계;

상기 이미지 데이터에 대해 얼굴 검출을 수행하여 얼굴 검출 결과를 얻는 단계; 및

상기 얼굴 검출 결과가 얼굴 이미지가 검출된 것을 지시하는 경우, 상기 얼굴 이미지를 획득하는 단계

를 포함하는, 얼굴 검증 방법. - 제1항에 있어서,

상기 미리 설정된 알고리즘을 활용하여 상기 특징점 조합 사이에서 호모그래피 변환 행렬을 갖추는 단계는,

미리 설정된 랜덤 샘플링 컨센서스(random sampling consensus) 알고리즘을 활용하여 상기 특징점 조합을 피팅(fit)하여서, 최소 제곱법(least square method)을 사용하여 상기 호모그래피 변환 행렬을 생성하는 단계

를 포함하는, 얼굴 검증 방법. - 제3항에 있어서,

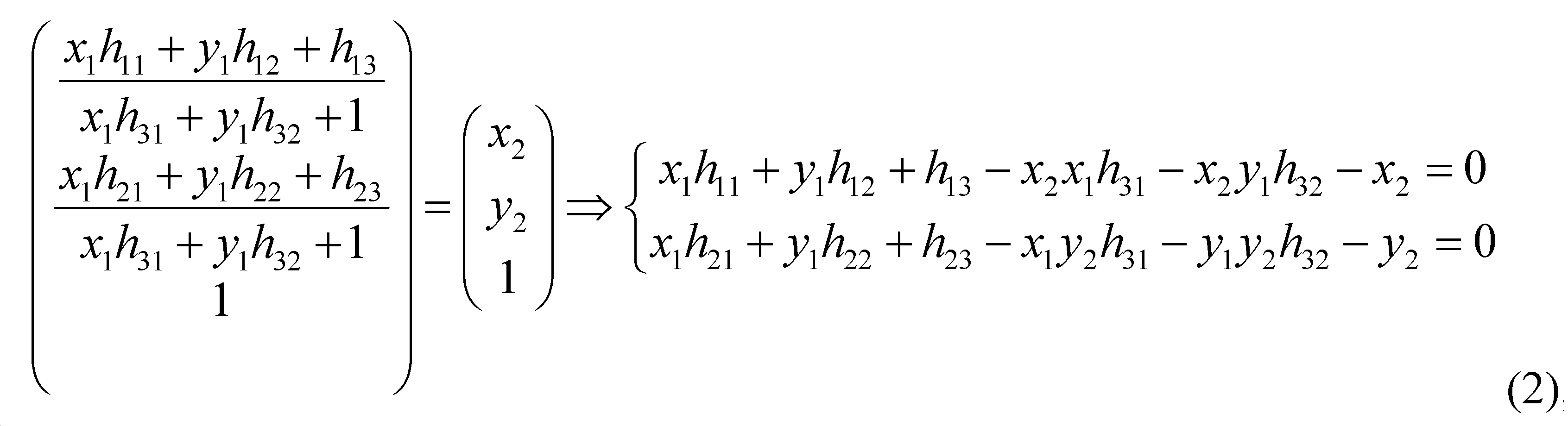

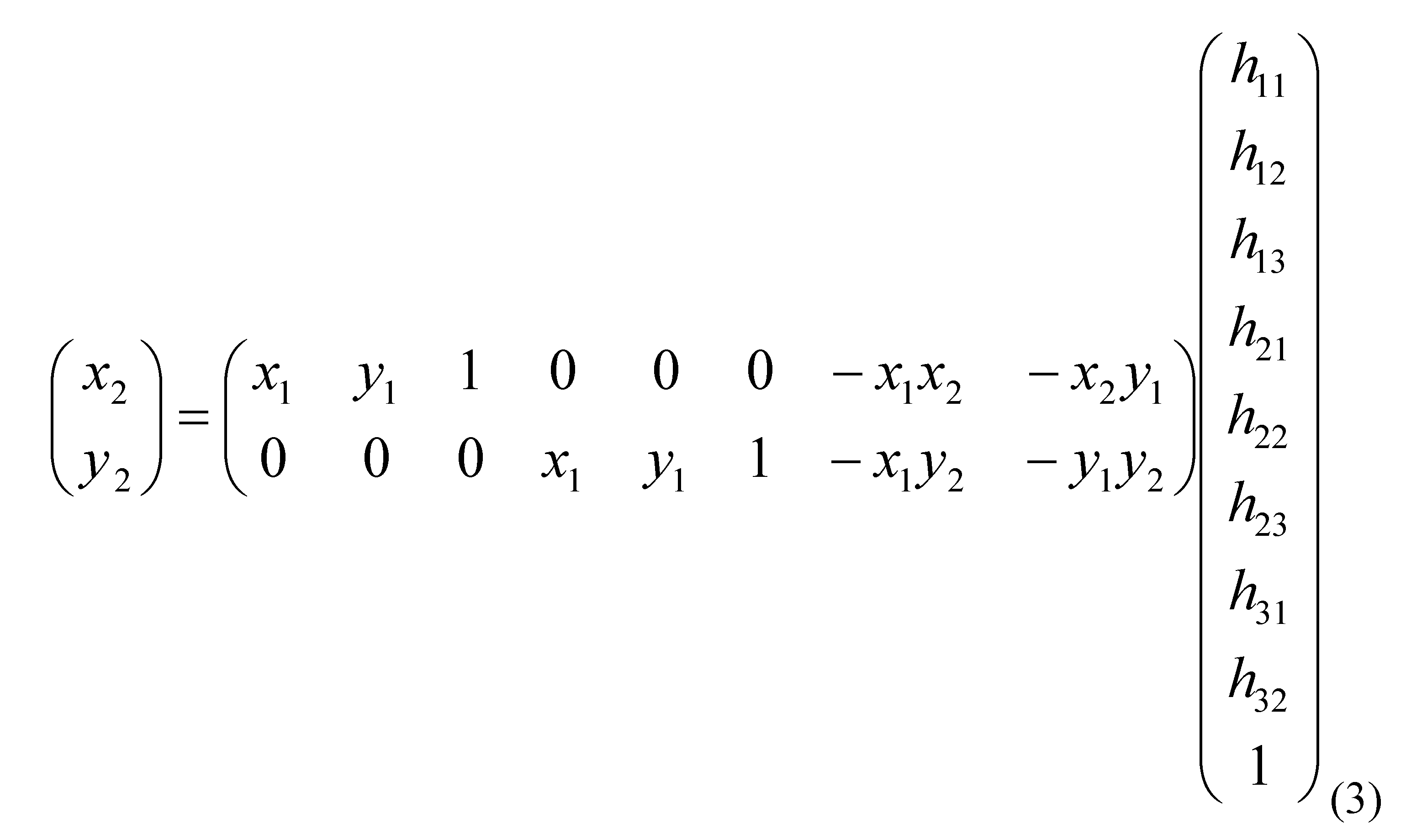

상기 특징점 조합을 피팅하여서 상기 호모그래피 변환 행렬을 생성하는 단계는,

상기 특징점 조합의 각각의 특징점 쌍을 동차 좌표(homogeneous coordinates)의 형태로 마킹(marking)하는 단계;

행렬 모델을 고안하고(create), 상기 행렬 모델에 의하여 각각의 특징점 사이의 대응 관계를 결정하는 단계;

상기 대응 관계에 대해 동차 변환(homogeneous transformation)을 수행하여 동차 대응 관계를 생성하는 단계; 및

상기 동차 대응 관계에 기반하여 상기 특징점 조합을 피팅하여 상기 호모그래피 변환 행렬을 생성하는 단계

를 포함하는, 얼굴 검증 방법. - 제1항에 있어서,

상기 호모그래피 변환 행렬을 사용하여 상기 특징점 조합의 변환 에러를 계산하여 에러 계산 결과를 얻는 단계는,

각각의 특징점의 조합에 대하여, 상기 호모그래피 변환 행렬을 사용하여 대응하는 변환 에러(corresponding transformation error)를 계산하는 단계;

각각의 특징점 조합의 상기 대응하는 변환 에러에 따라 평균값 계산을 수행하여 평균 에러를 얻는 단계; 및

상기 평균 에러를 상기 에러 계산 결과로 결정하는 단계

를 포함하는, 얼굴 검증 방법. - 제5항에 있어서

상기 에러 계산 결과에 따라 상기 얼굴 이미지의 살아 있는 인간 얼굴 검증을 수행하는 단계는,

상기 에러 계산 결과에 의해 지시되는 상기 평균 에러가 미리 설정된 임계 값보다 작거나 같으면, 살아 있는 인간 얼굴 검증의 결과가 "통과"인 것으로 결정하는 단계; 및

상기 에러 계산 결과에 의해 지시되는 상기 평균 에러가 상기 미리 설정된 임계 값보다 크면, 살아 있는 인간 얼굴 검증의 결과가 "통과되지 않음"인 것으로 결정하는 단계

를 포함하는, 얼굴 검증 방법. - 살아 있는 인간 얼굴 검증 장치로서,

하나 이상의 프로세서; 및

메모리

를 포함하며,

상기 메모리에 저장된 복수의 프로그램이, 상기 하나 이상의 프로세서에 의해 실행되는 경우, 상기 장치가,

상기 컴퓨팅 장치가, 적어도 2대의 카메라에 의해 캡처된 얼굴 이미지를 획득하고;

상기 컴퓨팅 장치가, 미리 설정된 얼굴 특징점에 따라 상기 얼굴 이미지에 대해 특징점 등록을 수행하여 상기 얼굴 이미지의 대응하는 특징점 조합을 얻으며;

상기 컴퓨팅 장치가, 미리 설정된 알고리즘을 활용하여 상기 특징점 조합 사이에서 호모그래피 변환 행렬을 갖추고;

상기 컴퓨팅 장치가, 상기 호모그래피 변환 행렬을 사용하여 상기 특징점 조합의 변환 에러를 계산하여 에러 계산 결과를 얻으며; 그리고

상기 컴퓨팅 장치가, 상기 에러 계산 결과에 따라 상기 얼굴 이미지의 살아 있는 인간 얼굴 검증을 수행하는 동작을 실행하도록 하는, 얼굴 검증 장치. - 제7항에 있어서,

상기 프로그램이, 상기 하나 이상의 프로세서에 의해 실행되는 경우, 상기 컴퓨팅 장치가,

적어도 두 대의 카메라에 의해 캡처된 이미지 데이터를 획득하고;

상기 이미지 데이터에 대해 얼굴 검출을 수행하여 얼굴 검출 결과를 얻으며; 그리고

상기 얼굴 검출 결과가 얼굴 이미지가 검출된 것을 지시하는 경우, 상기 얼굴 이미지를 획득하는 동작을 실행하도록 하는, 얼굴 검증 장치. - 제7항에 있어서,

상기 프로그램이, 상기 하나 이상의 프로세서에 의해 실행되는 경우, 상기 컴퓨팅 장치가,

미리 설정된 랜덤 샘플링 컨센서스 알고리즘을 활용하여 상기 특징점 조합을 피팅하여서, 최소 제곱법을 사용하여 상기 호모그래피 변환 행렬을 생성하는 동작을 실행하도록 하는, 얼굴 검증 장치. - 제9항에 있어서,

상기 프로그램이, 상기 하나 이상의 프로세서에 의해 실행되는 경우, 상기 컴퓨팅 장치가,

상기 특징점 조합의 각각의 특징점 쌍을 동차 좌표의 형태로 마킹하고;

행렬 모델을 고안하고, 상기 행렬 모델에 의하여 각각의 특징점 쌍간의 대응 관계를 결정하며;

상기 대응 관계에 대해 동차 변환을 수행하여 동차 대응 관계를 생성하고; 그리고

상기 동차 대응 관계에 기반하여 상기 특징점 조합을 피팅하여 상기 호모그래피 변환 행렬을 생성하는 동작을 실행하도록 하는, 얼굴 검증 장치. - 제7항에 있어서,

상기 프로그램이, 상기 하나 이상의 프로세서에 의해 실행되는 경우, 상기 컴퓨팅 장치가,

각각의 특징점의 조합에 대하여, 상기 호모그래피 변환 행렬을 사용하여 대응하는 변환 에러를 계산하고;

각각의 특징점 조합의 상기 대응하는 변환 에러에 따라 평균값 계산을 수행하여 평균 에러를 얻으며; 그리고

상기 평균 에러를 상기 에러 계산 결과로 결정하는 동작을 실행하도록 하는, 얼굴 검증 장치. - 제11항에 있어서,

상기 프로그램이, 상기 하나 이상의 프로세서에 의해 실행되는 경우, 상기 컴퓨팅 장치가,

상기 에러 계산 결과에 의해 지시되는 상기 평균 에러가 미리 설정된 임계 값보다 작거나 같으면, 살아 있는 인간 얼굴 검증의 결과가 "통과"인 것으로 결정하고; 그리고

상기 에러 계산 결과에 의해 지시되는 상기 평균 에러가 상기 미리 설정된 임계 값보다 크면, 살아 있는 인간 얼굴 검증의 결과가 "통과되지 않음"인 것으로 결정하는 동작을 실행하도록 하는, 얼굴 검증 장치. - 복수의 프로그램을 저장하는 컴퓨터 판독 가능한 저장 매체로서,

상기 프로그램은, 컴퓨팅 장치의 하나 이상의 프로세서에 의해 실행되는 경우, 상기 하나 이상의 프로세서가,

적어도 2대의 카메라에 의해 캡처된 얼굴 이미지를 획득하고;

미리 설정된 얼굴 특징점에 따라 상기 얼굴 이미지에 대해 특징점 등록을 수행하여 상기 얼굴 이미지의 대응하는 특징점 조합을 얻으며;

미리 설정된 알고리즘을 활용하여 상기 특징점 조합 사이에서 호모그래피 변환 행렬을 갖추고;

상기 호모그래피 변환 행렬을 사용하여 상기 특징점 조합의 변환 에러를 계산하여 에러 계산 결과를 얻으며; 그리고

상기 에러 계산 결과에 따라 상기 얼굴 이미지의 살아 있는 인간 얼굴 검증을 수행하는 동작을 실행하도록 하는, 저장 매체. - 제13항에 있어서,

상기 프로그램은, 컴퓨팅 장치의 하나 이상의 프로세서에 의해 실행되는 경우, 상기 하나 이상의 프로세서가,

적어도 두 대의 카메라에 의해 캡처된 이미지 데이터를 획득하고;

상기 이미지 데이터에 대해 얼굴 검출을 수행하여 얼굴 검출 결과를 얻으며; 그리고

상기 얼굴 검출 결과가 얼굴 이미지가 검출된 것을 지시하는 경우, 상기 얼굴 이미지를 획득하는 동작을 실행하도록 하는, 저장 매체. - 제13항에 있어서,

상기 프로그램은, 컴퓨팅 장치의 하나 이상의 프로세서에 의해 실행되는 경우, 상기 하나 이상의 프로세서가,

미리 설정된 랜덤 샘플링 컨센서스 알고리즘을 활용하여 상기 특징점 조합을 피팅하여서, 최소 제곱법을 사용하여 상기 호모그래피 변환 행렬을 생성하는 동작을 실행하도록 하는, 저장 매체. - 제15항에 있어서,

상기 프로그램은, 컴퓨팅 장치의 하나 이상의 프로세서에 의해 실행되는 경우, 상기 하나 이상의 프로세서가,

상기 특징점 조합의 각각의 특징점 쌍을 동차 좌표의 형태로 마킹하고;

행렬 모델을 고안하고, 상기 행렬 모델에 의하여 각각의 특징점 쌍간의 대응 관계를 결정하며;

상기 대응 관계에 대해 동차 변환을 수행하여 동차 대응 관계를 생성하고; 그리고

상기 동차 대응 관계에 기반하여 상기 특징점 조합을 피팅하여 상기 호모그래피 변환 행렬을 생성하는 동작을 실행하도록 하는, 저장 매체. - 제13항에 있어서,

상기 프로그램은, 컴퓨팅 장치의 하나 이상의 프로세서에 의해 실행되는 경우, 상기 하나 이상의 프로세서가,

각각의 특징점의 조합에 대하여, 상기 호모그래피 변환 행렬을 사용하여 대응하는 변환 에러를 계산하고;

각각의 특징점 조합의 상기 대응하는 변환 에러에 따라 평균값 계산을 수행하여 평균 에러를 얻으며; 그리고

상기 평균 에러를 상기 에러 계산 결과로 결정하는 동작을 실행하도록 하는, 저장 매체. - 제11항에 있어서,

상기 프로그램은, 컴퓨팅 장치의 하나 이상의 프로세서에 의해 실행되는 경우, 상기 하나 이상의 프로세서가,

상기 에러 계산 결과에 의해 지시되는 상기 평균 에러가 미리 설정된 임계 값보다 작거나 같으면, 살아 있는 인간 얼굴 검증의 결과가 "통과"인 것으로 결정하고; 그리고

상기 에러 계산 결과에 의해 지시되는 상기 평균 에러가 상기 미리 설정된 임계 값보다 크면, 살아 있는 인간 얼굴 검증의 결과가 "통과되지 않음"인 것으로 결정하는 동작을 실행하도록 하는, 저장 매체.

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN201610252267.9 | 2016-04-21 | ||

| CN201610252267.9A CN105868733A (zh) | 2016-04-21 | 2016-04-21 | 一种人脸活体验证方法及装置 |

| PCT/CN2017/080376 WO2017181899A1 (zh) | 2016-04-21 | 2017-04-13 | 一种人脸活体验证方法及装置 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| KR20180098367A true KR20180098367A (ko) | 2018-09-03 |

| KR102120241B1 KR102120241B1 (ko) | 2020-06-08 |

Family

ID=56632933

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020187021514A Active KR102120241B1 (ko) | 2016-04-21 | 2017-04-13 | 얼굴 생체 검증 방법 및 장치 |

Country Status (6)

| Country | Link |

|---|---|

| US (1) | US10796179B2 (ko) |

| EP (1) | EP3447679A4 (ko) |

| JP (1) | JP2019509545A (ko) |

| KR (1) | KR102120241B1 (ko) |

| CN (1) | CN105868733A (ko) |

| WO (1) | WO2017181899A1 (ko) |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20200029951A (ko) * | 2018-09-11 | 2020-03-19 | 한국산업기술대학교산학협력단 | 적응적 분류에 기반한 영상정합 시스템 및 방법 |

| WO2020205980A1 (en) * | 2019-04-05 | 2020-10-08 | Realnetworks, Inc. | Face liveness detection systems and methods |

Families Citing this family (27)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN105868733A (zh) | 2016-04-21 | 2016-08-17 | 腾讯科技(深圳)有限公司 | 一种人脸活体验证方法及装置 |

| CN107316029B (zh) * | 2017-07-03 | 2018-11-23 | 腾讯科技(深圳)有限公司 | 一种活体验证方法及设备 |

| US20190034857A1 (en) * | 2017-07-28 | 2019-01-31 | Nuro, Inc. | Food and beverage delivery system on autonomous and semi-autonomous vehicle |

| WO2019077863A1 (ja) * | 2017-10-18 | 2019-04-25 | ソニーセミコンダクタソリューションズ株式会社 | 識別装置及び電子機器 |

| CN108156161A (zh) * | 2017-12-27 | 2018-06-12 | 百度在线网络技术(北京)有限公司 | 验证方法和装置 |

| CN111046703B (zh) * | 2018-10-12 | 2023-04-18 | 杭州海康威视数字技术股份有限公司 | 人脸防伪检测方法、装置及多目相机 |

| CN111079470B (zh) * | 2018-10-18 | 2023-08-22 | 杭州海康威视数字技术股份有限公司 | 人脸活体检测的方法和装置 |

| CN111291586B (zh) * | 2018-12-06 | 2024-05-24 | 北京市商汤科技开发有限公司 | 活体检测方法、装置、电子设备及计算机可读存储介质 |

| CN111666786B (zh) * | 2019-03-06 | 2024-05-03 | 杭州海康威视数字技术股份有限公司 | 图像处理方法、装置、电子设备及存储介质 |

| CN110059590B (zh) * | 2019-03-29 | 2023-06-30 | 努比亚技术有限公司 | 一种人脸活体验证方法、装置、移动终端及可读存储介质 |

| CN111860055B (zh) * | 2019-04-29 | 2023-10-24 | 北京眼神智能科技有限公司 | 人脸静默活体检测方法、装置、可读存储介质及设备 |

| CN110636276B (zh) * | 2019-08-06 | 2021-12-28 | RealMe重庆移动通信有限公司 | 视频拍摄方法、装置、存储介质及电子设备 |

| CN110751017B (zh) * | 2019-09-03 | 2021-03-02 | 上海交通大学 | 一种基于强化学习的在线非监督的人群组分割方法及终端 |

| CN112883762A (zh) * | 2019-11-29 | 2021-06-01 | 广州慧睿思通科技股份有限公司 | 一种活体检测方法、装置、系统及存储介质 |

| CN111079587B (zh) * | 2019-12-03 | 2023-09-22 | 北京迈格威科技有限公司 | 人脸的识别方法、装置、计算机设备及可读存储介质 |

| CN111079684B (zh) * | 2019-12-24 | 2023-04-07 | 陕西西图数联科技有限公司 | 一种基于粗糙-精细拟合的三维人脸检测方法 |

| CN113128258B (zh) * | 2019-12-30 | 2022-10-04 | 杭州海康威视数字技术股份有限公司 | 活体检测方法、装置、电子设备及存储介质 |

| CN111209870A (zh) * | 2020-01-09 | 2020-05-29 | 杭州涂鸦信息技术有限公司 | 一种双目活体摄像头快速配准方法及其系统和装置 |

| CN111339958B (zh) * | 2020-02-28 | 2023-08-29 | 南京鑫之派智能科技有限公司 | 一种基于单目视觉的人脸活体检测方法及系统 |

| CN113536844B (zh) * | 2020-04-16 | 2023-10-31 | 中移(成都)信息通信科技有限公司 | 人脸对比方法、装置、设备及介质 |

| CN111581411B (zh) * | 2020-06-09 | 2023-08-22 | 腾讯科技(深圳)有限公司 | 高精度人脸形状库的构建方法、装置、设备及存储介质 |

| CN111780673B (zh) * | 2020-06-17 | 2022-05-31 | 杭州海康威视数字技术股份有限公司 | 一种测距方法、装置及设备 |

| CN112287798A (zh) * | 2020-10-23 | 2021-01-29 | 深圳市商汤科技有限公司 | 测温方法及装置、电子设备及存储介质 |

| CN112418021A (zh) * | 2020-11-10 | 2021-02-26 | 上海臻面智能信息科技有限公司 | 一种单rgb-ir摄像头的安全模组的实现方法及装置 |

| CN112598716B (zh) * | 2020-12-01 | 2024-04-05 | 浙江大华技术股份有限公司 | 一种多模态图像的配准方法、装置及系统 |

| CN113553990B (zh) * | 2021-08-09 | 2022-04-15 | 深圳智必选科技有限公司 | 多人脸跟踪识别的方法、装置、计算机设备及存储介质 |

| CN118597713B (zh) * | 2024-05-22 | 2025-11-11 | 福建龙净环保股份有限公司 | 一种机器停机控制方法及装置、电子设备、存储介质 |

Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN101923641A (zh) * | 2010-09-09 | 2010-12-22 | 北京交通大学 | 一种改进的人脸识别方法 |

| KR20130028734A (ko) * | 2010-04-02 | 2013-03-19 | 노키아 코포레이션 | 얼굴 검출을 위한 방법 및 장치 |

Family Cites Families (15)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR100851981B1 (ko) * | 2007-02-14 | 2008-08-12 | 삼성전자주식회사 | 비디오 영상에서 실 객체 판별 방법 및 장치 |

| JP5170094B2 (ja) | 2007-06-29 | 2013-03-27 | 日本電気株式会社 | なりすまし検知システム、なりすまし検知方法およびなりすまし検知用プログラム |

| US8448859B2 (en) * | 2008-09-05 | 2013-05-28 | Datalogic ADC, Inc. | System and method for preventing cashier and customer fraud at retail checkout |

| JP5445460B2 (ja) | 2008-10-28 | 2014-03-19 | 日本電気株式会社 | なりすまし検知システム、なりすまし検知方法及びなりすまし検知プログラム |

| US8553982B2 (en) * | 2009-12-23 | 2013-10-08 | Intel Corporation | Model-based play field registration |

| US8675926B2 (en) * | 2010-06-08 | 2014-03-18 | Microsoft Corporation | Distinguishing live faces from flat surfaces |

| CN102065313B (zh) * | 2010-11-16 | 2012-10-31 | 上海大学 | 平行式相机阵列的未标定多视点图像校正方法 |

| US9342886B2 (en) * | 2011-04-29 | 2016-05-17 | Qualcomm Incorporated | Devices, methods, and apparatuses for homography evaluation involving a mobile device |

| KR101373397B1 (ko) * | 2012-06-11 | 2014-03-13 | 인하대학교 산학협력단 | 증강현실의 호모그래피 정확도 향상을 위한 csp 기반의 ransac 샘플링 방법 |

| CN103679118B (zh) * | 2012-09-07 | 2017-06-16 | 汉王科技股份有限公司 | 一种人脸活体检测方法及系统 |

| CN103971400B (zh) * | 2013-02-06 | 2018-02-02 | 阿里巴巴集团控股有限公司 | 一种基于标识码的三维交互的方法和系统 |

| CN104573682A (zh) * | 2015-02-15 | 2015-04-29 | 四川川大智胜软件股份有限公司 | 一种基于人脸相似度的人脸防伪方法 |

| CN105023010B (zh) * | 2015-08-17 | 2018-11-06 | 中国科学院半导体研究所 | 一种人脸活体检测方法及系统 |

| CN105205458A (zh) * | 2015-09-16 | 2015-12-30 | 北京邮电大学 | 人脸活体检测方法、装置及系统 |

| CN105868733A (zh) * | 2016-04-21 | 2016-08-17 | 腾讯科技(深圳)有限公司 | 一种人脸活体验证方法及装置 |

-

2016

- 2016-04-21 CN CN201610252267.9A patent/CN105868733A/zh active Pending

-

2017

- 2017-04-13 KR KR1020187021514A patent/KR102120241B1/ko active Active

- 2017-04-13 EP EP17785384.3A patent/EP3447679A4/en not_active Ceased

- 2017-04-13 JP JP2018538712A patent/JP2019509545A/ja active Pending

- 2017-04-13 WO PCT/CN2017/080376 patent/WO2017181899A1/zh not_active Ceased

-

2018

- 2018-06-29 US US16/024,117 patent/US10796179B2/en active Active

Patent Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20130028734A (ko) * | 2010-04-02 | 2013-03-19 | 노키아 코포레이션 | 얼굴 검출을 위한 방법 및 장치 |

| CN101923641A (zh) * | 2010-09-09 | 2010-12-22 | 北京交通大学 | 一种改进的人脸识别方法 |

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| KR20200029951A (ko) * | 2018-09-11 | 2020-03-19 | 한국산업기술대학교산학협력단 | 적응적 분류에 기반한 영상정합 시스템 및 방법 |

| WO2020205980A1 (en) * | 2019-04-05 | 2020-10-08 | Realnetworks, Inc. | Face liveness detection systems and methods |

| US10997396B2 (en) | 2019-04-05 | 2021-05-04 | Realnetworks, Inc. | Face liveness detection systems and methods |

| US11610437B2 (en) | 2019-04-05 | 2023-03-21 | Realnetworks Llc | Face liveness detection systems and methods |

Also Published As

| Publication number | Publication date |

|---|---|

| KR102120241B1 (ko) | 2020-06-08 |

| WO2017181899A1 (zh) | 2017-10-26 |

| US20180307928A1 (en) | 2018-10-25 |

| JP2019509545A (ja) | 2019-04-04 |

| US10796179B2 (en) | 2020-10-06 |

| EP3447679A1 (en) | 2019-02-27 |

| EP3447679A4 (en) | 2019-04-24 |

| CN105868733A (zh) | 2016-08-17 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR102120241B1 (ko) | 얼굴 생체 검증 방법 및 장치 | |

| JP3954484B2 (ja) | 画像処理装置およびプログラム | |

| JP5445460B2 (ja) | なりすまし検知システム、なりすまし検知方法及びなりすまし検知プログラム | |

| KR102927073B1 (ko) | 안면 인식을 위한 방법 및 시스템 | |

| CN109977770B (zh) | 一种自动跟踪拍摄方法、装置、系统及存储介质 | |

| KR101791590B1 (ko) | 물체 자세 인식장치 및 이를 이용한 물체 자세 인식방법 | |

| US7733404B2 (en) | Fast imaging system calibration | |

| CN110287772B (zh) | 平面手掌掌心区域提取方法及装置 | |

| US20140092132A1 (en) | Systems and methods for 3d pose estimation | |

| JP2008506953A5 (ko) | ||

| WO2018228218A1 (zh) | 身份识别方法、计算设备及存储介质 | |

| WO2013009662A2 (en) | Calibration between depth and color sensors for depth cameras | |

| US11182636B2 (en) | Method and computing device for adjusting region of interest | |

| CN104246793A (zh) | 移动设备的三维脸部识别 | |

| US10705217B2 (en) | Controlling multiple imaging sensors | |

| JP6662382B2 (ja) | 情報処理装置および方法、並びにプログラム | |

| CN112818874B (zh) | 一种图像处理方法、装置、设备及存储介质 | |

| US20150178927A1 (en) | Method and system for determining a transformation associated with a capturing device | |

| CN106406507B (zh) | 图像处理方法以及电子设备 | |

| CN116363401B (zh) | 图像匹配方法、装置、电子设备、芯片 | |

| CN113330275B (zh) | 相机信息计算装置、系统、相机信息计算方法及记录介质 | |

| US20240005554A1 (en) | Non-transitory computer-readable recording medium, verification method, and information processing apparatus | |

| WO2005093656A1 (ja) | 特定部分姿勢推定装置、特定部分姿勢推定方法及び特定部分姿勢推定プログラム | |

| Skocaj et al. | Evaluation of performance of smart mobile devices in machine vision tasks | |

| Cui et al. | External calibration of multi-camera system based on efficient pair-wise estimation |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A201 | Request for examination | ||

| AMND | Amendment | ||

| E13-X000 | Pre-grant limitation requested |

St.27 status event code: A-2-3-E10-E13-lim-X000 |

|

| P11-X000 | Amendment of application requested |

St.27 status event code: A-2-2-P10-P11-nap-X000 |

|

| P13-X000 | Application amended |

St.27 status event code: A-2-2-P10-P13-nap-X000 |

|

| PA0105 | International application |

St.27 status event code: A-0-1-A10-A15-nap-PA0105 |

|

| PA0201 | Request for examination |

St.27 status event code: A-1-2-D10-D11-exm-PA0201 |

|

| PG1501 | Laying open of application |

St.27 status event code: A-1-1-Q10-Q12-nap-PG1501 |

|

| E902 | Notification of reason for refusal | ||

| PE0902 | Notice of grounds for rejection |

St.27 status event code: A-1-2-D10-D21-exm-PE0902 |

|

| AMND | Amendment | ||

| E13-X000 | Pre-grant limitation requested |

St.27 status event code: A-2-3-E10-E13-lim-X000 |

|

| P11-X000 | Amendment of application requested |

St.27 status event code: A-2-2-P10-P11-nap-X000 |

|

| P13-X000 | Application amended |

St.27 status event code: A-2-2-P10-P13-nap-X000 |

|

| E601 | Decision to refuse application | ||

| PE0601 | Decision on rejection of patent |

St.27 status event code: N-2-6-B10-B15-exm-PE0601 |

|

| X091 | Application refused [patent] | ||

| AMND | Amendment | ||

| P11-X000 | Amendment of application requested |

St.27 status event code: A-2-2-P10-P11-nap-X000 |

|

| P13-X000 | Application amended |

St.27 status event code: A-2-2-P10-P13-nap-X000 |

|

| PX0901 | Re-examination |

St.27 status event code: A-2-3-E10-E12-rex-PX0901 |

|

| PX0701 | Decision of registration after re-examination |

St.27 status event code: A-3-4-F10-F13-rex-PX0701 |

|

| X701 | Decision to grant (after re-examination) | ||

| GRNT | Written decision to grant | ||

| PR0701 | Registration of establishment |

St.27 status event code: A-2-4-F10-F11-exm-PR0701 |

|

| PR1002 | Payment of registration fee |

St.27 status event code: A-2-2-U10-U12-oth-PR1002 Fee payment year number: 1 |

|

| PG1601 | Publication of registration |

St.27 status event code: A-4-4-Q10-Q13-nap-PG1601 |

|

| P22-X000 | Classification modified |

St.27 status event code: A-4-4-P10-P22-nap-X000 |

|

| PR1001 | Payment of annual fee |

St.27 status event code: A-4-4-U10-U11-oth-PR1001 Fee payment year number: 4 |

|

| PR1001 | Payment of annual fee |

St.27 status event code: A-4-4-U10-U11-oth-PR1001 Fee payment year number: 5 |

|

| PR1001 | Payment of annual fee |

St.27 status event code: A-4-4-U10-U11-oth-PR1001 Fee payment year number: 6 |

|

| U11 | Full renewal or maintenance fee paid |

Free format text: ST27 STATUS EVENT CODE: A-4-4-U10-U11-OTH-PR1001 (AS PROVIDED BY THE NATIONAL OFFICE) Year of fee payment: 6 |