KR20120071279A - 입체 영상의 오차 보정 장치 및 그 방법 - Google Patents

입체 영상의 오차 보정 장치 및 그 방법 Download PDFInfo

- Publication number

- KR20120071279A KR20120071279A KR1020110024032A KR20110024032A KR20120071279A KR 20120071279 A KR20120071279 A KR 20120071279A KR 1020110024032 A KR1020110024032 A KR 1020110024032A KR 20110024032 A KR20110024032 A KR 20110024032A KR 20120071279 A KR20120071279 A KR 20120071279A

- Authority

- KR

- South Korea

- Prior art keywords

- image

- error

- phase difference

- interest

- camera

- Prior art date

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/10—Segmentation; Edge detection

- G06T7/13—Edge detection

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/10—Segmentation; Edge detection

- G06T7/174—Segmentation; Edge detection involving the use of two or more images

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/20—Image signal generators

- H04N13/204—Image signal generators using stereoscopic image cameras

- H04N13/246—Calibration of cameras

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

Landscapes

- Engineering & Computer Science (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Testing, Inspecting, Measuring Of Stereoscopic Televisions And Televisions (AREA)

Abstract

입체 영상의 오차 보정 장치는 입체 영상을 구성하는 좌측 영상과 우측 영상을 각각 촬영하는 두 개의 카메라, 좌측 영상과 우측 영상에서 각각 주요 관심 영역을 추출하는 영역 추출부, 좌측 영상의 주요 관심 영역과 우측 영상의 주요 관심 영역의 위상차를 연산하는 위상차 연산부, 주요 관심 영역의 위상차를 토대로 두 개의 카메라의 위치에 해당하는 카메라 배치 오차값을 추출하는 오차값 추출부 및 카메라 배치 오차값이 설정 범위 내에 존재하는지를 판단하고, 판단한 결과를 토대로 입체 영상의 오차를 보정하는 오차 분석부를 포함한다.

Description

본 발명은 입체 영상의 오차 보정 장치 및 그 방법에 관한 것이다. 보다 상세하게는 입체 영상을 촬영하는 경우에 발생하는 오차를 보정하는 장치 및 그 방법에 관한 것이다.

사람은 자신의 좌우안이 각기 다른 위치에서 다른 영상을 뇌로 전달하므로, 물체를 바라보는 경우에 물체의 깊이감을 인지할 수 있다. 즉, 사람의 뇌는 좌우안을 통해 입력받은 2개의 영상의 위상 차이를 이용하여 물체의 깊이를 인지한다.

그래서, 입체 동영상을 촬영하는 경우에는 사람의 왼쪽 눈과 오른쪽 눈에 대응하는 좌우 두 개의 카메라가 필요하다. 이때, 두 개의 카메라를 이용하여 원하는 깊이감을 연출하기 위해서는 "리그(Rig)"라는 장치가 필요하다. 리그는 두 개의 카메라를 올려놓을 수 있는 거치대 역할을 하기도 하지만, 사람의 눈과 같이 카메라의 위치와 방향을 잡는 중요한 역할을 한다.

종래의 두 개의 카메라와 리그를 포함하는 입체 동영상 촬영 장치는 두 개의 카메라의 위치, 각 카메라가 촬영하는 방향 등에 대응하게 영상의 깊이감을 표현할 수 있다.

하지만, 두 개의 카메라의 잘못된 배치로 인하여 사용자에게 어지러움증을 유발할 수 있다. 예를 들어, 두 개의 카메라의 좌표축이 각각 다른 방향을 가리키고 있거나 뒤틀려 있는 등과 같이 사람의 눈으로는 발생할 수 없는 상황에서의 사용자는 영상의 깊이를 인지하는 과정 중 어지러움증을 느낄 수 있다.

그러므로, 영상의 깊이를 인지하는 과정에서는 잘못된 카메라의 배치를 반드시 바로 잡아야 한다. 카메라의 위치를 보정하는 방법은 카메라를 통해 촬영된 좌우 영상을 촬영 감독이 직접 눈으로 보고 맞추는 방법, 특정 이미지 프로세서를 적용하여 교정하는 방법 등이 있다.

예를 들어, 이미지 프로세서들을 이용하여 HD급 이상의 동영상을 분석하는 경우에는 동영상이 포함하는 각각의 픽셀에 이미지 프로세서를 각각 적용함에 따라 발생하는 프로세싱 타임으로 인하여 프레임의 지연 또는 손실이 발생하는 문제점이 있다.

HD급 입체 동영상은 한 프레임당 가로 1280 픽셀 X 세로 1024 픽셀 = 약1.3M 픽셀들을 포함한다. 또한, HD급 입체 동영상의 경우에는 초당 25프레임 이상의 좌우 두 개의 영상(두 개의 카메라를 통해 획득한 영상)을 처리해야 실시간 처리가 가능하다. 즉, 좌우 두 개의 영상의 위상 차이를 분석하기 위해서는 약 초당 65M 픽셀을 분석해야 한다.

하지만, 좌우 두 개의 영상을 분석하는 방법은 복잡한 알고리즘으로 인하여 실시간 처리가 힘들고, 프레임의 지연이 발생하거나 프레임 손실 현상이 일어나는 문제점이 있다.

본 발명의 목적은, 입체 영상을 촬영하는 경우에 발생하는 오차를 실시간으로 보정하는 장치 및 그 방법을 제공하는 것이다.

상기 과제를 해결하기 위한 본 발명의 실시예에 따른, 입체 영상의 오차 보정 장치는

입체 영상을 구성하는 좌측 영상과 우측 영상을 각각 촬영하는 두 개의 카메라; 상기 좌측 영상과 상기 우측 영상에서 각각 주요 관심 영역을 추출하는 영역 추출부; 상기 좌측 영상의 주요 관심 영역과 상기 우측 영상의 주요 관심 영역의 위상차를 연산하는 위상차 연산부; 상기 주요 관심 영역의 위상차를 토대로 상기 두 개의 카메라의 위치에 해당하는 카메라 배치 오차값을 추출하는 오차값 추출부; 및 상기 카메라 배치 오차값이 설정 범위 내에 존재하는지를 판단하고, 판단한 결과를 토대로 상기 입체 영상의 오차를 보정하는 오차 분석부를 포함한다.

상기 영역 추출부는 상기 좌측 영상과 상기 우측 영상을 각각 복수개의 영역으로 분할하고, 분할한 영역 중 포커싱 영역과 모서리 영역을 상기 주요 관심 영역으로 추출한다.

상기 포커싱 영역은 상기 좌측 영상과 상기 우측 영상 각각의 중심 영역으로 해당 카메라가 초점을 맞추고 있는 지점을 포함하는 것을 특징으로 한다.

상기 모서리 영역은 상기 좌측 영상과 상기 우측 영상 각각의 모서리 부분에 해당하는 영역인 것을 특징으로 한다.

상기 위상차 연산부는 상기 위상차에 대응하는 이동 벡터를 상기 주요 관심 영역에 표시하여 위상차 분석도를 생성하는 것을 특징으로 한다.

상기 이동 벡터는 상기 좌측 영상의 주요 관심 영역이 상기 우측 영상의 주요 관심 영역과 매칭되기 위하여 이동하는 형태인 것을 특징으로 한다.

상기 카메라 배치 오차값은 상기 입체 영상을 촬영하는 기준 카메라 위치와 상기 두 개의 카메라 위치의 오차값에 해당하는 것을 특징으로 한다.

상기 오차 분석부는 상기 카메라 배치 오차값이 상기 설정 범위를 벗어난 경우, 수동 또는 자동으로 상기 두 개의 카메라의 배치를 교정하는 것을 특징으로 한다.

상기 오차 분석부는 상기 카메라 배치 오차값이 상기 설정 범위를 벗어난 경우, 이미지 프로세싱을 통해 상기 좌측 영상 내지 상기 우측 영상을 교정하는 것을 특징으로 한다.

상기 과제를 해결하기 위한 본 발명의 다른 실시예에 따른, 두 개의 카메라를 이용하여 획득한 입체 영상의 오차를 보정하는 방법은

상기 입체 영상을 구성하는 좌측 영상 및 우측 영상을 획득하는 단계; 상기 좌측 영상과 상기 우측 영상에서 각각 주요 관심 영역을 추출하는 단계; 상기 좌측 영상의 주요 관심 영역과 상기 우측 영상의 주요 관심 영역의 위상차를 연산하는 단계; 상기 주요 관심 영역의 위상차를 토대로 상기 두 개의 카메라의 위치에 해당하는 카메라 배치 오차값을 추출하는 단계; 및 상기 카메라 배치 오차값이 설정 범위 내에 존재하는지를 판단하고, 판단한 결과를 토대로 상기 입체 영상의 오차를 보정하는 단계를 포함한다.

상기 주요 관심 영역을 추출하는 단계는 상기 좌측 영상과 상기 우측 영상을 각각 복수개의 영역으로 분할하는 단계; 및 분할한 영역 중 포커싱 영역과 모서리 영역을 상기 주요 관심 영역으로 추출하는 단계를 포함한다.

상기 포커싱 영역은 상기 좌측 영상과 상기 우측 영상 각각의 중심 영역으로 해당 카메라가 초점을 맞추고 있는 지점을 포함하는 것을 특징으로 한다.

상기 모서리 영역은 상기 좌측 영상과 상기 우측 영상 각각의 모서리 부분에 해당하는 영역인 것을 특징으로 한다.

상기 위상차를 연산하는 단계는 상기 위상차에 대응하는 이동 벡터를 상기 주요 관심 영역에 표시하여 위상차 분석도를 생성하는 단계를 더 포함한다.

상기 이동 벡터는 상기 좌측 영상의 주요 관심 영역이 상기 우측 영상의 주요 관심 영역과 매칭되기 위하여 이동하는 형태인 것을 특징으로 한다.

상기 카메라 배치 오차값은 상기 입체 영상을 촬영하는 기준 카메라 위치와 상기 두 개의 카메라 위치의 오차값에 해당하는 것을 특징으로 한다.

상기 입체 영상의 오차를 보정하는 단계는 상기 카메라 배치 오차값이 상기 설정 범위를 벗어난 경우, 수동 또는 자동으로 상기 두 개의 카메라의 배치를 교정하여 상기 입체 영상의 오차를 보정한다.

상기 입체 영상의 오차를 보정하는 단계는 상기 카메라 배치 오차값이 상기 설정 범위를 벗어난 경우, 이미지 프로세싱을 통해 상기 입체 영상의 오차를 보정한다.

본 발명의 실시예에 따르면, 입체 영상의 오차 보정 장치 및 그 방법은 실시간으로 입체 동영상을 처리하는 과정에서 발생하는 영상의 픽셀 데이터 용량을 오차 분석을 위한 주요 관심 영역으로 한정함으로써, 분석 시간을 감소 시킬 수 있다.

또한, 주요 관심 영역은 주로 오차가 많이 나타나거나 초점이 맞춰지는 중요 지점으로 한정함으로써, 촬영 감독이 직접 눈으로 보고 수동으로 오차를 찾아낼 때 주로 참조되는 영역과 유사한 유효성을 확인 할 수 잇다.

도 1은 본 발명의 실시예에 따른 입체 영상의 오차 보정 장치를 개략적으로 나타내는 구성도이다.

도 2는 본 발명의 실시예에 따른 입체 영상의 오차 보정 장치에 적용하는 좌우 영상을 나타내는 도면이다.

도 3은 본 발명의 실시예에 따른 입체 영상의 오차 보정 장치에 적용하는 좌우 영상에서 주요 관심 영역을 나타내는 도면이다.

도 4는 본 발명의 실시예에 따른 촬영 대상에 해당하는 좌우 영상을 나타내는 도면이다.

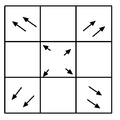

도 5는 본 발명의 실시예에 따른 입체 영상을 촬영하는 두 개의 카메라의 배치가 적합한 경우의 위상차를 나타내는 도면이다.

도 6 내지 도 8은 본 발명의 실시예에 따른 입체 영상을 촬영하는 두 개의 카메라의 배치가 잘못되었을 경우의 위상차를 나타내는 도면이다.

도 9는 본 발명의 실시예에 따른 입체 영상의 오차 보정 방법을 적용하는 입체 촬영 방법을 나타내는 흐름도이다.

도 10은 본 발명의 실시예에 따른 입체 영상의 오차 보정 방법을 나타내는 흐름도이다.

도 2는 본 발명의 실시예에 따른 입체 영상의 오차 보정 장치에 적용하는 좌우 영상을 나타내는 도면이다.

도 3은 본 발명의 실시예에 따른 입체 영상의 오차 보정 장치에 적용하는 좌우 영상에서 주요 관심 영역을 나타내는 도면이다.

도 4는 본 발명의 실시예에 따른 촬영 대상에 해당하는 좌우 영상을 나타내는 도면이다.

도 5는 본 발명의 실시예에 따른 입체 영상을 촬영하는 두 개의 카메라의 배치가 적합한 경우의 위상차를 나타내는 도면이다.

도 6 내지 도 8은 본 발명의 실시예에 따른 입체 영상을 촬영하는 두 개의 카메라의 배치가 잘못되었을 경우의 위상차를 나타내는 도면이다.

도 9는 본 발명의 실시예에 따른 입체 영상의 오차 보정 방법을 적용하는 입체 촬영 방법을 나타내는 흐름도이다.

도 10은 본 발명의 실시예에 따른 입체 영상의 오차 보정 방법을 나타내는 흐름도이다.

본 발명을 첨부된 도면을 참조하여 상세히 설명하면 다음과 같다. 여기서, 반복되는 설명, 본 발명의 요지를 불필요하게 흐릴 수 있는 공지 기능, 및 구성에 대한 상세한 설명은 생략한다. 본 발명의 실시형태는 당 업계에서 평균적인 지식을 가진 자에게 본 발명을 보다 완전하게 설명하기 위해서 제공되는 것이다. 따라서, 도면에서의 요소들의 형상 및 크기 등은 보다 명확한 설명을 위해 과장될 수 있다.

이하에서는, 본 발명의 실시예에 따른 입체 영상의 오차 보정 장치 및 그 방법에 대하여 첨부한 도면을 참고로 하여 상세히 설명한다.

도 1은 본 발명의 실시예에 따른 입체 영상의 오차 보정 장치를 개략적으로 나타내는 구성도이다.

도 1을 참고하면, 입체 영상의 오차 보정 장치는 촬영부(100), 영역 추출부(200), 위상차 연산부(300), 오차값 추출부(400) 및 오차 분석부(500)를 포함한다.

촬영부(100)는 입체 영상을 촬영하는 카메라 즉, 동일한 촬영 대상의 좌측 및 우측을 촬영하는 두 개의 카메라를 포함한다. 이때, 두 개의 카메라는 HD급 이상의 입체 동영상을 촬영하는 장치에 해당한다. 도 2와 같이, 촬영부(100)는 두 개의 카메라를 이용하여 촬영 대상에 해당하는 좌우 영상(L, R)을 획득한다.

본 발명의 실시예에 따른, 촬영부(100)가 포함하는 두 개의 카메라는 사람의 눈과 유사한 구조로 촬영 대상에 해당하는 좌우 영상(L, R)을 획득하고, 이에 한정되지 않는다.

영역 추출부(200)는 좌우 영상에서 주요 관심 영역을 추출한다. 여기서, 주요 관심 영역은 좌우 영상 전체에서 도 3과 같이 추출될 수 있으며, 이에 한정되지 않는다. 또한, 영역 추출부(200)는 추출한 주요 관심 영역을 음영으로 도시한다.

도 3과 같이, 영역 추출부(200)는 좌우 영상을 복수개의 영역으로 분할하고, 분할한 영역 중 포커싱 영역(A)과 모서리 영역(B)을 주요 관심 영역으로 추출한다. 여기서, 포커싱 영역(A)은 좌우 영상 각각의 중심 영역으로 관심도가 가장 높은 영역이다. 또한, 포커싱 영역(A)은 두 개의 카메라가 초점을 맞추고 있는 지점을 포함하며, 전체 영상에서 좌우 영상의 위상차가 가장 적게 나타나게 되는 영역이다. 모서리 영역(B)은 전체 영상의 모서리 부분에 해당하는 영역으로, 카메라 배치 오류로 인하여 영상의 위상차가 많이 날 수 있는 영역이다.

위상차 연산부(300)는 좌측 영상의 주요 관심 영역과 우측 영상의 주요 관심 영역의 위상차를 연산하고, 연산한 결과를 토대로 위상차 분석도를 생성한다.

예를 들어, 위상차 연산부(300)는 도 4와 같은 좌우 영상(L, R)의 위상차를 연산한다. 다음, 위상차 연산부(300)는 위상차를 토대로 도 5와 같은 위상차 분석도를 생성한다.

도 5는 두 개의 카메라 배치가 촬영 대상을 촬영하기에 가장 적합한 위치 즉, 기준 카메라 위치에 대응하는 위상차 분석도이다.

도 5를 참고하면, 위상차 분석도가 포함하는 화살표는 좌측 영상의 특징점들이 우측 영상의 특징점들로 매칭되기 위한 이동 벡터에 해당한다.

다음, 위상차 연산부(300)는 좌우 영상의 주요 관심 영역(A, B)에서만 위상차를 연산하고, 연산한 결과를 토대로 이동 벡터 즉, 화살표를 주요 관심 영역에 표시한다. 여기서, 화살표들은 영상의 깊이감을 나타내기 위하여 연출되는 두 개의 카메라의 수직, 수평, 회전 및 확대 이동 등을 나타낸다.

다음, 입체 영상을 촬영하는 두 개의 카메라의 배치가 잘못되었을 경우의 위상차를 도 6 내지 도 8을 참조하여 상세하게 설명한다.

도 6은 본 발명의 실시예에 따른 우측 카메라가 좌측 카메라보다 확대되어 있을 경우, 좌측 영상의 주요 관심 영역과 우측 영상의 주요 관심 영역의 위상차를 나타내는 위상차 분석도이다.

도 6을 참고하면, 위상차 분석도의 밖을 향하고 있는 화살표는 좌측 영상의 특징점들이 확대되어 있는 우측 영상의 특징점들로 매칭되기 위한 이동 벡터에 해당한다. 즉, 위상차 연산부(300)는 위상차를 토대로 우측 카메라가 좌측 카메라보다 확대되어 있는 것을 알 수 있다.

도 7은 본 발명의 실시예에 따른 우측 카메라가 좌측 카메라보다 위쪽에 위치되어 있을 경우, 좌측 영상의 주요 관심 영역과 우측 영상의 주요 관심 영역의 위상차를 나타내는 위상차 분석도이다.

도 7을 참고하면, 위상차 분석도에서 위를 향하고 있는 화살표는 좌측 영상의 특징점들이 위쪽에 위치하는 우측 영상의 특징점들로 매칭되기 위한 이동 벡터에 해당한다. 즉, 위상차 연산부(300)는 위상차를 토대로 우측 카메라가 좌측 카메라보다 위쪽에 배치되어 있는 것을 알 수 있다.

도 8은 본 발명의 실시예에 따른 우측 카메라가 Z축으로 회전되어 있을 경우, 좌측 영상의 주요 관심 영역과 우측 영상의 주요 관심 영역의 위상차를 나타내는 위상차 분석도이다.

위상차 연산부(300)는 좌측 영상과 우측 영상의 모든 영역이 아닌 주요 관심 영역의 위상차를 연산함으로써, 카메라의 배치 오류를 빠르게 찾을 수 있다. 또한, 위상차 연산부(300)는 위상차 연산을 수행해야하는 대상을 5/9로 줄임으로써 실시간성을 보장할 수 있다.

오차값 추출부(400)는 주요 관심 영역의 위상차를 연산한 결과를 토대로 좌우 카메라의 위치에 해당하는 카메라 배치 오차값을 추출한다. 여기서, 카메라 배치 오차값은 촬영 대상을 촬영하기에 가장 적합한 위치에 해당하는 기준 카메라 위치와 좌우 카메라 위치의 오차값에 해당한다.

오차 분석부(500)는 카메라 배치 오차값이 설정 범위를 벗어난 경우, 수동 또는 자동으로 좌우 카메라의 배치를 교정한다. 이와 같이, 카메라의 배치를 직접적으로 교정하는 방법 외에, 오차 분석부(500)는 이미지 프로세싱으로 좌우 영상을 간접적으로 교정할 수 있다. 이때, 오차 분석부(500)는 이미지 프로세싱을 수행하는 이미지 프로세서를 포함한다. 예를 들어, 오차 분석부(500)는 이미지 프로세서에 오차값을 적용하여 교정된 좌우 영상을 획득한다.

다음, 입체 영상의 오차 보정 방법을 적용하는 입체 촬영 방법을 도 9를 참조하여 상세하게 설명한다.

도 9는 본 발명의 실시예에 따른 입체 영상의 오차 보정 방법을 적용하는 입체 영상 촬영 방법을 나타내는 흐름도이다.

먼저, 본 발명의 실시예에 따른 입체 영상을 촬영하는 촬영 시스템(도시하지 않음)은 촬영 대상의 좌측 및 우측을 촬영하는 두 개의 카메라를 포함한다.

도 9를 참고하면, 촬영 시스템은 두 개의 카메라를 이용하여 촬영 대상에 해당하는 좌우 영상(L, R)을 획득한다(S100). 이때, 두 개의 카메라는 촬영 대상으로부터 일정 거리만큼 떨어진 지점에서 사람의 좌우안과 같은 형태로 좌우 영상을 획득한다.

촬영 시스템은 획득한 좌우 영상을 토대로 카메라 배치 오차값을 분석한다(S200). 여기서, 카메라 배치 오차값은 촬영 대상을 촬영하기에 가장 적합한 위치에 해당하는 기준 카메라 위치와 좌우 카메라 위치의 오차값에 해당한다. 분석 결과, 카메라 배치 오차값이 설정 범위를 벗어난 경우, 촬영 시스템은 좌우 카메라의 배치를 교정한다(S300).

다음, 촬영 시스템은 이미지 프로세싱을 통해 교정된 좌우 영상을 획득한다(S400).

촬영 시스템은 교정된 좌우 영상에 대응하는 입체 영상을 인코딩한다(S500). 또한, 촬영 시스템은 좌우 영상의 카메라 배치 오차값이 설정 범위 내에 있는 경우, 좌우 영상에 대응하는 입체 영상을 인코딩한다.

다음, 입체 영상을 촬영하는 과정에서 발생하는 카메라 배치 오차값 즉, 입체 영상의 오차를 보정하는 방법을 도 10을 참조하여 상세하게 설명한다.

도 10은 본 발명의 실시예에 따른 입체 영상의 오차 보정 방법을 나타내는 흐름도이다.

먼저, 본 발명의 실시예에 따른 입체 영상의 오차 보정 장치는 입체 영상을 촬영하는 촬영 시스템과 연동하여 동작할 수 있으며, 이에 한정되지 않는다. 또한, 입체 영상의 오차 보정 장치는 두 개의 카메라를 이용하여 촬영 대상에 해당하는 좌우 영상을 획득한다.

도 10을 참고하면, 입체 영상의 오차 보정 장치는 좌우 영상에서 주요 관심 영역을 추출한다(S210). 구체적으로, 오차 보정 장치는 좌우 영상을 각각 복수개의 영역으로 분할하고, 분할한 영역 중 주요 관심 영역으로 추출한다. 여기서, 주요 관심 영역은 포커싱 영역(A)과 모서리 영역(B)을 포함한다.

오차 보정 장치는 좌측 영상의 주요 관심 영역과 우측 영상의 주요 관심 영역의 위상차를 연산한다(S220). 또한, 오차 보정 장치는 연산한 결과 즉, 위상차에 대응하는 이동 벡터를 주요 관심 영역에 표시하여 위상차 분석도를 생성한다. 여기서, 위상차 분석도는 도 5 내지 도 8과 같이 나타낸다. 이때, 이동 벡터는 영상의 깊이감을 나타내기 위하여 연출되는 두 개의 카메라의 수평 이동을 나타내는 화살표이다.

오차 보정 장치는 주요 관심 영역의 위상차를 토대로 좌우 카메라의 위치에 해당하는 카메라 배치 오차값을 추출한다(S230). 여기서, 카메라 배치 오차값은 촬영 대상을 촬영하기에 가장 적합한 위치에 해당하는 기준 카메라 위치와 좌우 카메라 위치 간의 오차값에 해당한다.

오차 보정 장치는 카메라 배치 오차값이 설정 범위 내에 위치하는지를 판단하고, 판단한 결과를 토대로 카메라 배치 오차값의 안전성 여부를 검증한다(S240).

구체적으로, 오차 보정 장치는 카메라 배치 오차값이 설정 범위 내에 위치하는 경우, 카메라 배치 오차값이 안전한 범위에 속하는 것으로 판단한다.

반면에, 오차 보정 장치는 카메라 배치 오차값이 설정 범위 내에 위치하지 않는 경우, 카메라 배치 오차값에 대응하는 좌우 카메라의 배치가 잘못 되어 있는 것으로 판단한다. 또한, 오차 보정 장치는 카메라 배치 오차값을 토대로 수동 또는 자동으로 좌우 카메라의 배치를 교정한다.

이처럼, 본 발명의 실시예에 따른 입체 영상의 오차 보정 방법은 좌우 영상의 모든 영역의 위상차를 연산하지 않고도 카메라 배치 오차값을 산출할 수 있으며, 위상차 연산을 수행해야하는 대상을 5/9로 줄임으로써 실시간성을 보장할 수 있다.

이상에서와 같이 도면과 명세서에서 최적의 실시예가 개시되었다. 여기서 특정한 용어들이 사용되었으나, 이는 단지 본 발명을 설명하기 위한 목적에서 사용된 것이지 의미 한정이나 특허청구범위에 기재된 본 발명의 범위를 제한하기 위하여 사용된 것은 아니다. 그러므로, 본 기술 분야의 통상의 지식을 가진자라면 이로부터 다양한 변형 및 균등한 타 실시예가 가능하다는 점을 이해할 것이다. 따라서, 본 발명의 진정한 기술적 보호범위는 첨부된 특허청구범위의 기술적 사상에 의해 정해져야 할 것이다.

100; 촬영부

200; 추출부

300; 위상차 연산부

400; 오차값 추출부

500; 오차 분석부

200; 추출부

300; 위상차 연산부

400; 오차값 추출부

500; 오차 분석부

Claims (18)

- 입체 영상을 구성하는 좌측 영상과 우측 영상을 각각 촬영하는 두 개의 카메라;

상기 좌측 영상과 상기 우측 영상에서 각각 주요 관심 영역을 추출하는 영역 추출부;

상기 좌측 영상의 주요 관심 영역과 상기 우측 영상의 주요 관심 영역의 위상차를 연산하는 위상차 연산부;

상기 주요 관심 영역의 위상차를 토대로 상기 두 개의 카메라의 위치에 해당하는 카메라 배치 오차값을 추출하는 오차값 추출부; 및

상기 카메라 배치 오차값이 설정 범위 내에 존재하는지를 판단하고, 판단한 결과를 토대로 상기 입체 영상의 오차를 보정하는 오차 분석부

를 포함하는 입체 영상의 오차 보정 장치. - 청구항 1에 있어서,

상기 영역 추출부는

상기 좌측 영상과 상기 우측 영상을 각각 복수개의 영역으로 분할하고, 분할한 영역 중 포커싱 영역과 모서리 영역을 상기 주요 관심 영역으로 추출하는 입체 영상의 오차 보정 장치. - 청구항 2에 있어서,

상기 포커싱 영역은 상기 좌측 영상과 상기 우측 영상 각각의 중심 영역으로 해당 카메라가 초점을 맞추고 있는 지점을 포함하는 것을 특징으로 하는 입체 영상의 오차 보정 장치. - 청구항 2에 있어서,

상기 모서리 영역은 상기 좌측 영상과 상기 우측 영상 각각의 모서리 부분에 해당하는 영역인 것을 특징으로 하는 입체 영상의 오차 보정 장치. - 청구항 1에 있어서,

상기 위상차 연산부는

상기 위상차에 대응하는 이동 벡터를 상기 주요 관심 영역에 표시하여 위상차 분석도를 생성하는 것을 특징으로 하는 입체 영상의 오차 보정 장치. - 청구항 5에 있어서,

상기 이동 벡터는

상기 좌측 영상의 주요 관심 영역이 상기 우측 영상의 주요 관심 영역과 매칭되기 위하여 이동하는 형태인 것을 특징으로 하는 입체 영상의 오차 보정 장치. - 청구항 1에 있어서,

상기 카메라 배치 오차값은

상기 입체 영상을 촬영하는 기준 카메라 위치와 상기 두 개의 카메라 위치의 오차값에 해당하는 것을 특징으로 하는 입체 영상의 오차 보정 장치. - 청구항 1에 있어서,

상기 오차 분석부는

상기 카메라 배치 오차값이 상기 설정 범위를 벗어난 경우, 수동 또는 자동으로 상기 두 개의 카메라의 배치를 교정하는 것을 특징으로 하는 입체 영상의 오차 보정 장치. - 청구항 1에 있어서,

상기 오차 분석부는

상기 카메라 배치 오차값이 상기 설정 범위를 벗어난 경우, 이미지 프로세싱을 통해 상기 좌측 영상 내지 상기 우측 영상을 교정하는 것을 특징으로 하는 입체 영상의 오차 보정 장치. - 두 개의 카메라를 이용하여 획득한 입체 영상의 오차를 보정하는 방법에 있어서,

상기 입체 영상을 구성하는 좌측 영상 및 우측 영상을 획득하는 단계;

상기 좌측 영상과 상기 우측 영상에서 각각 주요 관심 영역을 추출하는 단계;

상기 좌측 영상의 주요 관심 영역과 상기 우측 영상의 주요 관심 영역의 위상차를 연산하는 단계;

상기 주요 관심 영역의 위상차를 토대로 상기 두 개의 카메라의 위치에 해당하는 카메라 배치 오차값을 추출하는 단계; 및

상기 카메라 배치 오차값이 설정 범위 내에 존재하는지를 판단하고, 판단한 결과를 토대로 상기 입체 영상의 오차를 보정하는 단계

를 포함하는 입체 영상의 오차 보정 방법. - 청구항 10에 있어서,

상기 주요 관심 영역을 추출하는 단계는

상기 좌측 영상과 상기 우측 영상을 각각 복수개의 영역으로 분할하는 단계; 및

분할한 영역 중 포커싱 영역과 모서리 영역을 상기 주요 관심 영역으로 추출하는 단계

를 포함하는 입체 영상의 오차 보정 방법. - 청구항 11에 있어서,

상기 포커싱 영역은

상기 좌측 영상과 상기 우측 영상 각각의 중심 영역으로 해당 카메라가 초점을 맞추고 있는 지점을 포함하는 것을 특징으로 하는 입체 영상의 오차 보정 방법. - 청구항 11에 있어서,

상기 모서리 영역은

상기 좌측 영상과 상기 우측 영상 각각의 모서리 부분에 해당하는 영역인 것을 특징으로 하는 입체 영상의 오차 보정 방법. - 청구항 10에 있어서,

상기 위상차를 연산하는 단계는

상기 위상차에 대응하는 이동 벡터를 상기 주요 관심 영역에 표시하여 위상차 분석도를 생성하는 단계

를 더 포함하는 영상의 오차 보정 방법. - 청구항 14에 있어서,

상기 이동 벡터는

상기 좌측 영상의 주요 관심 영역이 상기 우측 영상의 주요 관심 영역과 매칭되기 위하여 이동하는 형태인 것을 특징으로 하는 영상의 오차 보정 방법. - 청구항 10에 있어서,

상기 카메라 배치 오차값은

상기 입체 영상을 촬영하는 기준 카메라 위치와 상기 두 개의 카메라 위치의 오차값에 해당하는 것을 특징으로 하는 입체 영상의 오차 보정 방법. - 청구항 10에 있어서,

상기 입체 영상의 오차를 보정하는 단계는

상기 카메라 배치 오차값이 상기 설정 범위를 벗어난 경우, 수동 또는 자동으로 상기 두 개의 카메라의 배치를 교정하여 상기 입체 영상의 오차를 보정하는 입체 영상의 오차 보정 방법. - 청구항 10에 있어서,

상기 입체 영상의 오차를 보정하는 단계는

상기 카메라 배치 오차값이 상기 설정 범위를 벗어난 경우, 이미지 프로세싱을 통해 상기 입체 영상의 오차를 보정하는 입체 영상의 오차 보정 방법.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US13/335,612 US20120162386A1 (en) | 2010-12-22 | 2011-12-22 | Apparatus and method for correcting error in stereoscopic image |

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| KR1020100132867 | 2010-12-22 | ||

| KR20100132867 | 2010-12-22 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20120071279A true KR20120071279A (ko) | 2012-07-02 |

Family

ID=46706357

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020110024032A KR20120071279A (ko) | 2010-12-22 | 2011-03-17 | 입체 영상의 오차 보정 장치 및 그 방법 |

Country Status (1)

| Country | Link |

|---|---|

| KR (1) | KR20120071279A (ko) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11575821B2 (en) | 2018-09-21 | 2023-02-07 | Lg Innotek Co., Ltd. | Camera device having first and second cameras, and method of operating same |

-

2011

- 2011-03-17 KR KR1020110024032A patent/KR20120071279A/ko not_active Application Discontinuation

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11575821B2 (en) | 2018-09-21 | 2023-02-07 | Lg Innotek Co., Ltd. | Camera device having first and second cameras, and method of operating same |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US10609282B2 (en) | Wide-area image acquiring method and apparatus | |

| US10460521B2 (en) | Transition between binocular and monocular views | |

| KR102170182B1 (ko) | 패턴 프로젝션을 이용한 왜곡 보정 및 정렬 시스템, 이를 이용한 방법 | |

| US10157477B2 (en) | Robust head pose estimation with a depth camera | |

| EP3190781B1 (en) | Autofocus method, device and electronic apparatus | |

| US8890934B2 (en) | Stereoscopic image aligning apparatus, stereoscopic image aligning method, and program of the same | |

| JP6289811B2 (ja) | 映像処理装置及び方法 | |

| US20170316582A1 (en) | Robust Head Pose Estimation with a Depth Camera | |

| US9619886B2 (en) | Image processing apparatus, imaging apparatus, image processing method and program | |

| US9613404B2 (en) | Image processing method, image processing apparatus and electronic device | |

| US20130258059A1 (en) | Three-dimensional (3d) image photographing apparatus and method | |

| US20120162386A1 (en) | Apparatus and method for correcting error in stereoscopic image | |

| JPWO2018189880A1 (ja) | 情報処理装置、情報処理システム、および画像処理方法 | |

| US20080226159A1 (en) | Method and System For Calculating Depth Information of Object in Image | |

| US20160150182A1 (en) | Method and apparatus for providing eye-contact function to multiple points of attendance using stereo image in video conference system | |

| KR20120071279A (ko) | 입체 영상의 오차 보정 장치 및 그 방법 | |

| US10148929B2 (en) | Method of prompting proper rotation angle for image depth establishing | |

| KR101275127B1 (ko) | 초점 가변 액체 렌즈를 이용한 3차원 이미지 촬영장치 및 방법 | |

| KR102516358B1 (ko) | 영상 처리 방법 및 영상 처리 장치 | |

| US20120154546A1 (en) | Apparatus and method for capturing stereographic images | |

| JP2018149234A (ja) | 注視点推定システム、注視点推定方法及び注視点推定プログラム | |

| KR101813371B1 (ko) | 영상 처리 장치 및 영상 처리 프로그램을 기록한 컴퓨터로 읽을 수 있는 기록 매체 | |

| KR101995985B1 (ko) | 영상회의 시스템에서 스테레오 영상을 이용한 참여자들 눈맞춤 제공 방법 및 장치 | |

| JP2007096480A (ja) | 対象物追跡装置及び対象物追跡方法 | |

| US10425594B2 (en) | Video processing apparatus and method and computer program for executing the video processing method |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| WITN | Withdrawal due to no request for examination |