KR20120031260A - 3d 비디오 콘텐츠의 적응 - Google Patents

3d 비디오 콘텐츠의 적응 Download PDFInfo

- Publication number

- KR20120031260A KR20120031260A KR1020110095851A KR20110095851A KR20120031260A KR 20120031260 A KR20120031260 A KR 20120031260A KR 1020110095851 A KR1020110095851 A KR 1020110095851A KR 20110095851 A KR20110095851 A KR 20110095851A KR 20120031260 A KR20120031260 A KR 20120031260A

- Authority

- KR

- South Korea

- Prior art keywords

- max

- shift

- stereoscopic image

- image pair

- maximum

- Prior art date

Links

- 230000006978 adaptation Effects 0.000 title claims description 21

- 238000000034 method Methods 0.000 claims abstract description 18

- 238000001914 filtration Methods 0.000 claims description 14

- 230000002123 temporal effect Effects 0.000 claims description 7

- 238000003860 storage Methods 0.000 claims description 5

- 230000000694 effects Effects 0.000 abstract description 11

- 230000015572 biosynthetic process Effects 0.000 description 5

- 238000003786 synthesis reaction Methods 0.000 description 5

- 230000000007 visual effect Effects 0.000 description 3

- 208000003464 asthenopia Diseases 0.000 description 2

- 239000012141 concentrate Substances 0.000 description 2

- 238000004519 manufacturing process Methods 0.000 description 2

- 210000001525 retina Anatomy 0.000 description 2

- 206010013082 Discomfort Diseases 0.000 description 1

- 206010019233 Headaches Diseases 0.000 description 1

- 208000002193 Pain Diseases 0.000 description 1

- 230000003750 conditioning effect Effects 0.000 description 1

- 230000001627 detrimental effect Effects 0.000 description 1

- 238000010586 diagram Methods 0.000 description 1

- 238000009826 distribution Methods 0.000 description 1

- 238000011156 evaluation Methods 0.000 description 1

- 231100000869 headache Toxicity 0.000 description 1

- 230000008447 perception Effects 0.000 description 1

- 230000002265 prevention Effects 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/10—Processing, recording or transmission of stereoscopic or multi-view image signals

- H04N13/106—Processing image signals

- H04N13/144—Processing image signals for flicker reduction

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/50—Depth or shape recovery

- G06T7/55—Depth or shape recovery from multiple images

- G06T7/593—Depth or shape recovery from multiple images from stereo images

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/10—Processing, recording or transmission of stereoscopic or multi-view image signals

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/10—Processing, recording or transmission of stereoscopic or multi-view image signals

- H04N13/106—Processing image signals

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N13/00—Stereoscopic video systems; Multi-view video systems; Details thereof

- H04N13/10—Processing, recording or transmission of stereoscopic or multi-view image signals

- H04N13/106—Processing image signals

- H04N13/128—Adjusting depth or disparity

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10016—Video; Image sequence

- G06T2207/10021—Stereoscopic video; Stereoscopic image sequence

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N2213/00—Details of stereoscopic systems

- H04N2213/002—Eyestrain reduction by processing stereoscopic signals or controlling stereoscopic devices

Abstract

본 발명은 3D 비디오 콘텐츠 표시의 분야에 관한 것으로서, 구체적으로는 상이한 관찰 조건들에서의 표시를 위한 3D 비디오 콘텐츠의 적응에 관한 것이다. 본 발명에 따르면, 3D 비디오 콘텐츠를 디스플레이에 적응시키기 위한 방법은,

- 입체 이미지 쌍을 검색하는 단계(10);

- 상기 입체 이미지 쌍에 대한 최대 디스패리티 값(dmax(t))을 얻는 단계(11);

- 얻어진 상기 최대 디스패리티 값(dmax(t))을 이용하여 상기 입체 이미지 쌍에 대한 최대 허용 가능 시프트(hMAX(t))를 결정하는 단계(12);

- 결정된 상기 최대 허용 가능 시프트(hMAX(t))를 이용하여 상기 입체 이미지 쌍의 좌측 이미지 및 우측 이미지에 대한 실제 시프트(h(t)/2)를 계산하는 단계(13); 및

- 계산된 상기 실제 시프트(h(t)/2)에 따라 상기 좌측 이미지 및 상기 우측 이미지를 시프트시키는 단계(14)를 포함한다.

- 입체 이미지 쌍을 검색하는 단계(10);

- 상기 입체 이미지 쌍에 대한 최대 디스패리티 값(dmax(t))을 얻는 단계(11);

- 얻어진 상기 최대 디스패리티 값(dmax(t))을 이용하여 상기 입체 이미지 쌍에 대한 최대 허용 가능 시프트(hMAX(t))를 결정하는 단계(12);

- 결정된 상기 최대 허용 가능 시프트(hMAX(t))를 이용하여 상기 입체 이미지 쌍의 좌측 이미지 및 우측 이미지에 대한 실제 시프트(h(t)/2)를 계산하는 단계(13); 및

- 계산된 상기 실제 시프트(h(t)/2)에 따라 상기 좌측 이미지 및 상기 우측 이미지를 시프트시키는 단계(14)를 포함한다.

Description

본 발명은 3D 비디오 콘텐츠 표시의 분야에 관한 것으로서, 구체적으로는 상이한 관찰 조건들에서의 표시를 위한 3D 비디오 콘텐츠의 적응에 관한 것이다.

3D 비디오의 제작은 대부분이 표적 관찰 조건들, 예를 들어 극장에서의 영사 또는 가정용 3D-TV 디스플레이상의 표시 등에 의해 결정된다. 제작 동안에 고려되는 주요 파라미터들은 표적 스크린의 폭 및 관찰자와 스크린 사이의 거리이다.

특정 관찰 조건들에 대해 설계된 3D 비디오 콘텐츠가 다른 관찰 조건들에서 표시되어야 할 때, 3D 비디오 콘텐츠는 그러한 새로운 관찰 조건들에 맞도록 수정되어야 한다. 그렇지 않으면, 피상적인 3D 효과들 또는 불편 및 시각적 피로로 인해 3D 경험 품질이 다소 떨어질 수 있다. 이러한 문제에도 불구하고, 현재는 일반적으로 어떠한 종류의 적응도 수행되지 않는다. 이것은 때때로 예를 들어 3D-TV 디스플레이 상에서 3D 영화 발췌 또는 예고편을 재생할 때 매우 열악한 3D 효과들을 유발한다.

현재의 3D 시네마 시장의 성장과 더불어, 3D 비디오 콘텐츠의 적응은 3D-DVD(디지털 다기능 디스크) 및 3D-BD(블루레이 디스크)의 복제 및 배포를 위한 중요한 과제가 될 것이다. 그 목적은 동일한 3D 비디오 콘텐츠에 대해 여러 개의 마스터를 처리할 필요가 없게 하는 것이다.

현재, 3D 비디오 콘텐츠의 적응을 위해 가장 처음으로 연구된 접근법은 표적 관찰 조건들에 대해 이상적인 카메라 위치들에 위치하는 새로운 "가상" 뷰들의 합성으로 이루어진다. 이러한 뷰 합성은 장면 촬영의 구조를 변경하지 않고도 만족스런 3D 효과들을 가능하게 한다. 그러나, 뷰 합성은 계산 면에서 복잡하고 비싸다. 이것은 컬러 비디오 뷰들과 더불어 고품질의 디스패리티 맵들(disparity maps)의 전달을 필요로 하는데, 이는 저품질의 디스패리티 맵들의 사용이 합성된 뷰들 내에 수용 불가한 아티팩트들을 유발하기 때문이다. 컴퓨터 생성 콘텐츠의 경우에는, 필요한 디스패리티 맵들의 생성이 다소 쉽지만, 자연적인 비디오 콘텐츠의 경우에 이것은 상당히 어려운 작업이다. 지금까지는, 디스패리티 추정으로부터 뷰 합성에 이르는 신뢰할만한 체인이 이용 가능하지 않다.

디스패리티 추정을 위한 개선된 솔루션들이 이용 가능하게 되는 경우에도, 예를 들어 3D 셋톱 박스들에 대한 적절하고 덜 복잡한 적응 솔루션을 제공하는 것이 여전히 바람직하다.

따라서, 본 발명의 목적은 상이한 관찰 조건들에 대한 3D 비디오 콘텐츠의 적응을 위한 솔루션을 제안하는 것이며, 이러한 솔루션은 낮은 복잡성을 갖도록 구현될 수 있다.

본 발명에 따르면, 이러한 목적은 3D 비디오 콘텐츠를 디스플레이에 적응시키기 위한 방법에 의해 달성되며, 이러한 방법은

- 입체 이미지 쌍을 검색하는 단계;

- 상기 입체 이미지 쌍에 대한 최대 디스패리티 값을 얻는 단계;

- 얻어진 상기 최대 디스패리티 값을 이용하여 상기 입체 이미지 쌍에 대한 최대 허용 가능 시프트를 결정하는 단계;

- 결정된 상기 최대 허용 가능 시프트를 이용하여 상기 입체 이미지 쌍의 좌측 이미지 및 우측 이미지에 대한 실제 시프트를 계산하는 단계; 및

- 계산된 상기 실제 시프트에 따라 상기 좌측 이미지 및 상기 우측 이미지를 시프트시키는 단계

를 갖는다.

유사하게, 3D 비디오 콘텐츠를 디스플레이에 적응시키기 위한 장치는

- 입체 이미지 쌍을 검색하기 위한 입력;

- 상기 입체 이미지 쌍에 대한 최대 디스패리티 값을 얻기 위한 디스패리티 결정 유닛;

- 얻어진 상기 최대 디스패리티 값을 이용하여 상기 입체 이미지 쌍에 대한 최대 허용 가능 시프트를 결정하기 위한 최대 시프트 결정 유닛;

- 결정된 상기 최대 허용 가능 시프트를 이용하여 상기 입체 이미지 쌍의 좌측 이미지 및 우측 이미지에 대한 실제 시프트를 계산하기 위한 실제 시프트 계산 유닛; 및

- 계산된 상기 실제 시프트에 따라 상기 좌측 이미지 및 상기 우측 이미지를 시프트시키기 위한 이미지 시프팅 유닛

을 갖는다.

본 발명은 프레임 단위로 뷰 시프팅을 수행함에 의한 3D 콘텐츠의 적응을 제안한다. 장면을 장면에 대해 뒤로 이동시킴으로써, 즉 뷰들을 떨어지도록 이동시킴으로써 3D 효과가 향상된다. 이 때문에, 3D 영화를 3D-TV에 적응시키기 위하여, 좌측 뷰는 좌측으로 시프트되고, 우측 뷰는 우측으로 시프트된다. 이것은 영화의 감독이 최초 선택한 것에 대해 장면 구조를 변경하지만, 3D 효과는 최적화된다. 콘텐츠에 적응되는 또는 더 구체적으로는 각각의 입체 이미지 쌍의 디스패리티의 양에 적응되는 실시간 제어를 구현하여, 결과적인 심도가 시각적 안락 영역에 유지되는 것을 보장한다. 이러한 목적을 위해, 이롭게도 각각의 입체 이미지 쌍에 대해 최고 디스패리티 값이 전송된다. 대안으로서, 최고 디스패리티 값은 입체 이미지 쌍에 대해 전송된 완전한 디스패리티 맵 내의 최대 값에 대한 검색에 의해 얻어진다. 추가적인 대안으로서, 최고 디스패리티 값은 디스패리티 추정 특징에 의해 얻어진다. 이 경우에는, 디스패리티 추정의 대략적인 블록 기반 구현으로 충분하다.

본 발명에 따른 솔루션은 디스플레이 장치에 대한 3D 비디오 콘텐츠의 신뢰성 있고 빠른 적응을 가능하게 한다. 계산 면에서 비싸고, 저품질의 심도 맵들이 사용될 때 위험한 심도 기반 합성을 구현하지 않고도, 관찰자의 편안함을 제공하면서 3D 효과를 최적화한다.

이롭게도, 연속적인 시프팅 단계들을 시간 필터링, 예컨대 2차 필터링인 칼만(Kalman) 필터링으로 보완하여, 디스플레이 적응의 시간 거동을 평활화 한다. 시간 필터링은 결과적인 3D 콘텐츠 내의 성가진 지터링 3D 아티팩트들의 방지를 가능하게 한다. 그러한 아티팩트들은 특히 심도 추정이 요구될 때 존재할 가능성이 크다. 자연적인 콘텐츠의 경우, 디스패리티 맵들은 최종 심도 인식에 해로울 수 있는 프레임별 추정 에러들을 유발할 수 있다. 시간 필터링에 의해, 픽셀 시프트의 유연한 변화가 달성된다. 그들 자신의 심도 맵들을 더불어 공급되는 컴퓨터 생성 이미지(CGI) 콘텐츠의 경우에는, 시간 필터링이 반드시 수행될 필요는 없다.

바람직하게는, 관찰자는 인터페이스, 예를 들어 볼륨 또는 콘트라스트 바(bar)와 유사한 인터페이스를 이용하여 좌측 뷰 및 우측 뷰의 시프트를 조정할 가능성을 갖는다.

이롭게도, 시프트된 좌측 이미지 및 시프트된 우측 이미지는 디스플레이로 직접 전송된다. 대안으로서, 시프트된 좌측 이미지 및 시프트된 우측 이미지는 이들을 나중에 표시하기 위해 저장 매체 상에 저장된다.

더 나은 이해를 위해, 본 발명은 이제 아래의 설명에서 도면들을 참조하여 더 상세히 설명될 것이다. 본 발명은 이러한 예시적인 실시예로 한정되지 않으며, 상술되는 특징들은 첨부된 청구항들에서 정의되는 바와 같은 본 발명의 범위로부터 벗어나지 않고 유리하게 결합 및/또는 수정될 수도 있다는 것을 이해한다.

도면들에서:

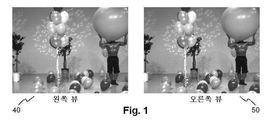

도 1은 입체 이미지 쌍을 나타내는 도면.

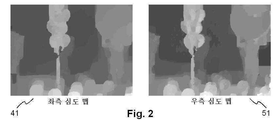

도 2는 도 1의 입체 이미지 쌍의 심도 맵들을 나타내는 도면.

도 3은 수렴(vergence) 조절 불일치의 설명을 제공하는 도면.

도 4는 시네마 영화 장면에 대한 심도 상황을 나타내는 도면.

도 5는 영화 장면이 가정용 3D-TV 패널 상에 표시될 때의 심도 상황을 나타내는 도면.

도 6은 본 발명에 따른 적응 방법의 흐름도.

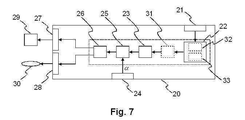

도 7은 본 발명에 따른 적응 방법을 수행하기 위한 장치의 개략도.

도 1은 입체 이미지 쌍을 나타내는 도면.

도 2는 도 1의 입체 이미지 쌍의 심도 맵들을 나타내는 도면.

도 3은 수렴(vergence) 조절 불일치의 설명을 제공하는 도면.

도 4는 시네마 영화 장면에 대한 심도 상황을 나타내는 도면.

도 5는 영화 장면이 가정용 3D-TV 패널 상에 표시될 때의 심도 상황을 나타내는 도면.

도 6은 본 발명에 따른 적응 방법의 흐름도.

도 7은 본 발명에 따른 적응 방법을 수행하기 위한 장치의 개략도.

도 1에는 입체 이미지 쌍이 도시되어 있다. 이미지 쌍은 좌측 뷰(40)와 우측 뷰(50)로 구성된다. 각각의 이미지(40, 50)는 1024 픽셀의 폭 및 768 픽셀의 높이를 갖는다. 2개의 이미지(40, 50)는 tc=10cm의 카메라간 거리 및 f=2240 픽셀의 초점 길이를 갖는 카메라 쌍을 이용하여 취해졌다. 카메라 기준으로부터의 수렴 평면의 거리는 Zconv=+∞이었다. 최소 시야 평면(near clipping plane)은 Znear=4.48m에 위치하고, 최대 시야 평면(far clipping plane)은 Zfar=112.06m에 위치하였다. 이미지들(40, 50) 내의 물체들의 최대 거리는 Zmax≒12m이었고, 최소 거리는 Zmin≒5m이었다.

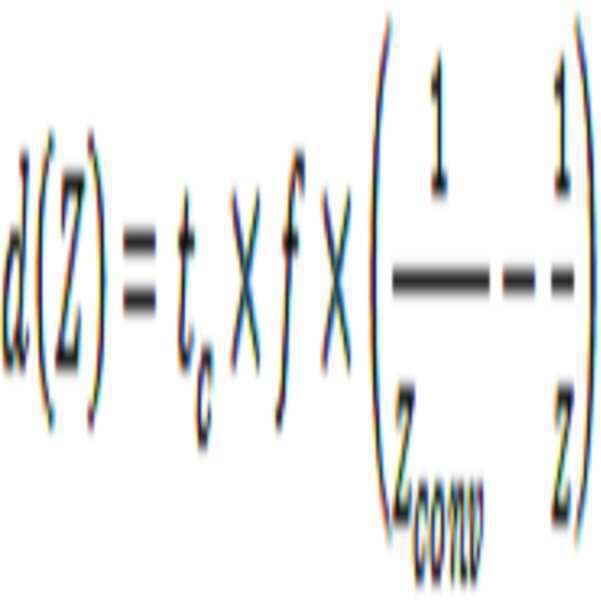

도 1의 입체 이미지 쌍의 심도 맵(depth map)들(41, 51)이 도 2에 도시되어 있다. 최소 시야 평면 내에 위치하는 물체는 순백색 값들에 대응할 것이다. 따라서, 최대 시야 평면 내에 위치하는 물체는 순흑색 값들에 대응할 것이다. 주어진 심도 Z에 대한 디스패리티 d(Z)는 다음과 같이 주어진다.

Zconv=+∞인 경우, 위의 식은 다음과 같이 간략화된다.

따라서, Zconv=+∞인 경우에, 최대 디스패리티는 음, 즉 dmax<0이 된다. 위의 식을 이용하면, 최소 심도 zmin은 dmin≒-44.8 픽셀의 최소 디스패리티로 귀착되는 반면, 최대 심도 zmax는 dmax≒-18.7 픽셀의 최대 디스패리티로 귀착된다. 일반적으로, 패럴랙스 및 디스패리티는 스크린 뒤에 위치하는 물체들에 대해서는 양인 반면(Z>Zconv), 스크린 앞에 위치하는 물체들에 대해서는 음이다(Z<Zconv).

실제의 삶에서 삼차원 물체를 보기 위해서는, 관찰자의 눈들이 두 가지를 행해야 한다. 첫째, 눈들은 수렴해야 하는데, 즉 눈들은 이미지의 투영이 양 망막의 중앙에 항상 위치하도록 약간 안쪽으로 또는 바깥쪽으로 회전해야 한다. 둘째, 눈들은 망막들 상에 이미지를 모으기 위해 각각의 수정체의 형상을 조절, 즉 변경해야 한다. 그러나, 인공적인 3D는 수렴 조절 불일치를 유발한다. 관찰자는 스크린으로부터 광이 방출되는 거리에 집중해야 하지만, 다른 거리, 즉 3D 물체의 공간 위치에 수렴한다. 이러한 수렴 조절 불일치는 두통 및 다른 불편을 유발할 수 있다.

수렴 조절 불일치가 도 3에 개략적으로 도시되어 있다. 눈 사이의 거리 te만큼 눈들이 분리된 관찰자는 폭 Wscreen을 갖는 스크린 1에 집중한다. 관찰자가 스크린 1의 평면에 위치한 물체(6) 상에 수렴하는 한, 수렴 조절 불일치는 존재하지 않는다. 이 경우에, 수렴 거리 Dconv는 눈들의 조절 거리와 동일하다. 그러나, 관찰자가 스크린 앞에 위치하는 물체(6') 또는 스크린 뒤에 위치하는 물체(6")에 수렴하는 경우, 수렴 거리 Dconv는 눈들의 조절 거리와 다르다.

이러한 수렴 조절 불일치로 인해, 패럴랙스 하한 및 패럴랙스 상한이 존재하며, 이는 물체들이 위치할 수 있는 심도 범위를 제한다. 패럴랙스 하한은 물체가 표시될 수 있는 스크린의 정면까지의 최대 거리를 나타내는 반면, 패럴랙스 상한은 스크린의 배면까지의 대응 거리를 나타낸다.

도 4는 시네마 영화 스크린의 심도 상황을 나타낸다. 현실 세계의 물체들의 심도에 대하여 관찰자에 의해 인식되는 심도가 도시되어 있다. 이 도면은 어떠한 특정 효과도 없는 시네마 영화 장면에 기초하는데, 즉 촬영된 심도와 관찰자들에 의해 인식된 심도 사이에는 선형 관계가 존재한다. 도면에서, 굵은 흑색 라인(1)은 시네마 스크린의 위치에 대응한다. 통상적으로, 시네마 스크린은 관찰자로부터 10m의 거리에 위치한다. 굵은 암회색 라인(2)은 음의 패럴랙스 값들에 대한 하한에 대응한다. 시네마에서는, 스크린이 관찰자로부터 충분히 멀기 때문에, 패럴랙스 상한은 존재하지 않는다. 관찰자는 어떠한 조절 고통도 느끼지 않고 무한대를 응시할 수 있다. 고려중인 영화 장면이 어떠한 특정 3D 효과도 제공하지 않을 때, 즉 입체 왜곡이 존재하지 않을 때, 흑색 파선(3)에 의해 표시되는, 관찰자에 의해 인식되는 심도는 촬영된 물체들의 심도에 대응한다.

도 5는 가정용 3D-TV 패널 상에 영화 장면이 표시될 때의 대응하는 심도 상황을 나타낸다. 이 경우, 스크린까지의 거리는 통상적으로 약 3m로 변한다. 결과적으로, 패럴랙스 상한이 나타난다. 패럴랙스 상한은 밝은 회색 라인(4)으로 표시된다. 시네마에서 달성되는 3D 효과들에 필적하는 3D 효과들을 얻는 것은 제한된 시각적 안락 영역으로 인해 불가능하다. 사실상, 가정에서, 관찰자는 스크린에 너무 가까이 위치한다. 결과적으로, 스크린 상에 계속 조절하면서 무한대를 응시하는 것은 시각적 피로를 유발한다. 적응이 수행되지 않는 경우, 영화 장면은 열악한 3D 효과들만을 제공하며, 이는 흑색 파선(3)으로 표시된다. 장면을 스크린 뒤쪽으로 더 멀리 이동시키는 본 발명에 따른 솔루션은 시각적 안락 영역을 초과하지 않고 심도 인식을 향상시키는 것을 가능하게 한다. 이것은 흑색 일점 쇄선(5)으로 표시된다.

아래에서는, 도 5에 흑색 일점 쇄선(5)으로 표시된 향상된 심도 인식을 달성하기 위하여 수행되는 적응 프로세스에 대한 기초가 설명될 것이다.

디스패리티 dmax(t)를 갖는 프레임(t)의 입체 이미지 쌍을 가정한다. 값 dmax(t)는 입체 이미지 쌍의 픽셀들에서의 최고 디스패리티 값을 나타낸다. 연역적으로 dmax(t)>0이다. 값 dmax(t)는 입체 이미지 쌍에 대한 메타데이터로서 전송되거나, 입체 이미지 쌍에 대해 전송되는 완전한 디스패리티 맵 내의 최대 값의 검색에 의해 얻어진다. 대안으로서, 3D-TV 디스플레이 또는 접속된 셋톱 박스 내에 디스패리티 추정 특징이 구현된다. 이 경우에는, 대략적인 블록 기반 구현으로 충분하다.

다음을 고려한다.

여기서, Nrow는 라인당 픽셀 수를 나타내고, Wscreen은 미터 단위의 가정용 스크린의 폭을 나타내며, te는 관찰자의 눈 사이의 거리를 나타낸다. 성인의 경우에 te=0.065m인 반면, 어린이의 경우에는 te=0.04m이다.

D가 관찰자로부터 3D-TV 스크린까지의 거리를 나타내는 것으로 한다.

여기서, 디옵터 단위의 값 1/M은 셋톱 박스 또는 3D-TV 디스플레이의 제조자에 의해 승인되는 수렴 조절 불일치 허용 한계에 대응한다. 이롭게도, 이러한 목적을 위해 HDMI 접속이 이용된다.

결과적으로, 프레임(t)에 대한 최대 허용 가능 시프트 hMAX(t)는 다음과 같이 주어진다.

실제 시프트 h(t)는 관찰자의 선호에 따라 좌측 뷰에 대해 좌측으로 h(t)/2 픽셀들의 시프트 및 우측 뷰에 대해 우측으로 h(t)/2 픽셀들의 시프트를 갖는 0과 hMAX(t) 사이의 임의 값일 수 있다. 이롭게도, 관찰자는 볼륨 또는 콘트라스트 바와 유사한 인터페이스를 이용하여 시프트를 조정할 가능성을 갖는다. 이러한 조정은 0과 1 사이의 값들을 가질 수 있는 팩터 α에 의해 표현된다.

실제로, 최대 ~60 픽셀, 즉 뷰당 30 픽셀의 시프트 값들 h(t)가 얻어진다. 이것은 수용 가능한 값인 약 3%의 수평 해상도에 대응한다.

바람직하게는, dmax의 시간적 변화들을 유연하게 하기 위해 시간 필터링 특징이 구현된다. 이러한 시간 필터링, 예컨대 칼만 필터링이 실행 가능하고, 관찰자의 눈을 끌지 않는 것으로 밝혀졌다.

본 발명에 따른 적응 방법이 도 6에 도시되어 있다. 제1 단계(10)에서, 입체 이미지 쌍이 수신된다. 이어서, 입체 이미지 쌍과 함께 전송된 메타데이터로부터 또는 디스패리티 추정에 의해 최대 디스패리티 값 dmax(t)가 얻어진다(11). 다음 단계(12)에서, 예를 들어, 전술한 바와 같이, 최대 허용 가능 시프트 hMAX(t)가 결정된다. 값 hMAX(t)로부터 그리고 이롭게도 또한 사용자 설정 가능 시프트 조정 파라미터 α로부터, 프레임에 대한 최종 시프트 h(t), 더 정확하게는 좌측 이미지 및 우측 이미지에 대한 시프트 값 h(t)/2가 계산된다(13). 좌측 이미지 및 우측 이미지는 그에 따라 시프트되고(14), 디스플레이로 전송되거나(15), 저장 매체 상에 저장된다(16).

본 발명에 따른 적응 방법을 수행하기 위한 장치(20)가 도 7에 개략적으로 도시되어 있다. 장치(20)는 입체 이미지 쌍을 수신(10)하기 위한 입력(21)을 포함한다. 디스패리티 결정 유닛(22)이 메타데이터 평가 유닛(32)을 이용하여 입체 이미지 쌍과 함께 전송된 메타데이터로부터 또는 디스패리티 추정기(33)를 이용하여 디스패리티 추정에 의해 최대 디스패리티 값 dmax(t)을 얻는다(11). 디스패리티 결정 유닛(22) 하류의 옵션인 시간 필터(31)가 최대 디스패리티 값 dmax(t)에 대해 시간 필터링을 수행한다. 최대 시프트 결정 유닛(23)이 최대 허용 가능 시프트 hMAX(t)를 결정한다(12). 바람직하게는, 장치(20)는 관찰자가 시프트 조정 파라미터 α를 설정할 수 있게 하는 사용자 인터페이스(24)를 구비한다. 실제 시프트 계산 유닛(25)이 시프트 조정 파라미터 α를 고려하여 프레임에 대한 최종 시프트 h(t), 더 정확하게는 좌측 이미지 및 우측 이미지에 대한 시프트 값 h(t)/2를 계산한다. 이미지 시프팅 유닛(26)이 좌측 이미지 및 우측 이미지를 그에 따라 시프트시킨다(14). 마지막으로, 시프트된 이미지를 디스플레이(29)로 전송하거나(15), 시프트된 이미지를 저장 매체(30) 상에 저장(16)하기 위해 출력들(27, 28)이 제공된다. 분명히, 상이한 유닛들은 단일 처리 유닛 내에 통합될 수도 있다. 이것은 파선 직사각형으로 지시된다. 또한, 사용자 인터페이스(24)는 장치(20) 내에 반드시 통합될 필요는 없다. 사용자 인터페이스(24)를 입력을 통해 장치(20)에 접속하는 것도 가능하다. 예컨대, 본 발명에 따른 적응 방법이 셋톱 박스에서 수행될 때, 사용자 인터페이스(24)는 접속된 디스플레이 또는 개인용 컴퓨터에 의해 제공될 수 있으며, 이는 이어서 조정 파라미터 α를 셋톱 박스로 전송한다.

Claims (13)

- 디스플레이에 3D 비디오 콘텐츠를 적응시키기 위한 방법으로서,

입체 이미지 쌍(stereoscopic image pair)을 검색하는 단계(10);

상기 입체 이미지 쌍에 대한 최대 디스패리티 값(dmax(t))을 얻는 단계(11);

얻어진 상기 최대 디스패리티 값(dmax(t))을 이용하여 상기 입체 이미지 쌍에 대한 최대 허용 가능 시프트(hMAX(t))를 결정하는 단계(12);

결정된 상기 최대 허용 가능 시프트(hMAX(t))를 이용하여 상기 입체 이미지 쌍의 좌측 이미지 및 우측 이미지에 대한 실제 시프트(h(t)/2)를 계산하는 단계(13); 및

계산된 상기 실제 시프트(h(t)/2)에 따라 상기 좌측 이미지 및 상기 우측 이미지를 시프트시키는 단계(14)

를 포함하는 3D 비디오 콘텐츠 적응 방법. - 제1항에 있어서, 상기 입체 이미지 쌍의 좌측 이미지 및 우측 이미지에 대한 실제 시프트(h(t)/2)를 계산(13)할 때 사용자 설정 가능 시프트 조정 파라미터(α)가 고려되는 3D 비디오 콘텐츠 적응 방법.

- 제1항 또는 제2항에 있어서, 상기 최대 허용 가능 시프트(hMAX(t))를 결정(12)하기 전에 상기 최대 디스패리티 값(dmax(t))에 대해 시간 필터링을 수행하는 단계를 더 포함하는 3D 비디오 콘텐츠 적응 방법.

- 제3항에 있어서, 칼만(Kalman) 필터링에 의해 시간 필터링이 수행되는 3D 비디오 콘텐츠 적응 방법.

- 제1항 내지 제4항 중 어느 한 항에 있어서, 상기 최대 디스패리티 값(dmax(t))은 상기 입체 이미지 쌍과 관련된 메타데이터로부터 또는 디스패리티 추정에 의해 얻어지는(11) 3D 비디오 콘텐츠 적응 방법.

- 제1항 내지 제5항 중 어느 한 항에 있어서, 시프트된 상기 좌측 이미지 및 시프트된 상기 우측 이미지를 상기 디스플레이(29)로 보내거나(15), 또는 시프트된 상기 좌측 이미지 및 시프트된 상기 우측 이미지를 저장 매체(30)상에 저장하는(16) 단계를 더 포함하는 3D 비디오 콘텐츠 적응 방법.

- 디스플레이에 3D 비디오 콘텐츠를 적응시키기 위한 장치(20)로서,

입체 이미지 쌍을 검색하기(10) 위한 입력(21);

상기 입체 이미지 쌍에 대한 최대 디스패리티 값(dmax(t))을 얻기(11) 위한 디스패리티 결정 유닛(22);

얻어진 상기 최대 디스패리티 값(dmax(t))으로부터 상기 입체 이미지 쌍에 대한 최대 허용 가능 시프트(hMAX(t))를 결정하기(12) 위한 최대 시프트 결정 유닛(23);

결정된 상기 최대 허용 가능 시프트(hMAX(t))로부터 상기 입체 이미지 쌍의 좌측 이미지 및 우측 이미지에 대한 실제 시프트(h(t)/2)를 계산하기(13) 위한 실제 시프트 계산 유닛(25); 및

계산된 상기 실제 시프트(h(t)/2)에 따라 상기 좌측 이미지 및 상기 우측 이미지를 시프트시키기(14) 위한 이미지 시프팅 유닛(26)

을 포함하는 장치(20). - 제7항에 있어서, 상기 실제 시프트 계산 유닛(25)에 접속되어, 상기 입체 이미지 쌍의 좌측 이미지 및 우측 이미지에 대한 실제 시프트(h(t)/2)를 계산할(13) 때 고려되는 시프트 조정 파라미터(α)를 설정하기 위한 사용자 인터페이스(24)를 더 포함하는 장치(20).

- 제7항 또는 제8항에 있어서, 상기 최대 허용 가능 시프트(hMAX(t))를 결정하기(12) 전에 상기 최대 디스패리티 값(dmax(t))에 대해 시간 필터링을 수행하기 위한 시간 필터(31)를 상기 디스패리티 결정 유닛(22)의 하류(downstream)에서 더 포함하는 장치(20).

- 제9항에 있어서, 상기 시간 필터(31)는 칼만 필터인 장치(20).

- 제7항 내지 제10항 중 어느 한 항에 있어서, 상기 최대 디스패리티 값(dmax(t))은 상기 입체 이미지 쌍과 관련된 메타데이터로부터 메타데이터 추정 유닛(32)에 의해 또는 디스패리티 추정기(33)에 의해 얻어지는(11) 장치(20).

- 제7항 내지 제11항 중 어느 한 항에 있어서, 시프트된 상기 좌측 이미지 및 시프트된 상기 우측 이미지를 상기 디스플레이(29)에게 보내기(15) 위한 제1 출력(27), 및/또는 시프트된 상기 좌측 이미지 및 시프트된 상기 우측 이미지를 저장 매체(30)상에 저장하기(16) 위한 제2 출력(28)을 더 포함하는 장치(20).

- 디스플레이에 3D 비디오 콘텐츠를 적응시키기 위한 제7항에 따른 장치(20); 및

상기 장치(20)에 접속되어, 입체 이미지 쌍의 좌측 이미지 및 우측 이미지에 대한 실제 시프트(h(t)/2)를 계산할(13) 때 상기 장치(20)에서 고려되는 시프트 조정 파라미터(α)를 설정하기 위한 사용자 인터페이스(24)

를 포함하는 시스템.

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP10306023A EP2434764A1 (en) | 2010-09-23 | 2010-09-23 | Adaptation of 3D video content |

| EP10306023.2 | 2010-09-23 |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| KR20120031260A true KR20120031260A (ko) | 2012-04-02 |

Family

ID=43384538

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| KR1020110095851A KR20120031260A (ko) | 2010-09-23 | 2011-09-22 | 3d 비디오 콘텐츠의 적응 |

Country Status (6)

| Country | Link |

|---|---|

| US (1) | US9204122B2 (ko) |

| EP (2) | EP2434764A1 (ko) |

| JP (1) | JP2012085284A (ko) |

| KR (1) | KR20120031260A (ko) |

| CN (1) | CN102413345B (ko) |

| TW (1) | TWI491216B (ko) |

Families Citing this family (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US9031316B2 (en) * | 2012-04-05 | 2015-05-12 | Mediatek Singapore Pte. Ltd. | Method for identifying view order of image frames of stereo image pair according to image characteristics and related machine readable medium thereof |

| US20150085073A1 (en) * | 2012-05-02 | 2015-03-26 | Koninklijke Philips N.V. | Quality metric for processing 3d video |

| US9838672B2 (en) | 2013-05-16 | 2017-12-05 | Mediatek Inc. | Apparatus and method for referring to motion status of image capture device to generate stereo image pair to auto-stereoscopic display for stereo preview |

| CN103391447B (zh) * | 2013-07-11 | 2015-05-20 | 上海交通大学 | 3d节目镜头切换中安全深度保证与调整方法 |

| US10469821B2 (en) | 2016-06-17 | 2019-11-05 | Altek Semiconductor Corp. | Stereo image generating method and electronic apparatus utilizing the method |

| CN115209122B (zh) * | 2022-07-26 | 2023-07-07 | 福州大学 | 一种基于多智能体的立体图像视觉舒适度增强方法及系统 |

Family Cites Families (24)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US5020878A (en) * | 1989-03-20 | 1991-06-04 | Tektronix, Inc. | Method and apparatus for generating a binocular viewing model automatically adapted to a selected image |

| JP2848291B2 (ja) | 1995-08-24 | 1999-01-20 | 松下電器産業株式会社 | 立体tv装置 |

| US6525821B1 (en) * | 1997-06-11 | 2003-02-25 | Ut-Battelle, L.L.C. | Acquisition and replay systems for direct-to-digital holography and holovision |

| US6584219B1 (en) * | 1997-09-18 | 2003-06-24 | Sanyo Electric Co., Ltd. | 2D/3D image conversion system |

| US6208348B1 (en) | 1998-05-27 | 2001-03-27 | In-Three, Inc. | System and method for dimensionalization processing of images in consideration of a pedetermined image projection format |

| JP2001331154A (ja) * | 2000-05-23 | 2001-11-30 | Matsushita Electric Ind Co Ltd | 液晶表示装置および液晶表示方法 |

| JP2003070009A (ja) * | 2001-08-28 | 2003-03-07 | Sharp Corp | 撮像装置 |

| JP2003284093A (ja) | 2002-03-27 | 2003-10-03 | Sanyo Electric Co Ltd | 立体画像処理方法および装置 |

| EP2357837A3 (en) * | 2002-03-27 | 2012-02-22 | Sanyo Electric Co., Ltd. | Method and apparatus for processing three-dimensional images |

| US8369607B2 (en) * | 2002-03-27 | 2013-02-05 | Sanyo Electric Co., Ltd. | Method and apparatus for processing three-dimensional images |

| JPWO2003092304A1 (ja) * | 2002-04-25 | 2005-09-08 | シャープ株式会社 | 画像データ生成装置、画像データ再生装置、および画像データ記録媒体 |

| US7583403B2 (en) * | 2002-09-12 | 2009-09-01 | Panasonic Corporation | Image processing device |

| JP4158029B2 (ja) * | 2003-04-25 | 2008-10-01 | 富士フイルム株式会社 | ホワイトバランス調整方法および電子カメラ |

| EP1665815A2 (de) | 2003-09-15 | 2006-06-07 | Armin Grasnick | Verfahren zum erstellen einer raumbildvorlage für abbildungsverfahren mit rumlichen tiefenwirkungen und vorrichtung zum anzeigen einer raumbildvorlage |

| JP4549661B2 (ja) | 2003-12-03 | 2010-09-22 | 学校法人早稲田大学 | 立体映像呈示装置 |

| JP4578294B2 (ja) * | 2005-03-18 | 2010-11-10 | 株式会社エヌ・ティ・ティ・データ三洋システム | 立体視画像表示装置、立体視画像表示方法及びコンピュータプログラム |

| KR100667810B1 (ko) * | 2005-08-31 | 2007-01-11 | 삼성전자주식회사 | 3d 영상의 깊이감 조정 장치 및 방법 |

| TWI312634B (en) * | 2006-06-06 | 2009-07-21 | Wintek Corporatio | Stereoscopic image display |

| US8330801B2 (en) * | 2006-12-22 | 2012-12-11 | Qualcomm Incorporated | Complexity-adaptive 2D-to-3D video sequence conversion |

| KR101313740B1 (ko) | 2007-10-08 | 2013-10-15 | 주식회사 스테레오피아 | 원소스 멀티유즈 스테레오 카메라 및 스테레오 영상 컨텐츠제작방법 |

| EP2063648A1 (en) * | 2007-11-24 | 2009-05-27 | Barco NV | Sensory unit for a 3-dimensional display |

| BRPI0914459A2 (pt) * | 2008-10-21 | 2015-10-27 | Koninkl Philips Electronics Nv | "método para processar um sinal de vídeo de entrada tridimensional compreendendo múltiplas visualizações, produto de programa de computador e sistema para processar um sinal de vídeo de entrada tridimensional compreendendo múltiplas visualizações" |

| WO2010095074A1 (en) | 2009-02-17 | 2010-08-26 | Koninklijke Philips Electronics N.V. | Combining 3d image and graphical data |

| US8474896B2 (en) * | 2011-04-19 | 2013-07-02 | Murray Ostberg | Vehcile topper that encloses the cargo bed of a vehicle such as a pickup truck, yet provides convenient open access thereto |

-

2010

- 2010-09-23 EP EP10306023A patent/EP2434764A1/en not_active Withdrawn

-

2011

- 2011-08-12 TW TW100128794A patent/TWI491216B/zh not_active IP Right Cessation

- 2011-08-13 US US13/136,857 patent/US9204122B2/en not_active Expired - Fee Related

- 2011-09-13 EP EP11181001.6A patent/EP2434766A3/en not_active Withdrawn

- 2011-09-22 KR KR1020110095851A patent/KR20120031260A/ko not_active Application Discontinuation

- 2011-09-23 CN CN201110285325.5A patent/CN102413345B/zh not_active Expired - Fee Related

- 2011-09-26 JP JP2011209788A patent/JP2012085284A/ja active Pending

Also Published As

| Publication number | Publication date |

|---|---|

| EP2434766A2 (en) | 2012-03-28 |

| US9204122B2 (en) | 2015-12-01 |

| CN102413345A (zh) | 2012-04-11 |

| TW201215103A (en) | 2012-04-01 |

| JP2012085284A (ja) | 2012-04-26 |

| TWI491216B (zh) | 2015-07-01 |

| CN102413345B (zh) | 2016-01-06 |

| EP2434766A3 (en) | 2014-12-10 |

| EP2434764A1 (en) | 2012-03-28 |

| US20120075419A1 (en) | 2012-03-29 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6520119B2 (ja) | 画像処理装置および画像処理方法 | |

| US9036006B2 (en) | Method and system for processing an input three dimensional video signal | |

| EP2532166B1 (en) | Method, apparatus and computer program for selecting a stereoscopic imaging viewpoint pair | |

| US20110228051A1 (en) | Stereoscopic Viewing Comfort Through Gaze Estimation | |

| US20120293489A1 (en) | Nonlinear depth remapping system and method thereof | |

| US11962746B2 (en) | Wide-angle stereoscopic vision with cameras having different parameters | |

| KR20120031260A (ko) | 3d 비디오 콘텐츠의 적응 | |

| CN101884222A (zh) | 用于支持立体呈现的图像处理 | |

| US9118894B2 (en) | Image processing apparatus and image processing method for shifting parallax images | |

| JP2010531102A (ja) | 色フィルタで立体画像を生成し表示する方法および装置 | |

| Yuan et al. | 61.3: Stereoscopic 3d content depth tuning guided by human visual models | |

| CN102006494A (zh) | 一种3d视频信号调节方法及装置 | |

| TWI436636B (zh) | 三維視訊影像調整方法及裝置 | |

| US20130208097A1 (en) | Three-dimensional imaging system and image reproducing method thereof | |

| US9918067B2 (en) | Modifying fusion offset of current, next, second next sequential frames | |

| CN102655597A (zh) | 可实时动态调节立体视频视差曲线的播放系统 | |

| CN104052990A (zh) | 一种基于融合深度线索的全自动二维转三维方法和装置 | |

| EP2721829A1 (en) | Method for reducing the size of a stereoscopic image | |

| CN202353727U (zh) | 可实时动态调节立体视频视差曲线的播放系统 | |

| CN116567191A (zh) | 一种面向舒适度提升的立体视觉内容视差调节方法 | |

| KR101369006B1 (ko) | 다시점 영상 재생 장치 및 방법 | |

| JP5720475B2 (ja) | 立体映像制御装置、立体映像制御方法および立体映像制御用プログラム | |

| JP2015029215A (ja) | 立体画像処理装置 | |

| TW201423489A (zh) | 三維立體顯示裝置及其方法 | |

| JP2012039479A (ja) | 表示装置及びその制御方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A201 | Request for examination | ||

| E902 | Notification of reason for refusal | ||

| E601 | Decision to refuse application |