JPWO2012144389A1 - 個人識別キャラクター表示システム、端末装置、個人識別キャラクター表示方法、及びコンピュータプログラム - Google Patents

個人識別キャラクター表示システム、端末装置、個人識別キャラクター表示方法、及びコンピュータプログラム Download PDFInfo

- Publication number

- JPWO2012144389A1 JPWO2012144389A1 JP2013510960A JP2013510960A JPWO2012144389A1 JP WO2012144389 A1 JPWO2012144389 A1 JP WO2012144389A1 JP 2013510960 A JP2013510960 A JP 2013510960A JP 2013510960 A JP2013510960 A JP 2013510960A JP WO2012144389 A1 JPWO2012144389 A1 JP WO2012144389A1

- Authority

- JP

- Japan

- Prior art keywords

- terminal device

- image

- character

- personal identification

- real

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T19/00—Manipulating 3D models or images for computer graphics

- G06T19/006—Mixed reality

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/14—Digital output to display device ; Cooperation and interconnection of the display device with other functional units

- G06F3/1423—Digital output to display device ; Cooperation and interconnection of the display device with other functional units controlling a plurality of local displays, e.g. CRT and flat panel display

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/41—Structure of client; Structure of client peripherals

- H04N21/414—Specialised client platforms, e.g. receiver in car or embedded in a mobile appliance

- H04N21/41407—Specialised client platforms, e.g. receiver in car or embedded in a mobile appliance embedded in a portable device, e.g. video client on a mobile phone, PDA, laptop

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/41—Structure of client; Structure of client peripherals

- H04N21/422—Input-only peripherals, i.e. input devices connected to specially adapted client devices, e.g. global positioning system [GPS]

- H04N21/42202—Input-only peripherals, i.e. input devices connected to specially adapted client devices, e.g. global positioning system [GPS] environmental sensors, e.g. for detecting temperature, luminosity, pressure, earthquakes

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/41—Structure of client; Structure of client peripherals

- H04N21/422—Input-only peripherals, i.e. input devices connected to specially adapted client devices, e.g. global positioning system [GPS]

- H04N21/4223—Cameras

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/43—Processing of content or additional data, e.g. demultiplexing additional data from a digital video stream; Elementary client operations, e.g. monitoring of home network or synchronising decoder's clock; Client middleware

- H04N21/44—Processing of video elementary streams, e.g. splicing a video clip retrieved from local storage with an incoming video stream, rendering scenes according to MPEG-4 scene graphs

- H04N21/44008—Processing of video elementary streams, e.g. splicing a video clip retrieved from local storage with an incoming video stream, rendering scenes according to MPEG-4 scene graphs involving operations for analysing video streams, e.g. detecting features or characteristics in the video stream

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N21/00—Selective content distribution, e.g. interactive television or video on demand [VOD]

- H04N21/40—Client devices specifically adapted for the reception of or interaction with content, e.g. set-top-box [STB]; Operations thereof

- H04N21/47—End-user applications

- H04N21/478—Supplemental services, e.g. displaying phone caller identification, shopping application

- H04N21/4788—Supplemental services, e.g. displaying phone caller identification, shopping application communicating with other users, e.g. chatting

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01S—RADIO DIRECTION-FINDING; RADIO NAVIGATION; DETERMINING DISTANCE OR VELOCITY BY USE OF RADIO WAVES; LOCATING OR PRESENCE-DETECTING BY USE OF THE REFLECTION OR RERADIATION OF RADIO WAVES; ANALOGOUS ARRANGEMENTS USING OTHER WAVES

- G01S19/00—Satellite radio beacon positioning systems; Determining position, velocity or attitude using signals transmitted by such systems

- G01S19/38—Determining a navigation solution using signals transmitted by a satellite radio beacon positioning system

- G01S19/39—Determining a navigation solution using signals transmitted by a satellite radio beacon positioning system the satellite radio beacon positioning system transmitting time-stamped messages, e.g. GPS [Global Positioning System], GLONASS [Global Orbiting Navigation Satellite System] or GALILEO

- G01S19/42—Determining position

- G01S19/45—Determining position by combining measurements of signals from the satellite radio beacon positioning system with a supplementary measurement

-

- G—PHYSICS

- G09—EDUCATION; CRYPTOGRAPHY; DISPLAY; ADVERTISING; SEALS

- G09G—ARRANGEMENTS OR CIRCUITS FOR CONTROL OF INDICATING DEVICES USING STATIC MEANS TO PRESENT VARIABLE INFORMATION

- G09G2370/00—Aspects of data communication

- G09G2370/16—Use of wireless transmission of display information

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04M—TELEPHONIC COMMUNICATION

- H04M2250/00—Details of telephonic subscriber devices

- H04M2250/12—Details of telephonic subscriber devices including a sensor for measuring a physical value, e.g. temperature or motion

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04M—TELEPHONIC COMMUNICATION

- H04M2250/00—Details of telephonic subscriber devices

- H04M2250/52—Details of telephonic subscriber devices including functional features of a camera

Abstract

Description

この分野の公知技術情報としては、例えば、非特許文献1に開示されたものが有る。

非特許文献1では、平行四辺形の各頂点に配置されたマーカーを用いて、物体の3次元位置及び姿勢を計測して現実世界の映像に仮想物体を合成する方法について記載している。

特許文献3には、エンタテイメント装置、システム、及び方法が示されており、上記の固有の物体としてサイコロ状の物体を使用する実施例が開示されている。

また、特許文献4には、目標位置探索装置、目標位置探索方法及びプログラムについて記載されている。これは本件出願人の先願特許技術であり、AR(Augmented Reality:拡張現実感)による個人及び目的施設等の検索表示システムについて記載されている。

具体的には、検索対象による区別を行なわない、単純な図形による表示方法によって、現実の映像に対象とする物の位置を表す図形を合成表示するものである。

前述の特許文献1に開示された技術では、画像を配置する位置に固有の物体を設置することが必要である。

即ち、この技術では、画像を合成する場所を指定するためのマーカーとして特別な物体(マーカー物体)を用意する必要がある。また、多くの種類の合成CG画像を制御するためには、無数の種類のマーカー物体が必要になるため、予め準備されたマーカーによって表示できるCG画像の種類は非常に限られたものになる。

また、特許文献4に開示された技術では、予め探す個人を特定して表示することしかできない。これによると、合成に用いる画像を、特定個人を表す画像データとしてカスタマイズすることができないので、風景の中に存在している仲間の存在に気づいたり、その気づいた中から個人を特定して、撮影者がその個人の元にまで辿り着くといった用途には使用することができなかった。

前記カメラで撮影した現実世界の画像データから、前記画像データを表示する画像領域において所定の被写体の特徴を有する部分領域を、パターンマッチング法で認識して検出する検出部と、前記現実世界の画像の前記検出した部分領域に、前記部分領域で特徴付けられた前記被写体に対応して予め保持されている所定のCG画像を合成描画する合成描画部と、前記合成された画像領域を含む前記現実世界の画像を表示する画像表示部と、を備えたことを特徴とする。

これにより、個人毎にカスタマイズされた無数のARキャラクターを制御することが可能となる。例えば、主人公に従う従者を持つアニメーション作品と、現実に撮影された人物とを融合表現するような画像を提供するサービスの実施が可能となる。また、眼前の風景にいるユーザをカスタマイズされた図形を羅列して表示することを可能にすると共に、その中から特定の個人を指定する操作を実行することができる。

(1) 複数の端末装置(例えば、携帯電話端末装置)と、データベースサーバとがネットワーク接続される構成において、複数の端末装置の各々は、カメラ部、測位部、方位測定部を備えおり、

(2) 少なくとも撮影者の端末装置は、キャラクター定義部の中に、端末ユーザのキャラクター画像、及びデータベースサーバ(或いは、他の端末)から取得した他の端末ユーザのキャラクター画像を保持することができ、

(3) 少なくとも撮影者の端末装置は、カメラ部から眼前の画像を取得して表示し、また、前記撮影者の端末装置の位置を取得することができる。

さらに、本発明の一実施形態の個人識別キャラクター表示システムにおいては、

(4) 少なくとも撮影者の端末装置は、カメラ部が向いている方向を取得することができ、

(5) 少なくとも撮影者の端末装置は、取得した前記方向に、探している他の端末装置のユーザが居るか否かを、撮影者の端末装置とは異なる他の端末装置の特定ユーザの顔画像を画像認識部を用いて識別することで判定し、前記他の端末装置の特定ユーザが居る場合には、前記他の端末装置までの距離を表示すると共に、前記他の端末装置の前記特定ユーザのキャラクター画像を、カメラ部が得た画像に合成して表示する。なお、より具体的には、合成するキャラクター画像は、前記他の端末装置の特定ユーザの顔から画像認識部を用いて抽出した特徴情報により選択されるように構成する。

通常、ARキャラクターデータの配信は、撮影した個人が所有する撮影者の携帯端末装置がARデータサーバとなって行われる。

他のユーザ(他の登録会員個人)の携帯端末装置が前記撮影者の端末装置と近接する場合(近距離無線通信手段等が使用できる範囲の場合)は、近距離無線通信手段等により、前記他のユーザの携帯端末装置が直接ARデータサーバとして動作する。

撮影者の端末装置が、他のユーザの他の携帯端末装置と近接しなくても、近傍に他のユーザが居る場合は、他のユーザの概略の位置を示したり、近傍に複数の他のユーザがいることを示すことができ、示されたキャラクターを指定することによって他の個人を指定することができる。

なお、撮影した登録会員個人が所有する携帯端末装置に保持されている撮影者のARキャラクターデータは、特殊には、撮影者個人が自分で撮影者自身の顔を撮影する場合に参照するように構成することも可能であるが、一般には、前記撮影した登録会員とは別の他の登録会員個人の携帯端末装置から参照されるものである。

これにより、登録会員のユーザに、AR環境で特定のアニメキャラクターの周囲を飛ぶ妖精や小動物のようなキャラクターをARキャラクターデータとして撮影者の装置に設定することで、アニメーション作品と現実とを融合した画像を表示するサービスを提供することができる。

さらに、カメラに写った前記の妖精や小動物を指定して、被写体となった本人のいる場所まで撮影者が辿り着くことができるシステムも提供できる。

なお、それぞれの実施形態の説明では、本発明に係る個人識別キャラクター表示システム、個人識別キャラクター表示方法、及び端末装置について詳述するが、本発明に係るコンピュータプログラムについては、前記端末装置を動作させるためのプログラムであることから、その説明は以下の説明に含まれる。

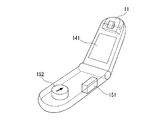

図1は、本発明の第一の実施形態に係る個人識別キャラクター表示システムの全体構成を示す構成図である。

図1に示す本実施形態に係る個人識別キャラクター表示システムは、携帯電話端末装置である携帯電話端末1及び携帯電話端末2(いずれも本発明の実施形態に係る端末装置)と、ARデータベースサーバ3と、を備えいる。

但し、本発明における係る個人識別キャラクター表示システムでは、一般に、2台以上の端末装置とデータベースサーバ装置によって構成することが可能である。本発明の実施形態に係る端末装置として、携帯電話端末装置1と、携帯電話端末2とを備える構成としたが、端末装置の構成は上記の構成に限定されるものではなく、従って、その台数は任意の複数でもよい。

また、本発明の実施形態に係る端末装置は、携帯電話端末装置やスマートフォンとは限らず、他の装置、例えば、ゲーム機、タブレットPC、ノートPCでもよい。

携帯電話端末装置1は、カメラ部11と、画像メモリ部12と、顔認識部13と、タッチパネルで構成された表示部14と、GPS/磁気センサ15と、AR制御部16と、通信部17と、を備える。

AR制御部16は、制御プログラム161と、自己ARキャラクター定義162と、他者ARキャラクター定義163と、を備える。

通信部17は、ネット通信部171と、近距離通信部172と、を備える。

携帯電話端末装置2は、カメラ部21と、画像メモリ部22と、顔認識部23と、タッチパネルで構成された表示部24と、GPS/磁気センサ25と、AR制御部26と、通信部27と、を備える。

通信部27は、ネット通信部271と、近距離通信部272と、を備える。

ARデータベースサーバ3は、端末通信部31と、登録制御部32と、検索制御部33と、ARデータキャラクタデータベース34と、備える。

ARデータキャラクタデータベース34は個人レコード1(341)と、個人レコード2(342)と、個人レコード3(343)…と、個人レコードn(34n)と、を備える(但し、前記のnは登録されたレコード数である)。

図2では、カメラ部11の一部と、表示部14の構成要素である表示画面141と、GPS/磁気センサ部16の構成要素であるGPS151及び磁気センサ152と、を示している。

以下、図1,2を参照して、本実施形態に係る個人識別キャラクター表示システムの機能を説明する。

なお、以下の説明では、携帯電話端末1の機能も併せて説明するが、携帯電話端末2の機能も携帯電話端末1の機能と同様であり、よって、以下の説明に含まれるものとする。

カメラ部11で撮影された画像は画像メモリ12に保持される。

画像メモリ12には顔認識部13が接続されている。この顔認識部13は、カメラ部11で撮影された画像中の人物の顔部分を切り出して、その大きさと位置を取得する手段と、切り出した顔の特徴を数値化する手段とを具備している。

この描画の際には、制御プログラム161は、顔の特徴数値に関連付けられた図形を、切り出された顔領域の大きさに応じて拡大縮小し、顔領域の近傍に表示する。

また、時刻をキーに相対位置を変化させることで検出された顔領域の上方周囲を飛翔するようなアニメーション表現をも可能にしている。

AR制御部16のキャラクター定義部(携帯電話端末1における自己ARキャラクター定義162及び他者ARキャラクター定義163)を備えており、制御プログラム161はキャラクター定義に定義されたデータを参照して画像メモリ12に図形を描画する。

さらに、AR制御部16は、携帯電話端末1で表示するための複数の他者ARキャラクター定義を格納する手段を具備している。

携帯電話端末1の自己ARキャラクター定義162の定義データは通信部17による参照が可能となっており、通信部17に具備された近距離通信部172(無線通信部)などによる近距離通信によって端末装置の間(例えば、携帯電話端末1と携帯電話端末2)でデータ交換が可能であるか、若しくは同じく通信部17に具備されたネット通信部171によってネットワークに設置されたARデータベースサーバ3に定義データをアップロードすることが可能である。

また、携帯電話端末1のGPS/磁気センサ15は、GPSによる端末位置の測位部及び磁気センサーによる方位測定部として搭載されている。なお、AR制御部16の制御プログラム161からも測位結果を参照することができる。

ARデータベースサーバ3は、携帯電話端末1との通信手段として端末通信部31を備えており、携帯電話端末1から端末通信部31を介して送られて来たキャラクター定義データを格納する手段としてARキャラクタデータベース34を備える。

この検索制御部33は、端末通信部31を介して検索結果を携帯電話端末1にネットワーク送信する手段を備えている。

さらに、ARデータベースサーバ3は、一人当たり少なくとも1レコードで構成されるARキャラクターをARキャラクタデータベース34に登録する手段として、登録制御部32を備える。

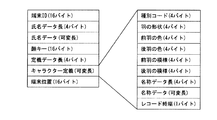

図1に示すように、ARキャラクタデータベース34が格納する1レコード分のデータには、端末装置を識別する端末IDとユーザ名、端末装置1の持ち主の顔認識を行った際に算出される特徴値である顔キー、個人毎にカスタマイズされた図形情報であるキャラクター定義、及びGPS等で計測される端末装置の現在位置が格納されている。

なお、後述の第2実施形態でも説明するが、このデータの格納方法は、端末IDとユーザ名、及び端末の現在位置情報だけを保持して、顔キーとキャラクター定義情報はデータが格納される対象の端末装置に情報取得要求をリダイレクトして前記データが格納される端末装置自身が情報を配信するように構成することもできる。

図3に例示するARキャラクタデータベース34が格納する個人レコードのデータは、端末装置の電話番号や通信MACアドレスなどの端末装置を識別できる端末ID、端末IDと関連付けるユーザの氏名データ、顔キー、キャラクター定義データ、端末の現在位置のデータで構成されている。

図3に例示する個人レコードのキャラクター定義には、キャラクターの種別、パーツの形状及び色や模様、キャラクターの名称などが含まれており、キャラクターの種別や模様は、図4A〜図4Dに示すようなコードが定義されていて、本システムのユーザは、これらを自由に組み合わせて独自のキャラクターを定義することができる。

図4Aは、種別コードが1(トンボ)、図4Bは種別コードが2(蝶)の場合を示している。

図4Cは、前羽の模様=1、図4Dは前羽の模様=2の場合を示している。

図4A〜図4Dでは、簡便にするために昆虫の例で示したが、もっと複雑なキャラクターにしても構わない。

前述のキャラクター定義レコードにより、ユーザとカスタマイズ定義された図形とが対応付けされるので、例えば、図5に示すようなユーザAとユーザBの位置を、現実の風景に合成して表示する動作において、撮影対象のユーザを端的に表す小さいキャラクター図形を用いて図6に示すような表示をすることが可能となる。

もしも、同時に二人を表示する場合であっても、図6に示すように小さいキャラクター図形を用いているため、同時に二人分のキャラクター図形を端末装置の表示部に表示することが可能であり、よって、キャラクターとユーザとの関連が既知であれば、どの辺りに、どちらの人が居るかを一目で視認できる表示をすることが可能となる。

例えば、図6では、太い実線の吹き出し内の図形の方が選択したキャラクターを表しており、図5に示すユーザBからユーザAまでの距離の表示を例示している。

図7は、図5に示すユーザBが、ユーザAとの間で近距離通信が可能な距離に近づいたときの様子を例示したものである。

ユーザAとユーザBとの距離が近距離通信が可能な距離に近づいたか否かは、ユーザAとユーザB間の距離と、予め設定された閾値とを比較することで決定され、ユーザAが使用する端末装置1から、この状態に至ったことが通知される。この場合、ユーザAは、自己が使用する端末装置1とARデータベースサーバ3とを介して、この状態に至ったことをユーザBに通知し、ユーザBの端末装置2を近距離通信モードに切り換えさせることができる。

図7は、図5に示すユーザBが、ユーザAに近づいたときの様子を例示したものであったが、この場合、端末装置1(ここでは携帯電話端末1の表示部14)の表示画面は、例えば図8に示すようになる。

ここでは、顔認識した領域をマーカーとして、その相対位置に領域の大きさに合わせたキャラクターを表示しているため、図9に示すように、ユーザの上方周囲をキャラクターが飛翔している表現になっている。

図8の右側半分に示すように、撮影対象のユーザBがさらにユーザAに近づいた場合は、撮影対象のユーザBの顔領域の大きさが大きくなり、それに従ってキャラクター図形も拡大するように構成するので、自然に感じられる合成結果を得ることができる。

撮影者の携帯電話端末1が一度取得したキャラクター定義は、(少なくとも後述する検索機能などを使わない限りは)他者ARキャラクター定義163に格納されているので、撮影対象のユーザの端末装置とは毎回通信を行わなくても表示することが可能である。

以上は表示する相手が分かっていて表示する相手を指定したか、若しくは目の前に表示する相手が存在する場合の動作であったが、ユーザAの目の前の空間に撮影対象のユーザB(携帯電話端末2)が居るかどうか分からない場合において本システムを動作させるのが、図9に画面例を示す通信相手発見機能である。

図9において、左端の図が通信相手発見機能を起動した直後の画面である。

この場合、操作者ユーザAが端末装置1のカメラを向けた方向と、端末装置1の位置の測定データとから、前方にいる登録ユーザをネット通信部17を介してARデータベースサーバ3に問い合わせた検索結果のキャラクターを並べて表示部14に表示している。

このような表示方法は、多数の検索結果が出たときに、その中から特定の個人を選択する操作をし易くするためである。

ここで図9の左側に示すように、表示部14に表示された中から、目的のキャラクターをタッチ指定することで図9の中央(即ち前述の図6で示した状態を示す画面と同じ画面)に遷移させることができる。

操作者(携帯電話端末1の操作者)は、この画面表示に従って歩行することで、特定された個人である相手の居る場所に到達することが可能となり、図9の右側(即ち、前述の図8の左側半分で示した状態を示す画面と同じ画面)に遷移する。

また、グループIDを導入した場合には、グループIDを指定した場合にのみ、キャラクターをタッチする指定が可能になり、グループIDを指定しない場合はキャラクターをタッチ指定することができないようにして、グループIDを指定しないことで本システムに加入するユーザがどれくらい来ているかを見てみたり、他の人の定義したキャラクターを鑑賞するといった表示のさせ方を実現することも可能である。

本発明における一形態においては、人物が写った映像から顔を認識し、顔部分の特徴を数値化して、その数値と関連付けられた図形としてユーザ個人がカスタマイズした独自図形を定義し、定義情報と顔部分の特徴数値をそのユーザの端末に保存して、無線による近接通信、あるいはネットワーク上のサーバーを経由して他のユーザの端末との間で交換することができるように構成している。よって、本システムのユーザは、無数の種類の合成画像と、無数の種類のマーカーを運用することができる。

キャラクター図形を配置する際には、認識された顔の画像の大きさと位置とを使用するので、対象となる特定の個人との関連を自然な表現で表示し、視認させることができる。

また、特定の個人を示すキャラクター図形を指定することで、前記特定の個人にまで辿り着くことができる手段を備える。

まず、ユーザが端末装置1を操作して自己ARキャラクターデータの定義を行うときの動作を説明する。

(ステップS1)

ステップS1では、カメラ部11が操作者によって起動される(ユーザ自身を撮影する準備)。

(ステップS2)

ステップS2では、カメラ部11を介して操作しているユーザ自身が撮影される。

(ステップS3)

ステップS3では、顔認識部13が、顔認識用の特徴抽出を行って顔キーの特徴データを作成し、端末装置1の自己ARキャラクター定義162の1項目である顔キー(図3参照)に登録する。

このとき、正面だけではなく、必要に応じて、左右方向からの撮影を行うようにしても良い。

ステップS4では、図4A〜図4Dに示したような定義のバリエーション(種別、色、模様等)が前記操作者によって指定され、自己ARキャラクターの見かけが定義される。

(ステップS5)

ステップS5では、AR制御部16が、ステップS4で定義されたARキャラクターを、自己ARキャラクター定義162の各項目に登録する(登録内容は表示部14に表示される)。

(ステップS6)

ステップS6では、操作者は、表示部14の表示画面を視認して、登録の確認を行う。

(ステップS7)

ステップS7では、AR制御部16が、登録がOKであったか否かを検証し、登録がOKの場合はステップS8に進み、登録がOKではない場合にはステップS4に戻る。

即ち、ここでは、操作者は、定義に従った表示を行ってみて、気に入れば登録を実行し、気に入らなければバリエーションの指定をし直すことができる。

ステップS8では、AR制御部16が、ネット通信部171を介してARデータベースサーバ3にステップS4で定義されたARキャラクターを登録させ、処理を終了する。

即ち、ここでは、ARデータベースサーバ3にもキャラクター定義を置くことにしているため、OKの場合はネットワーク通信によってARデータベースサーバ3に指定結果を登録するが、ARデータベースサーバ3がリダイレクト動作をして、毎回端末データを取得する制御方法にする場合はARデータベースサーバ3への登録は省略できる。

なお、端末装置の現在位置を、適宜ARデータベースサーバ3にアップロードして該サーバに保持させる処理は、本システムの特徴的な処理ではなく、既存の動作であるので、ここでの説明は省略する。

(ステップS21)

ステップS21では、操作者によって、データを取得する他者の端末装置2からの入力指定が示される。

(ステップS22)

ステップS22では、通信部17が、自己端末装置とデータを取得する他者の端末装置との間の距離が、前述のとおり予め設定された所定の閾値より、近いか否かを判定し、上記距離が近い場合はステップS26に移り、上記距離が近くない場合はステップS23に進む。

(ステップS23)

ステップS23では、端末装置1の通信部17は、ネット通信部171を介してARデータベースサーバ3にアクセスし、データを取得する他者の端末装置由来のARキャラクター定義を検索させる。

ステップS24では、通信部17は、ARデータベースサーバ3から、データを取得する他者の端末装置由来のARキャラクター定義と、前記他者の端末装置の位置情報とを取得する。

(ステップS25)

ステップS25では、通信部17は、前記取得した他者ARキャラクター定義と、該他者の端末装置の位置情報とを、他者ARキャラクター定義163に格納し、処理を終了する。

なお、遠距離通信による取得であれば、その後にGPSを使って相手(他者)の距離と方向を表示する必要があるので、上記のように、前記他者の端末装置位置情報も取得するものである。

(ステップS26)

ステップS26では、通信部17は、近距離通信部172を起動して、前記他者の端末装置と接続する。

(ステップS27)

ステップS27では、通信部17は、前記他者の端末装置から、他者の端末装置由来のARキャラクター定義を取得し、その後、ステップS25に移る。

図11Aに示した動作は、図7に示すシチュエーション(状況)で実行するものである。

この動作を実行する時点では、図10Bに示す他者データ取得処理は終了している状態であるものとする。

(ステップA1)

ステップA1では、操作者によって端末装置1のカメラ部11が操作され、撮影した撮像データが取得される。

(ステップA2)

ステップA2では、顔認識部13が、撮像データから、人間の顔として認識できるデータを検出する。

(ステップA3)

ステップA3では、顔認識部13が、人間の顔として認識できるデータを検出したか否かを検証し、人間の顔として認識できるデータを検出した場合はステップA4に進み、人間の顔として認識できるデータを検出しなかった場合は処理を終了する。

ステップA4では、顔認識部13が、人間の顔として認識できるデータが複数検出された場合には、最初の処理対象として、例えば一番左上に位置する検出結果を選択する。

(ステップA5)

ステップA5では、顔認識部13が、顔認識用の特徴データを抽出する。例えば、目と口の距離や目の間隔との比率などの顔の特徴データを抽出する。

(ステップA6)

ステップA6では、顔認識部13が、他者ARキャラクター定義163の顔キーのデータに一致する(あるいは近い)ものがあるか否かを検索する。

(ステップA7)

ステップA7では、顔認識部13が、上記検索により、他者ARキャラクター定義163の顔キーのデータに近い特徴データが存在していたか否かを検証し、上記特徴データが存在する場合はステップS9にて後述の顔基点AR表示処理を行い、その後、ステップA8に戻る。また、上記特徴データが存在しない場合は直ちにステップA8に進む。

ステップA8では、顔認識部13が、人間の顔として認識されたデータの全てについて、上記の処理が完了したか否かを検証し、未処理のデータが有ればステップA10に移り、また、全データについての上記処理が完了した場合は処理を終了する。

(ステップA9)

ステップA9(サブルーチン)の処理は後述する。

(ステップA10)

ステップA10では、顔認識部13が、人間の顔として認識された次のデータを選択し、ステップA5に戻る。

以下、図11Bでは、図11Aに示すフローチャートおいて、ステップA9で実行するサブルーチン(顔基点AR表示処理)での動作手順を説明する。

(ステップA21)

ステップA21では、顔認識部13が、パターンマッチング法を用いて、所与の画像から、所定の特徴を有する顔画像を認識して検出し、顔認識枠の位置と大きさとを取得する。

ステップA22では、顔認識部13が、顔認識枠の大きさによってARキャラクター画像の拡大(拡大率の決定)または縮小(縮小率の決定)を行う。

(ステップA23)

ステップA23では、顔認識部13が、現在時刻をパラメータとして、顔認識枠からの相対座標(即ち相対描画位置)を決定する。

なお、現在時刻をパラメータとして前記の相対描画位置を変化させることで、顔の周囲を飛翔したり、肩のあたりで上下して羽ばたくようなアニメーション表示も可能となる。

ステップA24では、顔認識部13が、ARキャラクター画像を、上記で決定した位置と大きさで、画像メモリ12に描画し、呼び出し元に復帰する。

これにより、現実の映像にカスタマイズされたキャラクターが合成された映像が表示される。

複数の顔が検出されていた場合は、検出された次の顔領域に対して特徴抽出処理以降の処理を繰り返すものとする。

これにより、端末装置1の表示部14の画面内にいる複数の人の周囲に、それぞれの人物に対応して、それぞれ定義したARキャラクターを飛翔させることができる。

図12に示すフローチャートは、図9の左端に示す画像の表示を行う場合の動作を示す。

(ステップB1)

ステップB1では、操作者によって端末装置1のカメラ部11が操作され、表示のベースとなる眼前の景色の撮像データが取得される。

(ステップB2)

ステップB2では、操作者によってGPS/磁気センサ15が起動され、端末装置1の位置が確定され、その位置が取得される。

(ステップB3)

ステップB3では、操作者によって起動されたGPS/磁気センサ15を介して、カメラ部11のカメラが向いている方向が取得される。

ステップB4では、カメラ部11が、カメラ撮影範囲の位置を算出する。

(ステップB5)

ステップB5では、ネット通信部171が、ARデータベースサーバ3と接続する。

(ステップB6)

ステップB6では、ネット通信部171が、ARデータベースサーバ3にアクセスし、ARキャラクタデータベース34内に、端末装置1の現在位置がカメラ撮影範囲に含まれる他者の端末装置から登録された個人レコードが存在するか否かを検索させる。

ここでは、例えば、カメラの画角が対角60度程度あり、前方80mまでを範囲とする場合は、自己の位置からカメラが向いている方向に40m先の、半径30mの円内に存在する端末装置のユーザを検索するようにARデータベースサーバ3に指示する。

より正確には、20m先の半径10mの円内に含まれる端末装置と、40m先の半径20m、及び60m先の半径30mの円内に含まれる端末装置を検索させる。

(ステップB7)

ステップB7では、ネット通信部171が、ARデータベースサーバ3から、上記個人レコードの存在が応答されたか否かを検証し、上記個人レコードの存在が応答された場合はステップB8に進み、上記個人レコードの存在が応答されなかった場合は処理を終了する。

ステップB8では、ネット通信部171が、ARデータベースサーバ3から存在が応答された他者の個人レコードを全て取得し、AR制御部16に送出する。

(ステップB9)

ステップB9では、AR制御部16が、存在した他者の個人レコードについて、画像メモリ12に、取得したARキャラクターを全てタイル状に並べて描画し、表示部14の画面上に表示すると共に、どの位置にどのARキャラクターを並べたかを記憶しておく(これは、後で表示画面がタッチされた時に、どのARキャラクターが選択されたのかを判断する必要があるからである)。

図13に示すフローチャートの動作は、図5に示すシチュエーション(ユーザAとユーザBが離れている状況)で、図6の表示を行う場合に実行されるものである。

ここでは、ARキャラクターの表示対象の指定は、端末装置1の他者ARキャラクター定義163に格納された他の個人であるものとしている。

(ステップC1)

ステップC1では、カメラ部11のカメラが、操作者によって操作され、表示のベースとなる映像が撮影されて、画像メモリ12に撮影された画像データが取得される。

(ステップC2)

ステップC2では、操作者によって起動されたGPS/磁気センサ15を介して、端末装置1が存在する位置の位置情報が取得される。

(ステップC3)

ステップC3では、操作者によって起動されたGPS/磁気センサ15を介して、端末装置1の方向が取得される。

ステップC4では、AR制御部16が、相手端末装置の位置を更新するために、図10Bに示した他者データ取得処理を実行して他者の個人レコードを再取得する。

このとき、ARデータベースサーバ3との通信手段としては、ネット通信部17を介したネットワーク通信手段が用いられる。但し、相手端末装置の位置情報以外の情報は既に保持しているため、相手端末装置の位置情報だけを取得するようにしても構わない。

(ステップC5)

ステップC5では、AR制御部16が、表示部14の表示画面上の、端末装置1から見た相手端末装置の方向を算出する。

(ステップC6)

ステップC6では、AR制御部16が、端末装置1と相手端末装置との間の距離を算出する。

(ステップC7)

ステップC7では、AR制御部16が、画像メモリ12内に相手端末装置に対応するARキャラクターと吹き出し図形とを合成し、表示部14の表示画面上の大体の場所に表示し、処理を終了する。これにより、図6に例示する画面表示が出力される。

(ステップC21)

ステップC21では、AR制御部16が、図12に示した範囲指定AR表示処理を実行する。これにより、図9の左側に示す画像が表示される。

(ステップC22)

ステップC22では、操作者が、図9の左側に表示された画像において、表示されている1つのARキャラクターの描画位置を指定する。

AR制御部16は、図12のステップB9の処理でARキャラクターの描画位置を記憶していたので、AR制御部16は、上記の指定により、どのARキャラクターが選択されたかが判り、他者ARキャラクター定義部163に格納されている、どの定義レコードであるかを判明することができる。

(ステップC23)

ステップC23では、AR制御部16が、上記で選択された定義だけを残して他の定義を消去する。

ステップC24では、AR制御部16が、図13に示す遠距離AR表示処理を実行する。

これにより、表示部14の表示画面は、図9に示す中央部の図形の表示状態に遷移するので、操作者は、この表示を見ながら歩行して相手端末装置に接近することができる。

(ステップC25)

ステップC25では、AR制御部16が、図13に示すステップC6の処理で計算された端末装置1と相手端末装置との距離が5m以内になったか否かを検証し、距離が5m以内の場合はステップC26に進み、また、前記の距離が5m以内でない場合はステップC24に戻る。

(ステップC26)

ステップC26では、AR制御部16が、図7に示すように、例えば相手との距離が5m以内になると、顔認識部13を起動し、カメラ部11から取得した画像中に、指定した定義に格納されているキーに近い顔画像が有るか否かを検索する。

(ステップC27)

ステップC27では、AR制御部16は、ステップC25の処理で、前記キーに近い顔画像が検索されたか否かを検証し、前記キーに近い顔画像が検索されたならステップC28に進み、前記キーに近い顔画像が検索されていない場合はステップC24に戻る。

ステップC28では、AR制御部16は、図11Aに示す近距離AR表示処理を実行する。

これにより、表示部14の表示画面は、図9の右側に示す表示状態に遷移する。

なお、図14のフローチャートに示す動作手順では、操作者が検索対象に近づいたときの動作として、5m以内に近づいた場合に顔認識部13を起動し、顔画像が検出できたことを確認した上で、図11Aに示す近距離AR表示処理を実行するものとしたが、この顔画像の検出処理を省略して、いきなり図11Aに示す近距離AR表示処理を動作させるようにしても構わない。

但し、この場合は、表示部14の表示画面から、一時的にキャラクター表示が消える可能性が有るが、その代わりに、顔画像の認識処理を、ステップC24の遠距離AR表示処理に続いて実行する必要が無くなり、処理が簡便で軽くなるというメリットが有る。

さらに、この時、この他の登録ユーザが設定した複数のARキャラクターの1つを指で指定することによって、特定の個人だけを指定して追跡することができるようになる。

前述の第一の実施形態では、連携するサーバ装置(即ちARデータベースサーバ3)にも、ARキャラクター定義データが保持されている場合を示したが、本発明は、一般に、連携するサーバ装置には、端末IDとユーザ名、及び端末装置の現在位置のみを保持し、顔キー及びキャラクター定義については、本システムに加入している個々のユーザの端末装置に取得要求をリダイレクトして取得するように構成することも可能である。

さらに、連携するサーバ装置には、個々の端末装置の現在位置を示す位置情報も保持しないものとし、ユーザ名と端末IDのみを保持するようにして、そのサーバ装置から遠隔制御によって端末装置の現在位置を取得させ、キー及びキャラクター定義データと共に、現在位置を取得した端末装置からARキャラクター定義データの一部を取得するようにしても良い。

しかしながら、この場合、相手端末装置が通信可能な場所に居る必要が有るという制約が発生する。

そこで、以下で説明する本発明の第二の実施形態では、上記の制約を緩和できるようにすることを意図し、具体的には、本システムに加入しているユーザの個々の端末装置に保持するARキャラクター定義データと、連携サーバ(ここでもARデータベースサーバ3とする)が保持するARキャラクター定義データには、それぞれグループIDを付加するものとしている。

以下、図を参照しながら、本発明の第二の実施形態について説明する。

図15に示す本発明の第二の実施形態に係る個人識別キャラクター表示システムの全体構成は、図1に示す本発明の第一の実施形態に係る個人識別キャラクター表示システムの全体構成と同じであるが、ARデータベースサーバ3のARキャラクタデータベース34に格納されている、顔キー、キャラクター定義、及び端末現在位置については、括弧付きで示している点だけが、図1に示す本発明の第一の実施形態に係る個人識別キャラクター表示システムとの相違点である。

このような表現の意図するところは、ARデータベースサーバ3のARキャラクタデータベース34には、実際には前記のデータが保持されておらず、前記のデータについては、指定された他の端末装置から取得したデータを転送するだけであることを示すことである。

図16に示す個人レコードデータは、本システムに加入しているユーザの個々の端末装置が保持する個人のレコードデータを表したものであり、ARデータベースサーバ3にも、同様に端末ID、氏名、及びグループIDが保持されているものとする。

以下、第二の実施形態に係る個人識別キャラクター表示システムの動作を、ARデータベースサーバ3の機能を中心にして説明する。

加入ユーザの端末装置の1つから、ARデータベースサーバ3に対してARキャラクター定義データの送信要求が発信されると、ARデータベースサーバ3は、その通信要求で指定された加入ユーザの端末装置に対してARキャラクター定義データの送信を要求する。

この端末装置が応答し、かつ該当ユーザのARキャラクター定義データを、この端末装置の他者ARキャラクター定義に保持している場合は、その保持されているARキャラクター定義データを送信させ、最初の要求元である加入ユーザの端末装置に対して転送する。

(ステップD1)

ステップD1では、ARデータベースサーバ3は、第1実施形態における図10Bの他者データ取得処理と同様の処理によって、例えば携帯電話端末1から、指定された相手端末装置のユーザのARキャラクター定義データを要求される。

(ステップD2)

ステップD2では、ARデータベースサーバ3の検索制御部33は、前記ARキャラクター定義データの要求において氏名で指定された加入ユーザの端末IDを、ARキャラクタデータベース34上で検索し、端末通信部31を介して、検索結果の端末IDを有する端末装置との通信が可能か否かをテストする。

(ステップD3)

ステップD3では、検索制御部33は、前記指定された加入ユーザの端末装置との通信が可能か否かのステップD2におけるテストの結果により、前記加入ユーザの端末装置との通信が可能か否か検証し、前記指定された加入ユーザの端末装置との通信が可能な場合はステップD4に進み、前記指定された加入ユーザの端末装置との通信が不可能の場合はステップD6に移る。

ステップD4では、検索制御部33は、前記加入ユーザの端末装置のARキャラクター定義に格納されたARキャラクター定義データを取得する。

(ステップD5)

ステップD5では、検索制御部33は、ステップD4の処理で取得したARキャラクター定義データを、端末通威信部31を介して元の要求元の端末装置(ここでは携帯電話端末1)に転送する。

(ステップD6)

ステップD6では、検索制御部33は、前記要求において通信対象として定義されたグループIDを有する他の端末装置を、ARキャラクタデータベース34上で検索する。

(ステップD7)

ステップD7では、検索制御部33は、ステップD6の検索処理の結果として、前記グループIDを有する他の端末装置が検索されたか否かを検証し、前記グループIDを有する他の端末装置が検索された場合はステップD8に進み、前記グループIDを有する他の端末装置が検索されなかった場合はステップD13に移る。

ステップD8では、検索制御部33は、検索結果の端末IDを有する端末装置との通信が可能か否かをテストする。

(ステップD9)

ステップD9では、検索制御部33は、ステップD8におけるテストの結果により、前記検索結果の端末IDを有する端末装置との通信が可能か否か検証し、該端末装置との通信が可能な場合はステップD10に進み、該端末装置との通信が不可能の場合はステップD6に戻る。

(ステップD10)

ステップD10では、検索制御部33は、前記検索結果の端末IDを有する端末装置のARキャラクター定義に格納されている、前記要求において氏名で指定された加入ユーザの端末装置のデータを取得する。

(ステップD11)

ステップD11では、検索制御部33は、前記データの取得が成功したか否かを検証し、前記データの取得に成功した場合はステップD12に進み、前記データの取得に成功しなかった場合はステップD6に戻る。

ステップD12では、検索制御部33は、前記検索結果の端末IDを有する端末装置のARキャラクター定義に格納されている、前記要求において氏名で指定された加入ユーザの端末装置のARキャラクター定義データを取得し、その後、ステップD5に移る。

(ステップD13)

ステップD13では、検索制御部33は、最初の要求元の端末装置(ここでは携帯電話端末1)に対して、「氏名で指定された人物のARキャラクター定義データは取得できなかった」という旨の信号を応答する。

(ステップE1)

ステップE1では、例えば携帯電話端末1のネット通信部171が、ARデータベースサーバ3から、データを転送すべき端末装置2(携帯電話端末2)が発信した端末IDの送信要求を受信する。

(ステップE2)

ステップE2では、端末装置1のAR制御部16が、自己ARキャラクター定義162の格納データが要求されたか否かを判断し、自己ARキャラクター定義162の格納データが要求された場合はステップE7に移り、自己ARキャラクター定義162の格納データが要求されていない場合にはステップE3に進む。

ステップE3では、端末装置1のAR制御部16が、他者ARキャラクター定義163の中に、受信した端末IDのデータが格納されているか否かを検証する。

(ステップE4)

ステップE4では、端末装置1のAR制御部16が、ステップE3の検証によって、他者ARキャラクター定義163の中に、該当する端末IDのデータが格納されていたか否かを判断し、他者ARキャラクター定義163の中に、該当する端末IDのデータが格納されていた場合はステップE5に進み、また、該当する端末IDのデータが格納されていなかった場合はステップEに移る。

(ステップE5)

ステップE5では、AR制御部16が、他者ARキャラクター定義163に格納されている受信した端末IDのデータを取得し、ネット通信部171を介してARデータベースサーバ3に送信し、処理を終了する。

ステップE6では、AR制御部16が、該当する端末IDのデータは格納されていなかった旨の信号を、ネット通信部171を介してARデータベースサーバ3に送信し、処理を終了する。

(ステップE7)

ステップE7では、AR制御部16が、自己ARキャラクター定義162に格納されている該当端末IDのデータを取得し、ネット通信部171を介してARデータベースサーバ3に送信し、処理を終了する。

このような動作の処理により、同じグループIDを持つ複数の端末装置群とARデータベースサーバ3とが、データキャッシュサーバの役割を果たすようになり、最初にARキャラクター定義データを要求した端末装置(ここでは携帯電話端末1)は、高い確度で、要求したデータを入手することができる。

この場合、本システムの加入ユーザは、ARキャラクター画像の指タッチで指定した本システムの他の加入ユーザが、どの程度の眼前に居るかを調べることができても、他の加入ユーザの個人情報は保護されることになる。

なお、上記のグループIDを参照する各処理においては、グループIDの文字列自体ではなく、その文字列から計算されるハッシュコードを通信時に交換することで、グループIDの設定が他者に漏洩することを防ぐことができる。

本願は、2011年4月20日に、日本に出願された特願2011−093810号に基づき優先権を主張し、その内容をここに援用する。

2 携帯電話端末

3 ARデータベースサーバ

11 カメラ部

12 画像メモリ

13 顔認識部

14 表示部

15 GPS/磁気センサ

16 AR制御部

17 通信部

31 端末通信部

32 登録制御部

33 検索制御部

34 ARキャラクタデータベース

161 制御プログラム

162 自己ARキャラクター定義

163 他者ARキャラクター定義

171 ネット通信部

172 近距離通信部

Claims (10)

- 端末装置に搭載したカメラで撮影した現実世界の画像にCG描画した画像を合成描画する個人識別キャラクター表示システムであって、

前記カメラで撮影した現実世界の画像データから、該画像データを表示する画像領域において所定の被写体の特徴を有する部分領域を、パターンマッチング法で認識して検出する検出手段と、

前記現実世界の画像の前記検出した部分領域に、該部分領域で特徴付けられた前記被写体に対応して予め保持されている所定のCG画像を合成描画する合成描画部と、

前記合成された画像領域を含む前記現実世界の画像を表示する画像表示部と、

を備えた個人識別キャラクター表示システム。 - 登録ユーザ個人が使用する端末装置には、他の登録ユーザも含めた登録ユーザ個人毎の情報を記録した個人レコードを保持すると共に、前記登録ユーザ個人毎の個人レコードの内訳は、前記ARキャラクター画像の形状を定義する情報、及び前記所定の被写体の特徴を示す情報である請求項1記載の個人識別キャラクター表示システム。

- 登録ユーザ個人毎の情報を記録した個人レコードを保持するネットワーク上のARデータベースサーバをさらに備えると共に、前記登録ユーザ個人毎の個人レコードの内訳は、前記ARキャラクター画像の形状を定義する情報、及び前記所定の被写体の特徴を示す情報である請求項2記載の個人識別キャラクター表示システム。

- 前記端末装置と前記他の登録ユーザが使用する他の端末装置とが各々保持する前記登録ユーザ個人毎の個人レコードの情報は、前記端末装置と前記他の端末装置間の直接の近接通信部、若しくは前記ARデータベースサーバが前記ネットワークを介して中継する通信部により、前記端末装置と前記他の端末装置の間で互いに交換して参照する請求項3記載の個人識別キャラクター表示システム。

- 前記ARデータベースサーバが保持する前記登録ユーザ個人毎の個人レコードの情報は、前記いずれの端末装置においてもダウンロードして該端末装置において参照する請求項3または請求項4記載の個人識別キャラクター表示システム。

- 前記ネットワーク上の前記ARデータベースサーバには、さらに、登録ユーザ個人が所有する端末装置の現在の位置情報の登録が可能であり、該位置情報は、前記ARデータベースサーバからの前記ダウンロードの際に前記端末装置に送信され、前記合成された画像領域を含む前記現実世界の画像の表示に反映される請求項5記載の個人識別キャラクター表示システム。

- 前記ネットワーク上の前記ARデータベースサーバに、現在位置が前記カメラの撮影範囲に含まれる他の登録ユーザの端末装置が存在し、かつ該他の登録ユーザの端末装置から登録された前記登録ユーザ個人毎の個人レコードの情報が存在するか否かを検索させる請求項2乃至6のいずれか1項に記載の個人識別キャラクター表示システム。

- 自己が搭載するカメラで撮影した現実世界の画像にCG描画した画像を合成描画する端末装置であって、

前記カメラで撮影した現実世界の画像データから、該画像データを表示する画像領域において所定の被写体の特徴を有する部分領域を、パターンマッチング法で認識して検出する検出部と、

前記現実世界の画像の前記検出した部分領域に、該部分領域で特徴付けられた前記被写体に対応して予め保持されている所定のCG画像を合成描画する合成描画部と、

前記合成された画像領域を含む前記現実世界の画像を表示する画像表示部と、

を備えた端末装置。 - 端末装置に搭載したカメラで撮影した現実世界の画像にCG描画した画像を合成描画する個人識別キャラクター表示方法であって、

前記カメラで撮影した現実世界の画像データから、該画像データを表示する画像領域において所定の被写体の特徴を有する部分領域を、パターンマッチング法で認識して検出するステップと、

前記現実世界の画像の前記検出した部分領域に、該部分領域で特徴付けられた前記被写体に対応して予め保持されている所定のCG画像を合成描画するステップと、

前記合成された画像領域を含む前記現実世界の画像を表示するステップと、

を有する個人識別キャラクター表示方法。 - 搭載するカメラで撮影した現実世界の画像にCG描画した画像を合成描画する端末装置を制御するためのコンピュータプログラムであって、

前記カメラで撮影した現実世界の画像データから、該画像データを表示する画像領域において所定の被写体の特徴を有する部分領域を、パターンマッチング法で認識して検出するステップと、

前記現実世界の画像の前記検出した部分領域に、該部分領域で特徴付けられた前記被写体に対応して予め保持されている所定のCG画像を合成描画するステップと、

前記合成された画像領域を含む前記現実世界の画像を表示するステップと、

を有するコンピュータプログラム。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2011093810 | 2011-04-20 | ||

| JP2011093810 | 2011-04-20 | ||

| PCT/JP2012/059911 WO2012144389A1 (ja) | 2011-04-20 | 2012-04-11 | 個人識別キャラクター表示システム、端末装置、個人識別キャラクター表示方法、及びコンピュータプログラム |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JPWO2012144389A1 true JPWO2012144389A1 (ja) | 2014-07-28 |

| JP6020446B2 JP6020446B2 (ja) | 2016-11-02 |

Family

ID=47041500

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2013510960A Expired - Fee Related JP6020446B2 (ja) | 2011-04-20 | 2012-04-11 | 画像表示システム、画像表示装置、画像表示方法及びプログラム |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US9721388B2 (ja) |

| EP (1) | EP2701123B1 (ja) |

| JP (1) | JP6020446B2 (ja) |

| WO (1) | WO2012144389A1 (ja) |

Families Citing this family (25)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8988574B2 (en) | 2012-12-27 | 2015-03-24 | Panasonic Intellectual Property Corporation Of America | Information communication method for obtaining information using bright line image |

| US9608725B2 (en) | 2012-12-27 | 2017-03-28 | Panasonic Intellectual Property Corporation Of America | Information processing program, reception program, and information processing apparatus |

| JP5603523B1 (ja) | 2012-12-27 | 2014-10-08 | パナソニック インテレクチュアル プロパティ コーポレーション オブ アメリカ | 制御方法、情報通信装置およびプログラム |

| US10303945B2 (en) * | 2012-12-27 | 2019-05-28 | Panasonic Intellectual Property Corporation Of America | Display method and display apparatus |

| EP2940901B1 (en) | 2012-12-27 | 2019-08-07 | Panasonic Intellectual Property Corporation of America | Display method |

| US10523876B2 (en) | 2012-12-27 | 2019-12-31 | Panasonic Intellectual Property Corporation Of America | Information communication method |

| US9341014B2 (en) | 2012-12-27 | 2016-05-17 | Panasonic Intellectual Property Corporation Of America | Information communication method using change in luminance |

| US10951310B2 (en) | 2012-12-27 | 2021-03-16 | Panasonic Intellectual Property Corporation Of America | Communication method, communication device, and transmitter |

| US10530486B2 (en) | 2012-12-27 | 2020-01-07 | Panasonic Intellectual Property Corporation Of America | Transmitting method, transmitting apparatus, and program |

| US9087349B2 (en) | 2012-12-27 | 2015-07-21 | Panasonic Intellectual Property Corporation Of America | Information communication method |

| US8922666B2 (en) | 2012-12-27 | 2014-12-30 | Panasonic Intellectual Property Corporation Of America | Information communication method |

| CN103105993B (zh) * | 2013-01-25 | 2015-05-20 | 腾讯科技(深圳)有限公司 | 基于增强现实技术实现互动的方法和系统 |

| JP2014174589A (ja) * | 2013-03-06 | 2014-09-22 | Mega Chips Corp | 拡張現実システム、プログラムおよび拡張現実提供方法 |

| FR3008210B1 (fr) * | 2013-07-03 | 2016-12-09 | Snecma | Procede et systeme de realite augmentee pour la supervision |

| KR102258490B1 (ko) | 2014-05-29 | 2021-05-31 | 삼성전자주식회사 | 전자 장치 및 전자 장치에서 무선 네트워크 접속 방법 |

| JP5989725B2 (ja) * | 2014-08-29 | 2016-09-07 | 京セラドキュメントソリューションズ株式会社 | 電子機器及び情報表示プログラム |

| KR102278460B1 (ko) * | 2014-10-17 | 2021-07-19 | 삼성전자주식회사 | 컨텐츠 공유 방법 및 디바이스, 컨텐츠 공유 시스템 |

| US20160227267A1 (en) * | 2015-01-30 | 2016-08-04 | The Directv Group, Inc. | Method and system for viewing set top box content in a virtual reality device |

| US10636175B2 (en) * | 2016-12-22 | 2020-04-28 | Facebook, Inc. | Dynamic mask application |

| JP6475776B2 (ja) * | 2017-04-27 | 2019-02-27 | 株式会社メガチップス | 拡張現実システムおよび拡張現実提供方法 |

| CN107566911B (zh) * | 2017-09-08 | 2021-06-29 | 广州方硅信息技术有限公司 | 一种直播方法、装置、系统及电子设备 |

| CN108693548B (zh) * | 2018-05-18 | 2021-10-22 | 中国科学院光电研究院 | 一种基于场景目标识别的导航方法及系统 |

| CN109064416B (zh) * | 2018-07-10 | 2021-06-15 | Oppo广东移动通信有限公司 | 图像处理方法、装置、存储介质及电子设备 |

| JP7160707B2 (ja) * | 2019-01-31 | 2022-10-25 | 株式会社スクウェア・エニックス | 仮想キャラクタを含む画像を提供するための方法 |

| JP7280492B2 (ja) * | 2019-03-25 | 2023-05-24 | 株式会社Mixi | 情報処理装置、情報処理方法およびプログラム |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2002077592A (ja) * | 2000-04-13 | 2002-03-15 | Fuji Photo Film Co Ltd | 画像処理方法 |

| JP2009076060A (ja) * | 2007-08-29 | 2009-04-09 | Casio Comput Co Ltd | 画像合成装置および画像合成処理プログラム |

| WO2010084242A1 (en) * | 2009-01-23 | 2010-07-29 | Nokia Corporation | Method, system, computer program, and apparatus for augmenting media based on proximity detection |

| JP2012060240A (ja) * | 2010-09-06 | 2012-03-22 | Sony Corp | 画像処理装置、プログラム及び画像処理方法 |

Family Cites Families (13)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US7106887B2 (en) | 2000-04-13 | 2006-09-12 | Fuji Photo Film Co., Ltd. | Image processing method using conditions corresponding to an identified person |

| JP3729161B2 (ja) | 2001-08-07 | 2005-12-21 | カシオ計算機株式会社 | 目標位置探索装置、目標位置探索方法及びプログラム |

| JP4032776B2 (ja) | 2002-03-04 | 2008-01-16 | ソニー株式会社 | 複合現実感表示装置及び方法、記憶媒体、並びにコンピュータ・プログラム |

| US8547401B2 (en) | 2004-08-19 | 2013-10-01 | Sony Computer Entertainment Inc. | Portable augmented reality device and method |

| US20060182433A1 (en) * | 2005-02-15 | 2006-08-17 | Nikon Corporation | Electronic camera |

| US8644842B2 (en) * | 2007-09-04 | 2014-02-04 | Nokia Corporation | Personal augmented reality advertising |

| JP4508257B2 (ja) * | 2008-03-19 | 2010-07-21 | ソニー株式会社 | 構図判定装置、構図判定方法、プログラム |

| US8199966B2 (en) * | 2008-05-14 | 2012-06-12 | International Business Machines Corporation | System and method for providing contemporaneous product information with animated virtual representations |

| EP2157545A1 (en) | 2008-08-19 | 2010-02-24 | Sony Computer Entertainment Europe Limited | Entertainment device, system and method |

| US8116749B2 (en) * | 2008-09-08 | 2012-02-14 | Proctor Jr James Arthur | Protocol for anonymous wireless communication |

| WO2012003844A1 (en) * | 2010-07-05 | 2012-01-12 | Sony Ericsson Mobile Communications Ab | Method for displaying augmentation information in an augmented reality system |

| JP5730518B2 (ja) * | 2010-08-27 | 2015-06-10 | 株式会社日立国際電気 | 特定人物検知システムおよび特定人物検知方法 |

| US9317530B2 (en) * | 2011-03-29 | 2016-04-19 | Facebook, Inc. | Face recognition based on spatial and temporal proximity |

-

2012

- 2012-04-11 WO PCT/JP2012/059911 patent/WO2012144389A1/ja active Application Filing

- 2012-04-11 JP JP2013510960A patent/JP6020446B2/ja not_active Expired - Fee Related

- 2012-04-11 EP EP12774800.2A patent/EP2701123B1/en not_active Not-in-force

- 2012-04-11 US US14/112,030 patent/US9721388B2/en not_active Expired - Fee Related

Patent Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2002077592A (ja) * | 2000-04-13 | 2002-03-15 | Fuji Photo Film Co Ltd | 画像処理方法 |

| JP2009076060A (ja) * | 2007-08-29 | 2009-04-09 | Casio Comput Co Ltd | 画像合成装置および画像合成処理プログラム |

| WO2010084242A1 (en) * | 2009-01-23 | 2010-07-29 | Nokia Corporation | Method, system, computer program, and apparatus for augmenting media based on proximity detection |

| JP2011521489A (ja) * | 2009-01-23 | 2011-07-21 | ノキア コーポレイション | 近接検出に基づいてメディアを拡張するための方法、システム、コンピュータプログラム、および装置 |

| JP2012060240A (ja) * | 2010-09-06 | 2012-03-22 | Sony Corp | 画像処理装置、プログラム及び画像処理方法 |

Also Published As

| Publication number | Publication date |

|---|---|

| US20140035952A1 (en) | 2014-02-06 |

| EP2701123B1 (en) | 2018-10-17 |

| WO2012144389A1 (ja) | 2012-10-26 |

| EP2701123A1 (en) | 2014-02-26 |

| EP2701123A4 (en) | 2014-12-17 |

| US9721388B2 (en) | 2017-08-01 |

| JP6020446B2 (ja) | 2016-11-02 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6020446B2 (ja) | 画像表示システム、画像表示装置、画像表示方法及びプログラム | |

| KR102417645B1 (ko) | Ar 장면 이미지 처리 방법, 장치, 전자 기기 및 저장 매체 | |

| US10636185B2 (en) | Information processing apparatus and information processing method for guiding a user to a vicinity of a viewpoint | |

| US20150379777A1 (en) | Augmented reality providing system, recording medium, and augmented reality providing method | |

| JP5934368B2 (ja) | 可搬装置、仮想現実システムおよび方法 | |

| CN104641399B (zh) | 用于创建环境并用于共享环境中基于位置的体验的系统和方法 | |

| US10241565B2 (en) | Apparatus, system, and method of controlling display, and recording medium | |

| TWI615776B (zh) | 移動物件的虛擬訊息建立方法、搜尋方法與應用系統 | |

| JP6348741B2 (ja) | 情報処理システム、情報処理装置、情報処理プログラム、および情報処理方法 | |

| CN108548300B (zh) | 空调送风方法及装置、电子设备 | |

| US10868977B2 (en) | Information processing apparatus, information processing method, and program capable of adaptively displaying a video corresponding to sensed three-dimensional information | |

| CN111179435A (zh) | 增强现实处理方法及装置、系统、存储介质和电子设备 | |

| JP6720385B1 (ja) | プログラム、情報処理方法、及び情報処理端末 | |

| KR102197615B1 (ko) | 증강 현실 서비스를 제공하는 방법 및 증강 현실 서비스를 제공하기 위한 서버 | |

| JP7150894B2 (ja) | Arシーン画像処理方法及び装置、電子機器並びに記憶媒体 | |

| CN110873963A (zh) | 内容显示方法、装置、终端设备及内容显示系统 | |

| KR20180120456A (ko) | 파노라마 영상을 기반으로 가상현실 콘텐츠를 제공하는 장치 및 그 방법 | |

| CN112740284A (zh) | 动画合成装置、动画合成方法以及记录介质 | |

| JP6640294B1 (ja) | 複合現実システム、プログラム、携帯端末装置、及び方法 | |

| TW201823929A (zh) | 移動物件的虛擬訊息遠距管理方法與應用系統 | |

| WO2021093703A1 (zh) | 基于光通信装置的交互方法和系统 | |

| JPWO2019026919A1 (ja) | 画像処理システム、画像処理方法、及びプログラム | |

| CN108092950B (zh) | 一种基于位置的ar或mr社交方法 | |

| WO2019127320A1 (zh) | 信息处理方法、装置、云处理设备及计算机程序产品 | |

| CN113760088A (zh) | 增强现实显示装置以及记录介质 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20150306 |

|

| A711 | Notification of change in applicant |

Free format text: JAPANESE INTERMEDIATE CODE: A711 Effective date: 20150617 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20150714 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20150831 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20151215 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20160208 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20160524 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20160810 |

|

| A911 | Transfer to examiner for re-examination before appeal (zenchi) |

Free format text: JAPANESE INTERMEDIATE CODE: A911 Effective date: 20160819 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20160906 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20160919 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6020446 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| LAPS | Cancellation because of no payment of annual fees |