JP7623716B2 - 情報処理装置および情報処理方法 - Google Patents

情報処理装置および情報処理方法 Download PDFInfo

- Publication number

- JP7623716B2 JP7623716B2 JP2022527621A JP2022527621A JP7623716B2 JP 7623716 B2 JP7623716 B2 JP 7623716B2 JP 2022527621 A JP2022527621 A JP 2022527621A JP 2022527621 A JP2022527621 A JP 2022527621A JP 7623716 B2 JP7623716 B2 JP 7623716B2

- Authority

- JP

- Japan

- Prior art keywords

- information

- subject

- brain

- signal source

- model

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B5/00—Measuring for diagnostic purposes; Identification of persons

- A61B5/24—Detecting, measuring or recording bioelectric or biomagnetic signals of the body or parts thereof

- A61B5/316—Modalities, i.e. specific diagnostic methods

- A61B5/369—Electroencephalography [EEG]

- A61B5/377—Electroencephalography [EEG] using evoked responses

- A61B5/38—Acoustic or auditory stimuli

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B5/00—Measuring for diagnostic purposes; Identification of persons

- A61B5/0033—Features or image-related aspects of imaging apparatus, e.g. for MRI, optical tomography or impedance tomography apparatus; Arrangements of imaging apparatus in a room

- A61B5/0035—Features or image-related aspects of imaging apparatus, e.g. for MRI, optical tomography or impedance tomography apparatus; Arrangements of imaging apparatus in a room adapted for acquisition of images from more than one imaging mode, e.g. combining MRI and optical tomography

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B5/00—Measuring for diagnostic purposes; Identification of persons

- A61B5/05—Detecting, measuring or recording for diagnosis by means of electric currents or magnetic fields; Measuring using microwaves or radio waves

- A61B5/055—Detecting, measuring or recording for diagnosis by means of electric currents or magnetic fields; Measuring using microwaves or radio waves involving electronic [EMR] or nuclear [NMR] magnetic resonance, e.g. magnetic resonance imaging

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B5/00—Measuring for diagnostic purposes; Identification of persons

- A61B5/16—Devices for psychotechnics; Testing reaction times ; Devices for evaluating the psychological state

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B5/00—Measuring for diagnostic purposes; Identification of persons

- A61B5/24—Detecting, measuring or recording bioelectric or biomagnetic signals of the body or parts thereof

- A61B5/316—Modalities, i.e. specific diagnostic methods

- A61B5/369—Electroencephalography [EEG]

- A61B5/372—Analysis of electroencephalograms

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B5/00—Measuring for diagnostic purposes; Identification of persons

- A61B5/40—Detecting, measuring or recording for evaluating the nervous system

- A61B5/4058—Detecting, measuring or recording for evaluating the nervous system for evaluating the central nervous system

- A61B5/4064—Evaluating the brain

-

- A—HUMAN NECESSITIES

- A61—MEDICAL OR VETERINARY SCIENCE; HYGIENE

- A61B—DIAGNOSIS; SURGERY; IDENTIFICATION

- A61B5/00—Measuring for diagnostic purposes; Identification of persons

- A61B5/72—Signal processing specially adapted for physiological signals or for diagnostic purposes

- A61B5/7235—Details of waveform analysis

- A61B5/7264—Classification of physiological signals or data, e.g. using neural networks, statistical classifiers, expert systems or fuzzy systems

- A61B5/7267—Classification of physiological signals or data, e.g. using neural networks, statistical classifiers, expert systems or fuzzy systems involving training the classification device

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01R—MEASURING ELECTRIC VARIABLES; MEASURING MAGNETIC VARIABLES

- G01R33/00—Arrangements or instruments for measuring magnetic variables

- G01R33/20—Arrangements or instruments for measuring magnetic variables involving magnetic resonance

- G01R33/44—Arrangements or instruments for measuring magnetic variables involving magnetic resonance using nuclear magnetic resonance [NMR]

- G01R33/48—NMR imaging systems

- G01R33/4806—Functional imaging of brain activation

Landscapes

- Health & Medical Sciences (AREA)

- Life Sciences & Earth Sciences (AREA)

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Biophysics (AREA)

- Public Health (AREA)

- General Health & Medical Sciences (AREA)

- Pathology (AREA)

- Veterinary Medicine (AREA)

- Biomedical Technology (AREA)

- Heart & Thoracic Surgery (AREA)

- Medical Informatics (AREA)

- Molecular Biology (AREA)

- Surgery (AREA)

- Animal Behavior & Ethology (AREA)

- Artificial Intelligence (AREA)

- Psychiatry (AREA)

- Nuclear Medicine, Radiotherapy & Molecular Imaging (AREA)

- Psychology (AREA)

- Physiology (AREA)

- Neurology (AREA)

- Radiology & Medical Imaging (AREA)

- Mathematical Physics (AREA)

- Acoustics & Sound (AREA)

- Fuzzy Systems (AREA)

- Signal Processing (AREA)

- Evolutionary Computation (AREA)

- Computer Vision & Pattern Recognition (AREA)

- High Energy & Nuclear Physics (AREA)

- Neurosurgery (AREA)

- Child & Adolescent Psychology (AREA)

- Developmental Disabilities (AREA)

- Educational Technology (AREA)

- Hospice & Palliative Care (AREA)

- Social Psychology (AREA)

- Measurement And Recording Of Electrical Phenomena And Electrical Characteristics Of The Living Body (AREA)

Description

実施例では、機械学習により構築した数理モデル(実施例ではニューラルネットワーク、以下「音声推定モデル」とも呼ぶ。)を用いて、呈示された音声が人にどのように聞こえているかを再現し、その判別を支援する技術を提案する。実施例では被験者の脳活動を示す信号として、脳波(頭皮脳波)を用いる。詳細は後述するが、被験者の脳活動を示す信号として、脳磁波を用いてもよく、近赤外線分光法(Near-infrared spectroscopy、NIRS)脳計測装置による計測結果を用いてもよい。

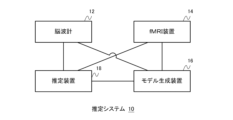

推定装置18を備える情報処理システムである。実施例では、図2の各装置は、LAN等の通信網を介して接続され、オンラインでデータが送受信される。変形例として、USBストレージ等の記録メディアを介して、オフラインでデータが交換されてもよい。

することにより信号源を推定するソフトウェアである。脳波データは、脳波の波形を示すデータでもよく、時系列での振幅の推移を示すデータでもよく、脳波の周波数特性を示すデータでもよい。

画像データ、(2)fMRIにより計測された脳活動データ、(3)頭皮上における電極の設置位置を示すデータ、(4)脳波取得部26により取得された脳波信号のデータを入力することにより、VBMEGに信号源推定関数を生成させる。

まず、主にモデル生成装置16が主体となる学習フェーズの動作を説明する。fMRI装置14は、第1被験者の脳活動を計測し、計測した脳活動データをモデル生成装置16へ出力する。モデル生成装置16のfMRI結果取得部20は、脳活動データを取得し、信号源推定関数生成部22は、VBMEGを起動して信号源推定関数を生成する。具体的には、信号源推定関数生成部22は、第1被験者の脳構造データ、電極位置、脳活動データをパラメータとして、VBMEGが提供する公知の関数をコールすることにより第1被験者用の信号源推定関数を生成する。信号源推定関数生成部22は、第1被験者用の信号源推定関数を信号源推定関数記憶部24に格納する。

実験の結果、音声「あ」の場合のR2は「0.983」、音声「い」の場合のR2は「0.957」、雑音の場合のR2は「0.997」となった。R2が0.7程度でも波形は類似するため、音声推定モデルの推定精度、すなわち、脳波を用いた音声再合成の精度はかなり高いと言える。

Low-Resolution Brain Electromagnetic Tomography)を使用して信号源を推定してもよい。sLORETAは、脳機能イメージング解析の手法であり、脳波や脳磁図による脳内神経活動を脳図譜(言い換えれば標準脳)に重畳して描く解析手法である。

Claims (7)

- 所定の音声の情報と、前記所定の音声が呈示された第1被験者の脳活動を示す信号の信号源に関する情報とを教師データとして機械学習により構築されたモデルであって、入力された被験者の脳活動を示す信号の信号源に関する情報をもとに、当該被験者が認識すると推定される音声の情報を出力するモデルを記憶するモデル記憶部にアクセス可能な装置であって、

前記所定の音声が呈示された第2被験者の脳活動を示す信号を取得する脳活動取得部と、

前記脳活動取得部により取得された脳活動を示す信号の態様に基づいて、前記第2被験者の脳の複数の領域の中から前記脳活動を示す信号の信号源を推定する信号源推定部と、

前記信号源推定部により推定された信号源に関する情報を前記モデルに入力して、前記モデルから出力された、前記第2被験者が認識すると推定される音声である認識音声の情報を取得する認識音声取得部と、

を備えることを特徴とする情報処理装置。 - 前記認識音声取得部により取得された認識音声の情報が示す音声を再生する再生部をさらに備えることを特徴とする請求項1に記載の情報処理装置。

- 脳内情報生成部をさらに備え、

前記信号源に関する情報が入力されたモデルには、前記第2被験者の脳の複数の領域それぞれの前記認識音声への影響度に関する情報が記録され、

前記脳内情報生成部は、前記モデルに記録された情報を参照して、前記第2被験者の脳の複数の領域それぞれの前記認識音声への影響度を示す脳内情報を生成することを特徴とする請求項1または2に記載の情報処理装置。 - 前記所定の音声の波形と、前記認識音声の波形の両方を示す画像を生成する画像生成部をさらに備えることを特徴とする請求項1から3のいずれかに記載の情報処理装置。

- 所定の音声の情報と、前記所定の音声が呈示された第1被験者の脳活動を示す信号の信号源に関する情報とを教師データとして機械学習により構築されたモデルであって、入力された被験者の脳活動を示す信号の信号源に関する情報をもとに、当該被験者が認識すると推定される音声の情報を出力するモデルを記憶するモデル記憶部にアクセス可能な装置であって、

任意の音声を想起した第2被験者の脳活動を示す信号を取得する脳活動取得部と、

前記脳活動取得部により取得された脳活動を示す信号の態様に基づいて、前記第2被験者の脳の複数の領域の中から前記脳活動を示す信号の信号源を推定する信号源推定部と、

前記信号源推定部により推定された信号源に関する情報を前記モデルに入力して、前記モデルから出力された、前記第2被験者が想起したと推定される音声の情報を取得する音声取得部と、

脳内情報生成部と、

を備え、

前記モデルは、プーリング層を挟まずに連続する複数の畳み込み層を備えるニューラルネットワークであり、

前記複数の畳み込み層は、複数回のフィルタリング処理により前記第2被験者が想起したと推定される音声への影響度が大きい信号源を抽出していくものであり、

前記脳内情報生成部は、前記複数の畳み込み層の中で最後に位置する畳み込み層に記録された情報を参照して、前記第2被験者が想起したと推定される音声に対する前記第2被験者の脳の複数の領域それぞれの影響度を示す脳内情報を生成することを特徴とする情報処理装置。 - 所定の音声の情報と、前記所定の音声が呈示された第1被験者の脳活動を示す信号の信号源に関する情報とを教師データとして機械学習により構築されたモデルであって、入力された被験者の脳活動を示す信号の信号源に関する情報をもとに、当該被験者が認識すると推定される音声の情報を出力するモデルを記憶するモデル記憶部にアクセス可能なコンピュータが、

前記所定の音声が呈示された第2被験者の脳活動を示す信号を取得するステップと、

取得された脳活動を示す信号の態様に基づいて、前記第2被験者の脳の複数の領域の中から前記脳活動を示す信号の信号源を推定するステップと、

推定された信号源に関する情報を前記モデルに入力して、前記モデルから出力された、前記第2被験者が認識すると推定される音声である認識音声の情報を取得するステップと、

を実行することを特徴とする情報処理方法。 - 所定の音声の情報と、前記所定の音声が呈示された第1被験者の脳活動を示す信号の信号源に関する情報とを教師データとして機械学習により構築されたモデルであって、入力された被験者の脳活動を示す信号の信号源に関する情報をもとに、当該被験者が認識すると推定される音声の情報を出力するモデルを記憶するモデル記憶部にアクセス可能なコンピュータが、

任意の音声を想起した第2被験者の脳活動を示す信号を取得するステップと、

取得された脳活動を示す信号の態様に基づいて、前記第2被験者の脳の複数の領域の中から前記脳活動を示す信号の信号源を推定するステップと、

推定された信号源に関する情報を前記モデルに入力して、前記モデルから出力された、前記第2被験者が想起したと推定される音声の情報を取得するステップと、

を実行し、

前記モデルは、プーリング層を挟まずに連続する複数の畳み込み層を備えるニューラルネットワークであり、

前記複数の畳み込み層は、複数回のフィルタリング処理により前記第2被験者が想起したと推定される音声への影響度が大きい信号源を抽出していくものであり、

前記複数の畳み込み層の中で最後に位置する畳み込み層に記録された情報を参照して、前記第2被験者が想起したと推定される音声に対する前記第2被験者の脳の複数の領域それぞれの影響度を示す脳内情報を生成するステップを前記コンピュータがさらに実行することを特徴とする情報処理方法。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2020092110 | 2020-05-27 | ||

| JP2020092110 | 2020-05-27 | ||

| PCT/JP2021/017180 WO2021241138A1 (ja) | 2020-05-27 | 2021-04-30 | 情報処理装置および情報処理方法 |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JPWO2021241138A1 JPWO2021241138A1 (ja) | 2021-12-02 |

| JPWO2021241138A5 JPWO2021241138A5 (ja) | 2023-03-23 |

| JP7623716B2 true JP7623716B2 (ja) | 2025-01-29 |

Family

ID=78744430

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2022527621A Active JP7623716B2 (ja) | 2020-05-27 | 2021-04-30 | 情報処理装置および情報処理方法 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US20230233132A1 (ja) |

| EP (1) | EP4147636A4 (ja) |

| JP (1) | JP7623716B2 (ja) |

| WO (1) | WO2021241138A1 (ja) |

Families Citing this family (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP7840535B2 (ja) * | 2022-05-30 | 2026-04-06 | 国立研究開発法人情報通信研究機構 | 気分推定プログラム |

| CN116211305A (zh) * | 2022-12-20 | 2023-06-06 | 重庆邮电大学 | 动态实时情绪检测方法及系统 |

| WO2025094727A1 (ja) * | 2023-10-30 | 2025-05-08 | パナソニックIpマネジメント株式会社 | 情報処理方法、情報処理装置、及びプログラム |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20090157482A1 (en) | 2007-12-13 | 2009-06-18 | Searete Llc, A Limited Liability Corporation Of The State Of Delaware | Methods and systems for indicating behavior in a population cohort |

| US20190107888A1 (en) | 2017-10-06 | 2019-04-11 | Holland Bloorview Kids Rehabilitation Hospital | Brain-computer interface platform and process for classification of covert speech |

| WO2019146753A1 (ja) | 2018-01-26 | 2019-08-01 | 国立研究開発法人情報通信研究機構 | 脳活動を利用した語学能力評価装置、及び語学能力評価システム |

| US20190333505A1 (en) | 2018-04-30 | 2019-10-31 | The Board Of Trustees Of The Leland Stanford Junior University | Systems and Methods for Decoding Intended Speech from Neuronal Activity |

Family Cites Families (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2012155559A (ja) * | 2011-01-26 | 2012-08-16 | Mariko Matsumoto | 生体信号を用いた発話支援装置、発話支援システム、及びプログラム |

| JP6643771B2 (ja) * | 2015-10-13 | 2020-02-12 | 株式会社国際電気通信基礎技術研究所 | 脳活動解析装置、脳活動解析方法および脳活動解析プログラム |

-

2021

- 2021-04-30 EP EP21810906.4A patent/EP4147636A4/en active Pending

- 2021-04-30 WO PCT/JP2021/017180 patent/WO2021241138A1/ja not_active Ceased

- 2021-04-30 JP JP2022527621A patent/JP7623716B2/ja active Active

- 2021-04-30 US US17/927,481 patent/US20230233132A1/en active Pending

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20090157482A1 (en) | 2007-12-13 | 2009-06-18 | Searete Llc, A Limited Liability Corporation Of The State Of Delaware | Methods and systems for indicating behavior in a population cohort |

| US20190107888A1 (en) | 2017-10-06 | 2019-04-11 | Holland Bloorview Kids Rehabilitation Hospital | Brain-computer interface platform and process for classification of covert speech |

| WO2019146753A1 (ja) | 2018-01-26 | 2019-08-01 | 国立研究開発法人情報通信研究機構 | 脳活動を利用した語学能力評価装置、及び語学能力評価システム |

| US20190333505A1 (en) | 2018-04-30 | 2019-10-31 | The Board Of Trustees Of The Leland Stanford Junior University | Systems and Methods for Decoding Intended Speech from Neuronal Activity |

Non-Patent Citations (2)

| Title |

|---|

| AKASHI Wataru et al.,Vowel Sound Synthesis from Electroencephalography during Listening and Recalling,Advanced Intelligent Systems,ドイツ,2021年01月07日,Volume.3, Issue2,https://doi.org/10.1002/aisy.202000164 |

| 西元 淳,脳活動信号を用いた音声識別,電子情報通信学会技術研究報告,日本,一般社団法人電子情報通信学会,2013年09月17日,Vol.113, No.223,pp.41-46 |

Also Published As

| Publication number | Publication date |

|---|---|

| EP4147636A4 (en) | 2024-05-15 |

| US20230233132A1 (en) | 2023-07-27 |

| JPWO2021241138A1 (ja) | 2021-12-02 |

| WO2021241138A1 (ja) | 2021-12-02 |

| EP4147636A1 (en) | 2023-03-15 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| Li et al. | Sensitivity analysis of changes in human physiological indicators observed in soundscapes | |

| Aziz-Zadeh et al. | Common premotor regions for the perception and production of prosody and correlations with empathy and prosodic ability | |

| Coffey et al. | Cortical contributions to the auditory frequency-following response revealed by MEG | |

| Möttönen et al. | Processing of changes in visual speech in the human auditory cortex | |

| Giordano et al. | The representational dynamics of perceived voice emotions evolve from categories to dimensions | |

| Young et al. | Evidence for a caregiving instinct: rapid differentiation of infant from adult vocalizations using magnetoencephalography | |

| JP7623716B2 (ja) | 情報処理装置および情報処理方法 | |

| CN117838154B (zh) | 一种基于脑电的认知下降风险评估方法及系统 | |

| Liu et al. | Auditory–articulatory neural alignment between listener and speaker during verbal communication | |

| Schüller et al. | Attentional modulation of the cortical contribution to the frequency-following response evoked by continuous speech | |

| Shahin et al. | Sensitivity of EEG and MEG to the N1 and P2 auditory evoked responses modulated by spectral complexity of sounds | |

| Carey et al. | Vocal tract images reveal neural representations of sensorimotor transformation during speech imitation | |

| CN109102862A (zh) | 正念减压系统及方法、存储介质、操作系统 | |

| Gupta et al. | PhySyQX: A database for physiological evaluation of synthesised speech quality-of-experience | |

| Saygin et al. | Nonverbal auditory agnosia with lesion to Wernicke's area | |

| Wisniewski et al. | Familiarity with speech affects cortical processing of auditory distance cues and increases acuity | |

| Jäncke et al. | Pre-attentive modulation of brain responses to tones in coloured-hearing synesthetes | |

| Schüller et al. | The early subcortical response at the fundamental frequency of speech is temporally separated from later cortical contributions | |

| TWI482611B (zh) | Emotional brainwave imaging method | |

| Hamzah et al. | EEG‐Based Emotion Recognition Datasets for Virtual Environments: A Survey | |

| JP7840535B2 (ja) | 気分推定プログラム | |

| JPS58500933A (ja) | 脳の電気的活動状態のマッピング(ビ−ム) | |

| Osnes et al. | Increased activation in superior temporal gyri as a function of increment in phonetic features | |

| Dourou et al. | IoT-enabled analysis of subjective sound quality perception based on out-of-lab physiological measurements | |

| WO2023074656A1 (ja) | プログラム、情報処理方法、及び情報処理装置 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A529 | Written submission of copy of amendment under article 34 pct |

Free format text: JAPANESE INTERMEDIATE CODE: A5211 Effective date: 20221122 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20240301 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20250107 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20250109 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7623716 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |