JP7570513B2 - 視線検出装置 - Google Patents

視線検出装置 Download PDFInfo

- Publication number

- JP7570513B2 JP7570513B2 JP2023526789A JP2023526789A JP7570513B2 JP 7570513 B2 JP7570513 B2 JP 7570513B2 JP 2023526789 A JP2023526789 A JP 2023526789A JP 2023526789 A JP2023526789 A JP 2023526789A JP 7570513 B2 JP7570513 B2 JP 7570513B2

- Authority

- JP

- Japan

- Prior art keywords

- image

- point

- gaze

- detection device

- dimensional

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F3/00—Input arrangements for transferring data to be processed into a form capable of being handled by the computer; Output arrangements for transferring data from processing unit to output unit, e.g. interface arrangements

- G06F3/01—Input arrangements or combined input and output arrangements for interaction between user and computer

- G06F3/011—Arrangements for interaction with the human body, e.g. for user immersion in virtual reality

- G06F3/013—Eye tracking input arrangements

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T17/00—Three-dimensional [3D] modelling for computer graphics

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/73—Determining position or orientation of objects or cameras using feature-based methods

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/18—Eye characteristics, e.g. of the iris

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10028—Range image; Depth image; 3D point clouds

-

- G—PHYSICS

- G06—COMPUTING OR CALCULATING; COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30196—Human being; Person

- G06T2207/30201—Face

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- General Physics & Mathematics (AREA)

- Human Computer Interaction (AREA)

- General Engineering & Computer Science (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Software Systems (AREA)

- General Health & Medical Sciences (AREA)

- Ophthalmology & Optometry (AREA)

- Health & Medical Sciences (AREA)

- Multimedia (AREA)

- Geometry (AREA)

- Computer Graphics (AREA)

- Image Analysis (AREA)

- Eye Examination Apparatus (AREA)

- Image Processing (AREA)

Description

図1は、実施の形態1に係る視線検出装置1の機能構成を示したブロック図である。図1が示すとおり、実施の形態1に係る視線検出装置1は、画像取得部10と、演算処理部100と、を含む。演算処理部100は、画像処理を行う。また演算処理部100は、実画像演算処理部20と、3次元モデル重合せ処理部30と、視線角度算出部40と、を含む。さらに実画像演算処理部20は、顔パーツ点抽出部21と、瞳孔位置検出部22と、を含む。また3次元モデル重合せ処理部30は、3次元位置姿勢推定部31と、3次元モデル補正部32と、3次元眼球位置推定部33と、を含む。

図3は、実施の形態2に係る視線検出装置1の機能構成を示したブロック図である。図3が示すとおり実施の形態2に係る視線検出装置1は、実施の形態1の3次元モデル補正部32に代えて、眼球位置補正部32Bを備える。ここでは特に明示する場合を除き、実施の形態1で用いたものと同じ符号が用いられる。また、実施の形態1と重複する説明は、適宜省略される。

参照点の一つである点Pは、例えば眼球中心から眼球の半径だけマイナスZ方向に移動した点として定義されてよい。眼球の半径は統計的に求めた値が用いられてよい。眼球の半径は、ここでは例えば10.00[mm]とする。

参照点の一つである点A0は、点PをマイナスZ方向にのみ移動した点であって、鼻点と同じZ座標を有する点、として定義されてよい。

参照点の一つである点Aは、点Pを起点とし、ベクトルPA0を1.2倍にした方向ベクトルの終点にある点、として定義されてよい。点Aは、点Pとも点A0とも同じXY座標を有する。なお、ここでベクトルPA0を1.2倍にする例が示されているが、本開示技術をこれに限定する意図ではない。

参照点の一つである点Mは、点A0をX方向にのみ移動した点であって、鼻点と同じX座標を有する点、として定義されてよい。なお図6は左目での例示であり、点Mは点A0よりもマイナスX方向に位置する。逆に右目の場合に点Mは、点A0よりもプラスX方向に位置する。

Claims (1)

- 対象者の画像を取得する画像取得部と、

画像処理を行う演算処理部と、

前記画像処理の結果に基づいて視線方向ベクトルを算出する視線角度算出部と、を備え、

前記演算処理部は、画像空間における実画像に対する演算処理を行う実画像演算処理部と3次元顔モデルを用いて前記画像空間に重合せ処理を行う3次元モデル重合せ処理部とで構成され、

前記3次元モデル重合せ処理部は、鼻点Nから瞳孔までの距離に基づいて前記瞳孔の向きを推定する眼球位置補正部を有し、

前記眼球位置補正部は、

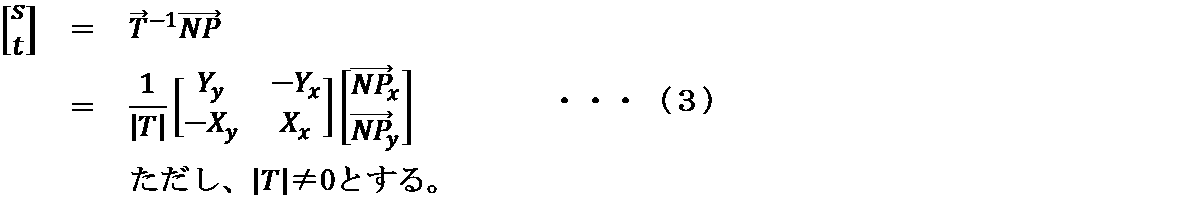

前記3次元顔モデルにおいて予め定義された複数の参照点を画像座標系へ座標変換し、

前記参照点のうちの一つである点Aの位置を補正し点A’としてあらたに定義し、

前記鼻点Nと前記点A’とを結ぶベクトルNA’をX軸方向とY軸方向とに分解し、

前記ベクトルNA’のY軸方向成分に基づいて前記鼻点Nから前記瞳孔までの距離を算出する、

ここで、画像座標系におけるX軸方向は概ね水平方向であり、画像座標系におけるY軸方向は概ね鉛直方向である、

視線検出装置。

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| PCT/JP2021/022230 WO2022259499A1 (ja) | 2021-06-11 | 2021-06-11 | 視線検出装置 |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JPWO2022259499A1 JPWO2022259499A1 (ja) | 2022-12-15 |

| JPWO2022259499A5 JPWO2022259499A5 (ja) | 2023-10-20 |

| JP7570513B2 true JP7570513B2 (ja) | 2024-10-21 |

Family

ID=84425095

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2023526789A Active JP7570513B2 (ja) | 2021-06-11 | 2021-06-11 | 視線検出装置 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US12124626B2 (ja) |

| JP (1) | JP7570513B2 (ja) |

| DE (1) | DE112021007811T5 (ja) |

| WO (1) | WO2022259499A1 (ja) |

Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2017514193A (ja) | 2014-02-04 | 2017-06-01 | フラウンホーファー−ゲゼルシャフト・ツール・フェルデルング・デル・アンゲヴァンテン・フォルシュング・アインゲトラーゲネル・フェライン | 視線方向を決定するための3d画像分析装置 |

| JP2019519859A (ja) | 2016-06-29 | 2019-07-11 | シーイング マシーンズ リミテッド | 視線追跡を実行するシステム及び方法 |

Family Cites Families (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4692526B2 (ja) | 2006-07-18 | 2011-06-01 | 株式会社国際電気通信基礎技術研究所 | 視線方向の推定装置、視線方向の推定方法およびコンピュータに当該視線方向の推定方法を実行させるためのプログラム |

| US9547798B2 (en) * | 2014-05-20 | 2017-01-17 | State Farm Mutual Automobile Insurance Company | Gaze tracking for a vehicle operator |

-

2021

- 2021-06-11 JP JP2023526789A patent/JP7570513B2/ja active Active

- 2021-06-11 WO PCT/JP2021/022230 patent/WO2022259499A1/ja not_active Ceased

- 2021-06-11 DE DE112021007811.9T patent/DE112021007811T5/de not_active Withdrawn

- 2021-06-11 US US18/567,375 patent/US12124626B2/en active Active

Patent Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2017514193A (ja) | 2014-02-04 | 2017-06-01 | フラウンホーファー−ゲゼルシャフト・ツール・フェルデルング・デル・アンゲヴァンテン・フォルシュング・アインゲトラーゲネル・フェライン | 視線方向を決定するための3d画像分析装置 |

| JP2019519859A (ja) | 2016-06-29 | 2019-07-11 | シーイング マシーンズ リミテッド | 視線追跡を実行するシステム及び方法 |

Also Published As

| Publication number | Publication date |

|---|---|

| US12124626B2 (en) | 2024-10-22 |

| JPWO2022259499A1 (ja) | 2022-12-15 |

| DE112021007811T5 (de) | 2024-04-18 |

| WO2022259499A1 (ja) | 2022-12-15 |

| US20240281059A1 (en) | 2024-08-22 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| KR102136241B1 (ko) | 표정 검출 성능을 갖는 머리-장착형 디스플레이 | |

| CN110913751B (zh) | 具有滑动检测和校正功能的可穿戴眼睛跟踪系统 | |

| EP3608755B1 (en) | Electronic apparatus operated by head movement and operation method thereof | |

| US20220198834A1 (en) | Skeleton recognition method, storage medium, and information processing device | |

| JP6723061B2 (ja) | 情報処理装置、情報処理装置の制御方法およびプログラム | |

| JP2008194146A (ja) | 視線検出装置及びその方法 | |

| CN113505694A (zh) | 一种基于视线追踪的人机交互方法、装置及计算机设备 | |

| EP3506149A1 (en) | Method, system and computer program product for eye gaze direction estimation | |

| CN112232128B (zh) | 基于视线追踪的老年残障人士照护需求识别方法 | |

| CN108629248A (zh) | 一种实现增强现实的方法及设备 | |

| JP4865517B2 (ja) | 頭部の位置・姿勢検出装置 | |

| JP6906943B2 (ja) | 車載器 | |

| JP7570513B2 (ja) | 視線検出装置 | |

| EP3710774A1 (en) | Systems and methods for calibrating an eye tracking system | |

| WO2022074886A1 (ja) | 姿勢検出装置、姿勢検出方法および寝相判定方法 | |

| JP6210447B2 (ja) | 視線計測装置、注視点の表示方法、注視領域の表示方法および注視点のガウス分布の表示方法 | |

| KR101844367B1 (ko) | 부분 포즈 추정에 의하여 개략적인 전체 초기설정을 사용하는 머리 포즈 추정 방법 및 장치 | |

| CN116563827A (zh) | 一种视线估计方法、系统及电子设备 | |

| JP6170696B2 (ja) | 画像処理装置及び画像処理方法 | |

| WO2023043442A1 (en) | Correcting raw coordinates of facial feature point | |

| CN113837098A (zh) | 一种通过简单面部关键点实时估计2d头部姿势的方法 | |

| Sumi et al. | Active wearable vision sensor: recognition of human activities and environments | |

| CN118570277B (zh) | 面部器官的闭合度计算方法及装置、介质及电子设备 | |

| US12422919B2 (en) | System and method for providing virtual reality service | |

| JPWO2022259499A5 (ja) |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20230725 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20230725 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20240528 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20240726 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20240910 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20241008 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7570513 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |