JP7544359B2 - 最適化装置、訓練装置、合成装置、それらの方法、およびプログラム - Google Patents

最適化装置、訓練装置、合成装置、それらの方法、およびプログラム Download PDFInfo

- Publication number

- JP7544359B2 JP7544359B2 JP2021083720A JP2021083720A JP7544359B2 JP 7544359 B2 JP7544359 B2 JP 7544359B2 JP 2021083720 A JP2021083720 A JP 2021083720A JP 2021083720 A JP2021083720 A JP 2021083720A JP 7544359 B2 JP7544359 B2 JP 7544359B2

- Authority

- JP

- Japan

- Prior art keywords

- image

- visibility

- map

- loss

- foreground

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Landscapes

- Image Processing (AREA)

- Editing Of Facsimile Originals (AREA)

- Image Analysis (AREA)

Description

上記の課題を解決するために、本発明の他の態様によれば、訓練装置は、前景画像と背景画像を深層ニューラルネットワークから成る共通のエンコーダによってエンコードしたのち、エンコードした特徴と所望の視認性マップから他の深層ニューラルネットワークから成るデコーダを用いてデコードすることによってアルファマップを生成するアルファ値生成部と、前景マスク画像と、前景マスク画像を適用したアルファマップαと、前景画像と、背景画像を用いて、アルファマップαを用いてブレンドした画像において前景画像の視認性を計算する対象となる画像特徴成分である第一対象成分の知覚コントラストマップと、前景マスク画像を用いて不透明にブレンドした画像において前景画像の視認性を計算する対象となる画像特徴成分である第二対象成分の知覚コントラストマップを計算する知覚コントラスト計算部と、第二対象成分の知覚コントラストマップを用いて、画像特徴に対する重みベクトルを計算する重み計算部と、第一対象成分の知覚コントラストマップと重みベクトルを用いて前景画像の視認性を示す視認性マップvを得る特徴集約部と、視認性マップvと所望の視認性マップ^vとから視認性損失を計算し、前景画像とアルファマップαとからアルファマップαが空間的に滑らかに変化するような制約を与える平滑度損失を計算し、視認性損失と平滑度損失を用いて損失LFを計算する損失計算部と、損失LFを用いて、エンコーダおよびデコーダのパラメータを更新するアルファ値更新部と、を含む。

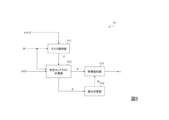

図1は第1実施形態に係る合成装置100の機能ブロック図を、図2はその処理フローを示す。

ただし、Ibl iは合成画像Iblのi番目の画素値、Ifg iは前景画像Ifgのi番目の画素値、Ibg iは背景画像Ibgのi番目の画素値をそれぞれ表す。

図3はアルファ値生成部110の機能ブロック図を、図4はその処理フローの例を示す。

図5は視認性予測部111の機能ブロック図を、図6はその処理フローの例を示す。

出力:視認性マップv

処理:

マスク適用部1111は、アルファマップαと前景マスク画像Mとを入力として、アルファマップαと前景マスク画像Mとを画素毎に乗算することで、アルファマップαにマスクを適用し(S1111)、マスク適用済のアルファマップα'を出力する

知覚コントラスト計算部1113は、マスク適用済のアルファマップα'、前景マスク画像M、前景画像Ifg、背景画像Ibgを入力として、第一対象成分ΔItgの知覚コントラストマップP∈R3N×H×W、第二対象成分ΔIfgの知覚コントラストマップP'∈R3N×H×Wを計算し(S1113)、出力する。ここで、第一対象成分ΔItgは入力されたマスク適用済のアルファマップα'を用いてブレンドした画像において、視認性を計算する対象となる画像特徴成分(前景画像成分とマスク適用済のアルファマップα'の構造を合わせたもの)を表し、第二対象成分ΔIfgは前景マスク画像Mを用いて不透明にブレンドした画像において、視認性を計算する対象となる画像特徴成分を表す。画像特徴成分は画像をN個の空間周波数帯域と3個の色成分に分解して得られる3×N次元の特徴として表現される。Nは入力画像サイズによって上限が決まり、画像サイズが大きいほどNを大きく設定できる。Nが大きいほど画像特徴数が増加するため、一般にモデルの予測力も向上すると考えられる。本実施形態ではモデルパラメータのフィッティングのために実施した実験で用いた刺激サイズに合わせN=6とした。また、画像特徴として空間周波数と色に加えて方位成分を考慮しても構わない。計算コストや精度を考慮して画像特徴を設定すればよい。知覚コントラスト計算部1113における処理の詳細は後述する。

ここで、Xおよびbは、後述する<視認性予測部111のパラメータ>の手順により、データへのフィッティングによって求められる。

ただし、pはモデルキャリブレーションで最適化されたパラメータであり、wnおよびrp nはそれぞれ重みベクトルwおよび特徴ベクトルrのn番目の成分を示す。

図7は知覚コントラスト計算部1113の機能ブロック図を、図8はその処理フローの例を示す。

出力:対象成分の知覚コントラストマップP、P'

処理:

まず、色変換部1113Aは、前景画像Ifgと背景画像Ibgを入力として、RGB色空間をYUV色空間に変換し(S1113A)、出力する。

バンド分解部1113Dは、アルファブレンド画像Iblと色変換後の背景画像Ibgを入力として、アルファブレンド画像Iblのバンドパス成分ΔIbl、アルファブレンド画像Iblのガウシアンピラミッド画像-Ibl、アルファブレンド画像Iblのローパス残余成分Lbl、背景画像Ibgのローパス残余成分Lbgを得(S1113D)、出力する。

ここで、ΔItg k,iおよびΔIbl k,iはそれぞれ対象成分ΔItgおよびバンドパス成分ΔIblのk番目のスケールのi番目の画素であり、-Ibl k,iはガウシアンピラミッド画像-Iblのk番目のスケールのi番目の画素である。σは、ゼロによる除算を避けるために必要なスカラー定数であり、例えば、σ=0.1である。式(4)の計算は、色チャンネルごとに独立して行われる。式(4)では、N-1個のバンドパス成分画像それぞれについて、2つ下のスケールのガウシアンピラミッド画像を同一スケールにアップサンプルした画像で割る処理を行っている。これは、人間が知覚するコントラストが、付近の平均輝度が小さいほど大きく、大きいほど小さく感じられるという特性を再現する処理に相当する。

ここで、Pc,k,i bandは、色チャンネルc(c∈{Y,U,V})のk番目のスケールのi番目の画素における対象成分ΔItgの正規化されたコントラスト応答を表す。N(i)は,i番目のピクセルに隣接するピクセルのグループを表す。例えば、周辺の5×5ピクセルを近隣の定義として使用した場合、|N|=25である。βc,kは応答の飽和が始まるポイントを定義するパラメータであり、γは非線形応答関数の傾きを変調するパラメータである。βc,kの画像特徴間(色チャンネルおよびスケール間)の相対的な大きさは、各画像特徴のバンドリミテッドコントラストの平均二乗画素値の比と同じにすることで正則化する。βc,kを得るために、各画像特徴のバンドリミテッドコントラストの平均二乗値を校正画像パッチ間で平均化し、パラメータβでスケーリングする。β、γは、モデルキャリブレーションで最適化されるパラメータである。

ここで、^βc、^γは式(5)のβc,k、γと同じ役割を持つパラメータであるが、ローパス成分はバンドパス成分とは質的に異なる応答関数を持ちうるため、異なる値を取りうる。βc,kと同様に、色チャンネル間の相対的な大きさを、ローパス残差成分の各色チャンネルの平均二乗画素値の比と同じにすることで^βcを正則化する。^βcを得るために、各色チャンネルの平均二乗値を校正画像パッチ間で平均化し、パラメータ^βでスケーリングする。^β、^γは、モデルキャリブレーションで最適化されるパラメータである。

対象成分抽出部1113Cでは、視認性を計算する対象となる画像特徴成分を抽出する。ブレンド画像中の前景画像Ifgの視認性を計算する場合、アルファ値が空間的に一様であれば前景画像Ifgとアルファマップαを掛け合わせたものを対象成分ΔItgとすればよい。しかし、アルファ値が空間的に変化する条件においては、アルファマップαの構造によって生じるコントラストも対象成分ΔItgに含める必要がある。例えば、アルファマップαが0から1に変化するエッジ付近では、前景画像Ifgの色と背景画像Ibgの色によってコントラストが定義されるので、前景画像Ifgだけでなく背景画像Ibgの色も考慮しつつ対象成分ΔItgを抽出する必要が生じる。ただし、背景画像Ibg中に含まれる構造は対象成分ΔItgに含まれてはならないという制約があるため、前景画像Ifgとローパスフィルタリングした背景画像Ibgをブレンドしてコントラストを計算する。しかし、この方法は、フィルタリングしすぎると背景画像Ibgの局所的な明るさの違いを考慮できず、フィルタリングが足りなければ背景の構造が対象成分ΔItgに混入してしまうというトレードオフの問題に直面する。この問題を解決するため、本実施形態では、ラプラシアンピラミッドによるバンドパス分解を利用する。ラプラシアンピラミッドでは、スケール毎に含まれる空間周波数の帯域が限られる。このため、各スケールにおいて、そこに含まれる空間周波数以上の帯域をカットするように背景画像Ibgのローパスフィルタリングを行うことで、背景画像Ibgの構造が対象成分ΔItgに含まれないようにしつつ、背景画像Ibgの局所的な色の変動を最大限考慮することが可能となる。具体的な処理は以下に記載する。

出力:対象成分ΔItg∈R3(N-1)×H×W

処理:

まず、対象成分抽出部1113Cは、色変換後の背景画像Ibgからガウシアンピラミッド(N+2スケール)を生成する。N+2としたのは、後の処理において、k番目のバンドの対象成分を抽出する際、k+3スケール目のガウシアンピラミッド画像を使用することになるため、最大で(N-1番目のバンドの対象成分抽出のために)N+2番目のスケールのガウシアンピラミッド画像が必要となるためである。

視認性予測部111で用いた知覚モデルは複数のパラメータθ∈{β、γ、^β、^γ、p、X、b}をもつため、これらのパラメータを事前にキャリブレーションし、決定しておかねばならない。このために、本実施形態では視認性マッチング課題を用いて様々な画像に対する視認性評価データを集め、データを最もよく説明できるように最尤推定によりパラメータをフィッティングする。視認性マッチング課題では、参照画像として提示したアルファブレンド画像の視認性とマッチするように、別の画像パッチ同士のブレンド画像(テスト画像)のアルファ値を調整する。モデルのパラメータθが与えられたとき、参照画像に使用した{前景画像Ifg、背景画像Ibg、前景マスク画像M、アルファ値}の組Rxを入力として得られる視認性予測値をv(Rx|θ)、その参照画像と合わせて提示されたテスト画像の{前景画像Ifg、背景画像Ibg、前景マスク画像M、アルファ値(観察者の回答)}の組Txを入力として得られる視認性予測値をv(Tx|θ)とすると、観察者があるアルファ値αxを回答として選択する確率は次式のようにモデル化できる。

ここで、Tx(α)は、アルファ値αでブレンドされたテスト画像である。モデルパラメータを用いてsを最適化する。α’は0.01間隔で離散的にサンプリングした。x∈χは実験条件を表すインデックスとする。sは回答の不確かさ(ばらつき)を表現するスケーリング変数で、モデルパラメータθと一緒にフィッティングする。ここで、視認性予測値-v∈{v(Rx|θ), v(Tx|θ)}は単一のスカラー値として与えられる必要があるため、以下の式でモデルが出力した視認性マップviを空間的に集約する。

ここでNtgは視認性を計算すべき対象成分が存在する画素の集合を表し、|Ntg|はNtgに含まれる画素数を表す。パラメータqはモデルパラメータθと一緒にフィッティングする。

ここから、全ての実験条件x∈χについて得られた回答値からnegative log likelihoodを次式のように計算できる。

パラメータのフィッティングは、式(9)を最小化することで得られる。最小化はAdam optimizerなどの確率的勾配降下法で行う。

図9は損失計算部113の機能ブロック図を、図10はその処理フローの例を示す。

入力:所望の視認性マップ^v∈RH×W、視認性マップv∈RH×W

出力:視認性損失Lv

処理:視認性損失計算部1131は、次式によって視認性損失Lvを計算する(S1131)。

<平滑度損失計算部1133>

エッジ保存型平滑化の効果を与えるため、前景画像Ifgの勾配の高いところではアルファマップαが空間的に大きく変化することを許容しつつ、前景画像Ifgの勾配の低いところではアルファマップαの空間的な変化を抑制するような損失関数を用いる。前景画像Ifgの勾配の計算には、輝度情報のみを用いる。

出力:平滑度損失Ls

処理:

まず、平滑度損失計算部1133は、前景画像IfgをYUV色空間に変換し、輝度成分であるYチャンネルだけを取り出す。例えば、平滑度損失計算部1133は、色変換部1113Aと同様の処理を行い、前景画像IfgをYUV色空間に変換してもよいし、色変換部1113Aの出力値を利用してもよい。

ここで、αx,yとIfg x,yは、それぞれ、y番目の行のx番目の列にあるアルファマップと前景画像(輝度成分であるYチャンネル)のピクセル値を表す。空間微分にはソーベルフィルタの畳み込みを用いたが、これ以外の微分フィルタを用いてもよい。また、エッジ保存型平滑化ではない通常の平滑化を用いても良い。この場合、損失関数は前景画像Ifgを用いない以下の式で定義される。

<加算部1135>

入力:視認性損失Lv、平滑度損失Ls

出力:損失L

処理:加算部1135は、次式により、損失Lを計算する(S1135)。例えば、2つの損失の重みは(λv,λs)=(0.1,1)とする。

<アルファ値更新部115>

アルファ値更新部115は、損失Lとアルファマップαを入力として、損失Lのアルファマップα中の各画素に関する勾配に基づいて、アルファマップαを更新する(S115)。本実施形態ではAdam optimizerを用いて更新を行う。アルファ値更新部115は、所定の条件を満たしたところで更新を終了し(S115-2のyes)、その時点でのアルファマップαを最適化済のアルファマップα’として出力する。所定の条件とは、損失Lが所定の閾値(例えば0.2)未満となるか、損失Lの減少が一定回数(例えば50回)以上観察されないとき、あるいは一定回数(例えば500回)の更新を終えた時点等である。

このような構成により、背景成分の減衰の効果が混入することなく正確に前景画像の視認性が推定可能となり、多様な前景画像に対する視認性の予測精度を大幅に改善することができるという効果を奏する。

アルファ値生成部を最適化装置として機能させてもよい。この場合、最適化装置は、前景画像Ifg、背景画像Ibg、前景マスク画像M、アルファマップの初期値αin、所望の視認性マップ^vを入力として、最適化済のアルファマップαout∈RH×Wを生成し、出力する。以降の実施形態についても同様である。

第1実施形態と異なる部分を中心に説明する。

図12はアルファ値生成部210の機能ブロック図を、図13はその処理フローの例を示す。

図14は視認性予測部211の機能ブロック図を、図15はその処理フローの例を示す。

出力:第一対象成分ΔItg、第二対象成分ΔIfg、視認性マップv

処理:

マスク適用部1111、重み計算部1115、特徴集約部1117における処理S1111,S1115,S1117は第1実施形態と同様であり、説明を省略する。

図16は知覚コントラスト計算部2113の機能ブロック図を、図17はその処理フローの例を示す。

出力:対象成分ΔItg、ΔIfg、対象成分の知覚コントラストマップP、P'

処理:

色変換部1113A、アルファブレンド部1113B、バンド分解部1113D、バンドリミテッドコントラスト計算部1113E、第一正規化部1113F、第二正規化部1113G、連結部1113Hにおける処理S1113A、S1113B、S1113D、S1113E、S1113F、S1113G、S1113Hは第1実施形態と同様であり、説明を省略する。

図18は損失計算部213の機能ブロック図を、図19はその処理フローの例を示す。

入力:第一対象成分ΔItg∈R^3(N-1)×H×W、第二対象成分ΔIfg∈R^3(N-1)×H×W

出力:画像忠実度損失Lf

処理:画像忠実度損失計算部2134は、第一対象成分ΔItg、第二対象成分ΔIfgを用いて、次式によって画像忠実度損失Lfを計算する(S2134)。

ただし、ρ(a,b)は、画像a,b間の相関を評価する関数である。

入力:視認性損失Lv、画像忠実度損失Lf、平滑度損失Ls

出力:損失L

処理:加算部2135は、次式により、損失Lを計算する(S2135)。例えば、3つの損失の重みは(λv,λf,λs)=(0.1,1,1)とする。

<効果>

上述の構成により、第1実施形態と同様の効果を得ることができる。さらに、前景画像の構造を保持しつつ所望の視認性が得られるようなブレンド結果を自動的に得ることができる。さらに、ユーザが画像領域毎に異なる「所望の視認性」を与えた場合に、アルファ値がオブジェクトの輪郭に沿って自然に変化するような結果が得られる。

第1実施形態および第2実施形態と異なる部分を中心に説明する。

図20はアルファ値生成部310の機能ブロック図を、図21はその処理フローの例を示す。

背景視認性予測部311Bは、前景視認性予測部311Fと共通の処理S311Bを行う。ただし、前景画像Ifgと背景画像Ibgの役割が逆転する。具体的には、全ての処理について前景画像Ifgを背景画像Ibgに置き換え、背景画像Ibgを前景画像Ifgに置き換える。

背景損失計算部313Bは、所望の視認性下限マップ^vBと視認性マップvBと前景画像Ifg、アルファマップα、第一対象成分ΔItg,Bと第二対象成分ΔIfg,Bを入力として、損失LBを計算し(S313B)、出力する。

ここでNは「ブレンドを行う画像領域に属する画素の集合」を表す。上の式は前景損失計算部313Fにおける視認性損失Lvと基本的に同様であるが、現在の視認性が視認性の下限値を上回る場合には損失としないよう変更が加えられている。なお、背景画像Ibgに対する画像忠実度損失Lfと平滑度損失Lsは、前景損失計算部313Fと同様に計算して損失に加えてもよいし、省略してもよい。つまり、背景損失計算部313B内の加算部は、視認性損失Lv,Bをそのまま損失LBとして出力してもよいし、視認性損失Lv,Bに画像忠実度損失Lfと平滑度損失Lsの少なくとも何れかを加えて損失LBとして出力してもよい。

最後に、損失加算部314は、前景損失計算部313Fで得られた損失LFと、背景損失計算部313Bで得られた損失LBとを入力とし、これらの値を加算し(S314)、和を損失L(=LF+LB)としてアルファ値更新部115に出力する。

これまでの実施形態では2枚の画像をブレンドする状況のみ考えてきたが、第4実施形態ではこれを任意の枚数の画像同士のブレンディングに拡張する。1枚の背景画像Ibg上にM枚の前景画像Ifgをブレンドする式は以下のように定義する。

ここで、Ii fgmはm番目の前景画像Ifgmのi番目の画素値、αi (m)はm番目の前景画像Ifgmのアルファマップα(m)のi番目の画素のアルファ値をそれぞれ表す。各アルファ値は、

αi (1)+αi (2)+…+αi (M)≦1, 0≦αi (m)≦1, m=1,2,…,M (4-2)

を満たすものとする。

以下、アルファ値生成部410の詳細について説明する。

図23はアルファ値生成部410の機能ブロック図を、図24はその処理フローの例を示す。

本実施形態では、視認性予測部に含まれていたマスク適用部(図5参照)を、視認性予測部から独立させることで、M+1個ある視認性予測部にて同一の処理を行わなくて済むようにしている。

ここで、α'(m)、α'(bg)は正規化前の前景アルファマップと正規化前の背景アルファマップを表すものとする。

出力:M個のマスク適用済のアルファマップα(m)

処理:

まず、マスク適用部4111は、式(4-3)によりM個の正規化後のアルファマップα(m)を得る。

前景視認性予測部411F―1~411F―Mは処理が共通するため、ここではm番目の前景視認性予測部411F-mの処理のみ記述する。第2実施形態における視認性予測部211と基本的に同一の処理を行うが、マスク適用部4111が前景視認性予測部411F-mの外側に移動したことで、マスク適用済のアルファマップα(m)を入力にとる点と、M枚のマスク適用済のアルファマップα(m)とm番目の前景画像Ifgmを入力にとる点が異なる。その他の相違点は知覚コントラスト計算部1113にて詳述する。

出力:前景視認性マップvm

処理:

知覚コントラスト計算部4113は、M枚のマスク適用済のアルファマップα(m)、m番目の前景マスク画像Mm、M枚の前景画像Ifgm、背景画像Ibgを入力として、前景画像Ifgmに対する第一対象成分ΔItg,mとその知覚コントラストマップPm、前景画像Ifgmに対する第二対象成分ΔIfg,mとその知覚コントラストマップP'mを得(S4113)、出力する。第一対象成分ΔItg,m、第二対象成分ΔIfg,mは、そのまま前景視認性予測部411F-mの出力として出力する。

図27は知覚コントラスト計算部4113の機能ブロック図を、図28はその処理フローの例を示す。

入力:M枚のマスク適用済のアルファマップα(m)、m番目の前景画像Ifgmに対応する1枚の前景マスク画像Mm、M枚の色変換後の前景画像Ifgm、色変換後の背景画像Ibg

出力:m番目のブレンド画像Ibl,tgm

アルファブレンド部4113Bは、前景画像Ifgmの第一対象成分ΔItgmを計算するために、式(4-1)にしたがってアルファブレンド画像Ibl,tgm∈R3×H×Wを得(S4113B)、出力する。

また、アルファブレンド部4113Bは、前景画像Ifgmの第二対象成分ΔIfgmを計算するために、次式にしたがってアルファブレンド画像Ibl,fgm∈R3×H×Wを得(S4113B)、出力する。

ただし、Mi mは前景マスク画像Mmのi番目の画素のアルファ値とする。

入力:M枚のアルファマップα(m)、m番目の前景画像Ifgmに対応する1枚の前景マスク画像Mm、M枚の色変換後の前景画像Ifgm、色変換後の背景画像Ibg

出力:m番目の前景画像Ifgmに対応する1個の第一対象成分ΔItgm、m番目の前景画像Ifgmに対応する1個の第二対象成分ΔIfgm

処理:第一対象成分ΔItgmと第二対象成分Ifgmの計算で基本的に共通の処理S4113Cとなるが、以下の(4)のブレンド処理のみ両者で異なる計算方法を用いる。

図25は前景視認性予測部411Bの機能ブロック図を、図26はその処理フローの例を示す。

知覚コントラスト計算部411B3(背景用)の処理S411B3は、前景用の知覚コントラスト計算部4113の処理S4113と基本的に同一の処理となるが、画像のブレンドの計算が異なる。ここでも、背景画像Ibgをマスク適用済のアルファマップα(m)でブレンドした際の背景画像Ibg(背景画像Ibgの第一対象成分ΔItg,B)に対する知覚コントラストマップPbgを計算する処理と、不透明な背景画像Ibg(背景画像Ibgの第二対象成分ΔIfg,B)に対する知覚コントラストマップP'bgを計算する処理とを行う。なお、図25、図27では第一対象成分ΔItg,B、第二対象成分ΔIfg,B、知覚コントラストマップPbg、知覚コントラストマップP'bgを破線で囲んで示す。

入力:M枚のマスク適用済のアルファマップα(m)、色変換後のM枚の前景画像Ifgm、色変換後の背景画像Ibg

出力:ブレンド画像Ibl

アルファブレンド部4113Bは、背景第一対象成分ΔItg,Bを計算する際には、上述の式(4-1)によりブレンド画像Iblを生成する。

入力:M枚のマスク適用済のアルファマップα(m)、色変換後のM枚の前景画像Ifgm、色変換後の背景画像Ibg

出力:背景第一対象成分ΔItg,B、背景第二対象成分ΔIfg,B

処理:

(第一対象成分ΔItg,Bの生成処理)

(1)まず、対象成分抽出部4113Cは、色変換後のM枚の前景画像Ifgmのガウシアンピラミッド(N+2スケール)を生成する。

対象成分抽出部4113Cは、色変換後の背景画像Ibgから直接ラプラシアンピラミッドを生成し、そのうちローパス残余成分を除いたバンドパス成分を第二対象成分ΔIfg,Bとする。

前景損失計算部413F-mは、第2実施形態の損失計算部213と同様の処理S413F-mを行う。背景損失計算部413Bは、第3実施形態の背景損失計算部313Bと同様の処理S413Bを行う

<損失加算部414>

損失加算部414は、M個の損失LF,mと損失LBとを入力とし、これらの値を加算し(S414)、和を損失L(=LF,1+…+LF,M+LB)としてアルファ値更新部415に出力する。M個の前景画像Ifgm、背景画像Ibgそれぞれについて、どの画像の視認性を最も所望の値に近づけたいかによって、それぞれの損失を重み付けしてから加算してもよい。例えば、前景画像Ifgmの視認性を優先して所望の値に近づけたい場合、前景損失計算部413F-mの損失をより大きく重み付けする。

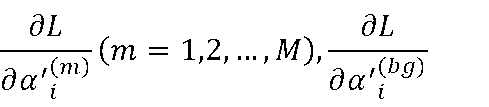

アルファ値更新部415は、損失LとM個の正規化前のアルファマップα'(m)と正規化前のアルファマップα'(bg)を入力として、M個の正規化前のアルファマップα'(m)および正規化前のアルファマップα'(bg)の各画素に関する勾配

に基づいて、正規化前の前景アルファマップα'(m)および正規化前の背景アルファマップα'(bg)を更新し(S415)、出力する。更新方法は第1、第2実施形態と同様の方法で行う。

これまでの実施形態のアルファ値生成部では、アルファマップαは損失計算部で計算された損失Lに基づいて少しずつ更新して最適化することにより得る。しかし、この方法は最適なアルファマップαを得るまでに時間がかかるため、実時間動作するアプリケーションには不向きである。第5実施形態では、最適なアルファマップαを生成するアルファ値生成器を損失計算部による損失Lに基づいて訓練する方法について説明する。この方法で事前に訓練した生成器を用いることで、1回のパスで高速にアルファマップαを生成することが可能となる。

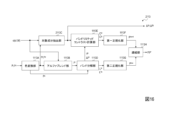

図29は訓練装置500の機能ブロック図を、図30はその処理フローの例を示す。

図31はアルファ値生成部510の機能ブロック図を、図32はその処理フローの例を示す。

出力:アルファマップα

処理:

エンコーダ511F,511Bは、それぞれ前景画像Ifg、背景画像Ibgを入力とし、エンコードし(S511F,S511B)、特徴量を抽出し、出力する。例えば、エンコーダ511F,511Bは、それぞれ前景画像Ifg、背景画像Ibgそれぞれに対して畳み込みとダウンサンプリングを交互に繰り返すことで階層的な特徴抽出を行い、出力する。

デコーダ517の各階層の特徴数は、入力時点では前景画像Ifgのエンコーダ511Fの出力と背景画像Ibgのエンコーダ511Bの出力を連結させるためエンコーダ511F,511Bの出力の特徴数の2倍となる。デコーダ517は、第1層の転置畳み込み処理において特徴数を半分に減らしつつ解像度を2倍に増やす。デコーダ517は、第2層では、第1層の出力に対して、エンコーダ511F,511Bから同じ解像度をもつ階層の出力を連結させたものを入力とするため、第2層の入力の特徴数は、「第1層の出力特徴数+2×エンコーダ中間層出力の特徴数」となる。その後、デコーダ517は、第2層の畳み込み処理において、この特徴数を第1層の出力の特徴数の半分に減らす。デコーダ517は、このようにして特徴数を徐々に減らしつつ解像度を上げていき、最終層の畳み込み処理で特徴数を1に減らし、出力をTanh関数またはSigmoid関数にかけてアルファマップαを得(S517)、出力する。Tanh関数を用いる場合は、出力の値域が-1~1となるので、これが0~1となるよう正規化する。

このために、ガウシアンピラミッド生成部513は、所望の視認性マップ^vを入力とし、所望の視認性マップ^vからガウシアンピラミッドを生成し(S513)、デコーダ517の各階層の空間サイズと一致する視認性マップVlを得、出力する。

パラメータ更新部515では、損失計算部213から与えられる損失Lの、アルファ値生成部510の各重みについての勾配に基づいて、アルファ値生成部510の各重みを更新し(S510)、出力する。本実施形態ではAdam optimizerを用いて更新を行う。更新は所定の条件を満たしたところで終了し(S515-2のyes)、その時点でのパラメータを保存して固定させる。所定の条件とは、損失Lが所定の閾値(例えば0.2)未満となるか、損失Lの減少が一定回数(例えば50回)以上観察されないとき、あるいは一定回数(例えば500回)の更新を終えた時点とする。

図33は第5実施形態に係る合成装置600の機能ブロック図を、図2はその処理フローを示す。

出力:ブレンド画像Ibl

処理:

アルファ値生成部510は、前景画像Ifg、背景画像Ibg、所望の視認性マップ^vを入力とし、これらの値を用いて、アルファマップαを生成し(S510)、出力する。

このような構成により、第1実施形態と同様の効果を得ることができる。さらに、高速にアルファマップαを生成することができる。

本発明は上記の実施形態及び変形例に限定されるものではない。例えば、上述の各種の処理は、記載に従って時系列に実行されるのみならず、処理を実行する装置の処理能力あるいは必要に応じて並列的にあるいは個別に実行されてもよい。その他、本発明の趣旨を逸脱しない範囲で適宜変更が可能である。

上述の各種の処理は、図34に示すコンピュータの記憶部2020に、上記方法の各ステップを実行させるプログラムを読み込ませ、制御部2010、入力部2030、出力部2040などに動作させることで実施できる。

Claims (13)

- 前景マスク画像と、前記前景マスク画像を適用したアルファマップαと、前景画像と、背景画像を用いて、前記アルファマップαを用いてブレンドした画像において前記前景画像の視認性を計算する対象となる画像特徴成分である第一対象成分の知覚コントラストマップと、前記前景マスク画像を用いて不透明にブレンドした画像において前記前景画像の視認性を計算する対象となる画像特徴成分である第二対象成分の知覚コントラストマップを計算する知覚コントラスト計算部と、

前記第二対象成分の知覚コントラストマップを用いて、画像特徴に対する重みベクトルを計算する重み計算部と、

前記第一対象成分の知覚コントラストマップと前記重みベクトルを用いて前記前景画像の視認性を示す視認性マップvを得る特徴集約部と、

前記視認性マップvと所望の視認性マップ^vとから視認性損失を計算し、前記前景画像と前記アルファマップαとから前記アルファマップαが空間的に滑らかに変化するような制約を与える平滑度損失を計算し、前記視認性損失と前記平滑度損失を用いて損失LFを計算する損失計算部と、

前記損失LFを用いて、前記アルファマップαを更新するアルファ値更新部と、を含む、

最適化装置。 - 請求項1の最適化装置であって、

前記損失計算部は、前記アルファマップαでブレンドした画像中に含まれている背景以外の前記第一対象成分と、前記前景画像を不透明にブレンドした際の背景以外の前記第二対象成分の相関が高くなる効果を与えるような画像忠実度損失を計算し、前記視認性損失と前記平滑度損失と前記画像忠実度損失を用いて前記損失LFを計算する、

最適化装置。 - 請求項1または請求項2の最適化装置であって、

前記背景画像の視認性を示す背景視認性マップと背景画像の視認性の下限を示す所望の視認性下限マップ^vBとから背景についての背景視認性損失を計算し、前記背景画像と前記アルファマップαとから前記アルファマップαが空間的に滑らかに変化するような制約を与える背景平滑度損失を計算し、前記背景視認性損失と前記背景平滑度損失を用いて損失LBを計算する背景損失計算部と、

前記損失LFと前記損失LBを用いて損失Lを求める損失加算部とを含み、

前記アルファ値更新部は、前記損失Lを用いて、前記アルファマップαを更新する、

最適化装置。 - 請求項3の最適化装置であって、

前記知覚コントラスト計算部は、M枚の前景マスク画像と、M枚の前記前景マスク画像を適用したM枚のアルファマップα(m)と、M枚の前景画像と、前記背景画像を用いて、前記アルファマップα(m)を用いてブレンドした画像においてM枚の前記前景画像の視認性を計算する対象となる画像特徴成分であるM個の第一対象成分の知覚コントラストマップと、M枚の前記前景マスク画像を用いて不透明にブレンドした画像においてM枚の前記前景画像の視認性を計算する対象となる画像特徴成分であるM個の第二対象成分の知覚コントラストマップを計算し、

前記重み計算部は、M個の前記第二対象成分の知覚コントラストマップを用いて、画像特徴に対するM個の重みベクトルを計算し、

前記特徴集約部は、M個の前記第一対象成分の知覚コントラストマップとM個の前記重みベクトルを用いてM枚の前記前景画像の視認性を示すM個の視認性マップvを得、

前記損失計算部は、M個の前記視認性マップvとM個の所望の視認性マップ^vとからM個の視認性損失を計算し、M枚の前記前景画像とM枚の前記アルファマップαとからM枚の前記アルファマップαが空間的に滑らかに変化するような制約を与えるM個の平滑度損失を計算し、M個の前記視認性損失とM個の前記平滑度損失を用いてM個の損失LFを計算し、

前記損失加算部は、M個の前記損失LFと前記損失LBを用いて損失Lを求める、

最適化装置。 - 前景画像と背景画像を深層ニューラルネットワークから成る共通のエンコーダによってエンコードしたのち、エンコードした特徴と所望の視認性マップから他の深層ニューラルネットワークから成るデコーダを用いてデコードすることによってアルファマップを生成するアルファ値生成部と、

前景マスク画像と、前記前景マスク画像を適用した前記アルファマップαと、前記前景画像と、前記背景画像を用いて、前記アルファマップαを用いてブレンドした画像において前記前景画像の視認性を計算する対象となる画像特徴成分である第一対象成分の知覚コントラストマップと、前記前景マスク画像を用いて不透明にブレンドした画像において前記前景画像の視認性を計算する対象となる画像特徴成分である第二対象成分の知覚コントラストマップを計算する知覚コントラスト計算部と、

前記第二対象成分の知覚コントラストマップを用いて、画像特徴に対する重みベクトルを計算する重み計算部と、

前記第一対象成分の知覚コントラストマップと前記重みベクトルを用いて前記前景画像の視認性を示す視認性マップvを得る特徴集約部と、

前記視認性マップvと所望の視認性マップ^vとから視認性損失を計算し、前記前景画像と前記アルファマップαとから前記アルファマップαが空間的に滑らかに変化するような制約を与える平滑度損失を計算し、前記視認性損失と前記平滑度損失を用いて損失LFを計算する損失計算部と、

前記損失LFを用いて、前記エンコーダおよび前記デコーダのパラメータを更新するパラメータ更新部と、を含む、

訓練装置。 - 請求項5の訓練装置で訓練したパラメータを用いる合成装置であって、

合成対象の前景画像と合成対象の背景画像を、前記パラメータを用いる前記エンコーダによってエンコードしたのち、エンコードした特徴と所望の視認性マップから前記パラメータを用いる前記デコーダを用いてデコードすることによってアルファマップを生成するアルファ値生成部と、

前記合成対象の前景画像と前記合成対象の背景画像を前記アルファマップを用いて合成し、合成画像を生成するブレンド部とを含む、

合成装置。 - 最適化装置が、前景マスク画像と、前記前景マスク画像を適用したアルファマップαと、前景画像と、背景画像を用いて、前記アルファマップαを用いてブレンドした画像において前記前景画像の視認性を計算する対象となる画像特徴成分である第一対象成分の知覚コントラストマップと、前記前景マスク画像を用いて不透明にブレンドした画像において前記前景画像の視認性を計算する対象となる画像特徴成分である第二対象成分の知覚コントラストマップを計算する知覚コントラスト計算ステップと、

前記最適化装置が、前記第二対象成分の知覚コントラストマップを用いて、画像特徴に対する重みベクトルを計算する重み計算ステップと、

前記最適化装置が、前記第一対象成分の知覚コントラストマップと前記重みベクトルを用いて前記前景画像の視認性を示す視認性マップvを得る特徴集約ステップと、

前記最適化装置が、前記視認性マップvと所望の視認性マップ^vとから視認性損失を計算し、前記前景画像と前記アルファマップαとから前記アルファマップαが空間的に滑らかに変化するような制約を与える平滑度損失を計算し、前記視認性損失と前記平滑度損失を用いて損失LFを計算する損失計算ステップと、

前記最適化装置が、前記損失LFを用いて、前記アルファマップαを更新するアルファ値更新ステップと、を含む、

最適化方法。 - 請求項7の最適化方法であって、

前記損失計算ステップは、前記アルファマップαでブレンドした画像中に含まれている背景以外の前記第一対象成分と、前記前景画像を不透明にブレンドした際の背景以外の前記第二対象成分の相関が高くなる効果を与えるような画像忠実度損失を計算し、前記視認性損失と前記平滑度損失と前記画像忠実度損失を用いて前記損失LFを計算する、

最適化方法。 - 請求項7または請求項8の最適化方法であって、

前記最適化装置が、前記背景画像の視認性を示す背景視認性マップと背景画像の視認性の下限を示す所望の視認性下限マップ^vBとから背景についての背景視認性損失を計算し、前記背景画像と前記アルファマップαとから前記アルファマップαが空間的に滑らかに変化するような制約を与える背景平滑度損失を計算し、前記背景視認性損失と前記背景平滑度損失を用いて損失LBを計算する背景損失計算ステップと、

前記最適化装置が、前記損失LFと前記損失LBを用いて損失Lを求める損失加算ステップとを含み、

前記アルファ値更新ステップは、前記損失Lを用いて、前記アルファマップαを更新する、

最適化方法。 - 請求項9の最適化方法であって、

前記知覚コントラスト計算ステップは、M枚の前景マスク画像と、M枚の前記前景マスク画像を適用したM枚のアルファマップα(m)と、M枚の前景画像と、前記背景画像を用いて、前記アルファマップα(m)を用いてブレンドした画像においてM枚の前記前景画像の視認性を計算する対象となる画像特徴成分であるM個の第一対象成分の知覚コントラストマップと、M枚の前記前景マスク画像を用いて不透明にブレンドした画像においてM枚の前記前景画像の視認性を計算する対象となる画像特徴成分であるM個の第二対象成分の知覚コントラストマップを計算し、

前記重み計算ステップは、M個の前記第二対象成分の知覚コントラストマップを用いて、画像特徴に対するM個の重みベクトルを計算し、

前記特徴集約ステップは、M個の前記第一対象成分の知覚コントラストマップとM個の前記重みベクトルを用いてM枚の前記前景画像の視認性を示すM個の視認性マップvを得、

前記損失計算ステップは、M個の前記視認性マップvとM個の所望の視認性マップ^vとからM個の視認性損失を計算し、M枚の前記前景画像とM枚の前記アルファマップαとからM枚の前記アルファマップαが空間的に滑らかに変化するような制約を与えるM個の平滑度損失を計算し、M個の前記視認性損失とM個の前記平滑度損失を用いてM個の損失LFを計算し、

前記損失加算ステップは、M個の前記損失LFと前記損失LBを用いて損失Lを求める、

最適化方法。 - 訓練装置が、前景画像と背景画像を深層ニューラルネットワークから成る共通のエンコーダによってエンコードしたのち、エンコードした特徴と所望の視認性マップから他の深層ニューラルネットワークから成るデコーダを用いてデコードすることによってアルファマップを生成するアルファ値生成ステップと、

前記訓練装置が、前景マスク画像と、前記前景マスク画像を適用した前記アルファマップαと、前記前景画像と、前記背景画像を用いて、前記アルファマップαを用いてブレンドした画像において前記前景画像の視認性を計算する対象となる画像特徴成分である第一対象成分の知覚コントラストマップと、前記前景マスク画像を用いて不透明にブレンドした画像において前記前景画像の視認性を計算する対象となる画像特徴成分である第二対象成分の知覚コントラストマップを計算する知覚コントラスト計算ステップと、

前記訓練装置が、前記第二対象成分の知覚コントラストマップを用いて、画像特徴に対する重みベクトルを計算する重み計算ステップと、

前記訓練装置が、前記第一対象成分の知覚コントラストマップと前記重みベクトルを用いて前記前景画像の視認性を示す視認性マップvを得る特徴集約ステップと、

前記訓練装置が、前記視認性マップvと所望の視認性マップ^vとから視認性損失を計算し、前記前景画像と前記アルファマップαとから前記アルファマップαが空間的に滑らかに変化するような制約を与える平滑度損失を計算し、前記視認性損失と前記平滑度損失を用いて損失LFを計算する損失計算ステップと、

前記訓練装置が、前記損失LFを用いて、前記エンコーダおよび前記デコーダのパラメータを更新するパラメータ更新ステップと、を含む、

訓練方法。 - 請求項11の訓練方法で訓練したパラメータを用いる合成方法であって、

合成装置が、合成対象の前景画像と合成対象の背景画像を、前記パラメータを用いる前記エンコーダによってエンコードしたのち、エンコードした特徴と所望の視認性マップから前記パラメータを用いる前記デコーダを用いてデコードすることによってアルファマップを生成するアルファ値生成ステップと、

前記合成装置が、前記合成対象の前景画像と前記合成対象の背景画像を前記アルファマップを用いて合成し、合成画像を生成するブレンドステップとを含む、

合成方法。 - 請求項1から請求項4の何れかの最適化装置、または、請求項5の訓練装置、または、請求項6の合成装置としてコンピュータを機能させるためのプログラム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2021083720A JP7544359B2 (ja) | 2021-05-18 | 2021-05-18 | 最適化装置、訓練装置、合成装置、それらの方法、およびプログラム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2021083720A JP7544359B2 (ja) | 2021-05-18 | 2021-05-18 | 最適化装置、訓練装置、合成装置、それらの方法、およびプログラム |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2022177454A JP2022177454A (ja) | 2022-12-01 |

| JP7544359B2 true JP7544359B2 (ja) | 2024-09-03 |

Family

ID=84237731

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2021083720A Active JP7544359B2 (ja) | 2021-05-18 | 2021-05-18 | 最適化装置、訓練装置、合成装置、それらの方法、およびプログラム |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP7544359B2 (ja) |

Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2012059158A (ja) | 2010-09-13 | 2012-03-22 | Casio Comput Co Ltd | 画像処理装置、画像処理方法及びプログラム |

| WO2016039301A1 (ja) | 2014-09-08 | 2016-03-17 | 国立大学法人東京大学 | 画像処理装置および画像処理方法 |

-

2021

- 2021-05-18 JP JP2021083720A patent/JP7544359B2/ja active Active

Patent Citations (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2012059158A (ja) | 2010-09-13 | 2012-03-22 | Casio Comput Co Ltd | 画像処理装置、画像処理方法及びプログラム |

| WO2016039301A1 (ja) | 2014-09-08 | 2016-03-17 | 国立大学法人東京大学 | 画像処理装置および画像処理方法 |

Non-Patent Citations (1)

| Title |

|---|

| 吹上 大樹、外2名,"透明視を利用した複合現実感環境下における遮蔽矛盾解消手法の提案",情報処理学会研究報告,日本,一般社団法人情報処理学会,2013年02月15日,Vol.2012-CVIM-184, No.1,pp.1-8 |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2022177454A (ja) | 2022-12-01 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN114008663B (zh) | 实时视频超分辨率 | |

| Moser et al. | Hitchhiker's guide to super-resolution: Introduction and recent advances | |

| Xie et al. | Learning frequency-aware dynamic network for efficient super-resolution | |

| Wei et al. | A-ESRGAN: Training real-world blind super-resolution with attention U-Net Discriminators | |

| US9569684B2 (en) | Image enhancement using self-examples and external examples | |

| CN109308679A (zh) | 一种图像风格转换方及装置、设备、存储介质 | |

| Zhao et al. | RIRO: From Retinex-inspired reconstruction optimization model to deep low-light image enhancement unfolding network | |

| Jiang et al. | A novel super-resolution CT image reconstruction via semi-supervised generative adversarial network | |

| CN120238709B (zh) | 基于深度信息与时频优化的轨迹控制视频生成方法及装置 | |

| Sandoub et al. | A low‐light image enhancement method based on bright channel prior and maximum colour channel | |

| CN114830168A (zh) | 图像重建方法、电子设备和计算机可读存储介质 | |

| Purkait et al. | Image upscaling using multiple dictionaries of natural image patches | |

| Soniya et al. | Integrating Kalman filter noise residue into U-Net for robust image denoising: the KU-Net model | |

| Mikaeli et al. | Single-image super-resolution via patch-based and group-based local smoothness modeling | |

| Dogra et al. | Effective image fusion strategies in scientific signal processing disciplines: Application to cancer and carcinoma treatment planning | |

| Hong et al. | Image interpolation using interpolative classified vector quantization | |

| JP7544359B2 (ja) | 最適化装置、訓練装置、合成装置、それらの方法、およびプログラム | |

| Shivam Kumar Jha et al. | A homotopy-CNN framework for continuous deformation in low-light image enhancement | |

| Feng et al. | VR Scene Detail Enhancement Method Based on Depth Reinforcement Learning Algorithm | |

| RU2770132C1 (ru) | Генераторы изображений с условно независимым синтезом пикселей | |

| Feng et al. | Hierarchical guided network for low‐light image enhancement | |

| Baiju et al. | L 1/2 regularized joint low rank and sparse recovery technique for illumination map estimation in low light image enhancement | |

| Mishra et al. | Experimentally proven bilateral blur on SRCNN for optimal convergence | |

| CA3144236C (en) | Real-time video ultra resolution | |

| EP4575974A1 (en) | Upsampling |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A821 Effective date: 20210518 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20230922 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20240611 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20240618 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20240725 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20240813 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20240814 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7544359 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| S533 | Written request for registration of change of name |

Free format text: JAPANESE INTERMEDIATE CODE: R313533 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |