JP7386812B2 - 照明推定 - Google Patents

照明推定 Download PDFInfo

- Publication number

- JP7386812B2 JP7386812B2 JP2020564910A JP2020564910A JP7386812B2 JP 7386812 B2 JP7386812 B2 JP 7386812B2 JP 2020564910 A JP2020564910 A JP 2020564910A JP 2020564910 A JP2020564910 A JP 2020564910A JP 7386812 B2 JP7386812 B2 JP 7386812B2

- Authority

- JP

- Japan

- Prior art keywords

- scene

- image

- pixels

- determining

- input image

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000013528 artificial neural network Methods 0.000 claims description 50

- 238000005286 illumination Methods 0.000 claims description 33

- 238000012545 processing Methods 0.000 claims description 30

- 238000000034 method Methods 0.000 claims description 23

- 230000004044 response Effects 0.000 claims description 7

- 230000007613 environmental effect Effects 0.000 description 12

- 238000010586 diagram Methods 0.000 description 10

- 238000004891 communication Methods 0.000 description 8

- 230000008569 process Effects 0.000 description 8

- 238000012549 training Methods 0.000 description 7

- 238000013527 convolutional neural network Methods 0.000 description 6

- 230000000694 effects Effects 0.000 description 6

- 230000006870 function Effects 0.000 description 6

- 239000000463 material Substances 0.000 description 6

- 230000004907 flux Effects 0.000 description 5

- 230000000750 progressive effect Effects 0.000 description 5

- 239000002131 composite material Substances 0.000 description 2

- 238000004590 computer program Methods 0.000 description 2

- 238000013507 mapping Methods 0.000 description 2

- 230000003287 optical effect Effects 0.000 description 2

- 230000004913 activation Effects 0.000 description 1

- 230000003466 anti-cipated effect Effects 0.000 description 1

- 238000003491 array Methods 0.000 description 1

- 230000003190 augmentative effect Effects 0.000 description 1

- 230000005284 excitation Effects 0.000 description 1

- 239000000835 fiber Substances 0.000 description 1

- 230000003993 interaction Effects 0.000 description 1

- 238000004519 manufacturing process Methods 0.000 description 1

- 238000010606 normalization Methods 0.000 description 1

- 230000002093 peripheral effect Effects 0.000 description 1

- 238000011176 pooling Methods 0.000 description 1

- 238000007670 refining Methods 0.000 description 1

- 238000009877 rendering Methods 0.000 description 1

- 239000004065 semiconductor Substances 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T15/00—3D [Three Dimensional] image rendering

- G06T15/50—Lighting effects

- G06T15/60—Shadow generation

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

- G06N3/045—Combinations of networks

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T15/00—3D [Three Dimensional] image rendering

- G06T15/50—Lighting effects

- G06T15/506—Illumination models

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T15/00—3D [Three Dimensional] image rendering

- G06T15/50—Lighting effects

- G06T15/80—Shading

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T17/00—Three dimensional [3D] modelling, e.g. data description of 3D objects

- G06T17/20—Finite element generation, e.g. wire-frame surface description, tesselation

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/50—Depth or shape recovery

- G06T7/507—Depth or shape recovery from shading

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10028—Range image; Depth image; 3D point clouds

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- General Physics & Mathematics (AREA)

- Computer Graphics (AREA)

- Software Systems (AREA)

- Computing Systems (AREA)

- Mathematical Physics (AREA)

- Data Mining & Analysis (AREA)

- Evolutionary Computation (AREA)

- General Health & Medical Sciences (AREA)

- Molecular Biology (AREA)

- Biophysics (AREA)

- General Engineering & Computer Science (AREA)

- Biomedical Technology (AREA)

- Computational Linguistics (AREA)

- Artificial Intelligence (AREA)

- Life Sciences & Earth Sciences (AREA)

- Health & Medical Sciences (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Geometry (AREA)

- Image Analysis (AREA)

- Image Generation (AREA)

- Image Processing (AREA)

Description

... 510-4に対する4つのエンコーダが重みを共有することができる。同様に、8つの放射照度マップ520-1 ... 520-8に対する8つのエンコーダが重みを共有することができる。ピクセルが分割されるべきかどうかの決定に関して、リファインメントネットワーク380は、それが分割されるべき確率及びそれが分割されるべきでない確率を出力することができる。次いで、ソフトマックス層が、それらを最終決定に変換し得る。4つのサブピクセルの値に対して、それらの放射照度強度の間により強いコントラストが存在することがある。幾つかの実装では、出力値の範囲は、複数の間隔に一様に分割することができ、各サブピクセルの値は、離散化された多項分類で出力することができる。

Claims (18)

- 電子デバイスであって:

処理ユニットと;

前記処理ユニットに結合され、前記処理ユニットによる実行のための命令を記憶するメモリであって、前記命令は、前記処理ユニットによって実行されるとき、前記デバイスに:

実オブジェクトについての入力画像及び前記入力画像に対応するデプスマップを取得することと;

前記デプスマップに基づいて前記入力画像内のシーンを決定することと;

前記シーンに基づいて、前記シーン内の光源によって引き起こされる前記実オブジェクトのシェーディング及び影情報を決定することであって、前記光源は、所定の形状の画像によって表され、前記画像は、前記光源の複数の部分に対応する複数のピクセルを含み、前記複数のピクセルのそれぞれのピクセル値は、前記光源の前記複数の部分のそれぞれの放射照度強度を表し、

前記シェーディング及び影情報を決定することは:

前記画像内の前記複数のピクセルのそれぞれのピクセル値を所定の値で初期化することと;

前記シーン及び初期化された前記画像に基づいて、前記複数のピクセルに対応する第1の放射照度マップのセットであって、前記放射照度マップの各々は前記光源の対応する部分によって引き起こされる前記実オブジェクトの対応するシェーディング及び影情報を表す、前記第1の放射照度マップのセットを生成することと;を含む、

シェーディング及び影情報を決定することと;

前記入力画像と、前記シェーディング及び影情報とに基づいて前記光源によって引き起こされる前記シーン内の照明条件を決定することであって、前記入力画像及び前記第1の放射照度マップのセットに基づいて、前記画像内の前記複数のピクセルのそれぞれのピクセル値を決定することを含む、前記シーン内の前記照明条件を決定することと;

を含む動作を実行させる、メモリと;

を有する、電子デバイス。 - 前記動作はさらに:

前記シーン及び前記照明条件に基づいて、前記実オブジェクト及び仮想オブジェクトを含む出力画像を生成することを含み、前記出力画像は前記入力画像の前記シーン内に前記仮想オブジェクトを合成する、

請求項1に記載のデバイス。 - 前記シーンは、前記実オブジェクトの配置のための表面を含み、前記シーンを決定することは:

前記デプスマップを点群に変換することと;

前記点群内の複数の点を面に適合させることであって、前記複数の点は前記表面を表す、適合させることと;

前記面の上に位置する前記点群内の前記複数の点を3次元メッシュに再構成することであって、前記面及び前記3次元メッシュは、前記入力画像内の前記シーンを共に表す、再構成することと:を含む、

請求項1に記載のデバイス。 - 前記光源を表す前記画像は、十字形状の画像である、

請求項1に記載のデバイス。 - 前記画像内の前記複数のピクセルのそれぞれのピクセル値を決定することは:

前記入力画像及び前記第1の放射照度マップのセットに基づいて、訓練されたニューラルネットワークを用いて前記画像内の前記複数のピクセルのそれぞれの前記ピクセル値を決定することを含む、

請求項1に記載のデバイス。 - 前記画像内の前記複数のピクセルのそれぞれのピクセル値を決定することは:

前記入力画像及び前記第1の放射照度マップのセットに基づいて、複数の訓練されたニューラルネットワークを用いて前記画像内の前記複数のピクセルのそれぞれの前記ピクセル値を漸進的に決定することを含む、

請求項1に記載のデバイス。 - 前記複数の訓練されたニューラルネットワークは、少なくとも第1のニューラルネットワーク及び第2のニューラルネットワークを含み、前記画像内の前記複数のピクセルのそれぞれの前記ピクセル値を決定することは:

前記入力画像及び前記第1の放射照度マップのセットに基づいて、前記第1のニューラルネットワークを使用して、前記複数のピクセルの第1のピクセルの第1のピクセル値及び前記第1のピクセルに隣接する少なくとも1つのピクセルのピクセル値を決定することと;

前記第1のピクセル、前記少なくとも1つのピクセル及び前記シーンに基づいて第2の放射照度マップのセットを生成することであって、前記第2の放射照度マップのセットは、前記第1のピクセルの複数のサブピクセル、前記少なくとも1つのピクセル、並びに前記複数のピクセルのうちの前記第1のピクセル及び前記少なくとも1つのピクセル以外のピクセルの組み合わせそれぞれに対応する、生成することと;

前記入力画像及び前記第2の放射照度マップのセットに基づいて、前記第1のピクセルが前記第2のニューラルネットワークを使用して分割されるべきかどうかを決定することと;

前記第1のピクセル値が分割されるべきでないと決定することに応答して、前記第1のピクセル値を前記第1のピクセルの最終ピクセルとして使用することと;を含む、

請求項6に記載のデバイス。 - 前記画像内の前記複数のピクセルのそれぞれの前記ピクセル値を決定することはさらに:

前記第1のピクセルが分割されるべきであると決定することに応答して、前記第1のピクセルを複数のサブピクセルに分割することと;

前記複数のサブピクセルのそれぞれのサブピクセル値を決定することと;を含む、

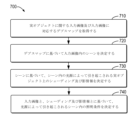

請求項7に記載のデバイス。 - コンピュータに実装される方法であって:

実オブジェクトに関する入力画像及び前記入力画像に対応するデプスマップを取得することと;

前記デプスマップに基づいて前記入力画像内のシーンを決定することと;

前記シーンに基づいて、前記シーン内の光源によって引き起こされる前記実オブジェクトのシェーディング及び影情報を決定することであって、前記光源は、所定の形状の画像によって表され、前記画像は、前記光源の複数の部分に対応する複数のピクセルを含み、前記複数のピクセルのそれぞれのピクセル値は、前記光源の前記複数の部分のそれぞれの放射照度強度を表し、

前記シェーディング及び影情報を決定することは:

前記画像内の前記複数のピクセルのそれぞれの前記ピクセル値を所定の値で初期化することと;

前記シーン及び初期化された前記画像に基づいて、前記複数のピクセルに対応する第1の放射照度マップのセットであって、前記放射照度マップの各々は前記光源の対応する部分によって引き起こされる前記実オブジェクトの対応するシェーディング及び影情報を表す、前記第1の放射照度マップのセットを生成することと;を含む、

シェーディング及び影情報を決定することと;

前記入力画像と、前記シェーディング及び影情報とに基づいて、前記光源によって引き起こされる前記シーン内の照明条件を決定することであって、前記入力画像及び前記第1の放射照度マップのセットに基づいて、前記画像内の前記複数のピクセルのそれぞれの前記ピクセル値を決定することを含む、シーン内の前記照明条件を決定することと;を含む、

方法。 - 前記シーン及び前記照明条件に基づいて、前記実オブジェクト及び仮想オブジェクトを含む出力画像を生成することをさらに含み、前記出力画像は、前記入力画像の前記シーン内に前記仮想オブジェクトを合成する、

請求項9に記載の方法。 - 前記シーンは、前記実オブジェクトの配置のための表面を含み、前記シーンを決定することは:

前記デプスマップを点群に変換することと;

前記点群内の複数の点を面に適合させることであって、前記複数の点は、前記表面を表す、適合させることと;

前記面の上に位置する前記点群内の複数の点を3次元メッシュに再構成することであって、前記面及び前記3次元メッシュは、前記入力画像内の前記シーンを共に表す、再構成することと;を含む、

請求項9に記載の方法。 - 前記光源を表す前記画像は、十字形状の画像である、

請求項9に記載の方法。 - 前記画像内の前記複数のピクセルのそれぞれのピクセル値を決定することは:

前記入力画像及び前記第1の放射照度マップのセットに基づいて、訓練されたニューラルネットワークを用いて前記画像内の前記複数のピクセルのそれぞれの前記ピクセル値を決定することを含む、

請求項9に記載の方法。 - 命令を記憶する機械可読媒体であって、前記命令は、1つ又は複数の機械によって実行されるとき、前記1つ又は複数の機械に:

実オブジェクトに関する入力画像及び前記入力画像に対応するデプスマップを取得することと;

前記デプスマップに基づいて前記入力画像内のシーンを決定することと;

前記シーンに基づいて、前記シーン内の光源によって引き起こされる前記実オブジェクトのシェーディング及び影情報を決定することであって、前記光源は、所定の形状の画像によって表され、前記画像は、前記光源の複数の部分に対応する複数のピクセルを含み、前記複数のピクセルのそれぞれのピクセル値は、前記光源の前記複数の部分のそれぞれの放射照度強度を表し、

前記シェーディング及び影情報を決定することは:

前記画像内の前記複数のピクセルのそれぞれの前記ピクセル値を所定の値で初期化することと;

前記シーン及び初期化された前記画像に基づいて、前記複数のピクセルに対応する第1の放射照度マップのセットであって、前記放射照度マップの各々は前記光源の対応する部分によって引き起こされる前記実オブジェクトの対応するシェーディング及び影情報を表す、前記第1の放射照度マップのセットを生成することと;を含む、

シェーディング及び影情報を決定することと;

前記入力画像と、前記シェーディング及び影情報とに基づいて、前記光源によって引き起こされる前記シーン内の照明条件を決定することであって、前記入力画像及び前記第1の放射照度マップのセットに基づいて、前記画像内の前記複数のピクセルのそれぞれの前記ピクセル値を決定することを含む、シーン内の前記照明条件を決定することと;を含む、動作を実行させる、

機械可読媒体。 - 前記動作は:

前記シーン及び前記照明条件に基づいて、前記実オブジェクト及び仮想オブジェクトを含む出力画像を生成することをさらに含み、前記出力画像は、前記入力画像の前記シーン内に前記仮想オブジェクトを合成する、

請求項14に記載の機械可読媒体。 - 前記シーンは、前記実オブジェクトの配置のための表面を含み、前記シーンを決定することは:

前記デプスマップを点群に変換することと;

前記点群内の複数の点を面に適合させることであって、前記複数の点は、前記表面を表す、適合させることと;

前記面の上に位置する前記点群内の複数の点を3次元メッシュに再構成することであって、前記面及び前記3次元メッシュは、前記入力画像内の前記シーンを共に表す、再構成することと;を含む、

請求項14に記載の機械可読媒体。 - 前記光源を表す前記画像は、十字形状の画像である、

請求項14に記載の機械可読媒体。 - 前記画像内の前記複数のピクセルのそれぞれのピクセル値を決定することは:

前記入力画像及び前記第1の放射照度マップのセットに基づいて、訓練されたニューラルネットワークを用いて前記画像内の前記複数のピクセルのそれぞれの前記ピクセル値を決定することを含む、

請求項14に記載の機械可読媒体。

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN201810510214.1 | 2018-05-24 | ||

| CN201810510214.1A CN110533707B (zh) | 2018-05-24 | 2018-05-24 | 照明估计 |

| PCT/US2019/031907 WO2019226366A1 (en) | 2018-05-24 | 2019-05-13 | Lighting estimation |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2021524628A JP2021524628A (ja) | 2021-09-13 |

| JPWO2019226366A5 JPWO2019226366A5 (ja) | 2022-04-22 |

| JP7386812B2 true JP7386812B2 (ja) | 2023-11-27 |

Family

ID=66655477

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2020564910A Active JP7386812B2 (ja) | 2018-05-24 | 2019-05-13 | 照明推定 |

Country Status (6)

| Country | Link |

|---|---|

| US (1) | US11151780B2 (ja) |

| EP (1) | EP3803803A1 (ja) |

| JP (1) | JP7386812B2 (ja) |

| KR (1) | KR102612808B1 (ja) |

| CN (1) | CN110533707B (ja) |

| WO (1) | WO2019226366A1 (ja) |

Families Citing this family (11)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP7003994B2 (ja) * | 2017-08-08 | 2022-01-21 | ソニーグループ株式会社 | 画像処理装置および方法 |

| CN112183551A (zh) * | 2019-07-02 | 2021-01-05 | 佳能株式会社 | 光照颜色预测方法、图像处理方法、装置及存储介质 |

| US11910095B2 (en) * | 2019-11-21 | 2024-02-20 | Sony Interactive Entertainment Inc. | Incident light information acquisition method, incident light information acquisition system, and information processing device |

| WO2021149526A1 (ja) * | 2020-01-23 | 2021-07-29 | ソニーグループ株式会社 | 情報処理装置、情報処理方法及びプログラム |

| CN115769268A (zh) * | 2020-06-22 | 2023-03-07 | 谷歌有限责任公司 | 增强现实中基于深度的重照明 |

| CN111932641B (zh) | 2020-09-27 | 2021-05-14 | 北京达佳互联信息技术有限公司 | 一种图像处理方法、装置、电子设备及存储介质 |

| KR102459771B1 (ko) * | 2021-11-15 | 2022-10-28 | 한국전자기술연구원 | 이미지 딥러닝 기반 객체의 실시간 메쉬화 장치 및 방법 |

| KR20230092514A (ko) * | 2021-12-17 | 2023-06-26 | 삼성전자주식회사 | 렌더링 방법 및 장치 |

| KR102559691B1 (ko) * | 2022-04-04 | 2023-07-26 | 주식회사 리빌더에이아이 | 뉴럴 렌더링 기반 형상 색상 통합 3d 메시 복원 방법 및 장치 |

| KR20240054111A (ko) * | 2022-10-18 | 2024-04-25 | 삼성전자주식회사 | 전자 디바이스, 전자 디바이스의 동작 방법 및 이미지 편집 시스템 |

| CN117496359B (zh) * | 2023-12-29 | 2024-03-22 | 浙江大学山东(临沂)现代农业研究院 | 基于三维点云的植物种植布局监测方法及系统 |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2009163610A (ja) | 2008-01-09 | 2009-07-23 | Canon Inc | 画像処理装置及び画像処理方法 |

| JP2013156670A (ja) | 2012-01-26 | 2013-08-15 | Fujitsu Ltd | 表示方法及び表示装置 |

| JP2014164497A (ja) | 2013-02-25 | 2014-09-08 | Canon Inc | 画像処理装置、画像処理方法及びプログラム |

| JP2015185176A (ja) | 2014-03-25 | 2015-10-22 | メタイオ ゲゼルシャフト ミット ベシュレンクテル ハフツングmetaio GmbH | 現実環境の視野におけるバーチャルオブジェクトを表現方法及びシステム |

Family Cites Families (14)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US7262770B2 (en) * | 2002-03-21 | 2007-08-28 | Microsoft Corporation | Graphics image rendering with radiance self-transfer for low-frequency lighting environments |

| US6791542B2 (en) | 2002-06-17 | 2004-09-14 | Mitsubishi Electric Research Laboratories, Inc. | Modeling 3D objects with opacity hulls |

| KR101885090B1 (ko) * | 2010-12-09 | 2018-08-03 | 삼성전자주식회사 | 영상 처리 장치, 조명 처리 장치 및 그 방법 |

| US9857470B2 (en) | 2012-12-28 | 2018-01-02 | Microsoft Technology Licensing, Llc | Using photometric stereo for 3D environment modeling |

| US9818224B1 (en) * | 2013-06-20 | 2017-11-14 | Amazon Technologies, Inc. | Augmented reality images based on color and depth information |

| EP2829842B1 (en) * | 2013-07-22 | 2022-12-21 | Hexagon Technology Center GmbH | Method, system and computer programme product for determination of an absolute volume of a stock pile using a structure from motion algorithm |

| US9412040B2 (en) * | 2013-12-04 | 2016-08-09 | Mitsubishi Electric Research Laboratories, Inc. | Method for extracting planes from 3D point cloud sensor data |

| US20150262412A1 (en) * | 2014-03-17 | 2015-09-17 | Qualcomm Incorporated | Augmented reality lighting with dynamic geometry |

| US20160140761A1 (en) * | 2014-11-19 | 2016-05-19 | Microsoft Technology Licensing, Llc. | Using depth information for drawing in augmented reality scenes |

| US10008032B2 (en) * | 2015-03-03 | 2018-06-26 | Imagination Technologies Limited | Graphics processing using directional representations of lighting at probe positions within a scene |

| US10354449B2 (en) | 2015-06-12 | 2019-07-16 | Hand Held Products, Inc. | Augmented reality lighting effects |

| CN105825544B (zh) * | 2015-11-25 | 2019-08-20 | 维沃移动通信有限公司 | 一种图像处理方法及移动终端 |

| JP6275362B1 (ja) | 2016-04-01 | 2018-02-07 | 株式会社wise | 3dグラフィック生成、人工知能の検証・学習システム、プログラム及び方法 |

| CN107341853B (zh) * | 2017-07-13 | 2021-02-12 | 河北中科恒运软件科技股份有限公司 | 超大虚拟场景和动态摄屏的虚实融合方法及系统 |

-

2018

- 2018-05-24 CN CN201810510214.1A patent/CN110533707B/zh active Active

-

2019

- 2019-05-13 WO PCT/US2019/031907 patent/WO2019226366A1/en unknown

- 2019-05-13 KR KR1020207036796A patent/KR102612808B1/ko active IP Right Grant

- 2019-05-13 JP JP2020564910A patent/JP7386812B2/ja active Active

- 2019-05-13 EP EP19726843.6A patent/EP3803803A1/en active Pending

- 2019-05-13 US US17/044,270 patent/US11151780B2/en active Active

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2009163610A (ja) | 2008-01-09 | 2009-07-23 | Canon Inc | 画像処理装置及び画像処理方法 |

| JP2013156670A (ja) | 2012-01-26 | 2013-08-15 | Fujitsu Ltd | 表示方法及び表示装置 |

| JP2014164497A (ja) | 2013-02-25 | 2014-09-08 | Canon Inc | 画像処理装置、画像処理方法及びプログラム |

| JP2015185176A (ja) | 2014-03-25 | 2015-10-22 | メタイオ ゲゼルシャフト ミット ベシュレンクテル ハフツングmetaio GmbH | 現実環境の視野におけるバーチャルオブジェクトを表現方法及びシステム |

Non-Patent Citations (1)

| Title |

|---|

| 平原 匡哲,RGB-Dカメラを用いた確率的探索による光源推定,映像情報メディア学会技術報告 Vol.37 No.36 ITE Technical Report,日本,(一社)映像情報メディア学会 The Institute of Image Information and Television Engineers,2013年08月12日,第37巻,p.9-12 |

Also Published As

| Publication number | Publication date |

|---|---|

| US20210027526A1 (en) | 2021-01-28 |

| KR20210013150A (ko) | 2021-02-03 |

| JP2021524628A (ja) | 2021-09-13 |

| CN110533707A (zh) | 2019-12-03 |

| US11151780B2 (en) | 2021-10-19 |

| KR102612808B1 (ko) | 2023-12-11 |

| CN110533707B (zh) | 2023-04-14 |

| EP3803803A1 (en) | 2021-04-14 |

| WO2019226366A1 (en) | 2019-11-28 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP7386812B2 (ja) | 照明推定 | |

| US10776688B2 (en) | Multi-frame video interpolation using optical flow | |

| JP7403528B2 (ja) | シーンの色及び深度の情報を再構成するための方法及びシステム | |

| US20240265561A1 (en) | Mesh reconstruction using data-driven priors | |

| US11748937B2 (en) | Sub-pixel data simulation system | |

| US11954830B2 (en) | High dynamic range support for legacy applications | |

| CN111161398B (zh) | 一种图像生成方法、装置、设备及存储介质 | |

| US11475549B1 (en) | High dynamic range image generation from tone mapped standard dynamic range images | |

| TWI546743B (zh) | 於一影像中之物件選擇技術 | |

| US20240104842A1 (en) | Encoder-based approach for inferring a three-dimensional representation from an image | |

| CN115053234A (zh) | 深度光度学习(dpl)系统、装置和方法 | |

| US20220284663A1 (en) | Method and apparatus with image processing and reconstructed image generation | |

| US11282258B1 (en) | Adaptive sampling at a target sampling rate | |

| US20230298243A1 (en) | 3d digital avatar generation from a single or few portrait images | |

| CN113139992A (zh) | 多分辨率体素网格化 | |

| CN117372607A (zh) | 一种三维模型的生成方法、装置及电子设备 | |

| GB2536060B (en) | Virtual trying-on experience | |

| EP4207089A1 (en) | Image processing method and apparatus | |

| US20210209798A1 (en) | Method and apparatus for processing sparse points | |

| CN116188349A (zh) | 图像处理方法、装置、电子设备及存储介质 | |

| CN112652056A (zh) | 一种3d信息展示方法及装置 | |

| CN116012666B (zh) | 图像生成、模型的训练、信息重建方法、装置及电子设备 | |

| US20240161391A1 (en) | Relightable neural radiance field model | |

| US20240015263A1 (en) | Methods and apparatus to provide remote telepresence communication | |

| CN118505872A (zh) | 一种图像渲染方法、图像渲染装置及计算机可读存储介质 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20220412 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20220412 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20230410 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20230418 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20230713 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20231017 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20231114 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7386812 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |