JP7197957B2 - Reaction analysis system and reaction analysis device - Google Patents

Reaction analysis system and reaction analysis device Download PDFInfo

- Publication number

- JP7197957B2 JP7197957B2 JP2022539466A JP2022539466A JP7197957B2 JP 7197957 B2 JP7197957 B2 JP 7197957B2 JP 2022539466 A JP2022539466 A JP 2022539466A JP 2022539466 A JP2022539466 A JP 2022539466A JP 7197957 B2 JP7197957 B2 JP 7197957B2

- Authority

- JP

- Japan

- Prior art keywords

- reaction

- displayed

- participant

- biological

- biological reaction

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000006243 chemical reaction Methods 0.000 title claims description 149

- 238000004458 analytical method Methods 0.000 title claims description 109

- 239000000463 material Substances 0.000 claims description 29

- 230000008451 emotion Effects 0.000 claims description 28

- 230000001815 facial effect Effects 0.000 claims description 13

- 230000004424 eye movement Effects 0.000 claims description 3

- 230000008921 facial expression Effects 0.000 description 51

- 230000002996 emotional effect Effects 0.000 description 16

- 238000010586 diagram Methods 0.000 description 6

- 238000000034 method Methods 0.000 description 5

- 230000007935 neutral effect Effects 0.000 description 4

- 238000012545 processing Methods 0.000 description 4

- 230000006870 function Effects 0.000 description 3

- 210000000887 face Anatomy 0.000 description 2

- 230000014509 gene expression Effects 0.000 description 2

- 238000010191 image analysis Methods 0.000 description 2

- 238000010801 machine learning Methods 0.000 description 1

- 239000002245 particle Substances 0.000 description 1

- 238000012805 post-processing Methods 0.000 description 1

- 239000004065 semiconductor Substances 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06Q—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES; SYSTEMS OR METHODS SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES, NOT OTHERWISE PROVIDED FOR

- G06Q10/00—Administration; Management

- G06Q10/10—Office automation; Time management

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06Q—INFORMATION AND COMMUNICATION TECHNOLOGY [ICT] SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES; SYSTEMS OR METHODS SPECIALLY ADAPTED FOR ADMINISTRATIVE, COMMERCIAL, FINANCIAL, MANAGERIAL OR SUPERVISORY PURPOSES, NOT OTHERWISE PROVIDED FOR

- G06Q50/00—Information and communication technology [ICT] specially adapted for implementation of business processes of specific business sectors, e.g. utilities or tourism

- G06Q50/10—Services

Landscapes

- Business, Economics & Management (AREA)

- Engineering & Computer Science (AREA)

- Human Resources & Organizations (AREA)

- Tourism & Hospitality (AREA)

- Strategic Management (AREA)

- General Business, Economics & Management (AREA)

- Entrepreneurship & Innovation (AREA)

- Marketing (AREA)

- Theoretical Computer Science (AREA)

- Physics & Mathematics (AREA)

- Economics (AREA)

- General Physics & Mathematics (AREA)

- Health & Medical Sciences (AREA)

- General Health & Medical Sciences (AREA)

- Data Mining & Analysis (AREA)

- Primary Health Care (AREA)

- Operations Research (AREA)

- Quality & Reliability (AREA)

- Measurement Of The Respiration, Hearing Ability, Form, And Blood Characteristics Of Living Organisms (AREA)

- User Interface Of Digital Computer (AREA)

Description

本発明は、反応解析システムおよび反応解析装置に関し、特にオンラインセッションに参加しているユーザの生体反応を解析するシステムおよび装置に関するものである。 The present invention relates to a reaction analysis system and reaction analysis device, and more particularly to a system and device for analyzing biological reactions of users participating in an online session.

従来、複数人が参加するオンライン会議などにおいて、カメラで撮影した参加者の画像を画面に表示させることによって参加者の様子を把握できるようにしたシステムが知られている。また、オンライン会議などにおいて共有資料をメイン画面に表示している際に、参加者の顔画像を小画面に表示させることによって参加者の様子を把握できるようにしたシステムも知られている(例えば、特許文献1参照)。 2. Description of the Related Art Conventionally, there is known a system in which an image of a participant captured by a camera is displayed on a screen in an online conference or the like in which a plurality of participants participate, so that the participant's state can be grasped. In addition, there is also a known system in which, when shared materials are displayed on the main screen in an online conference, etc., the facial images of the participants are displayed on a small screen so that the participant's state can be grasped (for example, , see Patent Document 1).

一方、テレビ電話において、使用者が自分の顔をそのまま相手の画面に表示させることを嫌う傾向があることに鑑みて、会話中の撮影画像から表情の変化を解析し、その解析結果をデフォルトの表情画像に反映させて相手側に送信することが特許文献2に開示されている。特許文献2には、上述の処理を常に行う実施形態の他、通話中にボタン操作を行った場合に上述の処理を行う一方で、ボタン操作を行わない場合はデフォルトの表情画像を相手側に送信する実施形態が開示されている。 On the other hand, in view of the fact that users tend to dislike displaying their own faces on the other party's screen as they are in videophones, we analyzed changes in facial expressions from captured images during conversations, and used the analysis results as the default Japanese Patent Application Laid-Open No. 2002-301000 discloses that the facial expression image is reflected in the facial expression image and transmitted to the other party. In Patent Document 2, in addition to an embodiment in which the above-described processing is always performed, the above-described processing is performed when a button operation is performed during a call, and a default facial expression image is displayed on the other party's side when no button operation is performed. A transmitting embodiment is disclosed.

なお、カメラで撮影した人物の顔画像をもとに、その人物の感情を解析する技術も知られている(例えば、特許文献3,4参照)。特許文献3には、複数人の対象者の顔面から取得した表情の情報から感情の表出度合を解析することが開示されている。また、特許文献4には、テレビ会議システムにおいて、話者の映像に含まれる顔画像から視線位置を検出し、話者の心情を推定して、発言中の話者に提示することが開示されている。 Techniques for analyzing the emotions of a person based on a face image of the person captured by a camera are also known (see Patent Documents 3 and 4, for example). Patent Literature 3 discloses analyzing the degree of expression of emotions from facial expression information obtained from the faces of a plurality of subjects. Further, Patent Document 4 discloses that in a video conference system, the line-of-sight position is detected from the face image included in the video of the speaker, the speaker's emotion is estimated, and the emotion is presented to the speaker who is speaking. ing.

最近のウェブ会議システムは、カメラのオン/オフ機能を有し、参加者の撮影画像を画面に表示させるか否かを切り替えることができるようになっているものが多い。カメラがオフに設定されていると、参加者の撮影画像が画面に表示されないため、カメラをオフに設定した参加者の様子を他の参加者が把握することはできない。これに対し、上記特許文献2に記載の技術を用いれば、撮影画像から解析される表情の変化を反映させて生成した表情画像を相手側に送信することにより、相手側は送信元の話者の表情の変化を把握することが可能である。 Many of the recent web conference systems have a camera on/off function, and can switch whether to display the photographed image of the participant on the screen. When the camera is turned off, the participant's photographed image is not displayed on the screen, so other participants cannot grasp the state of the participant whose camera is turned off. On the other hand, if the technique described in Patent Document 2 is used, by transmitting to the other party a facial expression image generated by reflecting changes in the facial expression analyzed from the captured image, the other party can It is possible to grasp the change in the facial expression of

しかしながら、特許文献2に記載のシステムでは、デフォルトの表情画像(初期設定画像)を相手側に送信するか、これに話者の表情の変化を反映させて生成した表情画像(編集画像)を相手側に送信するかの何れかであり、話者の撮影画像が相手側に送信されることはない。そのため、撮影画像によって相手側の様子を把握することが一切できないという問題があった。 However, in the system described in Patent Document 2, a default facial expression image (initial setting image) is transmitted to the other party, or a facial expression image (edited image) generated by reflecting changes in the speaker's facial expression is sent to the other party. However, the photographed image of the speaker is not transmitted to the other party. Therefore, there is a problem that it is impossible to grasp the state of the other party from the photographed image.

本発明は、このような問題を解決するためになされたものであり、複数人でオンラインセッションが行われる環境において、参加者による撮影画像の表示/非表示の切り替えに応じて、それぞれに適した態様で参加者の様子を把握できるようにすることを目的とする。 The present invention has been made to solve such problems, and in an environment where an online session is held by a plurality of people, according to the switching of the display / non-display of the captured image by the participants, it is suitable for each. An object of the present invention is to make it possible to grasp the state of a participant in a manner.

上記した課題を解決するために、本発明の反応解析システムでは、複数人の参加者でオンラインセッションが行われる環境において、オンラインセッション中に参加者のユーザ端末から得られる動画像をもとに、少なくともオンラインセッション中にユーザ端末の画面に顔画像が表示されていない参加者である非表示参加者について、生体反応を解析し、その解析結果を提示するようにしている。 In order to solve the above problems, in the reaction analysis system of the present invention, in an environment where an online session is held by a plurality of participants, based on the moving images obtained from the user terminals of the participants during the online session, At least for a non-display participant whose face image is not displayed on the screen of the user terminal during the online session, the biological reaction is analyzed and the analysis result is presented.

上記のように構成した本発明によれば、複数人でオンラインセッションが行われる環境において、顔画像が画面に表示されるように設定されている参加者については少なくとも顔画像が提示され、顔画像が画面に表示されないように設定されている参加者については少なくとも生体反応の変化の解析結果が提示されるので、参加者による撮影画像の表示/非表示の切り替えに応じて、それぞれに適した態様で参加者の様子を把握することができる。 According to the present invention configured as described above, in an environment where an online session is held by a plurality of people, at least the face images of the participants whose face images are set to be displayed on the screen are presented, and the face images are displayed. For participants who are set not to display on the screen, at least the analysis results of changes in biological reactions are presented, so depending on the display / non-display of the captured image by the participant, the mode suitable for each It is possible to grasp the state of the participants.

以下、本発明の一実施形態を図面に基づいて説明する。図1は、本実施形態による反応解析システムの全体構成例を示す図である。図1に示すように、本実施形態の反応解析システムは、反応解析装置100、複数のユーザ端末200-1,200-2,・・・(以下、特に区別しないときは単にユーザ端末200と記す)およびセッション管理サーバ300を備えて構成される。これらの反応解析装置100、ユーザ端末200およびセッション管理サーバ300は、インターネットや携帯電話網などの通信ネットワーク500を介して接続される。An embodiment of the present invention will be described below with reference to the drawings. FIG. 1 is a diagram showing an example of the overall configuration of a reaction analysis system according to this embodiment. As shown in FIG. 1, the reaction analysis system of this embodiment includes a

本実施形態の反応解析システムは、複数人の参加者でオンラインセッションが行われる環境において、少なくともオンラインセッション中にユーザ端末200の画面に顔画像が表示されていない参加者(以下、非表示参加者という)について、ユーザ端末200から得られる動画像をもとに生体反応を解析し、その解析結果を提示するシステムである。なお、生体反応の解析を通じて、参加者の感情を解析してもよい。 In an environment where an online session is held by a plurality of participants, the reaction analysis system of the present embodiment can be used for a participant whose face image is not displayed on the screen of the user terminal 200 during the online session (hereinafter referred to as a hidden participant). ), the biological reaction is analyzed based on the moving image obtained from the user terminal 200, and the analysis result is presented. It should be noted that the emotions of the participants may be analyzed through the analysis of biological reactions.

オンラインセッションは、例えばオンライン会議、オンライン授業、オンラインチャットなどであり、複数の場所に設置された複数のユーザ端末200を通信ネットワーク500を介して反応解析装置100およびセッション管理サーバ300に接続し、当該反応解析装置100およびセッション管理サーバ300を通じて複数のユーザ端末200間で動画像をやり取りできるようにしたものである。複数のユーザ端末200には、オンラインセッションで動画像をやり取りするために必要なアプリケーションプログラム(以下、セッションアプリという)がインストールされている。

An online session is, for example, an online conference, an online class, an online chat, or the like. A moving image can be exchanged between a plurality of user terminals 200 through the

オンラインセッションで扱う動画像には、ユーザ端末200を使用するユーザの顔画像(実際には、顔以外の身体の部位や背景の画像も含まれる)や音声が含まれる。ユーザの顔画像と音声は、ユーザ端末200に備えられた、またはユーザ端末200に接続されたカメラおよびマイクにより取得され、セッション管理サーバ300に送信される。そして、セッション管理サーバ300に送信された各ユーザの顔画像と音声は反応解析装置100によって取得され、反応解析装置100から各ユーザ端末200のセッションアプリに送信される。なお、ユーザ端末200から送信された動画像を反応解析装置100にて取得し、これを反応解析装置100からセッション管理サーバ300に転送するようにしてもよい。あるいは、ユーザ端末200から動画像を反応解析装置100およびセッション管理サーバ300の両方に送信するようにしてもよい。

The moving images handled in the online session include the face image of the user using the user terminal 200 (actually, body parts other than the face and background images are also included) and voice. A user's face image and voice are acquired by a camera and a microphone provided in the user terminal 200 or connected to the user terminal 200 and transmitted to the

また、動画像には、複数のユーザが共有して閲覧する資料などの画像も含まれる。ユーザが閲覧する資料画像は、何れかのユーザ端末200からセッション管理サーバ300に送信される。そして、セッション管理サーバ300に送信された資料画像は反応解析装置100によって取得され、反応解析装置100から各ユーザ端末200のセッションアプリに送信される。

Moving images also include images such as materials that are shared and viewed by a plurality of users. A material image viewed by the user is transmitted from any user terminal 200 to the

以上の動作により、複数のユーザ端末200のそれぞれにおいて、複数のユーザの顔画像または資料画像がディスプレイに表示され、複数のユーザの音声がスピーカから出力される。ここで、ユーザ端末200にインストールされているセッションアプリの機能により、ディスプレイの画面上に顔画像と資料画像とを切り替えて何れか一方のみを表示させたり、表示領域を分けて顔画像と資料画像とを同時に表示させたりすることが可能である。また、複数人のユーザのうち1人の画像を全画面表示させたり、一部または全部のユーザの画像を小画面に分割して表示させたりすることが可能である。 By the above operation, in each of the plurality of user terminals 200, the face images or document images of the plurality of users are displayed on the display, and the voices of the plurality of users are output from the speakers. Here, by the function of the session application installed in the user terminal 200, the face image and the document image are switched on the screen of the display to display only one of them, or the face image and the document image are displayed by dividing the display area. can be displayed at the same time. In addition, it is possible to display an image of one of a plurality of users on the full screen, or to display images of some or all of the users by dividing them into small screens.

また、ユーザ端末200にインストールされているセッションアプリの機能により、カメラのオン/オフを切り替えたり、マイクのオン/オフを切り替えたりすることも可能である。例えば、ユーザ端末200-1においてカメラをオフにした場合、ユーザ端末200-1のカメラにより撮影された顔画像はセッション管理サーバ300および反応解析装置100に送信されるが、反応解析装置100から各ユーザ端末200に送信されない。同様に、ユーザ端末200-1においてマイクをオフにした場合、ユーザ端末200-1のマイクにより集音された音声はセッション管理サーバ300および反応解析装置100に送信されるが、反応解析装置100から各ユーザ端末200に送信されない。It is also possible to switch on/off the camera and switch on/off the microphone by using the function of the session application installed in the user terminal 200 . For example, when the camera of the user terminal 200-1 is turned off, the face image captured by the camera of the user terminal 200-1 is transmitted to the

本実施形態において、複数のユーザ端末200-1,200-2,・・・は、オンラインセッションの主催者(主導者、進行者または管理者を含む)が使用する端末と、オンラインセッションに参加する参加者が使用する端末とを含む。オンラインセッションの主催者は、例えばオンライン授業の講師、オンライン会議の議長やファシリテータ、コーチングを目的としたセッションのコーチなどである。オンラインセッションの主催者は、オンラインセッションに参加する複数の参加者の中の一人であってもよいし、オンラインセッションに参加しない別人であってもよい。なお、以下の説明において、主催者と参加者とを特に区別しないときは「ユーザ」と記す。In this embodiment, a plurality of user terminals 200 -1 , 200 -2 , . terminals used by participants. Hosts of online sessions are, for example, instructors of online classes, chairpersons and facilitators of online meetings, coaches of sessions for coaching purposes, and the like. The online session host may be one of the participants participating in the online session or another person not participating in the online session. In the following description, the organizer and participants are referred to as "users" when not distinguished from each other.

本実施形態において、反応解析装置100は、複数のユーザ端末200から送信された動画像を取得し、この動画像に基づいてオンラインセッションの参加者の生体反応を解析する。オンラインセッションの主催者が参加者にもなる場合、主催者の生体反応を解析することは必須ではない。

In this embodiment, the

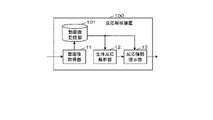

図2は、本実施形態による反応解析装置100の機能構成例を示すブロック図である。図2に示すように、本実施形態の反応解析装置100は、機能構成として、動画像取得部11、生体反応解析部12および反応情報提示部13を備えている。また、本実施形態の反応解析装置100は、記憶媒体として、動画像記憶部101を備えている。

FIG. 2 is a block diagram showing a functional configuration example of the

上記各機能ブロック10~13は、ハードウェア、DSP(Digital Signal Processor)、ソフトウェアの何れによっても構成することが可能である。例えばソフトウェアによって構成する場合、上記各機能ブロック10~13は、実際にはコンピュータのCPU、RAM、ROMなどを備えて構成され、RAMやROM、ハードディスクまたは半導体メモリ等の記録媒体に記憶されたプログラムが動作することによって実現される。 Each of the functional blocks 10 to 13 can be configured by hardware, DSP (Digital Signal Processor), or software. For example, when configured by software, each of the functional blocks 10 to 13 is actually configured with a CPU, RAM, ROM, etc. of a computer, and a program stored in a recording medium such as RAM, ROM, hard disk, or semiconductor memory. is realized by the operation of

動画像取得部11は、オンラインセッション中に各ユーザ端末200から送信される動画像(顔画像、音声、資料画像)をセッション管理サーバ300から取得する。動画像取得部11は、各ユーザ端末200からセッション管理サーバ300を介して取得した動画像を、各ユーザを識別可能な情報(例えば、ユーザID)に関連付けて動画像記憶部101に記憶させる。

The moving

セッション管理サーバ300から取得する顔画像は、各ユーザ端末200の画面上に表示されるように設定されているものか否か(カメラがオンに設定されているかオフに設定されているか)は問わない。すなわち、動画像取得部11は、各ユーザ端末200のディスプレイに表示中の顔画像および非表示中の顔画像を含めて、顔画像をセッション管理サーバ300から取得する。また、セッション管理サーバ300から取得する音声は、各ユーザ端末200のスピーカから出力されるように設定されているものか否か(マイクがオンに設定されているかオフに設定されているか)は問わない。すなわち、動画像取得部11は、各ユーザ端末200のスピーカから出力中の音声および非出力中の音声を含めて、音声をセッション管理サーバ300から取得する。

It does not matter whether the face image acquired from the

生体反応解析部12は、動画像取得部11により取得され動画像記憶部101に記憶された動画像に基づいて、オンラインセッション中にユーザ端末200の画面に顔画像が表示されていない非表示参加者(例えば、カメラをオフに設定している参加者)について、感情の変化に起因して起こる生体反応の変化を解析する。本実施形態において生体反応解析部12は、動画像取得部11により取得された動画像を顔画像のセット(フレーム画像の集まり)と音声とに分離し、それぞれから生体反応の変化を解析する。

Based on the moving image acquired by the moving

例えば、生体反応解析部12は、動画像取得部11により取得された動画像から分離したフレーム画像を用いてユーザの顔画像を解析することにより、表情、目線、脈拍、顔の動きの少なくとも1つに関する生体反応の変化を解析する。また、生体反応解析部12は、動画像取得部11により取得された動画像から分離した音声を解析することにより、ユーザの発言内容、声質の少なくとも1つに関する生体反応の変化を解析する。

For example, the biological

人は感情が変化すると、それが表情、目線、脈拍、顔の動き、発言内容、声質などの生体反応の変化となって現れる。本実施形態では、ユーザの感情の変化に起因して起こる生体反応の変化を解析する。また、生体反応の変化を解析することを通じて、ユーザの感情の変化を解析するようにしてもよい。 When people's emotions change, it appears as changes in biological reactions such as facial expressions, eyes, pulse, facial movements, content of remarks, and voice quality. In this embodiment, changes in biological reactions caused by changes in user's emotions are analyzed. Also, the change in the user's emotion may be analyzed through the analysis of the change in biological reaction.

表情の変化の解析は、例えば以下のようにして行う。すなわち、生体反応解析部12は、フレーム画像ごとに、フレーム画像の中から顔の領域を特定し、事前に機械学習させた画像解析モデルに従って、顔の表情がどの表情要素に該当するかを解析する。そして、その解析結果に基づいて、連続するフレーム画像間で表情変化が起きているか否か、表情変化が起きている場合はそれがポジティブな表情変化かネガティブな表情変化か、およびどの程度の大きさの表情変化が起きているかを解析する。

Analysis of changes in facial expressions is performed, for example, as follows. That is, for each frame image, the biological

顔の表情要素は、例えば、中立(neutral)/落ち着き(calm)/喜び(happy)/驚き(surprised)/悲しみ(sad)/怒り(angry)/恐れ(fearful)/嫌悪感(disgust)などである。このうち、喜びおよび驚きはポジティブな表情要素であり、悲しみ、怒り、恐れ、嫌悪感はネガティブな表情要素である。 Facial expression elements include, for example, neutral/calm/happy/surprised/sad/angry/fearful/disgust. be. Of these, joy and surprise are positive facial expression elements, and sadness, anger, fear, and disgust are negative facial expression elements.

生体反応解析部12は、各フレーム画像における顔の表情について、複数の表情要素ごとに合計100となるスコアを算出する。例えば、中立=10、落ち着き=10、喜び=30、驚き=20、悲しみ=10、怒り=10、恐れ=5、嫌悪感=5といったように、各表情要素に該当する可能性の高さに応じたスコアを表情要素ごとに算出する。そして、例えばスコアが最大の表情要素を、そのフレーム画像における顔の表情として決定する。以下では、フレーム画像ごとに決定される顔の表情のスコア(複数の表情要素について算出されたスコアのうち最大のスコア)を「表情スコア」という。

The biological

生体反応解析部12は、このようにしてフレーム画像ごとに決定される表情要素およびフレーム画像ごとに算出される表情スコアの少なくとも一方が前フレームから変化したか否かによって、連続するフレーム画像間で表情変化が起きているか否かを判定する。ここで、生体反応解析部12は、最大スコアの表情要素に変化がない場合に、前フレームからのスコア変化量が所定の閾値以上の場合に表情変化が起きていると判定するようにしてもよい。表情変化の大きさは、表情スコアの前フレームからの変化量によって判定することが可能である。

The biological

また、生体反応解析部12は、ポジティブな表情の表情スコアが前フレームから増加した場合、および、前フレームのネガティブな表情から現フレームのポジティブな表情に変化した場合に、ポジティブな表情変化が起きていると判定する。一方、生体反応解析部12は、ネガティブな表情の表情スコアが前フレームから増加した場合、および、前フレームのポジティブな表情から現フレームのネガティブな表情に変化した場合に、ネガティブな表情変化が起きていると判定する。

In addition, the biological

ここでは、連続するフレーム画像間での表情変化を解析する例について説明したが、所定の時間区間ごと(例えば、500ミリ秒ごと)に表情変化を解析するようにしてもよい。これは、以下に述べる目線の変化の解析、脈拍の変化の解析、顔の動きの変化の解析についても同様である。 Here, an example of analyzing facial expression changes between consecutive frame images has been described, but facial expression changes may be analyzed for each predetermined time interval (for example, every 500 milliseconds). This also applies to the analysis of changes in line of sight, the analysis of changes in pulse, and the analysis of changes in facial movements, which will be described below.

目線の変化の解析は、例えば以下のようにして行う。すなわち、生体反応解析部12は、フレーム画像ごとに、フレーム画像の中から目の領域を特定し、両目の向き(目線)を解析する。例えば、表示中の話者の顔を見ているか、表示中の共有資料を見ているか、表示中の共有資料のどこを見ているか、画面の外を見ているかなどを解析する。また、目線の動きが大きいか小さいか、動きの頻度が多いか少ないかなどを解析するようにしてもよい。目線の変化はユーザの集中度にも関連する。

The analysis of changes in line of sight is performed, for example, as follows. That is, for each frame image, the biological

脈拍の変化の解析は、例えば以下のようにして行う。すなわち、フレーム画像ごとに、フレーム画像の中から顔の領域を特定する。そして、顔の色情報(RGBのG)の数値を捉える学習済みの画像解析モデルを用いて、顔表面のG色の変化を解析する。その結果を時間軸に合わせて並べることによって色情報の変化を表した波形を形成し、この波形から脈拍を特定する。人は緊張すると脈拍が速くなり、気持ちが落ち着くと脈拍が遅くなる。 Analysis of changes in pulse rate is performed, for example, as follows. That is, for each frame image, the face area is specified in the frame image. Then, using a trained image analysis model that captures numerical values of face color information (G of RGB), changes in the G color of the face surface are analyzed. By arranging the results along the time axis, a waveform representing changes in color information is formed, and the pulse is identified from this waveform. When a person is tense, the pulse speeds up, and when the person is calm, the pulse slows down.

顔の動きの変化の解析は、例えば以下のようにして行う。すなわち、生体反応解析部12は、フレーム画像ごとに、フレーム画像の中から顔の領域を特定し、顔の向きを解析することにより、ユーザがどこを見ているかを解析する。例えば、表示中の話者の顔を見ているか、表示中の共有資料を見ているか、表示中の共有資料のどこを見ているか、画面の外を見ているかなどを解析する。また、顔の動きが大きいか小さいか、動きの頻度が多いか少ないかなどを解析するようにしてもよい。顔の動きと目線の動きとを合わせて解析するようにしてもよい。例えば、表示中の話者の顔をまっすぐ見ているか、上目遣いまたは下目使いに見ているか、斜めから見ているかなどを解析するようにしてもよい。

Analysis of changes in facial movement is performed, for example, as follows. That is, the biological

発言内容の解析は、例えば以下のようにして行う。すなわち、生体反応解析部12は、指定した時間(例えば、30~150秒程度の時間)の音声について公知の音声認識処理を行うことによって音声を文字列に変換し、当該文字列を形態素解析することにより、助詞、冠詞などの会話を表す上で不要なワードを取り除く。そして、残ったワードをTF-IDF(Term Frequency - Inverse Document Frequency)法などによりベクトル化し、ベクトルの特徴に基づいて、ポジティブな感情変化が起きているか、ネガティブな感情変化が起きているか、およびどの程度の大きさの感情変化が起きているかを解析する。例えば、発言内容に応じて算出されるベクトルの特徴に基づいて、ベクトルの特徴量と発言内容の種類とを関連付ける情報を格納したデータベース等を利用して、どのような種類の発言内容であるかを推定する。

Analysis of the content of the statement is performed, for example, as follows. That is, the biological

別の例として、以下のようにしてもよい。すなわち、生体反応解析部12は、指定した時間内の発言内容から抽出したワードを辞書(各ワードがポジティブかネガティブかが定義されたもの)と突き合わせ、ポジティブなワードの出現回数とネガティブなワードの出現回数とをカウントすることにより、ポジティブな感情変化が起きているか、ネガティブな感情変化が起きているか、およびどの程度の大きさの感情変化が起きているかを解析する。

As another example, the following may be done. That is, the biological

声質の解析は、例えば以下のようにして行う。すなわち、生体反応解析部12は、指定した時間(例えば、30~150秒程度の時間)の音声について公知の音声解析処理を行うことによって音声の音響的特徴(例えば、MFCC(メル周波数ケプストラム係数))を特定する。そして、その音響的特徴を表す値に基づいて、ポジティブな声質変化が起きているか、ネガティブな声質変化が起きているか、およびどの程度の大きさの声質変化が起きているかを解析する。例えば、顔の表情の解析と同様に、事前に機械学習させた音声解析モデルに従って、音声が中立/落ち着き/喜び/驚き/悲しみ/怒り/恐れ/嫌悪感のどの感情要素に該当するかを解析する。そして、その解析結果に基づいて、所定の時間区間ごとに感情変化が起きているか否か、感情変化が起きている場合はそれがポジティブな感情変化かネガティブな感情変化か、およびどの程度の大きさの感情変化が起きているかを解析する。なお、音声の音響的特徴としてMFCCは一例であり、これに限定されるものではない。

Analysis of voice quality is performed, for example, as follows. That is, the biological

また、本実施形態では、生体反応解析部12は、動画像取得部11により取得された動画像にける音声に基づいて、画面に表示されていない非表示参加者が、オンラインセッション中において画面に表示されている共有資料のどの部分が表示されているときに声を出したかを解析する。例えば、生体反応解析部12は、複数のページを有する共有資料のうち、どのページが表示されているときに非表示参加者が声を出したかを解析する。

In addition, in the present embodiment, the biological

反応情報提示部13は、ユーザ端末200の画面に表示されていない非表示参加者について生体反応解析部12により解析された生体反応の変化を示す情報を提示する。例えば、反応情報提示部13は、生体反応の変化を示す情報をオンラインセッションの主催者に提示する。これにより、主催者が使用するユーザ端末200の画面には、非表示参加者に関して解析された生体反応の変化を示す情報が表示される。

The reaction

なお、反応情報提示部13は、生体反応の変化を示す情報に代えてまたは加えて、感情の変化を示す情報を提示するようにしてもよい。例えば、生体反応解析部12により解析される感情要素(中立、落ち着き、喜び、驚き、悲しみ、怒り、恐れ、嫌悪感の何れか)を提示するようにしてもよい。あるいは、喜びおよび驚きの2つを「快」の感情と定義する一方、悲しみ、怒り、恐れおよび嫌悪感の4つを「不快」の感情と定義し、生体反応解析部12により解析される感情要素に基づいて、「快」または「不快」の何れかの感情を示す情報を提示するようにしてもよい。

Note that the reaction

例えば、反応情報提示部13は、非表示参加者の識別情報(氏名、ニックネームまたはID等)が一覧表示されたダッシュボード画面を主催者のユーザ端末200に表示させ、その中から主催者が何れかの非表示参加者を指定したときに、当該指定された非表示参加者に関する生体反応の変化を示す情報または感情の変化を示す情報を表示させるようにすることが可能である。図3は、このようにしてユーザ端末200に表示される感情の変化を示す情報の一例を示す図である。

For example, the reaction

図3(a)は、顔の表情または声質をもとに解析される複数の感情要素ごとのスコアを、フレーム画像間隔または所定の時間間隔(例えば、500ミリ秒間隔)で時系列に表した折れ線グラフである。図3(b)は、複数の感情要素ごとに、図3(a)のように時系列で得られる複数のスコアの平均値(オンラインセッションを通しての平均スコア)を示したものである。 FIG. 3(a) shows scores for each of multiple emotional elements analyzed based on facial expression or voice quality in chronological order at frame image intervals or predetermined time intervals (e.g., 500 millisecond intervals). It is a line graph. FIG. 3(b) shows an average value of multiple scores obtained in time series as shown in FIG. 3(a) (average score over online sessions) for each of multiple emotional elements.

ここでは、生体反応の変化を示す情報または感情の変化を示す情報の一例として、各感情要素のスコアを表示する例を示したが、本発明はこれに限定されない。例えば、目線の変化または顔の動きをもとにオンラインセッションに対する集中度を表すスコアを算出し、そのスコアを折れ線グラフで時系列に表示したり、オンラインセッションを通しての平均スコアを表示したりするようにしてもよい。また、脈拍の変化をもとに、感情要素のうち落ち着き(calm)の程度を表すスコアを算出し、そのスコアを折れ線グラフで時系列に表示したり、オンラインセッションを通しての平均スコアを表示したりするようにしてもよい。あるいは、顔の表情、発言内容または音質をもとにポジティブ度またはネガティブ度を表すスコアを算出し、そのスコアを折れ線グラフで時系列に表示したり、オンラインセッションを通しての平均スコアを表示したりするようにしてもよい。 Here, as an example of information indicating a change in biological reaction or information indicating a change in emotion, an example of displaying the score of each emotional element is shown, but the present invention is not limited to this. For example, a score that represents the degree of concentration for an online session is calculated based on changes in gaze or facial movement, and the score is displayed in chronological order in a line graph, or an average score is displayed throughout the online session. can be In addition, based on changes in the pulse, a score that expresses the degree of calmness (calm) among emotional factors is calculated, and the score is displayed in chronological order in a line graph, and the average score throughout the online session is displayed. You may make it Alternatively, calculate a score representing the degree of positivity or negativity based on facial expressions, speech content, or sound quality, and display the score in chronological order in a line graph, or display the average score throughout the online session. You may do so.

また、反応情報提示部13は、顔画像が画面に表示されるように設定されている参加者(例えば、カメラをオンに設定している参加者。以下、表示参加者という)については顔画像を主催者のユーザ端末200に提示する一方で、顔画像が画面に表示されないように設定されている非表示参加者については生体反応の変化を示す情報を主催者のユーザ端末200に提示するようにしてもよい。主催者のユーザ端末200では、例えば、参加者の人数分の小画面に分割し、表示参加者用の小画面には顔画像を表示させ、非表示参加者用の小画面には生体反応の変化を示す情報を表示させるようにすることが可能である。なお、人数分の小画面は、ディスプレイに全てが一度に表示されるようにしてもよいし、ディスプレイに一部の参加者の小画面のみを表示してスクロールできるようにしてもよい。あるいは、生体反応の変化を示す情報または感情の変化を示す情報を表示させる対象の表示参加者および/または非表示参加者を主催者が指定できるようにしてもよい。

In addition, the reaction

以上詳しく説明したように、本実施形態によれば、オンラインセッションの主催者が使用するユーザ端末200の画面において、表示参加者については顔画像が表示され、非表示参加者については生体反応の変化または感情の変化の解析結果が表示される。このため、主催者は、複数人の参加者でオンラインセッションが行われる環境において、顔画像が画面に表示されている表示参加者についてはその顔画像によって様子を把握することができる一方で、顔画像が画面に表示されていない非表示参加者については、生体反応の変化または感情の変化を示す情報によって様子を把握することができる。これにより、主催者は、参加者による顔画像の表示/非表示の切り替えに応じて、それぞれに適した態様で参加者の様子を把握することが可能である。 As described in detail above, according to the present embodiment, on the screen of the user terminal 200 used by the organizer of the online session, the face images of the displayed participants are displayed, and the biological reactions of the non-displayed participants change. Or the analysis result of the change of emotion is displayed. For this reason, in an environment where an online session is held with a plurality of participants, the organizer can grasp the state of the display participant whose face image is displayed on the screen from the face image, As for the non-display participants whose images are not displayed on the screen, it is possible to comprehend the situation from information indicating changes in biological reactions or changes in emotions. This allows the organizer to grasp the state of the participants in a manner suitable for each of the participants, according to the display/non-display switching of the face images of the participants.

以上説明した生体反応解析部12および反応情報提示部13の処理は、動画像取得部11が複数の参加者の動画像を取得したときにリアルタイムに行うようにしてもよいし、動画像記憶部101に記憶された動画像を用いて事後的に行うようにしてもよい。

The processing of the biological

上記実施形態において、顔画像が画面に表示されないように設定されている参加者は、ユーザ端末200のカメラをオフに設定している参加者であると説明したが、これに限定されない。例えば、画面に共有資料のみが表示されているときは、カメラをオンに設定している参加者であっても、共有資料の表示中は顔画像が画面に表示されないように設定されている非表示参加者となる。 In the above embodiment, the participant whose face image is set not to be displayed on the screen is the participant whose camera of the user terminal 200 is set to OFF, but the present invention is not limited to this. For example, when only the shared document is displayed on the screen, even if the participant has the camera turned on, the face image is set not to be displayed on the screen while the shared document is being displayed. Become a display participant.

また、上記実施形態では、非表示参加者についてのみ生体反応の変化を解析する例について説明したが、本発明はこれに限定されない。例えば、生体反応解析部12は、動画像取得部11により取得された動画像に基づいて、オンラインセッション中にユーザ端末200の画面に顔画像が表示されている表示参加者についても、生体反応の変化を解析するようにしてもよい。

Further, in the above-described embodiment, an example in which changes in biological reactions are analyzed only for non-display participants has been described, but the present invention is not limited to this. For example, based on the moving image acquired by the moving

この場合、反応情報提示部13は、生体反応解析部2により非表示参加者および表示参加者について解析された生体反応の変化(または感情の変化)を示す情報を提示するようにしてもよい。表示参加者については、画面に表示される顔画像によって様子を把握することが可能であるが、これに加えて生体反応の変化(または感情の変化)を示す情報を提示することにより、主催者は、画像と解析結果の両面から表示参加者の様子を把握することが可能である。

In this case, the reaction

生体反応解析部12がオンラインセッションの参加者の全員(表示参加者および非表示参加者)について生体反応の変化を解析する場合において、表示参加者について解析された生体反応の変化(または感情の変化)を示す情報を主催者に提示するか否かを、主催者または表示参加者がユーザ端末200から指定できるようにしてもよい。同様に、非表示参加者について解析された生体反応の変化(または感情の変化)を示す情報を主催者に提示するか否かを、主催者または非表示参加者がユーザ端末200から指定できるようにしてもよい。

When the biological

また、上記実施形態において、反応情報提示部13は、目線の動きおよび顔の動きの少なくとも一方に関する生体反応の変化に基づいて参加者(非表示参加者のみ、または表示参加者を含む参加者の全員の何れでもよい。以下、同様)が表示中の共有資料のどこを見ていたかという解析結果をもとに、画面上の共有資料の上にヒートマップを投影して表示させるようにしてもよい。ここでいうヒートマップは、例えば、複数の参加者が多く見ている場所ほど色が濃くなるようなマップである。

Further, in the above embodiment, the reaction

あるいは、反応情報提示部13は、共有資料のどの部分(ページ)が表示されているときに参加者が声を出したかという音声に関する解析結果をもとに、画面上の共有資料の上にヒートマップを投影して表示させるようにしてもよい。ここでいうヒートマップは、例えば、複数のページを有する共有資料のうち、複数の参加者が多く声を出したときに表示されていたページほど色が濃くなるようなマップである。

Alternatively, the reaction

更に別の例として、反応情報提示部13は、参加者が表示中の共有資料のどこを見ていたかという目線および顔の動きの少なくとも一方に関する第1の解析結果と、共有資料のどの部分が表示されているときに参加者が声を出したかという音声に関する第2の解析結果とをもとに、ヒートマップを投影して表示させるようにしてもよい。ここでいうヒートマップは、例えば、第1の解析結果を反映させたページ内の特定エリアの色と、第2の解析結果を反映させたページ全体の色とが重なったマップである。

As yet another example, the reaction

なお、上記実施形態は、何れも本発明を実施するにあたっての具体化の一例を示したものに過ぎず、これによって本発明の技術的範囲が限定的に解釈されてはならないものである。すなわち、本発明はその要旨、またはその主要な特徴から逸脱することなく、様々な形で実施することができる。 It should be noted that each of the above-described embodiments merely shows an example of implementation of the present invention, and the technical scope of the present invention should not be construed to be limited. Thus, the invention may be embodied in various forms without departing from its spirit or essential characteristics.

11 動画像取得部

12 生体反応解析部

13 反応情報提示部11 moving

Claims (10)

上記オンラインセッション中に上記参加者のユーザ端末から送信される動画像を取得する動画像取得部と、

上記動画像取得部により取得された動画像に基づいて、少なくとも上記オンラインセッション中に上記ユーザ端末の画面に顔画像が表示されていない参加者である非表示参加者について、生体反応の変化を解析する生体反応解析部と、

上記生体反応解析部により少なくとも上記非表示参加者について解析された上記生体反応の変化を示す情報を提示する反応情報提示部とを備え、

上記生体反応解析部は、上記動画像取得部により取得された動画像における音声に基づいて、上記オンラインセッション中に上記画面に表示されている共有資料のどの部分が表示されているときに参加者が声を出したかを解析し、

上記反応情報提示部は、上記オンラインセッション中に上記共有資料のどの部分が表示されているときに参加者が声を出したかという解析結果をもとに、ヒートマップを上記共有資料に投影して表示させる

ことを特徴とする反応解析システム。 A reaction analysis system that analyzes the biological reactions of the participants in an environment where an online session is held by a plurality of participants,

a moving image acquisition unit that acquires a moving image transmitted from the user terminal of the participant during the online session;

Based on the moving image acquired by the moving image acquiring unit, analyze changes in biological reactions of non-display participants who are participants whose face images are not displayed on the screen of the user terminal at least during the online session. a biological reaction analysis unit to

a reaction information presentation unit that presents information indicating changes in the biological reaction analyzed at least for the non-display participant by the biological reaction analysis unit;

Based on the audio in the video image acquired by the video image acquisition unit, the biological reaction analysis unit determines which part of the shared material displayed on the screen during the online session is being displayed. Analyze whether the participant spoke,

The reaction information presentation unit projects a heat map onto the shared material based on the analysis result of which part of the shared material is being displayed during the online session and the participant speaks out. A reaction analysis system characterized by displaying.

上記反応情報提示部は、上記生体反応解析部により上記非表示参加者および上記表示参加者について解析された上記生体反応の変化を示す情報を提示する

ことを特徴とする請求項1に記載の反応解析システム。 Based on the video image acquired by the video image acquisition unit, the biological reaction analysis unit also performs display participants whose face images are displayed on the screen of the user terminal during the online session. Analyzing changes in the above biological reactions,

2. The reaction according to claim 1, wherein the reaction information presenting unit presents information indicating changes in the biological reaction analyzed for the non-display participant and the displayed participant by the biological reaction analysis unit. analysis system.

上記反応情報提示部は、上記参加者が上記画面に表示されている共有資料のどこを見ているかという解析結果をもとに、ヒートマップを上記共有資料に投影して表示させる

ことを特徴とする請求項1または2に記載の反応解析システム。 The biological reaction analysis unit analyzes a change in biological reaction related to at least one of eye movement and facial movement based on the facial image in the moving image acquired by the moving image acquisition unit, thereby Analyze where you are looking at the shared document displayed on the above screen,

The reaction information presentation unit is characterized by projecting and displaying a heat map on the shared material based on an analysis result of where the participants are looking in the shared material displayed on the screen. The reaction analysis system according to claim 1 or 2.

上記反応情報提示部は、上記生体反応の変化を示す情報に代えてまたは加えて、上記感情の変化を示す情報を提示する

ことを特徴とする請求項1~5の何れか1項に記載の反応解析システム。 The biological reaction analysis unit analyzes changes in the participant's emotions through analysis of changes in the biological reaction,

6. The reaction information presenting unit according to any one of claims 1 to 5, wherein the reaction information presenting unit presents the information indicating the change in emotion instead of or in addition to the information indicating the change in biological reaction. Reaction analysis system.

上記生体反応解析部により少なくとも上記非表示参加者について解析された上記生体反応の変化を示す情報を提示する反応情報提示部とを備え、

上記生体反応解析部は、上記動画像における音声に基づいて、上記オンラインセッション中に上記画面に表示されている共有資料のどの部分が表示されているときに参加者が声を出したかを解析し、

上記反応情報提示部は、上記オンラインセッション中に上記画面に表示されている共有資料のどの部分が表示されているときに参加者が声を出したかという解析結果をもとに、ヒートマップを上記共有資料に投影して表示させる

ことを特徴とする反応解析装置。 A non-display participant who is a participant whose face image is not displayed on the screen of the user terminal at least during the online session based on the moving image obtained for the participant during the online session conducted by a plurality of participants About, a biological reaction analysis unit that analyzes changes in biological reactions,

a reaction information presentation unit that presents information indicating changes in the biological reaction analyzed at least for the non-display participant by the biological reaction analysis unit;

The biological reaction analysis unit determines which part of the shared material displayed on the screen during the online session was displayed and when the participant spoke, based on the voice in the moving image. parse and

The reaction information presentation unit creates a heat map based on the analysis result of which part of the shared material displayed on the screen during the online session is displayed and when the participant speaks out. A reaction analysis device characterized by projecting and displaying on shared materials.

上記反応情報提示部は、上記生体反応解析部により上記非表示参加者および上記表示参加者について解析された上記生体反応の変化を示す情報を提示する

ことを特徴とする請求項7に記載の反応解析装置。 Based on the moving image, the biological reaction analysis unit also analyzes the change in the biological reaction of the display participant whose face image is displayed on the screen of the user terminal during the online session. ,

8. The reaction according to claim 7, wherein the reaction information presentation unit presents information indicating changes in the biological reaction analyzed for the non-display participant and the display participant by the biological reaction analysis unit. analysis equipment.

上記反応情報提示部は、上記参加者が上記画面に表示されている共有資料のどこを見ているかという解析結果をもとに、ヒートマップを上記共有資料に投影して表示させる

ことを特徴とする請求項7または8に記載の反応解析装置。 The biological reaction analysis unit analyzes changes in biological reactions related to at least one of eye movement and facial movement based on the face image in the moving image, thereby enabling the participant to share the image displayed on the screen. Analyze where you are looking at the material,

The reaction information presentation unit is characterized by projecting and displaying a heat map on the shared material based on an analysis result of where the participants are looking in the shared material displayed on the screen. The reaction analysis device according to claim 7 or 8.

上記反応情報提示部は、上記生体反応の変化を示す情報に代えてまたは加えて、上記感情の変化を示す情報を提示する

ことを特徴とする請求項7~9の何れか1項に記載の反応解析装置。 The biological reaction analysis unit analyzes changes in the participant's emotions through analysis of changes in the biological reaction,

10. The reaction information presenting unit according to any one of claims 7 to 9 , wherein the information indicating the change in emotion is presented instead of or in addition to the information indicating the change in biological reaction. Reaction analyzer.

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JPPCT/JP2020/029466 | 2020-07-31 | ||

| PCT/JP2020/029466 WO2022024353A1 (en) | 2020-07-31 | 2020-07-31 | Reaction analysis system |

| PCT/JP2021/027637 WO2022025024A1 (en) | 2020-07-31 | 2021-07-27 | Reaction analysis system and reaction analysis device |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JPWO2022025024A1 JPWO2022025024A1 (en) | 2022-02-03 |

| JPWO2022025024A5 JPWO2022025024A5 (en) | 2022-09-07 |

| JP7197957B2 true JP7197957B2 (en) | 2022-12-28 |

Family

ID=80035326

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2022539466A Active JP7197957B2 (en) | 2020-07-31 | 2021-07-27 | Reaction analysis system and reaction analysis device |

Country Status (2)

| Country | Link |

|---|---|

| JP (1) | JP7197957B2 (en) |

| WO (2) | WO2022024353A1 (en) |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP7333570B1 (en) | 2022-12-21 | 2023-08-25 | 株式会社Shift | program, method, information processing device, system |

Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2005269207A (en) | 2004-03-18 | 2005-09-29 | Nippon Telegr & Teleph Corp <Ntt> | Information delivery method and communication apparatus for realizing this method, and program therefor |

| JP2007213364A (en) | 2006-02-10 | 2007-08-23 | Nec Corp | Image converter, image conversion method, and image conversion program |

| JP2008294724A (en) | 2007-05-24 | 2008-12-04 | Panasonic Corp | Image receiver |

| JP2011065467A (en) | 2009-09-17 | 2011-03-31 | Sharp Corp | Conference relay device and computer program |

| US20200169693A1 (en) | 2016-02-03 | 2020-05-28 | Hewlett-Packard Development Company, L.P. | Eye gaze angle feedback in a remote meeting |

Family Cites Families (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US10586131B2 (en) * | 2017-07-11 | 2020-03-10 | International Business Machines Corporation | Multimedia conferencing system for determining participant engagement |

-

2020

- 2020-07-31 WO PCT/JP2020/029466 patent/WO2022024353A1/en active Application Filing

-

2021

- 2021-07-27 JP JP2022539466A patent/JP7197957B2/en active Active

- 2021-07-27 WO PCT/JP2021/027637 patent/WO2022025024A1/en active Application Filing

Patent Citations (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2005269207A (en) | 2004-03-18 | 2005-09-29 | Nippon Telegr & Teleph Corp <Ntt> | Information delivery method and communication apparatus for realizing this method, and program therefor |

| JP2007213364A (en) | 2006-02-10 | 2007-08-23 | Nec Corp | Image converter, image conversion method, and image conversion program |

| JP2008294724A (en) | 2007-05-24 | 2008-12-04 | Panasonic Corp | Image receiver |

| JP2011065467A (en) | 2009-09-17 | 2011-03-31 | Sharp Corp | Conference relay device and computer program |

| US20200169693A1 (en) | 2016-02-03 | 2020-05-28 | Hewlett-Packard Development Company, L.P. | Eye gaze angle feedback in a remote meeting |

Also Published As

| Publication number | Publication date |

|---|---|

| WO2022024353A1 (en) | 2022-02-03 |

| WO2022025024A1 (en) | 2022-02-03 |

| JPWO2022025024A1 (en) | 2022-02-03 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| WO2020148920A1 (en) | Information processing device, information processing method, and information processing program | |

| JP7242114B2 (en) | Reaction analysis system and reaction analysis device | |

| JP2013101680A (en) | Method and system for electronically evaluating dialogue | |

| CN114566187A (en) | System, electronic device, and related method with post-session representation | |

| JP7197957B2 (en) | Reaction analysis system and reaction analysis device | |

| WO2022025025A1 (en) | Emotion analysis system and emotion analysis device | |

| JP7165463B2 (en) | Emotion analysis system and emotion analysis device | |

| WO2022024356A1 (en) | Organization attribute analysis system | |

| JP7465040B1 (en) | Communication visualization system | |

| WO2022064622A1 (en) | Emotion analysis system | |

| WO2022201272A1 (en) | Video analysis program | |

| WO2022230136A1 (en) | Video analysis system | |

| JP7197955B1 (en) | Video meeting evaluation terminal | |

| WO2022269802A1 (en) | Video analysis system | |

| JP7121433B1 (en) | Video analysis program | |

| WO2022254497A1 (en) | Video analysis system | |

| WO2022230051A1 (en) | Video analysis system | |

| JP2023055761A (en) | Organization attribute analysis system and organization attribute analysis device | |

| WO2022201267A1 (en) | Video analysis program | |

| JP7138997B1 (en) | Video meeting evaluation terminal | |

| WO2022201268A1 (en) | Video analysis programme | |

| JP7152817B1 (en) | Video analysis program | |

| WO2022201270A1 (en) | Video analysis program | |

| JP7121439B1 (en) | Video image analysis system | |

| JP7138990B1 (en) | Video image analysis system |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20220818 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20220818 |

|

| A871 | Explanation of circumstances concerning accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A871 Effective date: 20220818 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20220929 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20221110 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20221124 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20221209 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7197957 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |