JP7177242B2 - イントラ予測のための方法及び機器 - Google Patents

イントラ予測のための方法及び機器 Download PDFInfo

- Publication number

- JP7177242B2 JP7177242B2 JP2021504520A JP2021504520A JP7177242B2 JP 7177242 B2 JP7177242 B2 JP 7177242B2 JP 2021504520 A JP2021504520 A JP 2021504520A JP 2021504520 A JP2021504520 A JP 2021504520A JP 7177242 B2 JP7177242 B2 JP 7177242B2

- Authority

- JP

- Japan

- Prior art keywords

- intra

- prediction

- block

- mode

- video

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000000034 method Methods 0.000 title claims description 125

- 238000012545 processing Methods 0.000 claims description 65

- 239000013074 reference sample Substances 0.000 claims description 62

- 238000001914 filtration Methods 0.000 claims description 36

- 238000004590 computer program Methods 0.000 claims description 13

- 230000001419 dependent effect Effects 0.000 claims description 5

- 230000008569 process Effects 0.000 description 34

- 238000004891 communication Methods 0.000 description 23

- 230000006854 communication Effects 0.000 description 23

- 239000000523 sample Substances 0.000 description 21

- 238000010586 diagram Methods 0.000 description 17

- 230000033001 locomotion Effects 0.000 description 17

- 238000013139 quantization Methods 0.000 description 14

- 230000006835 compression Effects 0.000 description 10

- 238000007906 compression Methods 0.000 description 10

- 230000005540 biological transmission Effects 0.000 description 9

- 238000007781 pre-processing Methods 0.000 description 9

- 238000009499 grossing Methods 0.000 description 8

- 238000005192 partition Methods 0.000 description 7

- 241000023320 Luma <angiosperm> Species 0.000 description 6

- 238000003491 array Methods 0.000 description 6

- OSWPMRLSEDHDFF-UHFFFAOYSA-N methyl salicylate Chemical compound COC(=O)C1=CC=CC=C1O OSWPMRLSEDHDFF-UHFFFAOYSA-N 0.000 description 6

- 238000000638 solvent extraction Methods 0.000 description 6

- 208000037170 Delayed Emergence from Anesthesia Diseases 0.000 description 5

- 230000011664 signaling Effects 0.000 description 5

- 238000006243 chemical reaction Methods 0.000 description 4

- 238000013461 design Methods 0.000 description 4

- 230000007246 mechanism Effects 0.000 description 4

- 230000003287 optical effect Effects 0.000 description 4

- 238000012805 post-processing Methods 0.000 description 4

- 230000002123 temporal effect Effects 0.000 description 4

- 238000012360 testing method Methods 0.000 description 4

- 238000005516 engineering process Methods 0.000 description 3

- 238000005457 optimization Methods 0.000 description 3

- 230000000644 propagated effect Effects 0.000 description 3

- 230000002441 reversible effect Effects 0.000 description 3

- 238000000926 separation method Methods 0.000 description 3

- 239000013598 vector Substances 0.000 description 3

- 230000000007 visual effect Effects 0.000 description 3

- VBRBNWWNRIMAII-WYMLVPIESA-N 3-[(e)-5-(4-ethylphenoxy)-3-methylpent-3-enyl]-2,2-dimethyloxirane Chemical compound C1=CC(CC)=CC=C1OC\C=C(/C)CCC1C(C)(C)O1 VBRBNWWNRIMAII-WYMLVPIESA-N 0.000 description 2

- 230000003044 adaptive effect Effects 0.000 description 2

- 230000008901 benefit Effects 0.000 description 2

- 238000012937 correction Methods 0.000 description 2

- 238000006073 displacement reaction Methods 0.000 description 2

- 230000006870 function Effects 0.000 description 2

- 239000004973 liquid crystal related substance Substances 0.000 description 2

- 238000012986 modification Methods 0.000 description 2

- 230000004048 modification Effects 0.000 description 2

- 230000010076 replication Effects 0.000 description 2

- 238000013515 script Methods 0.000 description 2

- 230000011218 segmentation Effects 0.000 description 2

- 230000001360 synchronised effect Effects 0.000 description 2

- 101150039623 Clip1 gene Proteins 0.000 description 1

- 241000699666 Mus <mouse, genus> Species 0.000 description 1

- 241000699670 Mus sp. Species 0.000 description 1

- 238000012952 Resampling Methods 0.000 description 1

- XUIMIQQOPSSXEZ-UHFFFAOYSA-N Silicon Chemical compound [Si] XUIMIQQOPSSXEZ-UHFFFAOYSA-N 0.000 description 1

- 230000009471 action Effects 0.000 description 1

- 230000003190 augmentative effect Effects 0.000 description 1

- 230000007175 bidirectional communication Effects 0.000 description 1

- 230000002146 bilateral effect Effects 0.000 description 1

- 230000000903 blocking effect Effects 0.000 description 1

- 238000010276 construction Methods 0.000 description 1

- 238000013500 data storage Methods 0.000 description 1

- 238000009795 derivation Methods 0.000 description 1

- 238000011161 development Methods 0.000 description 1

- 230000018109 developmental process Effects 0.000 description 1

- 238000002474 experimental method Methods 0.000 description 1

- 239000011159 matrix material Substances 0.000 description 1

- 238000010295 mobile communication Methods 0.000 description 1

- 230000008520 organization Effects 0.000 description 1

- 230000002093 peripheral effect Effects 0.000 description 1

- 238000011084 recovery Methods 0.000 description 1

- 230000009467 reduction Effects 0.000 description 1

- 238000009877 rendering Methods 0.000 description 1

- 238000012552 review Methods 0.000 description 1

- 239000004065 semiconductor Substances 0.000 description 1

- 229910052710 silicon Inorganic materials 0.000 description 1

- 239000010703 silicon Substances 0.000 description 1

- 239000007787 solid Substances 0.000 description 1

- 230000003068 static effect Effects 0.000 description 1

- 238000006467 substitution reaction Methods 0.000 description 1

- 239000000758 substrate Substances 0.000 description 1

- 238000012546 transfer Methods 0.000 description 1

- 230000009466 transformation Effects 0.000 description 1

- 230000007704 transition Effects 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/593—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving spatial prediction techniques

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/105—Selection of the reference unit for prediction within a chosen coding or prediction mode, e.g. adaptive choice of position and number of pixels used for prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/117—Filters, e.g. for pre-processing or post-processing

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/132—Sampling, masking or truncation of coding units, e.g. adaptive resampling, frame skipping, frame interpolation or high-frequency transform coefficient masking

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/157—Assigned coding mode, i.e. the coding mode being predefined or preselected to be further used for selection of another element or parameter

- H04N19/159—Prediction type, e.g. intra-frame, inter-frame or bidirectional frame prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/176—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a block, e.g. a macroblock

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/46—Embedding additional information in the video signal during the compression process

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/80—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/80—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation

- H04N19/82—Details of filtering operations specially adapted for video compression, e.g. for pixel interpolation involving filtering within a prediction loop

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/11—Selection of coding mode or of prediction mode among a plurality of spatial predictive coding modes

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Compression Or Coding Systems Of Tv Signals (AREA)

Description

本開示は、画像及び/又はビデオ符号化及び復号の技術分野に関し、特に、イントラ/インター予測のための方法及び機器に関する。

前記ブロックのイントラ予測モードを取得するステップと、

前記ブロックの前記イントラ予測モードが広角モードであるとき、フィルタリング済み参照サンプルに基づき、前記ブロックの予測サンプルを取得するステップと、

を含む方法に関する。

[表2]色度動き補間フィルタ係数

(BMS1.0で定義されたイントラ予測モードのセットについて)mTの例示的な値、及び対応する角度は、表4に示される。角度αは図19~20に示されるように与えられる。

[表4](BMS1.0で定義されたイントラ予測モードのセットについて)mTの例示的な値

[表5]例示的な参照サンプルフィルタ

・境界平滑化、

・PDPC及び簡易PDPC。

(x,y)に位置する予測サンプルP(x,y)は以下のように計算される。

右上対角モードのPDPC重みは、

・簡易PDPC処理、

・PDPC処理(例えば、JEMで指定される)、

・境界平滑化(例えば、HEVCで指定される)。

イントラ予測の結果を更新するために線形結合を使用する他の方法。

・「S」は、決定がブロックサイズに依存することを意味する。このサイズ依存性は、以下のように実行される。(log2(nTbW)+Log2(nTbH))>>1に等しく設定されたブロックサイズパラメータnTbSは、所定の閾値TSと比較される。nTbS>TSの場合、「1」の値について更に説明されるのと同じ処理が適用される。或いは、nTbS≦TSの場合、「0」の値について更に説明されるのと同じ処理が適用される。ここで、nTbW及びnTbHは、それぞれ予測ブロックの幅及び高さを示し、「>>」は右シフト演算を示す。TSの値は、例えば2に設定され、又は(例えば、HEVCのMDISの場合に行われるように)イントラ予測モードに依存して定義され得る。

・「1」は、処理が有効にされることを意味する。参照サンプルフィルタリングの場合、「1」の値は、参照サンプルが[1 2 1]フィルタにより処理されることを意味する。

・「0」は、処理が無効にされることを意味する。参照サンプルフィルタリングの場合、「1」の値は、参照サンプルが[1]フィルタにより処理されること、つまりフィルタリングが参照サンプルに適用されないことを意味する。

[表X](図4Bに示すような)方向intraPredModeに依存する参照サンプルフィルタリングの決定

[表Y](図4Bに示すような)方向intraPredModeに依存する参照サンプルフィルタリングの決定

Log2(x)は、2を底とするxの対数である。

intraPredAngleは、表X又は表Yで指定された角度パラメータである。

A=C?B:Dは、三項代入演算であり、ここで条件Cが真の場合、AはBに等しく設定される。或いは、条件Cが偽の場合、AはDに等しく設定される。

INTRA_PLANARは、平面イントラ予測モード()である。

INTRA_DCは、DCイントラ予測モードである。

INTRA_ANGULARXXは、方向イントラ予測モードのうちの1つであり、ここでXXは、図4Bに示されるその番号及び対応する方向を示す。

この処理への入力は:

・イントラ予測モードpredModeIntra、

・変換ブロック幅を指定する変数nTbW、

・変換ブロック高さを指定する変数nTbH、

・参照サンプル幅を指定する変数refW、

・参照サンプル高さを指定する変数refH、

・予測サンプルpredSamples[x][y]、ここでx=0...nTbW-1、y=0...nTbH-1、

・近隣サンプルp[x][y]、ここで、x=-1、y=-1...refH-1、及びx=0...refW-1、y=-1、

・現在ブロックの色成分を指定する変数cIdx。

この処理の出力は、変更された予測サンプルpredSamples[x][y]、ここでx=0...nTbW-1、y=0...nTbH-1である。

cIdxの値に依存して、関数clip1Cmpは以下の通り設定される。

・cIdxが0に等しい場合、clip1CmpはClip1Yに等しく設定され、

・その他の場合、clip1CmpはClip1Cに等しく設定される。

変数nScaleは以下に設定される:

・predModeIntraがINTRA_PLANAR、INTRA_DC、INTRA_ANGULAR18、又はINTRA_ANGULAR50に等しい場合、以下が適用される:

1.変数dXPos[y]、dXFrac[y]、dXInt[y]、及びdX[x][y]は、invAngleを用いて以下のように導出される:

1.変数dYPos[x]、dYFrac[x]、dYInt[x]、及びdY[x][y]は、intraPredModeに依存して以下に指定されるようにinvAngleを用いて以下のように導出される:

・方向イントラ予測モード(図4A及び図4Bに示されるpredModeIntraとして更に示される)、

・ブロックサイズパラメータnTbS、これは、(log2(nTbW)+Log2(nTbH))>>1に等しく設定され、ここで、nTbW及びnTbHは、それぞれ予測ブロックの幅及び高さを示し、「>>」は右シフト演算を示す。

ステップ1。参照サンプル、イントラ予測モードintraPredMode及び/又はブロック寸法(幅及び高さ)に基づき、参照サンプルフィルタリングを実行する。

ステップ2。intraPredAngleに従い、処理済み(フィルタリング済み又は未フィルタリング参照サンプル)参照サンプル(ステップ1の結果)に基づき、方向イントラ予測を実行する。

ステップ3。ステップ2で取得された結果を、以下であり得る予測組み合わせにより更新する:

・PDPC、

・簡易PDPC。

predModeIntraに基づき、フィルタリング済み又は未フィルタリング参照サンプルバッファが使用されるべきかを決定する。これは、以下の表5にリストされたフィルタのうちの1つを適用することにより実行され得る。VVCでは、インデックス0及び1を有するフィルタが使用される。例えば、参照サンプルは、predModeが2、34、又は66に等しいとき、及びnTbS>2のときに、フィルタリングされる(表5のフィルタインデックス「1」が使用される)。

[表8]intraPredAngleをpredModeIntraから導出するための例示的なLUT

実施形態1。イントラ予測の方法であって、前記方法は、

参照サンプルを処理するステップと、

イントラ予測に従い、前記処理された参照サンプルに基づき、方向イントラ予測を実行するステップと、

前記処理された参照サンプルに基づき、追加予測を実行するステップと、を含む方法。

実施形態2。参照サンプルを処理する前記ステップは、参照サンプルフィルタリング又はサブピクセル補間フィルタリングを含む、実施形態1に記載の方法。

実施形態3。前記方向イントラ予測モードは、

A.垂直又は水平モード、

B.45°の倍数である角度を表す対角モード、

C.残りの方向モード、

のうちの少なくとも1つのグループに含まれる、実施形態1に記載の方法。

実施形態4。前記方向イントラ予測モードが、グループAに属するとして分類されるとき、イントラ予測器を生成するために参照サンプルにフィルタが適用されない、実施形態3に記載の方法。

実施形態5。前記方向モードがグループBに含まれるとき、前記選択された方向に従い、フィルタされた値をイントラ予測器にコピーするために、参照サンプルフィルタが参照サンプルに適用される(補間フィルタは適用されない)、実施形態3に記載の方法。

実施形態6。前記方向モードがグループCに属するとして分類されるとき、選択された方向に従い、参照サンプルの間の分数又は整数位置に含まれる予測サンプルを生成するために、イントラ参照サンプル補間フィルタのみが参照サンプルに適用される(参照サンプルフィルタリングは実行されない)、実施形態3に記載の方法。

実施形態7。参照サンプル、イントラ予測モード(IntraPredMode)、又はブロックサイズパラメータ、のうちの少なくとも1つに基づき参照サンプルフィルタリングを実行する、実施形態1~6のいずれか1つに記載の方法。

実施形態8。前記処理された参照サンプルは、フィルタリング済み参照サンプル又は未フィルタリング参照サンプルを含む、実施形態7に記載の方法。

実施形態9。前記方法は、前記predModeIntraに基づき、フィルタリング済み又は未フィルタリング参照サンプルバッファが使用されるかを決定すること、を更に含む実施形態7に記載の方法。

実施形態10。インデックス0又は1を有するフィルタが使用される、実施形態9に記載の方法。

実施形態11。参照サンプルは、predModeが2、34、又は66に等しいとき、及びnTbS>2のときに、フィルタリングされる(表5のフィルタインデックス「1」が使用される)、実施形態9に記載の方法。

実施形態12。前記方法は、前記ブロックサイズパラメータに基づき、フィルタリング済み又は未フィルタリング参照サンプルバッファが使用されるかを決定するステップであって、前記ブロックサイズパラメータは角度パラメータ(intraPredAngle)である、ステップ、を更に含む実施形態7に記載の方法。

実施形態13。前記intraPredAngleの値が32の倍数であるとき、及びnTbS>2のとき、参照サンプルは、フィルタリングされる(表5のフィルタインデックス「1」が使用される)、実施形態12に記載の方法。

実施形態14。前記追加予測は、位置依存予測組み合わせ(Position-Dependent Prediction Combination (PDPC))又は簡易PDPCである、実施形態1~13のいずれか1つに記載の方法。

実施形態15。前記イントラ予測及び前記追加予測は、並列に実行される、実施形態1~14のいずれか1つに記載の方法。

実施形態16。前記方向イントラ予測は、整数勾配広角モード(例えば、表X及びYで指定されたような-14、-12、-10、-6、72、76、78、80)を含む、実施形態1~15のいずれか1つに記載の方法。

本開示では、ビデオデータを復号するデコーダが開示される。前記デコーダは、

1つ以上のプロセッサと、

プロセッサに結合されプロセッサによる実行のためのプログラミングを格納する非一時的コンピュータ可読記憶媒体であって、該プログラミングは、プロセッサにより実行されると、上述の方法を実行するようデコーダを構成する、非一時的コンピュータ可読記憶媒体と、

を含む。

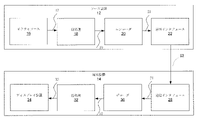

ブロックのイントラ予測モードを取得するよう構成される取得ユニット2502と、

ブロックのイントラ予測モードが広角モードであるとき、フィルタリング済み参照サンプルに基づき、ブロックの予測サンプルを取得するよう構成される広角予測ユニット2504と、

を含んでよい。

Claims (13)

- ブロックのイントラ予測の方法であって、前記方法は、

前記ブロックのイントラ予測モードを取得するステップと、

前記ブロックの前記イントラ予測モードが広角モードか否かを決定するステップであって、前記広角モードは、所定の広角方向のイントラ予測方向のうち、-14、-12、-10、-6、72、76、78、又は80に等しいモード番号を有するイントラ予測モードである、ステップと、

前記ブロックの前記イントラ予測モードが前記広角モードであるとき、参照サンプルをフィルタリングするステップと、

前記ブロックの前記イントラ予測モードが前記広角モードであるとき、フィルタリング済み参照サンプルに基づき、前記ブロックの予測サンプルを取得するステップと、

を含む方法。 - 前記参照サンプルをフィルタリングするために使用されるフィルタは、以下の係数:[1,2,1]/4により定義される、請求項1に記載の方法。

- 前記方法は、

前記ブロックの前記イントラ予測モードが前記広角モードであるかに基づき、フィルタリング済み又は未フィルタリング参照サンプルバッファが使用されるかを決定するステップ、を更に含む請求項1~2のいずれかに記載の方法。 - 位置依存予測組み合わせ(PDPC)は、(i)前記ブロックの前記イントラ予測モードが前記広角モードか否かに基づきフィルタリングされた又はフィルタリングされなかった参照サンプル、及び(ii)前記参照サンプルから取得された前記ブロックの予測サンプルについて実行される、請求項1~3のいずれかに記載の方法。

- 前記ブロックの前記イントラ予測モードは前記広角モードではないとき、前記方法は、

前記イントラ予測モードに対応するモード値が2、34、又は66のうちの1つであるかを決定するステップと、

前記ブロックの前記イントラ予測モードに対応する前記モード値が2、34、又は66のうちの1つであるとき、参照サンプルをフィルタリングするステップと、

を更に含む請求項1~4のいずれかに記載の方法。 - ブロックのイントラ予測のための機器であって、前記機器は、

前記ブロックのイントラ予測モードを取得するよう構成される取得ユニットと、

前記ブロックの前記イントラ予測モードが広角モードであるかを決定するよう構成される決定ユニットであって、前記広角モードは、所定の広角方向のイントラ予測方向のうち、-14、-12、-10、-6、72、76、78、又は80に等しいモード番号を有するイントラ予測モードである、決定ユニットと、

前記ブロックの前記イントラ予測モードが前記広角モードであるとき、参照サンプルをフィルタリングし、フィルタリング済み参照サンプルに基づき、前記ブロックの予測サンプルを取得するよう構成される広角予測ユニットと、

を含む機器。 - 前記参照サンプルをフィルタリングするために使用されるフィルタは、以下の係数:[1,2,1]/4により定義される、請求項6に記載の機器。

- 前記決定ユニットは、

前記ブロックの前記イントラ予測モードが前記広角モードではないとき、前記ブロックの前記イントラ予測モードに対応する値が2、34、又は66のうちの1つであるかを決定し、

前記ブロックの前記イントラ予測モードに対応する前記値が2、34、又は66のうちの1つであるとき、参照サンプルをフィルタリングするよう更に構成される、請求項6~7のいずれかに記載の機器。 - 前記決定ユニットは、前記ブロックの前記イントラ予測モードが前記広角モードか否かに基づき、フィルタリング済み又は未フィルタリング参照サンプルバッファが使用されるかを決定するよう更に構成される、請求項6~8のいずれかに記載の機器。

- 位置依存予測組み合わせ(PDPC)は、(i)前記ブロックの前記イントラ予測モードが前記広角モードか否かに基づきフィルタリングされた又はフィルタリングされなかった参照サンプル、及び(ii)前記参照サンプルから取得された前記ブロックの前記予測サンプルについて実行される、請求項6~9のいずれかに記載の機器。

- 請求項1乃至5のいずれか一項に記載の方法を実行する処理回路を含むエンコーダ。

- 請求項1乃至5のいずれか一項に記載の方法を実行する処理回路を含むデコーダ。

- 請求項1乃至5のいずれか一項に記載の方法を実行するためのコンピュータプログラム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2022180464A JP2023022071A (ja) | 2018-11-14 | 2022-11-10 | イントラ予測のための方法及び機器 |

Applications Claiming Priority (3)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US201862767496P | 2018-11-14 | 2018-11-14 | |

| US62/767,496 | 2018-11-14 | ||

| PCT/RU2019/050214 WO2020101545A1 (en) | 2018-11-14 | 2019-11-14 | Method and apparatus for intra prediction |

Related Child Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2022180464A Division JP2023022071A (ja) | 2018-11-14 | 2022-11-10 | イントラ予測のための方法及び機器 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2021533618A JP2021533618A (ja) | 2021-12-02 |

| JP7177242B2 true JP7177242B2 (ja) | 2022-11-22 |

Family

ID=70731882

Family Applications (2)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2021504520A Active JP7177242B2 (ja) | 2018-11-14 | 2019-11-14 | イントラ予測のための方法及び機器 |

| JP2022180464A Pending JP2023022071A (ja) | 2018-11-14 | 2022-11-10 | イントラ予測のための方法及び機器 |

Family Applications After (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2022180464A Pending JP2023022071A (ja) | 2018-11-14 | 2022-11-10 | イントラ予測のための方法及び機器 |

Country Status (12)

| Country | Link |

|---|---|

| US (2) | US11689729B2 (ja) |

| EP (1) | EP3864847A4 (ja) |

| JP (2) | JP7177242B2 (ja) |

| KR (2) | KR20230127376A (ja) |

| CN (1) | CN112997497B (ja) |

| AU (3) | AU2019381145B2 (ja) |

| BR (1) | BR112020025155A2 (ja) |

| CA (1) | CA3119645C (ja) |

| CL (1) | CL2021001265A1 (ja) |

| MX (2) | MX2021001514A (ja) |

| NZ (1) | NZ776204A (ja) |

| WO (1) | WO2020101545A1 (ja) |

Families Citing this family (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20220224938A1 (en) * | 2021-01-08 | 2022-07-14 | Offinno, LLC | Intra Prediction Signaling |

Citations (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2016530779A (ja) | 2013-07-19 | 2016-09-29 | クゥアルコム・インコーポレイテッドQualcomm Incorporated | イントラ予測フィルタリングの無効化 |

Family Cites Families (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US8619857B2 (en) * | 2010-04-09 | 2013-12-31 | Sharp Laboratories Of America, Inc. | Methods and systems for intra prediction |

| US10362314B2 (en) * | 2015-11-27 | 2019-07-23 | Mediatek Inc. | Apparatus and method for video coding by intra-prediction |

| FI20175006A1 (en) * | 2017-01-03 | 2019-02-15 | Nokia Technologies Oy | Video and image coding using wide-angle intra-prediction |

| US10917660B2 (en) * | 2017-01-13 | 2021-02-09 | Vid Scale, Inc. | Prediction approaches for intra planar coding |

| KR102361010B1 (ko) * | 2017-06-21 | 2022-02-09 | 엘지전자 주식회사 | 영상 코딩 시스템에서 인트라 예측에 따른 영상 디코딩 방법 및 장치 |

| EP3496401A1 (en) * | 2017-12-05 | 2019-06-12 | Thomson Licensing | Method and apparatus for video encoding and decoding based on block shape |

| US11128872B2 (en) * | 2018-07-16 | 2021-09-21 | Qualcomm Incorporated | Position dependent intra prediction combination with wide angle intra prediction |

| US10834393B2 (en) * | 2018-09-10 | 2020-11-10 | Tencent America LLC | Intra interpolation filter for multi-line intra prediction |

| US11303885B2 (en) * | 2018-10-25 | 2022-04-12 | Qualcomm Incorporated | Wide-angle intra prediction smoothing and interpolation |

-

2019

- 2019-11-14 NZ NZ776204A patent/NZ776204A/en unknown

- 2019-11-14 KR KR1020237028717A patent/KR20230127376A/ko not_active Application Discontinuation

- 2019-11-14 MX MX2021001514A patent/MX2021001514A/es unknown

- 2019-11-14 JP JP2021504520A patent/JP7177242B2/ja active Active

- 2019-11-14 CA CA3119645A patent/CA3119645C/en active Active

- 2019-11-14 CN CN201980072829.3A patent/CN112997497B/zh active Active

- 2019-11-14 KR KR1020217000324A patent/KR102571856B1/ko active IP Right Grant

- 2019-11-14 AU AU2019381145A patent/AU2019381145B2/en active Active

- 2019-11-14 BR BR112020025155-0A patent/BR112020025155A2/pt unknown

- 2019-11-14 EP EP19883882.3A patent/EP3864847A4/en active Pending

- 2019-11-14 WO PCT/RU2019/050214 patent/WO2020101545A1/en unknown

-

2021

- 2021-01-05 US US17/142,185 patent/US11689729B2/en active Active

- 2021-02-05 MX MX2024002097A patent/MX2024002097A/es unknown

- 2021-05-14 CL CL2021001265A patent/CL2021001265A1/es unknown

-

2022

- 2022-11-10 JP JP2022180464A patent/JP2023022071A/ja active Pending

-

2023

- 2023-02-16 AU AU2023200908A patent/AU2023200908B2/en active Active

- 2023-05-19 US US18/320,199 patent/US20230421776A1/en active Pending

-

2024

- 2024-09-03 AU AU2024219340A patent/AU2024219340A1/en active Pending

Patent Citations (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2016530779A (ja) | 2013-07-19 | 2016-09-29 | クゥアルコム・インコーポレイテッドQualcomm Incorporated | イントラ予測フィルタリングの無効化 |

Non-Patent Citations (1)

| Title |

|---|

| BROSS, Benjamin et al.,Versatile Video Coding (Draft 3),Joint Video Experts Team (JVET) of ITU-T SG 16 WP 3 and ISO/IEC JTC 1/SC 29/WG 11 12th Meeting: Macao, CN, 3-12 Oct. 2018, [JVET-L1001-v2],JVET-L1001 (version 2),ITU-T,2018年11月08日,<URL:http://phenix.it-sudparis.eu/jvet/doc_end_user/documents/12_Macao/wg11/JVET-L1001-v2.zip>: JVET-L1001-v2.docx: pp. 70-74, 77-79 |

Also Published As

| Publication number | Publication date |

|---|---|

| AU2023200908B2 (en) | 2024-06-06 |

| MX2024002097A (es) | 2024-03-05 |

| KR20210016615A (ko) | 2021-02-16 |

| AU2024219340A1 (en) | 2024-09-19 |

| AU2019381145B2 (en) | 2022-11-17 |

| US11689729B2 (en) | 2023-06-27 |

| EP3864847A4 (en) | 2021-12-15 |

| JP2021533618A (ja) | 2021-12-02 |

| NZ776204A (en) | 2023-02-24 |

| JP2023022071A (ja) | 2023-02-14 |

| CA3119645A1 (en) | 2020-05-22 |

| AU2023200908A1 (en) | 2023-03-16 |

| AU2019381145A1 (en) | 2021-06-10 |

| WO2020101545A1 (en) | 2020-05-22 |

| BR112020025155A2 (pt) | 2021-05-18 |

| CN112997497A (zh) | 2021-06-18 |

| EP3864847A1 (en) | 2021-08-18 |

| MX2021001514A (es) | 2021-04-13 |

| KR102571856B1 (ko) | 2023-08-28 |

| CN112997497B (zh) | 2024-10-18 |

| CA3119645C (en) | 2024-05-28 |

| CL2021001265A1 (es) | 2021-10-22 |

| US20210127122A1 (en) | 2021-04-29 |

| KR20230127376A (ko) | 2023-08-31 |

| US20230421776A1 (en) | 2023-12-28 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP7375125B2 (ja) | ルーマおよびクロマ成分についてibc専用バッファおよびデフォルト値リフレッシュを使用するエンコーダ、デコーダおよび対応する方法 | |

| JP7342188B2 (ja) | ビデオコーディングにおけるイントラ予測およびインター予測のための補間フィルタリングのための方法および装置 | |

| JP7521057B2 (ja) | エンコーダ、デコーダ、及びデブロッキングフィルタの境界強度導出の対応する方法 | |

| JP7039731B2 (ja) | イントラ予測のための方法及び装置 | |

| JP7250917B2 (ja) | 補間フィルタを使用するイントラ予測のための方法および装置 | |

| KR102694040B1 (ko) | 예측 방법 및 장치 | |

| KR102625986B1 (ko) | 인트라 서브파티션 코딩 툴로 인한 서브파티션 경계를 위한 디블로킹 필터 | |

| AU2024219340A1 (en) | Method and apparatus for intra prediction | |

| CN112425165B (zh) | 基于邻块的帧内预测模式推导 | |

| WO2020061949A1 (en) | Encoding method, decoding method, encoder, and decoder |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20210127 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20210127 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20220303 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20220308 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20220602 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20221011 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20221110 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7177242 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |