JP7112802B1 - 学習モデルの軽量化 - Google Patents

学習モデルの軽量化 Download PDFInfo

- Publication number

- JP7112802B1 JP7112802B1 JP2022073380A JP2022073380A JP7112802B1 JP 7112802 B1 JP7112802 B1 JP 7112802B1 JP 2022073380 A JP2022073380 A JP 2022073380A JP 2022073380 A JP2022073380 A JP 2022073380A JP 7112802 B1 JP7112802 B1 JP 7112802B1

- Authority

- JP

- Japan

- Prior art keywords

- learning

- model

- weight

- data

- predetermined

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/08—Learning methods

- G06N3/082—Learning methods modifying the architecture, e.g. adding, deleting or silencing nodes or connections

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N20/00—Machine learning

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N20/00—Machine learning

- G06N20/20—Ensemble learning

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

- G06N3/045—Combinations of networks

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

- G06N3/0495—Quantised networks; Sparse networks; Compressed networks

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/08—Learning methods

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/08—Learning methods

- G06N3/09—Supervised learning

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Physics & Mathematics (AREA)

- Software Systems (AREA)

- Computing Systems (AREA)

- Artificial Intelligence (AREA)

- Mathematical Physics (AREA)

- General Physics & Mathematics (AREA)

- Data Mining & Analysis (AREA)

- Evolutionary Computation (AREA)

- General Engineering & Computer Science (AREA)

- Biomedical Technology (AREA)

- Molecular Biology (AREA)

- General Health & Medical Sciences (AREA)

- Computational Linguistics (AREA)

- Biophysics (AREA)

- Life Sciences & Earth Sciences (AREA)

- Health & Medical Sciences (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Medical Informatics (AREA)

- Management, Administration, Business Operations System, And Electronic Commerce (AREA)

- Image Analysis (AREA)

Abstract

Description

<システム構成>

図1は、実施形態に係るシステム構成の一例を示す図である。図1に示す例では、サーバ10と、各情報処理装置20A、20B、20C、20Dとが、ネットワークを介してデータ送受信可能なように接続される。情報処理装置を個別に区別しない場合は情報処理装置20とも表記する。

図2は、実施形態に係る情報処理装置10の物理的構成の一例を示す図である。情報処理装置10は、演算部に相当する1又は複数のCPU(Central Processing Unit)10aと、記憶部に相当するRAM(Random Access Memory)10bと、記憶部に相当するROM(Read only Memory)10cと、通信部10dと、入力部10eと、表示部10fと、を有する。これらの各構成は、バスを介して相互にデータ送受信可能に接続される。

図3は、実施形態に係る情報処理装置10の処理ブロックの一例を示す図である。情報処理装置10は、取得部101、第1学習部102、変更部103、第2学習部104、予測部105、判定部106、設定部107、関連付け部108、特定部109、表示制御部110、出力部111、及び記憶部112を備える。例えば、図3に示す第1学習部102、変更部103、第2学習部104、予測部105、判定部106、設定部107、関連付け部108、特定部109、表示制御部110は、例えばCPU10aなどにより実行されて実現され、取得部101及び出力部111は、例えば通信部10dなどにより実現され、記憶部112は、RAM10b及び/又はROM10cなどにより実現され得る。

M1(x)=w1m1(x)+w2m2(x)+w3m3(x) …式(1)

wn:重み(各重みの集合(セット)をWとも表記する)

mn(x):第nモデル

x:学習データ

<データ例>

図7は、実施形態に係る関係情報の一例を示す図である。図7に示す例では、関係情報は、各第1変数(例、P11)及び各第2変数(例、P21)に対応する各重み(例、W1)を含む。第1変数P1nは、例えば学習精度であり、第2変数P2nは例えばモデルサイズの圧縮率であり、変数としてはいずれかの変数だけでもよい。各重みW(P1n,P2m)は、第第1変数P1n及び第2変数P2nの場合の重みである。

図8は、実施形態に係る関係情報の表示例を示す図である。図8に示す例では、関係情報に含まれる第1変数と第2変数とをスライドバーを用いて変更可能にする。ユーザが第1変数又は第2変数に対してスライドバーを用いて移動させることで、例えば、移動後の第1変数(P1n)又は第2変数(P2m)に対応する各重みWのセットW(P1n,P2m)が、対応する点に関連付けて表示される。

図9は、実施形態に係る予測モデルの生成に関する処理の一例を示すフローチャートである。図9に示す処理は、情報処理装置10により実行される。

Claims (9)

- 情報処理装置に含まれる1又は複数のプロセッサが、

所定の学習データを取得すること、

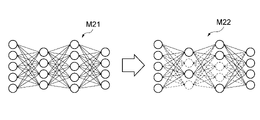

ニューラルネットワークを用いる所定の学習モデルに対して、蒸留処理された第1学習モデル、枝刈り処理された第2学習モデル、及び量子化処理された第3学習モデルの少なくとも2つのモデルを含む各モデルがそれぞれ重み付けされた重み学習モデルに、所定のデータを入力して機械学習を行うこと、

前記各モデルそれぞれの重みが変更された重み学習モデルごとに、前記所定の学習データを入力して前記機械学習が行われた場合の学習結果を取得すること、

変更された各重みが重み付けされた各重み学習モデルと、前記各重み学習モデルで学習されたときの各学習結果とを含む学習データを用いて、教師あり学習を行うこと、

前記教師あり学習により、任意の学習データを入力する場合に、各重みの集合ごとに学習結果を予測する予測モデルを生成すること、

を実行する、情報処理方法。 - 前記1又は複数のプロセッサは、

任意の学習データを前記予測モデルに入力し、前記各重みの集合ごとに、前記重み学習モデルを実行した場合の学習結果を予測することを実行する、請求項1に記載の情報処理方法。 - 前記1又は複数のプロセッサが、

前記任意の学習データを前記所定の学習モデルに入力した場合の学習結果と、前記予測モデルにより予測された学習結果とが、軽量化に関する所定条件を満たすか否かを判定すること、

前記所定条件の判定結果に基づいて、前記各重みの有効性を判定すること、

をさらに実行する請求項2に記載の情報処理方法。 - 前記1又は複数のプロセッサが、

前記軽量化に関する所定条件に関するユーザ操作を受け付けること、

前記ユーザ操作に基づいて、前記軽量化に関する所定条件を設定すること、

をさらに実行する請求項3に記載の情報処理方法。 - 前記プロセッサは、

前記学習結果に含まれる学習精度を第1変数、前記学習結果に含まれるモデルサイズに関する値を第2変数とし、前記第1変数及び前記第2変数と、前記各重みとを対応付ける関係情報を生成すること、

を実行する請求項1に記載の情報処理方法。 - 前記プロセッサは、

前記第1変数の第1値及び前記第2変数の第2値を取得すること、

前記関係情報に基づいて、前記第1値及び前記第2値に対応する各重みを特定すること、

を実行する請求項5に記載の情報処理方法。 - 前記重み学習モデルは、前記第1学習モデル、前記第2学習モデル、及び前記第3学習モデルそれぞれに重みが付与されて線形結合されたモデルを含む、請求項1に記載の情報処理方法。

- メモリと、1又は複数のプロセッサとを備える情報処理装置であって、

前記メモリは、

ニューラルネットワークを用いる所定の学習モデルと、

前記所定の学習モデルに対して、蒸留処理された第1学習モデル、枝刈り処理された第2学習モデル、及び量子化処理された第3学習モデルの少なくとも2つのモデルを含む各モデルがそれぞれ重み付けされた重み学習モデルと、を記憶し、

前記1又は複数のプロセッサは、

所定の学習データを取得すること、

前記重み学習モデルに、前記所定の学習データを入力して機械学習を行うこと、

前記各モデルそれぞれの重みが変更された重み学習モデルごとに、前記所定の学習データを入力して前記機械学習が行われた場合の学習結果を取得すること、

変更された各重みが重み付けされた各重み学習モデルと、前記各重み学習モデルで学習されたときの各学習結果とを含む学習データを用いて、教師あり学習を行うこと、

前記教師あり学習により、任意の学習データを入力する場合に、各重みの集合ごとに学習結果を予測する予測モデルを生成すること、

を実行する、情報処理装置。 - 情報処理装置に含まれる1又は複数のプロセッサに、

所定の学習データを取得すること、

ニューラルネットワークを用いる所定の学習モデルに対して、蒸留処理された第1学習モデル、枝刈り処理された第2学習モデル、及び量子化処理された第3学習モデルの少なくとも2つのモデルを含む各モデルがそれぞれ重み付けされた重み学習モデルに、所定の学習データを入力して機械学習を行うこと、

前記各モデルそれぞれの重みが変更された重み学習モデルごとに、前記所定の学習データを入力して前記機械学習が行われた場合の学習結果を取得すること、

変更された各重みが重み付けされた各重み学習モデルと、前記各重み学習モデルで学習されたときの各学習結果とを含む学習データを用いて、教師あり学習を行うこと、

前記教師あり学習により、任意の学習データを入力する場合に、各重みの集合ごとに学習結果を予測する予測モデルを生成すること、

を実行させる、プログラムを記録したコンピュータ読み取り可能な非一時的な記憶媒体。

Priority Applications (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2022073380A JP7112802B1 (ja) | 2022-04-27 | 2022-04-27 | 学習モデルの軽量化 |

| JP2022113601A JP2023163102A (ja) | 2022-04-27 | 2022-07-15 | 学習モデルの軽量化 |

| PCT/JP2023/016014 WO2023210546A1 (ja) | 2022-04-27 | 2023-04-21 | 学習モデルの軽量化 |

| US18/927,625 US20250053819A1 (en) | 2022-04-27 | 2024-10-25 | Compression of learning model |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2022073380A JP7112802B1 (ja) | 2022-04-27 | 2022-04-27 | 学習モデルの軽量化 |

Related Child Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2022113601A Division JP2023163102A (ja) | 2022-04-27 | 2022-07-15 | 学習モデルの軽量化 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP7112802B1 true JP7112802B1 (ja) | 2022-08-04 |

| JP2023162766A JP2023162766A (ja) | 2023-11-09 |

Family

ID=82702006

Family Applications (2)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2022073380A Active JP7112802B1 (ja) | 2022-04-27 | 2022-04-27 | 学習モデルの軽量化 |

| JP2022113601A Pending JP2023163102A (ja) | 2022-04-27 | 2022-07-15 | 学習モデルの軽量化 |

Family Applications After (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2022113601A Pending JP2023163102A (ja) | 2022-04-27 | 2022-07-15 | 学習モデルの軽量化 |

Country Status (3)

| Country | Link |

|---|---|

| US (1) | US20250053819A1 (ja) |

| JP (2) | JP7112802B1 (ja) |

| WO (1) | WO2023210546A1 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2024237371A1 (ko) * | 2023-05-17 | 2024-11-21 | 주식회사 사피온코리아 | 인공 신경망 모델의 학습 도메인을 고려한 캘리브레이션 데이터셋 생성 및 이를 이용한 인공 신경망 모델의 최적화를 위한 방법 및 장치 |

Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20200125956A1 (en) | 2017-05-20 | 2020-04-23 | Google Llc | Application Development Platform and Software Development Kits that Provide Comprehensive Machine Learning Services |

| US20200311552A1 (en) | 2019-03-25 | 2020-10-01 | Samsung Electronics Co., Ltd. | Device and method for compressing machine learning model |

| WO2022023022A1 (en) | 2020-07-28 | 2022-02-03 | Siemens Aktiengesellschaft | Method for automated determination of a model compression technique for compression of an artificial intelligence-based model |

Family Cites Families (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN112106081A (zh) * | 2018-05-07 | 2020-12-18 | 谷歌有限责任公司 | 提供综合机器学习服务的应用开发平台和软件开发套件 |

-

2022

- 2022-04-27 JP JP2022073380A patent/JP7112802B1/ja active Active

- 2022-07-15 JP JP2022113601A patent/JP2023163102A/ja active Pending

-

2023

- 2023-04-21 WO PCT/JP2023/016014 patent/WO2023210546A1/ja active Application Filing

-

2024

- 2024-10-25 US US18/927,625 patent/US20250053819A1/en active Pending

Patent Citations (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20200125956A1 (en) | 2017-05-20 | 2020-04-23 | Google Llc | Application Development Platform and Software Development Kits that Provide Comprehensive Machine Learning Services |

| US20200311552A1 (en) | 2019-03-25 | 2020-10-01 | Samsung Electronics Co., Ltd. | Device and method for compressing machine learning model |

| WO2022023022A1 (en) | 2020-07-28 | 2022-02-03 | Siemens Aktiengesellschaft | Method for automated determination of a model compression technique for compression of an artificial intelligence-based model |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2024237371A1 (ko) * | 2023-05-17 | 2024-11-21 | 주식회사 사피온코리아 | 인공 신경망 모델의 학습 도메인을 고려한 캘리브레이션 데이터셋 생성 및 이를 이용한 인공 신경망 모델의 최적화를 위한 방법 및 장치 |

Also Published As

| Publication number | Publication date |

|---|---|

| US20250053819A1 (en) | 2025-02-13 |

| JP2023162766A (ja) | 2023-11-09 |

| WO2023210546A1 (ja) | 2023-11-02 |

| JP2023163102A (ja) | 2023-11-09 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US20240273394A1 (en) | Method of determining fusion parameter, method of recommending information, and method of training model | |

| JP6774129B1 (ja) | 解析装置、解析方法及び解析プログラム | |

| CN110520871A (zh) | 训练机器学习模型 | |

| CN108921300A (zh) | 执行自动机器学习的方法和装置 | |

| JP2022033695A (ja) | モデルを生成するための方法、装置、電子機器、記憶媒体、及びコンピュータプログラム製品 | |

| US20240152809A1 (en) | Efficient machine learning model architecture selection | |

| US20210350175A1 (en) | Key-value memory network for predicting time-series metrics of target entities | |

| US20220253680A1 (en) | Sparse and differentiable mixture of experts neural networks | |

| US20250053819A1 (en) | Compression of learning model | |

| EP4189606A1 (en) | Neural architecture and hardware accelerator search | |

| CN112015990A (zh) | 待推荐网络资源的确定方法、装置、计算机设备及介质 | |

| WO2018220700A1 (ja) | 新規学習データセット生成方法、新規学習データセット生成装置および生成された学習データセットを用いた学習方法 | |

| EP3968648A1 (en) | Bitrate decision model training method and electronic device | |

| JP6942900B1 (ja) | 情報処理装置、情報処理方法及びプログラム | |

| JP2021193623A (ja) | 試験評価システム、プログラムおよび試験評価方法 | |

| US20230137995A1 (en) | Information processing method, storage medium, and information processing apparatus | |

| US20250053820A1 (en) | Computation graph | |

| JP2010204974A (ja) | 時系列データ予測装置 | |

| CN118093830A (zh) | 基于大语言模型的问题答案生成方法、装置、设备及介质 | |

| JP7199115B1 (ja) | 機械学習における分散学習 | |

| JP7078307B1 (ja) | 学習モデルの個別化 | |

| US20240152554A1 (en) | System and methods for generating contextual graphs and integrated uses thereof | |

| WO2025075038A1 (ja) | 情報処理装置、情報処理方法及びプログラム | |

| KR20250057392A (ko) | 인공 지능 기반의 헬스데이터 공유를 위한 플랫폼을 제공하는 방법 및 장치 | |

| CN111427935A (zh) | 量化交易指标的预测和显示方法、电子设备和介质 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20220427 |

|

| A871 | Explanation of circumstances concerning accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A871 Effective date: 20220427 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20220629 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20220715 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 7112802 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |