JP6866919B2 - 動画像復号装置、動画像復号方法、動画像復号プログラム、動画像符号化装置、動画像符号化方法及び動画像符号化プログラム - Google Patents

動画像復号装置、動画像復号方法、動画像復号プログラム、動画像符号化装置、動画像符号化方法及び動画像符号化プログラム Download PDFInfo

- Publication number

- JP6866919B2 JP6866919B2 JP2019239372A JP2019239372A JP6866919B2 JP 6866919 B2 JP6866919 B2 JP 6866919B2 JP 2019239372 A JP2019239372 A JP 2019239372A JP 2019239372 A JP2019239372 A JP 2019239372A JP 6866919 B2 JP6866919 B2 JP 6866919B2

- Authority

- JP

- Japan

- Prior art keywords

- prediction

- motion information

- motion vector

- block

- unit

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/137—Motion inside a coding unit, e.g. average field, frame or block difference

- H04N19/139—Analysis of motion vectors, e.g. their magnitude, direction, variance or reliability

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/107—Selection of coding mode or of prediction mode between spatial and temporal predictive coding, e.g. picture refresh

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/103—Selection of coding mode or of prediction mode

- H04N19/105—Selection of the reference unit for prediction within a chosen coding or prediction mode, e.g. adaptive choice of position and number of pixels used for prediction

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/102—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or selection affected or controlled by the adaptive coding

- H04N19/119—Adaptive subdivision aspects, e.g. subdivision of a picture into rectangular or non-rectangular coding blocks

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/134—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the element, parameter or criterion affecting or controlling the adaptive coding

- H04N19/136—Incoming video signal characteristics or properties

- H04N19/137—Motion inside a coding unit, e.g. average field, frame or block difference

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/10—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding

- H04N19/169—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding

- H04N19/17—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object

- H04N19/176—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using adaptive coding characterised by the coding unit, i.e. the structural portion or semantic portion of the video signal being the object or the subject of the adaptive coding the unit being an image region, e.g. an object the region being a block, e.g. a macroblock

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/42—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by implementation details or hardware specially adapted for video compression or decompression, e.g. dedicated software implementation

- H04N19/423—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by implementation details or hardware specially adapted for video compression or decompression, e.g. dedicated software implementation characterised by memory arrangements

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/44—Decoders specially adapted therefor, e.g. video decoders which are asymmetric with respect to the encoder

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/513—Processing of motion vectors

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/50—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding

- H04N19/503—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals using predictive coding involving temporal prediction

- H04N19/51—Motion estimation or motion compensation

- H04N19/513—Processing of motion vectors

- H04N19/517—Processing of motion vectors by encoding

- H04N19/52—Processing of motion vectors by encoding by predictive encoding

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N19/00—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals

- H04N19/70—Methods or arrangements for coding, decoding, compressing or decompressing digital video signals characterised by syntax aspects related to video coding, e.g. related to compression standards

Landscapes

- Engineering & Computer Science (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Compression Or Coding Systems Of Tv Signals (AREA)

Description

実施の形態では、所定の大きさで符号化・復号処理対象画像を均等分割する。この単位をツリーブロックと定義する。図4では、ツリーブロックのサイズを128x128画素としているが、ツリーブロックのサイズはこれに限定されるものではなく、任意のサイズを設定してよい。処理対象(符号化処理においては符号化対象、復号処理においては復号対象に対応する。)のツリーブロックは、ラスタスキャン順、すなわち左から右、上から下の順序で切り替わる。各ツリーブロックの内部は、さらに再帰的な分割が可能である。ツリーブロックを再帰的に分割した後の、符号化・復号の対象となるブロックを符号化ブロックと定義する。また、ツリーブロック、符号化ブロックを総称してブロックと定義する。適切なブロック分割を行うことにより効率的な符号化が可能となる。ツリーブロックのサイズは、符号化装置と復号装置で予め取り決めた固定値とすることもできるし、符号化装置が決定したツリーブロックのサイズを復号装置に伝送するような構成をとることもできる。ここでは、ツリーブロックの最大サイズを128x128画素、ツリーブロックの最小サイズを16x16画素とする。また、符号化ブロックの最大サイズを64x64画素、符号化ブロックの最小サイズを4x4画素とする。

処理対象符号化ブロック単位で、処理対象画像の処理済み画像信号から予測を行うイントラ予測(MODE_INTRA)、及び処理済み画像の画像信号から予測を行うインター予測(MODE_INTER)を切り替える。

処理済み画像は、符号化処理においては符号化が完了した信号を復号した画像、画像信号、ツリーブロック、ブロック、符号化ブロック等に用いられ、復号処理においては復号が完了した画像、画像信号、ツリーブロック、ブロック、符号化ブロック等に用いられる。

このイントラ予測(MODE_INTRA)とインター予測(MODE_INTER)を識別するモードを予測モード(PredMode)と定義する。予測モード(PredMode)はイントラ予測(MODE_INTRA)、またはインター予測(MODE_INTER)を値として持つ。

処理済み画像の画像信号から予測を行うインター予測では、複数の処理済み画像を参照ピクチャとして用いることができる。複数の参照ピクチャを管理するため、L0(参照リスト0)とL1(参照リスト1)の2種類の参照リストを定義し、それぞれ参照インデックスを用いて参照ピクチャを特定する。PスライスではL0予測(Pred_L0)が利用可能である。BスライスではL0予測(Pred_L0)、L1予測(Pred_L1)、双予測(Pred_BI)が利用可能である。L0予測(Pred_L0)はL0で管理されている参照ピクチャを参照するインター予測であり、L1予測(Pred_L1)はL1で管理されている参照ピクチャを参照するインター予測である。双予測(Pred_BI)はL0予測とL1予測が共に行われ、L0とL1のそれぞれで管理されている1つずつの参照ピクチャを参照するインター予測である。L0予測、L1予測、双予測を特定する情報を、インター予測モードと定義する。以降の処理において出力に添え字LXが付いている定数、変数に関しては、L0、L1ごとに処理が行われることを前提とする。

予測動きベクトルモードは、予測動きベクトルを特定するためのインデックス、差分動きベクトル、インター予測モード、参照インデックスを伝送し、処理対象ブロックのインター予測情報を決定するモードである。予測動きベクトルは、処理対象ブロックに隣接する処理済みブロック、または処理済み画像に属するブロックで処理対象ブロックと同一位置またはその付近(近傍)に位置するブロックから導出した予測動きベクトル候補と、予測動きベクトルを特定するためのインデックスから導出する。

マージモードは、差分動きベクトル、参照インデックスを伝送せずに、処理対象ブロックに隣接する処理済みブロック、または処理済み画像に属するブロックで処理対象ブロックと同一位置またはその付近(近傍)に位置するブロックのインター予測情報から、処理対象ブロックのインター予測情報を導出するモードである。

図11は、予測動きベクトルモード、マージモードで、インター予測情報を導出するために参照する参照ブロックを説明する図である。A0,A1,A2,B0,B1,B2,B3は、処理対象ブロックに隣接する処理済みブロックである。T0は、処理済み画像に属するブロックで、処理対象画像における処理対象ブロックと同一位置またはその付近(近傍)に位置するブロックである。

アフィン変換動き補償は、符号化ブロックを所定単位のサブブロックに分割し、分割された各サブブロックに対して個別に動きベクトルを決定して動き補償を行うものである。各サブブロックの動きベクトルは、処理対象ブロックに隣接する処理済みブロック、または処理済み画像に属するブロックで処理対象ブロックと同一位置またはその付近(近傍)に位置するブロックのインター予測情報から導出する1つ以上の制御点に基づき導出する。本実施の形態では、サブブロックのサイズを4x4画素とするが、サブブロックのサイズはこれに限定されるものではないし、画素単位で動きベクトルを導出してもよい。

図15に、制御点が3つの場合のアフィン変換動き補償の例を示す。この場合、3つの制御点が水平方向成分、垂直方向成分の2つのパラメータを有する。このため、制御点が3つの場合のアフィン変換を、6パラメータアフィン変換と呼称する。図15のCP1、CP2、CP3が制御点である。

図12、図13を用いて、インター予測に関するシンタックスを説明する。

図12のmerge_flagは、処理対象符号化ブロックをマージモードとするか、予測動きベクトルモードとするかを示すフラグである。merge_affine_flagは、マージモードの処理対象符号化ブロックでサブブロックマージモードを適用するか否かを示すフラグである。inter_affine_flagは、予測動きベクトルモードの処理対象符号化ブロックでサブブロック予測動きベクトルモードを適用するか否かを示すフラグである。cu_affine_type_flagは、サブブロック予測動きベクトルモードにおいて、制御点の数を決定するためのフラグである。

図13に各シンタックスエレメントの値と、それに対応する予測方法を示す。merge_flag=1,merge_affine_flag=0 は、通常マージモードに対応する。通常マージモードは、サブブロックマージでないマージモードである。merge_flag=1,merge_affine_flag=1は、サブブロックマージモードに対応する。merge_flag=0,inter_affine_flag=0は、通常予測動きベクトルモードに対応する。通常予測動きベクトルモードは、サブブロック予測動きベクトルモードでない予測動きベクトルマージである。merge_flag=0,inter_affine_flag=1は、サブブロック予測動きベクトルモードに対応する。merge_flag=0,inter_affine_flag=1の場合は、さらにcu_affine_type_flagを伝送し、制御点の数を決定する。

POC(Picture Order Count)は符号化されるピクチャに関連付けられる変数であり、ピクチャの出力順序に応じた1ずつ増加する値が設定される。POCの値によって、同じピクチャであるかを判別したり、出力順序でのピクチャ間の前後関係を判別したり、ピクチャ間の距離を導出したりすることができる。例えば、2つのピクチャのPOCが同じ値を持つ場合、同一のピクチャであると判断できる。2つのピクチャのPOCが違う値を持つ場合、POCの値が小さいピクチャのほうが、先に出力されるピクチャであると判断でき、2つのピクチャのPOCの差が時間軸方向でのピクチャ間距離を示す。

本発明の第1の実施の形態に係る画像符号化装置100及び画像復号装置200について説明する。

図10A及び図10Bにイントラ予測の例を示す。図10Aは、イントラ予測の予測方向とイントラ予測モード番号の対応を示したものである。例えば、イントラ予測モード50は、垂直方向に参照画素をコピーすることによりイントラ予測画像を生成する。イントラ予測モード1は、DCモードであり、処理対象ブロックのすべての画素値を参照画素の平均値とするモードである。イントラ予測モード0は、Planarモードであり、垂直方向・水平方向の参照画素から2次元的なイントラ予測画像を作成するモードである。図10Bは、イントラ予測モード40の場合のイントラ予測画像を生成する例である。イントラ予測部103は、処理対象ブロックの各画素に対し、イントラ予測モードの示す方向の参照画素の値をコピーする。イントラ予測部103は、イントラ予測モードの参照画素が整数位置でない場合には、周辺の整数位置の参照画素値から補間により参照画素値を決定する。

実施の形態に係るインター予測方法は、図1の画像符号化装置のインター予測部102および図2の画像復号装置のインター予測部203において実施される。

図16は図1の画像符号化装置のインター予測部102の詳細な構成を示す図である。通常予測動きベクトルモード導出部301は、複数の通常予測動きベクトル候補を導出して予測動きベクトルを選択し、選択した予測動きベクトルと、検出された動きベクトルとの差分動きベクトルを算出する。検出されたインター予測モード、参照インデックス、動きベクトル、算出された差分動きベクトルが通常予測動きベクトルモードのインター予測情報となる。このインター予測情報がインター予測モード判定部305に供給される。通常予測動きベクトルモード導出部301の詳細な構成と処理については後述する。

図22は図2の画像復号装置のインター予測部203の詳細な構成を示す図である。

図17の通常予測動きベクトルモード導出部301は、空間予測動きベクトル候補導出部321、時間予測動きベクトル候補導出部322、履歴予測動きベクトル候補導出部323、予測動きベクトル候補補充部325、通常動きベクトル検出部326、予測動きベクトル候補選択部327、動きベクトル減算部328を含む。

図19を参照して符号化側の通常予測動きベクトルモード導出処理手順を説明する。図19の処理手順の説明において、図19に示した通常という言葉を省略することがある。

mvdLX = mvLX - mvpLX

としてLXの差分動きベクトルmvdLXを算出する(図19のステップS105)。

次に、図25を参照して復号側の通常予測動きベクトルモード処理手順を説明する。復号側では、空間予測動きベクトル候補導出部421、時間予測動きベクトル候補導出部422、履歴予測動きベクトル候補導出部423、予測動きベクトル候補補充部425で、通常予測動きベクトルモードのインター予測で用いる動きベクトルをL0,L1毎にそれぞれ算出する(図25のステップS201〜S206)。具体的には処理対象ブロックの予測モードPredModeがインター予測(MODE_INTER)で、処理対象ブロックのインター予測モードがL0予測(Pred_L0)の場合、L0の予測動きベクトル候補リストmvpListL0を算出して、予測動きベクトルmvpL0を選択し、L0の動きベクトルmvL0を算出する。処理対象ブロックのインター予測モードがL1予測(Pred_L1)の場合、L1の予測動きベクトル候補リストmvpListL1を算出して、予測動きベクトルmvpL1を選択し、L1の動きベクトルmvL1を算出する。処理対象ブロックのインター予測モードが双予測(Pred_BI)の場合、L0予測とL1予測が共に行われ、L0の予測動きベクトル候補リストmvpListL0を算出して、L0の予測動きベクトルmvpL0を選択し、L0の動きベクトルmvL0を算出するとともに、L1の予測動きベクトル候補リストmvpListL1を算出して、L1の予測動きベクトルmvpL1を算出し、L1の動きベクトルmvL1をそれぞれ算出する。

mvLX = mvpLX + mvdLX

としてLXの動きベクトルmvLXを算出する(図25のステップS205)。

図20は本発明の実施の形態に係る画像符号化装置の通常予測動きベクトルモード導出部301及び画像復号装置の通常予測動きベクトルモード導出部401とで共通する機能を有する通常予測動きベクトルモード導出処理の処理手順を表すフローチャートである。

図18の通常マージモード導出部302は、空間マージ候補導出部341、時間マージ候補導出部342、平均マージ候補導出部344、履歴マージ候補導出部345、マージ候補補充部346、マージ候補選択部347を含む。

なお、マージ候補リストmergeCandList内に登録されているマージ候補数numCurrMergeCandが、最大マージ候補数MaxNumMergeCandより小さい場合、マージ候補リストmergeCandList内に登録されているマージ候補数numCurrMergeCandが最大マージ候補数MaxNumMergeCandを上限として履歴マージ候補は導出されて、マージ候補リストmergeCandListに登録される。

なお、マージ候補リストmergeCandList内に登録されているマージ候補数numCurrMergeCandが、最大マージ候補数MaxNumMergeCandより小さい場合、マージ候補リストmergeCandList内に登録されているマージ候補数numCurrMergeCandが最大マージ候補数MaxNumMergeCandを上限として平均マージ候補は導出されて、マージ候補リストmergeCandListに登録される。

ここで、平均マージ候補は、マージ候補リストmergeCandListに登録されている第1のマージ候補と第2のマージ候補の有する動きベクトルをL0予測及びL1予測毎に平均して得られる動きベクトルを有する新たなマージ候補である。

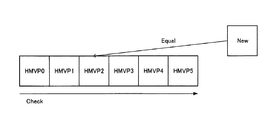

次に、符号化側の符号化情報格納メモリ111及び復号側の符号化情報格納メモリ205に備える履歴予測動きベクトル候補リストHmvpCandListの初期化方法および更新方法について詳細に説明する。図26は履歴予測動きベクトル候補リスト初期化・更新処理手順を説明するフローチャートである。

次に、符号化側の通常予測動きベクトルモード導出部301の履歴予測動きベクトル候補導出部323、復号側の通常予測動きベクトルモード導出部401の履歴予測動きベクトル候補導出部423で共通の処理である図20のステップS304の処理手順である履歴予測動きベクトル候補リストHmvpCandListからの履歴予測動きベクトル候補の導出方法について詳細に説明する。図29は履歴予測動きベクトル候補導出処理手順を説明するフローチャートである。

次に、符号化側の通常マージモード導出部302の履歴マージ候補導出部345、復号側の通常マージモード導出部402の履歴マージ候補導出部445で共通の処理である図21のステップS404の処理手順である履歴マージ候補リストHmvpCandListからの履歴マージ候補の導出方法について詳細に説明する。図30は履歴マージ候補導出処理手順を説明するフローチャートである。

履歴予測動きベクトル候補リストのすべての要素の確認が完了するか、マージ候補リストのすべての要素にマージ候補が追加されたら、本履歴マージ候補の導出処理を完了する。

動き補償予測部306は、符号化において現在予測処理の対象となっているブロックの位置およびサイズを取得する。また、動き補償予測部306は、インター予測情報をインター予測モード判定部305から取得する。取得したインター予測情報から参照インデックスおよび動きベクトルを導出し、復号画像メモリ104内の参照インデックスで特定される参照ピクチャを、動きベクトルの分だけ予測ブロックの画像信号と同一位置より移動させた位置の画像信号を取得した後に予測信号を生成する。

単一の参照ピクチャからの予測を行う処理を単予測と定義し、単予測の場合はL0予測またはL1予測という、参照リストL0、L1に登録された2つの参照ピクチャのいずれか一方を利用した予測を行う。

本発明の実施の形態では、動き補償予測の精度向上のために、動き補償予測において複数の参照ピクチャの中から最適な参照ピクチャを選択することを可能とする。そのため、動き補償予測で利用した参照ピクチャを参照インデックスとして利用するとともに、参照インデックスを差分動きベクトルとともにビットストリーム中に符号化する。

動き補償予測部306は、図16の符号化側におけるインター予測部102でも示されるように、インター予測モード判定部305において、通常予測動きベクトルモード導出部301によるインター予測情報が選択された場合には、このインター予測情報をインター予測モード判定部305から取得し、現在処理対象となっているブロックのインター予測モード、参照インデックス、動きベクトルを導出し、動き補償予測信号を生成する。生成された動き補償予測信号は、予測方法決定部105に供給される。

動き補償予測部306は、図16の符号化側におけるインター予測部102でも示されるように、インター予測モード判定部305において、通常マージモード導出部302によるインター予測情報が選択された場合には、このインター予測情報をインター予測モード判定部305から取得し、現在処理対象となっているブロックのインター予測モード、参照インデックス、動きベクトルを導出し、動き補償予測信号を生成する。生成された動き補償予測信号は、予測方法決定部105に供給される。

動き補償予測部306は、図16の符号化側におけるインター予測部102でも示されるように、インター予測モード判定部305において、サブブロック予測動きベクトルモード導出部303によるインター予測情報が選択された場合には、このインター予測情報をインター予測モード判定部305から取得し、現在処理対象となっているブロックのインター予測モード、参照インデックス、動きベクトルを導出し、動き補償予測信号を生成する。生成された動き補償予測信号は、予測方法決定部105に供給される。

動き補償予測部306は、図16の符号化側におけるインター予測部102でも示されるように、インター予測モード判定部305において、サブブロックマージモード導出部304によるインター予測情報が選択された場合には、このインター予測情報をインター予測モード判定部305から取得し、現在処理対象となっているブロックのインター予測モード、参照インデックス、動きベクトルを導出し、動き補償予測信号を生成する。生成された動き補償予測信号は、予測方法決定部105に供給される。

通常予測動きベクトルモード、および通常マージモードでは、以下のフラグに基づいてアフィンモデルによる動き補償が利用できる。以下のフラグは、符号化処理においてインター予測モード判定部305により決定されるインター予測の条件に基づいて以下のフラグに反映され、ビットストリーム中に符号化される。復号処理においては、ビットストリーム中の以下のフラグに基づいてアフィンモデルによる動き補償を行うか否かを特定する。

第2の実施の形態では、通常予測動きベクトルモードの予測動きベクトル候補リスト生成において、時間予測動きベクトル候補を導出せず、空間予測動きベクトル候補、履歴予測動きベクトル候補の順に候補の追加を行う。

図38は、第2の実施の形態における、図16の通常予測動きベクトルモード導出部301の詳細な構成のブロック図である。

図39は、第2の実施の形態における、図22の通常予測動きベクトルモード導出部401の詳細な構成のブロック図である。

第2の実施の形態では、時間予測動きベクトル候補を導出せずに予測動きベクトル候補リストを生成するため、処理負荷を軽減させることができる。また、通常予測動きベクトルモードでは、履歴予測動きベクトル候補で十分に予測動きベクトル候補リストを満たせるため、符号化効率も低下しない。

第3の実施の形態では、通常予測動きベクトルモードの予測動きベクトル候補リスト生成において、空間予測動きベクトル候補、時間予測動きベクトル候補、履歴予測動きベクトル候補の順に候補の追加を行う。ここで、履歴予測動きベクトル候補導出処理において、空間予測動きベクトル候補、及び、時間予測動きベクトル候補との同一要素確認を行わない。

Claims (8)

- 復号対象ブロックに空間的に近接するブロックの動き情報から空間動き情報候補を導出する空間動き情報候補導出部と、

復号対象ブロックに時間的に近接するブロックの動き情報から時間動き情報候補を導出する時間動き情報候補導出部と、

復号済ブロックの動き情報を保持するメモリから履歴動き情報候補を導出する履歴動き情報候補導出部と、

を備え、

前記履歴動き情報候補は、前記空間動き情報候補との動き情報の比較が行われ、前記時間動き情報候補との動き情報の比較が行われない、

ことを特徴とする動画像復号装置。

- 動画像復号装置における動画像復号方法であって、

復号対象ブロックに空間的に近接するブロックの動き情報から空間動き情報候補を導出するステップと、

復号対象ブロックに時間的に近接するブロックの動き情報から時間動き情報候補を導出するステップと、

復号済ブロックの動き情報を保持するメモリから履歴動き情報候補を導出するステップと、

を有し、

前記時間動き情報候補は、前記空間動き情報候補との動き情報の比較が行われ、前記時間動き情報候補との動き情報の比較が行われない、

ことを特徴とする動画像復号方法。 - コンピュータを、

復号対象ブロックに空間的に近接するブロックの動き情報から空間動き情報候補を導出するステップと、

復号対象ブロックに時間的に近接するブロックの動き情報から時間動き情報候補を導出するステップと、

復号済ブロックの動き情報を保持するメモリから履歴動き情報候補を導出するステップと、

として機能させるための動画像復号プログラムであって、

前記時間動き情報候補は、前記空間動き情報候補との動き情報の比較が行われ、前記時間動き情報候補との動き情報の比較が行われない、

ことを特徴とする動画像復号プログラム。 - 符号化対象ブロックに空間的に近接するブロックの動き情報から空間動き情報候補を導出する空間動き情報候補導出部と、

符号化対象ブロックに時間的に近接するブロックの動き情報から時間動き情報候補を導出する時間動き情報候補導出部と、

符号化済ブロックの動き情報を保持するメモリから履歴動き情報候補を導出する履歴動き情報候補導出部と、

を備え、

前記時間動き情報候補は、前記空間動き情報候補との動き情報の比較が行われ、前記時間動き情報候補との動き情報の比較が行われない、

ことを特徴とする動画像符号化装置。 - 動画像符号化装置における動画像符号化方法であって、

符号化対象ブロックに空間的に近接するブロックの動き情報から空間動き情報候補を導出するステップと、

符号化対象ブロックに時間的に近接するブロックの動き情報から時間動き情報候補を導出するステップと、

符号化済ブロックの動き情報を保持するメモリから履歴動き情報候補を導出するステップと、

を有し、

前記時間動き情報候補は、前記空間動き情報候補との動き情報の比較が行われ、前記時間動き情報候補との動き情報の比較が行われない、

ことを特徴とする動画像符号化方法。 - コンピュータを、

符号化対象ブロックに空間的に近接するブロックの動き情報から空間動き情報候補を導出するステップと、

符号化対象ブロックに時間的に近接するブロックの動き情報から時間動き情報候補を導出するステップと、

符号化済ブロックの動き情報を保持するメモリから履歴動き情報候補を導出するステップと、

として機能させるための動画像符号化プログラムであって、

前記時間動き情報候補は、前記空間動き情報候補との動き情報の比較が行われ、前記時間動き情報候補との動き情報の比較が行われない、

ことを特徴とする動画像符号化プログラム。 - 前記空間動き情報候補との動き情報の比較をせず前記時間動き情報候補を動き情報候補リストに登録し、前記空間動き情報候補と動き情報候補が同一でない場合に前記履歴動き情報候補を前記動き情報候補リストに登録する、

ことを特徴とする請求項1に記載の動画像復号装置。

- 前記空間動き情報候補、前記時間動き情報候補、前記履歴動き情報候補の順に前記動き情報候補リストへの登録を行う、

ことを特徴とする請求項7に記載の動画像復号装置。

Priority Applications (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2021045720A JP7140224B2 (ja) | 2018-12-28 | 2021-03-19 | 動画像復号装置、動画像復号方法、動画像復号プログラム、動画像符号化装置、動画像符号化方法及び動画像符号化プログラム |

| JP2021193044A JP7405127B2 (ja) | 2018-12-28 | 2021-11-29 | 画像復号装置、画像復号方法及び画像復号プログラム |

| JP2023211396A JP2024023678A (ja) | 2018-12-28 | 2023-12-14 | 画像復号装置、画像復号方法及び画像復号プログラム |

| JP2024035709A JP2024053072A (ja) | 2018-12-28 | 2024-03-08 | 画像復号装置、画像復号方法及び画像復号プログラム |

Applications Claiming Priority (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2018247407 | 2018-12-28 | ||

| JP2018247407 | 2018-12-28 | ||

| JP2019063065 | 2019-03-28 | ||

| JP2019063065 | 2019-03-28 |

Related Child Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2021045720A Division JP7140224B2 (ja) | 2018-12-28 | 2021-03-19 | 動画像復号装置、動画像復号方法、動画像復号プログラム、動画像符号化装置、動画像符号化方法及び動画像符号化プログラム |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2020167663A JP2020167663A (ja) | 2020-10-08 |

| JP2020167663A5 JP2020167663A5 (ja) | 2021-04-01 |

| JP6866919B2 true JP6866919B2 (ja) | 2021-04-28 |

Family

ID=71128684

Family Applications (5)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2019239372A Active JP6866919B2 (ja) | 2018-12-28 | 2019-12-27 | 動画像復号装置、動画像復号方法、動画像復号プログラム、動画像符号化装置、動画像符号化方法及び動画像符号化プログラム |

| JP2021045720A Active JP7140224B2 (ja) | 2018-12-28 | 2021-03-19 | 動画像復号装置、動画像復号方法、動画像復号プログラム、動画像符号化装置、動画像符号化方法及び動画像符号化プログラム |

| JP2021193044A Active JP7405127B2 (ja) | 2018-12-28 | 2021-11-29 | 画像復号装置、画像復号方法及び画像復号プログラム |

| JP2023211396A Pending JP2024023678A (ja) | 2018-12-28 | 2023-12-14 | 画像復号装置、画像復号方法及び画像復号プログラム |

| JP2024035709A Pending JP2024053072A (ja) | 2018-12-28 | 2024-03-08 | 画像復号装置、画像復号方法及び画像復号プログラム |

Family Applications After (4)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2021045720A Active JP7140224B2 (ja) | 2018-12-28 | 2021-03-19 | 動画像復号装置、動画像復号方法、動画像復号プログラム、動画像符号化装置、動画像符号化方法及び動画像符号化プログラム |

| JP2021193044A Active JP7405127B2 (ja) | 2018-12-28 | 2021-11-29 | 画像復号装置、画像復号方法及び画像復号プログラム |

| JP2023211396A Pending JP2024023678A (ja) | 2018-12-28 | 2023-12-14 | 画像復号装置、画像復号方法及び画像復号プログラム |

| JP2024035709A Pending JP2024053072A (ja) | 2018-12-28 | 2024-03-08 | 画像復号装置、画像復号方法及び画像復号プログラム |

Country Status (10)

| Country | Link |

|---|---|

| US (4) | US11503283B2 (ja) |

| EP (1) | EP3905686A4 (ja) |

| JP (5) | JP6866919B2 (ja) |

| KR (2) | KR102606883B1 (ja) |

| CN (1) | CN113287314A (ja) |

| BR (1) | BR112021012414A2 (ja) |

| CA (1) | CA3129872A1 (ja) |

| MX (1) | MX2021007756A (ja) |

| RU (1) | RU2768375C1 (ja) |

| WO (1) | WO2020137888A1 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2021100285A (ja) * | 2018-12-28 | 2021-07-01 | 株式会社Jvcケンウッド | 動画像復号装置、動画像復号方法、動画像復号プログラム、動画像符号化装置、動画像符号化方法及び動画像符号化プログラム |

Families Citing this family (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN113039800B (zh) | 2018-11-16 | 2024-05-10 | 北京字节跳动网络技术有限公司 | 用于基于历史的仿射参数的修剪方法 |

| CN113491125A (zh) * | 2019-02-22 | 2021-10-08 | 北京字节跳动网络技术有限公司 | 基于历史的仿射模式子表 |

Family Cites Families (17)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP3277111B2 (ja) | 1995-10-18 | 2002-04-22 | シャープ株式会社 | 動画像符号化装置および動画像復号化装置 |

| US8514933B2 (en) | 2005-03-01 | 2013-08-20 | Qualcomm Incorporated | Adaptive frame skipping techniques for rate controlled video encoding |

| US9313494B2 (en) * | 2011-06-20 | 2016-04-12 | Qualcomm Incorporated | Parallelization friendly merge candidates for video coding |

| HUE052897T2 (hu) * | 2011-06-27 | 2021-05-28 | Samsung Electronics Co Ltd | Mozgásinformáció kódolása és dekódolása |

| KR102014332B1 (ko) * | 2011-10-21 | 2019-08-26 | 노키아 테크놀로지스 오와이 | 비디오 코딩 방법 및 장치 |

| US9571833B2 (en) | 2011-11-04 | 2017-02-14 | Nokia Technologies Oy | Method for coding and an apparatus |

| KR20130050149A (ko) | 2011-11-07 | 2013-05-15 | 오수미 | 인터 모드에서의 예측 블록 생성 방법 |

| CN103999464B (zh) * | 2011-12-28 | 2017-09-26 | Jvc建伍株式会社 | 动图像解码装置、动图像解码方法、接收装置及接收方法 |

| US9300906B2 (en) * | 2013-03-29 | 2016-03-29 | Google Inc. | Pull frame interpolation |

| JP6430542B2 (ja) | 2014-06-16 | 2018-11-28 | クゥアルコム・インコーポレイテッドQualcomm Incorporated | 3d−hevcにおける簡略化シフティングマージ候補およびマージリスト導出 |

| CN110662054B (zh) | 2018-06-29 | 2023-01-06 | 北京字节跳动网络技术有限公司 | 用于视频处理的方法、装置、计算机可读存储介质 |

| US10785582B2 (en) | 2018-12-10 | 2020-09-22 | Starkey Laboratories, Inc. | Ear-worn electronic hearing device incorporating an antenna with cutouts |

| KR102616766B1 (ko) | 2018-09-22 | 2023-12-27 | 엘지전자 주식회사 | 인터 예측을 기반으로 비디오 신호를 처리하기 위한 방법 및 장치 |

| TWI818086B (zh) | 2018-09-24 | 2023-10-11 | 大陸商北京字節跳動網絡技術有限公司 | 擴展Merge預測 |

| US11470340B2 (en) * | 2018-12-10 | 2022-10-11 | Tencent America LLC | Simplified merge list construction for small coding blocks |

| CN116389749A (zh) * | 2018-12-28 | 2023-07-04 | Jvc建伍株式会社 | 动图像解码装置和方法、以及动图像编码装置和方法 |

| MX2021007756A (es) | 2018-12-28 | 2021-08-05 | Jvckenwood Corp | Dispositivo de decodificacion de imagenes dinamicas, metodo de decodificacion de imagenes dinamicas, programa de decodificacion de imagenes dinamicas, dispositivo de codificacion de imagenes dinamicas, metodo de codificacion de imagenes dinamicas, programa de codificacion de imagenes dinamicas. |

-

2019

- 2019-12-20 MX MX2021007756A patent/MX2021007756A/es unknown

- 2019-12-20 RU RU2021121169A patent/RU2768375C1/ru active

- 2019-12-20 EP EP19903254.1A patent/EP3905686A4/en active Pending

- 2019-12-20 CN CN201980050793.9A patent/CN113287314A/zh active Pending

- 2019-12-20 US US17/417,351 patent/US11503283B2/en active Active

- 2019-12-20 KR KR1020217003084A patent/KR102606883B1/ko active IP Right Grant

- 2019-12-20 BR BR112021012414-4A patent/BR112021012414A2/pt unknown

- 2019-12-20 CA CA3129872A patent/CA3129872A1/en active Pending

- 2019-12-20 WO PCT/JP2019/050103 patent/WO2020137888A1/ja unknown

- 2019-12-20 KR KR1020237040331A patent/KR20230163002A/ko not_active Application Discontinuation

- 2019-12-27 JP JP2019239372A patent/JP6866919B2/ja active Active

-

2021

- 2021-03-19 JP JP2021045720A patent/JP7140224B2/ja active Active

- 2021-11-29 JP JP2021193044A patent/JP7405127B2/ja active Active

-

2022

- 2022-10-07 US US17/962,421 patent/US11856190B2/en active Active

-

2023

- 2023-06-15 US US18/210,559 patent/US20230328236A1/en active Pending

- 2023-06-15 US US18/210,512 patent/US20230328235A1/en active Pending

- 2023-12-14 JP JP2023211396A patent/JP2024023678A/ja active Pending

-

2024

- 2024-03-08 JP JP2024035709A patent/JP2024053072A/ja active Pending

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2021100285A (ja) * | 2018-12-28 | 2021-07-01 | 株式会社Jvcケンウッド | 動画像復号装置、動画像復号方法、動画像復号プログラム、動画像符号化装置、動画像符号化方法及び動画像符号化プログラム |

Also Published As

| Publication number | Publication date |

|---|---|

| RU2022106266A (ru) | 2022-03-17 |

| JP2024023678A (ja) | 2024-02-21 |

| RU2768375C1 (ru) | 2022-03-24 |

| JP2022036089A (ja) | 2022-03-04 |

| KR102606883B1 (ko) | 2023-11-24 |

| CN113287314A (zh) | 2021-08-20 |

| US11856190B2 (en) | 2023-12-26 |

| US20230031647A1 (en) | 2023-02-02 |

| KR20210022757A (ko) | 2021-03-03 |

| MX2021007756A (es) | 2021-08-05 |

| EP3905686A4 (en) | 2022-10-19 |

| JP7405127B2 (ja) | 2023-12-26 |

| US20220078411A1 (en) | 2022-03-10 |

| JP2020167663A (ja) | 2020-10-08 |

| EP3905686A1 (en) | 2021-11-03 |

| BR112021012414A2 (pt) | 2021-09-08 |

| JP7140224B2 (ja) | 2022-09-21 |

| US20230328236A1 (en) | 2023-10-12 |

| US11503283B2 (en) | 2022-11-15 |

| JP2021100285A (ja) | 2021-07-01 |

| KR20230163002A (ko) | 2023-11-29 |

| US20230328235A1 (en) | 2023-10-12 |

| CA3129872A1 (en) | 2020-07-02 |

| WO2020137888A1 (ja) | 2020-07-02 |

| JP2024053072A (ja) | 2024-04-12 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6864841B2 (ja) | 画像符号化装置、画像符号化方法、画像符号化プログラム、画像復号装置、画像復号方法及び画像復号プログラム | |

| JP6866919B2 (ja) | 動画像復号装置、動画像復号方法、動画像復号プログラム、動画像符号化装置、動画像符号化方法及び動画像符号化プログラム | |

| JP6911912B2 (ja) | 画像符号化装置、画像符号化方法、画像符号化プログラム、画像復号装置、画像復号方法及び画像復号プログラム | |

| JP6763467B2 (ja) | 画像符号化装置、画像符号化方法、画像符号化プログラム、画像復号装置、画像復号方法及び画像復号プログラム | |

| JP2024053073A (ja) | 動画像符号化装置、動画像符号化方法、及び動画像符号化プログラム、動画像復号装置、動画像復号方法及び動画像復号プログラム | |

| JP7060773B2 (ja) | 画像復号装置、画像復号方法及び画像復号プログラム | |

| JP6936448B2 (ja) | 画像符号化装置、画像符号化方法、画像符号化プログラム、画像復号装置、画像復号方法及び画像復号プログラム | |

| JP6950847B2 (ja) | 動画像符号化装置、動画像符号化方法、及び動画像符号化プログラム、動画像復号装置、動画像復号方法及び動画像復号プログラム | |

| WO2020137857A1 (ja) | 画像符号化装置、画像符号化方法、画像符号化プログラム、画像復号装置、画像復号方法及び画像復号プログラム | |

| JP2022046468A (ja) | 画像符号化装置、画像符号化方法、画像符号化プログラム、画像復号装置、画像復号方法及び画像復号プログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20210204 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20210204 |

|

| A871 | Explanation of circumstances concerning accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A871 Effective date: 20210204 |

|

| A975 | Report on accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A971005 Effective date: 20210304 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20210309 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20210322 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6866919 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |