JP6856906B2 - 自律走行車両レベル4を満たすために領域のクラスに応じてモードを切り換えるためにグリッド生成器を利用するニューラルネットワーク演算方法及びこれを利用した装置 - Google Patents

自律走行車両レベル4を満たすために領域のクラスに応じてモードを切り換えるためにグリッド生成器を利用するニューラルネットワーク演算方法及びこれを利用した装置 Download PDFInfo

- Publication number

- JP6856906B2 JP6856906B2 JP2020002012A JP2020002012A JP6856906B2 JP 6856906 B2 JP6856906 B2 JP 6856906B2 JP 2020002012 A JP2020002012 A JP 2020002012A JP 2020002012 A JP2020002012 A JP 2020002012A JP 6856906 B2 JP6856906 B2 JP 6856906B2

- Authority

- JP

- Japan

- Prior art keywords

- test

- neural network

- learning

- pair

- information

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/08—Learning methods

-

- B—PERFORMING OPERATIONS; TRANSPORTING

- B60—VEHICLES IN GENERAL

- B60W—CONJOINT CONTROL OF VEHICLE SUB-UNITS OF DIFFERENT TYPE OR DIFFERENT FUNCTION; CONTROL SYSTEMS SPECIALLY ADAPTED FOR HYBRID VEHICLES; ROAD VEHICLE DRIVE CONTROL SYSTEMS FOR PURPOSES NOT RELATED TO THE CONTROL OF A PARTICULAR SUB-UNIT

- B60W60/00—Drive control systems specially adapted for autonomous road vehicles

- B60W60/001—Planning or execution of driving tasks

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/21—Design or setup of recognition systems or techniques; Extraction of features in feature space; Blind source separation

- G06F18/214—Generating training patterns; Bootstrap methods, e.g. bagging or boosting

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/21—Design or setup of recognition systems or techniques; Extraction of features in feature space; Blind source separation

- G06F18/2163—Partitioning the feature space

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/21—Design or setup of recognition systems or techniques; Extraction of features in feature space; Blind source separation

- G06F18/217—Validation; Performance evaluation; Active pattern learning techniques

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/24—Classification techniques

- G06F18/241—Classification techniques relating to the classification model, e.g. parametric or non-parametric approaches

- G06F18/2413—Classification techniques relating to the classification model, e.g. parametric or non-parametric approaches based on distances to training or reference patterns

- G06F18/24133—Distances to prototypes

- G06F18/24143—Distances to neighbourhood prototypes, e.g. restricted Coulomb energy networks [RCEN]

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F18/00—Pattern recognition

- G06F18/20—Analysing

- G06F18/24—Classification techniques

- G06F18/243—Classification techniques relating to the number of classes

- G06F18/2431—Multiple classes

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

- G06N3/045—Combinations of networks

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/764—Arrangements for image or video recognition or understanding using pattern recognition or machine learning using classification, e.g. of video objects

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V10/00—Arrangements for image or video recognition or understanding

- G06V10/70—Arrangements for image or video recognition or understanding using pattern recognition or machine learning

- G06V10/82—Arrangements for image or video recognition or understanding using pattern recognition or machine learning using neural networks

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/50—Context or environment of the image

- G06V20/56—Context or environment of the image exterior to a vehicle by using sensors mounted on the vehicle

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/50—Context or environment of the image

- G06V20/56—Context or environment of the image exterior to a vehicle by using sensors mounted on the vehicle

- G06V20/58—Recognition of moving objects or obstacles, e.g. vehicles or pedestrians; Recognition of traffic objects, e.g. traffic signs, traffic lights or roads

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20081—Training; Learning

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/20—Special algorithmic details

- G06T2207/20084—Artificial neural networks [ANN]

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30248—Vehicle exterior or interior

- G06T2207/30252—Vehicle exterior; Vicinity of vehicle

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Data Mining & Analysis (AREA)

- Evolutionary Computation (AREA)

- Artificial Intelligence (AREA)

- General Engineering & Computer Science (AREA)

- Life Sciences & Earth Sciences (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Health & Medical Sciences (AREA)

- Software Systems (AREA)

- General Health & Medical Sciences (AREA)

- Computing Systems (AREA)

- Multimedia (AREA)

- Evolutionary Biology (AREA)

- Bioinformatics & Cheminformatics (AREA)

- Bioinformatics & Computational Biology (AREA)

- Mathematical Physics (AREA)

- Biomedical Technology (AREA)

- Biophysics (AREA)

- Computational Linguistics (AREA)

- Molecular Biology (AREA)

- Medical Informatics (AREA)

- Databases & Information Systems (AREA)

- Automation & Control Theory (AREA)

- Transportation (AREA)

- Human Computer Interaction (AREA)

- Mechanical Engineering (AREA)

- Image Analysis (AREA)

- Business, Economics & Management (AREA)

- Game Theory and Decision Science (AREA)

- Aviation & Aerospace Engineering (AREA)

- Radar, Positioning & Navigation (AREA)

- Remote Sensing (AREA)

Description

Claims (20)

- グリッド生成器を利用したニューラルネットワーク演算方法において、

(a)コンピュータ装置が、テストイメージが取得されると、ペア検出器(pair detector)をもって、前記テストイメージ上に存在するテスト用物体と前記テスト用物体に対応するテスト用非物体とを含む一つ以上のテスト用ペアを検出して、前記テスト用ペアに関するクラス情報と位置情報とを取得させるようにする段階;

(b)前記コンピュータ装置が、前記グリッド生成器をもって、前記テストペアに関する位置情報を参照して、前記テストイメージ内の複数個のサブセクションに関する情報を含むセクション情報を生成させる段階;

(c)前記コンピュータ装置が、ニューラルネットワークをもって、前記ニューラルネットワーク演算を前記テスト用ペアそれぞれを含む前記サブセクションのうち少なくとも一部それぞれに適用するのに使用されるテスト用パラメータを決定し、前記テスト用ペアに関する前記クラス情報と同一又は類似するクラス情報を有する学習用ペアに関する情報を利用して学習された学習用パラメータを参照して決定させる段階;及び

(d)前記コンピュータ装置が、前記ニューラルネットワークをもって、前記サブセクションのうち前記少なくとも一部それぞれに対応するそれぞれの前記テスト用パラメータを利用して、前記テストイメージに前記ニューラルネットワーク演算を適用することにより、一つ以上のニューラルネットワーク結果を出力させる段階;

を含むことを特徴とする方法。 - 前記(b)段階で、

前記グリッド生成器が、可変テンプレート(dynamic template)を利用して前記テストイメージを分け、(i)前記テンプレートペアのうち少なくとも一つが前記可変テンプレートの前記サブセクションの前記少なくとも一部それぞれに含まれるように一つ以上の境界線が調整された前記可変テンプレートが提供されることを特徴とする請求項1に記載の方法。 - 前記グリッド生成器が、前記可変テンプレートに関する情報を管理し、前記可変テンプレートは、(i)第1方向の少なくとも一つの第1境界線及び(ii)第2方向の少なくとも一つの第2境界線のうち少なくとも一部を含み、このうち一部は調整可能であることを特徴とする請求項2に記載の方法。

- 前記可変テンプレートは、行グループ(row group)と一つ以上の列グループ(column group)とを含み、前記行グループは(i)上段行グループ、(ii)前記列グループのうち少なくとも一部を含む中段行グループ、及び (iii)下段行グループを含み、前記テスト用ペアのうち少なくとも一つが前記行グループと前記列グループとによって形成される前記サブセクションのうち前記少なくとも一部それぞれに含まれることを特徴とする請求項2に記載の方法。

- 前記(a)段階以前に、

(a0)前記コンピュータ装置が、前記ニューラルネットワークをもって、一つ以上のトレーニングイメージに含まれるそれぞれの前記学習用ペアに関する情報を利用して、前記学習用パラメータを学習させる段階;

をさらに含むことを特徴とする請求項1に記載の方法。 - 前記(a0)段階で、

前記ニューラルネットワークは、前記トレーニングイメージ内に含まれた第1分割領域ないし第k分割領域までの分割領域のうち少なくとも一部それぞれに含まれるそれぞれの前記学習用ペアに関する情報を利用して、前記学習用パラメータを学習し、前記学習用ペアに関するクラス情報を、前記学習用ペアに対応する学習用パラメータと連動して格納することを特徴とする請求項5に記載の方法。 - 前記それぞれのトレーニングイメージ内の前記第1分割領域ないし前記第k分割領域の位置情報を第1位置情報ないし第k位置情報とするとき、前記トレーニングイメージそれぞれの第1位置情報の相対的な偏差ないし前記第k位置情報の相対的な偏差のうち少なくとも一部それぞれが設定済み閾値以下に該当すれば、それを前記トレーニングイメージとして選定することを特徴とする請求項6に記載の方法。

- 前記(c)段階で、

(i)特定のテスト用物体の面積が前記特定のテスト用物体による特定のサブセクションに含まれた特定のテスト用非物体の面積を超過する場合、前記コンピュータ装置は、前記特定のテスト用物体と前記特定のテスト用非物体とを含む特定のテスト用ペアが第1クラス情報を有するものと決定し、前記ニューラルネットワークをもって、前記学習用パラメータのうち少なくとも一つの第1特定の学習用パラメータを参照して、前記ニューラルネットワーク演算を前記特定のサブセクションに適用するのに使用される、前記テスト用パラメータのうち少なくとも一つの特定のテスト用パラメータを決定するようにし、(ii)前記特定のテスト用物体の前記面積が、前記特定のテスト用非物体の前記面積以下である場合、前記コンピュータ装置は前記特定のテスト用物体と前記特定のテスト用非物体とを含む特定のテスト用ペアが第2クラス情報を有するものと決定し、前記ニューラルネットワークをもって、前記学習用パラメータのうち少なくとも一つの第2特定の学習用パラメータを参照して、前記ニューラルネットワーク演算を前記特定のサブセクションに適用するのに使用される、前記テスト用パラメータのうち少なくとも一つの特定のテスト用パラメータを決定させることを特徴とする請求項6に記載の方法。 - 前記(d)段階で、

前記コンピュータ装置が、前記ニューラルネットワークをもって、前記テスト用パラメータを利用して前記テストイメージに一つ以上のコンボリューション演算と一つ以上のデコンボリューション演算とを適用して、前記ニューラルネットワーク結果を出力させることを特徴とする請求項1に記載の方法。 - 前記テストイメージは道路走行状況を示し、前記テスト用物体は道路上で現れ得る物体を示し、前記ニューラルネットワーク結果は自律走行のために使用されることを特徴とする請求項9に記載の方法。

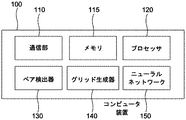

- グリッド生成器を利用したニューラルネットワーク演算をするためのコンピュータ装置において、

各インストラクションを格納する少なくとも一つのメモリ;及び

(I)ペア検出器をもって、前記テストイメージ上に存在するテスト用物体と前記テスト用物体に対応するテスト用非物体とを含む一つ以上のテスト用ペアを検出して、前記テスト用ペアに関するクラス情報と位置情報とを取得させるプロセス、(II)前記グリッド生成器をもって、前記テスト用ペアに関する前記位置情報を参照して、前記テストイメージ内の複数個のサブセクションに関する情報を含むセクション情報を生成させるプロセス、(III)ニューラルネットワークをもって、前記ニューラルネットワーク演算を前記テスト用ペアそれぞれを含む前記サブセクションのうち少なくとも一部それぞれに適用するのに使用されるテスト用パラメータを決定させ、前記テスト用ペアに関する前記クラス情報と同一または類似するクラス情報を有する学習用ペアに関する情報を利用して学習された学習用パラメータを参照して決定させるプロセス;及び(IV)前記ニューラルネットワークをもって、前記サブセクションのうち前記少なくとも一部それぞれに対応するそれぞれの前記テスト用パラメータを利用して、前記テストイメージに前記ニューラルネットワーク演算を適用することにより、一つ以上のニューラルネットワーク結果を出力させるプロセスを遂行するための前記インストラクションを実行するように構成された少なくとも一つのプロセッサ;

を含むことを特徴とするコンピュータ装置。 - 前記(II)プロセスで、

前記グリッド生成器が、可変テンプレートを利用して前記テストイメージを分け、(i)前記テスト用ペアのうち少なくとも一つが、前記可変テンプレートの前記サブセクションの前記少なくとも一部それぞれに含まれるように一つ以上の境界線が調整された前記可変テンプレートが提供されることを特徴とする請求項11に記載のコンピュータ装置。 - 前記グリッド生成器が、前記可変テンプレートに関する情報を管理し、前記可変テンプレートは(i)第1方向の少なくとも一つの第1境界線及び(ii)第2方向の少なくとも一つの第2境界線のうち少なくとも一部を含み、このうち一部は調整可能であることを特徴とする請求項12に記載のコンピュータ装置。

- 前記可変テンプレートは、行グループと一つ以上の列グループを含み、前記行グループは(i)上段行グループ、(ii)前記列グループのうち少なくとも一部を含む中段行グループ、及び(iii)下段行グループを含み、前記テスト用ペアのうち少なくとも一つが前記行グループと前記列グループとによって形成される前記サブセクションのうち前記少なくとも一部それぞれに含まれることを特徴とする請求項12に記載のコンピュータ装置。

- 前記(I)プロセス以前に、

前記プロセッサが、(0)前記ニューラルネットワークをもって、一つ以上のトレーニングイメージに含まれるそれぞれの前記学習用ペアに関する情報を利用して、前記学習用パラメータを学習させるプロセスをさらに遂行することを特徴とする請求項11に記載のコンピュータ装置。 - 前記(0)プロセスで、

前記ニューラルネットワークは、前記トレーニングイメージ内に含まれた第1分割領域ないし第k分割領域までの分割領域のうち少なくとも一部それぞれに含まれるそれぞれの前記学習用ペアに関する情報を利用して、前記学習用パラメータを学習し、前記学習用ペアに関するクラス情報を、前記学習用ペアに対応する学習用パラメータと連動して格納することを特徴とする請求項15に記載のコンピュータ装置。 - 前記それぞれのトレーニングイメージ内の前記第1分割領域ないし前記第k分割領域の位置情報を第1位置情報ないし第k位置情報とするとき、前記トレーニングイメージそれぞれの第1位置情報の相対的な偏差ないし前記第k位置情報の相対的な偏差のうち少なくとも一部それぞれが設定済み閾値以下に該当すれば、それを前記トレーニングイメージとして選定することを特徴とする請求項16に記載のコンピュータ装置。

- 前記(III)プロセスで、

(i)特定のテスト用物体の面積が前記特定のテスト用物体による特定のサブセクションに含まれた特定のテスト用非物体の面積を超過する場合、前記プロセッサは、前記特定のテスト用物体と前記特定のテスト用非物体とを含む特定のテスト用ペアが第1クラス情報を有するものと決定し、前記ニューラルネットワークをもって、前記学習用パラメータのうち少なくとも一つの第1特定の学習用パラメータを参照して、前記ニューラルネットワーク演算を前記特定のサブセクションに適用するのに使用される、前記テスト用パラメータのうち少なくとも一つの特定のテスト用パラメータを決定するようにし、(ii)前記特定のテスト用物体の前記面積が、前記特定のテスト用非物体の前記面積以下である場合、前記プロセッサは前記特定のテスト用物体と前記特定のテスト用非物体とを含む特定のテスト用ペアが第2クラス情報を有するものと決定し、前記ニューラルネットワークをもって、前記学習用パラメータのうち少なくとも一つの第2特定の学習用パラメータを参照して、前記ニューラルネットワーク演算を前記特定のサブセクションに適用するのに使用される、前記テスト用パラメータのうち少なくとも一つの特定のテスト用パラメータを決定させることを特徴とする請求項16に記載のコンピュータ装置。 - 前記(IV)プロセスで、

前記プロセッサが前記ニューラルネットワークをもって、前記テスト用パラメータを利用して前記テストイメージに一つ以上のコンボリューション演算と一つ以上のデコンボリューション演算とを適用して、前記ニューラルネットワーク結果を出力させることを特徴とする請求項11に記載のコンピュータ装置。 - 前記テストイメージは道路走行状況を示し、前記テスト用物体は道路上で現れ得る物体を示し、前記ニューラルネットワーク結果は自律走行のために使用されることを特徴とする請求項19に記載のコンピュータ装置。

Applications Claiming Priority (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| US16/254,525 | 2019-01-22 | ||

| US16/254,525 US10311336B1 (en) | 2019-01-22 | 2019-01-22 | Method and device of neural network operations using a grid generator for converting modes according to classes of areas to satisfy level 4 of autonomous vehicles |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2020119537A JP2020119537A (ja) | 2020-08-06 |

| JP6856906B2 true JP6856906B2 (ja) | 2021-04-14 |

Family

ID=66673239

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2020002012A Active JP6856906B2 (ja) | 2019-01-22 | 2020-01-09 | 自律走行車両レベル4を満たすために領域のクラスに応じてモードを切り換えるためにグリッド生成器を利用するニューラルネットワーク演算方法及びこれを利用した装置 |

Country Status (5)

| Country | Link |

|---|---|

| US (1) | US10311336B1 (ja) |

| EP (1) | EP3686783A1 (ja) |

| JP (1) | JP6856906B2 (ja) |

| KR (1) | KR102325025B1 (ja) |

| CN (1) | CN111460879B (ja) |

Families Citing this family (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP7261022B2 (ja) * | 2019-01-30 | 2023-04-19 | キヤノン株式会社 | 情報処理システム、端末装置及びその制御方法、プログラム、記憶媒体 |

| EP4162338A4 (en) | 2020-06-05 | 2024-07-03 | Gatik AI Inc. | METHOD AND SYSTEM FOR DETERMINISTIC TRAJECTORY SELECTION BASED ON UNCERTAINTY ESTIMATION FOR AN AUTONOMOUS AGENT |

| JP7538893B2 (ja) | 2020-06-05 | 2024-08-22 | ガティック エーアイ インコーポレイテッド | 自律エージェントのデータドリブンかつモジュラー式の意思決定と経路生成のための方法およびシステム |

| CA3181067A1 (en) * | 2020-06-05 | 2021-12-09 | Gautam Narang | Method and system for context-aware decision making of an autonomous agent |

| US12037011B2 (en) | 2021-12-16 | 2024-07-16 | Gatik Ai Inc. | Method and system for expanding the operational design domain of an autonomous agent |

| US12091052B2 (en) | 2021-12-16 | 2024-09-17 | Gatik Ai Inc. | Method and system for addressing failure in an autonomous agent |

| US12167297B2 (en) | 2023-04-25 | 2024-12-10 | T-Mobile Usa, Inc. | Location clustering and routing for 5G drive testing |

Family Cites Families (29)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US5448484A (en) * | 1992-11-03 | 1995-09-05 | Bullock; Darcy M. | Neural network-based vehicle detection system and method |

| US5640468A (en) * | 1994-04-28 | 1997-06-17 | Hsu; Shin-Yi | Method for identifying objects and features in an image |

| US7398259B2 (en) * | 2002-03-12 | 2008-07-08 | Knowmtech, Llc | Training of a physical neural network |

| US7433524B2 (en) * | 2003-05-08 | 2008-10-07 | Ricoh Company, Ltd. | Processing system with frame rate and image quality optimized |

| US20050175243A1 (en) * | 2004-02-05 | 2005-08-11 | Trw Automotive U.S. Llc | Method and apparatus for classifying image data using classifier grid models |

| US7958063B2 (en) * | 2004-11-11 | 2011-06-07 | Trustees Of Columbia University In The City Of New York | Methods and systems for identifying and localizing objects based on features of the objects that are mapped to a vector |

| US8798314B2 (en) * | 2008-07-14 | 2014-08-05 | National Ict Australia Limited | Detection of vehicles in images of a night time scene |

| WO2012124000A1 (ja) * | 2011-03-17 | 2012-09-20 | 日本電気株式会社 | 画像認識システム、画像認識方法および画像認識用プログラムが格納された非一時的なコンピュータ可読媒体 |

| GB2497516A (en) * | 2011-12-05 | 2013-06-19 | Univ Lincoln | Generating training data for automation of image analysis |

| US9158995B2 (en) * | 2013-03-14 | 2015-10-13 | Xerox Corporation | Data driven localization using task-dependent representations |

| CN104346620B (zh) * | 2013-07-25 | 2017-12-29 | 佳能株式会社 | 对输入图像中的像素分类的方法和装置及图像处理系统 |

| US20160042548A1 (en) * | 2014-03-19 | 2016-02-11 | Intel Corporation | Facial expression and/or interaction driven avatar apparatus and method |

| US9390348B2 (en) * | 2014-05-19 | 2016-07-12 | Jinling Institute Of Technology | Method for categorizing objects in image |

| US9430715B1 (en) * | 2015-05-01 | 2016-08-30 | Adobe Systems Incorporated | Identifying and modifying cast shadows in an image |

| US9836839B2 (en) * | 2015-05-28 | 2017-12-05 | Tokitae Llc | Image analysis systems and related methods |

| US9904849B2 (en) * | 2015-08-26 | 2018-02-27 | Digitalglobe, Inc. | System for simplified generation of systems for broad area geospatial object detection |

| US9881234B2 (en) * | 2015-11-25 | 2018-01-30 | Baidu Usa Llc. | Systems and methods for end-to-end object detection |

| US9760806B1 (en) * | 2016-05-11 | 2017-09-12 | TCL Research America Inc. | Method and system for vision-centric deep-learning-based road situation analysis |

| CN107247956B (zh) * | 2016-10-09 | 2020-03-27 | 成都快眼科技有限公司 | 一种基于网格判断的快速目标检测方法 |

| US11308350B2 (en) * | 2016-11-07 | 2022-04-19 | Qualcomm Incorporated | Deep cross-correlation learning for object tracking |

| JP6964234B2 (ja) * | 2016-11-09 | 2021-11-10 | パナソニックIpマネジメント株式会社 | 情報処理方法、情報処理装置およびプログラム |

| US10176388B1 (en) * | 2016-11-14 | 2019-01-08 | Zoox, Inc. | Spatial and temporal information for semantic segmentation |

| US10013773B1 (en) * | 2016-12-16 | 2018-07-03 | Waymo Llc | Neural networks for object detection |

| US10108850B1 (en) * | 2017-04-24 | 2018-10-23 | Intel Corporation | Recognition, reidentification and security enhancements using autonomous machines |

| KR102463175B1 (ko) * | 2017-09-04 | 2022-11-04 | 삼성전자주식회사 | 객체 인식 방법 및 장치 |

| CN107506802A (zh) * | 2017-10-19 | 2017-12-22 | 广东工业大学 | 一种基于网格的聚类算法及其装置 |

| US10535191B2 (en) * | 2017-12-21 | 2020-01-14 | Luminar Technologies, Inc. | Object identification and labeling tool for training autonomous vehicle controllers |

| CN108229446B (zh) * | 2018-02-09 | 2020-07-24 | 中煤航测遥感集团有限公司 | 一种区域圈定方法及系统 |

| US10140553B1 (en) * | 2018-03-08 | 2018-11-27 | Capital One Services, Llc | Machine learning artificial intelligence system for identifying vehicles |

-

2019

- 2019-01-22 US US16/254,525 patent/US10311336B1/en active Active

- 2019-09-27 KR KR1020190119528A patent/KR102325025B1/ko active Active

- 2019-12-18 CN CN201911310674.0A patent/CN111460879B/zh active Active

- 2019-12-31 EP EP19220179.6A patent/EP3686783A1/en active Pending

-

2020

- 2020-01-09 JP JP2020002012A patent/JP6856906B2/ja active Active

Also Published As

| Publication number | Publication date |

|---|---|

| KR20200091321A (ko) | 2020-07-30 |

| EP3686783A1 (en) | 2020-07-29 |

| KR102325025B1 (ko) | 2021-11-12 |

| CN111460879B (zh) | 2023-09-26 |

| JP2020119537A (ja) | 2020-08-06 |

| CN111460879A (zh) | 2020-07-28 |

| US10311336B1 (en) | 2019-06-04 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP6856906B2 (ja) | 自律走行車両レベル4を満たすために領域のクラスに応じてモードを切り換えるためにグリッド生成器を利用するニューラルネットワーク演算方法及びこれを利用した装置 | |

| JP6923960B2 (ja) | 自動駐車システムを提供するために決定地点間の関係及び決定地点に対するリグレッション結果を利用して駐車スペースを検出する学習方法及び学習装置、そしてこれを利用したテスティング方法及びテスティング装置 | |

| JP6810415B2 (ja) | 自律走行自動車のレベル4を満たすために領域のクラスに応じてモードを切り換えてグリッドセルごとに重み付けコンボリューションフィルタを利用した監視用イメージセグメンテーション方法及び装置、並びにそれを利用したテスト方法及びテスト装置 | |

| KR102337376B1 (ko) | 레인 마스크(Lane Mask)를 사용하여 후처리 없이 입력 이미지에 포함된 하나 이상의 차선을 검출하는 방법 및 장치, 그리고 이를 이용한 테스트 방법 및 테스트 장치 | |

| JP6957050B2 (ja) | モバイルデバイスまたは小型ネットワークに適用可能なハードウェアを最適化するのに利用可能なroiをプーリングするために、マスキングパラメータを利用する方法及び装置、そしてこれを利用したテスト方法及びテスト装置{learning method and learning device for pooling roi by using masking parameters to be used for mobile devices or compact networks via hardware optimization, and testing method and testing device using the same} | |

| KR20200092845A (ko) | 인스턴스 세그멘테이션을 이용한 객체의 자세에 따라 모드를 전환할 수 있는 cnn 기반의 수도-3d 바운딩 박스를 검출하는 방법 및 이를 이용한 장치 | |

| JP6857369B2 (ja) | Cnnを学習する方法及び学習装置、それを利用したテスト方法及びテスト装置 | |

| JP6856904B2 (ja) | 物体のスケールに応じてモード転換が可能なcnn基盤の監視用物体検出器の学習方法及び学習装置、そしてこれを利用したテスト方法及びテスト装置 | |

| JP6908945B2 (ja) | 機能的安全性のために極限状況でフォールトトレランス及びフラクチュエーションロバスト性を向上させるようにテストパターンを利用してcnnのパラメータの無欠性を検証するための方法及び装置 | |

| JP6903352B2 (ja) | 非最大値抑制を学習する併合ネットワークを利用した異種センサ融合のための学習方法及び学習装置{learning method and learning device for heterogeneous sensor fusion by using merging network which learns non−maximum suppression} | |

| JP6856957B2 (ja) | 写真スタイル変換を使用してランタイム入力の変換によりリアル世界で使用されるバーチャル世界で学習されたcnnを許容するための学習方法及び学習装置、そしてこれを利用したテスト方法及びテスト装置 | |

| JP6864891B2 (ja) | 自律走行車両レベル4を満たすために領域のクラスに応じてモードを切り換えるためにグリッド生成器を利用するニューラルネットワーク演算方法及びこれを利用した装置 | |

| JP6856905B2 (ja) | 自律走行車両レベル4を満たすために領域のクラスに応じてモードを切り換えるためにグリッド生成器を利用するニューラルネットワーク演算方法及びこれを利用した装置 | |

| JP6856852B2 (ja) | 横フィルタマスクを利用して自律走行車の走行経路を計画するために車線要素を検出する方法及び装置 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20200109 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20210224 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20210302 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20210311 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6856906 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |