JP6851278B2 - ユーザ状態及び複雑度によってビットレートを決定するコンテンツ配信装置、システム、プログラム及び方法 - Google Patents

ユーザ状態及び複雑度によってビットレートを決定するコンテンツ配信装置、システム、プログラム及び方法 Download PDFInfo

- Publication number

- JP6851278B2 JP6851278B2 JP2017141705A JP2017141705A JP6851278B2 JP 6851278 B2 JP6851278 B2 JP 6851278B2 JP 2017141705 A JP2017141705 A JP 2017141705A JP 2017141705 A JP2017141705 A JP 2017141705A JP 6851278 B2 JP6851278 B2 JP 6851278B2

- Authority

- JP

- Japan

- Prior art keywords

- content

- bit rate

- user

- determined

- physical state

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Landscapes

- Compression Or Coding Systems Of Tv Signals (AREA)

- Two-Way Televisions, Distribution Of Moving Picture Or The Like (AREA)

- Processing Or Creating Images (AREA)

Description

当該ユーザの現実空間での物理的状態毎に、当該物理的状態によって決定される当該見える内容における見え方の複雑度を、予め設定された複数のビットレートの各々の下で当該物理的状態によって決定される当該見える内容に基づき算出しておく複雑度算出手段と、

取得された当該ユーザの現実空間での物理的状態から、予め設定された複雑度に基づき、その下で該複雑度が該物理的状態に対応して算出されることになるビットレートを求め、該ビットレートを、配信する当該コンテンツのビットレートに決定するビットレート決定手段と、

決定されたビットレートに該当するコンテンツを、取得された当該物理的状態に係るユーザのクライアントへ配信させる配信制御手段と

を有するコンテンツ配信装置が提供される。

当該コンテンツの配信される形態は、仮想空間における視点映像に係るデータであり、

当該ユーザの現実空間での物理的状態は、ユーザの位置情報を含み、

複雑度算出手段は、当該複雑度として、当該ユーザの位置情報に対応する当該仮想空間での位置における当該視点映像についての画質指標を算出する

ことも好ましい。

本コンテンツ配信装置は、当該仮想空間における3次元映像情報を2次元の視点画像群へ展開し、当該2次元の視点画像群を所定のビットレート条件下でエンコードして2次元の当該視点映像を生成する視点映像生成手段を更に有し、

配信制御手段は、決定されたビットレートに該当する当該2次元の視点映像を、取得された当該ユーザの位置情報に係るクライアントへ配信する

ことも好ましい。

本コンテンツ配信装置は、予め設定されたビットレート条件毎に生成された視点映像であって当該仮想空間での1つの位置における視点映像についての画質指標から、当該ユーザの位置情報若しくは当該仮想空間での位置及び画質指標と、ビットレートとの関係を決定する画質・ビットレートマッピング手段を更に有し、

ビットレート決定手段は、決定された当該関係に基づいて、取得された当該ユーザの位置情報から、配信する当該コンテンツのビットレートを決定する

ことも好ましい。

当該クライアント及びユーザは、本コンテンツ配信装置から当該コンテンツを配信される複数のクライアント及びユーザであり、

ビットレート決定手段は、決定された当該関係に基づいて、取得された各ユーザの位置情報と、取得された各クライアントに係るスループット情報とから、各クライアントへ配信する当該コンテンツのビットレートを決定する

ことも好ましい。

当該コンテンツはコンピュータグラフィックスデータを含み、

複雑度算出手段は、当該コンピュータグラフィックスデータにおけるポリゴン数及び/又はテクスチャ指標に基づいて、当該複雑度を算出する

ことも好ましい。

1つの時点又は時間区間において検出、測定又は決定された当該ユーザの現実空間での物理的状態に係る情報を生成する状態情報生成手段と、

生成された当該ユーザの現実空間での物理的状態に係る情報を、当該1つの時点又は時間区間と紐づけて前記コンテンツ配信装置に送信するクライアント通信制御手段と

を有し、本コンテンツ配信装置は、

当該ユーザの現実空間での物理的状態毎に、当該物理的状態によって決定される当該見える内容における見え方の複雑度を、予め設定された複数のビットレートの各々の下で当該物理的状態によって決定される当該見える内容に基づき算出しておく複雑度算出手段と、

受信された当該ユーザの現実空間での物理的状態から、予め設定された複雑度に基づき、その下で該複雑度が該物理的状態に対応して算出されることになるビットレートを求め、該ビットレートを、配信する当該コンテンツのビットレートに決定するビットレート決定手段と、

決定されたビットレートに該当するコンテンツを、受信された当該物理的状態に係るユーザのクライアントへ配信させる配信制御手段と

を有するコンテンツ配信システムが提供される。

当該ユーザの現実空間での物理的状態毎に、当該物理的状態によって決定される当該見える内容における見え方の複雑度を、予め設定された複数のビットレートの各々の下で当該物理的状態によって決定される当該見える内容に基づき算出しておく複雑度算出手段と、

取得された当該ユーザの現実空間での物理的状態から、予め設定された複雑度に基づき、その下で該複雑度が該物理的状態に対応して算出されることになるビットレートを求め、該ビットレートを、配信する当該コンテンツのビットレートに決定するビットレート決定手段と、

決定されたビットレートに該当するコンテンツを、取得された当該物理的状態に係るユーザのクライアントへ配信させる配信制御手段と

してコンピュータを機能させるコンテンツ配信プログラムが提供される。

当該ユーザの現実空間での物理的状態毎に、当該物理的状態によって決定される当該見える内容における見え方の複雑度を、予め設定された複数のビットレートの各々の下で当該物理的状態によって決定される当該見える内容に基づき算出しておくステップと、

取得された当該ユーザの現実空間での物理的状態から、予め設定された複雑度に基づき、その下で該複雑度が該物理的状態に対応して算出されることになるビットレートを求め、該ビットレートを、配信する当該コンテンツのビットレートに決定するステップと、

決定されたビットレートに該当するコンテンツを、取得された当該物理的状態に係るユーザのクライアントへ配信させるステップと

を有するコンテンツ配信方法が提供される。

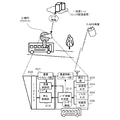

図1は、本発明によるコンテンツ配信装置の一実施形態における機能構成を示す機能ブロック図である。

(A)「ユーザ状態」毎に決定される、見える内容における見え方の「複雑度」を算出する複雑度算出手段としての画像算出部12と、

(B)取得された「ユーザ状態」と算出された「複雑度」とに基づいて、配信するコンテンツの「ビットレート」を決定するビットレート決定部14と、

(C)決定された「ビットレート」に該当するコンテンツを、取得された「ユーザ状態」に係るクライアントへ配信させる映像配信制御部15と

を有している。

(a)VRコンテンツ内の視点位置毎に作成されるパノラマ映像について、複数のビットレートでエンコードした場合の「画質指標」を予め算出して、画質・BR(Bit Rate)テーブルを生成しておき、

(b)この画質・BRテーブルを参照して、「ユーザ状態(位置情報)」や「画質指標」の設定に応じてビットレートを決定する

ことも好ましい。

図2は、本発明に係るクライアントの一実施形態における機能構成を示す機能ブロック図である。

以下、図1に戻って、配信サーバ1の機能構成を説明する。同図に示した機能ブロック図によれば、本発明のコンテンツ配信装置である配信サーバ1は、通信インタフェース部101と、VRコンテンツ蓄積部102と、パノラマ画像蓄積部103と、パノラマ映像蓄積部104と、画像・BRテーブル保存部105と、プロセッサ・メモリとを有する。ここで、プロセッサ・メモリは、配信サーバ1のコンピュータを機能させるプログラムを実行することによって、本発明に係る映像生成・コンテンツ配信制御機能を実現させる。

(ア)VRコンテンツにおける1つのメッシュの中心点(ui, vi)を視点位置に設定する。

ここで、1つのメッシュの中心点は、図3ではユーザ(HMD2)の現実世界(U-V座標系)での位置に対応するメッシュの点となっているが、後述するように、画質・BRテーブルを予め生成する処理段階では、このテーブル生成のために必要となる一連の複数中心点のうちの1つとなる。

(イ)視点位置(ui, vi)を中心とした適当な半径を持つ球面を設定し、視点位置(ui, vi)から見えるVRコンテンツの内容をこの球面上に射影し、

(ウ)射影された結果としての球面上の画像データを、円筒に投影するように展開して、パノラマ画像を生成する。

(エ)生成したパノラマ画像を所定時間Δt分だけ切り出してとりまとめ、パノラマ画像群とする。

ここで、このパノラマ画像群は、次に説明するパノラマ映像生成の際に実行されるエンコード処理における一単位分の画像の集合であり、例えば1つのGOP(Group Of Pictures)とすることができる。なお、生成されたパノラマ画像(群)は、一旦パノラマ画像蓄積部103に保存され、適宜読み出されてもよい。

(オ)生成されたパノラマ画像群を入力し、エンコード部112aにおいて当該パノラマ画像群に対して、設定されたビットレート条件下でエンコード(符号化)処理を行い、パノラマ映像を生成する。

(カ)パノラマ画像における各画素(x, y)の面積と符号化誤差e(x, y)とを球面に射影し、表面で積分して、AW-MSE(Average-Weighted Mean Squared Error, 重み付け平均二乗誤差)を、次式

(1) AW-MSE={Σx,y∈X,Y w(x, y)・e(x, y)2}/{Σx,y∈X,Y w(x, y)}

(2) w(x, y)=sin{(2y+1)・π/2Y}

を用いて算出する。

(キ)算出したAW-MSEから、複雑度に相当する客観画質指標(以下、画質指標と略称)としてのPSNR(Peak Signal-to-Noise Ratio, ピーク信号対雑音比)を、次式

(3) PSNR=10・log10 (MAX2/AW-MSE)

によって算出する。上式(3)において、MAX=255(基準となる画素最大値)である。なお、画質算出部12は、エンコード単位として取りまとめたパノラマ画像群における上記PSNRの代表値、例えば平均値を、このパノラマ画像群の画質指標に決定してもよい。

(a)第1条件として、各クライアントのビットレートの合計が全体のスループット内に収まり、

(b)第2条件として、クライアント間で画質を同等とし、この画質指標ができるだけ大きくなる

ように、各クライアントのビットレートを、画質・BRテーブルを用いて決定することも好ましい。

図7は、本発明によるコンテンツ配信方法の一実施形態を概略的に示すシーケンス図である。本実施形態では、配信先のクライアントとして、HMD21及びHMD22の2つが存在している。

(S102a,S102b)HMD21及び22はそれぞれ、配信の際に使用される通信ネットワークのスループットを測定し、このスループット測定値を配信サーバ1へ通知する。

(S103a,S103b)HMD21及び22はそれぞれ、(例えばGPSによる測位によって)自らの位置情報を取得し、この位置情報をユーザ状態として配信サーバ1へ通知する。

ここで、配信サーバ1は、通知された現実世界の位置に対応する仮想空間での位置を算出し、この位置を視点位置としてパノラマ画像を切り出すのであるが、変更態様として、この仮想空間位置への変換の際、実際にクライアント側で再生される時点での現実世界での位置を推測した上で、視点位置を決定してもよい。

(a)RTT(Round-Trip Time)+(サーバ1での配信に要する時間、及び

(b)クライアント側での受信後のバッファリング時間

の経過した時点で、移動するクライアントが到達する地点を予測する。次いで、この予測到達地点に対応する仮想空間での位置を、視点位置に決定する。

(S107)配信サーバ1は、生成したパノラマ映像を、該当する各クライアントへ(HMD21及び22へ)配信する。

(S108a,S108b)HMD21及び22はそれぞれ、自ら宛てに配信されたパノラマ映像を受信する。

(S109a,S109b)HMD21及び22はそれぞれ、受信したパノラマ映像をVR映像に変換して再生を行う。

ここで、この通知は、映像配信とは別のプロトコル、例えばTCP等のセッションによって実施することができる。

(S207a,S207b)HMD21及び22はそれぞれ、設定したビットレートに係るパノラマ映像を要求(リクエスト)する。

ここで、この要求は、例えばHLSやMPEG−DASH等の配信プロトコルを利用して実施されてもよい。

101 通信インタフェース部

102 VRコンテンツ蓄積部

103 パノラマ画像蓄積部

104 パノラマ映像蓄積部

105 画像・BRテーブル保存部

11 視点映像生成部

111 パノラマ画像生成部

112 パノラマ映像生成部

112a エンコード部112a

12 画質算出部

13 画像・BRマッピング部

14 ビットレート決定部

15 映像配信制御部

16 通信制御部

2、21、22 HMD(クライアント)

201 通信インタフェース部

202 測位部

203 加速度センサ

204 ジャイロセンサ

205 地磁気センサ

206 ディスプレイ

211 通信制御部

212 再生制御部

213 ユーザ情報生成部

3 GPS衛星

Claims (10)

- クライアントのユーザの現実空間での物理的状態によって見える内容が決まるコンテンツを配信するコンテンツ配信装置であって、

当該ユーザの現実空間での物理的状態毎に、当該物理的状態によって決定される当該見える内容における見え方の複雑度を、予め設定された複数のビットレートの各々の下で当該物理的状態によって決定される当該見える内容に基づき算出しておく複雑度算出手段と、

取得された当該ユーザの現実空間での物理的状態から、予め設定された複雑度に基づき、その下で該複雑度が該物理的状態に対応して算出されることになるビットレートを求め、該ビットレートを、配信する当該コンテンツのビットレートに決定するビットレート決定手段と、

決定されたビットレートに該当するコンテンツを、取得された当該物理的状態に係るユーザのクライアントへ配信させる配信制御手段と

を有することを特徴とするコンテンツ配信装置。 - 当該コンテンツの配信される形態は、仮想空間における視点映像に係るデータであり、

当該ユーザの現実空間での物理的状態は、ユーザの位置情報を含み、

前記複雑度算出手段は、当該複雑度として、当該ユーザの位置情報に対応する当該仮想空間での位置における当該視点映像についての画質指標を算出する

ことを特徴とする請求項1に記載のコンテンツ配信装置。 - 当該仮想空間における3次元映像情報を2次元の視点画像群へ展開し、当該2次元の視点画像群を所定のビットレート条件下でエンコードして2次元の当該視点映像を生成する視点映像生成手段を更に有し、

前記配信制御手段は、決定されたビットレートに該当する当該2次元の視点映像を、取得された当該ユーザの位置情報に係るクライアントへ配信する

ことを特徴とする請求項2に記載のコンテンツ配信装置。 - 予め設定されたビットレート条件毎に生成された視点映像であって当該仮想空間での1つの位置における視点映像についての画質指標から、当該ユーザの位置情報若しくは当該仮想空間での位置及び画質指標と、ビットレートとの関係を決定する画質・ビットレートマッピング手段を更に有し、

前記ビットレート決定手段は、決定された当該関係に基づいて、取得された当該ユーザの位置情報から、配信する当該コンテンツのビットレートを決定する

ことを特徴とする請求項2又は3に記載のコンテンツ配信装置。 - 当該クライアント及びユーザは、前記コンテンツ配信装置から当該コンテンツを配信される複数のクライアント及びユーザであり、

前記ビットレート決定手段は、決定された当該関係に基づいて、取得された各ユーザの位置情報と、取得された各クライアントに係るスループット情報とから、各クライアントへ配信する当該コンテンツのビットレートを決定する

ことを特徴とする請求項4に記載のコンテンツ配信装置。 - 前記ビットレート決定手段は、決定された当該関係に基づいて、取得された各ユーザの位置情報と、取得された各クライアントに係るスループット情報と、当該スループット情報の合計とから、配信の際のスループット条件が満たされるように当該コンテンツの画質指標を決定し、決定された画質指標から、各クライアントへ配信する当該コンテンツのビットレートを決定することを特徴とする請求項5に記載のコンテンツ配信装置。

- 当該コンテンツはコンピュータグラフィックスデータを含み、

前記複雑度算出手段は、当該コンピュータグラフィックスデータにおけるポリゴン数及び/又はテクスチャ指標に基づいて、当該複雑度を算出する

ことを特徴とする請求項1に記載のコンテンツ配信装置。 - クライアントと、当該クライアントのユーザの現実空間での物理的状態によって見える内容が決まるコンテンツを配信するコンテンツ配信装置とを有するコンテンツ配信システムであって、当該クライアントは、

1つの時点又は時間区間において検出、測定又は決定された当該ユーザの現実空間での物理的状態に係る情報を生成する状態情報生成手段と、

生成された当該ユーザの現実空間での物理的状態に係る情報を、当該1つの時点又は時間区間と紐づけて前記コンテンツ配信装置に送信するクライアント通信制御手段と

を有し、前記コンテンツ配信装置は、

当該ユーザの現実空間での物理的状態毎に、当該物理的状態によって決定される当該見える内容における見え方の複雑度を、予め設定された複数のビットレートの各々の下で当該物理的状態によって決定される当該見える内容に基づき算出しておく複雑度算出手段と、

受信された当該ユーザの現実空間での物理的状態から、予め設定された複雑度に基づき、その下で該複雑度が該物理的状態に対応して算出されることになるビットレートを求め、該ビットレートを、配信する当該コンテンツのビットレートに決定するビットレート決定手段と、

決定されたビットレートに該当するコンテンツを、受信された当該物理的状態に係るユーザのクライアントへ配信させる配信制御手段と

を有することを特徴とするコンテンツ配信システム。 - クライアントのユーザの現実空間での物理的状態によって見える内容が決まるコンテンツを配信する装置に搭載されたコンピュータを機能させるコンテンツ配信プログラムであって、

当該ユーザの現実空間での物理的状態毎に、当該物理的状態によって決定される当該見える内容における見え方の複雑度を、予め設定された複数のビットレートの各々の下で当該物理的状態によって決定される当該見える内容に基づき算出しておく複雑度算出手段と、

取得された当該ユーザの現実空間での物理的状態から、予め設定された複雑度に基づき、その下で該複雑度が該物理的状態に対応して算出されることになるビットレートを求め、該ビットレートを、配信する当該コンテンツのビットレートに決定するビットレート決定手段と、

決定されたビットレートに該当するコンテンツを、取得された当該物理的状態に係るユーザのクライアントへ配信させる配信制御手段と

してコンピュータを機能させることを特徴とするコンテンツ配信プログラム。 - クライアントのユーザの現実空間での物理的状態によって見える内容が決まるコンテンツを配信する装置に搭載されたコンピュータにおけるコンテンツ配信方法であって、

当該ユーザの現実空間での物理的状態毎に、当該物理的状態によって決定される当該見える内容における見え方の複雑度を、予め設定された複数のビットレートの各々の下で当該物理的状態によって決定される当該見える内容に基づき算出しておくステップと、

取得された当該ユーザの現実空間での物理的状態から、予め設定された複雑度に基づき、その下で該複雑度が該物理的状態に対応して算出されることになるビットレートを求め、該ビットレートを、配信する当該コンテンツのビットレートに決定するステップと、

決定されたビットレートに該当するコンテンツを、取得された当該物理的状態に係るユーザのクライアントへ配信させるステップと

を有することを特徴とするコンテンツ配信方法。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2017141705A JP6851278B2 (ja) | 2017-07-21 | 2017-07-21 | ユーザ状態及び複雑度によってビットレートを決定するコンテンツ配信装置、システム、プログラム及び方法 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2017141705A JP6851278B2 (ja) | 2017-07-21 | 2017-07-21 | ユーザ状態及び複雑度によってビットレートを決定するコンテンツ配信装置、システム、プログラム及び方法 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2019022176A JP2019022176A (ja) | 2019-02-07 |

| JP6851278B2 true JP6851278B2 (ja) | 2021-03-31 |

Family

ID=65355799

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2017141705A Active JP6851278B2 (ja) | 2017-07-21 | 2017-07-21 | ユーザ状態及び複雑度によってビットレートを決定するコンテンツ配信装置、システム、プログラム及び方法 |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP6851278B2 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11981363B1 (en) | 2023-11-20 | 2024-05-14 | Parallel Systems, Inc. | System and/or method for remote operation of a rail vehicle |

Families Citing this family (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP7322510B2 (ja) * | 2019-05-27 | 2023-08-08 | 沖電気工業株式会社 | 情報処理装置、情報処理方法およびプログラム |

| WO2021130355A1 (en) * | 2019-12-24 | 2021-07-01 | Koninklijke Kpn N.V. | Video processing device and manifest file for video streaming |

| WO2021201307A1 (ko) * | 2020-03-30 | 2021-10-07 | 엘지전자 주식회사 | 차량에 의해 기록되는 비디오를 전송하는 방법 및 장치 |

Family Cites Families (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4108640B2 (ja) * | 2004-04-27 | 2008-06-25 | 三菱電機株式会社 | 映像伝送システム |

| FR2903259A1 (fr) * | 2006-06-29 | 2008-01-04 | Thomson Licensing Sa | Procede de gestion de demandes d'acces a distance a des contenus multimedia |

| US9125073B2 (en) * | 2012-08-03 | 2015-09-01 | Intel Corporation | Quality-aware adaptive streaming over hypertext transfer protocol using quality attributes in manifest file |

| US20150350300A1 (en) * | 2013-01-18 | 2015-12-03 | Sony Corporation | Content server and content distribution method |

| US20150026358A1 (en) * | 2013-07-19 | 2015-01-22 | Futurewei Technologies, Inc. | Metadata Information Signaling And Carriage In Dynamic Adaptive Streaming Over Hypertext Transfer Protocol |

| JP6224516B2 (ja) * | 2014-05-07 | 2017-11-01 | 日本電信電話株式会社 | エンコード方法およびエンコードプログラム |

| JP6216398B2 (ja) * | 2016-02-22 | 2017-10-18 | 株式会社ソニー・インタラクティブエンタテインメント | 画像生成装置および画像生成方法 |

-

2017

- 2017-07-21 JP JP2017141705A patent/JP6851278B2/ja active Active

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US11981363B1 (en) | 2023-11-20 | 2024-05-14 | Parallel Systems, Inc. | System and/or method for remote operation of a rail vehicle |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2019022176A (ja) | 2019-02-07 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP7307259B2 (ja) | 三次元情報処理方法及び三次元情報処理装置 | |

| US11223821B2 (en) | Video display method and video display device including a selection of a viewpoint from a plurality of viewpoints | |

| US10469820B2 (en) | Streaming volumetric video for six degrees of freedom virtual reality | |

| CN111567052B (zh) | 用于将vr 360视频下发给远程终端用户的可缩放fov+ | |

| KR102343651B1 (ko) | 생성 장치 및 생성 방법, 그리고, 재생 장치 및 재생 방법 | |

| US10687050B2 (en) | Methods and systems of reducing latency in communication of image data between devices | |

| KR102420290B1 (ko) | 공간적으로 불균등한 스트리밍 | |

| JP6851278B2 (ja) | ユーザ状態及び複雑度によってビットレートを決定するコンテンツ配信装置、システム、プログラム及び方法 | |

| JP6944138B2 (ja) | 画像処理装置および画像処理方法 | |

| US11159823B2 (en) | Multi-viewport transcoding for volumetric video streaming | |

| US20200137417A1 (en) | Generation device and generation method, and reproduction device and reproduction method | |

| US20200404241A1 (en) | Processing system for streaming volumetric video to a client device | |

| US9283349B2 (en) | Methods and apparatus for device based prevention of kinetosis | |

| JP6648061B2 (ja) | クライアント状態に応じた映像を配信する映像配信装置、システム、プログラム及び方法 | |

| JP6859286B2 (ja) | Vr映像配信装置および方法、vr映像再生装置および方法ならびにvr映像システム | |

| CN113992996A (zh) | 传输数据的方法和装置 | |

| JP2022032838A (ja) | 送信装置、受信装置、ネットワークノード、及びプログラム | |

| CN116105756A (zh) | 在线实景导航系统、方法和移动终端 | |

| CN112673634A (zh) | 用于支持渐进式视频比特流切换的系统和方法 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20190701 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20200327 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20200403 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20200526 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20201021 |

|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20201224 |

|

| C60 | Trial request (containing other claim documents, opposition documents) |

Free format text: JAPANESE INTERMEDIATE CODE: C60 Effective date: 20201224 |

|

| A911 | Transfer of reconsideration by examiner before appeal (zenchi) |

Free format text: JAPANESE INTERMEDIATE CODE: A911 Effective date: 20210107 |

|

| C21 | Notice of transfer of a case for reconsideration by examiners before appeal proceedings |

Free format text: JAPANESE INTERMEDIATE CODE: C21 Effective date: 20210108 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20210224 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20210309 |

|

| R150 | Certificate of patent or registration of utility model |

Ref document number: 6851278 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R150 |