JP4585759B2 - 音声合成装置、音声合成方法、プログラム、及び記録媒体 - Google Patents

音声合成装置、音声合成方法、プログラム、及び記録媒体 Download PDFInfo

- Publication number

- JP4585759B2 JP4585759B2 JP2003403364A JP2003403364A JP4585759B2 JP 4585759 B2 JP4585759 B2 JP 4585759B2 JP 2003403364 A JP2003403364 A JP 2003403364A JP 2003403364 A JP2003403364 A JP 2003403364A JP 4585759 B2 JP4585759 B2 JP 4585759B2

- Authority

- JP

- Japan

- Prior art keywords

- text information

- operation parameter

- speech

- state

- interest

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Expired - Fee Related

Links

Images

Classifications

-

- G—PHYSICS

- G10—MUSICAL INSTRUMENTS; ACOUSTICS

- G10L—SPEECH ANALYSIS OR SYNTHESIS; SPEECH RECOGNITION; SPEECH OR VOICE PROCESSING; SPEECH OR AUDIO CODING OR DECODING

- G10L13/00—Speech synthesis; Text to speech systems

- G10L13/02—Methods for producing synthetic speech; Speech synthesisers

- G10L13/033—Voice editing, e.g. manipulating the voice of the synthesiser

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06F—ELECTRIC DIGITAL DATA PROCESSING

- G06F16/00—Information retrieval; Database structures therefor; File system structures therefor

- G06F16/30—Information retrieval; Database structures therefor; File system structures therefor of unstructured textual data

- G06F16/33—Querying

- G06F16/332—Query formulation

- G06F16/3329—Natural language query formulation or dialogue systems

Description

S:「こちらは経路案内システムです。」

S:「出発駅を発声してください。」

U:「東京」

S:「到着駅を発声してください。」

U:「大阪」

S:「東京から大阪でよろしいですか?」

U:「はい」

:

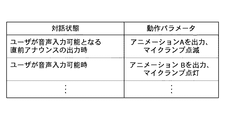

このようなシステム主導型の対話システムにおいては、ユーザが適切な場所で適切な入力を行うように、対話を組み上げていくことが大切である。しかし、どこで、どのような入力を行うかをユーザに適切に通知することは意外に難しく、結果として次のような入力ミスが生じることが多い。

(1)システムアナウンスがまだ続くと勘違いすることにより、入力を躊躇してしまう。

(2)入力可能位置と勘違いすることにより、システムアナウンス中に無駄な入力をしてしまう。

(3)入力を急に促されることにより、入力内容を頭の中で整理しきれない、あるいは喉の調子を整えられていないため、「えー」「あのー」等の不要語の入力や、咳払いをしてしまう。

S:「こちらは経路案内システムです。」

S:「発信音の後に出発駅を発声してください。」(ピー)

U:「東京」

:

また、従来技術には、ユーザの対話モードに合わせて音声合成パラメータを変更するようにしたものがある(例えば特許文献1を参照:第2の従来手法)。これにより、ユーザはシステムアナウンスを聞くだけで、どのような対話状況であるかが判るようになる。

図1は、本発明の実施の形態に係る動作パラメータ決定装置の機能構成図である。

次に、図1に示した動作パラメータ決定装置をカーナビゲーションシステムに利用した例について、図3〜図6を参照して説明する。

U01:(ボタンを押しながら)「近くのコンビニ」

S02:「進行方向5分圏内に、4軒あります。」

S03:「最も近いコンビニはABCです。」

S04:「こちらでよろしいですか?」

U05:「はい」

:

(Sはシステムの出力アナウンス、Uはユーザの入力)

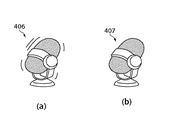

システムからのアナウンス(問いかけ)に対し、ユーザがどのアナウンス後に入力すべきかは、そのシステムアナウンスの内容により判断することが可能である。しかし、運転により対話に気が回らない場合やシステム自体に不慣れな場合には、入力すべきタイミングを適切に判断することができないことがある。そこで、発声のガイドとして、本例では、図4に示すようなアニメーションアイコン402を表示する。

本実施例では、図1に示した動作パラメータ決定装置を利用した音声合成装置の例について、図7〜図12を参照して説明する。

本実施例は、図1に示した動作パラメータ決定装置を、GUIと音声によるフォーム入力に利用したものである。

101 動作パラメータ決定装置

102 対話状態検出部

103 動作パラメータ受信部

104 問い合わせシグナル入力部

105 対話状態/動作パラメータ対応テーブル

106 動作パラメータ検索部

107 対話状態取り込み部

108 動作パラメータ出力部

109 動作パラメータ統合部

110 問い合わせシグナル受付部

Claims (4)

- 音声出力する際の音声の種類を決定する動作パラメータとテキスト情報とを用いて、システムアナウンスとして当該テキスト情報の内容を示す合成音声を出力する音声合成装置であって、

前記システムアナウンスがユーザの音声入力に対してどのような状況にあるかを示す対話状態と前記テキスト情報とを対応付けたセットを1セット以上有するコンテンツから、注目するテキスト情報に対応する対話状態を判断する判断手段と、

前記判断手段により、前記注目するテキスト情報に対応する前記対話状態がないと判断された場合、予め設定された第1の動作パラメータを検索し、前記判断手段により、前記注目するテキスト情報に対応する対話状態が音声を入力する直前のシステムアナウンスを出力している状態にあることを示す第2の対話状態と判断された場合、対話状態と動作パラメータとを対応付けて保持するテーブルから、前記第2の対話状態に対応する動作パラメータとして前記第1の動作パラメータと異なる第2の動作パラメータを検索し、前記判断手段により、前記注目するテキスト情報に対応する対話状態が前記第2の対話状態と判断され、かつ前記注目するテキスト情報に対応する対話状態がバージイン可能なシステムアナウンスを出力している状態にあることを示す第3の対話状態と判断された場合、前記テーブルから、前記第2の対話状態に対応する前記第2の動作パラメータと前記第3の対話状態に対応する動作パラメータとして前記第1の動作パラメータ及び前記第2の動作パラメータと異なる第3の動作パラメータとを検索する検索手段と、

前記検索手段により、前記第1の動作パラメータが検索された場合、前記注目するテキスト情報と前記第1の動作パラメータとを用いて、前記注目するテキスト情報の内容を示す合成音声として第1の合成音声を生成し、前記検索手段により、前記第2の動作パラメータのみが検索された場合、前記注目するテキスト情報と前記第2の動作パラメータとを用いて、前記注目するテキスト情報の内容を示す合成音声であって前記第1の合成音声とは識別可能な第2の合成音声を生成し、前記検索手段により、前記第2の動作パラメータと前記第3の動作パラメータとが検索された場合、前記注目するテキスト情報と前記第2及び第3の動作パラメータとを用いて、前記注目するテキスト情報の内容を示す合成音声であって前記第1及び第2の合成音声と識別可能な第3の合成音声を生成する音声合成手段とを有する音声合成装置。 - 判断手段、検索手段、及び音声合成手段を有し、音声出力する際の音声の種類を決定する動作パラメータとテキスト情報とを用いて、システムアナウンスとして当該テキスト情報の内容を示す合成音声を出力する音声合成装置の音声合成方法であって、

前記システムアナウンスがユーザの音声入力に対してどのような状況にあるかを示す対話状態と前記テキスト情報とを対応付けたセットを1セット以上有するコンテンツから、前記判断手段が、注目するテキスト情報に対応する対話状態を判断する判断工程と、

前記検索手段が、前記判断工程により、前記注目するテキスト情報に対応する前記対話状態がないと判断された場合、予め設定された第1の動作パラメータを検索し、前記判断工程により、前記注目するテキスト情報に対応する対話状態が音声を入力する直前のシステムアナウンスを出力している状態にあることを示す第2の対話状態と判断された場合、対話状態と動作パラメータとを対応付けて保持するテーブルから、前記第2の対話状態に対応する動作パラメータとして前記第1の動作パラメータと異なる第2の動作パラメータを検索し、前記判断工程により、前記注目するテキスト情報に対応する対話状態が前記第2の対話状態と判断され、かつ前記注目するテキスト情報に対応する対話状態がバージイン可能なシステムアナウンスを出力している状態にあることを示す第3の対話状態と判断された場合、前記テーブルから、前記第2の対話状態に対応する前記第2の動作パラメータと前記第3の対話状態に対応する動作パラメータとして前記第1の動作パラメータ及び前記第2の動作パラメータと異なる第3の動作パラメータとを検索する検索工程と、

前記音声合成手段が、前記検索工程により前記第1の動作パラメータが検索された場合、前記注目するテキスト情報と前記第1の動作パラメータとを用いて、前記注目するテキスト情報の内容を示す合成音声として第1の合成音声を生成し、前記検索工程により前記第2の動作パラメータのみが検索された場合、前記注目するテキスト情報と前記第2の動作パラメータとを用いて、前記注目するテキスト情報の内容を示す合成音声であって前記第1の合成音声とは識別可能な第2の合成音声を生成し、前記検索工程により前記第2の動作パラメータと前記第3の動作パラメータとが検索された場合、前記注目するテキスト情報と前記第2及び第3の動作パラメータとを用いて、前記注目するテキスト情報の内容を示す合成音声であって前記第1及び第2の合成音声と識別可能な第3の合成音声を生成する音声合成工程とを有する音声合成装置の音声合成方法。 - 請求項2に記載の音声合成方法をコンピュータに実行させるプログラム。

- 請求項3に記載のプログラムが記録されたことを特徴とするコンピュータが読み取り可能な記録媒体。

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003403364A JP4585759B2 (ja) | 2003-12-02 | 2003-12-02 | 音声合成装置、音声合成方法、プログラム、及び記録媒体 |

| US10/999,787 US20050120046A1 (en) | 2003-12-02 | 2004-11-29 | User interaction and operation-parameter determination system and operation-parameter determination method |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2003403364A JP4585759B2 (ja) | 2003-12-02 | 2003-12-02 | 音声合成装置、音声合成方法、プログラム、及び記録媒体 |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2005164944A JP2005164944A (ja) | 2005-06-23 |

| JP2005164944A5 JP2005164944A5 (ja) | 2007-01-25 |

| JP4585759B2 true JP4585759B2 (ja) | 2010-11-24 |

Family

ID=34616776

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2003403364A Expired - Fee Related JP4585759B2 (ja) | 2003-12-02 | 2003-12-02 | 音声合成装置、音声合成方法、プログラム、及び記録媒体 |

Country Status (2)

| Country | Link |

|---|---|

| US (1) | US20050120046A1 (ja) |

| JP (1) | JP4585759B2 (ja) |

Families Citing this family (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2006044867A2 (en) * | 2004-10-19 | 2006-04-27 | Web Bindery Llc | System and method for dynamic e-commerce shopping icons |

| US20060122916A1 (en) * | 2004-10-19 | 2006-06-08 | Peter Kassan | System and method for dynamic e-commerce shopping icons |

| US20060247925A1 (en) * | 2005-04-27 | 2006-11-02 | International Business Machines Corporation | Virtual push-to-talk |

| JP4810343B2 (ja) * | 2006-07-20 | 2011-11-09 | キヤノン株式会社 | 音声処理装置およびその制御方法 |

| JP5790238B2 (ja) * | 2011-07-22 | 2015-10-07 | ソニー株式会社 | 情報処理装置、情報処理方法及びプログラム |

| US9600474B2 (en) * | 2013-11-08 | 2017-03-21 | Google Inc. | User interface for realtime language translation |

| JP7319639B1 (ja) * | 2022-08-24 | 2023-08-02 | ダイレクトソリューションズ株式会社 | 音声入力システム及びそのプログラム |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH10301675A (ja) * | 1997-02-28 | 1998-11-13 | Toshiba Corp | マルチモーダルインタフェース装置およびマルチモーダルインタフェース方法 |

| JP2001142483A (ja) * | 1991-11-18 | 2001-05-25 | Toshiba Corp | 音声対話方法及びそのシステム |

| JP2001162573A (ja) * | 1999-12-08 | 2001-06-19 | Fujitsu Ltd | ロボット装置 |

| JP2003241797A (ja) * | 2002-02-22 | 2003-08-29 | Fujitsu Ltd | 音声対話システム |

Family Cites Families (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| DE69232407T2 (de) * | 1991-11-18 | 2002-09-12 | Toshiba Kawasaki Kk | Sprach-Dialog-System zur Erleichterung von Rechner-Mensch-Wechselwirkung |

| JP3548230B2 (ja) * | 1994-05-30 | 2004-07-28 | キヤノン株式会社 | 音声合成方法及び装置 |

| US6118888A (en) * | 1997-02-28 | 2000-09-12 | Kabushiki Kaisha Toshiba | Multi-modal interface apparatus and method |

| US6173266B1 (en) * | 1997-05-06 | 2001-01-09 | Speechworks International, Inc. | System and method for developing interactive speech applications |

| US6865533B2 (en) * | 2000-04-21 | 2005-03-08 | Lessac Technology Inc. | Text to speech |

| US6728708B1 (en) * | 2000-06-26 | 2004-04-27 | Datria Systems, Inc. | Relational and spatial database management system and method for applications having speech controlled data input displayable in a form and a map having spatial and non-spatial data |

| US7143039B1 (en) * | 2000-08-11 | 2006-11-28 | Tellme Networks, Inc. | Providing menu and other services for an information processing system using a telephone or other audio interface |

-

2003

- 2003-12-02 JP JP2003403364A patent/JP4585759B2/ja not_active Expired - Fee Related

-

2004

- 2004-11-29 US US10/999,787 patent/US20050120046A1/en not_active Abandoned

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2001142483A (ja) * | 1991-11-18 | 2001-05-25 | Toshiba Corp | 音声対話方法及びそのシステム |

| JPH10301675A (ja) * | 1997-02-28 | 1998-11-13 | Toshiba Corp | マルチモーダルインタフェース装置およびマルチモーダルインタフェース方法 |

| JP2001162573A (ja) * | 1999-12-08 | 2001-06-19 | Fujitsu Ltd | ロボット装置 |

| JP2003241797A (ja) * | 2002-02-22 | 2003-08-29 | Fujitsu Ltd | 音声対話システム |

Also Published As

| Publication number | Publication date |

|---|---|

| JP2005164944A (ja) | 2005-06-23 |

| US20050120046A1 (en) | 2005-06-02 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US7822613B2 (en) | Vehicle-mounted control apparatus and program that causes computer to execute method of providing guidance on the operation of the vehicle-mounted control apparatus | |

| CN105027194B (zh) | 话语主题的识别 | |

| US9495956B2 (en) | Dealing with switch latency in speech recognition | |

| US11217230B2 (en) | Information processing device and information processing method for determining presence or absence of a response to speech of a user on a basis of a learning result corresponding to a use situation of the user | |

| JP6078964B2 (ja) | 音声対話システム及びプログラム | |

| US8909532B2 (en) | Supporting multi-lingual user interaction with a multimodal application | |

| US10572107B1 (en) | Voice communication targeting user interface | |

| US20090030691A1 (en) | Using an unstructured language model associated with an application of a mobile communication facility | |

| JPWO2016051519A1 (ja) | 音声認識システム | |

| KR20070026452A (ko) | 음성 인터랙티브 메시징을 위한 방법 및 장치 | |

| US20060020471A1 (en) | Method and apparatus for robustly locating user barge-ins in voice-activated command systems | |

| EP2682931B1 (en) | Method and apparatus for recording and playing user voice in mobile terminal | |

| US10452351B2 (en) | Information processing device and information processing method | |

| CN111949240A (zh) | 交互方法、存储介质、服务程序和设备 | |

| JP2006251545A (ja) | 音声対話システム及びコンピュータプログラム | |

| WO2018034077A1 (ja) | 情報処理装置、情報処理方法、及びプログラム | |

| JP4585759B2 (ja) | 音声合成装置、音声合成方法、プログラム、及び記録媒体 | |

| US20170221481A1 (en) | Data structure, interactive voice response device, and electronic device | |

| CN110493461A (zh) | 消息播放方法及装置、电子设备、存储介质 | |

| KR20190091265A (ko) | 정보 처리 장치, 정보 처리 방법, 및 정보 처리 시스템 | |

| KR102092058B1 (ko) | 인터페이스 제공 방법 및 장치 | |

| JP6851491B2 (ja) | 音声対話制御装置および音声対話制御方法 | |

| JP3846500B2 (ja) | 音声認識対話装置および音声認識対話処理方法 | |

| JP2015052744A (ja) | 情報処理装置、制御方法、及びプログラム | |

| JP2004134942A (ja) | 携帯電話装置 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| RD03 | Notification of appointment of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7423 Effective date: 20060418 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20061204 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20061204 |

|

| RD05 | Notification of revocation of power of attorney |

Free format text: JAPANESE INTERMEDIATE CODE: A7425 Effective date: 20070626 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20090914 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20090929 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20091130 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20100510 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20100708 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20100831 |

|

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20100906 |

|

| R150 | Certificate of patent or registration of utility model |

Free format text: JAPANESE INTERMEDIATE CODE: R150 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20130910 Year of fee payment: 3 |

|

| LAPS | Cancellation because of no payment of annual fees |