JP2018091656A - 情報処理装置、計測装置、システム、算出方法、プログラムおよび物品の製造方法 - Google Patents

情報処理装置、計測装置、システム、算出方法、プログラムおよび物品の製造方法 Download PDFInfo

- Publication number

- JP2018091656A JP2018091656A JP2016233160A JP2016233160A JP2018091656A JP 2018091656 A JP2018091656 A JP 2018091656A JP 2016233160 A JP2016233160 A JP 2016233160A JP 2016233160 A JP2016233160 A JP 2016233160A JP 2018091656 A JP2018091656 A JP 2018091656A

- Authority

- JP

- Japan

- Prior art keywords

- target object

- sampling

- orientation

- model

- unit

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

- 230000010365 information processing Effects 0.000 title claims abstract description 41

- 238000000034 method Methods 0.000 title claims description 116

- 238000004519 manufacturing process Methods 0.000 title claims description 9

- 238000005070 sampling Methods 0.000 claims abstract description 139

- 238000005259 measurement Methods 0.000 claims abstract description 61

- 238000004364 calculation method Methods 0.000 claims abstract description 58

- 238000012545 processing Methods 0.000 claims description 44

- 238000003384 imaging method Methods 0.000 claims description 37

- 230000036544 posture Effects 0.000 description 136

- 230000008569 process Effects 0.000 description 36

- 238000011156 evaluation Methods 0.000 description 33

- 238000006243 chemical reaction Methods 0.000 description 32

- 238000010586 diagram Methods 0.000 description 11

- 239000011159 matrix material Substances 0.000 description 8

- 238000003860 storage Methods 0.000 description 8

- 239000013598 vector Substances 0.000 description 8

- 230000009466 transformation Effects 0.000 description 6

- 230000006870 function Effects 0.000 description 4

- 238000013519 translation Methods 0.000 description 4

- 230000008859 change Effects 0.000 description 2

- 238000013500 data storage Methods 0.000 description 2

- 238000009877 rendering Methods 0.000 description 2

- 230000008901 benefit Effects 0.000 description 1

- 238000007796 conventional method Methods 0.000 description 1

- 238000005520 cutting process Methods 0.000 description 1

- 230000007423 decrease Effects 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 238000007689 inspection Methods 0.000 description 1

- 239000004973 liquid crystal related substance Substances 0.000 description 1

- 238000012423 maintenance Methods 0.000 description 1

- 230000003287 optical effect Effects 0.000 description 1

- 238000002360 preparation method Methods 0.000 description 1

- 230000001629 suppression Effects 0.000 description 1

- 238000002366 time-of-flight method Methods 0.000 description 1

Images

Classifications

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01B—MEASURING LENGTH, THICKNESS OR SIMILAR LINEAR DIMENSIONS; MEASURING ANGLES; MEASURING AREAS; MEASURING IRREGULARITIES OF SURFACES OR CONTOURS

- G01B11/00—Measuring arrangements characterised by the use of optical techniques

- G01B11/24—Measuring arrangements characterised by the use of optical techniques for measuring contours or curvatures

- G01B11/25—Measuring arrangements characterised by the use of optical techniques for measuring contours or curvatures by projecting a pattern, e.g. one or more lines, moiré fringes on the object

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01B—MEASURING LENGTH, THICKNESS OR SIMILAR LINEAR DIMENSIONS; MEASURING ANGLES; MEASURING AREAS; MEASURING IRREGULARITIES OF SURFACES OR CONTOURS

- G01B11/00—Measuring arrangements characterised by the use of optical techniques

- G01B11/24—Measuring arrangements characterised by the use of optical techniques for measuring contours or curvatures

- G01B11/2433—Measuring arrangements characterised by the use of optical techniques for measuring contours or curvatures for measuring outlines by shadow casting

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

-

- G—PHYSICS

- G01—MEASURING; TESTING

- G01B—MEASURING LENGTH, THICKNESS OR SIMILAR LINEAR DIMENSIONS; MEASURING ANGLES; MEASURING AREAS; MEASURING IRREGULARITIES OF SURFACES OR CONTOURS

- G01B11/00—Measuring arrangements characterised by the use of optical techniques

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/60—Analysis of geometric attributes

- G06T7/62—Analysis of geometric attributes of area, perimeter, diameter or volume

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/70—Determining position or orientation of objects or cameras

- G06T7/73—Determining position or orientation of objects or cameras using feature-based methods

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/10—Terrestrial scenes

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V20/00—Scenes; Scene-specific elements

- G06V20/60—Type of objects

- G06V20/64—Three-dimensional objects

- G06V20/653—Three-dimensional objects by matching three-dimensional models, e.g. conformal mapping of Riemann surfaces

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/10—Image acquisition modality

- G06T2207/10028—Range image; Depth image; 3D point clouds

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V2201/00—Indexing scheme relating to image or video recognition or understanding

- G06V2201/06—Recognition of objects for industrial automation

Abstract

【解決手段】対象物体の位置および姿勢を算出する情報処理装置100は、対象物体の形状の計測データおよび対象物体の形状モデルを取得する3次元形状モデル保持部12と、3次元形状モデル保持部12が取得した形状モデルにおいて、対象物体の姿勢を特定するための特定部位のサンプリングに関する情報を決定する特定部位内サンプリング部16と、特定部位内サンプリング部16が決定した特定部位のサンプリングに関する情報および対象物体の形状の計測データに基づいて対象物体の位置および姿勢を算出する位置姿勢算出部17と、を有する。

【選択図】図2

Description

物体の3次元位置姿勢を計測する方法として、対象物体の撮影画像から一個体のおおよその位置姿勢を検出し、その位置姿勢を初期値として、画像データに対して物体の3次元形状モデルをあてはめるモデルフィッティング法がある。モデルフィッティングの手法としては、特許文献1のように対象物体の3次元形状モデル上の幾何特徴からサンプリングしたモデル点を対象物体の距離画像上もしくは濃淡画像上に投影し、画像上の幾何特徴と対応付ける方法が知られている。また、誤認識しやすい形状をもつ対象物体の姿勢を判別する方法として、特許文献2の方法が知られている。特許文献2の方法では、事前に互いに誤りやすい複数の姿勢間の関係を登録しておき、概略位置姿勢からモデルフィッティングした姿勢と、事前の登録に基づいて変換パラメータを用いて算出した姿勢とを比較し、より一致度の高い姿勢を出力している。

特許文献1や特許文献2の方法では、サンプリングする密度を疎にしてモデル点の数を少なくするほど処理時間が短縮されるが、1点あたりの位置姿勢推定の計算に寄与する度合いが相対的に高まるために位置姿勢推定の精度が低下する。局所的な形状を手掛かりとして姿勢の違いやものの違いを判別する必要のある物体を計測する場合、手掛かりとなる部位についての3次元モデル上での幾何的な情報の不足により誤認識する可能性がある。

一方、位置姿勢推定の精度を上げるために、サンプリングする密度を細かくしてモデル点の数を多くすると、モデル点の数に比例して画像上の幾何特徴との対応探索時間が増大してしまう。

特許文献3は、モデルフィッティングに用いるモデル点をサンプリングする方法として、3次元モデルの面を平面や曲面の集合として表現し、各面を単位面積で分割したときの小領域ごとに生成する方法を開示している。特許文献3の方法では、距離計測の誤差が小さいと推測される領域ではサンプリングの密度を低く設定する一方で、距離計測の誤差が大きいと推測される小領域ほどサンプリングの密度を高く設定している。

本実施形態では、類似姿勢の判別の手掛かりとなる局所的な特徴を有する部位(特定部位)に含まれる幾何特徴について、判別が十分可能な密度でモデル点を事前にサンプリングした上で、類似した姿勢を高精度に判別する方法について説明する。

CPU101は、バス106を介して接続する各デバイスを統括的に制御する。CPU101は、読み出し専用メモリであるROM102に記憶された処理ステップやプログラムを読み出して実行する。オペレーティングシステム(OS)をはじめ、本実施形態に係る各処理プログラム、デバイスドライバ等はROM102に記憶されており、RAM(ランダムアクセスメモリ)103に一時記憶され、CPU101によって適宜実行される。入力I/F104は、外部の装置(撮像装置や操作装置など)から情報処理装置100で処理可能な形式で入力信号として入力する。出力I/F105は、外部の装置(表示装置)へ表示装置が処理可能な形式で出力信号として出力する。

情報処理装置100は、各処理部と記憶部22を有している。各処理部は、計測データ保持部10、概略位置姿勢算出部11、3次元形状モデル保持部12、モデル点サンプリング部13、類似姿勢指定部14、特定部位指定部15、特定部位内サンプリング部16、位置姿勢算出部17、出力部21を含む。また、情報処理装置100は撮像装置18、表示装置19、操作装置20、ロボットなどの外部装置の制御部23に接続されている。なお、本実施形態では、情報処理装置100の外部に撮像装置18、表示装置19、操作装置20、制御部23を接続しているが、撮像装置18、表示装置19、操作装置20、制御部23を含めて一体として情報処理装置として構成してもよい。

計測データ保持部10は、撮像装置18によって撮像された対象物体の濃淡画像(2次元画像)や距離画像(3次元情報)などの計測データ(計測情報)を取得して保持する。本実施形態において計測データ保持部10は、撮像装置18によって撮像した計測データを取得するが、これに限らず記憶媒体等から事前に取得した計測データを取得しても構わない。

具体的にはまず、概略位置姿勢に基づき、3次元形状モデルと画像中の対象物体とが最もフィットするような位置姿勢を算出する。その後、類似姿勢の変換パラメータに基づき、算出された位置姿勢と誤りやすい関係にある位置姿勢を求め、その位置姿勢を初期値として別途モデルフィッティングを行う。その後、モデルフィッティング結果の評価値を、特定部位に含まれるモデル点を用いて算出・比較し、評価値のよい方の位置姿勢を最終結果として出力部21に入力する。

モデルフィッティングは、モデル点を距離画像上もしくは濃淡画像上に投影し、画像上の幾何特徴とフィットするように位置姿勢を補正することで行う。モデル点と対応づける計測データについては、距離画像のみあるいは濃淡画像のみを用いてフィッティングを行ってもよいし、その両方を用いてもよい。

操作装置20は、例えば、キーボードとマウスであり、ユーザからの指示を入力するのに用いられ、特にマウスはGUIを操作するのに用いられる。

なお、情報処理装置100が備える各処理部の機能は、図1中のCPU101が、ROM102に記録されているプログラムをRAM103にロードして実行することによって実現される。また、各処理部におけるデータの保持や記憶部22におけるデータの記憶は、図1中のROM102やRAM103などのメモリで行われる。

(ステップS401)

ステップS401において、情報処理装置100に対象物体の3次元形状モデルを入力する。入力された3次元形状モデルは、3次元形状モデル保持部12に保持される。モデル点サンプリング部13、類似姿勢指定部14、特定部位指定部15、および位置姿勢算出部17は、3次元形状モデル保持部12から対象物体の3次元形状モデルを取得する。

ステップS402において、モデル点サンプリング部13は、入力される3次元形状モデルの情報からモデル点をサンプリングする。ここでサンプリングされる点は、後述のステップS408とステップS410においてモデルフィッティングを行うために用いられる。モデルフィッティング用のモデル点をサンプリングする際には、サンプリングを実施する3次元形状モデル上の部位や、サンプリングするモデル点の数(即ち、サンプリング点数)について事前に設定を行う必要がある。なお、モデル点のサンプリングに関する情報については、本実施形態においてはサンプリング点数を設定しているが、3次元形状モデル上の面やエッジ稜線上にサンプリングを行うサンプリング密度を設定してもよい。

ステップS403において、類似姿勢指定部14は、互いに誤りやすい異なる2つの姿勢(第1の姿勢、第2の姿勢)の関係を表す、類似姿勢の変換パラメータを登録する。本ステップでの姿勢の登録方法は、例えば特許文献2に示されているような、GUIを用いた方法を用いることとする。このとき、ユーザは類似姿勢指定部14を介して操作装置20を用いてGUIを操作する。

XV’=TVBXB’

ここで、

XV’=[XV,YV,ZV,1]T

XB’=[XB,YB,ZB,1]T

XV’=TVOXO’

ここで、

XO’=[XO,YO,ZO,1]T

XV’=[XV,YV,ZV,1]T

Tr=(TVB)−1TVO

算出したTrは位置を表す3パラメータ、姿勢を表す3パラメータの合計6パラメータで表現可能である。そこで、Trから位置姿勢を表す6パラメータの値を取得し、これらを一組にしたものを変換パラメータとしてリストに追加する。なお、6パラメータの値の代わりに、4×4行列を構成する16個のパラメータの値を一組にしたものを変換パラメータとすることもできる。あるいは、基準モデルの位置姿勢を表す6パラメータ、操作モデルの位置姿勢を表す6パラメータを一組にして変換パラメータとしてももちろんよい。その他、基準モデルと操作モデルとの相対位置姿勢Trを復元可能、すなわち、2つのモデル間の位置姿勢を互いに変換可能であればいかなるパラメータを変換パラメータとしてもかまわない。また、姿勢を表す3パラメータのみを変換パラメータとしてもかまわない。

ステップS404において、特定部位指定部15は、ステップS403において登録された類似姿勢の判別に用いる特定部位を登録する。本実施形態における特定部位の登録は、ステップS403と同様に、ユーザがGUIを用いて行う方法を用いることとする。ユーザは特定部位指定部15を介して操作装置20を用いてGUIを操作する。表示装置19に、類似姿勢の関係にある2つの3次元形状モデルと、特定部位を登録するための直方体が表示されている状態で、ユーザは操作装置20を用いて直方体を移動もしくは拡大/縮小させて直方体内に囲まれる部位を選択し、特定部位として登録する。このとき、直方体を選択した時の仮想カメラから観測可能な操作モデル表面について、画面上で指定した直方体内における奥行き方向の存在範囲を算出し、算出した存在範囲と画面上の直方体により定義される3次元空間を算出する。そして、仮想カメラに対する操作モデルの位置姿勢に基づきモデル座標系に変換し直して記録する。

ステップS405において、特定部位内サンプリング部16は、ステップS404において登録された特定部位の情報からモデル点をサンプリングする。ここでサンプリングされる点は、後述のステップS412における評価値の算出に用いられる。ステップS405においてサンプリング類似姿勢判別用のモデル点をサンプリングする際には、サンプリングを実施する部位が特定部位に限定される。

ステップS406において、計測データ保持部10は、撮像装置18により撮像された対象物体の距離画像および濃淡画像を取得する。図9(A)に撮像した画像900を示す。なお、本実施形態においては、モデル点のサンプリングの後に計測データを取得しているが、撮像装置18によって撮像が実施された後であれば、ステップS401からステップS405までの一連の処理の中のどこで実施しても構わない。

ステップS407において、概略位置姿勢算出部11は、撮影画像中に存在するバラ積みされた多数の対象物体の中から一個体の検出を行い、センサ座標系における対象物体の概略位置姿勢を表す6つのパラメータを算出して記録する。ここで算出した6つのパラメータに基づくモデル座標系からセンサ座標系への座標変換において、姿勢を表す3つのパラメータで表現される3×3の回転行列をRSM、位置を表す3つのパラメータで表現される3列の並進ベクトルをtSMとする。このとき、モデル座標系XM=[XM,YM,ZM]Tからセンサ座標系XS=[XS,YS,ZS]Tへの変換は、4×4行列T0’を用いて以下のように表すことができる。

XS’=T0’XM’

ここで、

XS’=[XS,YS,ZS,1]T

XM’=[XM,YM,ZM,1]T

ステップS408において、位置姿勢算出部17は、概略位置姿勢T0’を初期値として3次元モデルと画像中の対象物体とのモデルフィッティングを行うことで、対象物体の位置姿勢を算出する。具体的には、3次元形状モデルを撮像装置のパラメータと概略位置姿勢とに基づいて撮影画像に投影する。そして、投影された3次元形状モデルの特徴と画像中の対象物体の特徴とを対応付けてその残差を小さくすることにより、対象物体の位置姿勢を算出する。対象物体の高精度な位置姿勢を算出する。ここで算出した位置姿勢の6パラメータにより表現可能な、モデル座標系からセンサ座標系への座標変換を行う4×4の回転行列をT0とする。ここで、図9(C)に、フィッティング後の位置姿勢T0に基づき、撮影画像上に3次元形状モデルを投影した結果を示す。投影した3次元形状モデルが点線902である。この例では、概略位置姿勢算出部11が誤った一個体を検出したために、本ステップにおいて高精度な位置姿勢算出を行っても、正しい位置姿勢が算出されていない。

ステップS409において、位置姿勢算出部17は、ステップS408で算出した位置姿勢に対して評価値を算出し、所定の閾値と比較を行うことで位置姿勢の正誤を判定し、後段の処理を実施するか否かの判定を行う。たとえばフィッティング後の位置姿勢におけるモデル表面上の幾何特徴と、画像中の幾何特徴との3次元的な距離を残差とする(ずれ量取得)。そして、全幾何特徴の残差の平均値Eをスコアとして用いることができる。

ステップS410において、位置姿勢算出部17は、位置姿勢T0と、類似姿勢指定部14から取得したN組の各変換パラメータとを用いて、新たな位置姿勢の候補を生成する。まず、変換パラメータから復元可能な相対位置姿勢をTr_i(i=1〜N)と表現し、それぞれを用いて作成した新たな候補の位置姿勢をTi’とする。Ti’は以下により算出する。

Ti’=T0Tr_i −1

図9(D)は、新たな候補の位置姿勢Ti’に基づき、撮影画像上に3次元形状モデルを投影したものである。投影した3次元形状モデルが点線903である。次に位置姿勢算出部17は、生成された新たな候補の位置姿勢Ti’を初期値として、ステップS408と同様に撮影画像と3次元形状モデルとがフィットするように、対象物体の位置姿勢を算出(導出)する。ここで算出された位置姿勢をTiとする。

ステップS411において、位置姿勢算出部17は、ステップS409で生成されたN個の位置姿勢Tiの算出が完了しているかを判定する。N個のTiの算出が完了していればステップS412へ処理を進め、完了していなければステップS410へ処理を戻す。なお、N個の新たな候補位置姿勢に対してステップS410の処理を並列化して実施してもよい。

ステップS412において、位置姿勢算出部17は、ステップS410で算出した(N+1)個の位置姿勢Ti(i=0〜N)に対して、S305で決定した特定部位のサンプリングに関する情報に基づいて、評価値を算出する。具体的には、特定部位のモデル点と計測点の一致度から評価値を算出する。そして、算出した評価値のうち、最良の評価値に対応する位置姿勢を最終的な対象物体の位置姿勢として出力する。

第1実施形態においては、特定部位についてなるべく多くのモデル点をサンプリングするようにパラメータを設定した。モデル点の数が多いほど類似姿勢の判別が容易となる一方、評価値を算出するための処理時間が増大する。サンプリング点数もしくはサンプリング密度の設定値が過剰である場合、類似姿勢の峻別性と処理時間との両立ができなくなる場合が考えられる。そこで、本実施形態では、サンプリングするモデル点の数が判定の精度を維持しつつも処理時間の増加を抑制することができる所定の基準値以下になるよう、サンプリング点数もしくはサンプリング密度を決定する。具体的には、特定部位のサンプリングを行った後に、サンプリングした点の数が過剰であるかどうかを判別し、過剰分については間引くという処理を追加で行う。本実施形態にかかる情報処理装置100の構成は第1実施形態と同様であるため説明を省略する。

ステップS1006において、特定部位内サンプリング部16は、ステップS1005においてサンプリングしたモデル点の数についてサンプリングするモデル点数の所定の基準値との比較を行い、モデル点数が過剰であるか否か判定する。モデル点数の所定の基準値(以下、「サンプリング基準点数」ともいう)は面積に関わらず設定してよいが、観測される面積ごとに段階的に設定してもよい。ここで、サンプリング基準点数は事前に設定されるパラメータである。サンプリング基準点数は、類似姿勢を判別でき、かつ所望の処理時間以内で一連の処理を実施可能な範囲内で設定される。

ステップS1007において、特定部位内サンプリング部は、過剰であると判断されたモデル点を間引く処理を実施し、モデル点の数が所定の基準値以下になるようにする。モデル点を間引く方法としては、例えば特定部位におけるモデル点がなるべく等間隔に分布するように間引く方法がある。具体的には、まずサンプリング基準値の情報と、特定部位に含まれる幾何特徴の面積や稜線の長さの情報から、間引き後のモデル点について、モデル点が一様に分布している場合を想定したモデル点間の距離の理想値を算出する。次に、特定部位内で実際にサンプリングされている各モデル点について再近傍のモデル点との距離を算出する。距離が理想値より短い場合には、距離を算出するのに用いたモデル点のどちらかを間引く。この処理を全モデル点について順次実施することにより、モデル点がおおよそ等間隔に分布するようにモデル点を間引くことができる。また、モデル点を間引くその他の方法としては、ランダムに間引く方法を用いてもよい。

以上説明したように、特定部位のサンプリングを行った後に、サンプリングした点の数が過剰であるかどうかを判別し、過剰分については間引くという処理を追加で行うことにより、判定の精度を維持しつつも処理時間の増加を抑制することができる。

ステップS1105において、特定部位内サンプリング部16は、モデル点を設定する概略位置姿勢(以下、「概略位置姿勢候補」ともいう)と、概略位置姿勢候補ごとのサンプリング条件を設定する。サンプリング条件とは、例えば特定部位内のサンプリング密度やサンプリングするモデル点の数が挙げられる。サンプリング条件を設定する方法としては、例えば計測範囲内における対象物の位置ごとに設定する方法等がある。

図12(A)では、撮像装置18から見て、撮像範囲800の中で手前側の位置に対象物体1200が、奥側の位置に対象物体1210が配置されている。この場合、手前側の対象物体1200の方が奥側の対象物体1210よりも大きく撮像される。そのため、手前側の対象物体1200の方が、奥側の対象物体1210よりもモデル点の密度が低くても類似姿勢の判別が可能である。よって、図12(A)のような場合には、撮像装置の手前側におけるモデル点のサンプリング密度を、奥側におけるモデル点のサンプリング密度よりも低く設定するのが有効である。概略位置姿勢候補の数については、2つに限らず、いくつ設定してもよい。その場合、配置される対象物体が類似姿勢の判別に有利な位置(例えば、幾何特徴が大きく観測される位置)になる場合はサンプリング密度を低く設定するのが有効である。一方、配置される対象物体が類似姿勢の判別に不利な位置(例えば、幾何特徴が小さく観測される位置)になる場合は、サンプリング密度を高く設定するのが有効である。

図11のステップS1106において、特定部位内サンプリング部16は、ステップS1105において設定されたサンプリング条件に従って概略位置姿勢候補ごとにモデル点のサンプリングを実施する。サンプリングされたモデル点の情報は概略位置姿勢候補に紐づけられる。概略位置姿勢候補の情報とそれに紐づくモデル点の情報は位置姿勢算出部17に送られ、後述の処理であるステップS1109においてどのモデル点を使用するかが決定される。

ステップS1109において、位置姿勢算出部17はステップS1108において算出された概略位置姿勢の情報をもとに、どのモデル点を類似姿勢の判別に用いるかを決定する。使用するモデル点の決定方法としてはまず、ステップS1108において算出された概略位置姿勢と、ステップS1105で設定された概略位置姿勢候補の照合を行う。概略位置姿勢候補の中で、ステップS1108において算出された概略位置姿勢と一致するものがあった場合は、一致した概略位置姿勢候補に紐づけられたモデル点が類似姿勢の判別に用いられる。概略位置姿勢候補の中で、ステップS1108において算出された概略位置姿勢と一致するものがなかった場合は、最も近い概略位置姿勢候補が選択され、それに紐づくモデル点が類似姿勢の判別に用いられる。

第1実施形態、第2実施形態、第3実施形態では、姿勢を誤りやすい形状の特徴をもつ同じ形状の対象物体を判別する方法について述べた。本実施形態では、対象物体と形状の一部が異なる類似物体とを判別する方法について述べる。

図13は、対象物体と類似物体を示す図である。本実施形態で想定するのは、図13(A)で示すような形状をした対象物体3と、図13(B)で示すような形状をした類似物体1300との判別である。両者は形状の一部(対象物体3の特定部位4と類似物体1300の特定部位1301)が異なっており、例えば対象物体のバラ積みに類似物体が混入していた場合、誤認識する可能性がある。そのような誤認識を防ぐために、まず対象物体とともに類似物体の3次元形状モデルを入力し、対象物体と類似物体で誤認識する可能性のある相対姿勢を登録した上で判別の手掛かりとなる特定部位を登録する。図13(C)及び図13(D)は、登録する特定部位503の一例を示す図である。その後、対象物体と類似物体の3次元形状モデルにおいてそれぞれ特定部位503内のモデル点をサンプリングし、撮影画像上で観測される物体についてモデルフィッティングを実施して特定部位内での評価値を算出する。そして、対象物体のモデル点を用いた特定部位内での評価値と、類似物体のモデル点を用いた特定部位内での評価値とを比較することで、対象物体と類似物体を判別する。なお、本実施形態にかかる情報処理装置100の構成は第1実施形態と同様であるため説明を省略する。

ステップS1401において、モデル点サンプリング部13、類似姿勢指定部14、特定部位指定部15、および位置姿勢算出部17は、3次元形状モデル保持部12から対象物体の3次元形状モデルと類似物体の3次元形状モデルを取得する。これらの処理を実施する順番は任意であり、もしくは同時に取得しても構わない。

ステップS1402において、モデル点サンプリング部13は、入力される対象物体の3次元形状モデルの情報と類似物体の3次元形状モデルの情報から、それぞれモデル点をサンプリングする。ここでサンプリングされる点は、後述のステップS1408とステップS1410においてモデルフィッティングを行うために用いられる。ここで、サンプリングを実施する条件については第1実施形態のステップS402における条件と同様であるため、説明を省略する。

ステップS1403において、類似姿勢指定部14は、対象物体と類似物体について誤認識しやすい相対位置姿勢の変換パラメータを登録する。図13(A)に示すような対象物体と類似物体については、図13(B)に示すような相対位置姿勢に対応する変換パラメータが登録される。相対位置姿勢の変換パラメータの登録方法については第1実施形態のステップS403における方法と同様であるため、説明を省略する。

ステップS1404において、特定部位指定部15は、ステップS1403において登録された相対位置姿勢で対象物体と類似物体を判別する特定部位を登録する。ステップS1403において図13(B)に示すような相対位置姿勢が登録された場合、図13(C)に示すように特定部位を登録することが有効である。本実施形態における特定部位の登録方法は、ステップS1403、および第1実施形態のステップS404における方法と同様であるため、説明を省略する。

ステップS1405において、特定部位内サンプリング部16は、ステップS1404において登録された特定部位の情報から対象物体の3次元形状モデルと類似物体の3次元形状モデルのそれぞれについて、特定部位内でモデル点をサンプリングする。ここで、サンプリングされる点は、後述のステップS1411における評価値の算出に用いられる。ここで、サンプリングを実施する際の条件については、第1実施形態のステップS405における条件と同様であるため、説明を省略する。

ステップS1409において、位置姿勢算出部17は、ステップS1408で算出した対象物体の位置姿勢に対して評価値を算出し、所定の閾値と比較を行う。評価値の例としては、第1実施形態と同様に、フィッティング後の位置姿勢におけるモデル表面上の幾何特徴と画像中の幾何特徴との3次元的な距離の残差について、全幾何特徴の残差の平均値を用いることができる。算出した残差の平均値Eが所定の閾値よりも小さければ、対象物体であると判定し、以降の処理を省略することができる。一方、Eが所定の閾値よりも大きければ、類似物体である可能性があると判定してステップS1410に進む。このほか、ステップS1408で算出された位置姿勢について、対象物体と類似物体を峻別可能な方法であればいかなる方法であっても構わない。

なお、この処理を省略し、必ずステップS1410へ進むようにしてもよい。

ステップS1410において、位置姿勢算出部17は、ステップS1408において算出された位置姿勢T0と、対象物体の姿勢と類似物体の姿勢との変換パラメータを用いて、新たな位置姿勢の候補を生成する。まず、変換パラメータから復元可能な相対位置姿勢をTと表現し、それぞれを用いて作成した新たな候補の位置姿勢をT’とする。T’は以下により算出する。

T’=T0T−1

次に位置姿勢算出部17は、生成された新たな候補の位置姿勢T’を初期値として、撮影画像と3次元形状モデルとがフィットするように位置姿勢を算出する。ここで、3次元形状モデルは、対象物体のモデルと類似物体のモデルを両方用い、それぞれについて姿勢を算出する。対象物体の3次元形状モデルを用いて算出された位置姿勢をTA、類似物体の3次元形状モデルを用いて算出された位置姿勢をTBとする。

ステップS1411において、位置姿勢算出部17は、ステップS1410で算出した位置姿勢TA、TBに対し、特定部位として登録された部位のモデル点と計測点の一致度からそれぞれ評価値を算出する。ここで用いる評価値には、ステップS1409と同様に残差を用いてもよいし、算出された位置姿勢に基づいて対象物体を投影した画像と、撮影画像との正規化相互相関を用いてもよい。その他、複数の位置姿勢の正誤を評価値に基づいて峻別可能な方法であればいかなる方法であっても構わない。

ステップS1412において、位置姿勢算出部17は位置姿勢TAについて算出した評価値(評価値A)と、位置姿勢TBについて算出した評価値(評価値B)を比較する。具体的には、評価値Aが評価値Bよりも高い値であった場合、撮影画像中の物体は対象物体であると判定される。一方、評価値Bが評価値Aよりも高い値であった場合、撮影画像中の物体は類似物体であると判定される。

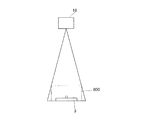

上述の撮像装置18は、ある支持部材に支持された状態で使用されうる。本実施形態では、一例として、図15のように把持装置としてのロボットアーム1500に備え付けられて使用される制御システムについて説明する。撮像装置18を有する計測装置は、支持台1550にバラ積みされた対象物体3にパターン光を投影して撮像し、情報処理装置100はその画像を取得する。そして、情報処理装置100の位置姿勢算出部17が、対象物体3の位置および姿勢を求め、求められた位置および姿勢の情報を制御部23が取得する。制御部23は、計測結果である、対象物体3の位置および姿勢の情報に基づいて、ロボットアーム1500に駆動指令を送ってロボットアーム1500を制御する。ロボットアーム1500は保持部、把持部としての先端のロボットハンドなどで対象物体3を保持して、並進や回転などの移動をさせる。さらに、ロボットアーム1500によって対象物体3を他の部品に組み付けることにより、複数の部品で構成された物品、例えば電子回路基板や機械などを製造することができる。また、移動された対象物体3を加工することにより、物品を製造することができる。また、情報処理装置100が取得した計測データや画像や算出結果をディスプレイなどの表示装置19に表示してもよい。

以上に説明した実施形態に係る計測装置は、物品製造方法に使用しうる。当該物品製造方法は、当該計測装置を用いて物体の計測を行う工程と、計測の結果に基づいて当該工程で計測を行われた物体の処理を行う工程と、を含みうる。当該処理は、例えば、加工、切断、搬送、組立(組付)、検査、および選別のうちの少なくともいずれか一つを含みうる。本実施形態の物品製造方法は、従来の方法に比べて、物品の性能・品質・生産性・生産コストのうちの少なくとも1つにおいて有利である。

本発明は、上述の実施形態の1以上の機能を実現するプログラムを、ネットワーク又は記憶媒体を介してシステム又は装置に供給し、そのシステム又は装置のコンピュータにおける1つ以上のプロセッサーがプログラムを読出し実行する処理でも実現可能である。また、1以上の機能を実現する回路(例えば、ASIC)によっても実現可能である。

12 3次元形状モデル保持部

15 特定部位指定部

16 特定部位内サンプリング部

17 位置姿勢算出部

Claims (15)

- 対象物体の位置および姿勢を算出する情報処理装置であって、

前記対象物体の形状の計測データおよび前記対象物体の形状モデルを取得する取得部と、

前記取得部が取得した前記形状モデルにおいて、前記対象物体の姿勢を特定するための特定部位のサンプリングに関する情報を決定するサンプリング部と、

前記サンプリング部が決定した前記特定部位の前記サンプリングに関する情報および前記対象物体の形状の計測データに基づいて前記対象物体の位置および姿勢を算出する算出部と、を有することを特徴とする情報処理装置。 - 前記サンプリング部は、前記サンプリングに関する情報として、サンプリングするモデル点の密度を決定し、当該決定された前記特定部位のモデル点の密度は、前記特定部位とは異なる他の領域をサンプリングするモデル点の密度より高いことを特徴とする請求項1に記載の情報処理装置。

- 前記サンプリング部は、前記対象物体を撮像する撮像装置の解像度または撮像可能範囲に基づいて、前記サンプリングに関する情報を決定することを特徴とする請求項1または請求項2に記載の情報処理装置。

- 前記サンプリング部は、前記サンプリングに関する情報として、サンプリングするモデル点の数を所定の基準値以下の範囲で決定することを特徴とする請求項1乃至3のうちいずれか1項に記載の情報処理装置。

- 前記対象物体の概略の位置および姿勢を算出する概略算出部をさらに有し、

前記サンプリング部は、前記対象物体の概略位置姿勢の候補ごとに前記サンプリングに関する情報を設定し、

前記算出部は、前記概略算出部が算出した前記対象物体の概略の位置および姿勢に基づいて前記対象物体の位置および姿勢を算出するのに用いる前記サンプリングに関する情報を決定することを特徴とする請求項1乃至4のうちいずれか1項に記載の情報処理装置。 - 前記取得部は、さらに、前記対象物体と形状の類似する類似物体の3次元形状モデルを取得し、

前記サンプリング部は、さらに、前記対象物体と前記類似物体との判別に用いる特定部位のサンプリングに関する情報を決定し、

前記算出部は、前記サンプリング部が決定した、前記対象物体の前記サンプリングに関する情報と前記類似物体の前記サンプリングに関する情報に基づいて、計測された物体が前記対象物体であるか否か判断することを特徴とする請求項1乃至5のうちいずれか1項に記載の情報処理装置。 - 前記算出部により算出された前記対象物体の位置および姿勢の情報を出力する出力部をさらに有することを特徴とする請求項1乃至6のうちいずれか1項に記載の情報処理装置。

- 前記特定部位は、前記対象物体の類似姿勢を判別するための部位であることを特徴とする請求項1乃至7のうちいずれか1項に記載の情報処理装置。

- 対象物体の位置および姿勢を計測する計測装置であって、

前記対象物体の形状を計測する計測部と、

請求項1乃至8のうちいずれか1項に記載の情報処理装置と、を有し、

前記情報処理装置は、前記計測部によって計測された前記対象物体の形状の計測データを取得し、前記対象物体の位置および姿勢を算出することを特徴とする計測装置。 - 請求項1乃至8のうちいずれか1項に記載の情報処理装置と、

前記対象物体を保持して移動させるロボットと、を有し、

前記情報処理装置から出力された前記対象物体の位置および姿勢に基づいて、前記ロボットが前記対象物体を保持する、ことを特徴とするシステム。 - 対象物体の位置および姿勢を計測する計測装置であって、

前記対象物体の形状を計測する計測部と、

前記計測部による前記形状の計測データと前記対象物体の形状モデルとを比較することによって、前記対象物体の位置および姿勢を算出する処理部と、を有し、

前記処理部は、前記対象物体の形状モデルにおいて前記対象物体の姿勢を特定するための特定部位のサンプリングに関する情報を決定し、前記サンプリングに関する情報に基づいて前記対象物体の位置および姿勢を算出することを特徴とする計測装置。 - 請求項11に記載の計測装置と、

前記対象物体を保持して移動させるロボットと、を有し、

前記計測装置から出力された前記対象物体の位置および姿勢に基づいて、前記ロボットが前記対象物体を保持する、ことを特徴とするシステム。 - 対象物体の位置および姿勢を算出する算出方法であって、

前記対象物体の形状の計測データおよび前記対象物体の形状モデルを取得する取得工程と、

前記取得工程で取得した前記形状モデルにおいて、前記対象物体の類似姿勢を判別し、姿勢を特定するための特定部位を指定する指定工程と、

前記指定工程で指定した前記特定部位のサンプリングに関する情報を決定するサンプリング工程と、

前記サンプリング工程で決定した前記特定部位の前記サンプリングに関する情報および前記対象物体の形状の計測データに基づいて前記対象物体の位置および姿勢を算出する算出工程と、を有することを特徴とする算出方法。 - 請求項13に記載の算出方法をコンピュータに実行させるためのプログラム。

- 請求項1乃至8のうちいずれか1項に記載の情報処理装置を用いて対象物体の計測を行う工程と、該計測の結果に基づいて前記対象物体を処理する工程と、を含むことを特徴とする物品の製造方法。

Priority Applications (4)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2016233160A JP2018091656A (ja) | 2016-11-30 | 2016-11-30 | 情報処理装置、計測装置、システム、算出方法、プログラムおよび物品の製造方法 |

| US15/817,459 US20180150969A1 (en) | 2016-11-30 | 2017-11-20 | Information processing device, measuring apparatus, system, calculating method, storage medium, and article manufacturing method |

| EP17001905.3A EP3330921A1 (en) | 2016-11-30 | 2017-11-22 | Information processing device, measuring apparatus, system, calculating method, storage medium, and article manufacturing method |

| CN201711213323.9A CN108120391A (zh) | 2016-11-30 | 2017-11-28 | 信息处理设备和方法、存储介质和物品制造方法 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2016233160A JP2018091656A (ja) | 2016-11-30 | 2016-11-30 | 情報処理装置、計測装置、システム、算出方法、プログラムおよび物品の製造方法 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2018091656A true JP2018091656A (ja) | 2018-06-14 |

| JP2018091656A5 JP2018091656A5 (ja) | 2020-07-09 |

Family

ID=60484093

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2016233160A Pending JP2018091656A (ja) | 2016-11-30 | 2016-11-30 | 情報処理装置、計測装置、システム、算出方法、プログラムおよび物品の製造方法 |

Country Status (4)

| Country | Link |

|---|---|

| US (1) | US20180150969A1 (ja) |

| EP (1) | EP3330921A1 (ja) |

| JP (1) | JP2018091656A (ja) |

| CN (1) | CN108120391A (ja) |

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2019215180A (ja) * | 2018-06-11 | 2019-12-19 | オムロン株式会社 | 計測システムおよび計測方法 |

| WO2021039403A1 (ja) * | 2019-08-30 | 2021-03-04 | オムロン株式会社 | 顔向き推定装置及び方法 |

Families Citing this family (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US20180268614A1 (en) * | 2017-03-16 | 2018-09-20 | General Electric Company | Systems and methods for aligning pmi object on a model |

| CN109840947B (zh) * | 2017-11-28 | 2023-05-09 | 广州腾讯科技有限公司 | 增强现实场景的实现方法、装置、设备及存储介质 |

| CN108089958B (zh) * | 2017-12-29 | 2021-06-08 | 珠海市君天电子科技有限公司 | Gpu测试方法、终端设备和计算机可读存储介质 |

| CN109242903B (zh) * | 2018-09-07 | 2020-08-07 | 百度在线网络技术(北京)有限公司 | 三维数据的生成方法、装置、设备及存储介质 |

| JP7208480B2 (ja) * | 2018-10-12 | 2023-01-19 | 富士通株式会社 | 学習プログラム、検出プログラム、学習装置、検出装置、学習方法および検出方法 |

| GB201912439D0 (en) * | 2019-08-30 | 2019-10-16 | Renishaw Plc | Spectroscopic apparatus and methods for determining components present in a sample |

| CN113674430A (zh) * | 2021-08-24 | 2021-11-19 | 上海电气集团股份有限公司 | 虚拟模型定位配准方法、装置、增强现实设备和存储介质 |

Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2007098567A (ja) * | 2006-09-25 | 2007-04-19 | Hitachi Ltd | 自律制御型ロボットおよびその制御装置 |

| JP2011179910A (ja) * | 2010-02-26 | 2011-09-15 | Canon Inc | 位置姿勢計測装置、位置姿勢計測方法、およびプログラム |

| JP2014120068A (ja) * | 2012-12-18 | 2014-06-30 | Canon Inc | 情報処理装置および情報処理方法 |

| JP2015194478A (ja) * | 2014-03-20 | 2015-11-05 | キヤノン株式会社 | 情報処理装置、情報処理方法、プログラム |

Family Cites Families (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US5988862A (en) * | 1996-04-24 | 1999-11-23 | Cyra Technologies, Inc. | Integrated system for quickly and accurately imaging and modeling three dimensional objects |

| JP4900204B2 (ja) * | 2007-11-22 | 2012-03-21 | 株式会社Ihi | 物体認識方法 |

| JP5460341B2 (ja) * | 2010-01-06 | 2014-04-02 | キヤノン株式会社 | 3次元計測装置及びその制御方法 |

| JP2011175477A (ja) | 2010-02-24 | 2011-09-08 | Canon Inc | 3次元計測装置、処理方法及びプログラム |

| JP2013101045A (ja) * | 2011-11-08 | 2013-05-23 | Fanuc Ltd | 物品の3次元位置姿勢の認識装置及び認識方法 |

-

2016

- 2016-11-30 JP JP2016233160A patent/JP2018091656A/ja active Pending

-

2017

- 2017-11-20 US US15/817,459 patent/US20180150969A1/en not_active Abandoned

- 2017-11-22 EP EP17001905.3A patent/EP3330921A1/en not_active Withdrawn

- 2017-11-28 CN CN201711213323.9A patent/CN108120391A/zh active Pending

Patent Citations (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2007098567A (ja) * | 2006-09-25 | 2007-04-19 | Hitachi Ltd | 自律制御型ロボットおよびその制御装置 |

| JP2011179910A (ja) * | 2010-02-26 | 2011-09-15 | Canon Inc | 位置姿勢計測装置、位置姿勢計測方法、およびプログラム |

| JP2014120068A (ja) * | 2012-12-18 | 2014-06-30 | Canon Inc | 情報処理装置および情報処理方法 |

| JP2015194478A (ja) * | 2014-03-20 | 2015-11-05 | キヤノン株式会社 | 情報処理装置、情報処理方法、プログラム |

Cited By (4)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2019215180A (ja) * | 2018-06-11 | 2019-12-19 | オムロン株式会社 | 計測システムおよび計測方法 |

| JP7119606B2 (ja) | 2018-06-11 | 2022-08-17 | オムロン株式会社 | 計測システムおよび計測方法 |

| WO2021039403A1 (ja) * | 2019-08-30 | 2021-03-04 | オムロン株式会社 | 顔向き推定装置及び方法 |

| JP2021039420A (ja) * | 2019-08-30 | 2021-03-11 | オムロン株式会社 | 顔向き推定装置及び方法 |

Also Published As

| Publication number | Publication date |

|---|---|

| EP3330921A1 (en) | 2018-06-06 |

| US20180150969A1 (en) | 2018-05-31 |

| CN108120391A (zh) | 2018-06-05 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP2018091656A (ja) | 情報処理装置、計測装置、システム、算出方法、プログラムおよび物品の製造方法 | |

| CN110568447B (zh) | 视觉定位的方法、装置及计算机可读介质 | |

| CN110411441B (zh) | 用于多模态映射和定位的系统和方法 | |

| CN110807350B (zh) | 用于面向扫描匹配的视觉slam的系统和方法 | |

| JP6681729B2 (ja) | オブジェクトの3d姿勢およびオブジェクトのランドマーク点の3dロケーションを求める方法、およびオブジェクトの3d姿勢およびオブジェクトのランドマークの3dロケーションを求めるシステム | |

| JP6642968B2 (ja) | 情報処理装置、情報処理方法、プログラム | |

| JP5430456B2 (ja) | 幾何特徴抽出装置、幾何特徴抽出方法、及びプログラム、三次元計測装置、物体認識装置 | |

| JP4677536B1 (ja) | 3次元物体認識装置及び3次元物体認識方法 | |

| JP5380789B2 (ja) | 情報処理装置、および情報処理方法、並びにコンピュータ・プログラム | |

| JP6594129B2 (ja) | 情報処理装置、情報処理方法、プログラム | |

| US11654571B2 (en) | Three-dimensional data generation device and robot control system | |

| JP6632208B2 (ja) | 情報処理装置、情報処理方法、プログラム | |

| JP2008506953A (ja) | 機械視覚のための方法及び装置 | |

| CN107025663A (zh) | 视觉系统中用于3d点云匹配的杂波评分系统及方法 | |

| US20180290300A1 (en) | Information processing apparatus, information processing method, storage medium, system, and article manufacturing method | |

| JP2019114103A (ja) | 物体認識処理装置、物体認識処理方法及びプログラム | |

| JP2019153290A (ja) | ビジョンシステムにより画像特徴におけるエッジと法線を同時に考慮するためのシステム及び方法 | |

| JP2014134856A (ja) | 被写体識別装置、被写体識別方法および被写体識別プログラム | |

| US11189053B2 (en) | Information processing apparatus, method of controlling information processing apparatus, and non-transitory computer-readable storage medium | |

| JP2018195070A (ja) | 情報処理装置、情報処理方法、及びプログラム | |

| JPH07103715A (ja) | 視覚に基く三次元位置および姿勢の認識方法ならびに視覚に基く三次元位置および姿勢の認識装置 | |

| JP5462662B2 (ja) | 位置姿勢計測装置、物体識別装置、位置姿勢計測方法及びプログラム | |

| JPH0981737A (ja) | 三次元物体モデル生成方法 | |

| WO2022137509A1 (ja) | 物体認識装置、物体認識方法、非一時的なコンピュータ可読媒体及び物体認識システム | |

| JP2018200175A (ja) | 情報処理装置、情報処理方法及びプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20191114 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20200529 |

|

| A871 | Explanation of circumstances concerning accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A871 Effective date: 20200529 |

|

| A975 | Report on accelerated examination |

Free format text: JAPANESE INTERMEDIATE CODE: A971005 Effective date: 20200813 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20200826 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20200901 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20201102 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20210202 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20210427 |

|

| C60 | Trial request (containing other claim documents, opposition documents) |

Free format text: JAPANESE INTERMEDIATE CODE: C60 Effective date: 20210427 |

|

| A911 | Transfer to examiner for re-examination before appeal (zenchi) |

Free format text: JAPANESE INTERMEDIATE CODE: A911 Effective date: 20210511 |

|

| C21 | Notice of transfer of a case for reconsideration by examiners before appeal proceedings |

Free format text: JAPANESE INTERMEDIATE CODE: C21 Effective date: 20210518 |

|

| A912 | Re-examination (zenchi) completed and case transferred to appeal board |

Free format text: JAPANESE INTERMEDIATE CODE: A912 Effective date: 20210903 |

|

| C211 | Notice of termination of reconsideration by examiners before appeal proceedings |

Free format text: JAPANESE INTERMEDIATE CODE: C211 Effective date: 20210907 |

|

| C22 | Notice of designation (change) of administrative judge |

Free format text: JAPANESE INTERMEDIATE CODE: C22 Effective date: 20210928 |

|

| C22 | Notice of designation (change) of administrative judge |

Free format text: JAPANESE INTERMEDIATE CODE: C22 Effective date: 20211102 |

|

| C23 | Notice of termination of proceedings |

Free format text: JAPANESE INTERMEDIATE CODE: C23 Effective date: 20211221 |

|

| C03 | Trial/appeal decision taken |

Free format text: JAPANESE INTERMEDIATE CODE: C03 Effective date: 20220125 |

|

| C30A | Notification sent |

Free format text: JAPANESE INTERMEDIATE CODE: C3012 Effective date: 20220125 |