JP2017531242A - 顔画像を編集する方法及びデバイス - Google Patents

顔画像を編集する方法及びデバイス Download PDFInfo

- Publication number

- JP2017531242A JP2017531242A JP2017509711A JP2017509711A JP2017531242A JP 2017531242 A JP2017531242 A JP 2017531242A JP 2017509711 A JP2017509711 A JP 2017509711A JP 2017509711 A JP2017509711 A JP 2017509711A JP 2017531242 A JP2017531242 A JP 2017531242A

- Authority

- JP

- Japan

- Prior art keywords

- image

- face

- model

- facial

- editing

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Withdrawn

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T19/00—Manipulating 3D models or images for computer graphics

- G06T19/20—Editing of 3D images, e.g. changing shapes or colours, aligning objects or positioning parts

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T11/00—2D [Two Dimensional] image generation

- G06T11/60—Editing figures and text; Combining figures or text

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T17/00—Three dimensional [3D] modelling, e.g. data description of 3D objects

- G06T17/20—Finite element generation, e.g. wire-frame surface description, tesselation

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T7/00—Image analysis

- G06T7/30—Determination of transform parameters for the alignment of images, i.e. image registration

- G06T7/33—Determination of transform parameters for the alignment of images, i.e. image registration using feature-based methods

- G06T7/337—Determination of transform parameters for the alignment of images, i.e. image registration using feature-based methods involving reference images or patches

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2207/00—Indexing scheme for image analysis or image enhancement

- G06T2207/30—Subject of image; Context of image processing

- G06T2207/30196—Human being; Person

- G06T2207/30201—Face

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T2219/00—Indexing scheme for manipulating 3D models or images for computer graphics

- G06T2219/20—Indexing scheme for editing of 3D models

- G06T2219/2021—Shape modification

Abstract

本発明は、顔の3Dメッシュモデルを編集して表情を変更することと、変更されたモデルに対応する新しい画像を生成して、変更された表情を有する画像を提供することとを含む、画像内の表情を編集する方法に関する。

Description

本発明は、顔画像を編集する方法及びデバイスに関する。限定するものではないが、特に、本発明は、画像内の表情を編集する方法及びデバイスに関する。

顔は、キャプチャーされた画像及びビデオにおける重要な対象である。人の顔は、屋内パーティの状況又は観光アトラクションの前でポーズを取る等、様々な状況でキャプチャーされ得る。しかし、一般に、人の表情は、多くの場合、状況に合うように適切にキャプチャーされない。そのような場合、表情を変更するために写真編集ソフトウェアが必要とされる。新しい表情を合成するために、例えば人の口を開けるか又は笑顔にするために、追加の画像が必要とされ得る。しかし、これは退屈な作業であり、ユーザの多くの時間とスキルを必要とする。同時に、表情の編集は、最も一般的な写真編集に求められることの1つである。

ビデオについては、時間的アーティファクト及びジッターを生じさせないように表情を編集することは更に困難である。通常、厳密な3Dモデルは、各時間ステップで位置合わせする必要があり、これは、特殊なキャプチャーセットアップ又は相当な計算時間がかかる高度なアルゴリズムを必要とする。

本発明は、上記を踏まえて考え出されたものである。

一般的な形態では、本発明は、顔の3Dメッシュモデルを編集して表情を変更することと、変更されたモデルに対応する新しい画像を生成して、変更された表情を有する画像を生成することとを含む、画像内の表情を編集する方法に関する。

本発明の態様は、共通メッシュテンプレートモデルを、キャプチャーされた顔のビデオに位置合わせすることにより、複数の顔領域のテクスチャデータベースを収集する方法を提供する。

本発明の別の態様は、様々な顔領域で最も適切な表情を選ぶことにより、複合画像を生成する方法を提供する。

本発明の別の態様は、局所化されたワープを適用して、合成複合画像での射影変換を補正する方法を提供する。

本発明の別の態様は、顔テクスチャデータベースを編成及びインデックス付けし、表情に対応する最も近いテクスチャを選ぶ方法を提供する。

本発明の別の態様は、3D顔モデルをプロキシとして操作することにより、RGB顔画像編集を実行する方法を提供する。

本発明の別の態様は、3D顔モデルをプロキシとして編集することにより、複数の顔画像を同時に同じ顔のポーズにする方法を提供する。

本発明の別の態様は、画像内の表情を編集する方法に関し、本方法は、

ブレンドシェイプモデルを使用して、顔の変形空間をパラメータ化することと、

3D表情変化に対応して、様々な顔領域から画像テクスチャのデータベースを構築することと、

データベースから取り出される、様々な顔領域からの適する画像テクスチャの複合により、新しい顔画像を生成することと

を含む。

ブレンドシェイプモデルを使用して、顔の変形空間をパラメータ化することと、

3D表情変化に対応して、様々な顔領域から画像テクスチャのデータベースを構築することと、

データベースから取り出される、様々な顔領域からの適する画像テクスチャの複合により、新しい顔画像を生成することと

を含む。

本発明の別の態様は、表情を示す画像を編集する方法を提供し、本方法は、

様々な顔領域の画像パッチのデータベースを提供することと、

編集すべき画像に位置合わせされた顔モデルを編集し、変更に従ってデータベースからパッチを選択し、パッチから複合画像を生成することと

を含む。

様々な顔領域の画像パッチのデータベースを提供することと、

編集すべき画像に位置合わせされた顔モデルを編集し、変更に従ってデータベースからパッチを選択し、パッチから複合画像を生成することと

を含む。

本発明の別の態様は、画像内の表情を編集するデバイスを提供し、本デバイスは、メモリと、メモリと通信する少なくとも1つのプロセッサとを含み、メモリは命令を含み、命令は、プロセッサにより実行されると、本デバイスに、顔の3Dメッシュモデルを編集して表情を変更することと、変更されたモデルに対応する新しい画像を生成して、変更された表情を有する画像を提供することとを含む動作を実行させる。

本発明の別の態様は、画像内の表情を編集するデバイスを提供し、本デバイスは、メモリと、メモリと通信する少なくとも1つのプロセッサとを含み、メモリは命令を含み、命令は、プロセッサにより実行されると、本デバイスに、

様々な顔領域の画像パッチのデータベースにアクセスすることと、

編集すべき画像と位置合わせされた顔モデルを変更することと、

変更に従ってデータベースからパッチを選択することと、

パッチから複合画像を生成することと

を含む動作を実行させる。

様々な顔領域の画像パッチのデータベースにアクセスすることと、

編集すべき画像と位置合わせされた顔モデルを変更することと、

変更に従ってデータベースからパッチを選択することと、

パッチから複合画像を生成することと

を含む動作を実行させる。

本発明の実施形態は、単純なモノクロカメラを用いてキャプチャーされる顔のビデオを編集する方法を提供する。前処理段階において、顔追跡アルゴリズムがビデオに適用され、3Dメッシュモデルが、時間とともに変化する表情に対して位置合わせされると仮定される。次に、実行時に、ユーザは、顔の3Dメッシュモデルを直接編集し、3D表情に対応する新規の画像を合成する。変形空間は、線形ブレンドシェイプモデルを使用し、3D表現の変化に対応して様々な顔領域から画像テクスチャのデータベースを収集することにより、パラメータ化される。新規の顔画像は、データベースを参照することにより、様々な顔領域から最も適切なテクスチャを複合することで生成される。このようにして、所与の入力顔画像において新規の表情を編集及び合成する高速な方法が提供される。

顔モデルに基づいてビデオを編集する幾つかの用途がある。一般消費者が撮影するホームビデオ及び写真は、新しい表情を示すように、高速で容易な方法で編集することができる。本発明の実施形態による顔合成技術は、フィルム撮影後の編集で俳優の表情を編集するために適用することもできる。心理学的研究及び通信エージェントとしての仮想の人間アバターの生成にも用途がある。

本発明の要素により実施される幾つかのプロセスは、コンピュータにより実施され得る。したがって、そのような要素は、全体的にハードウェアの実施形態、全体的にソフトウェアの実施形態(ファームウェア、常駐ソフトウェア、マイクロコード等を含む)、又はソフトウェア及びハードウェア態様を組み合わせた実施形態の形態を取り得、本明細書では、これらは全て一般に、「回路」、「モジュール」、又は「システム」と呼ばれ得る。更に、そのような要素は、内部に埋め込まれたコンピュータ使用可能プログラムコードを有する任意の有形表現媒体に埋め込まれるコンピュータプログラム製品の形態を取り得る。

本発明の要素は、ソフトウェアで実施することができるため、本発明は、任意の適する搬送媒体でプログラマブル装置に提供されるコンピュータ可読コードとして実施することができる。有形搬送媒体は、フロッピーディスク、CD−ROM、ハードディスクドライブ、磁気テープデバイス、又は固体状態メモリデバイス等の記憶媒体を含み得る。一時的な搬送媒体は、電気信号、電子信号、光信号、音響信号、磁気信号、又は電磁信号、例えば、マイクロ波信号又はRF信号等の信号を含み得る。

本発明の実施形態について、例として以下の図面を参照して説明する。

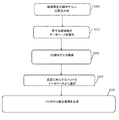

図1は、本発明の実施形態による、表情を示す画像を編集する方法のステップを示すフローチャートである。

ステップS101において、様々な表情にわたる様々な顔領域に対応する顔画像パッチのテクスチャデータベースが、前処理ステップS100において実行される顔−モデル−画像位置合わせ方法を使用することにより構築される。

ステップS100において適用される顔モデル画像位置合わせ方法は、顔のキャプチャー画像のモノクロ顔ビデオシーケンスを入力することと、画像シーケンス中の顔に関する顔のランドマークを追跡することとを含む。キャプチャーされた画像シーケンスは、例えば、怒りの表情、驚きの表情、笑う表情、話す表情、微笑む表情、ウィンクする表情、睫を上げる表情、及び通常の表情を含め、時間の経過に伴う様々な表情を示す。図2の列(A)に画像シーケンスの例を示す。

例えば、疎空間特徴追跡アルゴリズムを適用して、画像シーケンスを通して顔のランドマーク(例えば、鼻の先端部、口角、目等)を追跡し得る。図2の列(B)に顔のランドマークの例を示す。顔のランドマークの追跡は、ビデオシーケンスの各時間ステップ(フレーム)において、及び異なる顔のランドマークを示す3Dポイントの疎な集合において、カメラ射影行列を生成する。

プロセスは、様々な表情をブレンドするようにパラメータ化された人の顔の3Dメッシュブレンドシェイプモデルを適用することを含む。これらの表情は、それぞれブレンドシェイプターゲットと呼ばれる。ブレンドシェイプターゲット間の加重線形ブレンドにより、任意の表情が生成される。

形式上、顔モデルは、幾らか任意であるが、xyzxyz..xyzのように固定順の全ての頂点座標を含む列ベクトルFとして表される。

任意の重みwkは、基本的に、ブレンドシェイプターゲットbkのスパンを定義し、一緒に結合されたとき、モデリングされる顔Fにわたる表情の範囲を定義する。全てのブレンドシェイプターゲットは、行列Bの列及び単一のベクトルwに位置合わせされる重みとして配置することができ、それにより、

F=Bw

として与えられるブレンドシェイプモデルを生成する。

F=Bw

として与えられるブレンドシェイプモデルを生成する。

したがって、3D顔モデルFが得られ、これは、幾らかの剛性変換又は非剛性変換を受けた後、前に得られた3D顔ランドマークの疎な集合の上に位置合わせすることができる。

次に、方法を適用して、この3D顔ブレンドシェイプモデルを、疎な顔のランドマークの前の出力に位置合わせする。ここで、入力ビデオ中の人は、メッシュテンプレートモデルと比較して非常に異なる生理学的特徴を有する。

図2の列(C)に収集されるテクスチャ画像パッチの例を示す。これらの各テクスチャには、その時間ステップ(フレーム)に位置合わせされた顔ブレンドシェイプモデルのブレンド重みwcにより表される正確な表情が注釈付けられる。この目的は、このテクスチャデータベースを検索し、様々なテクスチャ画像パッチから画像を複合することにより、新規の表情に対応する新しい顔画像を合成することである。各顔領域で、顔モデルの変更に従って表情変更に最も適切なテクスチャ画像パッチが、位置合わせされた表情のデータベース内の最も近い近傍を選択することにより選択される。これは、ブレンドシェイプ重み(近傍に影響するブレンドシェイプ重みのサブセットのみに関する)が現在のブレンドシェイプ重みに最も近い特定の変更された近傍のフレームから画像パッチを選択することを含む。テクスチャ/顔画像パッチを選択するのに選ばれた時間ステップが、様々な顔領域にわたり可変であることに留意し得る。

近傍パッチのこのデータベースが、ビデオ中のあらゆるフレームでいかに構築されるかを説明する。ビデオのフレーム毎に、非重複近傍(例えば、合計で4つ)のそれぞれが画像に射影され、次に、矩形パッチとしてクロッピングされる。この矩形パッチの両端部は、射影される近傍の極値を使用することにより計算される。したがって、ビデオのあらゆるフレームに生成されるこれらの近傍パッチを使用して、ビデオ中の全ての可能なフレームのあらゆる非重複領域/近傍(合計で4つ)の全体データベース(図2に示されるような)が構築される。

したがって、i=1,2,3,4であるi番目の近傍、K番目のフレームについて、対応するパッチは、pKiにより与えられる。

次のステップとして、最もよく似た近傍パッチを取り出すために、最小二乗の最小化技法が適用され、この技法は、構成要素(特定の近傍に直接的な影響を有する)の重みが現在の重みに最も近いフレームを提供する。しかし、この前に、2組のリストが作成される。第1のリストは、いずれの構成要素(ブレンドシェイプターゲット)が、対応するいずれの近傍に影響しているかを示す。したがって、j番目のブレンドシェイプターゲットbjがi番目の近傍Uiに影響している場合、マッピングbj→Uiが提供される。特定のi番目の近傍に関連付けられたブレンドシェイプターゲットのセットは、Aiにより与えられる。

第2のリストは、ビデオ中の可能なあらゆるフレームについて、40の全ブレンドシェイプターゲットに関する、対応するブレンドシェイプ重みを提供する。換言すれば、フレーム毎に最も影響される構成要素についての情報が提供される。K番目のフレームのj番目のブレンドシェイプターゲットのブレンドシェイプ重みは、wjkで示すことができる。

このデータベース及びインデックス付け方法を用いて、アーティストにより編集されたジオメトリックモデルの現在のブレンドシェイプ重みを調べることにより、全ての近傍が影響されるのはいずれであるかと、次に、複合画像を構築するために特定の近傍の最も代表的なパッチを得ることができる最も近いフレームがいずれであるかとについて推測することができる。

ステップS102において、編集アーティストは、所望の編集に従ってモデルを変更する。ステップ103において、変更に対応する画像パッチがデータベースから選択される。実際には、アーティストが3Dブレンドシェイプモデルに対して妥当な変更を行うと、任意の変更された近傍領域を最も良く表すデータベース内の異なるフレーム内の複数のパッチから1つのパッチが選択され、修正される。これは、全ての異なる近傍領域に対して行われ、したがって、複合画像と呼ばれるものが得られる。そのような技術は、効率的で計算的に安価な装置モデルを与えるのみならず、単に、実際にこの外観モデルと直接相関する3Dジオメトリックモデルにおいて変更を行うことにより、ビデオの対応するフレームにおいて所望の効果を得るよりよく、より単純な方法であるため、利用される。

まず、アーティストは、ここでも、例えば、(“Direct Manipulation Blendshapes”, J. P. Lewis, K. Anjyo. IEEE Computer Graphics Applications 30 (4) 42-50, July 2010)に記載されるような直接操作の技術を使用して、図3に示される3Dブレンドシェイプモデルにおいて幾つかの所望の変更を行い得る。アーティストは、少数の頂点をドラッグし、顔全体は、それらの頂点を制約として変形される。

本発明の本実施形態によるアルゴリズムは、影響を受ける可能性がある全てのブレンドシェイプターゲットbj及び対応するブレンドシェイプ重みwjを計算する。ここで、j=1,2,・・・40である。データベースを見ることにより、ジオメトリックモデルでの編集によって全ての近傍が影響されたことも分かる。

次のステップにおいて、アルゴリズムは、前のステップから得た各近傍に対応するデータベースからの最も代表的なパッチを提供する最も近いフレームを計算する。したがって、換言すれば、あらゆる近傍で、幾つかの関連付けられたブレンドシェイプターゲットが生成される。これらの関連付けられたブレンドシェイプターゲットについて、アルゴリズムは、データベースからの関連付けられたブレンドシェイプ重みが最も近い(同じブレンドシェイプターゲットの現在のブレンド重みから最小のユークリッド距離にある)、最も近いフレームを特定する。したがって、全ての特定のi番目の近傍について、関連付けられたブレンドシェイプターゲットがwjとして与えられるように加重されると仮定する場合、ここで、jは、i番目の近傍の関連付けられた構成要素Aiのリストに存在するj番目の構成要素を表す。

K番目のフレーム及びj番目のブレンドシェイプターゲットについて、ブレンド重みはwjkとして与えられる。したがって、最も近いフレームは、ビデオ中の可能な全てのフレームにわたり最小二乗を実行することにより計算することができ、

K* i=Mink(Σj(wj−wjk)2)

により与えられ、式中、K* iは、i番目の近傍に最も近いフレームを与える。次に、i番目の各近傍について、pk*iにより与えられる最も近いフレームパッチが求められる。図4に、影響される近傍の結果的なパッチを見て取ることができる。

K* i=Mink(Σj(wj−wjk)2)

により与えられ、式中、K* iは、i番目の近傍に最も近いフレームを与える。次に、i番目の各近傍について、pk*iにより与えられる最も近いフレームパッチが求められる。図4に、影響される近傍の結果的なパッチを見て取ることができる。

ステップS104において、複合画像が生成される。これは、基本的に、パッチを適切な画像領域/近傍に適用することにより行われる。しかし、その前に、スライトワープアルゴリズムが実行されて、現在のフレームとデータベース中の選ばれたフレームとの間の射影変換を補正することにより、パッチを現在の画像に位置合わせする。この補正ワープは、

qk*i=PcPo +pk*i

により与えられ、式中、Pcは、パッチが適用されている現在のフレームの射影行列であり、Po +は、パッチpk*iが選ばれた元フレームの射影行列の疑似逆行列である。

qk*i=PcPo +pk*i

により与えられ、式中、Pcは、パッチが適用されている現在のフレームの射影行列であり、Po +は、パッチpk*iが選ばれた元フレームの射影行列の疑似逆行列である。

最終ワープパッチqk*iは、次に、画像の適切な位置に配置される。これらの最終複合画像は、複数のパッチから合成される。最終複合画像は、キャプチャーされた俳優の顔を完全に異なる合成表情で示す。図5は、新規の表情の合成に関する結果の集合の例を示す。一番上の行は、入力画像を示し、中間行は、3Dメッシュモデルに対するアーティストの編集を示し、一番下の行は、この編集された表情に対応する合成顔複合画像を示す。

本発明の実施形態による顔編集方法は、様々な俳優の複数の画像に対して同時に適用することもでき、同じ表情を示す全ての俳優の合成顔画像を生成する。図6にこれを示し、図6は、同じ表情にされた複数の俳優を示す。一番上の行は入力画像を示す。中間行は、射影変換に関する本発明の実施形態により提案される補正無しの、顔の単純な複合結果を示す。一番下の行は、本発明の実施形態による方法の結果である最終的な複合画像を示す。

本発明の実施形態に準拠する装置は、ハードウェアのみ、ソフトウェアのみ、又はハードウェアとソフトウェアとの組合せのいずれかにより実施され得る。ハードウェアに関しては、例えば、専用ハードウェアを使用し得、そのようなASIC、FPGA、又はVLSIはそれぞれ<<特定用途向け集積回路>>、<<フィールドプログラマブルゲートアレイ>>、<<超大規模集積回路>>であり、又はデバイスに埋め込まれる幾つかの集積電子構成要素を使用することによるか、若しくはハードウェア構成要素とソフトウェア構成要素との組合せからのものであり得る。

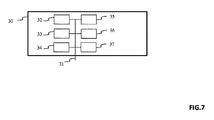

図7は、本発明の1つ又は複数の実施形態を実施し得る画像処理デバイス30の例を表す概略ブロック図である。デバイス30は、データアドレスバス31により一緒にリンクされる以下のモジュールを含む:

− マイクロプロセッサ32(又はCPU)であり、これは、例えば、DSP(又はデジタル信号プロセッサ)である、

− ROM(又は読み取り専用メモリ)33、

− RAM(又はランダムアクセスメモリ)34、

− デバイスのアプリケーションとデータを送受信するI/Oインタフェース35、及び

− 電池36、

− ユーザインタフェース37。

− マイクロプロセッサ32(又はCPU)であり、これは、例えば、DSP(又はデジタル信号プロセッサ)である、

− ROM(又は読み取り専用メモリ)33、

− RAM(又はランダムアクセスメモリ)34、

− デバイスのアプリケーションとデータを送受信するI/Oインタフェース35、及び

− 電池36、

− ユーザインタフェース37。

代替の実施形態によれば、電池36はデバイスの外部にあり得る。図6のこれらの各要素は、当業者により周知であり、したがって、本発明を理解するために、これ以上詳細に説明する必要はない。レジスタは、デバイスの任意のメモリの小容量エリア(幾つかのビット)又は非常に大きいエリア(例えば、プログラム全体若しくは大量の受信データ若しくは復号化データ)に対応し得る。ROM33は、少なくともプログラム及びパラメータを含む。本発明の実施形態による方法のアルゴリズムは、ROM33に記憶される。電源投入されると、CPU32は、プログラムをRAMにアップロードし、対応する命令を実行して、方法を実行する。

RAM34は、レジスタ内に、CPU32により実行され、デバイス30の電源投入後にアップロードされるプログラムを含み、レジスタ内に入力データを含み、レジスタ内に方法の様々な状態での中間データを含み、方法の実行に必要な他の変数をレジスタ内に含む。

ユーザインタフェース37は、本発明の実施形態により、画像処理デバイスを制御し、画像内の表情を編集するユーザ入力を受信するように動作可能である。

密な3Dメッシュ出力を生成するが、計算的に高速であり、オーバーヘッドが僅かである本発明の実施形態が提供される。更に、本発明の実施形態は、3D顔データベースを必要としない。その代わり、本発明の実施形態は、取得がはるかに容易である、参照人として1人の人からの表情変化を示す3D顔モデルを使用し得る。

本発明について、特定の実施形態を参照して上述したが、本発明は、特定の実施形態に限定されず、当業者には変更形態が明らかであり、それらの変更形態は本発明の範囲内にある。

例えば、上記例は表情に関連して説明されたが、本発明が、他の顔態様又は画像内の他のランドマークの変更にも適用可能なことが理解される。

上述した例示的な実施形態を参照したうえで、多くの更なる変更形態及び変形形態が当業者にとって自明であり、実施形態は単なる例示として与えられ、本発明の範囲の限定を意図せず、本発明の範囲は、添付の特許請求の範囲によってのみ決定される。特に、異なる実施形態からの異なる特徴は、適切な場合、相互交換し得る。

Claims (15)

- 表情を有する顔の少なくとも一部を示す顔の画像を編集する方法であって、

前記表情を変更するために、前記顔の画像と位置合わせされた3Dメッシュモデルを編集することと、

前記編集されたモデルに対応する新しい顔の画像を生成して、変更された表情を有する新しい顔の画像を生成することと

を含み、

前記新しい顔の画像は、選択された顔の画像パッチの複合体から生成されるものであり、前記顔の画像パッチは、前記編集された3Dメッシュモデルに従って選択されるものである、方法。 - 前記顔の画像パッチは、前記顔のキャプチャーされた画像のシーケンスから収集される顔の画像パッチのデータベースから選択され、各顔の画像パッチは、前記シーケンス内の所与の時間での前記顔の一部に対応する、請求項1に記載の方法。

- 前記キャプチャーされた画像のシーケンスは、共通するメッシュテンプレートモデルに位置合わせされる、請求項2に記載の方法。

- 局所化されたワープを前記3Dメッシュモデルに適用して、前記新しい顔の画像内の射影変換を補正することを含む、請求項1〜3のいずれか一項に記載の方法。

- 前記3Dメッシュモデルは、異なる表情間でブレンドするようにパラメータ化されたブレンドシェイプモデルである、請求項1〜4のいずれか一項に記載の方法。

- 3D顔モデルをプロキシとして操作することにより、RGB顔画像の編集を実行することを含む、請求項1〜5のいずれか一項に記載の方法。

- 3D顔モデルをプロキシとして編集することにより、複数の顔の画像を、同時に同じ顔のポーズにすることを含む、請求項1〜6のいずれか一項に記載の方法。

- 顔の少なくとも一部を含む顔の画像における表情を編集する画像編集デバイスであって、プロセッサを含み、前記プロセッサは、

前記顔の画像と位置合わせされた3Dメッシュモデルを変更して、前記表情を変化させることと、

前記変更された3Dメッシュモデルに従って複数の顔の画像パッチを選択することと、

前記変更されたモデルに対応する顔の画像を生成して、変更された表情を有する新しい顔の画像を生成することと

を行うように構成され、

前記新しい顔の画像は、前記選択された顔の画像パッチの複合体から生成されるものである、画像編集デバイス。 - 前記顔の画像パッチは、前記顔のキャプチャーされた画像のビデオシーケンスから収集される顔の画像パッチのデータベースから選択され、各顔の画像パッチは、前記顔の一部に対応する、請求項8に記載の画像編集デバイス。

- 前記画像のビデオシーケンスは、共通するメッシュテンプレートモデルに位置合わせされる、請求項9に記載の画像編集デバイス。

- 前記少なくとも1つのプロセッサは、局所化されたワープを適用して、前記新しい顔の画像内の射影変換を補正するように構成された、請求項8〜10のいずれか一項に記載の画像編集デバイス。

- 前記プロセッサは、3D顔モデルをプロキシとして操作することにより、RGB顔画像の編集を実行するように構成された、請求項8〜11のいずれか一項に記載の画像編集デバイス。

- 前記プロセッサは、3D顔モデルをプロキシとして編集することにより、複数の顔の画像を、同時に同じ顔のポーズにするように構成された、請求項8〜12のいずれか一項に記載の画像編集デバイス。

- 前記3Dメッシュモデルはブレンドシェイプモデルである、請求項8〜12のいずれか一項に記載の画像編集デバイス。

- プログラマブル装置のためのコンピュータプログラム製品であって、命令シーケンスを含み、前記命令シーケンスは、前記プログラマブル装置にロードされ、前記プログラマブル装置によって実行されると、請求項1〜7のいずれか一項に記載の方法を実施する、コンピュータプログラム製品。

Applications Claiming Priority (5)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| EP14306336.0 | 2014-08-29 | ||

| EP14306336 | 2014-08-29 | ||

| EP15305883.9 | 2015-06-10 | ||

| EP15305883 | 2015-06-10 | ||

| PCT/EP2015/069306 WO2016030304A1 (en) | 2014-08-29 | 2015-08-24 | Method and device for editing a facial image |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2017531242A true JP2017531242A (ja) | 2017-10-19 |

| JP2017531242A5 JP2017531242A5 (ja) | 2018-09-06 |

Family

ID=53879531

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2017509711A Withdrawn JP2017531242A (ja) | 2014-08-29 | 2015-08-24 | 顔画像を編集する方法及びデバイス |

Country Status (6)

| Country | Link |

|---|---|

| US (1) | US20180225882A1 (ja) |

| EP (1) | EP3186788A1 (ja) |

| JP (1) | JP2017531242A (ja) |

| KR (1) | KR20170046140A (ja) |

| CN (1) | CN106663340A (ja) |

| WO (1) | WO2016030304A1 (ja) |

Cited By (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2021523437A (ja) * | 2018-05-07 | 2021-09-02 | グーグル エルエルシーGoogle LLC | 顔面表情による遠隔アバターの操縦 |

Families Citing this family (7)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN107180446B (zh) * | 2016-03-10 | 2020-06-16 | 腾讯科技(深圳)有限公司 | 人物面部模型的表情动画生成方法及装置 |

| CN107180453B (zh) * | 2016-03-10 | 2019-08-16 | 腾讯科技(深圳)有限公司 | 人物面部模型的编辑方法及装置 |

| US10872451B2 (en) * | 2018-10-31 | 2020-12-22 | Snap Inc. | 3D avatar rendering |

| CN111488778A (zh) * | 2019-05-29 | 2020-08-04 | 北京京东尚科信息技术有限公司 | 图像处理方法及装置、计算机系统和可读存储介质 |

| KR102128399B1 (ko) * | 2019-06-04 | 2020-06-30 | (주)자이언트스텝 | Ai 기반의 얼굴 애니메이션 구현을 위한 학습데이터 생성 방법, ai 기반의 얼굴 애니메이션 구현 방법 및 컴퓨터 판독 가능한 저장매체 |

| KR102111499B1 (ko) * | 2019-09-19 | 2020-05-18 | (주)자이언트스텝 | 얼굴 애니메이션을 위한 얼굴 형태 변화 전사 방법 및 컴퓨터 판독 가능한 저장매체 |

| CN113763517B (zh) * | 2020-06-05 | 2024-04-12 | 华为技术有限公司 | 人脸表情编辑方法及电子设备 |

Family Cites Families (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| US6072496A (en) * | 1998-06-08 | 2000-06-06 | Microsoft Corporation | Method and system for capturing and representing 3D geometry, color and shading of facial expressions and other animated objects |

-

2015

- 2015-08-24 KR KR1020177005596A patent/KR20170046140A/ko unknown

- 2015-08-24 CN CN201580046187.1A patent/CN106663340A/zh not_active Withdrawn

- 2015-08-24 JP JP2017509711A patent/JP2017531242A/ja not_active Withdrawn

- 2015-08-24 US US15/506,754 patent/US20180225882A1/en not_active Abandoned

- 2015-08-24 EP EP15751035.5A patent/EP3186788A1/en not_active Withdrawn

- 2015-08-24 WO PCT/EP2015/069306 patent/WO2016030304A1/en active Application Filing

Cited By (2)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2021523437A (ja) * | 2018-05-07 | 2021-09-02 | グーグル エルエルシーGoogle LLC | 顔面表情による遠隔アバターの操縦 |

| JP7090178B2 (ja) | 2018-05-07 | 2022-06-23 | グーグル エルエルシー | 顔面表情による遠隔アバターの操縦 |

Also Published As

| Publication number | Publication date |

|---|---|

| EP3186788A1 (en) | 2017-07-05 |

| CN106663340A (zh) | 2017-05-10 |

| US20180225882A1 (en) | 2018-08-09 |

| KR20170046140A (ko) | 2017-04-28 |

| WO2016030304A1 (en) | 2016-03-03 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP2017531242A (ja) | 顔画像を編集する方法及びデバイス | |

| Lin et al. | St-gan: Spatial transformer generative adversarial networks for image compositing | |

| US20240078838A1 (en) | Face reenactment | |

| US11393152B2 (en) | Photorealistic real-time portrait animation | |

| JP5319415B2 (ja) | 画像処理装置、画像処理方法 | |

| US20170278302A1 (en) | Method and device for registering an image to a model | |

| CN113313085B (zh) | 一种图像处理方法、装置、电子设备及存储介质 | |

| EP3980974A1 (en) | Single image-based real-time body animation | |

| CN112233212A (zh) | 人像编辑与合成 | |

| JPWO2019230813A1 (ja) | 三次元再構成方法および三次元再構成装置 | |

| EP2615583B1 (en) | Method and arrangement for 3D model morphing | |

| Li et al. | Spa: Sparse photorealistic animation using a single rgb-d camera | |

| CN114387392A (zh) | 一种根据人影重建三维人体姿态的方法 | |

| WO2022107245A1 (ja) | マップ生成装置、マップ生成方法、及びプログラムが格納された非一時的なコンピュータ可読媒体 | |

| CN113034345B (zh) | 一种基于sfm重建的人脸识别方法及系统 | |

| JPWO2019186833A1 (ja) | 画像処理装置、画像処理方法、及びプログラム | |

| KR102463778B1 (ko) | 블러가 존재하는 영상으로부터의 3차원 인체 모델 복원 방법 및 장치 | |

| Bakken | Using synthetic data for planning, development and evaluation of shape-from-silhouette based human motion capture methods | |

| JP2017059233A (ja) | 画像合成方法及び装置 | |

| CA3226474A1 (en) | System and method for simplified facial capture with head-mounted cameras | |

| CN115294298A (zh) | 数据处理方法及其装置 | |

| JP2023009952A (ja) | 分析装置、データ生成方法、及びプログラム | |

| TW201342305A (zh) | 三維模型變形之方法及裝置 | |

| CN112330529A (zh) | 基于Dlid的人脸老化方法、系统以及终端 | |

| Zeng et al. | A video based personalized face model generation approach for network 3D games |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Written amendment |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20180726 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20180726 |

|

| A761 | Written withdrawal of application |

Free format text: JAPANESE INTERMEDIATE CODE: A761 Effective date: 20190122 |