以下本発明の実施の形態について、図面を参照しながら説明する。

(実施の形態1)

[構成]

図1は、本発明の実施の形態における吹奏楽器の練習支援装置の構成の一例を示すブロック図である。図1において、吹奏楽器の練習支援システム1は、練習支援装置10と、筋電センサ101と、カメラ装置103と、表示装置110とを備えている。

練習支援装置10は、筋活動入力部102と、顔画像入力部104と、練習支援データ記憶部105と、条件判定部106と、練習支援画像取得部107と、画像合成部108とを備えている。

筋電センサ101は、吹奏楽器を演奏している演奏者の顔の一つ以上の筋肉の筋電位を計測する筋電計であり、この筋電位の計測データを筋肉の活動を示すデータ(以下、筋活動データという)として出力する。本実施の形態において、筋活動は筋電位の値で表わされる。筋電センサ101は、本実施の形態における筋活動計測器の例である。

筋活動入力部102は、筋電センサ101から出力された筋活動データの入力を受ける。

カメラ装置103はイメージセンサを備え、吹奏楽器演奏時の演奏者の顔画像を撮影し、この顔画像のデータ(以下、顔画像データという)を出力する。

顔画像入力部104は、カメラ装置103から出力された顔画像データの入力を受け、この顔画像データを画像合成部108に出力する。

練習支援データ記憶部105は、筋活動を変数とした条件(以下、筋活動条件ともいう)、と及び練習支援情報とを対応付けて練習支援データとして格納する。筋活動条件及び練習支援情報の詳細については、図を用いて後に説明する。

条件判定部106は、筋活動入力部102から受け取った筋活動データ、及び練習支援データ記憶部105に格納された練習支援データが含む筋活動条件を利用して、条件判定を実施し、判定結果に対応付けられた練習支援情報を出力する。

練習支援画像取得部107は、筋活動入力部102から受け取った筋活動データ、及び条件判定部106から受け取る練習支援情報に基づいて練習支援画像を取得する。

画像合成部108は、練習支援画像取得部107が取得した練習支援画像と、顔画像入力部104から受け取った演奏者の顔画像とを合成し、その結果として得られる合成画像を表示装置110に出力する。表示装置110は、表示部を備え、画像合成部108から受け取った合成画像を表示部に表示する。

なお、図1の構成では、練習支援装置10は、筋活動及び顔画像の入力を、筋電センサ101及びカメラ装置103から直接受けているが、これに限定しない。例えば、演奏中の演奏者の顔画像の録画データが、並行して筋電センサ101によって計測された筋活動の時系列データとあわせて、いったん外部記憶装置405(後述)に格納されてもよい。そして練習支援装置10は、外部記憶装置405に格納された筋活動及び顔画像の各データを、演奏時の時系列に従って読み出して練習支援画像を表示するための処理を実施してもよい。

図2は、本実施の形態における、練習支援データ記憶部105に格納される条件及び練習支援情報の一例を示す図である。

練習支援データ記憶部105は、筋活動条件と練習支援情報とを対応付けて練習支援データ1050として格納する。なお、図2では、テーブルの各データ行にある筋活動条件と練習支援情報とが対応付けられている。

筋活動条件では、筋活動は筋電センサ101からの筋活動データに対応する形式で示され、例えば本実施の形態では筋電位で示される。筋活動条件に対応付けられる練習支援情報は、文字情報及び画像情報を含む。文字情報は、筋活動条件が満たされた場合に演奏者に提示される、この筋活動条件に含まれる筋活動に関する言語による情報の例である。画像情報は、筋活動を視覚化した図形等の画像に関する情報であって、筋活動条件が満たされた場合に、例えば注目箇所を強調するための表示態様を示す情報である。

なお、練習支援情報の内容は前述のものだけに限定されず、例えば、筋活動条件を一意に識別するIDがさらに含まれてよい。この場合、条件判定部106は、入力を受けた筋活動が満たす筋活動条件に対応するIDを練習支援画像取得部107に通知する。練習支援画像取得部107は、通知されたIDを利用し、練習支援データ記憶部105にアクセスして練習支援データ1050を参照することで、練習支援情報を読み出してもよい。または、練習支援情報は、文字情報のみ又は画像情報のみであってもよい。

また、練習支援データ1050の構成は、図2に示されるようなデータベースとして利用されるテーブルに限定されない。例えば練習支援装置10を実現するための後述のプログラムの一部であって、このテーブルに含まれる各条件に相当する条件式と、その条件に対応付けられている練習支援情報の内容に相当する制御命令として構成されてもよい。

図3は、本実施の形態における画像合成部108が表示装置110に出力して表示させる合成画像の例である。

図3において、画像301は、画像合成部108が顔画像入力部104から受け取った、演奏中の演奏者の顔画像である。なお、本図では、顔画像は模式的に示されている。

また、画像302は、画像合成部108が練習支援画像取得部107から受け取った、演奏中の顔の筋活動を視覚化した図形である。画像302の表示形態(色や形状など)は、練習支援情報の画像情報に従って決まる。例えば、画像302の色は筋活動のレベルに応じて変更されてもよい。練習支援データ1050に入力された筋活動が満たす条件が存在する場合に、練習支援画像取得部107は、その満たされた筋活動条件に対応付けられている練習支援情報の画像情報に従って、該当の画像302を表示形態の異なる画像302に変えて、画像合成部108に出力する。

また、画像303は、練習支援データ1050において、満たされた筋活動条件に対応付けられている練習支援情報の文字情報を練習支援画像取得部107が視覚化して取得し、画像合成部108に出力した画像である。画像合成部108は、画像302を配置するべき顔画像上での位置(座標)を計算して、その位置に画像302を配置し、さらに画像303を所定の位置に配置することで図3に示されるような合成画像を得る。

なお、練習支援情報は、文字情報のみ、または、画像制御情報のみであってもよい。また、文字情報に代えて、又は加えて音声情報が練習支援情報に含まれてもよい。音声情報も、演奏者に提示される言語による情報の例のひとつである。また、文字情報の読み上げ部(図示なし)による読み上げ、または音声情報の再生による音声が音声出力装置(図示なし)から出力されることで演奏者等のユーザに提示されてもよい。また、練習支援情報の内容は、練習支援装置10を実現するための後述のプログラムが実行されることで実現される練習支援画像取得部107及び画像合成部108が上記のような画像又は音声を出力するために利用な情報であればよく、図3に示される例に限定されない。例えば対応付けされている筋活動条件が満たされている場合に出力される画像、文字、又は音声のデータの保存場所を示す情報であってもよい。

また、筋活動を視覚化する画像302を含む合成画像は、練習支援データの筋活動条件が満たされた場合のみならず、筋電センサ101からの筋活動データの入力がある間、常に表示されていてもよい。そして練習支援データの筋活動条件が満たされたときに、筋活動条件に含まれる筋肉に対応する位置の画像302は特定の色又は形状に変更され、さらに文字情報含む合成画像が表示されてもよい。

また、筋活動を視覚化する方法は、前述の図形の色の変化を利用した方法に限られるものではない。例えば、筋活動を図形の面積で表現してもよい。この場合においても、練習支援画像取得部107に、画像情報を用いて、図形を拡大または縮小させることが可能である。また、複数の図形の組み合わせにより筋活動を視覚化してもよい。例えば、図形を複数組み合わせることでグラフを構成し、筋活動の時系列変化又は筋肉間での差異を表現してもよい。この場合においても、画像情報を用いて、グラフを構成する図形の色、形状、又は大きさを変化させてもよい。さらに、画像情報によって、筋活動を視覚化する方法を変化させてもよい。例えば、特定の条件が満足された場合は、グラフで表わすということも可能である。このようなグラフは表示範囲が大きい場合もあるため、演奏者の顔画像と重畳せずに表示されてもよい。

図4は、本実施の形態における練習支援装置10を実現する情報処理装置のハードウェア構成の一例を示す図である。

練習支援装置10は、例えばディスプレイ、カメラ、筋電計などの入出力装置を搭載した、又はそれらが接続された情報処理装置が吹奏楽器の演奏の練習支援のためのプログラム(以下、練習支援プログラムという)を実行することにより実現される。

図4において、情報処理装置は、CPU(Central Processing Unit:中央演算処理部)403、RAM(Random Access Memory)402、タイマ404、外部記憶装置405、センサ406、入力インタフェース407、ディスプレイ408を備えている。これらの装置は、バスライン401を通じて互いに接続されている。

タイマ404は、プログラムの割込みタイミング等を制御するタイマである。

外部記憶装置405は、HDD(Hard Disk Drive)等の光学ディスクドライブ、若しくは半導体記憶装置等、又はこれらの組み合わせである。外部記憶装置405には、練習支援プログラム及び練習支援情報が格納されている。外部記憶装置405は、本実施の形態におけるメモリの例である。

CPU403は、外部記憶装置405に格納される練習支援プログラム及び練習支援情報を読み出し、読み出したプログラム又は情報を必要に応じてRAM402に書き込みつつ、練習支援プログラムが規定する処理を実行する。

センサ406は、入力装置である図1の筋電センサ101及びカメラ装置103である。

入力インタフェース407は、ユーザが練習支援装置10の操作を行うためのマウス、キーボード、タッチパネルなどである。

ディスプレイ408は、図1の表示装置110であり、図3に例示される、支援画像を含む合成画像を表示する。また、ディスプレイ408は、練習支援装置10の操作画面等を表示する。

CPU403は、RAM402を作業領域として練習支援プログラムが規定する処理を実行することで、本実施の形態における筋活動入力部102、顔画像入力部104、条件判定部106、練習支援画像取得部107、及び画像合成部108を実現する。より具体的には、練習支援プログラムを実行するCPU403は、入力インタフェース407からの操作の入力に応じて、センサ406から入力されたデータの処理、練習支援データを参照しての条件判定及び支援画像の取得、合成画像の合成、並びに各種の操作画面及び合成画像のディスプレイ408への表示のための画像表示制御を行う。CPU403は、本実施の形態におけるプロセッサの例である。また、CPU403の入力ポートは、本実施の形態における第1入力回路の例である。

[動作]

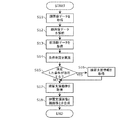

図5は、本実施の形態における練習支援装置10の動作の一例を示すフローチャートである。タイマ404からの制御信号をトリガとして、練習支援のための一連の処理が、CPU403によって割込み実行される。

まず、ステップS01において、顔画像入力部104は、カメラ装置103が撮影した顔画像を示す顔画像データを取得し、この顔画像データを画像合成部108に出力する。また、ステップS02において、筋活動入力部102は、筋電センサ101が計測した筋活動を示す筋活動データを取得し、この筋活動データを条件判定部106及び練習支援画像取得部107に出力する。

次に、ステップS03において、条件判定部106は、練習支援データ記憶部105に格納された練習支援データ1050を参照し、ステップS02で入力を受けた筋活動データが示す筋活動が、練習支援データ1050に含まれる筋活動条件を満たすか否かについての条件判定を実施する。この条件判定は、筋電位の変化の有無又は筋電位の変化の大きさに基づいて実施される。

次に、ステップS04において、練習支援画像取得部107は、ステップS03での条件判定の結果、満たされたと判定された筋活動条件が存在するか否かを判断する。存在する場合(ステップS04でYES)、練習支援画像取得部107は、練習支援データ1050において満たされた筋活動条件に対応付けられている練習支援情報を取得する(ステップS05)。

次に、ステップS06において、練習支援画像取得部107は、ステップS02で取得された筋活動データとステップS05で取得された練習支援情報とを視覚化、つまり練習支援画像を取得し、この練習支援画像を画像合成部108に出力する。

最後に、ステップS07において、画像合成部108は、練習支援画像取得部107から入力を受けた練習支援画像と、顔画像入力部104から入力を受けた顔画像とを合成し、これによって得られた合成画像を表示装置110で表示させるために出力する。

なお、顔画像301は、正像と鏡像とのいずれが出力されてもよい。例えば指導者が合成画像を見る場合は正像が表示され、演奏者が合成画像を見る場合は鏡像が表示されるように切換が可能であってもよい。また、練習支援装置10に接続される表示装置110は、文字又は図形等による情報を、周囲を映した鏡像とあわせて鏡面に提示可能な鏡であってもよく、この鏡面に映る演奏者の鏡像とあわせて練習支援画像が表示されてもよい。

[効果]

かかる構成によれば、本実施の形態における練習支援装置10は、筋電計から取得された吹奏楽器演奏時の演奏者の顔の筋活動を、直観的にわかりやすい形態で視覚化し、さらに、カメラ装置103から取得した演奏時の演奏者の顔画像の適切な位置に重畳して表示することができる。これにより、練習支援装置10のユーザである演奏者または指導者は、演奏者の吹奏楽器演奏時の筋活動を容易かつ正確に把握することができる。

さらに、練習支援装置10は、現在の筋活動が特定の状態のとき、例えば、演奏時の状態としては好ましくない状態のとき、その状態を是正するためのアドバイスを内容とする文字情報を表示させることができる。さらに、現在の筋活動が特定の状態のとき、例えば、演奏時の状態としては好ましくない状態のとき、画像制御情報を用いて、ユーザが注目すべき箇所を強調して表示することができる。結果、演奏時の顔の筋活動、及び手本となる状態との差異又は理想的な状態をユーザにわかりやすく提示することができる。

また、演奏中の筋活動及び顔画像それぞれの時系列データが、いったん外部記憶装置405に格納されてから利用されてもよい。この場合、練習支援装置10では、外部記憶装置405に格納された演奏中の筋活動データと顔画像データとが、演奏時の時系列に従って読み出されて上述の一連の処理が実施されることで、練習支援画像を含む合成画像が出力される。つまり、外部記憶装置405に記録された演奏時の筋活動データと顔画像データとを事後的に利用して取得される練習支援画像を用いて合成画像が生成されることで、練習支援画像を含む合成画像の振り返り再生機能を実現することができる。さらに、合成画像のデータを外部記憶装置405に保存し、再生ボタン、停止ボタンやシークバーなどを含む操作画面で合成画像を表示させ、それらを入力インタフェースで操作することで、任意の再生位置での停止、任意の再生位置からの再生といった機能を提供することもできる。

なお、合成画像に含まれる顔画像301は、演奏時の演奏者の顔画像の時系列データから抽出される画像に限定されるわけではない。例えば、演奏者の顔の静止画像や、顔を模したイラスト画像などが利用されてもよい。このような画像は、例えば練習支援装置10がカメラ装置103を搭載しておらず、接続もできない場合、演奏場所の環境が撮影に不向きな場合、演奏者の顔の位置が遠いか又は動きがちな場合、外部記憶装置405の記憶容量に制限がある場合など、顔画像の時系列データの取得・記録が困難な場合に有用である。

(実施の形態2)

[構成]

実施の形態1では、筋活動データの取得及び入力の手段として筋電計が用いられている。本実施の形態では、筋活動データの取得及び入力の手段として、カメラ装置と顔画像解析とが用いられる構成について説明する。

図6は、本実施の形態における吹奏楽器の練習支援装置20の構成の一例を示すブロック図である。図6において、吹奏楽器の練習支援システム2は、練習支援装置20と、カメラ装置103と、表示装置110とを備えている。

練習支援装置20は、筋活動入力部102と、顔画像入力部204と、練習支援データ記憶部105と、条件判定部106と、練習支援画像取得部107と、画像合成部108と、顔画像解析部109とを備えている。実施の形態1と共通の構成要素については、共通の符号を用いて示し説明を省略する。

図6において、顔画像入力部204は、カメラ装置103で撮影して取得された顔画像データの入力を受ける。

顔画像入力部204は、入力された顔画像データを、顔画像解析部109及び画像合成部108に出力する。

顔画像解析部109は、顔画像入力部204から、演奏時の演奏者の顔画像データの入力を受ける。顔画像解析部109は、入力された顔画像データに対して解析処理を行うことで演奏者の顔の筋活動を示す筋活動データを取得し、この筋活動データを筋活動入力部102に出力する。より具体的には、顔画像解析部109は、入力された顔画像データに対して顔認識処理を行い、認識した顔の表面にある、注目の対象となる各筋肉に対し2つの特徴点を抽出し、その位置を取得するする。さらに、顔画像解析部109は、1組以上の特徴点の組に対し、その位置に基づいて点間距離を計算することで、注目する筋肉の筋長を算出し、算出した筋長のデータを、筋活動データとして筋活動入力部102に出力する。本実施の形態において、筋活動は、顔画像解析によって得られた筋長の値で表わされる。そして、このように演奏者の筋活動データの取得に供するカメラ装置103、顔画像入力部104、及び顔画像解析部109は、本実施の形態における筋長計測器の構成要素であり、この筋長計測器は、筋活動計測器の例である。

本実施の形態における、練習支援データ記憶部105に格納される練習支援データの構成は、図2で示される実施の形態1の練習支援データの構成と基本的に共通であるため説明を省略する。ただし、本実施の形態における筋活動を変数とした条件に含まれる筋活動は、筋長の値で表される。

なお、本実施の形態における練習支援装置20を実現する情報処理装置のハードウェア構成は、図4で示される実施の形態1の練習支援装置10の構成と基本的に共通であるため説明を省略する。ただし、練習支援装置20においては、顔画像解析部109も、CPU403がRAM402を作業領域として練習支援プログラムが規定する処理を実行することで実現される。また、本実施の形態においては、センサ406に相当するのは、図6のカメラ装置103である。

[動作]

図7は、本実施の形態における練習支援装置20の動作の一例を説明するフローチャートである。練習支援装置20の動作では、実施の形態1における練習支援装置10の動作に比べて、顔画像データの取得のステップに続いて顔画像の解析のステップが追加されている。

まず、ステップS11において、顔画像入力部104は、カメラ装置103が撮影した顔画像を示す顔画像データを取得し、この顔画像データを顔画像解析部109及び画像合成部108に出力する。

次に、ステップS12において、顔画像解析部109は、ステップS11で入力を受けた顔画像データを解析することで筋長の値を取得し、取得した筋長の値を、筋活動を示す筋活動データとして筋活動入力部102に出力する。

また、ステップS13において、筋活動入力部102は、顔画像解析部109が解析して取得した筋活動データを、条件判定部106及び練習支援画像取得部107に出力する。

次に、ステップS14において、条件判定部106は、練習支援データ記憶部105に格納された練習支援データ1050を参照し、ステップS13で入力を受けた筋活動データが示す筋活動が、練習支援データ1050に含まれる筋活動条件を満たすか否かについての条件判定を実施する。この条件判定は、筋長の変化の有無又は当該筋長の変化の大きさに基づいて実施される。

次に、ステップS15において、練習支援画像取得部107は、ステップS14での条件判定の結果、満たされたと判定された筋活動条件が存在するか否かを判断する。存在する場合(ステップS15でYES)、練習支援画像取得部107は、練習支援データ1050において満たされた条件に対応付けられている練習支援情報を取得する(ステップS16)。

次に、ステップS17において、練習支援画像取得部107は、ステップS13で取得された筋活動データとステップS16で取得された練習支援情報とを視覚化、つまり練習支援画像を取得し、この練習支援画像を画像合成部108に出力する。

最後に、ステップS18において、画像合成部108は、練習支援画像取得部107から入力を受けた練習支援画像と、顔画像入力部104から入力を受けた顔画像とを合成し、これによって得られた合成画像を表示装置110で表示させるために出力する。

[効果]

かかる構成によれば、本実施の形態における練習支援装置20は、顔画像データを解析することで取得された吹奏楽器演奏時の演奏者の顔の筋活動を、直観的にわかりやすい形態で視覚化し、さらに、カメラ装置103から取得した演奏時の演奏者の顔画像の適切な位置に重畳して表示することができる。これにより、練習支援装置20のユーザである演奏者または指導者は、演奏者の吹奏楽器演奏時の筋活動を容易かつ正確に把握することができる。

さらに、練習支援装置20では、筋活動データの取得及び入力の手段として、カメラ装置103と顔画像解析とが用いられる。つまり、筋電計は不要であり、本発明の実施に要するコストを削減できる効果がある。また、接触式のセンサが不要なため、練習支援装置20は利用の準備にかかる時間が接触式のセンサを含む装置に比べて短縮される。また、演奏者は筋電計を装着しなくてよいため、通常の演奏時に近い状態で練習を行うことができる。

なお、顔画像データから筋活動データ状態を得る手段として、顔認識によって抽出される顔画像の特徴点を用いることを上記では説明したが、これに限定されない。例えば、演奏者の顔の特定の位置に複数のマーカーを貼り付け、画像解析によりマーカーの画像を顔画像内の特徴点として検出し、各マーカーの位置に基づいて、特定のマーカーの対の距離を求めることで筋長が算出されてもよい。これらのマーカーは、演奏者の顔の特定の筋肉の筋長が算出できるよう配置される。

(実施の形態3)

[構成]

本実施の形態では、条件判定に用いられる条件の変数として、筋活動に加えて、演奏音の情報を利用する。

図8は、本実施の形態における吹奏楽器の練習支援装置30の構成の一例を示すブロック図である。図8において、吹奏楽器の練習支援システム3は、練習支援装置30と、筋電センサ101と、カメラ装置103と、表示装置110と、マイク111とを備えている。

練習支援装置30は、筋活動入力部102と、顔画像入力部104と、練習支援データ記憶部205と、条件判定部206と、練習支援画像取得部107と、画像合成部108と、演奏音入力部112とを備えている。実施の形態1と共通の構成要素については、共通の符号を用いて示し説明を省略する。

図8において、マイク111は演奏音を収音し、収音した演奏音を示すデータ(以下、演奏音データという)を出力する。

演奏音入力部112は、マイク111から出力された演奏音データの入力を受け、この演奏音データを条件判定部206に出力する。

練習支援データ記憶部205は、筋活動を変数とした条件(以下、筋活動条件ともいう)と、演奏音を変数とした条件(以下、演奏音条件ともいう)と、練習支援情報とを対応付けて練習支援データ2050として格納する。

条件判定部206は、筋活動入力部102から受け取った筋活動データ、演奏音入力部112から受け取った演奏音データ、及び練習支援データ記憶部205に格納された条件を利用して、条件判定を実施する。この条件判定の結果に応じて、条件判定部206は、受け取った筋活動データ及び演奏音データに対応する練習支援情報を出力する。

図9は、本実施の形態における、練習支援データ記憶部205に格納される条件及び練習支援情報の一例を示す図である。

練習支援データ記憶部205は、筋活動条件と、演奏音条件と、練習支援情報とを対応付けて練習支援データ2050として格納する。図9では、テーブルの各データ行にある条件と練習支援情報とが対応付けられている。なお、この例では筋活動条件と演奏音条件とは、1つの複合条件とすることで対応付けられ、その上で練習支援情報と対応付けられているが、個別の条件として相互に、及び練習支援情報と対応付けられてもよい。

筋活動条件では、筋活動は筋電センサ101からの筋活動データに対応する形式で示され、例えば本実施の形態では筋電位で示される。演奏音条件では、演奏音はマイク111からの演奏音データに基づく情報に対応する形式で示され、例えば本実施の形態では音高又は音圧で示される。筋活動条件及び演奏音条件に対応付けられる練習支援情報は、文字情報及び画像情報を含む。文字情報は、筋活動条件及び演奏音条件が満たされた場合に演奏者に提示される、この筋活動条件に含まれる筋活動に関する言語による情報の例である。画像情報は、筋活動を視覚化した図形等の画像に関する情報であって、筋活動条件及び演奏音条件が満たされた場合に、例えば注目箇所を強調するための表示態様を示す情報である。

なお、本実施の形態における練習支援装置30を実現する情報処理装置のハードウェア構成は、図4で示される実施の形態1の練習支援装置10の構成と基本的に共通であるため説明を省略する。ただし、練習支援装置30においては、演奏音入力部112も、CPU403がRAM402を作業領域として練習支援プログラムが規定する処理を実行することで実現される。また、本実施の形態においては、センサ406に相当するのは、図8の筋電センサ101、カメラ装置103、及びマイク111である。また、CPU403の入力ポートは、本実施の形態における第1入力回路及び第2入力回路の例である。

[動作]

図10は、本実施の形態における練習支援装置30の動作の一例を示すフローチャートである。練習支援装置30の動作では、実施の形態1における練習支援装置10の動作に比べて、演奏音データの取得のステップであるステップが追加されている。

まず、ステップS21において、顔画像入力部104は、カメラ装置103が撮影した顔画像を示す顔画像データを取得し、この顔画像データを画像合成部108に出力する。また、ステップS22において、筋活動入力部102は、筋電センサ101が計測した筋活動を示す筋活動データを取得し、この筋活動データを条件判定部206及び練習支援画像取得部107に出力する。また、ステップS23において、演奏音入力部112は、マイク111が収音した演奏音を示す演奏音データを取得し、この演奏音データを条件判定部206に出力する。

次に、ステップS24において、条件判定部206は、練習支援データ記憶部205に格納された練習支援データ2050を参照し、筋活動条件及び演奏音条件に基づく条件判定を実施する。条件判定部206は、ステップS22で入力を受けた筋活動データが示す筋活動、及びステップ23で入力を受けた演奏音データが示す演奏音が、練習支援データ2050に含まれる各筋活動条件及び演奏音条件を満たすか否かの判定をする。

次に、ステップS25において、練習支援画像取得部107は、ステップS24での条件判定の結果、対応付けられている筋活動条件及び演奏音条件が満たされたか否かを判断する。図9の練習支援データ2050が用いられている場合、筋活動条件と演奏音条件との複合条件のうちで、満たされたものが存在するか否か判断される。対応付けられている筋活動条件及び演奏音条件が満たされた場合(ステップS25でYES)、練習支援画像取得部107は、練習支援データ2050において、満たされたこれらの条件に対応付けられている練習支援情報を取得する(ステップS26)。

次に、ステップS27において、練習支援画像取得部107は、ステップS22で取得された筋活動データ状態とステップS26で取得された練習支援情報とを視覚化、つまり練習支援画像を取得し、この練習支援画像を画像合成部108に出力する。

最後に、ステップS28において、画像合成部108は、練習支援画像取得部107から入力を受けた練習支援画像と、顔画像入力部104から入力を受けた顔画像とを合成し、これによって得られた合成画像を表示装置110で表示させるために出力する。

[効果]

かかる構成によれば、本実施の形態における練習支援装置30は、筋電計から取得された吹奏楽器演奏時の演奏者の顔の筋活動を、直観的にわかりやすい形態で視覚化し、さらに、カメラから取得した演奏時の演奏者の顔画像の適切な位置に重畳して表示することができる。これにより、練習支援装置30のユーザである演奏者または指導者は、演奏者の吹奏楽器演奏時の筋活動を容易かつ正確に把握することができる。

また、練習支援装置30は、演奏音も変数として利用することで、筋活動のみでは扱えない条件、例えば演奏の技術に関する条件にも対応でき、より多様な練習支援情報の提供が可能となる。

また、演奏中の筋活動と、顔画像と、演奏音とのそれぞれの時系列データが、いったん外部記憶装置405に格納されてから利用されてもよい。この場合、練習支援装置30では、外部記憶装置405に格納された演奏中の筋活動データと、顔画像データと、演奏音データとが、演奏時の時系列に従って読み出されて上述の一連の処理が実施されることで、練習支援画像を含む合成画像が出力される。また、本実施の形態では、練習支援装置30にスピーカ(図示なし)を搭載又は接続して、練習支援画像の振り返り再生時に演奏音も合わせて再生してもよい。

(実施の形態4)

[構成]

実施の形態4では、練習支援対象に基づいて、条件及びこれに対応付けられている練習支援情報を選択して指定する構成について説明する。

図11は、本実施の形態における吹奏楽器の練習支援装置40の構成の一例を示すブロック図である。図11において、吹奏楽器の練習支援システム4は、練習支援装置40と、筋電センサ101と、カメラ装置103と、表示装置110とを備えている。

練習支援装置40は、筋活動入力部102と、顔画像入力部104と、練習支援データ記憶部305と、条件判定部306と、練習支援画像取得部107と、画像合成部108と、練習支援対象指定部113とを備えている。実施の形態1と共通の構成要素については、共通の符号を用いて示し説明を省略する。

図11において、練習支援対象指定部113は、練習支援対象である楽器や演奏者に応じて、練習支援データ記憶部305に格納された複数の条件及び各条件に対応付けられた練習支援情報の中から適切なものを選択し、練習支援での使用対象として指定する。

本実施の形態において、練習支援データ記憶部305では、練習支援データに含まれる、筋活動を変数とした条件及びこれに対応付けられている練習支援情報の各セット(以下、条件‐支援情報セットという)が分類して管理される。例えば、練習支援データ記憶部305では、練習支援データに含まれる複数の条件‐支援情報セットは、各条件‐支援情報セットが属する分類を示す分類情報を用いて管理される。

分類情報には、例えば吹奏楽器の種類を示す識別子が用いられる。吹奏楽器の種類とは、例えば金管楽器、木管楽器といった中分類でもよいし、トランペット、ホルン、トロンボーン、クラリネット、サックス等のより具体的な種類でもよい。これにより、練習支援の実施において、練習支援装置40は、演奏者が演奏する楽器に応じた条件‐支援情報セットのみを用いることができる。したがって、演奏者は、自分が練習している楽器に関連する練習支援情報、つまりアドバイスを受けることができる。

なお、分類情報は、楽器の種類に関するものに限定されない。

例えば練習支援装置40では、実施の形態2に示した筋長が示す筋活動を変数とする条件を含む練習支援データを用いることができる。例えば練習支援装置40では、入力される筋活動データが筋電位のデータと筋長のデータとで切換え可能であれば、各条件‐支援情報セットが含む条件が筋電位及び筋長のいずれが示す筋活動を変数とするかに応じた分類情報が用いられてもよい。

また、演奏者の属性に関する情報が分類情報として用いられてもよい。演奏者の属性の例としては、熟達度及び身体的特徴が挙げられる。例えば、熟達度、唇の厚さ、歯並びに応じて、異なる閾値を条件に含む条件‐支援情報セットが選択される。

条件判定部306は、筋活動入力部102から受け取った筋活動データ、及び練習支援データ記憶部305に格納された練習支援データが含む条件を利用して、条件判定を実施する。そして、この条件判定において、練習支援対象指定部113が指定した条件を判定に用いる。

なお、本実施の形態における練習支援装置40を実現する情報処理装置のハードウェア構成は、図4で示される実施の形態1の練習支援装置10の構成と基本的に共通であるため説明を省略する。ただし、練習支援装置40では、練習支援対象指定部113も、CPU403がRAM402を作業領域として練習支援プログラムが規定する処理を実行することで実現される。

また、練習支援対象指定部113は、練習支援対象である楽器や演奏者に関する情報の入力を、入力インタフェースを介して外部から受けてもよい。また、練習支援対象指定部113は、カメラ装置103が撮影した画像から、練習支援対象である楽器や演奏者に関する情報を取得してもよい。また、練習支援装置40では、実施の形態3に示されるようなマイクから入力される演奏音を変数とする条件を含む練習支援データを用いることもできる。この場合、練習支援対象指定部113は、演奏音から、練習支援対象である楽器や演奏者に関する情報を取得してもよい。

また、練習支援対象指定部113は、練習支援データ記憶部305に記憶される複数の条件‐支援情報セットから適切なものを指定するとしたが、これに限定されない。例えば、練習支援装置40が、練習支援対象指定部113が保持している分類に属する条件‐支援情報セットを外部から取得して、練習支援データ記憶部305に練習支援データとして格納してもよい。この場合、例えば、練習支援装置40は、大きな練習支援データを保持するサーバとネットワークを介して接続し、適切な条件‐支援情報セットを取得する。

[効果]

かかる構成によれば、本実施の形態における練習支援装置40は、筋電計等の筋活動計測器から取得された吹奏楽器演奏時の演奏者の顔の筋活動を、直観的にわかりやすい形態で視覚化し、さらに、カメラから取得した演奏時の顔画像の適切な位置に重畳して表示することができる。これにより、練習支援装置40のユーザである演奏者または指導者は、演奏者の吹奏楽器演奏時の筋活動を容易かつ正確に把握することができる。

また、練習支援対象(演奏者の属性、楽器の種類など)に応じて、関連する条件‐支援情報セットを柔軟に指定することが可能となり、練習支援情報をより適切に提示することができる。

(使用の態様の具体例)

ここで、上記の各実施の形態で説明される本発明に係る練習支援装置のさらなる理解のために、この練習支援装置の使用の態様の具体例を用いて、この練習支援装置によって実現され得る吹奏楽器の練習の支援について説明する。

その理解の前提として、吹奏楽器の演奏と顔の筋肉との関係について説明を加えておく。吹奏楽器の演奏においては、顔の筋肉の適切な活動が重要な要素であることは上述のとおりであり、未熟達者と熟達者とでは顔の筋肉の使い方に違いがあるという知見がある。しかしながら、吹奏楽器の演奏では、楽譜、運指、呼吸、実際に出ている音等注意を払うべき点が多い。また、吹奏楽器の演奏に関与する顔の筋肉は複数あり、しかも各筋肉の活動を個別に意識するのは簡単ではない。また、仮に指導者によって、あるいは録画を観ることで演奏中の演奏者が客観的に観察されたとしても、皮膚の上に現れない筋肉の活動(等尺性収縮)もあり、筋肉の活動が適切であるかの把握は難しい。したがって、上記のような知見を理解している人であっても、発された音の良し悪しから筋肉の活動の適否を判定又は推測するというアプローチを取らざるを得ない場合がある。また、例えば音の安定に複数の筋肉を適切に活動させる必要がある場合、音が不安定であっても活動に問題がある筋肉の特定は難しい。

本発明に係る練習支援装置を使用する演奏者や指導者は、このアプローチと比べて演奏に用いられる個別の筋肉の活動を容易かつより詳細に把握できる。そして、演奏者の演奏の結果として発生する音ではなく、演奏のために行われた筋活動と適切な音を発生させるための手本的な筋活動との比較に基づくアドバイスの情報を得ることができる。以下は、その使用の態様の具体例である。

[例1]

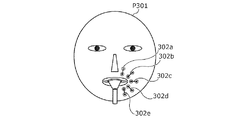

図12は、練習支援装置の使用態様の具体例における筋電センサ101の取付例を示す図である。図中の黒い点は筋電センサ101の電極を示す。

この例では、筋電センサ101A〜101Eの5個の筋電センサ101が使用されている。筋電センサ101Aは、演奏者P1の上唇挙筋の筋電位を計測するための位置に取り付けられている。筋電センサ101Bは、演奏者P1の大頬骨筋の筋電位を計測するための位置に取り付けられている。筋電センサ101Cは、演奏者P1の笑筋の筋電位を計測するための位置に取り付けられている。筋電センサ101Dは、演奏者P1の口角下制筋の筋電位を計測するための位置に取り付けられている。筋電センサ101Eは、演奏者P1の下唇下制筋の筋電位を計測するための位置に取り付けられている。この例で筋電位が計測されるこれらの筋肉は、吹奏楽器の演奏で用いられる口周りの筋肉の例である。

このように取り付けられた筋電センサ101で計測された筋電位に基づく筋活動の視覚化の例を示すのが図13である。この例では、演奏者P1の顔画像P301に重畳して表示される5個の円の画像302(302A〜302E)を用いて筋活動が視覚化されている。5個の円の画像302は、上記の5つの筋肉を示すよう、顔画像P301上で各筋肉の位置に対応する位置に表示される。また、画像302の中の色の違い、例えば濃淡の違いで、各位置にある筋肉の筋電位を示す。ただし、図13では、この色の違いはドットの密度で表わされている。なお、このような入力される筋電位の値に基づく色の画像302が重畳された顔画像P301は、演奏者P1が演奏し、カメラ装置103が撮影している間中表示されてもよい。また、図3では顔の左右両側に図形302が表れていたが、演奏中の顔の筋肉の活動は基本的に左右対称であるため、この使用態様の具体例のように顔の左右いずれかでのみで筋電位の計測及び表示がなされてもよい。

なお、この使用態様の具体例では、練習支援装置の入力装置として、筋電センサ101に加えてマイクがある。したがって、本例の練習支援装置は、演奏者P1に発生している筋活動が演奏音に対して適切か否かについて判定することができる。このような判定には、図14に示されるような練習支援データが用いられる。図14は、練習支援装置の練習支援データ記憶部が格納する練習支援データの一例を示す図である。

この練習支援データには、各行に条件と、その条件に対応付けられている練習支援情報とが格納される。各行の条件には、演奏音を変数とする条件と、筋活動を変数とする条件とが含まれる。図14の1行目では、演奏音を変数とする条件は「楽器音が無音から有音に変化すること」であり、筋活動を変数とする条件は「いずれかの部位の筋電位が変化」である。このような条件‐情報セットは、未熟達者は発音前でアンブシュア(表情筋の状態)の準備ができておらず、発音前後で表情筋の筋活動に(筋電位)が変化し、一方で熟達者はそのような変化が見られないという知見に基づいて用意されている。図15を参照して、練習支援装置の条件判定部が実施するこの条件判定の具体例を説明する。

図15は、この使用態様の具体例において、マイクによって取得される演奏音データ及び筋電センサによって取得される筋活動データの例を示す図である。練習支援装置において、条件判定部は、一定時間蓄積したこれらのデータに基づいて条件判定を実施する。データが蓄積される時間の単位区間をフレームと呼称し、この例では1フレームは100ミリ秒である。

楽器音の無音から有音への変化の判定は、例えば着目しているフレームの音圧の平均値が閾値を超える場合であって、且つ、その直前のフレームが閾値以下の場合に当該変化が起こったと判定される。図15の例では、閾値として50dBが用いられており、本図中の左から2フレーム目から3フレーム目にかけて無音から有音へ変化したと判定される。

また、筋電位の変化は、例えば統計処理によって検出される。具体的には、連続するフレームに対応する2つのデータ群に対してマン・ホイットニーのU検定が実施され、有意差が確認された場合、フレーム間で筋電位が変化したと判定する。有意水準は0.01である。図15の例では、本図中の左から2フレーム目から3フレーム目にかけて筋電位が変化したと判定される可能性が高い。

なお、条件判定に用いられた上記の各方法、及びこの条件判定に用いられたフレーム長、閾値、有意水準等の数値はあくまでも一例であり、本発明はこれらに限定されるものではない。

図15に示されるデータで図中の左から2フレーム目から3フレーム目にかけて無音から有音へ変化し、いずれかの筋電センサで計測された筋電位も変化したと判定された場合を想定する。この場合、1行目の条件が満たされるため、練習支援装置の練習支援画像取得部は、この条件と同じ行にある練習支援情報に基づいて練習支援画像を取得する。そして画像合成部は、その練習支援画像と、この時の演奏者P1の顔画像P301とを合成して、図16に示されるような合成画像を取得する。図16は、1行目の条件が満たされた場合に表示装置に表示される、練習支援情報を含む合成画像の一例を示す。

図16においては、演奏者P1の顔画像P301に、筋電位に基づく筋活動を示す5個の画像302が図13と同じ場所に重畳されている。5個の画像302のうち、口角下制筋を示す画像302が、強調のために他の画像302とは異なる表示態様の画像302DDを用いて表示されている。異なる表示態様とは、例えば他の画像302とは色系統(暖色系と寒色系)を変えたり、強調する画像302を明滅又は点滅させたりして表示することである。この例では、色系統を変えた画像302を用いることで、口角下制筋の筋電位で変化が検出されたことが示されている。このような表示態様の変化は、図14のテーブルの1行目の条件が満たされたときに、練習支援画像取得部が、この条件に対応付けられている練習支援情報の画像情報に基づいて練習支援画像302を生成などすることで取得し、画像合成部が適切な位置に各画像302を配置することで実現される。なお、画像302DDも、口角下制筋の筋電位に応じて同系統の範囲で色が変更されたり、明滅又は点滅の速度が変更されたりしてもよい。また、合成画像では、強調される画像302のみが表示されてもよい。画像302DDは、本例における第1練習支援画像である。

また、図16の合成画像には、練習支援情報の文字情報を含む画像303が含まれている。このような表示は、図14のテーブルの1行目の条件が満たされた場合に、練習支援画像取得部が、この条件に対応付けられている練習支援情報の文字情報に基づいて練習支援画像303を生成する等して取得し、画像合成部が、画像303が所定の位置に来るよう画像を合成することで実現される。これにより演奏者P1は、画像302DDで示される筋肉の活動の改善に関するより詳細な情報を得ることができる。

練習支援装置を使用しない指導者や演奏者P1は、演奏者P1が発音時に音を外しやすい、又はその原因がアンブシュアの不十分な準備だとまではわかっていても、例えば顔のどの部位に注意を払えばよいか等の詳細を把握するのは難しい。しかし、練習支援装置を使用して、図16に示されるような合成画像を表示装置で見た演奏者P1は、自分の筋活動の癖を的確に知ることができ、詳細な改善点、例えば特に強く意識するべき部位を把握することができる。

図17は、図14のテーブルの2行目の条件に対する条件判定で、条件が満たされた場合に表示される合成画像の例である。この例では、演奏音を変数とする条件は、演奏音の音程が上昇することである。また、筋活動を変数とする条件は、上唇挙筋の筋電位が上昇することである。この例の条件判定も、1行目の条件の条件判定と同様に、それぞれ演奏音データ、筋活動データに基づいて、例えば閾値との比較又は統計処理によって実施され得る。図17では、上唇挙筋を示す画像302AAを用いて上唇挙筋に演奏者P1の注意を向けるための強調表示がされている。画像302AAは、本例における第2練習支援画像である。

なお、練習支援装置の使用において取り付けられる筋電センサ101の個数及び取付位置は、上記の例に限定されない。例えば図14のテーブルの1行目の条件に基づく条件判定をするためには、典型的には上記の例のように口周りの複数の筋肉の筋電位が計測される。しかしながら、上記の例のすべての筋肉の筋電位が常に計測される必要はない。例えば、発音時に無用な力が入る筋肉を既に知る演奏者P1は、その筋肉の筋電位を測定するための筋電センサ101のみを取り付けて練習支援装置を使用してもよい。また、図14のテーブルの2行目の条件に基づく条件判定は、上唇挙筋の筋電位のみを計測して実施することができる。したがって、例えば演奏者P1が、練習支援装置を使ってこの2行目の条件に示される癖を克服する練習をする場合は、上唇挙筋の筋電位を計測する筋電センサ101Aのみが取り付けられてもよい。

[例2]

次に、筋電位ではなく筋長の値を筋活動データとして用いる具体例を説明する。上述のとおり、筋活動には皮膚の上から視覚的に感知可能なものとそうでないものがある。筋長の計測値で感知できる筋活動は、これらのうち、皮膚の上からも感知可能なものに該当する。以下では、筋長の計測のために演奏者の顔表面に貼り付けるマーカーを用いる、練習支援装置の使用の態様の具体例を説明する。

図18は、練習支援装置の使用態様の具体例におけるマーカーの取付例を示す図である。図中の黒い点を含む白丸がマーカーであり、破線の矩形で囲まれる2個1対(以下、マーカー対という)を特徴点として用いる画像解析によって1つの筋肉の筋長が計測される。

この例では、マーカー対201a〜201eの5対のマーカー対201が使用されている。マーカー対201aは、演奏者P1の上唇挙筋の筋長を計測するための位置に取り付けられている。マーカー対201bは、演奏者P1の大頬骨筋の筋長を計測するための位置に取り付けられている。マーカー対201cは、演奏者P1の笑筋の筋長を計測するための位置に取り付けられている。マーカー対201dは、演奏者P1の口角下制筋の筋長を計測するための位置に取り付けられている。マーカー対201eは、演奏者P1の下唇下制筋の筋長を計測するための位置に取り付けられている。この例で筋長が計測されるこれらの筋肉は、吹奏楽器の演奏で用いられる口周りの筋肉の例である。

このように取り付けられたマーカー対201を用いて計測された筋長に基づく筋活動の視覚化の例を示すのが図19である。この例では、演奏者P1の顔画像P301に重畳して表示される5本の線分の画像302(302a〜302e)を用いて筋活動が視覚化されている。5本の線分の画像302は、上記の5つの筋肉を示すよう、顔画像P301上の各筋肉の位置に対応する位置に、各筋肉の伸びる方向で配置される。また、各画像302の長さは、上記の各マーカー対201のマーカーどうしの距離に応じたものであり、筋長を示す。なお、このような入力される筋長の値に基づく長さの画像302が重畳された顔画像P301は、演奏者P1が演奏し、カメラ装置103が撮影している間中表示されてもよい。また、例1の場合と同じく、顔の左右いずれかのみで筋長の計測及び表示がなされてもよい。

なお、本例でも、練習支援装置の入力装置として、マーカー対201の画像を含む顔画像を撮影するカメラ装置に加えてマイクがある。実施の形態2又は3では説明していないが、筋長に基づく筋活動データも、演奏音データとともに条件として用いることができる。したがって、本例の練習支援装置は、演奏者P1に発生している筋活動が演奏音に対して適切か否かについて判定することができる。このような判定には、図20に示されるような練習支援データが用いられる。図20は、練習支援装置の練習支援データ記憶部が格納する練習支援データの一例を示す図である。実施の形態4で説明したように、図14の練習支援データと図20の練習支援データとは、例えば同一のテーブルに含まれ、分類情報に従って選択されてもよい。

この練習支援データには、各行に条件と、その条件に対応付けられている練習支援情報とが格納される。各行の条件には、演奏音を変数とする条件と、筋活動を変数とする条件とが含まれる。図20のテーブルの1行目では、演奏音を変数とする条件は「楽器音の音程が変化すること」であり、筋活動を変数とする条件は「笑筋の皮膚表面の動きに変化なし」である。このような条件−情報セットは、高音の発音は口角を左右に引いて行うと容易であるという知見に基づいて用意されている。

条件判定部がする条件判定は、例1の場合と同様に、一定時間蓄積された筋活動データ及び演奏音データに基づいて、例えば閾値との比較、又は統計処理によって実施され得る。

図21は、図20のテーブルの1行目の条件が満たされた場合に表示装置に表示される、練習支援情報を含む合成画像の一例である。この例における練習支援画像は、笑筋の筋長を計測するためのマーカー対201cに重畳されている矢印の画像302ccである。この矢印は、図20のテーブルの1行目の条件が満たされたときに、この条件に対応付けられている「笑筋の活動に対応する図形を矢印に変更」という画像情報に基づいて練習支援画像取得部によって取得され、画像合成部によってこの位置に配置されている。これにより演奏者P1は、口周りのどの部位をどの方向へ動かせばよいか知ることができる。この例では、画像302ccによって、口を左右に広げるような方向への口角の位置変化が示されている。画像302ccは、本例における第3練習支援画像である。

また、図21の合成画像には、練習支援情報の文字情報を含む画像303が含まれている。このような表示は、図20のテーブルの1行目の条件が満たされた場合に、練習支援画像取得部が、この条件に対応付けられている練習支援情報の文字情報に基づいて画像303を取得し、画像合成部が、画像303が所定の位置に来るよう画像を合成することで実現される。これにより演奏者P1は、画像302ccで示される筋肉の活動の改善に関するより詳細な情報を得ることができる。例えば個人練習において練習支援装置を使用する演奏者P1は、図16に示されるような合成画像を見て、音程の上昇時に意識するべき顔の部位、改善の内容を容易かつ的確に知ることができる。

図22は、図20のテーブルの2行目の条件に対する条件判定で、条件が満たされた場合に表示装置に表示される合成画像の例である。この合成画像では、図21で示した例と異なり、特定の部位の筋肉に動きがないことが良い状態であることが示される。この例の条件判定も、上記の条件判定と同様に、演奏音データ及び筋活動データに基づいて、例えば閾値との比較又は統計処理によって実施され得る。図22では、上唇挙筋を示す画像302aaを他の画像302よりも太い線分の画像としてこの部位が強調されている。画像302aaは、本例における第4練習支援画像である。

また、図22の合成画像には、練習支援情報の文字情報を含む画像303が含まれている。このような表示は、図20のテーブルの2行目の条件が満たされたときに、練習支援画像取得部が、この条件に対応付けられている練習支援情報の文字情報に従って練習支援画像303を取得し、画像合成部が、画像303が所定の位置に来るよう画像を合成することですることで実現される。これにより演奏者P1は、太い線分で示される部位の活動を抑えるように注意しながら音程を変える練習をすることができる。

なお、練習支援装置の使用において取り付けられるマーカー対201の個数及び取付位置は、上記の例に限定されない。例えば図20のテーブルの1行目の条件に基づく条件判定では、笑筋の筋長のみを計測して実施することができる。したがって、例えば演奏者P1が、練習支援装置を使って音程の変化時の口角の動きを訓練したい場合は、笑筋の筋電位を計測するマーカー対201cのみが取り付けられてもよい。また、図20のテーブルの2行目の条件に基づく条件判定をするためには、典型的には上記の例のように口周りの複数の筋肉の筋長が計測される。しかしながら、上記の例のすべての筋肉の筋長が常に計測される必要はない。例えば、音程の上昇時に動きがちな部位を既に知る演奏者P1は、その部位で筋長を測定するためのマーカー対201のみを取り付けて練習支援装置を使用してもよい。

(他の実施の形態)

上記の練習支援装置に、演奏者の演奏音を収音するためのマイクが接続(搭載を含む)されている場合、プロセッサは、演奏者による演奏を検知している時、例えばマイクから所定の大きさ以上の音の入力がある場合に、自動的に練習支援データに含まれる条件を用いて条件判定を実施してもよい。これにより、個人練習で本発明の練習支援装置を使用する演奏者は、入力インタフェースを介して判定の開始させる操作をする必要がない。演奏のために楽器を構えてから、楽器から手を離すことなく練習の支援を受けることができる。また、練習支援装置と演奏者との位置関係の高い自由度が得られる。

なお、演奏音の大きさが所定以上である場合に条件判定が実施されてもよいのは、マイクが接続されているときに限定されない。例えば、練習支援装置が録画データ又は録音データを時系列に従って読み出して上記の各実施形態の処理を実施する場合も、データ上で、演奏音の大きさが所定の大きさ以上である区間に対しこの処理が実施されてもよい。これにより、例えば演奏の前又は後の記録を含む録画データ又は録音データであっても自動的に処理対象の区間が特定され、高い利便性が実現される。

また、演奏者の顔画像を撮影するためのカメラ装置が練習支援装置にさらに接続(搭載を含む)されている場合、プロセッサは、カメラが取得する画像に演奏者の顔の画像が含まれ、且つマイクから所定の大きさ以上の音の入力がある場合に、自動的に練習支援データに含まれる条件を用いて条件判定を実施してもよい。これにより、顔画像を用いた判定、又は判定結果の表示が適切に実施可能である場合にのみ判定がされるため、例えば判定がされていると思い込んでの無駄な演奏を避け、支援を受けながらの練習を効率よくすることができる。また、一時的に判定を止めるために、演奏者は少し身体の位置又は向きを変えたりすればよく、練習支援装置を手に届く範囲に置く必要がない。つまり、練習支援装置と演奏者との位置関係の高い自由度が得られる。

なお、演奏者の顔の画像が含まれる場合に条件判定が実施されてもよいのは、カメラが接続されているときに限定されない。例えば、練習支援装置が録画データを時系列に従って読み出して上記の各実施形態の処理を実施する場合も、録画データ上で、演奏者の顔の画像が含まれ、且つ演奏音の大きさが所定の大きさ以上である区間に対しこの処理が実施されてもよい。これにより、例えば演奏の前又は後の記録を含む録画データであっても自動的に処理対象の区間が特定され、高い利便性が実現される。

また、本発明は、各実施の形態における練習支援装置が実行する処理の各手順をステップとする、吹奏楽器の練習支援方法としても実現可能である。また、この練習支援方法を、パーソナルコンピュータ、タブレットコンピュータ、スマートフォン等の各種の汎用性の高い情報処理装置、又はプロセッサ及びメモリを少なくとも備える、吹奏楽器の練習支援用の装置に実行させるプログラムとしても実現可能である。また、練習支援装置と、カメラ装置等の入力装置若しくは表示装置又はその両方とを含む吹奏楽器の練習支援システムとして実現されてもよい。

その他、本発明の趣旨を逸脱しない限り、当業者が思いつく各種変形を本実施の形態に施したものや、異なる実施の形態における構成要素を組み合わせて構築される形態も、本発明の実施の態様に含まれてもよい。例えば、練習支援装置は、演奏者の顔面の筋肉の筋電位と筋長との両方の筋活動データの入力を筋活動計測器から受けてもよい。また、プログラムを実行するプロセッサによって実現される各構成要素の機能の上記の分担は一例であり、変更してもよく、これらの構成要素及び機能を任意に組み合わせることで実現される形態も本発明の範囲に含まれる。

また、上記の各練習支援装置のハードウェア構成は上記の説明に限定されない。例えば、練習支援装置は補助演算処理部等の他のプロセッサを備えてもよく、CPUがする上記の処理の一部を他のプロセッサが実行してもよい。また、練習支援装置と各入出力装置及び外部記憶装置とはインターネットなどの通信ネットワークを介して接続されてもよい。例えば、練習支援装置から遠隔にいる演奏者のもとにあるセンサから顔画像データ及び筋活動データが、通信ネットワーク上のサーバにある記憶装置に保存され、練習支援装置はこの記憶装置にアクセスしてこれらのデータを取得してもよい。そして合成画像は、練習支援装置から通信ネットワークを介して演奏者のもとにあるディスプレイに送信されてもよい。なお、この場合は、入力インタフェース407も演奏者が使用している情報処理装置の一部であり、練習支援装置の他の構成要素から遠隔にある。