JP2016158780A - Riding attitude evaluation device, riding attitude evaluation method, and program - Google Patents

Riding attitude evaluation device, riding attitude evaluation method, and program Download PDFInfo

- Publication number

- JP2016158780A JP2016158780A JP2015038859A JP2015038859A JP2016158780A JP 2016158780 A JP2016158780 A JP 2016158780A JP 2015038859 A JP2015038859 A JP 2015038859A JP 2015038859 A JP2015038859 A JP 2015038859A JP 2016158780 A JP2016158780 A JP 2016158780A

- Authority

- JP

- Japan

- Prior art keywords

- riding

- user

- posture

- evaluation

- bicycle

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Abstract

Description

本発明は、自転車の乗車姿勢評価装置、乗車姿勢評価方法及びプログラムに関する。 The present invention relates to a bicycle riding posture evaluation apparatus, a riding posture evaluation method, and a program.

従来、自転車の走行に関する情報として、走行速度や平均速度、ケイデンス(回転数)、心拍、パワー等が取得され、乗車技術の評価に用いられている。

特許文献1には、自転車の走行に関する情報を、走行中に計測、記録、表示するサイクルコンピュータに関する技術が開示されている。

Conventionally, traveling speed, average speed, cadence (number of rotations), heart rate, power, and the like are acquired as information related to traveling of a bicycle and used for evaluation of riding technology.

しかしながら、従来のサイクルコンピュータ等、自転車の走行に関する情報を取得する技術においては、自転車自体の動きを捉えることはできるものの、実際にライダーの動きそのものを捉えるものではない。

一方、より速く、あるいは、より遠くへ移動することを目的としたライダーにとって、自らの走行姿勢等の運転技術は重要な要素である。そのため、走行中もしくは走行後に自身の運転技術を客観的かつ正確に評価できれば、ライダーにとって有用であるが、このような技術は実現されていないのが現状である。

即ち、従来の技術においては、自転車の運転技術を適切に評価することが困難であった。

However, a technique for acquiring information related to bicycle travel, such as a conventional cycle computer, can capture the motion of the bicycle itself, but does not actually capture the motion of the rider itself.

On the other hand, for riders aiming to move faster or farther, driving skills such as their own running posture are important factors. Therefore, it is useful for the rider if his / her driving technique can be objectively and accurately evaluated during or after traveling, but such a technique has not yet been realized.

That is, in the conventional technology, it has been difficult to appropriately evaluate the bicycle driving technology.

本発明は、このような状況に鑑みてなされたものであり、自転車の運転技術をより適切に評価することを目的とする。 The present invention has been made in view of such a situation, and an object thereof is to more appropriately evaluate the driving skill of a bicycle.

上記目的を達成するため、本発明の一態様の乗車姿勢評価装置は、

自転車に乗車している際のユーザの物理量を取得する取得手段と、

前記取得手段により取得された前記物理量に基づいて、前記ユーザが自転車に乗車している際のユーザの乗車姿勢の評価を行う評価処理手段と、

を備えることを特徴とする。

In order to achieve the above object, a riding posture evaluation apparatus according to an aspect of the present invention includes:

Acquisition means for acquiring a physical quantity of the user when riding a bicycle;

Evaluation processing means for evaluating the user's riding posture when the user is riding a bicycle based on the physical quantity acquired by the acquiring means;

It is characterized by providing.

本発明によれば、自転車の運転技術をより適切に評価することができる。 According to the present invention, it is possible to more appropriately evaluate a bicycle driving technique.

以下、本発明の実施形態について、図面を用いて説明する。 Hereinafter, embodiments of the present invention will be described with reference to the drawings.

[第1実施形態]

図1は、本発明の一実施形態に係る運転評価システム1のシステム構成を示す模式図である。

運転評価システム1は、計測装置100と、情報表示装置200と、撮像装置300とを含んで構成され、これらの装置は、ブルートゥース(登録商標)等の無線通信によって互いに通信可能に構成されている。

計測装置100は、自転車のライダー(ユーザである運転者)の身体(例えば腰部)に装着され、ライダーの身体における物理量を計測する。

情報表示装置200は、スマートフォン等の携帯端末によって構成され、計測装置100の計測結果を表示する。

撮像装置300は、ライダーの身体(例えば頭部)に装着され、ライダーが視認する風景を撮影する。

[ハードウェア構成]

図2は、計測装置100のハードウェアの構成を示すブロック図である。

計測装置100は、CPU(Central Processing Unit)111と、ROM(Read Only Memory)112と、RAM(Random Access Memory)113と、バス114と、入出力インターフェース115と、センサ部116と、入力部117と、出力部118と、記憶部119と、通信部120と、を備えている。

[First Embodiment]

FIG. 1 is a schematic diagram showing a system configuration of a

The

The

The

The

[Hardware configuration]

FIG. 2 is a block diagram illustrating a hardware configuration of the

The

CPU111は、ROM112に記録されているプログラム、または、記憶部119からRAM113にロードされたプログラムに従って各種の処理を実行する。

The

RAM113には、CPU111が各種の処理を実行する上において必要なデータ等も適宜記憶される。

The

CPU111、ROM112及びRAM113は、バス114を介して相互に接続されている。このバス114にはまた、入出力インターフェース115も接続されている。入出力インターフェース115には、センサ部116、入力部117、出力部118、記憶部119及び通信部120が接続されている。

The

センサ部116は、物理量を計測するセンサと、位置を測定する位置センサとを備えている。本実施形態において、センサ部116は、3軸加速度センサを備え、ライダーの装着部位における鉛直方向及び水平方向の加速度を計測する。また、センサ部116は、GPS(Global Positioning System)信号を受信し、GPSに基づく位置信号を取得する。

入力部117は、各種ボタン等で構成され、ユーザの指示操作に応じて各種情報を入力する。

出力部118は、ランプやスピーカあるいは振動用モータ等で構成され、光や音声あるいはバイブレーション信号を出力する。

記憶部119は、DRAM(Dynamic Random Access Memory)等の半導体メモリで構成され、各種データを記憶する。

通信部120は、端末間の直接的な無線通信によって他の装置との間で行う通信を制御する。

The

The

The

The

The

図3は、情報表示装置200のハードウェア構成を示すブロック図である。

情報表示装置200は、CPU211と、ROM212と、RAM213と、バス214と、入出力インターフェース215と、撮像部216と、入力部217と、出力部218と、記憶部219と、通信部220と、ドライブ221と、を備えている。

FIG. 3 is a block diagram illustrating a hardware configuration of the

The

これらのうち、CPU211、ROM212、RAM213、バス214及び入出力インターフェース215の構成は、図2における計測装置100の対応する構成と同様である。

Among these, the configurations of the

撮像部216は、図示はしないが、光学レンズ部と、イメージセンサと、を備えている。

Although not shown, the

光学レンズ部は、被写体を撮影するために、光を集光するレンズ、例えばフォーカスレンズやズームレンズ等で構成される。

フォーカスレンズは、イメージセンサの受光面に被写体像を結像させるレンズである。ズームレンズは、焦点距離を一定の範囲で自在に変化させるレンズである。

光学レンズ部にはまた、必要に応じて、焦点、露出、ホワイトバランス等の設定パラメータを調整する周辺回路が設けられる。

The optical lens unit is configured by a lens that collects light, for example, a focus lens or a zoom lens, in order to photograph a subject.

The focus lens is a lens that forms a subject image on the light receiving surface of the image sensor. The zoom lens is a lens that freely changes the focal length within a certain range.

The optical lens unit is also provided with a peripheral circuit for adjusting setting parameters such as focus, exposure, and white balance as necessary.

イメージセンサは、光電変換素子や、AFE(Analog Front End)等から構成される。

光電変換素子は、例えばCMOS(Complementary Metal Oxide Semiconductor)型の光電変換素子等から構成される。光電変換素子には、光学レンズ部から被写体像が入射される。そこで、光電変換素子は、被写体像を光電変換(撮像)して画像信号を一定時間蓄積し、蓄積した画像信号をアナログ信号としてAFEに順次供給する。

AFEは、このアナログの画像信号に対して、A/D(Analog/Digital)変換処理等の各種信号処理を実行する。各種信号処理によって、ディジタル信号が生成され、撮像部216の出力信号として出力される。

このような撮像部216の出力信号を、以下、「撮像画像のデータ」と呼ぶ。撮像画像のデータは、CPU211等に適宜供給される。

The image sensor includes a photoelectric conversion element, AFE (Analog Front End), and the like.

The photoelectric conversion element is composed of, for example, a CMOS (Complementary Metal Oxide Semiconductor) type photoelectric conversion element or the like. A subject image is incident on the photoelectric conversion element from the optical lens unit. Therefore, the photoelectric conversion element photoelectrically converts (captures) the subject image, accumulates the image signal for a predetermined time, and sequentially supplies the accumulated image signal as an analog signal to the AFE.

The AFE performs various signal processing such as A / D (Analog / Digital) conversion processing on the analog image signal. Through various signal processing, a digital signal is generated and output as an output signal of the

Such an output signal of the

入力部217は、各種ボタンやタッチパネル等で構成され、ユーザの指示操作に応じて各種情報を入力する。

出力部218は、ディスプレイやスピーカ等で構成され、画像や音声を出力する。

記憶部219は、ハードディスクあるいはDRAM等で構成され、各種画像のデータを記憶する。

通信部220は、端末間の直接的な無線通信あるいはインターネットを含むネットワークを介して他の装置との間で行う通信を制御する。

The

The

The

The

ドライブ221には、磁気ディスク、光ディスク、光磁気ディスク、あるいは半導体メモリ等よりなる、リムーバブルメディア231が適宜装着される。ドライブ221によってリムーバブルメディア231から読み出されたプログラムは、必要に応じて記憶部219にインストールされる。また、リムーバブルメディア231は、記憶部219に記憶されている画像のデータ等の各種データも、記憶部219と同様に記憶することができる。

A

図4は、撮像装置300のハードウェア構成を示すブロック図である。

撮像装置300は、例えばウェアラブルなデジタルカメラ等によって構成され、CPU311と、ROM312と、RAM313と、バス314と、入出力インターフェース315と、撮像部316と、記憶部317と、通信部318と、を備えている。

FIG. 4 is a block diagram illustrating a hardware configuration of the

The

これらのうち、CPU311、ROM312、RAM313、バス314、入出力インターフェース315及び通信部318の構成は、図1における計測装置100の対応する構成と同様である。また、撮像部316及び記憶部317の構成は、情報表示装置200の対応する構成と同様である。

Among these, the configurations of the

図5は、このような運転評価システム1の機能的構成のうち、運転状態判定処理及び撮影処理を実行するための機能的構成を示す機能ブロック図である。

運転状態判定処理とは、計測装置100において、センサ部116によって取得した物理量からライダーの乗車姿勢及び運転状態を判定し、判定結果に応じて画像の撮影を行う一連の処理をいう。

また、撮影処理とは、撮像装置300において、運転状態判定処理を実行する計測装置100からの撮影トリガ信号を受けて、撮影を実行する一連の処理をいう。

FIG. 5 is a functional block diagram illustrating a functional configuration for executing the driving state determination process and the imaging process among the functional configurations of the driving

The driving state determination process refers to a series of processes in which the rider's riding posture and driving state are determined from the physical quantity acquired by the

The imaging process refers to a series of processes in the

運転状態判定処理が実行される場合には、図5に示すように、計測装置100のCPU111において、センサ情報取得部151と、運転評価処理部152と、撮影制御部153と、乗車判定部154と、出力制御部155とが機能する。同様に、情報表示装置200のCPU211において、表示情報受信部251と、表示制御部252とが機能する。

また、計測装置100における記憶部119の一領域には、評価情報記憶部171が設定される。

評価情報記憶部171には、センサ部116によって計測された物理量のデータと、ライダーの乗車姿勢と、ライダーの運転状態の評価結果とが対応付けて記憶される。

When the driving state determination process is executed, as shown in FIG. 5, in the

In addition, an evaluation information storage unit 171 is set in one area of the

The evaluation information storage unit 171 stores the physical quantity data measured by the

計測装置100において、センサ情報取得部151は、センサ部116によって計測された物理量のデータ(センサ情報)を予め設定された時間(例えば、0.1秒)毎に取得する。

運転評価処理部152は、センサ情報取得部151によって取得された物理量を基に、後述する運転評価処理を実行し、ライダーの乗車姿勢及び運転状態の評価結果を取得する。なお、以下、これらを総称して、適宜「運転評価処理結果」と呼ぶ。運転評価処理結果は、ライダーの乗車姿勢がどのような状態であるか、及び、運転内容がどのような状態であるかを含む、ライダーの状態に関する評価を総合的に表している。ライダーの乗車姿勢としては、主として、サドルに座ってペダルを踏むシッティングの状態と、サドルから腰を浮かせて立ち上がった状態でペダルを踏むダンシングとが知られている。ライダーがいずれの乗車姿勢の種類であるかは、鉛直方向、進行方向の前後方向及び左右方向の加速度の波形パターンから判定することができる。また、運転状態の評価としては、例えば、ライダーの運転状態として望ましい状態、通常の状態あるいは望ましくない状態といった評価を行うことができる。運転状態の評価は、センサ部116によって計測された物理量の安定性、乗車姿勢の継続時間、基準とするデータとの相違の大きさ、あるいは、ケイデンスや走行速度の維持状態等から判定することができる。

In the measuring

The driving

図6は、乗車姿勢がシッティングからダンシングに変化した場合の加速度の波形パターンの一例を示す図である。

図6に示すように、シッティングの状態とダンシングの状態とでは、鉛直方向、前後方向及び左右方向の加速度の比及び振幅の絶対値が明確に異なるという実験結果が得られている。そのため、乗車姿勢を判別する条件として、鉛直方向、前後方向及び左右方向の加速度の比及び振幅の絶対値における判定閾値を実験値に基づいて設定することができる。例えば、一例として、シッティングの場合とダンシングの場合とでは、鉛直方向、前後方向及び左右方向の加速度の振幅(絶対値)の比が、シッティングではおおよそ1:1:2、ダンシングではおおよそ4:1:1となるため、これらの比を基準として、判定閾値を設定することができる。ただし、これらの比は、ライダーが乗車する自転車の仕様等によって幅があることから、乗車する自転車においてキャリブレーションを行う等して、調整することが望ましい。

FIG. 6 is a diagram illustrating an example of an acceleration waveform pattern when the riding posture changes from sitting to dancing.

As shown in FIG. 6, an experimental result has been obtained that the ratio of the acceleration in the vertical direction, the front-rear direction, and the left-right direction and the absolute value of the amplitude are clearly different between the sitting state and the dancing state. Therefore, as a condition for discriminating the riding posture, it is possible to set a determination threshold in the absolute value of the amplitude and the ratio of the acceleration in the vertical direction, the front-rear direction, and the left-right direction based on the experimental value. For example, in the case of sitting and in the case of dancing, the ratio of the amplitudes (absolute values) of acceleration in the vertical direction, the front-rear direction, and the left-right direction is approximately 1: 1: 2 for sitting and approximately 4: 1 for dancing. Therefore, the determination threshold can be set on the basis of these ratios. However, since these ratios vary depending on the specifications of the bicycle on which the rider rides, it is desirable to adjust the ratio by performing calibration on the bicycle on which the rider rides.

なお、その他の自転車の乗車姿勢として、上体を起こしたシッティングであるアップライト、上体を前傾したシッティングであるノーマル、サドルの前部に座るノーマルである前乗り、サドルの後部に座るノーマルである後乗り、スピードを求めて勢い良くペダルを踏むダンシングである攻めのダンシング、体力の消耗を抑えてゆっくりとペダルを踏むダンシングである休みのダンシング等が知られている。これらについても、センサ部116によって計測された物理量の波形パターン(例えば、比あるいは絶対値)によって、いずれの状態であるかを判別することができる。

As for other bicycle riding postures, uprights that are sitting with the upper body raised, normal that is sitting with the upper body tilted forward, normal riding that sits on the front of the saddle, and normal that sits on the rear of the saddle There are known rear riding, aggressive dancing, which is a stepping pedal for speed, and resting dancing, which is a stepping pedal that slowly suppresses the exhaustion of physical strength. Also in these cases, it is possible to determine which state is in accordance with the waveform pattern (for example, ratio or absolute value) of the physical quantity measured by the

図5に戻り、撮影制御部153は、運転評価処理部152によって取得された乗車姿勢及び運転状態の評価結果(運転評価処理結果)が、予め設定された特定の状態(例えば、「乗車姿勢が変化した」、「特定の乗車姿勢となった」、「計測された物理量の安定性が低下した」等)となっているか否かを判定し、予め設定された特定の状態となっている場合、撮像装置300に対して、撮影トリガ信号を出力する。撮影トリガ信号においては、乗車姿勢及び運転状態の評価結果(運転評価処理結果)に対応する撮影パラメータ(即ち、特定の状態に対応する撮影パラメータ)が含まれている。

乗車判定部154は、センサ情報取得部151によって取得された物理量を基に、ライダーが自転車に乗車している状態であるか否かを判定する。ライダーが自転車に乗車している状態であるか否かは、鉛直方向、前後方向及び左右方向の加速度の波形パターンから判定することができる。

Returning to FIG. 5, the

The

図7は、歩行時における加速度の波形パターンの一例を示す図である。

また、図8は、自転車乗車時(シッティング時)の加速度の波形パターンの一例を示す図である。

図7及び図8に示すように、歩行している場合と自転車に乗車している状態とでは、鉛直方向、前後方向及び左右方向の加速度の比が明確に異なるという実験結果が得られている。そのため、歩行時と自転車の乗車時とを判別する条件として、鉛直方向、前後方向及び左右方向の加速度の比における判定閾値を実験値に基づいて設定することができる。また、同様に、ジョギング等の走行時と自転車の乗車時とでは、加速度の振幅が明確に異なるため、加速度の振幅における判定閾値を実験値に基づいて設定することができる。例えば、一例として、歩行の場合とシッティングの場合とでは、鉛直方向、前後方向及び左右方向の加速度の振幅(絶対値)の比が、歩行ではおおよそ2:1:1、シッティングではおおよそ1:1:2となるため、これらの比を基準として、判定閾値を設定することができる。ただし、これらの比は、ライダーの身体的特徴や、ライダーが乗車する自転車の仕様等によって幅があることから、歩行によるキャリブレーションあるいは乗車する自転車においてキャリブレーションを行う等して、調整することが望ましい。

FIG. 7 is a diagram illustrating an example of a waveform pattern of acceleration during walking.

FIG. 8 is a diagram showing an example of an acceleration waveform pattern when riding a bicycle (when sitting).

As shown in FIGS. 7 and 8, there is an experimental result that the ratio of acceleration in the vertical direction, the front-rear direction, and the left-right direction is clearly different between when walking and when riding a bicycle. . Therefore, as a condition for discriminating between walking and riding a bicycle, a determination threshold for the ratio of acceleration in the vertical direction, the front-rear direction, and the left-right direction can be set based on experimental values. Similarly, since the acceleration amplitude is clearly different between running such as jogging and riding a bicycle, the determination threshold for the acceleration amplitude can be set based on experimental values. For example, as an example, in the case of walking and the case of sitting, the ratio of the amplitude (absolute value) of acceleration in the vertical direction, the front-rear direction, and the left-right direction is approximately 2: 1: 1 for walking and approximately 1: 1 for sitting. Therefore, the determination threshold value can be set on the basis of these ratios. However, these ratios vary depending on the physical characteristics of the rider, the specifications of the bicycle on which the rider rides, etc., and can be adjusted by calibration by walking or calibration on the ride bicycle. desirable.

図5に戻り、出力制御部155は、運転評価処理部152における運転評価処理結果を情報表示装置200に出力する。また、出力制御部155は、運転評価処理部152における運転評価処理結果が予め設定された報知条件に合致するか否かを判定し、報知条件に合致する場合、運転評価処理結果を示す音声を出力する。運転評価処理部152の運転評価処理結果における報知条件としては、例えば、乗車姿勢が変化した場合、あるいは、乗車姿勢が乱れている場合等を設定することができる。

また、情報表示装置200において、表示情報受信部251は、計測装置100から運転評価処理結果を受信する。

表示制御部252は、表示情報受信部251が受信した運転評価処理結果をディスプレイに表示する。このとき、表示制御部252は、地図データに重畳して、GPS等に基づく計測装置100の現在位置を表示し、現在位置と対応付けて運転評価処理結果を表示することができる。

Returning to FIG. 5, the

In the

The

また、撮影処理が実行される場合には、図5に示すように、撮像装置300のCPU311において、撮影トリガ信号受信部351と、撮影パラメータ設定部352と、撮像制御部353と、記憶制御部354とが機能する。

また、記憶部317の一領域には、画像記憶部371が設定される。

画像記憶部371には、撮像された静止画像または動画像が記憶される。本実施形態において、画像記憶部371には、撮像された静止画像または動画像のデータと、撮影位置を示す情報と、ライダーの乗車姿勢及び運転状態の評価結果(運転評価処理結果)とが対応付けて記憶される。

When the shooting process is executed, as shown in FIG. 5, in the

An

The

撮影トリガ信号受信部351は、計測装置100から撮影トリガ信号を受信する。

撮影パラメータ設定部352は、撮影トリガ信号に含まれている撮影パラメータに撮像部316を設定する。ここで、撮影パラメータとしては、シャッタ速度、絞り、感度、セピア、パノラマあるいはブラー(スピード感を出すために画角の周縁をぼかす処理)等の撮影シーン設定が含まれる。

撮像制御部353は、撮影パラメータ設定部352によって設定された撮影パラメータに従って、撮像部316による撮像を実行する。

記憶制御部354は、撮像部316によって撮像された撮像画像のデータを、撮影位置を示す情報、ライダーの乗車姿勢及び運転状態の評価結果(運転評価処理結果)と対応付けて、画像記憶部371に記憶する。

The shooting trigger

The shooting

The

The

このような構成を備える運転評価システム1は、以下のような特徴を有するものとなる。

即ち、より速く、あるいは、より遠くへ移動したいライダーにとっては効率的に乗車姿勢を変更することは重要である。例えば、前乗りの場合、進行方向右側から見てクランクの12時の位置から踏み込むことができ、真下に掛ける力を強めることができる。この時に主に利用さるのは大腿四頭筋である。また、後乗りの場合では、進行方向右側から見てクランクの2時半の位置から7時までの位置で踏み込むことができ、踏み込み量を大きく取ることができる。この場合には通常よりも大腿二頭筋が多く利用される。そのため、乗車姿勢を変化させることで、乗車時における特定部位の筋疲労の集中を防ぐことが可能となり、より長距離への走行、あるいは、より短時間での走破が可能となる。そこで、上述のように、乗車姿勢や運転状態の評価結果(運転評価処理結果)を記憶しておくことができれば、自分自身の気付かなかった乗車姿勢の偏りや非効率な姿勢変化等を認識できる。そのため、次回以降のサイクリングへ活かすデータとすることができる。

また、乗車姿勢の変化や運転状態の評価結果(運転評価処理結果)と対応付けて、乗車中にライダーが視認する風景等を撮影することにより、どのような地点で乗車姿勢の変化や運転状態の低下が生じたのかを容易に思い出すことができる。さらに、自転車による走行中に撮影のための操作を行うことなく風景を撮影することができるため、走行時の安全性の低下を防ぐことができる。また、乗車中の風景を撮影し続ける場合に比べ、より低消費電力で、効果的な撮影を行うことができる。

The driving

In other words, it is important for the rider who wants to move faster or farther to change the riding posture efficiently. For example, in the case of a front ride, it can be stepped on from the 12 o'clock position of the crank as viewed from the right side of the traveling direction, and the force applied directly below can be increased. At this time, the quadriceps muscle is mainly used. Further, in the case of rear riding, it is possible to depress at a position from 2:30 to 7 o'clock of the crank as viewed from the right in the traveling direction, and a large amount of depression can be obtained. In this case, the biceps femoris is used more than usual. Therefore, by changing the riding posture, it is possible to prevent concentration of muscle fatigue in a specific part during riding, and it is possible to travel to a longer distance or run in a shorter time. Therefore, as described above, if the evaluation result (driving evaluation processing result) of the riding posture and the driving state can be stored, it is possible to recognize the deviation of the riding posture, the inefficient posture change, etc. that were not noticed by itself. . Therefore, the data can be used for the next and subsequent cycling.

In addition, by taking pictures of scenery that the rider sees while riding in association with changes in riding posture and evaluation results of driving conditions (driving evaluation processing results), changes in riding posture and driving conditions at any point It can be easily remembered whether or not the decrease occurred. Furthermore, since it is possible to take a picture of a landscape without performing a shooting operation while traveling on a bicycle, it is possible to prevent a reduction in safety during driving. In addition, it is possible to perform effective shooting with lower power consumption than in the case of continuously shooting the scenery while riding.

[動作]

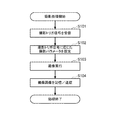

図9は、図5の機能的構成を有する図2の計測装置100が実行する運転状態判定処理の流れを説明するフローチャートである。

運転状態判定処理は、ユーザによる入力部117への運転状態判定処理開始のための操作により開始される。

[Operation]

FIG. 9 is a flowchart for explaining the flow of the operation state determination process executed by the measuring

The driving state determination process is started by an operation for starting the driving state determination process to the

ステップS1において、センサ情報取得部151は、センサ部116からセンサ情報を取得する。

ステップS2において、運転評価処理部152は、取得されたセンサ情報に基づいて、後述する運転評価処理を実行する。

In step S <b> 1, the sensor information acquisition unit 151 acquires sensor information from the

In step S <b> 2, the driving

ステップS3において、撮影制御部153は、運転評価処理部152によって取得された乗車姿勢及び運転状態の評価結果(運転評価処理結果)が、予め設定された特定の状態となっているか否かの判定を行う。

運転評価処理部152によって取得された乗車姿勢及び運転状態の評価結果(運転評価処理結果)が、予め設定された特定の状態となっている場合、ステップS3においてYESと判定されて、処理はステップS4に移行する。

一方、運転評価処理部152によって取得された乗車姿勢及び運転状態の評価結果(運転評価処理結果)が、予め設定された特定の状態となっていない場合、ステップS3においてNOと判定されて、処理はステップS5に移行する。

In step S <b> 3, the

When the evaluation result (driving evaluation processing result) of the boarding posture and the driving state acquired by the driving

On the other hand, when the evaluation result (driving evaluation processing result) of the boarding posture and the driving state acquired by the driving

ステップS4において、撮影制御部153は、乗車姿勢及び運転状態の評価結果(運転評価処理結果)に対応した撮影パラメータを含む撮影トリガ信号を撮像装置300に送信する。

また、ステップS4において、出力制御部155は、運転評価処理結果を情報表示装置200に送信する。さらに、出力制御部155は、評価情報記憶部171に記憶されている計測された物理量のデータ、ライダーの乗車姿勢及びライダーの運転状態の評価結果を、情報表示装置200の出力部218のディスプレイに表示する。

ステップS5において、乗車判定部154は、センサ部116の計測結果に基づいて、自転車に乗車中の状態であるか否かの判定を行う。

自転車に乗車中の状態である場合、ステップS5においてYESと判定されて、処理はステップS1に移行する。

一方、自転車に乗車中の状態でない場合、ステップS5においてNOと判定されて、処理はステップS6に移行する。

In step S <b> 4, the

In step S <b> 4, the

In step S <b> 5, the

If the bicycle is being ridden, YES is determined in step S5, and the process proceeds to step S1.

On the other hand, if the bicycle is not being ridden, NO is determined in step S5, and the process proceeds to step S6.

ステップS6において、乗車判定部154は、自転車に乗車中でない時間に設定されたタイムアウトの状態となっている(自転車に乗車中でない時間に設定された閾値時間を超えている)か否かの判定を行う。

自転車に乗車中でない時間に設定されたタイムアウトの状態となっていない場合、ステップS6においてNOと判定されて、処理はステップS1に移行する。

一方、自転車に乗車中でない時間に設定されたタイムアウトの状態となっている場合、ステップS6においてYESと判定されて、運転状態判定処理は終了となる。

In step S <b> 6, the

If it is not in the time-out state set at the time when the bicycle is not being ridden, NO is determined in step S6, and the process proceeds to step S1.

On the other hand, when it is in the time-out state set at the time when the bicycle is not being ridden, it is determined as YES in Step S6, and the driving state determination process is ended.

次に、運転評価処理について説明する。

図10は、運転評価処理の流れを説明するフローチャートである。

ステップS21において、運転評価処理部152は、センサ部116によって計測された物理量を乗車姿勢判定条件と照合する。乗車姿勢判定条件は、各種乗車姿勢について設定された物理量(ここでは加速度)の各方向の比あるいは振幅それぞれに設定された閾値として定義される。

Next, the driving evaluation process will be described.

FIG. 10 is a flowchart illustrating the flow of the driving evaluation process.

In step S21, the driving

ステップS22において、運転評価処理部152は、乗車姿勢判定条件の照合結果から、現在の乗車姿勢を特定する。これにより、例えば、シッティングのノーマルといった乗車姿勢が特定される。

ステップS23において、運転評価処理部152は、センサ部116によって計測された物理量及び乗車姿勢の履歴を用いて、現在のライダーの運転状態を運転評価条件と照合する。運転評価条件は、ライダーの運転状態が望ましい状態、通常の状態あるいは望ましくない状態といった評価を行うための条件であり、センサ部116によって計測された物理量の安定性、乗車姿勢の継続時間、基準とするデータとの相違の大きさ、あるいは、走行速度の維持状態等として定義される。

例えば、運転評価の基準となる理想の乗車姿勢の物理量(例えば、ロードレース選手の運動データ)と自分の測定された物理量とを比較して、物理量の差分を評価結果として情報表示装置200の出力部218に表示することができる。

また、評価する項目としては、腰の上下動の変化量、胴体の左右の変化量、ケイデンス、推進力(所定のペダル回転数で進む距離)等が考えられる。ステップS4で運転評価結果を表示する際に、これらの項目をレーダーチャートで表わして出力部218に出力してもよい。

In step S22, the driving

In step S23, the driving

For example, the physical quantity of an ideal riding posture (for example, road racer's exercise data), which is a reference for driving evaluation, is compared with the measured physical quantity, and the difference between the physical quantities is output as an evaluation result. It can be displayed on the

Further, as items to be evaluated, the amount of change in the vertical movement of the waist, the amount of change in the left and right sides of the body, cadence, propulsive force (distance traveled at a predetermined pedal rotation speed), and the like can be considered. When the driving evaluation result is displayed in step S4, these items may be represented by a radar chart and output to the

ステップS24において、運転評価処理部152は、乗車姿勢及び運転状態の評価結果(運転評価処理結果)をセンサ部116によって計測された物理量(センサ情報)と対応付けて、評価情報記憶部171に記憶する。

ステップS24の後、処理は運転状態判定処理に戻る。

In step S <b> 24, the driving

After step S24, the process returns to the driving state determination process.

次に、撮影処理について説明する。

図11は、図5の機能的構成を有する図4の撮像装置300が実行する撮影処理の流れを説明するフローチャートである。

撮影処理は、計測装置100において運転状態判定処理が実行されることに対応して開始される。

ステップS101において、撮影トリガ信号受信部351は、計測装置100から撮影トリガ信号を受信する。

ステップS102において、撮影パラメータ設定部352は、撮影トリガ信号に含まれている撮影パラメータに撮像部316を設定する。

ステップS103において、撮像制御部353は、撮影パラメータ設定部352によって設定された撮影パラメータに従って、撮像部316による撮像を実行する。

ステップS104において、撮像制御部353は、撮像画像のデータを画像記憶部371に記憶する。このとき、撮像画像のデータを情報表示装置200等の他の装置に送信する設定となっている場合、撮像制御部353は、撮像画像のデータを他の装置に送信する。

Next, the photographing process will be described.

FIG. 11 is a flowchart for explaining the flow of imaging processing executed by the

The imaging process is started in response to the operation state determination process being executed in the

In step S <b> 101, the shooting trigger

In step S102, the imaging

In step S <b> 103, the

In step S <b> 104, the

[変形例1]

自転車乗車時の加速度の変化は、走行路面の状況によっても生じる。例えば、凹凸の大きな路面上を走行すると重力加速度方向に変化が生じるが、加速度データをフーリエ変換し、周波数成分として表すことで、路面状況を推定することができる。そして、路面状況に応じて選択されたローパスフィルタを用いてセンサ部116の計測結果をフィルタ処理することで、姿勢変化をより正確に捉えることができる。

[Modification 1]

The change in acceleration when riding a bicycle also occurs depending on the condition of the road surface. For example, when traveling on a road with large irregularities, a change occurs in the direction of gravitational acceleration, but the road surface condition can be estimated by performing a Fourier transform on the acceleration data and expressing it as a frequency component. Then, by filtering the measurement result of the

[変形例2]

乗車姿勢あるいは乗車中であるか否かを判定する際に、GPSによる測位結果とセンサ部116の計測結果とを合わせて判定することで、より正確に乗車姿勢等を判定することができる。

例えば、シッティングの場合、各軸に対する加速度変化の度合いは比較的小さいものの、一定量以上の移動量変化がGPSにより観察された場合、自転車による移動であるとことをより明確に判定できる。

[Modification 2]

When determining the boarding posture or whether or not the vehicle is in the boarding state, it is possible to more accurately determine the boarding posture or the like by determining the GPS positioning result and the measurement result of the

For example, in the case of sitting, although the degree of acceleration change with respect to each axis is relatively small, when a movement amount change of a certain amount or more is observed by GPS, it can be more clearly determined that the movement is by a bicycle.

[変形例3]

シッティングの状態からスタンディングとなった場合、各軸に対して大きな加速度変化が生じる。なお、この加速度を2回積分することで、姿勢変化に係る移動距離として検出することができる。シッティングからスタンディングへ移行した場合の垂直方向の変化量は、実験の結果、おおよそ15〜40cm程度であり、センサ部116によって十分に計測可能である。同様に、進行方向への変化量は、おおよそ20〜45cm程度であり、進行方向に対する左右方向の変化量は、各方向に対しておおよそ5〜25cm程度である。

即ち、上述の実施形態に示すように、鉛直方向、前後方向及び左右方向の加速度の比及び振幅の絶対値を用いる他、シッティングからスタンディングの姿勢変化は、これらの変化量のデータを用いることによっても判定することができる。

[Modification 3]

When standing from the sitting state, a large acceleration change occurs for each axis. In addition, by integrating this acceleration twice, it can be detected as a moving distance related to the posture change. As a result of the experiment, the amount of change in the vertical direction when shifting from sitting to standing is approximately 15 to 40 cm, and can be sufficiently measured by the

That is, as shown in the above-described embodiment, in addition to using the ratio of the acceleration in the vertical direction, the front-rear direction, and the left-right direction and the absolute value of the amplitude, the posture change from sitting to standing is obtained by using the data of these changes. Can also be determined.

[変形例4]

スタンディングにおいて、GPSにより得られた移動距離と、スタンディングの維持時間とから単位時間あたりの移動量を算出することができる。このとき、攻めのダンシングは、休みのダンシングと比較すると、明らかに単位時間あたりの移動量が大きく、一方で持続時間が短いという特徴がある。また、スタンディングの場合、上下動と左右の移動に周期性あり、攻めのダンシングの方が休みのダンシングに比べて周期が短いという特徴がある。

そのため、単位時間あたりの移動量及び波形パターンの周期の長さを基に、スタンディングとダンシングをより正確に判定することができる。

[Modification 4]

In standing, the moving amount per unit time can be calculated from the moving distance obtained by GPS and the maintenance time of standing. At this time, the aggressive dancing has a feature that the amount of movement per unit time is clearly large, while the duration is short, as compared with the resting dancing. In the case of standing, there is a characteristic that the vertical movement and the horizontal movement are periodic, and the aggressive dancing has a shorter period than the resting dancing.

Therefore, standing and dancing can be more accurately determined based on the movement amount per unit time and the length of the waveform pattern period.

[変形例5]

シッティングにおいて重力方向に対する前傾角度は、実験の結果、通常時はおおよそ95〜135度の範囲にあるが、アップライト時にはそれまでの角度範囲から外れ、おおよそ140〜180度に変化することが明らかとなった。

そのため、シッティングにおけるアップライトとノーマルとの判定は、計測装置100の重力方向に対する前傾角度によって、より正確に判定することができる。

[Modification 5]

As a result of experiments, it is clear that the forward tilt angle with respect to the gravitational direction in sitting is normally in the range of 95 to 135 degrees, but when upright, it is outside the previous angle range and changes to approximately 140 to 180 degrees. It became.

Therefore, the determination of upright and normal in sitting can be made more accurately by the forward tilt angle of the measuring

[変形例6]

シッティングにおいて、上方向に移動した後、進行方向の移動量変化が続けて生じる場合がある。この時の移動量変化はスタンディングへの変化よりも小さく、上方向に5cm程度、前後方向に10cm程度であったが、これは、シッティングにおける前乗りと後乗りの差異を表していると推定できる。

即ち、シッティングにおける上記進行方向への移動量変化を監視することで、前乗り及び後乗りをより正確に判定することができる。

[Modification 6]

In the sitting, the movement amount in the traveling direction may change continuously after moving upward. The change in the amount of movement at this time was smaller than the change to the standing, about 5 cm in the upward direction and about 10 cm in the front-rear direction. This can be estimated to represent the difference between the front and rear riding in sitting. .

That is, it is possible to more accurately determine the front ride and the rear ride by monitoring the movement amount change in the traveling direction in the sitting.

[変形例7]

上述の実施形態において、乗車中にライダーに対して、こぎ方のアドバイスを行うこととしてもよい。

即ち、コースの走行中に、スピードを求める、あるいは、効率的なこぎ方を求める等のライダーの目的に合った自転車のこぎ方をアドバイスすることができる。具体的には、運転評価処理部152において、ライダーの乗車姿勢の判定条件及び運転評価条件を目的に合ったものに設定しておき、これらの条件に対する判定結果を音声あるいはディスプレイによってライダーに報知する。

なお、こぎ方のアドバイスの他、乗車姿勢の乱れの傾向に応じて、自転車の設定(サドルやハンドルの位置等)についてのアドバイスを行うこととしてもよい。例えば、「腰が左右に揺れ過ぎているため、サドルの高さを下げた方がよい」といったアドバイスを行うことができる。

[Modification 7]

In the above-mentioned embodiment, it is good also as giving advice of how to saw to a rider during boarding.

That is, it is possible to give advice on how to ride a bicycle suitable for the rider's purpose, such as obtaining speed or finding an efficient way to ride while traveling on a course. Specifically, the driving

In addition to advice on how to saw, advice on bicycle settings (saddle, steering wheel position, etc.) may be given according to the tendency of the riding posture to be disturbed. For example, advice such as “it is better to lower the height of the saddle because the waist is shaking too much from side to side” can be given.

[変形例8]

上述の実施形態において、地図データ、現在位置のデータ及びセンサ部116の計測結果を基に、ライダーが理想的なコーナリングを行っているか否かを判定することとしてもよい。

具体的には、地図データから把握される旋回半径を基に、コーナーへの理想的な進入速度及びコース取りを算出し、コーナリング時におけるふらつきや加減速の状態から、理想的なコーナリングの状態との相違を判定することができる。

[Modification 8]

In the above-described embodiment, it may be determined whether or not the rider is performing ideal cornering based on the map data, the current position data, and the measurement result of the

Specifically, based on the turning radius obtained from the map data, the ideal approach speed and course taking to the corner are calculated, and the ideal cornering state is determined from the state of wobbling and acceleration / deceleration during cornering. Can be determined.

[変形例9]

上述の実施形態において、乗車姿勢や運転状態の評価結果(運転評価処理結果)を、走行中に計測装置100からライダーに対して、逐次報知することとしてもよい。例えば、コーナーを曲がる度、乗車姿勢が変化する度といったタイミングで、運転状態や現在の乗車姿勢の適否を音声あるいはバイブレーション信号等によって、リアルタイムにライダーに報知することができる。

[Modification 9]

In the above-described embodiment, the evaluation result (driving evaluation processing result) of the riding posture and the driving state may be sequentially notified from the measuring

[変形例10]

上述の実施形態において、撮影制御部153が乗車姿勢や運転状態の評価結果(運転評価処理結果)が特定の状態であるか否かを判定する場合に、センサ部116によって検出された物理量の絶対値に基づいて判定すること、センサ部116によって検出された物理量の組み合わせが所定状態であるか否かに基づいて判定すること、センサ部116によって検出された物理量が基準値と一致するか否かに基づいて判定することが可能であり、これらの判定方法を組み合わせることも可能である。

即ち、撮影制御部153は、物理量の絶対値が閾値以上(または閾値以下)となった場合に、状態の変化があったものとして、撮影トリガ信号を送信することが可能である。

これにより、単独の物理量として表れる乗車姿勢の変化等を検出して、撮影を行うことができる。

また、撮影制御部153は、物理量の絶対値の組み合わせが所定の状態(加速度が小さく、腰の回転が大きい状態等)となった場合に、乗車姿勢が所定状態(疲労から乗車姿勢が乱れている状態等)になったものとして、撮影トリガ信号を送信することが可能である。同様に、休みのダンシングになった場合(ユーザの頭が前向きと推定される場合)に、撮影トリガ信号を送信することが可能である。

これにより、複数の物理量の組み合わせとして表れる乗車姿勢の変化等を検出して、撮影を行うことができる。

さらに、撮影制御部153は、コースに対して基準となる物理量のデータ(プロのライダーのデータ、複数ユーザのデータあるいは過去の自身のデータ等)を用意しておき、計測された物理量と基準のデータとに所定量の乖離が生じた場合に、撮影トリガ信号を送信することが可能である。

これにより、疲労等によって、基準となるデータとの乖離が生じ、乗車姿勢が乱れた場合等に、撮影を行うことができる。

[Modification 10]

In the above-described embodiment, the absolute value of the physical quantity detected by the

That is, the

As a result, it is possible to detect a change in the riding posture that appears as a single physical quantity and to perform shooting.

In addition, when the combination of the absolute values of the physical quantities is in a predetermined state (such as a state where acceleration is small and hip rotation is large), the

As a result, it is possible to detect a change in the riding posture that appears as a combination of a plurality of physical quantities, and to perform shooting.

Further, the

As a result, photographing can be performed when a deviation from the reference data occurs due to fatigue or the like and the riding posture is disturbed.

[変形例11]

上述の実施形態において、撮影制御部153は、乗車姿勢に対応して、撮像トリガ信号に含める撮影パラメータを種々設定することができる。

例えば、乗車姿勢に応じて、シャッタ速度、絞り、感度、セピア、パノラマあるいはブラー等の撮影シーン設定の他、撮影インターバル、画角等の撮影パラメータを設定することができる。

これにより、乗車姿勢から推定される走行状態に応じて、より適切な撮影パラメータで撮影を行うことができる。

また、撮影制御部153は、乗車姿勢に応じて、動画または静止画のうち、いずれかを選択して撮影することができる。

これにより、乗車姿勢から推定される走行状態に応じて、動画または静止画像を適切に選択して撮影を行うことができる。

さらに、撮影制御部153は、乗車姿勢に応じて、撮影された画像に施すエフェクトを種々切り替えることができる。

例えば、攻めのダンシング時に撮影された静止画像には、ブレを低減するために高速なシャッタ速度で撮影する一方、スピード感を出すためのブラーを施すことができる。また、アップライトのシッティング時に撮影された動画像は、風景が映りやすい姿勢であることから、パノラマ撮影を行ったりすることができる。

[Modification 11]

In the above-described embodiment, the

For example, shooting parameters such as shooting interval and angle of view can be set in addition to shooting scene settings such as shutter speed, aperture, sensitivity, sepia, panorama, and blur according to the riding posture.

Thereby, it is possible to perform shooting with more appropriate shooting parameters according to the running state estimated from the riding posture.

In addition, the

Thereby, according to the driving | running state estimated from a boarding attitude | position, a moving image or a still image can be selected appropriately, and it can image | photograph.

Furthermore, the

For example, a still image shot during aggressive dancing can be shot at a high shutter speed in order to reduce blurring, while being blurred to give a sense of speed. In addition, since the moving image taken at the time of upright sitting has a posture in which the landscape is easily reflected, panoramic photography can be performed.

[第2実施形態]

次に、本発明の第2実施形態について説明する。

本実施形態に係る運転評価システム1では、計測装置100がセンサ部116にジャイロセンサを備えている。

そして、運転状態判定処理において、計測装置100が計測したライダーの身体における角速度を用いて、乗車姿勢判定条件及び運転評価条件の判定が行われる。

ジャイロセンサを用いることにより、ペダルを踏む動作に伴う腰の回転の有無が明瞭に判定される。腰の回転の周期を算出することでケイデンス(ペダル回転数)を計測することが可能となった。ケイデンスが変化するのはライダーが置かれた状況が変化したとき(例えば、上り坂や下り坂により負荷が変動した、あるいは風景を楽しもうと走行速度を落とした等)であることが多いため、この変化を捉えて撮影を行うことで効果的な撮影を行うことができる。具体的には、ケイデンスに対して閾値判定を行い、閾値を通過する際にシャッタを切る。自転車に特別な機器を取り付けることなくケイデンスの計測が可能であり、旅先でレンタサイクルを利用したときでもケイデンスの計測及びこれを利用した撮影が容易に行うことができる。

また、第1実施形態においては、自転車での移動であることを加速度センサ及びGPSによる移動の検出によって判定していたところ、トンネル内や、屋内での練習に用いられるエアロバイク等においては、GPSを利用できなかった。

これに対し、本実施形態に係る計測装置100は、ジャイロセンサの計測結果を用いることで、より正確に姿勢変化を検出することができる。

具体的には、ジャイロセンサのサンプリングレートを200Hz程度とし、左右1回転に要する時間を正確に計測することで、右脚と左脚との回転左右差を判定することができる。

また、シッティングにおける前乗りの場合には、一方の脚に注目すると、回転の初動部分から半回転が終了するまで(ペダルの頂部から底部への踏み込み過程)の時間の方が、回転の後半よりも長くなる。これに対し、シッティングの後乗りの場合には、前乗りの場合と比較して、回転の後半の方が半回転に要する時間が長くなる。

そのため、一方の脚の回転に注目し、半回転に要する時間を前半と後半とで比較することで、シッティングの前乗りであるか後乗りであるかをより正確に判定することができる。

[第3実施形態]

次に、本発明の第3実施形態について説明する。

本実施形態に係る運転評価システム1では、計測装置100がセンサ部116に気圧センサを備えている。

そして、運転状態判定処理において、計測装置100が計測した気圧のデータを用いて、乗車姿勢判定条件及び運転評価条件の判定が行われる。具体的には、気圧のデータから計測装置100の高度の変化を計測し、高度の変化を利用して、乗車姿勢判定条件及び運転評価条件の判定が行われる。

気圧センサによる高度変化を計測することにより、走行路が上り坂であるか下り坂であるかを容易に判定することが可能となる。そのため、ライダーの身体のみが上下方向に移動しているのか、走行路自体に起伏があるのかを判別できるため、ライダーの乗車姿勢の判定をより正確に行うことができる。

また、シッティングにおいて、ノーマルからアップライトに姿勢を変化する際に、姿勢変化の速度が小さい場合においては、加速度センサの計測結果として明確に表れ難い場合がある。これに対し、気圧センサを用いた場合、ノーマルからアップライトへの姿勢変化の速度が小さい場合であっても、計測結果に明確な上昇が見られ、より容易にアップライト姿勢の判定を行うことができる。

[第4実施形態]

次に、本発明の第4実施形態について説明する。

第1実施形態〜第3実施形態においては、各軸の加速度の計測結果に対する閾値の判定に基づいて姿勢変化の検出を行うものであった。

これに対し、本実施形態に係る運転評価システム1では、機械学習により姿勢変化の検出を行う。

具体的には、性別、体格、年齢、自転車乗車歴の異なる複数の被験者におけるシッティング及びスタンディングの物理量を計測し、これらを教師データとして特徴点抽出を行う機械学習を行う。そして、機械学習において、被験者の母集団において得られた特徴点を利用して、新たな被験者に対して姿勢判定を行うことができる。なお、機械学習の結果を用いて、新たな被験者の姿勢変化を判定したところ、全姿勢変化に対して98%の精度で正しい判定が得られた。即ち、複数の被験者における物理量の計測結果を教師データとして、機械学習により新たな被験者の姿勢変化を判定することによって、より正確に乗車姿勢を判定することが可能となる。

[Second Embodiment]

Next, a second embodiment of the present invention will be described.

In the driving

In the driving state determination process, the riding posture determination condition and the driving evaluation condition are determined using the angular velocity of the rider's body measured by the

By using the gyro sensor, the presence / absence of hip rotation associated with the stepping on the pedal is clearly determined. Cadence (pedal rotation speed) can be measured by calculating the period of hip rotation. Cadence often changes when the rider's position changes (for example, the load changes due to uphill or downhill, or the running speed is reduced to enjoy the scenery) By capturing this change and performing imaging, it is possible to perform effective imaging. Specifically, threshold determination is performed for cadence, and the shutter is released when the threshold is passed. Cadence can be measured without attaching special equipment to the bicycle, and cadence can be easily measured and photographed using this even when a bicycle is used on the road.

Further, in the first embodiment, the movement by bicycle is determined by detecting the movement by the acceleration sensor and the GPS. However, in an exercise bike used for practice in a tunnel or indoors, the GPS Was not available.

On the other hand, the measuring

Specifically, the rotational left-right difference between the right leg and the left leg can be determined by setting the sampling rate of the gyro sensor to about 200 Hz and accurately measuring the time required for one rotation left and right.

Also, in the case of front riding in sitting, paying attention to one leg, the time from the initial rotation part until the half rotation is completed (stepping from the top of the pedal to the bottom) is longer than the latter half of the rotation. Also gets longer. On the other hand, in the case of rear riding of sitting, the time required for half rotation is longer in the latter half of the rotation than in the case of front riding.

Therefore, paying attention to the rotation of one leg and comparing the time required for half rotation between the first half and the second half, it is possible to more accurately determine whether it is a front ride or a rear ride of sitting.

[Third Embodiment]

Next, a third embodiment of the present invention will be described.

In the driving

In the driving state determination process, the riding posture determination condition and the driving evaluation condition are determined using the atmospheric pressure data measured by the measuring

By measuring the altitude change by the atmospheric pressure sensor, it is possible to easily determine whether the travel path is uphill or downhill. Therefore, since it is possible to determine whether only the rider's body is moving up and down or whether the travel path itself is undulating, the rider's riding posture can be more accurately determined.

Further, when the posture is changed from normal to upright in sitting, if the posture change speed is low, it may be difficult to clearly show the measurement result of the acceleration sensor. On the other hand, when a barometric sensor is used, even if the rate of change in posture from normal to upright is small, a clear rise in the measurement results can be seen, making it easier to determine the upright posture. Can do.

[Fourth Embodiment]

Next, a fourth embodiment of the present invention will be described.

In the first to third embodiments, the posture change is detected based on the determination of the threshold value with respect to the acceleration measurement result of each axis.

On the other hand, in the driving

Specifically, machine learning is performed in which physical quantities of sitting and standing are measured for a plurality of subjects having different genders, physiques, ages, and bicycle riding histories, and feature points are extracted using them as teacher data. In machine learning, it is possible to perform posture determination on a new subject using feature points obtained in the population of subjects. In addition, when the posture change of a new subject was determined using the result of machine learning, a correct determination was obtained with an accuracy of 98% with respect to all posture changes. That is, it is possible to determine the riding posture more accurately by using the physical quantity measurement results of a plurality of subjects as teacher data and determining a new posture change of the subject by machine learning.

以上のように構成される運転評価システム1は、計測装置100を含み、計測装置100は、センサ部116と、運転評価処理部152と、を備える。

センサ部116は、自転車に乗車している際のユーザの物理量(加速度、角速度あるいは気圧等)を取得する。

運転評価処理部152は、センサ部116により取得された前記物理量に基づいて、前記ユーザが自転車に乗車している際のユーザの乗車姿勢の評価を行う。

これにより、ユーザに関連する物理量を基に、乗車姿勢の評価が行われる。

そのため、走行時におけるユーザの乗車姿勢を客観的かつ正確に評価することができる。

したがって、自転車の運転技術をより適切に評価することができる。

The driving

The

Based on the physical quantity acquired by the

Thus, the riding posture is evaluated based on the physical quantity related to the user.

Therefore, it is possible to objectively and accurately evaluate the user's riding posture during traveling.

Therefore, the driving skill of the bicycle can be more appropriately evaluated.

また、運転評価処理部152は、センサ部116により取得された所定種類の乗車姿勢のときのユーザの物理量と、評価基準となる所定種類の乗車姿勢の物理量と、の比較に基づいて、ユーザの乗車姿勢の評価を行う。

これにより、ユーザの乗車姿勢を、乗車姿勢の種類毎に適切に評価することができる。

Further, the driving

Thereby, a user's boarding attitude | position can be evaluated appropriately for every kind of boarding attitude | position.

また、センサ部116は、物理量として、ユーザの鉛直方向、進行方向の前後方向及び左右方向それぞれの加速度を取得する。

運転評価処理部152は、鉛直方向、進行方向の前後方向及び左右方向それぞれの加速度の変化に基づいて、ユーザの乗車姿勢の種類を判定する。

これにより、ユーザに生じている加速度を測定することで、簡単に運転状態の評価を行うことが可能となる。

In addition, the

The driving

Accordingly, it is possible to easily evaluate the driving state by measuring the acceleration generated in the user.

また、運転評価処理部152は、鉛直方向、進行方向の前後方向及び左右方向それぞれの加速度の比及び加速度の絶対値の少なくともいずれかひとつに基づいて、ユーザの乗車姿勢の種類を判定する。

これにより、ユーザに生じている各方向の加速度を利用して、適確にユーザの乗車姿勢を判定することができる。

Further, the driving

Thereby, a user's boarding attitude | position can be determined correctly using the acceleration of each direction which has arisen in the user.

また、センサ部116は、計測装置100の位置情報を取得する位置センサを備える。

運転評価処理部152は、加速度及び位置情報に基づいて、ユーザの乗車姿勢の種類を判定する。

これにより、ユーザの運転状態を正確に把握して、より適確に乗車姿勢を判定することができる。

In addition, the

The driving

Thereby, a user's driving | running state can be grasped | ascertained correctly and a boarding attitude | position can be determined more appropriately.

なお、本発明は、上述の実施形態に限定されるものではなく、本発明の目的を達成できる範囲での変形、改良等は本発明に含まれるものである。 In addition, this invention is not limited to the above-mentioned embodiment, The deformation | transformation in the range which can achieve the objective of this invention, improvement, etc. are included in this invention.

上述の実施形態では、計測装置100を運転者の腰部に装着するものとして説明したが、これに限られない。例えば、計測装置100は、運転者に生じる物理量を計測できれば、運転者の腕や頸あるいは胸部等に装着することとしてもよい。

In the above-described embodiment, the

また、上述の実施形態において、本発明が適用される計測装置100は、情報処理機能を有する電子機器一般によって構成することができる。例えば、計測装置100は、携帯型ナビゲーション装置、携帯電話機、スマートフォン、ポータブルゲーム機等によって構成することが可能である。

In the above-described embodiment, the measuring

また、上述の実施形態では、本発明が適用される情報表示装置200は、スマートフォンを例として説明したが、特にこれに限定されない。

例えば、情報表示装置200は、情報表示機能を有する電子機器一般に適用することができる。具体的には、例えば、情報表示装置200は、ノート型のパーソナルコンピュータ、テレビジョン受像機、ビデオカメラ、携帯型ナビゲーション装置、携帯電話機、ポータブルゲーム機等によって構成することが可能である。

In the above-described embodiment, the

For example, the

また、上述の実施形態では、本発明が適用される撮像装置300は、デジタルカメラを例として説明したが、特にこれに限定されない。

例えば、撮像装置300は、撮像機能を有する電子機器一般に適用することができる。例えば、撮像装置300は、ノート型のパーソナルコンピュータ、ビデオカメラ、携帯型ナビゲーション装置、携帯電話機、スマートフォン、ポータブルゲーム機等によって構成することが可能である。

Further, in the above-described embodiment, the

For example, the

上述した一連の処理は、ハードウェアにより実行させることもできるし、ソフトウェアにより実行させることもできる。

換言すると、図5の機能的構成は例示に過ぎず、特に限定されない。即ち、上述した一連の処理を全体として実行できる機能が運転評価システム1に備えられていれば足り、この機能を実現するためにどのような機能ブロックを用いるのかは特に図5の例に限定されない。

また、1つの機能ブロックは、ハードウェア単体で構成してもよいし、ソフトウェア単体で構成してもよいし、それらの組み合わせで構成してもよい。

The series of processes described above can be executed by hardware or can be executed by software.

In other words, the functional configuration of FIG. 5 is merely an example, and is not particularly limited. That is, it is sufficient that the

In addition, one functional block may be constituted by hardware alone, software alone, or a combination thereof.

つまり、運転評価システム1の機能構成は、全体として、図5に示す機能が実現されていれば、いずれの装置が各機能を備えるかは、図5の例に限定されず、情報表示装置200が運転評価処理部152、撮影制御部153、乗車判定部154あるいは出力制御部155等の機能の一部または全部を備えること等が可能である。

即ち、上述の実施形態では、計測装置100が、センサ部116と、運転評価処理部152とを備え、運転評価処理部152は、センサ部116によって計測された物理量に基づいて、運転者の状態に関する評価を行うこととしたが、これに限られない。例えば、計測装置100はセンサ部116のみを有し、センサ部116によって計測された物理量の情報を情報表示装置200に送信することとしてもよい。そして、情報表示装置200は、その送信された物理量の情報を取得し、取得した物理量の情報に基づいて運転者の状態に関する評価を行うこととしてよい。このように、ライダーの物理量については、運転評価処理部152を備える装置が直接計測して取得したり、他の装置によって計測したものを運転評価処理部152を備える装置が通信等を介して取得したりすることができる。

That is, as for the functional configuration of the driving

That is, in the above-described embodiment, the

一連の処理をソフトウェアにより実行させる場合には、そのソフトウェアを構成するプログラムが、コンピュータ等にネットワークや記録媒体からインストールされる。

コンピュータは、専用のハードウェアに組み込まれているコンピュータであってもよい。また、コンピュータは、各種のプログラムをインストールすることで、各種の機能を実行することが可能なコンピュータ、例えば汎用のパーソナルコンピュータであってもよい。

When a series of processing is executed by software, a program constituting the software is installed on a computer or the like from a network or a recording medium.

The computer may be a computer incorporated in dedicated hardware. The computer may be a computer capable of executing various functions by installing various programs, for example, a general-purpose personal computer.

このようなプログラムを含む記録媒体は、ユーザにプログラムを提供するために装置本体とは別に配布される図3のリムーバブルメディア231により構成されるだけでなく、装置本体に予め組み込まれた状態でユーザに提供される記録媒体等で構成される。リムーバブルメディア231は、例えば、磁気ディスク(フロッピディスクを含む)、光ディスク、または光磁気ディスク等により構成される。光ディスクは、例えば、CD−ROM(Compact Disk−Read Only Memory),DVD(Digital Versatile Disk),Blu−ray(登録商標) Disc(ブルーレイディスク)等により構成される。光磁気ディスクは、MD(Mini−Disk)等により構成される。また、装置本体に予め組み込まれた状態でユーザに提供される記録媒体は、例えば、プログラムが記録されている図2のROM112や図3のROM212、図2の記憶部119に含まれる半導体メモリや図3の記憶部219に含まれるハードディスク等で構成される。

The recording medium including such a program is not only constituted by the

なお、本明細書において、記録媒体に記録されるプログラムを記述するステップは、その順序に沿って時系列的に行われる処理はもちろん、必ずしも時系列的に処理されなくとも、並列的あるいは個別に実行される処理をも含むものである。

また、本明細書において、システムの用語は、複数の装置や複数の手段等より構成される全体的な装置を意味するものとする。

In the present specification, the step of describing the program recorded on the recording medium is not limited to the processing performed in chronological order according to the order, but is not necessarily performed in chronological order, either in parallel or individually. The process to be executed is also included.

Further, in the present specification, the term “system” means an overall apparatus configured by a plurality of devices, a plurality of means, and the like.

以上、本発明のいくつかの実施形態について説明したが、これらの実施形態は、例示に過ぎず、本発明の技術的範囲を限定するものではない。本発明はその他の様々な実施形態を取ることが可能であり、さらに、本発明の要旨を逸脱しない範囲で、省略や置換等種々の変更を行うことができる。これら実施形態やその変形は、本明細書等に記載された発明の範囲や要旨に含まれるとともに、特許請求の範囲に記載された発明とその均等の範囲に含まれる。 As mentioned above, although several embodiment of this invention was described, these embodiment is only an illustration and does not limit the technical scope of this invention. The present invention can take other various embodiments, and various modifications such as omission and replacement can be made without departing from the gist of the present invention. These embodiments and modifications thereof are included in the scope and gist of the invention described in this specification and the like, and are included in the invention described in the claims and the equivalent scope thereof.

以下に、本願の出願当初の特許請求の範囲に記載された発明を付記する。

[付記1]

自転車に乗車している際のユーザの物理量を取得する取得手段と、

前記取得手段により取得された前記物理量に基づいて、前記ユーザが自転車に乗車している際のユーザの乗車姿勢の評価を行う評価処理手段と、

を備えることを特徴とする乗車姿勢評価装置。

[付記2]

前記評価処理手段は、前記取得手段により取得された所定種類の乗車姿勢のときのユーザの前記物理量と、評価基準となる前記所定種類の乗車姿勢の物理量と、の比較に基づいて、前記ユーザの乗車姿勢の評価を行うことを特徴とする付記1に記載の乗車姿勢評価装置。

[付記3]

前記取得手段は、前記物理量として、前記ユーザの鉛直方向、進行方向の前後方向及び左右方向それぞれの加速度を取得し、

前記評価処理手段は、前記鉛直方向、前記進行方向の前後方向及び前記左右方向それぞれの加速度の変化に基づいて、前記ユーザの乗車姿勢の種類を判定することを特徴とする付記1または2に記載の乗車姿勢評価装置。

[付記4]

前記評価処理手段は、前記鉛直方向、前記進行方向の前後方向及び前記左右方向それぞれの加速度の比及び加速度の絶対値の少なくともいずれかひとつに基づいて、前記ユーザの乗車姿勢の種類を判定することを特徴とする付記3に記載の乗車姿勢評価装置。

[付記5]

前記乗車姿勢評価装置の位置情報を取得する位置情報取得手段を備え、

前記評価処理手段は、前記加速度及び前記位置情報に基づいて、前記ユーザの乗車姿勢の種類を判定することを特徴とする付記3または4に記載の乗車姿勢評価装置。

[付記6]

自転車に乗車している際のユーザの物理量を取得する取得ステップと、

前記取得ステップにおいて取得された前記物理量に基づいて、前記ユーザが自転車に乗車している際のユーザの乗車姿勢の評価を行う評価処理ステップと、

を含むことを特徴とする乗車姿勢評価方法。

[付記7]

自転車に乗車している際のユーザの乗車姿勢の評価を行う乗車姿勢評価装置を制御するコンピュータに、

自転車に乗車している際のユーザの物理量を取得する取得機能と、

前記取得機能により取得された前記物理量に基づいて、前記ユーザが自転車に乗車している際のユーザの乗車姿勢の評価を行う評価処理機能と、

を実現させることを特徴とするプログラム。

The invention described in the scope of claims at the beginning of the filing of the present application will be appended.

[Appendix 1]

Acquisition means for acquiring a physical quantity of the user when riding a bicycle;

Evaluation processing means for evaluating the user's riding posture when the user is riding a bicycle based on the physical quantity acquired by the acquiring means;

A riding posture evaluation device comprising:

[Appendix 2]

The evaluation processing means is based on a comparison between the physical quantity of the user at the predetermined type of boarding posture acquired by the acquiring means and the physical quantity of the predetermined type of boarding posture as an evaluation reference. The boarding posture evaluation apparatus according to

[Appendix 3]

The acquisition means acquires the acceleration in the vertical direction of the user, the front-rear direction and the left-right direction of the traveling direction as the physical quantity,

The

[Appendix 4]

The evaluation processing means determines the type of riding posture of the user based on at least one of an acceleration ratio and an absolute value of acceleration in the vertical direction, the front-rear direction and the left-right direction of the traveling direction. The riding posture evaluation apparatus according to supplementary note 3, characterized by:

[Appendix 5]

Position information acquisition means for acquiring position information of the riding posture evaluation device,

The riding posture evaluation apparatus according to appendix 3 or 4, wherein the evaluation processing means determines the type of the riding posture of the user based on the acceleration and the position information.

[Appendix 6]

An acquisition step of acquiring a physical quantity of the user when riding the bicycle;

Based on the physical quantity acquired in the acquisition step, an evaluation processing step for evaluating a user's riding posture when the user is riding a bicycle;

A riding posture evaluation method comprising:

[Appendix 7]

A computer that controls a riding posture evaluation device that evaluates the riding posture of a user when riding a bicycle,

An acquisition function that acquires the physical quantity of the user when riding a bicycle,

Based on the physical quantity acquired by the acquisition function, an evaluation processing function for evaluating the user's riding posture when the user is riding a bicycle;

A program characterized by realizing.

1・・・運転評価システム,100・・・計測装置,200・・・情報表示装置,300・・・撮像装置,111、211、311・・・CPU,112、212、312・・・ROM,113、213、313・・・RAM,114、214、314・・・バス,115、215、315・・・入出力インターフェース,116・・・センサ部,216・・・撮像部,117、217・・・入力部,118、218・・・出力部,119、219、317・・・記憶部,120、220、318・・・通信部,221・・・ドライブ,231・・・リムーバブルメディア,151・・・センサ情報取得部,152・・・運転評価処理部,153・・・撮影制御部,154・・・乗車判定部,155・・・出力制御部,171・・・評価情報記憶部,251・・・表示情報受信部,252・・・表示制御部,351・・・撮影トリガ信号受信部,352・・・撮影パラメータ設定部,353・・・撮像制御部,354・・・記憶制御部,371・・・画像記憶部

DESCRIPTION OF

Claims (7)

前記取得手段により取得された前記物理量に基づいて、前記ユーザが自転車に乗車している際のユーザの乗車姿勢の評価を行う評価処理手段と、

を備えることを特徴とする乗車姿勢評価装置。 Acquisition means for acquiring a physical quantity of the user when riding a bicycle;

Evaluation processing means for evaluating the user's riding posture when the user is riding a bicycle based on the physical quantity acquired by the acquiring means;

A riding posture evaluation device comprising:

前記評価処理手段は、前記鉛直方向、前記進行方向の前後方向及び前記左右方向それぞれの加速度の変化に基づいて、前記ユーザの乗車姿勢の種類を判定することを特徴とする請求項1または2に記載の乗車姿勢評価装置。 The acquisition means acquires the acceleration in the vertical direction of the user, the front-rear direction and the left-right direction of the traveling direction as the physical quantity,

The said evaluation process means determines the kind of said user's boarding attitude | position based on the change of the acceleration of the said vertical direction, the front-back direction of the said advancing direction, and the said left-right direction, respectively. The described riding posture evaluation apparatus.

前記評価処理手段は、前記加速度及び前記位置情報に基づいて、前記ユーザの乗車姿勢の種類を判定することを特徴とする請求項3または4に記載の乗車姿勢評価装置。 Position information acquisition means for acquiring position information of the riding posture evaluation device,

5. The riding posture evaluation apparatus according to claim 3, wherein the evaluation processing unit determines a type of a riding posture of the user based on the acceleration and the position information.

前記取得ステップにおいて取得された前記物理量に基づいて、前記ユーザが自転車に乗車している際のユーザの乗車姿勢の評価を行う評価処理ステップと、

を含むことを特徴とする乗車姿勢評価方法。 An acquisition step of acquiring a physical quantity of the user when riding the bicycle;

Based on the physical quantity acquired in the acquisition step, an evaluation processing step for evaluating a user's riding posture when the user is riding a bicycle;

A riding posture evaluation method comprising:

自転車に乗車している際のユーザの物理量を取得する取得機能と、

前記取得機能により取得された前記物理量に基づいて、前記ユーザが自転車に乗車している際のユーザの乗車姿勢の評価を行う評価処理機能と、

を実現させることを特徴とするプログラム。 A computer that controls a riding posture evaluation device that evaluates the riding posture of a user when riding a bicycle,

An acquisition function that acquires the physical quantity of the user when riding a bicycle,

Based on the physical quantity acquired by the acquisition function, an evaluation processing function for evaluating the user's riding posture when the user is riding a bicycle;

A program characterized by realizing.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2015038859A JP2016158780A (en) | 2015-02-27 | 2015-02-27 | Riding attitude evaluation device, riding attitude evaluation method, and program |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2015038859A JP2016158780A (en) | 2015-02-27 | 2015-02-27 | Riding attitude evaluation device, riding attitude evaluation method, and program |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| JP2016158780A true JP2016158780A (en) | 2016-09-05 |

| JP2016158780A5 JP2016158780A5 (en) | 2018-04-05 |

Family

ID=56845927

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2015038859A Pending JP2016158780A (en) | 2015-02-27 | 2015-02-27 | Riding attitude evaluation device, riding attitude evaluation method, and program |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2016158780A (en) |

Cited By (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2016179718A (en) * | 2015-03-23 | 2016-10-13 | カシオ計算機株式会社 | Kinetic motion measuring apparatus, kinetic motion measuring method and program |

| JP2018057527A (en) * | 2016-10-04 | 2018-04-12 | 日本電信電話株式会社 | Posture estimation device, method and program |

| JP2018201723A (en) * | 2017-05-31 | 2018-12-27 | 地方独立行政法人東京都立産業技術研究センター | Personal trainer suit, posture measurement device, posture measurement method and training shirt |

| EP3438607A1 (en) | 2017-08-03 | 2019-02-06 | Casio Computer Co., Ltd. | Track estimation device, method for estimating track and track estimation program |

| JP2019170397A (en) * | 2019-07-16 | 2019-10-10 | Nttテクノクロス株式会社 | Behavior identification device, behavior identification method and program |

| US10870038B2 (en) | 2017-08-03 | 2020-12-22 | Casio Computer Co., Ltd. | Activity recording data processing apparatus |

| US11123606B2 (en) | 2017-08-03 | 2021-09-21 | Casio Computer Co., Ltd. | Activity state analyzer to analyze activity state during cycling |

| WO2023132430A1 (en) * | 2022-01-10 | 2023-07-13 | (주)신티에스 | Method and device for providing cycle-related information |

Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2012056558A1 (en) * | 2010-10-29 | 2012-05-03 | パイオニア株式会社 | Pedaling target setting device, pedaling target setting method, pedaling target setting program, and medium that records pedaling target setting program |

| JP2013172359A (en) * | 2012-02-22 | 2013-09-02 | Zenrin Datacom Co Ltd | Portable terminal device, operation control method of portable terminal device, and operation control program of portable terminal device |

| JP2014045783A (en) * | 2012-08-29 | 2014-03-17 | Casio Comput Co Ltd | Exercise state notification system, exercise state notification method, and exercise state notification program |

| JP2015002964A (en) * | 2013-05-20 | 2015-01-08 | セイコーインスツル株式会社 | Exercise form analyzer and exercise form analysis method |

| JP2015012486A (en) * | 2013-06-28 | 2015-01-19 | 株式会社ニコン | Imaging device, control program, and electronic apparatus |

| WO2016035884A1 (en) * | 2014-09-04 | 2016-03-10 | レモネード ラブ インク | Information terminal device, motion capture system, and motion capture method |

-

2015

- 2015-02-27 JP JP2015038859A patent/JP2016158780A/en active Pending

Patent Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| WO2012056558A1 (en) * | 2010-10-29 | 2012-05-03 | パイオニア株式会社 | Pedaling target setting device, pedaling target setting method, pedaling target setting program, and medium that records pedaling target setting program |

| JP2013172359A (en) * | 2012-02-22 | 2013-09-02 | Zenrin Datacom Co Ltd | Portable terminal device, operation control method of portable terminal device, and operation control program of portable terminal device |

| JP2014045783A (en) * | 2012-08-29 | 2014-03-17 | Casio Comput Co Ltd | Exercise state notification system, exercise state notification method, and exercise state notification program |

| JP2015002964A (en) * | 2013-05-20 | 2015-01-08 | セイコーインスツル株式会社 | Exercise form analyzer and exercise form analysis method |

| JP2015012486A (en) * | 2013-06-28 | 2015-01-19 | 株式会社ニコン | Imaging device, control program, and electronic apparatus |

| WO2016035884A1 (en) * | 2014-09-04 | 2016-03-10 | レモネード ラブ インク | Information terminal device, motion capture system, and motion capture method |

Cited By (11)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2016179718A (en) * | 2015-03-23 | 2016-10-13 | カシオ計算機株式会社 | Kinetic motion measuring apparatus, kinetic motion measuring method and program |

| JP2018057527A (en) * | 2016-10-04 | 2018-04-12 | 日本電信電話株式会社 | Posture estimation device, method and program |

| JP2018201723A (en) * | 2017-05-31 | 2018-12-27 | 地方独立行政法人東京都立産業技術研究センター | Personal trainer suit, posture measurement device, posture measurement method and training shirt |

| EP3438607A1 (en) | 2017-08-03 | 2019-02-06 | Casio Computer Co., Ltd. | Track estimation device, method for estimating track and track estimation program |

| US10870038B2 (en) | 2017-08-03 | 2020-12-22 | Casio Computer Co., Ltd. | Activity recording data processing apparatus |

| US10881906B2 (en) | 2017-08-03 | 2021-01-05 | Casio Computer Co., Ltd. | Track estimation device |

| US11123606B2 (en) | 2017-08-03 | 2021-09-21 | Casio Computer Co., Ltd. | Activity state analyzer to analyze activity state during cycling |

| JP2019170397A (en) * | 2019-07-16 | 2019-10-10 | Nttテクノクロス株式会社 | Behavior identification device, behavior identification method and program |

| WO2023132430A1 (en) * | 2022-01-10 | 2023-07-13 | (주)신티에스 | Method and device for providing cycle-related information |

| KR20230109189A (en) * | 2022-01-10 | 2023-07-20 | (주)신티에스 | Method and device for providing cycle-related information |

| KR102595008B1 (en) * | 2022-01-10 | 2023-11-01 | (주)신티에스 | Method and device for providing cycle-related information |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| JP2016119624A (en) | Photographing system, photographing control device, photographing control method, and program | |

| JP2016158780A (en) | Riding attitude evaluation device, riding attitude evaluation method, and program | |

| RU2638353C2 (en) | Method and device for recommending bicycle gearshift | |

| KR101503761B1 (en) | Information processing apparatus, information processing method, and recording medium, for displaying information of object | |

| US10648997B2 (en) | Rotation rate detecting apparatus and rotation rate detecting method | |

| KR101256320B1 (en) | A playback display device, an image capturing device, a playback display method and a computer readable storage medium | |

| CN109120844B (en) | Image pickup control device, image pickup control method, and storage medium | |

| JP7215515B2 (en) | Analysis device, analysis method and program | |

| JP2018085575A (en) | Image processing apparatus, analysis system, image processing method, and program | |

| KR102049506B1 (en) | VR motion support device equipped with IoT sensor | |

| JP2022140458A (en) | Information processing device, information processing method, and program | |

| JP5459077B2 (en) | Digital camera | |

| JP6798473B2 (en) | Electronics, evaluation methods and programs | |

| CN108234739B (en) | Information processing apparatus, movement trajectory information output method, and recording medium | |

| JP6380634B2 (en) | Image reproducing apparatus, image reproducing method and program | |

| JP2021102075A (en) | Output device, output method, and program | |

| JP6914480B2 (en) | Indicator display device, indicator display method, program, and indicator display system | |

| JP2016179718A (en) | Kinetic motion measuring apparatus, kinetic motion measuring method and program | |

| JP6939001B2 (en) | Information processing equipment, information processing methods and programs | |

| JP7069662B2 (en) | Electronic devices, evaluation methods and programs | |

| JP2021165763A (en) | Information processor, method for information processing, and program | |

| JP2017161458A (en) | Measuring device, measuring method, and program | |

| JP6787072B2 (en) | Image processing equipment, analysis system, image processing method and program | |

| KR20210066046A (en) | Exercise support device using IoT sensor | |

| JP6981518B2 (en) | Electronics, evaluation methods and programs |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20180221 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20180221 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20181227 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20190108 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20190121 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20190604 |

|

| A02 | Decision of refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A02 Effective date: 20191203 |