JP2013132046A - Video decoder, video decoding method, video decoding program, receiver, receiving method, and receiving program - Google Patents

Video decoder, video decoding method, video decoding program, receiver, receiving method, and receiving program Download PDFInfo

- Publication number

- JP2013132046A JP2013132046A JP2012254949A JP2012254949A JP2013132046A JP 2013132046 A JP2013132046 A JP 2013132046A JP 2012254949 A JP2012254949 A JP 2012254949A JP 2012254949 A JP2012254949 A JP 2012254949A JP 2013132046 A JP2013132046 A JP 2013132046A

- Authority

- JP

- Japan

- Prior art keywords

- prediction

- motion vector

- decoded

- decoding

- inter

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Abstract

Description

本発明は、動画像復号技術に関し、特に動き補償予測を利用した動画像復号技術に関する。 The present invention relates to a moving picture decoding technique, and more particularly to a moving picture decoding technique using motion compensated prediction.

動画像の圧縮符号化方式の代表的なものとして、MPEG−4 AVC/H.264の規格がある。MPEG−4 AVC/H.264では、ピクチャを複数の矩形ブロックに分割し、すでに符号化・復号したピクチャを参照ピクチャとし、参照ピクチャからの動きを予測する動き補償が用いられている。この動き補償により動きを予測する手法をインター予測と呼ぶ。MPEG−4 AVC/H.264でのインター予測では、複数のピクチャを参照ピクチャとして用いることができ、これらの複数の参照ピクチャから最も適した参照ピクチャをブロック毎に選択して動き補償を行う。そこで、それぞれの参照ピクチャには参照インデックスが割り当てられ、この参照インデックスにより、参照ピクチャを特定する。なお、Bピクチャでは、符号化・復号済みの参照ピクチャから最大で2枚を選択してインター予測に用いることができる。それらの2枚の参照ピクチャからの予測をL0予測(リスト0予測)、L1予測(リスト1予測)として区別している。

As a typical moving image compression encoding method, MPEG-4 AVC / H. There are H.264 standards. MPEG-4 AVC / H. In H.264, motion compensation is used in which a picture is divided into a plurality of rectangular blocks, a picture that has already been encoded / decoded is used as a reference picture, and motion from the reference picture is predicted. A technique for predicting motion by this motion compensation is called inter prediction. MPEG-4 AVC / H. In the inter prediction in H.264, a plurality of pictures can be used as reference pictures, and the most suitable reference picture is selected for each block from the plurality of reference pictures to perform motion compensation. Therefore, a reference index is assigned to each reference picture, and the reference picture is specified by this reference index. Note that, for B pictures, a maximum of two reference pictures that have been encoded and decoded can be selected and used for inter prediction. The predictions from these two reference pictures are distinguished as L0 prediction (

さらに、L0予測とL1予測の2つのインター予測を同時に用いる双予測も定義されている。双予測の場合は、双方向の予測を行い、L0予測、L1予測のそれぞれのインター予測された信号に重み付け係数を掛け算し、オフセット値を加算して重畳し、最終的なインター予測画像信号を生成する。重み付け予測に用いる重み付け係数及びオフセット値はピクチャ単位で各リストの参照ピクチャ毎に代表的な値が設定され、符号化される。インター予測に関する符号化情報には、ブロック毎に、L0予測とL1予測、双予測を区別する予測モード、ブロック毎の参照リスト毎に、参照ピクチャを特定する参照インデックス、ブロックの移動方向・移動量を表す動きベクトルがあり、これらの符号化情報を符号化・復号する。すなわち、L0予測、L1予測は1つの参照インデックスと1つの動きベクトルをインター予測情報として持ち、双予測は2つの参照インデックスと2つの動きベクトルをインター予測情報として持つ。 Furthermore, bi-prediction using two inter predictions of L0 prediction and L1 prediction at the same time is also defined. In the case of bi-prediction, bi-directional prediction is performed, the inter-predicted signals of L0 prediction and L1 prediction are multiplied by a weighting coefficient, an offset value is added and superimposed, and a final inter-predicted image signal is obtained. Generate. As weighting coefficients and offset values used for weighted prediction, representative values are set for each reference picture in each list and encoded. The encoding information related to inter prediction includes, for each block, a prediction mode for distinguishing between L0 prediction and L1 prediction and bi-prediction, a reference index for specifying a reference picture for each reference list for each block, and a moving direction and a moving amount of the block. There is a motion vector that expresses and encodes and decodes the encoded information. That is, L0 prediction and L1 prediction have one reference index and one motion vector as inter prediction information, and bi-prediction has two reference indexes and two motion vectors as inter prediction information.

動き補償を行う動画像符号化方式では、各ブロックで生成される動きベクトルの符号量を削減する為に、動きベクトルに対して予測処理が行われる。MPEG−4 AVC/H.264では、符号化対象の動きベクトルが周囲の近接ブロックの動きベクトルと強い相関があることを利用して、周囲の近接ブロックからの予測を行うことにより予測動きベクトルを算出し、符号化対象の動きベクトルと予測動きベクトルとの差分である差分動きベクトルを算出し、その差分動きベクトルを符号化することによって符号量を削減している。L0予測、L1予測は1つの参照インデックスと1つの差分動きベクトルをインター予測情報として符号化または復号し、双予測は2つの参照インデックスと2つの差分動きベクトルをインター予測情報として符号化または復号する。 In a moving picture coding system that performs motion compensation, a prediction process is performed on a motion vector in order to reduce the amount of code of the motion vector generated in each block. MPEG-4 AVC / H. In H.264, using the fact that the motion vector of the encoding target has a strong correlation with the motion vector of the neighboring neighboring block, the prediction motion vector is calculated by performing prediction from the neighboring neighboring block, and the encoding target motion vector is calculated. A difference motion vector that is a difference between the motion vector and the predicted motion vector is calculated, and the difference motion vector is encoded to reduce the amount of codes. L0 prediction and L1 prediction encode or decode one reference index and one differential motion vector as inter prediction information, and bi-prediction encodes or decodes two reference indexes and two differential motion vectors as inter prediction information. .

具体的には、図41(a)に示されるように、周囲の近接ブロックA,B,Cの動きベクトルから中央値を算出して予測動きベクトルとし、動きベクトルとその予測動きベクトルとの差分をとることで動きベクトルの符号量を削減している。但し、図41(b)のように符号化対象ブロックと近接ブロックの大きさや形状が異なる場合は、左隣に複数の近接ブロックがある時はその中の一番上のブロックを、上に複数の近接ブロックがある時はその中の一番左のブロックを予測ブロックとし、決定された予測ブロックの動きベクトルから予測を実施する。 Specifically, as shown in FIG. 41 (a), the median is calculated from the motion vectors of the neighboring blocks A, B, and C and is used as a predicted motion vector, and the difference between the motion vector and the predicted motion vector is calculated. By taking this, the amount of code of the motion vector is reduced. However, if the size and shape of the encoding target block and the neighboring block are different as shown in FIG. 41 (b), if there are multiple neighboring blocks on the left, When there is a neighboring block, the leftmost block is used as a prediction block, and prediction is performed from the motion vector of the determined prediction block.

しかし、従来の方法では、双予測は2つの参照インデックスと2つの差分動きベクトルをインター予測情報として符号化または復号するため、符号化効率が良くならない場合もあった。 However, in the conventional method, since bi-prediction encodes or decodes two reference indexes and two differential motion vectors as inter prediction information, the encoding efficiency may not be improved.

このような状況下、本発明者らは、動き補償予測を使用する動画像符号化方式において、符号化情報をより一層圧縮し、全体の符号量を削減する必要性を認識するに至った。 Under such circumstances, the present inventors have come to recognize the necessity of further compressing the encoded information and reducing the overall code amount in the moving image encoding method using motion compensation prediction.

本発明はこうした状況に鑑みてなされたものであり、その目的は、参照インデックス、または差分動きベクトルの符号量の削減を図って符号化効率を向上させる動画像復号技術を提供することにある。 The present invention has been made in view of such circumstances, and an object of the present invention is to provide a moving picture decoding technique that improves the coding efficiency by reducing the code amount of a reference index or a differential motion vector.

上記課題を解決するために、本発明のある態様の動画像復号装置は、各ピクチャを分割した予測ブロック単位でインター予測を用いて動画像が符号化された符号化ビット列を復号する動画像復号装置であって、復号対象の予測ブロックのインター予測において参照されるべき参照ピクチャを複数の参照画像の中から特定する参照インデックスを復号すると共に、選択されるべき予測動きベクトルと前記復号対象の予測ブロックの動きベクトルとの差分動きベクトルを復号して、インター予測情報を得る復号部(202)と、複数の復号済みのブロックの符号化情報を参照して複数の予測動きベクトルの候補を導出し、前記複数の予測動きベクトルの候補の中から選択される予測動きベクトルと復号された前記差分動きベクトルとを加算して前記復号対象の予測ブロックの動きベクトルを導出する動きベクトル導出部(204)とを備える。前記復号部は、インター予測モードが第1予測と第2予測とを有する双予測である場合、スライス単位で、第1予測のインター予測情報または第2予測のインター予測情報について、前記差分動きベクトルおよび前記参照インデックスの少なくとも一つの復号を行わないモードを有する。 In order to solve the above-described problem, a moving picture decoding apparatus according to an aspect of the present invention decodes a coded bit string in which a moving picture is encoded using inter prediction in units of prediction blocks obtained by dividing each picture. An apparatus for decoding a reference index for specifying a reference picture to be referred to in inter prediction of a prediction block to be decoded from among a plurality of reference images, a prediction motion vector to be selected, and prediction of the decoding target A decoding unit (202) that obtains inter prediction information by decoding a difference motion vector with respect to a block motion vector, and deriving a plurality of motion vector predictor candidates with reference to encoding information of a plurality of decoded blocks Adding the predicted motion vector selected from the plurality of predicted motion vector candidates and the decoded difference motion vector And a motion vector derivation unit (204) for deriving a motion vector of the prediction block to be decoded. When the inter prediction mode is bi-prediction having the first prediction and the second prediction, the decoding unit performs the difference motion vector for the inter prediction information of the first prediction or the inter prediction information of the second prediction in units of slices. And a mode in which at least one decoding of the reference index is not performed.

本発明の別の態様は、動画像復号方法である。この方法は、各ピクチャを分割した予測ブロック単位でインター予測を用いて動画像が符号化された符号化ビット列を復号する動画像復号方法であって、復号対象の予測ブロックのインター予測において参照されるべき参照ピクチャを複数の参照画像の中から特定する参照インデックスを復号すると共に、選択されるべき予測動きベクトルと前記復号対象の予測ブロックの動きベクトルとの差分動きベクトルを復号して、インター予測情報を得る復号ステップと、複数の復号済みのブロックの符号化情報を参照して複数の予測動きベクトルの候補を導出し、前記複数の予測動きベクトルの候補の中から選択される予測動きベクトルと復号された前記差分動きベクトルとを加算して前記復号対象の予測ブロックの動きベクトルを導出する動きベクトル導出ステップとを備える。前記復号ステップは、インター予測モードが第1予測と第2予測とを有する双予測である場合、スライス単位で、第1予測のインター予測情報または第2予測のインター予測情報について、前記差分動きベクトルおよび前記参照インデックスの少なくとも一つの復号を行わないモードを有する。 Another aspect of the present invention is a video decoding method. This method is a moving picture decoding method for decoding a coded bit string in which a moving picture is encoded using inter prediction in units of prediction blocks obtained by dividing each picture, and is referred to in inter prediction of a prediction block to be decoded. Inter-prediction is performed by decoding a reference index for specifying a reference picture to be selected from a plurality of reference images, and decoding a difference motion vector between a prediction motion vector to be selected and a motion vector of the prediction block to be decoded. A decoding step of obtaining information, deriving a plurality of prediction motion vector candidates with reference to encoding information of a plurality of decoded blocks, and a prediction motion vector selected from the plurality of prediction motion vector candidates; A motion vector for deriving a motion vector of the prediction block to be decoded by adding the decoded differential motion vector. And a torque derivation step. When the inter prediction mode is bi-prediction having the first prediction and the second prediction, the decoding step performs the difference motion vector for the inter prediction information of the first prediction or the inter prediction information of the second prediction in units of slices. And a mode in which at least one decoding of the reference index is not performed.

本発明のさらに別の態様は、受信装置である。この装置は、動画像が符号化された符号化ビット列を受信して復号する受信装置であって、各ピクチャを分割したブロック単位でインター予測を用いて動画像が符号化された符号化ビット列がパケット化された符号化データを受信する受信部と、受信された前記符号化データをパケット処理して元の符号化ビット列を復元する復元部と、復元された符号化ビット列から、復号対象の予測ブロックのインター予測において参照されるべき参照ピクチャを複数の参照画像の中から特定する参照インデックスを復号すると共に、選択されるべき予測動きベクトルと前記復号対象の予測ブロックの動きベクトルとの差分動きベクトルを復号して、インター予測情報を得る復号部(202)と、複数の復号済みのブロックの符号化情報を参照して複数の予測動きベクトルの候補を導出し、前記複数の予測動きベクトルの候補の中から選択される予測動きベクトルと復号された前記差分動きベクトルとを加算して前記復号対象の予測ブロックの動きベクトルを導出する動きベクトル導出部(204)とを備える。前記復号部は、インター予測モードが第1予測と第2予測とを有する双予測である場合、スライス単位で、第1予測のインター予測情報または第2予測のインター予測情報について、前記差分動きベクトルおよび前記参照インデックスの少なくとも一つの復号を行わないモードを有する。 Yet another embodiment of the present invention is a receiving device. This apparatus is a receiving apparatus that receives and decodes an encoded bit string in which a moving image is encoded, and an encoded bit sequence in which the moving image is encoded using inter prediction in units of blocks obtained by dividing each picture. A receiving unit that receives packetized encoded data, a restoration unit that performs packet processing on the received encoded data to restore the original encoded bit sequence, and predicts a decoding target from the restored encoded bit sequence A reference index for specifying a reference picture to be referred to in inter prediction of a block from among a plurality of reference images is decoded, and a difference motion vector between a prediction motion vector to be selected and a motion vector of the prediction block to be decoded And a decoding unit (202) that obtains inter prediction information and a plurality of decoded blocks with reference to the encoded information. A motion vector predictor candidate is derived, and a motion vector of the prediction block to be decoded is derived by adding a motion vector predictor selected from the plurality of motion vector predictor candidates and the decoded differential motion vector. A motion vector deriving unit (204). When the inter prediction mode is bi-prediction having the first prediction and the second prediction, the decoding unit performs the difference motion vector for the inter prediction information of the first prediction or the inter prediction information of the second prediction in units of slices. And a mode in which at least one decoding of the reference index is not performed.

本発明のさらに別の態様は、受信方法である。この方法は、動画像が符号化された符号化ビット列を受信して復号する受信方法であって、各ピクチャを分割したブロック単位でインター予測を用いて動画像が符号化された符号化ビット列がパケット化された符号化データを受信する受信ステップと、受信された前記符号化データをパケット処理して元の符号化ビット列を復元する復元ステップと、復元された符号化ビット列から、復号対象の予測ブロックのインター予測において参照されるべき参照ピクチャを複数の参照画像の中から特定する参照インデックスを復号すると共に、選択されるべき予測動きベクトルと前記復号対象の予測ブロックの動きベクトルとの差分動きベクトルを復号して、インター予測情報を得る復号ステップと、複数の復号済みのブロックの符号化情報を参照して複数の予測動きベクトルの候補を導出し、前記複数の予測動きベクトルの候補の中から選択される予測動きベクトルと復号された前記差分動きベクトルとを加算して前記復号対象の予測ブロックの動きベクトルを導出する動きベクトル導出ステップとを備える。前記復号ステップは、インター予測モードが第1予測と第2予測とを有する双予測である場合、スライス単位で、第1予測のインター予測情報または第2予測のインター予測情報について、前記差分動きベクトルおよび前記参照インデックスの少なくとも一つの復号を行わないモードを有する。 Yet another embodiment of the present invention is a reception method. This method is a reception method for receiving and decoding a coded bit sequence in which a moving image is encoded, and an encoded bit sequence in which a moving image is encoded using inter prediction in units of blocks obtained by dividing each picture. A reception step for receiving packetized encoded data, a restoration step for packetizing the received encoded data to restore the original encoded bit sequence, and prediction of a decoding target from the restored encoded bit sequence A reference index for specifying a reference picture to be referred to in inter prediction of a block from among a plurality of reference images is decoded, and a difference motion vector between a prediction motion vector to be selected and a motion vector of the prediction block to be decoded Decoding step to obtain inter prediction information and encoding information of a plurality of decoded blocks. Deriving a plurality of motion vector predictor candidates, adding a motion vector predictor selected from the motion vector predictor candidates and the decoded motion vector difference, and a motion vector of the prediction block to be decoded A motion vector deriving step for deriving. When the inter prediction mode is bi-prediction having the first prediction and the second prediction, the decoding step performs the difference motion vector for the inter prediction information of the first prediction or the inter prediction information of the second prediction in units of slices. And a mode in which at least one decoding of the reference index is not performed.

なお、以上の構成要素の任意の組合せ、本発明の表現を方法、装置、システム、記録媒体、コンピュータプログラムなどの間で変換したものもまた、本発明の態様として有効である。 It should be noted that any combination of the above-described constituent elements and a conversion of the expression of the present invention between a method, an apparatus, a system, a recording medium, a computer program, etc. are also effective as an aspect of the present invention.

本発明によれば、複数の予測動きベクトルを算出し、それら複数の予測動きベクトルの中から最適な予測動きベクトルを選択し、差分動きベクトルの発生符号量を削減させて、符号化効率を向上させることができる。 According to the present invention, a plurality of prediction motion vectors are calculated, an optimal prediction motion vector is selected from the plurality of prediction motion vectors, and the amount of generated code of the difference motion vector is reduced, thereby improving the encoding efficiency. Can be made.

本実施の形態では、動画像の符号化に関し、特にピクチャを任意のサイズ、形状の矩形ブロックに分割し、ピクチャ間でブロック単位に動き補償を行う動画像符号化における符号化効率を向上させる為に、符号化済みの周囲のブロックの動きベクトルから複数の予測動きベクトルを算出し、符号化対象のブロックの動きベクトルと選択された予測動きベクトルとの差分ベクトルを算出して符号化することによって符号量を削減する。あるいは、符号化済みの周囲のブロックの符号化情報を利用することにより、符号化対象ブロックの符号化情報を推定することによって符号量を削減する。また、動画像の復号の場合は、復号済みの周囲のブロックの動きベクトルから複数の予測動きベクトルを算出し、符号化ストリームから復号された差分ベクトルと選択された予測動きベクトルとから復号対象のブロックの動きベクトルを算出して復号する。あるいは、復号済みの周囲のブロックの符号化情報を利用することにより、復号対象ブロックの符号化情報を推定する。 In the present embodiment, with regard to moving picture coding, in particular, to improve coding efficiency in moving picture coding in which a picture is divided into rectangular blocks of an arbitrary size and shape and motion compensation is performed in units of blocks between pictures. In addition, by calculating a plurality of predicted motion vectors from the motion vectors of the surrounding blocks that have been encoded, and calculating and encoding a difference vector between the motion vector of the block to be encoded and the selected predicted motion vector Reduce the amount of code. Alternatively, the amount of code is reduced by estimating the encoding information of the encoding target block by using the encoding information of the surrounding blocks that have already been encoded. Also, in the case of decoding a moving image, a plurality of predicted motion vectors are calculated from the motion vectors of the peripheral blocks that have been decoded, and a decoding target is calculated from the difference vector decoded from the encoded stream and the selected predicted motion vector. The motion vector of the block is calculated and decoded. Alternatively, the encoding information of the decoding target block is estimated by using the encoding information of the peripheral blocks that have been decoded.

まず、本実施の形態において使用する技術、及び技術用語を定義する。 First, techniques used in the present embodiment and technical terms are defined.

(ツリーブロック、符号化ブロックについて)

実施の形態では、図3に示されるように、ピクチャ内を任意の同一サイズの正方の矩形の単位にて均等分割する。この単位をツリーブロックと定義し、ピクチャ内での符号化または復号対象ブロック(符号化処理においては符号化対象ブロック、復号処理においては復号対象ブロックのことである。以下、断りのない限り、この意味で用いる。)を特定するためのアドレス管理の基本単位とする。モノクロを除きツリーブロックは1つの輝度信号と2つの色差信号で構成される。ツリーブロックのサイズはピクチャサイズやピクチャ内のテクスチャに応じて、2のべき乗のサイズで自由に設定することができる。ツリーブロックはピクチャ内のテクスチャに応じて、符号化処理を最適にすべく、必要に応じてツリーブロック内の輝度信号、及び色差信号を階層的に4分割(縦横に2分割ずつ)して、ブロックサイズの小さいブロックにすることができる。このブロックをそれぞれ符号化ブロックと定義し、符号化及び復号を行う際の処理の基本単位とする。モノクロを除き符号化ブロックも1つの輝度信号と2つの色差信号で構成される。符号化ブロックの最大サイズはツリーブロックのサイズと同一である。符号化ブロックの最小のサイズとなる符号化ブロックを最小符号化ブロックと呼び、2のべき乗のサイズで自由に設定することができる。

(About tree blocks and coding blocks)

In the embodiment, as shown in FIG. 3, the picture is equally divided into square units of any same size. This unit is defined as a tree block, and is a block to be encoded or decoded in a picture (a block to be encoded in the encoding process and a block to be decoded in the decoding process. Hereinafter, unless otherwise noted, It is used as a basic unit of address management for specifying. Except for monochrome, the tree block is composed of one luminance signal and two color difference signals. The size of the tree block can be freely set to a power of 2 depending on the picture size and the texture in the picture. In order to optimize the encoding process according to the texture in the picture, the tree block divides the luminance signal and chrominance signal in the tree block hierarchically into four parts (two parts vertically and horizontally) as necessary, The block can be made smaller in block size. Each block is defined as a coding block, and is a basic unit of processing when performing coding and decoding. Except for monochrome, the coding block is also composed of one luminance signal and two color difference signals. The maximum size of the coding block is the same as the size of the tree block. An encoded block having the minimum size of the encoded block is called a minimum encoded block, and can be freely set to a power of 2.

図3においては、符号化ブロックAは、ツリーブロックを分割せず、1つの符号化ブロックとしたものである。符号化ブロックBは、ツリーブロックを4分割してできた符号化ブロックである。符号化ブロックCは、ツリーブロックを4分割してできたブロックをさらに4分割してできた符号化ブロックである。符号化ブロックDは、ツリーブロックを4分割してできたブロックをさらに階層的に2度4分割してできた符号化ブロックであり、最小サイズの符号化ブロックである。 In FIG. 3, the encoding block A is a single encoding block without dividing the tree block. The encoding block B is an encoding block formed by dividing a tree block into four. The coding block C is a coding block obtained by further dividing the block obtained by dividing the tree block into four. The coding block D is a coding block obtained by further dividing the block obtained by dividing the tree block into four parts and further dividing the block into four twice hierarchically, and is a coding block of the minimum size.

(予測モードについて)

符号化ブロック単位で、符号化または復号済み(符号化処理においては符号化した信号を復号したピクチャ、予測ブロック、画像信号等に用い、復号処理においては復号したピクチャ、予測ブロック、画像信号等に用いる。以下、断りのない限り、この意味で用いる。以下、断りのないかぎり、この意味で用いる。)の周囲の画像信号から予測を行うイントラ予測(MODE_INTRA)、及び符号化または復号済みのピクチャの画像信号から予測を行うインター予測(MODE_INTER)を切り替える。このイントラ予測(MODE_INTRA)とインター予測(MODE_INTER)を識別するモードを予測モード(PredMode)と定義する。予測モード(PredMode)はイントラ予測(MODE_INTRA)、またはインター予測(MODE_INTER)を値として持ち、選択して符号化できる。

(About prediction mode)

Encoded or decoded in units of encoded blocks (used in encoded processing for encoded picture, predicted block, image signal, etc., and used in decoded processing for decoded picture, predicted block, image signal, etc.) The following is used in this sense unless otherwise noted, and is used in this sense unless otherwise noted.) Intra prediction (MODE_INTRA) in which prediction is performed from the surrounding image signal, and a picture that has been encoded or decoded Inter prediction (MODE_INTER) for predicting from the image signal is switched. A mode for identifying the intra prediction (MODE_INTRA) and the inter prediction (MODE_INTER) is defined as a prediction mode (PredMode). The prediction mode (PredMode) has intra prediction (MODE_INTRA) or inter prediction (MODE_INTER) as a value, and can be selected and encoded.

(分割モード、予測ブロック、予測ユニットについて)

ピクチャ内をブロックに分割してイントラ予測(MODE_INTRA)及びインター予測(MODE_INTER)を行う場合、イントラ予測及びインター予測の方法を切り替える単位をより小さくするために、必要に応じて符号化ブロックを分割して予測を行う。この符号化ブロックの輝度信号と色差信号の分割方法を識別するモードを分割モード(PartMode)と定義する。さらに、この分割されたブロックを予測ブロックと定義する。図4に示すように、符号化ブロックの輝度信号の分割方法に応じて4種類の分割モード(PartMode)を定義する。符号化ブロックの輝度信号を分割せず1つの予測ブロックとみなしたもの(図4(a))の分割モード(PartMode)を2N×2N分割(PART_2Nx2N)、符号化ブロックの輝度信号を水平方向に2分割し、2つの予測ブロックとしたもの(図4(b))の分割モード(PartMode)を2N×N分割(PART_2NxN)、符号化ブロックの輝度信号を垂直方向に分割し、符号化ブロックを2つの予測ブロックとしたもの(図4(c))の分割モード(PartMode)をN×2N分割(PART_Nx2N)、符号化ブロックの輝度信号を水平と垂直の均等分割により4つの予測ブロックとしたもの(図4(d))の分割モード(PartMode)をN×N分割(PART_NxN)とそれぞれ定義する。なお、イントラ予測(MODE_INTRA)のN×N分割(PART_NxN)を除き、各分割モード(PartMode)毎に輝度信号の縦横の分割比率と同様に色差信号も分割する。

(About split mode, prediction block, prediction unit)

When performing intra prediction (MODE_INTRA) and inter prediction (MODE_INTER) by dividing the picture into blocks, the coded block is divided as necessary to reduce the unit for switching the intra prediction and inter prediction methods. Make predictions. A mode for identifying the division method of the luminance signal and the color difference signal of the coding block is defined as a division mode (PartMode). Furthermore, this divided block is defined as a prediction block. As shown in FIG. 4, four types of partition modes (PartMode) are defined according to the method of dividing the luminance signal of the coding block. The division mode (PartMode) of what is regarded as one prediction block without dividing the luminance signal of the coding block (FIG. 4A) is 2N × 2N division (PART_2Nx2N), and the luminance signal of the coding block is horizontally The division mode (PartMode) of the two prediction blocks (FIG. 4B) is divided into 2N × N divisions (PART_2NxN), the luminance signal of the encoded block is divided in the vertical direction, and the encoded block is The division mode (PartMode) of the two prediction blocks (FIG. 4 (c)) is N × 2N division (PART_Nx2N), and the luminance signal of the encoded block is divided into four prediction blocks by horizontal and vertical equal divisions. The division mode (PartMode) of (FIG. 4D) is defined as N × N division (PART_NxN), respectively. Except for N × N division (PART_NxN) of intra prediction (MODE_INTRA), the color difference signal is also divided for each division mode (PartMode) in the same manner as the vertical / horizontal division ratio of the luminance signal.

符号化ブロック内部において、各予測ブロックを特定する為に、0から開始する番号を、符号化順序で、符号化ブロック内部に存在する予測ブロックに対して割り当てる。この番号を分割インデックスPartIdxと定義する。図4の符号化ブロックの各予測ブロックの中に記述された数字は、その予測ブロックの分割インデックスPartIdxを表す。図4(b)に示す2N×N分割(PART_2NxN)では上の予測ブロックの分割インデックスPartIdxを0とし、下の予測ブロックの分割インデックスPartIdxを1とする。図4(c)に示すN×2N分割(PART_Nx2N)では左の予測ブロックの分割インデックスPartIdxを0とし、右の予測ブロックの分割インデックスPartIdxを1とする。図4(d)に示すN×N分割(PART_NxN)では、左上の予測ブロックの分割インデックスPartIdxを0とし、右上の予測ブロックの分割インデックスPartIdxを1とし、左下の予測ブロックの分割インデックスPartIdxを2とし、右下の予測ブロックの分割インデックスPartIdxを3とする。 In order to specify each prediction block within the coding block, a number starting from 0 is assigned to the prediction block existing inside the coding block in the coding order. This number is defined as a split index PartIdx. A number described in each prediction block of the encoded block in FIG. 4 represents a partition index PartIdx of the prediction block. In the 2N × N division (PART_2NxN) shown in FIG. 4B, the division index PartIdx of the upper prediction block is set to 0, and the division index PartIdx of the lower prediction block is set to 1. In the N × 2N division (PART_Nx2N) shown in FIG. 4C, the division index PartIdx of the left prediction block is set to 0, and the division index PartIdx of the right prediction block is set to 1. In the N × N partition (PART_NxN) shown in FIG. 4D, the partition index PartIdx of the upper left prediction block is 0, the partition index PartIdx of the upper right prediction block is 1, and the partition index PartIdx of the lower left prediction block is 2. And the division index PartIdx of the prediction block at the lower right is set to 3.

予測モード(PredMode)がインター予測(MODE_INTER)では、最小の符号化ブロックである符号化ブロックD以外では、分割モード(PartMode)は2N×2N分割(PART_2Nx2N)、2N×N分割(PART_2NxN)、及びN×2N分割(PART_Nx2N)を定義し、最小の符号化ブロックである符号化ブロックDのみ、分割モード(PartMode)は2N×2N分割(PART_2Nx2N)、2N×N分割(PART_2NxN)、及びN×2N分割(PART_Nx2N)に加えてN×N分割(PART_NxN)を定義する。なお、最小の符号化ブロック以外にN×N分割(PART_NxN)を定義しない理由は最小の符号化ブロック以外では、符号化ブロックを4分割して小さな符号化ブロックを表現できるからである。 When the prediction mode (PredMode) is inter prediction (MODE_INTER), except for the coding block D which is the smallest coding block, the partition mode (PartMode) is 2N × 2N partition (PART_2Nx2N), 2N × N partition (PART_2NxN), and N × 2N partition (PART_Nx2N) is defined, and only the coding block D which is the smallest coding block, the partition mode (PartMode) is 2N × 2N partition (PART_2Nx2N), 2N × N partition (PART_2NxN), and N × 2N In addition to the division (PART_Nx2N), N × N division (PART_NxN) is defined. The reason why N × N division (PART_NxN) is not defined other than the smallest coding block is that, except for the smallest coding block, the coding block can be divided into four to represent a small coding block.

(ツリーブロック、符号化ブロック、予測ブロック、変換ブロックの位置)

本実施の形態のツリーブロック、符号化ブロック、予測ブロック、変換ブロックを始めとする各ブロックの位置は、輝度信号の画面の一番左上の輝度信号の画素の位置を原点(0,0)とし、それぞれのブロックの領域に含まれる一番左上の輝度信号の画素の位置を(x,y)の二次元座標で表す。座標軸の向きは水平方向に右の方向、垂直方向に下の方向をそれぞれ正の向きとし、単位は輝度信号の1画素単位である。輝度信号と色差信号で画像サイズ(画素数)が同じである色差フォーマットが4:4:4の場合ではもちろんのこと、輝度信号と色差信号で画像サイズ(画素数)が異なる色差フォーマットが4:2:0、4:2:2の場合でも色差信号の各ブロックの位置をそのブロックの領域に含まれる輝度信号の画素の座標で表し、単位は輝度信号の1画素である。この様にすることで、色差信号の各ブロックの位置が特定できるのはもちろんのこと、座標の値を比較するだけで、輝度信号のブロックと色差信号のブロックの位置の関係も明確となる。

(Position of tree block, coding block, prediction block, transform block)

The position of each block including the tree block, the encoding block, the prediction block, and the transform block according to the present embodiment has the position of the pixel of the luminance signal at the upper left of the luminance signal screen as the origin (0, 0). The pixel position of the upper left luminance signal included in each block area is represented by two-dimensional coordinates (x, y). The direction of the coordinate axis is a right direction in the horizontal direction and a downward direction in the vertical direction, respectively, and the unit is one pixel unit of the luminance signal. Of course, the luminance signal and the color difference signal have the same image size (number of pixels) and the color difference format is 4: 4: 4. Of course, the luminance signal and the color difference signal have a different color size format of 4: 4. Even in the case of 2: 0, 4: 2: 2, the position of each block of the color difference signal is represented by the coordinates of the pixel of the luminance signal included in the block area, and the unit is one pixel of the luminance signal. In this way, not only can the position of each block of the color difference signal be specified, but also the relationship between the positions of the luminance signal block and the color difference signal block can be clarified only by comparing the coordinate values.

(インター予測モード、参照リスト、参照インデックスについて)

本発明の実施の形態においては、符号化または復号済みのピクチャの画像信号から予測を行うインター予測では、複数の復号済みのピクチャを参照ピクチャとして用いることができる。複数の参照ピクチャからインター予測に用いる参照ピクチャを特定するため、予測ブロック毎に参照インデックスで指定する。Bスライスでは予測ブロック毎に任意の2枚の参照ピクチャを選択してインター予測(動き補償予測)することができ、インター予測モードとしてL0予測(Pred_L0)、L1予測(Pred_L1)、双予測(Pred_BI)がある。参照ピクチャはリスト構造のL0(参照リスト0)とL1(参照リスト1)で管理され、L0またはL1の参照インデックスを指定することにより参照ピクチャを特定することができる。L0予測(Pred_L0)はL0で管理されている参照ピクチャを参照して予測画像信号を生成するインター予測であり、L1予測(Pred_L1)はL1で管理されている参照ピクチャを参照して予測画像信号を生成するインター予測であり、双予測(Pred_BI)はL0予測とL1予測が共に行われ、L0とL1のそれぞれで管理されている1つずつの参照ピクチャを参照して得られるL0予測画像信号とL1予測画像信号を平均または重み付け加算して予測画像信号を生成するインター予測である。Pスライスのインター予測ではL0予測(Pred_L0)のみが使用でき、Bスライスのインター予測ではL0予測(Pred_L0)、L1予測(Pred_L1)、および双予測(Pred_BI)が使用できる。L0予測、L1予測は1つの参照インデックスと1つの動きベクトルをインター予測情報として持ち、双予測は2つの参照インデックスと2つの動きベクトルをインター予測情報として持つ。以降の処理において出力に添え字LX(Xは0または1)が付いている定数、変数に関しては、L0、L1ごとに処理が行われることを前提とする。

(Inter prediction mode, reference list, reference index)

In the embodiment of the present invention, in inter prediction in which prediction is performed from an image signal of a coded or decoded picture, a plurality of decoded pictures can be used as reference pictures. In order to specify a reference picture used for inter prediction from a plurality of reference pictures, each prediction block is designated by a reference index. In the B slice, any two reference pictures can be selected for each prediction block and inter prediction (motion compensation prediction) can be performed. As inter prediction modes, L0 prediction (Pred_L0), L1 prediction (Pred_L1), and bi-prediction (Pred_BI) ) The reference picture is managed by L0 (reference list 0) and L1 (reference list 1) of the list structure, and the reference picture can be specified by specifying the reference index of L0 or L1. The L0 prediction (Pred_L0) is inter prediction that generates a predicted image signal with reference to a reference picture managed in L0, and the L1 prediction (Pred_L1) is a predicted image signal with reference to a reference picture managed in L1. The bi-prediction (Pred_BI) is an L0 prediction image signal obtained by referring to one reference picture managed by each of L0 and L1. And L1 prediction image signals are averaged or weighted and added to generate a prediction image signal. Only L0 prediction (Pred_L0) can be used for inter prediction of P slice, and L0 prediction (Pred_L0), L1 prediction (Pred_L1), and bi-prediction (Pred_BI) can be used for inter prediction of B slice. The L0 prediction and the L1 prediction have one reference index and one motion vector as inter prediction information, and the bi-prediction has two reference indexes and two motion vectors as inter prediction information. In the subsequent processing, regarding constants and variables with subscript LX (X is 0 or 1) in the output, it is assumed that processing is performed for each of L0 and L1.

(予測動きベクトル、差分動きベクトル、予測動きベクトルインデックスについて)

本発明の実施の形態においては、各予測ブロックで生成される動きベクトルの符号量を削減する為に、動きベクトルに対して予測処理が行われる。複数の予測動きベクトルの候補を導出し、それら予測動きベクトルの候補の中から1つの予測動きベクトルを選択し、符号化または復号対象の動きベクトルと選択された予測動きベクトルとの差分である差分動きベクトルを算出する。複数の予測動きベクトルからインター予測に用いる予測動きベクトルを特定するため、予測ブロック毎に予測動きベクトルインデックスで指定する。

(About predicted motion vectors, differential motion vectors, and predicted motion vector indexes)

In the embodiment of the present invention, in order to reduce the code amount of the motion vector generated in each prediction block, a prediction process is performed on the motion vector. A plurality of motion vector predictor candidates are derived, one motion vector predictor is selected from the motion vector predictor candidates, and a difference that is a difference between the motion vector to be encoded or decoded and the selected motion vector predictor A motion vector is calculated. In order to specify a prediction motion vector used for inter prediction from a plurality of prediction motion vectors, each prediction block is designated by a prediction motion vector index.

(マージモード、マージ候補)

マージモードとは、符号化または復号対象の予測ブロックの予測モード、参照インデックス、動きベクトル等のインター予測情報を符号化または復号するのではなく、符号化または復号対象の予測ブロックと同一ピクチャ内でその符号化または復号対象の予測ブロックに近接する予測ブロック、あるいは符号化または復号対象の予測ブロックと時間的に異なる符号化または復号済みのピクチャの符号化または復号対象の予測ブロックと同一位置あるいはその付近(近傍の位置)に存在する予測ブロックのインター予測情報から符号化または復号対象の予測ブロックのインター予測情報を導出することによりインター予測を行うモードである。符号化または復号対象の予測ブロックと同一ピクチャ内でその符号化または復号対象の予測ブロックに近接する予測ブロック及びその予測ブロックのインター予測情報を空間マージ候補、符号化または復号対象の予測ブロックと時間的に異なる符号化または復号済みのピクチャの符号化または復号対象の予測ブロックと同一位置あるいはその付近(近傍の位置)に存在する予測ブロック及びその予測ブロックのインター予測情報から導出されるインター予測情報を時間マージ候補とする。それぞれのマージ候補はマージ候補リストに登録され、マージインデックスによりインター予測で用いるマージ候補を特定する。導出されるインター予測情報はインター予測モード、各参照リストの参照インデックス及び動きベクトルである。

(Merge mode, merge candidate)

In the merge mode, the prediction mode of the prediction block to be encoded or decoded, the inter prediction information such as the reference index and the motion vector is not encoded or decoded, but within the same picture as the prediction block to be encoded or decoded. The prediction block adjacent to the prediction block to be encoded or decoded, or the same position as the prediction block to be encoded or decoded of the encoded or decoded picture that is temporally different from the prediction block to be encoded or decoded. In this mode, inter prediction is performed by deriving inter prediction information of a prediction block to be encoded or decoded from inter prediction information of a prediction block existing in the vicinity (neighboring position). A prediction block close to the prediction block to be encoded or decoded in the same picture as the prediction block to be encoded or decoded and inter prediction information of the prediction block are spatial merge candidates, a prediction block to be encoded or decoded, and time Prediction information derived from a prediction block existing at the same position as or near (previously near) a prediction block to be encoded or decoded of a differently encoded or decoded picture and inter prediction information of the prediction block Are time merge candidates. Each merge candidate is registered in the merge candidate list, and the merge candidate used in the inter prediction is specified by the merge index. The derived inter prediction information includes an inter prediction mode, a reference index of each reference list, and a motion vector.

(近接する予測ブロックについて)

図5、図6、図7及び図8は符号化または復号対象の予測ブロックと同一ピクチャ内でその符号化または復号対象の予測ブロックに近接する予測ブロックを説明する図である。図9は符号化または復号対象の予測ブロックと時間的に異なる符号化または復号済みのピクチャにおいて、符号化または復号対象の予測ブロックと同一位置あるいはその付近に存在する既に符号化または復号済みの予測ブロックを説明する図である。図5、図6、図7、図8及び図9を用いて符号化または復号対象の予測ブロックの空間方向に近接する予測ブロック、及び異なる時間の同一位置の予測ブロックについて説明する。

(About adjacent prediction blocks)

5, FIG. 6, FIG. 7 and FIG. 8 are diagrams for explaining a prediction block close to the prediction block to be encoded or decoded in the same picture as the prediction block to be encoded or decoded. FIG. 9 shows an already encoded or decoded prediction existing in the same position as or near the prediction block to be encoded or decoded in a picture that has been encoded or decoded that differs in time from the prediction block to be encoded or decoded. It is a figure explaining a block. A prediction block that is close in the spatial direction of a prediction block to be encoded or decoded and a prediction block at the same position at different times will be described with reference to FIGS. 5, 6, 7, 8, and 9.

図5に示すように、符号化または復号対象の予測ブロックと同一ピクチャ内でその符号化または復号対象の予測ブロックの左側の辺に近接する予測ブロックA1、上側の辺に近接する予測ブロックB1、右上の頂点に近接する予測ブロックB0、左下の頂点に近接する予測ブロックA0、および左上の頂点に近接する予測ブロックB2を空間方向に近接する予測ブロックと定義する。 As shown in FIG. 5, in the same picture as the prediction block to be encoded or decoded, a prediction block A1 close to the left side of the prediction block to be encoded or decoded, prediction block B1 close to the upper side, The prediction block B0 close to the top right vertex, the prediction block A0 close to the bottom left vertex, and the prediction block B2 close to the top left vertex are defined as prediction blocks close to the spatial direction.

なお、図6に示すように、符号化または復号対象の予測ブロックの左側の辺に近接する予測ブロックのサイズが符号化または復号対象の予測ブロックより小さく、複数存在する場合には、本実施の形態においては左側の辺に近接する予測ブロックの中で最も下の予測ブロックA10だけを左側の辺に近接する予測ブロックA1とする。 As shown in FIG. 6, when the size of the prediction block adjacent to the left side of the prediction block to be encoded or decoded is smaller than the prediction block to be encoded or decoded and there are a plurality of prediction blocks, this embodiment In the embodiment, only the lowest prediction block A10 among the prediction blocks adjacent to the left side is set as the prediction block A1 adjacent to the left side.

同様に、符号化または復号対象の予測ブロックの上側の辺に近接する予測ブロックのサイズが符号化または復号対象の予測ブロックより小さく、複数存在する場合には、本実施の形態においては左側の辺に近接する予測ブロックの中で最も右の予測ブロックB10だけを上側の辺に近接する予測ブロックB1とする。 Similarly, when the size of the prediction block adjacent to the upper side of the prediction block to be encoded or decoded is smaller than the prediction block to be encoded or decoded and there are a plurality of prediction blocks, the left side in the present embodiment Only the rightmost prediction block B10 in the prediction blocks close to is set as the prediction block B1 close to the upper side.

なお、図7に示すように、符号化または復号対象の予測ブロックの左側に近接する予測ブロックAのサイズが符号化または復号対象の予測ブロックより大きい場合にも、前記条件に従い、左側に近接する予測ブロックAがその符号化または復号対象の予測ブロックの左側の辺に近接していれば予測ブロックA1とし、符号化または復号対象の予測ブロックの左下の頂点に近接していれば予測ブロックA0とし、符号化または復号対象の予測ブロックの左上の頂点に近接していれば予測ブロックB2とする。図6の例では、予測ブロックA0、予測ブロックA1及び予測ブロックB2は同一の予測ブロックとなる。 In addition, as shown in FIG. 7, even when the size of the prediction block A adjacent to the left side of the prediction block to be encoded or decoded is larger than the prediction block to be encoded or decoded, it is close to the left side according to the above condition. If the prediction block A is close to the left side of the prediction block to be encoded or decoded, the prediction block A1 is used. If the prediction block A is close to the lower left vertex of the prediction block to be encoded or decoded, the prediction block A0 is set. If it is close to the upper left vertex of the prediction block to be encoded or decoded, the prediction block is B2. In the example of FIG. 6, the prediction block A0, the prediction block A1, and the prediction block B2 are the same prediction block.

なお、図8に示すように、符号化または復号対象の予測ブロックの上側に近接する予測ブロックBのサイズが符号化または復号対象の予測ブロックより大きい場合にも、前記条件に従い、上側に近接する予測ブロックBがその符号化または復号対象の予測ブロックの上側の辺に近接していれば予測ブロックB1とし、符号化または復号対象の予測ブロックの右上の頂点に近接していれば予測ブロックB0とし、符号化または復号対象の予測ブロックの左上の頂点に近接していれば予測ブロックB2とする。図8の例では、予測ブロックB0、予測ブロックB1及び予測ブロックB2は同一の予測ブロックとなる。 As shown in FIG. 8, even when the size of the prediction block B adjacent to the upper side of the prediction block to be encoded or decoded is larger than the prediction block to be encoded or decoded, the size is close to the upper side according to the above condition. If the prediction block B is close to the upper side of the prediction block to be encoded or decoded, the prediction block B1 is set. If the prediction block B is close to the upper right vertex of the prediction block to be encoded or decoded, the prediction block B0 is set. If it is close to the upper left vertex of the prediction block to be encoded or decoded, the prediction block is B2. In the example of FIG. 8, the prediction block B0, the prediction block B1, and the prediction block B2 are the same prediction block.

図9に示すように、符号化または復号対象の予測ブロックと時間的に異なる符号化または復号済みのピクチャにおいて、符号化または復号対象の予測ブロックと同一位置あるいはその付近に存在する既に符号化または復号済みの予測ブロックT0およびT1を異なる時間の同一位置の予測ブロックと定義する。 As shown in FIG. 9, in a picture that has been encoded or decoded that is temporally different from the prediction block to be encoded or decoded, already encoded or existing at the same position as or near the prediction block to be encoded or decoded. The decoded prediction blocks T0 and T1 are defined as prediction blocks at the same position at different times.

(予測ブロックグループについて)

複数の予測ブロックで構成されるグループを予測ブロックグループと定義する。図5に示す符号化または復号対象の予測ブロックと同一ピクチャ内でその符号化または復号対象の予測ブロックの左側の辺に近接する予測ブロックA1、および符号化または復号対象の予測ブロックの左下の頂点に近接する予測ブロックA0で構成される第1の予測ブロックグループを左側に近接する予測ブロックグループと定義する。

(About prediction block groups)

A group composed of a plurality of prediction blocks is defined as a prediction block group. The prediction block A1 close to the left side of the prediction block to be encoded or decoded in the same picture as the prediction block to be encoded or decoded shown in FIG. 5, and the lower left vertex of the prediction block to be encoded or decoded Is defined as a prediction block group adjacent to the left side.

図5に示す符号化または復号対象の予測ブロックと同一ピクチャ内でその符号化または復号対象の予測ブロックの上側の辺に近接する予測ブロックB1、符号化または復号対象の予測ブロックの右上の頂点に近接する予測ブロックB0、および符号化または復号対象の予測ブロックの左上の頂点に近接する予測ブロックB2で構成される第2の予測ブロックグループを上側に近接する予測ブロックグループと定義する。 In the same picture as the prediction block to be encoded or decoded shown in FIG. 5, the prediction block B1 close to the upper side of the prediction block to be encoded or decoded, and the upper right vertex of the prediction block to be encoded or decoded A second prediction block group including a prediction block B0 that is close and a prediction block B2 that is close to the top left vertex of the prediction block to be encoded or decoded is defined as a prediction block group that is close to the upper side.

図9に示す符号化または復号対象の予測ブロックと時間的に異なる符号化または復号済みのピクチャにおいて、符号化または復号対象の予測ブロックと同一位置あるいはその近傍の位置に存在する既に符号化または復号済みの予測ブロックグループT0およびT1で構成される第3の予測ブロックグループを異なる時間の予測ブロックグループと定義する。 In a picture that has been encoded or decoded that is temporally different from the prediction block to be encoded or decoded shown in FIG. 9, already encoded or decoded at the same position as or near the prediction block to be encoded or decoded A third prediction block group composed of already-predicted prediction block groups T0 and T1 is defined as a prediction block group at different times.

(POCについて)

POCは符号化されるピクチャに関連付けられる変数とし、ピクチャの出力/表示順序で1ずつ増加する値が設定される。POCの値によって、同じピクチャであるかを判別したり、出力/表示順序でのピクチャ間の前後関係を判別したり、ピクチャ間の距離を導出したりすることができる。例えば、2つのピクチャのPOCが同じ値を持つ場合、同一のピクチャであると判断できる。2つのピクチャのPOCが違う値を持つ場合、POCの値が小さいピクチャのほうが、時間的に先に出力/表示されるピクチャであると判断でき、2つのピクチャのPOCの差が時間軸方向でのピクチャ間距離を示す。

(About POC)

POC is a variable associated with the picture to be encoded, and is set to a value that increases by 1 in the picture output / display order. Based on the POC value, it is possible to determine whether they are the same picture, to determine the front-to-back relationship between pictures in the output / display order, or to derive the distance between pictures. For example, if the POCs of two pictures have the same value, it can be determined that they are the same picture. When the POCs of two pictures have different values, it can be determined that the picture with the smaller POC value is a picture that is output / displayed earlier in time, and the difference between the POCs of the two pictures is the time axis direction. Indicates the distance between pictures.

本発明の実施の形態における動画像符号化装置、動画像符号化方法、動画像符号化プログラム、動画像復号装置、動画像復号方法、動画像復号プログラムにおいては、スライス単位、または予測ブロックのサイズに応じて、インター予測モードが双予測(Pred_BI)の場合に、L0またはL1のいずれか一方のインター予測情報の符号化または復号を行うかどうかを切り替える。切り替える対象となるインター予測情報は差分動きベクトル、参照インデックス、予測動きベクトルインデックスの一部、またはすべてである。 In the moving image encoding device, the moving image encoding method, the moving image encoding program, the moving image decoding device, the moving image decoding method, and the moving image decoding program according to the embodiment of the present invention, the size of the slice unit or the prediction block Accordingly, when the inter prediction mode is bi-prediction (Pred_BI), whether to encode or decode either L0 or L1 inter prediction information is switched. The inter prediction information to be switched is a difference motion vector, a reference index, a part or all of a prediction motion vector index.

インター予測モードが双予測(Pred_BI)の場合、L0およびL1の2つの動きベクトルを利用してインター予測するので、1つの動きベクトルのみを利用するL0予測やL1予測に比べて、動きベクトルを符号化するのに多くの符号量を必要とする。動きベクトルを符号化する際には符号量を削減するために差分動きベクトルを導出し、その導出された差分動きベクトルが符号化される。双予測の場合において、L0またはL1の動きベクトルに対応する差分動きベクトルの一方の符号化を行わず、差分動きベクトルの値を(0,0)とすることで、インター予測情報の符号量を削減する。ただし、双予測においてL0またはL1のいずれか一方の差分動きベクトルの値を(0,0)とすることで、予測動きベクトルの値がそのまま動きベクトルとなり、任意の動きベクトルを利用することができないので残差信号の符号量が増加することがある。したがって、本実施の形態においては、双予測においてL0またはL1の動きベクトルに対応する動きベクトルの一方を予測動きベクトルと同じ値に設定しても残差信号の符号量が増加しにくく、全体としての符号量が減少しやすい状況ではL0またはL1の動きベクトルに対応する差分動きベクトルの一方の符号化を行わないこととし、双予測においてL0またはL1の動きベクトルに対応する動きベクトルの一方を予測動きベクトルと同じ値に設定すると残差信号の符号量が増加しやすく、全体としての符号量が増加しやすい状況ではL0およびL1の動きベクトルに対応する差分動きベクトルをそれぞれ符号化する。 When the inter prediction mode is bi-prediction (Pred_BI), since inter prediction is performed using two motion vectors of L0 and L1, a motion vector is encoded as compared with L0 prediction and L1 prediction using only one motion vector. Requires a large amount of code. When encoding a motion vector, a differential motion vector is derived in order to reduce the amount of code, and the derived differential motion vector is encoded. In the case of bi-prediction, coding of one of the differential motion vectors corresponding to the L0 or L1 motion vector is not performed, and the value of the differential motion vector is set to (0, 0). Reduce. However, in bi-prediction, by setting the value of one of the difference motion vectors of L0 or L1 to (0, 0), the value of the predicted motion vector becomes the motion vector as it is, and an arbitrary motion vector cannot be used. Therefore, the code amount of the residual signal may increase. Therefore, in this embodiment, even if one of the motion vectors corresponding to the L0 or L1 motion vector is set to the same value as the predicted motion vector in bi-prediction, the code amount of the residual signal is unlikely to increase. In a situation where the amount of code of L is likely to decrease, one of the differential motion vectors corresponding to the L0 or L1 motion vector is not encoded, and one of the motion vectors corresponding to the L0 or L1 motion vector is predicted in bi-prediction If it is set to the same value as the motion vector, the code amount of the residual signal is likely to increase, and in a situation where the overall code amount is likely to increase, the differential motion vectors corresponding to the L0 and L1 motion vectors are encoded.

本実施の形態においては、第1の方法として、予測ブロックのサイズに応じて、インター予測モードが双予測(Pred_BI)の場合に、L0またはL1のいずれか一方の差分動きベクトルの符号化または復号を行うかどうかを切り替える。予測ブロックのサイズが小さい場合はL0またはL1のいずれか一方の差分動きベクトルの符号化または復号を行わず、予測ブロックのサイズが大きい場合はL0およびL1の双方の差分動きベクトルの符号化または復号を行う。予測ブロックのサイズが小さい場合は、画素数が少ないため、予測ブロックあたりの残差信号の符号量も小さい。したがって、双予測において差分動きベクトルの一方の符号化を行わなくても残差信号の符号量が増加しにくく、全体としての符号量が減少する。一方、予測ブロックのサイズが大きい場合は、画素数が多いため、予測ブロックあたりの残差信号の符号量も大きい。したがって、双予測において差分動きベクトルの一方の符号化を行わないと残差信号の符号量が増加しやすく、全体としての符号量が増加する。 In the present embodiment, as a first method, depending on the size of the prediction block, when the inter prediction mode is bi-prediction (Pred_BI), encoding or decoding of either L0 or L1 differential motion vector Switch whether to do. When the predicted block size is small, either the L0 or L1 differential motion vector is not encoded or decoded, and when the predicted block size is large, both the L0 and L1 differential motion vectors are encoded or decoded. I do. When the size of the prediction block is small, the number of pixels is small, so the code amount of the residual signal per prediction block is also small. Therefore, even if one of the differential motion vectors is not encoded in bi-prediction, the code amount of the residual signal is difficult to increase, and the code amount as a whole decreases. On the other hand, when the size of the prediction block is large, since the number of pixels is large, the code amount of the residual signal per prediction block is also large. Therefore, if one of the differential motion vectors is not encoded in bi-prediction, the code amount of the residual signal is likely to increase, and the code amount as a whole increases.

また、本実施の形態においては、第2の方法として、スライス毎に、インター予測モードが双予測(Pred_BI)の場合に、L0またはL1のいずれか一方の差分動きベクトルの符号化または復号を行うかどうかを切り替える。 In the present embodiment, as the second method, for each slice, when the inter prediction mode is bi-prediction (Pred_BI), either differential motion vector of L0 or L1 is encoded or decoded. To switch.

例えば、L0とL1で同一の参照画像を含むスライスや、L0とL1を共に時間方向で符号化または復号対象ピクチャよりも前の参照ピクチャを参照する前方向予測として利用し、時間方向で符号化または復号対象ピクチャよりも後ろの参照ピクチャを参照する後方向予測を含まないスライスでは、L0またはL1のいずれか一方を動きベクトルにより検出される動きベクトルの代わりに予測動きベクトルを用いても予測精度が低下しにくく残差成分の符号量の増加量が小さいため、差分動きベクトルの符号量を削減するために、L0またはL1のいずれか一方の差分動きベクトルの符号化または復号を行わない。 For example, a slice including the same reference image in L0 and L1, or both L0 and L1 are encoded in the temporal direction, or used as forward prediction to refer to a reference picture before the decoding target picture, and encoded in the temporal direction. Alternatively, in a slice that does not include backward prediction that refers to a reference picture after the picture to be decoded, even if one of L0 and L1 is used instead of the motion vector detected by the motion vector, the prediction accuracy is used. Since the amount of increase in the code amount of the residual component is small, the difference motion vector of either L0 or L1 is not encoded or decoded in order to reduce the code amount of the difference motion vector.

L0とL1で同一の参照画像を含まないスライスや、L0を前方向予測、L1を後方向予測として用いるスライスでは、L0またはL1のいずれか一方を動きベクトルにより検出される動きベクトルの代わりに予測動きベクトルを用いると予測精度が低下して残差成分の符号量の増加量が大きいため、予測精度を高めて残差成分の符号量を削減するために、L0およびL1の双方の差分動きベクトルの符号化または復号を行う。 For slices that do not include the same reference image in L0 and L1, or slices that use L0 as forward prediction and L1 as backward prediction, predict either L0 or L1 instead of the motion vector detected by the motion vector. If a motion vector is used, the prediction accuracy decreases and the amount of increase in the residual component code amount is large. Therefore, in order to increase the prediction accuracy and reduce the residual component code amount, the difference motion vectors of both L0 and L1 are used. Is encoded or decoded.

また、差分動きベクトルと同様の理由により、スライス単位、または予測ブロックのサイズに応じて、双予測においてL0またはL1のいずれか一方の参照インデックスも符号化または復号を行うかどうかを切り替えることができる。インター予測情報の符号量が大きくなる双予測の場合において、L0およびL1の動きベクトルに対応する参照インデックスの一方の符号化を行わず、参照インデックスの値を導出するかどうかをデフォルト値に設定することで、インター予測情報の符号量を削減する。ただし、双予測においてL0またはL1のいずれか一方の参照インデックスの値を導出するかどうかをデフォルト値に設定することで、任意の参照ピクチャを利用することができないので残差信号の符号量が増加することがある。したがって、本実施の形態においては、双予測においてL0またはL1のいずれか一方の参照インデックスの値を導出するかデフォルト値に設定しても残差信号の符号量が増加しにくく、全体としての符号量が減少しやすい状況ではL0またはL1の参照インデックスの一方の符号化を行わないこととし、双予測においてL0またはL1のいずれか一方の参照インデックスの値を導出するかデフォルト値に設定すると残差信号の符号量が増加しやすく、全体としての符号量が増加しやすい状況ではL0およびL1の参照インデックスを共に符号化する。 Also, for the same reason as the difference motion vector, it is possible to switch whether or not the reference index of either L0 or L1 is also encoded or decoded in bi-prediction according to the slice unit or the size of the prediction block. . In the case of bi-prediction in which the code amount of inter prediction information is large, one of the reference indexes corresponding to the L0 and L1 motion vectors is not encoded, and whether or not the reference index value is derived is set as a default value. Thus, the code amount of the inter prediction information is reduced. However, by setting whether to derive the reference index value of either L0 or L1 in the bi-prediction as a default value, an arbitrary reference picture cannot be used, so the code amount of the residual signal increases. There are things to do. Therefore, in this embodiment, even if the value of one of the reference indexes of L0 or L1 is derived or set to the default value in bi-prediction, the code amount of the residual signal hardly increases, and the code as a whole In a situation where the amount is likely to decrease, one of the L0 or L1 reference indexes is not encoded, and if bi-prediction derives the value of either the L0 or L1 reference index or sets the default value, the residual In a situation where the code amount of the signal is likely to increase and the code amount as a whole is likely to increase, both the L0 and L1 reference indexes are encoded.

また、差分動きベクトル、参照インデックスと同様の理由により、スライス単位、または予測ブロックのサイズに応じて、双予測においてL0またはL1のいずれか一方の差分予測ベクトルインデックスも符号化または復号を行うかどうかを切り替えることができる。インター予測情報の符号量が大きくなる双予測の場合において、L0またはL1の動きベクトルに対応する予測ベクトルインデックスの一方の符号化を行わず、予測ベクトルインデックスの値を他方の予測ベクトルインデックスと同じ値に設定することで、インター予測情報の符号量を削減する。ただし、双予測においてL0またはL1のいずれか一方の予測ベクトルインデックスの値を他方の予測ベクトルインデックスと同じ値とすることで、任意の予測ベクトルインデックスを利用することができないので残差信号の符号量が増加することがある。したがって、本実施の形態においては、双予測においてL0またはL1のいずれか一方の予測ベクトルインデックスの値を他方の予測ベクトルインデックスと同じ値に設定しても残差信号の符号量が増加しにくく、全体としての符号量が減少しやすい状況ではL0またはL1の予測ベクトルインデックスの一方の符号化を行わないこととし、双予測においてL0またはL1のいずれか一方の予測ベクトルインデックスの値を他方の予測ベクトルインデックスと同じ値に設定すると残差信号の符号量が増加しやすく、全体としての符号量が増加しやすい状況ではL0およびL1の予測ベクトルインデックスを共に符号化する。 Also, for the same reason as the difference motion vector and the reference index, whether or not to encode or decode either the L0 or L1 difference prediction vector index in bi-prediction according to the slice unit or the size of the prediction block Can be switched. In the case of bi-prediction in which the code amount of inter prediction information is large, one of the prediction vector indexes corresponding to the motion vector of L0 or L1 is not encoded, and the value of the prediction vector index is the same value as the other prediction vector index By setting to, the code amount of inter prediction information is reduced. However, since the prediction vector index value of either L0 or L1 is set to the same value as the other prediction vector index in bi-prediction, an arbitrary prediction vector index cannot be used. May increase. Therefore, in the present embodiment, even if the value of one of the prediction vector indexes of L0 or L1 is set to the same value as the other prediction vector index in bi-prediction, the code amount of the residual signal is unlikely to increase. In a situation where the overall code amount is likely to decrease, one of the L0 or L1 prediction vector indexes is not encoded, and in bi-prediction, the value of one of the L0 or L1 prediction vector indexes is used as the other prediction vector. When the same value as the index is set, the code amount of the residual signal is likely to increase, and in a situation where the code amount as a whole is likely to increase, both the L0 and L1 prediction vector indexes are encoded.

以下の説明においては、スライス単位、または予測ブロックのサイズに応じて、インター予測モードが双予測(Pred_BI)の場合における、L0またはL1のいずれか一方のインター予測の符号化または復号を行うかどうかの切り替えに際しては、インター予測情報である差分動きベクトル、参照インデックス、予測動きベクトルインデックスのすべてを切り替えるものとして説明するが、すべてを切り替える場合に限定されず、差分動きベクトル、参照インデックス、予測動きベクトルインデックスの一部、すなわちいずれか1つまたは2つだけを切り替えることもできる。例えば、L0またはL1のいずれか一方の予測動きベクトルだけを符号化または復号を行うかどうかを切り替えて、L0およびL1の両方の参照インデックス、予測動きベクトルインデックスを符号化または復号してもよいし、L0またはL1のいずれか一方の予測動きベクトルおよび参照インデックスを符号化または復号を行うかどうかを切り替えて、L0およびL1の両方の予測動きベクトルインデックスを符号化または復号してもよい。 In the following description, whether to perform inter prediction encoding or decoding of either L0 or L1 when the inter prediction mode is bi-prediction (Pred_BI) according to the slice unit or the size of the prediction block. However, the present invention is not limited to switching all of the inter-prediction information, that is, the differential motion vector, the reference index, and the prediction motion vector index. It is also possible to switch only part of the index, ie only one or two. For example, it is possible to encode or decode both the L0 and L1 reference indexes and the prediction motion vector index by switching whether to encode or decode only one of the L0 and L1 prediction motion vectors. The prediction motion vector and the reference index of either L0 or L1 may be switched to encode or decode, and the prediction motion vector index of both L0 and L1 may be encoded or decoded.

また、以下の説明においては、スライス単位、または予測ブロックのサイズに応じて、インター予測モードが双予測(Pred_BI)の場合における、L1のインター予測の符号化または復号を行うかどうかを切り替えるものとして説明するが、L1に限定されず、L0のインター予測の符号化または復号を行うかどうかを切り替えることもできる。 Also, in the following description, it is assumed that whether to perform encoding or decoding of L1 inter prediction when the inter prediction mode is bi-prediction (Pred_BI) according to the slice unit or the size of the prediction block. As will be described, the present invention is not limited to L1, and it is also possible to switch whether to perform encoding or decoding of L0 inter prediction.

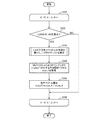

以下、図面と共に本発明の実施の形態を説明する。図1は本発明の実施の形態に係る動画像符号化装置100の構成を示すブロック図である。実施の形態の動画像符号化装置は、画像メモリ101、参照インデックス導出部116、動きベクトル検出部102、差分動きベクトル導出部103、インター予測情報推定部104、動き補償予測部105、予測方法決定部106、残差信号生成部107、直交変換・量子化部108、第1の符号化ビット列生成部109、第2の符号化ビット列生成部110、多重化部111、逆量子化・逆直交変換部112、復号画像信号重畳部113、符号化情報格納メモリ114、および復号画像メモリ115を備える。

Hereinafter, embodiments of the present invention will be described with reference to the drawings. FIG. 1 is a block diagram showing a configuration of a moving

本実施の形態においては、インター予測モードが双予測において、スライス毎、または符号化対象の予測ブロックのサイズに応じて、L1予測のインター予測情報を符号化するかどうかを切り替える。切り替える対象となるインター予測情報は参照インデックス、予測動きベクトルインデックス、差分動きベクトルの一部、またはすべてである。そこで、実施の形態の動画像符号化装置100では、双予測においてL1のインター予測情報が符号化されるかどうかを示すフラグinterInfoCodingL1Flagが0または1に設定される。フラグinterInfoCodingL1Flagが1は双予測においてL1のインター予測情報が符号化されることを示し、フラグinterInfoCodingL1Flagが0は双予測においてL1のインター予測情報が符号化されないことを示す。双予測においてL1のインター予測情報が符号化されるかどうかを示すフラグinterInfoCodingL1Flagは参照インデックス導出部116、動きベクトル検出部102、差分動きベクトル導出部103、動き補償予測部105、予測方法決定部106、第1の符号化ビット列生成部109で参照される。

In the present embodiment, when the inter prediction mode is bi-prediction, whether to encode inter prediction information for L1 prediction is switched for each slice or according to the size of a prediction block to be encoded. The inter prediction information to be switched is a reference index, a prediction motion vector index, a part of or all of a difference motion vector. Therefore, in the

画像メモリ101は、撮影/表示時間順に供給された符号化対象のピクチャの画像信号を一時格納する。画像メモリ101は、格納された符号化対象のピクチャの画像信号を、所定の画素ブロック単位で、動きベクトル検出部102、予測方法決定部106、および残差信号生成部107に供給する。その際、撮影/表示時間順に格納されたピクチャの画像信号は、符号化順序に並べ替えられて、画素ブロック単位で、画像メモリ101から出力される。

The

本実施の形態においては、インター予測モードが双予測において、スライス毎、または符号化対象の予測ブロックのサイズに応じて、L1予測のインター予測情報を符号化するかどうかを切り替える。切り替える対象となるインター予測情報として双予測でのL1の参照インデックスが含まれる場合で、双予測でのL1の参照インデックスを符号化しない場合、参照インデックス導出部116は、双予測でのL1の参照インデックスを導出し、動きベクトル検出部102、予測方法決定部106に供給する。符号化情報格納メモリに格納されている近接する予測ブロックのL1の参照インデックスを含む符号化情報を利用して、符号化対象の予測ブロックのL1の参照インデックスを導出してもよいし、L0の参照インデックスに対応するL0の参照ピクチャがL1にも含まれている場合にL1でも同じ参照ピクチャを用いることとし、その参照ピクチャに対応するL1の参照インデックスを導出してもよい。

In the present embodiment, when the inter prediction mode is bi-prediction, whether to encode inter prediction information for L1 prediction is switched for each slice or according to the size of a prediction block to be encoded. When the L1 reference index in bi-prediction is included as the inter prediction information to be switched, and the L1 reference index in bi-prediction is not encoded, the reference

動きベクトル検出部102は、画像メモリ101から供給される画像信号と復号画像メモリ115から供給される参照ピクチャ間でブロックマッチング等により各予測ブロックサイズ、および各インター予測モードでの、L0及びL1の各参照インデックス毎のそれぞれの動きベクトルを各予測ブロック単位で検出し、検出された動きベクトルを動き補償予測部105、差分動きベクトル導出部103、および予測方法決定部106に供給する。

The motion

インター予測が双予測においては、L0予測及びL1予測のために検出したそれぞれの動きベクトルを組み合わせて双予測の動きベクトルとしてもよいし、双予測のために別途動きベクトルを検出してもよい。 When the inter prediction is bi-prediction, the motion vectors detected for L0 prediction and L1 prediction may be combined into a motion vector for bi-prediction, or a separate motion vector may be detected for bi-prediction.

なお、本実施の形態においては、インター予測モードが双予測において、スライス毎、または符号化対象の予測ブロックのサイズに応じて、L1のインター予測情報を符号化するかどうかを切り替える。切り替える対象となるインター予測情報として双予測でのL1の差分動きベクトルが含まれる場合で、L1の差分動きベクトルを符号化しない場合、後述する方法によりL1の予測動きベクトルを導出し、その予測動きベクトルを双予測でのL1の動きベクトルとする。 In the present embodiment, when the inter prediction mode is bi-prediction, whether to encode L1 inter prediction information is switched for each slice or according to the size of the prediction block to be encoded. When the L1 differential motion vector in bi-prediction is included as the inter prediction information to be switched, and the L1 differential motion vector is not encoded, the L1 predicted motion vector is derived by the method described later, and the predicted motion Let the vector be the L1 motion vector in bi-prediction.

さらに、切り替える対象となるインター予測情報として双予測でのL1の参照インデックスが含まれる場合で、L1の参照インデックスを符号化しない場合、L1の参照インデックスの値を導出するかデフォルト値とする。 Further, when the L1 reference index in bi-prediction is included as the inter prediction information to be switched and the L1 reference index is not encoded, the value of the L1 reference index is derived or set as a default value.

差分動きベクトル導出部103は、符号化情報格納メモリ114に記憶されている既に符号化された画像信号の符号化情報を用いて、複数の予測動きベクトルの候補を算出して後述する予測動きベクトルリストに登録し、予測動きベクトルリストに登録された複数の予測動きベクトルの候補の中から最適な予測動きベクトルを選択し、動きベクトル検出部102が検出した動きベクトルと予測動きベクトルから差分動きベクトルを算出し、算出された差分動きベクトルを予測方法決定部106に供給する。なお、本実施の形態においては、インター予測モードが双予測において、スライス毎、または符号化対象の予測ブロックのサイズに応じて、L1のインター予測情報を符号化するかどうかを切り替える。切り替える対象となるインター予測情報として双予測でのL1の差分動きベクトルが含まれる場合で、双予測でのL1の差分動きベクトルを符号化しない場合、差分動きベクトルを(0,0)とする。さらに、予測動きベクトルリストに登録された予測動きベクトルの候補から選択された予測動きベクトルを特定する予測動きベクトルインデックスを予測方法決定部106に供給する。差分動きベクトル導出部103の詳細な構成と動作は後述する。

The differential motion

インター予測情報推定部104は、マージモードのインター予測情報を推定する。マージモードとは、当該予測ブロックの予測モード、参照インデックス(参照リストに登録されている複数の参照ピクチャから動き補償予測に利用する参照ピクチャを特定するための情報)、動きベクトル等のインター予測情報を符号化するのではなく、符号化済みの近接するインター予測された予測ブロック、あるいは異なるピクチャのインター予測された予測ブロックのインター予測情報を利用するモードである。符号化情報格納メモリ114に記憶されている既に符号化された予測ブロックの符号化情報を用いて、複数のマージの候補(インター予測情報の候補)を算出してマージ候補リストに登録し、マージ候補リストに登録された複数のマージ候補の中から最適なマージ候補を選択し、選択されたマージ候補の予測モード、参照インデックス、動きベクトル等のインター予測情報を動き補償予測部105に供給するとともに、選択されたマージ候補を特定するマージインデックスを予測方法決定部106に供給する。

The inter prediction

動き補償予測部105は、動きベクトル検出部102およびインター予測情報推定部104により検出された動きベクトルを用いて参照ピクチャから動き補償予測により予測画像信号を生成し、予測画像信号を予測方法決定部106に供給する。なお、L0予測、及びL1予測では、片方向の予測を行う。双予測(Pred_BI)の場合は、双方向の予測を行い、L0予測、L1予測のそれぞれのインター予測された信号に適応的に重み係数を掛け算し、オフセット値を加算して重畳し、最終的な予測画像信号を生成する。

The motion

予測方法決定部106は予測方法を決定する。それぞれの予測モードごとに符号量と符号化歪を算出し、最も少ない発生符号量と符号化歪となる予測ブロックサイズと予測モードが決定される。インター予測情報やイントラ予測情報等の符号化情報の符号量を算出する。さらに、動き補償予測部105から供給される予測画像信号と、画像メモリ101から供給される符号化対象の画像信号との予測残差信号を符号化した予測残差信号の符号量を算出する。動き情報の符号量と予測残差信号の符号量とが加算された総発生符号量を算出し、第1の評価値とする。尚、ここで算出される発生符号量は、符号化過程をシミュレートしたものであることが望ましいが、簡便に近似したり、概算することも可能である。

The prediction

また、こうした予測残差信号を符号化後に、歪量評価の為に復号し、符号化により生じる元の画像信号との誤差を表す比率として符号化歪が算出される。これら総発生符号量と符号化歪とを予測方法毎に比較することで、最も少ない発生符号量と符号化歪となる予測方法が決定される。 Further, after encoding such a prediction residual signal, it is decoded for distortion amount evaluation, and the encoding distortion is calculated as a ratio representing an error from the original image signal caused by the encoding. By comparing the total generated code amount and the coding distortion for each prediction method, a prediction method with the least generated code amount and the coding distortion is determined.

複数の予測方法の中から、最適な符号化ブロック単位でインター予測(PRED_INTER)かイントラ予測(PRED_INTRA)かを判別する予測モードPredMode、分割モードPartModeを決定し、インター予測(PRED_INTER)では予測ブロック単位でマージモードか否か等の予測方法を決定し、マージモードの場合はマージインデックス、マージモードでない場合はインター予測フラグ、予測動きベクトルインデックス、L0、L1の参照インデックス、差分動きベクトル等を決定して、決定に応じた符号化情報を第1の符号化ビット列生成部109に供給する。

PredMode that determines whether inter prediction (PRED_INTER) or intra prediction (PRED_INTRA) is optimized for each coding block among multiple prediction methods, determines the partition mode PartMode, and predictive block units for inter prediction (PRED_INTER) In the merge mode, a merge index is determined. In the merge mode, an inter prediction flag, a prediction motion vector index, a reference index of L0 and L1, a difference motion vector, and the like are determined. Thus, the encoded information corresponding to the determination is supplied to the first encoded bit

さらに、予測方法決定部106は、決定された予測方法を示す情報、及び決定された予測方法に応じた動きベクトル等を含む符号化情報を符号化情報格納メモリ114に格納する。ここで格納する符号化情報は、予測モードPredMode、分割モードPartMode、L0予測、及びL1予測を利用するかどうかを示すフラグpredFlagL0, predFlagL1、L0、L1の参照インデックスrefIdxL0, refIdxL1、L0、L1の動きベクトルmvL0, mvL1等である。ここで、予測モードPredModeがイントラ予測(MODE_INTRA)の場合、L0予測を利用するかどうかを示すフラグpredFlagL0、L1予測を利用するかどうかを示すフラグpredFlagL1は共に0である。一方、予測モードPredModeがインター予測(MODE_INTER)で、インター予測モードがL0予測(Pred_L0)の場合、L0予測を利用するかどうかを示すフラグpredFlagL0は1, L1予測を利用するかどうかを示すフラグpredFlagL1は0である。インター予測モードがL1予測(Pred_L1)の場合、L0予測を利用するかどうかを示すフラグpredFlagL0は0, L1予測を利用するかどうかを示すフラグpredFlagL1は1である。インター予測モードが双予測(Pred_BI)の場合、L0予測を利用するかどうかを示すフラグpredFlagL0、L1予測を利用するかどうかを示すフラグpredFlagL1は共に1である。予測方法決定部106は、決定された予測モードに応じた予測画像信号を残差信号生成部107と復号画像信号重畳部113に供給する。

Further, the prediction

残差信号生成部107は、符号化する画像信号と予測画像信号との減算を行うことにより残差信号を生成し、直交変換・量子化部108に供給する。

The residual

直交変換・量子化部108は、残差信号に対して量子化パラメータに応じて直交変換及び量子化を行い直交変換・量子化された残差信号を生成し、第2の符号化ビット列生成部110と逆量子化・逆直交変換部112に供給する。さらに、直交変換・量子化部108は、量子化パラメータを符号化情報格納メモリ114に格納する。

The orthogonal transform /

第1の符号化ビット列生成部109は、シーケンス、ピクチャ、スライス、符号化ブロック単位の情報に加えて、符号化ブロック及び予測ブロック毎に予測方法決定部106によって決定された予測方法に応じた符号化情報を符号化する。具体的には、符号化ブロック毎の予測モードPredModeがインター予測(PRED_INTER)の場合、マージモードかどうかを判別するフラグ、マージモードの場合はマージインデックス、マージモードでない場合はインター予測モード、参照インデックス、予測動きベクトルインデックス、差分動きベクトル等のインター予測情報を規定のシンタックス規則に従って符号化して第1の符号化ビット列を生成し、多重化部111に供給する。なお、本実施の形態においては、インター予測モードが双予測において、スライス毎、または符号化対象の予測ブロックのサイズに応じて、L1のインター予測情報を符号化するかどうかを切り替える。切り替える対象となるインター予測情報は双予測でのL1の参照インデックス、予測動きベクトルインデックス、差分動きベクトルの一部またはすべてである。

The first encoded bit

第2の符号化ビット列生成部110は、直交変換及び量子化された残差信号を規定のシンタックス規則に従ってエントロピー符号化して第2の符号化ビット列を生成し、多重化部111に供給する。多重化部111で、第1の符号化ビット列と第2の符号化ビット列を規定のシンタックス規則に従って多重化し、ビットストリームを出力する。

The second encoded bit

逆量子化・逆直交変換部112は、直交変換・量子化部108から供給された直交変換・量子化された残差信号を逆量子化及び逆直交変換して残差信号を算出し、復号画像信号重畳部113に供給する。復号画像信号重畳部113は、予測方法決定部106による決定に応じた予測画像信号と逆量子化・逆直交変換部112で逆量子化及び逆直交変換された残差信号を重畳して復号画像を生成し、復号画像メモリ115に格納する。なお、復号画像に対して符号化によるブロック歪等の歪を減少させるフィルタリング処理を施して、復号画像メモリ115に格納されることもある。

The inverse quantization / inverse

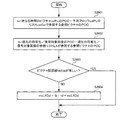

図2は図1の動画像符号化装置に対応した本発明の実施の形態に係る動画像復号装置200の構成を示すブロックである。実施の形態の動画像復号装置は、分離部201、第1符号化ビット列復号部202、第2符号化ビット列復号部203、参照インデックス導出部211、動きベクトル導出部204、インター予測情報推定部205、動き補償予測部206、逆量子化・逆直交変換部207、復号画像信号重畳部208、符号化情報格納メモリ209、および復号画像メモリ210を備える。

FIG. 2 is a block diagram showing a configuration of a moving

図2の動画像復号装置の復号処理は、図1の動画像符号化装置の内部に設けられている復号処理に対応するものであるから、図2の動き補償予測部206、逆量子化・逆直交変換部207、復号画像信号重畳部208、符号化情報格納メモリ209、および復号画像メモリ210の各構成は、図1の動画像符号化装置の動き補償予測部105、逆量子化・逆直交変換部112、復号画像信号重畳部113、符号化情報格納メモリ114、および復号画像メモリ115の各構成とそれぞれ対応する機能を有する。

The decoding process of the moving picture decoding apparatus in FIG. 2 corresponds to the decoding process provided in the moving picture encoding apparatus in FIG. 1, so the motion

分離部201に供給されるビットストリームは規定のシンタックスの規則に従って分離し、分離された符号化ビット列が第1符号化ビット列復号部202、第2符号化ビット列復号部203に供給される。

The bit stream supplied to the

第1符号化ビット列復号部202は、供給された符号化ビット列を復号して、シーケンス、ピクチャ、スライス、符号化ブロック単位の情報、及び、予測ブロック単位の符号化情報を得る。具体的には、符号化ブロック単位でインター予測(PRED_INTER)かイントラ予測(PRED_INTRA)かを判別する予測モードPredMode、分割モードPartMode、インター予測(PRED_INTER)の場合、予測ブロック単位でマージモードかどうかを判別するマージフラグ、マージフラグがマージモードの場合はマージインデックス、マージフラグがマージモードでない場合はインター予測モード、予測動きベクトルインデックス、差分動きベクトル等に関する符号化情報を規定のシンタックス規則に従って復号し、参照インデックス導出部211、符号化情報を動きベクトル導出部204およびインター予測情報推定部205に供給する。

The first encoded bit

なお、本実施の形態においては、インター予測モードが双予測において、スライス毎、または復号対象の予測ブロックのサイズに応じて、L1予測のインター予測情報を復号するかどうかを切り替える。切り替える対象となるインター予測情報は参照インデックス、予測動きベクトルインデックス、差分動きベクトルの一部、またはすべてである。そこで、第1符号化ビット列復号部202では、双予測においてL1のインター予測情報が符号化されるかどうかを示すフラグinterInfoCodingL1Flagが0または1に設定される。フラグinterInfoCodingL1Flagが1は双予測においてL1のインター予測情報が符号化されることを示し、フラグinterInfoCodingL1Flagが0は双予測においてL1のインター予測情報が符号化されないことを示す。設定された双予測においてL1のインター予測情報が符号化されるかどうかを示すフラグinterInfoCodingL1Flagの情報は参照インデックス導出部211、および動きベクトル導出部212に供給される。

In the present embodiment, when the inter prediction mode is bi-prediction, whether to decode L1 prediction inter prediction information is switched for each slice or according to the size of a prediction block to be decoded. The inter prediction information to be switched is a reference index, a prediction motion vector index, a part of or all of a difference motion vector. Therefore, in the first encoded bit

双予測でL1のインター予測情報が符号化されるかどうかを示すフラグinterInfoCodingL1Flagが1の場合、切り替える対象となるインター予測情報として双予測でのL1の差分動きベクトルが含まれる場合で、双予測でのL1の差分動きベクトルを復号しない場合、に双予測でのL1の差分動きベクトルが(0,0)に設定され、切り替える対象となるインター予測情報として双予測でのL1の予測動きベクトルインデックスが含まれる場合で、双予測でのL1の予測動きベクトルインデックスを復号しない場合、双予測でのL1の予測動きベクトルインデックスがL0の予測動きベクトルインデックスの値に設定され、符号化情報を参照インデックス導出部211および動きベクトル導出部204に供給する。なお、本実施の形態においては動きベクトル導出部204において切り替える対象となるインター予測情報として双予測でのL1の参照インデックスが含まれる場合で、双予測でのL1の参照インデックスを復号しない場合、双予測でのL1の参照インデックスを導出した値に設定するが、双予測でのL1の参照インデックスをデフォルト値に設定することもできる。その場合、第1符号化ビット列復号部202で、双予測でのL1の参照インデックスをデフォルト値に設定し、符号化情報を参照インデックス導出部211に供給する。

When the flag interInfoCodingL1Flag indicating whether or not the L1 inter prediction information is encoded by bi-prediction is 1, when the L1 differential motion vector in bi-prediction is included as the inter prediction information to be switched, the bi-prediction When the differential motion vector of L1 is not decoded, the differential motion vector of L1 in bi-prediction is set to (0, 0), and the predicted motion vector index of L1 in bi-prediction is set as inter prediction information to be switched. If the prediction motion vector index of L1 in bi-prediction is not decoded, the prediction motion vector index of L1 in bi-prediction is set to the value of the prediction motion vector index of L0, and the encoding information is derived as a reference index. To the

第2符号化ビット列復号部203は、供給された符号化ビット列を復号して直交変換・量子化された残差信号を算出し、直交変換・量子化された残差信号を逆量子化・逆直交変換部207に供給する。

The second encoded bit

参照インデックス導出部211は、供給された符号化情報から予測モードPredModeがインター予測(MODE_INTER)であり、マージフラグがマージモードでなく、インター予測モードが双予測(Pred_BI)であり、双予測においてL1のインター予測情報が符号化されるかどうかを示すフラグinterInfoCodingL1Flagが0の場合に、L1の参照インデックスを導出し、動き補償予測部206に供給する。符号化情報格納メモリに格納されている近接する予測ブロックのL1の参照インデックスを含む符号化情報を利用して、復号対象の予測ブロックのL1の参照インデックスを導出してもよいし、L0の参照インデックスに対応するL0の参照ピクチャがL1にも含まれている場合にL1でも同じ参照ピクチャを用いることとし、その参照ピクチャに対応するL1の参照インデックスを導出してもよい。

The reference

動きベクトル導出部204は、マージフラグがマージモードでない時に、符号化情報格納メモリ209に記憶されている既に復号された画像信号の符号化情報を用いて、複数の予測動きベクトルの候補を算出して後述する予測動きベクトルリストに登録し、予測動きベクトルリストに登録された複数の予測動きベクトルの候補の中から、第1符号化ビット列復号部202で復号され供給される予測動きベクトルインデックスに応じた予測動きベクトルを選択し、第1符号化ビット列復号部202で復号された差分ベクトルと選択された予測動きベクトルから動きベクトルを算出し、他の符号化情報とともに動き補償予測部206に供給するとともに、符号化情報格納メモリ209に格納する。ここで供給・格納する予測ブロックの符号化情報は、予測モードPredMode、分割モードPartMode、L0予測、及びL1予測を利用するかどうかを示すフラグpredFlagL0, predFlagL1、L0、L1の参照インデックスrefIdxL0, refIdxL1、L0、L1の動きベクトルmvL0, mvL1等である。ここで、予測モードPredModeがイントラ予測(MODE_INTRA)の場合、L0予測を利用するかどうかを示すフラグpredFlagL0、L1予測を利用するかどうかを示すフラグpredFlagL1は共に0である。一方、予測モードPredModeがインター予測(MODE_INTER)で、インター予測モードがL0予測(Pred_L0)の場合、L0予測を利用するかどうかを示すフラグpredFlagL0は1, L1予測を利用するかどうかを示すフラグpredFlagL1は0である。インター予測モードがL1予測(Pred_L1)の場合、L0予測を利用するかどうかを示すフラグpredFlagL0は0, L1予測を利用するかどうかを示すフラグpredFlagL1は1である。インター予測モードが双予測(Pred_BI)の場合、L0予測を利用するかどうかを示すフラグpredFlagL0、L1予測を利用するかどうかを示すフラグpredFlagL1は共に1である。動きベクトル導出部204の詳細な構成と動作は後述する。

When the merge flag is not in the merge mode, the motion

インター予測情報推定部205は、復号対象の予測ブロックのマージフラグがマージモードの時に、マージモードのインター予測情報を推定する。符号化情報格納メモリ114に記憶されている既に復号された予測ブロックの符号化情報を用いて、複数のマージの候補を算出してマージ候補リストに登録し、マージ候補リストに登録された複数のマージ候補の中から第1符号化ビット列復号部202で復号され供給されるマージインデックスに対応したマージ候補を選択し、選択されたマージ候補の予測モードPredMode、分割モードPartMode、L0予測、及びL1予測を利用するかどうかを示すフラグ、L0、L1の参照インデックス、L0、L1の動きベクトル等のインター予測情報を動き補償予測部206に供給するとともに、符号化情報格納メモリ209に格納する。

The inter prediction

動き補償予測部206は、動きベクトル導出部204で算出された動きベクトルを用いて参照ピクチャから動き補償予測により予測画像信号を生成し、予測画像信号を復号画像信号重畳部208に供給する。なお、双予測(Pred_BI)の場合は、L0予測、L1予測の2つの予測画像信号に適応的に重み係数を掛け算し、オフセット値を加算して重畳し、最終的な予測画像信号を生成する。

The motion compensated

逆量子化・逆直交変換部207は、第1符号化ビット列復号部202で復号された直交変換・量子化された残差信号に対して逆直交変換及び逆量子化を行い、逆直交変換・逆量子化された残差信号を得る。

The inverse quantization / inverse

復号画像信号重畳部208は、動き補償予測部206で動き補償予測された予測画像信号と、逆量子化・逆直交変換部207により逆直交変換・逆量子化された残差信号とを重畳することにより、復号画像信号を復号し、復号画像メモリ210に格納する。復号画像メモリ210に格納する際には、復号画像に対して符号化によるブロック歪等を減少させるフィルタリング処理を施して、復号画像メモリ210に格納されることもある。

The decoded image

本実施の形態の動画像符号化装置100および動画像復号装置200においては、インター予測モードが双予測において、スライス単位、または符号化または復号対象の予測ブロックのサイズに応じて、双予測でL1のインター予測情報を符号化または復号するかどうかを切り替える。

In the moving

スライス単位でL1のインター予測情報を符号化または復号するかどうかを切り替える場合、図10のスライスヘッダーのシンタックス構造の例に示すように、スライスヘッダーに双予測でL1のインター予測情報を符号化または復号するかどうかを示すフラグinterInfoCodingL1Flagを符号化または復号するためのシンタックス要素inter_info_coding_l1_flagを用意し、このシンタックス要素をスライスタイプがBスライスの場合に動画像符号化装置100の第1の符号化ビット列生成部109で符号化し、動画像復号装置200の第1符号化ビット列復号部202で復号することで、双予測においてL1のインター予測情報を符号化または復号するかどうかを判別する。また、スライス単位でL0のインター予測情報を符号化または復号するかどうかを切り替えてもよい。L0のインター予測情報を切り替える場合は、L0のインター予測情報を符号化または復号するかどうかを示すフラグinterInfoCodingL0Flagを符号化または復号するためのシンタックス要素inter_info_coding_l0_flagを用意して符号化または復号することで判別する。本実施の形態においては、差分動きベクトル、参照インデックス、予測動きベクトルインデックスの少なくとも1つを、符号化または復号するかどうかを切り替えることで符号量の削減を行う。例えば、双予測ではL1の差分動きベクトルだけを切り替え対象のインター予測情報とし、スライス単位で双予測のL1の差分予測動きベクトルだけを符号化または復号するかどうかを切り替える。符号化側で、双予測でのL1の動きベクトル検出処理を削減することで、演算量を削減する場合、または、L1の差分予測動きベクトルを省略することで符号化効率が向上すると判断した場合、双予測でL1のインター予測情報を符号化または復号するかどうかを示すフラグinterInfoCodingL1Flagの値を0としてシンタックス要素inter_info_coding_l1_flag を符号化または復号し、その値に応じて双予測のL1の差分動きベクトルの符号化および復号を省略することで、インター予測情報の符号量を削減する。双予測でL1の差分動きベクトルの符号化および復号を省略する際には符号化側、復号側共に、L1の差分動きベクトルの値を(0,0)とする。すなわち、双予測でL1の差分動きベクトルの符号化および復号を省略する際には符号化側、復号側共に、L1の予測動きベクトルをそのままL1の動きベクトルとする。

When switching whether to encode or decode L1 inter prediction information in units of slices, as shown in the example of the syntax structure of the slice header in FIG. 10, the L1 inter prediction information is encoded by bi-prediction in the slice header. Alternatively, a syntax element inter_info_coding_l1_flag for encoding or decoding a flag interInfoCodingL1Flag indicating whether or not to decode is prepared, and this syntax element is the first encoding of the

なお、参照インデックスだけを切り替え対象のインター予測情報としてもよいし、予測動きベクトルインデックスだけを切り替え対象のインター予測情報としてもよいし、すべてを切り替え対象のインター予測情報としてもよい。また、スライス単位で双予測のL1のインター予測情報だけを符号化または復号するかどうかを切り替えてもよいし、スライス単位で双予測のL0のインター予測情報だけを符号化または復号するかどうかを切り替えてもよい。ここでは、スライス単位で、双予測のL0およびL1のいずれか一方のインター予測情報において、差分動きベクトル、参照インデックス、および前記予測動きベクトルインデックスの少なくとも一つの符号化または復号を行わないモードに切り替えるようにする。 Note that only the reference index may be the inter prediction information to be switched, only the predicted motion vector index may be the inter prediction information to be switched, or all may be the inter prediction information to be switched. Also, whether to encode or decode only the bi-predicted L1 inter prediction information in units of slices may be switched, and whether to encode or decode only the bi-predicted L0 inter prediction information in units of slices. You may switch. Here, the mode is switched to a mode in which at least one of the differential motion vector, the reference index, and the predicted motion vector index is not encoded or decoded in the inter prediction information of one of L0 and L1 of bi-prediction in units of slices. Like that.

また、双予測でL1のインター予測情報を符号化または復号するかどうかを示すフラグinterInfoCodingL1Flagの代わりに、双予測でL1の参照インデックスを符号化または復号するかどうかを示すフラグrefIdxCodingL1Flag、双予測でL1の予測動きベクトルインデックスを符号化または復号するかどうかを示すフラグmvpIdxCodingL1Flag、または双予測でL1の差分予測動きベクトルを符号化または復号するかどうかを示すフラグmvdCodingL1Flagを用意してそれぞれ個別に切り替えることもできる。 また、双予測でL0の参照インデックスを符号化または復号するかどうかを示すフラグrefIdxCodingL0Flag、双予測でL0の予測動きベクトルインデックスを符号化または復号するかどうかを示すフラグmvpIdxCodingL0Flag、双予測でL0の差分予測動きベクトルを符号化または復号するかどうかを示すフラグmvdCodingL0Flagを用意してそれぞれ個別に切り替えることもできる。図11のスライスヘッダー のシンタックス構造の例に示すように、スライスヘッダーに双予測でL1の参照インデックスを符号化または復号するかどうかを示すフラグrefIdxCodingL1Flagを符号化または復号するためのシンタックス要素ref_idx_coding_l1_flag、双予測でL1の予測動きベクトルインデックスを符号化または復号するかどうかを示すフラグmvpIdxCodingL1Flagを符号化または復号するためのシンタックス要素mvp_idx_coding_l1_flag、双予測でL1の差分予測動きベクトルを符号化または復号するかどうかを示すフラグmvdCodingL1Flagを符号化または復号するためのシンタックス要素mvd_coding_l1_flag を用意し、これらのシンタックス要素をスライスタイプがBスライスの場合に動画像符号化装置100の第1の符号化ビット列生成部109で符号化し、動画像復号装置200の第1符号化ビット列復号部202で復号することで、双予測においてL1のそれぞれのインター予測情報を符号化または復号するかどうかを判別することもできる。また、L0のそれぞれのインター予測情報を切り替える場合は、双予測でL0の参照インデックスを符号化または復号するかどうかを示すフラグrefIdxCodingL0Flagを符号化または復号するためのシンタックス要素ref_idx_coding_l0_flag、双予測でL0の予測動きベクトルインデックスを符号化または復号するかどうかを示すフラグmvpIdxCodingL0Flagを符号化または復号するためのシンタックス要素mvp_idx_coding_l0_flag、双予測でL0の差分予測動きベクトルを符号化または復号するかどうかを示すフラグmvdCodingL0Flagを符号化または復号するためのシンタックス要素mvd_coding_l0_flagを用意して符号化または復号することで判別する。本実施の形態においては、これらのインター予測情報の少なくとも1つを、符号化または復号するかどうかを切り替えることで符号量の削減を行う。例えば、双予測ではL1の差分動きベクトルだけを切り替え対象のインター予測情報とし、スライス単位で双予測のL1の差分予測動きベクトルだけを符号化または復号するかどうかを切り替える。符号化側で、双予測でのL1の動きベクトル検出処理を削減することで、演算量を削減する場合、または、L1の差分予測動きベクトルを省略することで符号化効率が向上すると判断した場合、双予測でL1の差分予測動きベクトルを符号化または復号するかどうかを示すフラグmvdCodingL1Flagの値を0としてシンタックス要素mvp_idx_coding_l1_flag を符号化または復号し、その値に応じて双予測のL1の差分動きベクトルの符号化および復号を省略することで、インター予測情報の符号量を削減する。双予測でL1の差分動きベクトルの符号化および復号を省略する際には符号化側、復号側共に、L1の差分動きベクトルを(0,0)とする。すなわち、双予測でL1の差分動きベクトルの符号化および復号を省略する際には符号化側、復号側共に、L1の予測動きベクトルをそのままL1の動きベクトルとする。

Also, instead of the flag interInfoCodingL1Flag indicating whether or not L1 inter prediction information is encoded or decoded in bi-prediction, the flag refIdxCodingL1Flag indicating whether or not the L1 reference index is encoded or decoded in bi-prediction, and L1 in bi-prediction It is also possible to prepare a flag mvpIdxCodingL1Flag indicating whether or not to encode or predict the predicted motion vector index, or a flag mvdCodingL1Flag indicating whether or not to encode or decode the L1 differential prediction motion vector in bi-prediction, it can. Also, a flag refIdxCodingL0Flag indicating whether or not the L0 reference index is encoded or decoded in bi-prediction, a flag mvpIdxCodingL0Flag indicating whether or not the L0 motion vector index is encoded or decoded in bi-prediction, and the difference of L0 in bi-prediction It is also possible to prepare a flag mvdCodingL0Flag indicating whether or not to encode or decode a predicted motion vector and switch them individually. As shown in the example of the syntax structure of the slice header in FIG. 11, a syntax element ref_idx_coding_l1_flag for encoding or decoding a flag refIdxCodingL1Flag indicating whether or not the L1 reference index is encoded or decoded by bi-prediction in the slice header , A syntax element mvp_idx_coding_l1_flag for encoding or decoding a flag mvpIdxCodingL1Flag indicating whether to encode or decode the L1 motion vector predictor index in bi-prediction, and L1 differential prediction motion vector in bi-prediction A syntax element mvd_coding_l1_flag for encoding or decoding a flag mvdCodingL1Flag indicating whether or not the first encoding bit sequence of the