JP2012203439A - 情報処理装置および情報処理方法、記録媒体、並びにプログラム - Google Patents

情報処理装置および情報処理方法、記録媒体、並びにプログラム Download PDFInfo

- Publication number

- JP2012203439A JP2012203439A JP2011064508A JP2011064508A JP2012203439A JP 2012203439 A JP2012203439 A JP 2012203439A JP 2011064508 A JP2011064508 A JP 2011064508A JP 2011064508 A JP2011064508 A JP 2011064508A JP 2012203439 A JP2012203439 A JP 2012203439A

- Authority

- JP

- Japan

- Prior art keywords

- recognition

- shape

- unit

- predicted

- prediction

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Withdrawn

Links

Images

Abstract

【課題】対象を迅速に追跡できるようにする。

【解決手段】物体認識部は、画像から認識物体を認識する。予測部は、認識物体の次の位置および形状を予測する。そして、物体認識部は、予測部により予測された位置に対応する画像の領域内から予測された形状の認識物体を認識する。本開示は、例えば情報処理装置に適用できる。

【選択図】図1

【解決手段】物体認識部は、画像から認識物体を認識する。予測部は、認識物体の次の位置および形状を予測する。そして、物体認識部は、予測部により予測された位置に対応する画像の領域内から予測された形状の認識物体を認識する。本開示は、例えば情報処理装置に適用できる。

【選択図】図1

Description

本開示は情報処理装置および方法、記録媒体、並びにプログラムに関し、特に、対象を迅速に追跡することができるようにした情報処理装置および情報処理方法、記録媒体、並びにプログラムに関する。

ジェスチャコントロールや自動監視システム等を実現するため、物体を追跡する様々な手法が提案されている。

手ジェスチャを認識する技術としては、まず、手のみが撮像されている画像を用いるか、または、画像内における手の位置が指定されることにより、手のみが含まれている画像が抽出される。

そして、抽出された手のみが含まれている画像について、肌色情報、動き検出、およびパターンマッチングと言った手法により手ジェスチャが認識されている(特許文献1)。

また、パーティクルフィルタを用いて、対象物の次の状態を予測し、予測された状態と実際の画像をマッチングして追跡処理を実行することも知られている。

このような技術を用いることで、画像から認識したい対象物を検出し、検出された対象物の次の状態を予測することで、効率的に対象物を追跡することが可能となる。

しかしながら、パーティクルフィルタを用いた追跡処理は、対象物の形状が変化した場合、形状が変化する前の対象物の追跡が終了され、形状が変化した後の対象物を認識し、再び追跡処理が開始される。

例えば、手の形状としてパーを追跡しているとき、手の形状がグーに変化した場合、画像上にパーの形状が存在しなくなるので、パーの形状を追跡する追跡処理は終了する。

そして、再び手を認識する処理が実行され、画像全体から現在の手の位置と新たな手の形状であるグーが認識され、グーの形状を追跡する追跡処理が実行される。

このように、従来のパーティクルフィルタを用いた追跡処理は、対象物の形状が変化した場合、追跡処理が中断されてしまった。すなわち、形状が変化する前の対象物と形状が変化した後の対象物は、異なる対象物として追跡されていた。

従って、対象物の形状が変化するたびに画像全体を探索して対象物を認識しなおさなければならないので、形状が頻繁に変化する対象物を追跡する場合、追跡処理を迅速に実行できないおそれがあった。

本開示は、このような状況に鑑みてなされたものであり、対象を迅速に追跡できるようにするものである。

本開示の一側面の情報処理装置は、画像から認識物体を認識する物体認識部と、前記認識物体の次の位置および形状を予測する予測部とを備え、前記物体認識部は、前記予測部により予測された前記位置に対応する前記画像の領域内から、予測された前記形状の前記認識物体を認識する。

前記物体認識部は、前記認識物体の前記形状ごとの認識器を有し、予測された前記形状に対応する前記認識器を使用して、前記認識物体を認識することができる。

前記予測部は、前記物体認識部の過去の認識結果と、予め記憶されている前記認識物体の標準パターンとを比較し、前記過去の認識結果との一致点の多い前記標準パターンに基づいて、前記位置および前記形状を予測することができる。

前記予測部は、予測された前記位置および前記形状を組み合せた複数の仮説を生成し、前記物体認識部は、前記仮説に基づいて前記認識物体を認識する。

前記物体認識部の認識結果に基づいて、前記認識物体が認識されやすくなるように、前記認識器のパラメータ、および前記標準パターンのパラメータの少なくとも一方を更新する学習部をさらに備えるようにすることができる。

前記予測部は、前記認識物体の大きさおよび回転のうち少なくとも一方をさらに予測し、前記位置および前記形状に、前記大きさおよび前記回転のうち少なくとも一方を組み合せた仮説を生成することができる。

前記予測部の処理、および前記物体認識部の処理は、パーティクルフィルタの手法を用いて実行されるようにすることができる。

前記形状ごとの前記認識器は、ツリー構造により構成されることができる。

本開示の一側面の情報処理方法は、画像から認識物体を認識する物体認識ステップと、前記認識物体の次の位置および形状を予測する予測ステップとを含み、前記物体認識ステップの処理は、前記予測ステップの処理により予測された前記位置に対応する前記画像の領域内から、予測された前記形状の前記認識物体を認識する。

本開示の一側面の記録媒体、またはプログラムは、コンピュータに、画像から認識物体を認識する物体認識ステップと、前記認識物体の次の位置および形状を予測する予測ステップとを実行させるプログラムであって、前記物体認識ステップの処理は、前記予測ステップの処理により予測された前記位置に対応する前記画像の領域内から、予測された前記形状の前記認識物体を認識するプログラムを記録したコンピュータ読み取り可能な記録媒体、またはプログラムである。

本開示の一側面においては、画像から認識物体が認識され、認識物体の次の位置および形状が予測される。そして物体認識部は、予測部により予測された位置に対応する画像の領域内から、予測された形状の認識物体を認識する。

本開示の側面によれば、対象を迅速に追跡することが可能になる。

以下、本開示を実施するための形態(以下、実施の形態という)について説明する。なお、説明は以下の順序で行う。

1.情報処理装置の構成

2.パーソナルコンピュータの構成

3.物体追跡処理

4.予測処理

5.複数の辞書を用いた物体予測処理

6.ツリー構造の辞書を用いた物体認識処理

7.その他

1.情報処理装置の構成

2.パーソナルコンピュータの構成

3.物体追跡処理

4.予測処理

5.複数の辞書を用いた物体予測処理

6.ツリー構造の辞書を用いた物体認識処理

7.その他

[情報処理装置の構成]

図1は、本開示が適用される情報処理装置1の一実施の形態の構成を示すブロック図である。

この情報処理装置1は、画像入力部21、状態予測部22、物体認識部23、後処理部24、および物体学習部25から構成されている。

画像入力部21は、カメラ等により被写体を撮像することにより取得された画像を入力し、入力された画像を状態予測部22に出力する。状態予測部22は、事前に記録された予測情報に基づいて認識物体の次の状態を予測し、予測した認識物体の次の状態を物体認識部23に出力する。

物体認識部23は、状態予測部22により予測された認識物体の次の状態に対応する物体認識情報と、入力された画像とを比較することで、認識物体を認識し、入力された画像に対して一致点の多い認識物体の次の状態を後処理部24に出力する。

後処理部24は、物体認識部23により出力された認識結果を統合し、統合された認識結果を出力部46および物体学習部25に出力する。

物体学習部25は、認識物体の情報を学習し、状態予測部22に供給する標準パターン等の予測情報、および物体認識部23に供給する辞書などの物体認識情報を更新する。

また、この情報処理装置1は、図2に示されるような、ソフトウェアを実行することで所定の機能を実現するパーソナルコンピュータ31により構成することもできる。

[パーソナルコンピュータの構成]

図2は、本開示が適用されるパーソナルコンピュータ31の一実施の形態の構成を示すブロック図である。

情報処理装置としてのパーソナルコンピュータ31は、バス41、CPU(Central Processing Unit)42、ROM(Read Only Memory)43、RAM(Random Access Memory)44、入力部45、出力部46、記憶部47、通信部48、ドライブ49、およびリムーバブルメディア50から構成されている。

バス41は、CPU42、ROM43、RAM44、入力部45、出力部46、記憶部47、通信部48、ドライブ49をそれぞれ相互に接続する。

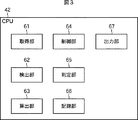

CPU42は、パーソナルコンピュータ31の各種の動作を制御する。CPU42の各種の機能は、図3を参照して後述する。

ROM43は、パーソナルコンピュータ31において実行される各種の処理プログラムや処理に必要なデータなどを記録する。RAM44は、各種の処理において得られたデータを一時的に記録保持するなどのように、各種の処理の作業領域として用いられる。

入力部45は、キーボード、マウス、マイクロフォンなどよりなる。出力部46は、ディスプレイ、スピーカなどよりなる。記憶部47は、ハードディスクや不揮発性のメモリなどよりなる。

通信部48は、ネットワークインタフェースなどよりなる。ドライブ49は、磁気ディスク、光ディスク、光磁気ディスク、或いは半導体メモリなどのリムーバブルメディア50を駆動する。

以上のように構成されるパーソナルコンピュータ31においては、CPU42が、例えば、ROM43や記憶部47に記憶されているプログラムを、バス41を介して、RAM44にロードして実行することにより、各種の処理が行われる。

CPU42が実行するプログラムは、例えば、パッケージメディア等としてのリムーバブルメディア50に記録して提供される。

なお、パッケージメディアとしては、磁気ディスク(フレキシブルディスクを含む)、光ディスク(CD-ROM(Compact Disc-Read Only Memory),DVD(Digital Versatile Disc)等)、光磁気ディスク、もしくは半導体メモリなどが用いられる。

また、プログラムは、ローカルエリアネットワーク、インターネット、デジタル衛星放送といった、有線または無線の伝送媒体を介して提供することができる。

パーソナルコンピュータ31においては、プログラムは、リムーバブルメディア50をドライブ49に装着することにより、バス41を介して、記憶部47にインストールすることができる。

また、プログラムは、有線または無線の伝送媒体を介して、通信部48で受信し、記憶部47にインストールすることができる。その他、プログラムは、ROM43や記憶部47に、あらかじめインストールしておくことができる。

なお、パーソナルコンピュータ31が実行するプログラムは、本明細書で説明する順序に沿って時系列に処理が行われる処理であっても良いし、並列に、あるいは呼び出しが行われたとき等の必要なタイミングで処理が行われるプログラムであっても良い。

図3は、CPU42の機能的構成例を示すブロックである。この各ブロックにより図1の画像入力部21、状態予測部22、物体認識部23、後処理部24、および物体学習部25が構成される。

CPU42は、取得部61、検出部62、算出部63、制御部64、判定部65、記録部66、および出力部67の機能ブロックを有している。なおCPU42の各ブロックは、必要に応じて相互に信号、データを授受することが可能とされている。

取得部61は、各種の情報を取得する。検出部62は、各種の検出処理を実行する。算出部63は、各種の算出処理を実行する。制御部64は、各種の制御処理を行う。判定部65は、各種の判定処理を実行する。記録部66は、各種の情報を記録する。出力部67は、各種の情報を出力する。

[物体追跡処理]

図4は、パーソナルコンピュータ31の物体追跡処理を説明するフローチャートである。図4の物体追跡処理は、例えばパーソナルコンピュータ31が起動されたときに実行される。

以下、各ステップを、図3の各ブロックが実行するものとして説明するが、図1の各ブロックによっては、次のように実行される。

すなわち、ステップS1乃至S3およびステップS13は、画像入力部21により、ステップS4は、状態予測部22により、ステップS5,S6は、物体認識部23により、ステップS7は、後処理部24により、ステップS8乃至S12は、物体学習部25により、それぞれ実行される。

ステップS1において、制御部64は、認識物体を設定する。認識物体は、予め記憶されている複数の物体検出手法の中から設定される。

認識物体は、例えば、ユーザにより指定されるようにすることができる。例えばジェスチャにより電子機器を制御する場合、ユーザの手が認識物体として指定される。

なお、記憶されている物体検出手法が1つである等、予め認識物体が決定している場合、ステップS1の処理は省略することができる。

ステップS2において、取得部61は、画像を取得する。すなわち、被写体を撮像して得られた画像が取得される。

ステップS3において、検出部62は、認識物体を検出する。すなわち、ステップS1の処理で設定された物体検出手法を用いて、ステップS2の処理により取得された画像から認識物体が検出される。

物体追跡処理の開始直後は、認識物体を追跡するための情報が不十分になる。そこで、初期状態においては、物体検出手法を用いて認識物体が追跡される。

例えば予め決められたグー、チョキ、パーの手の形状が検出され、初期情報とされる。勿論、初期情報はユーザが指定したものを使用することもできる。

次にステップS4において状態予測部22により予測処理が実行される。図5を参照して、予測処理について説明する。

[予測処理]

図5は、予測処理を説明するフローチャートである。ここにおける予測処理は、例えば、パーティクルフィルタの手法を用いて実行される。

ステップS21において、算出部63は、予測用特徴量を算出する。例えば、過去の認識結果を使い、取得された画像の過去30フレームにおける、認識物体の運動方向、移動距離、および形状の変化等の情報が予測用特徴量として算出される。

過去の認識結果が存在しない場合、手検出器などの物体認識器により、取得された画像から目標物体の認識が行われる。

ステップS22において、制御部64は、予測用特徴量を平滑化する。すなわち、予測用特徴量に平滑化フィルタ等をかけて、スムージングの処理が実行される。図6を参照して、スムージングの例について説明する。

図6は、スムージングの例を示す図である。図6Aは、認識物体である手81−1の移動の軌跡を示す図である。手81−1の軌跡は、過去に認識された手81−1の運動方向および移動距離などの情報から算出された予測用特長量により描かれる。

図6Aに示すように、手81−1の実際の軌跡は、細かいブレを含んでいる。このような細かいブレは、ユーザが意図する操作ではない。従って、図6Aの軌跡から、手81−1がどのように動いていたかを直接判断すると、正確な判断が困難になる。

図6Bは、図6Aの手81−1の軌跡に対して平滑化フィルタによるフィルタリングを実行した例を示す図である。図6Bに示すように、手81−2の実施の軌跡から細かいブレを除去すると、滑らかな直線になる。

このように、スムージングの処理を実行することで、予測処理に不要なノイズの情報を除去することで、ユーザの意図に沿って認識物体の状態を正確に判断することができる。

図5のステップS23において、算出部63は、予測用特徴量を正規化して時系列運動パターンを算出する。

認識物体の時系列運動パターンとは、認識物体の運動の種類等を特定する情報である。例えば、図6の手81−2の時系列運動パターンは、直線運動となる。

ステップS24において、制御部64は、標準パターンと時系列運動パターンをマッチングする。すなわち、標準パターンと時系列運動パターンが比較される。

標準パターンは、記録部66により予め記録されている、事前に学習された認識物体の運動パターンである。例えば、物を手でつかむ操作の標準パターンは、手の形状がパーからグーに変化する動作に対応する。

ステップS25において、算出部63は、標準パターンごとに時系列運動パターンの確率を算出する。確率は、時系列運動パターンが標準パターンに対してどれだけ一致するかを示す値である。

例えば、手が図6Bのように左から右に移動する場合の時系列運動パターンの確率は、直線運動の標準パターンである場合に高くなり、物を手でつかむ操作の標準パターンである場合に低くなる。

ステップS26において、取得部61は、時系列運動パターンの確率が第1の閾値以上となる標準パターンを取得する。すなわち、時系列運動パターンとの一致点が多い標準パターンが取得される。

第1の閾値は、学習等により予め設定されている。後述する他の閾値についても同様とする。なお、時系列運動パターンの確率が第1の閾値以上となる標準パターンが存在しない場合、処理は図4のステップS1に戻り、それ以降の処理が繰り返される。

ステップS27において、算出部63は、取得された標準パターンから認識物体の状態を予測した仮説を生成する。図7乃至図9を参照して、認識物体の状態を予測する場合について説明する。

図7は、手の形状の変化の例を示す図である。図7Aには、手102−1の形状がパーである状態が示されている。図7Cには、手102−3の形状がグーである状態が示されている。

図7Bには、手102−2の形状が図7Aに示すパーから、図7Cに示すグーへ変化する途中の状態が示されている。

なお、手102−1乃至102−3を個々に区別する必要がない場合、以下単に、手102と記述する。他の構成要素についても同様とする。

例えば、ユーザ101が物をつかむジェスチャをする場合、ユーザ101の手102の形状は、図7Aの手102−1の形状から図7Bの手102−2の形状を経由して、図7Cの手102−3の形状に遷移する。

そして、ユーザ101の手102の形状は、所定時間経過後に、図7Cの手102−3の形状から図7Bの手102−2の形状を経由して、図7Aの手102−1の形状に戻るようになる。

図8を参照して、現在の手102の形状がパーである場合、すなわち図7Aの手102−1が認識結果として出力された場合について説明する。

図8は、認識結果の例を示す図である。図8には、図7Aの画像に対して、図4のステップS3の処理、または後述するステップS12の処理が実行された場合の例が示されている。

図8の例には、ユーザ101の手102−1の形状であるパーが認識され、手102−1の中心121−1と、手102−1の中心121−1から所定の大きさで表示される認識領域122−1が表示されている。

また、出力部46を構成する表示部46Aの左上の頂点が原点120であり、手102−1の中心121−1の座標が(x1,y1)であるとする。

ユーザ101が物をつかむジェスチャをする場合、現在の手102−1の形状がパーであるので、次の状態における手の形状はパー、すなわち図7Aの手102−1の形状、またはパーからグーに変化する途中の形状、すなわち図7Bの手102−2の形状となる可能性が高いと考えられる。

また、ユーザ101が物をつかむジェスチャをする場合、ユーザ101の手102の位置は、ほとんど移動しないと考えられる。図9を参照して、パーの次の状態を予測した場合について説明する。

図9は、認識物体の仮説の例を示す図である。図9の例では、認識物体の仮説として、手の形状と位置を予測する場合について説明する。図9には、仮説と予測形状と予測位置の例が示されている。

予測形状は、手の次の形状を示している。なお、簡単のため、手の予測形状の種類は、グー、チョキ、パーの3種類とする。

予測位置は、手の次の中心位置の座標を示している。図9の例には、図8の手102−1の中心121−1の座標(x1,y1)から上下左右の4方向にa(aは自然数)だけ移動した座標(x1,y1−a)、(x1,y1+a)、(x1−a,y1)、および(x1+a,y1)が示されている。

仮説は、予測形状と予測位置を組み合せたものである。例えば、予測形状が3種類であり、予測位置が4種類である場合、仮説は、最大で3×4=12個生成される。図9の例では、8個の仮説が示されている。

例えば、予測形状であるパーと、予測位置の座標(x1,y1−a)を組み合せたものが仮説1として生成される。すなわち、仮説1は、手の次の状態において、手の形状がパーであり、手の中心が座標(x1,y1−a)にあることを示している。

他の仮説も、予測形状と予測位置を組み合せることで同様に生成される。

例えば、図8に示すように、現在の手102−1の形状がパーである場合、次の手の形状がパーとなる可能性は高く、次の手の形状がグーとなる可能性は低くなると考えられる。従って、図9に示すように、仮説の予測形状には、パーが多くなり、グーが少なくなる。

図5に戻り、ステップS27の処理の後、処理は図4のステップS5に進む。

図4のステップS5において、物体認識部23により物体認識処理が実行される。この物体認識処理には、例えば特開2010−108475号公報の技術を用いることができるが、ここではパーティクルフィルタの手法を用いた2つの場合について説明する。

1つは図10に示される複数の辞書を用いる場合であり、1つは図14と図15に示されるツリー構造の辞書を用いた場合である。最初に図10を参照して、複数の辞書を用いる場合の物体認識処理について説明する。

[複数の辞書を用いた物体認識処理]

図10は、複数の辞書を用いた物体認識処理を説明するフローチャートである。物体認識処理も図5の予測処理と同様にパーティクルフィルタの手法を用いて実行される。

辞書は、認識物体の形状ごとに予め用意されている認識器であり、学習された特徴量やパラメータを有している。例えば、手の形状の場合、グーの辞書、パーの辞書、チョキの辞書等が用意される。

また辞書には、辞書ごとに認識特徴量を算出するためのパラメータが設定されている。例えば、パーの辞書の場合、取得された画像から5本の指が検出されるようなパラメータが設定されている。

ステップS41において、取得部61は、仮説を1つ取得する。すなわち、図5のステップS27の処理により生成された仮説が1つ取得される。例えば、図9の仮説1乃至8の中から仮説1が取得される。

ステップS42において、取得部61は、仮説に対応する辞書を取得する。すなわち、取得された仮説の予測形状に対応する辞書が、記録部66により記録されている辞書の中から取得される。例えば、図9の仮説1の場合、予測形状がパーであるので、パーの辞書が取得される。

ステップS43において、算出部63は、仮説に対応する認識特徴量を算出する。すなわち、予測位置を中心とする所定の範囲内の画像から、予測形状の辞書のパラメータを用いて、認識特徴量が算出される。

図11を参照して、図9の仮説1に基づいて、認識特徴量を算出する場合について説明する。

図11は、認識物体を認識する例を示す図である。図11には、現在の画像として図7Bの画像が取得された例が示されている。

図11の例には、ユーザ101の手102−11、過去の認識結果(すなわち図8)の中心121−1、予測位置141、および予測位置141から所定の大きさで示される予測領域142が表示されている。

なお、簡単のため、予測領域142の大きさは、図8の認識領域122−1と同じ大きさとする。

過去の認識結果の中心121−1は、座標(x1,y1)に位置している。また、図9に示すように、仮説1の予測位置141は座標(x1,y1−a)となる。従って、図11に示すように、仮説1の予測位置141は、中心121−1よりaだけ上に位置する。

仮説1に対するステップS43の処理により、予測位置141を中心とする予測領域142内の画像から、パーの辞書のパラメータを用いて、認識特徴量が算出される。

図10に戻り、ステップS44において、算出部63は、仮説の信頼度を算出する。すなわち、仮説がどれだけ正しいかが算出される。

信頼度は確率を意味し、例えば、シグモイド関数を用いて算出される。シグモイド関数P(t)は、次の式(1)で表わされる。

P(t)=1/(1+e−t) (1)

P(t)=1/(1+e−t) (1)

図12は、シグモイド関数の例を示す図である。図12に示すように、シグモイド関数は、P(t)=0とP(t)=1に漸近線を持ち、特徴量に対応する変数tの値が大きくなる程、1に漸近し、小さい程、0に漸近する。

すなわち、認識特徴量が大きい程、すなわち仮説が正しい程、信頼度が高くなる。変数tは、例えば、ブースティング(Boosting)、SVM(Support Vector Machine)などで学習された手の認識器のスコアである。

図10に戻り、ステップS45において、判定部65は、全ての仮説を取得したかを判定する。すなわち、全ての仮説に対して信頼度が算出されたかが判定される。

ステップS45において、まだ全ての仮説を取得していないと判定された場合、すなわち、まだ信頼度が算出されていない仮説が存在する場合、ステップS46において、取得部61は、取得されていない仮説を1つ取得する。

図9の例では、既に仮説1が取得され、仮説2乃至8がまだ取得されていないので、仮説2乃至8のうち1つの仮説、例えば仮説2が新たに取得される。

ステップS46の処理の後、処理はステップS42に戻り、それ以降の処理が繰り返される。このようにして全ての仮説の信頼度が算出される。

一方、ステップS45において、全ての仮説が取得されたと判定された場合、すなわち、全ての仮説の信頼度が算出された場合、処理はステップS47に進む。

ステップS47において、取得部61は、信頼度が第2の閾値以上の仮説を取得する。すなわち、より正しいと判断された仮説が取得され、間違いと判断された仮説は取得されない。ステップS47の処理の後、処理は図4のステップS6に進む。

このように、物体認識部23は、仮説に基づいて認識物体を認識するように制御する。具体的には、予測位置に対応する制限された予測領域142内の画像から予測形状の認識物体が認識されるので、パーソナルコンピュータ31は、より迅速に認識物体を追跡することができる。

なお、図10の物体認識処理においては、仮説を1つずつ取得して仮説の信頼度を算出するようにしたが、複数の仮説に対して並列に物体認識処理を実行して、仮説の信頼度を算出するようにしてもよい。

図4に戻り、ステップS6において、判定部65は、信頼度が第2の閾値以上となる仮説を取得したかを判定する。

ステップS6において、信頼度が第2の閾値以上となる仮説が取得されなかったと判定された場合、処理はステップS1に戻り、それ以降の処理が繰り返される。

一方、ステップS6において、信頼度が第2の閾値以上となる仮説が取得されたと判定された場合、ステップS7において、制御部64は、仮説を統合して認識結果を生成する。

すなわち、図10のステップS47の処理により取得された仮説が統合され、認識物体の状態が決定される。

具体的には、仮説の信頼度に応じた重みを予測位置および予測形状の情報に付加し、その総和を算出することで認識物体の状態が一意に決定される。なお、認識結果は、信頼度が最大となる仮説に基づいて一意に決定されるようにしてもよい。

ステップS8において、算出部63は、認識結果の信頼度を算出する。信頼度は、図10のステップS44の処理と同様に、シグモイド関数等を用いて算出される。

ステップS9において、判定部65は、認識結果の信頼度が第3の閾値以上であるかを判定する。すなわち、認識結果を出力するかが判定される。

ステップS9において、認識結果の信頼度が第3の閾値より小さいと判定された場合、すなわち、認識結果を出力すべきではないと判定された場合、ステップS10乃至S12の処理はスキップされ、処理はステップS13に進む。

一方、ステップS9において、認識結果の信頼度が第3の閾値以上であると判定された場合、すなわち、認識結果を出力すべきと判定された場合、処理はステップS10に進む。

ステップS10において、制御部64は、認識結果から認識物体の情報を学習する。学習は、オンラインブースティングの手法等を用いて実行される。オンラインブースティングの手法については、例えば次の文献に開示されている。

Helmut Grabner and Horst Bischof, "On-line Boosting and Vision", In Proceedings IEEE Conference on Computer Vision and Pattern Recognition (CVPR), volume 1, pages 260-267, 2006

Helmut Grabner and Horst Bischof, "On-line Boosting and Vision", In Proceedings IEEE Conference on Computer Vision and Pattern Recognition (CVPR), volume 1, pages 260-267, 2006

具体的には、予測処理に用いられる標準パターンのパラメータ、および物体認識処理に用いられる辞書のパラメータの少なくとも一方が、より効率的に認識物体を検出できるように変更される。

例えば、図10の物体認識処理で、パーの辞書を使用して仮説の信頼度を算出する場合、図7Bの手102−2の形状では、図7Aの手102−1の形状より仮説の信頼度が低く算出される。

しかし、予測形状がパーであるとき、手102−2の形状が頻繁に認識された場合、学習により手102−2の形状もパーに含まれると判断され、手102−2の形状の信頼度が高くなるようにパーの辞書のパラメータが変更される。

このように、学習により認識物体が認識されやすくなるので、より迅速かつ確実に認識物体を追跡することができるようになる。

ステップS11において、記録部66は、学習結果を記録する。すなわち、学習により、標準パターンのパラメータおよび辞書のパラメータの少なくとも一方が更新される。

ステップS12において、出力部67は、認識結果を出力する。すなわち、ステップS7の処理により生成された認識結果が出力部46の表示部46Aに表示される。

図13は、認識結果の例を示す図である。図13には、図7Bの画像に対する認識結果の例が示されている。

図13の例には、ユーザ101の手102−2の形状が認識され、手102−2の中心121−2と、手102−2の中心121−2から所定の大きさの認識領域122−2が表示されている。

これにより、ユーザ101が認識物体としての手102の追跡を確認することができる。

なお、図4のステップS10,S11の処理とステップS12の処理は、並列に実行することができる。すなわち、ステップS10,S11の処理が終了するより前に、ステップS12の処理が実行されるようにしてもよい。

ステップS13において、取得部61は、画像を取得する。すなわち、新たな画像が取得される。

なお、新たに取得される画像は、過去に取得された画像(例えば図7Bの画像)の次のフレームの画像(例えば図7Cの画像)でもよいし、過去に取得された画像から所定のフレーム数だけ後の画像でもよい。

すなわち、新たな画像は、1フレームごとに取得されてもよいし、所定のフレーム数ごとに取得されてもよい。

ステップS13の処理の後、処理はステップS4に戻り、それ以降の処理が繰り返される。

次に、図14と図15を参照して、図4のステップS5の物体認識処理の他の例について説明する。

図14は、ツリー構造の辞書の例を示す図である。図15は、ツリー構造の辞書を用いた物体認識処理を説明するフローチャートである。まず図14を参照してツリー構造の辞書について説明する。

図14に示すように、ツリー構造の辞書には、認識物体としての手201の様々な形状がノードに予め設定されている。

図14の例には、手201が右手221および左手222の子ノードを有し、右手221がグー241、チョキ242、およびパー243の認識用リーフノードを有している場合が示されている。

認識用リーフノードには、認識用リーフノードごとに認識特徴量を算出するためのパラメータが設定されている。

なお、簡単のため、左手222の子ノードは、省略されており、右手221の認識用リーフノードには、グー241、チョキ242、およびパー243の3種類の認識用リーフノードが示されている。

また、図14のツリー構造の深さは2であるが、ツリー構造の深さは3以上の複数でもよい。

例えば、ツリー構造の深さが3である場合、右手221が「手を閉じている状態」および「手を開いている状態」の子ノードを有し、「手を閉じている状態」がグー241の子ノードを有し、「手を開いている状態」がチョキ242およびパー243の子ノードを有するようにしてもよい。

[ツリー構造の辞書を用いた物体認識処理]

次に、図15を参照して、ツリー構造の辞書を用いた物体認識処理について説明する。

図15において、ステップS61,S63乃至S67の処理は、図10のステップS41,S43乃至S47の処理に対応する処理である。従って、これらの処理は繰り返しになるので簡単に説明する。

ステップS61において、取得部61は、仮説を1つ取得する。ステップS62において、取得部61は、仮説に対応する認識用リーフノードを取得する。

例えば、図9の仮説1の場合、予測形状がパー(右手)であるので、図14のパー243の認識用リーフノードが取得される。

このように、ツリー構造の辞書には多くの辞書が存在するが、仮説に対応する認識用リーフノードを用いるので、全ての認識用リーフノードを用いる必要がなく、より迅速に物体認識処理を実行することができる。

ステップS63において、算出部63は、仮説に対応する認識特徴量を算出する。すなわち、取得された認識用リーフノードに設定されているパラメータを使用し、予測位置を中心とする所定の範囲内の画像に対して、認識特徴量が算出される。

ステップS64において、算出部62は、仮説の信頼度を算出する。ステップS65において、判定部65は、全ての仮説を取得したかを判定する。

ステップS65において、まだ全ての仮説を取得していないと判定された場合、ステップS66において、取得部61は、まだ取得されていない仮説を1つ取得する。ステップS66の処理の後、処理はステップS62に戻り、それ以降の処理が繰り返される。

一方、ステップS65において、全ての仮説が取得されたと判定された場合、ステップS67において、取得部61は、信頼度が第4の閾値以上の仮説を認識結果として取得する。ステップS67の処理の後、処理は図4のステップS6に進む。

なお、ツリー構造の辞書を用いた物体認識処理の場合、図4のステップS6において、判定部65は、信頼度が第4の閾値以上の仮説を取得したかを判定する。

このように、ツリー構造の辞書を用いることで、複数の辞書を1つまとめて容易に管理することができる。

本開示によれば、次のような効果を実現することができる。

(1)事前学習を行い、状態空間の予測を行って、全状態空間のマッチングを行わずに、迅速に、複数の状態の追跡を行うことができる。

(2)状態の予測は、状態空間の中の確率の高い状態を推定することで行われる。物体の位置や大きさの他に、形状や種類といった離散的な状態も予測される。追跡の時、全空間の探索は行わず、予測された状態のみが認識されるので、迅速な処理が可能となる。

(3)全部の状態を同じモデルを使って認識する必要はなく、各状態に最適な認識手法を用いることができる。例えば物体の形状の認識には、Steerable Filterを使用し、位置の認識には、ヒストグラムマッチングを用いることができる。さらに事前学習の際にも、全部の状態を同時に学習する必要はなく、各状態を個別に学習することができる。それにより学習を高速化することができる。

(4)物体の追跡中に追跡結果を使い、認識物体の状態空間と予測モデルと認識手法をオンライン学習することができる。それにより追跡精度を向上させることができる。

(5)状態変化がある目標物体を追跡し、追跡結果を認識して、ジェスチャ認識におけるアプリケーションへの応用が容易となる。

(1)事前学習を行い、状態空間の予測を行って、全状態空間のマッチングを行わずに、迅速に、複数の状態の追跡を行うことができる。

(2)状態の予測は、状態空間の中の確率の高い状態を推定することで行われる。物体の位置や大きさの他に、形状や種類といった離散的な状態も予測される。追跡の時、全空間の探索は行わず、予測された状態のみが認識されるので、迅速な処理が可能となる。

(3)全部の状態を同じモデルを使って認識する必要はなく、各状態に最適な認識手法を用いることができる。例えば物体の形状の認識には、Steerable Filterを使用し、位置の認識には、ヒストグラムマッチングを用いることができる。さらに事前学習の際にも、全部の状態を同時に学習する必要はなく、各状態を個別に学習することができる。それにより学習を高速化することができる。

(4)物体の追跡中に追跡結果を使い、認識物体の状態空間と予測モデルと認識手法をオンライン学習することができる。それにより追跡精度を向上させることができる。

(5)状態変化がある目標物体を追跡し、追跡結果を認識して、ジェスチャ認識におけるアプリケーションへの応用が容易となる。

[その他]

本明細書において、システムの用語は、複数の装置、手段などより構成される全体的な装置を意味するものとする。

本開示の実施の形態は、上述した実施形態に限定されるものではなく、本開示の要旨を逸脱しない範囲において種々の変更が可能である。また、本開示の実施の形態は、一部の機能を他の装置が有していても良い。

なお、本開示の実施の形態においては、認識物体の状態が手の形状および位置であるとしたが、認識物体の状態は、他にも大きさ、回転等を含めてもよい。

また、本開示の実施の形態においては、パーティクルフィルタを用いて予測処理および物体認識処理を実行するとしたが、予測処理および物体認識処理は、カルマンフィルタ等の他の物体追跡手法を用いて実行するようにしてもよい。

図4のステップS4の予測処理における予測モデルの事前学習には、HMM(Hidden Markov Model)法やニューラルネットワーク法を用いることが可能である。

図4のステップS5の物体認識処理には、例えば特開2010−108475号公報のような、Steerable Filterの応答を特徴量としてBoostingを用いて認識器を構成する技術を用いることができる。

また、SSD(Sum of Squared Difference)、カラーヒストグラムのテンプレートマッチング手法などを用いることができる。

さらに全部の状態を同じ認識手法で処理する必要はなく、例えば、局所特徴量を用いて形状の特徴を表現し、色ヒストグラムを用いて色の特徴を表現するなど、各状態に応じてさまざまな特徴量を併用することができる。

また、図5のステップS24の標準パターンと時系列運動パターンをマッチング処理においては、例えば、次の文献の技術を利用することができる。

(1)Michael Isard and Andrew Blake, "CONDENSATION - Conditional Density Propagation for Visual Tracking", International Journal of Computer Vision 29(1),5-28(1998)

(2)Michael Isard and Andrew Blake, "Contour tracking by stochastic propagation of conditional density", In Proc. European Conf. Computer Vision, 1996, pp. 343-356, Cambridge, UK

(1)Michael Isard and Andrew Blake, "CONDENSATION - Conditional Density Propagation for Visual Tracking", International Journal of Computer Vision 29(1),5-28(1998)

(2)Michael Isard and Andrew Blake, "Contour tracking by stochastic propagation of conditional density", In Proc. European Conf. Computer Vision, 1996, pp. 343-356, Cambridge, UK

本開示は、例えばテレビジョン受像器、パーソナルコンピュータなどの情報処理装置をジェスチャで遠隔操作する場合などに適用することができる。

なお、本開示は以下のような構成も取ることができる。

(1)画像から認識物体を認識する物体認識部と、前記認識物体の次の位置および形状を予測する予測部とを備え、前記物体認識部は、前記予測部により予測された前記位置に対応する前記画像の領域内から、予測された前記形状の前記認識物体を認識する情報処理装置。

(2)前記物体認識部は、前記認識物体の前記形状ごとの認識器を有し、予測された前記形状に対応する前記認識器を使用して、前記認識物体を認識する前記(1)に記載の情報処理装置。

(3)前記予測部は、前記物体認識部の過去の認識結果と、予め記憶されている前記認識物体の標準パターンとを比較し、前記過去の認識結果との一致点の多い前記標準パターンに基づいて、前記位置および前記形状を予測する前記(1)または(2)に記載の情報処理装置。

(4)前記予測部は、予測された前記位置および前記形状を組み合せた複数の仮説を生成し、前記物体認識部は、前記仮説に基づいて前記認識物体を認識する前記(1)から(3)のいずれかに記載の情報処理装置。

(5)前記物体認識部の認識結果に基づいて、前記認識物体が認識されやすくなるように、前記認識器のパラメータ、および前記標準パターンのパラメータの少なくとも一方を更新する学習部をさらに備える前記(2)から(4)のいずれかに記載の情報処理装置。

(6)前記予測部は、前記認識物体の大きさおよび回転のうち少なくとも一方をさらに予測し、前記位置および前記形状に、前記大きさおよび前記回転のうち少なくとも一方を組み合せた仮説を生成する前記(1)から(5)のいずれかに記載の情報処理装置。

(7)前記予測部の処理、および前記物体認識部の処理は、パーティクルフィルタの手法を用いて実行される前記(1)から(6)のいずれかに記載の情報処理装置。

(8)前記形状ごとの前記認識器は、ツリー構造により構成される前記(2)から(7)のいずれかに記載の情報処理装置。

(1)画像から認識物体を認識する物体認識部と、前記認識物体の次の位置および形状を予測する予測部とを備え、前記物体認識部は、前記予測部により予測された前記位置に対応する前記画像の領域内から、予測された前記形状の前記認識物体を認識する情報処理装置。

(2)前記物体認識部は、前記認識物体の前記形状ごとの認識器を有し、予測された前記形状に対応する前記認識器を使用して、前記認識物体を認識する前記(1)に記載の情報処理装置。

(3)前記予測部は、前記物体認識部の過去の認識結果と、予め記憶されている前記認識物体の標準パターンとを比較し、前記過去の認識結果との一致点の多い前記標準パターンに基づいて、前記位置および前記形状を予測する前記(1)または(2)に記載の情報処理装置。

(4)前記予測部は、予測された前記位置および前記形状を組み合せた複数の仮説を生成し、前記物体認識部は、前記仮説に基づいて前記認識物体を認識する前記(1)から(3)のいずれかに記載の情報処理装置。

(5)前記物体認識部の認識結果に基づいて、前記認識物体が認識されやすくなるように、前記認識器のパラメータ、および前記標準パターンのパラメータの少なくとも一方を更新する学習部をさらに備える前記(2)から(4)のいずれかに記載の情報処理装置。

(6)前記予測部は、前記認識物体の大きさおよび回転のうち少なくとも一方をさらに予測し、前記位置および前記形状に、前記大きさおよび前記回転のうち少なくとも一方を組み合せた仮説を生成する前記(1)から(5)のいずれかに記載の情報処理装置。

(7)前記予測部の処理、および前記物体認識部の処理は、パーティクルフィルタの手法を用いて実行される前記(1)から(6)のいずれかに記載の情報処理装置。

(8)前記形状ごとの前記認識器は、ツリー構造により構成される前記(2)から(7)のいずれかに記載の情報処理装置。

1 情報処理装置,22 状態予測部, 23 物体認識部, 25 物体学習部,31 パーソナルコンピュータ

Claims (11)

- 画像から認識物体を認識する物体認識部と、

前記認識物体の次の位置および形状を予測する予測部と

を備え、

前記物体認識部は、前記予測部により予測された前記位置に対応する前記画像の領域内から、予測された前記形状の前記認識物体を認識する

情報処理装置。 - 前記物体認識部は、前記認識物体の前記形状ごとの認識器を有し、予測された前記形状に対応する前記認識器を使用して、前記認識物体を認識する

請求項1に記載の情報処理装置。 - 前記予測部は、前記物体認識部の過去の認識結果と、予め記憶されている前記認識物体の標準パターンとを比較し、前記過去の認識結果との一致点の多い前記標準パターンに基づいて、前記位置および前記形状を予測する

請求項2に記載の情報処理装置。 - 前記予測部は、予測された前記位置および前記形状を組み合せた複数の仮説を生成し、

前記物体認識部は、前記仮説に基づいて前記認識物体を認識する

請求項3に記載の情報処理装置。 - 前記物体認識部の認識結果に基づいて、前記認識物体が認識されやすくなるように、前記認識器のパラメータ、および前記標準パターンのパラメータの少なくとも一方を更新する学習部

をさらに備える請求項4に記載の情報処理装置。 - 前記予測部は、前記認識物体の大きさおよび回転のうち少なくとも一方をさらに予測し、前記位置および前記形状に、前記大きさおよび前記回転のうち少なくとも一方を組み合せた仮説を生成する

請求項5に記載の情報処理装置。 - 前記予測部の処理、および前記物体認識部の処理は、パーティクルフィルタの手法を用いて実行される

請求項6に記載の情報処理装置。 - 前記形状ごとの前記認識器は、ツリー構造により構成される

請求項7に記載の情報処理装置。 - 画像から認識物体を認識する物体認識ステップと、

前記認識物体の次の位置および形状を予測する予測ステップと

を含み、

前記物体認識ステップの処理は、前記予測ステップの処理により予測された前記位置に対応する前記画像の領域内から、予測された前記形状の前記認識物体を認識する

情報処理方法。 - コンピュータに、

画像から認識物体を認識する物体認識ステップと、

前記認識物体の次の位置および形状を予測する予測ステップと

を実行させるプログラムであって、

前記物体認識ステップの処理は、前記予測ステップの処理により予測された前記位置に対応する前記画像の領域内から、予測された前記形状の前記認識物体を認識する

プログラムを記録したコンピュータ読み取り可能な記録媒体。 - コンピュータに、

画像から認識物体を認識する物体認識ステップと、

前記認識物体の次の位置および形状を予測する予測ステップと

を実行させるプログラムであって、

前記物体認識ステップの処理は、前記予測ステップの処理により予測された前記位置に対応する前記画像の領域内から、予測された前記形状の前記認識物体を認識する

プログラム。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2011064508A JP2012203439A (ja) | 2011-03-23 | 2011-03-23 | 情報処理装置および情報処理方法、記録媒体、並びにプログラム |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2011064508A JP2012203439A (ja) | 2011-03-23 | 2011-03-23 | 情報処理装置および情報処理方法、記録媒体、並びにプログラム |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2012203439A true JP2012203439A (ja) | 2012-10-22 |

Family

ID=47184437

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2011064508A Withdrawn JP2012203439A (ja) | 2011-03-23 | 2011-03-23 | 情報処理装置および情報処理方法、記録媒体、並びにプログラム |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2012203439A (ja) |

Cited By (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN106471443A (zh) * | 2014-07-04 | 2017-03-01 | 捷豹路虎有限公司 | 用于确定意图目标的设备和方法 |

| JP2018045287A (ja) * | 2016-09-12 | 2018-03-22 | 日本電気株式会社 | 画像処理装置 |

| JP2019519049A (ja) * | 2016-06-23 | 2019-07-04 | アリババ グループ ホウルディング リミテッド | 手検出及び追跡方法並びに装置 |

| JPWO2021131039A1 (ja) * | 2019-12-27 | 2021-07-01 | ||

| US20210286982A1 (en) * | 2019-09-26 | 2021-09-16 | Panasonic Intellectual Property Corporation Of America | Information processing method, recording medium, and information processing device |

| CN113590042A (zh) * | 2021-07-29 | 2021-11-02 | 杭州宏杉科技股份有限公司 | 一种数据保护存储方法、装置及设备 |

-

2011

- 2011-03-23 JP JP2011064508A patent/JP2012203439A/ja not_active Withdrawn

Cited By (13)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2017525074A (ja) * | 2014-07-04 | 2017-08-31 | ジャガー ランド ローバー リミテッドJaguar Land Rover Limited | 所望のターゲットを判定するための装置及び方法 |

| CN106471443A (zh) * | 2014-07-04 | 2017-03-01 | 捷豹路虎有限公司 | 用于确定意图目标的设备和方法 |

| JP2019519049A (ja) * | 2016-06-23 | 2019-07-04 | アリババ グループ ホウルディング リミテッド | 手検出及び追跡方法並びに装置 |

| US10885639B2 (en) | 2016-06-23 | 2021-01-05 | Advanced New Technologies Co., Ltd. | Hand detection and tracking method and device |

| US10885638B2 (en) | 2016-06-23 | 2021-01-05 | Advanced New Technologies Co., Ltd. | Hand detection and tracking method and device |

| JP2018045287A (ja) * | 2016-09-12 | 2018-03-22 | 日本電気株式会社 | 画像処理装置 |

| US20210286982A1 (en) * | 2019-09-26 | 2021-09-16 | Panasonic Intellectual Property Corporation Of America | Information processing method, recording medium, and information processing device |

| US11776320B2 (en) * | 2019-09-26 | 2023-10-03 | Panasonic Intellectual Property Corporation Of America | Information processing method of predicting calculation amount suitable for recognizing motion of object |

| JPWO2021131039A1 (ja) * | 2019-12-27 | 2021-07-01 | ||

| JP7331949B2 (ja) | 2019-12-27 | 2023-08-23 | 日本電気株式会社 | 画像処理装置、画像処理方法、学習装置、学習方法、及び、プログラム |

| WO2021131039A1 (ja) * | 2019-12-27 | 2021-07-01 | 日本電気株式会社 | 画像処理装置、画像処理方法、学習装置、学習方法、及び、記録媒体 |

| CN113590042A (zh) * | 2021-07-29 | 2021-11-02 | 杭州宏杉科技股份有限公司 | 一种数据保护存储方法、装置及设备 |

| CN113590042B (zh) * | 2021-07-29 | 2024-03-19 | 杭州宏杉科技股份有限公司 | 一种数据保护存储方法、装置及设备 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US10269125B1 (en) | Method for tracking object by using convolutional neural network including tracking network and computing device using the same | |

| JP6625220B2 (ja) | シーン内のオブジェクトのアクションを検出する方法及びシステム | |

| US11836931B2 (en) | Target detection method, apparatus and device for continuous images, and storage medium | |

| JP4208898B2 (ja) | 対象物追跡装置および対象物追跡方法 | |

| JP4708422B2 (ja) | 両手動作の追跡 | |

| JP7146247B2 (ja) | 動作認識方法及び装置 | |

| JP2020530162A (ja) | アクションを検出する方法及びシステム | |

| KR102133728B1 (ko) | 인공지능을 이용한 멀티모달 감성인식 장치, 방법 및 저장매체 | |

| US8600108B2 (en) | Data processing system and method | |

| JP2012203439A (ja) | 情報処理装置および情報処理方法、記録媒体、並びにプログラム | |

| US9299161B2 (en) | Method and device for head tracking and computer-readable recording medium | |

| EP3035235B1 (en) | Method for setting a tridimensional shape detection classifier and method for tridimensional shape detection using said shape detection classifier | |

| KR20160096460A (ko) | 복수의 분류기를 포함하는 딥 러닝 기반 인식 시스템 및 그 제어 방법 | |

| KR20130141657A (ko) | 제스처 인식을 위한 시스템 및 방법 | |

| US20100316298A1 (en) | Multiple view face tracking | |

| JP2012098988A (ja) | 画像処理装置および方法、並びにプログラム | |

| CN110942142B (zh) | 神经网络的训练及人脸检测方法、装置、设备和存储介质 | |

| CN114092521A (zh) | 基于多阶段自适应网络的鲁棒目标跟踪方法及系统 | |

| KR20130091441A (ko) | 물체 추적 장치 및 그 제어 방법 | |

| JP2021015479A (ja) | 行動認識装置、行動認識方法、及び行動認識プログラム | |

| JP2011204181A (ja) | 経路設定装置、経路設定方法、及びプログラム | |

| US9508026B2 (en) | System and a method for camera motion analysis and understanding from a video sequence | |

| KR101982942B1 (ko) | 객체 추적 방법 및 이를 수행하는 장치들 | |

| JP2017033175A (ja) | 画像処理装置、画像処理方法及びプログラム | |

| JP2013152595A (ja) | 情報処理装置および方法、並びにプログラム |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A300 | Withdrawal of application because of no request for examination |

Free format text: JAPANESE INTERMEDIATE CODE: A300 Effective date: 20140603 |