JP2007266902A - Camera - Google Patents

Camera Download PDFInfo

- Publication number

- JP2007266902A JP2007266902A JP2006088071A JP2006088071A JP2007266902A JP 2007266902 A JP2007266902 A JP 2007266902A JP 2006088071 A JP2006088071 A JP 2006088071A JP 2006088071 A JP2006088071 A JP 2006088071A JP 2007266902 A JP2007266902 A JP 2007266902A

- Authority

- JP

- Japan

- Prior art keywords

- time

- shooting

- image

- classification

- display

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

Images

Abstract

Description

本発明は、数多く撮り込んだカメラの撮影画像の中から、所望の画像を検索するためのカメラに関するものである。 The present invention relates to a camera for searching for a desired image from images taken by a camera taken many times.

近年、小型のデジタルカメラの普及やカメラが携帯電話器や携帯音楽プレーヤに搭載されるようになっている。そして、1人の人が日常撮影する画像の数が多くなっており、カメラの取込んだ画像を、後で鑑賞しようとしても、見つけるのに時間がかかってしまい、あきらめてしまうことも多かった。また、インターネットのサイト運営の会社等も、近年、画像や音楽を検索する技術を重視している。 In recent years, the spread of small digital cameras and cameras have been installed in mobile phones and portable music players. In addition, the number of images taken by one person on a daily basis has increased, and even if you try to view the images captured by the camera later, it often takes time to find them and often gives up. . In addition, Internet site management companies and the like have recently emphasized technology for searching for images and music.

そして、従来から、画像に感性的なキーワードをつける技術(例えば、下記特許文献1参照)や、意味情報をつける技術(例えば、下記特許文献2参照)や、文章によって検索するような技術(例えば、下記特許文献3参照)等が知られていた。また、撮影地点を画像と関連付ける技術も提案されている(例えば、下記特許文献4参照)。

Conventionally, a technique for attaching a sensitive keyword to an image (for example, see

一方、下記特許文献5のように、過去の画像を小さく表示するような技術も知られている。

しかしながら、上述した特許文献1乃至4の先行技術は、画像に様々なテキスト情報が関連付けられ、辞書情報のように、膨大なデータベースを必要とした上、文章を入力する等、入力時にユーザに多くの負荷がかかったりした。そのため、ユーザに負荷がかからない簡単な操作によって効率的な画像検索を行うことのできるカメラが望まれていた。

However, the above-described prior arts of

また、上記特許文献5は、過去の画像を小さく表示するような技術が記載されているが、これらは2次元方向に意味を持たせておらず、従来のカレンダー式のものと差異がないものであった。

Moreover, although the said

したがって本発明は上記課題に鑑みてなされたものであり、その目的は、撮影時に付加する簡単な情報から簡単な操作によって、効率的な画像検索を行うように画像を分類し、表示することのできるカメラを提供することである。 Therefore, the present invention has been made in view of the above problems, and its purpose is to classify and display images so as to perform efficient image search by simple operation from simple information added at the time of shooting. It is to provide a camera that can.

すなわち請求項1に記載の発明は、撮影により画像データを得る撮影手段と、撮影時の場所を表す撮影位置情報を検出する位置検出手段と、撮影時の時刻情報を検出する時刻検出手段と、上記画像データ、撮影位置情報、及び時刻情報を記憶する記憶手段と、上記撮影位置情報、時間情報及び撮影手段で撮影した画像データ数に従って上記画像データの分類方法を変更して表示する分類表示手段と、を具備することを特徴とする。

That is, the invention described in

請求項2に記載の発明は、請求項1に記載の発明に於いて、上記分類表示手段は、上記撮影時の時間が所定の間隔で近接し、且つ、撮影時の場所を表す位置情報が所定の距離の関係にある複数の画像データをまとめて分類し、且つその画像データ数に従った大きさの図形で表示することを特徴とする。 According to a second aspect of the present invention, in the first aspect of the present invention, the classification display means is configured such that the photographing time is close at a predetermined interval, and positional information indicating a photographing place is provided. A plurality of image data having a predetermined distance relationship are grouped together and displayed as a graphic having a size according to the number of image data.

請求項3に記載の発明は、請求項1に記載の発明に於いて、上記分類表示手段は、画面の奥行きと視認される方向に撮影時の時刻を表し、該奥行き方向以外の方向に時間以外の撮影位置等を表し、上記奥行き方向に分布する図形の大きさに従って、上記撮影時に撮影された画像の数を表示することを特徴とする。 According to a third aspect of the present invention, in the first aspect of the invention, the classification display means represents a shooting time in a direction visually recognized as a depth of the screen, and a time in a direction other than the depth direction. The number of images taken at the time of shooting is displayed according to the size of the figure distributed in the depth direction.

請求項4に記載の発明は、請求項1に記載の発明に於いて、上記分類方法は、撮影された画像データが前回の撮影と時間、位置が離れていない場合には前回の画像データと同一のフォルダに分類し、更に上記時間、位置が離れていても単独の画像データを前回の画像データと同一のフォルダに分類することを特徴とする。 According to a fourth aspect of the present invention, in the first aspect of the invention, the classification method may be configured such that when the captured image data is not separated from the previous photographing by the time and position, the previous image data is obtained. It is characterized in that it is classified into the same folder, and even if the time and position are separated, the single image data is classified into the same folder as the previous image data.

請求項5に記載の発明は、請求項1に記載の発明に於いて、上記分類表示手段は、画面の奥行きと視認される方向に撮影時の日時を表し、該奥行き方向と直交する方向に撮影地点を表し、上記画像フォルダ内の画像の数を、該フォルダを示す図形内に表示することを特徴とする。 According to a fifth aspect of the present invention, in the first aspect of the present invention, the classification display means represents the date and time at the time of photographing in a direction visually recognized as the depth of the screen, and in a direction orthogonal to the depth direction. It represents a shooting point, and the number of images in the image folder is displayed in a graphic showing the folder.

請求項6に記載の発明は、請求項1に記載の発明に於いて、上記分類表示手段は、特定の位置を基準位置として、時間及び方向に基づいて保存された写真を、表示サイズと表示位置を変えて表示することを特徴とする。 According to a sixth aspect of the present invention, in the first aspect of the invention, the classification display means displays a photograph stored based on time and direction with a specific position as a reference position and a display size. It is characterized by being displayed with its position changed.

請求項7に記載の発明は、請求項1に記載の発明に於いて、上記分類表示手段は、保存された写真の位置情報の中心となる位置を基準位置として表示することを特徴とする。 According to a seventh aspect of the present invention, in the first aspect of the invention, the classification display unit displays a position that is the center of the position information of the stored photograph as a reference position.

請求項8に記載の発明は、請求項1に記載の発明に於いて、上記分類表示手段は、分類に応じて表示領域を複数設け、更に各分類の時間の古いものを同じ基準点に近付くように表示することを特徴とする。

The invention according to

請求項9に記載の発明は、被写体を撮影する撮影手段と、上記撮影手段で撮影を行った撮影位置を検出する位置検出手段と、撮影時の時間情報を検出する時刻検出手段と、上記位置検出手段と上記時刻検出手段の出力に基づき、上記撮影位置の情報、上記時間情報及び上記撮影した写真の枚数に従って写真の情報を分類する分類手段と、上記分類手段で分類された上記写真の情報を表示する表示手段と、を具備することを特徴とする。 According to a ninth aspect of the present invention, there is provided a photographing means for photographing a subject, a position detecting means for detecting a photographing position at which photographing is performed by the photographing means, a time detecting means for detecting time information at the time of photographing, and the position Based on the output of the detection means and the time detection means, classification means for classifying the information of the photograph according to the information on the photographing position, the time information, and the number of the photographed photographs, and the information on the photograph classified by the classification means Display means for displaying.

請求項10に記載の発明は、請求項9に記載の発明に於いて、上記分類手段は、上記撮影時の時間が所定の間隔で近接し、且つ、撮影時の場所が所定の距離の関係にある複数の写真をまとめて、且つその写真枚数に従った大きさの図形で分類することを特徴とする。 According to a tenth aspect of the present invention, in the invention according to the ninth aspect, the classifying means has a relationship in which the photographing time is close at a predetermined interval and the photographing location is a predetermined distance. A plurality of photographs in the above are collected and classified by a figure having a size according to the number of photographs.

請求項11に記載の発明は、請求項9に記載の発明に於いて、上記撮影手段で撮影された写真を時間及び方向に基づいて保存する保存手段を更に具備し、上記分類手段は、特定の位置を基準位置として、上記保存手段に保存された写真の情報を、表示サイズと表示位置を変えて表示することを特徴とする。

The invention according to

請求項12に記載の発明は、請求項11に記載の発明に於いて、上記分類手段は、保存された写真の位置情報の中心となる位置を基準位置とすることを特徴とする。 According to a twelfth aspect of the present invention, in the invention according to the eleventh aspect, the classification means uses a position that is the center of position information of a stored photograph as a reference position.

請求項13に記載の発明は、請求項9に記載の発明に於いて、上記表示手段は、上記分類手段による分類に応じて表示領域を複数設け、更に各分類の時間の古いものを同じ基準点に近付くように表示することを特徴とする。

The invention according to

請求項14に記載の発明は、請求項9に記載の発明に於いて、上記撮影手段で撮影された画像を保存する保存手段を更に具備し、上記表示手段は、上記保存手段で保存された画像について、画面の奥行きと視認される方向に撮影時の時刻を表し、該奥行き方向以外の方向に時間以外の少なくとも撮影位置を表し、上記奥行き方向に分布する図形の大きさに従って、上記撮影された画像の撮影時の情報を表示することを特徴とする。

The invention described in

請求項15に記載の発明は、請求項9に記載の発明に於いて、上記撮影手段で撮影された画像をフォルダ毎に保存する保存手段を更に具備し、上記表示手段は、上記保存手段で保存された画像について、画像の奥行きと視認される方向に撮影時の日時を表し、該奥行き方向と直交する方向に撮影地点を表し、上記フォルダ内の画像の情報を、該フォルダを示す図形内に表示することを特徴とする。 A fifteenth aspect of the present invention is the information processing apparatus according to the ninth aspect of the present invention, further comprising storage means for storing the images photographed by the photographing means for each folder, wherein the display means is the storage means. For the stored image, the date and time of shooting is shown in the direction of visual recognition and the depth of the image, the shooting point is shown in the direction orthogonal to the depth direction, and the image information in the folder is stored in the figure indicating the folder. It is characterized by displaying.

本発明によれば、ユーザにわかりやすい表示と簡単な操作によって画像検索を行うことができるように、撮影時の情報を駆使して撮影された画像データを分類し、ビジュアルに表した画面から感覚的に適切な画像を選択することができる。 According to the present invention, image data captured using information at the time of shooting is classified so that the user can perform an image search with an easy-to-understand display and simple operation. A suitable image can be selected.

以下、図面を参照して本発明の実施形態を説明する。 Hereinafter, embodiments of the present invention will be described with reference to the drawings.

図1は、本発明の一実施形態に係るカメラの基本構成を示すブロック図である。このカメラは、メインCPU(以下、MPUと記す)11と、複数のスイッチ11a、11b、11cと、信号処理部12と、撮影位置検出部13と、時計部14と、フラッシュROM15と、アナログフロントエンド部(AFE)18と、RAM19と、メモリ20と、表示部21と、マイクロホン22と、スピーカ23と、プリント信号出力部25と、無線通信部26と、撮像素子28及び撮影レンズ29とを有して構成される。

FIG. 1 is a block diagram showing a basic configuration of a camera according to an embodiment of the present invention. The camera includes a main CPU (hereinafter referred to as MPU) 11, a plurality of

図1に於いて、制御手段と分類手段の機能を有するMPU11はマイクロコントローラ等から構成されるもので、ユーザによる各種の操作をスイッチ11a、11b、11cの状態によって検出する。更に、MPU11は、上記スイッチ11a、11b、11cの検出結果とフラッシュROM15内に記憶されているプログラムに従って、後述する各ブロックをシーケンシャルに制御して、撮影や再生のシーケンスを実行する。尚、スイッチ11a〜11cは、電源のオン、オフを行う電源スイッチ(11a)や、レリーズスイッチ(11b)、後述する撮影と再生やその他のスイッチ(11c)として選択手段としての機能を有しており、ユーザの操作を入力するものである。

In FIG. 1, an

上記MPU11には、圧縮手段である信号処理部12と、撮影位置検出部13と、時計部14と、フラッシュROM15とが接続されている。上記信号処理部12では、色補正や信号圧縮等の処理が行われる。また、信号処理部12の内部には、画像処理時の補正のかけ方を変更したり、特定の信号を付加するための補助ブロック12aを有している。

Connected to the

上記撮影位置検出部13は、図示されない衛星を用いたグローバルポジショニングシステム(GPS)等により、撮影位置を検出して記録可能とした位置検出手段である。また、時刻検出手段である時計部14は、撮影の日時を記録できるようにする他、露出の時間を計時したり、所定のタイミングの間隔を測定したりする時に利用されるものである。更に、フラッシュROM15は、本カメラのMPU11が実行する種々のプログラムや、本カメラに関する各種調整値が記憶されている。

The photographing

上記信号処理部12には、また、アナログフロントエンド部18と、RAM19と、メモリ20と、表示部21と、音声入力手段であるマイクロホン22と、スピーカ23と、プリント信号出力部25と、無線通信部26とが接続されている。また、アナログフロントエンド部18には、撮影時に、撮影レンズ29から入射された被写体30の像を結像する撮影手段である撮像素子28が接続されている。この撮像素子28は、CCDやCMOSセンサ等により構成されるもので、上記被写体の像を光電変換して画像信号にするものである。

The

上記アナログフロントエンド部18では、変換された画像信号の読み出しやA/D変換が行われる。そして、このアナログフロントエンド部18で変換されたデジタル画像信号は、信号処理部12に入力される。そして、信号処理部12にて種々の画像処理が施され画像データを生成する。そして、この画像データは、記録手段である着脱自在のメモリ20に記録される。ここで、メモリ20に記録される画像データは、カメラの設定に応じて適当なデータ量に圧縮されて記録される。この時、種々の演算を行うために、RAM19に適宜データが格納される。本発明では、動画も、先ずここに格納される。

The analog

MPUと共に分類表示手段を構成する表示部(表示手段)21は、LCD等から構成される。そして、構図決定は、この表示部21によって撮像素子28からの信号を逐次再生して表示することによって、被写体30の状態を確認して行われる。再生表示は、ユーザのスイッチ11cの操作に従って、メモリ20内の圧縮された画像データが信号処理部12に読み出されて表示データに変換され、表示部21に表示されることによって行われる。同様に、音声の再生は、上記スイッチ11cの操作に従って、メモリ20内の圧縮された音声データが信号処理部12に読み出されて音声データに変換され、スピーカ23より出力される。

The display unit (display unit) 21 that constitutes the classification display unit together with the MPU is configured by an LCD or the like. The composition is determined by confirming the state of the subject 30 by sequentially reproducing and displaying signals from the

撮影された画像等は、プリント信号出力部25や無線通信部26を介して、図示されない外部機器に送信が可能である。

The captured image or the like can be transmitted to an external device (not shown) via the print

このような構成に於いて、ユーザがスイッチ11a〜11cを操作すると、その状態がMPU11によって検出され、フラッシュROM15に記憶されているプログラムに従って、各ブロックがシーケンシャルに制御されて、撮影や再生のシーケンスが実行される。

In such a configuration, when the user operates the

撮影時には、撮影レンズ23から入射した被写体25の像が、撮像素子22によって取り込まれて電気信号に変換され、アナログフロントエンド部18を介してデジタル画像信号が信号処理部12に入力される。そして、この信号処理部12にて色補正や画像圧縮等の処理が行われ、その結果として圧縮画像データ、日時データ、位置データがメモリ20に記録されて撮影が終了する。

At the time of shooting, an image of the subject 25 incident from the shooting

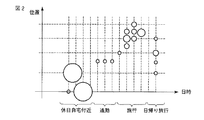

このような構成のカメラを使用して、写真撮影した結果について、横軸に日時、縦軸に撮影した位置をとってグラフ化すると、図2に示されるようになる。この例では、休日の自宅付近で子供や身近なものを撮影した例や、会社で撮影した例や、旅行や日帰り旅行に行った時の写真が分類されて表示されている。尚、図2に於いて、撮影枚数は白丸の大きさで表示している。 FIG. 2 shows the result of taking a picture using the camera having such a configuration, with the horizontal axis representing the date and time and the vertical axis representing the photographed position. In this example, an example in which a child or familiar object is photographed near a holiday home, an example photographed at a company, or a photograph taken when traveling or a day trip is displayed. In FIG. 2, the number of shots is indicated by the size of a white circle.

これらの図2に示されたグラフを単純な日付け管理にして表すと、図3に示されるようになる。この図3のカレンダー表示でも、撮影枚数を白丸の大きさで表している。 When these graphs shown in FIG. 2 are represented by simple date management, they are as shown in FIG. In the calendar display of FIG. 3, the number of shots is represented by the size of white circles.

しかしながら、図3の例では、どれが旅行に行った時の写真かわからない、という問題が生じるおそれがある。また、日曜日に学校の行事やパーティ等のイベントがあると、例えば、撮影日よりも後になって旅行に行った時の写真を見たくなった時等に、写真を多く撮った日が旅行日であると思っていても実際には違うことがある。 However, in the example of FIG. 3, there is a possibility that a problem may occur that it is not known which photograph is taken when traveling. Also, if there is a school event or a party on Sunday, for example, when you want to see a photo when you went on a trip later than the shooting date, the day when you took many photos Even if you think it is, there are actually differences.

このように、時間だけで写真を管理するには無理がある。一方、図2のグラフのように位置の情報を加味すると、図3のグラフと比べて、白丸の数が増えていることがわかり、分類が細かすぎるという問題を生じることがわかる。つまり、これら図2、図3に示されるような形式では、もう少し大まかな分類にしないと検索が大変になるということがわかる。 In this way, it is impossible to manage photos by time alone. On the other hand, when position information is added as in the graph of FIG. 2, it can be seen that the number of white circles is increased compared to the graph of FIG. 3, and there is a problem that the classification is too fine. In other words, it can be understood that, in the formats shown in FIGS. 2 and 3, the search becomes difficult unless the classification is made a little more roughly.

更には、フォルダ内に複数の画像が含まれているようにして表示すると、図2のグラフは図4のように表される。この場合、フォルダ内には複数の画像が含まれていることが好ましいが、フォルダ内の画像数が多すぎても好ましくない。それは、フォルダを検索することができても、その後の画像検索が困難となってしまうからである。 Further, when the folder is displayed so that a plurality of images are included, the graph of FIG. 2 is represented as shown in FIG. In this case, the folder preferably includes a plurality of images, but it is not preferable that the number of images in the folder is too large. This is because even if a folder can be searched, subsequent image search becomes difficult.

したがって、本発明では適当な数の画像を含むフォルダを、先ずユーザにて目視可能として検索を容易にし、その後にユーザの操作により当該フォルダ内の画像を検索するようにしている。 Therefore, in the present invention, a folder including an appropriate number of images is first made visible to the user so that the search can be facilitated, and then the images in the folder are searched by user operation.

すなわち、初めは、図5(a)に示されるように、例えばユーザがカメラ35の背面に設けられた表示部21としての液晶ディスプレイ31上に表示された、図4のようなグラフを目視している。次に、この状態で、ユーザの指36によって、表示部21を構成するタッチセンサ32を操作するか、図5(b)に示されるように、カメラ35の背面部に設けられた十字キースイッチ33を操作して、希望するフォルダを選択する。この場合、斜線で示されるフォルダが選択されたものとする。そして、図5(c)に示されるように、液晶ディスプレイ31に表示された当該フォルダ内の画像を検索するようにする。

That is, first, as shown in FIG. 5A, for example, the user visually observes a graph as shown in FIG. 4 displayed on the

カメラ背面に表示可能なスペースから考えても、図2のグラフのような細かい表示よりも、図4のグラフのような大まかな表示にした方がユーザの直感に近く、使いやすい表示にすることができる。更に、図6に示されるように、画面に奥行きを感じさせるようにして、過去の記憶は奥にあるような表示にして、遠い所に行った時の画像は上の方にあるような表示にすると、更にグラフ等を見慣れないユーザにも理解しやすい表示となる。 Considering the space that can be displayed on the back of the camera, it is closer to the user's intuition and easier to use than the detailed display such as the graph shown in FIG. Can do. In addition, as shown in FIG. 6, the screen is made to feel the depth, the past memory is displayed at the back, and the image when going to a distant place is at the top. Then, the display is easy to understand even for users who are not familiar with graphs and the like.

次に、図7及び図8のフローチャートを参照して、このような分類表示が可能なカメラの動作について説明する。尚、このカメラの動作は、主にカメラ内のMPU11の制御によって行われる。

Next, the operation of the camera capable of such classification display will be described with reference to the flowcharts of FIGS. The operation of this camera is mainly performed by controlling the

本ルーチンが開始されると、先ず、ステップS1に於いて、撮影モードか再生モードかが判定される。このモード選択は、ユーザの操作により行われる。ここで、再生モードが選択された場合は、後述するステップS28へ移行する。一方、再生モード以外が選択された場合は、撮影が開始されるように、ステップS2に於いてレリーズスイッチ11aの状態が判定される。ここで、撮影が開始されない場合は上記ステップS1に移行し、撮影が開始される場合は、ステップS3以降の撮影シーケンスが実行される。

When this routine is started, first, in step S1, it is determined whether the photographing mode or the reproduction mode. This mode selection is performed by a user operation. Here, when the reproduction mode is selected, the process proceeds to step S28 described later. On the other hand, when a mode other than the playback mode is selected, the state of the

すなわち、ステップS3及びS4にて、ピント合わせ及び露出制御が、被写体30の条件に合わせて行われる。次いで、ステップS5にて、画像信号が撮像素子28から信号処理部12に取込まれる。そして、ステップS6にて、その画像の特徴(色や明るさ、被写体形状や距離等)を簡単に分類できるような特徴が抽出される。この特徴抽出には、例えば、近年発展している人物検知を利用してもよい。

That is, in steps S3 and S4, focusing and exposure control are performed according to the conditions of the subject 30. Next, in step S <b> 5, the image signal is taken from the

次に、ステップS7では画像が圧縮され、更にステップS8及びS9にて、撮影の位置や日時、時刻が検出される。ステップS10では、これら検出された位置や時刻等がメモリ20に記録される。 Next, in step S7, the image is compressed. In steps S8 and S9, the shooting position, date and time, and time are detected. In step S <b> 10, the detected position and time are recorded in the memory 20.

ステップS11以降は、このような1回の撮影毎の画像ファイルを幾つか集めて画像フォルダにまとめるためのフローチャートである。 Steps S11 and thereafter are flowcharts for collecting several image files for each photographing and collecting them in an image folder.

つまり、ステップS11では、今回撮影された撮影画像と前回撮影された撮影画像の位置情報や日時情報が比較される。次いで、ステップS12では、自宅画像と今撮影された画像との位置差が検出される。 That is, in step S11, the position information and the date / time information of the captured image captured this time and the previously captured image are compared. Next, in step S12, a positional difference between the home image and the image just taken is detected.

ところで、本実施形態のカメラには、自宅での撮影は、カメラ購入後に行うように促す機能があり、その時のGPS情報や日時情報がメモリ20内に記録されている。そして、ステップS13以降の処理では、前回の撮影や自宅での撮影の結果を利用して、上記ステップS11及びS12のGPS(位置)情報や日時時刻情報の差より、撮影画像が既に存在するフォルダに入れるか、新しいフォルダに入れるかが決定される。 By the way, the camera of the present embodiment has a function of prompting photographing at home after purchase of the camera, and GPS information and date / time information at that time are recorded in the memory 20. In the processing after step S13, a folder in which a photographed image already exists is obtained from the difference between the GPS (position) information and date / time information in steps S11 and S12 using the result of the previous photographing or the photographing at home. It is decided whether to put it in the new folder.

すなわち、ステップS13に於いて、撮影された日が前の撮影と同じ日であるか否かが判定される。その結果、同じ日であれば後述するステップS23に移行し、別の日であればステップS14へ移行する。 That is, in step S13, it is determined whether or not the date of shooting is the same as the previous shooting. As a result, if it is the same day, it will transfer to step S23 mentioned later, and if it is another day, it will transfer to step S14.

上記ステップS13にて別の日であると判定された場合は、次にステップS14に於いて前回の撮影と今回の撮影の地点が20km以上離れているか否かが判定される。ここで、20km離れていない場合は、ステップS21に移行して、フォルダ内の画像数が多いか否かが判定される。これは、同じフォルダで管理したいが、上述したように、同一のフォルダ内にあまりにも多くの画像が入ると検索が大変になってしまうので、ステップS21にて、画像が多すぎるようであれば後述するステップS15に移行し、そうでない場合はステップS22に移行して、前の撮影画像が分類されたのと同じフォルダ(旧フォルダ)に記録された後、ステップS20へ移行する。 If it is determined in step S13 that it is another day, it is then determined in step S14 whether or not the previous shooting point and the current shooting point are separated by 20 km or more. Here, if it is not 20 km away, the process proceeds to step S21, and it is determined whether the number of images in the folder is large. This is to be managed in the same folder. However, as described above, if there are too many images in the same folder, the search becomes difficult, so if there are too many images in step S21. The process proceeds to step S15 to be described later. Otherwise, the process proceeds to step S22, and after the previous captured image is recorded in the same folder (old folder) as classified, the process proceeds to step S20.

一方、上記ステップS14にて、20km以上離れていると判定された場合には、ステップS15及びS16に移行して、新しいフォルダが作成されて、そこに今回撮影された画像が記録されるようにしている。これによって旧フォルダは、それ以上の画像を含まず、これからの画像は新しいフォルダに記録されることとなる。 On the other hand, if it is determined in step S14 that the distance is 20 km or more, the process proceeds to steps S15 and S16 so that a new folder is created and the image taken this time is recorded there. ing. As a result, the old folder does not contain any more images, and future images are recorded in the new folder.

但し、ステップS17に於いて、もう画像が含まれないようにした旧フォルダがたった1枚の画像しか含まないと判定された場合には、ステップS18に移行して、旧フォルダ内の画像が、更に前のフォルダ(旧々フォルダ)に含まれるように記録される。これはフォルダと称しながら、1枚しか画像を含んでいない場合には、検索時に手間がかかるのを防止するためである。したがって、フォルダ数をなるべく減らすために、続くステップS19にて、画像が存在しなくなったフォルダは削除されるようにしている。尚、上記ステップS17にて旧フォルダの画像が1枚でない場合は、ステップS18及びS19はスキップされる。 However, if it is determined in step S17 that the old folder that no longer contains images contains only one image, the process proceeds to step S18, and the images in the old folder are Furthermore, it is recorded so as to be included in the previous folder (old folder). This is to prevent troubles in searching when a folder includes only one image although it is called a folder. Therefore, in order to reduce the number of folders as much as possible, in the subsequent step S19, the folder in which no image exists is deleted. Note that if the image in the old folder is not one in step S17, steps S18 and S19 are skipped.

一方、上記ステップS21にて、旧フォルダが1枚の画像だけではない場合は、ステップS22に移行して、そのまま旧フォルダに画像が記録される。 On the other hand, if the old folder is not only one image in step S21, the process proceeds to step S22, and the image is recorded in the old folder as it is.

尚、ここでは、旧フォルダより前に作られた旧々フォルダに画像を入れるようにしたが勿論、新フォルダの中に旧フォルダの内容を入れてフォルダ数を減少させるようにしてもよい。 Here, the image is put in the old folder created before the old folder, but the contents of the old folder may be put in the new folder to reduce the number of folders.

こうして、もう新たに画像を含まなくなったフォルダは、ステップS20にて、中に含まれる各画像の日時や、GPS情報による経度や緯度の中心値や、上記ステップS6で得られた画像の特徴によって分類可能となるような信号が付加される。これを利用して、再生モードで検索する場合には、液晶ディスプレイ31の画面上での図示を容易にできるようにする。

Thus, a folder that no longer contains an image is determined in step S20 according to the date and time of each image contained therein, the center value of longitude and latitude according to GPS information, and the characteristics of the image obtained in step S6. A signal that can be classified is added. Using this, when searching in the playback mode, the

上記ステップS13にて同じ日の画像であると判定された場合は、次にステップS23に於いて、フォルダ内の画像数が多いか否かが判定される。これは、同じ日に撮影された画像は、極力同じフォルダで管理したいが、上述したように、同一のフォルダ内にあまりにも多くの画像が入ると検索が大変になってしまうので、ステップS23にて、画像が多すぎるようであれば、後述するステップS24〜S27にて別フォルダに記録することができるようにしている。 If it is determined in step S13 that the images are on the same day, it is next determined in step S23 whether the number of images in the folder is large. This is because images taken on the same day want to be managed in the same folder as much as possible. However, as described above, if too many images are included in the same folder, the search becomes difficult. If there are too many images, steps S24 to S27 described later can be recorded in another folder.

すなわち、上記ステップS23にて画像数が多くないと判定された場合は、上記ステップS22へ移行して、旧フォルダに記録される。また、上記ステップS23にて、旧フォルダの画像数が多いと判定された場合は、続くステップS24に於いて、今回の撮影位置が離れているか、例えばこの場合は自宅から20km以上離れているか否かが判定される。その結果、20km以上離れている場合はステップS25に移行し、そうでない場合はステップS26へ移行する。 That is, if it is determined in step S23 that the number of images is not large, the process proceeds to step S22 and is recorded in the old folder. If it is determined in step S23 that the number of images in the old folder is large, it is determined in subsequent step S24 whether the current shooting position is far away, for example, 20 km or more away from home in this case. Is determined. As a result, if the distance is 20 km or more, the process proceeds to step S25, and if not, the process proceeds to step S26.

ステップS25では、今回の撮影位置が前回の撮影位置と10km以上離れているか否かが判定される。ここで、10km以上離れている場合はステップS27へ移行するが、そうでない場合は上記ステップS22へ移行して旧フォルダに画像が記録される。 In step S25, it is determined whether or not the current shooting position is 10 km or more away from the previous shooting position. If the distance is 10 km or more, the process proceeds to step S27. If not, the process proceeds to step S22, and the image is recorded in the old folder.

ステップS26では、今回の撮影位置が前回の撮影位置とが500m以内であるか否かが判定される。ここで、500m以内である場合はステップS27へ移行し、そうでない場合は上記ステップS15へ移行する。ステップS27では、前回の撮影から2時間が経過したか否かが判定される。ここで、2時間が経過したならば上記ステップS15へ、経過していない場合は上記ステップS22へ、それぞれ移行する。 In step S26, it is determined whether or not the current shooting position is within 500 m from the previous shooting position. Here, when it is within 500 m, it transfers to step S27, and when that is not right, it transfers to said step S15. In step S27, it is determined whether or not two hours have passed since the previous shooting. If 2 hours have elapsed, the process proceeds to step S15. If not, the process proceeds to step S22.

上述したように、ステップS24〜S27に於いて、撮影位置が離れておらず時間も経過していない場合は、ステップS22にて前回の撮影画像が分類されたのと同じフォルダに記録される。しかし、その条件を満たしていないと、フォルダ内の画像数が多すぎて検索できない(例えば、図5(c)の表示部31の画面に表示しきれない)ので、ステップS22に移行して、新フォルダを作成し、そこに分類記録する。

As described above, in steps S24 to S27, if the shooting position is not separated and the time has not elapsed, the previous shot image is recorded in the same folder as that in step S22. However, if the condition is not satisfied, the number of images in the folder is too large to be searched (for example, it cannot be displayed on the screen of the

上記ステップS24〜S27の処理で特徴的なのは、自宅から20km以下でそれほど離れていない場合には、前回の撮影との位置の比較を500mで行い(ステップS26)、自宅から20km以上離れている場合には、10km以内の差ではほぼ同じ位置と判定する(ステップS25)点である。これは、自宅付近であれば、あまり離れていない場所でも別の場所と認識しやすいことに対応し、一方、自宅から20km以上離れている場合には、例えば旅先で激しく動き回っていたりするので、10km以内の差ではほぼ同じ位置と判定するようにしているからである。 What is characteristic of the processing in steps S24 to S27 is that if the distance from the home is 20 km or less and not so far, the position is compared with the previous shooting at 500 m (step S26), and the distance from the home is 20 km or more. The point is determined to be substantially the same position within a difference of 10 km (step S25). This corresponds to the fact that it is easy to recognize another place even if it is near the house if it is near the house, while if it is 20 km or more away from the house, for example, it is moving around violently on the road, This is because it is determined that the positions are almost the same if the difference is within 10 km.

上記ステップS1に於いて再生モードであると判定された場合は、ステップS28移行の再生モードに入る。これにより、カメラ35の背面に設けられた液晶ディスプレイ31で撮影画像を観賞することができるようになる。そして、先ずステップS28に於いて、ユーザの自宅付近のGPS情報の有無が判定される。ここで、ユーザの自宅付近のGPS情報がメモリ20に記録されている場合はステップS32に移行するが、記録されていない場合は、ステップS29に移行する。

If it is determined in step S1 that the playback mode is set, the process enters the playback mode in step S28. As a result, the photographed image can be viewed on the

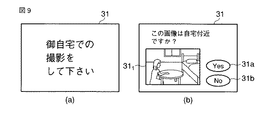

ステップS29では、図9(a)に示されるような警告表示が行われる。次いで、ステップS30に於いて、レリーズ操作の有無が判定される。つまり、上記ステップS29で表示された警告表示を自宅で見たユーザにより、レリーズ動作が行われれば、ステップS31に移行して、その時の日時とGPS情報がカメラのメモリ20に記録される。これにより、上記ステップS11及びS12の比較時のデータとして利用できるようになる。 In step S29, a warning display as shown in FIG. 9A is performed. Next, in step S30, it is determined whether or not a release operation has been performed. That is, if the user who viewed the warning display displayed in step S29 performs a release operation, the process proceeds to step S31, and the date and time and GPS information at that time are recorded in the memory 20 of the camera. As a result, it can be used as data at the time of comparison in steps S11 and S12.

また、GPS情報は必ずしも撮影時に正しく入力されないこともあるので、ステップS32及びS33にて、所定時間おきに位置検出される。これにより、撮影時にGPS情報が得られなかった場合に、この値を代用したりして問題を回避することができる。 In addition, since GPS information may not always be input correctly at the time of shooting, the position is detected at predetermined intervals in steps S32 and S33. Thereby, when GPS information is not acquired at the time of imaging | photography, a problem can be avoided by substituting this value.

ステップS34では、検索モードであるか否かが判定される。ここで、ユーザが検索モードに設定していなければステップS35に移行し、設定していれば後述するステップS42へ移行する。 In step S34, it is determined whether or not the search mode is set. If the user has not set the search mode, the process proceeds to step S35. If the user has set the search mode, the process proceeds to step S42 described later.

ステップS35では、画像が1枚ずつ鑑賞できるように液晶ディスプレイ31に表示される。つまり、ここでは最新の撮影結果が表示される。そして、ステップS36に於いて、ユーザにより画像切り替えが行われたか否かが判定される。ここで、画像切り替え操作が行われると、ステップS37に移行して別の画像が再生表示される。一方、画像切り替え操作が行われない場合は、ステップS38へ移行する。

In step S35, the images are displayed on the

次に、ステップS38では、自宅付近のGPS情報の有無が判定される。ここで、上記GPS情報が有る場合はステップS41へ移行し、無い場合はステップS39に移行する。ステップS39では、その再生画像が自宅付近のものであるか否かが判定される。例えば、図9(b)に示されるように、再生画像311 が自宅付近のものであるか否かを問い掛ける表示が、液晶ディスプレイ31になされる。この時、自宅付近の画像が表示されていれば、ユーザは画面上の“Yes”と表示された操作釦31aによる入力操作を行う。この場合はステップS40に移行して、その画像の有するGPS情報(位置情報)が自宅付近の情報としてメモリ20に記録される。一方、上記ステップS39にて、表示された再生画像が自宅付近のものでない場合は、画面上の“No”と表示された操作釦31bによる入力操作が行われて、ステップS41へ移行する。

Next, in step S38, the presence / absence of GPS information near the home is determined. If the GPS information is present, the process proceeds to step S41. If not, the process proceeds to step S39. In step S39, it is determined whether or not the reproduced image is near the home. For example, as shown in FIG. 9 (b), it displays the

ステップS41では、画像の再生が終了したか否かが判定される。ここで、まだ終了でない場合は上記ステップS36へ移行し、終了であれば本シーケンスが終了する。 In step S41, it is determined whether or not the reproduction of the image has ended. Here, if not finished yet, the process proceeds to step S36, and if finished, this sequence is finished.

上記ステップS34に於いて検索モードに設定されていると判定された場合は、ステップS42に於いて、グラフ表示が求められているか否かが判定される。 If it is determined in step S34 that the search mode is set, it is determined in step S42 whether a graph display is required.

ここで、グラフ表示が求められている場合は、ステップS43に移行して、上記ステップS20で作成されたフォルダが液晶ディスプレイ31上に表示される。このグラフは、例えば、上述した図4や図5(a)、(b)で示されるような、横軸を時間、縦軸を自宅からの距離とした表示となる。この時、撮影画像数が多いフォルダは大きく、数が少ないフォルダは小さく表示すると、更に検索がし易くなる。

If graph display is required, the process proceeds to step S43, and the folder created in step S20 is displayed on the

また、内蔵する画像の特徴によって、色を変えたり形を変えたりすれば、ユーザは更に画像の検索がし易くなる。 Further, if the color or shape is changed according to the characteristics of the built-in image, the user can more easily search for the image.

例えば、結婚式のように人物の画像が多いものは人の形状にしたり、旅行のように風景が多いものは青色にしたりすればよい。 For example, a person having many images such as a wedding may be shaped like a person, or a person having many scenery such as a trip may be blue.

上記ステップS42に於いて、ユーザによりグラフ表示以外が選択された場合には、ステップS44に移行して、例えば図6に示されるような表示が行われる。これは、過去の記憶は遡っていくようなビジュアル表示である。 In step S42, when the user selects a display other than the graph display, the process proceeds to step S44, and for example, the display as shown in FIG. 6 is performed. This is a visual display in which the past memory goes back.

すなわち、ステップS44にて、過去のフォルダのうち旅行中の画像のフォルダ41、42、43は小さく画面の上の方に表示され、続くステップS45にて、過去のフォルダのうち自宅付近の画像のフォルダは小さく画面の下の方に表示される。更に、ステップS46にて、最近のフォルダのうち旅行中の画像のフォルダ44は大きく画面の上の方に表示され、続くステップS47にて、最近のフォルダのうち自宅付近の画像のフォルダ45は大きく画面の下の方に表示される。そして、ステップS48にて、上記ステップS44〜S47に該当しないフォルダは、これらの中間に表示される。

That is, in step S44, the

これらをまとめると、過去のフォルダは小さく表示し、それが自宅より距離が近いものなら下に、遠いものは上に表示する。また、最近の撮影画像は、大きく表示し、近所で撮影したものは下の方に、遠い所で撮影したものは、上の方に表示する。更に、その他のフォルダはその中間に表示する。このようにすれば、図6に示されるような表示となり、遠近法のような効果で、過去のフォルダ(41〜43)は遠くにあるように見え、最近のフォルダ(44、45)は近くにあるように見える。 To put these together, past folders are displayed small, if they are closer than home, they are displayed below, and those far away are displayed above. Also, recent captured images are displayed in a large size, and those photographed in the neighborhood are displayed in the lower part, and those photographed in the distant place are displayed in the upper part. Further, other folders are displayed in the middle. If it does in this way, it will become a display as shown in FIG. 6, and the past folders (41-43) will seem to be far away, and the recent folders (44, 45) will be near by the effect like perspective. Looks like there is.

その後、ステップS49にて、各フォルダが内容に合わせて特徴を持たせるように設定される。 Thereafter, in step S49, each folder is set so as to have characteristics according to the contents.

これによって、ユーザは過去に対して記憶を遡られるような形で画像を検索することができる。 As a result, the user can search for images in such a manner that the memory can be traced back to the past.

尚、図6に示されるフォルダ検索画面は、「過去」、「現在」の文字表示がされているが、この表記は無くともよい。 In the folder search screen shown in FIG. 6, the characters “past” and “present” are displayed, but this notation is not necessary.

また、十字キー等の操作によってユーザが過去の画像を探す場合等には、どんどん過去のフォルダが手前に来るように表示するようにしてもよい。 Further, when the user searches for past images by operating the cross key or the like, the past folders may be displayed so as to come closer to the front.

以下、フォルダ検索のための別の表示例(変形例)について説明する。 Hereinafter, another display example (modification) for folder search will be described.

(第1の変形例)

図10は、第1の変形例による撮影画像の検索時の表示例を示したものである。

(First modification)

FIG. 10 shows a display example when searching for a captured image according to the first modification.

この第1の変形例では、過去のフォルダはやはり遠近法で遠くに見えるように小さく中心付近に表示し、新しいフォルダほど手前の方に見えるようにして、上述した図6と同じような表示及び検索の効果を持たせるようにしている。この第1の変形例では、自宅の位置は必要とせず、全フォルダの有する座標(GPS情報から得られた経度と緯度)に従って各フォルダの位置関係を求め、その中心を原点とする。つまり、全ての画像のGPS情報の中心を原点とするので、自宅等の原点位置を必要とせず、地図情報等も必要とせず、図10に示されるように、東西南北に合わせて上下左右の方向を決定し、中心(原点)に対して、どの方向にあるかによって表示するようにしている。例えば、旅行先が東北地方であるとか関西方面であるとかを液晶ディスプレイ上に表示することができる。 In this first modification, the past folder is displayed in a small area near the center so that it can be seen far away in perspective, and the new folder is displayed in the foreground, and the same display and display as in FIG. I try to have a search effect. In this first modification, the home position is not required, the positional relationship of each folder is obtained according to the coordinates (longitude and latitude obtained from GPS information) of all folders, and the center is set as the origin. That is, since the center of the GPS information of all images is the origin, no origin position such as home is required, and no map information is required, and as shown in FIG. The direction is determined, and the display is made according to which direction the center (origin) is. For example, it is possible to display on the liquid crystal display whether the travel destination is the Tohoku region or the Kansai area.

但し、国外の場合は東西の関係が判断不能になるので、その場合は、その国を中心とした世界地図表記に合わせればよい。 However, since the relationship between east and west becomes indeterminate outside the country, in that case, it is sufficient to match the world map notation centered on that country.

尚、図10の表記「東」、「西」、「南」、「北」は、必ずしも表示されなくともよいものである。 Note that the notations “east”, “west”, “south”, and “north” in FIG. 10 are not necessarily displayed.

図11は、図10に示されるような表示にする場合の、カメラのMPU11による制御動作を説明するためのフローチャートである。

FIG. 11 is a flowchart for explaining a control operation by the

本ルーチンが開始されると、先ずステップS51に於いて、上述したように、全フォルダの位置の中心が原点とされる。次いで、ステップS52では、各フォルダを配置する座標が、緯度と経度に合わせて決定される。更に、ステップS53では、撮影の日時情報が加味され、古いフォルダほど遠近法で遠く見えるように小さく中心に向うように補正が行われて配置されるようにする。 When this routine is started, first, in step S51, as described above, the center of the position of all folders is set as the origin. Next, in step S52, coordinates for arranging each folder are determined according to the latitude and longitude. Further, in step S53, the shooting date / time information is taken into consideration, and the old folder is corrected and arranged so as to be closer to the center so that it can be seen farther in perspective.

ここで、ステップS54に於いて、図10に示される画面を見ながら、ユーザがフォルダ41〜45から何れかを選択する。このフォルダ選択は、タッチパネル式でも、十字キー式、或いはその他のスイッチ等による選択であってもよい。

Here, in step S54, the user selects one of the

ステップS54にてフォルダが選択されると、続くステップS55にて選択されたフォルダが一番手前に表示されるようにし、それより新しいフォルダは表示しないように候補画像から外される。こうして、上記ステップS51に移行すると、次々と過去に遡れるような表示が可能となる。 When a folder is selected in step S54, the folder selected in the next step S55 is displayed in the forefront, and a newer folder is removed from the candidate images so as not to be displayed. In this way, when the process proceeds to step S51, it is possible to display information that can be traced back to the past.

上記ステップS54にてフォルダ選択が行われない場合は、ステップS56に移行してフォルダ選択を終了するか否かが判定される。ここで、まだ選択が続けられる場合は上記ステップS54に移行し、終了する場合はステップS57へ移行する。そして、ステップS57では、図5(c)に示されるような画像表示に切り替えられる。 If no folder is selected in step S54, the process proceeds to step S56 to determine whether or not to end the folder selection. If the selection is still continued, the process proceeds to step S54, and if completed, the process proceeds to step S57. In step S57, the display is switched to the image display as shown in FIG.

このように、大まかに時間や空間を表す画面上に配置されたフォルダを選択して、個々の画像にアクセスするようにしたので、ユーザは記憶を辿るように、過去の思い出を回想しながら画像を迅速に検索することができる。また、背景画面も静止画である必要はなく、時間の流れを表すように、手前側に流れるような動画表示としてもよい。 In this way, since the folders arranged on the screen that roughly represent the time and space are selected and individual images are accessed, the user can recall the past memories while following the memories. Can be searched quickly. Further, the background screen does not have to be a still image, and may be a moving image display that flows to the near side so as to represent the flow of time.

(第2の変形例)

図12は、第2の変形例として、フォルダ内の画像の特徴によって、人物と旅行を表すフォルダを配置表示した例を示した図である。

(Second modification)

FIG. 12 is a diagram showing an example in which folders representing a person and a trip are arranged and displayed according to the characteristics of images in the folder as a second modification.

図12(a)は、画面中央部に大きな人物のフォルダ51が存在する例を示した図である。これ以前のデータを選択したい場合は、例えば右上の旅行写真を示すフォルダ52を選択すると、図12(b)に示されるように、中央の人物フォルダ51は消え、それ以前の画像が見えるようになり、奥行き方向に過去のフォルダが見えてくる。また、フォルダ52に相当する旅行写真を示すフォルダ52aが反転表示される。

FIG. 12A is a diagram showing an example in which a

尚、図12(a)、(b)に於いて、フォルダ内に示される数字は、この場合撮影日時を表している。 In FIGS. 12A and 12B, the numbers shown in the folders represent the shooting date and time in this case.

また、カメラに時間を遡るスイッチを設けておき、これによって奥にあるものを見えるようにしてもよい。 In addition, a switch that goes back in time may be provided in the camera so that the object behind can be seen.

このように、各フォルダを時間軸と空間軸で分類して表示することによって、ユーザは記憶を辿る形で過去の画像を検索することができ、しかも相対的にどの位置で撮影したかも画面内の上下左右の配置の具合から判断することができる。 In this way, each folder is classified and displayed on the time axis and the space axis, so that the user can search past images in the form of tracing the memory, and the relative position where the image was taken in the screen. It can be judged from the state of arrangement of the top, bottom, left and right.

尚、図12(b)に矢印Aで示されるように、動画表示をして時間の流れを示してもよい。また、画面上のアイコンのデザインによって中味も知ることができる。その際、フォルダの日付けも併記してもよい。 In addition, as shown by the arrow A in FIG. 12B, a moving image may be displayed to show the flow of time. You can also know the contents by designing the icons on the screen. At that time, the date of the folder may also be indicated.

更に、遠近法を有効利用するために、フォルダを表す円の大きさは、遠近を表すために利用されているので、この表示形態はどのフォルダにもほぼ同じ数の画像が入っていることを想定している。しかしながら、図13(a)に示されるように、中の画像の数に従ってフォルダを表す円内のアイコン61〜64の大きさを変えるようにしてもよい。

Furthermore, in order to effectively use the perspective method, the size of the circle representing the folder is used to represent the perspective, so this display form shows that almost every folder contains the same number of images. Assumed. However, as shown in FIG. 13A, the size of the

また、図13(b)に示されるように、円内を着色表示し、画像の少ないフォルダはその色の部分を小さくして表示するようにしてもよい。例えば、フォルダ67は略一杯に画像が入っており、フォルダ68、69はフォルダに余裕があることを表している。

Further, as shown in FIG. 13B, a circle may be displayed in a colored manner, and a folder with a small number of images may be displayed with the color portion reduced. For example, the

更に、この第2の変形例では、遠近法をアイコンの大小関係で表現したが、近年開発された3Dディスプレイの技術で実際に奥行き方向を表すようにし、その中にアイコンを表示するようにしてもよい。 Furthermore, in this second modification, the perspective is expressed by the size relationship of the icons, but the depth direction is actually expressed by the recently developed 3D display technology, and the icons are displayed therein. Also good.

(第3の変形例)

また、本発明の時間による遠近法を応用した表示技術を利用すると、2次元方向(紙面に対して垂直方向)に季節を表す領域を設けて、図14に示されるように、それぞれの季節(地域(GPS情報)と時刻情報から割り出す)毎に画像を分類し、過去の写真と最近の写真を分類表示して検索しやすくすることが可能である。

(Third Modification)

In addition, when the display technique using the time perspective according to the present invention is used, an area representing a season is provided in a two-dimensional direction (perpendicular to the paper surface), and as shown in FIG. Images can be classified for each region (GPS information) and time information), and past and recent photos can be classified and displayed for easy retrieval.

(第4の変形例)

更に、図15に示されるように、2次元方向に写真の分類を示す領域を設け、それぞれの行事毎に時間分類した表示を行うこともできる。この例は、GPS情報は用いられず、ユーザにより分類された分類情報に基いて行われる。

(Fourth modification)

Furthermore, as shown in FIG. 15, it is also possible to provide an area indicating the classification of photographs in a two-dimensional direction and perform display classified by time for each event. This example is performed based on classification information classified by the user without using GPS information.

(第5の変形例)

また、図16に示されるように、撮影された人物毎の分類を2次元方向に分類し、遠近法のように、画像の重なりや中央に行くほど小さい表示にするような手法にて、写真の前後関係を表し、検索を容易にするようにしてもよい。これは、人の顔検知による個人特定の技術を流用してもよい。

(Fifth modification)

In addition, as shown in FIG. 16, the photographed person is classified in a two-dimensional direction, and the method is such that images are overlapped or displayed smaller toward the center as in perspective. It is also possible to make the search easier. This may use personal identification technology based on human face detection.

(第6の変形例)

更に、図17に示されるように、被写体の距離や被写体の明るさや像信号によって画像を分類し、その奥行き方向に撮影時刻の前後関係を示すようにしてもよいのは勿論である。

(Sixth Modification)

Furthermore, as shown in FIG. 17, it is of course possible to classify the images according to the distance of the subject, the brightness of the subject, and the image signal, and to indicate the context of the photographing time in the depth direction.

このように、本発明によれば、ユーザは、好きな時に手軽に、古い写真の中から自分の見たいものを探して写真鑑賞を楽しむことができる。したがって、撮影画像を検索するのに、わかりやすく分類可能で表示可能なカメラを提供することができる。 As described above, according to the present invention, a user can easily enjoy a photo appreciation by searching for an item he / she wants to see from an old photo at any time. Therefore, it is possible to provide a camera that can be easily classified and displayed when searching for a captured image.

また、本発明は、カメラ内で全てを完結させるべき技術ではなく、分類表示は、例えばパーソナルコンピュータにて行ってもよい。この際、カメラからは、日時や位置が添付された画像ファイルが送られるようにする。 In addition, the present invention is not a technique for completing everything in the camera, and the classification display may be performed by, for example, a personal computer. At this time, an image file to which the date and time and position are attached is sent from the camera.

更に、本発明はカメラに限られることなく、単に表示装置や表示方法としても適用可能である。この場合、画像は、例えばカメラから送られるようにする。 Furthermore, the present invention is not limited to a camera, but can be applied as a display device or a display method. In this case, the image is sent from, for example, a camera.

例えば、画像フォルダを図形で表示する表示装置であって、画面の奥行き方向に撮影時の時刻を表し、該奥行き方向以外の方向に時間以外の少なくとも撮影位置等を表し、上記奥行き方向に分布する図形の大きさに従って、上記撮影時に撮影された画像の数を表示するようにしてもよい。 For example, it is a display device that displays an image folder in a graphic form, which represents the time of shooting in the depth direction of the screen, represents at least the shooting position other than time in a direction other than the depth direction, and is distributed in the depth direction. You may make it display the number of the images image | photographed at the time of the said imaging | photography according to the magnitude | size of a figure.

或いは、画像の奥行き方向に撮影時の日時を表し、該奥行き方向と直交する方向に撮影地点を表し、上記画像フォルダ内の画像の数を、該フォルダを示す図形内に表示するようにしてもよい。 Alternatively, the date and time of shooting may be indicated in the depth direction of the image, the shooting point may be indicated in a direction orthogonal to the depth direction, and the number of images in the image folder may be displayed in a graphic indicating the folder. Good.

また、保存手段に予め撮影された画像を、例えばフォルダ毎に保存するようにし、この保存手段で保存された画像について上述した表示を行うようにしてもよい。 In addition, an image captured in advance in the storage unit may be stored, for example, for each folder, and the above-described display may be performed on the image stored in the storage unit.

このような構成の表示装置によれば、ユーザは、撮影された画像または保存された画像について、過去に対して記憶を遡られるような形で、場所や画像の数を検索することができる。 According to the display device having such a configuration, the user can search for the location and the number of images in a manner that allows the captured image or the stored image to be traced back to the past.

更には、撮影画像の分類方法として、前回の撮影と時間、距離が離れていない場合には同一のフォルダに分類し、上記時間、距離が離れていても単独の画像は同じく同一のフォルダに分類するようにしてもよい。 Furthermore, as a method of classifying captured images, if the time and distance are not different from the previous shooting, the images are classified into the same folder, and even if the time and distance are separated, a single image is also classified into the same folder. You may make it do.

このように分類を行うようにすれば、フォルダ毎の検索も容易になる。 If classification is performed in this way, searching for each folder becomes easy.

以上、本発明の実施形態について説明したが、本発明は上述した実施形態に限定されるものではなく、本発明の要旨を逸脱しない範囲で種々の変形実施が可能であるのは勿論である。 Although the embodiments of the present invention have been described above, the present invention is not limited to the above-described embodiments, and various modifications can be made without departing from the scope of the present invention.

更に、上述した実施形態には種々の段階の発明が含まれており、開示される複数の構成要件の適当な組合せにより種々の発明が抽出され得る。例えば、実施形態に示される全構成要件から幾つかの構成要件が削除されても、発明が解決しようとする課題の欄で述べた課題が解決でき、発明の効果の欄で述べられている効果が得られる場合には、この構成要件が削除された構成も発明として抽出され得る。 Further, the above-described embodiments include inventions at various stages, and various inventions can be extracted by appropriately combining a plurality of disclosed constituent elements. For example, even if some constituent requirements are deleted from all the constituent requirements shown in the embodiment, the problem described in the column of the problem to be solved by the invention can be solved, and the effect described in the column of the effect of the invention Can be extracted as an invention.

11…メインCPU(MPU)、11a、11b、11c…スイッチ、12…信号処理部、13…撮影位置検出部、14…時計部、15…フラッシュROM、18…アナログフロントエンド部(AFE)、19…RAM、20…メモリ、21…表示部、22…マイクロホン、23…スピーカ、25…プリント信号出力部、26…無線通信部、28…撮像素子、29…撮影レンズ、30…被写体、31…液晶ディスプレイ、35…カメラ。

DESCRIPTION OF

Claims (15)

撮影時の場所を表す撮影位置情報を検出する位置検出手段と、

撮影時の時刻情報を検出する時刻検出手段と、

上記画像データ、撮影位置情報、及び時刻情報を記憶する記憶手段と、

上記撮影位置情報、時間情報及び撮影手段で撮影した画像データ数に従って上記画像データの分類方法を変更して表示する分類表示手段と、

を具備することを特徴とするカメラ。 Photographing means for obtaining image data by photographing;

Position detecting means for detecting shooting position information representing a place at the time of shooting;

Time detection means for detecting time information at the time of shooting;

Storage means for storing the image data, shooting position information, and time information;

Classification display means for changing and displaying the classification method of the image data according to the photographing position information, time information and the number of image data photographed by the photographing means,

A camera comprising:

上記撮影手段で撮影を行った撮影位置を検出する位置検出手段と、

撮影時の時間情報を検出する時刻検出手段と、

上記位置検出手段と上記時刻検出手段の出力に基づき、上記撮影位置の情報、上記時間情報及び上記撮影した写真の枚数に従って写真の情報を分類する分類手段と、

上記分類手段で分類された上記写真の情報を表示する表示手段と、

を具備することを特徴とするカメラ。 Photographing means for photographing the subject;

Position detecting means for detecting a shooting position at which shooting is performed by the shooting means;

Time detection means for detecting time information at the time of shooting;

Based on the output of the position detection means and the time detection means, classification means for classifying the information of the photo according to the information on the shooting position, the time information, and the number of the taken pictures,

Display means for displaying the information of the photos classified by the classification means;

A camera comprising:

上記分類手段は、特定の位置を基準位置として、上記保存手段に保存された写真の情報を、表示サイズと表示位置を変えて表示することを特徴とする請求項9に記載のカメラ。 And further comprising storage means for storing the photograph taken by the photographing means based on time and direction,

The camera according to claim 9, wherein the classification unit displays the information of the photograph stored in the storage unit by changing a display size and a display position with a specific position as a reference position.

上記表示手段は、上記保存手段で保存された画像について、画面の奥行きと視認される方向に撮影時の時刻を表し、該奥行き方向以外の方向に時間以外の少なくとも撮影位置を表し、上記奥行き方向に分布する図形の大きさに従って、上記撮影された画像の撮影時の情報を表示することを特徴とする請求項9に記載のカメラ。 A storage unit that stores the image captured by the imaging unit;

For the image stored in the storage unit, the display unit represents the time of shooting in the direction viewed as the depth of the screen, represents at least the shooting position other than the time in a direction other than the depth direction, and the depth direction The camera according to claim 9, wherein information at the time of photographing of the photographed image is displayed in accordance with a size of a figure distributed on the screen.

上記表示手段は、上記保存手段で保存された画像について、画像の奥行きと視認される方向に撮影時の日時を表し、該奥行き方向と直交する方向に撮影地点を表し、上記フォルダ内の画像の情報を、該フォルダを示す図形内に表示することを特徴とする請求項9に記載のカメラ。 The image processing apparatus further includes a storage unit that stores the images captured by the imaging unit for each folder,

For the image stored in the storage unit, the display unit represents the date and time of shooting in the direction viewed with the depth of the image, the shooting point in the direction orthogonal to the depth direction, and the images in the folder The camera according to claim 9, wherein the information is displayed in a graphic indicating the folder.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2006088071A JP4901258B2 (en) | 2006-03-28 | 2006-03-28 | Camera and data display method |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2006088071A JP4901258B2 (en) | 2006-03-28 | 2006-03-28 | Camera and data display method |

Publications (3)

| Publication Number | Publication Date |

|---|---|

| JP2007266902A true JP2007266902A (en) | 2007-10-11 |

| JP2007266902A5 JP2007266902A5 (en) | 2009-05-07 |

| JP4901258B2 JP4901258B2 (en) | 2012-03-21 |

Family

ID=38639468

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2006088071A Expired - Fee Related JP4901258B2 (en) | 2006-03-28 | 2006-03-28 | Camera and data display method |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP4901258B2 (en) |

Cited By (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2009116769A (en) * | 2007-11-09 | 2009-05-28 | Sony Corp | Input device, control method for input device and program |

| JP2010233081A (en) * | 2009-03-27 | 2010-10-14 | Olympus Imaging Corp | Image playback apparatus and image display control method |

| JP2011054035A (en) * | 2009-09-03 | 2011-03-17 | Fujitsu Ltd | Content display device and contents display program |

| JP2013098756A (en) * | 2011-11-01 | 2013-05-20 | Pentax Ricoh Imaging Co Ltd | Data file arrangement device, system, and method, and image recorder |

| JP2013211904A (en) * | 2013-05-31 | 2013-10-10 | Casio Comput Co Ltd | Display control device, server, display control method, information transmission method, and program |

| JP2015165422A (en) * | 2015-05-07 | 2015-09-17 | ソニー株式会社 | Information processing device, information processing method and program |

| CN105324747A (en) * | 2013-06-27 | 2016-02-10 | 利普雷克斯有限公司 | Image display method and system |

| US10817541B2 (en) | 2011-06-17 | 2020-10-27 | Sony Corporation | Information processing device, information processing method, and program |

Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH07121348A (en) * | 1993-10-26 | 1995-05-12 | Canon Inc | Information processing system |

| JPH10187743A (en) * | 1996-12-26 | 1998-07-21 | Sharp Corp | Data display method |

| JP2000101894A (en) * | 1998-09-21 | 2000-04-07 | Seiko Epson Corp | Image data management device, image data management method, and medium recording image data management program |

| JP2001344591A (en) * | 2000-05-31 | 2001-12-14 | Nippon Telegr & Teleph Corp <Ntt> | Method for controlling and display image and device for the same and recording medium |

| JP2002232814A (en) * | 2001-02-05 | 2002-08-16 | Fuji Photo Film Co Ltd | Picture reproducing device, camera, picture reproducing method and program |

| JP2005174060A (en) * | 2003-12-12 | 2005-06-30 | Matsushita Electric Ind Co Ltd | Image classification device, and image classification method and program |

-

2006

- 2006-03-28 JP JP2006088071A patent/JP4901258B2/en not_active Expired - Fee Related

Patent Citations (6)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JPH07121348A (en) * | 1993-10-26 | 1995-05-12 | Canon Inc | Information processing system |

| JPH10187743A (en) * | 1996-12-26 | 1998-07-21 | Sharp Corp | Data display method |

| JP2000101894A (en) * | 1998-09-21 | 2000-04-07 | Seiko Epson Corp | Image data management device, image data management method, and medium recording image data management program |

| JP2001344591A (en) * | 2000-05-31 | 2001-12-14 | Nippon Telegr & Teleph Corp <Ntt> | Method for controlling and display image and device for the same and recording medium |

| JP2002232814A (en) * | 2001-02-05 | 2002-08-16 | Fuji Photo Film Co Ltd | Picture reproducing device, camera, picture reproducing method and program |

| JP2005174060A (en) * | 2003-12-12 | 2005-06-30 | Matsushita Electric Ind Co Ltd | Image classification device, and image classification method and program |

Cited By (10)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2009116769A (en) * | 2007-11-09 | 2009-05-28 | Sony Corp | Input device, control method for input device and program |

| US8164577B2 (en) | 2007-11-09 | 2012-04-24 | Sony Corporation | Input device, control method of input device, and program |

| JP2010233081A (en) * | 2009-03-27 | 2010-10-14 | Olympus Imaging Corp | Image playback apparatus and image display control method |

| JP2011054035A (en) * | 2009-09-03 | 2011-03-17 | Fujitsu Ltd | Content display device and contents display program |

| US10817541B2 (en) | 2011-06-17 | 2020-10-27 | Sony Corporation | Information processing device, information processing method, and program |

| US11573984B2 (en) | 2011-06-17 | 2023-02-07 | Sony Group Corporation | Information processing device, information processing method, and program |

| JP2013098756A (en) * | 2011-11-01 | 2013-05-20 | Pentax Ricoh Imaging Co Ltd | Data file arrangement device, system, and method, and image recorder |

| JP2013211904A (en) * | 2013-05-31 | 2013-10-10 | Casio Comput Co Ltd | Display control device, server, display control method, information transmission method, and program |

| CN105324747A (en) * | 2013-06-27 | 2016-02-10 | 利普雷克斯有限公司 | Image display method and system |

| JP2015165422A (en) * | 2015-05-07 | 2015-09-17 | ソニー株式会社 | Information processing device, information processing method and program |

Also Published As

| Publication number | Publication date |

|---|---|

| JP4901258B2 (en) | 2012-03-21 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US8988347B2 (en) | Image processing apparatus, image displaying method, and image displaying program | |

| US8462993B2 (en) | Map information display apparatus, map information display method, and program | |

| JP4462331B2 (en) | Imaging apparatus, control method, program | |

| US8599251B2 (en) | Camera | |

| US8212784B2 (en) | Selection and display of media associated with a geographic area based on gesture input | |

| EP2271088B1 (en) | Information recording device, imaging device, information recording method, and program | |

| JP4901258B2 (en) | Camera and data display method | |

| US20060039674A1 (en) | Image editing apparatus, method, and program | |

| KR100828357B1 (en) | Method and apparatus for storing data obtained by image filming apparatus, and navigation apparatus using location information included in image data | |

| JP2008182662A (en) | Camera | |

| CN101834991A (en) | Image processing apparatus, image processing method and image processing program | |

| JP2010259064A (en) | Display and image pickup device | |

| US20130100329A1 (en) | Image pickup apparatus | |

| US20060050166A1 (en) | Digital still camera | |

| CN100370799C (en) | Imaging apparatus with communication function, image data storing method and computer program | |

| JP2012156640A (en) | Image display apparatus and imaging apparatus | |

| JP2012253421A (en) | Image display device, imaging apparatus, and image display program | |

| JP4054167B2 (en) | Imaging device | |

| JP2010068247A (en) | Device, method, program and system for outputting content | |

| KR20100101960A (en) | Digital camera, system and method for grouping photography | |

| JP2007156729A (en) | Retrieval device and retrieval method and camera having retrieval device | |

| JP5593778B2 (en) | Image processing apparatus and method, and program | |

| KR20090050420A (en) | Method and apparatus for displaying contents | |

| WO2023021759A1 (en) | Information processing device and information processing method | |

| JP2010183565A (en) | Image capturing apparatus, image retrieval device, and program |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20090318 |

|

| A621 | Written request for application examination |

Free format text: JAPANESE INTERMEDIATE CODE: A621 Effective date: 20090318 |

|

| A977 | Report on retrieval |

Free format text: JAPANESE INTERMEDIATE CODE: A971007 Effective date: 20110104 |

|

| A131 | Notification of reasons for refusal |

Free format text: JAPANESE INTERMEDIATE CODE: A131 Effective date: 20110125 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20110328 |

|

| A521 | Request for written amendment filed |

Free format text: JAPANESE INTERMEDIATE CODE: A523 Effective date: 20110422 |

|

| TRDD | Decision of grant or rejection written | ||

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 Effective date: 20111220 |

|

| A01 | Written decision to grant a patent or to grant a registration (utility model) |

Free format text: JAPANESE INTERMEDIATE CODE: A01 |

|

| A61 | First payment of annual fees (during grant procedure) |

Free format text: JAPANESE INTERMEDIATE CODE: A61 Effective date: 20111227 |

|

| R151 | Written notification of patent or utility model registration |

Ref document number: 4901258 Country of ref document: JP Free format text: JAPANESE INTERMEDIATE CODE: R151 |

|

| FPAY | Renewal fee payment (event date is renewal date of database) |

Free format text: PAYMENT UNTIL: 20150113 Year of fee payment: 3 |

|

| S111 | Request for change of ownership or part of ownership |

Free format text: JAPANESE INTERMEDIATE CODE: R313111 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| S531 | Written request for registration of change of domicile |

Free format text: JAPANESE INTERMEDIATE CODE: R313531 |

|

| R350 | Written notification of registration of transfer |

Free format text: JAPANESE INTERMEDIATE CODE: R350 |

|

| R250 | Receipt of annual fees |

Free format text: JAPANESE INTERMEDIATE CODE: R250 |

|

| LAPS | Cancellation because of no payment of annual fees |