JP2006331445A - Image processing apparatus and image processing method - Google Patents

Image processing apparatus and image processing method Download PDFInfo

- Publication number

- JP2006331445A JP2006331445A JP2006197923A JP2006197923A JP2006331445A JP 2006331445 A JP2006331445 A JP 2006331445A JP 2006197923 A JP2006197923 A JP 2006197923A JP 2006197923 A JP2006197923 A JP 2006197923A JP 2006331445 A JP2006331445 A JP 2006331445A

- Authority

- JP

- Japan

- Prior art keywords

- image

- pixel

- value

- pixel value

- conversion

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Granted

Links

- 238000012545 processing Methods 0.000 title claims abstract description 226

- 238000003672 processing method Methods 0.000 title abstract description 41

- 238000006243 chemical reaction Methods 0.000 claims abstract description 358

- 230000002093 peripheral effect Effects 0.000 claims description 79

- 238000004364 calculation method Methods 0.000 claims description 57

- 238000012937 correction Methods 0.000 claims description 50

- 238000000605 extraction Methods 0.000 claims description 44

- 230000008878 coupling Effects 0.000 claims description 35

- 238000010168 coupling process Methods 0.000 claims description 35

- 238000005859 coupling reaction Methods 0.000 claims description 35

- 238000009826 distribution Methods 0.000 claims description 24

- 238000009795 derivation Methods 0.000 claims description 17

- 230000002441 reversible effect Effects 0.000 claims description 12

- 239000000203 mixture Substances 0.000 claims description 11

- 238000003786 synthesis reaction Methods 0.000 claims description 11

- 230000015572 biosynthetic process Effects 0.000 claims description 10

- 239000002131 composite material Substances 0.000 claims description 8

- 230000003247 decreasing effect Effects 0.000 claims description 3

- 230000002194 synthesizing effect Effects 0.000 abstract description 20

- 238000000034 method Methods 0.000 description 144

- 239000013598 vector Substances 0.000 description 105

- 230000008569 process Effects 0.000 description 64

- 230000000007 visual effect Effects 0.000 description 64

- 238000010586 diagram Methods 0.000 description 46

- 238000011156 evaluation Methods 0.000 description 42

- 238000004422 calculation algorithm Methods 0.000 description 32

- 230000002068 genetic effect Effects 0.000 description 32

- 230000000694 effects Effects 0.000 description 31

- 230000006870 function Effects 0.000 description 31

- 239000003086 colorant Substances 0.000 description 21

- 230000006798 recombination Effects 0.000 description 18

- 238000005215 recombination Methods 0.000 description 17

- 230000035772 mutation Effects 0.000 description 11

- 210000000349 chromosome Anatomy 0.000 description 10

- 230000006872 improvement Effects 0.000 description 10

- 238000005457 optimization Methods 0.000 description 10

- 230000008901 benefit Effects 0.000 description 9

- 239000000284 extract Substances 0.000 description 8

- 230000004438 eyesight Effects 0.000 description 7

- 238000010187 selection method Methods 0.000 description 6

- 230000008859 change Effects 0.000 description 5

- 238000007796 conventional method Methods 0.000 description 5

- 238000005516 engineering process Methods 0.000 description 4

- 230000009466 transformation Effects 0.000 description 4

- 230000029777 axis specification Effects 0.000 description 3

- 238000003384 imaging method Methods 0.000 description 3

- 230000009467 reduction Effects 0.000 description 3

- 230000002829 reductive effect Effects 0.000 description 3

- 241000282412 Homo Species 0.000 description 2

- 238000009825 accumulation Methods 0.000 description 2

- 238000013459 approach Methods 0.000 description 2

- 210000001726 chromosome structure Anatomy 0.000 description 2

- 230000006835 compression Effects 0.000 description 2

- 238000007906 compression Methods 0.000 description 2

- 239000000470 constituent Substances 0.000 description 2

- 238000001914 filtration Methods 0.000 description 2

- 108090000623 proteins and genes Proteins 0.000 description 2

- 238000013139 quantization Methods 0.000 description 2

- 230000000717 retained effect Effects 0.000 description 2

- 208000019901 Anxiety disease Diseases 0.000 description 1

- 206010044565 Tremor Diseases 0.000 description 1

- 230000036506 anxiety Effects 0.000 description 1

- 238000013528 artificial neural network Methods 0.000 description 1

- 230000001174 ascending effect Effects 0.000 description 1

- 238000005282 brightening Methods 0.000 description 1

- 230000002759 chromosomal effect Effects 0.000 description 1

- 230000004456 color vision Effects 0.000 description 1

- 230000000295 complement effect Effects 0.000 description 1

- 230000001186 cumulative effect Effects 0.000 description 1

- 238000013461 design Methods 0.000 description 1

- 230000005484 gravity Effects 0.000 description 1

- 238000005286 illumination Methods 0.000 description 1

- 230000000670 limiting effect Effects 0.000 description 1

- 238000010801 machine learning Methods 0.000 description 1

- 238000004519 manufacturing process Methods 0.000 description 1

- 238000010606 normalization Methods 0.000 description 1

- 230000008447 perception Effects 0.000 description 1

- 230000005043 peripheral vision Effects 0.000 description 1

- 230000001737 promoting effect Effects 0.000 description 1

- 230000008707 rearrangement Effects 0.000 description 1

- 238000009738 saturating Methods 0.000 description 1

- 238000010186 staining Methods 0.000 description 1

- 230000001131 transforming effect Effects 0.000 description 1

- 238000013519 translation Methods 0.000 description 1

Images

Abstract

Description

本発明は、カメラ等で得られたカラー画像信号のコントラストや色を自動的に調整して、所望のコントラストや色調を持つ画像を得ることができる画像処理装置及び画像処理方法に関するものである。 The present invention relates to an image processing apparatus and an image processing method capable of automatically adjusting the contrast and color of a color image signal obtained by a camera or the like to obtain an image having a desired contrast and color tone.

ディジタルカメラで撮影されたカラー画像は、撮像素子であるCCD素子で得られたアナログ値におけるノイズ割合を表すSNレベルやアナログ値をディジタル値に変換する際の変換精度等の影響で、実際に撮影された自然画像の持つ画素濃度のダイナミックレンジよりも狭いレンジに制限されるため、影がかかった細部での情報が損失する現象が発生する傾向がある。特に画像内に明るい領域と暗い領域が混在するようなサンプルを撮影しようとした場合にその傾向は大きい。その改善として、ディジタル画像の輝度等の範囲をより輝度の高い画像部分からより輝度の低い画像部分までに拡げるように、コントラスト強調を行う手法がまず考えられる。そのコントラスト強調の従来手法としては、原画像を構成する全画素の輝度値の分布状態を示すヒストグラムを作成し、ヒストグラムの累積曲線を輝度変換曲線として原画像中の画素の輝度値を新な輝度値に変換し、画像のコントラストを強調するヒストグラム均等化手法がある。この手法は、原画像全領域の画素の輝度を同一の輝度変換曲線で新たな輝度に変換するために、部分的にはかえってコントラストが低下してしまう部分が生じることがある。このため、画像全体にわたってコントラスト強調を行いたい場合には、その領域に合ったコントラスト強調処理を行う必要がある。 A color image taken with a digital camera is actually taken due to the influence of the SN level representing the noise ratio in the analog value obtained by the CCD element, which is an image sensor, and the conversion accuracy when the analog value is converted into a digital value. Since the natural image is limited to a range narrower than the dynamic range of the pixel density, there is a tendency that information in a shadowed detail is lost. This tendency is particularly significant when trying to photograph a sample in which a bright area and a dark area are mixed in the image. As an improvement, first, a method of performing contrast enhancement so as to expand the range of the brightness of the digital image from an image portion with higher brightness to an image portion with lower brightness can be considered. As a conventional method of contrast enhancement, a histogram showing the distribution of the luminance values of all the pixels that make up the original image is created, and the luminance value of the pixels in the original image is set to a new luminance using the histogram's cumulative curve as the luminance conversion curve. There is a histogram equalization technique that converts to a value and enhances the contrast of the image. In this method, since the luminance of the pixels in the entire original image region is converted to a new luminance using the same luminance conversion curve, a portion where contrast is lowered may occur. For this reason, when it is desired to perform contrast enhancement over the entire image, it is necessary to perform contrast enhancement processing suitable for the region.

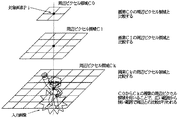

この手法のさらなる改善として、画像を複数の矩形領域に分割し、各々の領域毎に上記ヒストグラム均等化手法を適用する局所的ヒストグラム均等化手法も多く提案されており(例えば特開2000−285230号公報参照、文献1)、その構成図は図28のようになる。 As a further improvement of this technique, many local histogram equalization techniques that divide an image into a plurality of rectangular areas and apply the histogram equalization technique for each area have been proposed (for example, Japanese Patent Laid-Open No. 2000-285230). Refer to the publication, reference 1), and its configuration diagram is as shown in FIG.

図28は文献1における画像処理装置を示すブロック図である。 FIG. 28 is a block diagram showing an image processing apparatus in Literature-1.

図28はコントラスト強調部を表したものであり、画像を矩形に分割する画像データ分割手段281、矩形ごとにヒストグラムを作成するヒストグラム作成手段282、矩形ごとにコントラストの伸張を行うコントラスト伸張手段283よりなる。しかし、この手法を用いた場合、コントラストが強調されすぎる矩形領域が発生したり、隣接する矩形領域間の境界でコントラストが不連続になる可能性があるなどの問題点が指摘されている。

FIG. 28 shows a contrast emphasizing unit, which includes an image

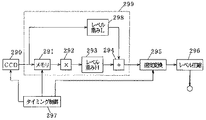

一方、ヒストグラムを利用しないで、このような問題の解決策として、フィールドごとにディジタルカメラのシャッタ時間や絞りを変えて、明るい部分と暗い部分を別々に撮像し、得られた各々の情報を1枚の画像に合成して中間調濃度を実現することで、実際に撮影された自然画像の持つ画素濃度のダイナミックレンジに近づける手法も提案されている。その例として、特開平6−141229号公報(文献2)に参照されている例があり、その装置の構成図は図29のようになる。 On the other hand, as a solution to such a problem without using the histogram, the bright time and the dark portion are separately imaged by changing the shutter time and aperture of the digital camera for each field, and each information obtained is 1 A method has also been proposed in which a halftone density is realized by synthesizing with a single image so as to approach the dynamic range of the pixel density of an actually captured natural image. As an example, there is an example referred to in Japanese Patent Application Laid-Open No. 6-141229 (Document 2), and the configuration diagram of the apparatus is as shown in FIG.

図29は文献2における撮像装置を示すブロック図である。

FIG. 29 is a block diagram showing an imaging apparatus in

図29において、290は被写体の光電効果を行う撮像素子(CCD)、291は画像信号を記録するメモリ、292は信号レベルを常数倍する乗算手段、293,298は画像信号のレベルに応じて重みを付加するレベル重み手段、294は信号を加算する加算手段、295は画像信号の速度を変換する速度変換手段、296は画像信号のレベルを圧縮するレベル圧縮手段、297は各ブロックのタイミングを制御するタイミング制御手段である。この装置は、撮像素子における電荷蓄積期間の異なる2枚以上の画像の信号レベルに応じて重み付け合成を行い、得られた合成画像出力を標準テレビ信号の速度に変換するとともに、テレビ信号での基準レベルに圧縮するテレビ撮像装置に関するものであるため、速度変換手段、レベル圧縮手段等を有する。そのため、ディジタルカメラに当てはめる場合、速度変換手段やレベル圧縮手段は必要な構成要素ではない。しかし、この装置のように複数の電荷蓄積期間で得られた画像合成による手法の場合、合成された画像におけるコントラストの不連続性は生じにくいが、最低2枚の画像を続けて取るため、原理的に同じ画像を取ることができない。そのため、これらの画像を合成した場合、シャッタ速度にも影響されるが合成画像の細部がぼけたりずれたりする画像が作成される可能性がある。また、明るい部分を撮影する際の濃度レンジと暗い部分を撮影する際の濃度レンジで画像内の持つ濃度レンジ全域をカバーできていない場合、その2つの中間濃度レンジで不連続性が生じる危険もある。

In FIG. 29,

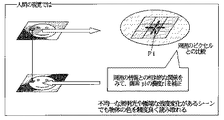

ところで、このような影のかかった領域での細部及び色を人間が観察した場合、人間の視覚は上記のような問題を発生させることなく、画像の持つ広い濃度のダイナミクスや色を知覚することができる。このような人間の視覚を中心とした中央視野/周辺視野レティネックスの概念は、Edwin Land(エドウィン・ランド)により(「An Alternativ Technique for the Computation of the Designator in the Retinex Theory of Color Vision」National Academy of Science、第84巻、pp.3078からpp.3080(1986))の中で紹介されている。この中では、人間の視覚のレティネックスの概念では、中央視野が2から4基礎単位分の直径を持ち、周辺視野が中央視野の約200から250倍の直径を有する逆2乗関数で記述されている。そして、中央視野、周辺視野各々の視野内での信号強度の空間的平均が知覚される強度に関係するとして定義されている。これらの原理に従い、上記のような暗部における色と明度表現を改善する手法が近年提案されている。この例は国際公開番号W097/45809(日本では特表2000−511315号公表、文献3)で記述されている。 By the way, when humans observe details and colors in such shadowed areas, human vision can perceive wide-range dynamics and colors of images without causing the above problems. Can do. The concept of central vision / peripheral vision Retinex centered on human vision is described by Edwin Land ("An Alternative Technology for the Design of the Designer in the Retinax Theorem Theorem Theorem Theorem Theorem Theorem Theorem in the Rethenology Theorem." of Science, vol. 84, pp. 3078 to pp. 3080 (1986)). In this, the Retinex concept of human vision is described by an inverse square function with a central visual field having a diameter of 2 to 4 basic units and a peripheral visual field having a diameter approximately 200 to 250 times the central visual field. ing. Then, the spatial average of the signal intensity in each of the central visual field and the peripheral visual field is defined as related to the perceived intensity. In recent years, a technique for improving the color and lightness expression in the dark part as described above has been proposed in accordance with these principles. This example is described in International Publication No. W097 / 45809 (published in Japanese translation table 2000-511315, Document 3).

図30は文献3におけるディジタル画像改善方法の説明図である。なお、ここではグレースケール画像を例に説明するが、カラー画像に対しても拡張することができる。画像の(i,j)における画素値I(i,j)は、プロセッサ301及びフィルタ302によって調整され、フィルタリング処理が行われる。画素ごとに、プロセッサ301は、(数1)のような調整画素値I’(i,j)を算出する。

FIG. 30 is an explanatory diagram of the digital image improvement method in

ここで、F(i,j)は周辺視野を表す周辺視野関数であり、「*」は畳み込み演算処理を示す。そして、F(i,j)が(数2)の条件を満足するように正規化係数Kが決定されており、これにより(数1)の第2項は、周辺視野における画素値の平均値に相当する。 Here, F (i, j) is a peripheral visual field function representing the peripheral visual field, and “*” indicates a convolution calculation process. Then, the normalization coefficient K is determined so that F (i, j) satisfies the condition of (Equation 2), whereby the second term of (Equation 1) is the average value of the pixel values in the peripheral visual field. It corresponds to.

つまり、(数1)は大きな領域における画素値平均値に対する各画素の画素値の比率を対数変換したものに相当する。周辺視野関数F(i,j)は、人間の視覚モデルとの対応から対象画素に近づくほど寄与する割合が高いように設計されており、(数3)のようなガウス関数が適用される。 That is, (Equation 1) corresponds to a logarithmic conversion of the ratio of the pixel value of each pixel to the average pixel value in a large area. The peripheral visual field function F (i, j) is designed so that the contribution ratio increases as it approaches the target pixel from the correspondence with the human visual model, and a Gaussian function like (Equation 3) is applied.

ここでcは各画素値I(i,j)の調整画素値I’(i,j)をコントロールするための定数である。 Here, c is a constant for controlling the adjusted pixel value I ′ (i, j) of each pixel value I (i, j).

以上のように、文献3のディジタル画像改善方法では、周辺視野での平均画素値に対する対象画素値を調整された画素値I’(i,j)として算出し、この値に対して、ディスプレイ303によって使用されるレティネックス出力R(i,j)を生成するためのフィルタ処理が302により行われる。302はI’(i,j)を対数領域からディスプレイ303で扱われるR(i,j)の画素値領域へ変換するものであり、処理の簡便化のために全ての画素に対して同一のオフセット及び利得変換関数を適用する処理が用いられる。

As described above, in the digital image improvement method of

しかしながら、この手法の場合、周辺視野関数を制御するcによる影響を大きく受ける。例えば、このcが大きな値になると対象画素に寄与する周辺視野が大きくなることで、大きな影における色の補償のみが可能となるが、一方、このcが小さい値の場合、対象画素近傍のみが影響を与えることとなり、小さな影領域での改善のみが見受けられる。このように扱う画像内の画素値のダイナミックスレンジに応じて適切なcを考慮する必要があり画像依存性の問題が挙げられる。その改善として、複数の周辺視野領域を設ける手法も同じ特許内に提案されているが、いくつ周辺視野領域を用意するかが明確になっておらず、改善精度を向上されるために大きな周辺領域から小さい周辺領域を多く用意することにより、処理時間が膨大になってしまうという問題点がある。 However, this method is greatly affected by c that controls the peripheral visual field function. For example, if this c is a large value, the peripheral visual field contributing to the target pixel is increased, so that only color compensation in a large shadow is possible. On the other hand, if this c is a small value, only the vicinity of the target pixel is detected. Only an improvement in small shadow areas can be seen. Appropriate c must be taken into account according to the dynamic range of pixel values in the image to be handled in this way, and there is a problem of image dependency. As an improvement, a method for providing a plurality of peripheral visual field areas has been proposed in the same patent. Therefore, there is a problem that the processing time becomes enormous by preparing many small peripheral areas.

次に、フィルタ302では、ディスプレイ303で使用される実際の画素値に変換する処理が行われているが、この方法ではどの画像に対しても同一のオフセット及び利得変換関数処理をするように設定されており、この最適なオフセット及び利得変換関数の設定には経験的知見を要する点も問題として挙げられる。さらに、複数の定数cにより設定される最大の周辺視野内で画素値変動が非常に小さい場合、調整された画素値I’(i,j)は複数領域を用意してもI(i,j)に関係なく1.0近傍になる。このような場合、画素値変動の小さい対象画素でのI’(i,j)はその入力画像全体におけるI’(i,j)の平均近傍に位置する場合が多く、フィルタ302におけるオフセット及び利得変換関数如何に問わず、実際の画素値における中央付近に向かいやすい傾向がある。特にハイライト輝度をもつ一様に広い画像領域では、調整後の輝度が下がる方向に調整されやすく視覚的に悪化する問題がある。

Next, in the

一方、画像処理として色調整処理を用いた場合、従来の色調整処理では、予め色変換テーブル内に変換前の色と変換後の色を定義する手法が用いられたが、例えばディジタルカメラで取られた画像をよりきれいにしたいような欲求の場合、変換前の色は入力画像を見るまで判明しないことが多く、予め一律に決めることができず、自動的に色調整を行うことができないという問題点がある。この改善として、入力画像において色のヒストグラムをとり、その上位色を色変換テーブル内の変換後の色で変換する手法も考えられるが、単純に色のヒストグラムを取りだけでは変換後の色バランスが崩れる可能性が大きかった。

このように、従来のヒストグラムに基づくコントラスト強調処理技術は、特定の部分のコントラストが強調されすぎたり、局所的に隣接する矩形領域境界で不連続性を示すことがあるという問題点を有していた。また、複数の絞り条件等で撮像された複数画像を合成した場合、原理的には同じ被写体を撮像することができず、合成画像細部のぼけや色ずれを生じる可能性があるという問題点を有していた。さらに、従来の人間の視覚モデルをもとにしたコントラスト調整技術では、人間の周辺視野を規定するための定数や最終的に扱うための実際の画素値に変換する際のフィルタ処理の設計に経験的知識を多く含むという問題点を有していた。そのうえ、特にハイライト輝度をもつ一様に広い画像領域では、調整後の輝度が下がる方向に調整されやすく視覚的に悪化するという問題点を有していた。 As described above, the conventional contrast enhancement processing technique based on the histogram has a problem in that the contrast of a specific portion is excessively emphasized or discontinuity may be shown at a locally adjacent rectangular region boundary. It was. In addition, when a plurality of images captured under a plurality of aperture conditions are combined, in principle, the same subject cannot be captured, and there is a possibility that the composite image details may be blurred or color misalignment may occur. Had. Furthermore, with contrast adjustment technology based on the conventional human visual model, we have experience in designing filter processing when converting to constants for defining the peripheral visual field of humans and actual pixel values for final handling. Had the problem of including a lot of technical knowledge. In addition, particularly in a uniformly wide image area having highlight luminance, there is a problem that the luminance after adjustment is easily adjusted in a decreasing direction and visually deteriorates.

この画像処理装置および画像処理方法では、撮像された明暗部を持つ画像のみを用いて簡易に撮像画像のコントラストを調整することができ、入力画像に対する依存性と変換後の色バランスの崩れを無くすことができることが要求されている。 In this image processing apparatus and image processing method, it is possible to easily adjust the contrast of the captured image using only the captured image having a bright and dark part, and to eliminate the dependence on the input image and the collapse of the color balance after conversion. It is required to be able to.

本発明は、この要求を満たすため、撮像された明暗部を持つ画像のみを用いて簡易に撮像画像のコントラストを調整することができ、また入力画像に対する依存性と変換後の色バランスの崩れを無くすことができる画像処理装置、および、撮像された明暗部を持つ画像のみを用いて簡易に撮像画像のコントラストを調整し、また入力画像に対する依存性と変換後の色バランスの崩れを無くすための画像処理方法を提供することを目的とする。 In order to satisfy this requirement, the present invention can easily adjust the contrast of the captured image using only the captured image having a bright and dark part, and also eliminates dependency on the input image and collapse of the color balance after conversion. An image processing device that can be eliminated, and the contrast of the captured image can be easily adjusted using only the captured image having a bright and dark portion, and the dependency on the input image and the collapse of the color balance after conversion are eliminated. An object is to provide an image processing method.

画像データに対しコントラスト調整を行う画像処理装置において、処理対象画素の画素値と前記処理対象画素の周辺領域に含まれる複数の画素の画素値とを取得する手段と、前記処理対象画素の画素値と前記周辺領域に含まれる複数の画素の画素値又はその変換値との比較に基づいて前記処理対象画素の画素値を変更し出力するコントラスト調整手段と、出力された個々の画素値より画像データを生成する手段と、を備え、前記コントラスト調整手段は、前記周辺領域に含まれる複数の画素が一様に略同じ画素値を示す場合は、前記処理対象画素に対して前記コントラスト調整を行なわずに前記処理対象画素の画素値を出力すること、ことを特徴とする。 In an image processing apparatus that performs contrast adjustment on image data, means for obtaining a pixel value of a processing target pixel and pixel values of a plurality of pixels included in a peripheral region of the processing target pixel, and a pixel value of the processing target pixel And a contrast adjusting means for changing and outputting the pixel value of the pixel to be processed based on a comparison between the pixel values of the plurality of pixels included in the peripheral region or a converted value thereof, and image data from the output individual pixel values And the contrast adjusting means does not perform the contrast adjustment on the processing target pixel when a plurality of pixels included in the peripheral region uniformly show substantially the same pixel value. And outputting a pixel value of the pixel to be processed.

この構成により大きな領域で一律な入力画像のハイライト部(白)やブラック部を処理対象外として除去することで、前述のようにそのような領域でのコントラスト調整画像に発生しやすい輝度レベルの大きな変動を抑えることができる。 With this configuration, the highlight (white) and black portions of the input image that are uniform in a large area are removed from the processing target, so that the brightness level that is likely to occur in the contrast-adjusted image in such an area as described above. Large fluctuations can be suppressed.

なお、これ以降で、画素位置(i,j)の単位には全て画素単位が用いられることする。また、各実施例(実施の形態)におけるステップは、ハードウェアで構成してもソフトウェアで構成してもよい。 In the following, pixel units are all used as the unit of pixel position (i, j). Further, the steps in the respective examples (embodiments) may be configured by hardware or software.

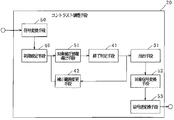

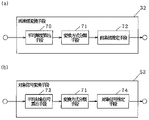

図1は本発明の実施例(実施の形態)1による画像処理装置の基本構成を示すブロック図である。また、図2(a)は図1の画像処理手段を示すブロック図、図3は図2(a)のコントラスト調整手段を示すブロック図、図10は図1の画像合成手段を示すブロック図、図11は人間の視覚を模式的に示す説明図である。 FIG. 1 is a block diagram showing a basic configuration of an image processing apparatus according to an embodiment (embodiment) 1 of the present invention. 2A is a block diagram showing the image processing means in FIG. 1, FIG. 3 is a block diagram showing the contrast adjusting means in FIG. 2A, and FIG. 10 is a block diagram showing the image synthesizing means in FIG. FIG. 11 is an explanatory diagram schematically showing human vision.

図1において、viはアナログ入力画像であり、voは最終的に出力される出力画像、vは後述の画像処理手段11で得られた処理後の画像である。10はCCD素子等の撮像素子からのアナログ画像信号viをディジタル画像データに変換する画像入力手段、11は画像入力手段10で得られたディジタル画像データに所望の画像処理を行う画像処理手段、12は画像入力手段からのディジタル画像データと画像処理手段11で得られた処理済みディジタル画像データvとを合成する画像合成手段、13は画像合成手段12で得られた合成ディジタル画像データを最終処理後の画像(アナログ画像信号)として所望のデバイス(プリンタ、ディスプレイ等)へ出力するための画像出力手段である。なお、本実施例(実施の形態)では、画像処理手段11における画像処理は、図2(a)で示すように、入力画像のコントラスト調整処理を行うコントラスト調整手段20で表されるものとする。その際、コントラスト調整手段は図3のような構成になる、図3において、30は対象画素Pij(i,j)におけるカラー3成分値VPij(r(i,j),g(i,j),b(i,j))からPijの広さcの周囲画素との比較によりコントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))を算出する補正情報導出手段、31は補正情報導出手段30で得られたコントラスト調整量VRPijから、有効となる範囲を限定し抽出する抽出手段、32は抽出手段31で選択されたコントラスト調整量VRPijを実際の画素Pijにおける調整後の画素値VPdij(rd(i,j),gd(i,j),bd(i,j))に変換する画素値変換手段である。また、画像合成手段12は、図10に示されるように、入力画像1内の輝度をもとに入力画像viとコントラスト調整手段20で得られた調整後の画像vとのどちらを優先するかを決める選択基準値判定手段100と、選択基準値判定手段100の結果をもとに、入力画像viとコントラスト調整手段20で得られた調整後の画像vとに掛かる結合係数ws(S=1,3;ここで1は入力画像viに掛かる結合係数であり、3は調整後の画像vに掛かる結合係数を示す)を決定する結合係数導出手段101と、結合係数導出手段101で得られた結合係数w0、w1を使って、入力画像viとコントラスト調整手段で得られた調整後の画像vとの加重平均画像を生成する加重平均合成手段102より構成される。

In FIG. 1, vi is an analog input image, vo is an output image that is finally output, and v is a processed image obtained by an

以上のように構成された画像処理装置の動作についてその動作を説明する。 The operation of the image processing apparatus configured as described above will be described.

画像入力手段10を介して、画像処理手段11に、カラー画像viがディジタル入力される。画像入力手段10では、カラー画像の場合、通常レッドr、グリーンg、ブルーbの成分データが画像入力手段10の精度で(8ビットならば0から255の値で)得られる。画像入力手段10では、この値を0.0から1.0の値に正規化する。次に、ディジタル入力画像に対して、入力画像の暗部におけるコントラストを改善するためのコントラスト調整処理がコントラスト調整手段20で行われる。コントラスト調整手段20では後述の図12のように行われる。人間の視覚では、図11に模式的に示されるように、対象画素Pijに対して知覚された画素値のみでPijの画素情報(色、コントラストなど)を認知するのではなく、対象画素Pijの画素値をその周囲にある画素の情報との相対的な関係により調整することで、Pijの画素情報を知覚している。これは、従来の技術で説明したように、Edwin Landにより紹介されたレティネックス概念と呼ばれるものであり、このような知覚により一部だけ別の照明を受けているような不均一な照明光や極端に画素値の強度変化があるようなシーンでも、物体の色を精度よく認知することができる。本実施例(実施の形態)でも、この概念を利用することで影のような暗部における色や細部情報を明確にする。

The color image vi is digitally input to the

図12は、本実施例(実施の形態)による画像処理装置のコントラスト調整手段20における動作を示すフローチャートである。 FIG. 12 is a flowchart showing the operation of the contrast adjusting means 20 of the image processing apparatus according to the present embodiment (embodiment).

図12において、まず、補正情報導出手段30は、入力画像内における画素Pijの各成分の最大値Vmax(rx,gx,bx)と最小値Vmin(rn,gn,bn)を算出する(S1)。これは、出力画像voにおける最小画素値と最大画素値が入力画像viと大きく異なった場合、両者の画像の違和感が大きくなることをできるだけ抑えるために、出力画像voの画素値の最小画素値と最大画素値を入力画像viの最小画素値と最大画素値に合わせるための処理である。次に、対象画素Pijの画素値VPijをLandにおける中心視野と見なし、その周囲にc画素の矩形領域に属する領域を周辺視野と見なす。そして、補正情報導出手段30は、周辺視野における画素値の加重平均画素値VAPij(Ar(i,j),Ag(i,j),Ab(i,j))を求めるとともに(S2)、このVAPijとVPijの間の相対的関係につながるコントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))を算出する(S3)。このVAPijとして、従来の技術のように(数1)の2項におけるc画素の周辺視野内における画素値VPij(r(i,j),g(i,j),b(i,j))と(数2)、(数3)のようにガウス関数で定義された周辺視野関数F(x,y)の畳み込み積分値で定義することも可能であり、加重平均画素値VAPijも(数1)を画素値を構成する3成分独立に定義することも可能である。しかし、本実施例(実施の形態)では、処理の簡単化と高速化を考慮して、(数4)のようにVAPijはc画素の周辺視野内における画素値VPij(r(i,j),g(i,j),b(i,j))の平均値を定義した。そして、コントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))も(数1)のように対数変換値の差分を用いるのではなく(数5)のように各成分ごとの画素値VPijの加重平均画素値VAPijに対する比を定義することとした。

In FIG. 12, first, the correction

補正情報導出手段30は、以上のような対象画素Pijに対するコントラスト調整量VRPijを入力画像内の全ての画像に対して行う(S4)。その後、抽出手段31は、コントラスト調整量VRPijの成分ごとの平均値VaR(aRr,aRg,aRb)と標準偏差量VdR(dRr,dRg,dRb)を求め(S5)、その値を使ってコントラスト調整量VRPijより抽出される際の最小値eminと最大値emaxを導出する(S6)。この導出としても多くの方法があるが、ここでは、emaxの候補としてaRr+α×dRr、aRg+α×dRg、aRb+α×dRbを求め、この3値の内の最大値をemaxとする。そして、eminの候補としてaRr−β×dRr、aRg−β×dRg、aRb−β×dRbを求め、この3値の内の最小値をeminとする。こうすることで、抽出されたコントラスト調整量VRPijの各成分のバランスが崩れないように、必要とする領域を抽出することとした。次に、画素値変換手段32は、このemaxとeminを使って、コントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))の各成分は0.0から1.0の範囲内の値に変換され(S7)、変換値を入力画像のVmax(rx,gx,bx)と最小値Vmin(rn,gn,bn)内に抑える処理を行う(S8)。こうして得られたコントラスト調整量VRPijを対象画素Pijにおけるコントラスト調整の画素値と見なされ、コントラスト調整処理が終了する(S9)。終了か否かの判定は画素値変換手段32が行う。

The correction

このような一連の処理により、周辺視野内での加重平均画素値に対する対象画素値の比の分布で中心付近部分のみは取り出され、中心からの変動量は強調されるとともに、中心付近から大きく外れた比の値を持つ画素のコントラスト調整量VRPijは1.0もしくは0.0になりやすくなる。そのため、中心視野である対象画素Pijとその周辺視野における画素との差が少しでもある領域はその差が強調されやすくなりコントラスト強調が行われ、影内の細部や入力機器のレンジ不足で埋もれてしまった色情報を強調して表現することができるようになる。本実施例(実施の形態)の場合、各画素におけるコントラスト調整量の導出が従来のレティネックス概念による手法よりも簡易な形で構成されている。そして、従来のレティネックス概念による手法では、各画素におけるコントラスト調整量から実際の画素値成分へ変換する際のフィルタ処理(オフセット、利得変換関数)の設定が経験的知識を要することが問題とされていたが、本実施例(実施の形態)ではその必要がないことが利点として挙げられる。一方、周辺視野内での加重平均画素値に対する対象画素値の比の分布で中心付近部分のみを抽出し、その前後の領域を0.0もしくは1.0で飽和させることにより、このコントラスト調整処理で得られた処理後の画像voは全体的に輝度レベルが中心付近に集まる問題が生じる可能性がある。この問題及び、従来の技術で説明した非常に大きな領域で一律な色を持つハイライト部での輝度レベルの低下を改善するために、本実施例(実施の形態)では、入力画像viとこの処理後の画像voを適応的に合成することで、入力画像viが本来持つ輝度レベルの低減や上昇を抑えることとしたのである。 By such a series of processing, only the portion near the center is extracted in the distribution of the ratio of the target pixel value to the weighted average pixel value in the peripheral visual field, the amount of variation from the center is emphasized, and the deviation from the center is greatly deviated. The contrast adjustment amount VRPij of the pixel having the ratio value is likely to be 1.0 or 0.0. For this reason, the region where the difference between the target pixel Pij as the central visual field and the pixels in the peripheral visual field is slightly enhanced, the difference is easily enhanced, and contrast enhancement is performed, and the details in the shadow and the range of the input device are insufficient. It becomes possible to emphasize and express the color information. In the case of the present embodiment (embodiment), the derivation of the contrast adjustment amount in each pixel is configured in a simpler form than the conventional method based on the Retinex concept. In the conventional method based on the Retinex concept, the setting of the filter processing (offset, gain conversion function) when converting the contrast adjustment amount in each pixel into the actual pixel value component requires an empirical knowledge. However, in the present embodiment (embodiment), it is mentioned as an advantage that it is not necessary. On the other hand, this contrast adjustment process is performed by extracting only the vicinity of the center in the distribution of the ratio of the target pixel value to the weighted average pixel value in the peripheral visual field, and saturating the area before and after that at 0.0 or 1.0. There is a possibility that the image vo after processing obtained in (1) may have a problem that the luminance level collects near the center as a whole. In this embodiment (embodiment), in order to improve this problem and the reduction of the luminance level in the highlight portion having a uniform color in a very large area described in the prior art, the input image vi and this By adaptively synthesizing the processed image vo, the reduction or increase in the luminance level inherent in the input image vi is suppressed.

画像合成手段12における画像合成処理では、このコントラスト調整処理での処理後画像vと入力画像viを受けて図13で示されているように処理が実行される。

In the image synthesizing process in the

図13は本発明の実施例(実施の形態)1による画像処理装置の画像合成手段12の動作を示すフローチャートである。

FIG. 13 is a flowchart showing the operation of the image synthesizing means 12 of the image processing apparatus according to

ここでは、まず、選択基準値判定手段100は、入力画像における各画素Pijの輝度y(i,j)を計算する(S11)。そして、予め用意されたしきい値Th_hとTh_lを各画素輝度y(i,j)と比較する(S12)。その際、Th_l>y(i,j)またはy(i,j)>Th_hの場合は、選択基準値判定手段100は、さらにPijのcの矩形の周辺視野領域における平均輝度Ay(i,j)を求める(S13)。そして、y(i,j)が|Ay(i,j)−y(i,j)|<Th_len(S14)を満足する場合には、対象画素Pijにおける入力画像viにおける画素値VPij(r(i,j),g(i,j),b(i,j))を処理済画像voの画素Pijの値であるVWPij(WRr(i,j),WRg(i,j),WRb(i,j))に置き換える処理を行う(S15)。この処理は、従来の技術で説明したように、周辺視野領域cより大きな領域で変動が非常に小さい場合でのPijにおけるコントラスト調整量は1.0近傍に集中しやすいことを考慮した処理であり、この処理により大きな領域で一律な入力画像のハイライト部(白)やブラック部を処理対象外として除去することで、前述のようにそのような領域でのコントラスト調整画像に発生しやすい輝度レベルの大きな変動を抑えることを目的とする。

Here, first, the selection reference

次に上記条件に属さないような場合は、結合係数導出手段101は、入力画像viのPijにおける輝度値y(i,j)と処理済画像vの対応する画素での輝度値yd(i,j)を比較し(S16)、その両者間の誤差の絶対値len=|y(i,j)−yd(i,j)|を用意されたw3決定関数に入力することで、処理済画像vの占める結合係数w3を決定する(S17)。そして入力画像viの占める結合係数w1はw1=1.0−w3より決定する。このw3決定関数も一律に決まらないが、ここでは簡易目的のため、(数6)のようなしきい値関数g(X)を使用する。

Next, in the case where the above condition is not satisfied, the coupling

そして、加重平均合成手段102は、このw1とw3を使って、Pijにおける入力画像viの画素値VPijと処理済画像vの画素値VRPijの加重平均画素値VWPij(WRr(i,j),WRg(i,j),WRb(i,j))を求め(S17)、画像vの対応する画素位置に埋め込む(S18)。このような一連の判定、加重平均処理を全画素に対して行うことで(S19)、最終的に画像出力手段13で出力される出力画像voを生成するのである。 The weighted average combining means 102 uses the w1 and w3 to calculate the weighted average pixel value VWPij (WRr (i, j), WRg) of the pixel value VPij of the input image vi and the pixel value VRPij of the processed image v using Pij. (I, j), WRb (i, j)) is obtained (S17) and embedded in the corresponding pixel position of the image v (S18). By performing such a series of determination and weighted average processing for all the pixels (S19), an output image vo that is finally output by the image output means 13 is generated.

以上のような構成や処理を行うことで本実施例(実施の形態)による画像処理装置は、従来の技術の問題点を解決するとともにその利点を生かすことで、簡易かつ高精度に入力画像のコントラスト調整を行うことができる。 By performing the configuration and processing as described above, the image processing apparatus according to the present embodiment (embodiment) solves the problems of the conventional technology and takes advantage of the advantages of the input image easily and accurately. Contrast adjustment can be performed.

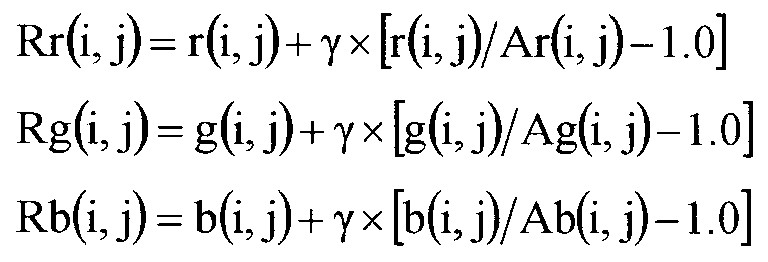

なお、コントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))の定義は一律ではなく、例えば(数7)のように、各成分ごとの画素値VPijの加重平均画素値VAPijに対する比から1.0を減算した値に予め設定された正定数γを乗算した値を入力画像の画素値VPij(r(i,j),g(i,j),b(i,j))に加算した値を改めてコントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))として定義することも可能である。 Note that the definition of the contrast adjustment amount VRPij (Rr (i, j), Rg (i, j), Rb (i, j)) is not uniform. For example, as in (Equation 7), the pixel value for each component The value obtained by subtracting 1.0 from the ratio of VPij to the weighted average pixel value VAPij multiplied by a preset positive constant γ is the pixel value VPij (r (i, j), g (i, j)) of the input image. , B (i, j)) can be redefined as the contrast adjustment amount VRPij (Rr (i, j), Rg (i, j), Rb (i, j)).

こうすることで、従来の技術でも問題とした、c画素の周辺視野内で画素値変動が非常に小さい場合にコントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))の各成分はVPij(r(i,j),g(i,j),b(i,j))に関係なく1.0近傍になってしまうことを避けることができるという利点があるが、設定されたγによる依存性があることに注意する必要がある。また、これらの処理は、本実施例(実施の形態)による画像処理方法に従い、コンピュータ等に使用される中央演算処理装置(CPU)及びディジタルシグナルプロセッサ(DSP)等を使ったソフトウェア処理でも同様に実現することができる。 By doing so, the contrast adjustment amounts VRPij (Rr (i, j), Rg (i, j), Rb () when the pixel value variation is very small in the peripheral visual field of the c pixel, which is a problem in the conventional technique, i, j)) each component of VPij (r (i, j), g (i, j), b (i, j)) can be avoided from being in the vicinity of 1.0. Although there is an advantage, it should be noted that there is a dependency due to the set γ. These processes are also performed by software processing using a central processing unit (CPU) and a digital signal processor (DSP) used in a computer or the like according to the image processing method according to the present embodiment (embodiment). Can be realized.

本発明の実施例(実施の形態)2による画像処理装置の基本構成は実施例(実施の形態)1と同様、図1の構成であり、また画像処理手段11も図2(a)のようにコントラスト調整手段20になる。その際、コントラスト調整手段20は図4のような構成になる。 The basic configuration of the image processing apparatus according to the embodiment (embodiment) 2 of the present invention is the configuration of FIG. 1 as in the embodiment (embodiment) 1, and the image processing means 11 is also as shown in FIG. Thus, the contrast adjusting means 20 is obtained. At that time, the contrast adjusting means 20 is configured as shown in FIG.

図4において、補正情報導出手段30、抽出手段31、画素値変換手段32は図3と同様のものなので、同一符号を付し、説明は省略する。40は補正情報導出(対象画素のコントラスト調整量算出)を行う際の初期条件を設定する初期設定手段である。初期設定手段40は、主に中央視野である対象画素Pijと比較する周辺視野部の大きさcに初期周辺領域サイズc0を設定する処理を行う。また、41は予め用意された複数の周辺視野領域すべてでコントラスト調整量が算出されたかどうかを判定する終了判定条件、42は終了判定条件41で終了判定と見なされなかった場合に現在処理している周辺視野領域の大きさcを次の候補に変更する補正範囲変更手段である。なお、画像合成手段12は実施例(実施の形態)1と同様に図10のように構成されている。

In FIG. 4, the correction information deriving means 30, the extracting

以上のように構成された画像処理装置について、その動作を図10、図14、図15を用いて説明する。図14は周辺視野領域を模式的に示す説明図、図15はコントラスト調整手段20における動作を示すフローチャートである。 The operation of the image processing apparatus configured as described above will be described with reference to FIG. 10, FIG. 14, and FIG. FIG. 14 is an explanatory diagram schematically showing the peripheral visual field region, and FIG.

画像入力手段10を介して、画像処理手段11に、カラー画像viがディジタル入力される。画像入力手段10では、カラー画像の場合、通常レッドr、グリーンg、ブルーbの成分データが画像入力手段10の精度で(8ビットならば0から255の値で)得られる。画像入力手段10では、この値を0.0から1.0の値に正規化する。次に、ディジタル入力画像に対して、入力画像の暗部におけるコントラストを改善するためのコントラスト調整処理がコントラスト調整手段20で行われる。コントラスト調整手段20では図15のように行われる。本実施例(実施の形態)の特徴は、実施例(実施の形態)1に対して、図14で模式的に示されるように、複数用意された周辺視野領域でのコントラスト調整を行うことで、画像内に存在する暗部(影)の大きさによる影響を低減するようにした点である。

The color image vi is digitally input to the

次に、コントラスト調整手段20について、その動作を図15を用いて説明する。

Next, the operation of the

図15において、まず、初期設定手段40は、入力画像内における画素Pijの各成分の最大値Vmax(rx,gx,bx)と最小値Vmin(rn,gn,bn)を算出する(S21)。次に、対象画素Pijの画素値VPijをLandにおける中心視野と見なし、その周囲にc画素の矩形領域に属する領域を周辺視野と見なす。その際、初期設定手段40で、まずc=c0というように、予め用意された複数の周辺視野領域サイズck(k=0,1,・・・,Cnum−1)内でc0を周辺視野領域として設定する。この場合、ckは最小サイズ領域から昇順に用意しても構わないし、最大サイズから降順に用意しても構わないが、サイズの変更方向をそろえた方がよい。ここでは最大サイズから降順に用意されているとして、順に周辺視野領域を小さいくしながら、入力画像における細部改善を行うこととする。次に、補正情報導出手段30では、現在設定されているc=ckの矩形域の周辺視野に対して、周辺視野における画素値の加重平均画素値VAPij_k(Ar_k(i,j),Ag_k(i,j),Ab_k(i,j))が算出される(S22)。そして、すべてのckで補正情報導出手段30での画素Pij周辺視野における加重平均画素値計算が終了したかどうかの判定を終了判定手段41で行う(S23)。終了していないと判定された場合には補正情報範囲変更手段42へ処理が移り、現在設定されている周辺視野領域cをつぎの候補に変更し、再び補正情報導出手段30での加重平均画素値算出が行われる。一方、終了判定手段41で終了判定された場合には、補正情報導出手段30は、各周辺視野領域ckに対するPijの加重平均画素値VAPij_k(Ar_k(i,j),Ag_k(i,j),Ab_k(i,j))の重み付き平均値を求め、その値をPijの全加重平均画素値VAPij(Ar(i,j),Ag(i,j),Ab(i,j))と設定する(S24)。その際、周辺視野領域ckの大きさに応じた重み付けを各ckによるPijの加重平均画素値に付加することが考えられるが、ここでは簡易化のために、各ckによる加重平均画素値VAPij_kの平均画素値をPijの全加重平均画素値として採用する。そして、補正情報導出手段30は、Pijにおける各成分ごとの画素値VPijの全加重平均画素値VAPijに対する比をコントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))として算出する(S25)。

In FIG. 15, first, the initial setting means 40 calculates the maximum value Vmax (rx, gx, bx) and the minimum value Vmin (rn, gn, bn) of each component of the pixel Pij in the input image (S21). Next, the pixel value VPij of the target pixel Pij is regarded as a central visual field in Land, and a region belonging to a rectangular region of c pixels around it is regarded as a peripheral visual field. At that time, the initial setting means 40 first sets c0 as the peripheral visual field area within a plurality of peripheral visual field area sizes ck (k = 0, 1,..., Cnum−1) prepared in advance, such as c = c0. Set as. In this case, ck may be prepared in ascending order from the minimum size area, or may be prepared in descending order from the maximum size, but it is better to align the direction of size change. Here, assuming that the images are prepared in descending order from the maximum size, it is assumed that the detail improvement in the input image is performed while the peripheral visual field region is sequentially reduced. Next, in the correction

これ以降の処理は実施例(実施の形態)1と同様に、まず、コントラスト調整量VRPijより抽出される際の最小値eminと最大値emaxを導出する(S26、S27、S28)。次に、このemaxとeminを使って、コントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))の各成分を0.0から1.0の範囲内の値に変換し(S29)、変換値を入力画像のVmax(rx,gx,bx)と最小値Vmin(rn,gn,bn)内に抑える(S30)。こうして得られたコントラスト調整量VRPijを対象画素Pijにおけるコントラスト調整の画素値と見なして(S30)、コントラスト調整処理が終了する(S30a)。 In the subsequent processing, as in Example (Embodiment) 1, first, a minimum value emin and a maximum value emax are derived when extracted from the contrast adjustment amount VRPij (S26, S27, S28). Next, using emax and emin, each component of the contrast adjustment amount VRPij (Rr (i, j), Rg (i, j), Rb (i, j)) is in the range of 0.0 to 1.0. (S29), and the converted value is suppressed to Vmax (rx, gx, bx) and the minimum value Vmin (rn, gn, bn) of the input image (S30). The contrast adjustment amount VRPij obtained in this way is regarded as the pixel value for contrast adjustment in the target pixel Pij (S30), and the contrast adjustment processing is ended (S30a).

また、画像合成処理部も実施例(実施の形態)1と同様に、入力画像1のPijにおける輝度値y(i,j)と処理済画像3の対応する画素での輝度値yd(i,j)より得られた結合係数w1とw3を使って、Pijにおける入力画像viの画素値VPijと処理済画像vの画素値VRPijの加重平均画素値VWPij(WRr(i,j),WRg(i,j),WRb(i,j))が求められ、処理済み画像vの対応する画素位置Pijに埋め込まれる。このような処理が全画素に対して行うことで、最終的に画像出力手段13で出力される出力画像voが生成される。

Similarly to the embodiment (embodiment) 1, the image composition processing unit also uses the luminance value y (i, j) in Pij of the

以上のような構成や処理を行うことで本実施例(実施の形態)である画像処理装置は、実施例(実施の形態)1による画像処理装置の特徴を生かしながら、入力画像における画素値のダイナミックレンジや影のような暗部サイズにあまり影響されることなく、自動的に入力画像のコントラスト調整を行うことができ、画像のコントラスト調整の効率化につながる。なお、これらの処理は、本実施例(実施の形態)による画像処理方法に従い、コンピュータ等に使用される中央演算処理装置(CPU)及びディジタルシグナルプロセッサ(DSP)等を使ったソフトウェア処理でも同様に実現することができる。 By performing the configuration and processing as described above, the image processing apparatus according to the present embodiment (embodiment) takes advantage of the characteristics of the image processing apparatus according to the embodiment (embodiment) 1 and changes the pixel values in the input image. The contrast of the input image can be automatically adjusted without being greatly affected by the size of the dark part such as the dynamic range and shadow, which leads to the efficiency of the image contrast adjustment. These processes are also performed by software processing using a central processing unit (CPU) and a digital signal processor (DSP) used in a computer or the like according to the image processing method according to the present embodiment (embodiment). Can be realized.

本発明の実施例(実施の形態)3による画像処理装置の基本構成は実施例(実施の形態)1と同様、図1の構成である。また、画像処理手段11も図2(a)のようにコントラスト調整手段20が採用されている。その際、コントラスト調整手段20は図5のような構成になる。図5は本実施例(実施の形態)による画像処理装置を構成するコントラスト調整手段20を示すブロック図である。 The basic configuration of the image processing apparatus according to the embodiment (embodiment) 3 of the present invention is the same as that of the embodiment (embodiment) 1 as shown in FIG. The image processing means 11 also employs contrast adjustment means 20 as shown in FIG. At that time, the contrast adjusting means 20 is configured as shown in FIG. FIG. 5 is a block diagram showing the contrast adjusting means 20 constituting the image processing apparatus according to the present embodiment (embodiment).

図5において、31は図3と同様の抽出手段、50は入力画像vi内の画素値をコントラスト調整時の対象とする信号(対象信号)へ変換する信号変換手段、51は信号変換手段50で得られた対象信号に対して、対象画素Pijのコントラスト調整量を求める対象補正情報導出手段、52は抽出手段31で抽出されたコントラスト調整量に基づいて、信号変換手段50で得られた対象信号を実際の対象信号(調整済みの対象信号)に変換する対象信号変換手段、53は対象信号変換手段52で得られた調整済みの対象信号と信号変換手段50で得られたそれ以外の信号(対象信号)とにより調整済みの対象信号の実際の画素値への逆変換処理を行う信号逆変換手段である。 In FIG. 5, 31 is extraction means similar to FIG. 3, 50 is signal conversion means for converting the pixel value in the input image vi into a signal (target signal) to be subjected to contrast adjustment, and 51 is signal conversion means 50. Target correction information deriving means for obtaining the contrast adjustment amount of the target pixel Pij with respect to the obtained target signal, 52 is a target signal obtained by the signal conversion means 50 based on the contrast adjustment amount extracted by the extraction means 31 Is converted into an actual target signal (adjusted target signal), 53 is an adjusted target signal obtained by the target signal conversion means 52 and other signals obtained by the signal conversion means 50 ( Signal reverse conversion means for performing reverse conversion processing of the target signal adjusted with the target signal) to the actual pixel value.

本実施例(実施の形態)の特徴は、カラー画像の画素Pijにおける画素値VPij(r(i,j),g(i,j),b(i,j))を他の複数信号に変換し、その内の1つの信号に対して実施例(実施の形態)1と同様にコントラスト調整量を算出し、最後に調整された対象信号のコントラスト調整量と入力画像viより変換時にそのまま保持された他の信号とから信号変換手段50で行われた変換処理の逆変換処理を行うことで、図1における処理済画像の画素Pijにおける画素値を求める点である。ここで、信号変換手段50において、Pijの画素値VPij(r(i,j),g(i,j),b(i,j))から例えば明度L(i,j)と色相a*(i,j),b*(i,j)に変換し、この明度L(i,j)をコントラスト調整時の対象信号にする。そして、他の色相信号を入力画像のまま保持することで、本実施例(実施の形態)では、明度のレベルを制御しながら、入力画像における色情報をそのまま保持することができるため、コントラスト調整手段20で得られた処理済み画像vの色バランスは入力画像をそのまま再現することが出来るとともに、対象補正情報導出手段51での周辺視野領域と対象画素での比較処理量を軽減することができる。

A feature of the present embodiment (embodiment) is that the pixel value VPij (r (i, j), g (i, j), b (i, j)) in the pixel Pij of the color image is converted into other plural signals. Then, the contrast adjustment amount is calculated for one of the signals in the same manner as in the first embodiment (embodiment), and is maintained as it is at the time of conversion from the contrast adjustment amount of the last adjusted target signal and the input image vi. The pixel value in the pixel Pij of the processed image in FIG. 1 is obtained by performing an inverse conversion process of the conversion process performed by the

以上のように構成された画像処理装置について、その動作を図16を用いて説明する。図16は図5のコントラスト調整手段20の動作を示すフローチャートである。 The operation of the image processing apparatus configured as described above will be described with reference to FIG. FIG. 16 is a flowchart showing the operation of the contrast adjusting means 20 of FIG.

図16において、まず、入力画像1の画素PijにおけるVPij(r(i,j),g(i,j),b(i,j))をLa*b*空間における信号VPLij(L(i,j),a*(i,j),b*(i,j))に信号変換手段50で変換するとともに、Pijにおける変換値信号の内、色相a*(i,j)とb*(i,j)を保持する(S31)。これ以降、対象補正情報導出手段51から対象信号変換手段52までの処理は明度L(i,j)を対象信号として処理が行われる。なお、L(i,j)は0.0から1.0に正規化されているものとする。これにより、入力画像viの持つ色情報のバランスを処理済み画像vでも精度よく保持することができると考えられる。対象補正情報導出手段51は、入力画像の画素Pijの明度L(i,j)の最大値Lxと最小値Lnを算出する(S32)。次に、対象画素Pijの周辺視野における明度L(i,j)の加重平均明度AL(i,j)を求めるとともに(S33)、L(i,j)とAL(i,j)に対する比を明度のコントラスト調整量RL(i,j)として算出する(S34)。以上のような対象画素Pijに対する明度のコントラスト調整量RL(i,j)の算出が入力画像内の全ての画素に対して対象補正情報導出手段51で行われる。抽出手段31では、明度のコントラスト調整量RL(i,j)の平均値aRLと標準偏差量dRLを求め(S36)、その値により明度のコントラスト調整量RL(i,j)より抽出される際の最小値eminと最大値emaxを決定する(S37)。対象信号変換手段52は、このemaxとeminを使って、明度のコントラスト調整量RL(i,j)を0.0から1.0の範囲内の値に変換し(S38)、その変換値を入力画像の最大値Lxと最小値Ln内に抑える処理を行う(S39)。信号逆変換手段53では、こうして得られた明度のコントラスト調整量RL(i,j)を対象画素Pijにおける明度のコントラスト調整値と見なすとともに、保持されていた色相a*(i,j)とb*(i,j)を使って、処理済み画像vの画素Pijにおける画素値VRPij(Rr(i,j),Rg(i,j),Rb(i,j))を信号変換手段50で用いた信号変換の逆変換により求めることで(S40)、コントラスト調整済み画像vを生成する(S40a)。なお、信号逆変換手段53において明度のコントラスト調整量RL(i,j)は0.0から1.0の範囲の値に変換されているため、1度色相a*(i,j)とb*(i,j)と合わせて逆変換する際の信号レベルに戻すことも必要になる。

In FIG. 16, first, VPij (r (i, j), g (i, j), b (i, j)) in the pixel Pij of the

このような一連の処理を取ることで、本実施例(実施の形態)である画像処理装置は、従来や実施例(実施の形態)1、2のようにカラー画像で3画素独立にコントラスト調整した場合に比べて、入力画像内の画素の持つ色バランスを保持しやすくなり、調整により得られた画像における影のような暗部での色の安定性をより保つことができる。さらに、対象補正情報導出手段51における対象画素と周辺視野内の画素との相対的比較で算出されるコントラスト調整量は、従来の技術や実施例(実施の形態)1、2では3成分独立に算出する必要があったのに対し、明度1成分ですむため、大幅な処理時間の短縮化につながる。また、これらの処理は、実施例(実施の形態)3による画像処理方法に従い、コンピュータ等に使用される中央演算処理装置(CPU)及びディジタルシグナルプロセッサ(DSP)等を使ったソフトウェア処理でも同様に実現することができる。 By taking such a series of processes, the image processing apparatus according to the present embodiment (embodiment) can adjust contrast independently for three pixels in a color image as in the prior art and embodiments (embodiments) 1 and 2. Compared to the case, it becomes easier to maintain the color balance of the pixels in the input image, and the stability of the color in a dark part such as a shadow in the image obtained by the adjustment can be further maintained. Further, the contrast adjustment amount calculated by the relative comparison between the target pixel in the target correction information deriving means 51 and the pixel in the peripheral visual field is independent of the three components in the conventional technique and the embodiments (embodiments) 1 and 2. Although it was necessary to calculate, only one component of brightness is required, leading to a significant reduction in processing time. These processes are also performed by software processing using a central processing unit (CPU) and a digital signal processor (DSP) used in a computer or the like according to the image processing method according to the third embodiment (embodiment). Can be realized.

本発明の実施例(実施の形態)4による画像処理装置の基本構成は実施例(実施の形態)1と同様、図1の構成である。また、画像処理手段11も図2(a)のようにコントラスト調整手段20が採用されている。その際、コントラスト調整手段20は図6のような構成になる。 The basic configuration of the image processing apparatus according to the embodiment (embodiment) 4 of the present invention is the same as that of the embodiment (embodiment) 1 as shown in FIG. The image processing means 11 also employs contrast adjustment means 20 as shown in FIG. At that time, the contrast adjusting means 20 is configured as shown in FIG.

図6は本実施例(実施の形態)による画像処理装置を構成するコントラスト調整手段20を示すブロック図である。図6において、信号変換手段50、補記設定手段40、対象補正情報導出手段51、補正範囲変更手段42、終了判定手段41、抽出手段31、対象信号変換手段52、信号逆変換手段53は図3〜図5と同様のものなので、同一符号を付し、説明は省略する。図6より明らかのように、実施例(実施の形態)2における複数の周辺視野を持つコントラスト調整処理に、実施例(実施の形態)3におけるコントラスト調整手段におけるコントラスト調整処理を対象信号のみに限定した工夫を加えたものである。 FIG. 6 is a block diagram showing the contrast adjusting means 20 constituting the image processing apparatus according to the present embodiment (embodiment). In FIG. 6, the signal conversion means 50, the supplementary note setting means 40, the target correction information derivation means 51, the correction range change means 42, the end determination means 41, the extraction means 31, the target signal conversion means 52, and the signal reverse conversion means 53 are shown in FIG. Since it is the same as that shown in FIG. As apparent from FIG. 6, the contrast adjustment processing in the contrast adjustment means in Example (Embodiment) 3 is limited to the target signal only in contrast adjustment processing having a plurality of peripheral visual fields in Example (Embodiment) 2. It is something that has been added.

図6のコントラスト調整手段20について、その動作を図17を用いて説明する。図17は図6のコントラスト調整手段20の動作を示すフローチャートである。

The operation of the

図17において、まず、画像入力手段10で入力された入力画像viの画素PijにおけるVPij(r(i,j),g(i,j),b(i,j))は信号変換手段50でLa*b*空間における信号VPLij(L(i,j),a*(i,j),b*(i,j))に変換され、Pijにおける変換値信号の内、色相a*(i,j)とb*(i,j)が保持され、L(i,j)は0.0から1.0に正規化される(S41)。対象補正情報導出手段51は、入力画像の画素Pijの明度L(i,j)の最大値Lxと最小値Lnを算出する(S42)。次に、対象補正情報導出手段51は、この明度L(i,j)を対象信号として、実施例(実施の形態)2と同様に、複数の周辺視野領域ck(k=0,1,・・・,Cnum−1)の加重平均明度AL_k(i,j)を求める(S43)。そして、終了判定手段41が、所定の周辺視野領域全部に対する加重平均明度の算出が終了したと判定した時点で(S44)、対象補正情報導出手段51は、それらの重みつき平均値が全加重平均明度AL(i,j)とされ(S45)、その値に対するL(i,j)の比を明度のコントラスト調整量RL(i,j)として算出する(S46)。終了判定手段41が全画素終了と判定すると(S47)、抽出手段31では、明度のコントラスト調整量RL(i,j)の平均値aRLと標準偏差量dRLが求められ(S48)、その値により決定された明度のコントラスト調整量RL(i,j)の最小値eminと最大値emaxを使って、明度のコントラスト調整量RL(i,j)は0.0から1.0の範囲内の値に変換される(S49、S50)。その変換値は、入力画像の最大値Lxと最小値Ln内に抑えられ、信号逆変換手段53では、こうして得られた明度のコントラスト調整量RL(i,j)を対象画素Pijにおける明度のコントラスト調整値と見なすとともに(S51)、保持されていた色相a*(i,j)とb*(i,j)を使って、処理済み画像3の画素Pijにおける画素値VRPij(Rr(i,j),Rg(i,j),Rb(i,j))を求めることで(S52)、コントラスト調整済み画像vを生成する(S53)。

In FIG. 17, first, VPij (r (i, j), g (i, j), b (i, j)) in the pixel Pij of the input image vi inputted by the image input means 10 is obtained by the signal conversion means 50. It is converted into a signal VPLij (L (i, j), a * (i, j), b * (i, j)) in the La * b * space, and the hue a * (i, j) and b * (i, j) are retained, and L (i, j) is normalized from 0.0 to 1.0 (S41). The target correction

以上のように本実施例(実施の形態)による画像処理装置は、実施例(実施の形態)3で対象画素値とその周辺領域における平均画素値との比較により算出したコントラスト調整量を複数の周辺領域でのコントラスト調整量の加重平均値に拡張したものであり、実施例(実施の形態)2の特徴である周辺視野領域を予め決定する必要がない利点と、実施例(実施の形態)3のように画素の持つ色バランスを保持しやすくなり、調整により得られた画像における影のような暗部での色の安定性をより保つことができる。また、処理の簡易化につながり処理時間の短縮化も可能となる利点を持つ。 As described above, the image processing apparatus according to the present embodiment (embodiment) uses a plurality of contrast adjustment amounts calculated by comparing the target pixel value with the average pixel value in the surrounding area in the embodiment (embodiment) 3. This is an extension to the weighted average value of the contrast adjustment amount in the peripheral area, and there is an advantage that it is not necessary to predetermine the peripheral visual field area, which is a feature of the embodiment (embodiment) 2, and the embodiment (embodiment). As shown in FIG. 3, the color balance of the pixels can be easily maintained, and the color stability in a dark portion such as a shadow in the image obtained by the adjustment can be further maintained. In addition, there is an advantage that processing is simplified and processing time can be shortened.

さらに、これらの処理は、実施例(実施の形態)4であるカラー画像処理方法に従い、コンピュータ等に使用される中央演算処理装置(CPU)及びディジタルシグナルプロセッサ(DSP)等を使ったソフトウェア処理でも同様に実現することができる。 Further, these processes are performed by software processing using a central processing unit (CPU) and a digital signal processor (DSP) used in a computer or the like according to the color image processing method according to the fourth embodiment (embodiment). It can be realized similarly.

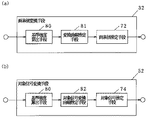

本発明の実施例(実施の形態)5による画像処理装置の基本構成は実施例(実施の形態)1と同様、図1の構成である。また、画像処理手段11も図2(a)のようにコントラスト調整手段20が採用され、さらにコントラスト調整手段20は図3のような構成になる。本実施例(実施の形態)が実施例(実施の形態)1と異なる点は、図3におけるコントラスト調整手段20内の画素値変換手段32が図7(a)のように構成されていることである。 The basic configuration of an image processing apparatus according to Example (Embodiment) 5 of the present invention is the same as that of Example (Embodiment) 1 as shown in FIG. Further, the image processing means 11 employs the contrast adjusting means 20 as shown in FIG. 2A, and the contrast adjusting means 20 has a configuration as shown in FIG. This embodiment (embodiment) is different from embodiment (embodiment) 1 in that the pixel value conversion means 32 in the contrast adjustment means 20 in FIG. 3 is configured as shown in FIG. It is.

図7(a)は、本実施例(実施の形態)による画素値変換手段32を示すブロック図である。図7(a)に示されるように、画素値変換手段32は、入力画像vi内の平均輝度を算出する平均輝度算出手段70と、平均輝度算出手段70で得られた平均輝度をもとに、抽出手段31で得られたコントラスト調整量を実際の画素値に変換する際の変換方式を選択する変換方式分類手段71と、変換方式分類手段71で得られた変換方式に従い、抽出手段31で得られたコントラスト調整量を実際の画素の持つ画素値に変換する画素値推定手段72とを構成要素として持つ。本実施例(実施の形態)の特徴は、実施例(実施の形態)1に、入力画像の輝度をもとに、周辺視野内の画素との相対的比較で得られた値を実際の画素値に変換する際の変換方式を選択するものである。

FIG. 7A is a block diagram showing the pixel value conversion means 32 according to the present embodiment (embodiment). As shown in FIG. 7A, the pixel

図3におけるコントラスト調整手段20において、画素値変換手段32以外の処理の流れは実施例(実施の形態)1と同様に、入力画像内の画素Pijにおいて、その画素値をc画素の周辺視野領域における加重平均画素値で除することで、まずコントラスト調整量を求める。そして、このコントラスト調整量から、有効となる領域が、コントラスト調整量を構成する各成分のヒストグラム分布をもとに抽出され、各成分ともに0.0から1.0内の値に変換される。この後で図12のステップS8のかわりに画素値変換手段32における画素値変換処理が実行されるのであるが、その処理は、図18のようになる。

In the

次に、図7(a)の画素値変換手段32について、その動作を図18を用いて説明する。図18は図7(a)の画素値変換手段32の動作を示すフローチャートである。 Next, the operation of the pixel value conversion means 32 in FIG. 7A will be described with reference to FIG. FIG. 18 is a flowchart showing the operation of the pixel value conversion means 32 in FIG.

図18において、まず、平均輝度算出手段70は、入力画像内の画素Pijの輝度y(i,j)を計算し、その輝度平均ave_yを求める(S61)。次に、変換方式分類手段71は、このave_yの値でコントラスト調整量が実際の画素値に変換される方式を選択する。その場合、多くの手法が考えられるが、ここでは低輝度しきい値Th_lowと高輝度しきい値Th_highを設け、(数8)のようにコントラスト調整量を実際の画素値成分に変換する際の変換関数gg(x)を選択することとした(S62〜S66)。

In FIG. 18, first, the average luminance calculating means 70 calculates the luminance y (i, j) of the pixel Pij in the input image and obtains the average luminance ave_y (S61). Next, the conversion

なお、(数8)でk_l,g_l,g_n,k_h,g_hは予め設定された定数であり、Xは変換される前のコントラスト調整量の対象成分値を示す。これは、処理前の入力画像における平均輝度をもとに、その重点すべき部分を決めるものである。例えば、入力画像全体が低い輝度の場合、全体が急激に明るくなるよりも低輝度部分をできるだけ残す方が立体感の観点からも印象がよい。また、入力画像全体が高い輝度の場合、高輝度部分に対する人間の注目度は高く、その部分をできるだけ保持することも必要である。そして、自然画像のように中間輝度を持つ場合は、中心より低い輝度部分をやや暗くし、中心より高い輝度をやや明るくする手法がプリンタ出力等の時の入出力値のガンマ変換で行われる。ここでの処理はこれらの知見に従ったものであり、このような知見に沿う変換方式であれば、ここで示す方式に一律に決まるものではなく同様に使用することができると思われる。最後に、画素値推定手段72が変換方式分類手段71で選択された変換関数を使って、抽出手段31で抽出されたコントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))の各成分の変換値VRPoij(Rro(i,j),Rgo(i,j),Rbo(i,j))を求める(S67、S68)。これを、入力画像内における画素Pijの各成分の最大値Vmax(rx,gx,bx)と最小値Vmin(rn,gn,bn)内に抑え、処理済み画像vの画素Pijにおける調整済み画素値として設定することで処理済画像vを得るのである(S69、S70)。この画像vと入力画像viの加重平均画像を画像合成手段12が求め、これが最終的に出力される出力画像voとなる。

In

以上のように実施例(実施の形態)5による画像処理装置は、実施例(実施の形態)1の画素値変換手段32において、周囲画素との比較で得られたコントラスト調整量から有効と思われる領域を抽出した後に、入力画像における平均輝度をもとに、抽出されたコントラスト調整量を変換する変換方式を選択し適用する画素値推定手段72を設けたものである。こうすることで、入力画像内の輝度分布に応じて適切な画素値変換を選択することが可能となり、より調整後の画像におけるコントラスト調整を高めることが可能となる。

As described above, the image processing apparatus according to Example (Embodiment) 5 seems to be effective from the contrast adjustment amount obtained by comparison with surrounding pixels in the pixel

なお、この実施例(実施の形態)ではコントラスト調整手段として実施例(実施の形態)1で説明した図3の構成の場合で説明したが、図4のように複数の周辺視野領域を持つ実施例(実施の形態)2で用いられたコントラスト調整手段に本実施例(実施の形態)における画素値変換手段を組み合わせることも可能である。さらに、これらの処理は、実施例(実施の形態)5による画像処理方法に従い、コンピュータ等に使用される中央演算処理装置(CPU)及びディジタルシグナルプロセッサ(DSP)等を使ったソフトウェア処理でも同様に実現することができる。 In this embodiment (embodiment), the contrast adjusting means is described in the case of the configuration of FIG. 3 described in embodiment (embodiment) 1. However, as shown in FIG. It is also possible to combine the pixel value conversion means in this example (embodiment) with the contrast adjustment means used in Example (embodiment) 2. Further, these processes are also performed by software processing using a central processing unit (CPU) and a digital signal processor (DSP) used in a computer or the like according to the image processing method according to the embodiment (embodiment) 5. Can be realized.

本発明の実施例(実施の形態)6による画像処理装置の基本構成は実施例(実施の形態)1と同様、図1の構成である。画像処理手段11として設定されたコントラスト調整手段は図5のような構成になる。実施例(実施の形態)6が実施例(実施の形態)3と異なる点は、図5におけるコントラスト調整手段20内の対象信号変換手段52が図7(b)のように構成されていることである。 The basic configuration of an image processing apparatus according to Example (Embodiment) 6 of the present invention is the same as that of Example (Embodiment) 1 as shown in FIG. The contrast adjusting means set as the image processing means 11 has a configuration as shown in FIG. The difference between Example (Embodiment) 6 and Example (Embodiment) 3 is that target signal conversion means 52 in contrast adjustment means 20 in FIG. 5 is configured as shown in FIG. 7B. It is.

図7(b)は、図5の対象信号変換手段52を示すブロック図である。 FIG. 7B is a block diagram showing the target signal conversion means 52 of FIG.

図7(b)に示されるように、対象信号変換手段52は、入力画像vi内の平対象信号の平均値を算出する平均対象信号算出手段73と、平均対象信号算出手段73で得られた対象信号の平均値をもとに、抽出手段31で得られた対象信号のコントラスト調整量を実際の対象信号値に変換する際の変換方式を選択する変換方式分類手段71と、変換方式分類手段71で得られた変換方式に従い、抽出手段31で得られた対象信号のコントラスト調整量を実際の対象信号値に変換する対象信号推定手段74とを構成要素として持つ。この実施例(実施の形態)の特徴は、実施例(実施の形態)3に、入力画像の対象信号をもとに、周辺視野内の対象信号との相対的比較で得られた値を実際の対象信号値に変換する際の変換方式を選択するものである。

As shown in FIG. 7B, the target

本実施例(実施の形態)におけるコントラスト調整処理の流れは、実施例(実施の形態)3を表す図16とほぼ同じように処理される。実施例(実施の形態)3と比べると図16のステップS40のかわりに図7(b)の対象信号変換手段74の処理が付加されていることが異なる。この図7(b)における対象信号変換手段74での処理は、実施例(実施の形態)5で用いられた図7(a)の画素値変換手段32での処理を対象信号である明度に対して行うように変更したものが行われる。つまり、図18で示された実施例(実施の形態)5の画素値変換処理に対して、本実施例(実施の形態)では対象信号に対してのみ変換関数が適用される点と、抽出手段31で抽出されたコントラスト調整量の変換方式の選択に実施例(実施の形態)5では入力画像の平均輝度を用いたが、本実施例(実施の形態)では信号変換手段50で入力画像より得られた明度、色相のうちで対象信号とされた明度の平均値が用いられている点が異なる。このように対象信号の平均値が抽出手段31で抽出されたコントラスト調整量の変換方式の選択に使用されている理由として、元々実施例(実施の形態)3では、コントラスト調整量の算出は信号変換手段50で得られた明度に対してのみ行われ、対象信号変換手段52を介して得られた調整後の画素(i,j)の明度RL(i,j)と信号変換手段50で得られた色相を逆変換することで所望のコントラスト調整済み画像vを得ているため、処理の簡易化の点から、そして明度が輝度と同じような意味を持つ点が挙げられる。

The flow of contrast adjustment processing in the present embodiment (embodiment) is processed in substantially the same manner as in FIG. 16 representing the embodiment (embodiment) 3. Compared to Example (Embodiment) 3, the processing of the target signal conversion means 74 of FIG. 7B is added instead of step S40 of FIG. The processing in the target signal conversion means 74 in FIG. 7B is performed by changing the processing in the pixel value conversion means 32 in FIG. 7A used in the embodiment (embodiment) 5 to the lightness that is the target signal. What has been changed to be performed on is performed. That is, in contrast to the pixel value conversion processing of Example 5 (Embodiment) 5 shown in FIG. 18, the conversion function is applied only to the target signal in this Example (Embodiment), and extraction is performed. In the embodiment (embodiment) 5, the average luminance of the input image is used to select the conversion method of the contrast adjustment amount extracted by the

このような本実施例(実施の形態)による画像処理装置は、実施例(実施の形態)3の対象信号変換手段50において、周囲画素との比較で得られた明度のコントラスト調整量から有効と思われる領域を抽出した後に、入力画像における平均明度をもとに、抽出された対象信号のコントラスト調整量を変換する変換方式を選択し適用するものである。よって、本実施例(実施の形態)は実施例(実施の形態)3のように画素の色安定を高めるとともに、実施例(実施の形態)5におけるコントラストのより高精度化を進めるためのものである。 Such an image processing apparatus according to the present embodiment (embodiment) is effective from the contrast adjustment amount of brightness obtained by comparison with surrounding pixels in the target signal conversion means 50 of the embodiment (embodiment) 3. After extracting a possible region, a conversion method for converting the contrast adjustment amount of the extracted target signal is selected and applied based on the average brightness in the input image. Therefore, the present embodiment (embodiment) is for improving the color stability of the pixel as in the embodiment (embodiment) 3 and further improving the accuracy of the contrast in the embodiment (embodiment) 5. It is.

なお、本実施例(実施の形態)では、コントラスト調整手段20として実施例(実施の形態)3で説明した図5の構成の場合で説明したが、図6のように複数の周辺視野領域を持つ実施例(実施の形態)4で用いられたコントラスト調整手段20に本実施例(実施の形態)における対象信号変換手段52を組み合わせることも可能である。さらに、これらの処理は、本実施例(実施の形態)による画像処理方法に従い、コンピュータ等に使用される中央演算処理装置(CPU)及びディジタルシグナルプロセッサ(DSP)等を使ったソフトウェア処理でも同様に実現することができる。 In the present embodiment (embodiment), the contrast adjusting means 20 has been described in the case of the configuration of FIG. 5 described in the embodiment (embodiment) 3. However, as shown in FIG. It is also possible to combine the target signal conversion means 52 in the present embodiment (embodiment) with the contrast adjustment means 20 used in the embodiment 4 (embodiment). Further, these processes are also performed by software processing using a central processing unit (CPU) and a digital signal processor (DSP) used in a computer or the like according to the image processing method according to the present embodiment (embodiment). Can be realized.

本発明の実施例(実施の形態)7による基本的構成は実施例(実施の形態)1と同様、図1の構成である。画像処理手段11であるコントラスト調整手段20は図3のような構成になる。図3のようにコントラスト調整手段21は補正情報導出手段30、抽出手段31、画素値変換手段32より構成されている。

The basic configuration according to the embodiment (embodiment) 7 of the present invention is the configuration shown in FIG. The contrast adjusting means 20 which is the image processing means 11 has a configuration as shown in FIG. As shown in FIG. 3, the contrast adjusting unit 21 includes a correction

図8(a)は画像変換手段32を示すブロック図である。画像変換手段32は図8(a)のように、入力画像vi内のコントラスト情報を表す輝度エッジ強度を算出する基準強度算出手段80と、抽出手段31で得られたコントラスト調整量を実際の画素値に変換する際の変換曲線を遺伝的アルゴリズムで推定する変換曲線推定手段81と、変換曲線推定手段81で推定された画素値の変換曲線をもとに、抽出手段31で得られたコントラスト調整量を実際の画素値に変換する画素値推定手段72とを構成要素として持つ。

FIG. 8A is a block diagram showing the image conversion means 32. As shown in FIG. 8A, the image conversion means 32 uses the reference intensity calculation means 80 for calculating the luminance edge intensity representing the contrast information in the input image vi, and the contrast adjustment amount obtained by the extraction means 31 as the actual pixel. A conversion curve estimation means 81 for estimating a conversion curve at the time of conversion into a value by a genetic algorithm, and a contrast adjustment obtained by the extraction means 31 based on the conversion curve of the pixel value estimated by the conversion curve estimation means 81 A pixel

図9(a)は、遺伝的アルゴリズム推定のために用意された変換曲線推定手段81を示すブロック図である。図9(a)のように、変換曲線推定手段81は、推定を行う際に必要な初期条件および複数の変換曲線を示す染色体集合を用意する初期候補設定手段90と、各染色体より得られる変換曲線をもとに実際の画素値を求める画素値変換候補算出手段91と、画素値変換候補算出手段91で得られた各染色からの画素値を使って各染色体で生成される画像の輝度エッジ強度と入力画像より得られた輝度エッジ強度より、各変換曲線の評価値を算出する評価値算出手段92と、評価値算出手段92で得られた評価値より各染色体の適合度を計算する適合度計算手段93と、適合度計算手段93で得られた各染色体集合の選択的淘汰、交叉や突然変異の組替え操作を行い次の染色体集団を生成する組替え操作手段94と、変換曲線の最適化推定が終了したかどうかの判定を行い、終了した時点には最適な変換曲線を次の画素値推定手段72に渡す推定終了判定手段95とを構成要素として持つ。

FIG. 9A is a block diagram showing a conversion curve estimation means 81 prepared for genetic algorithm estimation. As shown in FIG. 9A, the conversion curve estimation means 81 includes initial candidate setting means 90 for preparing a chromosome set indicating a plurality of conversion curves and initial conditions necessary for estimation, and conversion obtained from each chromosome. A pixel value conversion

本実施例(実施の形態)の特徴は、実施例(実施の形態)1で得られた周辺視野内の対象信号との相対的比較で得られた値を実際の画素値に変換する際に、遺伝的アルゴリズムを使ってコントラスト調整量で得られた画像のエッジ部分をさらにシャープにするような工夫を加えたものであり、実施例(実施の形態)5が入力画像の平均輝度で予め用意された複数の変換方式(変換関数)より選択するようにしたのに比べ、より適切な変換関数を自動的に推定することができるため、予め平均輝度を分類する際の条件設定や複数の変換関数を選定する必要がなく、入力画像に対する依存性が非常に小さいという利点を持つ。 The feature of the present embodiment (embodiment) is that the value obtained by relative comparison with the target signal in the peripheral visual field obtained in embodiment (embodiment) 1 is converted into an actual pixel value. The image is obtained by further improving the sharpness of the edge portion of the image obtained using the genetic algorithm with the contrast adjustment amount. Example 5 is prepared in advance with the average luminance of the input image. Compared to selecting from a plurality of conversion methods (conversion functions), it is possible to automatically estimate a more appropriate conversion function, so it is possible to set conditions for classifying the average luminance in advance and multiple conversions There is no need to select a function, and there is an advantage that the dependence on the input image is very small.

本実施例(実施の形態)における処理の流れにおいて、画像入力手段10、画像合成手段12、画像出力手段13については実施例(実施の形態)1と同様であるので省略する。 In the flow of processing in the present embodiment (embodiment), the image input means 10, the image composition means 12, and the image output means 13 are the same as those in the embodiment (embodiment) 1 and will not be described.

図19は、画像処理手段11であるコントラスト調整手段20での処理の流れを示すフローチャートであり、図20は、コントラスト調整処理における変換曲線推定手段81の処理の流れを示すフローチャートである。これらの図に従い、本実施例(実施の形態)におけるコントラスト調整処理を示す。

FIG. 19 is a flowchart showing a process flow in the

図19において、まず、補正情報算出手段30は、入力画像内における画素Pijの各成分の最大値Vmax(rx,gx,bx)と最小値Vmin(rn,gn,bn)を算出する(S71)。次に、対象画素Pijの画素値VPijをLandにおける中心視野と見なし、その周囲にc画素の矩形領域に属する領域を周辺視野と見なす。そして、補正情報算出手段30は、周辺視野における画素値の加重平均画素値VAPij(Ar(i,j),Ag(i,j),Ab(i,j))を求めるとともに(S72)、このVAPijとVPijの間の相対的関係につながるコントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))を算出する(S73)。このVAPijとして、実施例(実施の形態)1と同様に従来の技術のように、c画素の周辺視野内における画素値Vpij(r(i,j),g(i,j),b(i,j))の平均値を定義し、コントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))も(数5)のように各成分ごとの画素値VPijの加重平均画素値VAPijに対する比を定義することとした。 In FIG. 19, first, the correction information calculation means 30 calculates the maximum value Vmax (rx, gx, bx) and the minimum value Vmin (rn, gn, bn) of each component of the pixel Pij in the input image (S71). . Next, the pixel value VPij of the target pixel Pij is regarded as a central visual field in Land, and a region belonging to a rectangular region of c pixels around it is regarded as a peripheral visual field. Then, the correction information calculation means 30 obtains a weighted average pixel value VAPij (Ar (i, j), Ag (i, j), Ab (i, j)) of the pixel value in the peripheral visual field (S72). A contrast adjustment amount VRPij (Rr (i, j), Rg (i, j), Rb (i, j)) that leads to a relative relationship between VAPij and VPij is calculated (S73). As VAPij, as in the prior art (embodiment) 1, as in the prior art, pixel values Vpij (r (i, j), g (i, j), b (i , J)), and the contrast adjustment amount VRPij (Rr (i, j), Rg (i, j), Rb (i, j)) is a pixel for each component as shown in (Equation 5). The ratio of the value VPij to the weighted average pixel value VAPij is defined.

以上のような対象画素Pijに対するコントラスト調整量VRPijの算出を入力画像内の全ての画像に対して行う(S74)。その後、抽出手段31は、コントラスト調整量VRPijの成分ごとの平均値VaR(aRr,aRg,aRb)と標準偏差量VdR(dRr,dRg,dRb)よりコントラスト調整量VRPijより抽出される際の最小値eminと最大値emaxを導出し、このemaxとeminを使って、コントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))の各成分を0.0から1.0の範囲内の値に変換する(S75〜S77)。ここまでは実施例(実施の形態)1と同様である。この後に、抽出されたコントラスト調整量の変換曲線推定処理S78、S79が図20のように遺伝的アルゴリズムを使って行われる。

The calculation of the contrast adjustment amount VRPij for the target pixel Pij as described above is performed for all images in the input image (S74). Thereafter, the

変換曲線推定手段81は初期候補設定手段90から推定終了判定手段95で構成されており、その間における処理は、遺伝的アルゴリズムと呼ばれる最適解探索手法に局所探索能力を補った手法に該当する。遺伝的アルゴリズムについては、例えば“Genetic Algorithms in Search,Optimization and Machine Learning”(David E.Goldberg,Addison Wesley)等の文献に記載されており、大域的探索能力に優れ、最適解探索問題の対象とする評価関数の微分情報が得られなくとも、その評価値自身が得られれば、探索を行うことができ、人間の主観的評価しか判断基準のない対象問題へも適用が可能でありかつその有効性はこれまでに報告されている手法である。具体的には次のように処理が進められる。処理は、図21〜図23を用いて、ステージ毎に説明する。図21は変換曲線推定手段81における遺伝的アルゴリズムで使用される染色体構造を模式的に示す模式図であり、図22は変換曲線推定手段81におけるルーレット選択法の概要を模式的に示す模式図、図23は変換曲線推定手段81で使用されている遺伝的アルゴリズムの組替え操作処理を模式的に示す模式図である。

The conversion

{ステップS81〜ステップS83}

まず、図21におけるg0からgn−1を探索パラメータとして、そのn個のパラメータにより構成される探索ベクトルVch[A]を元として、Nch個の元からなる集合Gvを考える。この探索ベクトルVch[A]の各要素g−k[A](k=0,・・・,n−1)は、生物との関連から遺伝子と呼ばれ、探索ベクトルVch[A]は染色体と呼ばれる。遺伝的アルゴリズムを用いる際、まず最初に、この探索ベクトルの初期集合Gvを適当に作る処理を初期候補設定手段90が行う。初期候補設定手段90において、染色体の設定方法として様々な方法が考えられるが、ここでは図21のように0.0から1.0の範囲に存在する変換前のコントラスト調整量i−kに対して、その変換出力量o−kを0.0から1.0の範囲の値に変換するとして変換曲線を設定する。そして、g−k=o,k−o,k−1から得られるn個のg−kをそのままならべた実数コーディング手法を用いて探索ベクトルの染色体表記を行うこととした。g−0はg−0=o−0とする。この表記は、つまり、0.0から1.0における変換曲線をn個のデータに量子化し、各量子化で得られる値を遺伝的アルゴリズムで推定する探索パラメータとしたのである。しかし、変換曲線の探索パラメータの変換は一義的に決まるものではなく、これ以外にも可能である。また、ここで使用した染色体構造においても、各g−kを2進数表示してその2進数を並べるバイナリーコーディング手法も扱うことはできる。

{Step S81 to Step S83}

First, consider a set Gv consisting of Nch elements based on the search vector Vch [A] composed of the n parameters with g0 to gn-1 in FIG. 21 as search parameters. Each element g−k [A] (k = 0,..., N−1) of the search vector Vch [A] is called a gene because of the relationship with the organism, and the search vector Vch [A] be called. When using the genetic algorithm, first, the initial candidate setting means 90 performs a process for appropriately generating the initial set Gv of search vectors. In the initial candidate setting means 90, various methods are conceivable as chromosome setting methods. Here, for the contrast adjustment amount ik before conversion existing in the range of 0.0 to 1.0 as shown in FIG. Then, a conversion curve is set on the assumption that the converted output amount ok is converted to a value in the range of 0.0 to 1.0. Then, the chromosome notation of the search vector is performed using a real number coding method in which n pieces of g-k obtained from g-k = o, k-o, k-1 are used as they are. g-0 is assumed to be g-0 = o-0. That is, the conversion curve from 0.0 to 1.0 is quantized into n pieces of data, and the value obtained by each quantization is used as a search parameter that is estimated by a genetic algorithm. However, conversion of the search parameter for the conversion curve is not uniquely determined, and other conversion is possible. In addition, the chromosomal structure used here can also handle a binary coding method in which each gk is displayed in binary and the binary numbers are arranged.

初期候補設定手段90ではまず、一様乱数により−1から1の領域内よりランダムに実数をn個選択することで1つの初期探索ベクトルvが設定される。これを予め設定された染色体集合数Nch個用意することで初期探索ベクトル集合Gv={Vch[A]}(A=0,・・・,Nch−1)が設定される。この初期探索ベクトル集合Gvより最適解探索が開始されるのである。そして、各探索ベクトルVch[A]の評価のために、入力画像1の全画素Pijにおける輝度y(i,j)、色差u(i,j),v(i,j)を計算する。そして、この輝度より入力画像のエッジ強度Ecを求める。このEcは(数9)のように定義されているものであり、Sobelオペレータにより算出された画素Pijにおけるエッジ強度ec(i,j)の総和として定義されている。

Initial candidate setting means 90 first sets one initial search vector v by randomly selecting n real numbers from within a range of −1 to 1 using uniform random numbers. By preparing Nch number of preset chromosome sets, an initial search vector set Gv = {Vch [A]} (A = 0,..., Nch−1) is set. The optimum solution search is started from the initial search vector set Gv. Then, in order to evaluate each search vector Vch [A], the luminance y (i, j) and color differences u (i, j), v (i, j) in all the pixels Pij of the

{ステップS84}

集合Gvの各元(染色体)より得られる変換曲線を使って、各探索ベクトルVch[A]により、抽出手段で得られたコントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))をVRPoij[A](Rro(i,j,A),Rgo(i,j,A),Rbo(i,j,A))に出力変換する。そして、この値より調整輝度値yo(i,j,A)を計算する。そして、この調整輝度より調整済み画像v候補のエッジ強度E[A]を求める。このE[A]はEcと同様に(数9)により求められる。これらの処理を画素値変換候補手段91が行う。

{Step S84}

Using the conversion curve obtained from each element (chromosome) of the set Gv, the contrast adjustment amounts VRPij (Rr (i, j), Rg (i, j) obtained by the extraction means using each search vector Vch [A]. , Rb (i, j)) is output to VRPoij [A] (Rro (i, j, A), Rgo (i, j, A), Rbo (i, j, A)). Then, the adjusted luminance value yo (i, j, A) is calculated from this value. Then, the edge intensity E [A] of the adjusted image v candidate is obtained from the adjusted luminance. This E [A] is obtained by (Equation 9) similarly to Ec. These processes are performed by the pixel value conversion candidate means 91.

{ステップS84}

前ステップで得られた各探索ベクトルVch[A]の解としての良さを予め設定された評価尺度に従って評価し、探索ベクトルVch[A]の評価結果を評価値E[A]として表す。ここで、予め設定された評価尺度のことを評価関数(fitness関数)と呼ぶ。この処理を評価値導出手段92が行う。この評価関数E[A]として多くのものが考えられるが、(数9)のように、各探索ベクトルで得られた調整済み画像v候補のエッジ強度を使用した。これは、視覚的にコントラストが良好と感じる画像は、明暗がはっきりしているだけでなく、画像のエッジ部分が鮮明であることに注目したためである。

{Step S84}

The goodness as a solution of each search vector Vch [A] obtained in the previous step is evaluated according to a preset evaluation scale, and the evaluation result of the search vector Vch [A] is expressed as an evaluation value E [A]. Here, the evaluation scale set in advance is referred to as an evaluation function (fitness function). This process is performed by the evaluation

{ステップS85、ステップS86}

適応度計算手段93では、評価値導出手段92で求められる評価値E[A]から、各探索ベクトルの適合性を見るために適合度が計算される。適合度f[A]を導出する関数として様々な関数が考えられるが、各探索ベクトルで得られた調整済み画像v候補のエッジ強度E[A]に調整済み画像v候補の各画素における輝度yo(i,j,A)の最大値yox[A]と最小値yon[A]間の距離に関する第2項を加算した値を入力画像のエッジ強度Ecで除した値を適合度f[A]として使用した。ここでφは定数である。

{Step S85, Step S86}

In the fitness calculation means 93, fitness is calculated from the evaluation value E [A] obtained by the evaluation value deriving means 92 in order to see the fitness of each search vector. Various functions are conceivable as functions for deriving the fitness f [A]. The brightness yo at each pixel of the adjusted image v candidate is added to the edge intensity E [A] of the adjusted image v candidate obtained by each search vector. A value obtained by dividing the value obtained by adding the second term relating to the distance between the maximum value yox [A] and the minimum value yon [A] of (i, j, A) by the edge strength Ec of the input image is the fitness f [A]. Used as. Here, φ is a constant.

このf[A]が大きな値ほどよい探索ベクトル、つまり変換曲線と判断される。なお、第2項は、エッジ強度の向上だけでなく、できるだけ多くの変換出力領域を持つようにしたものである。 A larger value of f [A] is determined as a better search vector, that is, a conversion curve. The second term not only improves the edge strength, but also has as many conversion output regions as possible.

{ステップS87〜ステップS90}

ステップS86により選択された探索ベクトル集合について、交叉や突然変異等の遺伝的な組み替え操作を施し、新しい探索ベクトル集合を作成する。なお、探索ベクトル集合に含まれる探索ベクトルの個体数Nchは、ここでは一定としたが、増加しても減少してもよい。この処理を組替え操作手段94が行う。ここでは、図適合度に比例する確率で探索ベクトルを選択するルーレット選択法により選択的淘汰を行う。ルーレット選択法の概要は次の通りである。

{Step S87 to Step S90}

The search vector set selected in step S86 is subjected to genetic recombination operations such as crossover and mutation to create a new search vector set. The number Nch of search vectors included in the search vector set is constant here, but may increase or decrease. This process is performed by the rearrangement operation means 94. Here, selective selection is performed by a roulette selection method in which a search vector is selected with a probability proportional to the figure matching degree. The outline of the roulette selection method is as follows.

{ルーレット選択法}

(i)集合Gvに属する探索ベクトルVch[A](A=0,・・・,Nch−1)の適合度f[A]、全探索ベクトルの適合度の総和Fを求める。

{Roulette selection method}

(I) The fitness f [A] of the search vector Vch [A] (A = 0,..., Nch−1) belonging to the set Gv and the sum F of the fitness of all search vectors are obtained.

(ii)Vch[A]が次世代の探索ベクトルを作り出す親として選ばれる選択確率h[k]を図22(a)のように決める。この確率を探索ベクトルVch[A]に割り当てるためには例えば次のような方法が考えられる。 (Ii) The selection probability h [k] that is selected as a parent for generating the next generation search vector by Vch [A] is determined as shown in FIG. In order to assign this probability to the search vector Vch [A], for example, the following method can be considered.

(iii)各探索ベクトルの選択範囲I[A]を[0,1]内の区間に図22(b)のように割り当てる。ここで、[0,1]内に一様乱数ra[A]の組RR=(ra[0],ra[1],・・・・,ra[Nch−1])を発生させる。そして図22(d)のようにRR内のra[B]に対して(数11)を満足するnum[B]=I[A]の組Num=(num[0],num[1],・・・,num[Nch−1])を求めることにより、このNumに対応するNch個の探索ベクトルの組が選択されることになる。 (Iii) The selection range I [A] of each search vector is assigned to the interval in [0, 1] as shown in FIG. Here, a set RR = (ra [0], ra [1],..., Ra [Nch-1]) of uniform random numbers ra [A] is generated in [0, 1]. Then, as shown in FIG. 22D, a set of num [B] = I [A] satisfying (Expression 11) for ra [B] in the RR Num = (num [0], num [1], .., Num [Nch-1]), a set of Nch search vectors corresponding to this Num is selected.

このようなルーレット選択法により、現在の探索ベクトル集団Gvの中の探索ベクトルVch[A]の選択を行うのである。 By such a roulette selection method, the search vector Vch [A] in the current search vector group Gv is selected.

次に、このようにして得られた新しい探索ベクトル集団Gvに対して、図23で示されるような交叉処理と突然変異処理を行う。交叉は、図23(a)に示されるように有限のシンボルで表現された探索ベクトルでの一部を他の調整ベクトルの一部と置き換えることにより新しい探索ベクトルを作り出す操作である。また、突然変異は、図23(b)に示されるようにある低い確率で探索ベクトル集合から選択された探索ベクトルの成分の一部を他のシンボルに変更する操作である。交叉処理は、現在の解ベクトルから大きく離れた位置における探索に相当し、突然変異は現在の探索ベクトル近傍における探索に相当する。この2つの処理を経て、遺伝的アルゴリズムでは新しい探索ベクトルの集合を作り出すのである。なお、この交叉、突然変異等の処理には様々な方法が提案されているが、本実施例(実施の形態)では図23のような1点交叉もしくは2点を入れ替える2点交叉処理を用いる。さらに突然変異としては、交叉処理を経て得られた新しい探索ベクトル集団Gvに対して探索ベクトルを構成する各遺伝子(g−k)を低い確率で選び出し、ランダム定数を付加することで突然変異処理を実行するのである。その際、突然変異を行う確率は、探索ベクトル集団の半分と残り半分では変動させることにより、より探索ベクトルの多様性に維持することに努めた。 Next, crossover processing and mutation processing as shown in FIG. 23 are performed on the new search vector group Gv thus obtained. Crossover is an operation of creating a new search vector by replacing a part of the search vector represented by a finite symbol with a part of another adjustment vector as shown in FIG. Further, the mutation is an operation of changing a part of the component of the search vector selected from the search vector set to another symbol with a certain low probability as shown in FIG. Crossover processing corresponds to a search at a position far away from the current solution vector, and mutation corresponds to a search in the vicinity of the current search vector. Through these two processes, the genetic algorithm creates a new set of search vectors. Various methods have been proposed for processing such as crossover and mutation. In this embodiment (embodiment), one-point crossover or two-point crossover that replaces two points as shown in FIG. 23 is used. . Further, as a mutation, a mutation is performed by selecting each gene (g−k) constituting the search vector with a low probability from the new search vector group Gv obtained through the crossover process, and adding a random constant. Do it. At that time, we tried to maintain the diversity of search vectors by changing the probability of mutation in the half and the other half of the search vector group.

これらの遺伝的アルゴリズムによる変換曲線をあらわす探索ベクトルの最適化処理の収束条件として繰り返し回数が許容繰り返し回数をこえていないかどうかを判断し、超えていない場合にはもう一度画素値変換候補算出手段91へ処理が移る。以上のような処理過程を収束条件を満足するまで繰り返し実行することにより、最適な変換曲線を構成する探索パラメータの推定を行うのである。このように、大域的に多くの候補を用意し、局所的最適解(ローカルミニマム)にトラップざれにくい交叉や突然変異等の記号的な組み替え操作を繰り返し行うことで、精度よくかつ自動的に抽出手段31で得られたコントラスト調整量を変換する最適な変換曲線を推定することが可能となる。

It is determined whether or not the number of iterations exceeds the allowable number of iterations as a convergence condition for the search vector optimization process that represents the transformation curve by these genetic algorithms. The process moves to. By repeatedly executing the above processing steps until the convergence condition is satisfied, the search parameters constituting the optimum conversion curve are estimated. In this way, a large number of candidates are prepared globally, and extracted accurately and automatically by repeatedly performing symbolic recombination operations such as crossover and mutation that are difficult to trap in the local optimal solution (local minimum). It is possible to estimate an optimal conversion curve for converting the contrast adjustment amount obtained by the

以上のようにして得られた変換曲線を用いて、画素値推定手段72が、抽出されたコントラスト調整量VRPij(Rr(i,j),Rg(i,j),Rb(i,j))をVRPoij(Rro(i,j),Rgo(i,j),Rbo(i,j))に変換するとともに、入力画像内における画素Pijの各成分の最大値Vmax(rx,gx,bx)と最小値Vmin(rn,gn,bn)内に抑える処理を行う。ここで得られたVRPoij(Rro(i,j),Rgo(i,j),Rbo(i,j))が処理済画像3の画素Pijにおける画素値として生成される。

Using the conversion curve obtained as described above, the pixel

以上のように本実施例(実施の形態)による画像処理装置は、実施例(実施の形態)1の画素値変換手段32において、周囲画素との比較で得られたコントラスト調整量より有効と思われる領域を抽出した後に、入力画像の輝度より得られるエッジ強度の総和を計算する。次に、抽出されたコントラスト調整量を変換する際の変換曲線を複数候補用意し、各変換曲線より得られた最終出力候補画像の輝度のエッジ強度総和を計算し、その値の入力画像のエッジ強度総和に対する比を評価値として最適な変換曲線を遺伝的アルゴリズムで推定する変換曲線推定手段81を設けたものである。このように、抽出されたコントラスト調整量を変換する際の変換関数を推定する際に、細部の明瞭度に関連するエッジ強度の改善度合いを評価値に設けることで、よりコントラストを高めることができるとともにエッジのシャープ化にもつながる。また、そのような最適な変換関数の推定に遺伝的アルゴリズムを用いることで、入力画像に依存せず自動的に適切な変換関数を推定することができる。

As described above, the image processing apparatus according to the present embodiment (embodiment) seems to be more effective than the contrast adjustment amount obtained by comparison with the surrounding pixels in the pixel

なお、本実施例(実施の形態)ではコントラスト調整手段20として実施例(実施の形態)1で説明した図3の構成の場合で説明したが、図4のように複数の周辺視野領域を持つ実施例(実施の形態)2で用いられたコントラスト調整手段20に本実施例(実施の形態)における画素値変換手段32を組み合わせることも可能である。また、これらの処理は、本実施例(実施の形態)による画像処理方法に従い、コンピュータ等に使用される中央演算処理装置(CPU)及びディジタルシグナルプロセッサ(DSP)等を使ったソフトウェア処理でも同様に実現することができる。 In the present embodiment (embodiment), the contrast adjusting means 20 has been described in the case of the configuration of FIG. 3 described in the embodiment (embodiment) 1. However, as shown in FIG. It is also possible to combine the pixel value converting means 32 in the present embodiment (embodiment) with the contrast adjusting means 20 used in the embodiment (embodiment) 2. These processes are also performed by software processing using a central processing unit (CPU) and a digital signal processor (DSP) used in a computer or the like according to the image processing method according to the present embodiment (embodiment). Can be realized.